Leerpad

NVIDIA Nemotron-3 is NVIDIA’s nieuwe open modelfamilie voor redeneren, coderen, chat en agent-gebaseerde AI-workflows. De familie omvat verschillende modelgroottes, zoals Nano, Super en Ultra, zodat ontwikkelaars kunnen kiezen tussen kleinere, efficiënte modellen en grotere, high-performance modellen.

De belangrijkste vernieuwing in Nemotron-3 is de focus op efficiëntie. De modellen zijn ontworpen om sterke prestaties te leveren, terwijl inferentie en fine-tuning praktischer blijven. De Nano-versie is vooral handig voor hands-on experimenten, omdat die werkt op toegankelijkere GPU-sets dan de grotere modellen.

In deze gids gaan we NVIDIA Nemotron-3-Nano-4B fijnstemmen op een psychologie-vraag-en-antwoord-dataset. We gebruiken Low-Rank Adaptation (LoRA), Transformers Reinforcement Learning (TRL) en Hugging Face om de data voor te bereiden, het model te trainen, de adapter op te slaan, naar Hugging Face te pushen en de antwoorden vóór en na fine-tuning te vergelijken.

Wil je aan de slag met het vinden van de nieuwste open-source AI-modellen, AI-agents bouwen en LLM’s fijnstemmen? Schrijf je dan in voor onze skill track Hugging Face Fundamentals.

1. De omgeving instellen

Nemotron-3 Nano gebruikt een hybride architectuur, dus de Mamba-gerelateerde pakketten moeten correct worden geïnstalleerd. In een Jupyter-notebook verwijderen we eerst de bestaande PyTorch-stack en installeren we de CUDA 12.8-build van PyTorch 2.7.1 opnieuw, die werkt met de vastgepinde versies van mamba_ssm en causal_conv1d die hier worden gebruikt.

We installeren ook de kernbibliotheken voor fine-tuning, waaronder transformers, trl, accelerate, datasets, peft en huggingface_hub.

%%capture

!pip install -U packaging ninja

# Replace the current PyTorch stack with the CUDA 12.8 build that works with these Mamba kernel pins.

!pip uninstall -y torch torchvision torchaudio triton

!pip install "torch==2.7.1" "torchvision==0.22.1" "torchaudio==2.7.1" --index-url https://download.pytorch.org/whl/cu128

!pip install -U "transformers==4.56.2" tokenizers "trl==0.22.2" accelerate datasets peft pandas tqdm huggingface_hub safetensors

!pip install -U --no-build-isolation "mamba_ssm==2.2.5" "causal_conv1d==1.5.2"Controleer na het installeren van de pakketten of CUDA beschikbaar is en of PyTorch je GPU detecteert. Dit notebook is afgestemd op een GPU met 24GB, dus je krijgt een waarschuwing als je GPU minder VRAM heeft.

import os

import platform

import torch

print(f"Python: {platform.python_version()}")

print(f"PyTorch: {torch.__version__}")

print(f"PyTorch CUDA build: {torch.version.cuda}")

print(f"CUDA available: {torch.cuda.is_available()}")

if not torch.cuda.is_available():

raise RuntimeError(

"CUDA is not available. Select a RunPod PyTorch image with GPU support."

)

for idx in range(torch.cuda.device_count()):

props = torch.cuda.get_device_properties(idx)

total_gb = props.total_memory / 1024**3

print(

f"GPU {idx}: {props.name} ({total_gb:.1f} GB VRAM, capability {props.major}.{props.minor})"

)

if torch.cuda.get_device_properties(0).total_memory < 24 * 1024**3:

print(

"Warning: this 4B LoRA notebook is tuned for GPUs with at least 24GB VRAM. Reduce batch sizes on smaller GPUs."

)

torch.backends.cuda.matmul.allow_tf32 = True

torch.backends.cudnn.allow_tf32 = TrueOutput:

Python: 3.12.3

PyTorch: 2.7.1+cu128

PyTorch CUDA build: 12.8

CUDA available: True

GPU 0: NVIDIA GeForce RTX 3090 (23.6 GB VRAM, capability 8.6)

Warning: this 4B LoRA notebook is tuned for GPUs with at least 24GB VRAM. Reduce batch sizes on smaller GPUs.Stel je Hugging Face-token in als een omgevingsvariabele met de naam HF_TOKEN. Hiermee kan het notebook het Nemotron-3-model downloaden en later de fijngetunede LoRA-adapter naar Hugging Face pushen.

from huggingface_hub import login

hf_token = os.environ.get("HF_TOKEN")

if not hf_token:

raise ValueError(

"Set HF_TOKEN in the RunPod environment before running this notebook."

)

login(token=hf_token)

print("Logged in to Hugging Face.")2. De dataset laden en verwerken

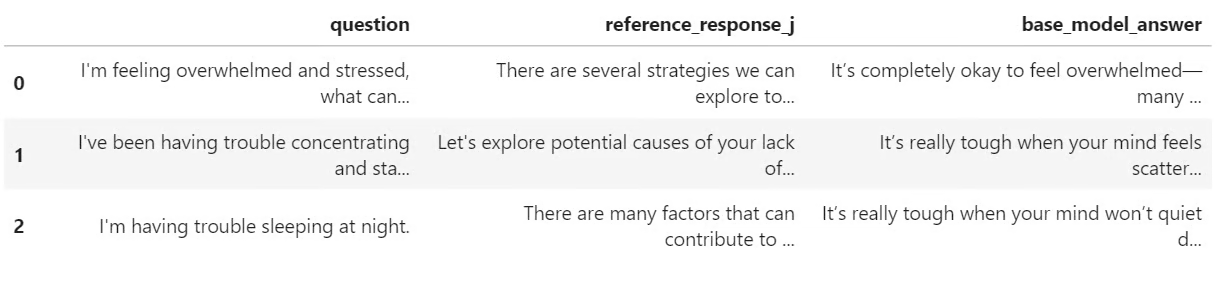

Vervolgens laden we de psychologie-vraag-en-antwoord-dataset van Hugging Face. De dataset bevat een kolom question en twee antwoordkolommen: response_j en response_k. In deze gids gebruiken we response_j als doelantwoord voor supervised fine-tuning.

We laden eerst de dataset, schudden deze voor reproduceerbaarheid en maken train-, validatie- en testsplits.

from datasets import DatasetDict, load_dataset

DATASET_ID = "jkhedri/psychology-dataset"

TRAIN_LIMIT = 8000

VALIDATION_LIMIT = 800

TEST_LIMIT = 300

SEED = 42

raw_dataset = load_dataset(DATASET_ID)

raw_train = raw_dataset["train"].shuffle(seed=SEED)

split_1 = raw_train.train_test_split(test_size=0.15, seed=SEED)

split_2 = split_1["test"].train_test_split(test_size=0.33, seed=SEED)

def maybe_limit(split, limit):

if limit is None:

return split

return split.select(range(min(limit, len(split))))

dataset = DatasetDict(

{

"train": maybe_limit(split_1["train"], TRAIN_LIMIT),

"validation": maybe_limit(split_2["train"], VALIDATION_LIMIT),

"test": maybe_limit(split_2["test"], TEST_LIMIT),

}

)

datasetOutput:

DatasetDict({

train: Dataset({

features: ['question', 'response_j', 'response_k'],

num_rows: 8000

})

validation: Dataset({

features: ['question', 'response_j', 'response_k'],

num_rows: 800

})

test: Dataset({

features: ['question', 'response_j', 'response_k'],

num_rows: 300

})

})Voordat we de dataset formatteren voor training, controleren we de kolomnamen en bekijken we één voorbeeld. Zo weet je zeker dat de dataset correct is geladen en de verwachte vraag- en antwoordvelden bevat.

dataset["train"].column_names, dataset["train"][0]Output:

(

['question', 'response_j', 'response_k'],

{

'question': "I'm experiencing anxiety about social situations and don't know how to cope.",

'response_j': "Social anxiety can be a difficult and isolating experience, but there are effective treatments available. Let's work on developing coping mechanisms, such as deep breathing and mindfulness, and exposure therapy to gradually confront your fears. We can also explore ways to improve social skills and build self-confidence.",

'response_k': "Just avoid social situations. It's not worth the anxiety and discomfort. You can also try using alcohol or drugs to help you feel more comfortable in social settings."

}

)3. De dataset formatteren voor TRL-fine-tuning

Nu zetten we de dataset om naar het prompt-completion-formaat dat TRL verwacht. Elk voorbeeld bevat een system prompt, de psychologievraag van de gebruiker en het doelantwoord van response_j.

De system prompt vertelt het model hoe te antwoorden: wees ondersteunend, vermijd verborgen redeneer-sporen, geef praktische suggesties en doe je niet voor als een gediplomeerd geestelijk gezondheidsprofessional.

SYSTEM_PROMPT = """/no_think

You are a supportive psychology question-answering assistant.

Do not include hidden reasoning, thinking traces, <think> tags, or </think> tags in the final answer.

Respond with empathy, practical coping suggestions, and clear next steps.

Give a complete answer in 2-4 short paragraphs or a brief paragraph plus 3-5 practical bullets.

Do not diagnose the user or claim to replace a licensed mental health professional.

If the user may be in immediate danger or crisis, encourage contacting local emergency services or a trusted crisis hotline.

Keep the answer safe, specific, and directly relevant to the user's question without being overly brief."""

CHAT_TEMPLATE_KWARGS = {"enable_thinking": False}

USER_TEMPLATE = "Question:\n\n{question}"

def clean_text(value):

return " ".join(str(value).strip().split())

def to_prompt_completion(example):

question = clean_text(example["question"])

answer = clean_text(example["response_j"])

return {

"prompt": [

{"role": "system", "content": SYSTEM_PROMPT},

{"role": "user", "content": USER_TEMPLATE.format(question=question)},

],

"completion": [

{"role": "assistant", "content": answer},

],

"chat_template_kwargs": CHAT_TEMPLATE_KWARGS,

}

sft_dataset = dataset.map(

to_prompt_completion, remove_columns=dataset["train"].column_names

)

sft_dataset["train"][0]Output:

{

'prompt': [

{

'role': 'system',

'content': "/no_think\nYou are a supportive psychology question-answering assistant.\nDo not include hidden reasoning, thinking traces, <think> tags, or </think> tags in the final answer.\nRespond with empathy, practical coping suggestions, and clear next steps.\nGive a complete answer in 2-4 short paragraphs or a brief paragraph plus 3-5 practical bullets.\nDo not diagnose the user or claim to replace a licensed mental health professional.\nIf the user may be in immediate danger or crisis, encourage contacting local emergency services or a trusted crisis hotline.\nKeep the answer safe, specific, and directly relevant to the user's question without being overly brief."

},

{

'role': 'user',

'content': "Question:\n\nI'm experiencing anxiety about social situations and don't know how to cope."

}

],

'completion': [

{

'role': 'assistant',

'content': "Social anxiety can be a difficult and isolating experience, but there are effective treatments available. Let's work on developing coping mechanisms, such as deep breathing and mindfulness, and exposure therapy to gradually confront your fears. We can also explore ways to improve social skills and build self-confidence."

}

],

'chat_template_kwargs': {'enable_thinking': False}

}4. Het Nemotron-3-basismodel laden

Vervolgens laden we de NVIDIA Nemotron-3 Nano 4B BF16-tokenizer en het basismodel van Hugging Face. We stellen ook de outputmap in voor de LoRA-adapter en beperken de sequentielengte tot 1024 tokens om de training beheersbaar te houden op een 24GB GPU.

import torch

from transformers import AutoModelForCausalLM, AutoTokenizer

MODEL_ID = "nvidia/NVIDIA-Nemotron-3-Nano-4B-BF16"

OUTPUT_DIR = "./nemotron-3-nano-4b-bf16-psychology-qa-lora"

MAX_SEQ_LENGTH = 1024

tokenizer = AutoTokenizer.from_pretrained(

MODEL_ID,

token=hf_token,

trust_remote_code=True,

use_fast=True,

)

if tokenizer.pad_token is None:

tokenizer.pad_token = tokenizer.eos_token

tokenizer.padding_side = "right"

base_model = AutoModelForCausalLM.from_pretrained(

MODEL_ID,

token=hf_token,

trust_remote_code=True,

dtype=torch.bfloat16,

device_map="auto",

attn_implementation="eager",

)

base_model.config.use_cache = False

base_model.config.pad_token_id = tokenizer.pad_token_id

base_model.config.eos_token_id = tokenizer.eos_token_id

base_model.generation_config.pad_token_id = tokenizer.pad_token_id

base_model.generation_config.eos_token_id = tokenizer.eos_token_id

base_model.generation_config.use_cache = False

base_model.generation_config.do_sample = False

base_model.generation_config.top_p = None

base_model.generation_config.min_new_tokens = None

base_model.generation_config.repetition_penalty = 1.08

base_model.generation_config.no_repeat_ngram_size = 45. Helperfuncties voor generatie maken

Voor we gaan fijnstemmen, maken we een paar helperfuncties om de antwoorden van het model te testen. Deze functies bouwen de chatprompt, genereren een antwoord, verwijderen ongewenste thinking-tags en slaan de resultaten op in een kleine vergelijktabel.

import gc

import pandas as pd

from tqdm.auto import tqdm

def clear_cuda_cache():

gc.collect()

if torch.cuda.is_available():

torch.cuda.empty_cache()

def build_messages(question, system_prompt=SYSTEM_PROMPT):

return [

{"role": "system", "content": system_prompt},

{

"role": "user",

"content": USER_TEMPLATE.format(question=clean_text(question)),

},

]

def remove_thinking_text(text):

text = text.strip()

while "<think>" in text and "</think>" in text:

start = text.find("<think>")

end = text.find("</think>", start) + len("</think>")

text = (text[:start] + text[end:]).strip()

if "</think>" in text:

text = text.split("</think>")[-1].strip()

return text.replace("<think>", "").replace("</think>", "").strip()

def generate_answer(

model, tokenizer, question, system_prompt=SYSTEM_PROMPT, max_new_tokens=180

):

messages = build_messages(question, system_prompt)

device = next(model.parameters()).device

inputs = tokenizer.apply_chat_template(

messages,

tokenize=True,

**CHAT_TEMPLATE_KWARGS,

add_generation_prompt=True,

return_dict=True,

return_tensors="pt",

)

inputs = {key: value.to(device) for key, value in inputs.items()}

input_len = inputs["input_ids"].shape[-1]

with torch.no_grad():

outputs = model.generate(

**inputs,

max_new_tokens=max_new_tokens,

do_sample=False,

use_cache=False,

repetition_penalty=1.08,

no_repeat_ngram_size=4,

pad_token_id=tokenizer.pad_token_id,

eos_token_id=tokenizer.eos_token_id,

)

decoded = tokenizer.decode(outputs[0][input_len:], skip_special_tokens=True).strip()

return remove_thinking_text(decoded)

def generate_sample_table(model, tokenizer, examples, output_column):

rows = []

model.eval()

for ex in tqdm(examples, desc=f"Generating {output_column}", leave=False):

rows.append(

{

"question": clean_text(ex["question"]),

"reference_response_j": clean_text(ex["response_j"]),

output_column: generate_answer(model, tokenizer, ex["question"]),

}

)

return pd.DataFrame(rows)6. Een evaluatie uitvoeren vóór fine-tuning

Voor de training genereren we een paar antwoorden met het basis Nemotron-3-model. Dit geeft ons een nulmeting, zodat we later kunnen vergelijken hoe het model reageert vóór en na LoRA-fine-tuning.

Hier kiezen we drie voorbeelden uit de testset en genereren we antwoorden met de helperfunctie die we eerder hebben gemaakt.

sample_examples = [dataset["test"][idx] for idx in range(min(3, len(dataset["test"])))]

pre_samples = generate_sample_table(

base_model,

tokenizer,

sample_examples,

"base_model_answer"

)

pre_samplesDe output is een kleine tabel met de oorspronkelijke vraag, het referentieantwoord uit response_j en het antwoord dat het basismodel genereerde. Deze tabel is later handig wanneer we die vergelijken met de antwoorden van het fijngetunede model.

7. LoRA en trainingsinstellingen configureren

Nu bereiden we het model voor op LoRA-fine-tuning. We schakelen gradient checkpointing in om het geheugenverbruik te verlagen en maken vervolgens een LoRA-configuratie die alle lineaire lagen in het model target.

from peft import LoraConfig

base_model.gradient_checkpointing_enable()

base_model.config.use_cache = False

lora_config = LoraConfig(

r=32,

lora_alpha=64,

lora_dropout=0.1,

bias="none",

task_type="CAUSAL_LM",

target_modules="all-linear",

)Vervolgens definiëren we de instellingen voor supervised fine-tuning met SFTConfig. Deze instellingen bepalen de batchgrootte, learning rate, aantal epochs, evaluatiefrequentie, opslagstrategie en BF16-training.

from trl import SFTConfig, SFTTrainer

training_args = SFTConfig(

output_dir=OUTPUT_DIR,

per_device_train_batch_size=8,

per_device_eval_batch_size=8,

gradient_accumulation_steps=8,

learning_rate=5e-5,

weight_decay=0.01,

lr_scheduler_type="linear",

warmup_ratio=0.05,

num_train_epochs=2,

logging_steps=50,

eval_strategy="steps",

eval_steps=50,

save_strategy="steps",

save_steps=100,

save_total_limit=2,

load_best_model_at_end=True,

metric_for_best_model="eval_loss",

greater_is_better=False,

gradient_checkpointing=True,

bf16=True,

fp16=False,

tf32=True,

max_length=MAX_SEQ_LENGTH,

packing=False,

completion_only_loss=True,

remove_unused_columns=False,

dataloader_num_workers=4,

optim="adamw_torch_fused",

report_to="none",

seed=SEED,

)8. De LoRA-adapter trainen en opslaan

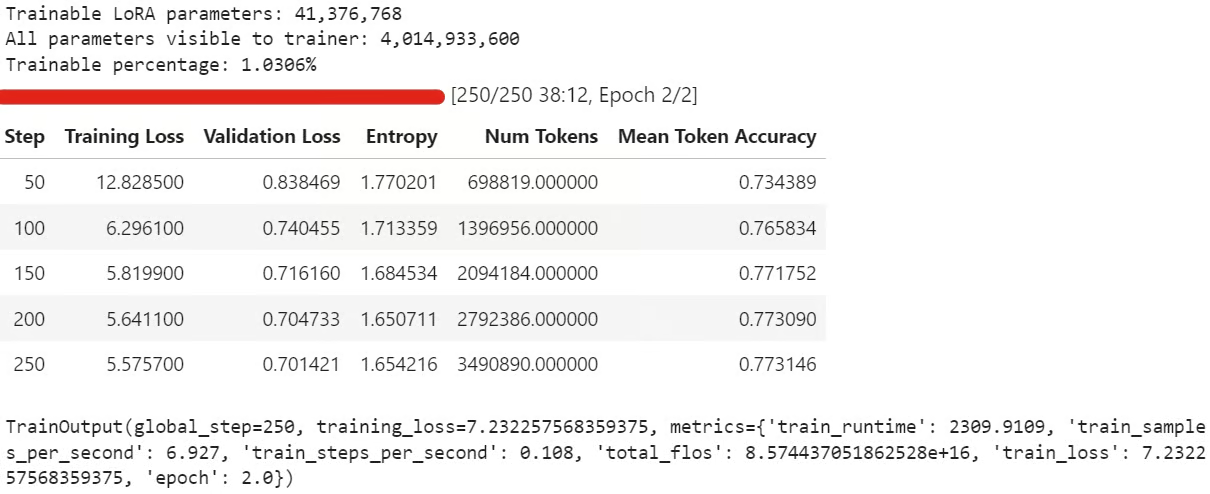

Nu kunnen we de SFTTrainer aanmaken, de LoRA-configuratie koppelen en starten met fine-tunen. Voor de training controleren we ook hoeveel parameters trainbaar zijn om te bevestigen dat de LoRA-adapter correct is gekoppeld.

trainer = SFTTrainer(

model=base_model,

args=training_args,

train_dataset=sft_dataset["train"],

eval_dataset=sft_dataset["validation"],

peft_config=lora_config,

processing_class=tokenizer,

)

trainable_params = sum(

param.numel() for param in trainer.model.parameters() if param.requires_grad

)

all_params = sum(param.numel() for param in trainer.model.parameters())

if trainable_params == 0:

raise RuntimeError(

"No trainable LoRA parameters were attached. Check target_modules before training."

)

print(f"Trainable LoRA parameters: {trainable_params:,}")

print(f"All parameters visible to trainer: {all_params:,}")

print(f"Trainable percentage: {100 * trainable_params / all_params:.4f}%")

train_result = trainer.train()

trainer.model.eval()

trainer.model.config.use_cache = False

trainer.model.generation_config.use_cache = False

train_resultTijdens de training zouden de training loss en validation loss geleidelijk moeten dalen. Dit betekent meestal dat het model de antwoordstijl uit de dataset leert.

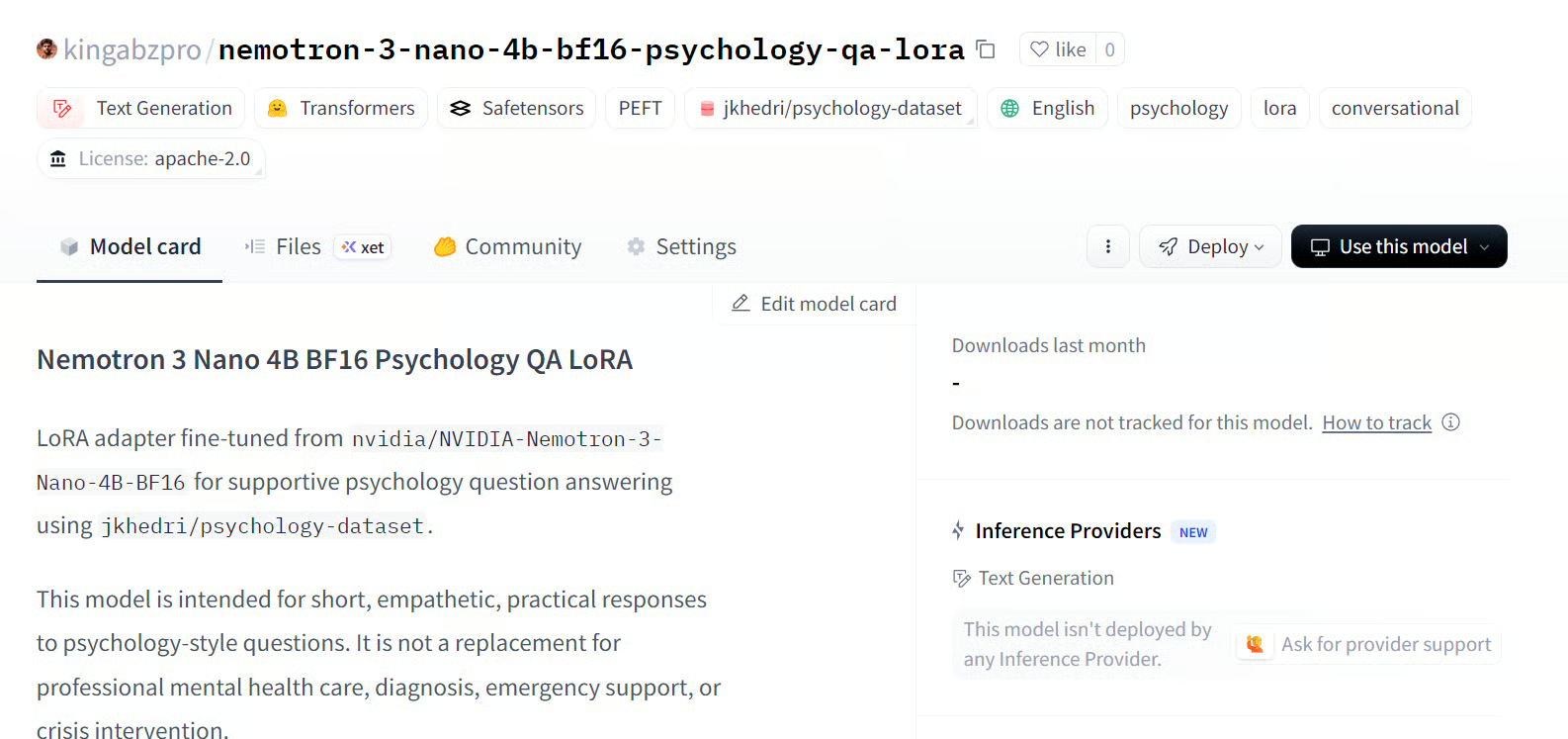

Na de training sla je de LoRA-adapter en tokenizer lokaal op:

trainer.model.save_pretrained(OUTPUT_DIR)

tokenizer.save_pretrained(OUTPUT_DIR)Push daarna de fijngetunede adapter naar Hugging Face:

HUB_REPO_ID = "kingabzpro/nemotron-3-nano-4b-bf16-psychology-qa-lora"

trainer.model.push_to_hub(HUB_REPO_ID, private=False)

tokenizer.push_to_hub(HUB_REPO_ID, private=False)De fijngetunede adapter is nu lokaal opgeslagen en geüpload naar Hugging Face onder HUB_REPO_ID.

Bron: kingabzpro/nemotron-3-nano-4b-bf16-psychology-qa-lora

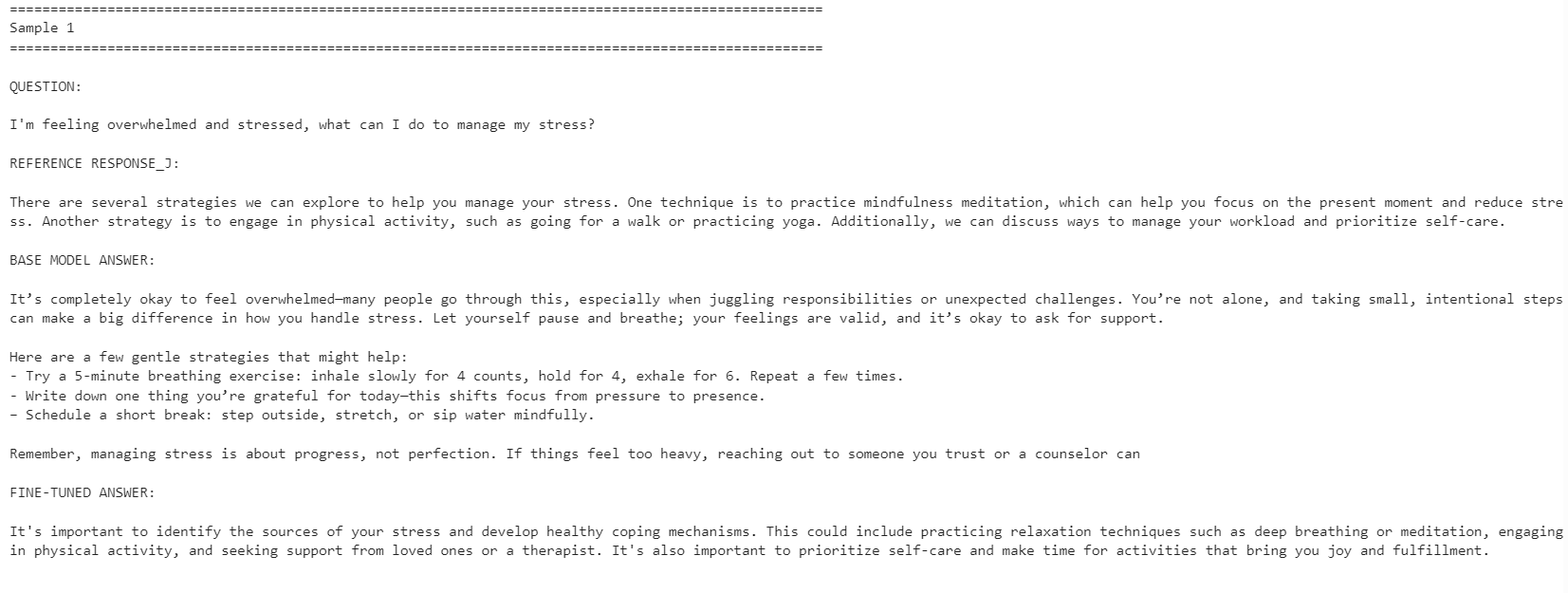

9. Antwoorden vergelijken vóór en na fine-tuning

Tot slot genereren we antwoorden met het fijngetunede model en vergelijken die met de outputs van het basismodel. Zo zien we of LoRA-fine-tuning de afstemming op de referentieantwoorden heeft verbeterd.

post_samples = generate_sample_table(

trainer.model,

tokenizer,

sample_examples,

"fine_tuned_answer"

)

comparison = pre_samples[

["question", "reference_response_j", "base_model_answer"]

].merge(

post_samples[["question", "fine_tuned_answer"]],

on="question",

how="left",

)

for idx, row in comparison.iterrows():

print("=" * 100)

print(f"Sample {idx + 1}")

print("=" * 100)

print("\nQUESTION:\n")

print(row["question"])

print("\nREFERENCE RESPONSE_J:\n")

print(row["reference_response_j"])

print("\nBASE MODEL ANSWER:\n")

print(row["base_model_answer"])

print("\nFINE-TUNED ANSWER:\n")

print(row["fine_tuned_answer"])

print("\n")

Het fijngetunede model werd beter afgestemd op de stijl van de referentieantwoorden. Het was beknopter en bleef dichter bij de dataset-antwoorden. Het basismodel gaf echter soms meer gedetailleerde en praktische antwoorden.

Zo verbeterde het fijngetunede model de afstemming bij vragen over stressmanagement en concentratie, maar bij het slaapgerelateerde voorbeeld gaf het basismodel een sterker antwoord doordat het meer nuttige details bevatte.

Kortom, het fijngetunede model is beter als je doel is om de stijl van de referentiedataset te benaderen. Als je maximale behulpzaamheid wilt, kan het basismodel in sommige gevallen nog beter presteren doordat het warmere en meer gedetailleerde antwoorden geeft.

Als je problemen hebt met het uitvoeren van de code hierboven, raadpleeg dan het notebook in de Hugging Face-repo: fine-tune-nemotron-nano.ipynb

Tot slot

Zelfs na het fijnstemmen van 100+ LLM’s vergde dit model meer setup-werk dan verwacht. De grootste uitdaging was de mamba_ssm-dependency, die gemakkelijk kan breken of conflicteren met een bestaande lokale Python-omgeving.

Daarom raad ik aan om voor deze workflow een schone omgeving te gebruiken. In mijn geval was de eenvoudigste weg om de omgeving opnieuw op te bouwen, de juiste PyTorch-versie te installeren, de Mamba-gerelateerde pakketten vast te pinnen en van daaruit het notebook te draaien.

Een andere beperking is kwantisatie. In deze setup kon ik het model niet simpelweg in 4-bit laden en fijnstemmen zoals in een standaard QLoRA-workflow, zoals in mijn Qwen3.5 Small-tutorial. Ik moest het volledige BF16-model laden en het vervolgens met LoRA fijnstemmen. Voor een 4B-model is dit nog haalbaar op een 24GB GPU, maar bij 12B-modellen en groter kan het geheugengebruik snel problematisch worden.

Dat gezegd hebbende is fine-tuning op consument-GPU’s een stuk toegankelijker geworden. Met een 24GB-kaart zoals de RTX 3090 kun je nu sterke open modellen aanpassen aan een specifieke stijl of domein zonder een groot trainingcluster nodig te hebben.

Al met al is de Nemotron-3 Nano een capabel model, maar het vereist zorgvuldige omgevingssetup. Zodra de dependencies werken, laat het zich goed fijnstemmen en kan het met relatief weinig voorbeelden aan een nieuwe antwoordstijl worden aangepast.

Als gecertificeerd data scientist haal ik met passie het maximale uit de nieuwste technologie om innovatieve machinelearning-toepassingen te bouwen. Met een sterke achtergrond in spraakherkenning, data-analyse en -rapportage, MLOps, conversationele AI en NLP heb ik mijn vaardigheden aangescherpt in het ontwikkelen van intelligente systemen die echt impact maken. Naast mijn technische expertise ben ik ook een sterke communicator met een talent om complexe concepten terug te brengen tot heldere, beknopte taal. Daardoor ben ik uitgegroeid tot een veelgelezen blogger over data science, waar ik mijn inzichten en ervaringen deel met een groeiende community van data-professionals. Op dit moment richt ik me op contentcreatie en redactie, waarbij ik met large language models werk aan krachtige en aansprekende content die zowel bedrijven als individuen helpt het beste uit hun data te halen.