Track

5 мая 2026 года небольший стартап из Майами под названием Subquadratic выпустил модель SubQ. Команда маленькая, но они привлекли $29 млн посевных инвестиций и заявляют, что модель может обрабатывать до 12 миллионов токенов за один проход.

Они также сделали другие звучащие невероятно заявления, например, что их модель до 52 раз эффективнее FlashAttention на 1 млн токенов и достигает качества кодирования, сопоставимого с Claude Opus, примерно за 1/20 стоимости.

Это серьёзные заявления, поэтому есть смысл разложить всё по полочкам и понять, что на самом деле происходит. В этом материале я расскажу, что такое SubQ, как устроена архитектура и что ранние детали и обсуждения в среде разработчиков говорят о этих заявлениях.

Что такое SubQ?

SubQ — это LLM компании Subquadratic, выпущенная 5 мая 2026 года и построенная вокруг одного ключевого свойства: контекстного окна на 12 миллионов токенов. Это первая модель компании, и она сопровождается смелыми заявлениями об эффективности и стоимости, которые уже вызвали заметные споры.

Модель ещё недоступна публично: доступ к API, SubQ Code и SubQ Search пока возможен только по раннему списку ожидания.

Она построена на так называемой SSA — Subquadratic Sparse Attention (разреженное внимание субквадратичной сложности).

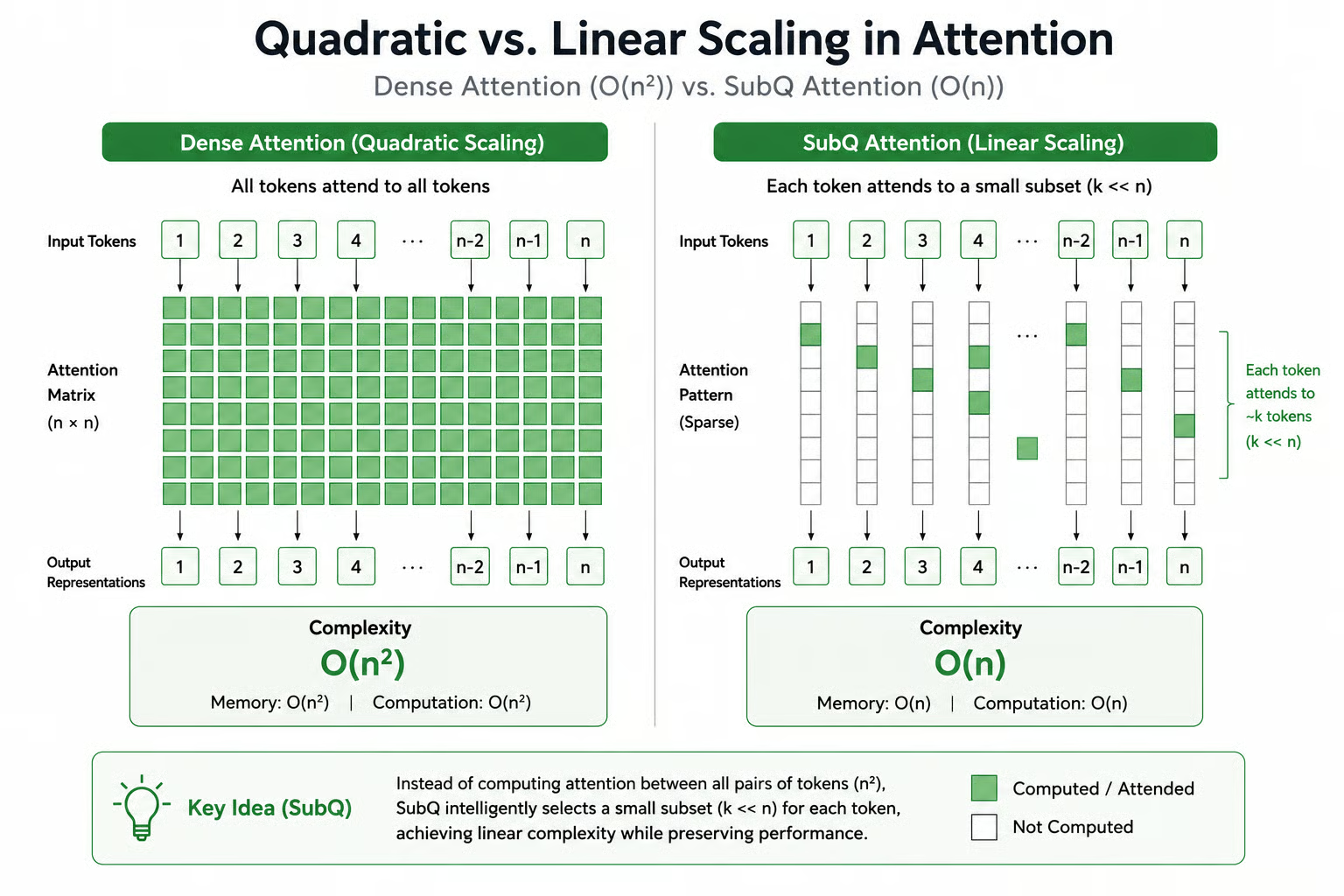

Вместо сравнения каждого токена с каждым, как это делает стандартное плотное внимание, SSA подходит избирательно. Для каждого токена модель выбирает наиболее релевантные токены и вычисляет связи только внутри этого подмножества.

Это даёт два очевидных эффекта.

- Во-первых, снижается число вычислений, что напрямую повышает эффективность и уменьшает стоимость.

- Во-вторых, отбор зависит от содержания. Это значит, что модель смотрит не только на соседние токены. Она может подтягивать релевантные токены из любой части последовательности, даже если они сильно удалены.

В чём особенность SubQ?

На практике архитектура SSA означает, что модель фокусируется на действительно важном, а не обрабатывает всё одинаково. Ожидаемый результат — сопоставимая с полным вниманием точность при значительно меньших затратах вычислений и памяти.

Давайте сначала подробнее рассмотрим плотное внимание, а затем сравним оба подхода.

Проблема квадратичного масштабирования в трансформерах

Современные модели вроде GPT, Claude и Gemini опираются на плотное внимание. В общих чертах это означает, что каждый токен сравнивается с каждым другим токеном во входе. По мере роста входа число сравнений растёт квадратично.

Возьмём длинный документ и представим, что модели нужно сгенерировать последнее слово. Она оглядывается на каждый токен в документе, выстраивает связи и затем решает, что должно быть дальше. Поэтому плотное внимание хорошо работает: оно учитывает всё.

Но у этой силы есть цена. По мере увеличения размера входа резко растут требования к вычислениям и памяти, что создаёт ограничения контекстного окна. Проще говоря, это масштабируется как O(n²), где n — число токенов.

Поэтому большинство моделей остаются в практических рамках. В стандартных моделях нормой являются 128k токенов, а самые мощные, такие как Claude Opus, ограничиваются контекстным окном в 1 млн.

Чтобы обойти это, большинство систем ИИ избегают подачи в модель полных наборов данных. Вместо этого они полагаются на такие техники, как:

- RAG (Retrieval-Augmented Generation): Храните данные вне модели, извлекайте только релевантные фрагменты и передавайте их в модель.

- Чанкинг: Разбейте большой текст на меньшие части и отправляйте модели только релевантные фрагменты.

- Стратегии суммаризации: Сжимайте длинный контент и подавайте модели краткие изложения вместо полного текста.

Если хотите глубже разобраться в механизмах внимания, посмотрите это руководство по механизму внимания в LLM. Чтобы получить практический опыт с базовыми блоками современных LLM, рекомендую наш курс Transformer Models with PyTorch.

Как SubQ позиционирует себя иначе

Плотное внимание растёт квадратично с размером входа, тогда как SSA спроектировано масштабироваться субквадратично, ближе к O(n·k) вместо O(n²), где k — число отбираемых токенов на шаг. Когда k мало по отношению к n, это существенно эффективнее полного внимания.

Диаграмма квадратичного и линейного внимания: плотные всесторонние связи против разрежённых избирательных связей.

Очевидная обеспокоенность здесь — точность. Если модель рассматривает лишь часть входа, она может пропустить важные связи. Обычно именно ради этого и существует плотное внимание.

Заявление SubQ в том, что на практике такого компромисса не наблюдается. Они утверждают, что модель уделяет внимание всем нужным токенам, даже если они далеко от текущего, и сохраняет сопоставимую точность с топовыми моделями.

Как работает Subquadratic Sparse Attention?

Теперь мы знаем, что вместо сравнения каждого токена со всеми остальными SSA выбирает только значимые токены в последовательности и вычисляет внимание по этим позициям. Посмотрим, как выполняется этот отбор.

Как SSA отбирает релевантные связи

SSA использует маршрутизацию, зависящую от содержания. Проще говоря, она выбирает токены исходя из их релевантности к текущему токену. Вычисляется мера схожести между токенами, что-то вроде similarity(query_i, key_j), и для внимания сохраняются только топ-k токенов с наивысшими оценками.

Со временем модель учится приоритизировать значимые токены и игнорировать шум. Это включает ключевые слова, важные сущности и токены с сильными контекстными сигналами.

Важно не только содержание: SSA также сохраняет структурные отношения в последовательности. Например, соседним токенам всегда уделяется внимание через локальные шаблоны внимания, а определённые глобальные токены спроектированы так, чтобы учитывать всю последовательность.

SSA включает иерархические и кластеризующие техники внимания. Например, она группирует похожие токены и вычисляет внимание с наиболее релевантными кластерами. Это означает, что модели не нужно оценивать каждый токен по отдельности — сначала можно рассуждать на уровне групп, а затем при необходимости «приблизиться» к токенам внутри этих кластеров.

Обучение извлечению из длинного контекста

Одного большого контекстного окна недостаточно. Даже предоставив модели 12 млн токенов, нужно научить её эффективно пользоваться этим контекстом. SSA обучается именно с этой целью:

- Предобучение: Базовая модель обучается на масштабных и разнообразных датасетах с представлениями длинного контекста.

- Контролируемое дообучение: Модель затем дообучается на структурированных задачах, включая рассуждение и генерацию кода.

- Обучение с подкреплением: Вместо ограничения модели на ближайшие токены (локальное внимание) этот этап направлен на использование релевантных токенов из всего текста (глобальное внимание).

Этап обучения с подкреплением особенно важен для корпоративных сценариев кодирования. Он позволяет модели одновременно учитывать более широкий контекст — в данном случае весь кодовый репозиторий — при генерации ответа.

Бенчмарки и производительность SubQ

Обратите внимание, что «SubQ 1M-Preview» относится к версии, протестированной на 1 млн токенов. Полное контекстное окно в 12 млн доступно через API.

По трём бенчмаркам, которые Subquadratic решила опубликовать, SubQ 1M-Preview сопоставим с Claude Opus 4.7, GPT-5.5 и Gemini 3.1 Pro.

Но выбор бенчмарков узок: ровно три теста, все сфокусированы на извлечении из длинного контекста и кодировании — двух вещах, для которых SubQ явно и создавался. Более широкие оценки по общему рассуждению, математике, мультиязычности и безопасности не публиковались.

Полная карточка модели на сайте помечена как «скоро будет», поэтому можно ожидать больше бенчмарков по общим сценариям.

Пока что вот результаты по извлечению из длинного контекста и сценариям кодирования:

|

Модель |

SWE-Bench Verified |

RULER 128K |

MRCR v2 (8-needle, 1M) |

|

SubQ (Subquadratic) |

81,8% |

95,0% |

65,9% |

|

Claude Opus 4.7 (Anthropic) |

87,6% |

94,8% |

32,2% |

|

GPT-5.5 (OpenAI) |

88,7% |

Недоступно |

74,0% |

|

Gemini 3.1 Pro (Google DeepMind) |

80,6% |

Недоступно |

26,3% |

|

DeepSeek V4 Pro (DeepSeek) |

80,6% |

Недоступно |

83,5% |

Что показывают цифры

RULER 128K: SubQ набирает 95% против 94,8% у Opus 4.7. Хотя разница в точности ничтожна, здесь важнее стоимость: Subquadratic утверждает, что прогон этого теста на SubQ обошёлся примерно в $8 против примерно $2 600 на Opus при той же длине контекста.

MRCR v2 (8-needle, 1M): Этот бенчмарк проверяет, корректно ли модель извлекает и отслеживает 8 отдельных фактов, «вшитых» в контекст из 1 млн токенов. SubQ показывает исследовательский результат 83%, но в проде оценка падает до 65,9%. Этот разрыв примерно в 17 пунктов между лабораторной и развёрнутой производительностью заметен и не до конца объяснён. Тем не менее модель остаётся конкурентоспособной с GPT-5.5 (74,0%) и значительно опережает Claude Opus 4.7 (32,2%) и Gemini 3.1 Pro (26,3%).

SWE-Bench Verified: SubQ набирает 81,8%, опережая Opus 4.6 с 80,8%, но уступая Opus 4.7 с 87,6%. Отрывы от Opus 4.6 малы и чувствительны к настройке стенда. В сравнении с Opus 4.7 и GPT-5.5 SubQ заметно позади.

На 12 миллионах токенов: Сообщается, что SubQ набирает свыше 90% в задачах «иголка в стоге сена» при контексте 12 млн, хотя эта цифра не подтверждена официальными бенчмарками. Другие передовые модели на такой длине не тестировались, поэтому сравнивать не с чем. Это самый интересный архитектурный результат запуска и одновременно тот, который нуждается в независимом воспроизведении, прежде чем делать выводы.

Что SubQ означает для RAG, кодирующих агентов и стоимости ИИ

Если архитектура SubQ масштабируется, это меняет подход к построению систем LLM. Длинный контекст становится практичным, уменьшая потребность в агрессивном чанкинге, извлечении и оптимизации токенов. Рассмотрим эти изменения подробнее.

Когда RAG становится опциональным

За последние два года Retrieval-Augmented Generation (RAG) был стандартным ответом на фундаментальное ограничение LLM: модели не могут читать всё сразу. Если ваша база знаний больше контекстного окна, вы режете документы на части, встраиваете их, храните в векторной базе, извлекаете наиболее релевантные куски и передаёте в модель только эти фрагменты вместе с промптом.

Вся эта экосистема существует потому, что контекст — дефицитный ресурс.

Когда модель надёжно обрабатывает миллионы токенов за один проход, многие инженерные слои, построенные вокруг извлечения, становятся менее необходимыми для ряда процессов. Вместо того чтобы тратить время на выбор того, какие фрагменты извлечь, система может загружать исходный материал напрямую и рассуждать по нему end-to-end.

Однако за пределами контекстного окна RAG по-прежнему важен для следующих возможностей:

- Память между сессиями: LLM ничего не запоминают после завершения сессии. Если пользователь вернётся позже, модель начнёт с нуля. Системы извлечения (или базы данных) сохраняют важные сведения — прошлые решения, документы или пользовательские данные — чтобы модель могла «помнить» их и использовать в будущем.

- Права и контроль доступа: Системы извлечения могут применять правила вроде «этот пользователь видит данные только своей команды». Так модель получает только разрешённые документы, предотвращая утечки данных.

- Аудируемость: В корпоративной среде мало просто дать ответ; нужно показать, почему он верен. Системы извлечения указывают на конкретные документы или источники, чтобы команды могли верифицировать результаты и отладить проблемы.

- Структурированное управление знаниями: Компании постоянно добавляют, обновляют и удаляют документы. Системы извлечения используют эмбеддинги и индексирование, чтобы организовать эти данные так, чтобы модель быстро находила самую актуальную и релевантную информацию без повторной обработки всего массива каждый раз.

Для нового интересного подхода к добавлению постоянной памяти в ИИ-агентов прочитайте наш учебник по Supermemory, в котором вы научитесь создавать тренера-ассистента с краткосрочной и долгосрочной памятью.

Рабочие процессы кодирования с длинным контекстом

Сейчас большинство кодирующих моделей не видят весь кодовый репозиторий. Поэтому мы добавляем надстройки — поиск по файлам, чанкинг, ранжирование и многошаговое планирование — только чтобы удержать в окне нужный контекст и выстраивать связи между файлами.

Но с контекстом 12 млн в SubQ весь кодовый репозиторий загружается в модель сразу. Это существенно упрощает дизайн агентов.

- Планирование становится глобальным: Модель может рассуждать об архитектуре, зависимостях и межфайловых взаимодействиях без потери контекста.

- Исполнение более цельное: Изменения в нескольких файлах можно согласовать за один проход, а не через поэтапные обновления.

- Проверка надёжнее: Модель может верифицировать собственные изменения на фоне всего репозитория, уменьшая несогласованности.

Экономика стоимости

В стандартных трансформерах внимание масштабируется квадратично с длиной последовательности. Если вы удваиваете контекст, стоимость не просто удваивается — она может вырасти вчетверо.

SubQ утверждает, что ломает этот компромисс.

- Сообщается о ~1/20 стоимости в сравнении с аналогичными передовыми моделями (Claude Opus)

- И до ~1000× сокращения вычислений при контексте 12 млн токенов

Если это подтвердится в проде, обработка длинного контекста перестанет быть дорогой экзотикой и станет тем, что можно использовать повседневно.

Однако вместе с дешёвым контекстным окном модель должна уметь эффективно использовать загруженную в контекст информацию. Судя по бенчмаркам, SubQ заявляет сопоставимую точность при гораздо меньшей стоимости, но делать окончательные выводы пока рано.

Как получить доступ к SubQ?

SubQ пока недоступен публично. Все три продукта — базовый API, SubQ Code и SubQ Search — находятся в приватной бете, и доступ требует ранней заявки через сайт SubQ.

С точки зрения разработчика, API спроектирован для простой интеграции. Он поддерживает:

- потоковую выдачу ответов

- вызов инструментов/функций

- эндпоинты, совместимые с OpenAI

Это значит, что если ваш стек уже работает с API в стиле OpenAI, обычно не нужно переписывать интеграцию.

SubQ Code позиционируется как консольный агент для кодирования, а SubQ Search — как поиск с длинным контекстом для глубоких исследовательских сценариев. Думайте о них как о версиях SubQ для Claude Code и Perplexity.

Цены на эти инструменты также пока непрозрачны. Публично недоступны ставки за токен, что затрудняет независимую проверку заявлений компании о стоимости.

Скепсис и открытые вопросы

В течение нескольких часов после запуска в соцсетях и на форумах вроде Hacker News появилось много скепсиса и смешанных реакций. Обсуждение разделилось: одни видят настоящий прорыв, другие сравнивают это с «AI Theranos» (отсылка к несостоявшемуся стартапу по анализу крови, делавшему мошеннические технологические заявления).

Большинство сомнений сосредоточено на:

- Они заявляют контекстное окно 12 млн, но все опубликованные бенчмарки — на 1 млн.

- Компания называется Subquadratic, но местами упоминается масштабирование, похожее на O(1). При O(1) стоило бы ожидать больше, чем контекст в 12 млн токенов. Даже O(log n) позволило бы более крупные лимиты.

Похожий нарратив был у Magic.dev в 2024 году. Они делали сильные заявления о чрезвычайно больших контекстных окнах — до 100 млн токенов — и серьёзном росте эффективности, особенно для рабочих процессов кодирования.

Посыл был почти идентичен: загружать целые кодовые базы, снижать сложность извлечения и упрощать дизайн агентов. Но результат, по крайней мере публично, оказался более сдержанным. Несмотря на привлечение около $500 млн, по состоянию на начало 2026 года реальная видимость и внедрение остаются ограниченными.

Что подтверждено

Заявления SubQ не чисто теоретические. Subquadratic сообщает, что бенчмарки RULER, MRCR v2 и SWE-Bench Verified запускала сторонняя тестовая служба, и они показали высокие результаты на извлечении из длинного контекста и конкурентоспособность в задачах кодирования.

Однако эти результаты ещё не были независимо воспроизведены внешними исследователями, а охват оценки узок. Все три бенчмарка акцентируют именно те области, под которые создан SubQ (извлечение сигналов из большого контекста и работа с кодом).

Ещё одна важная деталь — архитектура. CTO подтвердил, что SubQ не обучает модели с нуля, а строится на базовых моделях с открытым исходным кодом (вероятно, из семейств DeepSeek или Kimi). Для небольшой команды это практичное решение: ускоряет итерации и снижает стоимость обучения. Это также означает, что основное новшество — не в самой базовой модели, а в механизме внимания и системном дизайне вокруг неё.

Итоговые мысли

SubQ уже здесь, и заявления весьма смелые. Вектор понятен: снять ограничение контекстного окна и позволить моделям обрабатывать куда более крупные входы. Они позиционируют её как сопоставимую или лучшую по кодированию и извлечению из длинного контекста по сравнению с моделями уровня frontier — при существенно меньшей стоимости.

При этом пока рано. Мы всё ещё ждём полную карточку модели для лучшего понимания широких возможностей и результатов тестирования. Продукты поверх неё — SubQ Code и API — тоже пока не доступны публично. С нетерпением жду возможности поработать с этими инструментами и посмотреть, как заявления подтвердятся в продакшене.

Вопросы и ответы о модели SubQ

Изменит ли SubQ подход к написанию промптов?

Потенциально. Если заявления подтвердятся и длинный контекст станет заметно дешевле, дизайн промптов может сместиться в сторону включения большего объёма «сырых» данных вместо сильно оптимизированных или сжатых входов.

Может ли SubQ обрабатывать мультимодальные входы, такие как изображения и код?

На сайте Subquadratic их архитектура описана как обеспечивающая «мультимодальный вывод с большим контекстом», что намекает на поддержку мультимодальности в их видении. Однако мультимодальные бенчмарки не публиковались, а текущие API и продукты в приватной бете полностью сосредоточены на тексте и коде. Имеется ли ввод изображений сейчас или планируется ли в ближайшем релизе — однозначно не задокументировано.

Как SubQ работает на очень коротких входах?

Все опубликованные бенчмарки тестируют SubQ на 128k токенов и выше. Как она работает на коротких, стандартной длины входах по сравнению с моделями уровня frontier — не раскрыто. Механизмы разрежённого внимания иногда уступают плотному на коротких последовательностях, где накладные расходы на отбор токенов перевешивают выгоды по эффективности. Имеет смысл посмотреть, когда выйдет полная карточка модели.

Нацелена ли компания на 50M или 100M токенов дальше?

The New Stack сообщал, что Subquadratic поставила целью контекстное окно в 50 миллионов токенов к IV кварталу. Если архитектура масштабируется линейно, технически это правдоподобно.