Program

Pada 5 Mei 2026, sebuah startup kecil berbasis di Miami bernama Subquadratic merilis model bernama SubQ. Timnya kecil, tetapi mereka telah menggalang pendanaan awal sebesar $29 juta dan mengklaim model ini dapat memproses hingga 12 juta token dalam sekali proses.

Mereka juga membuat klaim lain yang terdengar luar biasa, seperti modelnya hingga 52 kali lebih efisien daripada FlashAttention pada 1 juta token dan mencapai kinerja pengodean yang mirip dengan Claude Opus dengan biaya sekitar 1/20.

Ini adalah pernyataan besar, jadi ada baiknya menguraikannya untuk melihat apa yang sebenarnya terjadi. Dalam tulisan ini, saya akan membahas apa itu SubQ, bagaimana arsitekturnya bekerja, serta apa yang disiratkan detail awal dan komunitas pengembang tentang klaim-klaim ini.

Apa itu SubQ?

SubQ adalah LLM milik Subquadratic, dirilis pada 5 Mei 2026, dan dibangun di sekitar satu fitur utama: jendela konteks 12 juta token. Ini adalah model pertama yang mereka luncurkan, dan hadir dengan serangkaian klaim berani terkait efisiensi dan biaya yang telah memicu perdebatan signifikan.

Model ini belum tersedia untuk publik; akses ke API, SubQ Code, dan SubQ Search saat ini terbatas pada akses awal melalui daftar tunggu.

Model ini dibangun di atas sesuatu yang disebut SSA, singkatan dari Subquadratic Sparse Attention.

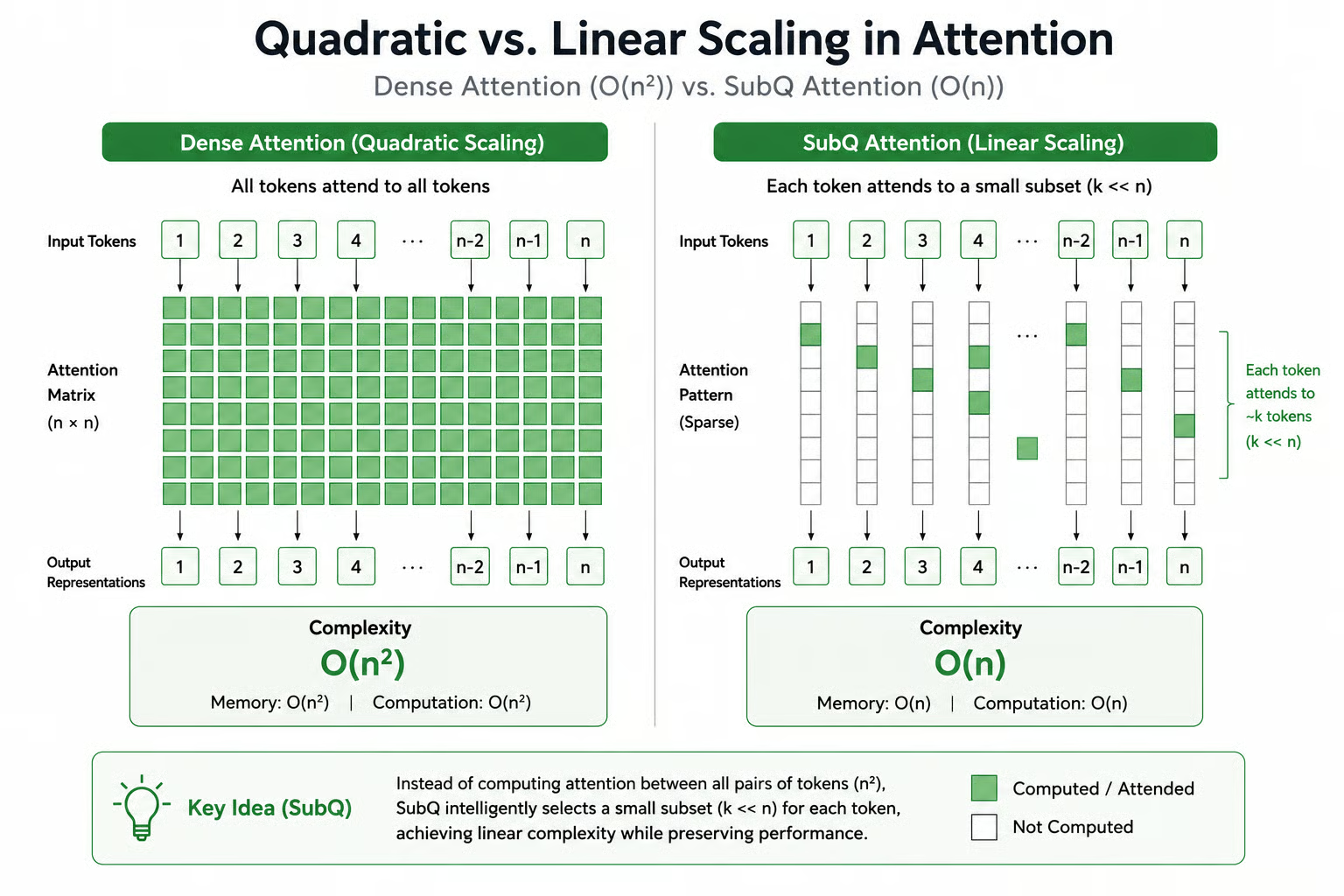

Alih-alih membandingkan setiap token dengan setiap token lainnya, seperti cara kerja dense attention standar, SSA mengambil pendekatan selektif. Untuk setiap token, model memilih token paling relevan dan menghitung hubungan hanya dalam subset tersebut.

Hal ini memiliki dua dampak jelas.

- Pertama, mengurangi jumlah komputasi, yang langsung meningkatkan efisiensi dan menurunkan biaya.

- Kedua, pemilihannya bergantung pada konten. Artinya, model tidak hanya melihat token terdekat. Ia dapat menarik token relevan dari mana saja dalam urutan, meskipun berjauhan.

Apa yang Istimewa dari SubQ?

Dalam praktiknya, arsitektur SSA membuat model berfokus pada hal yang benar-benar penting alih-alih memproses semuanya secara setara. Hasil yang diharapkan adalah akurasi serupa dengan full attention, tetapi dengan kebutuhan komputasi dan memori yang jauh lebih rendah.

Mari kita lihat lebih dekat dense attention terlebih dahulu, lalu bandingkan kedua pendekatan.

Masalah skala kuadratik pada transformer

Model saat ini seperti GPT, Claude, dan Gemini mengandalkan dense attention. Secara garis besar, ini berarti setiap token dibandingkan dengan setiap token lain dalam input. Saat input bertambah, jumlah perbandingan tumbuh secara kuadratik.

Ambil sebuah dokumen panjang dan bayangkan model harus menghasilkan kata terakhir. Ia meninjau setiap token dalam dokumen itu, membangun hubungan, lalu memutuskan apa yang berikutnya. Itulah mengapa dense attention bekerja dengan baik. Ia mempertimbangkan semuanya.

Namun kekuatan itu datang dengan biaya. Saat ukuran input meningkat, kebutuhan komputasi dan memori melonjak tajam, dan menciptakan batas jendela konteks. Secara sederhana, skalanya O(n²), di mana n adalah jumlah token.

Inilah sebab kebanyakan model bertahan dalam batas praktis. Pada model standar, 128 ribu token adalah norma, dan model paling kuat seperti Claude Opus mentok pada jendela konteks 1 juta.

Untuk menyiasati ini, sebagian besar sistem berbasis AI menghindari memasukkan seluruh dataset ke model. Sebaliknya, mereka mengandalkan teknik seperti:

- RAG (Retrieval-Augmented Generation): Menyimpan data secara eksternal, mengambil hanya potongan yang relevan, lalu memberikannya ke model.

- Chunking: Memecah teks besar menjadi potongan lebih kecil dan hanya mengirim chunk yang relevan ke model.

- Strategi peringkasan: Meringkas konten panjang dan memasukkan ringkasan ke model, alih-alih seluruh teks.

Jika Anda ingin pemahaman lebih dalam tentang mekanisme attention, lihat tutorial tentang Mekanisme Attention pada LLM. Untuk pengalaman praktik membangun blok penyusun LLM modern, saya sarankan mengikuti kursus Transformer Models with PyTorch kami.

Bagaimana posisi SubQ berbeda

Dense attention bertumbuh secara kuadratik dengan ukuran input, sedangkan SSA dirancang untuk skala sub-kuadratik, lebih mendekati O(n·k) alih-alih O(n²), di mana k adalah jumlah token yang dipilih per langkah. Saat k dijaga kecil relatif terhadap n, ini jauh lebih efisien daripada full attention.

Diagram perhatian kuadratik vs linear yang menampilkan koneksi padat semua-ke-semua dibandingkan koneksi jarang yang selektif.

Kekhawatiran yang jelas di sini adalah akurasi. Jika model hanya melihat sebagian input, ia bisa melewatkan hubungan penting. Pertukaran inilah biasanya alasan dense attention ada sejak awal.

Klaim SubQ adalah bahwa pertukaran ini tidak muncul dalam praktik. Mereka mengatakan model memperhatikan semua token yang diperlukan, meskipun jauh dari token saat ini, dan mempertahankan akurasi serupa dengan model papan atas.

Bagaimana Subquadratic Sparse Attention Bekerja?

Kini kita tahu bahwa alih-alih membandingkan setiap token dengan setiap token lain, SSA hanya memilih token yang penting dalam urutan dan menghitung attention pada posisi-posisi tersebut. Mari lihat bagaimana ia membuat seleksi itu.

Bagaimana SSA memilih hubungan yang relevan

SSA menggunakan routing yang bergantung pada konten. Sederhananya, ia memilih token berdasarkan seberapa relevan token tersebut dengan token saat ini. Ia menghitung skor kemiripan antar token, semacam similarity(query_i, key_j), dan hanya mempertahankan k token teratas dengan skor tertinggi untuk diperhatikan.

Seiring waktu, model belajar memprioritaskan token bermakna dan mengabaikan noise. Itu mencakup kata kunci, entitas penting, dan token yang membawa sinyal kontekstual kuat.

Tidak hanya bergantung pada konten, SSA juga mempertahankan hubungan struktural dalam urutan. Misalnya, token yang berdekatan selalu diberi perhatian melalui pola local attention, sementara token global tertentu dirancang untuk memperhatikan seluruh urutan.

SSA juga mencakup teknik attention hierarkis dan berbasis klaster. Misalnya, ia mengelompokkan token serupa dan menghitung attention dengan klaster yang paling relevan. Ini berarti model tidak perlu mengevaluasi setiap token satu per satu, melainkan dapat bernalar pada tingkat grup terlebih dahulu, lalu memperbesar ke token dalam klaster tersebut jika diperlukan.

Pelatihan untuk retrieval konteks panjang

Jendela konteks besar saja tidak menghasilkan keajaiban. Meski Anda memberi model 12 juta token, ia tetap perlu tahu cara menggunakan konteks itu secara efektif. SSA dilatih untuk tujuan ini:

- Prapelatihan: Model dasar dilatih pada dataset masif dan beragam dengan representasi konteks panjang.

- Penyetelan terarah (supervised fine-tuning): Model kemudian dilatih pada tugas terstruktur, termasuk penalaran dan pembuatan kode.

- Pembelajaran penguatan (reinforcement learning): Alih-alih membatasi model untuk mempertimbangkan token terdekat (local attention), langkah ini membuatnya menggunakan token relevan dari seluruh teks (global attention).

Tahap pembelajaran penguatan sangat penting untuk kasus penggunaan pengodean tingkat enterprise. Ini memungkinkan model mempertimbangkan konteks yang lebih luas sekaligus—dalam hal ini seluruh basis kode—saat menghasilkan keluaran.

Benchmark dan Kinerja SubQ

Perlu dicatat bahwa "SubQ 1M-Preview" merujuk pada versi yang di-benchmark pada 1 juta token. Jendela konteks penuh 12 juta dapat diakses melalui API.

Pada tiga benchmark yang dipilih Subquadratic untuk dirilis, SubQ 1M-Preview bersaing ketat dengan Claude Opus 4.7, GPT-5.5, dan Gemini 3.1 Pro.

Namun pilihan benchmark-nya sempit; tepat tiga pengujian, semuanya berfokus pada retrieval konteks panjang dan pengodean—dua hal yang secara eksplisit dirancang SubQ untuk unggul. Evaluasi yang lebih luas atas penalaran umum, matematika, performa multibahasa, dan keamanan belum dipublikasikan.

Kartu model lengkap tercantum sebagai "segera hadir" di situs web, jadi kita dapat mengharapkan lebih banyak benchmark untuk kasus penggunaan umum di sana.

Untuk saat ini, berikut hasil di lintas retrieval konteks panjang dan kasus penggunaan pengodean:

|

Model |

SWE-Bench Terverifikasi |

RULER 128K |

MRCR v2 (8-needle, 1M) |

|

SubQ (Subquadratic) |

81,8% |

95,0% |

65,9% |

|

Claude Opus 4.7 (Anthropic) |

87,6% |

94,8% |

32,2% |

|

GPT-5.5 (OpenAI) |

88,7% |

Tidak tersedia |

74,0% |

|

Gemini 3.1 Pro (Google DeepMind) |

80,6% |

Tidak tersedia |

26,3% |

|

DeepSeek V4 Pro (DeepSeek) |

80,6% |

Tidak tersedia |

83,5% |

Apa yang ditunjukkan angka-angka

RULER 128K: SubQ mencetak 95% dibanding Opus 4.7 yang 94,8%. Meski perbedaan akurasinya kecil, yang sebenarnya penting di sini adalah biaya: Subquadratic mengklaim menjalankan evaluasi ini pada SubQ menelan biaya sekitar $8, dibanding sekitar $2.600 pada Opus pada panjang konteks yang sama.

MRCR v2 (8-needle, 1M): Benchmark ini menguji apakah model dengan benar mengambil dan melacak 8 fakta terpisah yang disisipkan dalam konteks 1 juta token. SubQ menunjukkan hasil riset 83%, tetapi skor produksi turun menjadi 65,9%. Kesenjangan ~17 poin antara performa laboratorium dan terpasang ini patut dicatat dan belum sepenuhnya dijelaskan. Meski begitu, tetap kompetitif dengan GPT-5.5 (74,0%) dan jauh di depan Claude Opus 4.7 (32,2%) serta Gemini 3.1 Pro (26,3%).

SWE-Bench Terverifikasi: SubQ mencetak 81,8%, di atas Opus 4.6 yang 80,8% tetapi di bawah Opus 4.7 yang 87,6%. Margin terhadap Opus 4.6 kecil dan sensitif terhadap setelan harness. Dibanding Opus 4.7 dan GPT-5.5, SubQ jelas tertinggal.

Pada 12 juta token: SubQ dilaporkan mencetak lebih dari 90% pada tugas "needle-in-a-haystack" pada konteks 12 juta, meski angka ini belum diverifikasi dalam benchmark resmi. Tidak ada model frontier lain yang diuji pada panjang ini, jadi tidak ada pembanding langsung. Ini adalah hasil paling menarik dari sisi arsitektur saat peluncuran dan juga yang paling membutuhkan reproduksi independen sebelum menarik kesimpulan.

Apa Arti SubQ bagi RAG, Agen Pengodean, dan Biaya AI

Jika arsitektur SubQ terbukti pada skala besar, ini mengubah cara sistem LLM dibangun. Konteks yang lebih panjang menjadi praktis, mengurangi kebutuhan chunking agresif, retrieval, dan optimasi token. Mari lihat perubahan ini lebih rinci.

Saat RAG menjadi opsional

Selama dua tahun terakhir, Retrieval-Augmented Generation (RAG) telah menjadi jawaban default atas keterbatasan mendasar pada LLM: model tidak dapat membaca semuanya sekaligus. Jika basis pengetahuan Anda lebih besar dari jendela konteks, Anda melakukan chunking dokumen, membuat embedding, menyimpannya dalam basis data vektor, mengambil potongan paling relevan, dan hanya memasukkan fragmen tersebut ke model bersama prompt.

Seluruh ekosistem itu ada karena konteks adalah sumber daya yang langka.

Saat model dapat dengan andal memproses jutaan token dalam sekali proses, banyak lapisan rekayasa yang dibangun di sekitar retrieval menjadi kurang diperlukan untuk alur kerja tertentu. Alih-alih menghabiskan waktu memutuskan chunk mana yang akan diambil, sistem dapat memasukkan materi mentah secara langsung dan menalar ujung-ke-ujung.

Namun, di luar jendela konteks, RAG tetap penting untuk kemampuan berikut:

- Memori lintas sesi: LLM tidak mengingat apa pun setelah sesi berakhir. Jika pengguna kembali nanti, model memulai dari awal. Sistem retrieval (atau basis data) menyimpan informasi penting seperti keputusan masa lalu, dokumen, atau data pengguna agar model dapat mengingat dan menggunakannya di interaksi berikutnya.

- Izin dan kontrol akses: Sistem retrieval dapat menegakkan aturan seperti "pengguna ini hanya dapat mengakses data dari timnya." Dengan begitu, model hanya menerima dokumen yang boleh dilihat pengguna, mencegah kebocoran data tidak disengaja.

- Auditabilitas: Di lingkungan enterprise, tidak cukup hanya memberi jawaban; Anda perlu menunjukkan alasannya benar. Sistem retrieval dapat menunjuk ke dokumen atau sumber yang digunakan, sehingga tim dapat memverifikasi hasil dan men-debug jika terjadi kesalahan.

- Manajemen pengetahuan terstruktur: Perusahaan terus menambah, memperbarui, dan menghapus dokumen. Sistem retrieval menggunakan embedding dan pengindeksan untuk mengatur data ini agar model dapat menemukan informasi terbaru dan paling relevan dengan cepat, tanpa memproses ulang semuanya setiap saat.

Untuk pendekatan menarik yang baru dalam menambahkan memori persisten ke pada agen AI, baca Tutorial Supermemory kami, di mana Anda belajar membangun pelatih olahraga dengan memori jangka pendek dan panjang.

Alur kerja pengodean dengan konteks panjang

Saat ini, sebagian besar model pengodean tidak dapat melihat seluruh basis kode. Jadi kita menambahkan lapisan di atasnya—pencarian file, chunking, pemeringkatan, dan perencanaan multi-langkah—hanya untuk menjaga konteks yang tepat tetap dalam jendela dan membangun hubungan lintas file.

Namun dengan konteks 12 juta SubQ, keseluruhan basis kode dimuat ke model sekaligus. Ini menyederhanakan desain agen secara bermakna.

- Perencanaan menjadi global: Model dapat menalar tentang arsitektur, dependensi, dan interaksi lintas file tanpa kehilangan konteks.

- Eksekusi lebih koheren: Perubahan lintas banyak file dapat dikoordinasikan dalam sekali proses, alih-alih melalui pembaruan bertahap.

- Peninjauan lebih andal: Model dapat memverifikasi perubahannya sendiri terhadap seluruh basis kode, mengurangi inkonsistensi.

Ekonomi biaya

Pada model transformer standar, attention berskala kuadratik dengan panjang urutan. Jika Anda menggandakan konteks, biayanya tidak sekadar menjadi dua kali lipat; bisa menjadi empat kali lebih mahal.

SubQ mengklaim mematahkan trade-off tersebut.

- Mereka melaporkan ~1/20 biaya dibanding model frontier sebanding (Claude Opus)

- Dan hingga ~1.000× pengurangan komputasi pada konteks 12 juta token

Jika ini bertahan di produksi, pemrosesan konteks panjang berhenti menjadi kasus tepi yang mahal dan menjadi sesuatu yang dapat Anda gunakan lebih rutin.

Namun, seiring jendela konteks yang murah, model juga harus dapat menggunakan informasi yang kita muat ke dalam konteksnya secara efisien. Berdasarkan benchmark, SubQ mengklaim akurasi sebanding dengan biaya yang jauh lebih rendah, tetapi masih terlalu dini untuk membuat pernyataan final.

Bagaimana Saya Bisa Mengakses SubQ?

SubQ belum tersedia untuk publik. Ketiga produk—API inti, SubQ Code, dan SubQ Search—saat ini dalam beta privat, dan akses memerlukan permintaan akses awal melalui situs SubQ.

Dari perspektif pengembang, API dirancang agar mudah diintegrasikan. Ia mendukung:

- respons streaming

- pemanggilan tool/fungsi

- endpoint yang kompatibel dengan OpenAI

Artinya jika tumpukan Anda sudah bekerja dengan API bergaya OpenAI, Anda umumnya tidak perlu menulis ulang integrasi.

SubQ Code diposisikan sebagai agen pengodean berbasis command-line, sementara SubQ Search berfokus pada pencarian konteks panjang untuk alur kerja riset yang lebih mendalam. Anggap saja sebagai versi SubQ dari Claude Code dan Perplexity.

Harga untuk alat-alat ini juga belum transparan. Tidak ada tarif per-token yang tersedia publik, sehingga sulit untuk memvalidasi secara independen klaim biaya perusahaan.

Skepsis dan Pertanyaan Terbuka

Dalam hitungan jam setelah peluncuran, sudah banyak skeptisisme dan reaksi beragam di media sosial dan forum seperti Hacker News. Diskusinya terbelah, sebagian melihat ini sebagai terobosan nyata sementara yang lain membandingkannya dengan “AI Theranos” (merujuk pada startup tes darah yang gagal dan membuat klaim teknologi palsu).

Sebagian besar keraguan berfokus pada:

- Mereka mengklaim jendela konteks 12 juta, tetapi benchmark yang dibagikan semuanya pada 1 juta.

- Mereka menamai perusahaannya Subquadratic, tetapi di beberapa tempat mereka menyebut skala mirip O(1). Pada O(1), Anda akan mengharapkan lebih dari sekadar jendela konteks 12 juta token. Bahkan O(log n) akan memungkinkan batas yang lebih besar.

Narasi serupa muncul pada Magic.dev di 2024. Mereka membuat klaim kuat tentang jendela konteks yang sangat besar, hingga 100 juta token, dan peningkatan efisiensi besar, khususnya untuk alur kerja pengodean.

Pitch-nya hampir identik: memuat seluruh basis kode, mengurangi kompleksitas retrieval, dan menyederhanakan desain agen. Namun hasilnya, setidaknya di ranah publik, lebih meredup. Meski menggalang sekitar $500 juta, masih terbatas visibilitas atau adopsi di dunia nyata hingga awal 2026.

Apa yang telah diverifikasi

Klaim SubQ tidak murni teoretis. Subquadratic melaporkan bahwa benchmark pada RULER, MRCR v2, dan SWE-Bench Terverifikasi dijalankan oleh layanan pengujian pihak ketiga, menunjukkan kinerja kuat pada retrieval konteks panjang dan hasil kompetitif pada tugas pengodean.

Namun, hasil ini belum direproduksi secara independen oleh peneliti eksternal, dan cakupan evaluasinya sempit. Ketiga benchmark menekankan tepat area yang dibangun SubQ (mengambil sinyal dari konteks besar dan beroperasi atas kode).

Detail penting lainnya adalah arsitektur. CTO telah mengonfirmasi bahwa SubQ tidak melatih model dari nol, melainkan membangun di atas model open-source dasar (kemungkinan dari keluarga seperti DeepSeek atau Kimi). Ini adalah pilihan praktis untuk tim kecil. Mempercepat iterasi dan mengurangi biaya pelatihan. Itu juga berarti inovasi intinya bukan pada model dasar itu sendiri, melainkan mekanisme attention dan desain sistem di sekitarnya.

Penutup

SubQ telah hadir, dan klaimnya cukup berani. Arahannya jelas: menghapus batas jendela konteks dan membiarkan model menangani input yang jauh lebih besar. Mereka memposisikannya setara atau mengungguli model frontier pada pengodean dan retrieval konteks panjang, dengan biaya jauh lebih rendah.

Namun, ini masih awal. Kita masih menunggu kartu model lengkap untuk visibilitas lebih luas atas kapabilitas dan pengujian. Produk yang dibangun di atasnya, SubQ Code dan API, juga belum tersedia publik. Saya menantikan untuk mencoba langsung alat-alat ini dan melihat bagaimana klaimnya bertahan di produksi.

FAQ Model SubQ

Apakah SubQ akan mengubah cara penulisan prompt?

Bisa jadi. Jika klaimnya terbukti dan konteks yang lebih panjang menjadi jauh lebih murah, desain prompt mungkin bergeser ke arah memasukkan lebih banyak informasi mentah alih-alih input yang sangat dioptimalkan atau dikompresi.

Bisakah SubQ menangani input multimodal seperti gambar dan kode?

Situs Subquadratic sendiri menggambarkan arsitektur mereka memungkinkan "inferensi konteks besar, multimodal," yang menyiratkan dukungan multimodal adalah bagian dari visi mereka. Namun, belum ada benchmark multimodal yang dipublikasikan, dan API serta produk yang saat ini dalam beta privat sepenuhnya berfokus pada teks dan kode. Apakah input gambar tersedia atau direncanakan untuk rilis jangka dekat belum didokumentasikan dengan jelas.

Bagaimana performa SubQ pada input yang sangat pendek?

Semua benchmark yang dipublikasikan menguji SubQ pada 128 ribu token ke atas. Bagaimana kinerjanya pada input sangat pendek dengan model frontier belum diungkapkan. Mekanisme attention jarang kadang kalah performa dibanding attention padat pada panjang urutan pendek, ketika overhead pemilihan token lebih besar daripada keuntungan efisiensi. Patut ditunggu saat kartu model lengkap dirilis.

Apakah perusahaan menargetkan 50 juta atau 100 juta token berikutnya?

The New Stack melaporkan bahwa Subquadratic menargetkan jendela konteks 50 juta token pada kuartal IV. Jika arsitekturnya berskala linear, ini secara teknis masuk akal.

Srujana adalah penulis lepas di bidang teknologi dengan gelar sarjana Ilmu Komputer. Menulis tentang berbagai topik, termasuk data science, komputasi awan, pengembangan, pemrograman, keamanan, dan banyak lainnya adalah hal yang alami baginya. Ia menyukai sastra klasik dan menjelajahi destinasi baru.