Track

5 मई, 2026 को, मियामी स्थित एक छोटी स्टार्टअप Subquadratic ने SubQ नाम का एक मॉडल जारी किया। टीम छोटी है, लेकिन उन्होंने $29M का सीड फंडिंग जुटाया है और दावा किया है कि मॉडल एक ही पास में 12 मिलियन टोकन तक प्रोसेस कर सकता है।

उन्होंने कुछ और चौंकाने वाले दावे भी किए हैं, जैसे उनका मॉडल 1M टोकन पर FlashAttention से 52 गुना अधिक कुशल है और लगभग 1/20 लागत पर Claude Opus जैसा कोडिंग प्रदर्शन हासिल करता है।

ये बड़े बयान हैं, इसलिए इसे तोड़कर समझना तर्कसंगत है कि असल में हो क्या रहा है। इस लेख में, मैं बताऊंगा कि SubQ क्या है, इसकी आर्किटेक्चर कैसे काम करती है, और शुरुआती विवरणों व डेवलपर समुदायों से इन दावों के बारे में क्या संकेत मिलते हैं।

SubQ क्या है?

SubQ, Subquadratic का LLM है, जिसे 5 मई, 2026 को जारी किया गया और जिसका एक प्रमुख फीचर है: 12-मिलियन-टोकन संदर्भ-विंडो। यह कंपनी का पहला शिप किया गया मॉडल है, और इसके साथ दक्षता और लागत के साहसिक दावे जुड़े हैं, जिन्होंने पहले ही काफी बहस छेड़ दी है।

मॉडल अभी सार्वजनिक रूप से उपलब्ध नहीं है; API, SubQ Code, और SubQ Search की पहुँच फिलहाल केवल वेटलिस्ट के जरिए अर्ली एक्सेस तक सीमित है।

यह SSA, यानी Subquadratic Sparse Attention, पर आधारित है।

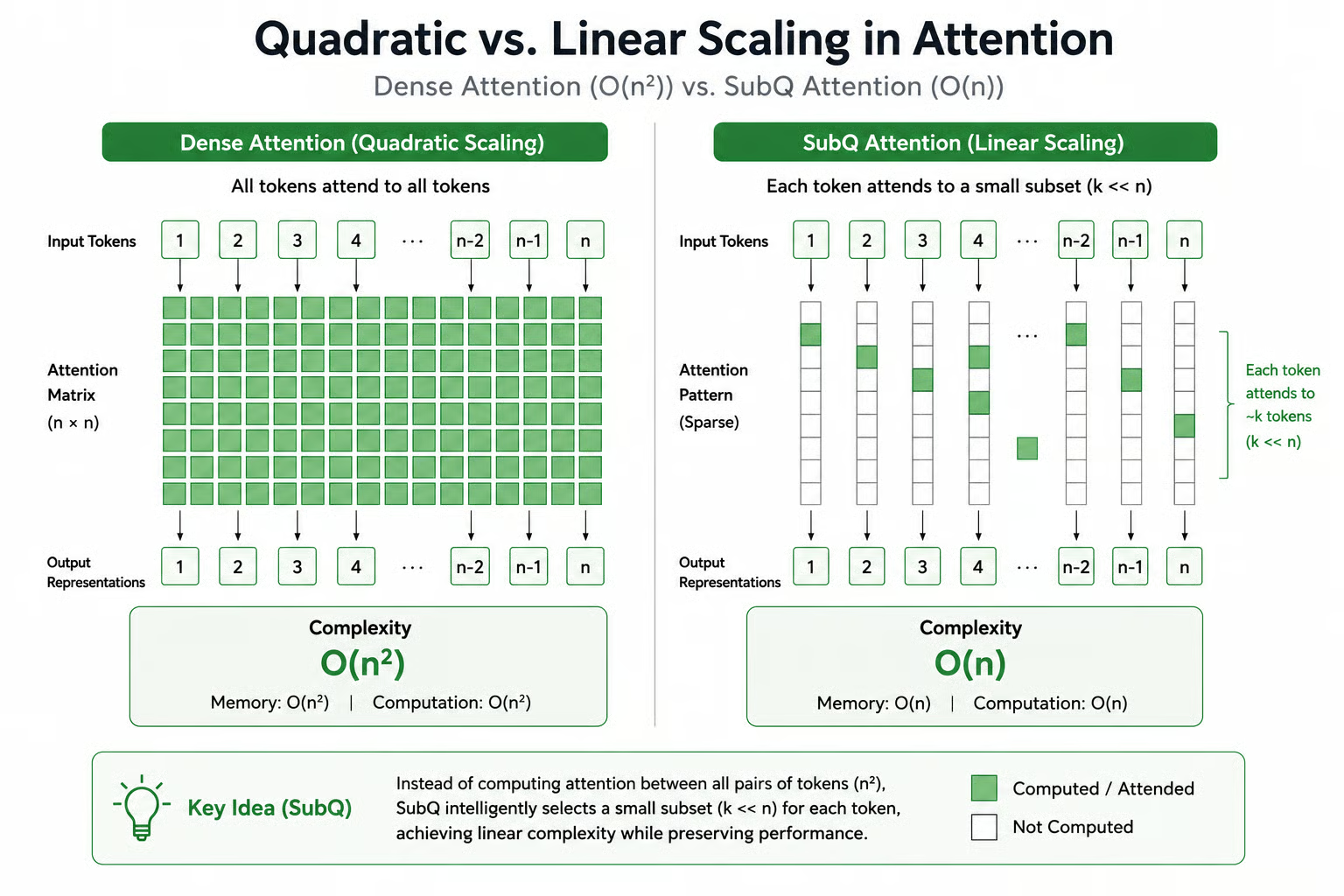

मानक डेंस अटेंशन में हर टोकन की तुलना हर दूसरे टोकन से होती है। इसके बजाय SSA एक चयनात्मक तरीका अपनाता है। हर टोकन के लिए, मॉडल सबसे प्रासंगिक टोकन चुनता है और केवल उसी उपसमूह के भीतर संबंधों की गणना करता है।

इससे दो स्पष्ट प्रभाव होते हैं।

- पहला, गणनाओं की संख्या घटती है, जिससे सीधे दक्षता बढ़ती है और लागत कम होती है।

- दूसरा, चयन सामग्री-निर्भर होता है। यानी मॉडल सिर्फ पास-पड़ोस के टोकनों को नहीं देखता; वह अनुक्रम में कहीं से भी, चाहे वे दूर ही क्यों न हों, प्रासंगिक टोकन ला सकता है।

SubQ में खास क्या है?

व्यवहार में, SSA आर्किटेक्चर का मतलब है कि मॉडल सब कुछ बराबर प्रोसेस करने के बजाय उस पर ध्यान देता है जो वाकई मायने रखता है। अपेक्षित परिणाम है फुल अटेंशन जैसी सटीकता, लेकिन कंप्यूट और मेमोरी की जरूरतें काफी कम।

पहले डेंस अटेंशन को करीब से देखते हैं और फिर दोनों तरीकों की तुलना करते हैं।

ट्रांसफॉर्मर्स में क्वाड्रेटिक स्केलिंग की समस्या

आज के मॉडल जैसे GPT, Claude, और Gemini डेंस अटेंशन पर निर्भर हैं। ऊपरी स्तर पर, इसका मतलब है कि इनपुट में हर टोकन की तुलना हर दूसरे टोकन से होती है। जैसे-जैसे इनपुट बढ़ता है, तुलनाओं की संख्या वर्गानुपाती रूप से बढ़ती है।

एक लंबे दस्तावेज़ को लें और मान लें कि मॉडल को आखिरी शब्द जनरेट करना है। वह दस्तावेज़ के हर टोकन को देखकर संबंध बनाता है और फिर तय करता है कि आगे क्या आएगा। यही कारण है कि डेंस अटेंशन अच्छी तरह काम करता है—यह सब कुछ विचार में लेता है।

लेकिन यह ताकत एक कीमत के साथ आती है। जैसे-जैसे इनपुट आकार बढ़ता है, कंप्यूट और मेमोरी की जरूरतें तेज़ी से बढ़ती हैं और संदर्भ-विंडो सीमाएँ बनती हैं। सरल शब्दों में, यह O(n²) पर स्केल करता है, जहाँ n टोकनों की संख्या है।

इसीलिए अधिकांश मॉडल व्यावहारिक सीमाओं के भीतर रहते हैं। मानक मॉडलों में 128k टोकन सामान्य हैं, और Claude Opus जैसे सबसे शक्तिशाली मॉडल 1M संदर्भ-विंडो पर अधिकतम होते हैं।

इससे निपटने के लिए, अधिकांश AI-संचालित सिस्टम मॉडल को पूरा डेटा फीड करने से बचते हैं। इसके बजाय वे इन तकनीकों पर निर्भर रहते हैं:

- RAG (Retrieval-Augmented Generation): डेटा को बाहर स्टोर करें, केवल प्रासंगिक हिस्से लाएँ, और उन्हें मॉडल में पास करें।

- Chunking: लंबे पाठ को छोटे टुकड़ों में तोड़ें और केवल प्रासंगिक भाग मॉडल को भेजें।

- सारांशण रणनीतियाँ: लंबी सामग्री को संक्षिप्त करें और पूरे पाठ के बजाय सारांश मॉडल में फीड करें।

यदि आप अटेंशन मेकैनिज्म को गहराई से समझना चाहते हैं, तो LLMs में Attention Mechanism पर यह ट्यूटोरियल देखें। आधुनिक LLMs के बिल्डिंग ब्लॉक्स पर हाथ आज़माने के लिए, हमारा Transformer Models with PyTorch कोर्स लेने की सलाह देता हूँ।

SubQ अपनी स्थिति अलग कैसे रखता है

डेंस अटेंशन इनपुट आकार के साथ वर्गानुपाती रूप से बढ़ता है, जबकि SSA को सब-क्वाड्रेटिक स्केलिंग के लिए डिज़ाइन किया गया है, जो O(n·k) के करीब है, O(n²) के बजाय, जहाँ k हर स्टेप पर चुने गए टोकनों की संख्या है। जब k को n के सापेक्ष छोटा रखा जाता है, तो यह फुल अटेंशन की तुलना में काफी अधिक कुशल होता है।

घने सर्व-से-सर्व संबंधों बनाम विरल चयनात्मक संबंधों को दर्शाता हुआ क्वाड्रेटिक बनाम रैखिक अटेंशन आरेख।

यहाँ स्पष्ट चिंता सटीकता की है। यदि मॉडल केवल इनपुट के एक हिस्से को देखता है, तो वह महत्वपूर्ण संबंधों को चूक सकता है। यही समझौता आमतौर पर डेंस अटेंशन के अस्तित्व का कारण है।

SubQ का दावा है कि यह समझौता व्यवहार में सामने नहीं आता। उनका कहना है कि मॉडल सभी आवश्यक टोकनों पर ध्यान देता है, भले ही वे वर्तमान टोकन से बहुत दूर हों, और शीर्ष मॉडलों जैसी सटीकता बनाए रखता है।

Subquadratic Sparse Attention कैसे काम करता है?

अब तक हम जानते हैं कि हर टोकन की हर दूसरे टोकन से तुलना करने के बजाय, SSA अनुक्रम में मायने रखने वाले टोकनों का चयन करता है और उन्हीं स्थानों पर अटेंशन की गणना करता है। देखते हैं यह चयन कैसे होता है।

SSA प्रासंगिक संबंध कैसे चुनता है

SSA कंटेंट-डिपेंडेंट रूटिंग का उपयोग करता है। सरल शब्दों में, यह वर्तमान टोकन से संबंधितता के आधार पर टोकन चुनता है। यह टोकनों के बीच समानता स्कोर गणना करता है, जैसे similarity(query_i, key_j), और अटेंशन के लिए केवल शीर्ष k सबसे अधिक स्कोर वाले टोकन रखता है।

समय के साथ, मॉडल सार्थक टोकनों को प्राथमिकता देना और शोर को नज़रअंदाज़ करना सीखता है। इसमें कीवर्ड, महत्वपूर्ण इकाइयाँ, और वे टोकन शामिल हैं जो मजबूत संदर्भ संकेत देते हैं।

यह केवल सामग्री पर निर्भर नहीं करता, SSA अनुक्रम में संरचनात्मक संबंधों को भी सुरक्षित रखता है। उदाहरण के लिए, पास के टोकनों को स्थानीय अटेंशन पैटर्न के माध्यम से हमेशा ध्यान मिलता है, जबकि कुछ ग्लोबल टोकन पूरे अनुक्रम में अटेंड करने के लिए डिज़ाइन किए गए हैं।

SSA में पदानुक्रमित और क्लस्टरिंग-आधारित अटेंशन तकनीकें भी शामिल हैं। उदाहरण के लिए, यह समान टोकनों को क्लस्टर करता है और सबसे प्रासंगिक क्लस्टरों के साथ अटेंशन गणना करता है। इसका मतलब है कि मॉडल को हर टोकन को अलग-अलग आंकने की जरूरत नहीं, वह पहले समूह-स्तर पर विचार कर सकता है, और आवश्यकता होने पर उन्हीं क्लस्टरों के भीतर टोकनों पर ज़ूम-इन कर सकता है।

लंबे संदर्भ-रीट्रीवल के लिए प्रशिक्षण

सिर्फ बड़ा संदर्भ-विंडो होना ही जादू नहीं करता। भले ही आप मॉडल को 12M टोकन दे दें, उसे उस संदर्भ का प्रभावी उपयोग करना आना चाहिए। SSA को इसी उद्देश्य से प्रशिक्षित किया गया है:

- प्री-ट्रेनिंग: बेस मॉडल को लंबे संदर्भ-प्रतिनिधित्व वाले विशाल, विविध डेटासेट्स पर प्रशिक्षित किया जाता है।

- सुपरवाइज्ड फाइन-ट्यूनिंग: इसके बाद मॉडल को संरचित कार्यों पर प्रशिक्षित किया जाता है, जिनमें रीज़निंग और कोड जनरेशन शामिल हैं।

- रिइनफोर्समेंट लर्निंग: मॉडल को सिर्फ पास के टोकन (लोकल अटेंशन) पर सीमित रखने के बजाय, यह चरण उसे पूरे पाठ (ग्लोबल अटेंशन) से प्रासंगिक टोकन उपयोग करने के लिए प्रेरित करता है।

रिइनफोर्समेंट लर्निंग चरण एंटरप्राइज़ कोडिंग उपयोग मामलों के लिए खास अहम है। यह मॉडल को एक बार में व्यापक संदर्भ—यहाँ पूरी कोडबेस—पर विचार करने देता है, जबकि आउटपुट जनरेट करता है।

SubQ बेंचमार्क्स और प्रदर्शन

ध्यान दें कि "SubQ 1M-Preview" उस संस्करण को संदर्भित करता है जिसे 1M टोकन पर बेंचमार्क किया गया है। पूरी 12M संदर्भ-विंडो API के जरिए सुलभ है।

Subquadratic द्वारा जारी तीन बेंचमार्क्स पर, SubQ 1M-Preview, Claude Opus 4.7, GPT-5.5, और Gemini 3.1 Pro के साथ कड़ी टक्कर लेता है।

लेकिन बेंचमार्क चयन सीमित है; ठीक तीन टेस्ट, और सभी लंबा संदर्भ-रीट्रीवल और कोडिंग पर केंद्रित—वही दो चीजें जिनके लिए SubQ स्पष्ट रूप से डिज़ाइन किया गया है। व्यापक मूल्यांकन—सामान्य तर्क, गणित, बहुभाषी प्रदर्शन, और सुरक्षा—प्रकाशित नहीं हुए हैं।

वेबसाइट पर पूरा मॉडल कार्ड "जल्द आ रहा है" के रूप में सूचीबद्ध है, इसलिए हम आशा कर सकते हैं कि वहाँ बेंचमार्क सामान्य उपयोग मामलों में भी दिखेंगे।

फिलहाल, यहाँ लंबे संदर्भ-रीट्रीवल और कोडिंग उपयोग मामलों के नतीजे दिए गए हैं:

|

मॉडल |

SWE-Bench Verified |

RULER 128K |

MRCR v2 (8-needle, 1M) |

|

SubQ (Subquadratic) |

81.8% |

95.0% |

65.9% |

|

Claude Opus 4.7 (Anthropic) |

87.6% |

94.8% |

32.2% |

|

GPT-5.5 (OpenAI) |

88.7% |

उपलब्ध नहीं |

74.0% |

|

Gemini 3.1 Pro (Google DeepMind) |

80.6% |

उपलब्ध नहीं |

26.3% |

|

DeepSeek V4 Pro (DeepSeek) |

80.6% |

उपलब्ध नहीं |

83.5% |

इन संख्याओं से क्या झलकता है

RULER 128K: SubQ 95% स्कोर करता है जबकि Opus 4.7 94.8% पर है। हालाँकि सटीकता का अंतर मामूली है, यहाँ वास्तविक मायने लागत के हैं: Subquadratic का दावा है कि SubQ पर यह इवैल चलाने की लागत लगभग $8 रही, जबकि Opus पर समान संदर्भ-लंबाई पर यह लगभग $2,600 रही।

MRCR v2 (8-needle, 1M): यह बेंचमार्क जाँचता है कि मॉडल 1M-टोकन संदर्भ में बिखरे 8 अलग-अलग तथ्यों को सही ढंग से रीट्रीव और ट्रैक करता है या नहीं। SubQ ने शोध में 83% का परिणाम दिखाया, पर प्रोडक्शन स्कोर 65.9% पर आ गया। लैब और डिप्लॉयड प्रदर्शन के बीच यह ~17 अंकों का अंतर उल्लेखनीय है और पूरी तरह स्पष्ट नहीं है। फिर भी, यह GPT-5.5 (74.0%) के साथ प्रतिस्पर्धी बना रहता है और Claude Opus 4.7 (32.2%) तथा Gemini 3.1 Pro (26.3%) से काफी आगे है।

SWE-Bench Verified: SubQ 81.8% स्कोर करता है, Opus 4.6 के 80.8% से आगे, लेकिन Opus 4.7 के 87.6% से पीछे। Opus 4.6 के मुकाबले मार्जिन छोटे हैं और हार्नेस सेटअप के प्रति संवेदनशील। Opus 4.7 और GPT-5.5 के मुकाबले SubQ स्पष्ट रूप से पीछे है।

12 मिलियन टोकन पर: रिपोर्ट है कि SubQ 12M संदर्भ पर needle-in-a-haystack कार्यों में 90% से ऊपर स्कोर करता है, हालांकि यह आँकड़ा आधिकारिक बेंचमार्क्स में सत्यापित नहीं हुआ है। इस लंबाई पर किसी अन्य अग्रिम मॉडल का परीक्षण नहीं हुआ है, इसलिए सीधी तुलना उपलब्ध नहीं है। यह लॉन्च से सबसे आर्किटेक्चरल रूप से दिलचस्प परिणाम है और निष्कर्ष निकालने से पहले स्वतंत्र पुनरुत्पादन की ज़रूरत भी सबसे अधिक इसी को है।

RAG, कोडिंग एजेंट्स, और AI लागतों के लिए SubQ का मतलब

यदि SubQ की आर्किटेक्चर स्केल पर टिकाऊ साबित होती है, तो यह LLM सिस्टम्स के निर्माण का तरीका बदल देती है। लंबा संदर्भ व्यावहारिक हो जाता है, जिससे आक्रामक चंकिंग, रीट्रीवल, और टोकन ऑप्टिमाइज़ेशन की जरूरत घटती है। आइए इन बदलावों को विस्तार से देखें।

जब RAG वैकल्पिक हो जाता है

पिछले दो सालों से, Retrieval-Augmented Generation (RAG) LLMs में एक बुनियादी सीमा का डिफ़ॉल्ट समाधान रहा है: मॉडल एक साथ सब कुछ नहीं पढ़ सकते। यदि आपका नॉलेज बेस संदर्भ-विंडो से बड़ा है, तो आप दस्तावेज़ों को चंक करते हैं, एम्बेड करते हैं, उन्हें वेक्टर डेटाबेस में स्टोर करते हैं, सबसे प्रासंगिक हिस्से रीट्रीव करते हैं, और केवल वही टुकड़े प्रॉम्प्ट के साथ मॉडल में पास करते हैं।

पूरा यह इकोसिस्टम इसलिए है क्योंकि संदर्भ दुर्लभ है।

जब कोई मॉडल एक ही पास में विश्वसनीय रूप से लाखों टोकन प्रोसेस कर सकता है, तो कुछ वर्कफ़्लो में रीट्रीवल के इर्द-गिर्द बनी कई इंजीनियरिंग परतें कम ज़रूरी हो जाती हैं। किस चंक को रीट्रीव करना है, इस पर समय लगाने के बजाय, सिस्टम कच्ची सामग्री सीधे इनजेस्ट कर सकता है और एंड-टू-एंड उस पर विचार कर सकता है।

हालाँकि, संदर्भ-विंडो से परे, RAG इन क्षमताओं के लिए अब भी मायने रखता है:

- क्रॉस-सेशन मेमोरी: LLMs किसी सेशन के खत्म होते ही कुछ याद नहीं रखते। यदि उपयोगकर्ता बाद में लौटता है, तो मॉडल फिर से शुरू करता है। रीट्रीवल सिस्टम (या डेटाबेस) महत्वपूर्ण जानकारी—जैसे पिछले निर्णय, दस्तावेज़, या उपयोगकर्ता डेटा—संग्रहित रखते हैं ताकि मॉडल भविष्य की इंटरैक्शन में उन्हें याद रख और उपयोग कर सके।

- अनुमतियाँ और एक्सेस कंट्रोल: रीट्रीवल सिस्टम ऐसे नियम लागू कर सकते हैं जैसे “यह उपयोगकर्ता केवल अपनी टीम का डेटा देख सकता है।” इस तरह, मॉडल को सिर्फ वही दस्तावेज़ मिलते हैं जिनकी उपयोगकर्ता को अनुमति है, जिससे डेटा-लीक की आशंका घटती है।

- ऑडिटेबिलिटी: एंटरप्राइज़ सेटिंग्स में, सिर्फ जवाब देना पर्याप्त नहीं; यह भी दिखाना होता है कि वह सही क्यों है। रीट्रीवल सिस्टम ठीक-ठीक उन दस्तावेज़ों या स्रोतों की ओर इशारा कर सकते हैं जिनका उपयोग हुआ, ताकि टीमें परिणाम सत्यापित कर सकें और कुछ गलत होने पर डिबग कर सकें।

- संरचित नॉलेज प्रबंधन: कंपनियाँ लगातार दस्तावेज़ जोड़ती, अपडेट करती और हटाती रहती हैं। रीट्रीवल सिस्टम एम्बेडिंग्स और इंडेक्सिंग का उपयोग कर इस डेटा को व्यवस्थित करते हैं ताकि मॉडल हर बार सब कुछ फिर से प्रोसेस किए बिना, जल्दी से नवीनतम और सबसे प्रासंगिक जानकारी पा सके।

AI एजेंट्स में स्थायी मेमोरी जोड़ने के एक नए, दिलचस्प तरीके के लिए हमारा Supermemory Tutorial पढ़ें, जिसमें आप शॉर्ट- और लॉन्ग-टर्म मेमोरी वाला एक एक्सरसाइज़ ट्रेनर बनाना सीखेंगे।

लंबे संदर्भ वाली कोडिंग वर्कफ़्लोज़

अभी ज्यादातर कोडिंग मॉडल पूरी कोडबेस नहीं देख पाते। इसलिए हम ऊपर परतें जोड़ते हैं—फाइल सर्च, चंकिंग, रैंकिंग, और मल्टी-स्टेप प्लानिंग—ताकि सही संदर्भ विंडो में रहे और फाइलों के पार संबंध बन सकें।

लेकिन SubQ की 12M संदर्भ-विंडो के साथ, पूरी कोडबेस एक साथ मॉडल में लोड हो जाती है। यह एजेंट डिज़ाइन को सार्थक रूप से सरल बनाता है।

- प्लानिंग ग्लोबल हो जाती है: मॉडल आर्किटेक्चर, डिपेंडेंसी, और क्रॉस-फाइल इंटरैक्शन पर बिना संदर्भ खोए विचार कर सकता है।

- एक्जीक्यूशन अधिक सुसंगत होता है: कई फाइलों में बदलाव एक ही पास में समन्वित किए जा सकते हैं, क्रमिक अपडेट के बजाय।

- रिव्यू अधिक विश्वसनीय होता है: मॉडल पूरी कोडबेस के संदर्भ में अपने बदलावों की जाँच कर सकता है, असंगतियाँ घटती हैं।

लागत अर्थशास्त्र

मानक ट्रांसफॉर्मर मॉडलों में, अटेंशन अनुक्रम-लंबाई के साथ वर्गानुपाती स्केल करता है। यदि आप संदर्भ को दोगुना करते हैं, तो लागत सिर्फ दोगुनी नहीं, चार गुना तक हो सकती है।

SubQ इस समझौते को तोड़ने का दावा करता है।

- यह तुलनीय अग्रिम मॉडलों (Claude Opus) की तुलना में ~1/20 लागत रिपोर्ट करता है

- और 12M-टोकन संदर्भ पर ~1,000× कंप्यूट में कमी तक

यदि यह प्रोडक्शन में सही बैठता है, तो लंबा संदर्भ प्रोसेसिंग महंगा किनारी मामला होने से हटकर कुछ ऐसा बन जाता है जिसे आप नियमित रूप से उपयोग कर सकें।

हालाँकि, सस्ता संदर्भ-विंडो होने के साथ, मॉडल में लोड की गई जानकारी का कुशल उपयोग करने की क्षमता भी होनी चाहिए। बेंचमार्क्स के आधार पर, SubQ समान सटीकता का दावा करता है वह भी कहीं कम लागत पर, लेकिन अंतिम राय देना अभी जल्दबाज़ी होगा।

मैं SubQ तक कैसे पहुँच सकता/सकती हूँ?

SubQ अभी सार्वजनिक रूप से उपलब्ध नहीं है। तीनों प्रोडक्ट—कोर API, SubQ Code, और SubQ Search—फिलहाल प्राइवेट बीटा में हैं, और एक्सेस के लिए SubQ वेबसाइट के जरिए अर्ली-एक्सेस अनुरोध की आवश्यकता है।

डेवलपर के नजरिए से, API को इंटीग्रेट करना आसान रखा गया है। यह सपोर्ट करता है:

- स्ट्रीमिंग रिस्पॉन्स

- टूल/फंक्शन कॉलिंग

- OpenAI-कम्पैटिबल एंडपॉइंट्स

इसका मतलब, यदि आपका स्टैक पहले से OpenAI-स्टाइल APIs के साथ काम करता है, तो आमतौर पर आपको अपना इंटीग्रेशन फिर से नहीं लिखना पड़ेगा।

SubQ Code को कमांड-लाइन कोडिंग एजेंट के रूप में पेश किया गया है, जबकि SubQ Search गहन शोध वर्कफ़्लोज़ के लिए लंबे संदर्भ वाली सर्च पर केंद्रित है। इन्हें Claude Code और Perplexity के SubQ संस्करणों के रूप में सोचें।

इनमें से किसी के लिए भी प्राइसिंग अभी पारदर्शी नहीं है। सार्वजनिक रूप से प्रति-टोकन दरें उपलब्ध नहीं हैं, जिससे कंपनी के लागत दावों को स्वतंत्र रूप से सत्यापित करना कठिन हो जाता है।

संशय और खुले प्रश्न

लॉन्च के कुछ ही घंटों के भीतर, सोशल मीडिया प्लेटफॉर्म्स और Hacker News जैसे मैसेज बोर्डों पर पहले से ही काफी संशय और मिली-जुली प्रतिक्रियाएँ दिखीं। चर्ऩा विभाजित है—कुछ इसे वास्तविक सफलता मानते हैं, जबकि अन्य इसे “AI Theranos” से तुलना करते हैं (धोखाधड़ी भरे तकनीकी दावों वाली विफल ब्लड-टेस्टिंग स्टार्टअप का संदर्भ)।

अधिकांश शंकाएँ इन बिंदुओं पर केंद्रित हैं:

- वे 12M संदर्भ-विंडो का दावा करते हैं, लेकिन साझा किए गए बेंचमार्क सभी 1M पर हैं।

- उन्होंने कंपनी का नाम Subquadratic रखा, लेकिन कुछ जगहों पर O(1)-जैसी स्केलिंग का उल्लेख करते हैं। O(1) पर, आप 12M टोकन संदर्भ-विंडो से कहीं अधिक की उम्मीद करेंगे। यहाँ तक कि O(log n) भी बड़े सीमाएँ देने चाहिए।

2024 में Magic.dev के साथ भी ऐसी ही कथा दिखी थी। उन्होंने अत्यंत बड़े संदर्भ-विंडो—100M टोकन तक—और बड़े पैमाने पर दक्षता वृद्धि, खासकर कोडिंग वर्कफ़्लोज़ के लिए, के बारे में मजबूत दावे किए।

पिच लगभग समान थी: पूरी कोडबेस लोड करें, रीट्रीवल जटिलता घटाएँ, और एजेंट डिज़ाइन सरल करें। लेकिन, कम से कम सार्वजनिक रूप से, परिणाम ज्यादा मृदु रहे हैं। लगभग $500M जुटाने के बावजूद, 2026 की शुरुआत तक वास्तविक दुनिया में दृश्यता या अपनाने में अब भी कमी है।

क्या सत्यापित हुआ है

SubQ के दावे पूरी तरह सैद्धांतिक नहीं हैं। Subquadratic बताता है कि RULER, MRCR v2, और SWE-Bench Verified पर बेंचमार्क एक तृतीय-पक्ष परीक्षण सेवा द्वारा चलाए गए, जो लंबे संदर्भ-रीट्रीवल पर मजबूत प्रदर्शन और कोडिंग कार्यों पर प्रतिस्पर्धी नतीजे दिखाते हैं।

हालाँकि, इन परिणामों की अभी बाहरी शोधकर्ताओं द्वारा स्वतंत्र पुनरुत्पादन नहीं हुआ है, और मूल्यांकन का दायरा सीमित है। तीनों बेंचमार्क ठीक उन्हीं क्षेत्रों पर जोर देते हैं जिनके लिए SubQ बना है (बड़े संदर्भ से संकेत निकालना और कोड पर काम करना)।

एक और महत्वपूर्ण विवरण आर्किटेक्चर का है। CTO ने पुष्टि की है कि SubQ मॉडलों को शून्य से ट्रेन नहीं करता, बल्कि ओपन-सोर्स बेस मॉडलों (संभवतः DeepSeek या Kimi परिवार) पर निर्माण करता है। यह एक छोटे दल के लिए व्यावहारिक विकल्प है—इटरेशन तेज़ होता है और ट्रेनिंग लागत घटती है। इसका मतलब यह भी है कि मुख्य नवाचार बास मॉडल नहीं, बल्कि अटेंशन मेकैनिज्म और उसके चारों ओर का सिस्टम डिज़ाइन है।

अंतिम विचार

SubQ आ चुका है, और दावे काफी साहसिक हैं। दिशा स्पष्ट है: संदर्भ-विंडो की बाधा हटाएँ और मॉडलों को कहीं बड़े इनपुट संभालने दें। वे इसे कोडिंग और लंबे संदर्भ-रीट्रीवल पर अग्रिम मॉडलों के बराबर या बेहतर, वह भी बहुत कम लागत पर, के रूप में पेश कर रहे हैं।

फिर भी, यह अभी शुरुआती चरण है। व्यापक क्षमताओं और परीक्षणों पर अधिक दृश्यता के लिए हम अब भी पूरे मॉडल कार्ड का इंतज़ार कर रहे हैं। इसके ऊपर बने प्रोडक्ट—SubQ Code और API—भी अभी सार्वजनिक रूप से उपलब्ध नहीं हैं। मैं इन टूल्स को हाथों-हाथ आज़माने और देखने के लिए उत्सुक हूँ कि दावे प्रोडक्शन में कैसे टिकते हैं।

SubQ मॉडल FAQs

क्या SubQ प्रॉम्प्ट लिखने का तरीका बदल देगा?

संभव है। यदि दावे सही साबित होते हैं और लंबा संदर्भ काफी सस्ता हो जाता है, तो प्रॉम्प्ट डिज़ाइन भारी-भरकम अनुकूलित या संक्षिप्त इनपुट्स की बजाय अधिक कच्ची जानकारी शामिल करने की ओर शिफ्ट हो सकता है।

क्या SubQ छवियों और कोड जैसे मल्टीमोडल इनपुट संभाल सकता है?

Subquadratic की अपनी वेबसाइट उनकी आर्किटेक्चर को "बड़े संदर्भ, मल्टी-मोडल इनफ़ेरेंस" सक्षम बताते हुए वर्णित करती है, जिससे संकेत मिलता है कि मल्टीमोडल सपोर्ट उनकी दृष्टि का हिस्सा है। हालाँकि, कोई मल्टीमोडल बेंचमार्क प्रकाशित नहीं हुए हैं, और प्राइवेट बीटा में मौजूदा API और प्रोडक्ट पूरी तरह टेक्स्ट और कोड पर केंद्रित हैं। इमेज इनपुट उपलब्ध है या निकट भविष्य में योजनाबद्ध है—यह स्पष्ट रूप से दस्तावेज़ीकृत नहीं है।

बहुत छोटे इनपुट्स पर SubQ का प्रदर्शन कैसा है?

प्रकाशित सभी बेंचमार्क SubQ का 128K टोकन और उससे ऊपर पर परीक्षण करते हैं। छोटे, मानक-लंबाई इनपुट्स पर अग्रिम मॉडलों के मुकाबले यह कैसा करता है—यह खुलासा नहीं किया गया है। विरल अटेंशन मेकैनिज्म कभी-कभी छोटे अनुक्रमों पर कमतर प्रदर्शन कर सकते हैं, जहाँ टोकन-चयन का ओवरहेड दक्षता लाभ से भारी पड़ता है। पूरा मॉडल कार्ड आते ही इस पर नज़र रखना होगा।

क्या कंपनी अगला लक्ष्य 50M या 100M टोकन रख रही है?

The New Stack ने रिपोर्ट किया है कि Subquadratic ने Q4 लक्ष्य के रूप में 50 मिलियन टोकन संदर्भ-विंडो तय की है। यदि आर्किटेक्चर रैखिक रूप से स्केल करता है, तो यह तकनीकी रूप से संभव है।