Programma

La containerizzazione è diventata la soluzione di riferimento per creare, distribuire e scalare applicazioni moderne in modo efficiente. Due nomi di spicco in questo ambito sono Kubernetes e Docker e, anche se vengono spesso menzionati insieme, in realtà hanno scopi differenti. Entrambi sono fondamentali, ma svolgono lavori distinti.

In questa guida ti aiuterò a capire cosa distingue Kubernetes e Docker, le loro caratteristiche e quando usare l’uno o l’altro.

Che cos’è la containerizzazione?

Prima di addentrarci in Docker e Kubernetes, facciamo prima chiarezza su ciò di cui si occupano, ovvero la containerizzazione.

La containerizzazione è una forma leggera di virtualizzazione che impacchetta un’applicazione e le sue dipendenze in un’unica unità chiamata container.

A differenza delle macchine virtuali tradizionali, i container condividono il sistema operativo dell’host ma mantengono l’isolamento tra le applicazioni. Questo li rende più efficienti, leggeri e veloci ad avviarsi!

La containerizzazione aiuta gli sviluppatori a creare ambienti coerenti, portabili e facili da gestire, indipendentemente da dove vengano eseguiti—che sia sul laptop di uno sviluppatore, in un data center o nel cloud.

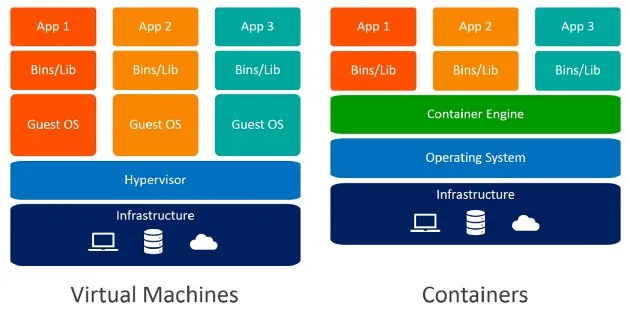

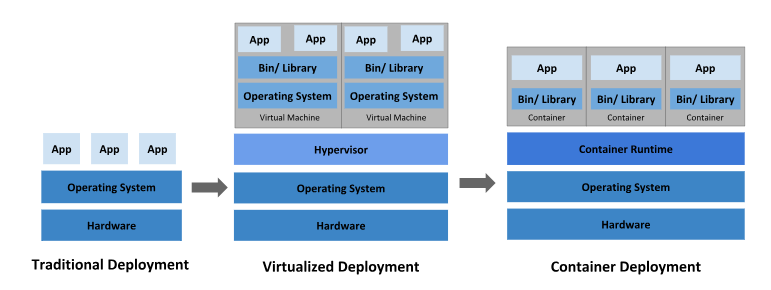

Containerizzazione vs virtualizzazione

È utile confrontare la containerizzazione con la virtualizzazione tradizionale per capirla meglio. Le macchine virtuali (VM) virtualizzano interi sistemi hardware, il che significa che ogni VM include un sistema operativo completo insieme ai binari e alle librerie necessari. Questo approccio offre isolamento ma comporta un notevole overhead di risorse—ogni VM richiede un proprio OS, rendendola dispendiosa in termini di risorse e più lenta all’avvio.

I container, invece, condividono il kernel del sistema operativo dell’host, risultando molto più leggeri e rapidi da avviare. Invece di virtualizzare l’hardware, i container virtualizzano il sistema operativo. Questo consente di eseguire processi isolati senza l’overhead di un OS completo per ogni istanza, con un migliore utilizzo delle risorse ed efficienza.

Le VM sono ottime per un isolamento completo e per eseguire più sistemi operativi diversi sullo stesso hardware, mentre i container sono più adatti a un deployment efficiente, scalabile e coerente delle applicazioni.

Macchine virtuali vs container. Fonte immagine: contentstack.io

Se vuoi approfondire gli elementi essenziali di VM, container, Docker e Kubernetes, dai un’occhiata al corso gratuito Containerization and Virtualization Concepts su Datacamp.

Ora entriamo nei dettagli di Docker e Kubernetes!

Che cos’è Docker?

Docker è una piattaforma open-source che fornisce un modo leggero e portabile per creare, distribuire e gestire container. A differenza delle macchine virtuali tradizionali, i container Docker impacchettano tutto—compreso il codice dell’applicazione, il runtime, gli strumenti di sistema e le librerie—consentendo alle applicazioni di funzionare in modo coerente su ambienti diversi.

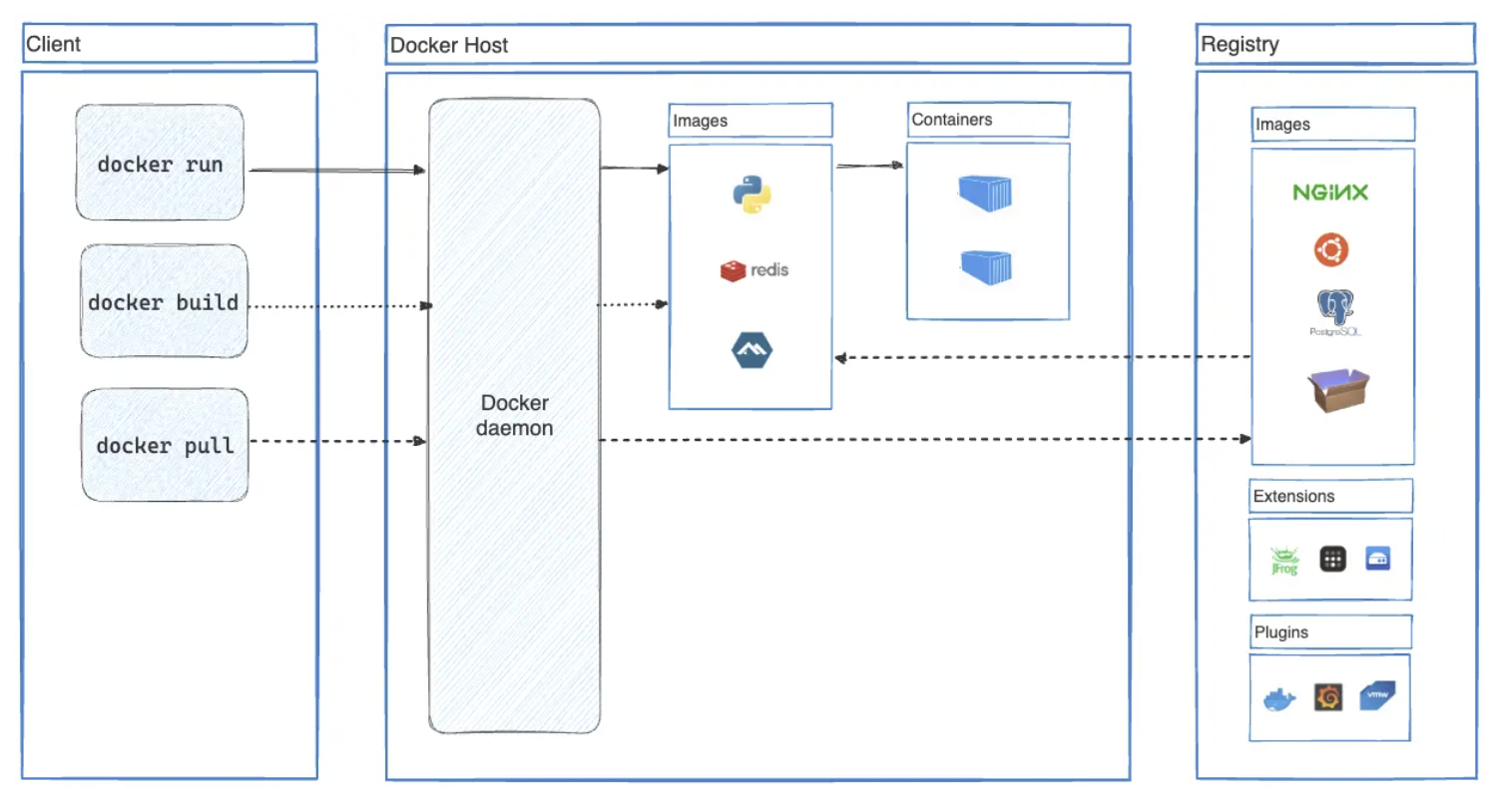

Come funziona Docker

Docker funziona creando container che, come abbiamo visto, sono pacchetti leggeri che racchiudono tutti i componenti necessari per eseguire un’applicazione.

I container sono costruiti a partire dalle Docker image, che fungono da blueprint e definiscono cosa c’è dentro ogni container. Una Docker image può includere un sistema operativo, i binari dell’applicazione e i file di configurazione, semplificando la replica degli ambienti.

Una volta creata un’immagine, gli sviluppatori possono usare Docker per eseguire container basati su quell’immagine. Uno dei maggiori punti di forza di Docker è la sua semplicità e coerenza: indipendentemente da dove venga eseguito un container—sulla macchina locale di uno sviluppatore, in un data center on-premises o nel cloud—il comportamento rimane lo stesso.

Panoramica dell’architettura Docker. Fonte immagine: documentazione Docker

Il seguente esempio fornisce una panoramica di come vengono implementate le Docker image. Dai un’occhiata al Dockerfile qui sotto:

# Use the official Python base image with version 3.9

FROM python:3.9

# Set the working directory within the container

WORKDIR /app

# Copy the requirements file to the container

COPY requirements.txt .

# Install the dependencies

RUN pip install -r requirements.txt

# Copy the application code to the container

COPY . .

# Set the command to run the application

CMD ["python", "app.py"]Un Dockerfile è uno script che contiene una serie di istruzioni per permettere a Docker di costruire un’immagine, che potrà poi essere usata per creare un container.

Dopo aver creato un Dockerfile nel tuo progetto, il passo successivo è creare la Docker image. Questo si fa con il comando docker build, che legge le istruzioni nel Dockerfile per assemblare l’immagine.

Ad esempio, eseguire docker build -t my-app . nel terminale indica a Docker di costruire un’immagine con il tag my-app dalla directory corrente (indicata da .).

Durante il processo di build, Docker esegue ogni step nel Dockerfile, come scaricare l’immagine base, installare le dipendenze e copiare il codice dell’applicazione nell’immagine. Una volta creata, l’immagine funge da template riutilizzabile per creare più container.

Dopo che l’immagine è stata costruita con successo, puoi creare ed eseguire container a partire da essa usando il comando docker run. Per esempio, docker run my-app avvia un nuovo container basato sull’immagine my-app, lanciando la tua applicazione nell’ambiente isolato fornito da Docker.

Se vuoi saperne di più sui comandi Docker più comuni e sulle migliori pratiche del settore, leggi il blog Docker for Data Science: An Introduction.

Caratteristiche di Docker

- Portabilità: i container Docker possono essere eseguiti in modo coerente su sistemi diversi, offrendo un’esperienza uniforme tra sviluppo, test e produzione.

- Facilità d’uso: l’interfaccia a riga di comando e l’ampia serie di strumenti rendono Docker accessibile agli sviluppatori, anche a chi è nuovo alla containerizzazione.

- Leggerezza: i container Docker condividono lo stesso kernel dell’OS, riducendo l’overhead di risorse rispetto alle macchine virtuali complete.

- Avvio rapido: i container Docker possono essere avviati in pochi secondi, risultando molto efficaci per applicazioni che richiedono spin-up e teardown rapidi.

Dai un’occhiata al cheat sheet su Docker di DataCamp, che offre una panoramica di tutti i comandi disponibili.

Che cos’è Kubernetes?

Kubernetes è una potente piattaforma open-source di orchestrazione dei container progettata per gestire applicazioni containerizzate su cluster di macchine.

Sviluppato inizialmente da Google, Kubernetes—spesso abbreviato in K8s—si occupa del deployment, dello scaling e delle operazioni dei container applicativi, rendendolo uno strumento essenziale per la gestione dei container su larga scala.

Evoluzione delle strategie di deployment nel tempo. Fonte immagine: Kubernetes.io

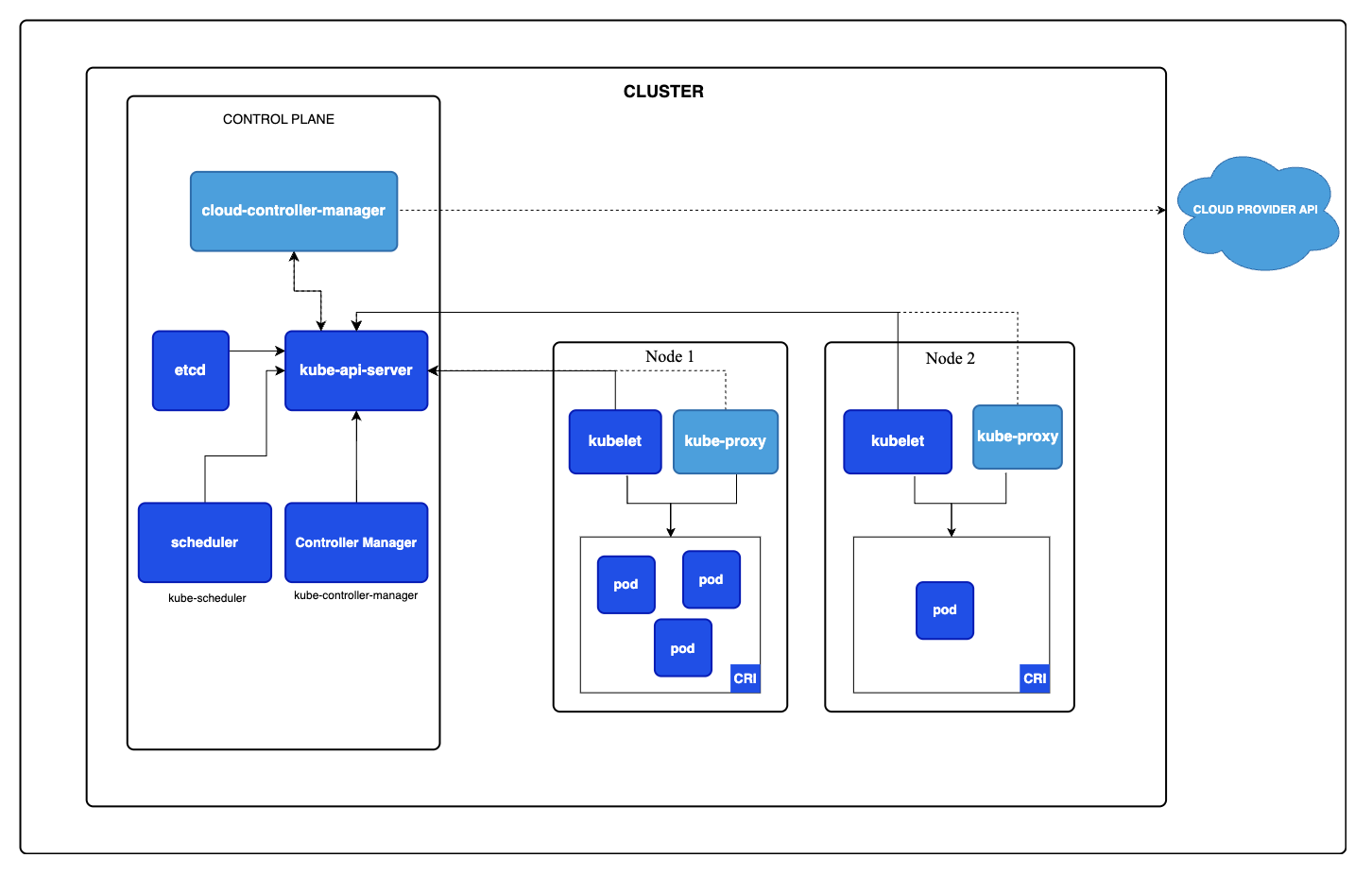

Come funziona Kubernetes

Kubernetes si basa sui concetti di cluster, nodi e pod, formando un’architettura a livelli che offre flessibilità e scalabilità. Un cluster rappresenta l’intera infrastruttura, composta da più nodi (macchine virtuali o fisiche).

Questi nodi lavorano insieme per ospitare e gestire applicazioni containerizzate. I nodi possono essere master, che controllano e gestiscono il cluster, oppure worker, che eseguono i carichi di lavoro applicativi. Il master si occupa di gestire lo stato del cluster, prendere decisioni di scheduling e monitorarne la salute.

Ogni nodo worker esegue uno o più pod, le unità minime distribuibili in Kubernetes, composte da uno o più container.

I pod agiscono come host logici per i container e condividono la stessa rete e lo stesso storage, facilitando la comunicazione tra i container all’interno del pod. I pod sono per natura effimeri, cioè possono essere creati, distrutti o replicati dinamicamente in base alle esigenze dell’applicazione.

Panoramica dell’architettura Kubernetes. Fonte immagine: Kubernetes.io

Kubernetes astrae la complessità della gestione dell’infrastruttura fornendo una potente API e una suite di strumenti per gestire applicazioni containerizzate. Mantiene le applicazioni in esecuzione senza intoppi distribuendo i carichi di lavoro, scalando le risorse in base alla domanda e riavviando i container in caso di errore.

Kubernetes gestisce anche lo stato desiderato delle applicazioni, garantendo che il numero di pod e la loro configurazione corrispondano sempre a quanto specificato e che le interruzioni vengano corrette automaticamente. Questa automazione riduce lo sforzo manuale per la gestione dell’infrastruttura e aumenta l’affidabilità e la resilienza delle applicazioni.

Caratteristiche di Kubernetes

- Scalabilità automatica: Kubernetes può scalare automaticamente le applicazioni in base alle richieste di risorse, ottimizzando l’utilizzo e mantenendo prestazioni costanti.

- Bilanciamento del carico: Kubernetes distribuisce efficacemente il traffico di rete in ingresso tra più container, garantendo disponibilità e resilienza.

- Service discovery: Kubernetes fornisce servizi per scoprire automaticamente i container, eliminando la necessità di gestire manualmente gli endpoint.

- Rolling update: Kubernetes consente di aggiornare le applicazioni con downtime minimo, garantendo stabilità e affidabilità durante gli upgrade.

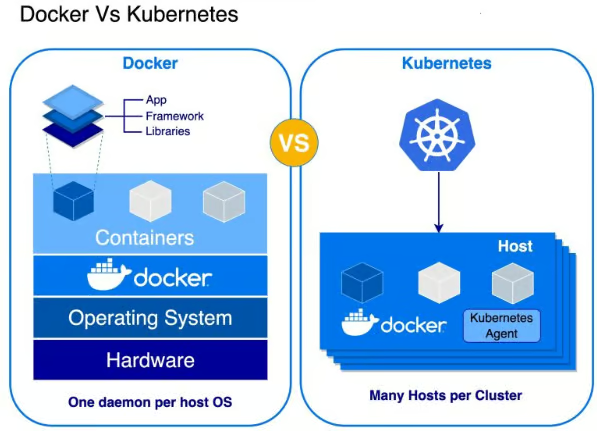

Kubernetes vs Docker: differenze principali

Ora che abbiamo una migliore comprensione di Docker e Kubernetes, è il momento di evidenziarne le principali differenze:

1. Scopo e funzione

Docker e Kubernetes risolvono problemi diversi nel processo di containerizzazione. Docker viene utilizzato per creare, distribuire ed eseguire container—fornisce i mezzi per creare ambienti isolati per le applicazioni.

Kubernetes, invece, si concentra sull’orchestrazione dei container, ovvero aiuta a gestire, scalare e garantire il corretto funzionamento di grandi insiemi di container.

2. Gestione dei container

Docker gestisce i singoli container, mentre Kubernetes gestisce più container su cluster.

Docker offre funzionalità di orchestrazione di base tramite Docker Compose e Docker Swarm, ma Kubernetes porta l’orchestrazione a un livello superiore, gestendo scenari complessi che coinvolgono migliaia di container.

3. Orchestrazione delle applicazioni

Per quanto riguarda l’orchestrazione avanzata, Kubernetes fornisce funzionalità come self-healing, bilanciamento del carico, rollout automatici e scalabilità.

Docker Swarm è lo strumento di orchestrazione nativo di Docker, ma Kubernetes è emerso come la soluzione preferita per orchestrare ambienti complessi e su larga scala grazie alle sue capacità avanzate e al più ampio supporto dell’ecosistema.

Docker vs Kubernetes. Fonte immagine: Alex Xu / ByteByteGo

Casi d’uso di Docker

Tenendo a mente le informazioni su Docker, ecco alcuni dei casi d’uso più comuni:

1. Sviluppo e test in locale

Docker è prezioso per lo sviluppo locale. Gli sviluppatori possono creare ambienti containerizzati che imitano la produzione, garantendo un comportamento coerente lungo tutto il ciclo di vita del software.

2. Applicazioni leggere

Docker è un’ottima scelta per casi d’uso più semplici che non richiedono orchestrazione. La sua semplicità emerge in scenari come l’esecuzione di applicazioni su piccola scala o il deployment di servizi standalone.

3. Pipeline CI/CD

Docker è ampiamente utilizzato nelle pipeline di Continuous Integration e Continuous Deployment (CI/CD). Garantisce che ogni fase—dalla creazione del codice al test—avvenga in un ambiente coerente e riproducibile, riducendo le sorprese in produzione.

Casi d’uso di Kubernetes

Kubernetes viene usato più comunemente nei seguenti scenari:

1. Gestione di applicazioni containerizzate su larga scala

Kubernetes brilla negli ambienti su larga scala. Può gestire migliaia di container su molti nodi in un cluster distribuito. Organizzazioni come Spotify e Airbnb usano Kubernetes per mantenere in funzione senza intoppi le loro complesse applicazioni basate su microservizi.

2. Scalabilità automatica e resilienza

Kubernetes scala automaticamente i container in base ai requisiti di sistema, rispondendo in modo dinamico a richieste variabili. Inoltre, Kubernetes ha meccanismi di self-healing integrati—riavvia i container in errore e sostituisce i nodi non responsivi per mantenere l’operatività dell’applicazione.

3. Architettura a microservizi

Kubernetes è ideale per gestire i microservizi in ambienti di produzione. La sua capacità di gestire numerosi servizi e le loro dipendenze, facilitandone al contempo la comunicazione, lo rende perfetto per applicazioni complesse e distribuite.

Kubernetes e Docker possono funzionare insieme?

A questo punto è chiaro che Docker e Kubernetes sono pensati per lavorare insieme.

Kubernetes utilizza runtime di container per eseguire i singoli container e Docker è tradizionalmente stato uno di questi runtime. Pur avendo ruoli distinti, lavorano molto bene insieme! Docker crea ed esegue i container, mentre Kubernetes orchestra quei container sui cluster.

Docker Swarm vs Kubernetes

Docker Swarm è lo strumento di orchestrazione nativo di Docker, adatto ad ambienti più semplici e meno esigenti.

Kubernetes, però, è diventato lo standard del settore per l’orchestrazione dei container grazie al set di funzionalità più ricco, alla scalabilità e al forte supporto della community. Sebbene Docker Swarm sia più semplice da configurare, Kubernetes offre funzionalità di orchestrazione più sofisticate e flessibilità.

Come scegliere tra Kubernetes e Docker

In sintesi, quando conviene scegliere Docker, Kubernetes o entrambi? Ecco alcune linee guida generali per aiutarti nella scelta.

Quando usare Kubernetes

Kubernetes è ideale per gestire ambienti complessi e su larga scala. Se stai costruendo un’architettura a microservizi o devi scalare dinamicamente le applicazioni con downtime minimo, è la scelta preferita. La sua capacità di orchestrare sistemi distribuiti lo rende uno standard di settore per deployment più ampi e complessi.

Quando usare Docker

Docker è adatto per sviluppare piccole applicazioni standalone o ambienti in cui l’orchestrazione non è necessaria. Per progetti personali, sviluppo locale o gestione di app leggere senza bisogno di scalare su più nodi, Docker offre tutto ciò che serve.

Quando usare Kubernetes e Docker insieme

Come detto, Kubernetes e Docker possono (e dovrebbero) essere usati insieme in determinate situazioni.

Per esempio, gli sviluppatori spesso usano Docker per containerizzare le applicazioni in fase di sviluppo e poi distribuiscono e orchestrano quei container con Kubernetes in produzione. Questo flusso di lavoro permette ai team di sfruttare la facilità d’uso di Docker per lo sviluppo e le funzionalità avanzate di Kubernetes per l’orchestrazione.

Vuoi mostrare al mondo le tue competenze su Docker? Se sei pronto per la certificazione, dai un’occhiata a questa Guida completa gratuita alla certificazione Docker (DCA) per il 2024.

Conclusione

Kubernetes e Docker sono entrambi strumenti essenziali per la containerizzazione, ma hanno scopi diversi.

Docker semplifica la creazione e l’esecuzione dei container, risultando perfetto per lo sviluppo locale e le applicazioni leggere. Kubernetes, invece, è una piattaforma robusta per orchestrare quei container su larga scala, indispensabile per gestire ambienti complessi e distribuiti.

In definitiva, la scelta tra Kubernetes e Docker dipende dalle esigenze del tuo progetto—gli ambienti di sviluppo su piccola scala traggono beneficio da Docker, mentre i sistemi di produzione su larga scala richiedono Kubernetes per un’orchestrazione efficace. In molti casi, questi strumenti si completano, offrendo un approccio completo per costruire e distribuire applicazioni moderne.

Se sei pronto ad avanzare con le tue competenze, esplora Introduction to Kubernetes e Intermediate Docker su DataCamp per approfondire la tua comprensione e la pratica.

FAQs

Qual è il ruolo di Docker Compose e in cosa differisce da Kubernetes?

Docker Compose è uno strumento per definire ed eseguire applicazioni Docker multi-container su un singolo host. È ideale per lo sviluppo locale e per deployment semplici, ma non offre le funzionalità di scalabilità, self-healing e orchestrazione che fornisce Kubernetes. Kubernetes, invece, è progettato per gestire applicazioni multi-container su larga scala attraverso cluster di macchine.

Docker Swarm può essere usato come alternativa a Kubernetes per l’orchestrazione?

Sì, Docker Swarm può orchestrare i container e fornisce funzionalità di clustering native per i container Docker. Tuttavia, è più semplice e non dispone delle funzionalità avanzate, della scalabilità e dell’ecosistema offerti da Kubernetes. Kubernetes è generalmente preferito per i deployment a livello di produzione, mentre Docker Swarm può essere sufficiente per progetti più piccoli e semplici.

Come si confronta la curva di apprendimento di Kubernetes con quella di Docker?

Docker ha una curva di apprendimento più dolce, poiché si concentra sulle basi della containerizzazione ed è relativamente facile da configurare e gestire su un singolo sistema. Kubernetes, invece, ha una curva di apprendimento più ripida a causa di funzionalità complesse come la gestione del cluster, la scalabilità e il networking. Si consiglia di partire dalle nozioni fondamentali di Docker prima di passare a Kubernetes.

Ci sono differenze di prestazioni tra l’uso di Docker e Kubernetes?

I container Docker sono leggeri ed efficienti su un singolo host, rendendoli adatti ad applicazioni con overhead minimo di risorse. Kubernetes introduce un consumo aggiuntivo di risorse per la gestione del cluster, che può essere più pesante rispetto a Docker standalone. Tuttavia, le capacità di orchestrazione di Kubernetes spesso compensano questo compromesso nelle applicazioni su larga scala, dove affidabilità e scalabilità sono prioritarie.