Cursus

Temidden van de Amerikaans-Chinese techspanning en een golf aan betaalbare Chinese modellen zoals Zhipu’s GLM-5 en Moonshot’s Kimi K2.5, duikt er een nieuwe speler op die opvalt met SOTA-benchmarks voor een fractie van de verwachte kosten.

Het MiniMax 2.5-model is deels belangrijk vanwege de prijs. Het past in de bredere trend richting “intelligentie zo goedkoop dat je het niet hoeft te meten”, een herinterpretatie van een oude uitdrukking over kernenergie.

MiniMax 2.5 is beschikbaar in twee varianten: de volledige M2.5 met 50 tokens/seconde en de Lightning-variant met, naar mijn idee, opvallende 100 tokens/seconde. Behalve het snelheidsverschil hebben beide varianten identieke capaciteiten.

In dit artikel leg ik uit wat M2.5 is en wat de belangrijkste kenmerken zijn, help ik je met ideeën voor je eigen tests en geef ik eerlijke vergelijkingen met de nieuwste GPT- en Gemini-modellen.

Wat is MiniMax M2.5?

MiniMax M2.5 is een zeer recent open-weight large language model van het in Shanghai gevestigde MinMax AI. Het werd primair aangekondigd op 12 februari 2026, enkele weken na de beursgang in Hongkong.

MiniMax AI is ontworpen voor productiviteit in de echte wereld en blinkt daarom uit in coderen, agentische toolgebruik, webzoekopdrachten en kantoorautomatisering. M2.5 is getraind via reinforcement learning in meer dan 200.000 complexe omgevingen. Hierdoor is het robuust genoeg om te plannen als een software-architect en autonoom uit te voeren.

Belangrijkste kenmerken van MiniMax M2.5

Het nieuwe model biedt verschillende features die het laten opvallen ten opzichte van andere LLM’s. In deze sectie noem ik er een paar.

Meertalige ondersteuning voor coderen

MiniMax M2.5 is getraind op een spaarzame dataset, waardoor het meer dan 10 programmeertalen aankan, zoals Python, Rust, Java, Go en andere, in verschillende fullstack-ontwikkelomgevingen. De vaardigheden variëren van systeemontwerp tot code review en omvatten web-, Android-, iOS- en Windows-applicaties.

Agentisch toolgebruik en zoekopdrachten

Het M2.5-model leidt in een multi-turn functieaanroep-taak met 76,9% op BFCL, en webnavigatie met 76,3% op BrowseComp, terwijl het 20% minder rondes gebruikt dan voorgangers voor efficiënte taakdecompositie.

Integratie met kantoorproductiviteit

Naast agentisch toolgebruik en zoekmogelijkheden genereerde het M2.5-model opgemaakte outputs voor Word, PowerPoint en Excel, zoals bij financiële modellen, met een winstpercentage van 59% ten opzichte van mainstream modellen op de GDPval-MM-benchmarks.

Efficiëntie en RL-training

Aangedreven door het Forge RL-framework en het CISPO-algoritme rondt het taken 37% sneller af dan M2.1, terwijl het minder tokens verbruikt, specifiek 3,52M per SWE-Bench-taak.

Hands-on met MiniMax M2.5

Ik besloot MiniMax M2.5 zelf te testen. Geïnspireerd door M2.5’s grote claims rond agentisch toolgebruik en zoeken, én de focus op kantoorproductiviteit, gaf ik het een onderzoekstaak die zo op iemands werk kan voorkomen.

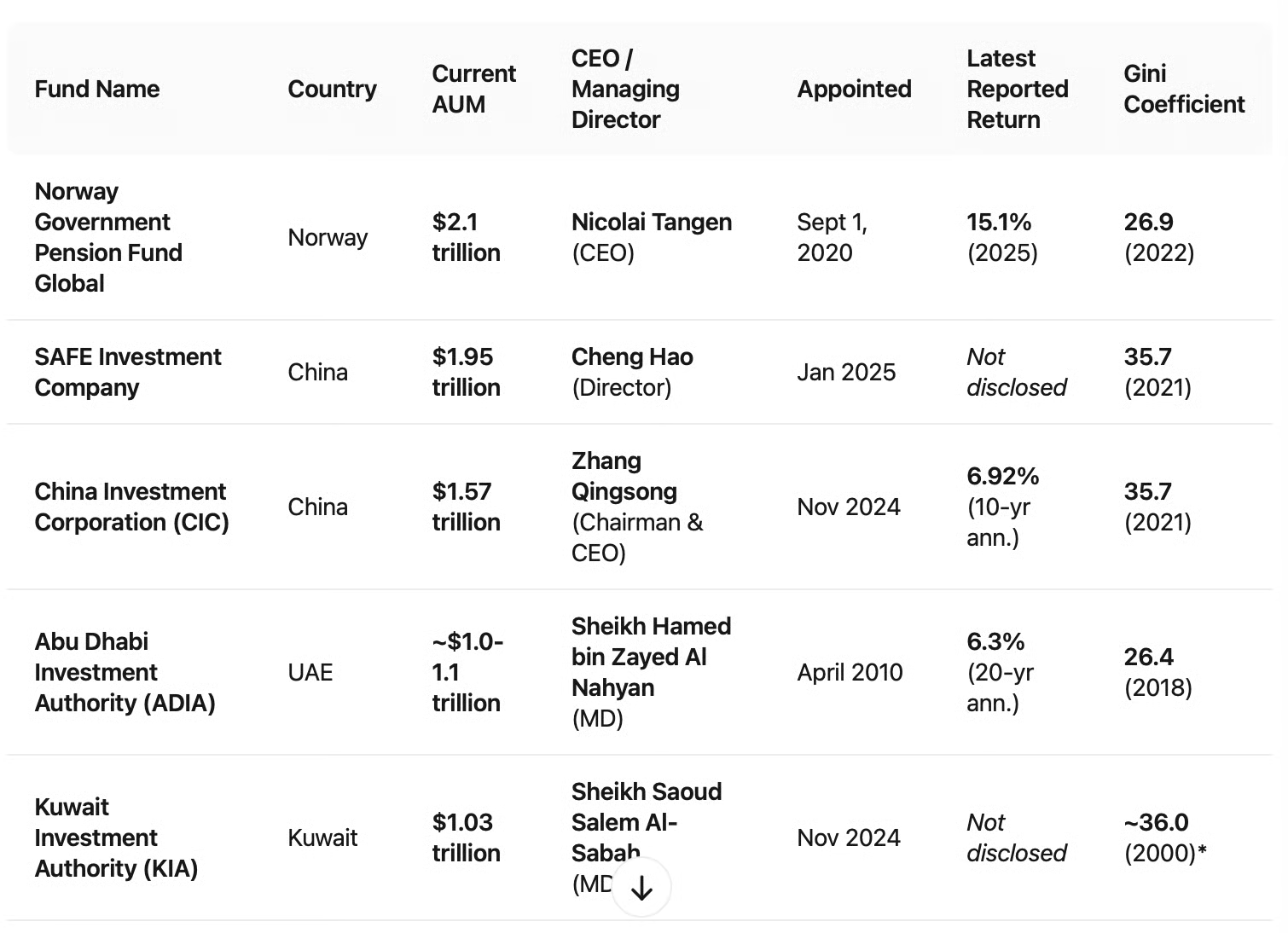

Hier gebruikte ik de volgende prompt om informatie over grote staatsinvesteringsfondsen te combineren. Voor deze tabel moest MiniMax M2.5 onderzoek uit verschillende bronnen synthetiseren. Let ook op dat ik vroeg om de Gini-coëfficiënt van het land te vinden, wat waarschijnlijk niet op de websites van die fondsen te vinden is.

Ik heb de informatie steekproefsgewijs gecontroleerd door de betreffende websites te bezoeken.

For each of the five largest sovereign wealth funds by AUM, find the following: the fund's name and country, current AUM, current CEO or equivalent, when that person took the role, the fund's reported return in their most recent annual report, and the Gini coefficient of the country. Compile into a table with sources for each figure.

Dit was maar een kleine test, maar wel een heel praktische. MiniMax 2.5 deed uitstekend werk door onderzoek uit meerdere bronnen te synthetiseren tot een accurate tabel.

Vervolgens heb ik onafhankelijke demo’s en benchmarks nauwkeurig bekeken om andere showcases te bestuderen.

Fullstack webontwikkeling

Je kunt M2.5 ook grondig testen op software-engineeringtaken en zien hoe het plant en uitvoert binnen een afgebakende scope. Ik stel voor dat je deze prompt gebruikt:

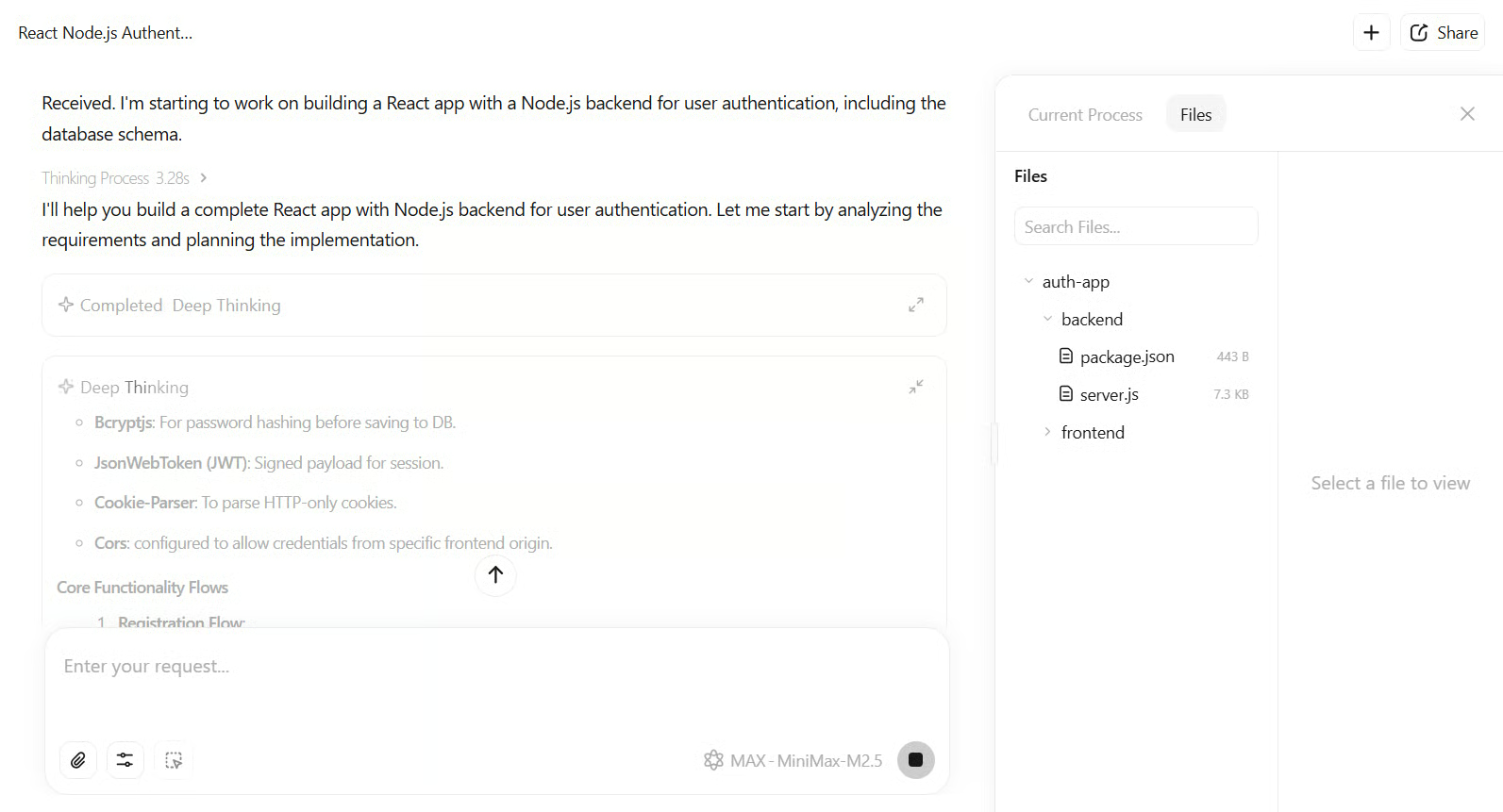

Build a React app with Node.js backend for user authentication, including database schema.M2.5 zou een volledige, spec-first planning outputten met UI-wireframes en API-endpoints. Vervolgens voegt het 1200+ regels TypeScript/JavaScript-code toe. De tests slaagden bij de eerste run in 22 minuten, wat sneller is dan het gemiddelde van Claude Opus 4.6. Het resultaat is een functionele applicatie met JWT-auth en MongoDB-integratie.

Deze afbeelding illustreert het voorbeeld en de prompt in de omgeving van MiniMax Agent met het M2.5-model.

Financiële modellering in Excel

Om de documentgeneratie te testen, kun je zo’n prompt proberen:

Create an Excel model for startup valuation using DCF, with sensitivity analysisM2.5 is gebouwd om opgemaakte bestanden met werkende formules en grafieken te genereren. Dit sluit aan bij de sterke GDPval-MM-benchmarkscores. (Ik kom in de volgende sectie nog terug op de benchmarks.)

MiniMax heeft serieuze moeite gestoken in kantoorproductiviteit, zodat het nuttige dingen kan doen zoals financiële modellen bouwen in Excel. Het team werkte direct samen met experts uit finance, recht en sociale wetenschappen om trainingsdata te bouwen die echte industrienormen weerspiegelen in plaats van generieke templates.

Een goede vervolgoefening is om het een bewust vage of ondergespecificeerde opdracht te geven. Denk aan een prompt die een junior analist van een partner kan krijgen. Kijk of het verduidelijkende vragen stelt of redelijke aannames maakt en die markeert.

SVG-generatie en redeneren

Waar je hier op moet letten, is hoe M2.5 de taak start.

Een van de interessantere punten uit de releasenotes is dat het schrijven van specificaties organisch naar voren kwam tijdens de training. Zoals ik al zei, vóórdat het code genereert, deconstrueert M2.5 het project en plant het de structuur, UI-ontwerp en API-endpoints vanuit het perspectief van een software-architect.

Of die planning daadwerkelijk tot betere output leidt, blijf ik zelf verder evalueren.

MiniMax M2.5 en het MiniMax Agent-platform

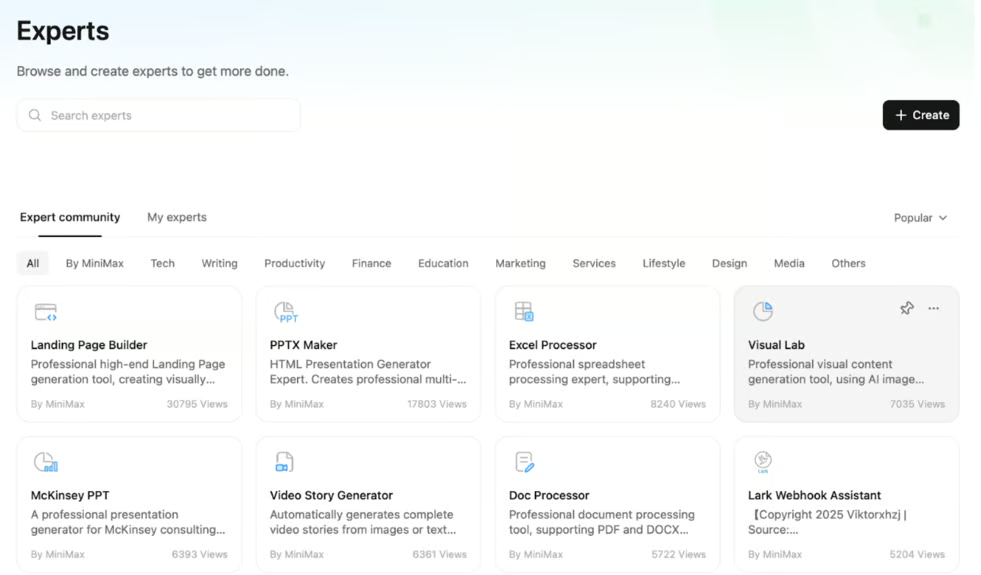

MiniMax levert M2.5 binnen een agentplatform dat niet-ontwikkelaars directe toegang geeft tot de mogelijkheden via zogenoemde voorgebouwde experts. Dit zijn gespecialiseerde agents die zijn geconfigureerd voor specifieke taken. Het platform werkt als een appstore: je bladert experts per categorie, kiest er één en krijgt een workflow-klare agent.

De meestgebruikte experts bij de lancering zijn Landing Page Builder, PPTX Maker, Excel Processor en nog een paar andere die oprecht nuttig lijken. Samen zie je zo hoe MiniMax zijn reputatie voor kantoorproductiviteit opbouwt.

Misschien nog interessanter is de communitylaag. Gebruikers kunnen hun eigen experts bouwen en publiceren. Er zouden inmiddels al meer dan 10.000 zijn gemaakt.

MiniMax M2.5-benchmarks

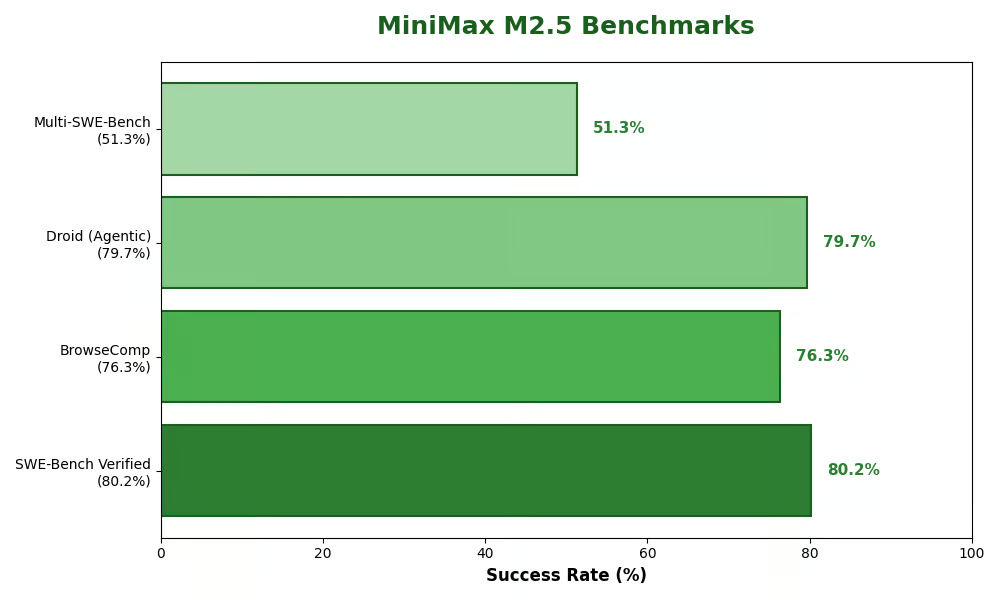

M2.5 toont sterke cijfers op de benchmarks die het meest tellen voor coderen en agentisch werk. Het scoorde 80,2% op SWE-Bench Verified — een test voor het oplossen van echte GitHub-issues — en rondde taken 37% sneller af dan voorganger M2.1.

Bij meertalige en cross-repository-taken stond het eerste op Multi-SWE-Bench met 51,3%. Bij lancering plaatste de 76,3% op BrowseComp het tussen de topmodellen voor webzoek en onderzoekstaken, maar het klassement is sindsdien verschoven. Gemini 3.1 Pro leidt nu met 85,9%, gevolgd door Claude Opus 4.6 met 84,0% en GPT-5.2 Pro met 77,9%. Zowel Gemini 3.1 Pro als Opus 4.6 werden binnen een week van M2.5 gelanceerd, wat goed illustreert hoe snel de frontier momenteel verschuift.

Tot slot scoorde het 79,7% op de Droid-benchmark voor agentisch coderen en staat het momenteel 4e op de OpenHands Index voor langlopende taken zoals app-building.

Deze afbeelding maakt de behaalde resultaten van M2.5 beter zichtbaar.

Hoe krijg ik toegang tot MiniMax M2.5?

Er zijn grofweg drie manieren om dit model te gebruiken. Je kunt dus gebruikmaken van:

- Open-source gewichten die je kunt downloaden van Hugging Face en lokaal deployen met vLLM, SGLang, Ollama of anderen. De GGUF-kwantisaties zijn beschikbaar voor consumentenhardware.

- API-toegang via de officiële website met $0,3/M inputtokens en $2,4/M outputtokens voor Lightning. Dit betekent dat je voor $1/uur aan 100 tokens/sec onafgebroken kunt draaien. Caching wordt ondersteund, net als enterpriseplannen voor gebruik op grote schaal.

- Integraties met verschillende IDE’s zoals VS Code, Cline CLI of Fireworks AI met ondersteuning vanaf dag één.

Voor de gewichten zijn er uiteraard geen gratis limieten, maar de API heeft gebruiksafhankelijke kosten.

MiniMax M2.5 vs. concurrenten

Het M2.5-model richt zich op niches rond coderen en agenten, en snijdt tegelijk de kosten terwijl de prestaties gelijk blijven. Hier is een vergelijking:

| Feature/Benchmark | MiniMax M2.5 | Claude Opus 4.6 | GPT-5.2 | Gemini 3 Pro |

|---|---|---|---|---|

| SWE-Bench Verified | 80.2% | 80.8% | 80% | 78% |

| Multi-SWE | 51.3% | 50.3% | 49.1% | 42.7% |

| BrowseComp (Search) | 76.3% (1e open-weight) | 84.0% | 65.8% | 73.2% |

| Outputkosten (/M tokens) | $2.4 | $25 | $14 | $15 |

| Snelheid (tokens/sec) | 100 | 60 | 80 | 70 |

| Open gewichten? | Ja (MIT) | Nee | Nee | Nee |

| Meertalig coderen | 10+ talen | Overwegend Engels | Sterk | Gemiddeld |

Deze data is afkomstig uit officiële evaluaties en Artificial Analysis, en uit het lezen van andere recente releases van andere modellen. M2.5 wint op efficiëntie en openheid, maar gesloten modellen scoren iets beter op brede kennis.

Hoe goed is MiniMax M2.5?

In de bredere industriecontext is M2.5 uitzonderlijk goed voor gerichte productiviteit. De 80,2% SWE-Bench-score en $1/uur-prijs kunnen de enterprise-AI-markt daadwerkelijk opschudden, waar kostenbarricades adoptie hebben afgeremd. De open-weight aanpak is een gamechanger in frontier-coderen en zet echte druk op de verdedigingslinies van gesloten modellen.

Nergens is dat duidelijker dan op BrowseComp, waar M2.5 alle open-weight modellen aanvoert met 76,3% — vóór GLM-5 en Kimi K2.5, ondanks dat die beide aanzienlijk groter zijn. De vier modellen die erboven staan, zijn allemaal proprietair, wat iets zegt over wat MiniMax heeft bereikt met een MIT-gelicentieerde release.

De agentische focus positioneert het ook goed voor de agent-economie, waar autonomie en efficiëntie zwaarder wegen dan pure schaal.

Dat gezegd hebbende, M2.5 heeft tekortkomingen. Het loopt achter op creatieve redenatie vergeleken met meer generalistische modellen, wat terug te zien is in de 42/100 op de Artificial Analysis Intelligence Index. Het is een specialist, geen alleskunner.

Ik geef het een A+ voor ontwikkelaars en een B+ voor veelzijdig gebruik. Let op fine-tunes die de scope waarschijnlijk flink zullen uitbreiden.

MiniMax M2.5 use cases

Er zijn veel maatwerktoepassingen voor dit model. Zo kan MiniMax M2.5 worden gebruikt voor software-engineeringtaken zoals het automatiseren van GitHub PR’s, bugfixes en volledige app-ontwikkeling. (Blijkbaar is 80% van MiniMax’ eigen broncode door AI gegenereerd!)

MiniMax M2.5 kan ook worden ingezet voor Enterprise Office-werk, zoals financiële modellering, rapportgeneratie en PPT-bewerking voor finance- of juridische teams. Daarnaast kun je via het MiniMax Agent-platform aangepaste AI-agentexperts bouwen voor onderzoek of sales.

Conclusie

MiniMax M2.5 heeft het potentieel om een productiviteitskrachtpatser te zijn die SOTA agentics combineert met open toegankelijkheid, tegen prijzen die de AI-economie kunnen hervormen.

Wil je meer hands-on leren, bekijk dan onze cursus AI for Developers. Experimenteer vandaag nog, want de toekomst van betaalbare intelligentie is hier.

Ik werk aan versnelde AI-systemen die edge-intelligentie mogelijk maken met gefedereerde ML-pijplijnen op gedecentraliseerde data en gedistribueerde workloads. Mijn werk richt zich op Large Models, spraakverwerking, computervisie, reinforcement learning en geavanceerde ML-topologieën.