Kursus

Di tengah ketegangan teknologi AS-Tiongkok dan maraknya model Tiongkok berbiaya rendah seperti GLM-5 milik Zhipu dan Kimi K2.5 dari Moonshot, muncul pemain baru yang menonjol berkat benchmark SOTA dengan biaya yang jauh di bawah perkiraan.

Model MiniMax 2.5 penting antara lain karena harganya. Ini merupakan bagian dari pergeseran industri menuju “kecerdasan yang terlalu murah untuk diukur,” sebuah bingkai ulang dari frasa lama tentang energi nuklir.

MiniMax 2.5 tersedia dalam dua varian: M2.5 penuh dengan 50 token/detik dan varian Lightning dengan 100 token/detik yang menurut saya cukup mencolok. Selain perbedaan kecepatan, keduanya memiliki kapabilitas yang identik.

Dalam artikel ini, saya akan menjelaskan apa itu M2.5 dan fitur utamanya, membantu Anda menemukan ide untuk pengujian sendiri, serta memberikan perbandingan jujur dengan model GPT dan Gemini terbaru.

Apa Itu MiniMax M2.5?

MiniMax M2.5 adalah model bahasa besar open-weight yang sangat baru dari perusahaan MinMax AI yang berbasis di Shanghai. Model ini diumumkan terutama pada 12 Februari 2026, hanya beberapa minggu setelah IPO perusahaan di Hong Kong.

MiniMax AI dirancang untuk produktivitas dunia nyata, sehingga unggul dalam coding, penggunaan alat agen, penelusuran web, dan otomatisasi perkantoran. M2.5 dilatih melalui reinforcement learning di lebih dari 200 ribu lingkungan kompleks. Ini membuatnya cukup tangguh untuk merencanakan layaknya arsitek perangkat lunak dan mengeksekusi secara otonom.

Fitur Utama MiniMax M2.5

Model baru ini menghadirkan berbagai fitur yang membuatnya menonjol dibanding LLM lain. Pada bagian ini, saya akan menyebutkan beberapa di antaranya.

Dukungan coding multibahasa

MiniMax M2.5 dilatih pada dataset jarang, yang memungkinkannya menangani lebih dari 10 bahasa pemrograman seperti Python, Rust, Java, Go, dan lainnya, di berbagai lingkungan pengembangan full-stack. Kemampuannya mencakup dari perancangan sistem hingga tinjauan kode, serta mencakup aplikasi web, Android, iOS, dan Windows.

Penggunaan alat agen dan penelusuran

Model M2.5 mampu memimpin pada tugas pemanggilan fungsi multi-giliran dengan 76,9% pada BFCL, dan navigasi web dengan 76,3% pada BrowseComp, sekaligus menggunakan 20% putaran lebih sedikit dibanding pendahulunya untuk dekomposisi tugas yang efisien.

Integrasi produktivitas perkantoran

Selain penggunaan alat agen dan kemampuan penelusuran, model M2.5 menghasilkan keluaran terformat untuk Word, PowerPoint, dan Excel, seperti pada pemodelan keuangan dengan tingkat kemenangan 59% dibanding model arus utama pada benchmark GDPval-MM.

Efisiensi dan pelatihan RL

Didukung oleh kerangka kerja Forge RL dan algoritma CISPO, model ini menyelesaikan tugas 37% lebih cepat daripada M2.1 sambil mengonsumsi lebih sedikit token, tepatnya 3,52 juta per tugas SWE-Bench.

Praktik Langsung dengan MiniMax M2.5

Saya memutuskan menguji MiniMax M2.5 sendiri. Terinspirasi oleh klaim besar MiniMax M2.5 seputar penggunaan alat agen dan penelusuran, serta fokusnya pada produktivitas perkantoran, saya memberinya tugas riset yang menurut saya mudah muncul dalam pekerjaan seseorang.

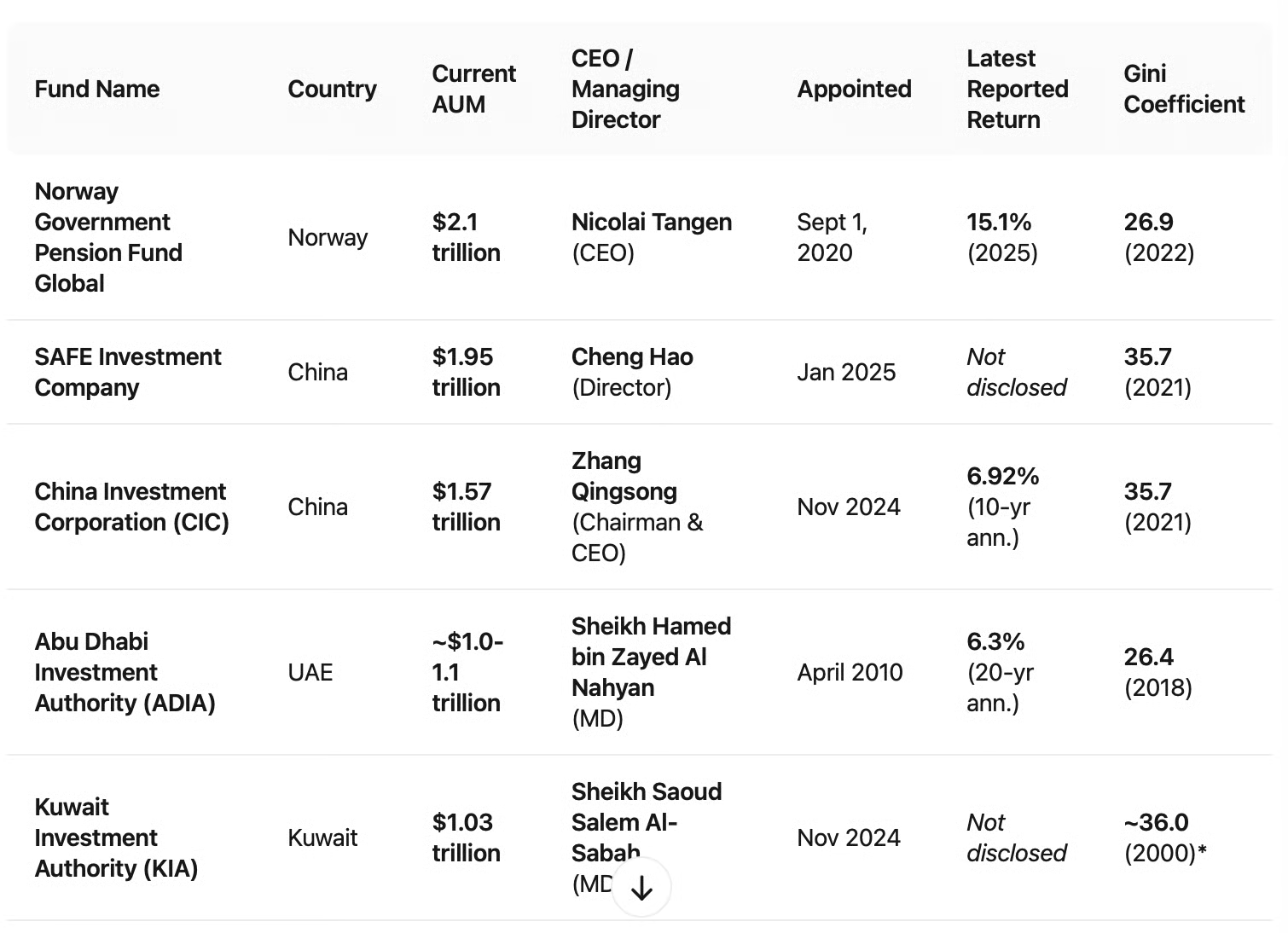

Di sini, saya mencoba prompt berikut untuk menggabungkan informasi tentang dana kekayaan negara besar. Untuk menyusun tabel ini, MiniMax M2.5 harus mensintesis riset dari berbagai sumber. Perhatikan bahwa saya juga memintanya mencari koefisien Gini negara, yang sangat saya ragukan ada di situs web dana kekayaan negara mana pun.

Saya cek silang informasi tersebut dengan mengunjungi situs masing-masing.

For each of the five largest sovereign wealth funds by AUM, find the following: the fund's name and country, current AUM, current CEO or equivalent, when that person took the role, the fund's reported return in their most recent annual report, and the Gini coefficient of the country. Compile into a table with sources for each figure.

Ini hanya uji kecil, tapi sangat praktis. MiniMax 2.5 melakukan pekerjaan hebat mensintesis riset dari berbagai sumber menjadi tabel yang akurat.

Selanjutnya, saya menelaah demo dan benchmark independen untuk mempelajari showcase lainnya.

Pengembangan web full-stack

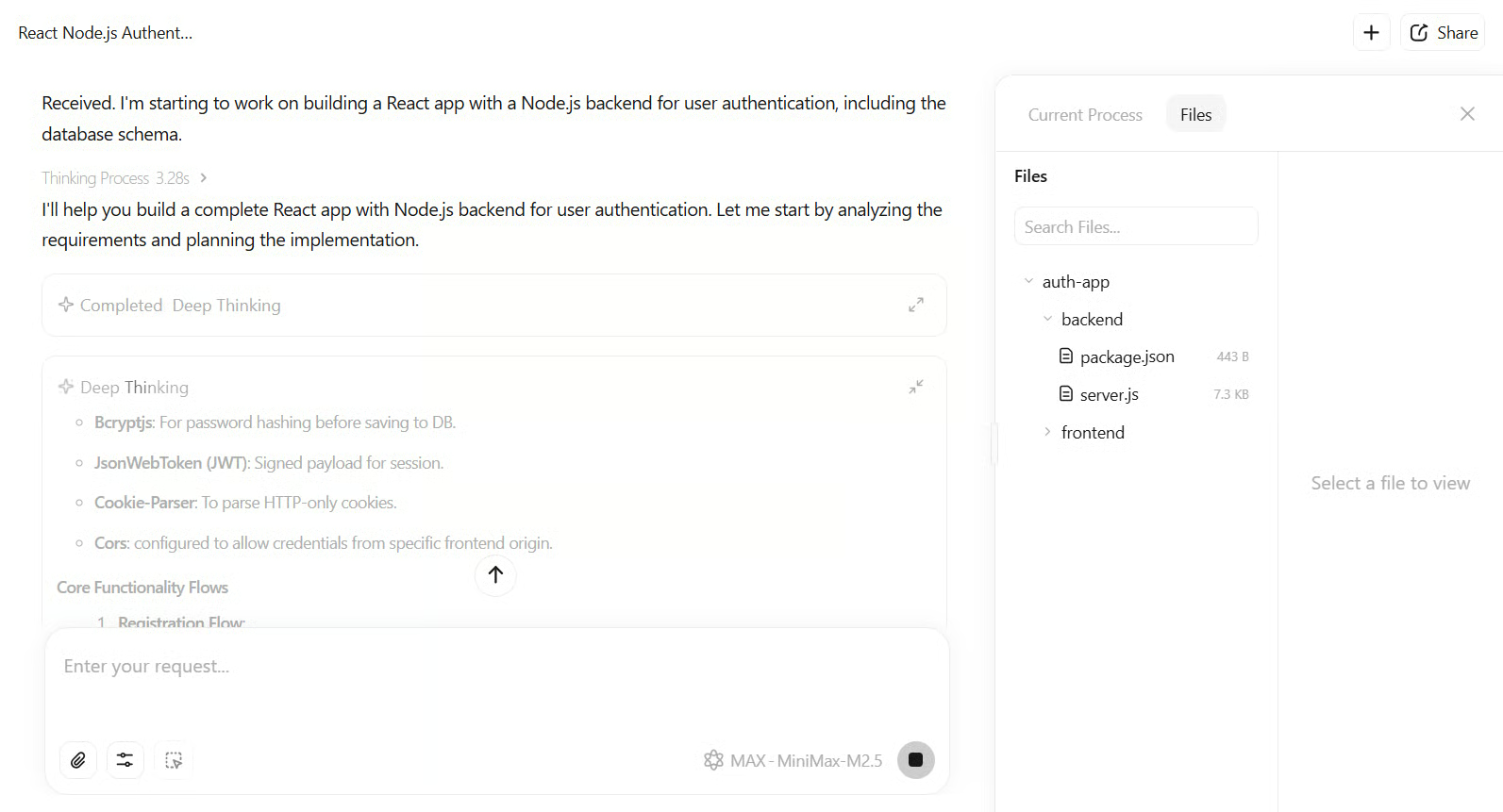

Anda juga bisa menguji M2.5 secara dekat pada tugas rekayasa perangkat lunak dan melihat bagaimana ia merencanakan dan mengeksekusi dalam lingkup tertutup. Saya sarankan masukkan prompt berikut:

Build a React app with Node.js backend for user authentication, including database schema.M2.5 akan menghasilkan rencana spec-first lengkap dengan wireframe UI dan endpoint API. Setelah itu, ia akan menambahkan 1200+ baris kode TypeScript/JavaScript. Pengujian lolos pada percobaan pertama dalam 22 menit, lebih cepat dari rata-rata Claude Opus 4.6. Hasilnya adalah aplikasi fungsional dengan autentikasi JWT dan integrasi MongoDB.

Gambar ini mengilustrasikan contoh dan prompt yang diberikan di lingkungan MiniMax Agent menggunakan model M2.5.

Pemodelan keuangan di Excel

Untuk menguji kemampuan pembuatan dokumen, Anda bisa mencoba prompt seperti ini:

Create an Excel model for startup valuation using DCF, with sensitivity analysisM2.5 dirancang untuk menghasilkan file terformat dengan rumus dan bagan yang berfungsi. Ini selaras dengan skor benchmark GDPval-MM yang kuat. (Saya akan membahas benchmark lebih lanjut di bagian berikutnya.)

MiniMax benar-benar menaruh perhatian pada keterampilan produktivitas perkantoran untuk melakukan hal berguna seperti membangun model keuangan di Excel. Tim bekerja langsung dengan pakar keuangan, hukum, dan ilmu sosial untuk membangun data pelatihan yang mencerminkan standar industri nyata alih-alih template generik.

Uji lanjutan yang baik adalah memberi brief yang sengaja ambigu atau kurang spesifik. Pikirkan prompt yang mungkin diterima analis junior dari partner. Lihat apakah ia mengajukan pertanyaan klarifikasi atau membuat asumsi yang wajar dan menandainya.

Pembuatan SVG dan penalaran

Yang perlu diperhatikan di sini adalah bagaimana M2.5 memulai tugas.

Salah satu hal menarik dari catatan rilis adalah perilaku penulisan spesifikasi yang muncul secara organik selama pelatihan. Seperti yang saya sebutkan, sebelum menghasilkan kode apa pun, M2.5 cenderung memecah proyek dan merencanakan struktur, desain UI, dan endpoint API dari perspektif arsitek perangkat lunak.

Apakah perencanaan itu benar-benar menghasilkan keluaran yang lebih baik adalah sesuatu yang terus saya evaluasi sendiri.

MiniMax M2.5 dan Platform MiniMax Agent

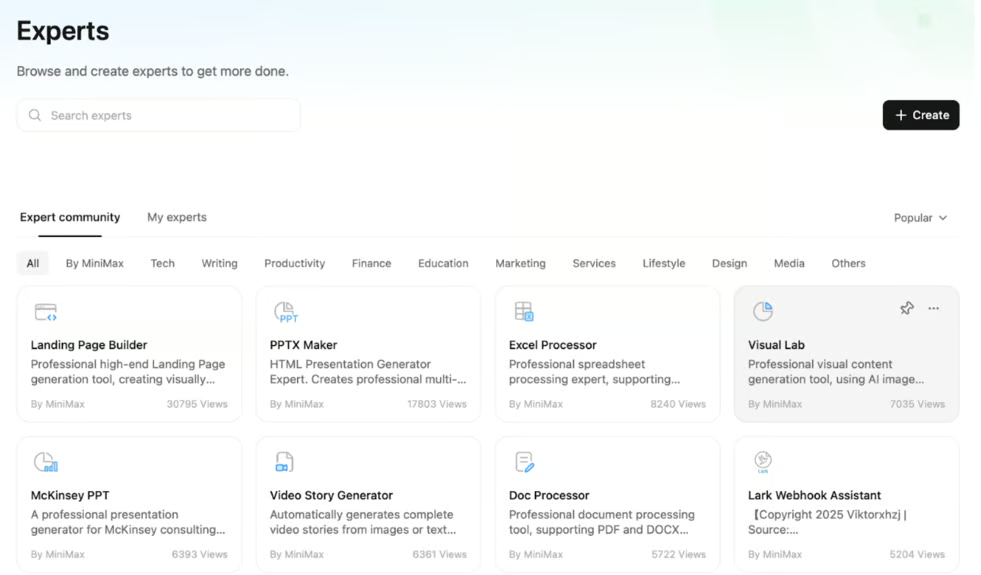

MiniMax menghadirkan M2.5 dalam sebuah platform agen yang memberi non-developer akses langsung ke kemampuannya melalui apa yang disebut pakar siap pakai. Ini adalah agen khusus yang dikonfigurasi untuk tugas tertentu. Platformnya bekerja seperti app store: Anda menelusuri pakar berdasarkan kategori, memilih satu, dan mendapatkan agen yang siap untuk workflow.

Pakar yang paling sering digunakan saat peluncuran adalah Landing Page Builder, PPTX Maker, Excel Processor, dan beberapa lainnya yang tampak benar-benar berguna. Secara keseluruhan, Anda bisa melihat bagaimana MiniMax memperoleh reputasi dalam produktivitas perkantoran.

Yang mungkin lebih menarik adalah lapisan komunitas. Pengguna dapat membangun dan menerbitkan pakar mereka sendiri. Faktanya, kabarnya sudah ada lebih dari 10.000 yang dibuat.

Benchmark MiniMax M2.5

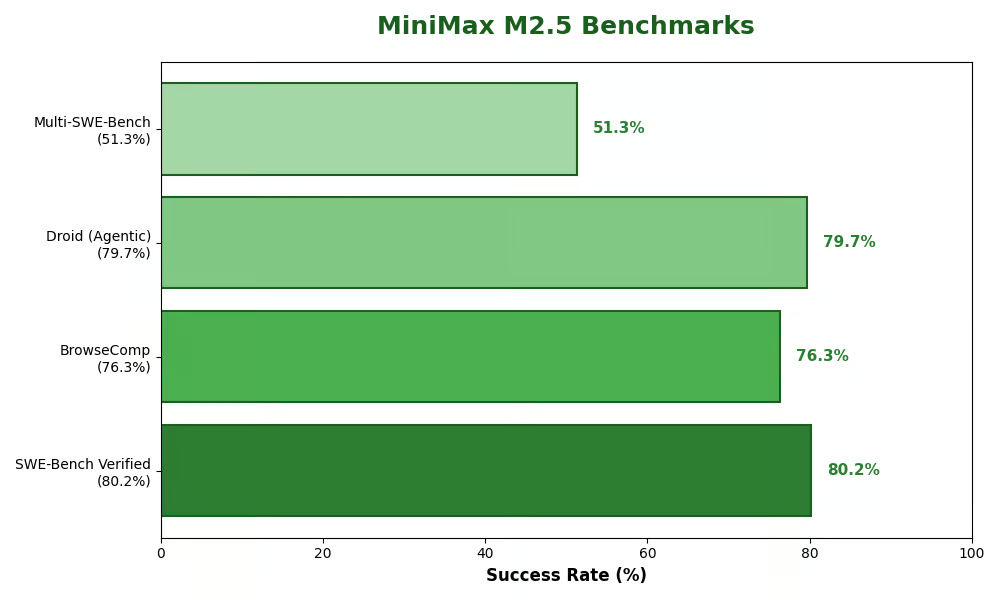

M2.5 mencatat angka kuat di berbagai benchmark yang paling penting untuk coding dan pekerjaan agen. Model ini meraih 80,2% pada SWE-Bench Verified — uji penyelesaian isu GitHub dunia nyata — sambil menyelesaikan tugas 37% lebih cepat daripada pendahulunya M2.1.

Pada tugas multibahasa dan lintas repositori, model ini menempati peringkat pertama di Multi-SWE-Bench dengan 51,3%. Saat peluncuran, skor 76,3% pada BrowseComp menempatkannya di antara model berkinerja terbaik untuk tugas penelusuran web dan riset, namun papan peringkat sejak itu berubah. Gemini 3.1 Pro kini memimpin dengan 85,9%, diikuti Claude Opus 4.6 di 84,0% dan GPT-5.2 Pro di 77,9%. Baik Gemini 3.1 Pro maupun Opus 4.6 diluncurkan dalam selang satu minggu dari M2.5, yang cukup menggambarkan betapa cepat garis depan bergerak saat ini.

Sebagai pelengkap, model ini mencetak 79,7% pada benchmark Droid untuk coding agen dan saat ini berada di posisi ke-4 pada OpenHands Index untuk tugas jangka panjang seperti pembuatan aplikasi.

Gambar ini memudahkan untuk melihat hasil skor M2.5.

Bagaimana Cara Mengakses MiniMax M2.5?

Ada 3 cara utama untuk menggunakan model ini. Anda dapat:

- Bobot open-source yang dapat Anda unduh dari Hugging Face dan melakukan deployment lokal dengan vLLM, SGLang, Ollama, atau lainnya. Kuantisasi GGUF tersedia untuk perangkat konsumen.

- Akses API dari situs resmi dengan biaya $0,3/juta token input dan $2,4/juta token output untuk Lightning. Ini berarti Anda bisa mendapatkan $1/jam pada 100 token/detik tanpa henti. Caching didukung serta paket enterprise untuk penggunaan volume tinggi.

- Integrasi dengan berbagai IDE seperti VS Code, Cline CLI, atau Fireworks AI untuk dukungan sejak hari pertama.

Tentu, tidak ada batasan tingkat gratis untuk bobot, tetapi API menggunakan penagihan berbasis penggunaan.

MiniMax M2.5 vs. Pesaing

Model M2.5 menyasar ceruk coding dan agen sekaligus menekan biaya dengan performa yang sepadan. Berikut perbandingannya:

| Fitur/Benchmark | MiniMax M2.5 | Claude Opus 4.6 | GPT-5.2 | Gemini 3 Pro |

|---|---|---|---|---|

| SWE-Bench Verified | 80,2% | 80,8% | 80% | 78% |

| Multi-SWE | 51,3% | 50,3% | 49,1% | 42,7% |

| BrowseComp (Penelusuran) | 76,3% (open-weight peringkat 1) | 84,0% | 65,8% | 73,2% |

| Biaya Output (/juta token) | $2,4 | $25 | $14 | $15 |

| Kecepatan (token/detik) | 100 | 60 | 80 | 70 |

| Open Weights? | Ya (MIT) | Tidak | Tidak | Tidak |

| Coding Multibahasa | 10+ bahasa | Berat ke Inggris | Kuat | Sedang |

Data ini bersumber dari evaluasi resmi dan Artificial Analysis, serta membaca rilis terbaru dari model lain. M2.5 unggul dalam efisiensi dan keterbukaan, tetapi model tertutup unggul dalam cakupan pengetahuan luas.

Seberapa Baik MiniMax M2.5?

Dalam konteks industri yang lebih luas, M2.5 sangat bagus untuk produktivitas terarah. Skor 80,2% pada SWE-Bench dan harga $1/jam berpotensi mendisrupsi AI enterprise, di mana hambatan biaya memperlambat adopsi. Pendekatan open-weight merupakan pengubah permainan dalam coding frontier dan memberi tekanan nyata pada parit pertahanan model tertutup.

Hal itu paling jelas terlihat pada BrowseComp, di mana M2.5 memimpin semua model open-weight dengan 76,3% — berada di depan GLM-5 dan Kimi K2.5 meski keduanya secara signifikan lebih besar. Empat model di atasnya semuanya bersifat proprietari, yang menunjukkan pencapaian MiniMax dengan rilis berlisensi MIT.

Fokus ageniknya juga memosisikannya dengan baik untuk ekonomi agen, di mana otonomi dan efisiensi lebih penting ketimbang skala mentah.

Meski begitu, M2.5 memiliki kekurangan. Ia tertinggal dalam penalaran kreatif dibanding model yang lebih generalis, tercermin pada skor 42/100 di Artificial Analysis Intelligence Index. Ia adalah spesialis, bukan serba bisa.

Saya akan memberinya nilai A+ untuk pengembang dan B+ untuk penggunaan serbaguna. Nantikan fine-tune yang kemungkinan besar akan memperluas cakupannya secara signifikan.

Use Case MiniMax M2.5

Ada banyak use case khusus dari model ini. Misalnya, MiniMax M2.5 dapat digunakan untuk tugas rekayasa perangkat lunak seperti otomatisasi PR GitHub, perbaikan bug, dan pengembangan aplikasi lengkap. (Kabarnya, 80% kode sumber MiniMax sendiri dibuat oleh AI!)

MiniMax M2.5 juga dapat digunakan untuk pekerjaan Office Enterprise, seperti pemodelan keuangan, pembuatan laporan, dan pengeditan PPT untuk tim keuangan atau hukum. Selain itu, Anda dapat membangun pakar agen AI khusus untuk riset atau penjualan melalui platform MiniMax Agent.

Kesimpulan

MiniMax M2.5 berpotensi menjadi mesin produktivitas yang memadukan agentics SOTA dengan aksesibilitas terbuka, dengan harga yang dapat membentuk ulang ekonomi AI.

Untuk pembelajaran yang lebih praktis, lihat kursus AI for Developers kami. Bereksperimenlah hari ini karena masa depan kecerdasan terjangkau sudah hadir.

Saya mengembangkan sistem AI terakselerasi yang memungkinkan kecerdasan di edge dengan pipeline ML federasi pada data terdesentralisasi dan beban kerja terdistribusi. Fokus kerja saya mencakup Model Besar, Pemrosesan Ucapan, Vision Komputer, Reinforcement Learning, dan Topologi ML tingkat lanjut.