Corso

Tra le tensioni tecnologiche tra USA e Cina e l’ondata di modelli cinesi economici come GLM-5 di Zhipu e Kimi K2.5 di Moonshot, emerge un nuovo protagonista che si distingue per benchmark SOTA a una frazione del costo atteso.

Il modello MiniMax 2.5 è significativo anche per il prezzo. Rientra nel più ampio spostamento del settore verso “intelligenza troppo economica per essere misurata”, una riformulazione di una vecchia frase sull’energia nucleare.

MiniMax 2.5 è disponibile in due varianti: la versione completa M2.5 con 50 token/secondo e la variante Lightning con, a mio avviso, un notevole valore di 100 token/secondo. A parte la differenza di velocità, entrambe le varianti hanno capacità identiche.

In questo articolo spiegherò cos’è M2.5 e le sue caratteristiche principali, ti aiuterò a trovare idee per i tuoi test e ti offrirò anche confronti onesti con gli ultimi modelli GPT e Gemini.

Che cos’è MiniMax M2.5?

MiniMax M2.5 è un LLM open-weight molto recente dell’azienda MinMax AI con sede a Shanghai. È stato annunciato principalmente il 12 febbraio 2026, poche settimane dopo l’IPO di Hong Kong dell’azienda.

MiniMax AI è pensato per la produttività reale, quindi eccelle in coding, uso agentico di strumenti, ricerca sul web e automazione d’ufficio. M2.5 è addestrato tramite reinforcement learning in oltre 200.000 ambienti complessi. Questo lo rende abbastanza robusto da pianificare come un software architect ed eseguire in modo autonomo.

Caratteristiche principali di MiniMax M2.5

Il nuovo modello presenta diverse funzionalità che lo distinguono rispetto ad altri LLM. In questa sezione ne menziono alcune.

Supporto al coding multilingue

MiniMax M2.5 è stato addestrato su un dataset sparso, che gli consente di gestire più di 10 linguaggi di programmazione, come Python, Rust, Java, Go e altri, in diversi ambienti di sviluppo full-stack. Le sue competenze vanno dal system design al code review e coprono applicazioni web, Android, iOS e Windows.

Uso agentico di strumenti e ricerca

Il modello M2.5 è in grado di primeggiare in attività multi-turn di function calling con il 76,9% su BFCL e nella navigazione web con il 76,3% su BrowseComp, utilizzando il 20% di turni in meno rispetto ai predecessori per una scomposizione efficiente dei task.

Integrazione per la produttività d’ufficio

Oltre alle capacità di uso agentico degli strumenti e di ricerca, il modello M2.5 ha generato output formattati per Word, PowerPoint ed Excel, come nel caso di modelli finanziari, con un tasso di successo del 59% rispetto ai modelli mainstream sui benchmark GDPval-MM.

Efficienza e addestramento RL

Grazie al framework Forge RL e all’algoritmo CISPO, completa i task il 37% più velocemente di M2.1 consumando meno token, in particolare 3,52M per task SWE-Bench.

Prova pratica con MiniMax M2.5

Ho deciso di testare MiniMax M2.5 in prima persona. Ispirato dalle grandi promesse di MiniMax M2.5 sull’uso agentico di strumenti e ricerca, oltre che dal suo focus sulla produttività d’ufficio, gli ho assegnato un compito di ricerca che potrebbe facilmente capitare nel lavoro di qualcuno.

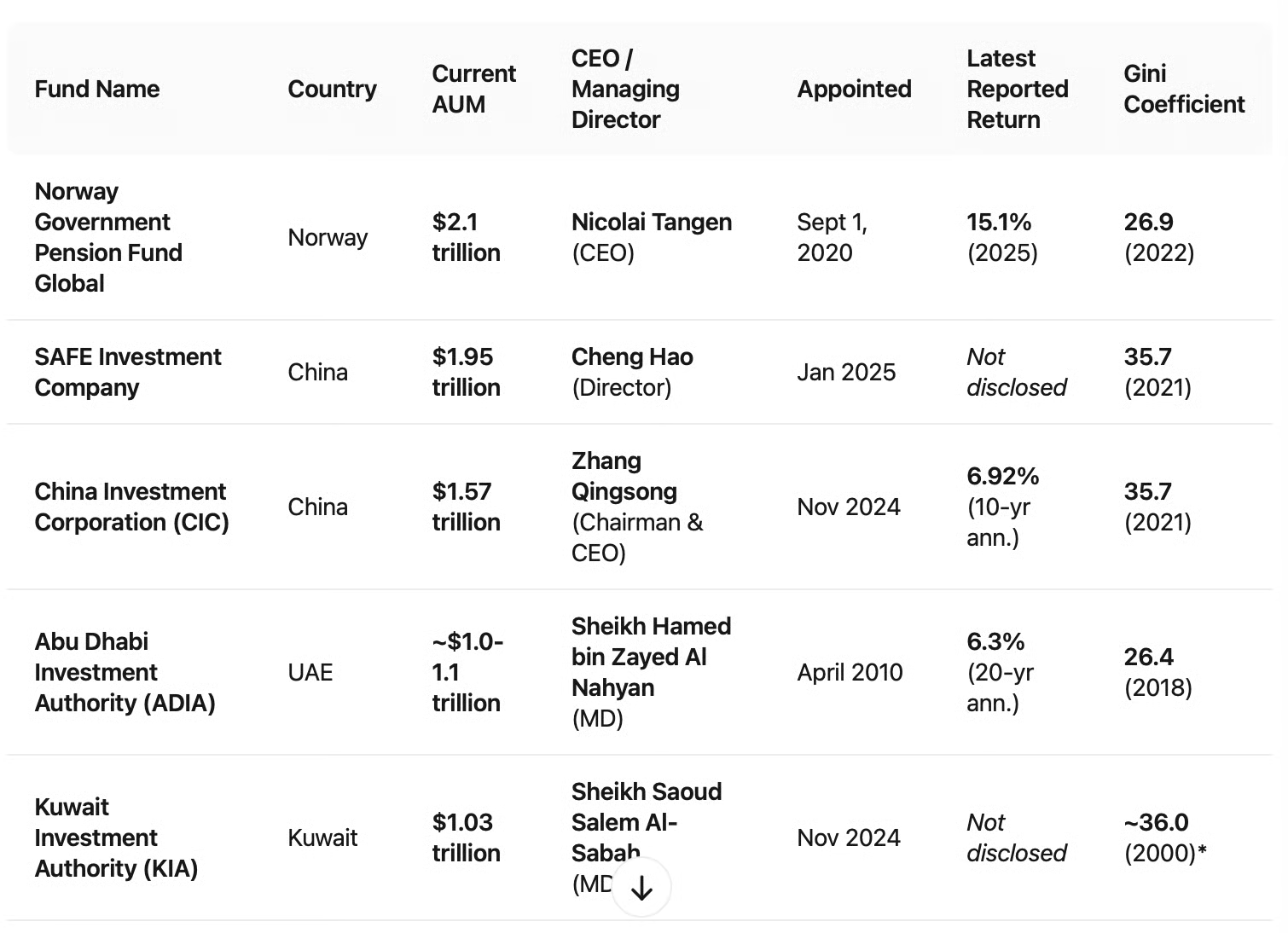

Qui ho provato il seguente prompt per combinare informazioni sui grandi fondi sovrani. Per compilare questa tabella, MiniMax M2.5 avrebbe dovuto sintetizzare ricerche da fonti diverse. Nota che gli ho anche chiesto di trovare il coefficiente di Gini del paese, cosa che dubitavo fortemente si trovasse sui siti dei fondi sovrani.

Ho verificato a campione le informazioni visitando i rispettivi siti.

For each of the five largest sovereign wealth funds by AUM, find the following: the fund's name and country, current AUM, current CEO or equivalent, when that person took the role, the fund's reported return in their most recent annual report, and the Gini coefficient of the country. Compile into a table with sources for each figure.

È stato solo un piccolo test, ma molto pratico. MiniMax 2.5 ha fatto un ottimo lavoro nel sintetizzare ricerche da più fonti in una tabella accurata.

Poi ho esaminato da vicino demo e benchmark indipendenti per studiare altri esempi.

Sviluppo web full-stack

Puoi anche testare a fondo M2.5 su task di ingegneria del software e vedere come pianifica ed esegue su uno scope chiuso. Ti suggerisco di inserire questo prompt:

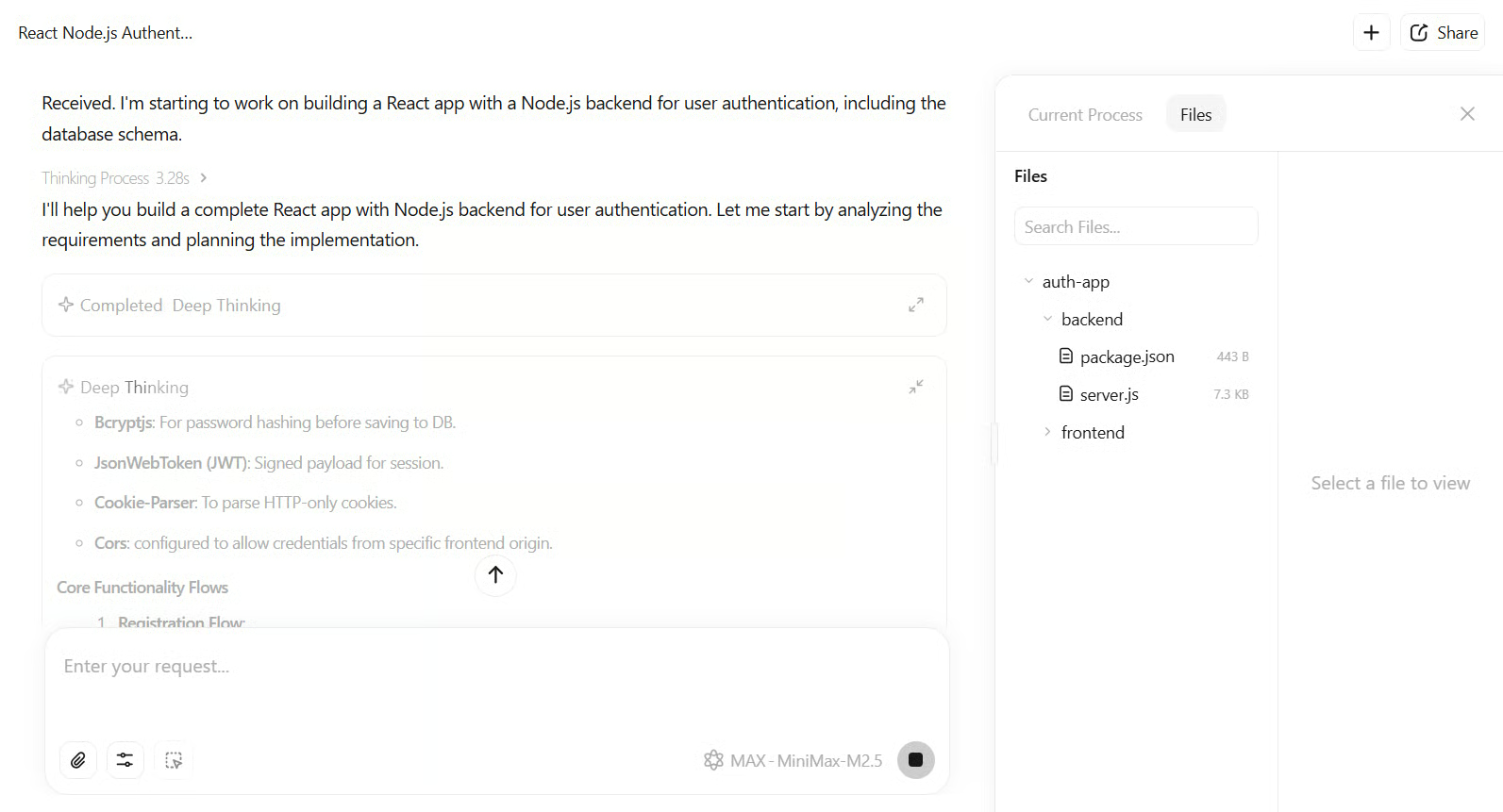

Build a React app with Node.js backend for user authentication, including database schema.M2.5 produrrebbe un piano completo “spec-first” con wireframe dell’interfaccia e endpoint API. A partire da quello, aggiungerà oltre 1200 righe di codice TypeScript/JavaScript. I test sono passati al primo tentativo in 22 minuti, il che lo rende più veloce della media di Claude Opus 4.6. Il risultato è un’applicazione funzionante con autenticazione JWT e integrazione MongoDB.

Questa figura illustra l’esempio e il prompt nell’ambiente di MiniMax Agent usando il modello M2.5.

Modellazione finanziaria in Excel

Per testare le sue capacità di generazione di documenti, puoi provare un prompt come questo:

Create an Excel model for startup valuation using DCF, with sensitivity analysisM2.5 è progettato per generare file formattati con formule e grafici funzionanti. Questo è in linea con i suoi solidi punteggi ai benchmark GDPval-MM. (Parlerò dei benchmark più avanti.)

MiniMax ha investito seriamente nelle competenze di produttività d’ufficio, per fare cose utili come costruire modelli finanziari in Excel. Il team ha lavorato direttamente con esperti di finanza, diritto e scienze sociali per creare dati di training che riflettano standard reali del settore, invece di template generici.

Un buon test successivo è dargli un brief volutamente ambiguo o poco specificato. Pensa a un prompt che un analista junior potrebbe ricevere da un partner. Vedi se pone domande di chiarimento o se fa assunzioni ragionevoli e le segnala.

Generazione SVG e reasoning

Qui vale la pena osservare come M2.5 avvia il compito.

Una delle cose più interessanti emerse dalle note di rilascio è che il comportamento di scrittura delle specifiche è emerso organicamente durante l’addestramento. Come accennato, prima di generare qualsiasi codice, M2.5 tende a scomporre il progetto e pianificare struttura, design UI ed endpoint API dalla prospettiva di un software architect.

Se quella pianificazione produca effettivamente output migliori è qualcosa che continuo a valutare personalmente.

MiniMax M2.5 e la piattaforma MiniMax Agent

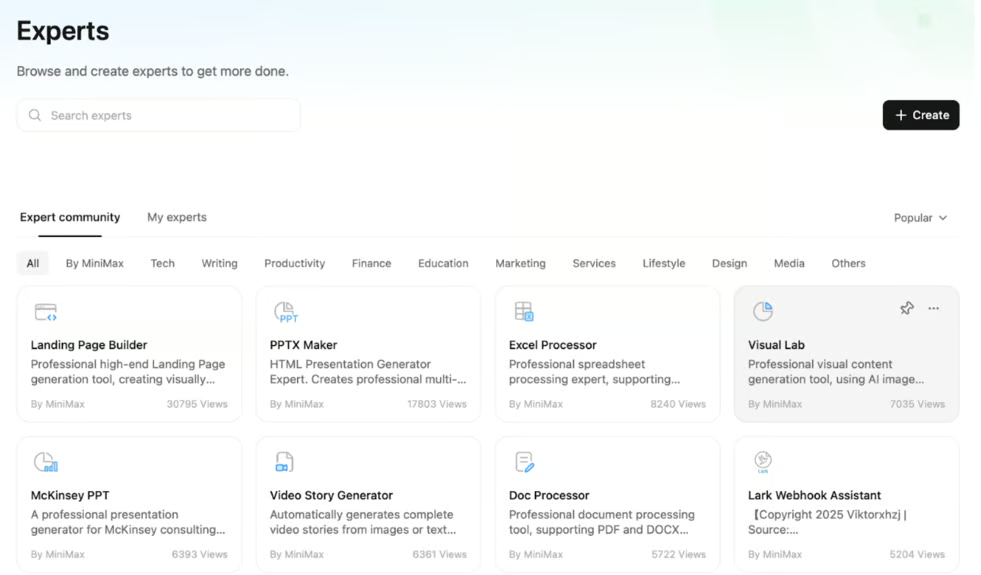

MiniMax distribuisce M2.5 all’interno di una piattaforma di agent che offre ai non sviluppatori accesso immediato alle sue capacità tramite quelli che chiama esperti preconfigurati. Si tratta di agent specializzati configurati per task specifici. La piattaforma funziona come un app store: sfogli gli esperti per categoria, ne scegli uno e ottieni un agent pronto al workflow.

Gli esperti più usati al lancio sono Landing Page Builder, PPTX Maker, Excel Processor e altri che sembrano davvero utili. Nel complesso si capisce come MiniMax si stia guadagnando la reputazione di strumento per la produttività d’ufficio.

Ancora più interessante è forse lo strato community. Gli utenti possono creare e pubblicare i propri esperti. A quanto pare, ne sono già stati creati oltre 10.000.

Benchmark di MiniMax M2.5

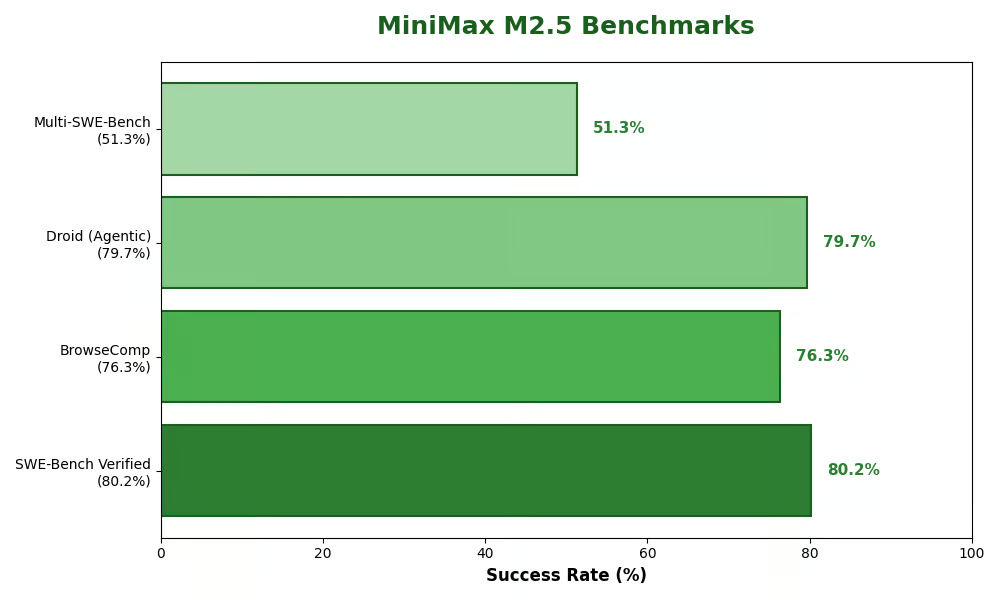

M2.5 ottiene numeri solidi nei benchmark più importanti per coding e lavoro agentico. Ha totalizzato l’80,2% su SWE-Bench Verified — un test reale di risoluzione di issue su GitHub — completando i task il 37% più velocemente del suo predecessore M2.1.

Sui task multilingue e cross-repository, si è classificato primo su Multi-SWE-Bench con il 51,3%. Al lancio, il suo 76,3% su BrowseComp lo collocava tra i modelli con le migliori prestazioni per attività di ricerca sul web e ricerca accademica, ma la classifica da allora è cambiata. Gemini 3.1 Pro è ora in testa con l’85,9%, seguito da Claude Opus 4.6 all’84,0% e GPT-5.2 Pro al 77,9%. Sia Gemini 3.1 Pro che Opus 4.6 sono stati lanciati a una settimana da M2.5, il che illustra bene la rapidità con cui si muove oggi la frontiera.

Per completare il quadro, ha ottenuto il 79,7% sul benchmark Droid per il coding agentico e attualmente è 4° nell’OpenHands Index per task di lunga durata come la creazione di app.

Questa immagine facilita la visualizzazione dei risultati ottenuti da M2.5.

Come posso accedere a MiniMax M2.5?

Ci sono principalmente 3 modi per usare questo modello. Quindi puoi usare:

- Pesi open-source che puoi sostanzialmente scaricare da Hugging Face e distribuire in locale con vLLM, SGLang, Ollama o altri. Le quantizzazioni GGUF sono disponibili per hardware consumer.

- Accesso API dal sito ufficiale con 0,3 $/M token in input e 2,4 $/M token in output per la versione Lightning. Questo significa che puoi avere 1 $/ora a 100 token/sec senza sosta. Sono supportati caching e piani enterprise per volumi elevati.

- Integrazioni con diversi IDE come VS Code, Cline CLI o Fireworks AI con supporto dal primo giorno.

Ovviamente non ci sono limiti di livello gratuito per i pesi, ma l’API prevede fatturazione in base all’uso.

MiniMax M2.5 vs. concorrenti

Il modello M2.5 punta alle nicchie di coding e agentiche, riducendo al contempo i costi con prestazioni allineate. Ecco un confronto:

| Caratteristica/Benchmark | MiniMax M2.5 | Claude Opus 4.6 | GPT-5.2 | Gemini 3 Pro |

|---|---|---|---|---|

| SWE-Bench Verified | 80,2% | 80,8% | 80% | 78% |

| Multi-SWE | 51,3% | 50,3% | 49,1% | 42,7% |

| BrowseComp (Ricerca) | 76,3% (1° open-weight) | 84,0% | 65,8% | 73,2% |

| Costo output (/M token) | 2,4 $ | 25 $ | 14 $ | 15 $ |

| Velocità (token/sec) | 100 | 60 | 80 | 70 |

| Pesi aperti? | Sì (MIT) | No | No | No |

| Coding multilingue | 10+ lingue | Forte per l’inglese | Forte | Moderato |

Questi dati provengono da valutazioni ufficiali e da Artificial Analysis, oltre che dalla lettura di altri recenti rilasci di altri modelli. M2.5 vince per efficienza e apertura, ma i modelli chiusi prevalgono per ampiezza di conoscenze.

Quanto è valido MiniMax M2.5?

Nel più ampio contesto del settore, M2.5 è eccezionale per la produttività mirata. Il suo punteggio di 80,2% su SWE-Bench e il prezzo di 1 $/ora potrebbero davvero scuotere l’AI enterprise, dove le barriere di costo hanno rallentato l’adozione. L’approccio open-weight è un punto di svolta nel coding di frontiera e mette una vera pressione sui vantaggi difensivi dei modelli chiusi.

Questo è evidente soprattutto su BrowseComp, dove M2.5 guida tutti i modelli open-weight con il 76,3% — davanti a GLM-5 e Kimi K2.5 nonostante siano modelli significativamente più grandi. I quattro modelli sopra di lui sono tutti proprietari, il che dice molto su ciò che MiniMax è riuscita a fare con un rilascio con licenza MIT.

Il suo focus agentico lo posiziona bene anche per l’economia degli agent, dove autonomia ed efficienza contano più della scala pura.

Detto ciò, M2.5 ha dei limiti. È indietro nel reasoning creativo rispetto ai modelli più generalisti, come riflette il suo punteggio di 42/100 sull’Artificial Analysis Intelligence Index. È uno specialista, non un tuttofare.

Gli darei una A+ per gli sviluppatori e una B+ per l’uso versatile. Tieni d’occhio i fine-tune che probabilmente ne amplieranno notevolmente la portata.

Casi d’uso di MiniMax M2.5

I casi d’uso personalizzati di questo modello sono molti. Per esempio, MiniMax M2.5 può essere usato per task di ingegneria del software come automatizzare PR su GitHub, correggere bug e sviluppare app complete. (A quanto pare, l’80% del codice sorgente di MiniMax è generato dall’AI!)

MiniMax M2.5 può anche essere usato per il lavoro d’ufficio in azienda, come modellazione finanziaria, generazione di report ed editing di PPT per team di finanza o legali. Inoltre, puoi creare esperti agent AI personalizzati per ricerca o vendite tramite la piattaforma MiniMax Agent.

Conclusione

MiniMax M2.5 ha il potenziale per diventare una potenza di produttività che combina agentica SOTA con accessibilità aperta, a prezzi che potrebbero ridefinire l’economia dell’AI.

Per un apprendimento più pratico, dai un’occhiata al nostro corso AI for Developers. Sperimenta oggi, perché il futuro dell’intelligenza accessibile è già qui.

Lavoro su sistemi di IA accelerata che abilitano l'intelligenza all'edge con pipeline di ML federate su dati decentralizzati e carichi di lavoro distribuiti. Il mio lavoro si concentra su Large Models, Elaborazione del Parlato, Computer Vision, Reinforcement Learning e topologie ML avanzate.