Track

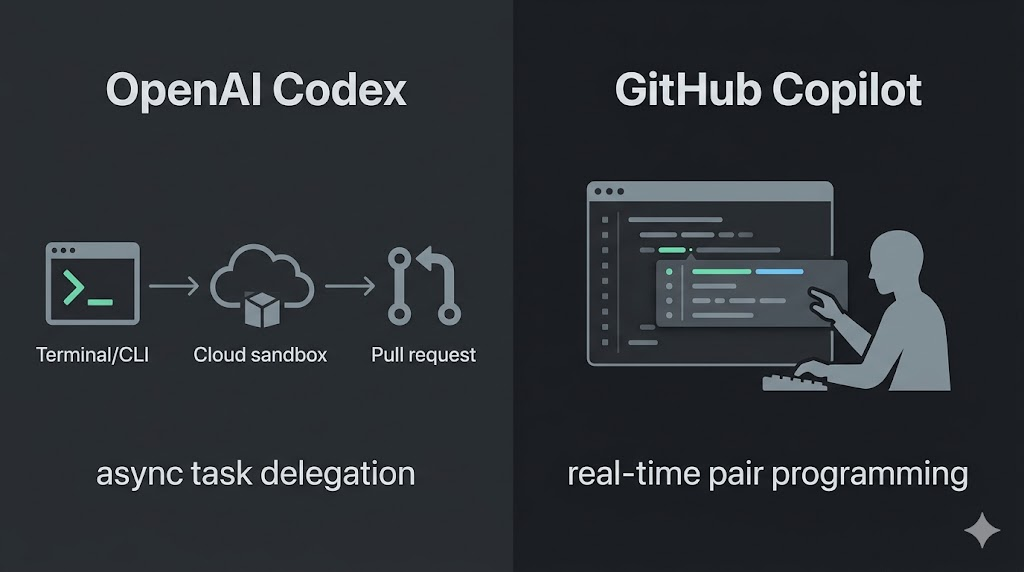

Narzędzia do kodowania z AI rozdzieliły się na dwa odmienne paradygmaty: agenci, którzy pracują, gdy śpisz, oraz asystenci, którzy pracują, gdy piszesz. OpenAI Codex i GitHub Copilot to najlepsze przykłady każdego z nich.

W tym artykule rozłożę na czynniki pierwsze kluczowe filozoficzne i techniczne różnice między tymi dwoma narzędziami. Zajrzymy pod maskę obu platform, porównując je bezpośrednio pod kątem możliwości agentowych, integracji z IDE, obsługi kontekstu w bazie kodu oraz struktury cen.

TL;DR: OpenAI Codex vs GitHub Copilot

Najszybszy sposób, by odróżnić te dwa narzędzia, to spojrzeć na to, jak oczekują, że będziesz pracować.

|

Funkcja |

OpenAI Codex |

Github Copilot |

|

Typ |

Autonomiczny agent do kodowania |

AI Pair Programmer i platforma multi-agentowa |

|

Interfejs |

CLI, aplikacja desktopowa, interfejs webowy |

Natywna integracja z IDE (VS Code, JetBrains itd.), CLI, interfejs webowy |

|

Wybór modelu |

Tylko modele GPT od OpenAI |

Wybór wielu modeli (GPT, Claude, Gemini) |

|

Unikalna przewaga |

Izolowane wykonywanie i równoległe przetwarzanie zadań |

Beztarciowy przepływ pracy w IDE i integracja z MCP |

|

Najlepsze do |

Asynchronicznego delegowania zadań i szerokiego refaktoringu |

Sugestii w czasie rzeczywistym i kodowania w stanie flow |

|

Progi cenowe |

$20/mies. (Plus), $100/mies. lub $200/mies. (plany Pro); ograniczony dostęp z Go ($8/mies.) |

$10/mies. i $39/mies. (Indywidualny), $19/mies. (Business), $39/mies. (Enterprise) |

Twój podstawowy wybór powinien być dyktowany przez twoje bieżące potrzeby inżynieryjne. Niektórzy zaawansowani użytkownicy stosują nawet podejście hybrydowe.

Czym jest OpenAI Codex?

Zanim spojrzymy na produkt, musimy rozplątać terminologię. "Codex" zaczął jako wyspecjalizowana rodzina modeli; oryginalny silnik stojący za pierwszą iteracją GitHub Copilota.

Choć bazowe modele poszły do przodu (przechodząc przez GPT-5.3-Codex i w coraz większym stopniu opierając się na GPT-5.4 i GPT-5.5), OpenAI wykorzystało nazwę "Codex" ponownie dla samodzielnego, autonomicznego produktu-agenta.

W całym artykule odnosimy się do OpenAI Codex jako do platformy, a nie rodziny modeli. Niezależnie od tego, czy korzystasz z niej przez CLI, aplikację desktopową czy interfejs webowy, uzyskujesz dostęp do tej samej głównej usługi agentowej. Traktujemy je jako punkty dostępu do tej samej bazowej inteligencji.

Dziś OpenAI Codex działa jako wytrzymały autonomiczny agent do kodowania. Uruchamia bezpieczne, izolowane środowiska chmurowe, klonuje twoje repozytorium, pisze i testuje kod, a następnie składa Pull Request do twojej recenzji.

Kluczowe funkcje i możliwości Codex

- Izolowane wykonywanie w chmurze: Codex uruchamia twój kod w odizolowanych środowiskach. To kluczowe dla bezpieczeństwa i testowania, bo pozwala agentowi wykonywać potencjalnie destrukcyjne skrypty lub złożone migracje bez dotykania twojej lokalnej maszyny.

- Obsługa zadań równoległych: Możesz jednocześnie delegować wiele, niezależnych zadań długoterminowych przez otwartoźródłowe CLI Codex lub aplikację desktopową.

- Kompakcja kontekstu i pamięci: Przy zadaniach długoterminowych Codex dynamicznie kompresuje swoje okno kontekstu, by utrzymać fokus bez przekraczania limitów tokenów. Zawiera teraz funkcję Chronicle, która pozwala agentowi przenosić przydatny kontekst, preferencje dewelopera i wnioski architektoniczne z jednej sesji do drugiej.

- Adaptacyjny nakład rozumowania: Możesz ręcznie regulować przydział mocy obliczeniowej agenta od minimalnego (dla szybkich skryptów) po bardzo wysoki (dla złożonych refaktoryzacji architektury).

Plusy i minusy Codex

- Plusy: Codex oferuje prawdziwą autonomię end-to-end. Jego zdolność do równoległego przetwarzania zadań, przenoszenia trwałego kontekstu dzięki pamięciom Chronicle i weryfikowania własnego wyjścia w izolowanym środowisku sprawia, że jest szczególnie przydatny do delegowania na dużą skalę. Oferuje też niższy próg wejścia dzięki nowo wprowadzonemu startowemu planowi za $8/mies. do lżejszego użycia.

- Minusy: Nie ma autouzupełniania w czasie rzeczywistym inline; wymaga wyraźnego przestawienia się na delegowanie zadań zamiast współpisania. Co więcej, choć poziom $8/mies. jest dostępny, deweloperzy uruchamiający ciężkie zadania równoległe szybko będą potrzebować wyższych planów ChatGPT Pro ($100/mies. lub $200/mies.), by nie wpadać na ciasne limity mocy obliczeniowej.

Aby zobaczyć Codex w akcji, polecam nasze poradniki pokazujące, jak używać CLI Codex do automatyzacji przepływów danych lub integrowania serwerów MCP.

Czym jest GitHub Copilot?

GitHub Copilot przeszedł ogromną przemianę od czasów, gdy był prostym narzędziem autouzupełniania inline. Dziś to platforma multi-agentowa zaprojektowana tak, by działać natywnie tam, gdzie piszesz.

Jednak gwałtowny rozwój Copilota w kierunku przepływów agentowych zasadniczo zmienił jego zapotrzebowanie na obliczenia. Długotrwałe, zrównoleglone sesje obciążyły jego infrastrukturę, zmuszając GitHuba do radykalnych zmian w planach dla użytkowników indywidualnych w II kw. 2026 r., aby utrzymać niezawodność usługi.

Kluczowe funkcje i możliwości GitHub Copilot

-

Elastyczność wielu modeli: Copilot nie jest już ściśle przywiązany do jednego dostawcy. Wybór modelu obejmuje teraz dostęp do GPT-5.4 i GPT-5.5, a także Claude od Anthropic (z Opus 4.7 dostępnym w planach Pro+) oraz Google Gemini.

-

Copilot workspace i tryb planu: Workspace korzysta z modelu plan-review-execute. Możesz wziąć "tryb planu" w VS Code lub CLI, by poprawić efektywność zadań i zmniejszyć zużycie tokenów, zanim agent zacznie pisać.

-

Tryb agenta i

/fleet: Copilot obsługuje teraz edycje wielu plików i równoległe przepływy pracy bezpośrednio w IDE, choć te polecenia zużywają znaczące zasoby obliczeniowe. -

Integracja z MCP: Model Context Protocol (MCP) pozwala Copilotowi bezpiecznie łączyć się z twoimi zewnętrznymi lokalnymi narzędziami deweloperskimi i źródłami danych.

Plusy i minusy GitHub Copilot

- Plusy: Zapewnia beztarciową integrację z IDE (VS Code, JetBrains, Neovim) i ma najniższą krzywą nauki spośród narzędzi AI do kodowania. Elastyczność wielu modeli to ogromna przewaga nad starszymi wersjami, pozwalając kierować konkretne problemy do najlepiej pasujących modeli. Jego głęboka integracja z GitHubem (PR-y, zgłoszenia, wyszukiwanie kodu) jest bezkonkurencyjna.

- Minusy: Niedawne wprowadzenie ostrych limitów sesji i tygodniowych tokenów, w połączeniu z wstrzymaniem nowych płatnych rejestracji indywidualnych, utrudnia ciężkim użytkownikom poleganie na nim przy złożonych zadaniach bez przejścia na Pro+. Jego możliwości agentowe pozostają mniej dojrzałe niż podejście sandboxowe Codex, tzn. Copilot jest po prostu mniej agentowy, bo nie ma wbudowanego sandboxa do niezależnego wykonywania, ponawiania i testowania.

Po więcej informacji zajrzyj do naszego poradnika GitHub Copilot CLI i zobacz nasze porównania, jak Copilot wypada na tle Claude Code i Cursor.

Codex vs GitHub Copilot: Porównanie bezpośrednie

Mimo że dzielą to samo inżynierskie DNA, Codex i GitHub Copilot to zasadniczo różne produkty. Oto szczegółowe porównanie w różnych kluczowych aspektach:

|

Funkcja |

OpenAI Codex |

GitHub Copilot |

|

Typ produktu |

Autonomiczny agent do kodowania |

AI pair programmer i platforma multi-agentowa |

|

Interfejs |

Platforma wielointerfejsowa (CLI, Desktop, Web) |

Natywne IDE (VS Code, JetBrains, Neovim) |

|

Wybór modelu |

GPT-5.4, GPT-5.5 itd. |

Multi-model (GPT-5.4/5.5, Claude 4.7, Gemini) |

|

Umiejętności agentowe |

Izolowane wykonywanie, przetwarzanie równoległe |

Workspace, tryb agenta, |

|

Integracja z IDE |

W oparciu o rozszerzenia (agent czatu w pasku bocznym, odwołania do plików |

Głęboka, beztarciowa integracja |

|

Obsługa kontekstu |

Klonowanie repo + pamięć Chronicle |

Indeksowanie w całej organizacji (Enterprise) |

|

Cena (Indywidualnie) |

Free, $8/mies. (Base), $20/mies. (Plus), $100-200/mies. (Pro) |

Free, $10/mies. (Pro), $39/mies. (Pro+) |

|

Cena (Zespół) |

Model rozliczeń pay-as-you-go |

$19/mies. (Business), $39/mies. (Enterprise) |

|

Bezpieczeństwo |

Izolacja wykonywania w sandboxie |

Odszkodowanie IP, dzienniki audytu, polityki kontroli |

|

Najlepsze do |

Delegowania zadań, złożonych refaktoryzacji wielu plików |

Współpracy w czasie rzeczywistym, kodowania w stanie flow |

1. Interfejs i przepływ pracy

Podstawowy filozoficzny podział między tymi narzędziami sprowadza się do tego:

- Codex jest zbudowany do delegowania zadań

- Copilot jest zbudowany do współpracy w czasie rzeczywistym

Dla zobrazowania: wyobraź sobie, że musisz zrefaktoryzować przepływ uwierzytelniania w aplikacji. Z GitHub Copilot otwierasz IDE, przechodzisz do odpowiednich plików i zaczynasz współpracę. Używasz Copilot Chat, gdy utkniesz, polegasz na sugestiach inline podczas pisania i być może uruchamiasz tryb Agenta do lokalnych edycji wielu plików, podczas gdy nadzorujesz proces.

W OpenAI Codex przepływ wygląda bardziej jak zarządzanie podwładnym. Opisujesz pożądany rezultat przez interfejs CLI Codex lub aplikację desktopową, przekazujesz potrzebny kontekst repozytorium i odchodzisz. Codex zajmuje się refaktoryzacją w tle i ostatecznie składa Pull Request do twojej recenzji.

2. Modele AI i generowanie kodu

Dziś Codex jest mocno zoptymalizowany pod kątem najnowszych modeli GPT-5.4 i GPT-5.5 od OpenAI, wyraźnie dostrojonych do długoterminowych zadań inżynierii oprogramowania.

GitHub Copilot z kolei przyjmuje filozofię "przynieś swój własny model". Jego selektor modeli pozwala przełączać się między GPT-5.4, GPT-5.5, Google Gemini i Claude od Anthropic (z Opus 4.7 dostępny w planach Pro+).

Oba narzędzia generują wyjątkowo dobry kod do rutynowych zadań. Różnica pojawia się głównie przy złożonych, wieloetapowych problemach:

- Elastyczność wielu modeli w Copilocie pozwala odpytywać różne modele, by rozbić problem na części

- Codex polega na zdolności autonomicznego wykonywania i weryfikowania własnego wyjścia, by mieć pewność, że kod działa, zanim ci go przedstawi

3. Możliwości agentowe

Tu rozbieżności są najbardziej widoczne. Codex jest od podstaw zaprojektowany do prawdziwej autonomii agentowej. Używa bezpiecznych, izolowanych środowisk chmurowych do zamkniętej pętli weryfikacji testów i natywnie wspiera równoległe przetwarzanie zadań, więc możesz uruchamiać wiele niezależnych refaktoryzacji jednocześnie bez zawieszania swojej maszyny.

GitHub Copilot agresywnie wkroczył w przestrzeń agentową dzięki Copilot Workspace (z modelem plan-review-execute) i trybowi Agenta w IDE z poleceniami takimi jak /fleet.

Jednak, jak wspomniano wcześniej, te równoległe przepływy pracy zużywają dużo zasobów i często wpychają użytkowników Copilota w restrykcyjne limity tokenów. Co ważniejsze, Copilot nie ma niezależnego, odizolowanego wykonywania kodu. Wymaga twojego lokalnego środowiska, by uruchamiać i testować swoje wyniki, co czyni Codex bardziej solidnym wyborem do bezpiecznej, bezobsługowej autonomii w wielu plikach.

4. Integracja z IDE i konfiguracja

Do codziennego, skupionego kodowania integracja GitHub Copilot jest bezkonkurencyjna. Jest natywnie wbudowany w VS Code, JetBrains i Neovim i oferuje bezproblemowy przepływ tab-to-accept, który czuje się jak naturalne przedłużenie klawiatury.

OpenAI Codex tymczasem wyszedł poza początki jako agent wyłącznie webowy. Ma teraz solidne rozszerzenie IDE (dostępne dla VS Code i JetBrains), które przenosi jego autonomiczne możliwości bezpośrednio do paska bocznego edytora.

Choć nie jest to narzędzie "autouzupełniania inline" w tym samym sensie co Copilot, pozwala na czat, odwoływanie się do plików z użyciem składni @ oraz delegowanie złożonych zadań do uruchomienia w tle bez opuszczania IDE. Do delegowania zadań w tle i rozumowania na wielu plikach zdolność Codex do "myślenia" podczas twojej dalszej pracy w edytorze to istotna przewaga operacyjna.

5. Kontekst bazy kodu i zrozumienie

Kontekst to wszystko w kodowaniu wspieranym przez AI. Dla dużych organizacji z ogromnymi, złożonymi bazami kodu GitHub Copilot Enterprise ma wyraźną przewagę dzięki trwałemu, organizacyjnemu indeksowaniu repozytoriów. Natywnie rozumie, jak twoje mikroserwisy współdziałają, bo ma dostęp do całego grafu organizacyjnego.

Codex inaczej obsługuje kontekst. Klonuje twoje repozytorium na świeżo dla aktywnej sesji, by zbudować głębokie zrozumienie bazy kodu, na której pracuje. Wcześniej Codex "zapominał" wszystko po zakończeniu sesji.

Jednak dzięki nowo wprowadzonej funkcji zarządzania pamięcią znanej jako Chronicle Codex może teraz trwale przenosić kluczowy kontekst architektoniczny, preferencje dewelopera i złożone wnioski z jednej sesji do drugiej.

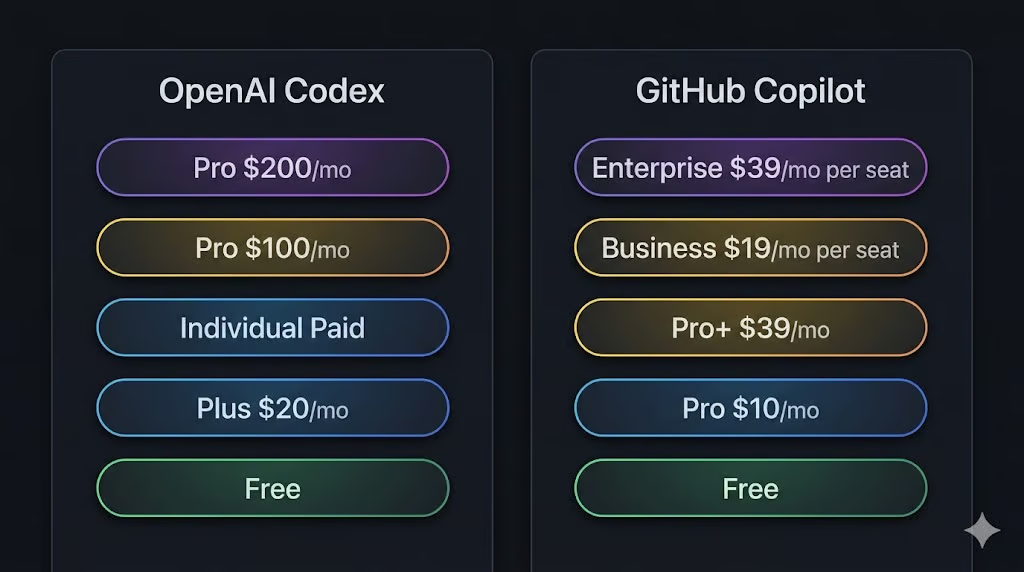

6. Ceny i plany

GitHub Copilot działa w oparciu o przewidywalny model cen za użytkownika. Dla osób indywidualnych są trzy poziomy:

- Free: $0/mies.

- Pro: $10/mies.

- Pro+: $39/mies.

Dla zespołów ścieżki organizacyjne to:

- Business: $19/mies.

- Enterprise: $39/mies.

Ponieważ przepływy agentowe podbiły koszty obliczeń do zaporowych poziomów, często sprawiając, że garść zapytań przekracza cenę indywidualnej subskrypcji, GitHub podjął zdecydowane działania. Jeśli chcesz zarejestrować się jako użytkownik indywidualny dziś, trafisz na listę oczekujących. Nowe rejestracje do planów Copilot Pro, Pro+ i Student są obecnie wstrzymane, aby chronić doświadczenie obecnych klientów.

Dla tych, którzy już są na platformie, wprowadzono ścisłe limity sesji i tygodniowe (7-dniowe) limity tokenów. Limity te zależą od zużycia tokenów i konkretnych "mnożników modeli". Jeśli uruchamiasz równoległe przepływy (jak polecenie /fleet), szybko przepalisz swój przydział tokenów.

Aby zwiększyć przejrzystość, VS Code i Copilot CLI wyświetlają teraz ostrzeżenia o zużyciu w czasie rzeczywistym, gdy zbliżasz się do limitu. Użytkownicy, którzy osiągną pułap, będą domyślnie korzystać ze standardowych modeli do czasu resetu tygodniowego okresu, choć przejście na Pro+ oferuje ponad 5x limity standardowego planu Pro.

OpenAI Codex jest zorganizowany wokół mocy obliczeniowej, a nie przewidywalności SaaS na użytkownika. Oferuje bardzo dostępny bezpłatny poziom dla deweloperów, którzy chcą go wypróbować, a następnie startowy plan za $8/mies. do lekkiego użycia. Oba nadają się tylko do testów Codex, ale są bardzo ograniczone.

Poza tym skaluje się wraz ze standardowymi subskrypcjami ChatGPT:

- Plus: $20/mies. (oferuje ograniczone wykonywanie zadań)

- Poziomy Pro: $100/mies. i $200/mies. (zapewniają ogromną moc obliczeniową wymaganą do poważnej, zrównoleglonej inżynierii oprogramowania)

Kompromis jest prosty: Copilot jest znacznie łatwiejszy do budżetowania w całej organizacji, podczas gdy Codex daje bardziej granulowane punkty wejścia; jest całkowicie darmowy na start, ale skaluje się do zauważalnie wyższych kosztów dla power userów uruchamiających ciężkie, agentowe obciążenia.

7. Bezpieczeństwo i zgodność

GitHub Copilot Enterprise mocno stawia na tradycyjną zgodność korporacyjną. Oferuje

- Kompleksowe odszkodowanie IP

- Rozbudowane logowanie audytowe

- Ścisłe polityki organizacyjne integrujące się z twoją istniejącą administracją GitHub.

Codex podchodzi do bezpieczeństwa poprzez architekturę, a nie polityki. Jego izolowane wykonywanie w sandboxie gwarantuje, że potencjalnie destrukcyjne operacje (jak migracje baz danych czy gruntowne zmiany zależności) nie uszkodzą twojego lokalnego środowiska ani serwerów produkcyjnych.

Jednak konfiguracja zgodności, taka jak zarządzanie kluczami API i utrzymywanie ścieżek audytu, w dużej mierze spada na twój zespół inżynieryjny, zamiast być obsługiwana od razu po wyjęciu z pudełka.

Czy wybrać Codex czy GitHub Copilot?

Koniec końców wybór między OpenAI Codex a GitHub Copilot rzadko jest debatą o tym, który model AI jest "mądrzejszy". To raczej kalkulacja tego, jak ty i twój zespół wolicie pracować.

Czy potrzebujesz asystenta, który szkicuje boilerplate, gdy twoje ręce są na klawiaturze, czy wysoko kompetentnego agenta, który weźmie na siebie ciężki refaktoring bez twojego nadzoru?

Wybierz Codex, jeśli...

- Chcesz delegować całe funkcje end-to-end. Jeśli twoim celem jest opisanie pożądanego wyniku, przekazanie potrzebnego kontekstu i po prostu przejrzenie gotowego Pull Requesta, Codex jest do tego stworzony. Najlepiej sprawdza się w autonomicznym, bezobsługowym wykonaniu.

- Potrzebujesz równoległego przetwarzania zadań. Dla deweloperów, którzy regularnie żonglują wieloma złożonymi problemami, możliwość odpalenia kilku niezależnych zadań jednocześnie, ze świadomością, że działają bezpiecznie w odizolowanych sandboxach chmurowych, to game changer. Zapobiega to zawieszaniu się twojej lokalnej maszyny pod ciężarem zadań obliczeniowych.

- Pracujesz w środowiskach terminal/CLI-first. Jeśli twój workflow kręci się wokół linii komend lub chcesz budować własne narzędzia deweloperskie i potoki CI/CD, interfejs CLI Codex i solidne samodzielne aplikacje desktopowe (na macOS i Windows) zapewniają dokładnie taki podział, jakiego potrzebujesz.

- Już płacisz za ChatGPT Pro. Jeśli już wykładasz $100 lub $200 miesięcznie za jeden z wyższych planów ChatGPT Pro, by mieć dostęp do ogromnych limitów mocy obliczeniowej, kierowanie zadań programistycznych przez Codex to najlepszy sposób, by zmaksymalizować wartość tej inwestycji. A jeśli nie, darmowy lub startowy poziom $8/mies. ułatwia przetestowanie rozwiązania.

Wybierz GitHub Copilot, jeśli...

- Chcesz sugestii AI w IDE bez żadnego tarcia przy konfiguracji. Jeśli priorytetem jest pozostanie w stanie flow, Copilot pozostaje standardem branżowym dla takich przepływów. Jego natywna integracja z VS Code, JetBrains i Neovim oznacza błyskawiczne sugestie zatwierdzane tabulatorem dokładnie tam, gdzie już piszesz.

- Cenisz przełączanie się między dostawcami modeli AI w trakcie sesji. Selektor wielu modeli w Copilocie to ogromna przewaga dla deweloperów, którzy wiedzą, że różne modele w czym innym są najlepsze. Przełączenie z GPT-5.5 na Claude Opus 4.7 od Anthropic lub Gemini 3.1 od Google, by ominąć konkretną przeszkodę, może być pomocne.

- Potrzebujesz przewidywalnej ceny za użytkownika dla zespołu. Zarządzanie budżetami na oprogramowanie i tak jest skomplikowane. Choć indywidualne rejestracje są obecnie wstrzymane, organizacje mogą polegać na poziomach Business ($19/mies.) i Enterprise ($39/mies.) Copilota, by skalować adopcję AI bez obaw o nieregularne, oparte na mocy obliczeniowej skoki rachunków na koniec miesiąca.

- Już korzystasz z ekosystemu GitHub. Jeśli twoja organizacja polega wyłącznie na GitHub issues, Pull Requestach i actions, zdolność Copilot Enterprise do natywnego indeksowania całej bazy kodu organizacji i bezpośredniej integracji z istniejącymi workflow PR to duży wyróżnik.

Końcowe przemyślenia

Wybór między OpenAI Codex a GitHub Copilot zależy od tego, jak ty i twój zespół inżynierski faktycznie pracujecie.

Zasada przewodnia do zapamiętania jest taka:

- Codex jest zbudowany do delegowania.

- Copilot jest zbudowany do współpracy.

Jeśli chcesz inteligentnego partnera-programisty, który wyłapie literówki, odblokuje cię sugestiami inline i pozwoli przełączać się między najlepszymi modelami bazowymi świata w trakcie sesji, przewagę ma GitHub Copilot. Ale jeśli chcesz przekazać agentowi autonomicznemu aktualizację architektury obejmującą wiele plików i po prostu przejrzeć Pull Request przy porannej kawie, narzędziem, którego potrzebujesz, jest OpenAI Codex.

Jeśli chcesz zacząć, polecam nasz skill track AI for Software Engineering, który uczy z wykorzystaniem GitHub Copilot i podobnych narzędzi AI.

Codex vs GitHub Copilot FAQ

Czy mogę używać Codex i GitHub Copilot razem?

Tak, i wielu zaawansowanych użytkowników tak robi. Ponieważ Codex działa głównie poza IDE poprzez CLI, aplikacje desktopowe lub interfejs webowy, nie koliduje z GitHub Copilot działającym lokalnie w VS Code lub JetBrains. Możesz mieć Copilota autouzupełniającego twoją bieżącą funkcję, podczas gdy Codex równolegle uruchamia złożoną, wieloplikową migrację bazy danych w chmurowym sandboxie.

Czy Codex to ten sam model, który zasila GitHub Copilot?

Już nie. To częsta przyczyna nieporozumień. "Codex" pierwotnie odnosił się do rodziny modeli OpenAI, która zasilała pierwszą wersję Copilota. Dziś Codex to samodzielny, autonomiczny produkt-agenta do kodowania od OpenAI. Tymczasem GitHub Copilot to platforma multi-agentowa, która wykorzystuje różne modele, w tym różne wersje GPT od OpenAI, Claude od Anthropic i modele Gemini od Google.

Które narzędzie jest lepsze do autonomicznych, bezobsługowych zadań kodowania?

OpenAI Codex jest zdecydowanie lepszy do zadań bezobsługowych. Jego zdolność do uruchamiania odizolowanych, sandboxowych środowisk chmurowych oznacza, że może niezależnie pisać, wykonywać i weryfikować kod bez ryzyka dla twojej lokalnej konfiguracji. W połączeniu ze zdolnością do równoległego przetwarzania zadań i zachowywania kontekstu dzięki funkcji pamięci Chronicle, Codex jest najlepszym wyborem do prawdziwego delegowania zadań.

Które ma lepsze ceny dla zespołów?

GitHub Copilot jest najlepszy, jeśli chcesz przewidywalnego miesięcznego rachunku, ponieważ używa stałej ceny za użytkownika $19 lub $39. OpenAI Codex jest bardziej elastyczny, bo działa w modelu pay-as-you-go, w którym płacisz tylko za faktyczne użycie.

Dlaczego jest lista oczekujących do GitHub Copilot i czy OpenAI Codex to sensowna alternatywa?

Ad II kw. 2026 r. GitHub wstrzymał nowe rejestracje indywidualne, aby poradzić sobie z ekstremalnym zapotrzebowaniem obliczeniowym funkcji agentowych, takich jak /fleet. OpenAI Codex stanowi przyzwoitą alternatywę o bardziej agentowym profilu dla deweloperów na liście oczekujących.