track

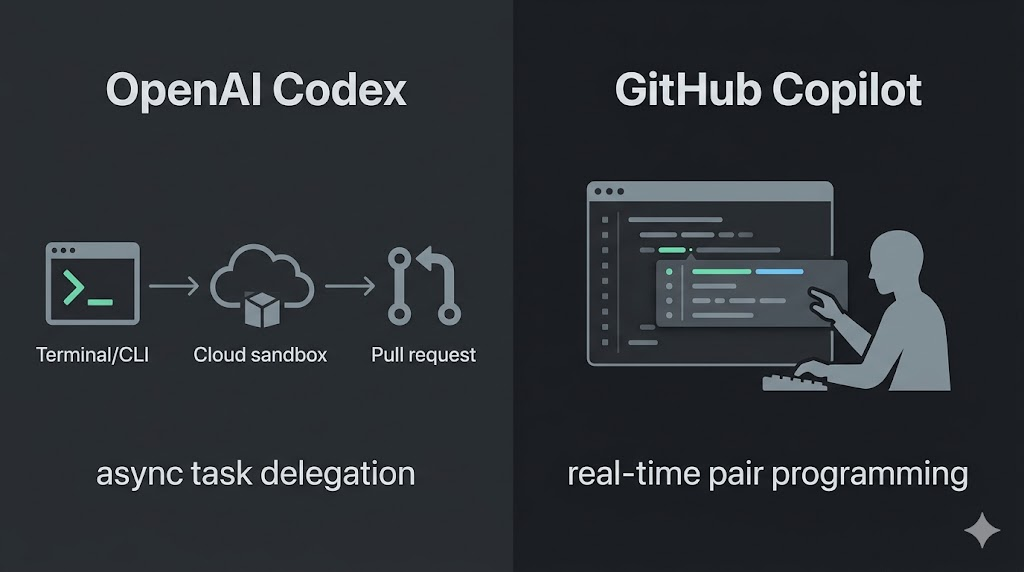

AI-kodningsverktyg har delats upp i två tydliga paradigm: agenter som arbetar medan du sover, och assistenter som arbetar medan du skriver. OpenAI Codex och GitHub Copilot är tydliga exempel på varsin kategori.

I den här artikeln går jag igenom de grundläggande filosofiska och tekniska skillnaderna mellan verktygen. Vi tittar under huven på båda plattformarna och jämför dem direkt utifrån deras agentförmågor, IDE-integrationer, hantering av kodbasens kontext och prismodeller.

TL;DR: OpenAI Codex vs GitHub Copilot

Det snabbaste sättet att särskilja verktygen är att se hur de förväntar sig att du arbetar.

|

Funktion |

OpenAI Codex |

Github Copilot |

|

Typ |

Autonom kodningsagent |

AI-parprogrammerare & multi-agentplattform |

|

Gränssnitt |

CLI, skrivbordsapp, webbgränssnitt |

Inbyggd IDE-integration (VS Code, JetBrains, etc.), CLI, webbgränssnitt |

|

Modellval |

Endast OpenAI GPT-modeller |

Multimodellväljare (GPT, Claude, Gemini) |

|

Unik fördel |

Sandboxad körning och parallell uppgiftshantering |

Friktionsfritt arbetsflöde i IDE och MCP-integration |

|

Bäst för |

Asynkron uppgiftsdelegering och storskalig refaktorisering |

Realtidsförslag och flow-state-kodning |

|

Prisnivåer |

$20/mån (Plus), $100/mån eller $200/mån (Pro-nivåer); begränsad åtkomst med Go ($8/mån) |

$10/mån och $39/mån (Individuell), $19/mån (Business), $39/mån (Enterprise) |

Ditt primära val bör styras av dina omedelbara ingenjörsbehov. Vissa avancerade användare väljer till och med en hybridstrategi.

Vad är OpenAI Codex?

Innan vi tittar på produkten måste vi reda ut terminologin. "Codex" började som en specialiserad modellfamilj; den ursprungliga motorn bakom den första versionen av GitHub Copilot.

Även om de underliggande modellerna har utvecklats (via GPT-5.3-Codex och i allt högre grad med GPT-5.4 och GPT-5.5), har OpenAI återanvänt namnet "Codex" för en fristående, autonom agentprodukt.

Genom hela artikeln syftar vi på OpenAI Codex som plattformen, inte modellfamiljen. Oavsett om du använder den via CLI, skrivbordsappen eller webbgränssnittet, använder du samma kärntjänst för agentik. Vi betraktar dessa som åtkomstpunkter till samma underliggande intelligens.

Idag fungerar OpenAI Codex som en tung, autonom kodningsagent. Den startar säkra, sandboxade molnmiljöer, klonar ditt repo, skriver och testar koden och skickar sedan in en Pull Request för din granskning.

Viktiga funktioner och förmågor i Codex

- Sandboxad molnkörning: Codex kör din kod i isolerade miljöer. Detta är avgörande för säkerhet och testning, eftersom agenten kan köra potentiellt destruktiva skript eller komplexa migreringar utan att röra din lokala maskin.

- Parallell uppgiftshantering: Du kan delegera flera, oberoende långsiktiga uppgifter samtidigt via den öppna Codex CLI:n eller skrivbordsappen.

- Kontextkomprimering & minnen: För långsiktiga uppgifter komprimerar Codex dynamiskt sitt kontextfönster för att behålla fokus utan att överskrida token-gränser. Den innehåller nu funktionen Chronicle, som gör att agenten kan bära med sig användbar kontext, utvecklarpreferenser och arkitekturella lärdomar från en session till en annan.

- Adaptiv resonemangsinsats: Du kan manuellt ställa in agentens beräkningsallokering från minimal (för snabba skript) till extra hög (för komplexa arkitekturella refaktoriseringar).

För- och nackdelar med Codex

- Fördelar: Codex erbjuder sann end-to-end-autonomi. Förmågan att hantera uppgifter parallellt, bära bestående kontext via Chronicle-minnen och verifiera sina egna resultat i en sandboxad miljö gör den särskilt användbar för storskalig delegering. Den har också en lägre tröskel med en ny introducerad startplan på $8/månad för lättare användning.

- Nackdelar: Det finns ingen realtids autokomplettering inline; det kräver ett tydligt mentalt skifte mot uppgiftsdelegering snarare än samskrivning. Dessutom, även om nivån $8/mån är tillgänglig, kommer utvecklare som kör tunga parallella uppgifter snabbt att behöva de högre ChatGPT Pro-planerna ($100/mån eller $200/mån) för att undvika att slå i tajta beräkningsgränser.

För att se Codex i praktiken rekommenderar jag våra handledningar som visar hur du använder Codex CLI för automatisering av dataarbetsflöden eller integrering av MCP-servrar.

Vad är GitHub Copilot?

GitHub Copilot har förändrats dramatiskt från sina rötter som ett enkelt inline-autokompletteringsverktyg. Idag är det en multi-agentplattform som är designad för att leva inbyggt där du skriver.

Copilots snabba utveckling mot agentiska arbetsflöden har dock i grunden förändrat dess beräkningskrav. Långvariga, parallelliserade sessioner har belastat infrastrukturen, vilket tvingade GitHub att göra drastiska förändringar i sina individuella planstrukturer under Q2 2026 för att upprätthålla tillförlitligheten.

Viktiga funktioner och förmågor i GitHub Copilot

-

Multimodellflexibilitet: Copilot är inte längre strikt låst till en leverantör. Modellväljaren inkluderar nu tillgång till GPT-5.4 och GPT-5.5 samt Anthropics Claude (med Opus 4.7 tillgänglig på Pro+-planer) och Googles Gemini.

-

Copilot workspace & planläge: Workspace använder en plan-granska-exekvera-modell. Du kan ta "planläge" i VS Code eller CLI för att förbättra uppgiftseffektiviteten och minska tokenförbrukningen innan agenten börjar skriva.

-

Agentläge &

/fleet: Copilot stöder nu redigering av flera filer och parallella arbetsflöden direkt i IDE:n, även om dessa kommandon förbrukar betydande beräkning. -

MCP-integration: Model Context Protocol (MCP) gör att Copilot på ett säkert sätt kan koppla upp sig mot dina externa lokala utvecklarverktyg och datakällor.

För- och nackdelar med GitHub Copilot

- Fördelar: Det ger en helt friktionsfri IDE-integration (VS Code, JetBrains, Neovim) och har den lägsta inlärningströskeln av alla AI-kodningsverktyg. Multimodellflexibiliteten är en stor fördel jämfört med äldre versioner och låter dig dirigera specifika problem till de modeller som är bäst lämpade. Den djupa integrationen med GitHub (PR:ar, issues, kodsökning) är oöverträffad.

- Nackdelar: Den senaste implementeringen av strikta sessions- och veckovisa tokengränser, tillsammans med paus för nya individuella betalande registreringar, gör det svårt för tunga användare att förlita sig på det för komplexa uppgifter utan uppgradering till Pro+. Dess agentiska förmågor är mindre mogna än Codex sandboxade angreppssätt, d.v.s. Copilot är helt enkelt mindre agentisk eftersom det saknar inbyggd sandbox för oberoende körning, iteration och testning.

För mer information, kolla in vår GitHub Copilot CLI-handledning och se våra jämförelser av hur Copilot står sig mot Claude Code och Cursor.

Codex vs GitHub Copilot: Direkt jämförelse

Trots att de delar samma underliggande ingenjörs-DNA är Codex och GitHub Copilot fundamentalt olika produkter. Här är en detaljerad jämförelse över olika kritiska faktorer:

|

Funktion |

OpenAI Codex |

GitHub Copilot |

|

Produkttyp |

Autonom kodningsagent |

AI-parprogrammerare & multi-agentplattform |

|

Gränssnitt |

Multi-gränssnittsplattform (CLI, Desktop, Web) |

Inbyggd IDE (VS Code, JetBrains, Neovim) |

|

Modellval |

GPT-5.4, GPT-5.5, etc. |

Multimodell (GPT-5.4/5.5, Claude 4.7, Gemini) |

|

Agentiska färdigheter |

Sandboxad körning, parallell bearbetning |

Workspace, agentläge, |

|

IDE-integration |

Extensionsbaserad (sidopanel-chattagent, |

Djup, friktionsfri integration |

|

Kontexthantering |

Repo-kloning + Chronicle-minne |

Organisationstäckande indexering i Enterprise |

|

Pris (Individ) |

Gratis, $8/mån (Bas), $20/mån (Plus), $100–200/mån (Pro) |

Gratis, $10/mån (Pro), $39/mån (Pro+) |

|

Pris (Team) |

Betala-efter-förbrukning-modell |

$19/mån (Business), $39/mån (Enterprise) |

|

Säkerhet |

Isolering via sandboxad körning |

IP-skydd, granskningsloggar, policystyrning |

|

Bäst för |

Uppgiftsdelegering, komplexa refaktoriseringar över flera filer |

Samarbete i realtid, flow-state-kodning |

1. Gränssnitt och arbetsflöde

Den grundläggande filosofiska skillnaden mellan verktygen kokar ner till detta:

- Codex är byggt för uppgiftsdelegering

- Copilot är byggt för samarbete i realtid

Föreställ dig att du behöver refaktorisera din applikations autentiseringsflöde. Med GitHub Copilot öppnar du din IDE, går till relevanta filer och börjar samarbeta. Du använder Copilot Chat när du kör fast, litar på inline-förslag medan du skriver och kan trigga Agent Mode för lokala ändringar över flera filer medan du övervakar.

Med OpenAI Codex liknar arbetsflödet mer att hantera en direkt rapport. Du beskriver önskat resultat via Codex CLI eller skrivbordsappen, ger den nödvändig repokontext och kliver åt sidan. Codex hanterar refaktoriseringen i bakgrunden och skickar till slut in en Pull Request för dig att granska.

2. AI-modeller och kodgenerering

Idag är Codex kraftigt optimerat kring OpenAI:s senaste GPT-5.4- och GPT-5.5-modeller, uttryckligen trimmade för långsiktiga mjukvaruingenjörsuppgifter.

GitHub Copilot omfamnar å andra sidan en "ta med din egen modell"-filosofi. Dess multimodellväljare låter dig växla mellan GPT-5.4, GPT-5.5, Googles Gemini och Anthropic’s Claude (med Opus 4.7 tillgänglig på Pro+-planer).

Båda verktygen producerar mycket bra kod för rutinuppgifter. Skillnaden märks främst vid komplexa, flerstegsuppgifter:

- Copilots multimodellflexibilitet låter dig fråga olika modeller för att bryta ner ett problem

- Codex förlitar sig på sin förmåga att autonomt köra och verifiera sina egna resultat för att säkerställa att koden fungerar innan den presenteras för dig

3. Agentiska förmågor

Här blir skillnaden som tydligast. Codex är konstruerat från grunden för sann agentisk autonomi. Det använder säkra, sandboxade molnmiljöer för slutna testverifieringar och stöder inbyggt parallell uppgiftsbearbetning så att du kan köra flera oberoende refaktoriseringar samtidigt utan att frysa din maskin.

GitHub Copilot har tagit stora kliv in i det agentiska området med Copilot Workspace (med en plan-granska-exekvera-modell) och IDE-baserat Agent Mode med kommandon som /fleet.

Men som nämnts tidigare förbrukar dessa parallella arbetsflöden mycket beräkning och pressar ofta Copilot-användare in i restriktiva tokengränser. Viktigare är att Copilot inte har oberoende, isolerad kodkörning. Det kräver din lokala miljö för att köra och testa sina utdata, vilket gör Codex till ett mer robust val för säker, hands-off autonomi över flera filer.

4. IDE-integration och setup

För daglig kodning i "zonen" är GitHub Copilots integration oöverträffad. Den är inbyggd i VS Code, JetBrains och Neovim, och erbjuder ett friktionsfritt tab-to-accept-arbetsflöde som känns som en naturlig förlängning av tangentbordet.

OpenAI Codex har under tiden gått bortom sina rötter som en webbonly-agent. Den har nu ett robust IDE-tillägg (tillgängligt för VS Code och JetBrains) som tar dess autonoma kapabiliteter direkt in i din editors sidofält.

Även om det inte är ett "inline-autokompletteringsverktyg" i samma bemärkelse som Copilot låter det dig chatta, referera filer med @-syntax och delegera komplexa uppgifter att köras i bakgrunden utan att lämna din IDE. För bakgrundsdelegering och resonemang över flera filer är Codex förmåga att "tänka" medan du fortsätter arbeta i editorn en betydande operativ fördel.

5. Kontext och förståelse av kodbas

Kontext är allt i AI-assisterad kodning. För stora organisationer med massiva, komplexa kodbaser har GitHub Copilot Enterprise en tydlig fördel med sin beständiga, organisationstäckande repo-indexering. Den förstår inbyggt hur dina mikrotjänster samverkar eftersom den har tillgång till hela organisationsgrafen.

Codex hanterar kontext annorlunda. Den klonar ditt repo fräscht för sin aktiva session för att bygga en djup förståelse för den kodbas den arbetar mot. Tidigare "glömde" Codex allt när sessionen tog slut.

Men med den nyligen introducerade minneshanteringsfunktionen som kallas Chronicle kan Codex nu beständigt bära kritisk arkitekturell kontext, utvecklarpreferenser och komplexa lärdomar från en session till en annan.

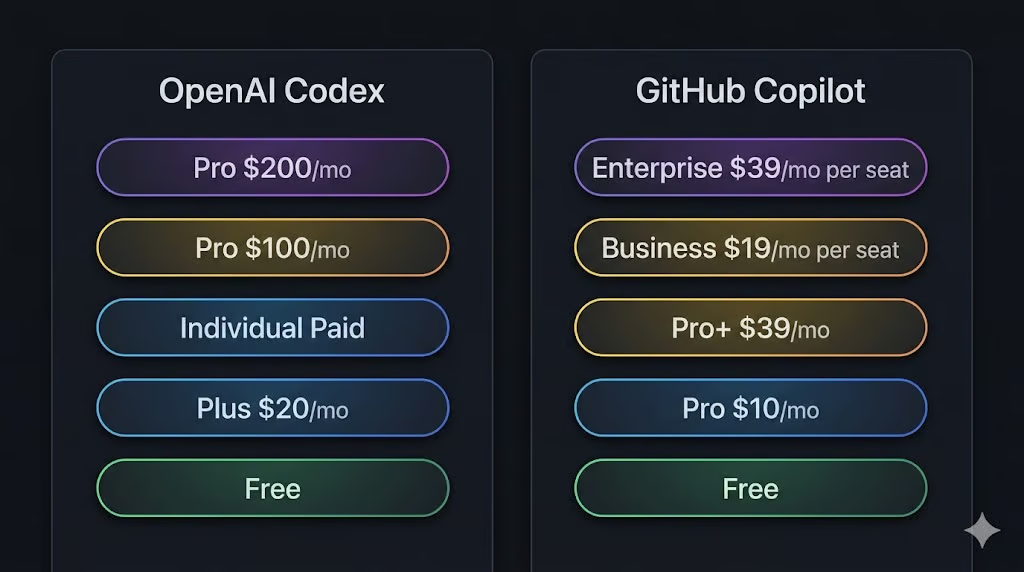

6. Prissättning och planer

GitHub Copilot använder en förutsägbar prissättning per säte. För individer finns tre nivåer:

- Gratis: $0/mån

- Pro: $10/mån

- Pro+: $39/mån

För team är organisationsspåren:

- Business: $19/mån

- Enterprise: $39/mån

Eftersom agentiska arbetsflöden har drivit upp beräkningskostnaderna till orimliga nivåer, ofta så att några få förfrågningar överstiger priset för en individuell prenumeration, har GitHub vidtagit kraftfulla åtgärder. Om du försöker registrera dig som individ idag kommer du att mötas av en väntelista. Nya registreringar för Copilot Pro, Pro+ och Student-planer är för närvarande pausade för att skydda upplevelsen för befintliga kunder.

För dem som redan är på plattformen har strikta sessions- och veckovisa (7 dagar) tokengränser införts. Dessa gränser styrs av tokenförbrukning och specifika "modellmultiplikatorer". Om du kör parallella arbetsflöden (som kommandot /fleet) förbrukar du snabbt din tilldelning.

För att öka transparensen visar VS Code och Copilot CLI nu varningar i realtid när du närmar dig din gräns. Användare som når sitt tak växlar till standardmodeller tills deras veckoperiod återställs, även om uppgradering till Pro+ ger över 5 gånger gränserna för standard Pro-planen.

OpenAI Codex är strukturerat kring beräkningskapacitet snarare än förutsägbar SaaS per säte. Det erbjuder en mycket tillgänglig gratisnivå för utvecklare som vill prova, följt av en startplan på $8/mån för lätt användning. Båda är endast lämpade för att testa Codex och är mycket begränsade.

Därutöver skalar det med standardabonnemang för ChatGPT:

- Plus: $20/mån (erbjuder begränsad uppgiftskörning)

- Pro-nivåer: $100/mån och $200/mån (ger den massiva beräkning som krävs för seriös, parallelliserad programvaruutveckling)

Avvägningen är enkel: Copilot är mycket lättare att budgetera för i en organisation, medan Codex ger mer finmaskiga insteg; helt gratis att börja med, men blir märkbart dyrare för kraftanvändare som kör tunga agentiska arbetslaster.

7. Säkerhet och efterlevnad

GitHub Copilot Enterprise lutar sig tungt mot traditionell företagscompliance. Det erbjuder

- Omfattande IP-skydd

- Utförlig loggning för granskning

- Strikt policystyrning på organisationsnivå som integreras med din befintliga GitHub-administration.

Codex närmar sig säkerhet genom arkitektur snarare än policy. Dess sandboxade körningsisolering säkerställer att potentiellt destruktiva operationer (som databasmigreringar eller omdaningar av beroenden) inte kan skada din lokala miljö eller produktionsservrar.

Däremot faller compliance-setupen, såsom hantering av API-nycklar och upprätthållande av granskningsspår, i stor utsträckning på ditt ingenjörsteam snarare än att hanteras färdigt ur lådan.

Ska du välja Codex eller GitHub Copilot?

I slutändan handlar valet mellan OpenAI Codex och GitHub Copilot sällan om vilken AI-modell som är "smartast". Det är snarare en fråga om hur du och ditt team föredrar att arbeta.

Behöver du en assistent som skriver mallkod medan dina händer är på tangentbordet, eller behöver du en högkapabel agent som tar sig an tung refaktorisering utan att du övervakar?

Du bör välja Codex om...

- Du vill delegera hela funktioner end-to-end. Om ditt mål är att beskriva ett önskat resultat, lämna över nödvändig kontext och helt enkelt granska en färdig Pull Request, är Codex byggt för just detta. Det briljerar i autonom, hands-off-körning.

- Du behöver parallell uppgiftsbearbetning. För utvecklare som regelbundet jonglerar flera komplexa problem är möjligheten att skicka iväg flera oberoende uppgifter samtidigt, med vetskap om att de körs säkert i isolerade molnsandlådor, en gamechanger. Det hindrar din lokala maskin från att frysa under tunga beräkningslaster.

- Du arbetar i terminal-/CLI-först-miljöer. Om ditt arbetsflöde kretsar kring kommandoraden, eller om du vill bygga egna utvecklarverktyg och CI/CD-pipelines, ger Codex CLI och robusta fristående skrivbordsappar (tillgängliga på både macOS och Windows) den separering du behöver.

- Du betalar redan för ChatGPT Pro. Om du redan lägger $100 eller $200 i månaden på en av de högre ChatGPT Pro-nivåerna för att få enorma beräkningsgränser är det bästa sättet att maximera värdet att kanalisera dina kodningsuppgifter genom Codex. Och om du inte gör det, gör gratisnivån eller startnivån på $8/mån det enkelt att prova.

Du bör välja GitHub Copilot om...

- Du vill ha AI-förslag i din IDE utan någon setup-friktion. Om du prioriterar att stanna i ditt flow är Copilot fortfarande branschstandard för dessa arbetsflöden. Den inbyggda integrationen i VS Code, JetBrains och Neovim ger blixtsnabba, tab-to-accept-förslag precis där du redan skriver.

- Du värdesätter att växla mellan AI-modellleverantörer mitt i en session. Copilots multimodellväljare är en stor fördel för utvecklare som vet att olika modeller briljerar på olika saker. Att växla från GPT-5.5 till Anthropics Claude Opus 4.7 eller Googles Gemini 3.1 för att komma förbi ett specifikt hinder kan vara hjälpsamt.

- Du behöver förutsägbar prissättning per säte för ett team. Att hantera mjukvarubudgetar är tillräckligt komplicerat. Även om individuella registreringar för närvarande är pausade kan organisationer lita på Copilots Business ($19/mån) och Enterprise ($39/mån) för att skala sin AI-adoption utan att oroa sig för oförutsägbara, beräkningsbaserade toppar i slutet av månaden.

- Du använder redan GitHub-ekosystemet. Om din organisation förlitar sig uteslutande på GitHub issues, Pull Requests och actions är Copilot Enterprises förmåga att inbyggt indexera hela din organisations kodbas och integrera direkt i dina befintliga PR-arbetsflöden en stor differentierare.

Avslutande tankar

Valet mellan OpenAI Codex och GitHub Copilot beror på hur du och ditt ingenjörsteam faktiskt arbetar.

Grundprincipen att komma ihåg är denna:

- Codex är byggt för delegering.

- Copilot är byggt för samarbete.

Om du vill ha en intelligent parprogrammerare som fångar dina stavfel, låser upp dig med inline-förslag och låter dig växla mellan världens bästa grundmodeller mitt i en session, har GitHub Copilot ett övertag. Men om du vill lämna över en arkitekturell uppdatering över flera filer till en autonom agent och bara granska Pull Requesten över morgonkaffet, är OpenAI Codex verktyget du behöver.

Om du vill komma igång rekommenderar jag att du anmäler dig till vår AI for Software Engineering-kompetensväg, som lär ut med GitHub Copilot och liknande AI-verktyg.

Codex vs GitHub Copilot vanliga frågor

Kan jag använda Codex och GitHub Copilot tillsammans?

Ja, och många avancerade användare gör det. Eftersom Codex i huvudsak fungerar utanför IDE:n via sin CLI, sina skrivbordsappar eller webbgränssnitt, krockar det inte med GitHub Copilot som körs lokalt i VS Code eller JetBrains. Du kan låta Copilot autokomplettera din aktuella funktion medan Codex samtidigt kör en komplex databasmigrering över flera filer i en parallell molnsandbox.

Är Codex samma modell som driver GitHub Copilot?

Inte längre. Detta är en vanlig källa till förvirring. "Codex" syftade ursprungligen på OpenAI:s modellfamilj som drev den första versionen av Copilot. Idag är Codex OpenAI:s fristående, autonoma kodningsagentprodukt. Samtidigt är GitHub Copilot en multi-agentplattform som använder en rad olika modeller, inklusive olika versioner av OpenAI:s GPT, Anthropics Claude och Googles Gemini-modeller.

Vilket verktyg är bättre för autonoma, hands-off-kodningsuppgifter?

OpenAI Codex är avsevärt bättre för hands-off-uppgifter. Dess förmåga att starta isolerade, sandboxade molnmiljöer innebär att den självständigt kan skriva, köra och verifiera kod utan risk för din lokala setup. I kombination med förmågan att processa uppgifter parallellt och behålla kontext via Chronicle-minnet är Codex förstahandsvalet för sann uppgiftsdelegering.

Vilket har bättre prissättning för team?

GitHub Copilot är bäst om du vill ha en förutsägbar månadskostnad eftersom det använder en fast prissättning per säte på $19 eller $39. OpenAI Codex är mer flexibelt eftersom det använder en betala-efter-förbrukning-modell där du bara betalar för det du faktiskt använder.

Varför finns det en väntelista för GitHub Copilot, och är OpenAI Codex ett gångbart alternativ?

Av Q2 2026 har GitHub pausat nya individuella registreringar för att hantera de extrema beräkningskraven från agentiska funktioner som /fleet. OpenAI Codex fungerar som ett bra alternativ med ett mer agentiskt fokus för utvecklare på väntelistan.