Lernpfad

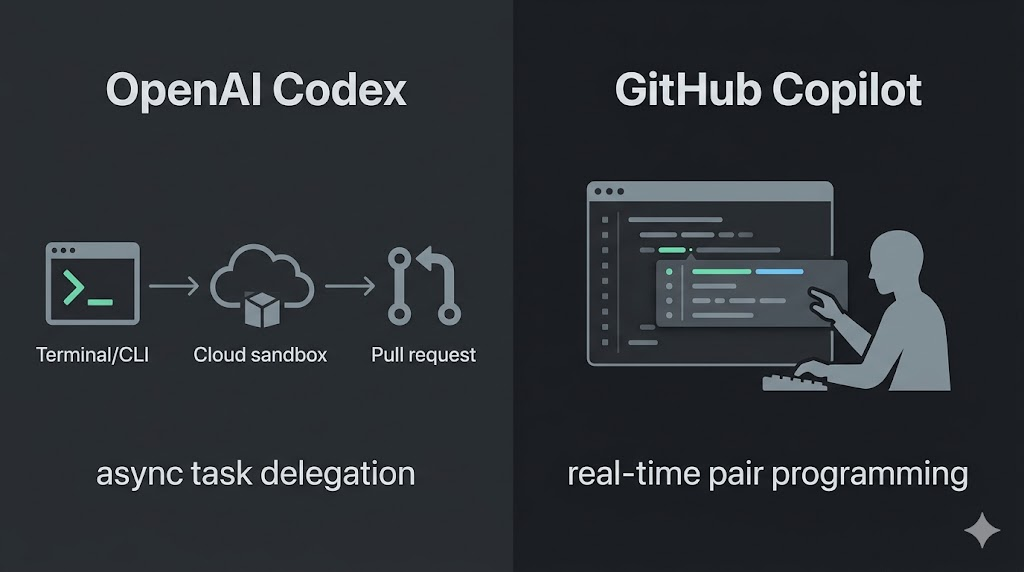

KI-Coding-Tools haben sich in zwei klare Paradigmen aufgespalten: Agenten, die arbeiten, während du schläfst, und Assistenten, die arbeiten, während du tippst. OpenAI Codex und GitHub Copilot sind die Paradebeispiele.

In diesem Artikel zerlege ich die zentralen philosophischen und technischen Unterschiede der beiden Tools. Wir schauen unter die Haube und vergleichen Agentenfähigkeiten, IDE-Integrationen, den Umgang mit Codekontext und die Preisstruktur im direkten Duell.

TL;DR: OpenAI Codex vs. GitHub Copilot

Am schnellsten unterscheidest du die Tools, wenn du dir ansiehst, wie sie erwarten, dass du arbeitest.

|

Feature |

OpenAI Codex |

Github Copilot |

|

Typ |

Autonomer Coding-Agent |

KI-Pair-Programmer & Multi-Agent-Plattform |

|

Interface |

CLI, Desktop-App, Weboberfläche |

Native IDE-Integration (VS Code, JetBrains etc.), CLI, Weboberfläche |

|

Modellwahl |

Nur OpenAI GPT-Modelle |

Multi-Modell-Auswahl (GPT, Claude, Gemini) |

|

Einzigartiger Vorteil |

Sandboxed Execution und parallele Aufgabenverarbeitung |

Reibungsloser IDE-Workflow und MCP-Integration |

|

Am besten geeignet für |

Asynchrone Aufgabendelegation und großangelegte Refactorings |

Echtzeit-Codevorschläge und Flow-State-Coding |

|

Preisstufen |

$20/Monat (Plus), $100/Monat oder $200/Monat (Pro), eingeschränkter Zugriff mit Go ($8/Monat) |

$10/Monat und $39/Monat (Individual), $19/Monat (Business), $39/Monat (Enterprise) |

Deine Entscheidung sollte sich vor allem nach deinem unmittelbaren Engineering-Bedarf richten. Manche Power-User setzen sogar bewusst auf einen hybriden Ansatz.

Was ist OpenAI Codex?

Bevor wir über das Produkt sprechen, müssen wir die Terminologie entwirren. "Codex" startete als spezialisierte Modellfamilie – der ursprüngliche Motor hinter der ersten Iteration von GitHub Copilot.

Während sich die zugrunde liegenden Modelle weiterentwickelt haben (über GPT-5.3-Codex hin zu stärkerem Einsatz von GPT-5.4 und GPT-5.5), hat OpenAI den Namen "Codex" für ein eigenständiges, autonomes Agentenprodukt neu positioniert.

Im gesamten Artikel bezeichnen wir OpenAI Codex als Plattform, nicht als Modellfamilie. Egal ob du über die CLI, die Desktop-App oder die Weboberfläche interagierst: Du greifst auf denselben Kernservice des Agenten zu. Wir betrachten dies als unterschiedliche Einstiegspunkte in dieselbe zugrunde liegende Intelligenz.

Heute fungiert OpenAI Codex als leistungsstarker, autonomer Coding-Agent. Er startet sichere, isolierte Cloud-Umgebungen, klont dein Repository, schreibt und testet Code und erstellt anschließend eine Pull Request zu deiner Prüfung.

Wichtigste Funktionen und Fähigkeiten von Codex

- Sandboxed Cloud Execution: Codex führt deinen Code in isolierten Umgebungen aus. Das ist für Sicherheit und Tests entscheidend, da der Agent so potenziell destruktive Skripte oder komplexe Migrationen ausführen kann, ohne deine lokale Maschine zu berühren.

- Parallele Aufgabenverarbeitung: Du kannst mehrere, unabhängige Langläufer-Aufgaben gleichzeitig über die Open-Source-CLI von Codex oder die Desktop-App delegieren.

- Kontextkompression & Memories: Für Langläufer-Aufgaben komprimiert Codex seinen Kontext dynamisch, um den Fokus zu halten, ohne Tokenlimits zu sprengen. Neu ist das Feature Chronicle, mit dem der Agent nützlichen Kontext, Entwicklerpräferenzen und architektonische Learnings von einer Session zur nächsten mitnimmt.

- Adaptiver Reasoning-Aufwand: Du kannst die Rechenleistung des Agents manuell einstellen – von minimal (für schnelle Skripte) bis extra hoch (für komplexe Architektur-Refactorings).

Die Vor- und Nachteile von Codex

- Vorteile: Codex bietet echte End-to-End-Autonomie. Die Fähigkeit, Aufgaben parallel zu verarbeiten, Kontext über Chronicle-Memories persistent zu tragen und Ausgaben in einer Sandbox zu verifizieren, macht es besonders stark für groß angelegte Delegation. Zudem senkt ein neues Einstiegsangebot für $8/Monat die Hürde für leichtere Nutzung.

- Nachteile: Es gibt kein Inline-Autocomplete in Echtzeit; mental bedeutet das Umdenken von Co-Writing hin zur Aufgabendelegation. Und obwohl die $8/Monat-Stufe zugänglich ist, benötigen Entwickler mit intensiven Parallelaufgaben schnell die höherwertigen ChatGPT-Pro-Pläne ($100/Monat oder $200/Monat), um enge Rechenlimits zu vermeiden.

Um Codex in Aktion zu sehen, empfehle ich unsere Tutorials zur Nutzung der Codex-CLI für Automatisierung von Daten-Workflows oder zur Integration von MCP-Servern.

Was ist GitHub Copilot?

GitHub Copilot hat sich von einem einfachen Inline-Autocomplete-Tool stark weiterentwickelt. Heute ist es eine Multi-Agent-Plattform, die dort nativ lebt, wo du tippst.

Die schnelle Entwicklung hin zu agentischen Workflows hat Copilots Rechenbedarf jedoch grundlegend verändert. Langlaufende, parallelisierte Sessions belasten die Infrastruktur, weshalb GitHub im Q2 2026 drastische Änderungen an den Individual-Plänen vorgenommen hat, um die Service-Qualität zu sichern.

Wichtigste Funktionen und Fähigkeiten von GitHub Copilot

-

Multi-Modell-Flexibilität: Copilot ist nicht mehr strikt an einen Anbieter gebunden. Der Modellwähler enthält nun GPT-5.4 und GPT-5.5 sowie Anthropics Claude (mit Opus 4.7 auf Pro+-Plänen) und Googles Gemini.

-

Copilot Workspace & Plan-Modus: Workspace nutzt ein Plan-Review-Execute-Modell. Du kannst den "Plan-Modus" in VS Code oder der CLI nutzen, um Aufgaben zu strukturieren und den Tokenverbrauch zu senken, bevor der Agent schreibt.

-

Agent Mode &

/fleet: Copilot unterstützt jetzt Multi-File-Edits und parallele Workflows direkt in der IDE, allerdings mit hohem Rechenverbrauch. -

MCP-Integration: Model Context Protocol (MCP) ermöglicht Copilot eine sichere Anbindung an lokale Entwickler-Tools und Datenquellen.

Die Vor- und Nachteile von GitHub Copilot

- Vorteile: Nahtlose IDE-Integration (VS Code, JetBrains, Neovim) und die geringste Lernkurve unter den KI-Coding-Tools. Die Multi-Modell-Flexibilität ist ein großer Pluspunkt und erlaubt, Probleme gezielt an das jeweils beste Modell zu routen. Die tiefe GitHub-Integration (PRs, Issues, Code-Suche) ist unerreicht.

- Nachteile: Strikte Sitzungs- und Wochen-Tokenlimits sowie ein Stopp neuer kostenpflichtiger Individual-Anmeldungen erschweren Heavy-Usern komplexe Aufgaben ohne Pro+-Upgrade. Die agentischen Fähigkeiten sind weniger ausgereift als der Sandbox-Ansatz von Codex, d. h. Copilot ist schlicht weniger agentisch, da eine eingebaute Sandbox für unabhängige Ausführung, Iteration und Tests fehlt.

Mehr dazu findest du in unserem GitHub Copilot CLI-Tutorial und in unseren Vergleichen, wie Copilot gegenüber Claude Code und Cursor abschneidet.

Codex vs. GitHub Copilot: Direktvergleich

Trotz ihrer gemeinsamen Engineering-DNA sind Codex und GitHub Copilot grundverschiedene Produkte. Hier ist ein detaillierter Vergleich entlang zentraler Kriterien:

|

Feature |

OpenAI Codex |

GitHub Copilot |

|

Produkttyp |

Autonomer Coding-Agent |

KI-Pair-Programmer & Multi-Agent-Plattform |

|

Interface |

Multi-Interface-Plattform (CLI, Desktop, Web) |

Native IDE (VS Code, JetBrains, Neovim) |

|

Modellwahl |

GPT-5.4, GPT-5.5, etc. |

Multi-Modell (GPT-5.4/5.5, Claude 4.7, Gemini) |

|

Agentische Fähigkeiten |

Sandboxed Execution, parallele Verarbeitung |

Workspace, Agent Mode, |

|

IDE-Integration |

Erweiterungsbasiert (Sidebar-Chat-Agent, |

Tiefe, reibungslose Integration |

|

Kontexthandling |

Repo-Klonen + Chronicle Memory |

Unternehmensweites Org-Indexing |

|

Preis (Individual) |

Kostenlos, $8/Monat (Base), $20/Monat (Plus), $100–200/Monat (Pro) |

Kostenlos, $10/Monat (Pro), $39/Monat (Pro+) |

|

Preis (Team) |

Pay-as-you-go-Preismodell |

$19/Monat (Business), $39/Monat (Enterprise) |

|

Sicherheit |

Isolierte Sandboxed Execution |

IP-Freistellung, Audit-Logs, Richtliniensteuerung |

|

Am besten für |

Aufgabendelegation, komplexe Multi-File-Refactorings |

Echtzeit-Zusammenarbeit, Flow-State-Coding |

1. Interface und Workflow

Der zentrale philosophische Unterschied lässt sich so zusammenfassen:

- Codex ist für Aufgabendelegation gebaut.

- Copilot ist für die Zusammenarbeit in Echtzeit gebaut.

Beispiel: Du musst den Authentifizierungs-Flow deiner Anwendung refactoren. Mit GitHub Copilot öffnest du die IDE, gehst in die relevanten Dateien und arbeitest zusammen. Du nutzt Copilot Chat, wenn du festhängst, verlässt dich beim Tippen auf Inline-Vorschläge und triggerst ggf. den Agent Mode für begrenzte Multi-File-Edits unter deiner Aufsicht.

Mit OpenAI Codex ähnelt der Ablauf eher dem Managen eines direkten Reports. Du beschreibst das gewünschte Ergebnis über die Codex-CLI oder die Desktop-App, übergibst den nötigen Repo-Kontext und trittst zur Seite. Codex führt das Refactoring im Hintergrund durch und reicht am Ende eine Pull Request zur Prüfung ein.

2. KI-Modelle und Codegenerierung

Codex ist aktuell stark auf OpenAIs neueste GPT-5.4- und GPT-5.5-Modelle optimiert, explizit auf Langläufer-Engineering-Aufgaben getrimmt.

GitHub Copilot hingegen verfolgt ein "Bring your own model"-Prinzip. Über den Modellwähler kannst du zwischen GPT-5.4, GPT-5.5, Googles Gemini und Anthropics Claude (mit Opus 4.7 auf Pro+) wechseln.

Beide Tools liefern bei Routineaufgaben sehr starken Code. Der Unterschied zeigt sich vor allem bei komplexen, mehrstufigen Problemen:

- Copilots Multi-Modell-Flexibilität erlaubt es, Probleme über verschiedene Modelle zu zerlegen.

- Codex setzt darauf, Ausgaben autonom auszuführen und zu verifizieren – und liefert dir erst dann funktionierenden Code.

3. Agentische Fähigkeiten

Hier wird die Abzweigung am deutlichsten. Codex ist von Grund auf für echte agentische Autonomie gebaut. Es nutzt sichere, isolierte Cloud-Umgebungen für Closed-Loop-Testverifikation und unterstützt nativ parallele Aufgabenverarbeitung – so kannst du mehrere unabhängige Refactorings gleichzeitig starten, ohne deine Maschine zu blockieren.

GitHub Copilot ist mit Copilot Workspace (Plan-Review-Execute) und IDE-basiertem Agent Mode mit Befehlen wie /fleet aggressiv in den agentischen Bereich vorgedrungen.

Diese parallelen Workflows verbrauchen jedoch viel Rechenleistung und treiben Copilot-Nutzende oft in restriktive Tokenlimits. Wichtiger noch: Copilot hat keine unabhängige, isolierte Codeausführung. Tests und Laufzeit benötigen deine lokale Umgebung, wodurch Codex die robustere Wahl für sicheres, hands-off Multi-File-Working ist.

4. IDE-Integration und Setup

Für den täglichen, fokussierten Coding-Flow ist GitHub Copilots Integration unübertroffen. Nativ in VS Code, JetBrains und Neovim eingebettet, bietet es einen friktionslosen Tab-to-Accept-Workflow, der sich wie eine natürliche Erweiterung deiner Tastatur anfühlt.

OpenAI Codex hat sich derweil vom reinen Web-Agenten gelöst. Es gibt inzwischen eine solide IDE-Erweiterung (für VS Code und JetBrains), die die autonomen Fähigkeiten in deine Editor-Sidebar bringt.

Es ist zwar kein Inline-Autocomplete wie Copilot, ermöglicht dir aber Chat, Dateireferenzen per @-Syntax und Delegation komplexer Aufgaben im Hintergrund – ohne die IDE zu verlassen. Für Hintergrunddelegation und Multi-File-Reasoning ist Codex’ Fähigkeit, „weiterzudenken", während du im Editor arbeitest, ein spürbarer operativer Vorteil.

5. Codebase-Kontext und -Verständnis

Kontext ist alles beim KI-gestützten Coden. Für große Organisationen mit umfangreichen, komplexen Codebasen hat GitHub Copilot Enterprise mit persistentem, organisationsweitem Repo-Indexing einen klaren Vorteil. Es versteht nativ die Interaktion deiner Microservices, weil es Zugriff auf den gesamten Organisationsgraphen hat.

Codex geht anders vor. Es klont dein Repository zu Beginn einer aktiven Session, um ein tiefes Verständnis der bearbeiteten Codebasis aufzubauen. Früher „vergaß" Codex nach dem Ende der Session alles.

Mit dem neuen Memory-Management-Feature Chronicle kann Codex nun kritischen Architekturkontext, Entwicklerpräferenzen und komplexe Learnings persistent von einer Session zur nächsten mitnehmen.

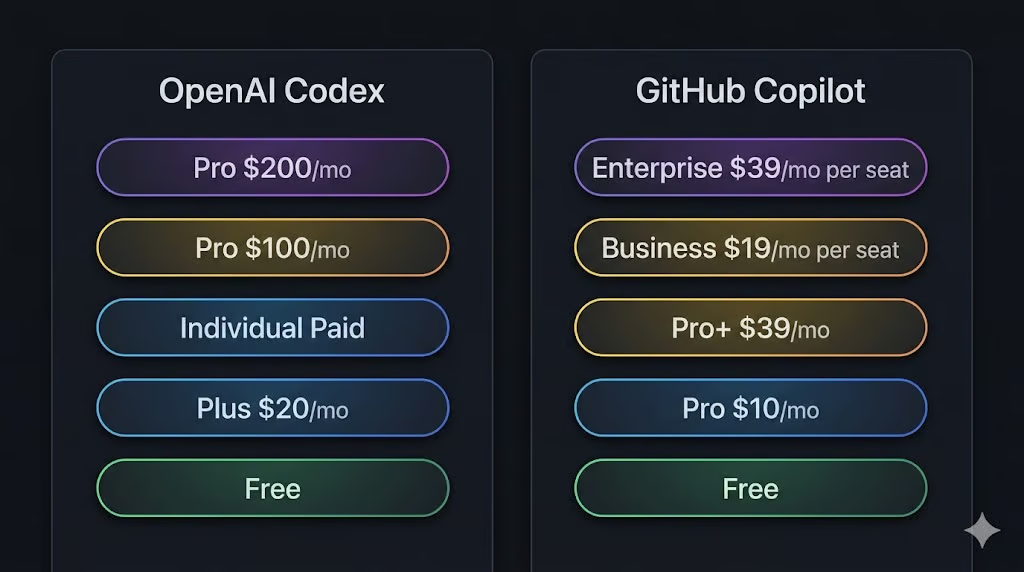

6. Preise und Pläne

GitHub Copilot arbeitet mit vorhersehbaren Pro-Sitz-Preisen. Für Einzelpersonen gibt es drei Stufen:

- Kostenlos: $0/Monat

- Pro: $10/Monat

- Pro+: $39/Monat

Für Teams gibt es folgende Organisationstarife:

- Business: $19/Monat

- Enterprise: $39/Monat

Da agentische Workflows die Rechenkosten stark erhöhen und teils wenige Requests mehr kosten als ein Einzelabo, hat GitHub konsequent reagiert. Wenn du dich heute als Einzelperson anmelden willst, landest du auf einer Warteliste. Neue Anmeldungen für Copilot Pro, Pro+ und Student sind derzeit pausiert, um die Erfahrung bestehender Kundinnen und Kunden zu schützen.

Für bereits aktive Nutzer wurden strikte Sitzungs- und Wochenlimits (7 Tage) eingeführt. Diese richten sich nach Tokenverbrauch und spezifischen „Modell-Multiplikatoren". Wenn du parallele Workflows nutzt (wie den /fleet-Befehl), verbrauchst du dein Tokenkontingent schnell.

Zur Transparenz zeigen VS Code und die Copilot-CLI nun Echtzeitwarnungen, wenn du dich deinem Limit näherst. Wer das Limit erreicht, fällt bis zum Reset der Wochenperiode auf Standardmodelle zurück; ein Upgrade auf Pro+ bietet über das 5-Fache der Pro-Limits.

OpenAI Codex ist eher an Rechenkapazität als an klassische SaaS-Seat-Modelle gekoppelt. Es bietet eine sehr zugängliche Kostenlos-Stufe zum Ausprobieren sowie einen $8/Monat-Einstiegsplan für leichte Nutzung. Beide eignen sich zum Testen, sind aber stark limitiert.

Darüber hinaus skaliert es mit den üblichen ChatGPT-Abos:

- Plus: $20/Monat (bietet begrenzte Aufgabenausführung)

- Pro-Stufen: $100/Monat und $200/Monat (stellen die massive Rechenleistung für ernsthaftes, parallelisiertes Software-Engineering bereit)

Der Trade-off ist klar: Copilot ist für Organisationen deutlich leichter planbar, während Codex granularere Einstiege bietet – kostenlos startbar, für Power-Developer mit schweren agentischen Workloads aber spürbar teurer.

7. Sicherheit und Compliance

GitHub Copilot Enterprise setzt stark auf klassische Unternehmens-Compliance. Es bietet

- Umfassende IP-Freistellung

- Ausführliche Audit-Logs

- Strikte, organisationsweite Richtlinienkontrollen, die sich in deine GitHub-Administration einfügen.

Codex adressiert Sicherheit architektonisch statt politisch. Die isolierte Sandbox-Ausführung stellt sicher, dass potenziell destruktive Operationen (z. B. Datenbankmigrationen oder Dependency-Overhauls) weder deine lokale Umgebung noch Produktionsserver gefährden.

Die Compliance-Einrichtung – etwa API-Keys verwalten oder Audit-Trails pflegen – liegt jedoch größtenteils bei deinem Engineering-Team und kommt nicht out of the box.

Solltest du Codex oder GitHub Copilot wählen?

Am Ende ist die Wahl zwischen OpenAI Codex und GitHub Copilot selten die Frage, welches KI-Modell „klüger" ist. Es geht darum, wie du und dein Team arbeiten wollt.

Brauchst du einen Assistenten, der Boilerplate schreibt, während du an der Tastatur bist, oder einen fähigen Agenten, der schwere Refactorings ohne Aufsicht übernimmt?

Wähle Codex, wenn ...

- du ganze Features End-to-End delegieren willst. Wenn du ein gewünschtes Ergebnis beschreiben, den nötigen Kontext übergeben und am Ende nur die fertige Pull Request prüfen willst, ist Codex genau dafür gebaut. Es glänzt bei autonomer, hands-off Ausführung.

- du parallele Aufgabenverarbeitung brauchst. Wer regelmäßig mehrere komplexe Issues jongliert, profitiert immens davon, mehrere unabhängige Tasks gleichzeitig abzufeuern – mit der Sicherheit isolierter Cloud-Sandboxes. So friert deine lokale Maschine nicht unter Last ein.

- du terminal-/CLI-first arbeitest. Wenn dein Workflow um die Kommandozeile kreist oder du eigene Dev-Tools und CI/CD-Pipelines bauen willst, liefern die Codex-CLI und die robusten Standalone-Desktop-Apps (macOS und Windows) die gewünschte Trennung.

- du bereits für ChatGPT Pro zahlst. Wenn du ohnehin $100 oder $200 pro Monat für die höheren ChatGPT-Pro-Tiers für große Rechenkontingente zahlst, ist Codex der beste Weg, diesen Invest voll auszuschöpfen. Und falls nicht, machen die kostenlose oder die $8/Monat-Einstiegsstufe den Start leicht.

Wähle GitHub Copilot, wenn ...

- du KI-Vorschläge direkt in der IDE ohne Setup-Reibung willst. Wenn du deinen Flow State priorisierst, bleibt Copilot hier der Branchenstandard. Die native Integration in VS Code, JetBrains und Neovim liefert blitzschnelle Tab-to-Accept-Vorschläge genau dort, wo du tippst.

- du mitten in der Session zwischen Modellen wechseln willst. Copilots Multi-Modell-Wähler ist ein großer Vorteil, wenn du weißt, dass unterschiedliche Modelle in unterschiedlichen Bereichen glänzen. Der Wechsel von GPT-5.5 zu Anthropics Claude Opus 4.7 oder Googles Gemini 3.1 kann helfen, Blockaden zu lösen.

- du planbare Pro-Sitz-Preise fürs Team brauchst. Budgetplanung ist kompliziert genug. Auch wenn Einzelanmeldungen derzeit pausiert sind, ermöglichen die Stufen Business ($19/Monat) und Enterprise ($39/Monat) eine skalierbare KI-Einführung ohne unberechenbare, compute-basierte Kostenspitzen am Monatsende.

- du ohnehin im GitHub-Ökosystem arbeitest. Wenn deine Organisation stark auf GitHub Issues, Pull Requests und Actions setzt, sind Copilot Enterprises orgweites Indexing und die direkte Einbettung in bestehende PR-Workflows ein großer Vorteil.

Fazit

Die Wahl zwischen OpenAI Codex und GitHub Copilot hängt davon ab, wie du und dein Engineering-Team tatsächlich arbeiten.

Die Leitplanke ist einfach:

- Codex ist für Delegation gebaut.

- Copilot ist für Zusammenarbeit gebaut.

Wenn du einen intelligenten Pair Programmer willst, der Tippfehler abfängt, dich mit Inline-Vorschlägen entblockt und dir den Wechsel zwischen führenden Grundmodellen in der Session erlaubt, hat GitHub Copilot die Nase vorn. Wenn du dagegen ein mehrteiliges Architekturupdate an einen autonomen Agenten abgeben und am Morgen nur die Pull Request prüfen willst, ist OpenAI Codex das richtige Tool.

Für den Einstieg empfehle ich unseren AI for Software Engineering-Lernpfad, in dem du mit GitHub Copilot und ähnlichen KI-Tools arbeitest.

Codex vs. GitHub Copilot: FAQs

Kann ich Codex und GitHub Copilot zusammen nutzen?

Ja, und viele Power-User tun genau das. Da Codex größtenteils außerhalb der IDE über CLI, Desktop-Apps oder Web läuft, kollidiert es nicht mit GitHub Copilot, das lokal in VS Code oder JetBrains aktiv ist. Du kannst dir mit Copilot deine aktuelle Funktion autovervollständigen lassen, während Codex parallel in einer Cloud-Sandbox eine komplexe, mehrteilige Datenbankmigration ausführt.

Ist Codex dasselbe Modell, das GitHub Copilot antreibt?

Nicht mehr. Das führt oft zu Verwirrung. "Codex" bezeichnete ursprünglich die OpenAI-Modellfamilie hinter der ersten Copilot-Version. Heute ist Codex OpenAIs eigenständiges, autonomes Coding-Agent-Produkt. GitHub Copilot ist hingegen eine Multi-Agent-Plattform, die verschiedene Modelle nutzt, darunter Versionen von OpenAIs GPT, Anthropics Claude und Googles Gemini.

Welches Tool ist besser für autonome, hands-off Coding-Aufgaben?

OpenAI Codex ist für hands-off Aufgaben deutlich besser geeignet. Durch das Starten isolierter Cloud-Sandboxes kann es Code unabhängig schreiben, ausführen und verifizieren, ohne deine lokale Umgebung zu riskieren. In Kombination mit paralleler Aufgabenverarbeitung und der Chronicle-Memory-Funktion ist Codex die erste Wahl für echte Delegation.

Wer bietet bessere Team-Preise?

GitHub Copilot ist ideal, wenn du eine planbare Monatsrechnung willst, da es mit festen Pro-Sitz-Preisen von $19 oder $39 arbeitet. OpenAI Codex ist flexibler, da es ein Pay-as-you-go-Modell nutzt, bei dem du nur für tatsächliche Nutzung zahlst.

Warum gibt es eine Warteliste für GitHub Copilot, und ist OpenAI Codex eine echte Alternative?

Ab Q2 2026 hat GitHub neue Individual-Anmeldungen pausiert, um die enormen Rechenlasten agentischer Features wie /fleet zu managen. OpenAI Codex ist für Wartelisten-Plätze eine sinnvolle Alternative mit stärkerem Agentenfokus.