Leerpad

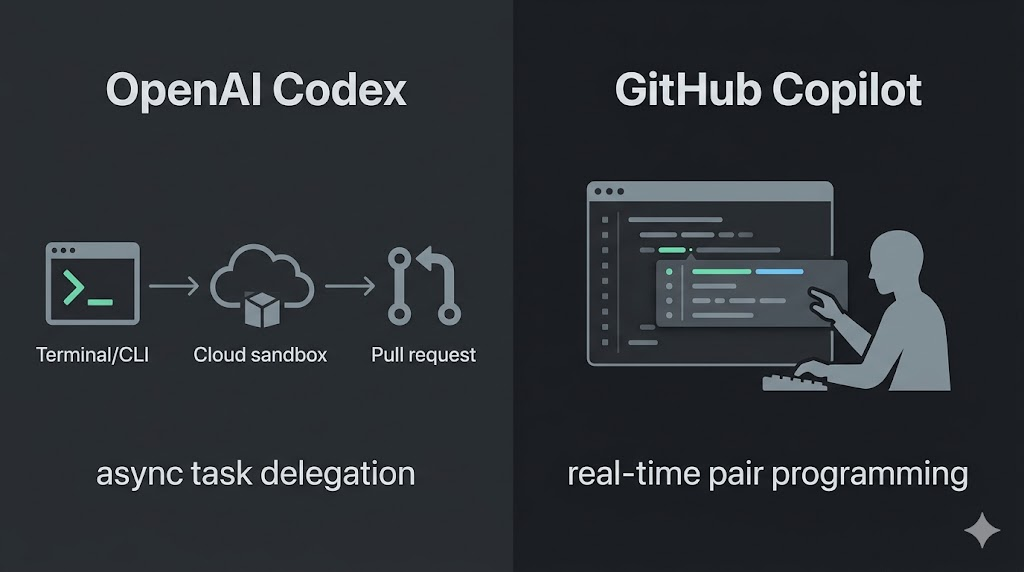

AI-codetools zijn opgesplitst in twee duidelijke paradigma’s: agents die doorwerken terwijl jij slaapt, en assistenten die meewerken terwijl jij typt. OpenAI Codex en GitHub Copilot zijn de schoolvoorbeelden van beide.

In dit artikel bespreek ik de kernachtige filosofische en technische verschillen tussen deze twee tools. We kijken onder de motorkap van beide platforms en vergelijken ze rechtstreeks op hun agent-capabilities, IDE-integraties, omgang met codebasecontext en prijsstructuren.

TL;DR: OpenAI Codex vs GitHub Copilot

Het snelste onderscheid maak je door te kijken hoe ze verwachten dat jij werkt.

|

Functie |

OpenAI Codex |

Github Copilot |

|

Type |

Autonome codingagent |

AI pair programmer & multi-agentplatform |

|

Interface |

CLI, desktopapp, webinterface |

Native IDE-integratie (VS Code, JetBrains, enz.), CLI, webinterface |

|

Modelkeuze |

Alleen OpenAI GPT-modellen |

Multimodelkeuze (GPT, Claude, Gemini) |

|

Uniek voordeel |

Gesandboxte uitvoering en parallelle taakverwerking |

Wrijvingsloze IDE-workflow en MCP-integratie |

|

Beste voor |

Asynchrone taakdelegatie en grootschalige refactors |

Realtime codevoorstellen en flow-state coderen |

|

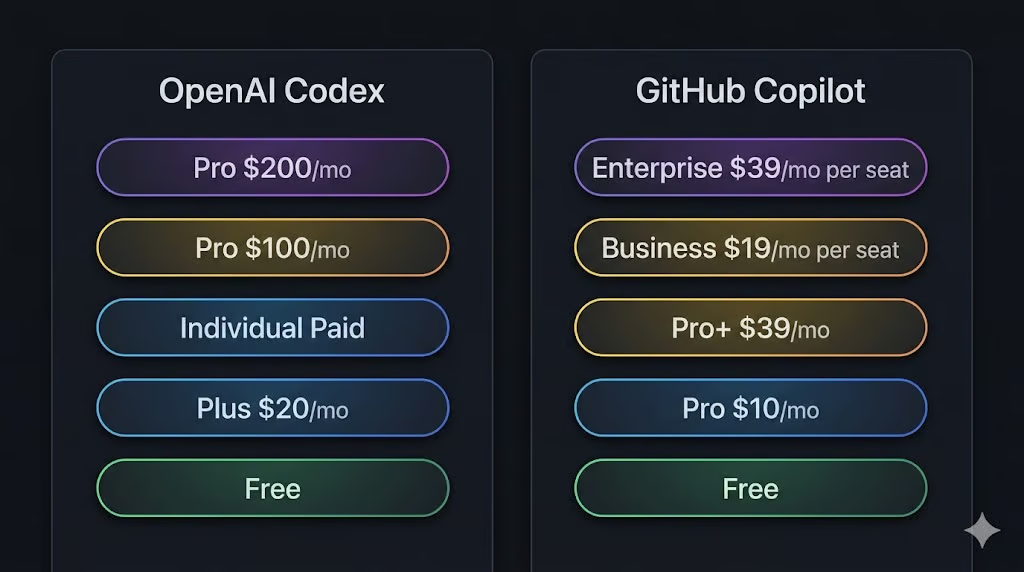

Prijslagen |

$20/maand (Plus), $100/maand of $200/maand (Pro-lagen); beperkte toegang met Go ($8/maand) |

$10/maand en $39/maand (Individueel), $19/maand (Business), $39/maand (Enterprise) |

Je primaire keuze moet worden gedicteerd door je directe engineeringbehoeften. Sommige power users kiezen zelfs voor een hybride aanpak.

Wat is OpenAI Codex?

Voor we naar het product kijken, moeten we de terminologie ontwarren. "Codex" begon als een gespecialiseerde modelfamilie; de oorspronkelijke engine achter de eerste iteratie van GitHub Copilot.

Hoewel de onderliggende modellen zijn doorontwikkeld (via GPT-5.3-Codex en met toenemende nadruk op GPT-5.4 en GPT-5.5), heeft OpenAI de naam "Codex" herbestemd voor een losstaand, autonoom agentproduct.

In dit artikel verwijzen we naar OpenAI Codex als het platform, niet de modelfamilie. Of je nu via de CLI, de desktopapp of de webinterface werkt, je gebruikt dezelfde kernachtige agentservice. We zien deze als toegangswegen tot dezelfde onderliggende intelligentie.

Tegenwoordig functioneert OpenAI Codex als een zware autonome codingagent. Het start veilige, gesandboxte cloudomgevingen op, kloont je repository, schrijft en test de code en dient vervolgens een pull request in ter review.

Belangrijkste features en mogelijkheden van Codex

- Gesandboxte clouduitvoering: Codex draait je code in geïsoleerde omgevingen. Dit is cruciaal voor veiligheid en testen, omdat de agent zo potentieel destructieve scripts of complexe migraties kan uitvoeren zonder je lokale machine aan te raken.

- Parallelle taakafhandeling: Je kunt meerdere, onafhankelijke langetermijntaken tegelijk delegeren via de open-source CLI of desktopapp van Codex.

- Contextcompressie & memories: Voor langetermijntaken comprimeert Codex dynamisch het contextvenster om focus te houden zonder tokenlimieten te overschrijden. Het bevat nu de Chronicle-functie, waarmee de agent nuttige context, ontwikkelaarsvoorkeuren en architecturale inzichten van de ene sessie naar de andere kan meenemen.

- Adaptieve redeneerinspanning: Je kunt handmatig de compute-toewijzing van de agent instellen van minimaal (voor snelle scripts) tot extra hoog (voor complexe architecturale refactors).

De voor- en nadelen van Codex

- Voordelen: Codex biedt echte end-to-end autonomie. De mogelijkheid om taken parallel te verwerken, persistente context mee te dragen via chronicle-memories en eigen output te verifiëren in een gesandboxte omgeving, maakt het bijzonder nuttig voor grootschalige delegatie. Het biedt ook een lagere instapdrempel met een nieuw startabonnement van $8/maand voor lichtere gebruiksscenario’s.

- Nadelen: Er is geen realtime inline-autocomplete; het vraagt om een mentale switch naar taakdelegatie in plaats van samen schrijven. Bovendien zullen ontwikkelaars die zware parallelle taken draaien, ondanks de toegankelijke $8/maand-laag, al snel de hogere ChatGPT Pro-abonnementen ($100/maand of $200/maand) nodig hebben om krappe computelimieten te vermijden.

Wil je Codex in actie zien? Bekijk dan onze tutorials over het gebruik van de Codex-CLI voor automatisering van dataworkflows of het integreren van MCP-servers.

Wat is GitHub Copilot?

GitHub Copilot is drastisch veranderd sinds de oorsprong als eenvoudige inline-autocomplete. Tegenwoordig is het een multi-agentplatform dat native leeft waar jij typt.

De snelle ontwikkeling van Copilot naar agent-achtige workflows heeft echter de compute-eisen fundamenteel veranderd. Langdurige, geparallelliseerde sessies hebben de infrastructuur belast, waardoor GitHub in Q2 2026 ingrijpende wijzigingen moest doorvoeren in de individuele abonnementen om de betrouwbaarheid te waarborgen.

Belangrijkste features en mogelijkheden van GitHub Copilot

-

Multimodale flexibiliteit: Copilot zit niet langer vast aan één provider. De modelkeuze bevat nu toegang tot GPT-5.4 en GPT-5.5, evenals Anthropic’s Claude (met Opus 4.7 beschikbaar op Pro+-plannen) en Google’s Gemini.

-

Copilot Workspace & plan-modus: Workspace gebruikt een plan-review-execute-model. Je kunt "plan-modus" nemen in VS Code of de CLI om taak-efficiëntie te verbeteren en tokenverbruik te verlagen voordat de agent begint te schrijven.

-

Agent-modus &

/fleet: Copilot ondersteunt nu bewerkingen over meerdere bestanden en parallelle workflows rechtstreeks in de IDE, al verbruiken deze opdrachten veel compute. -

MCP-integratie: Model Context Protocol (MCP) stelt Copilot in staat veilig te interfacen met je externe lokale ontwikkeltools en databronnen.

De voor- en nadelen van GitHub Copilot

- Voordelen: Het biedt wrijvingsloze IDE-integratie (VS Code, JetBrains, Neovim) en heeft de laagste leercurve van alle AI-codetools. De multimodel-flexibiliteit is een enorm voordeel ten opzichte van oudere versies, waardoor je specifieke problemen naar de meest geschikte modellen kunt routeren. De diepe integratie met GitHub (PR’s, issues, code search) is ongeëvenaard.

- Nadelen: De recente invoering van strikte sessie- en wekelijkse tokenlimieten, samen met het pauzeren van nieuwe individuele betaalde aanmeldingen, maakt het voor zware gebruikers lastig om erop te vertrouwen voor complexe taken zonder te upgraden naar Pro+. De agent-capabilities zijn minder volwassen dan de gesandboxte aanpak van Codex; Copilot is simpelweg minder agent-gedreven omdat het geen ingebouwde sandbox heeft voor onafhankelijke uitvoering, her-iteratie en testen.

Meer weten? Bekijk onze GitHub Copilot CLI-tutorial en zie onze vergelijkingsgidsen over hoe Copilot zich verhoudt tot Claude Code en Cursor.

Codex vs GitHub Copilot: rechtstreekse vergelijking

Ondanks hun gedeelde technische DNA zijn Codex en GitHub Copilot fundamenteel verschillende producten. Hier is een gedetailleerde vergelijking op verschillende kritische factoren:

|

Functie |

OpenAI Codex |

GitHub Copilot |

|

Producttype |

Autonome codingagent |

AI pair programmer & multi-agentplatform |

|

Interface |

Multi-interfaceplatform (CLI, Desktop, Web) |

Native IDE (VS Code, JetBrains, Neovim) |

|

Modelkeuze |

GPT-5.4, GPT-5.5, enz. |

Multimodel (GPT-5.4/5.5, Claude 4.7, Gemini) |

|

Agentvaardigheden |

Gesandboxte uitvoering, parallelle verwerking |

Workspace, agent-modus, |

|

IDE-integratie |

Extensie-gebaseerd (zijbalk chat-agent, |

Diepe, wrijvingsloze integratie |

|

Omgang met context |

Repo klonen + Chronicle-geheugen |

Enterprise-brede indexing |

|

Prijs (individueel) |

Gratis, $8/maand (Base), $20/maand (Plus), $100–200/maand (Pro) |

Gratis, $10/maand (Pro), $39/maand (Pro+) |

|

Prijs (team) |

Pay-as-you-go-prijsmodel |

$19/maand (Business), $39/maand (Enterprise) |

|

Beveiliging |

Isolatie via gesandboxte uitvoering |

IP-vrijwaring, auditlogs, beleidscontroles |

|

Beste voor |

Taakdelegatie, complexe refactors over meerdere bestanden |

Samenwerking in realtime, flow-state coderen |

1. Interface en workflow

De kern van het filosofische verschil tussen de twee tools komt hierop neer:

- Codex is gebouwd voor taakdelegatie

- Copilot is gebouwd voor samenwerking in realtime

Stel je voor dat je de authenticatiestroom van je app moet refactoren. Met GitHub Copilot open je je IDE, navigeer je naar de relevante bestanden en begin je samen te werken. Je gebruikt Copilot Chat wanneer je vastloopt, vertrouwt op inlinevoorstellen terwijl je typt en start eventueel Agent Mode voor lokale bewerkingen over meerdere bestanden terwijl jij toezicht houdt.

Met OpenAI Codex lijkt de workflow meer op het aansturen van een directe collega. Je beschrijft het gewenste resultaat via de Codex-CLI of de desktopapp, geeft de nodige repositorycontext door en stapt weg. Codex handelt de refactor op de achtergrond af en dient uiteindelijk een pull request in voor jouw review.

2. AI-modellen en codegeneratie

Codex is vandaag sterk geoptimaliseerd rond OpenAI’s nieuwste GPT-5.4- en GPT-5.5-modellen, expliciet getuned voor langetermijntaken in software-engineering.

GitHub Copilot hanteert daarentegen een "bring your own model"-filosofie. Met de multimodelkeuze kun je schakelen tussen GPT-5.4, GPT-5.5, Google’s Gemini en Anthropic’s Claude (met Opus 4.7 beschikbaar op Pro+).

Beide tools leveren uitzonderlijk sterke code voor routinetaken. Het verschil zie je vooral bij complexe problemen in meerdere stappen:

- Copilots multimodel-flexibiliteit laat je verschillende modellen bevragen om een probleem op te breken

- Codex vertrouwt op zijn vermogen om autonoom uit te voeren en eigen output te verifiëren, zodat de code werkt vóórdat die aan jou wordt gepresenteerd

3. Agent-capabilities

Hier wordt het verschil het duidelijkst. Codex is vanaf de basis ontworpen voor echte agentische autonomie. Het gebruikt veilige, gesandboxte cloudomgevingen om gesloten-lus testverificatie uit te voeren en ondersteunt native parallelle taakverwerking, zodat je meerdere onafhankelijke refactors tegelijk kunt draaien zonder je machine te laten vastlopen.

GitHub Copilot is agressief de agent-ruimte ingestapt met Copilot Workspace (met een plan-review-execute-model) en IDE-gebaseerde Agent Mode met commando’s als /fleet.

Maar zoals eerder genoemd, verbruiken deze parallelle workflows veel compute en duwen ze Copilot-gebruikers vaak richting beperkende tokenlimieten. Belangrijker: Copilot heeft geen onafhankelijke, geïsoleerde code-uitvoering. Het vereist je lokale omgeving om outputs te draaien en te testen, waardoor Codex een robuustere keuze is voor veilige, hands-off autonomie over meerdere bestanden.

4. IDE-integratie en setup

Voor dagelijks, in-the-zone coderen is de integratie van GitHub Copilot onovertroffen. Het is native ingebouwd in VS Code, JetBrains en Neovim en biedt een wrijvingsloze tab-to-accept-workflow die voelt als een natuurlijke extensie van je toetsenbord.

OpenAI Codex is intussen verder geëvolueerd dan de oorsprong als web-only agent. Het heeft nu een robuuste IDE-extensie (beschikbaar voor VS Code en JetBrains) die de autonome mogelijkheden direct naar je editorsidebar brengt.

Hoewel het geen "inline-autocomplete"-tool is in dezelfde zin als Copilot, kun je er wel mee chatten, bestanden refereren met @-syntaxis en complexe taken op de achtergrond delegeren zonder je IDE te verlaten. Voor achtergronddelegatie en redeneren over meerdere bestanden is het vermogen van Codex om te "denken" terwijl jij doorwerkt in je editor een aanzienlijk operationeel voordeel.

5. Codebasecontext en -begrip

Context is alles bij AI-ondersteund coderen. Voor grote organisaties met enorme, complexe codebases heeft GitHub Copilot Enterprise een duidelijk voordeel met persistente, organisatiebrede repository-indexing. Het begrijpt native hoe je microservices samenwerken, simpelweg omdat het toegang heeft tot de volledige organisatiemap.

Codex gaat anders met context om. Het kloont je repository vers voor de actieve sessie, om een diep begrip op te bouwen van de codebase waarop het opereert. Voorheen "vergat" Codex alles zodra de sessie eindigde.

Met de nieuw geïntroduceerde geheugenfunctie, Chronicle genaamd, kan Codex nu kritische architecturale context, ontwikkelaarsvoorkeuren en complexe inzichten persistent meenemen van de ene naar de andere sessie.

6. Prijzen en abonnementen

GitHub Copilot werkt met een voorspelbaar prijsmodel per seat. Voor individuen zijn er drie lagen:

- Gratis: $0/maand

- Pro: $10/maand

- Pro+: $39/maand

Voor teams zijn de organisatielijnen:

- Business: $19/maand

- Enterprise: $39/maand

Omdat agent-workflows de compute-kosten prohibitief hoog hebben gemaakt—vaak resulterend in een paar verzoeken die al de prijs van een individueel abonnement overstijgen—heeft GitHub hard ingegrepen. Als je je vandaag als individu wilt aanmelden, kom je op een wachtlijst. Nieuwe aanmeldingen voor Copilot Pro, Pro+ en Student-plannen zijn momenteel gepauzeerd om de ervaring van bestaande klanten te beschermen.

Voor wie al op het platform zit, zijn strikte sessie- en wekelijkse (7 dagen) tokenlimieten ingevoerd. Deze limieten worden bepaald door tokenverbruik en specifieke "modelmultipliers". Als je parallelle workflows draait (zoals het /fleet-commando), ga je snel door je tokenbudget heen.

Om de transparantie te verbeteren tonen VS Code en de Copilot-CLI nu realtime gebruikswaarschuwingen wanneer je je limiet nadert. Gebruikers die hun cap raken, vallen terug op standaardmodellen tot hun weekperiode reset, al biedt upgraden naar Pro+ meer dan 5X de limieten van het standaard Pro-plan.

OpenAI Codex is gestructureerd rond compute-capaciteit in plaats van voorspelbare SaaS per seat. Het biedt een zeer toegankelijke gratis laag voor ontwikkelaars die het willen uitproberen, gevolgd door een startabonnement van $8/maand voor licht gebruik. Beide zijn vooral geschikt om Codex te testen en zijn erg beperkt.

Daarna schaalt het mee met standaard ChatGPT-abonnementen:

- Plus: $20/maand (biedt beperkte taakuitvoering)

- Pro-lagen: $100/maand en $200/maand (leveren de enorme compute die nodig is voor serieuze, geparallelliseerde software-engineering)

De afweging is simpel: Copilot is veel makkelijker te budgetteren voor een hele organisatie, terwijl Codex meer fijnmazige instappunten biedt; volledig gratis om te beginnen, maar opschalend naar merkbaar duurder voor powerdevelopers met zware agent-workloads.

7. Beveiliging en compliance

GitHub Copilot Enterprise leunt sterk op traditionele corporate compliance. Het biedt

- Uitgebreide IP-vrijwaring

- Uitgebreide auditlogging

- Strikte organisatiebrede beleidscontroles die integreren met je bestaande GitHub-administratie.

Codex benadert beveiliging via architectuur in plaats van beleid. De gesandboxte uitvoeringsisolatie zorgt ervoor dat potentieel destructieve operaties (zoals databasemigraties of dependency-overhauls) je lokale omgeving of productie-servers niet kunnen beschadigen.

De compliance-inrichting—zoals het beheren van API-sleutels en het bijhouden van audittrails—ligt echter grotendeels bij je engineeringteam in plaats van dat dit out-of-the-box wordt geregeld.

Moet je kiezen voor Codex of GitHub Copilot?

Uiteindelijk gaat de keuze tussen OpenAI Codex en GitHub Copilot zelden over welke AI “slimmer” is. Het is eerder een rekensom van hoe jij en je team het liefst werken.

Heb je een assistent nodig die boilerplate opstelt terwijl jij aan het toetsenbord zit, of een zeer capabele agent die zware refactors aanpakt zonder jouw toezicht?

Kies voor Codex als...

- Je complete features end-to-end wilt delegeren. Als je doel is om een gewenst resultaat te beschrijven, de nodige context te overhandigen en simpelweg een afgerond pull request te reviewen, is Codex hier precies voor gebouwd. Het blinkt uit in autonome, hands-off uitvoering.

- Je parallelle taakverwerking nodig hebt. Voor ontwikkelaars die regelmatig meerdere complexe issues tegelijk managen, is de mogelijkheid om meerdere onafhankelijke taken gelijktijdig af te vuren—wetend dat ze veilig draaien in geïsoleerde cloud-sandboxes—een gamechanger. Het voorkomt dat je lokale machine vastloopt onder zware compute-taken.

- Je in terminal-/CLI-first omgevingen werkt. Als je workflow om de command line draait, of als je eigen ontwikkeltooling en CI/CD-pijplijnen wilt bouwen, bieden de CLI-interface van Codex en de robuuste standalone desktopapps (beschikbaar op macOS en Windows) precies de scheiding die je nodig hebt.

- Je al betaalt voor ChatGPT Pro. Als je al $100 of $200 per maand neerlegt voor een van de hogere ChatGPT Pro-lagen om enorme computelimieten te krijgen, is je codetaken via Codex laten lopen de beste manier om de waarde van die investering te maximaliseren. En zo niet, dan maken de gratis of $8/maand-startlagen het heel eenvoudig om te proeven.

Kies voor GitHub Copilot als...

- Je AI-voorstellen in je IDE wilt zonder setupgedoe. Als je je flow state wilt behouden, blijft Copilot de industriestandaard voor deze workflows. De native integratie in VS Code, JetBrains en Neovim betekent razendsnelle, tab-to-accept-voorstellen precies waar je typt.

- Je het waardevol vindt om midden in een sessie van AI-model te wisselen. De multimodelkeuze van Copilot is een enorm voordeel voor ontwikkelaars die weten dat verschillende modellen excelleren in verschillende dingen. Schakelen van GPT-5.5 naar Anthropic’s Claude Opus 4.7 of Google’s Gemini 3.1 om een specifiek struikelblok te passeren, kan helpen.

- Je voorspelbare prijs per seat voor een team nodig hebt. Softwarebudgetten beheren is al ingewikkeld genoeg. Hoewel individuele aanmeldingen momenteel gepauzeerd zijn, kunnen organisaties vertrouwen op de Business- ($19/maand) en Enterprise- ($39/maand) lagen van Copilot om hun AI-adoptie te schalen zonder te vrezen voor grillige, compute-gebaseerde pieken op het eind van de maand.

- Je al het GitHub-ecosysteem gebruikt. Als je organisatie volledig leunt op GitHub issues, pull requests en actions, is het vermogen van Copilot Enterprise om je hele organisatorische codebase native te indexeren en direct te integreren in je bestaande PR-workflows een groot onderscheidend vermogen.

Tot slot

De keuze tussen OpenAI Codex en GitHub Copilot hangt af van hoe jij en je engineeringteam daadwerkelijk werken.

De leidende gedachte om te onthouden is:

- Codex is gebouwd voor delegatie.

- Copilot is gebouwd voor samenwerking.

Als je een intelligente pair programmer wilt die je typefouten opvangt, je los trekt met inlinevoorstellen en je laat schakelen tussen de beste basismodellen ter wereld midden in een sessie, dan heeft GitHub Copilot een voordeel. Maar als je een update van een multi-file architectuur wilt overdragen aan een autonome agent en ’s ochtends bij je koffie simpelweg het pull request wilt reviewen, dan is OpenAI Codex de tool die je nodig hebt.

Wil je aan de slag? Schrijf je dan in voor onze skill track AI for Software Engineering, waarin je leert werken met GitHub Copilot en soortgelijke AI-tools.

Codex vs GitHub Copilot: veelgestelde vragen

Kan ik Codex en GitHub Copilot samen gebruiken?

Ja, en veel power users doen dat ook. Omdat Codex grotendeels buiten de IDE werkt via de CLI, desktopapps of webinterface, botst het niet met GitHub Copilot dat lokaal draait in VS Code of JetBrains. Je kunt Copilot je huidige functie laten autocompleten terwijl Codex tegelijkertijd een complexe databasemigratie over meerdere bestanden draait in een parallelle cloud-sandbox.

Is Codex hetzelfde model dat GitHub Copilot aandrijft?

Niet meer. Dit is een veelvoorkomende verwarring. "Codex" verwees oorspronkelijk naar de OpenAI-modelfamilie die de eerste versie van Copilot aandreef. Tegenwoordig is Codex het zelfstandige, autonome codingagentproduct van OpenAI. Ondertussen is GitHub Copilot een multi-agentplatform dat verschillende modellen gebruikt, waaronder verschillende versies van OpenAI’s GPT, Anthropic’s Claude en Google’s Gemini-modellen.

Welke tool is beter voor autonome, hands-off codetaken?

OpenAI Codex is aanzienlijk beter voor hands-off taken. Doordat het geïsoleerde, gesandboxte cloudomgevingen kan opstarten, kan het onafhankelijk code schrijven, uitvoeren en verifiëren zonder risico voor je lokale setup. In combinatie met de mogelijkheid om taken parallel te verwerken en context te behouden via de Chronicle-geheugenfunctie, is Codex de beste keuze voor echte taakdelegatie.

Welke heeft betere prijzen voor teams?

GitHub Copilot is het beste als je een voorspelbare maandelijkse rekening wilt, omdat het een vaste prijs per seat hanteert van $19 of $39. OpenAI Codex is flexibeler, omdat het een pay-as-you-go-model gebruikt waarbij je alleen betaalt voor wat je daadwerkelijk gebruikt.

Waarom is er een wachtlijst voor GitHub Copilot, en is OpenAI Codex een haalbaar alternatief?

Af Q2 2026 heeft GitHub nieuwe individuele aanmeldingen gepauzeerd om de extreme compute-eisen van agent-features zoals /fleet te managen. OpenAI Codex is een degelijk alternatief met een sterkere agent-focus voor ontwikkelaars op de wachtlijst.