Programma

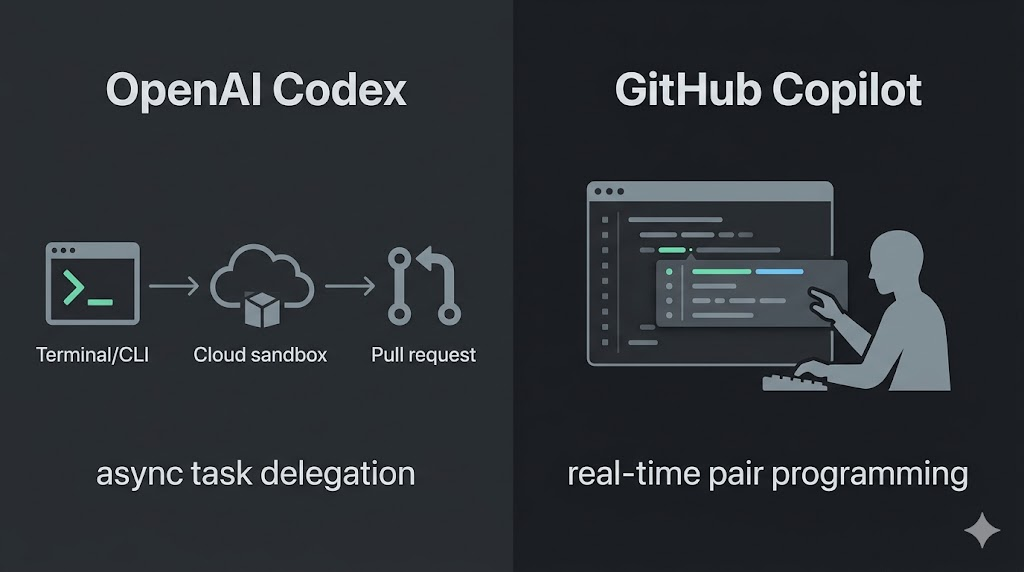

Gli strumenti di coding AI si sono divisi in due paradigmi distinti: agenti che lavorano mentre dormi e assistenti che lavorano mentre digiti. OpenAI Codex e GitHub Copilot sono i migliori esempi di ciascuno.

In questo articolo, analizzerò le differenze filosofiche e tecniche fondamentali tra i due strumenti. Guarderemo sotto il cofano di entrambe le piattaforme, confrontandole testa a testa in termini di capacità agentiche, integrazioni con l’IDE, gestione del contesto del codebase e strutture di prezzo.

TL;DR: OpenAI Codex vs GitHub Copilot

Il modo più rapido per distinguere i due strumenti è osservare come si aspettano che tu lavori.

|

Funzionalità |

OpenAI Codex |

Github Copilot |

|

Tipo |

Agente di coding autonomo |

AI pair programmer & piattaforma multi-agente |

|

Interfaccia |

CLI, app desktop, interfaccia web |

Integrazione IDE nativa (VS Code, JetBrains, ecc.), CLI, interfaccia web |

|

Scelta del modello |

Solo modelli OpenAI GPT |

Selettore multi-modello (GPT, Claude, Gemini) |

|

Vantaggio unico |

Esecuzione in sandbox e elaborazione parallela dei task |

Workflow IDE senza attriti e integrazione MCP |

|

Ideale per |

Delegare task asincroni e refactoring su larga scala |

Suggerimenti in tempo reale e coding in flow state |

|

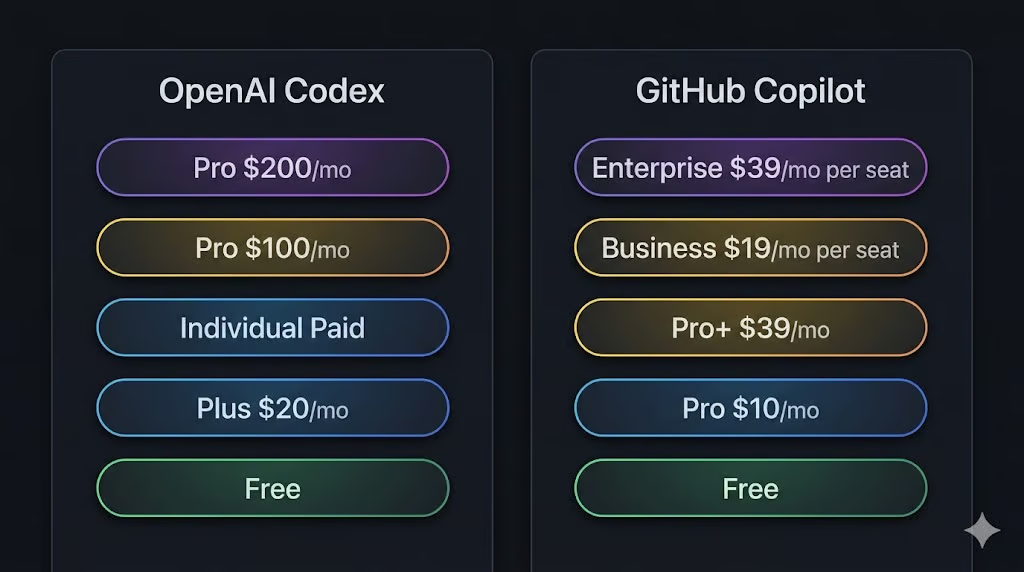

Fasce di prezzo |

$20/mese (Plus), $100/mese o $200/mese (Pro); accesso limitato con Go ($8/mese) |

$10/mese e $39/mese (Individual), $19/mese (Business), $39/mese (Enterprise) |

La tua scelta principale dovrebbe essere dictata dalle esigenze ingegneristiche immediate. Alcuni power user adottano persino un approccio ibrido.

Che cos’è OpenAI Codex?

Prima di guardare al prodotto, dobbiamo districare la terminologia. "Codex" è nato come una famiglia di modelli specializzati; il motore originale dietro la prima iterazione di GitHub Copilot.

Mentre i modelli sottostanti sono avanzati (passando attraverso GPT-5.3-Codex e facendo sempre più affidamento su GPT-5.4 e GPT-5.5), OpenAI ha riutilizzato il nome "Codex" per un prodotto autonomo di agente indipendente.

In tutto l’articolo, ci riferiamo a OpenAI Codex come piattaforma, non come famiglia di modelli. Che tu interagisca tramite CLI, applicazione desktop o interfaccia web, stai accedendo allo stesso servizio agentico di base. Consideriamo questi come punti di accesso alla stessa intelligenza sottostante.

Oggi, OpenAI Codex funziona come un agente di coding autonomo ad alte prestazioni. Avvia ambienti cloud sicuri e in sandbox, clona il tuo repository, scrive e testa il codice, quindi invia una Pull Request per la tua revisione.

Funzionalità e capacità principali di Codex

- Esecuzione cloud in sandbox: Codex esegue il tuo codice in ambienti isolati. Questo è fondamentale per sicurezza e test, poiché consente all’agente di eseguire script potenzialmente distruttivi o migrazioni complesse senza toccare la tua macchina locale.

- Gestione parallela dei task: Puoi delegare più task indipendenti e di lungo periodo simultaneamente tramite la CLI open-source di Codex o l’app desktop.

- Compattazione del contesto & memorie: Per task di lungo periodo, Codex comprime dinamicamente la finestra di contesto per mantenere il focus senza superare i limiti di token. Include ora la funzione Chronicle, che consente all’agente di portare contesto utile, preferenze dello sviluppatore e conoscenze architetturali da una sessione all’altra.

- Sforzo di ragionamento adattivo: Puoi regolare manualmente l’allocazione di calcolo dell’agente da minima (per script rapidi) a molto alta (per refactoring architetturali complessi).

Pro e contro di Codex

- Pro: Codex offre una vera autonomia end-to-end. La sua capacità di elaborare task in parallelo, mantenere un contesto persistente tramite le memorie Chronicle e verificare il proprio output in un ambiente sandbox lo rende particolarmente utile per la delega su larga scala. Offre anche una soglia d’ingresso più bassa con un nuovo piano iniziale da $8/mese per un uso leggero.

- Contro: Non esiste un completamento automatico inline in tempo reale; richiede un cambio di mentalità verso la delega di task piuttosto che la co-scrittura. Inoltre, sebbene il livello da $8/mese sia accessibile, gli sviluppatori che eseguono task paralleli pesanti avranno rapidamente bisogno dei piani ChatGPT Pro di livello superiore ($100/mese o $200/mese) per evitare di raggiungere limiti di calcolo stretti.

Per vedere Codex in azione, consiglio di dare un’occhiata ai nostri tutorial che mostrano come usare la CLI di Codex per l’automazione dei workflow sui dati o per integrare server MCP.

Che cos’è GitHub Copilot?

GitHub Copilot è cambiato drasticamente dalle sue origini come semplice strumento di completamento inline. Oggi è una piattaforma multi-agente progettata per vivere nativamente dove digiti.

Tuttavia, il rapido sviluppo di Copilot verso workflow agentici ha cambiato radicalmente le sue esigenze di calcolo. Sessioni lunghe e parallelizzate hanno messo sotto pressione l’infrastruttura, costringendo GitHub ad apportare modifiche drastiche ai piani individuali nel Q2 2026 per mantenere l’affidabilità del servizio.

Funzionalità e capacità principali di GitHub Copilot

-

Flessibilità multi-modello: Copilot non è più bloccato su un solo provider. Il selettore di modelli ora include accesso a GPT-5.4 e GPT-5.5, oltre a Claude di Anthropic (con Opus 4.7 disponibile nei piani Pro+) e a Gemini di Google.

-

Copilot workspace & plan mode: Workspace usa un modello plan-review-execute. Puoi attivare la "plan mode" in VS Code o nella CLI per migliorare l’efficienza del task e ridurre il consumo di token prima che l’agente inizi a scrivere.

-

Agent mode &

/fleet: Copilot ora supporta modifiche multi-file e workflow paralleli direttamente nell’IDE, anche se questi comandi consumano calcolo in modo significativo. -

Integrazione MCP: Model Context Protocol (MCP) consente a Copilot di interfacciarsi in modo sicuro con i tuoi strumenti di sviluppo locali esterni e le fonti dati.

Pro e contro di GitHub Copilot

- Pro: Offre un’integrazione IDE senza attriti (VS Code, JetBrains, Neovim) e ha la curva di apprendimento più bassa tra gli strumenti di coding AI. La flessibilità multi-modello è un enorme vantaggio rispetto alle versioni precedenti, permettendoti di indirizzare problemi specifici ai modelli più adatti. La sua profonda integrazione con GitHub (PR, issue, ricerca nel codice) è senza pari.

- Contro: L’introduzione recente di rigidi limiti di sessione e di token settimanali, insieme alla sospensione delle nuove iscrizioni individuali a pagamento, rende difficile per gli utenti intensivi farvi affidamento per task complessi senza passare a Pro+. Le capacità agentiche restano meno mature rispetto all’approccio in sandbox di Codex: in altre parole, Copilot è semplicemente meno agentico poiché manca di una sandbox integrata per esecuzione indipendente, iterazione e test.

Per maggiori informazioni, dai un’occhiata al nostro tutorial sulla CLI di GitHub Copilot e consulta le nostre guide di confronto su come Copilot se la cava rispetto a Claude Code e Cursor.

Codex vs GitHub Copilot: confronto diretto

Pur condividendo lo stesso DNA ingegneristico di base, Codex e GitHub Copilot sono prodotti fondamentalmente diversi. Ecco un confronto dettagliato su vari fattori critici:

|

Funzionalità |

OpenAI Codex |

GitHub Copilot |

|

Tipo di prodotto |

Agente di coding autonomo |

AI pair programmer & piattaforma multi-agente |

|

Interfaccia |

Piattaforma multi-interfaccia (CLI, Desktop, Web) |

IDE nativo (VS Code, JetBrains, Neovim) |

|

Scelta del modello |

GPT-5.4, GPT-5.5, ecc. |

Multi-modello (GPT-5.4/5.5, Claude 4.7, Gemini) |

|

Abilità agentiche |

Esecuzione in sandbox, elaborazione parallela |

Workspace, agent mode, |

|

Integrazione IDE |

Basata su estensioni (chat-agent nella sidebar, riferimenti ai file con |

Integrazione profonda e senza attriti |

|

Gestione del contesto |

Clonazione repo + memoria Chronicle |

Indicizzazione a livello enterprise di tutta l’organizzazione |

|

Prezzo (Individuale) |

Gratis, $8/mese (Base), $20/mese (Plus), $100-200/mese (Pro) |

Gratis, $10/mese (Pro), $39/mese (Pro+) |

|

Prezzo (Team) |

Modello di prezzo pay-as-you-go |

$19/mese (Business), $39/mese (Enterprise) |

|

Sicurezza |

Isolamento tramite esecuzione in sandbox |

Indennizzo IP, audit log, controlli di policy |

|

Ideale per |

Delega di task, refactoring complessi multi-file |

Collaborazione in tempo reale, coding in flow state |

1. Interfaccia e workflow

La divisione filosofica di base tra i due strumenti si riduce a questo:

- Codex è costruito per la delega di task

- Copilot è costruito per la collaborazione in tempo reale

Per illustrare, immagina di dover fare il refactoring del flusso di autenticazione della tua applicazione. Con GitHub Copilot, apri l’IDE, navighi nei file rilevanti e inizi a collaborare. Usi Copilot Chat quando rimani bloccato, ti affidi ai suggerimenti inline mentre digiti e magari attivi l’Agent Mode per modifiche localizzate multi-file mentre supervisioni.

Con OpenAI Codex, il workflow somiglia di più alla gestione di un diretto riporto. Descrivi il risultato desiderato tramite l’interfaccia CLI di Codex o l’app desktop, gli passi il contesto necessario del repository e ti allontani. Codex gestisce il refactoring in background e alla fine invia una Pull Request da revisionare.

2. Modelli di AI e generazione del codice

Oggi, Codex è fortemente ottimizzato attorno ai più recenti modelli GPT-5.4 e GPT-5.5 di OpenAI, esplicitamente tarati per task di ingegneria del software di lungo periodo.

GitHub Copilot, invece, abbraccia una filosofia "porta il tuo modello". Il suo selettore multi-modello ti consente di passare tra GPT-5.4, GPT-5.5, Gemini di Google e Claude di Anthropic (con Opus 4.7 disponibile nei piani Pro+).

Entrambi gli strumenti producono codice eccezionalmente valido per i task di routine. Il divario emerge principalmente su problemi complessi e multi-step:

- La flessibilità multi-modello di Copilot ti permette di interrogare modelli diversi per scomporre un problema

- Codex fa affidamento sulla sua capacità di eseguire e verificare autonomamente il proprio output per garantire che il codice funzioni prima di presentartelo

3. Capacità agentiche

Qui la divergenza diventa più evidente. Codex è progettato dalle fondamenta per una vera autonomia agentica. Utilizza ambienti cloud sicuri e in sandbox per eseguire verifiche di test a circuito chiuso e supporta nativamente l’elaborazione parallela dei task, così puoi eseguire più refactoring indipendenti simultaneamente senza bloccare la tua macchina.

GitHub Copilot è entrato in modo aggressivo nello spazio agentico con Copilot Workspace (con un modello plan-review-execute) e l’Agent Mode basato su IDE con comandi come /fleet.

Tuttavia, come accennato, questi workflow paralleli consumano molto calcolo e spesso spingono gli utenti di Copilot entro limiti di token restrittivi. Ancora più importante, Copilot non dispone di un’esecuzione del codice indipendente e isolata. Richiede il tuo ambiente locale per eseguire e testare gli output, rendendo Codex una scelta più solida per un’autonomia sicura, senza intervento, su più file.

4. Integrazione IDE e setup

Per un flusso di coding quotidiano e immersivo, l’integrazione di GitHub Copilot è impareggiabile. È incorporato nativamente in VS Code, JetBrains e Neovim, e offre un workflow senza attriti con tab-to-accept che sembra un’estensione naturale della tastiera.

OpenAI Codex, nel frattempo, è andato oltre le sue origini di agente solo web. Ora include una solida estensione IDE (disponibile per VS Code e JetBrains) che porta le sue capacità autonome direttamente nella sidebar dell’editor.

Sebbene non sia uno strumento di "completamento inline" nello stesso senso di Copilot, ti consente di chattare, fare riferimento ai file usando la sintassi @ e delegare task complessi da eseguire in background senza lasciare l’IDE. Per la delega di task in background e il ragionamento su più file, la capacità di Codex di "pensare" mentre continui a lavorare nell’editor è un vantaggio operativo significativo.

5. Contesto del codebase e comprensione

Il contesto è tutto nel coding assistito dall’AI. Per le grandi organizzazioni con codebase massivi e complessi, GitHub Copilot Enterprise ha un vantaggio netto con la sua indicizzazione persistente dei repository a livello di organizzazione. Comprende nativamente come interagiscono i tuoi microservizi semplicemente perché ha accesso all’intero grafo organizzativo.

Codex gestisce il contesto in modo diverso. Clona il tuo repository ex novo per la sessione attiva, per costruire una comprensione profonda del codebase su cui opera. In precedenza, Codex "dimenticava" tutto una volta terminata la sessione.

Tuttavia, con la nuova funzione di gestione della memoria nota come Chronicle, Codex può ora mantenere in modo persistente contesto architetturale critico, preferenze degli sviluppatori e conoscenze complesse da una sessione all’altra.

6. Prezzi e piani

GitHub Copilot opera con un modello di prezzo prevedibile per utente. Per gli individui, ci sono tre livelli:

- Free: $0/mese

- Pro: $10/mese

- Pro+: $39/mese

Per i team, i piani organizzativi sono:

- Business: $19/mese

- Enterprise: $39/mese

Poiché i workflow agentici hanno fatto lievitare i costi di calcolo in modo proibitivo, spesso con poche richieste che superano il prezzo di un abbonamento individuale, GitHub ha adottato misure aggressive. Se vuoi iscriverti come individuo oggi, incontrerai una lista d’attesa. Le nuove iscrizioni ai piani Copilot Pro, Pro+ e Student sono attualmente sospese per proteggere l’esperienza dei clienti esistenti.

Per chi è già sulla piattaforma, sono stati implementati rigidi limiti di sessione e di token settimanali (7 giorni). Questi limiti sono dettati dal consumo di token e da specifici "moltiplicatori di modello". Se esegui workflow paralleli (come il comando /fleet), brucerai rapidamente la tua dotazione di token.

Per maggiore trasparenza, VS Code e la CLI di Copilot ora mostrano avvisi di utilizzo in tempo reale quando ti avvicini al limite. Gli utenti che raggiungono il tetto passeranno ai modelli standard fino al reset del periodo settimanale, anche se l’upgrade a Pro+ offre oltre 5 volte i limiti del piano Pro standard.

OpenAI Codex è strutturato attorno alla capacità di calcolo piuttosto che alla prevedibilità SaaS per utente. Offre un livello Free molto accessibile per gli sviluppatori che vogliono provarlo, seguito da un piano iniziale da $8/mese per un uso leggero. Entrambi sono adatti solo a testare Codex e sono molto limitati.

Oltre questi, scala con gli abbonamenti standard a ChatGPT:

- Plus: $20/mese (offre esecuzione dei task limitata)

- Pro: $100/mese e $200/mese (forniscono l’enorme calcolo richiesto per ingegneria del software seria e parallelizzata)

Il compromesso è semplice: Copilot è molto più facile da budgettare a livello organizzativo, mentre Codex ti offre punti d’ingresso più granulari; è completamente gratuito per iniziare, ma scala fino a diventare sensibilmente più costoso per gli sviluppatori power che eseguono carichi agentici pesanti.

7. Sicurezza e compliance

GitHub Copilot Enterprise punta molto sulla compliance aziendale tradizionale. Offre

- Indennizzo IP completo

- Audit log estesi

- Rigorosi controlli di policy a livello di organizzazione che si integrano con l’amministrazione GitHub esistente.

Codex affronta la sicurezza tramite l’architettura più che la policy. Il suo isolamento tramite esecuzione in sandbox garantisce che operazioni potenzialmente distruttive (come migrazioni di database o revisioni delle dipendenze) non possano danneggiare il tuo ambiente locale o i server di produzione.

Tuttavia, l’assetto di compliance, come la gestione delle chiavi API e il mantenimento delle tracce di audit, ricade in gran parte sul tuo team di ingegneria piuttosto che essere gestito out-of-the-box.

Dovresti scegliere Codex o GitHub Copilot?

Alla fine, scegliere tra OpenAI Codex e GitHub Copilot raramente è un dibattito su quale modello AI sia "più intelligente". È piuttosto un calcolo su come tu e il tuo team preferite lavorare.

Ti serve un assistente che prepari il boilerplate mentre hai le mani sulla tastiera, o ti serve un agente altamente capace che gestisca un refactoring pesante senza che tu lo supervisioni?

Dovresti scegliere Codex se...

- Vuoi delegare funzionalità end-to-end. Se il tuo obiettivo è descrivere un risultato desiderato, fornire il contesto necessario e limitarti a revisionare una Pull Request finita, Codex è fatto apposta per questo. Eccelle nell’esecuzione autonoma e senza interventi.

- Hai bisogno di elaborazione parallela dei task. Per gli sviluppatori che gestiscono regolarmente più issue complesse, la possibilità di avviare diversi task indipendenti simultaneamente, sapendo che girano in modo sicuro in sandbox cloud isolate, cambia le carte in tavola. Evita che la tua macchina locale si blocchi sotto il peso di carichi di calcolo pesanti.

- Lavori in ambienti terminal/CLI-first. Se il tuo workflow ruota attorno alla riga di comando, o se vuoi costruire strumenti per sviluppatori personalizzati e pipeline CI/CD, l’interfaccia CLI di Codex e le robuste app desktop standalone (disponibili sia su macOS che Windows) forniscono l’esatta separazione di cui hai bisogno.

- Stai già pagando per ChatGPT Pro. Se stai già spendendo $100 o $200 al mese per uno degli abbonamenti ChatGPT Pro di livello superiore per accedere a limiti di calcolo massicci, convogliare i tuoi task di coding tramite Codex è il modo migliore per massimizzare il valore di quell’investimento. E se non lo fai, i livelli Free o da $8/mese rendono piuttosto semplice testare le acque.

Dovresti scegliere GitHub Copilot se...

- Vuoi suggerimenti AI dentro l’IDE senza attriti di setup. Se dai priorità al mantenerti nel flow, Copilot resta lo standard del settore per questi workflow. La sua integrazione nativa in VS Code, JetBrains e Neovim significa suggerimenti velocissimi, accettabili con il tasto Tab, esattamente dove stai già digitando.

- Apprezzi passare tra provider di modelli AI a sessione in corso. Il selettore multi-modello di Copilot è un enorme vantaggio per gli sviluppatori che sanno che modelli diversi eccellono in cose diverse. Passare da GPT-5.5 a Claude Opus 4.7 di Anthropic o a Gemini 3.1 di Google per superare un blocco specifico può essere utile.

- Ti serve un prezzo prevedibile per utente per un team. Gestire i budget software è già abbastanza complicato. Sebbene le iscrizioni individuali siano attualmente sospese, le organizzazioni possono fare affidamento sui livelli Business ($19/mese) ed Enterprise ($39/mese) di Copilot per scalare l’adozione dell’AI senza preoccuparsi di picchi di fatturazione erratici basati sul calcolo a fine mese.

- Usi già l’ecosistema GitHub. Se la tua organizzazione si affida esclusivamente a GitHub issues, Pull Request e actions, la capacità di Copilot Enterprise di indicizzare nativamente l’intero codebase organizzativo e integrarsi direttamente nei workflow di PR esistenti è un differenziatore importante.

Considerazioni finali

La scelta tra OpenAI Codex e GitHub Copilot dipende da come tu e il tuo team di ingegneria lavorate davvero.

Il principio guida da ricordare è questo:

- Codex è costruito per la delega.

- Copilot è costruito per la collaborazione.

Se vuoi un pair programmer intelligente che corregga i refusi, ti sblocchi con suggerimenti inline e ti permetta di passare tra i migliori modelli fondamentali al mondo a sessione in corso, GitHub Copilot ha un vantaggio. Ma se vuoi affidare un aggiornamento architetturale multi-file a un agente autonomo e limitarti a revisionare la Pull Request con il caffè del mattino, OpenAI Codex è lo strumento che ti serve.

Per iniziare, ti consiglio di iscriverti alla nostra skill track AI for Software Engineering, che ti insegna usando GitHub Copilot e strumenti AI simili.

Codex vs GitHub Copilot: FAQ

Posso usare Codex e GitHub Copilot insieme?

Sì, e molti power user lo fanno. Poiché Codex opera in gran parte al di fuori dell’IDE tramite la sua CLI, le app desktop o l’interfaccia web, non entra in conflitto con GitHub Copilot in esecuzione localmente in VS Code o JetBrains. Puoi far completare a Copilot la funzione su cui stai lavorando mentre Codex esegue contemporaneamente una complessa migrazione del database multi-file in una sandbox cloud parallela.

Codex è lo stesso modello che alimenta GitHub Copilot?

Non più. È un punto che genera spesso confusione. "Codex" inizialmente si riferiva alla famiglia di modelli OpenAI che alimentava la prima versione di Copilot. Oggi, Codex è il prodotto di OpenAI come agente di coding autonomo standalone. Nel frattempo, GitHub Copilot è una piattaforma multi-agente che utilizza una varietà di modelli diversi, inclusi le varie versioni di GPT di OpenAI, Claude di Anthropic e i modelli Gemini di Google.

Quale strumento è migliore per task di coding autonomi e senza intervento?

OpenAI Codex è significativamente migliore per i task senza intervento. La sua capacità di avviare ambienti cloud isolati e in sandbox significa che può scrivere, eseguire e verificare il codice in modo indipendente senza rischiare la tua configurazione locale. Abbinata alla capacità di elaborare task in parallelo e di mantenere il contesto tramite la funzione di memoria Chronicle, Codex è la scelta di riferimento per la vera delega di task.

Quale ha prezzi migliori per i team?

GitHub Copilot è la scelta migliore se vuoi una fattura mensile prevedibile perché utilizza un prezzo fisso per utente a $19 o $39. OpenAI Codex è più flessibile poiché utilizza un modello pay-as-you-go in cui paghi solo per ciò che usi effettivamente.

Perché c’è una lista d’attesa per GitHub Copilot e OpenAI Codex è un’alternativa valida?

A partire dal Q2 2026, GitHub ha sospeso le nuove iscrizioni individuali per gestire le estreme esigenze di calcolo di funzionalità agentiche come /fleet. OpenAI Codex è un’alternativa valida con un focus più agentico per gli sviluppatori in lista d’attesa.