Cursus

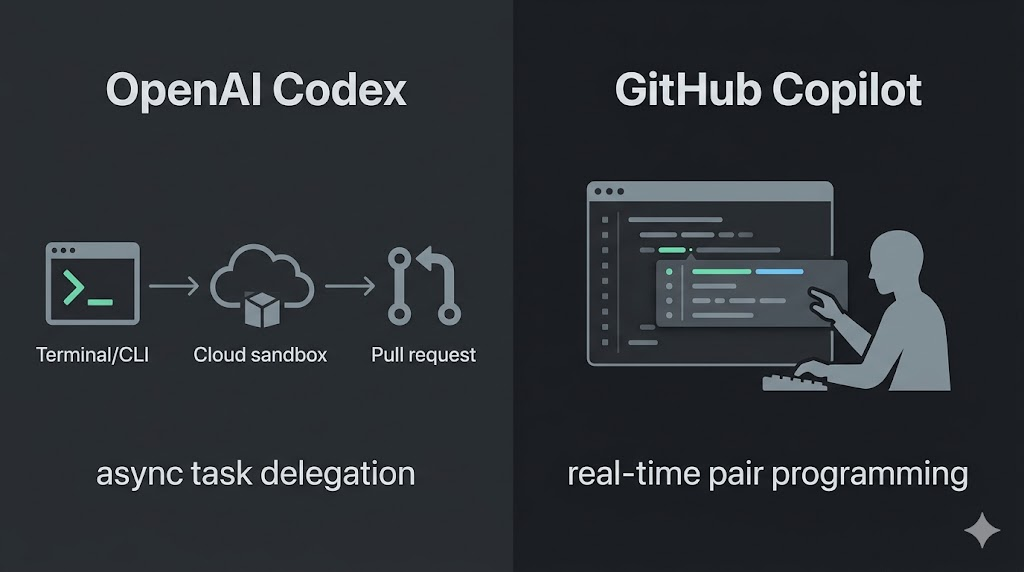

Les outils de codage IA se scindent aujourd'hui en deux paradigmes distincts : des agents qui travaillent pendant que vous dormez, et des assistants qui travaillent pendant que vous tapez. OpenAI Codex et GitHub Copilot en sont les meilleurs exemples.

Dans cet article, nous allons détailler les différences philosophiques et techniques clés entre ces deux outils. Nous passerons sous le capot des deux plateformes, en les comparant point par point sur leurs capacités agentiques, leurs intégrations IDE, leur gestion du contexte de codebase et leurs grilles tarifaires.

TL;DR : OpenAI Codex vs GitHub Copilot

La façon la plus rapide de les différencier consiste à regarder comment ils attendent que vous travailliez.

|

Fonctionnalité |

OpenAI Codex |

Github Copilot |

|

Type |

Agent de codage autonome |

Programmeur en binôme IA et plateforme multi-agents |

|

Interface |

CLI, application de bureau, interface web |

Intégration IDE native (VS Code, JetBrains, etc.), CLI, interface web |

|

Choix de modèle |

Modèles GPT d'OpenAI uniquement |

Sélecteur multi-modèles (GPT, Claude, Gemini) |

|

Avantage distinctif |

Exécution en sandbox et traitement parallèle des tâches |

Flux de travail IDE sans friction et intégration MCP |

|

Idéal pour |

Délégation asynchrone de tâches et refactoring à grande échelle |

Suggestions de code en temps réel et codage en plein flux |

|

Paliers de prix |

20 $/mois (Plus), 100 $/mois ou 200 $/mois (paliers Pro) ; accès limité avec Go (8 $/mois) |

10 $/mois et 39 $/mois (Individuel), 19 $/mois (Business), 39 $/mois (Enterprise) |

Votre choix principal doit être dicté par vos besoins d'ingénierie immédiats. Certains utilisateurs avancés adoptent même une approche hybride.

Qu'est-ce qu'OpenAI Codex ?

Avant d'aborder le produit, clarifions la terminologie. « Codex » a d'abord désigné une famille de modèles spécialisés : le moteur d'origine derrière la première version de GitHub Copilot.

Si les modèles sous-jacents ont évolué (en passant par GPT-5.3-Codex et en s'appuyant de plus en plus sur GPT-5.4 et GPT-5.5), OpenAI a réutilisé le nom « Codex » pour en faire un produit autonome d'agent de codage.

Dans cet article, nous parlons d'OpenAI Codex comme de la plateforme, pas de la famille de modèles. Que vous l'utilisiez via la CLI, l'application de bureau ou l'interface web, vous accédez au même service agentique central. Nous considérons ces interfaces comme des points d'accès à la même intelligence sous-jacente.

Aujourd'hui, OpenAI Codex fonctionne comme un agent de codage autonome « lourd ». Il lance des environnements cloud sécurisés et isolés, clone votre dépôt, écrit et teste le code, puis soumet une pull request pour votre relecture.

Fonctionnalités et capacités clés de Codex

- Exécution cloud en sandbox : Codex exécute votre code dans des environnements isolés. C'est essentiel pour la sécurité et les tests, car l'agent peut lancer des scripts potentiellement destructeurs ou des migrations complexes sans toucher à votre machine locale.

- Gestion parallèle des tâches : Vous pouvez déléguer simultanément plusieurs tâches longues et indépendantes via la CLI open source de Codex ou l'app de bureau.

- Compactage du contexte et mémoires : Pour les tâches au long cours, Codex compresse dynamiquement sa fenêtre de contexte pour rester focalisé sans dépasser les limites de jetons. Il inclut désormais la fonctionnalité Chronicle, qui permet à l'agent de conserver d'une session à l'autre un contexte utile, des préférences développeur et des enseignements architecturaux.

- Effort de raisonnement adaptatif : Vous pouvez régler manuellement l'allocation de calcul de l'agent, de minimale (scripts rapides) à très élevée (refactorings architecturaux complexes).

Avantages et limites de Codex

- Avantages : Codex offre une véritable autonomie de bout en bout. Sa capacité à traiter des tâches en parallèle, à conserver un contexte persistant via les mémoires Chronicle et à vérifier sa propre sortie en environnement isolé le rend particulièrement utile pour la délégation à grande échelle. Il propose aussi une barrière à l'entrée plus basse avec un nouveau plan de démarrage à 8 $/mois pour un usage léger.

- Limites : Il n'y a pas d'autocomplétion en ligne en temps réel ; il impose un changement de posture vers la délégation plutôt que la co-rédaction. Par ailleurs, si le palier à 8 $/mois est accessible, les développeurs qui exécutent des tâches parallèles lourdes devront rapidement passer aux abonnements ChatGPT Pro supérieurs (100 $/mois ou 200 $/mois) pour éviter des plafonds de calcul trop stricts.

Pour voir Codex à l'œuvre, nous vous recommandons nos tutoriels montrant comment utiliser la CLI Codex pour l'automatisation de workflows data ou pour intégrer des serveurs MCP.

Qu'est-ce que GitHub Copilot ?

GitHub Copilot a radicalement évolué depuis ses débuts comme simple outil d'autocomplétion en ligne. Aujourd'hui, c'est une plateforme multi-agents conçue pour vivre nativement là où vous tapez.

Cependant, l'évolution rapide de Copilot vers des workflows agentiques a profondément changé ses besoins en calcul. Des sessions longues et parallélisées ont mis à rude épreuve son infrastructure, poussant GitHub à modifier drastiquement ses formules individuelles au T2 2026 pour préserver la fiabilité du service.

Fonctionnalités et capacités clés de GitHub Copilot

-

Flexibilité multi-modèles : Copilot n'est plus strictement verrouillé à un seul fournisseur. Le sélecteur de modèles donne désormais accès à GPT-5.4 et GPT-5.5, ainsi qu'au Claude d'Anthropic (avec Opus 4.7 sur les formules Pro+) et à Gemini de Google.

-

Copilot workspace et mode plan : Workspace repose sur un modèle planifier–revoir–exécuter. Vous pouvez activer le « mode plan » dans VS Code ou la CLI pour améliorer l'efficacité des tâches et réduire la consommation de jetons avant que l'agent n'écrive.

-

Mode agent et

/fleet: Copilot prend désormais en charge les éditions multi-fichiers et les workflows parallèles directement dans l'IDE, bien que ces commandes consomment beaucoup de calcul. -

Intégration MCP : Model Context Protocol (MCP) permet à Copilot d'interagir en toute sécurité avec vos outils développeur locaux et sources de données externes.

Avantages et limites de GitHub Copilot

- Avantages : Intégration IDE sans friction (VS Code, JetBrains, Neovim) et courbe d'apprentissage la plus faible parmi les outils de codage IA. La flexibilité multi-modèles est un atout majeur par rapport aux anciennes versions, vous permettant d'orienter des problèmes spécifiques vers les modèles les plus adaptés. Son intégration poussée avec GitHub (PR, issues, recherche de code) est sans égale.

- Limites : L'instauration récente de limites strictes de session et de jetons hebdomadaires, couplée à la suspension des nouvelles inscriptions individuelles payantes, complique la vie des gros utilisateurs pour les tâches complexes sans passer à Pro+. Ses capacités agentiques restent moins matures que l'approche en sandbox de Codex ; en d'autres termes, Copilot est moins « agentique » car il n'intègre pas de sandbox pour une exécution, réitération et vérification indépendantes.

Pour en savoir plus, consultez notre tutoriel GitHub Copilot CLI et nos comparatifs sur la façon dont Copilot se positionne face à Claude Code et Cursor.

Codex vs GitHub Copilot : comparaison directe

Bien qu'ils partagent un ADN d'ingénierie commun, Codex et GitHub Copilot sont fondamentalement différents. Voici une comparaison détaillée selon plusieurs facteurs cruciaux :

|

Fonctionnalité |

OpenAI Codex |

GitHub Copilot |

|

Type de produit |

Agent de codage autonome |

Programmeur en binôme IA et plateforme multi-agents |

|

Interface |

Plateforme multi-interfaces (CLI, Bureau, Web) |

IDE natif (VS Code, JetBrains, Neovim) |

|

Choix de modèle |

GPT-5.4, GPT-5.5, etc. |

Multi-modèles (GPT-5.4/5.5, Claude 4.7, Gemini) |

|

Compétences agentiques |

Exécution en sandbox, traitement parallèle |

Workspace, mode agent, |

|

Intégration IDE |

Basée sur extension (agent de chat en barre latérale, références de fichiers avec |

Intégration profonde et sans friction |

|

Gestion du contexte |

Clonage de dépôt + mémoire Chronicle |

Indexation à l'échelle de l'organisation (Enterprise) |

|

Prix (individuel) |

Gratuit, 8 $/mois (Base), 20 $/mois (Plus), 100–200 $/mois (Pro) |

Gratuit, 10 $/mois (Pro), 39 $/mois (Pro+) |

|

Prix (équipe) |

Tarification à l'usage (pay-as-you-go) |

19 $/mois (Business), 39 $/mois (Enterprise) |

|

Sécurité |

Isolation par exécution en sandbox |

Protection de la PI, journaux d'audit, contrôles de politique |

|

Idéal pour |

Délégation de tâches, refactors complexes multi-fichiers |

Collaboration en temps réel, codage en plein flux |

1. Interface et workflow

La différence philosophique centrale entre les deux outils se résume à ceci :

- Codex est conçu pour la délégation de tâches

- Copilot est conçu pour la collaboration en temps réel

Par exemple, vous devez refondre le flux d'authentification de votre application. Avec GitHub Copilot, vous ouvrez votre IDE, vous parcourez les fichiers concernés et vous commencez à collaborer. Vous utilisez Copilot Chat quand vous bloquez, vous vous appuyez sur les suggestions en ligne au fil de la frappe, et vous déclenchez éventuellement le mode Agent pour des modifications multi-fichiers localisées, sous votre supervision.

Avec OpenAI Codex, le workflow ressemble davantage à la gestion d'un collaborateur direct. Vous décrivez le résultat souhaité via la CLI Codex ou l'app de bureau, vous lui fournissez le contexte du dépôt nécessaire, puis vous vous éloignez. Codex gère le refactoring en arrière-plan et vous soumet ensuite une pull request à relire.

2. Modèles IA et génération de code

Aujourd'hui, Codex est fortement optimisé autour des derniers modèles GPT-5.4 et GPT-5.5 d'OpenAI, explicitement réglés pour les tâches d'ingénierie logicielle au long cours.

GitHub Copilot, de son côté, adopte une philosophie « apportez votre propre modèle ». Son sélecteur multi-modèles permet de basculer entre GPT-5.4, GPT-5.5, Gemini de Google et Claude d'Anthropic (avec Opus 4.7 disponible sur les formules Pro+).

Les deux outils produisent un code de très haute qualité pour les tâches courantes. L'écart apparaît surtout sur les problèmes complexes en plusieurs étapes :

- La flexibilité multi-modèles de Copilot vous laisse interroger différents modèles pour décomposer un problème

- Codex s'appuie sur sa capacité à exécuter et vérifier son propre résultat de façon autonome pour garantir que le code fonctionne avant de vous le présenter

3. Capacités agentiques

C'est là que la divergence est la plus nette. Codex est conçu, dès l'origine, pour une véritable autonomie agentique. Il utilise des environnements cloud sécurisés et isolés pour exécuter des boucles de test fermées, et prend en charge nativement le traitement parallèle afin que vous puissiez lancer plusieurs refactors indépendants sans bloquer votre machine.

GitHub Copilot a investi agressivement le champ agentique avec Copilot Workspace (modèle planifier–revoir–exécuter) et le mode Agent dans l'IDE avec des commandes comme /fleet.

Cependant, comme indiqué plus haut, ces workflows parallèles consomment beaucoup de calcul et amènent souvent les utilisateurs Copilot à heurter des limites de jetons restrictives. Plus important encore, Copilot n'a pas d'exécution de code indépendante et isolée. Il a besoin de votre environnement local pour exécuter et tester ses sorties, ce qui fait de Codex un choix plus robuste pour une autonomie sûre, sans intervention, et multi-fichiers.

4. Intégration IDE et mise en place

Pour un flux de codage quotidien, en plein « flow », l'intégration de GitHub Copilot est inégalée. Il est intégré nativement à VS Code, JetBrains et Neovim, et offre un workflow « tab pour accepter » d'une fluidité telle qu'il devient une extension naturelle du clavier.

OpenAI Codex, de son côté, est allé bien au-delà de ses débuts comme agent uniquement web. Il propose désormais une extension IDE robuste (disponible pour VS Code et JetBrains) qui amène ses capacités autonomes directement dans la barre latérale de votre éditeur.

Ce n'est pas un outil « d'autocomplétion en ligne » au sens de Copilot, mais il vous permet de dialoguer, de référencer des fichiers via la syntaxe @, et de déléguer des tâches complexes à exécuter en arrière-plan sans quitter l'IDE. Pour la délégation de tâches en arrière-plan et le raisonnement multi-fichiers, la capacité de Codex à « réfléchir » pendant que vous continuez de travailler dans l'éditeur est un atout opérationnel majeur.

5. Contexte et compréhension de la codebase

Le contexte est crucial dans le codage assisté par l'IA. Pour les grandes organisations avec des codebases massives et complexes, GitHub Copilot Enterprise dispose d'un avantage net grâce à son indexation persistante des dépôts à l'échelle de l'organisation. Il comprend nativement comment interagissent vos microservices, car il a accès au graphe organisationnel complet.

Codex gère le contexte différemment. Il clone à neuf votre dépôt pour chaque session active afin de construire une compréhension profonde de la codebase sur laquelle il opère. Auparavant, Codex « oubliait » tout une fois la session terminée.

Cependant, avec la nouvelle fonctionnalité de gestion de mémoire appelée Chronicle, Codex peut désormais conserver d'une session à l'autre des éléments critiques : contexte architectural, préférences développeur et apprentissages complexes.

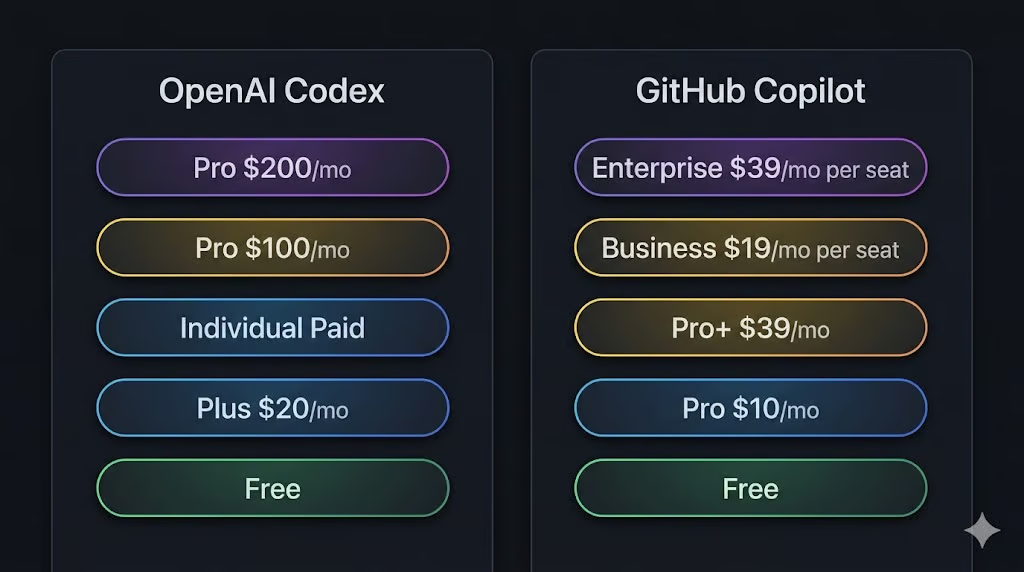

6. Tarification et formules

GitHub Copilot fonctionne avec une tarification prévisible par siège. Pour les particuliers, trois paliers existent :

- Gratuit : 0 $/mois

- Pro : 10 $/mois

- Pro+ : 39 $/mois

Pour les équipes, les niveaux organisationnels sont :

- Business : 19 $/mois

- Enterprise : 39 $/mois

Comme les workflows agentiques ont fait exploser les coûts de calcul — quelques requêtes suffisant parfois à dépasser le prix d'un abonnement individuel — GitHub a pris des mesures énergiques. Si vous cherchez à vous inscrire à titre individuel aujourd'hui, vous tomberez sur une liste d'attente. Les nouvelles inscriptions aux offres Copilot Pro, Pro+ et Student sont actuellement suspendues afin de préserver l'expérience des clients existants.

Pour ceux déjà sur la plateforme, des limites strictes de session et de jetons hebdomadaires (sur 7 jours) ont été mises en place. Ces plafonds dépendent de la consommation de jetons et de « multiplicateurs de modèle » spécifiques. Si vous exécutez des workflows parallèles (comme la commande /fleet), vous consommerez très vite votre allocation de jetons.

Pour plus de transparence, VS Code et la CLI Copilot affichent désormais des avertissements d'usage en temps réel à l'approche du plafond. Les utilisateurs qui atteignent leur limite basculeront sur des modèles standards jusqu'à la réinitialisation hebdomadaire, tandis que le passage à Pro+ offre plus de 5 fois les limites du plan Pro standard.

OpenAI Codex est structuré autour de la capacité de calcul plutôt que d'une prévisibilité SaaS par siège. Il propose un palier gratuit très accessible pour tester, suivi d'un plan de départ à 8 $/mois pour un usage léger. Ces deux paliers conviennent à l'évaluation de Codex, mais restent très limités.

Au-delà, l'échelle s'aligne sur les abonnements ChatGPT :

- Plus : 20 $/mois (exécution de tâches limitée)

- Paliers Pro : 100 $/mois et 200 $/mois (apportent le calcul massif requis pour une ingénierie logicielle sérieuse et parallélisée)

Le compromis est clair : Copilot est bien plus simple à budgéter à l'échelle d'une organisation, tandis que Codex offre des points d'entrée plus granulaires — gratuit pour commencer, mais nettement plus coûteux pour les power users qui exécutent des charges agentiques lourdes.

7. Sécurité et conformité

GitHub Copilot Enterprise mise fortement sur la conformité d'entreprise classique. Il offre

- Une indemnisation PI complète

- Des journaux d'audit étendus

- Des contrôles de politique stricts à l'échelle de l'organisation, intégrés à votre administration GitHub existante.

Codex aborde la sécurité par l'architecture plutôt que par la politique. Son exécution isolée en sandbox garantit que des opérations potentiellement destructrices (migrations de base de données, refonte de dépendances) ne peuvent pas endommager votre environnement local ni vos serveurs de production.

En revanche, la mise en conformité — gestion des clés API, maintien des pistes d'audit, etc. — incombe largement à votre équipe d'ingénierie, plutôt que d'être fournie prête à l'emploi.

Faut-il choisir Codex ou GitHub Copilot ?

Au final, choisir entre OpenAI Codex et GitHub Copilot relève rarement d'un débat sur « quel modèle IA est le plus intelligent ». C'est surtout une question de façon de travailler, pour vous et votre équipe.

Avez-vous besoin d'un assistant qui génère du boilerplate pendant que vos mains sont sur le clavier, ou d'un agent très capable pour mener un gros refactoring sans supervision ?

Choisissez Codex si...

- Vous voulez déléguer des fonctionnalités entières de bout en bout. Si votre objectif est de décrire un résultat, transmettre le contexte nécessaire, puis simplement relire une pull request finalisée, Codex est conçu pour ça. Il excelle dans l'exécution autonome, sans intervention.

- Vous avez besoin de traitement de tâches en parallèle. Pour les développeurs qui jonglent régulièrement avec plusieurs sujets complexes, la possibilité de lancer plusieurs tâches indépendantes en même temps, en sachant qu'elles tournent en toute sécurité dans des sandboxes cloud isolées, change la donne. Cela évite de faire geler votre machine sous la charge.

- Vous travaillez en environnement orienté terminal/CLI. Si votre workflow tourne autour de la ligne de commande, ou si vous voulez construire des outils développeur et des pipelines CI/CD sur mesure, la CLI de Codex et ses applications de bureau autonomes (macOS et Windows) offrent la séparation idéale.

- Vous payez déjà pour ChatGPT Pro. Si vous investissez déjà 100 ou 200 $ par mois dans un abonnement ChatGPT Pro haut de gamme pour accéder à des limites de calcul massives, canaliser vos tâches de codage via Codex est la meilleure façon d'optimiser cet investissement. Sinon, les paliers Gratuit ou 8 $/mois facilitent l'expérimentation.

Choisissez GitHub Copilot si...

- Vous voulez des suggestions IA dans votre IDE sans aucune friction de mise en place. Si vous privilégiez l'état de flux, Copilot reste la référence pour ces usages. Son intégration native à VS Code, JetBrains et Neovim vous donne des suggestions ultra-rapides, acceptées d'une touche, là où vous tapez déjà.

- Vous appréciez de changer de modèle IA en cours de session. Le sélecteur multi-modèles de Copilot est un atout majeur pour les développeurs qui savent que chaque modèle a ses forces. Basculer de GPT-5.5 à Claude Opus 4.7 d'Anthropic ou au Gemini 3.1 de Google pour franchir un blocage précis peut être très utile.

- Vous avez besoin d'une tarification prévisible par siège pour une équipe. La gestion budgétaire est déjà assez complexe. Même si les inscriptions individuelles sont actuellement suspendues, les organisations peuvent compter sur les paliers Business (19 $/mois) et Enterprise (39 $/mois) de Copilot pour déployer l'IA à l'échelle sans craindre des pics de facturation variables liés au calcul.

- Vous utilisez déjà l'écosystème GitHub. Si votre organisation repose exclusivement sur les issues GitHub, les pull requests et les actions, la capacité de Copilot Enterprise à indexer nativement toute votre codebase organisationnelle et à s'intégrer directement à vos workflows de PR est un vrai différenciateur.

Dernières réflexions

Le choix entre OpenAI Codex et GitHub Copilot dépend de votre façon réelle de travailler, vous et votre équipe d'ingénierie.

Le principe à garder en tête est le suivant :

- Codex est conçu pour la délégation.

- Copilot est conçu pour la collaboration.

Si vous cherchez un binôme de programmation intelligent pour rattraper vos coquilles, vous débloquer avec des suggestions en ligne et vous laisser basculer entre les meilleurs modèles fondamentaux du marché au fil de la session, GitHub Copilot a l'avantage. Mais si vous voulez confier à un agent autonome une mise à jour architecturale multi-fichiers et simplement relire la pull request avec votre café du matin, OpenAI Codex est l'outil qu'il vous faut.

Pour démarrer, nous vous recommandons de vous inscrire à notre parcours de compétences AI for Software Engineering, qui vous forme avec GitHub Copilot et des outils IA similaires.

Codex vs GitHub Copilot : FAQ

Puis-je utiliser Codex et GitHub Copilot ensemble ?

Oui, et de nombreux utilisateurs avancés le font. Comme Codex fonctionne en grande partie en dehors de l'IDE via sa CLI, ses apps de bureau ou son interface web, il n'entre pas en conflit avec GitHub Copilot exécuté localement dans VS Code ou JetBrains. Vous pouvez laisser Copilot autocompléter votre fonction en cours tandis que Codex exécute simultanément une migration de base de données complexe et multi-fichiers dans une sandbox cloud parallèle.

Codex est-il le même modèle qui alimente GitHub Copilot ?

Plus maintenant. C'est une source de confusion fréquente. « Codex » désignait à l'origine la famille de modèles OpenAI qui alimentait la première version de Copilot. Aujourd'hui, Codex est le produit d'agent de codage autonome d'OpenAI. De son côté, GitHub Copilot est une plateforme multi-agents qui utilise divers modèles, y compris différentes versions de GPT d'OpenAI, Claude d'Anthropic et les modèles Gemini de Google.

Quel outil est le meilleur pour des tâches autonomes et sans intervention ?

OpenAI Codex est nettement supérieur pour les tâches sans intervention. Sa capacité à lancer des environnements cloud isolés en sandbox lui permet d'écrire, d'exécuter et de vérifier le code de façon indépendante, sans risque pour votre configuration locale. Associé à son traitement parallèle des tâches et à la rétention de contexte via sa mémoire Chronicle, Codex est le choix de référence pour une véritable délégation de tâches.

Quel est le meilleur tarif pour les équipes ?

GitHub Copilot est le meilleur choix si vous voulez une facture mensuelle prévisible, car il utilise une tarification fixe par siège à 19 $ ou 39 $. OpenAI Codex est plus flexible puisqu'il adopte un modèle à l'usage où vous ne payez que ce que vous consommez réellement.

Pourquoi y a-t-il une liste d'attente pour GitHub Copilot, et OpenAI Codex est-il une alternative viable ?

Au T2 2026, GitHub a mis en pause les nouvelles inscriptions individuelles pour gérer les besoins extrêmes en calcul des fonctionnalités agentiques comme /fleet. OpenAI Codex constitue une alternative crédible, avec un angle plus agentique, pour les développeurs sur liste d'attente.