course

Att märka data är dyrt, långsamt, domänspecifikt och de flesta team har inte tillräckligt av det.

Du behöver alltid märkta data för att träna en modell, men att märka dem korrekt tar tid och kräver ofta en domänexpert. Till exempel behöver medicinska bilder radiologer och juridiska dokument behöver jurister. Även enkla uppgifter som sentimentanalys kräver att någon sätter sig ner och taggar varje exempel för hand. Som ett resultat slutar de flesta ML-team med ett litet märkt dataset och en enorm mängd omärkta data som de inte kan använda.

Semitillsynslärande löser detta genom att träna på båda. Det tar ditt lilla märkta dataset, kombinerar det med ditt stora omärkta, och låter modellen lära sig mönster.

I den här artikeln går jag igenom hur semitillsynslärande fungerar, tar upp de vanligaste teknikerna och visar när det är vettigt att använda det.

Men vad är egentligen tillsynslärande? Läs vårt blogginlägg för att lära dig hur grundläggande tillsynsalgoritmer fungerar.

Vad är semitillsynslärande?

Semitillsynslärande är ett maskininlärningssätt som tränar på en blandning av märkta och omärkta data.

Det ligger mellan tillsynslärande och utan tillsyn, precis som namnet antyder. Tillsynslärande kräver att varje exempel är märkt. Utan tillsyn fungerar helt utan etiketter. Semitillsynslärande använder en liten uppsättning märkta exempel tillsammans med en större samling omärkta.

De märkta datana talar om för modellen vad den ska leta efter. De omärkta datana visar modellen hur datat är strukturerat. Tillsammans ger de modellen mer att arbeta med än vad någon av typerna skulle göra var för sig.

Hur semitillsynslärande fungerar

Processen börjar med ett litet märkt dataset – kanske några hundra exempel där du känner till korrekt utdata.

Sedan tar du in ett mycket större omärkt dataset. Det kan vara tusentals eller till och med miljontals prover utan etiketter. Modellen använder dessa omärkta data för att lära sig underliggande mönster och relationer mellan datapunkter.

De märkta exemplen styr sedan denna struktur mot rätt svar. Modellen vet redan hur datat är organiserat utifrån de omärkta proverna. Etiketterna talar om vilka delar av den strukturen som motsvarar vilka utfall.

Här är ett snabbt exempel.

Säg att du klassificerar e‑post som skräppost eller inte. Du har 100 märkta mejl och 10 000 omärkta. Modellen lär sig först hur mejl grupperar sig baserat på ordmönster och struktur. Sedan använder den dina 100 märkta exempel för att avgöra vilka grupper som är skräppost och vilka som inte är det. Resultatet är en modell som presterar bättre än om du bara hade tränat på de 100 märkta mejlen.

Semitillsyn vs tillsyn vs utan tillsyn

Låt oss gå igenom varje inlärningssätt för att se var semitillsynslärande passar i förhållande till de andra två.

Tillsynslärande

Tillsynslärande tränar på fullt märkta data. Varje exempel i datasetet har en indata och ett känt utdata. Modellen lär sig avbildningen mellan dem.

Detta fungerar bra när du har tillräckligt många märkta exempel. Men ”tillräckligt” kan betyda tusentals eller till och med miljontals exempel beroende på uppgiften. Det är dyrt att ta fram och ibland helt enkelt omöjligt.

Utan tillsyn

Inlärning utan tillsyn använder inga etiketter alls. Modellen tittar på rådata och finner struktur på egen hand. Klassiska exempel är klustring och dimensionsreduktion.

Fördelen är att du inte behöver några märkta data. Nackdelen är att modellen inte vet vad du faktiskt bryr dig om. Den hittar mönster, visst, men de mönstren kanske inte matchar problemet du försöker lösa.

Semitillsynslärande

Semitillsynslärande kombinerar det bästa av båda. Du ger modellen ett litet märkt dataset för att definiera uppgiften och ett stort omärkt dataset för att lära sig datats struktur.

De märkta datana pekar modellen i rätt riktning. De omärkta datana visar hur olika exempel relaterar till varandra. Denna kombination överträffar ofta tillsynslärande på samma lilla märkta uppsättning, eftersom modellen upptäcker mönster den skulle ha missat utan de omärkta datana.

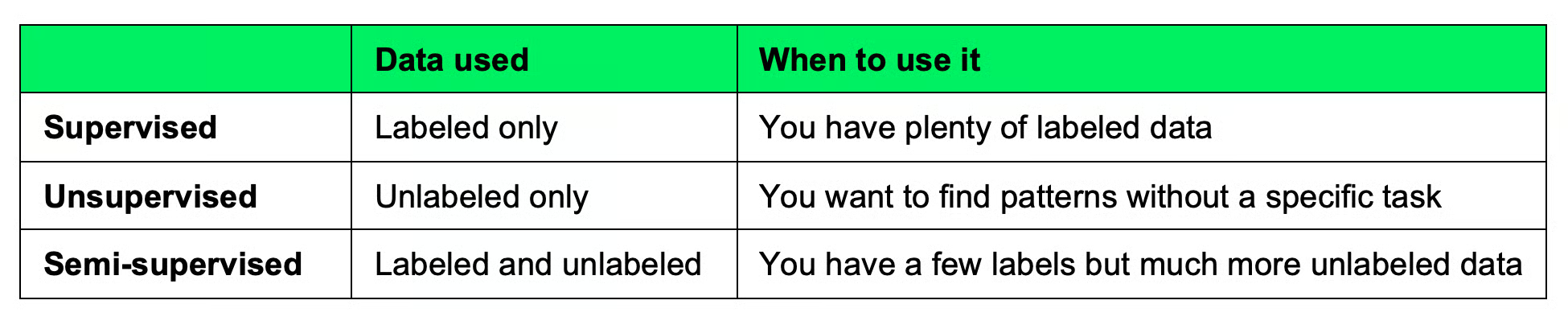

Här är en snabb jämförelse mellan dessa tre:

Jämförelsetabell för tillvägagångssätt inom maskininlärning

Sammanfattningsvis: om märkning tar för mycket tid och du har mycket omärkta data kan semitillsyn vara värt att överväga. Låt mig visa några vanliga tekniker härnäst.

Vanliga tekniker för semitillsynslärande

Det finns ett par sätt att implementera semitillsynslärande. Varje teknik hanterar uppdelningen märkt–omärkt på olika sätt, så låt oss gå igenom de vanligaste.

Självträning

Detta är det enklaste angreppssättet. Du tränar en modell på dina märkta data och använder den sedan för att förutsäga etiketter för de omärkta exemplen. De mest självsäkra förutsägelserna läggs till i den märkta uppsättningen som pseudoetiketter, och du tränar om modellen på det utökade datasetet.

Du upprepar processen tills modellen slutar förbättras eller du får slut på omärkta data. Det är lätt att implementera, men om modellen gör en felaktig förutsägelse tidigt blir det felet nu en del av ditt dataset.

Samskolning (co‑training)

Samskolning använder två modeller i stället för en. Varje modell tränas på en annan ”vy” av datat. Tänk på detta som en annan uppsättning funktioner.

Till exempel, säg att du klassificerar webbsidor. En modell kan titta på texten på sidan, medan den andra tittar på ankartexten i länkar som pekar på den. Varje modell märker omärkta exempel åt den andra, och de lär varandra över flera rundor.

Tanken är att den ena modellens styrkor täcker den andras svagheter. Om båda vyerna har tillräcklig information var för sig kan samskolning överträffa självträning eftersom fel från en modell korrigeras av den andra.

Etikettpropagation

Detta angreppssätt bygger en graf där varje datapunkt är en nod, och kanter kopplar samman liknande punkter. Etiketter ”sprids” sedan från märkta noder till deras grannar.

Antagandet är att liknande datapunkter bör dela samma etikett. Om ett märkt exempel ligger nära ett kluster av omärkta exempel tillhör de omärkta sannolikt samma klass. Etiketterna propagerar genom grafen tills varje nod har en.

Detta fungerar bra när dina data har en tydlig klusterstruktur, men kan fallera när gränserna mellan klasser är otydliga.

Semitillsynade neurala nätverk

Djupinlärning har egna semitillsynstekniker. Här är ett par av de vanligaste:

- Konsistensregularisering: Den pressar modellen att ge samma utdata för en indata även efter små störningar som brus eller augmentation. Tanken är att en bra modell inte ska ändra sin förutsägelse bara för att du ändrat indata lite

- Pseudoetikettering i neurala nätverk: Det fungerar som självträning men på batchnivå. Modellen genererar etiketter för omärkta exempel under träningen och använder dem tillsammans med riktiga etiketter i förlustfunktionen.

Metoder som FixMatch och MixMatch kombinerar dessa idéer, och de har visat goda resultat på benchmarktester med väldigt få märkta exempel.

Varför semitillsynslärande är viktigt

Du bör bry dig om semitillsynslärande av en anledning: kostnad.

Att märka data kräver data, domänexperter, tid och pengar. Semitillsynslärande minskar kostnaden genom att få ut mer av färre etiketter.

Sedan är det prestandan. En modell tränad på 500 märkta exempel och 50 000 omärkta slår ofta samma modell tränad på bara dessa 500 märkta. De omärkta datana ger modellen en mer komplett bild av hur datat är fördelat, vilket leder till bättre förutsägelser.

Och så finns verkligheten för de flesta dataset. Omärkta data finns överallt. Varje företag sitter på loggar, bilder, dokument och inspelningar som ingen har tid att märka. Semitillsynslärande låter dig få ut något användbart av de datana.

Tillämpningar av semitillsynslärande

Semitillsynslärande dyker upp i domäner där etiketter är svåra att få tag på.

Bildklassificering är ett av de vanligaste användningsområdena. Att märka tusentals bilder är tidsödande, men att samla in omärkta bilder är enkelt. Semitillsynsmetoder låter dig träna träffsäkra klassificerare med bara några hundra märkta bilder.

Textklassificering är likadant. Du kan ha miljontals kundrecensioner eller supportärenden, men bara en liten batch med manuella etiketter. Semitillsynslärande kan hjälpa dig bygga klassificerare som generaliserar över hela datasetet.

Talsyntes och taligenkänning är ett annat intressant område. Att transkribera ljud för hand kräver mycket arbete, men rå ljuddata är riklig. De omärkta inspelningarna hjälper modellen att lära sig akustiska mönster, medan de transkriberade exemplen lär den korrekta avbildningar.

Analys av medicinska data är en utmärkt domänspecifik uppgift. Att få en läkare att märka skanningar eller patientjournaler är dyrt och långsamt, eftersom de har viktigare saker att göra. Men sjukhus har enorma mängder omärkta kliniska data. Semitillsynsmetoder hjälper till att bygga diagnostiska modeller utan att behöva ett fullt märkt dataset.

Fördelar med semitillsynslärande

Detta gör semitillsynslärande lämpligt för många projekt:

- Det kräver färre märkta data: Du kan få bra resultat med en bråkdel av etiketterna som en fullt tillsynad metod skulle kräva

- Det förbättrar generalisering: De omärkta datana exponerar modellen för ett bredare spektrum av exempel, vilket hjälper den att prestera bättre på osedda data

- Det är kostnadseffektivt: När märkning är dyrt eller tidskrävande – vilket det oftast är – sparar semitillsynslärande tid och budget genom att få ut mesta möjliga av det du redan har

Så om du har mer data än etiketter är det dags att överväga semitillsynslärande.

Begränsningar med semitillsynslärande

Semitillsynslärande har ett par avvägningar som du bör känna till.

- Kvaliteten på de omärkta datana spelar roll: Om dina omärkta data inte kommer från samma fördelning som dina märkta lär sig modellen fel mönster

- Felaktiga pseudoetiketter: I metoder som självträning behandlas en självsäker men felaktig förutsägelse som sanning. Modellen tränas på den dåliga etiketten, vilket förstärker misstaget och försämrar framtida förutsägelser

- Det är mer komplext än tillsynslärande: Du har fler hyperparametrar att finjustera, fler designval att göra och fler saker som kan gå fel. En tillsynad modell är enklare att bygga och förklara. Semitillsynsmetoder adderar komplexitet som inte alltid är värd det – särskilt om ditt märkta dataset redan är tillräckligt stort

Inget av detta är avgörande hinder, bara något att känna till innan du sätter igång.

Semitillsynslärande i praktiken (Pythonexempel)

Låt oss se semitillsynslärande i aktion med ett enkelt Pythonexempel med scikit‑learns LabelSpreading‑algoritm.

Jag skapar ett dataset, märker bara en liten del av det och låter modellen lista ut resten.

Förbereda datat

Först genererar jag ett dataset och maskerar de flesta etiketter för att simulera ett semitillsynsscenario:

import numpy as np

from sklearn.datasets import make_moons

from sklearn.semi_supervised import LabelSpreading

from sklearn.metrics import accuracy_score

# Generate a dataset with 500 samples

X, y_true = make_moons(n_samples=500, noise=0.2, random_state=42)

# Keep only 10%, mask the rest as -1

rng = np.random.RandomState(42)

labeled_idx = rng.choice(500, size=50, replace=False)

y_train = np.full(500, -1) # -1 means unlabeled in scikit-learn

y_train[labeled_idx] = y_true[labeled_idx]

print(f"Labeled samples: {np.sum(y_train != -1)}")

print(f"Unlabeled samples: {np.sum(y_train == -1)}")

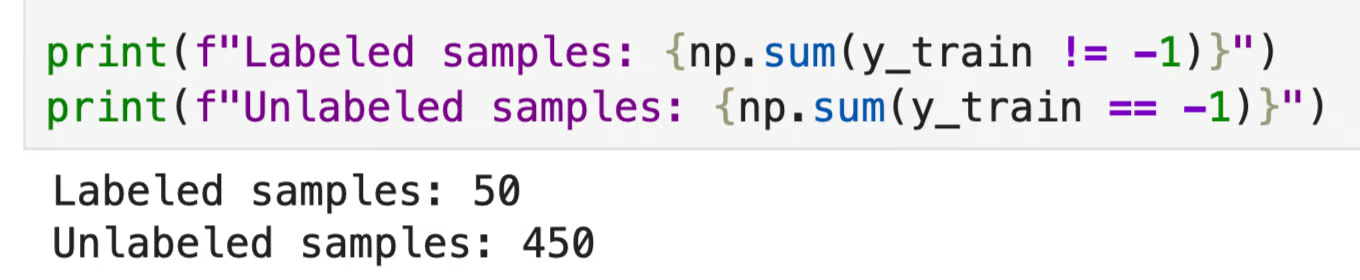

Antal märkta och omärkta dataprov

I scikit‑learn markerar −1 ett prov som omärkt. Av 500 prover har bara 50 etiketter. Modellen måste lista ut de övriga 450.

Träning och förutsägelse

Nu tränar jag en LabelSpreading‑modell och ser hur väl den märker de omärkta datana:

model = LabelSpreading(kernel="knn", n_neighbors=7)

model.fit(X, y_train)

y_pred = model.transduction_

# Check accuracy on the originally unlabeled samples

unlabeled_mask = y_train == -1

accuracy = accuracy_score(y_true[unlabeled_mask], y_pred[unlabeled_mask])

print(f"Accuracy on unlabeled samples: {accuracy:.2%}")

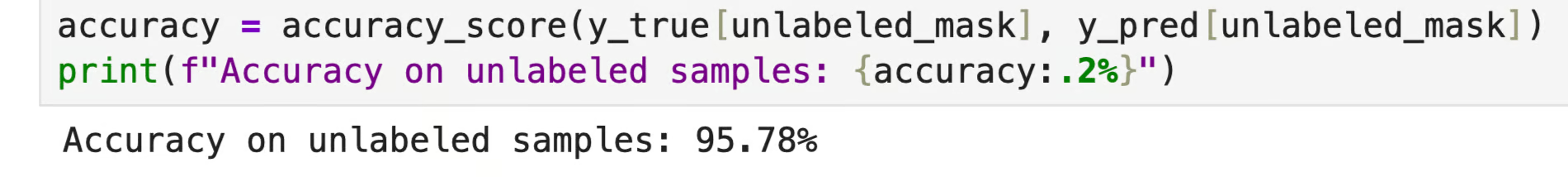

Noggrannhet på omärkta prover

Modellen märkte korrekt de flesta av de omärkta exemplen med bara 10 % av datat som märkta exempel. Det är själva kärnan.

Visualisera resultaten

Noggrannheten är hög – nästan 96 % – men låt oss visuellt granska vilka exempel som felklassificerades:

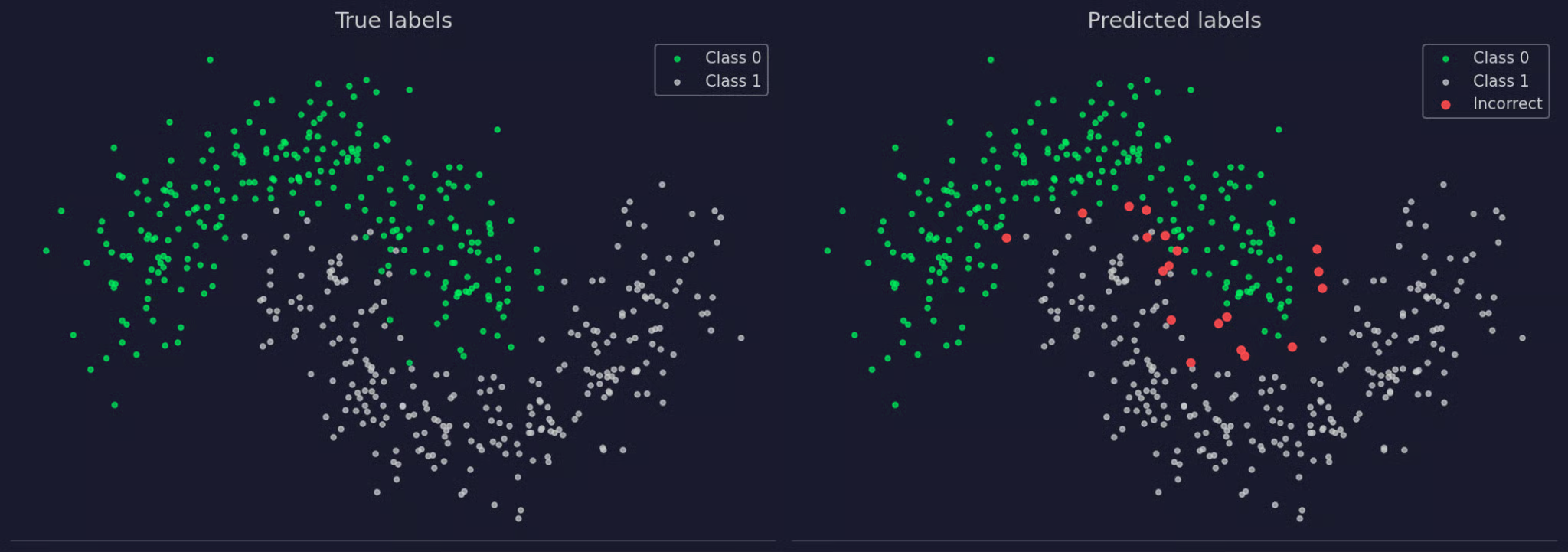

Sanna och förutsagda etiketter

De förutsagda etiketterna matchar nästan perfekt de sanna etiketterna, trots att modellen bara såg 50 märkta exempel av 500. Du kan se de felklassificerade markerade i rött i diagrammet till höger.

Vanliga misstag med semitillsynslärande

Du har sett hur kraftfullt semitillsynslärande kan vara, men det är inte perfekt för alla scenarier. Här är de vanligaste misstagen och hur du undviker dem.

- Att anta att omärkta data alltid hjälper: Det gör de inte. Om de omärkta datana kommer från en annan fördelning än dina märkta lär sig modellen mönster som inte gäller för din faktiska uppgift. Kontrollera alltid att dina märkta och omärkta data kommer från samma källa och representerar samma problem

- Dålig modellinitialisering: Semitillsynsmetoder bygger ovanpå en initial tillsynad modell. Om den första modellen är svag – tränad på för få exempel eller med dåliga hyperparametrar – ärver varje steg efter det dessa problem. Börja med den bästa tillsynade baslinjen du kan få innan du lägger till omärkta data

- Överdrivet förtroende för pseudoetiketter: Pseudoetiketter är bara så bra som modellen som genererade dem. Om du litar på varje pseudoetikett kan felen ackumuleras över träningsrundor. Sätt en hög konfidensgräns och använd bara pseudoetiketter som modellen är säker på. Kasta resten

- Att ignorera datafördelningen: Semitillsynsmetoder antar att strukturen i de omärkta datana säger något användbart om etiketterna. Om dina data inte har tydliga kluster eller mjuka beslutsgränser håller inte det antagandet

För att undvika dessa fyra misstag: börja med en stark tillsynad baslinje, lägg till omärkta data gradvis och kontrollera att prestandan faktiskt förbättras i varje steg.

När man ska använda semitillsynslärande

Semitillsynslärande är vettigt i dessa tre scenarier:

- När märkta data är begränsade: Om du bara har ett litet märkt dataset och att få fler etiketter är dyrt eller långsamt, hjälper semitillsynslärande dig pressa ut den där extra noggrannheten

- När omärkta data är rikliga: Du behöver en stor mängd omärkta data för att detta ska fungera. Om du bara har en liten omärkt uppsättning lär sig modellen inte tillräcklig struktur för att göra skillnad. Ju större gap mellan storleken på din märkta och omärkta uppsättning, desto mer kan semitillsynsmetoder hjälpa

- När dina data har en tydlig struktur: Semitillsynslärande fungerar bäst när liknande datapunkter delar samma etikett. Om dina data bildar kluster eller har mjuka gränser mellan klasser gör de omärkta datana dessa mönster desto tydligare. Om klasserna är sammanblandade utan tydlig separation tillför de omärkta datana inte mycket.

Om alla tre villkoren gäller är semitillsynslärande värt att prova.

Slutsats

Enkelt uttryckt ger semitillsynslärande dig ett sätt att träna bättre modeller utan att märka allt. Du tar ett litet märkt dataset, kombinerar det med ett stort omärkt, och låter modellen lära av båda.

Fördelarna är tydliga: mindre tid på märkning, snabbare time‑to‑market, lägre kostnader och bättre prestanda än att bara träna på begränsade etiketter. Och inom områden som medicin, juridik och NLP – där märkning kräver domänexperter – är det en stor sak.

Om du har en enorm mängd omärkta data, testa semitillsynslärande. Börja med en bra tillsynad baslinje, välj en teknik som passar din datas struktur och mät om de omärkta datana faktiskt hjälper. scikit‑learns LabelSpreading är ett bra första experiment, men testa även metoder som FixMatch och MixMatch.

Om du vill bli jobbredo 2026, gå vår Machine Learning Engineer‑track. Den täcker allt från grunder till MLOps.

FAQs

Vad är semitillsynslärande?

Semitillsynslärande är ett maskininlärningssätt som tränar modeller på en liten uppsättning märkta data och en stor uppsättning omärkta data. De märkta datana talar om för modellen vad den ska leta efter, medan de omärkta hjälper den att förstå den övergripande datastrukturen. På så sätt får du bättre resultat än om du bara tränar på de märkta datana.

Hur skiljer sig semitillsynslärande från tillsynslärande och inlärning utan tillsyn?

Tillsynslärande använder bara märkta data, där varje exempel har ett känt utfall. Inlärning utan tillsyn använder endast omärkta data och hittar mönster på egen hand. Semitillsynslärande använder ett litet märkt dataset för att definiera uppgiften och ett stort omärkt dataset för att lära sig datats struktur.

När ska jag använda semitillsynslärande?

Använd det när du har en liten mängd märkta data, en stor mängd omärkta data och dina data har en tydlig struktur, som naturliga kluster eller mjuka gränser mellan klasser. Om märkning är dyrt eller kräver domänexperter – som inom medicinsk bildbehandling eller juridisk textanalys – hjälper semitillsynslärande dig att bygga träffsäkra modeller utan att märka allt.

Vad är självträning i semitillsynslärande?

Självträning är en teknik där modellen tränas på märkta data först och sedan förutsäger etiketter för de omärkta exemplen. De mest självsäkra förutsägelserna läggs till i den märkta uppsättningen som pseudoetiketter, och modellen tränas om på det utökade datasetet. Risken är att felaktiga förutsägelser tidigt förstärks i senare rundor, så du bör sätta en hög konfidensgräns.