course

डेटा को लेबल करना महंगा, धीमा, डोमेन-विशिष्ट होता है, और ज़्यादातर टीमों के पास इसकी पर्याप्त मात्रा नहीं होती।

मॉडल ट्रेन करने के लिए आपको हमेशा लेबल्ड डेटा चाहिए, लेकिन उसे सही तरीके से लेबल करना समय लेता है और अक्सर डोमेन विशेषज्ञ की ज़रूरत पड़ती है। उदाहरण के लिए, मेडिकल इमेज के लिए रेडियोलॉजिस्ट और कानूनी दस्तावेज़ों के लिए वकील चाहिए होते हैं। यहाँ तक कि सेंटिमेंट एनालिसिस जैसे सरल कामों में भी किसी को बैठकर हर उदाहरण को हाथ से टैग करना पड़ता है। नतीजतन, ज़्यादातर ML टीमें एक बहुत छोटा लेबल्ड डेटासेट और बड़ी मात्रा में ऐसा अनलेबल्ड डेटा लेकर रह जाती हैं जिसे वे उपयोग नहीं कर पातीं।

सेमी-सुपरवाइज़्ड लर्निंग इसे दोनों पर ट्रेनिंग करके ठीक करती है। यह आपके छोटे लेबल्ड डेटासेट को बड़े अनलेबल्ड डेटासेट के साथ जोड़ती है और मॉडल को पैटर्न सीखने देती है।

इस लेख में, मैं बताऊँगा कि सेमी-सुपरवाइज़्ड लर्निंग कैसे काम करती है, सबसे आम तकनीकों को कवर करूँगा, और यह कब उपयोगी है, यह दिखाऊँगा।

लेकिन Supervised Machine Learning आखिर है क्या? हमारे ब्लॉग पोस्ट में पढ़ें कि आवश्यक सुपरवाइज़्ड लर्निंग एल्गोरिद्म कैसे काम करते हैं।

सेमी-सुपरवाइज़्ड लर्निंग क्या है?

सेमी-सुपरवाइज़्ड लर्निंग मशीन लर्निंग का एक तरीका है जो लेबल्ड और अनलेबल्ड डेटा के मिश्रण पर ट्रेन करता है।

जैसा नाम से स्पष्ट है, यह सुपरवाइज़्ड और अनसुपरवाइज़्ड लर्निंग के बीच आता है। सुपरवाइज़्ड लर्निंग में हर नमूना लेबल्ड होना चाहिए। अनसुपरवाइज़्ड लर्निंग बिना किसी लेबल के काम करती है। सेमी-सुपरवाइज़्ड लर्निंग कुछ लेबल्ड उदाहरणों को बहुत सारे अनलेबल्ड उदाहरणों के साथ उपयोग करती है।

लेबल्ड डेटा मॉडल को बताता है कि क्या खोजना है। अनलेबल्ड डेटा मॉडल को दिखाता है कि डेटा की संरचना कैसी है। जब इन्हें साथ जोड़ा जाता है, तो वे मॉडल को किसी भी एक प्रकार से अधिक जानकारी देते हैं।

सेमी-सुपरवाइज़्ड लर्निंग कैसे काम करती है

प्रक्रिया एक छोटे से लेबल्ड डेटासेट से शुरू होती है - मान लें कुछ सैकड़ों उदाहरण जिनके सही आउटपुट आपको पता हैं।

फिर आप एक बहुत बड़ा अनलेबल्ड डेटासेट लाते हैं। यह हज़ारों या लाखों सैंपल हो सकते हैं जिनके साथ कोई लेबल नहीं जुड़े हैं। मॉडल इस अनलेबल्ड डेटा का उपयोग डेटा बिंदुओं के बीच अंतर्निहित पैटर्न और संबंध सीखने के लिए करता है।

इसके बाद लेबल्ड उदाहरण उस संरचना को सही उत्तरों की ओर निर्देशित करते हैं। मॉडल को पहले से अनलेबल्ड सैंपलों से पता होता है कि डेटा कैसे व्यवस्थित है। लेबल उसे बताते हैं कि उस संरचना के कौन से क्षेत्र किस आउटपुट से मेल खाते हैं।

यहाँ एक त्वरित उदाहरण है।

मान लें आप ईमेल को स्पैम या नॉन-स्पैम के रूप में वर्गीकृत कर रहे हैं। आपके पास 100 लेबल्ड ईमेल हैं और 10,000 अनलेबल्ड। मॉडल पहले शब्द-पैटर्न और संरचना के आधार पर ईमेल के समूह बनना सीखता है। फिर वह आपके 100 लेबल्ड उदाहरणों का उपयोग करके समझता है कि कौन से समूह स्पैम हैं और कौन से नहीं। नतीजा ऐसा मॉडल होता है जो केवल उन 100 लेबल्ड ईमेल पर ट्रेन करने की तुलना में बेहतर प्रदर्शन करता है।

सेमी-सुपरवाइज़्ड बनाम सुपरवाइज़्ड बनाम अनसुपरवाइज़्ड लर्निंग

आइए हर लर्निंग तरीके को देखें ताकि समझ सकें कि सेमी-सुपरवाइज़्ड लर्निंग इन दोनों के सापेक्ष कहाँ फिट होती है।

सुपरवाइज़्ड लर्निंग

सुपरवाइज़्ड लर्निंग पूरी तरह लेबल्ड डेटा पर ट्रेन करती है। डेटासेट के हर सैंपल में इनपुट और ज्ञात आउटपुट होता है। मॉडल दोनों के बीच मैपिंग सीखता है।

यह तब अच्छा काम करता है जब आपके पास पर्याप्त लेबल्ड उदाहरण हों। लेकिन "पर्याप्त" का मतलब कार्य के आधार पर हज़ारों या लाखों सैंपल हो सकता है। यह बनाना महंगा और कभी-कभी असंभव होता है।

अनसुपरवाइज़्ड लर्निंग

अनसुपरवाइज़्ड लर्निंग बिल्कुल भी लेबल का उपयोग नहीं करती। मॉडल कच्चे डेटा को देखता है और खुद ही संरचना ढूँढ़ता है। क्लासिक उदाहरण क्लस्टरिंग और डाइमेंशनलिटी रिडक्शन हैं।

फायदा यह है कि आपको कोई लेबल्ड डेटा नहीं चाहिए। नुकसान यह है कि मॉडल को यह पता नहीं होता कि आपको वास्तव में किस चीज़ की परवाह है। वह पैटर्न तो ढूँढ़ लेता है, पर वे पैटर्न आपके हल किए जाने वाले समस्या से मेल भी खाएँ, यह ज़रूरी नहीं।

सेमी-сुपरवाइज़्ड लर्निंग

सेमी-सुपरवाइज़्ड लर्निंग दोनों का सर्वश्रेष्ठ जोड़ती है। आप मॉडल को टास्क परिभाषित करने के लिए छोटा लेबल्ड डेटासेट देते हैं और डेटा की संरचना सीखने के लिए बड़ा अनलेबल्ड डेटासेट।

लेबल्ड डेटा मॉडल को सही दिशा दिखाता है। अनलेबल्ड डेटा मॉडल को दिखाता है कि अलग-अलग सैंपल एक-दूसरे से कैसे संबंधित हैं। यह संयोजन अक्सर उसी छोटे लेबल्ड सेट पर सुपरवाइज़्ड लर्निंग से बेहतर प्रदर्शन करता है, क्योंकि मॉडल ऐसे पैटर्न पकड़ता है जो अनलेबल्ड डेटा के बिना छूट जाते।

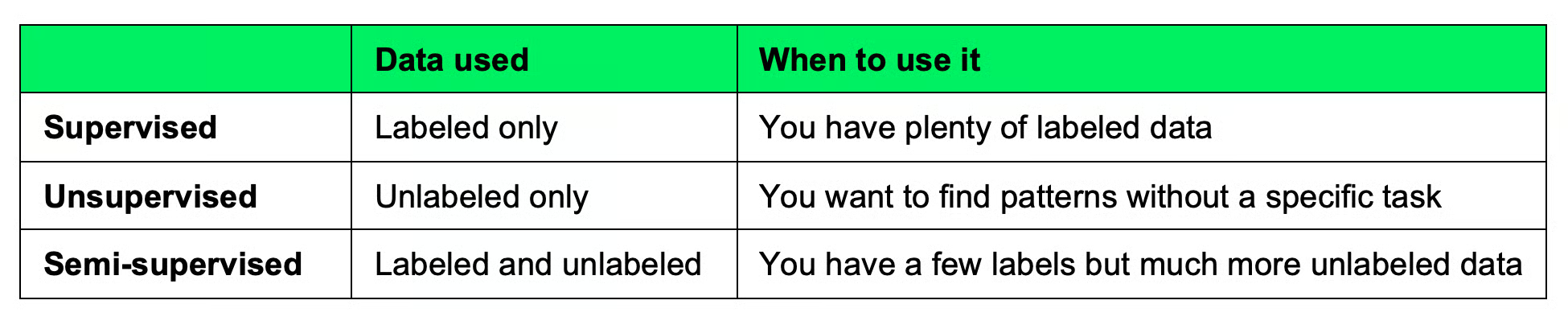

इन तीनों का त्वरित तुलना यहाँ है:

मशीन लर्निंग अप्रोच तुलना तालिका

संक्षेप में, यदि लेबलिंग में बहुत समय लगता है और आपके पास बहुत सारा अनलेबल्ड डेटा है, तो सेमी-सुपरवाइज़्ड लर्निंग पर विचार करना सार्थक हो सकता है। अब मैं आपको कुछ आम तकनीकें दिखाता हूँ।

आम सेमी-सुपरवाइज़्ड लर्निंग तकनीकें

सेमी-सुपरवाइज़्ड लर्निंग लागू करने के कुछ तरीके हैं। हर तकनीक लेबल्ड-अनलेबल्ड विभाजन को अलग ढंग से संभालती है, तो आइए सबसे आम तरीकों से गुजरते हैं।

सेल्फ-ट्रेनिंग

यह सबसे सरल तरीका है। आप अपने लेबल्ड डेटा पर एक मॉडल ट्रेन करते हैं, फिर उससे अनलेबल्ड सैंपलों के लिए लेबल का अनुमान लगवाते हैं। जिन भविष्यवाणियों में भरोसा सबसे अधिक होता है, उन्हें छद्म-लेबल (pseudo-labels) के रूप में लेबल्ड सेट में जोड़ दिया जाता है, और आप विस्तारित डेटासेट पर मॉडल को फिर से ट्रेन करते हैं।

आप इस प्रक्रिया को तब तक दोहराते हैं जब तक मॉडल में सुधार रुक न जाए या अनलेबल्ड डेटा समाप्त न हो जाए। इसे लागू करना आसान है, लेकिन यदि मॉडल शुरुआती चरण में गलत भविष्यवाणी कर देता है, तो वह त्रुटि अब आपके डेटासेट का हिस्सा बन जाती है।

को-ट्रेनिंग

को-ट्रेनिंग एक की बजाय दो मॉडल इस्तेमाल करता है। हर मॉडल डेटा के अलग "व्यू" पर ट्रेन होता है। इसे फीचर्स के अलग सबसेट की तरह समझें।

उदाहरण के लिए, मान लें आप वेब पेजों का वर्गीकरण कर रहे हैं। एक मॉडल पेज के टेक्स्ट को देख सकता है, जबकि दूसरा उस पर पॉइंट करने वाले लिंक के एंकर टेक्स्ट को। हर मॉडल दूसरे के लिए अनलेबल्ड सैंपलों को लेबल करता है, और कई राउंड में वे एक-दूसरे को सिखाते हैं।

विचार यह है कि एक मॉडल की ताकत दूसरे की कमज़ोरियों को कवर करती है। यदि दोनों व्यू अपने-आप में पर्याप्त जानकारी रखते हैं, तो को-ट्रेनिंग सेल्फ-ट्रेनिंग से बेहतर हो सकती है क्योंकि एक मॉडल की त्रुटियाँ दूसरे द्वारा सुधारी जाती हैं।

लेबल प्रोपेगेशन

इस तरीके में एक ग्राफ़ बनाया जाता है जहाँ हर डेटा पॉइंट एक नोड होता है, और एज समान बिंदुओं को जोड़ते हैं। फिर लेबल लेबल्ड नोड्स से उनके पड़ोसियों तक "फैलते" हैं।

मान्यता यह है कि समान डेटा पॉइंट्स को एक ही लेबल साझा करना चाहिए। यदि कोई लेबल्ड सैंपल अनलेबल्ड सैंपलों के क्लस्टर के पास है, तो वे अनलेबल्ड सैंपल संभवतः उसी क्लास के हैं। ग्राफ़ के जरिए लेबल फैलते हैं जब तक कि हर नोड को लेबल न मिल जाए।

यह तब अच्छा काम करता है जब आपके डेटा में स्पष्ट क्लस्टर संरचना हो, लेकिन तब विफल हो सकता है जब क्लासों के बीच की सीमाएँ धुंधली हों।

सेमी-सुपरवाइज़्ड न्यूरल नेटवर्क

डीप लर्निंग में सेमी-सुपरवाइज़्ड तकनीकों का अपना सेट है। यहाँ दो सबसे आम तरीके हैं:

- कंसिस्टेंसी रेग्युलराइज़ेशन: यह मॉडल को प्रेरित करता है कि हल्के-फुल्के बदलाव (जैसे नॉइज़ या ऑग्मेंटेशन) के बाद भी किसी इनपुट के लिए वही आउटपुट दे। विचार यह है कि अच्छा मॉडल केवल इसलिए अपनी भविष्यवाणी न बदले क्योंकि आपने इनपुट में थोड़ा परिवर्तन कर दिया

- न्यूरल नेटवर्क में छद्म-लेबलिंग: यह सेल्फ-ट्रेनिंग की तरह काम करता है लेकिन बैच स्तर पर। ट्रेनिंग के दौरान मॉडल अनलेबल्ड सैंपलों के लिए लेबल जनरेट करता है और उन्हें वास्तविक लेबल्स के साथ लॉस फंक्शन में उपयोग करता है।

FixMatch और MixMatch जैसी विधियाँ इन विचारों को जोड़ती हैं, और बहुत कम लेबल्ड उदाहरणों वाले बेंचमार्क्स पर अच्छे नतीजे दिखाए हैं।

सेमी-सुपरवाइज़्ड लर्निंग क्यों मायने रखती है

सेमी-सुपरवाइज़्ड लर्निंग आपके लिए एक मुख्य कारण से महत्वपूर्ण है: लागत।

डेटा को लेबल करना डेटा, डोमेन विशेषज्ञ, समय और धन मांगता है। सेमी-सुपरवाइज़्ड लर्निंग कम लेबल के साथ अधिक हासिल करके लागत घटाती है।

फिर आता है प्रदर्शन। 500 लेबल्ड और 50,000 अनलेबल्ड सैंपलों पर ट्रेन किया गया मॉडल अक्सर केवल उन 500 लेबल्ड सैंपलों पर ट्रेन किए गए उसी मॉडल को पछाड़ देगा। अनलेबल्ड डेटा मॉडल को डेटा के वितरण की अधिक संपूर्ण तस्वीर देता है, जिससे बेहतर भविष्यवाणियाँ मिलती हैं।

और फिर अधिकांश डेटासेट की वास्तविकता है। अनलेबल्ड डेटा हर जगह है। हर कंपनी के पास लॉग्स, इमेजेज, दस्तावेज़ और रिकॉर्डिंग्स हैं जिन्हें लेबल करने का किसी के पास समय नहीं है। सेमी-सुपरवाइज़्ड लर्निंग आपको उस डेटा से उपयोगी चीज़ें बनाने देती है।

सेमी-सुपरवाइज़्ड लर्निंग के अनुप्रयोग

सेमी-सुपरवाइज़्ड लर्निंग उन डोमेन्स में दिखती है जहाँ लेबल पाना कठिन होता है।

इमेज क्लासिफिकेशन सबसे आम उपयोग मामलों में से एक है। हज़ारों इमेज को लेबल करना थकाऊ है, पर अनलेबल्ड इमेज इकट्ठा करना आसान है। सेमी-सुपरवाइज़्ड तरीके कुछ सैकड़ों लेबल्ड इमेज के साथ भी सटीक क्लासिफायर ट्रेन करने देते हैं।

टेक्स्ट क्लासिफिकेशन भी ऐसा ही है। आपके पास लाखों ग्राहक समीक्षाएँ या सपोर्ट टिकट हो सकते हैं, पर केवल एक छोटा बैच मैनुअल लेबल्स के साथ। सेमी-सुपरवाइज़्ड लर्निंग आपको ऐसे क्लासिफायर बनाने में मदद करती है जो पूरे डेटासेट पर जनरलाइज़ कर सकें।

स्पीच रिकग्निशन एक और दिलचस्प क्षेत्र है। ऑडियो का हाथ से ट्रांसक्रिप्शन बहुत मेहनत मांगता है, पर कच्चा ऑडियो डेटा प्रचुर मात्रा में है। अनलेबल्ड रिकॉर्डिंग्स मॉडल को ध्वनिक पैटर्न सीखने में मदद करती हैं, जबकि ट्रांसक्राइब किए गए सैंपल सही मैपिंग सिखाते हैं।

मेडिकल डेटा विश्लेषण एक उत्कृष्ट डोमेन-विशिष्ट कार्य है। डॉक्टर से स्कैन या मरीज रिकॉर्ड्स लेबल करवाना महंगा और धीमा है, क्योंकि उनके पास और भी महत्वपूर्ण काम होते हैं। पर अस्पतालों के पास अनलेबल्ड क्लीनिकल डेटा की विशाल मात्रा होती है। सेमी-सुपरवाइज़्ड तरीके बिना पूर्ण लेबल्ड डेटासेट के डायग्नोस्टिक मॉडल बनाने में मदद करते हैं।

सेमी-सुपरवाइज़्ड लर्निंग के लाभ

यही कारण हैं कि सेमी-सुपरवाइज़्ड लर्निंग कई प्रोजेक्ट्स के लिए उपयुक्त बैठती है:

- इसमें कम लेबल्ड डेटा चाहिए: आप पूरी तरह सुपरवाइज़्ड अप्रोच की तुलना में बहुत कम लेबल्स के साथ अच्छे नतीजे पा सकते हैं

- यह जनरलाइजेशन सुधारती है: अनलेबल्ड डेटा मॉडल को उदाहरणों की व्यापक रेंज दिखाता है, जिससे अनदेखे डेटा पर प्रदर्शन बेहतर होता है

- यह किफायती है: जब लेबलिंग महंगी या समय लेने वाली हो - जो कि अक्सर होता है - सेमी-सुपरवाइज़्ड लर्निंग आपके पास मौजूद डेटा का अधिकतम उपयोग कर समय और बजट बचाती है

तो, यदि आपके पास डेटा लेबल्स से अधिक है, तो सेमी-सुपरवाइज़्ड लर्निंग पर विचार करने का समय है।

सेमी-सुपरवाइज़्ड लर्निंग की सीमाएँ

सेमी-सुपरवाइज़्ड लर्निंग के कुछ ट्रेड-ऑफ़ हैं जिनके बारे में आपको पता होना चाहिए।

- अनलेबल्ड डेटा की गुणवत्ता मायने रखती है: यदि आपका अनलेबल्ड डेटा आपके लेबल्ड डेटा जैसी वितरण से नहीं आता, तो मॉडल गलत पैटर्न सीखता है

- गलत छद्म-लेबल्स: सेल्फ-ट्रेनिंग जैसी विधियों में, आत्मविश्वासी लेकिन गलत भविष्यवाणी को ग्राउंड ट्रुथ मान लिया जाता है। मॉडल उस खराब लेबल पर ट्रेन करता है, जिससे गलती पुख्ता होती है और आगे की भविष्यवाणियाँ बदतर हो जाती हैं

- यह सुपरवाइज़्ड लर्निंग से अधिक जटिल है: आपको अधिक हाइपरपैरामीटर ट्यून करने होते हैं, अधिक डिज़ाइन विकल्प लेने होते हैं, और अधिक चीज़ें गलत हो सकती हैं। एक सुपरवाइज़्ड मॉडल बनाना और समझाना सरल है। सेमी-सुपरवाइज़्ड विधियाँ अतिरिक्त जटिलता लाती हैं जो हमेशा सार्थक नहीं होतीं - खासकर यदि आपका लेबल्ड डेटासेट पहले से पर्याप्त बड़ा है

इनमें से कोई भी सौदा-रोक नहीं है, बस कूदने से पहले जानने योग्य बातें हैं।

व्यवहार में सेमी-सुपरवाइज़्ड लर्निंग (Python उदाहरण)

आइए scikit-learn के LabelSpreading एल्गोरिद्म के साथ एक सरल Python उदाहरण से सेमी-सुपरवाइज़्ड लर्निंग को काम में देखकर समझते हैं।

मैं एक डेटासेट बनाऊँगा, उसका केवल एक छोटा हिस्सा लेबल करूँगा, और बाकी मॉडल पर छोड़ दूँगा।

डेटा सेटअप करना

सबसे पहले, मैं एक डेटासेट जनरेट करूँगा और सेमी-सुपरवाइज़्ड परिदृश्य का अनुकरण करने के लिए अधिकांश लेबल्स को मास्क कर दूँगा:

import numpy as np

from sklearn.datasets import make_moons

from sklearn.semi_supervised import LabelSpreading

from sklearn.metrics import accuracy_score

# Generate a dataset with 500 samples

X, y_true = make_moons(n_samples=500, noise=0.2, random_state=42)

# Keep only 10%, mask the rest as -1

rng = np.random.RandomState(42)

labeled_idx = rng.choice(500, size=50, replace=False)

y_train = np.full(500, -1) # -1 means unlabeled in scikit-learn

y_train[labeled_idx] = y_true[labeled_idx]

print(f"Labeled samples: {np.sum(y_train != -1)}")

print(f"Unlabeled samples: {np.sum(y_train == -1)}")

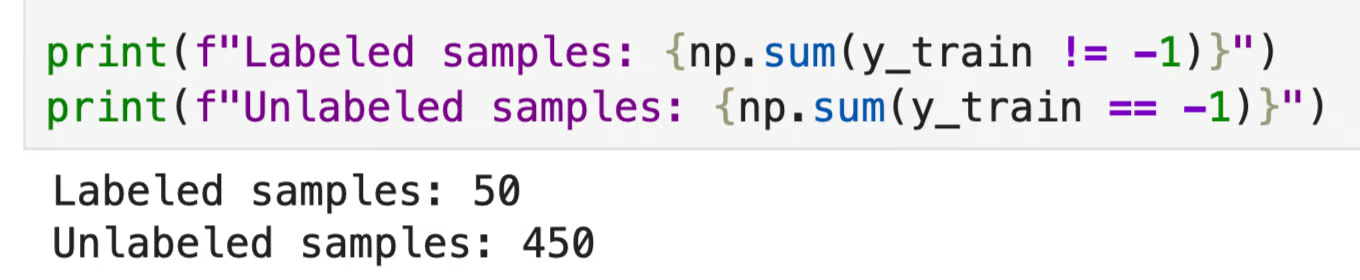

लेबल्ड और अनलेबल्ड डेटा सैंपलों की संख्या

scikit-learn में, -1 किसी सैंपल को अनलेबल्ड के रूप में चिह्नित करता है। 500 सैंपलों में से केवल 50 के पास लेबल हैं। मॉडल को बाकी 450 का पता लगाना है।

ट्रेनिंग और प्रेडिक्शन

अब मैं एक LabelSpreading मॉडल ट्रेन करूँगा और देखूँगा कि यह अनलेबल्ड डेटा को कितना अच्छी तरह लेबल करता है:

model = LabelSpreading(kernel="knn", n_neighbors=7)

model.fit(X, y_train)

y_pred = model.transduction_

# Check accuracy on the originally unlabeled samples

unlabeled_mask = y_train == -1

accuracy = accuracy_score(y_true[unlabeled_mask], y_pred[unlabeled_mask])

print(f"Accuracy on unlabeled samples: {accuracy:.2%}")

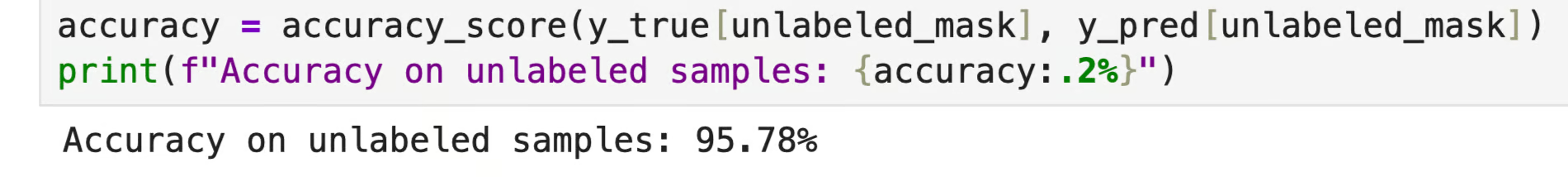

अनलेबल्ड सैंपलों पर शुद्धता

मॉडल ने केवल 10% डेटा को लेबल्ड उदाहरणों के रूप में उपयोग करके अधिकांश अनलेबल्ड सैंपलों को सही ढंग से लेबल किया। यही मूल विचार है।

नतीजों का विज़ुअलाइज़ेशन

शुद्धता अधिक है - लगभग 96% - लेकिन आइए दृश्य रूप से देखें कि कौन से सैंपल गलत वर्गीकृत हुए:

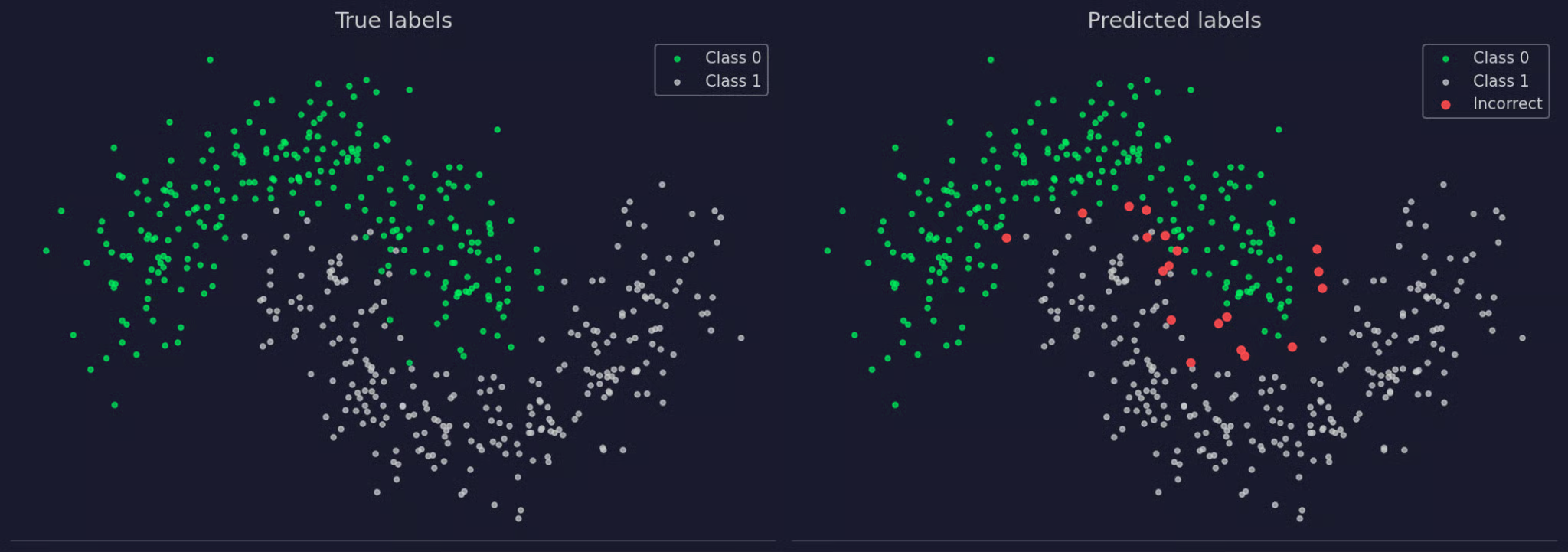

सही और अनुमानित लेबल

अनुमानित लेबल वास्तविक लेबल से लगभग पूरी तरह मेल खाते हैं, जबकि मॉडल ने 500 में से केवल 50 लेबल्ड उदाहरण देखे थे। दाईं चार्ट में लाल रंग में गलत वर्गीकृत सैंपल दिखते हैं।

सेमी-सुपरवाइज़्ड लर्निंग के साथ आम गलतियाँ

आपने देखा कि सेमी-सुपरवाइज़्ड लर्निंग कितनी शक्तिशाली हो सकती है, लेकिन यह हर परिदृश्य के लिए परफ़ेक्ट नहीं है। यहाँ सबसे आम गलतियाँ और उनसे बचने के तरीके हैं।

- मान लेना कि अनलेबल्ड डेटा हमेशा मदद करता है: ऐसा नहीं है। यदि अनलेबल्ड डेटा आपके लेबल्ड डेटा से अलग वितरण से आता है, तो मॉडल ऐसे पैटर्न सीखता है जो आपकी वास्तविक टास्क पर लागू नहीं होते। हमेशा जाँचें कि आपका लेबल्ड और अनलेबल्ड डेटा एक ही स्रोत से आता है और एक ही समस्या का प्रतिनिधित्व करता है

- खराब मॉडल इनिशियलाइज़ेशन: सेमी-सुपरवाइज़्ड तरीके एक शुरुआती सुपरवाइज़्ड मॉडल पर आधारित होते हैं। यदि पहला मॉडल कमज़ोर है - बहुत कम सैंपलों पर ट्रेन हुआ है या ख़राब हाइपरपैरामीटर्स के साथ - तो उसके बाद के हर चरण में वही समस्याएँ विरासत में मिलती हैं। अनलेबल्ड डेटा जोड़ने से पहले जितना अच्छा हो सके उतना मजबूत सुपरवाइज़्ड बेसलाइन से शुरू करें

- छद्म-लेबल्स पर अत्यधिक निर्भरता: छद्म-लेबल्स उतने ही अच्छे होते हैं जितना अच्छा उन्हें बनाने वाला मॉडल। यदि आप हर छद्म-लेबल पर भरोसा करते हैं, तो त्रुटियाँ ट्रेनिंग राउंड्स में जुड़ती जाती हैं। उच्च कॉन्फिडेंस थ्रेशोल्ड सेट करें और केवल उन्हीं छद्म-लेबल्स का उपयोग करें जिन पर मॉडल आश्वस्त हो। बाकी को छोड़ दें

- डेटा वितरण की अनदेखी: सेमी-सुपरवाइज़्ड तरीके मानते हैं कि अनलेबल्ड डेटा की संरचना लेबल्स के बारे में कुछ उपयोगी बताती है। यदि आपके डेटा में स्पष्ट क्लस्टर या स्मूद डिसीजन बाउंड्री नहीं हैं, तो यह मान्यता सही नहीं ठहरेगी

इन चार गलतियों से बचने के लिए, एक मजबूत सुपरवाइज़्ड बेसलाइन से शुरू करें, अनलेबल्ड डेटा धीरे-धीरे जोड़ें, और हर चरण में जाँचें कि प्रदर्शन वास्तव में बेहतर हो रहा है।

सेमी-सुपरवाइज़्ड लर्निंग कब उपयोग करें

इन तीन परिस्थितियों में सेमी-सुपरवाइज़्ड लर्निंग उचित लगती है:

- जब लेबल्ड डेटा सीमित हो: यदि आपके पास छोटा लेबल्ड डेटासेट है और अधिक लेबल जुटाना महंगा या धीमा है, तो सेमी-सुपरवाइज़्ड लर्निंग आपको अतिरिक्त सटीकता निचोड़ने में मदद करती है

- जब अनलेबल्ड डेटा प्रचुर मात्रा में हो: इसके काम करने के लिए आपको बड़ी मात्रा में अनलेबल्ड डेटा चाहिए। यदि आपके पास केवल थोड़ा अनलेबल्ड सेट है, तो मॉडल पर्याप्त संरचना नहीं सीखेगा। आपके लेबल्ड और अनलेबल्ड सेट के आकार के बीच अंतर जितना बड़ा होगा, सेमी-सुपरवाइज़्ड तरीके उतनी ही मदद करेंगे

- जब आपके डेटा की स्पष्ट संरचना हो: सेमी-सुपरवाइज़्ड लर्निंग तब सबसे अच्छा काम करती है जब समान डेटा पॉइंट्स एक ही लेबल साझा करते हों। यदि आपका डेटा क्लस्टर बनाता है या क्लासों के बीच स्मूद सीमाएँ हैं, तो अनलेबल्ड डेटा उन पैटर्न को और स्पष्ट कर देगा। यदि क्लासेज़ आपस में घुली-मिली हैं और स्पष्ट पृथक्करण नहीं है, तो अनलेबल्ड डेटा का लाभ कम मिलेगा।

यदि ये तीनों शर्तें लागू हों, तो सेमी-सुपरवाइज़्ड लर्निंग आज़माने लायक है।

निष्कर्ष

साधारण शब्दों में, सेमी-सुपरवाइज़्ड लर्निंग आपको बिना सब कुछ लेबल किए बेहतर मॉडल ट्रेन करने का तरीका देती है। आप छोटा लेबल्ड डेटासेट लेते हैं, उसे बड़े अनलेबल्ड डेटासेट के साथ जोड़ते हैं, और मॉडल को दोनों से सीखने देते हैं।

फ़ायदे स्पष्ट हैं: कम समय लेबलिंग में, बाज़ार तक तेज़ी से पहुँचना, कम लागत, और केवल सीमित लेबल्स पर ट्रेन करने की तुलना में बेहतर प्रदर्शन। और चिकित्सा, कानूनी और NLP जैसे क्षेत्रों में - जहाँ लेबलिंग के लिए डोमेन विशेषज्ञ चाहिए होते हैं - यह बहुत मायने रखता है।

यदि आपके पास बहुत बड़ी मात्रा में अनलेबल्ड डेटा है, तो सेमी-सुपरवाइज़्ड लर्निंग आज़माएँ। एक अच्छे सुपरवाइज़्ड बेसलाइन से शुरू करें, अपने डेटा की संरचना के अनुकूल तकनीक चुनें, और मापें कि अनलेबल्ड डेटा वास्तव में मदद कर रहा है या नहीं। scikit-learn का LabelSpreading एक अच्छा पहला प्रयोग है, लेकिन FixMatch और MixMatch जैसी विधियों के साथ भी प्रयोग करें।

यदि आप 2026 में नौकरी-तैयार होना चाहते हैं, तो हमारा Machine Learning Engineer ट्रैक लें। इसमें बुनियादी सिद्धांतों से लेकर MLOps तक सब कुछ शामिल है।

FAQs

सेमी-सुपरवाइज़्ड लर्निंग क्या है?

सेमी-सुपरवाइज़्ड लर्निंग एक मशीन लर्निंग तरीका है जिसमें मॉडल को थोड़े से लेबल्ड डेटा और बड़े अनलेबल्ड डेटा सेट पर ट्रेन किया जाता है। लेबल्ड डेटा मॉडल को बताता है कि क्या खोजना है, जबकि अनलेबल्ड डेटा उसे डेटा की समग्र संरचना समझने में मदद करता है। इस तरह, आपको केवल लेबल्ड डेटा पर ट्रेनिंग करने की तुलना में बेहतर नतीजे मिलते हैं।

सेमी-सुपरवाइज़्ड लर्निंग सुपरवाइज़्ड और अनसुपरवाइज़्ड लर्निंग से कैसे अलग है?

सुपरवाइज़्ड लर्निंग केवल लेबल्ड डेटा का उपयोग करती है, जहाँ हर सैंपल का ज्ञात आउटपुट होता है। अनसुपरवाइज़्ड लर्निंग केवल अनलेबल्ड डेटा का उपयोग करती है और स्वयं पैटर्न ढूँढ़ती है। सेमी-सुपरवाइज़्ड लर्निंग टास्क परिभाषित करने के लिए छोटा लेबल्ड डेटासेट और डेटा की संरचना सीखने के लिए बड़ा अनलेबल्ड डेटासेट उपयोग करती है।

मुझे सेमी-सुपरवाइज़्ड लर्निंग कब उपयोग करनी चाहिए?

जब आपके पास थोड़ी मात्रा में लेबल्ड डेटा, बड़ी मात्रा में अनलेबल्ड डेटा हो, और आपके डेटा की स्पष्ट संरचना हो, जैसे प्राकृतिक क्लस्टर या क्लासों के बीच स्मूद सीमाएँ। यदि लेबलिंग महंगी है या डोमेन विशेषज्ञ चाहिए होते हैं — जैसे मेडिकल इमेजिंग या कानूनी टेक्स्ट विश्लेषण में — सेमी-सुपरवाइज़्ड लर्निंग आपको बिना सब कुछ लेबल किए सटीक मॉडल बनाने में मदद करती है।

सेमी-सुपरवाइज़्ड लर्निंग में सेल्फ-ट्रेनिंग क्या है?

सेल्फ-ट्रेनिंग एक तकनीक है जिसमें मॉडल पहले लेबल्ड डेटा पर ट्रेन करता है, फिर अनलेबल्ड सैंपलों के लिए लेबल का अनुमान लगाता है। जिन भविष्यवाणियों पर भरोसा सबसे अधिक होता है, उन्हें छद्म-लेबल के रूप में लेबल्ड सेट में जोड़ दिया जाता है, और मॉडल विस्तारित डेटासेट पर पुनः ट्रेन होता है। जोखिम यह है कि शुरुआती गलत भविष्यवाणियाँ बाद के राउंड्स में मज़बूत हो सकती हैं, इसलिए उच्च कॉन्फिडेंस थ्रेशोल्ड सेट करना चाहिए।