Courses

การติดป้ายกำกับข้อมูลมีค่าใช้จ่ายสูง ใช้เวลานาน ต้องอาศัยผู้เชี่ยวชาญเฉพาะด้าน และส่วนใหญ่ทีมงานมีไม่เพียงพอ

การฝึกโมเดลต้องใช้ข้อมูลที่มีป้ายกำกับเสมอ แต่การติดป้ายกำกับให้ถูกต้องต้องใช้เวลา และมักต้องใช้ผู้เชี่ยวชาญเฉพาะด้าน ตัวอย่างเช่น ภาพทางการแพทย์ต้องมีรังสีแพทย์ เอกสารทางกฎหมายต้องมีทนายความ แม้แต่งานง่าย ๆ อย่างการวิเคราะห์อารมณ์ก็ต้องมีคนมานั่งติดแท็กตัวอย่างทีละรายการ ผลลัพธ์คือ ทีม ML ส่วนใหญ่ลงเอยด้วยชุดข้อมูลที่มีป้ายกำกับขนาดเล็กมาก และข้อมูลจำนวนมหาศาลที่ไม่มีป้ายกำกับซึ่งใช้ประโยชน์ไม่ได้

Semi-supervised learning แก้ปัญหานี้โดยการฝึกบนทั้งสองแบบ มันนำชุดข้อมูลที่มีป้ายกำกับขนาดเล็กของคุณมาผสมกับชุดข้อมูลที่ไม่มีป้ายกำกับขนาดใหญ่ และปล่อยให้โมเดลเรียนรู้รูปแบบต่าง ๆ

ในบทความนี้ ฉจะแจกแจงว่า semi-supervised learning ทำงานอย่างไร ครอบคลุมเทคนิคที่พบบ่อยที่สุด และอธิบายว่าเมื่อใดที่เหมาะสมจะใช้

แต่จริง ๆ แล้ว การเรียนรู้แบบมีผู้สอน (Supervised Machine Learning) คืออะไร? อ่านบล็อกของเราเพื่อเรียนรู้ว่าอัลกอริทึมแบบมีผู้สอนที่สำคัญทำงานอย่างไร

Semi-Supervised Learning คืออะไร?

Semi-supervised learning คือแนวทางการเรียนรู้ของเครื่องที่ฝึกโมเดลด้วยข้อมูลผสมระหว่างที่มีป้ายกำกับและไม่มีป้ายกำกับ

ตามชื่อ มันอยู่กึ่งกลางระหว่างการเรียนรู้แบบมีผู้สอนและไม่มีผู้สอน การเรียนรู้แบบมีผู้สอนต้องมีป้ายกำกับในทุกตัวอย่าง การเรียนรู้แบบไม่มีผู้สอนไม่มีป้ายกำกับเลย Semi-supervised learning ใช้ชุดตัวอย่างที่มีป้ายกำกับจำนวนเล็กควบคู่กับชุดตัวอย่างที่ไม่มีป้ายกำกับจำนวนมากกว่า

ข้อมูลที่มีป้ายกำกับบอกโมเดลว่าควรมองหาอะไร ข้อมูลที่ไม่มีป้ายกำกับแสดงโครงสร้างของข้อมูลให้โมเดลเห็น เมื่อผสานกัน จะให้ข้อมูลแก่โมเดลมากกว่าการใช้แบบใดแบบหนึ่งเพียงอย่างเดียว

Semi-Supervised Learning ทำงานอย่างไร

กระบวนการเริ่มจากชุดข้อมูลที่มีป้ายกำกับขนาดเล็ก — อาจเป็นไม่กี่ร้อยตัวอย่างที่รู้ผลลัพธ์ที่ถูกต้อง

จากนั้นนำเข้าชุดข้อมูลที่ไม่มีป้ายกำกับขนาดใหญ่กว่ามาก อาจมีตั้งแต่หลักพันจนถึงหลักล้านตัวอย่างที่ไม่มีป้ายกำกับ โมเดลใช้ข้อมูลที่ไม่มีป้ายกำกับนี้เพื่อเรียนรู้รูปแบบและความสัมพันธ์พื้นฐานระหว่างจุดข้อมูล

ตัวอย่างที่มีป้ายกำกับจะคอยชี้นำโครงสร้างนั้นไปสู่คำตอบที่ถูกต้อง โมเดลรู้แล้วว่าข้อมูลจัดระเบียบอย่างไรจากตัวอย่างที่ไม่มีป้ายกำกับ ป้ายกำกับจะบอกว่าบริเวณใดของโครงสร้างนั้นสอดคล้องกับผลลัพธ์ใด

มาดูตัวอย่างสั้น ๆ

สมมติว่ากำลังจัดประเภทอีเมลว่าเป็นสแปมหรือไม่เป็นสแปม คุณมีอีเมลที่มีป้ายกำกับ 100 ฉบับ และไม่มีป้ายกำกับ 10,000 ฉบับ โมเดลจะเรียนรู้ก่อนว่าอีเมลมีการจัดกลุ่มกันอย่างไรจากรูปแบบคำและโครงสร้าง จากนั้นใช้ตัวอย่างที่มีป้ายกำกับ 100 ฉบับเพื่อระบุว่ากลุ่มใดคือสแปมและกลุ่มใดไม่ใช่ ผลลัพธ์คือโมเดลที่ทำงานได้ดีกว่าการฝึกด้วยอีเมลที่มีป้ายกำกับเพียง 100 ฉบับนั้นอย่างเดียว

เปรียบเทียบ Semi-Supervised vs Supervised vs Unsupervised Learning

มาดูแต่ละแนวทางการเรียนรู้เพื่อดูว่า semi-supervised learning อยู่ตรงไหนเมื่อเทียบกับอีกสองแบบ

Supervised learning

Supervised learning ฝึกด้วยข้อมูลที่มีป้ายกำกับครบถ้วน ทุกตัวอย่างในชุดข้อมูลมีอินพุตและเอาต์พุตที่ทราบ โมเดลเรียนรู้การแมปปิ้งระหว่างทั้งสอง

วิธีนี้ได้ผลดีเมื่อมีตัวอย่างที่มีป้ายกำกับเพียงพอ แต่คำว่า "เพียงพอ" อาจหมายถึงหลายพันหรือแม้แต่หลายล้านตัวอย่าง ขึ้นอยู่กับงาน ซึ่งมีค่าใช้จ่ายสูงในการสร้าง และบางครั้งก็ทำไม่ได้จริง

Unsupervised learning

Unsupervised learning ไม่ใช้ป้ายกำกับเลย โมเดลดูข้อมูลดิบและค้นหาโครงสร้างด้วยตนเอง ตัวอย่างคลาสสิกคือการจัดกลุ่ม (clustering) และการลดมิติ (dimensionality reduction)

ข้อดีคือไม่ต้องใช้ข้อมูลที่มีป้ายกำกับ ข้อเสียคือโมเดลไม่รู้ว่าคุณสนใจอะไรจริง ๆ มันหาพบรูปแบบก็จริง แต่รูปแบบเหล่านั้นอาจไม่สอดคล้องกับปัญหาที่พยายามจะแก้

Semi-supervised learning

Semi-supervised learning ผสานข้อดีของทั้งสองแบบ คุณให้โมเดลมีชุดข้อมูลที่มีป้ายกำกับขนาดเล็กเพื่อกำหนดงาน และชุดข้อมูลที่ไม่มีป้ายกำกับขนาดใหญ่เพื่อเรียนรู้โครงสร้างของข้อมูล

ข้อมูลที่มีป้ายกำกับชี้นำโมเดลไปในทิศทางที่ถูกต้อง ข้อมูลที่ไม่มีป้ายกำกับแสดงให้โมเดลเห็นว่าตัวอย่างต่าง ๆ เกี่ยวข้องกันอย่างไร การผสมผสานนี้มักทำผลงานดีกว่าการเรียนรู้แบบมีผู้สอนเมื่อใช้ชุดป้ายกำกับเล็ก ๆ เท่ากัน เพราะโมเดลตรวจจับรูปแบบที่คงพลาดไปถ้าไม่มีข้อมูลที่ไม่มีป้ายกำกับ

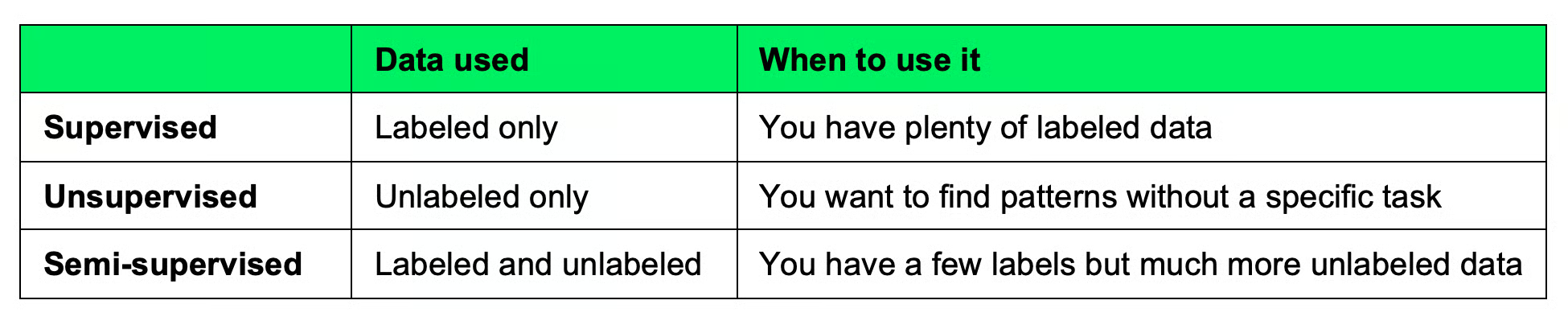

นี่คือการเปรียบเทียบอย่างรวดเร็วระหว่างทั้งสามแบบ:

ตารางเปรียบเทียบแนวทางการเรียนรู้ของเครื่อง

สรุปคือ หากการติดป้ายกำกับใช้เวลามากเกินไป และมีข้อมูลที่ไม่มีป้ายกำกับจำนวนมาก ก็ควรพิจารณา semi-supervised ต่อไปจะขอแสดงเทคนิคที่พบบ่อย

เทคนิค Semi-Supervised Learning ที่พบบ่อย

มีหลายวิธีในการทำ semi-supervised learning แต่ละเทคนิคจัดการการแบ่งระหว่างข้อมูลที่มีป้ายกำกับและไม่มีป้ายกำกับต่างกัน ไปดูวิธีที่พบบ่อยที่สุดกัน

Self-training

นี่คือแนวทางที่ง่ายที่สุด ฝึกโมเดลด้วยข้อมูลที่มีป้ายกำกับก่อน จากนั้นใช้โมเดลทำนายป้ายกำกับให้ตัวอย่างที่ไม่มีป้ายกำกับ การทำนายที่มั่นใจที่สุดจะถูกเพิ่มเข้าไปในชุดที่มีป้ายกำกับในฐานะป้ายกำกับเทียม (pseudo-labels) และฝึกโมเดลใหม่บนชุดข้อมูลที่ขยายแล้ว

ทำซ้ำขั้นตอนนี้จนกว่าโมเดลจะหยุดพัฒนา หรือไม่มีข้อมูลที่ไม่มีป้ายกำกับเหลือให้ใช้ วิธีนี้ทำได้ง่าย แต่ถ้าโมเดลทำนายผิดตั้งแต่แรก ความผิดพลาดนั้นจะกลายเป็นส่วนหนึ่งของชุดข้อมูล

Co-training

Co-training ใช้สองโมเดลแทนที่จะเป็นหนึ่ง แต่ละโมเดลฝึกบน "มุมมอง" ของข้อมูลที่ต่างกัน นึกภาพว่าเป็นชุดคุณลักษณะคนละส่วน

ตัวอย่างเช่น ในการจัดประเภทหน้าเว็บ โมเดลหนึ่งอาจดูข้อความบนหน้า ขณะที่อีกโมเดลดูข้อความลิงก์ที่ชี้มายังหน้านั้น แต่ละโมเดลจะติดป้ายกำกับตัวอย่างที่ไม่มีป้ายกำกับให้แก่อีกฝ่าย และสอนกันไปมาหลายรอบ

แนวคิดคือจุดแข็งของโมเดลหนึ่งจะกลบจุดอ่อนของอีกโมเดล หากแต่ละมุมมองมีข้อมูลเพียงพอในตัว Co-training อาจทำผลงานดีกว่า self-training เพราะความผิดพลาดของโมเดลหนึ่งจะถูกอีกโมเดลแก้ไข

Label propagation

วิธีนี้สร้างกราฟที่จุดข้อมูลแต่ละจุดเป็นโหนด และมีเส้นเชื่อมโยงโหนดที่คล้ายกัน ป้ายกำกับจะ "แพร่กระจาย" จากโหนดที่มีป้ายกำกับไปยังเพื่อนบ้าน

สมมติฐานคือจุดข้อมูลที่คล้ายกันควรมีป้ายกำกับเดียวกัน หากตัวอย่างที่มีป้ายกำกับอยู่ใกล้คลัสเตอร์ของตัวอย่างที่ไม่มีป้ายกำกับ ตัวอย่างเหล่านั้นมีแนวโน้มจะอยู่ในคลาสเดียวกัน ป้ายกำกับจะกระจายไปทั่วกราฟจนทุกโหนดมีป้ายกำกับ

วิธีนี้เหมาะเมื่อข้อมูลมีโครงสร้างการจัดคลัสเตอร์ที่ชัดเจน แต่จะล้มเหลวเมื่อเส้นแบ่งระหว่างคลาสพร่ามัว

โครงข่ายประสาทเทียมแบบกึ่งมีผู้สอน

ดีปเลิร์นนิงมีเทคนิค semi-supervised ของตนเอง นี่คือสองแนวทางที่พบบ่อย:

- Consistency regularization: กระตุ้นให้โมเดลให้ผลลัพธ์เหมือนเดิมกับอินพุตเดียวกัน แม้มีการรบกวนเล็กน้อย เช่น การใส่สัญญาณรบกวนหรือการทำ augmentation แนวคิดคือโมเดลที่ดีไม่ควรเปลี่ยนคำทำนายเพียงเพราะอินพุตถูกปรับเล็กน้อย

- Pseudo-labeling ในโครงข่ายประสาทเทียม: ทำงานคล้าย self-training แต่ในระดับแบตช์ โมเดลสร้างป้ายกำกับให้ตัวอย่างที่ไม่มีป้ายกำกับระหว่างการฝึก และใช้ร่วมกับป้ายกำกับจริงในฟังก์ชัน loss

วิธีอย่าง FixMatch และ MixMatch ผสานแนวคิดเหล่านี้ และแสดงผลลัพธ์ที่ดีบนชุดทดสอบที่มีตัวอย่างติดป้ายกำกับน้อยมาก

เหตุผลที่ Semi-Supervised Learning สำคัญ

เหตุผลหลักที่ควรใส่ใจ semi-supervised learning คือเรื่องต้นทุน

การติดป้ายกำกับข้อมูลต้องใช้ข้อมูล ผู้เชี่ยวชาญเฉพาะด้าน เวลา และเงิน Semi-supervised learning ลดต้นทุนด้วยการรีดประโยชน์จากป้ายกำกับที่มีอยู่น้อยให้มากที่สุด

ต่อมาคือเรื่องประสิทธิภาพ โมเดลที่ฝึกด้วยตัวอย่างที่มีป้ายกำกับ 500 รายการ และไม่มีป้ายกำกับ 50,000 รายการ มักทำงานดีกว่าโมเดลเดียวกันที่ฝึกด้วยป้ายกำกับ 500 รายการเท่านั้น ข้อมูลที่ไม่มีป้ายกำกับช่วยให้โมเดลเห็นภาพการกระจายตัวของข้อมูลครบถ้วนขึ้น จึงทำนายได้ดีขึ้น

และยังสอดคล้องกับความเป็นจริงของชุดข้อมูลส่วนใหญ่ ข้อมูลที่ไม่มีป้ายกำกับมีอยู่ทั่วไป ทุกบริษัทมีล็อก รูปภาพ เอกสาร และบันทึกเสียงจำนวนมากที่ไม่มีเวลาติดป้ายกำกับ Semi-supervised learning ช่วยให้สร้างสิ่งที่มีประโยชน์จากข้อมูลเหล่านั้นได้

การประยุกต์ใช้ Semi-Supervised Learning

Semi-supervised learning ปรากฏในโดเมนที่หาป้ายกำกับได้ยาก

การจัดประเภทภาพ เป็นกรณีใช้งานที่พบบ่อยที่สุด การติดป้ายกำกับรูปภาพนับพันเป็นงานน่าเบื่อ แต่การรวบรวมรูปภาพที่ไม่มีป้ายกำกับทำได้ง่าย วิธีแบบกึ่งมีผู้สอนช่วยให้ฝึกตัวจำแนกที่แม่นยำด้วยรูปภาพที่มีป้ายกำกับเพียงไม่กี่ร้อยภาพ

การจัดประเภทข้อความ ก็เช่นกัน อาจมีรีวิวลูกค้าหรือทิกเก็ตซัพพอร์ตนับล้าน แต่มีเพียงชุดเล็ก ๆ ที่ติดป้ายกำกับด้วยมือ Semi-supervised learning ช่วยสร้างตัวจำแนกที่ครอบคลุมทั้งชุดข้อมูลได้

การรู้จำเสียงพูด เป็นอีกพื้นที่หนึ่ง การถอดเสียงด้วยมือใช้ความพยายามมาก แต่ข้อมูลเสียงดิบมีมากมาย บันทึกเสียงที่ไม่มีป้ายกำกับช่วยให้โมเดลเรียนรู้รูปแบบเสียง ส่วนตัวอย่างที่ถอดเสียงสอนการแมประหว่างเสียงกับสัญลักษณ์ที่ถูกต้อง

การวิเคราะห์ข้อมูลทางการแพทย์ เป็นงานเฉพาะโดเมนที่ยอดเยี่ยม การให้แพทย์ติดป้ายกำกับสแกนหรือเวชระเบียนมีค่าใช้จ่ายสูงและช้า เพราะมีงานสำคัญกว่าให้ทำ แต่โรงพยาบาลมีข้อมูลคลินิกที่ไม่มีป้ายกำกับจำนวนมหาศาล วิธีแบบกึ่งมีผู้สอนช่วยสร้างโมเดลวินิจฉัยโดยไม่ต้องใช้ชุดข้อมูลที่ติดป้ายกำกับครบถ้วน

ข้อดีของ Semi-Supervised Learning

เหตุผลที่ทำให้ semi-supervised learning เหมาะกับหลายโปรเจ็กต์มีดังนี้:

- ต้องใช้ข้อมูลที่มีป้ายกำกับน้อยลง: ได้ผลลัพธ์ที่ดีด้วยป้ายกำกับเพียงเศษส่วนของที่วิธีมีผู้สอนเต็มรูปแบบต้องการ

- ช่วยให้ทั่วไปได้ดีขึ้น (improve generalization): ข้อมูลที่ไม่มีป้ายกำกับทำให้โมเดลได้เห็นตัวอย่างที่หลากหลายขึ้น จึงทำงานได้ดีขึ้นกับข้อมูลที่ไม่เคยเห็น

- คุ้มค่าใช้จ่าย: เมื่อการติดป้ายกำกับมีค่าใช้จ่ายหรือกินเวลา — ซึ่งมักจะเป็นเช่นนั้น — semi-supervised learning ช่วยประหยัดเวลาและงบประมาณโดยใช้สิ่งที่มีอยู่ให้เกิดประโยชน์สูงสุด

ดังนั้น หากมีข้อมูลมากกว่าป้ายกำกับ ก็ถึงเวลาพิจารณา semi-supervised learning

ข้อจำกัดของ Semi-Supervised Learning

Semi-supervised learning มีข้อแลกเปลี่ยนบางอย่างที่ควรรู้

- คุณภาพของข้อมูลที่ไม่มีป้ายกำกับมีความสำคัญ: หากข้อมูลที่ไม่มีป้ายกำกับไม่ได้มาจากการแจกแจงเดียวกับข้อมูลที่มีป้ายกำกับ โมเดลจะเรียนรู้รูปแบบที่ผิด

- ป้ายกำกับเทียมที่ผิดพลาด: ในวิธีอย่าง self-training การทำนายที่มั่นใจแต่ผิดพลาดจะถูกปฏิบัติเสมือนความจริง โมเดลฝึกบนป้ายกำกับที่ไม่ดีนั้น ทำให้ข้อผิดพลาดยิ่งตอกย้ำและทำให้การทำนายในอนาคตแย่ลง

- ซับซ้อนกว่าการเรียนรู้แบบมีผู้สอน: มีไฮเปอร์พารามิเตอร์ให้จูนมากขึ้น ต้องตัดสินใจด้านการออกแบบมากขึ้น และมีสิ่งที่อาจผิดพลาดได้มากขึ้น โมเดลแบบมีผู้สอนสร้างและอธิบายได้ง่ายกว่า วิธีแบบกึ่งมีผู้สอนเพิ่มความซับซ้อนที่อาจไม่คุ้มค่า — โดยเฉพาะหากชุดข้อมูลที่มีป้ายกำกับของคุณใหญ่พออยู่แล้ว

ข้อเหล่านี้ไม่ใช่ตัวตัดสิน แต่เป็นสิ่งที่ควรรู้ก่อนลงมือทำ

Semi-Supervised Learning ในทางปฏิบัติ (ตัวอย่าง Python)

มาดู semi-supervised learning แบบลงมือทำด้วยตัวอย่าง Python ง่าย ๆ โดยใช้ LabelSpreading ของ scikit-learn

ฉันจะสร้างชุดข้อมูล ติดป้ายกำกับเพียงบางส่วน และให้โมเดลจัดการส่วนที่เหลือ

ตั้งค่าข้อมูล

ขั้นแรก สร้างชุดข้อมูลและปิดบังป้ายกำกับส่วนใหญ่เพื่อจำลองสถานการณ์แบบกึ่งมีผู้สอน:

import numpy as np

from sklearn.datasets import make_moons

from sklearn.semi_supervised import LabelSpreading

from sklearn.metrics import accuracy_score

# Generate a dataset with 500 samples

X, y_true = make_moons(n_samples=500, noise=0.2, random_state=42)

# Keep only 10%, mask the rest as -1

rng = np.random.RandomState(42)

labeled_idx = rng.choice(500, size=50, replace=False)

y_train = np.full(500, -1) # -1 means unlabeled in scikit-learn

y_train[labeled_idx] = y_true[labeled_idx]

print(f"Labeled samples: {np.sum(y_train != -1)}")

print(f"Unlabeled samples: {np.sum(y_train == -1)}")

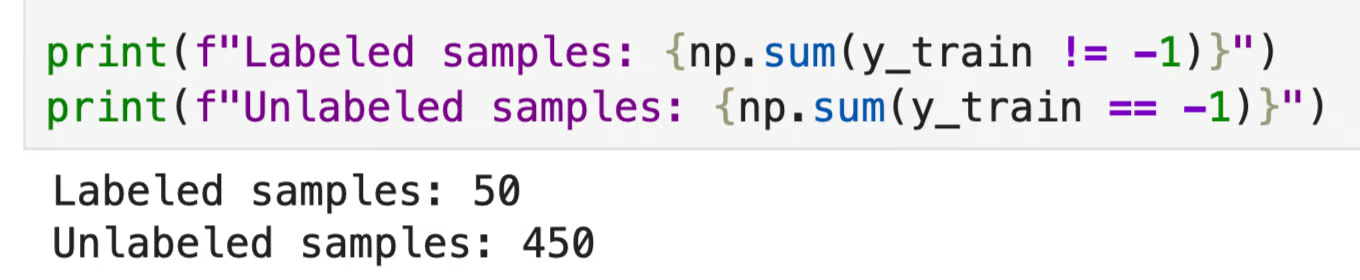

จำนวนตัวอย่างข้อมูลที่มีและไม่มีป้ายกำกับ

ใน scikit-learn ค่า -1 หมายถึงตัวอย่างที่ไม่มีป้ายกำกับ จาก 500 ตัวอย่าง มีเพียง 50 ตัวอย่างที่มีป้ายกำกับ โมเดลต้องจัดการอีก 450 ตัวอย่างที่เหลือ

การฝึกและการทำนาย

ต่อไปจะฝึกโมเดล LabelSpreading และดูว่ามันติดป้ายกำกับข้อมูลที่ไม่มีป้ายกำกับได้ดีเพียงใด:

model = LabelSpreading(kernel="knn", n_neighbors=7)

model.fit(X, y_train)

y_pred = model.transduction_

# Check accuracy on the originally unlabeled samples

unlabeled_mask = y_train == -1

accuracy = accuracy_score(y_true[unlabeled_mask], y_pred[unlabeled_mask])

print(f"Accuracy on unlabeled samples: {accuracy:.2%}")

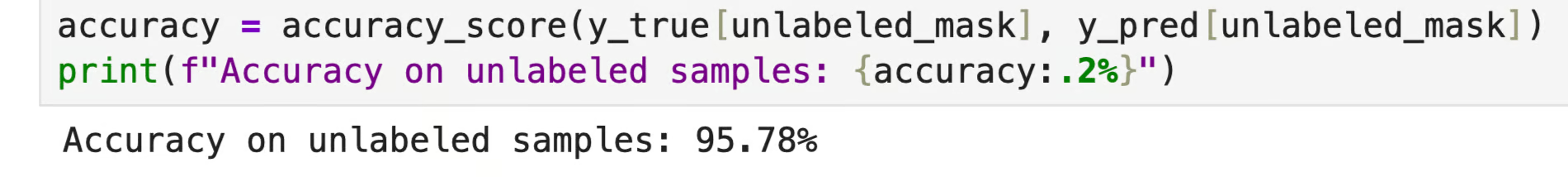

ความแม่นยำบนตัวอย่างที่ไม่มีป้ายกำกับ

โมเดลติดป้ายกำกับตัวอย่างที่ไม่มีป้ายกำกับได้ถูกต้องส่วนใหญ่ โดยใช้ข้อมูลที่มีป้ายกำกับเพียง 10% นี่แหละแนวคิดหลัก

การแสดงผลลัพธ์เชิงภาพ

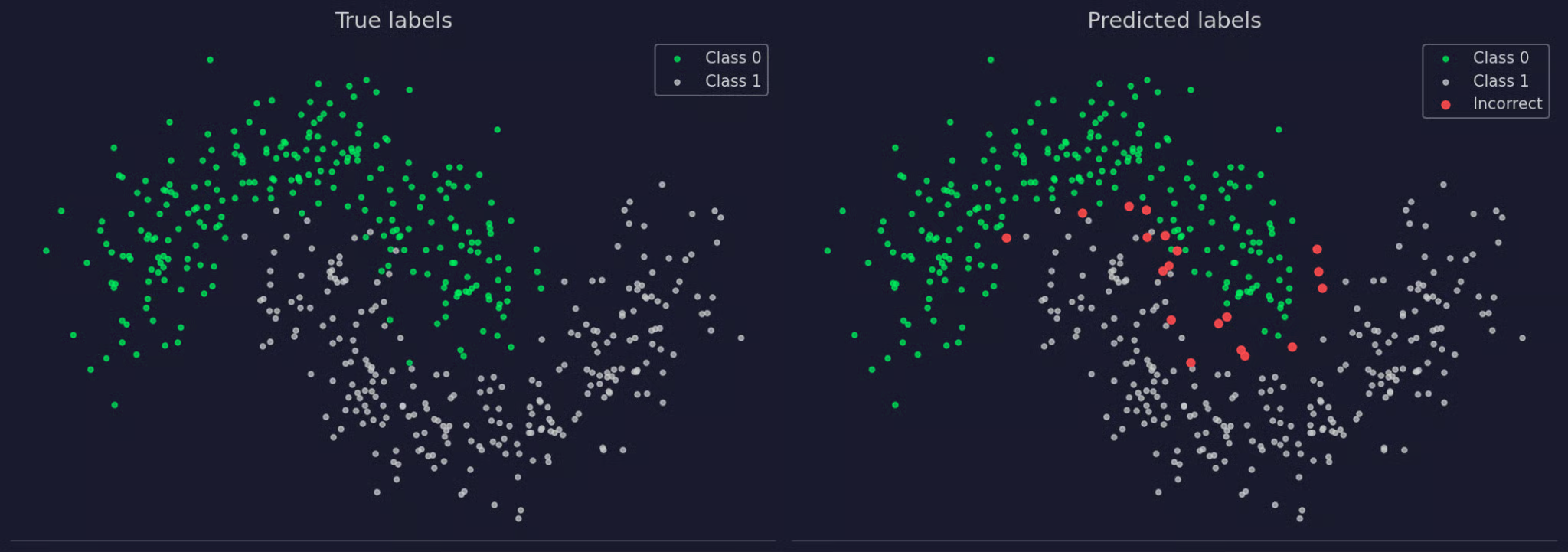

ความแม่นยำสูง — เกือบ 96% — แต่ลองตรวจสอบด้วยภาพว่าตัวอย่างใดถูกจัดผิดพลาด:

ป้ายกำกับจริงและที่ทำนาย

ป้ายกำกับที่ทำนายสอดคล้องกับป้ายกำกับจริงแทบสมบูรณ์ แม้โมเดลจะเห็นตัวอย่างที่มีป้ายกำกับเพียง 50 จาก 500 ตัวอย่าง คุณจะเห็นตัวอย่างที่จัดผิดเป็นสีแดงในกราฟด้านขวา

ข้อผิดพลาดที่พบบ่อยกับ Semi-Supervised Learning

แม้จะเห็นพลังของ semi-supervised learning แล้ว แต่มันก็ไม่เหมาะกับทุกสถานการณ์ นี่คือข้อผิดพลาดที่พบบ่อยและวิธีหลีกเลี่ยง

- คิดว่าข้อมูลที่ไม่มีป้ายกำกับช่วยเสมอ: ไม่เสมอไป หากข้อมูลที่ไม่มีป้ายกำกับมาจากการแจกแจงที่ต่างจากข้อมูลที่มีป้ายกำกับ โมเดลจะเรียนรู้รูปแบบที่ไม่เกี่ยวกับงานจริง ควรตรวจสอบเสมอว่าแหล่งที่มาของข้อมูลทั้งสองชุดเหมือนกันและแทนปัญหาเดียวกัน

- การตั้งต้นโมเดลที่ไม่ดี: วิธีแบบกึ่งมีผู้สอนต่อยอดจากโมเดลแบบมีผู้สอนเริ่มต้น หากโมเดลแรกอ่อนแอ — ฝึกจากตัวอย่างน้อยเกินไปหรือไฮเปอร์พารามิเตอร์ไม่ดี — ขั้นตอนถัดไปทั้งหมดจะรับช่วงปัญหาเหล่านั้นไป เริ่มจากเบสไลน์แบบมีผู้สอนที่ดีที่สุดก่อน แล้วค่อยเพิ่มข้อมูลที่ไม่มีป้ายกำกับ

- พึ่งพาป้ายกำกับเทียมมากเกินไป: ป้ายกำกับเทียมดีได้เท่าโมเดลที่สร้างมันขึ้นมาเท่านั้น หากเชื่อทุกป้ายกำกับเทียม ข้อผิดพลาดอาจสะสมตลอดรอบการฝึก กำหนดเกณฑ์ความมั่นใจให้สูงและใช้เฉพาะป้ายกำกับเทียมที่โมเดลมั่นใจ ทิ้งที่เหลือไป

- เพิกเฉยต่อการกระจายตัวของข้อมูล: วิธีแบบกึ่งมีผู้สันนิษฐานว่าโครงสร้างของข้อมูลที่ไม่มีป้ายกำกับบอกอะไรบางอย่างเกี่ยวกับป้ายกำกับ หากข้อมูลของคุณไม่มีคลัสเตอร์ชัดเจนหรือเส้นแบ่งการตัดสินใจที่ราบเรียบ สมมติฐานนั้นจะใช้ไม่ได้

เพื่อหลีกเลี่ยงสี่ข้อผิดพลาดนี้ เริ่มจากเบสไลน์แบบมีผู้สอนที่แข็งแรง เพิ่มข้อมูลที่ไม่มีป้ายกำกับอย่างค่อยเป็นค่อยไป และตรวจสอบว่าประสิทธิภาพดีขึ้นจริงในแต่ละขั้น

ควรใช้ Semi-Supervised Learning เมื่อใด

Semi-supervised learning เหมาะในสามสถานการณ์นี้:

- เมื่อข้อมูลที่มีป้ายกำกับมีจำกัด: หากมีชุดข้อมูลที่มีป้ายกำกับขนาดเล็ก และการหาป้ายกำกับเพิ่มมีค่าใช้จ่ายหรือช้า Semi-supervised learning ช่วยรีดความแม่นยำเพิ่มได้

- เมื่อข้อมูลที่ไม่มีป้ายกำกับมีมาก: ต้องมีข้อมูลที่ไม่มีป้ายกำกับจำนวนมากจึงจะได้ผล หากมีน้อย โมเดลจะไม่ได้เรียนรู้โครงสร้างพอให้เกิดความแตกต่าง ยิ่งขนาดชุดที่ไม่มีป้ายกำกับใหญ่กว่าชุดที่มีป้ายกำกับมากเท่าไร วิธีแบบกึ่งมีผู้สอนยิ่งช่วยได้มากเท่านั้น

- เมื่อข้อมูลมีโครงสร้างชัดเจน: Semi-supervised learning ได้ผลดีที่สุดเมื่อจุดข้อมูลที่คล้ายกันมีป้ายกำกับเดียวกัน หากข้อมูลเกิดคลัสเตอร์หรือมีเส้นแบ่งระหว่างคลาสที่ราบเรียบ ข้อมูลที่ไม่มีป้ายกำกับจะยิ่งทำให้รูปแบบเหล่านั้นเด่นชัดขึ้น หากคลาสปะปนกันโดยไม่มีเส้นแบ่งชัดเจน ข้อมูลที่ไม่มีป้ายกำกับก็ไม่ช่วยมากนัก

ถ้าทั้งสามเงื่อนไขนี้เป็นจริง Semi-supervised learning ก็คุ้มที่จะลอง

สรุป

พูดง่าย ๆ คือ semi-supervised learning เปิดทางให้ฝึกโมเดลที่ดีกว่าได้โดยไม่ต้องติดป้ายกำกับทุกอย่าง นำชุดข้อมูลที่มีป้ายกำกับขนาดเล็กมาผสานกับชุดที่ไม่มีป้ายกำกับขนาดใหญ่ แล้วให้โมเดลเรียนรู้จากทั้งสอง

ประโยชน์ชัดเจน: ใช้เวลาติดป้ายกำกับน้อยลง ออกสู่ตลาดได้เร็วขึ้น ต้นทุนต่ำลง และประสิทธิภาพดีกว่าการฝึกด้วยป้ายกำกับจำกัดเพียงอย่างเดียว และในสาขาอย่างการแพทย์ กฎหมาย และ NLP — ที่การติดป้ายกำกับต้องใช้ผู้เชี่ยวชาญเฉพาะด้าน — นี่ถือว่าสำคัญมาก

หากมีข้อมูลที่ไม่มีป้ายกำกับจำนวนมาก ลองใช้ semi-supervised learning เริ่มจากเบสไลน์แบบมีผู้สอนที่ดี เลือกเทคนิคที่เหมาะกับโครงสร้างข้อมูลของคุณ และวัดว่าข้อมูลที่ไม่มีป้ายกำกับช่วยจริงหรือไม่ LabelSpreading ของ scikit-learn เป็นจุดเริ่มทดลองที่ดี และลองต่อด้วยวิธีอย่าง FixMatch และ MixMatch

หากต้องการพร้อมทำงานในปี 2026 ลองเรียน เส้นทาง Machine Learning Engineerของเรา ครอบคลุมตั้งแต่พื้นฐานถึง MLOps

FAQs

Semi-supervised learning คืออะไร?

Semi-supervised learning คือแนวทางการเรียนรู้ของเครื่องที่ฝึกโมเดลด้วยชุดข้อมูลขนาดเล็กที่มีป้ายกำกับและชุดข้อมูลขนาดใหญ่ที่ไม่มีป้ายกำกับ ข้อมูลที่มีป้ายกำกับบอกโมเดลว่าควรมองหาอะไร ขณะที่ข้อมูลที่ไม่มีป้ายกำกับช่วยให้เข้าใจโครงสร้างโดยรวมของข้อมูล วิธีนี้ช่วยให้ได้ผลลัพธ์ดีกว่าการฝึกด้วยข้อมูลที่มีป้ายกำกับเพียงอย่างเดียว

Semi-supervised learning แตกต่างจากแบบมีผู้สอนและไม่มีผู้สอนอย่างไร?

การเรียนรู้แบบมีผู้สอนใช้เฉพาะข้อมูลที่มีป้ายกำกับ ซึ่งทุกตัวอย่างมีเอาต์พุตที่ทราบ การเรียนรู้แบบไม่มีผู้สอนใช้เฉพาะข้อมูลที่ไม่มีป้ายกำกับและค้นหารูปแบบด้วยตนเอง Semi-supervised learning ใช้ชุดข้อมูลที่มีป้ายกำกับขนาดเล็กเพื่อกำหนดงาน และใช้ชุดข้อมูลที่ไม่มีป้ายกำกับขนาดใหญ่เพื่อเรียนรู้โครงสร้างของข้อมูล

ควรใช้ semi-supervised learning เมื่อใด?

ใช้เมื่อมีข้อมูลที่มีป้ายกำกับน้อย ข้อมูลที่ไม่มีป้ายกำกับมาก และข้อมูลของคุณมีโครงสร้างชัดเจน เช่น มีคลัสเตอร์ตามธรรมชาติหรือเส้นแบ่งระหว่างคลาสที่ราบเรียบ หากการติดป้ายกำกับมีค่าใช้จ่ายสูงหรือจำเป็นต้องใช้ผู้เชี่ยวชาญเฉพาะด้าน — เช่น การถ่ายภาพทางการแพทย์หรือการวิเคราะห์ข้อความทางกฎหมาย — semi-supervised learning ช่วยสร้างโมเดลที่แม่นยำโดยไม่ต้องติดป้ายกำกับทั้งหมด

Self-training ใน semi-supervised learning คืออะไร?

Self-training คือเทคนิคที่โมเดลฝึกกับข้อมูลที่มีป้ายกำกับก่อน จากนั้นทำนายป้ายกำกับให้ตัวอย่างที่ไม่มีป้ายกำกับ การทำนายที่มั่นใจที่สุดจะถูกเพิ่มเข้าไปในชุดที่มีป้ายกำกับเป็นป้ายกำกับเทียม และโมเดลจะฝึกใหม่กับชุดข้อมูลที่ขยายแล้ว ความเสี่ยงคือการทำนายที่ผิดในช่วงแรกอาจถูกตอกย้ำในรอบถัดไป จึงควรกำหนดเกณฑ์ความมั่นใจให้สูง