course

Laplacian dyker upp i grafbaserade algoritmer, bildbehandlingsflöden och spektral klustring. Så om du bygger modeller som arbetar med grafer, bilder eller högdimensionella data är Laplacian inte valfri bakgrundsmatte. Det är det som faktiskt gör jobbet under huven.

I den här artikeln går jag igenom Laplacian från grunden: matematiken bakom, den geometriska intuitionen, graf-Laplacian och dess matrisform, och hur den används i verkliga maskininlärningsapplikationer.

Behöver du en praktisk introduktion till differentialekvationer? Läs vår senaste artikel för att gå från grunder till praktiska maskininlärningstillämpningar.

Vad är Laplacian?

Laplacian är en differentialoperator av andra ordningen. Den talar om hur en funktion kröker sig i en given punkt.

Du ser den ibland beskriven som divergensen av gradienten.

Och det är nyckeln till att förstå vad operatorn faktiskt gör:

- Gradienten visar i vilken riktning en funktion ökar snabbast

- Divergensen mäter om det flödet sprider ut sig eller dras ihop.

Tillsammans talar Laplacian om ifall en punkt är en lokal topp, en lokal dal eller någonstans platt däremellan.

Enkelt uttryckt mäter Laplacian hur mycket en funktions värde i en punkt skiljer sig från medelvärdet av dess grannar. Om Laplacian är noll är funktionen lokalt ”balanserad”. Positivt betyder att punkten ligger under sin omgivning. Negativt betyder att den ligger över.

Formeln

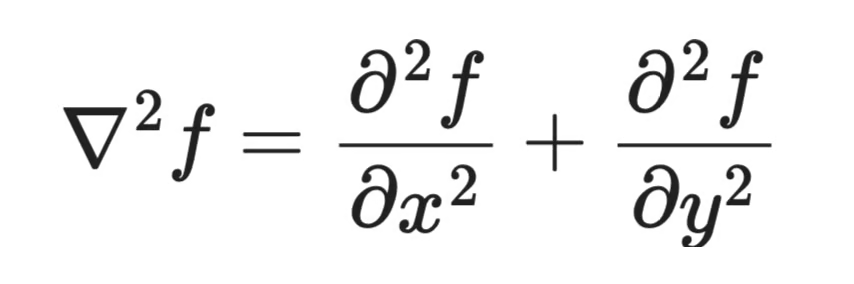

I 2D, för en funktion f(x, y):

2D-formel för Laplacian

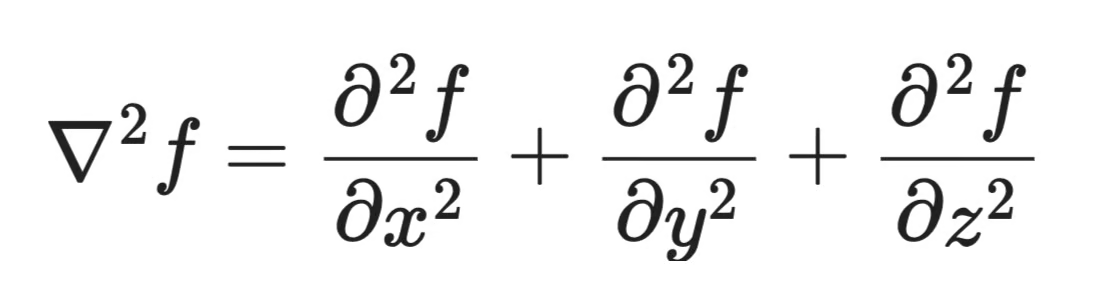

I 3D, för en funktion f(x, y, z):

3D-formel för Laplacian

Mönstret gäller i valfritt antal dimensioner – du summerar de andra ordningens partiella derivator längs varje axel. Det gör Laplacian mycket väl lämpad för högdimensionella data, vilket är precis varför den dyker upp så ofta i maskininlärning.

Laplacian-formeln i flervariabelanalys

Formeln för Laplacian är kortare än du kanske förväntar dig för något som förekommer i så mycket av maskininlärningen.

I 3D, för en funktion f(x, y, z), ser den ut så här:

3D-formel för Laplacian

Det är allt. Du summerar de andra ordningens partiella derivatorna längs varje dimension.

Varje term ställer samma fråga längs sin axel: kröker funktionen uppåt, nedåt eller är den platt? När du lägger ihop svaren får du ett enda tal som beskriver den övergripande krökningsgraden i punkten.

Från 3D till n dimensioner

Formeln generaliseras till n dimensioner. Det här är den generiska formeln för en funktion med n inparametrar:

Generaliserad Laplacian-formel

Det är därför Laplacian fungerar bra i maskininlärning, där dina data ofta lever i hundratals eller tusentals dimensioner. Operatorn summerar helt enkelt krökningen längs varje dimension.

Koppling till optimering

Om du har arbetat med gradienstegning tänker du redan på första derivator – vilken riktning är nedför? Laplacian tar dig ett steg till.

Andra derivator berättar om backens form.

En stor positiv Laplacian i en punkt betyder att funktionen kröker kraftigt uppåt i alla riktningar – du är nära ett minimum. Ett stort negativt värde betyder att du är nära ett maximum. Nära noll betyder att ytan är lokalt platt.

Denna krökningsinformation är viktig i metoder av andra ordningen, som använder den för att ta smartare steg än ren gradienstegning. Laplacian är ett sätt att sammanfatta den krökningen i ett enda skalärt värde.

Geometrisk intuition: vad Laplacian mäter

Tecknet på Laplacian i en punkt berättar om funktionens form runt punkten.

-

Om

∇²f > 0i en punkt kröker funktionen uppåt i alla riktningar. Punkten ligger lägre än sin omgivning. Det är konvexitet. -

Om

∇²f < 0kröker funktionen nedåt. Punkten ligger högre än sin omgivning. Det är konkavitet. -

Om

∇²f = 0är funktionen lokalt platt. Ingen nettokrökning i någon riktning.

Detta är flervariabelversionen av andraderivatatestet du redan känner till. I 1D betyder en positiv andraderivata ett lokalt minimum och en negativ ett lokalt maximum. Laplacian utvidgar samma idé till valfritt antal dimensioner genom att summera krökningen över alla axlar.

Relation till Hessian

Hessianmatrisen fångar hela krökningsbilden. Det är en matris av alla andra ordningens partiella derivator, och varje element beskriver hur funktionen kröker sig längs ett par axlar.

Laplacian är spåret av Hessian – summan av dess diagonalelement. Där Hessian ger den fullständiga krökningsuppdelningen, komprimerar Laplacian den till ett enda tal.

Den avvägningen är viktig i maskininlärning. Fullständig Hessian är dyr att beräkna för högdimensionella modeller – en modell med n parametrar har en n × n Hessian. Laplacian ger en billig, skalär sammanfattning av krökningen som är snabb att arbeta med.

Varför detta spelar roll för maskininlärning

När du tränar en modell navigerar du på en förlustyta. Platta områden betyder långsam inlärning. Konvexa områden betyder att optimeraren kan skjuta över. Laplacian ger dig en snabb lägesbild av vilken situation du befinner dig i.

Grafbaserade metoder använder Laplacian för att mäta hur mjukt värden förändras över en grafs noder. Det är en direkt förlängning av samma krökningsintution från kontinuerliga funktioner till diskreta strukturer.

Laplacian och optimering i maskininlärning

Gradienstegning använder bara första derivator.

Gradienten talar om i vilken riktning du ska ta ett steg. Den talar inte om hur stort steget ska vara. En brant gradient i en platt, bred dal kräver ett stort steg. Samma branta gradient nära en skarp klippkant kräver ett litet. Enbart första derivator kan inte skilja på detta.

Det är där andra derivator kommer in.

Krökning och steglängd

Krökning beskriver hur snabbt själva gradienten förändras. Hög krökning betyder att förlustytan böjer sig kraftigt – små steg i parameterutrymmet ger stora förändringar i gradienten. Låg krökning betyder att ytan är platt och gradienten förändras långsamt.

Om du ignorerar krökning och använder en fast inlärningshastighet gissar du bara. För stor, och du skjuter över i områden med hög krökning. För liten, och du kryper fram i platta områden.

Optimeringsmetoder av andra ordningen som Newtons metod använder krökning för att automatiskt sätta steglängder. De dividerar gradienten med krökningen, tar större steg där ytan är platt och mindre där den är skarp.

Var Laplacian passar in

Laplacian är spåret av Hessian – ett enda skalärt tal som sammanfattar den totala krökningen i en punkt. Den fångar inte hela bilden som Hessian gör, men den är billig att beräkna och användbar som signal.

Här är en enkel förklaring av vad du behöver minnas:

- En stor positiv Laplacian av förlusten i en punkt betyder att du är nära ett lokalt minimum – förlusten kröker uppåt i alla riktningar

- Ett negativt värde betyder att du är nära ett maximum

- Nära noll betyder att du är i ett platt eller sadelområde, vilket är precis där gradienstegning tenderar att fastna

Stabilitet och regularisering

Krökning hänger också ihop med träningsstabilitet. Skarpa minima – områden med hög krökning – tenderar att generalisera sämre än platta. En modell som konvergerar till ett skarpt minimum är känslig för små förändringar i indata.

Vissa regulariseringstekniker straffar direkt krökning för att styra optimeringen mot plattare områden av förlustytan. Laplacian dyker upp även här, som ett sätt att mäta och begränsa hur skarpt modellens prediktioner förändras över indatarummet.

Att förstå krökning hjälper dig att förstå varför din optimerare stannar av, varför din inlärningshastighet är så viktig, och varför vissa minima generaliserar bättre än andra.

Graf-Laplacian och Laplacian-matrisen

Hittills har Laplacian levt i världen av kontinuerliga funktioner. Men vad händer när dina data inte är en slät yta utan en graf?

Det är där graf-Laplacian kommer in. Den tar samma kärnidé – att mäta hur ett värde i en punkt skiljer sig från sina grannar – och applicerar den på noder och kanter.

Formeln

Graf-Laplacian L definieras som:

Graf-Laplacian-formel (förenklad)

Två matriser. Det är allt. Låt oss reda ut vad var och en betyder.

Adjacitetsmatrisen

Adjacitetsmatrisen A kodar vilka noder som är kopplade. För en graf med n noder är A en n × n matris där A_ij = 1 om det finns en kant mellan nod i och nod j, och 0 annars.

För en enkel odirigerad graf med 3 noder där nod 1 är kopplad till noderna 2 och 3, men 2 och 3 inte är kopplade till varandra:

Adjacitetsmatrisen

Gradsummematrisen

Gradsummematrisen D är en diagonalmatris. Varje diagonalterm D_ii är graden (antalet kanter) för nod i. Alla icke-diagonala element är noll.

Detta är formeln för samma graf:

Gradsummematrisen

Nod 1 har grad 2 (ansluten till två noder). Noderna 2 och 3 har vardera grad 1.

Sätta samman

Subtrahera A från D och du får L:

Adjacitetsmatrisen subtraherad från gradsummematrisen

Varje diagonalterm talar om hur många kopplingar en nod har. Varje icke-diagonalterm L_ij är -1 om noderna i och j är anslutna, och 0 om de inte är det.

Om du multiplicerar L med en vektor av värden tilldelade varje nod, mäter resultatet hur mycket varje nods värde skiljer sig från grannarnas värden. Det är den diskreta versionen av samma krökningsintuition som tidigare – fast applicerad på en graf istället för en kontinuerlig yta.

Vad egenvärden berättar om en graf

Den verkliga styrkan hos L kommer från dess egenvärden och egenvektorer:

-

Det minsta egenvärdet för

Lär alltid 0. Den motsvarande egenvektorn är en konstant vektor – varje nod får samma värde. Det är rimligt: en konstant funktion har noll ”variation” över grafen. -

Antalet noll-egenvärden motsvarar antalet sammanhängande komponenter i grafen. Om din graf har tre frånkopplade kluster har

Ltre noll-egenvärden. Det här är ett direkt sätt att läsa av grafsammanhang från en matris. -

Små icke-noll egenvärden motsvarar egenvektorer som förändras långsamt över grafen – närliggande noder får liknande värden. Stora egenvärden motsvarar egenvektorer som oscillerar snabbt mellan anslutna noder.

Kul fakta: Det är detta spektrum av egenvärden som ger spektrala metoder deras namn.

Spektral klustring och community-detektering

Spektral klustring använder egenvektorerna för L för att hitta kluster i grafstrukturerade data. Tanken är att egenvektorer associerade med små egenvärden tilldelar liknande värden till tätt sammanlänkade noder och olika värden till löst sammanlänkade.

För att hitta k kluster tar du de k egenvektorer som motsvarar de k minsta icke-noll egenvärdena för L, staplar dem till en matris och kör k-means på raderna. Varje rad är en nod, och dess position i detta lågdimensionella rum återspeglar dess grafgrannskap.

Detta fungerar för community-detektering i sociala nätverk, dokumentklustring, bildsegmentering och överallt där dina data har en naturlig grafstruktur. Två noder som är tätt förbundna hamnar nära varandra i egenvektorrummet. Två noder från olika gemenskaper hamnar långt ifrån varandra.

Graf-Laplacian förvandlar ett svårt kombinatoriskt problem – hitta klustren i denna graf – till ett linjäralgebraproblem som är lätt att lösa.

Laplacian i spektral klustring

Spektral klustring är där graf-Laplacian går från intressant matematik till ett praktiskt ML-verktyg.

Kärnidén är att istället för att klustra råa datapunkter direkt klustrar du dem i ett rum definierat av egenvektorerna för L. Det rummet fångar grafstrukturen, så att du kan se vilka noder som är tätt kopplade, vilka som är löst kopplade och vilka som tillhör separata gemenskaper.

Hur egenvektorer definierar kluster

Ta de k egenvektorer som motsvarar de k minsta icke-noll egenvärdena för L. Stapla dem som kolumner i en matris. Varje rad i den matrisen är en nod, nu representerad som en punkt i ett k-dimensionellt rum.

Egenvektorer associerade med små egenvärden förändras långsamt över grafen. Noder som är tätt kopplade får liknande värden i dessa egenvektorer – och liknande värden betyder liknande rader – och liknande rader betyder att de hamnar nära varandra i det nya rummet.

Onormaliserad kontra normaliserad Laplacian

Det finns två versioner av graf-Laplacian som du ser i praktiken.

Den onormaliserade Laplacian är den raka L = D - A. Den fungerar bra när noder har ungefär liknande grader – det vill säga när de flesta noder har ett liknande antal kopplingar

Den normaliserade Laplacian justerar för obalans i grader. Det finns ett par varianter, men den vanligaste är:

Normaliserad Laplacian-formel

Detta omskalar varje nods bidrag med dess grad. I verkliga grafer – sociala nätverk, webbgrafer, citeringsnätverk – har vissa noder hundratals kopplingar och andra bara en eller två. Utan normalisering dominerar höggradiga noder egenvektorerna och klustringsresultaten blir sämre.

Använd den normaliserade Laplacian som standard om du inte vet att din graf har en jämn gradsfördelning.

Praktiska tillämpningar

Spektral klustring med graf-Laplacian förekommer i en rad maskininlärningsuppgifter. Här är några:

- Bildsegmentering – pixlar blir noder, kantvikter kodar likhet och kluster motsvarar bildregioner

- Dokumentklustring – dokument blir noder, kanter kodar delade termer eller citeringar

- Analys av sociala nätverk – användare blir noder, kanter kodar kopplingar och kluster avslöjar gemenskaper

- Rekommendationssystem – artiklar eller användare bildar en graf och spektrala metoder hittar grupper med liknande beteende

När dina data har en naturlig grafstruktur, eller du kan bygga en från parvisa likheter, ger spektral klustring dig ett principiellt sätt att hitta grupper som rena avståndsbaserade metoder missar.

Laplacian i bildbehandling och datorseende

Laplacian är ett av de äldsta verktygen inom datorseende och används fortfarande aktivt idag.

I bildbehandling är pixelintensitet funktionen. Laplacian mäter hur en pixels intensitet skiljer sig från dess grannar. Där intensiteten förändras långsamt är Laplacian nära noll. Där den förändras tvärt – vid en kant – ger Laplacian en stark respons.

Det är hela grunden för kantdetektering med Laplacian.

Varför andra derivator hittar kanter

En första derivata hittar var intensiteten förändras. En andra derivata hittar var själva förändringen förändras – med andra ord där förändringstakten når topp och sedan avtar.

Vid en kant stiger intensiteten och planar sedan ut. Första derivatan spikar vid stigningen. Andra derivatan – Laplacian – korsar noll precis vid toppen av den spiken. Dessa nollgenomgångar markerar den exakta positionen för en kant, vilket gör Laplacian mer precis för kantlokalisering än förstaderivatsmetoder som Sobel-filtret.

Den diskreta Laplacian-kärnan

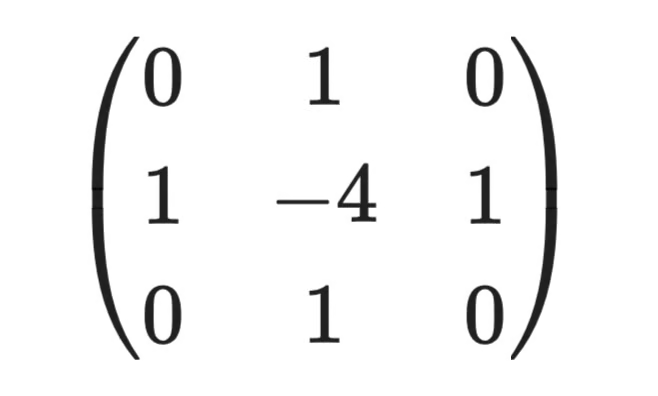

I praktiken är bilder pixelraster, inte kontinuerliga funktioner. Den kontinuerliga Laplacian approximeras med en konvolutionskärna – en liten matris som du skjuter över bilden.

Den standardiserade diskreta 3×3-Laplacian-kärnan ser ut så här:

Diskret 3x3-Laplacian-kärna

Vikten i mitten är -4 och de fyra direkta grannarna får vardera +1. När du applicerar denna kärna på en pixel beräknar du skillnaden mellan den pixelns intensitet och medelvärdet av dess fyra grannar – den diskreta versionen av samma ”hur förhåller sig denna punkt till sin omgivning”-fråga som tidigare.

Praktiska överväganden

Rå Laplacian-filtrering är känslig för brus. En enskild brusig pixel ger en skarp intensitetsspik och Laplacian flaggar den som en kant.

Standardlösningen är att först jämna ut bilden med en Gaussisk oskärpa och sedan applicera Laplacian. Denna kombination kallas Laplacian of Gaussian (LoG). Gaussianen dämpar brus och Laplacian hittar de verkliga kanterna.

I djupinlärning lär sig konvolutionella neurala nätverk sina egna kantdetekteringsfilter från data – men dessa inlärda filter liknar ofta Laplacian-kärnan. Så på ett sätt återupptäcker neurala nätverk samma matematik som gjorde Laplacian användbar i klassisk datorseende.

Diskret kontra kontinuerlig Laplacian

Laplacian är tre besläktade idéer som dyker upp i olika sammanhang.

Att förstå vilken version du arbetar med sparar mycket förvirring när du rör dig mellan analysböcker, numerisk kod och artiklar om graf-ML.

Den kontinuerliga Laplacian

Den kontinuerliga Laplacian är den från analysen. För en slät funktion f definierad över ett kontinuerligt rum är den summan av andra ordningens partiella derivator:

Den kontinuerliga Laplacian

Denna version antar att din funktion är slät och deriverbar överallt. Det är den teoretiska grunden – men verkliga data är aldrig kontinuerliga. Du kan inte beräkna exakta derivator på ett pixelraster eller en tabell med mätvärden.

Den diskreta Laplacian

När du går från kontinuerliga funktioner till sampeldata ersätts derivator med ändlig differens – approximationer beräknade från närliggande värden.

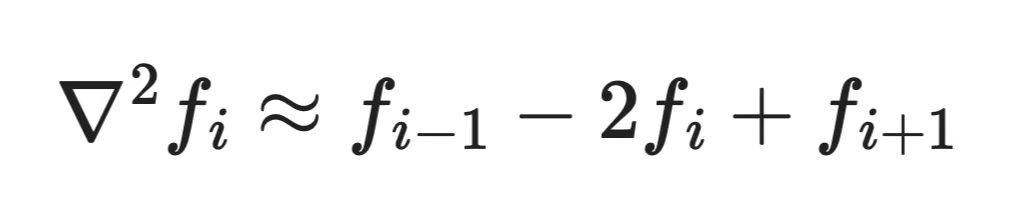

För en 1D-funktion samplad vid jämnt fördelade punkter är den diskreta andraderivatan i punkt i:

Den diskreta Laplacian

Du jämför värdet i i med dess två grannar. Samma idé utökas till 2D-raster (bilder), 3D-volymer och vidare. Konvolutionskärnorna från avsnittet om bildbehandling är just detta – ändlig differens-approximationer av den kontinuerliga Laplacian, applicerade på ett pixelraster.

Denna diskretisering gör Laplacian beräkningsbar i numeriska metoder och ML-flöden. Varje gång du applicerar ett Laplacian-filter i kod kör du en ändlig differens-approximation, inte den exakta analysoperatorn.

Graf-Laplacian

Graf-Laplacian tar diskretisering ett steg längre. Istället för ett regelbundet raster med jämn avstånd har du en godtycklig uppsättning noder kopplade med kanter med varierande vikter.

Här finns inget begrepp om ”närliggande pixel” – bara noder och kopplingarna mellan dem. Graf-Laplacian L = D - A ersätter ändlig differens-strukturen med adjacitetsstruktur. Kärnfrågan är densamma: hur förhåller sig en nods värde till dess grannars? Men ”grannar” definieras nu av grafen, inte av rumslig närhet.

Varför detta spelar roll i ML

De flesta ML-data lever inte på ett regelbundet raster. Molekyler, sociala nätverk, kunskapsgrafer och 3D-punktmoln har alla oregelbunden struktur. Du kan inte applicera en standard-Laplacian med ändlig differens på dem.

Graf-Laplacian löser detta genom att göra grannskapsstrukturen explicit via adjacitetsmatrisen. Det är därför grafneuronät och spektrala metoder kan tillämpa Laplacian-baserade operationer på data som saknar naturligt koordinatsystem.

Genomräknat exempel: att beräkna en Laplacian

Låt oss göra detta konkret med två exempel – ett kontinuerligt, ett grafbaserat.

Exempel 1: Kontinuerlig Laplacian av f(x, y) = x² + y²

Ta funktionen f(x, y) = x² + y². Det är en enkel paraboloid – en skålform som kröker uppåt i alla riktningar.

För att beräkna Laplacian behöver du andraderivatan med avseende på varje variabel.

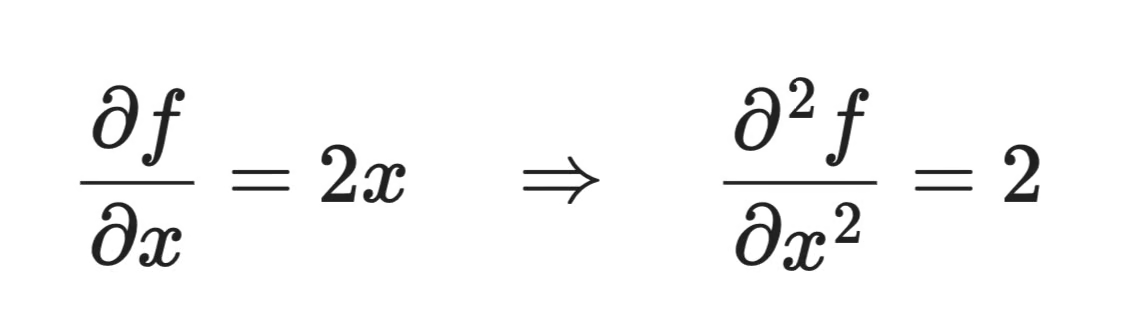

Först med avseende på x:

Kontinuerlig Laplacian-beräkning (1)

Sedan med avseende på y:

Kontinuerlig Laplacian-beräkning (2)

Och nu, bara summera dem:

Kontinuerlig Laplacian-beräkning (3)

Laplacian är en konstant 4 överallt. Det är logiskt eftersom en paraboloid har samma krökning i varje punkt. Det positiva värdet säger att funktionen kröker uppåt i alla riktningar, i linje med skålformen.

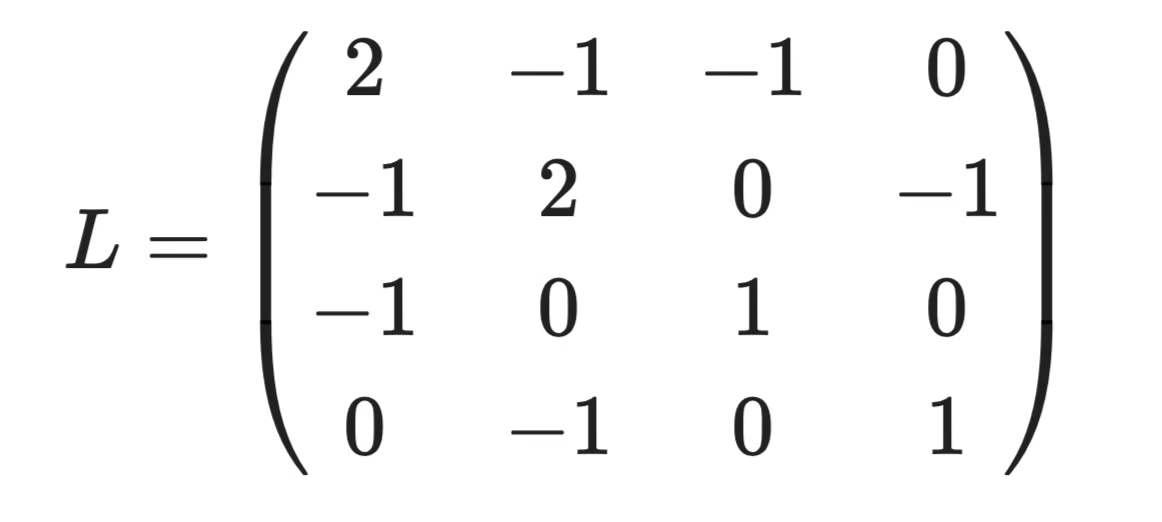

Exempel 2: Graf-Laplacian för en liten graf

Ta en graf med 4 noder och följande kanter:

- Nod 1 är kopplad till noderna 2 och 3

- Nod 2 är kopplad till noderna 1 och 4

- Nod 3 är kopplad till nod 1

- Nod 4 är kopplad till nod 2

Adjacitetsmatrisen A kodar kopplingarna:

Graf-Laplacian-beräkning (1)

Gradsummematrisen D sätter varje nods antal kopplingar på diagonalen:

Graf-Laplacian-beräkning (2)

Noderna 1 och 2 har vardera 2 kopplingar. Noderna 3 och 4 har vardera 1.

Till sist, subtrahera för att få L = D - A:

Graf-Laplacian-beräkning (3)

Så här läser du denna matris: Rad 1 säger: nod 1 har grad 2, och är kopplad till noderna 2 och 3 (termerna -1). Rad 3 säger: nod 3 har grad 1, kopplad endast till nod 1. Nollorna visar vilka nodpar som inte delar kant.

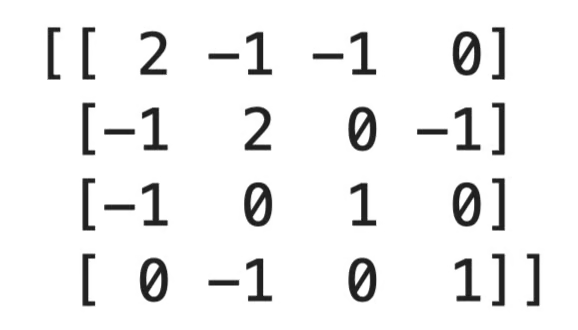

Du kan också beräkna den i Python för att verifiera:

import numpy as np

A = np.array([

[0, 1, 1, 0],

[1, 0, 0, 1],

[1, 0, 0, 0],

[0, 1, 0, 0]

])

D = np.diag(A.sum(axis=1))

L = D - A

print(L)

Graf-Laplacian-beräkning i Python

Vanliga förväxlingar

Laplacian liknar några andra begrepp, och skillnaderna är inte alltid uppenbara bara utifrån namnen. I det här avsnittet försöker jag eliminera alla förvirringspunkter.

Laplacian vs. gradient

Gradienten ∇f är en vektor. Den pekar i riktningen för snabbast ökning och dess magnitud talar om hur snabbt funktionen stiger. Den använder första derivator.

Laplacian ∇²f är en skalär. Den talar inte om i vilken riktning du ska röra dig – den berättar om funktionens form i en punkt. Den byggs av andra derivator.

Laplacian vs. Hessian

Detta är det som oftast ställer till det.

Hessian H är en matris av alla andra ordningens partiella derivator. För en funktion med n inparametrar är det en n × n matris som fångar hur gradienten förändras längs varje axelpar. Den ger hela krökningsbilden.

Laplacian är spåret av Hessian – summan av dess diagonala element. Du förlorar krökningsinformation utanför diagonalen, men du får ett enda tal som är snabbt att beräkna.

Använd Hessian när du behöver den fullständiga krökningsuppdelningen. Använd Laplacian när en skalär sammanfattning räcker.

Graf-Laplacian vs. differentialoperator

Dessa delar namn och samma kärnintuition, men verkar på helt olika objekt.

Den differentiella Laplacian verkar på släta, kontinuerliga funktioner. Den kräver derivator, vilket betyder att den antar att din funktion är deriverbar överallt.

Graf-Laplacian L = D - A verkar på grafer – diskreta strukturer med noder och kanter. Inga derivator är inblandade. Den mäter hur ett värde vid varje nod skiljer sig från dess grannars med hjälp av matrisoperationer.

Kopplingen är konceptuell, inte beräkningsmässig. Båda mäter lokal avvikelse från ett grannskapsmedelvärde, men är helt olika.

Teckenkonventioner

Vissa fält definierar Laplacian med ett minustecken: -∇²f. Du ser detta inom fysik och i vissa ML-artiklar om grafneuronät. Den negativa Laplacianen −L är positiv semidefinit, vilket har trevligare egenskaper för vissa optimeringsproblem och gör egenvärdesanalys renare.

När du läser en artikel och Laplaciens egenvärden alla är icke-negativa, kontrollera om de använder L eller -L. Matematiken är ekvivalent, men att blanda konventioner kan leda till fel resultat.

Varför Laplacian är viktig i data science

Vid det här laget har du sett Laplacian dyka upp inom analys, grafteori, bildbehandling och optimering. Samma operator löser samma grundproblem i olika sammanhang: att mäta hur ett värde i en punkt relaterar till sin omgivning.

Här är var det visar sig i data science:

-

Grafbaserad ML: Graf-Laplacian

L = D - Aär grunden för spektrala metoder. När dina data har en naturlig grafstruktur ger Laplacian en matris som kodar hela kopplingsmönstret i en form du kan göra linjär algebra på -

Klustring: Spektral klustring använder egenvektorerna för

Lför att hitta grupper som rena avståndsbaserade metoder missar. Den fungerar bra när kluster inte är konvexa eller linjärt separerbara -

Semitillsyn: Många semitillsynsmetoder använder graf-Laplacian för att sprida etiketter från märkta till omärkta noder. Antagandet är att anslutna noder sannolikt delar samma etikett, och Laplacian kvantifierar hur mjukt etiketter bör variera över grafen

-

Mångfaldsinlärning: Algoritmer som Laplacian Eigenmaps använder graf-Laplacian för att hitta lågdimensionella representationer av högdimensionella data. Egenvektorerna för

Lmappar närliggande punkter i ursprungsrummet till närliggande punkter i det reducerade rummet -

Bildfunktionsutvinning: Den diskreta Laplacian detekterar kanter och områden med snabba intensitetsförändringar. Dessa funktioner matas direkt in i både klassiska datorseende-flöden och som priorer i djupinlärningsarkitekturer

Sammanfattningsvis är Laplacian ett av få matematiska verktyg som skalar från en enda analysformel hela vägen upp till stora grafneuronät.

Slutsats

Laplacian börjar som en analysoperator, ett sätt att mäta krökning i kontinuerliga funktioner. När du når grafbaserad ML är den en matris som kodar strukturen i ett helt nätverk. Kärnidén är exakt densamma, bara formen är annorlunda.

Anmäl dig till vår Linear Algebra for Data Science in R-kurs för att få praktisk erfarenhet av många koncept och ämnen som behandlas i den här artikeln.

FAQs

Vad är Laplacian med enkla ord?

Laplacian är en matematisk operator som mäter hur en funktions värde i en punkt förhåller sig till medelvärdet av dess grannar. Om Laplacian är positivt ligger punkten under sin omgivning. Om den är negativ ligger den ovanför. Det är ett enda tal som sammanfattar den lokala krökningen hos en funktion.

Vad är skillnaden mellan Laplacian och gradienten?

Gradienten är en vektor som pekar i riktningen för snabbast ökning – den talar om åt vilket håll du ska röra dig. Laplacian är en skalär som berättar om funktionens form i en punkt, inte dess riktning. De bygger båda på derivator, men svarar på helt olika frågor.

Var används Laplacian i maskininlärning?

Laplacian förekommer i ett brett spektrum av ML-uppgifter – spektral klustring, semitillsyn, mångfaldsinlärning och detektion av bildkanter bygger alla på den i någon form. I grafbaserade metoder kodar graf-Laplacian-matrisen strukturen i ett nätverk och driver algoritmer som Laplacian Eigenmaps och grafneuronät. Det är ett av få matematiska verktyg som skalar från en enda formel till stora, verkliga ML-system.

Vad är graf-Laplacian och hur beräknas den?

Graf-Laplacian är en matris definierad som L = D - A, där D är gradsummematrisen och A är adjacitetsmatrisen för en graf. Varje diagonalterm innehåller hur många kopplingar en nod har, och varje icke-diagonalterm är -1 om två noder är anslutna och 0 om de inte är det. Egenvärdena och egenvektorerna för denna matris avslöjar grafens klusterstruktur, vilket är precis vad spektrala klustringsmetoder utnyttjar.

Vad är skillnaden mellan normaliserad och onormaliserad graf-Laplacian?

Den onormaliserade Laplacianen L = D - A fungerar bra när noderna i din graf har ungefär lika många kopplingar. Den normaliserade Laplacianen justerar för obalans i grader genom att omskala varje nods bidrag – detta spelar roll i verkliga grafer som sociala nätverk, där vissa noder har hundratals kopplingar och andra bara en eller två. Utan normalisering dominerar höggradiga noder egenvektorerna och klustringsresultaten försämras, så den normaliserade versionen är ett säkrare standardval för de flesta praktiska tillämpningar.