Kursus

Framework agen AI otonom dirancang untuk sistem yang menalar melalui tugas bertahap, memilih alat secara mandiri, dan mengeksekusi tindakan atas nama pengguna dengan intervensi manual yang lebih sedikit. SuperAGI menerapkan ini melalui loop bergaya ReAct dan lapisan orkestrasi yang berfokus pada GUI.

SuperAGI adalah salah satu framework open-source paling awal yang dirancang khusus untuk tujuan ini. Framework ini memberi pengembang platform untuk membangun, mengelola, dan menjalankan agen AI berorientasi tujuan melalui GUI berbasis web, lengkap dengan pemantauan bawaan, marketplace alat, dan dukungan untuk berbagai large language model (LLM).

Dalam panduan ini, saya akan menjelaskan apa itu SuperAGI, menelusuri arsitektur dan fiturnya, menunjukkan cara memasangnya dengan Docker, dan membandingkannya dengan AutoGPT dan LangChain. Saya juga akan membahas keunggulannya, kekurangannya, dan apakah ini cocok untuk penggunaan produksi.

Satu catatan penting sebelum kita mulai: SuperAGI sebagai framework open-source dan SuperAGI sebagai perusahaan kini bukan lagi cerita yang sama. Perusahaan telah beralih ke produk SaaS komersial yang berfokus pada alat penjualan bertenaga AI, dan repositori open-source hanya mengalami aktivitas minimal sejak 2024. Artikel ini berfokus pada framework open-source. Saya akan menyoroti status pemeliharaannya saat ini sepanjang artikel agar Anda dapat mengambil keputusan terinformasi apakah akan menggunakannya.

Apa Itu SuperAGI?

SuperAGI adalah framework agen AI otonom open-source yang berfokus pada pengembang dan dilisensikan di bawah MIT License. Framework ini dibuat oleh TransformerOptimus dan telah mengumpulkan ribuan bintang GitHub serta lebih dari 2.000 fork sejak diluncurkan pada 2023. Proyek ini ditulis terutama dalam Python (sekitar 70%) dengan JavaScript untuk frontend (sekitar 25%).

Gagasan intinya adalah: SuperAGI bukan model itu sendiri. Ini adalah lapisan orkestrasi yang berada di antara Anda, sebuah LLM, dan alat apa pun yang ingin Anda gunakan untuk agen. Anda mendefinisikan tujuan untuk agen, menetapkan alat (seperti penelusuran web, manajemen file, atau integrasi GitHub), memilih penyedia LLM, lalu agen secara otonom menalar tugas, memilih alat yang tepat di setiap langkah, dan beriterasi hingga menyelesaikan tujuan atau mencapai batas iterasi.

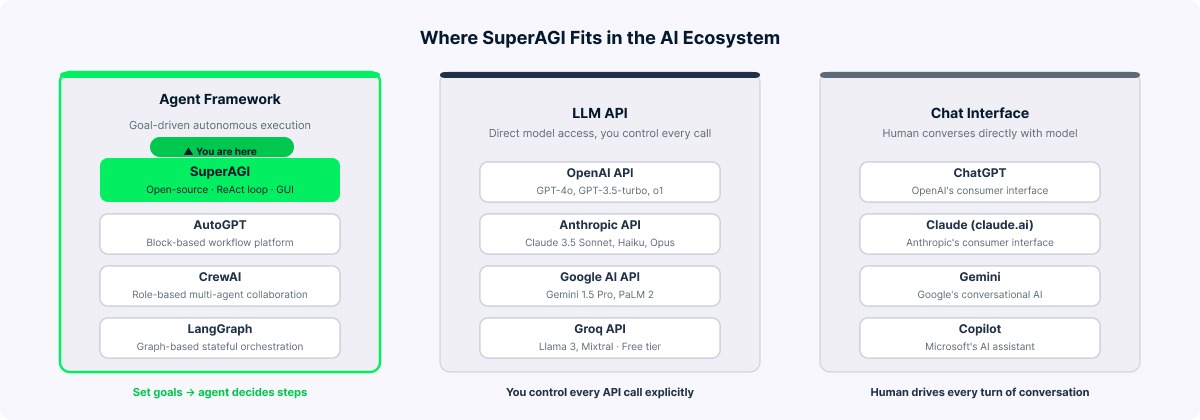

Tiga hal yang perlu dipahami sejak awal tentang posisi SuperAGI di ekosistem.

Sebuah framework agen (seperti SuperAGI, AutoGPT, atau CrewAI) mengorkestrasi eksekusi tugas otonom menggunakan LLM yang digabungkan dengan alat. API LLM (seperti OpenAI API atau Anthropic API) menyediakan akses model mentah untuk pembuatan teks, dan Anda mengendalikan setiap panggilan. Antarmuka chat (seperti ChatGPT atau Claude) adalah pembungkus percakapan yang berhadapan dengan pengguna, tempat manusia berinteraksi langsung dengan model.

SuperAGI berada pada level framework. Anda menetapkan tujuan, dan agen memutuskan apa yang harus dilakukan. Ini berbeda secara mendasar dari sekadar mengobrol dengan model dan melakukan panggilan API langsung.

Penjelasan SuperAGI sebagai framework agen. Gambar oleh Penulis.

Fitur Inti SuperAGI

Sekarang Anda memahami apa itu SuperAGI dan bagaimana ia berbeda dari alat yang lebih sederhana, berikut adalah yang ditawarkannya di balik layar.

-

Agen otonom. Anda menyiapkan agen dengan tujuan, instruksi, alat, dan batasan tertentu. Ada tiga tipe agen: Default (siklus pikir-eksekusi tunggal), Fixed Task Queue (mengurai tujuan menjadi subtugas berurutan), dan Dynamic Task Queue (agen dapat menambahkan tugas baru selama eksekusi saat menemukan kebutuhan).

-

Sistem integrasi alat. SuperAGI menyertakan beragam toolkit bawaan, termasuk Google Search, DuckDuckGo, Web Scraper, File Manager, GitHub, Jira, Twitter, Notion, Google Calendar, DALL-E, Coding Toolkit, dan alat Knowledge Search yang didukung basis data vektor. Toolkit kontribusi komunitas untuk layanan seperti Slack, Instagram, atau layanan pembuatan gambar lainnya juga mungkin tersedia tergantung pada pengaturan spesifik. Saya akan membahas integrasi alat lebih detail nanti.

-

GUI berbasis web. Antarmuka Next.js yang dapat diakses di

localhost:3000menyediakan pembuatan agen, penetapan alat, feed aktivitas waktu nyata, konfigurasi penyedia model, penjadwalan agen, dan penelusuran marketplace. -

Agent Performance Monitoring (APM). Diperkenalkan pada versi 0.0.8, dasbor APM adalah salah satu pembeda utama SuperAGI. Ini menyediakan metrik tingkat organisasi (total agen, token yang digunakan, total run), rincian per model (agen, run, dan token per LLM), serta analitik tingkat agen (rata-rata token per run, total panggilan API, dan waktu jalan). Kartu metrik yang dapat diurutkan ulang memungkinkan Anda menyesuaikan tata letak dasbor.

-

Orkestrasi multi-agen. Anda dapat menjalankan banyak agen secara bersamaan, masing-masing dikonfigurasi dengan tujuan, alat, dan model LLM yang berbeda, semuanya dikelola melalui GUI terpadu.

-

Action Console. Ini adalah fitur human-in-the-loop. Dalam mode izin terbatas, agen akan jeda sebelum mengeksekusi tindakan kritis (seperti mengirim email atau menulis file) dan menunggu persetujuan Anda melalui Action Console. Ini memberi Anda gerbang keamanan untuk operasi sensitif.

-

Dukungan basis data vektor. SuperAGI mendukung Weaviate, Pinecone, dan Qdrant untuk memori jangka panjang melalui embedding vektor. Konteks jangka pendek dipertahankan dalam run eksekusi agen, sementara pengetahuan jangka panjang bertahan antar run di basis data vektor.

-

Marketplace. Marketplace yang digerakkan komunitas menampung alat, toolkit, templat agen, embedding pengetahuan, dan model. Anda dapat menelusuri dan memasang langsung dari GUI.

Dasbor inti SuperAGI dengan metrik APM. Gambar oleh Penulis.

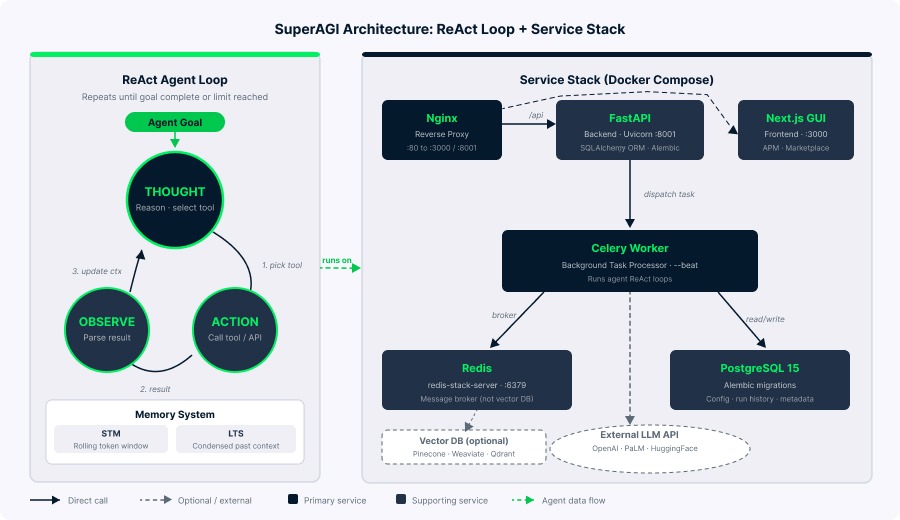

Cara Kerja SuperAGI: Tinjauan Arsitektur

Kesalahpahaman umum dalam artikel pihak ketiga adalah bahwa SuperAGI menggunakan loop "plan, execute, reflect, iterate". Kerangka itu memang umum dalam tulisan pihak ketiga, tetapi implementasinya lebih mirip dengan pola ReAct (Reason + Act). SuperAGI menerapkan loop Thought → Action → Observation, di mana agen memikirkan kondisi saat ini, memilih alat, mengamati hasilnya, lalu mengulang. ReAct adalah pola agen di mana model bergantian antara langkah penalaran ("Thought") dan pemanggilan alat ("Action"), dipandu oleh observasi.

Tumpukan teknologi, yang diverifikasi dari docker-compose.yaml dan kode sumberrnya, terbagi sebagai berikut:

|

Komponen |

Teknologi |

|

Web framework |

FastAPI |

|

Task queue |

Celery |

|

Message broker |

Redis (redis-stack-server) |

|

Database |

PostgreSQL 15 |

|

ORM |

SQLAlchemy |

|

Migrasi |

Alembic |

|

Frontend |

Next.js |

|

Reverse proxy |

Nginx |

|

Bahasa |

Python |

Backend menggunakan Uvicorn pada port 8001, dengan Nginx melakukan proxy /api ke backend dan semua path lain ke GUI Next.js. Celery menangani pemrosesan tugas latar belakang dengan --beat untuk operasi terjadwal. PostgreSQL menyimpan konfigurasi agen, riwayat run, dan metadata. Dalam pengaturan default, Redis terutama berfungsi sebagai message broker Celery, bukan sebagai basis data vektor, terlepas dari beberapa klaim pihak ketiga.

Untuk memori, SuperAGI menggunakan sistem dua bagian. Memori jangka pendek (STM) adalah jendela bergulir berdasarkan batas token LLM, sedangkan ringkasan jangka panjang (LTS) adalah ringkasan padat dari konteks di luar jendela STM. Bersama-sama, ini membentuk Agent Summary yang memberi masukan pada setiap langkah penalaran. Basis data vektor menangani embedding pengetahuan secara terpisah.

Arsitektur SuperAGI dengan loop agen ReAct. Gambar oleh Penulis.

Menyiapkan SuperAGI

Sebelum memulai, pastikan Anda memiliki Docker Desktop, Git, dan akses ke setidaknya satu penyedia LLM yang didukung (misalnya, kunci API OpenAI). Harapkan seluruh stack menggunakan sekitar 3 hingga 4 GB RAM. Jika Anda menggunakan Windows, Anda juga perlu mengaktifkan WSL2.

Pasang SuperAGI dengan Docker

Docker adalah metode pemasangan yang direkomendasikan dan paling andal. Prosesnya terbagi dalam beberapa langkah jelas.

Kloning dan konfigurasi

Berikut langkah-langkahnya:

# Clone the repository

git clone https://github.com/TransformerOptimus/SuperAGI.git

# Navigate into the project directory

cd SuperAGI

# Copy the configuration template

cp config_template.yaml config.yamlBuka config.yaml di editor teks dan konfigurasikan penyedia LLM Anda. Untuk OpenAI, setel OPENAI_API_KEY. Masukkan kunci Anda tanpa tanda kutip atau spasi ekstra:

# LLM Provider (choose one or more)

OPENAI_API_KEY: sk-your-openai-key-here

# PALM_API_KEY: your-palm-key-here

# HUGGING_FACE_API_KEY: your-hf-key-here

# Optional: for Google Search tool

GOOGLE_API_KEY: your-google-key

SEARCH_ENGINE_ID: your-cse-id

# Optional: for Pinecone vector DB

PINECONE_API_KEY: your-pinecone-keyBangun dan mulai container

Sekarang bangun dan luncurkan container:

# Build and start all services

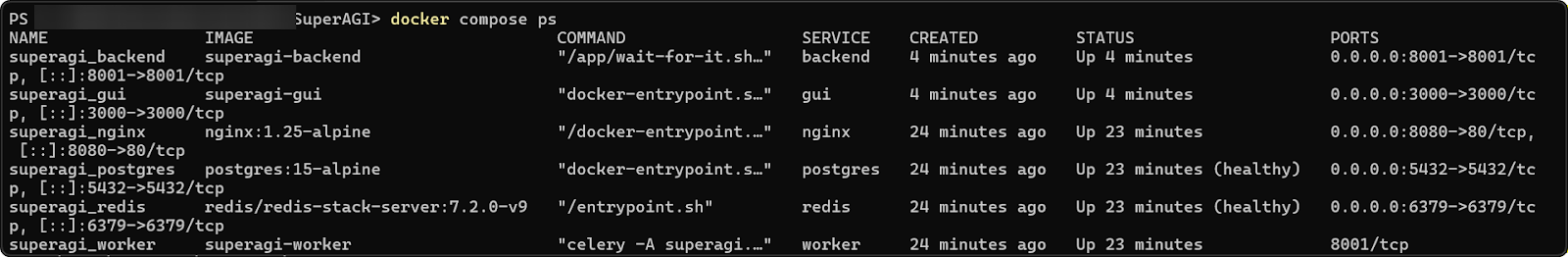

docker compose -f docker-compose.yaml up --buildProses build awal memakan waktu sekitar 10 hingga 15 menit. Setelah enam container berjalan (backend, celery, gui, redis, postgres, dan nginx), buka http://localhost:3000 di browser Anda (port default yang dikonfigurasi di file compose untuk GUI melalui Nginx).

Container Docker SuperAGI berhasil dibangun. Gambar oleh Penulis.

Verifikasi instalasi

Untuk memverifikasi semuanya berfungsi, jalankan docker compose ps dan pastikan enam container terdaftar. Kemudian buka localhost:3000, pergi ke Settings, dan pastikan konfigurasi kunci API Anda terdeteksi.

Masalah umum dan perbaikannya

Repositori resmi memiliki beberapa masalah yang diketahui yang mungkin Anda temui. Berikut yang paling umum dan cara memperbaikinya.

Docker daemon tidak berjalan: Pastikan Docker Desktop aktif sebelum menjalankan perintah compose.

Galat Celery "Unable to load application": Periksa kembali bahwa nama file Anda persis config.yaml dan bukan config_template.yaml, lalu build ulang dengan docker compose down && docker compose up --build.

Galat kunci enkripsi: Jika Anda melihat ValueError: Encryption key must be 32 bytes long, pastikan ENCRYPTION_KEY di config.yaml tepat 32 karakter dan dibungkus dengan tanda kutip:

ENCRYPTION_KEY: "abcdefghijklmnopqrstuvwxyz123456"

JWT_SECRET_KEY: "your-jwt-secret-key-change-this"JavaScript heap out of memory (container GUI): Jika GUI gagal dibangun, container Next.js membutuhkan lebih banyak memori. Tambahkan ini ke layanan gui di docker-compose.yaml:

gui:

environment:

NODE_OPTIONS: "--max-old-space-size=1024"

deploy:

resources:

limits:

memory: 1gIzin port 80 ditolak (Windows): Windows memerlukan hak admin untuk port 80. Ubah pemetaan port Nginx di docker-compose.yaml:

nginx:

ports:

- "8080:80" # Access via localhost:8080 insteadGalat format URL Redis: Jika Anda melihat ValueError: invalid literal for int() terkait Redis, hapus awalan redis:// dari REDIS_URL di config.yaml:

REDIS_URL: "redis:6379" # Not redis://redis:6379/0Loop restart container backend: Jika backend terus melakukan restart tanpa log galat, mungkin perintah startup hilang. Periksa bahwa docker-compose.yaml menyertakan entrypoint yang benar.

Konflik port: Jika port 3000 atau 8080 sudah digunakan, edit pemetaan port di docker-compose.yaml untuk menggunakan port lain.

Dukungan GPU

Untuk dukungan LLM lokal yang dipercepat GPU (ditambahkan di v0.0.14), gunakan file compose terpisah:

docker compose -f docker-compose-gpu.yml up --buildIni memerlukan GPU NVIDIA dengan NVIDIA Container Toolkit yang dikonfigurasi untuk dukungan runtime GPU Docker.

Pasang SuperAGI secara manual (setup pengembang)

Metode ini tidak direkomendasikan secara resmi namun berfungsi untuk pengembangan dan debug. Anda perlu menyiapkan backend dan frontend secara terpisah.

Penyiapan backend

# Clone and enter the directory

git clone https://github.com/TransformerOptimus/SuperAGI.git

cd SuperAGI

# Create and activate a virtual environment

pip install virtualenv

virtualenv venv

source venv/bin/activate # Windows: venv\Scripts\activate

# Install Python dependencies

pip install -r requirements.txt

# Copy and edit config

cp config_template.yaml config.yaml

# Edit config.yaml: set POSTGRES_URL to localhost, REDIS_URL to localhost:6379

# Start the backend

./run.sh # Windows: .\run.batPerlu diketahui bahwa dependensi Python dipatok ke versi lama (openai==0.27.7, FastAPI==0.95.2), yang dapat menyebabkan konflik di lingkungan modern. Isolasi environment virtual sangat penting.

Penyiapan frontend

Untuk frontend, navigasikan ke ./gui dan jalankan npm install && npm run dev. Anda harus membuat basis data PostgreSQL secara manual bernama super_agi_main dengan pengguna superagi dan sandi password. Anda juga memerlukan Redis yang berjalan terpisah.

Membuat dan Mengelola Agen di SuperAGI

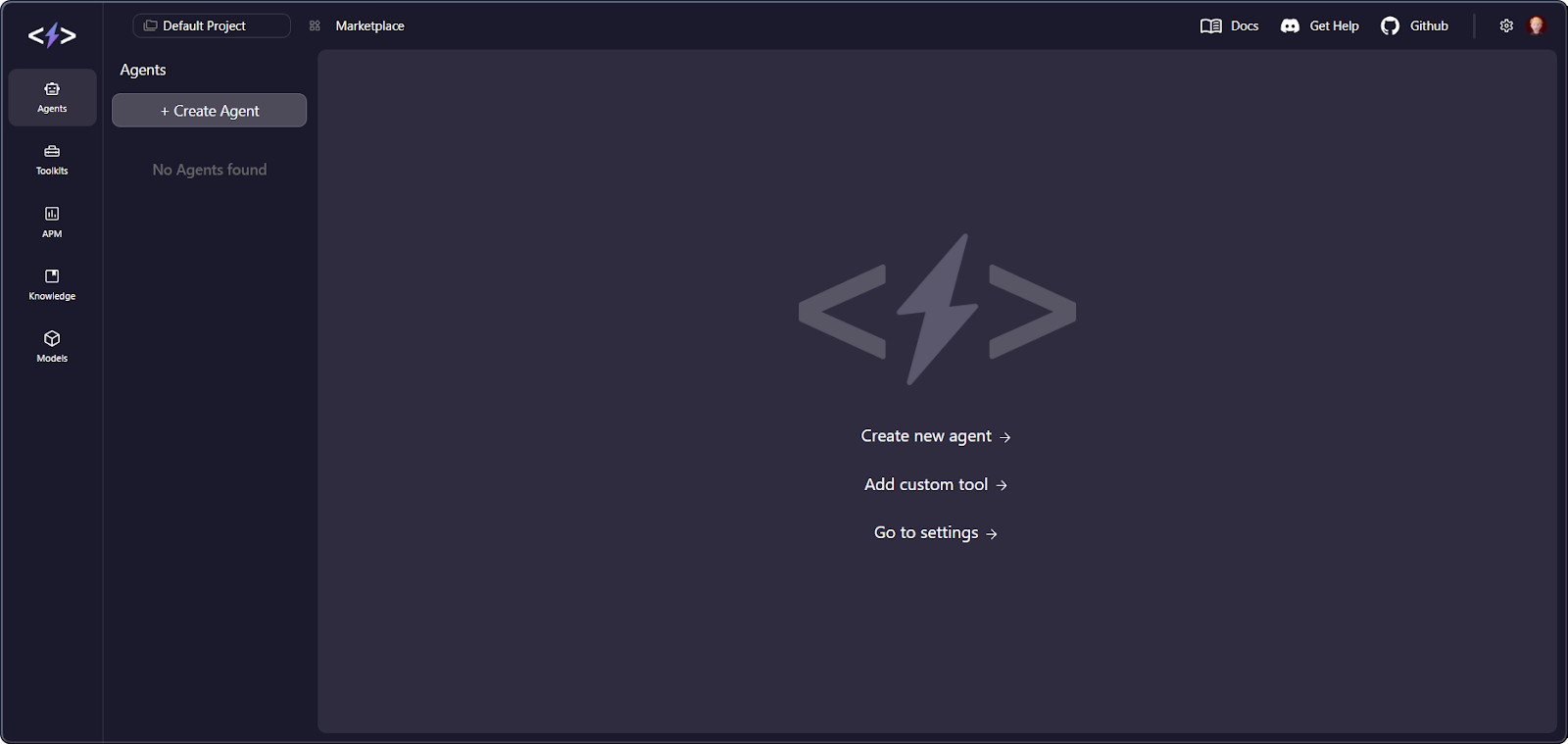

Setelah SuperAGI terpasang, mari kita bahas cara membuat dan menjalankan agen pertama Anda.

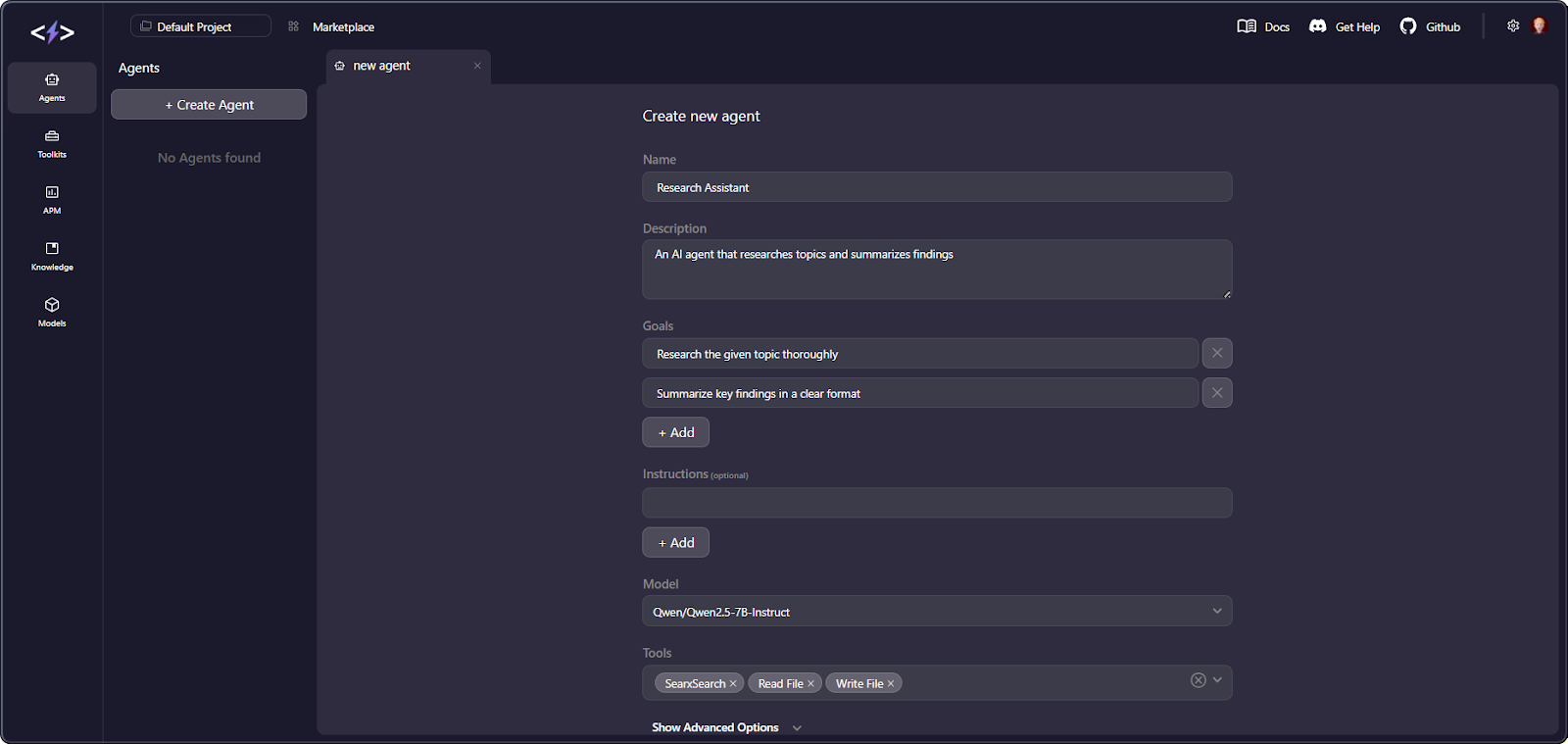

Konfigurasi agen

Dengan SuperAGI berjalan, buka tab Agents di GUI dan klik "Create Agent." Layar provisioning meminta beberapa isian: nama, deskripsi, tujuan (string teks yang mendefinisikan apa yang harus dicapai agen), instruksi, batasan, alat yang ditetapkan, model LLM yang digunakan, dan batas iterasi maksimum.

Batas iterasi dan kendali biaya

Pengaturan iterasi maksimum adalah kendali biaya dan keamanan utama Anda. Setiap iterasi memicu setidaknya satu panggilan LLM, dan agen yang kompleks dapat mengonsumsi token dengan cepat. Mulailah dengan angka rendah (10 hingga 15) saat belajar, dan tingkatkan seiring Anda memahami perilaku agen.

Mode izin

Ada dua mode izin. "God Mode" memungkinkan agen mengeksekusi secara bebas. Mode terbatas melakukan jeda sebelum tindakan kritis dan memerlukan persetujuan Anda melalui Action Console. Bagi siapa pun yang mempelajari platform ini, memulai dengan mode terbatas adalah kebiasaan yang baik.

Menjalankan dan memantau agen

Setelah Anda mengonfigurasi agen, Anda dapat meluncurkannya dan melacak progresnya secara real time.

Setelah dibuat, klik "Create and Run." Activity Feed memberikan visibilitas waktu nyata terhadap penalaran agen, pemilihan alat, dan outputnya. Anda dapat menjeda, melanjutkan, atau menghentikan agen kapan saja. Dasbor APM, seperti yang saya sebutkan sebelumnya, mengagregasi metrik di seluruh agen dan run untuk tampilan tingkat tinggi.

Membuat agen baru di antarmuka SuperAGI. Gambar oleh Penulis.

Akses programatis

Jika Anda lebih suka bekerja dengan kode daripada GUI, SuperAGI siap mendukung.

SuperAGI juga menyediakan SDK Python dan Node.js yang mengekspos operasi CRUD agen yang sama seperti di GUI (lihat dokumentasi resmi untuk contoh penggunaan).

Integrasi Alat di SuperAGI

Alat adalah cara agen berinteraksi dengan dunia luar. Anda menetapkan alat tertentu saat membuat agen, dan LLM memutuskan mana yang akan digunakan selama eksekusi berdasarkan tugas yang dihadapi.

SuperAGI hadir dengan set alat bawaan yang solid dan memungkinkan Anda membuat alat kustom. Berikut yang Anda dapatkan secara default.

Toolkit bawaan

Berikut ringkasan toolkit bawaan utama:

|

Toolkit |

Deskripsi |

Perlu Kunci API? |

|

Google Search |

Penelusuran web melalui Google Custom Search API |

Ya |

|

DuckDuckGo |

Penelusuran web berfokus privasi |

Tidak |

|

Coding Toolkit |

WriteCode, WriteSpec, WriteTest, ImproveCode |

Tidak |

|

File Manager |

Baca, tulis, tambahkan, hapus file |

Tidak |

|

Web Scraper |

Ekstraksi data dari halaman web |

Tidak |

|

GitHub |

Pencarian repositori, operasi file, pull request |

Ya |

|

Jira |

Manajemen isu (operasi CRUD) |

Ya |

|

|

Mengirim email dengan lampiran |

Ya |

|

DALL-E |

Pembuatan gambar melalui OpenAI |

Ya |

|

Knowledge Search |

Pencarian semantik atas embedding vektor |

Tidak (memerlukan basis data vektor) |

|

Thinking Tool |

Penalaran internal dengan dukungan memori jangka panjang |

Tidak |

Alat kustom

Di luar opsi bawaan, Anda dapat memperluas SuperAGI dengan toolkit Anda sendiri.

Untuk membuat alat kustom, Anda memasang paket superagi-tools, memperluas kelas BaseTool dan BaseToolkit, mendefinisikan skema input dengan Pydantic, dan mendaftarkan toolkit melalui URL repo GitHub-nya di GUI. Setelah menambahkan toolkit kustom, build ulang dengan docker compose down && docker compose up --build.

Pertimbangan keamanan untuk akses alat

Akses alat memperkenalkan risiko keamanan yang perlu diperhatikan dengan saksama.

Peringatan tentang akses alat tanpa batas: agen dengan akses email dan web secara teoretis dapat dieksploitasi melalui prompt injection untuk mengekfiltrasi data. Akses tulis file tanpa sandboxing dapat memungkinkan modifikasi yang tidak diinginkan. Selalu gunakan mode terbatas dan tetapkan hanya alat yang diperlukan untuk tujuan spesifik setiap agen.

SuperAGI vs. AutoGPT

Ini adalah perbandingan bernilai tinggi karena kedua framework menargetkan ruang masalah yang sama, tetapi telah berkembang berbeda secara signifikan.

|

Dimensi |

SuperAGI |

AutoGPT |

|

Komunitas GitHub |

Ribuan bintang |

Komunitas jauh lebih besar |

|

Rilis terbaru |

v0.0.14 (Jan 2024) |

Rilis berkelanjutan hingga 2025 |

|

Status pemeliharaan |

Aktivitas minimal sejak 2024 |

Pengembangan aktif |

|

Arsitektur |

Framework agen ReAct |

Platform alur kerja berbasis blok |

|

UI |

Dasbor web bawaan dengan APM |

Builder drag-and-drop Next.js |

|

Observabilitas |

APM bawaan (lebih matang) |

Dasbor dengan integrasi Sentry |

|

Dukungan LLM |

OpenAI, PaLM 2, HuggingFace, Replicate, lokal |

OpenAI, Anthropic, Groq, Ollama, dan lainnya |

|

Lisensi |

MIT |

Ganda (MIT + Polyform Shield) |

Perbandingan berlaku hingga awal 2026. Anda dapat memeriksa repositori masing-masing untuk pembaruan terbaru.

Perbedaan kunci bersifat filosofis. SuperAGI adalah framework agen berfokus pengembang di mana Anda menetapkan tujuan dan agen mencari langkah-langkahnya. AutoGPT berevolusi menjadi platform alur kerja low-code di mana pengguna menghubungkan blok secara visual. SuperAGI menawarkan observabilitas bawaan yang lebih matang melalui dasbor APM, tetapi AutoGPT memiliki komunitas yang jauh lebih besar, pengembangan aktif, dan dukungan LLM yang lebih luas. Keduanya cenderung menunjukkan ketidakstabilan dalam mode otonom yang terbuka.

Untuk proyek baru saat ini, AutoGPT umumnya merupakan opsi yang lebih aktif dipelihara. Jika Anda ingin mempelajari arsitektur agen yang bersih atau membutuhkan APM bawaan untuk riset, SuperAGI tetap memberi nilai sebagai alat pembelajaran.

SuperAGI vs. LangChain

Karakterisasi "SuperAGI sama dengan framework agen otonom versus LangChain sama dengan toolkit aplikasi LLM" terverifikasi dan akurat.

|

Dimensi |

SuperAGI |

LangChain |

|

Tujuan utama |

Framework agen otonom |

Toolkit orkestrasi LLM |

|

Tingkat abstraksi |

Tinggi (berpusat pada agen, berorientasi tujuan) |

Lebih rendah (berpusat pada rantai, alur eksplisit) |

|

Multi-agen |

Dukungan native |

Melalui ekstensi LangGraph |

|

Antarmuka visual |

UI web bawaan |

Tidak ada (LangSmith untuk pemantauan) |

|

Dukungan basis data vektor |

3 (Pinecone, Weaviate, Qdrant) |

15+ integrasi |

|

Dokumentasi |

Ada celah, perlu membaca kode sumber |

Luas dengan contoh |

|

Instalasi |

Docker Compose (setup lebih berat) |

pip install (ringan) |

|

Stabilitas produksi |

Lebih rendah, eksperimental |

Lebih tinggi, lebih matang |

Kapan memilih masing-masing: gunakan LangChain ketika Anda memerlukan kendali presisi atas setiap interaksi LLM, untuk RAG pipelines, antarmuka percakapan, atau pemrosesan dokumen. Gunakan SuperAGI ketika Anda menginginkan agen yang beroperasi secara mandiri dengan intervensi minimal, lebih suka manajemen visual ketimbang kode, atau menginginkan dukungan multi-agen bawaan dengan GUI.

LangChain dan LangGraph keduanya mencapai v1.0 pada Oktober 2025, dengan LangGraph menawarkan orkestrasi agen berbasis graf kelas produksi dengan alur kerja stateful dan observabilitas mendalam melalui LangSmith. Untuk proyek produksi baru, LangGraph umumnya merupakan jalur yang lebih matang.

Kasus Penggunaan SuperAGI

Berikut area di mana SuperAGI bekerja paling baik, berdasarkan contoh terdokumentasi dan penggunaan komunitas.

- Otomatisasi tugas. Agen dapat menangani alur kerja email, operasi file, dan penelusuran web terjadwal. Fitur penjadwalan bawaan (satu jadwal per agen) membuat tugas berulang menjadi sederhana.

- Asisten riset. Menggabungkan penelusuran web, pencarian pengetahuan, dan alat output file menciptakan agen yang dapat mengumpulkan informasi dari berbagai sumber dan menyusun output terstruktur.

- Produktivitas pengembang. Toolkit GitHub dan Jira memungkinkan penanganan isu otomatis, tinjauan PR, dan pembuatan kode. Coding Toolkit (WriteCode, WriteSpec, WriteTest, ImproveCode) mendukung alur kerja pengembangan end-to-end.

- Pembuatan konten. Menggabungkan DALL-E untuk pembuatan gambar dengan alat teks menciptakan agen untuk alur kerja konten media campuran. Toolkit komunitas untuk layanan pembuatan gambar lain juga mungkin tersedia.

- Manajemen media sosial. Toolkit Twitter memungkinkan posting otomatis dengan dukungan media, meski ini bergantung pada ketersediaan API eksternal. Toolkit kontribusi komunitas tambahan mungkin tersedia untuk platform lain tergantung pengaturan Anda.

- Perlu diingat bahwa bukti adopsi di tingkat enterprise masih tipis. Pemasaran SuperAGI menyebut perusahaan terkenal, tetapi perlakukan ini sebagai alat untuk eksperimen, prototipe, dan pembelajaran ketimbang solusi siap produksi.

Keterbatasan SuperAGI

Proyek ini terhenti. Rilis bertag terakhir (v0.0.14) dikirim pada Januari 2024. Commit terakhir ke main adalah patch keamanan pada Januari 2025. Aktivitas pengembangan menurun tajam setelah 2023, dengan sedikit fitur baru yang terlihat sejak saat itu. Banyak isu terbaru tampak tidak terjawab di pelacak isu publik.

Risiko halusinasi LLM bertambah dalam loop agen. Ketika agen secara otonom mengambil keputusan berdasarkan output LLM, parameter alat yang berhalusinasi atau fakta yang direkayasa dapat berujung pada tindakan dunia nyata. Agen multi-langkah yang berjalan sepuluh siklus dapat mengonsumsi jauh lebih banyak token daripada satu lintasan linear, memperbesar biaya dan risiko galat.

Agen sering macet. Beberapa isu GitHub melaporkan agen terjebak dalam status "Thinking" untuk periode lama tanpa kemajuan. Batas iterasi memberikan penghentian keras, tetapi agen dapat mengonsumsi sumber daya signifikan sebelum mencapainya.

Dokumentasi memiliki celah. Bahkan sebelum beberapa halaman dokumentasi offline selama peralihan komersial perusahaan, dokumentasinya kurang komprehensif dibanding pesaing seperti LangChain. Bekerja dengan SuperAGI sering membutuhkan membaca kode sumber langsung.

Biaya token cepat terakumulasi. Setiap langkah dalam loop ReAct memerlukan setidaknya satu panggilan LLM. Bergantung pada kompleksitas tugas, ini bisa bertambah lebih cepat daripada implementasi rantai yang lebih sederhana.

Perusahaan telah beralih haluan. Seperti disebutkan sebelumnya, perusahaan telah beralih ke produk SaaS. Situs web superagi.com tidak lagi menampilkan proyek open-source secara menonjol, dan beberapa halaman dokumentasi kini mengembalikan galat 404.

Pertimbangan Keamanan

Keamanan adalah area di mana SuperAGI menunjukkan usianya. Sistem agentic memperbesar dampak kerentanan, sehingga isu-isu ini lebih penting dibandingkan pada aplikasi tradisional. Berikut yang perlu Anda ketahui sebelum menggunakannya.

Rahasia dan konfigurasi

Kunci API disimpan dalam config.yaml teks biasa tanpa enkripsi, integrasi vault, atau mekanisme rotasi. Field ENCRYPTION_KEY dan JWT_SECRET_KEY dikirim dengan nilai placeholder yang tidak aman dan harus diubah sebelum penerapan apa pun di luar mesin lokal Anda.

Isolasi eksekusi

Container Docker menyediakan isolasi proses dasar, tetapi tidak ada sandboxing tingkat lanjut. Agen memiliki akses jaringan tanpa batas dan dapat menulis ke filesystem tanpa kontrol. Untuk penerapan yang lebih aman, panduan sandboxing NVIDIA merekomendasikan pembatasan akses jaringan dan penulisan filesystem, yang keduanya tidak diimplementasikan oleh SuperAGI.

Kerentanan yang diketahui

Beberapa kerentanan tingkat tinggi (termasuk eksekusi kode jarak jauh dan kebocoran konfigurasi) telah diungkapkan secara publik namun belum ditambal karena status proyek yang tidak aktif. Laporan didokumentasikan di hunter, platform pengungkapan kerentanan. Masalah tambahan seperti SSRF, penulisan file sewenang-wenang, dan miskonfigurasi CORS juga telah dilaporkan.

Jika Anda bergantung pada SuperAGI, periksa fork komunitas untuk patch dan selalu audit fork apa pun sebelum menggunakannya.

Risiko prompt injection

Serangan prompt injection menjadi sangat berbahaya ketika agen dapat mengeksekusi tindakan dunia nyata. SuperAGI rentan terhadap prompt injection langsung maupun tidak langsung; instruksi berbahaya di halaman web yang di-scrape dapat membajak perilaku agen. Perlakukan semua output alat yang tidak tepercaya (terutama konten web) sebagai vektor serangan potensial.

SuperAGI tidak memiliki pertahanan terdokumentasi selain gerbang persetujuan manual Action Console, jadi selalu gunakan mode izin terbatas.

Rekomendasi penerapan

Jika Anda menerapkan SuperAGI di luar pengujian lokal, ambil tindakan pencegahan ini setidaknya: ganti semua rahasia default, jalankan di belakang autentikasi (VPN atau reverse proxy), gunakan mode izin terbatas, dan tetapkan hanya alat yang diperlukan untuk setiap agen.

Apakah SuperAGI Siap Produksi?

Berdasarkan status pemeliharaan dan keamanan saat ini, ini tidak memenuhi kriteria kesiapan produksi yang umum. SuperAGI sendiri mengakui hal ini: README GitHub secara eksplisit menyatakan proyek ini "sedang dalam pengembangan aktif dan mungkin masih memiliki masalah."

Penilaian yang lebih panjang lebih bernuansa. Nomor versi pra-1.0 (v0.0.14) menandakan status eksperimental. Aktivitas pengembangan menunjukkan lonjakan tajam pada pertengahan 2023 diikuti dengan aktivitas minimal setelahnya. Banyak kerentanan keamanan telah dilaporkan dengan respons publik terbatas, dan peralihan perusahaan ke produk komersial berarti saat ini tidak ada peta jalan yang terlihat yang menunjukkan investasi baru dalam framework open-source.

Dasbor APM adalah titik terang sejati. Ini lebih matang daripada yang ditawarkan banyak pesaing secara default, dan tetap menjadi salah satu pembeda nyata SuperAGI bagi tim yang melakukan riset agen.

Kesimpulan

SuperAGI merintis beberapa gagasan yang memengaruhi ekosistem agen: APM bawaan, marketplace alat, dan manajemen yang berfokus pada GUI.

Namun, realitas pada 2026 adalah bahwa proyek SuperAGI terhenti. Perusahaan telah beralih, kerentanan keamanan tetap belum ditangani, dan tidak ada pengembangan baru yang terlihat. Untuk pekerjaan produksi, alternatif yang aktif dipelihara seperti LangGraph, CrewAI, dan Microsoft Agent Framework adalah pilihan yang lebih baik.

Sebagai langkah berikutnya, lihat kursus Introduction to AI Agents kami atau tutorial tentang membangun AI lokal dengan Docker dan n8n.

Saya seorang data engineer dan pembangun komunitas yang bekerja lintas pipeline data, cloud, dan perkakas AI sambil menulis tutorial praktis dan berdampak tinggi untuk DataCamp dan pengembang yang sedang berkembang.

FAQs

Bisakah saya tetap menggunakan SuperAGI pada 2026, atau sebenarnya sudah tidak dipelihara?

Ya, basis kodenya masih berfungsi. Anda dapat mengkloningnya, menjalankannya dengan Docker, dan membangun agen. Namun proyek ini tidak dipelihara: tidak ada rilis sejak Januari 2024, dan isu tidak dijawab. Bagus untuk mempelajari arsitektur agen, tetapi hindari penggunaan produksi karena kerentanan keamanan yang belum ditambal.

Haruskah saya mempelajari SuperAGI sebagai pemula?

Jika Anda ingin memahami cara kerja agen otonom di balik layar, ya. Basis kode SuperAGI bersih dan terstruktur dengan baik. Loop ReAct, integrasi alat, dan dasbor APM adalah contoh pembelajaran yang bagus. Namun jika tujuan Anda membangun aplikasi produksi, mulailah dengan LangGraph atau CrewAI. Keduanya memiliki dokumentasi lebih baik, komunitas aktif, dan fitur siap produksi.

Bagaimana perbandingan SuperAGI dengan framework yang lebih baru seperti CrewAI?

CrewAI berfokus pada kolaborasi multi-agen berbasis peran dan aktif dipelihara dengan pembaruan rutin. SuperAGI mengambil pendekatan single-agent-first. Untuk proyek baru pada 2026, CrewAI adalah pilihan yang lebih baik: pengembangan aktif, dokumentasi lebih baik, dan ekosistem yang berkembang. Pilih CrewAI jika Anda memerlukan kolaborasi berbasis peran, atau LangGraph jika Anda menginginkan keandalan kelas produksi.

Apakah saya memerlukan GPU yang kuat untuk menjalankan SuperAGI?

Tidak. SuperAGI memanggil penyedia LLM melalui API secara default, sehingga inferensi terjadi di server mereka. Anda hanya memerlukan sekitar 3 hingga 4 GB RAM untuk container Docker. Opsi GPU hanya relevan jika Anda ingin menjalankan LLM lokal.

Apa cara termurah untuk bereksperimen dengan SuperAGI?

Gunakan model terjangkau seperti gpt-3.5-turbo atau API gratis seperti Groq (yang menawarkan akses gratis ke model Llama). Setel iterasi maksimum ke 10–15 dan mulailah dengan agen satu alat yang sederhana. Pantau penggunaan token melalui dasbor APM. Perhatikan bahwa HuggingFace Inference API memiliki masalah kompatibilitas dengan ekspektasi format OpenAI milik SuperAGI, jadi tetaplah menggunakan penyedia yang kompatibel dengan OpenAI.