Courses

Các framework tác tử AI tự động được thiết kế cho những hệ thống có khả năng suy luận qua nhiều bước, tự chọn công cụ và thực thi hành động thay người dùng với ít can thiệp thủ công hơn. SuperAGI triển khai điều này thông qua vòng lặp kiểu ReAct và một lớp điều phối ưu tiên GUI.

SuperAGI là một trong những framework mã nguồn mở đầu tiên được thiết kế riêng cho mục đích này. Nó cung cấp cho nhà phát triển một nền tảng để xây dựng, quản lý và chạy các tác tử AI theo mục tiêu qua giao diện web, đi kèm giám sát tích hợp, chợ công cụ và hỗ trợ nhiều mô hình ngôn ngữ lớn (LLM).

Trong hướng dẫn này, tôi sẽ giải thích SuperAGI là gì, đi qua kiến trúc và tính năng, chỉ bạn cách cài đặt bằng Docker, và so sánh với AutoGPT và LangChain. Tôi cũng sẽ đề cập đến những điểm mạnh, hạn chế và liệu nó có phù hợp để dùng trong môi trường sản xuất hay không.

Một lưu ý quan trọng trước khi bắt đầu: SuperAGI với tư cách là framework mã nguồn mở và SuperAGI với tư cách là công ty hiện không còn là cùng một câu chuyện. Công ty đã chuyển hướng sang sản phẩm SaaS thương mại tập trung vào công cụ bán hàng dùng AI, và kho mã nguồn mở gần như không hoạt động kể từ 2024. Bài viết này tập trung vào framework mã nguồn mở. Tôi sẽ đề cập trạng thái bảo trì hiện tại trong suốt bài để bạn có thể đưa ra quyết định sáng suốt về việc sử dụng.

SuperAGI là gì?

SuperAGI là một framework tác tử AI tự động, định hướng nhà phát triển, mã nguồn mở theo giấy phép MIT. Nó được tạo bởi TransformerOptimus và đã tích lũy hàng nghìn sao GitHub và hơn 2.000 lượt fork kể từ khi ra mắt năm 2023. Dự án chủ yếu viết bằng Python (khoảng 70%) với JavaScript cho frontend (khoảng 25%).

Ý tưởng cốt lõi như sau: SuperAGI không phải là một mô hình. Nó là lớp điều phối nằm giữa bạn, một LLM và các công cụ bạn muốn tác tử sử dụng. Bạn định nghĩa mục tiêu cho tác tử, gán công cụ (như tìm kiếm web, quản lý tệp hoặc tích hợp GitHub), chọn nhà cung cấp LLM, rồi tác tử sẽ tự động suy luận qua nhiệm vụ, chọn công cụ phù hợp ở mỗi bước và lặp lại cho đến khi hoàn thành mục tiêu hoặc chạm giới hạn số vòng lặp.

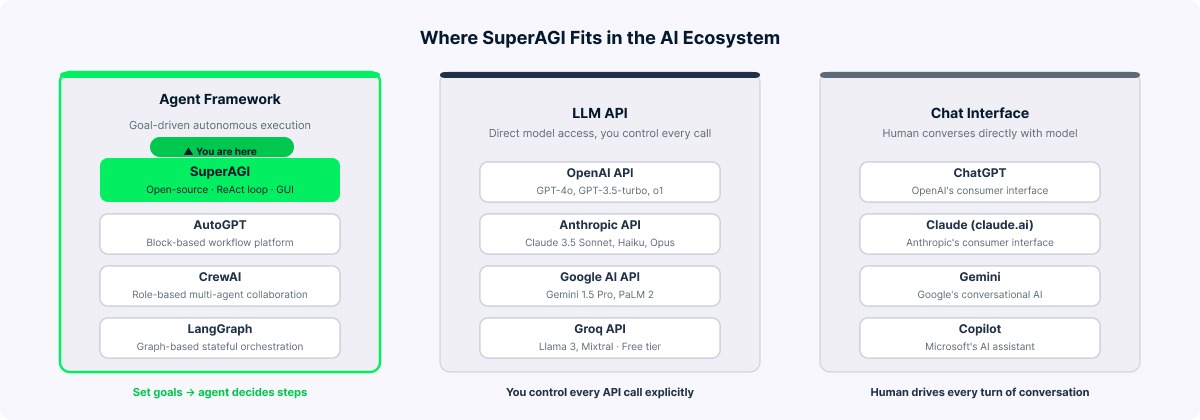

Ba điều cần hiểu ngay từ đầu về vị trí của SuperAGI trong hệ sinh thái.

Một framework tác tử (như SuperAGI, AutoGPT hoặc CrewAI) điều phối việc thực thi nhiệm vụ tự động bằng cách kết hợp LLM với công cụ. Một API LLM (như OpenAI API hoặc Anthropic API) cung cấp quyền truy cập mô hình thô để sinh văn bản, và bạn kiểm soát mọi lời gọi. Giao diện chat (như ChatGPT hoặc Claude) là lớp hội thoại hướng người dùng nơi con người tương tác trực tiếp với mô hình.

SuperAGI nằm ở cấp độ framework. Bạn đặt mục tiêu, và tác tử quyết định phải làm gì. Điều này khác căn bản với việc trò chuyện với mô hình hay gọi API trực tiếp.

Giải thích SuperAGI như một framework tác tử. Ảnh: Tác giả.

Các tính năng cốt lõi của SuperAGI

Giờ khi bạn đã hiểu SuperAGI là gì và khác với các công cụ đơn giản hơn như thế nào, đây là những gì nó thực sự cung cấp bên dưới.

-

Tác tử tự động. Bạn cung cấp cho tác tử các mục tiêu, hướng dẫn, công cụ và ràng buộc cụ thể. Có ba loại tác tử: Mặc định (chu trình suy nghĩ - thực thi đơn), Hàng đợi Nhiệm vụ Cố định (phân rã mục tiêu thành các nhiệm vụ con theo thứ tự), và Hàng đợi Nhiệm vụ Động (tác tử có thể thêm nhiệm vụ mới trong quá trình thực thi khi phát hiện yêu cầu).

-

Hệ thống tích hợp công cụ. SuperAGI bao gồm một bộ toolkit tích hợp rộng, gồm Google Search, DuckDuckGo, Web Scraper, File Manager, GitHub, Jira, Twitter, Notion, Google Calendar, DALL-E, Bộ công cụ Lập trình và công cụ Knowledge Search dùng cơ sở dữ liệu vector. Các toolkit do cộng đồng đóng góp cho các dịch vụ như Slack, Instagram hoặc những dịch vụ tạo ảnh khác cũng có thể khả dụng tùy cấu hình cụ thể. Tôi sẽ nói kỹ hơn về tích hợp công cụ ở phần sau.

-

GUI trên nền web. Giao diện Next.js truy cập tại

localhost:3000cung cấp tạo tác tử, gán công cụ, luồng hoạt động thời gian thực, cấu hình nhà cung cấp mô hình, lập lịch tác tử và duyệt chợ công cụ. -

Giám sát Hiệu năng Tác tử (APM). Giới thiệu ở phiên bản 0.0.8, bảng điều khiển APM là một khác biệt thực sự của SuperAGI. Nó cung cấp số liệu cấp tổ chức (tổng số tác tử, token tiêu thụ, tổng số lượt chạy), phân tách theo mô hình (tác tử, lượt chạy và token theo LLM), và phân tích cấp tác tử (token trung bình mỗi lượt chạy, tổng số cuộc gọi API và thời gian chạy). Thẻ số liệu có thể sắp xếp lại cho phép bạn tùy chỉnh bố cục bảng điều khiển.

-

Điều phối đa tác tử. Bạn có thể chạy nhiều tác tử đồng thời, mỗi cái cấu hình mục tiêu, công cụ và mô hình LLM khác nhau, tất cả được quản lý qua GUI thống nhất.

-

Action Console. Đây là tính năng có con người trong vòng lặp. Ở chế độ quyền hạn chế, tác tử tạm dừng trước khi thực hiện hành động quan trọng (như gửi email hoặc ghi tệp) và chờ bạn phê duyệt qua Action Console. Điều này giúp bạn có cổng an toàn cho các thao tác nhạy cảm.

-

Hỗ trợ cơ sở dữ liệu vector. SuperAGI hỗ trợ Weaviate, Pinecone và Qdrant cho bộ nhớ dài hạn qua vector embedding. Ngữ cảnh ngắn hạn được duy trì trong phiên thực thi của tác tử, trong khi kiến thức dài hạn tồn tại qua nhiều lần chạy trong cơ sở dữ liệu vector.

-

Marketplace. Chợ do cộng đồng vận hành lưu trữ công cụ, toolkit, mẫu tác tử, embedding kiến thức và mô hình. Bạn có thể duyệt và cài đặt trực tiếp từ GUI.

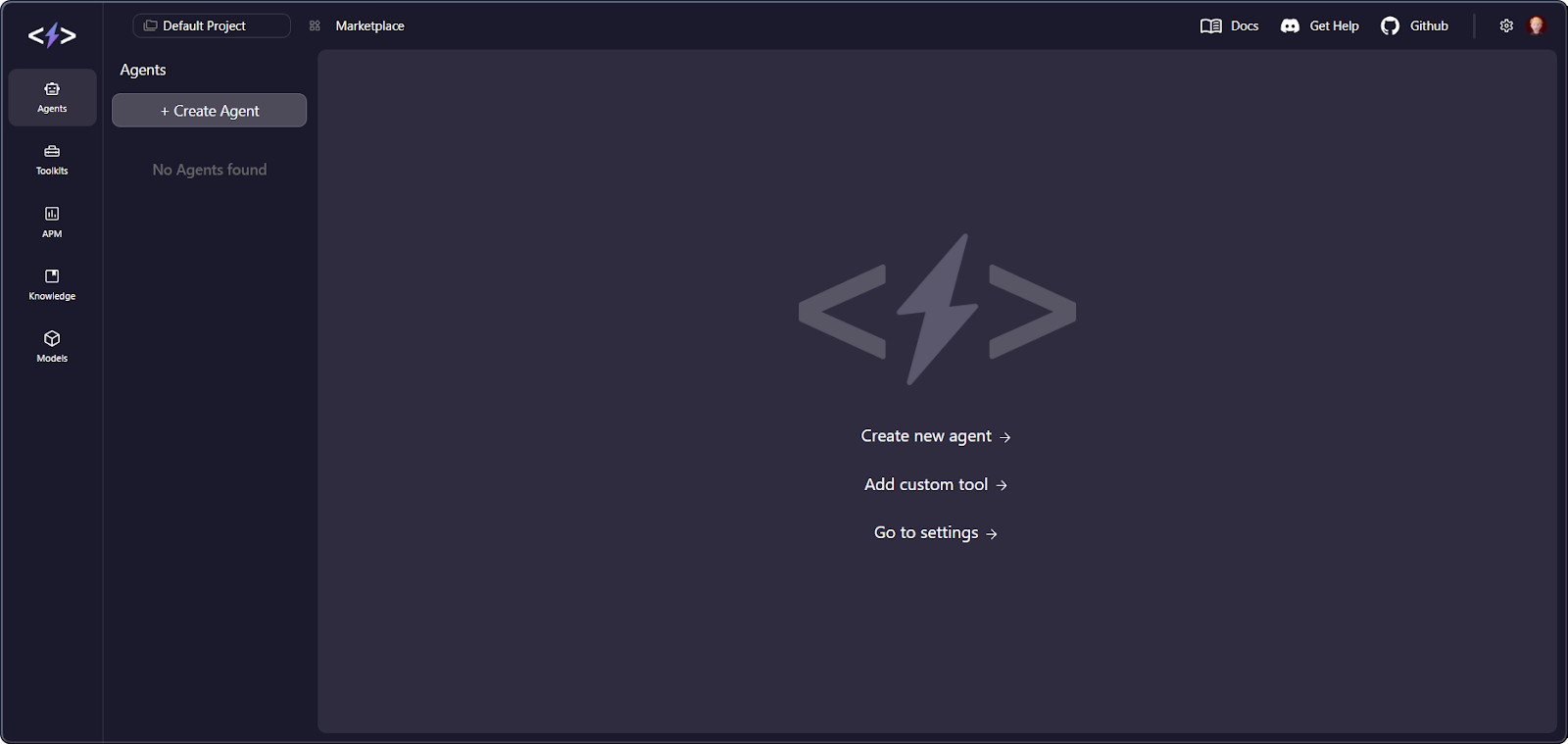

Bảng điều khiển cốt lõi của SuperAGI với số liệu APM. Ảnh: Tác giả.

Cách SuperAGI hoạt động: Tổng quan kiến trúc

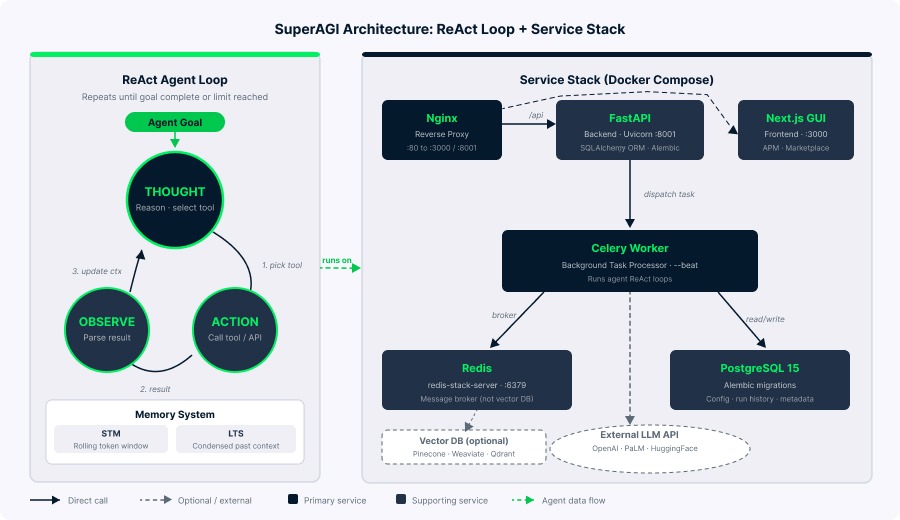

Một hiểu lầm phổ biến trong các bài bên thứ ba là SuperAGI dùng vòng lặp "lập kế hoạch, thực thi, phản tư, lặp lại". Cách diễn đạt đó hay gặp, nhưng triển khai thực tế giống với mẫu ReAct (Reason + Act) hơn. SuperAGI triển khai vòng lặp Suy nghĩ → Hành động → Quan sát, nơi tác tử suy xét trạng thái hiện tại, chọn công cụ, quan sát kết quả và lặp lại. ReAct là mẫu tác tử trong đó mô hình luân phiên giữa các bước lý luận ("Suy nghĩ") và gọi công cụ ("Hành động") được dẫn dắt bởi các quan sát.

Ngăn xếp công nghệ, được xác minh từ docker-compose.yaml và mã nguồn, phân rã như sau:

|

Thành phần |

Công nghệ |

|

Web framework |

FastAPI |

|

Hàng đợi tác vụ |

Celery |

|

Trung gian thông điệp |

Redis (redis-stack-server) |

|

Cơ sở dữ liệu |

PostgreSQL 15 |

|

ORM |

SQLAlchemy |

|

Di trú CSDL |

Alembic |

|

Frontend |

Next.js |

|

Reverse proxy |

Nginx |

|

Ngôn ngữ |

Python |

Backend dùng Uvicorn ở cổng 8001, với Nginx chuyển hướng /api đến backend và các đường dẫn khác đến GUI Next.js. Celery xử lý tác vụ nền với --beat cho các hoạt động theo lịch. PostgreSQL lưu cấu hình tác tử, lịch sử chạy và metadata. Ở cấu hình mặc định, Redis chủ yếu đóng vai trò trung gian thông điệp cho Celery, không phải cơ sở dữ liệu vector, trái với một số tuyên bố bên thứ ba.

Về bộ nhớ, SuperAGI dùng hệ hai phần. Bộ nhớ ngắn hạn (STM) là cửa sổ cuộn dựa trên giới hạn token của LLM, trong khi tóm tắt dài hạn (LTS) là bản tóm tắt cô đọng bối cảnh nằm ngoài cửa sổ STM. Kết hợp lại, chúng tạo thành Tóm tắt Tác tử cung cấp cho mỗi bước suy luận. Cơ sở dữ liệu vector xử lý embedding kiến thức riêng.

Kiến trúc SuperAGI với vòng lặp tác tử ReAct. Ảnh: Tác giả.

Thiết lập SuperAGI

Trước khi bắt đầu, hãy đảm bảo bạn có Docker Desktop, Git và quyền truy cập ít nhất một nhà cung cấp LLM được hỗ trợ (ví dụ, một khóa API OpenAI). Hãy dự kiến toàn bộ stack dùng khoảng 3 đến 4 GB RAM. Nếu dùng Windows, bạn cũng cần bật WSL2.

Cài đặt SuperAGI với Docker

Docker là phương pháp cài đặt được khuyến nghị và đáng tin cậy nhất. Quy trình gồm vài bước rõ ràng.

Clone và cấu hình

Các bước như sau:

# Clone the repository

git clone https://github.com/TransformerOptimus/SuperAGI.git

# Navigate into the project directory

cd SuperAGI

# Copy the configuration template

cp config_template.yaml config.yamlMở config.yaml bằng trình soạn thảo và cấu hình nhà cung cấp LLM của bạn. Với OpenAI, đặt OPENAI_API_KEY. Nhập khóa không có dấu ngoặc kép hoặc khoảng trắng dư thừa:

# LLM Provider (choose one or more)

OPENAI_API_KEY: sk-your-openai-key-here

# PALM_API_KEY: your-palm-key-here

# HUGGING_FACE_API_KEY: your-hf-key-here

# Optional: for Google Search tool

GOOGLE_API_KEY: your-google-key

SEARCH_ENGINE_ID: your-cse-id

# Optional: for Pinecone vector DB

PINECONE_API_KEY: your-pinecone-keyBuild và khởi động container

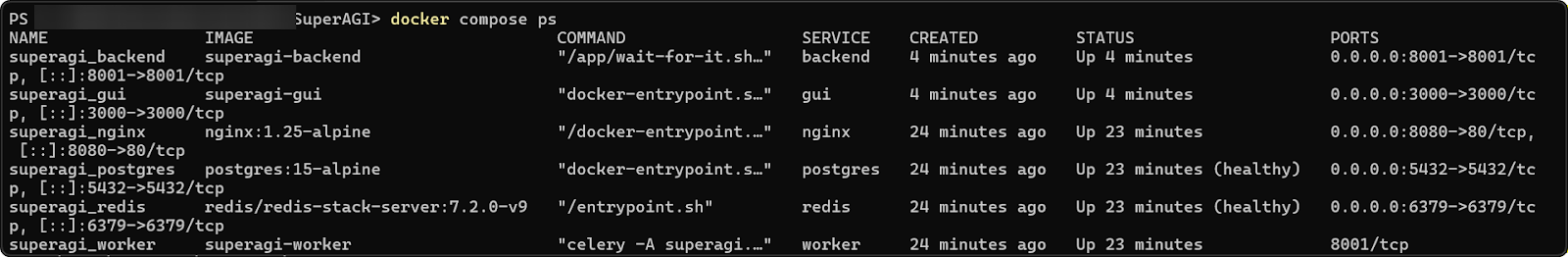

Giờ hãy build và khởi chạy các container:

# Build and start all services

docker compose -f docker-compose.yaml up --buildLần build đầu mất khoảng 10 đến 15 phút. Khi cả sáu container đang chạy (backend, celery, gui, redis, postgres và nginx), mở http://localhost:3000 trong trình duyệt của bạn (cổng mặc định cấu hình trong compose cho GUI qua Nginx).

Các container Docker của SuperAGI đã build thành công. Ảnh: Tác giả.

Xác minh cài đặt

Để xác minh mọi thứ hoạt động, chạy docker compose ps và đảm bảo cả sáu container được liệt kê. Sau đó truy cập localhost:3000, vào Settings và xác nhận cấu hình khóa API của bạn được nhận diện.

Lỗi thường gặp và cách khắc phục

Kho chính thức có một số vấn đề đã biết mà bạn có thể gặp. Dưới đây là những lỗi phổ biến nhất và cách sửa.

Docker daemon không chạy: Hãy chắc Docker Desktop đang hoạt động trước khi chạy lệnh compose.

Lỗi Celery "Unable to load application": Kiểm tra kỹ tệp của bạn tên chính xác là config.yaml chứ không phải config_template.yaml, sau đó build lại với docker compose down && docker compose up --build.

Lỗi khóa mã hóa: Nếu bạn thấy ValueError: Encryption key must be 32 bytes long, hãy đảm bảo ENCRYPTION_KEY trong config.yaml dài đúng 32 ký tự và được đặt trong dấu ngoặc kép:

ENCRYPTION_KEY: "abcdefghijklmnopqrstuvwxyz123456"

JWT_SECRET_KEY: "your-jwt-secret-key-change-this"JavaScript heap out of memory (container GUI): Nếu GUI build thất bại, container Next.js cần thêm bộ nhớ. Thêm vào service gui trong docker-compose.yaml:

gui:

environment:

NODE_OPTIONS: "--max-old-space-size=1024"

deploy:

resources:

limits:

memory: 1gQuyền cổng 80 bị từ chối (Windows): Windows yêu cầu quyền admin cho cổng 80. Hãy đổi ánh xạ cổng Nginx trong docker-compose.yaml:

nginx:

ports:

- "8080:80" # Access via localhost:8080 insteadLỗi định dạng URL Redis: Nếu bạn thấy ValueError: invalid literal for int() liên quan Redis, hãy bỏ tiền tố redis:// khỏi REDIS_URL trong config.yaml:

REDIS_URL: "redis:6379" # Not redis://redis:6379/0Vòng lặp khởi động lại container backend: Nếu backend liên tục khởi động lại mà không có log lỗi, có thể thiếu lệnh khởi chạy. Kiểm tra docker-compose.yaml bao gồm entrypoint phù hợp.

Xung đột cổng: Nếu cổng 3000 hoặc 8080 đã được dùng, hãy sửa ánh xạ cổng trong docker-compose.yaml sang cổng khác.

Hỗ trợ GPU

Để hỗ trợ LLM cục bộ tăng tốc GPU (thêm ở v0.0.14), hãy dùng file compose riêng:

docker compose -f docker-compose-gpu.yml up --buildYêu cầu GPU NVIDIA với NVIDIA Container Toolkit được cấu hình để Docker hỗ trợ runtime GPU.

Cài đặt SuperAGI thủ công (thiết lập cho nhà phát triển)

Phương pháp này không được khuyến nghị chính thức nhưng phù hợp cho phát triển và gỡ lỗi. Bạn sẽ cần thiết lập backend và frontend riêng.

Thiết lập backend

# Clone and enter the directory

git clone https://github.com/TransformerOptimus/SuperAGI.git

cd SuperAGI

# Create and activate a virtual environment

pip install virtualenv

virtualenv venv

source venv/bin/activate # Windows: venv\Scripts\activate

# Install Python dependencies

pip install -r requirements.txt

# Copy and edit config

cp config_template.yaml config.yaml

# Edit config.yaml: set POSTGRES_URL to localhost, REDIS_URL to localhost:6379

# Start the backend

./run.sh # Windows: .\run.batLưu ý rằng các phụ thuộc Python được ghim ở phiên bản cũ (openai==0.27.7, FastAPI==0.95.2), có thể gây xung đột trong môi trường hiện đại. Cách ly môi trường ảo là điều bắt buộc.

Thiết lập frontend

Với frontend, điều hướng đến ./gui và chạy npm install && npm run dev. Bạn phải tự tạo cơ sở dữ liệu PostgreSQL tên super_agi_main với người dùng superagi và mật khẩu password. Bạn cũng cần chạy Redis riêng.

Tạo và quản lý tác tử trong SuperAGI

Khi đã cài đặt SuperAGI, hãy cùng xem cách tạo và chạy tác tử đầu tiên của bạn.

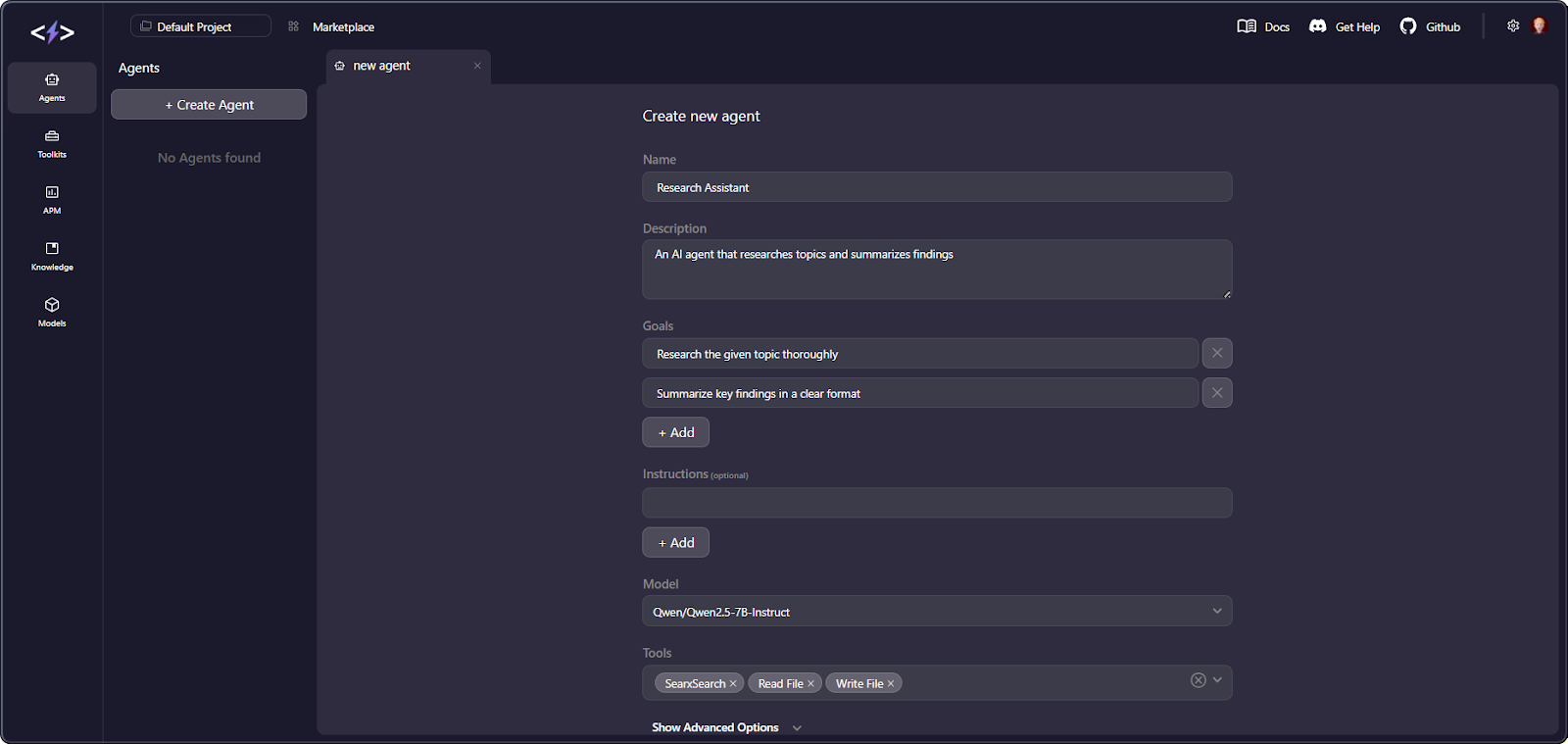

Cấu hình tác tử

Khi SuperAGI đang chạy, điều hướng đến tab Agents trong GUI và nhấp "Create Agent." Màn hình cấp phát yêu cầu: tên, mô tả, mục tiêu (chuỗi văn bản định nghĩa tác tử cần làm gì), hướng dẫn, ràng buộc, công cụ được gán, mô hình LLM dùng và giới hạn số vòng lặp tối đa.

Giới hạn vòng lặp và kiểm soát chi phí

Thiết lập số vòng lặp tối đa là cơ chế kiểm soát chi phí và an toàn chính của bạn. Mỗi vòng lặp kích hoạt ít nhất một cuộc gọi LLM, và tác tử phức tạp có thể tiêu thụ token nhanh. Bắt đầu với con số thấp (10 đến 15) khi học, rồi tăng dần khi bạn hiểu hành vi của tác tử.

Chế độ quyền

Có hai chế độ quyền. "God Mode" cho phép tác tử thực thi tự do. Chế độ hạn chế tạm dừng trước các hành động quan trọng và yêu cầu bạn phê duyệt qua Action Console. Với người mới, bắt đầu bằng chế độ hạn chế là thói quen tốt.

Chạy và giám sát tác tử

Sau khi cấu hình tác tử, bạn có thể khởi chạy và theo dõi tiến độ theo thời gian thực.

Khi đã tạo, nhấp "Create and Run." Activity Feed cung cấp tầm nhìn theo thời gian thực về lý luận, lựa chọn công cụ và đầu ra của tác tử. Bạn có thể tạm dừng, tiếp tục hoặc dừng tác tử bất kỳ lúc nào. Bảng điều khiển APM, như tôi đã đề cập, tổng hợp số liệu trên tất cả tác tử và lượt chạy để có góc nhìn cao hơn.

Tạo tác tử mới trong giao diện SuperAGI. Ảnh: Tác giả.

Truy cập lập trình

Nếu bạn thích làm việc bằng mã thay vì GUI, SuperAGI cũng đáp ứng.

SuperAGI còn cung cấp SDK Python và Node.js với các thao tác CRUD trên tác tử giống như GUI (xem tài liệu chính thức để biết ví dụ sử dụng).

Tích hợp công cụ trong SuperAGI

Công cụ là cách tác tử tương tác với thế giới bên ngoài. Bạn gán các công cụ cụ thể khi tạo tác tử, và LLM sẽ quyết định dùng công cụ nào trong quá trình thực thi dựa trên nhiệm vụ.

SuperAGI cung cấp sẵn một bộ công cụ tích hợp tốt và cho phép bạn tạo công cụ tùy chỉnh. Đây là những gì bạn nhận được ngay khi cài đặt.

Các toolkit tích hợp sẵn

Sau đây là tóm tắt các toolkit chính tích hợp sẵn:

|

Toolkit |

Mô tả |

Cần API Key? |

|

Google Search |

Tìm kiếm web qua Google Custom Search API |

Có |

|

DuckDuckGo |

Tìm kiếm web chú trọng quyền riêng tư |

Không |

|

Coding Toolkit |

WriteCode, WriteSpec, WriteTest, ImproveCode |

Không |

|

File Manager |

Đọc, ghi, nối, xóa tệp |

Không |

|

Web Scraper |

Trích xuất dữ liệu từ trang web |

Không |

|

GitHub |

Tìm kiếm kho, thao tác tệp, pull request |

Có |

|

Jira |

Quản lý issue (CRUD) |

Có |

|

|

Gửi email kèm tệp đính kèm |

Có |

|

DALL-E |

Tạo ảnh qua OpenAI |

Có |

|

Knowledge Search |

Tìm kiếm ngữ nghĩa trên embedding vector |

Không (cần CSDL vector) |

|

Thinking Tool |

Lý luận nội bộ với hỗ trợ bộ nhớ dài hạn |

Không |

Công cụ tùy chỉnh

Ngoài các tùy chọn tích hợp, bạn có thể mở rộng SuperAGI bằng toolkit riêng.

Để tạo công cụ tùy chỉnh, bạn cài gói superagi-tools, mở rộng các lớp BaseTool và BaseToolkit, định nghĩa schema đầu vào bằng Pydantic, và đăng ký toolkit qua URL repo GitHub trong GUI. Sau khi thêm toolkit tùy chỉnh, build lại với docker compose down && docker compose up --build.

Cân nhắc bảo mật cho quyền truy cập công cụ

Quyền truy cập công cụ mang đến rủi ro bảo mật cần chú ý cẩn trọng.

Một lời cảnh báo về quyền truy cập công cụ không hạn chế: một tác tử có quyền email và web về lý thuyết có thể bị khai thác qua prompt injection để rò rỉ dữ liệu. Quyền ghi tệp mà không sandbox có thể dẫn đến chỉnh sửa ngoài ý muốn. Luôn dùng chế độ hạn chế và chỉ gán công cụ cần thiết cho mục tiêu cụ thể của từng tác tử.

SuperAGI so với AutoGPT

Đây là một so sánh có giá trị vì cả hai framework nhắm đến cùng không gian vấn đề, nhưng đã khác biệt đáng kể.

|

Khía cạnh |

SuperAGI |

AutoGPT |

|

Cộng đồng GitHub |

Hàng nghìn sao |

Cộng đồng lớn hơn đáng kể |

|

Bản phát hành mới nhất |

v0.0.14 (Tháng 1/2024) |

Phát hành liên tục đến 2025 |

|

Trạng thái bảo trì |

Hoạt động tối thiểu từ 2024 |

Phát triển tích cực |

|

Kiến trúc |

Framework tác tử ReAct |

Nền tảng workflow dạng khối |

|

Giao diện |

Bảng điều khiển web tích hợp với APM |

Trình dựng kéo-thả Next.js |

|

Khả năng quan sát |

APM tích hợp (trưởng thành hơn) |

Bảng điều khiển với tích hợp Sentry |

|

Hỗ trợ LLM |

OpenAI, PaLM 2, HuggingFace, Replicate, local |

OpenAI, Anthropic, Groq, Ollama và khác |

|

Giấy phép |

MIT |

Kép (MIT + Polyform Shield) |

So sánh hiện tại vào đầu năm 2026. Bạn có thể kiểm tra các kho tương ứng để cập nhật mới nhất.

Khác biệt chính mang tính triết lý. SuperAGI là framework tác tử định hướng nhà phát triển, nơi bạn đặt mục tiêu và tác tử tự tìm ra các bước. AutoGPT đã phát triển thành nền tảng workflow low-code nơi người dùng kết nối các khối trực quan. SuperAGI cung cấp khả năng quan sát tích hợp trưởng thành hơn thông qua bảng APM, nhưng AutoGPT có cộng đồng lớn hơn nhiều, phát triển tích cực và hỗ trợ LLM rộng hơn. Cả hai đều có xu hướng thiếu ổn định ở chế độ tự động mở.

Với các dự án mới ngày nay, AutoGPT thường là lựa chọn được bảo trì tích cực hơn. Nếu bạn muốn nghiên cứu kiến trúc tác tử sạch hoặc cần APM tích hợp cho nghiên cứu, SuperAGI vẫn có giá trị như công cụ học tập.

SuperAGI so với LangChain

Việc mô tả "SuperAGI là framework tác tử tự động còn LangChain là bộ công cụ ứng dụng LLM" là chính xác.

|

Khía cạnh |

SuperAGI |

LangChain |

|

Mục đích chính |

Framework tác tử tự động |

Bộ công cụ điều phối LLM |

|

Mức trừu tượng |

Cao (lấy tác tử làm trung tâm, theo mục tiêu) |

Thấp hơn (lấy chuỗi làm trung tâm, luồng tường minh) |

|

Đa tác tử |

Hỗ trợ gốc |

Qua phần mở rộng LangGraph |

|

Giao diện trực quan |

UI web tích hợp |

Không (LangSmith cho giám sát) |

|

Hỗ trợ CSDL vector |

3 (Pinecone, Weaviate, Qdrant) |

Hơn 15 tích hợp |

|

Tài liệu |

Có thiếu sót, cần đọc mã nguồn |

Phong phú với ví dụ |

|

Cài đặt |

Docker Compose (thiết lập nặng) |

pip install (nhẹ) |

|

Độ ổn định sản xuất |

Thấp hơn, mang tính thử nghiệm |

Cao hơn, trưởng thành hơn |

Khi nào chọn mỗi bên: dùng LangChain khi bạn cần kiểm soát chính xác từng tương tác LLM, cho RAG, giao diện hội thoại hoặc xử lý tài liệu. Dùng SuperAGI khi bạn muốn tác tử vận hành độc lập với can thiệp tối thiểu, ưa thích quản trị trực quan thay vì mã hoặc muốn hỗ trợ đa tác tử tích hợp với GUI.

LangChain và LangGraph đều đạt v1.0 vào tháng 10/2025, với LangGraph cung cấp điều phối tác tử dựa trên đồ thị cấp sản xuất với workflow có trạng thái và khả năng quan sát sâu qua LangSmith. Với các dự án sản xuất mới, LangGraph nhìn chung là con đường trưởng thành hơn.

Trường hợp sử dụng cho SuperAGI

Dưới đây là nơi SuperAGI hoạt động tốt nhất, dựa trên ví dụ được ghi nhận và cách dùng của cộng đồng.

- Tự động hóa tác vụ. Tác tử có thể xử lý quy trình email, thao tác tệp và tìm kiếm web theo lịch. Tính năng lập lịch tích hợp (mỗi tác tử một lịch) giúp tác vụ định kỳ trở nên đơn giản.

- Trợ lý nghiên cứu. Kết hợp tìm kiếm web, tìm kiếm kiến thức và công cụ xuất tệp để tạo tác tử có thể thu thập thông tin từ nhiều nguồn và biên soạn đầu ra có cấu trúc.

- Năng suất cho nhà phát triển. Các toolkit GitHub và Jira cho phép xử lý issue tự động, review PR và sinh mã. Bộ công cụ Lập trình (WriteCode, WriteSpec, WriteTest, ImproveCode) hỗ trợ workflow phát triển đầu-cuối.

- Sáng tạo nội dung. Kết hợp DALL-E để tạo ảnh với công cụ văn bản nhằm tạo tác tử cho quy trình nội dung đa phương tiện. Các toolkit cộng đồng cho dịch vụ tạo ảnh khác cũng có thể khả dụng.

- Quản lý mạng xã hội. Toolkit Twitter cho phép đăng bài tự động với hỗ trợ media, dù phụ thuộc vào API bên ngoài. Các toolkit cộng đồng khác có thể khả dụng cho nền tảng khác tùy thiết lập của bạn.

- Lưu ý rằng bằng chứng về mức độ tiếp nhận trong doanh nghiệp còn mỏng. Marketing của SuperAGI tham chiếu các công ty nổi tiếng, nhưng hãy coi đây là công cụ cho thử nghiệm, tạo mẫu và học tập hơn là giải pháp sẵn sàng sản xuất.

Hạn chế của SuperAGI

Dự án đang đình trệ. Bản phát hành có thẻ gần nhất (v0.0.14) ra mắt tháng 1/2024. Commit cuối lên main là bản vá bảo mật tháng 1/2025. Hoạt động phát triển giảm mạnh sau 2023, với ít tính năng mới kể từ đó. Nhiều issue mới dường như chưa được trả lời trên trình theo dõi công khai.

Rủi ro ảo giác của LLM tăng lên trong vòng lặp tác tử. Khi tác tử tự chủ quyết định dựa trên đầu ra LLM, tham số công cụ bị ảo giác hoặc dữ kiện bịa đặt có thể dây chuyền thành hành động thực. Một tác tử nhiều bước chạy mười chu kỳ có thể tiêu tốn nhiều token hơn đáng kể so với một lượt tuyến tính, làm khuếch đại cả chi phí và rủi ro lỗi.

Tác tử thường bị kẹt. Nhiều issue trên GitHub báo cáo tác tử mắc kẹt ở trạng thái "Thinking" trong thời gian dài mà không tiến triển. Giới hạn vòng lặp cung cấp điểm dừng cứng, nhưng tác tử có thể tiêu tốn tài nguyên đáng kể trước khi chạm giới hạn.

Tài liệu còn thiếu. Ngay cả trước khi một số trang tài liệu ngoại tuyến do công ty chuyển hướng thương mại, tài liệu đã kém toàn diện hơn đối thủ như LangChain. Làm việc với SuperAGI thường cần đọc trực tiếp mã nguồn.

Chi phí token tăng nhanh. Mỗi bước trong vòng lặp ReAct yêu cầu ít nhất một cuộc gọi LLM. Tùy độ phức tạp nhiệm vụ, tổng chi phí có thể tăng nhanh hơn các triển khai chuỗi đơn giản.

Công ty đã chuyển hướng. Như đã đề cập, công ty chuyển sang sản phẩm SaaS. Website superagi.com không còn làm nổi bật dự án mã nguồn mở, và một số trang tài liệu giờ trả về lỗi 404.

Các cân nhắc bảo mật

Bảo mật là nơi SuperAGI bộc lộ sự lạc hậu. Hệ thống agentic khuếch đại tác động của lỗ hổng, vì vậy những vấn đề này quan trọng hơn so với ứng dụng truyền thống. Dưới đây là điều bạn cần biết trước khi dùng.

Bí mật và cấu hình

API key được lưu ở dạng văn bản thuần trong config.yaml mà không có mã hóa, tích hợp vault hay cơ chế xoay vòng. Trường ENCRYPTION_KEY và JWT_SECRET_KEY đi kèm giá trị giữ chỗ kém an toàn cần phải thay trước khi triển khai ngoài máy cục bộ.

Cách ly thực thi

Container Docker cung cấp cách ly tiến trình cơ bản, nhưng không có sandbox nâng cao. Tác tử có quyền truy cập mạng không hạn chế và có thể ghi vào hệ thống tệp mà không có kiểm soát. Với triển khai an toàn hơn, hướng dẫn sandbox của NVIDIA khuyến nghị hạn chế truy cập mạng và ghi hệ thống tệp, những điều mà SuperAGI chưa triển khai.

Lỗ hổng đã biết

Nhiều lỗ hổng mức nghiêm trọng cao (bao gồm thực thi mã từ xa và lộ cấu hình) đã được công bố công khai nhưng vẫn chưa được vá do dự án không hoạt động. Báo cáo được ghi lại trên hunter, một nền tảng công bố lỗ hổng. Các vấn đề bổ sung như SSRF, ghi tệp tùy ý và cấu hình sai CORS cũng đã được nêu.

Nếu bạn phụ thuộc vào SuperAGI, hãy kiểm tra các fork cộng đồng để tìm bản vá và luôn kiểm toán bất kỳ fork nào trước khi sử dụng.

Rủi ro prompt injection

Tấn công prompt injection trở nên đặc biệt nguy hiểm khi tác tử có thể thực thi hành động ngoài đời thực. SuperAGI dễ bị tổn thương trước cả injection trực tiếp và gián tiếp; hướng dẫn độc hại trong trang web được quét có thể chiếm quyền điều khiển hành vi tác tử. Hãy coi mọi đầu ra công cụ không tin cậy (đặc biệt là nội dung web) là vector tấn công tiềm ẩn.

SuperAGI không có biện pháp phòng vệ được ghi nhận nào ngoài cổng phê duyệt thủ công của Action Console, vì vậy hãy luôn dùng chế độ quyền hạn chế.

Khuyến nghị triển khai

Nếu bạn triển khai SuperAGI vượt ra ngoài thử nghiệm cục bộ, hãy thực hiện tối thiểu các biện pháp này: thay toàn bộ bí mật mặc định, chạy sau lớp xác thực (VPN hoặc reverse proxy), dùng chế độ quyền hạn chế và chỉ gán công cụ cần thiết cho từng tác tử.

SuperAGI đã sẵn sàng cho sản xuất chưa?

Dựa trên trạng thái bảo trì và bảo mật hiện tại, nó không đáp ứng các tiêu chí sẵn sàng sản xuất thông thường. Bản thân SuperAGI cũng thừa nhận điều này: README trên GitHub nêu rõ dự án "đang được phát triển tích cực và có thể còn lỗi."

Đánh giá dài hơn có sắc thái hơn. Số phiên bản trước 1.0 (v0.0.14) báo hiệu trạng thái thử nghiệm. Hoạt động phát triển cho thấy đỉnh điểm vào giữa 2023 rồi sau đó giảm tối thiểu. Nhiều lỗ hổng bảo mật đã được báo cáo với phản hồi công khai hạn chế, và việc công ty chuyển hướng sang sản phẩm thương mại đồng nghĩa hiện không có lộ trình rõ ràng cho đầu tư trở lại vào framework mã nguồn mở.

Bảng điều khiển APM là điểm sáng thực sự. Nó trưởng thành hơn so với nhiều đối thủ cung cấp sẵn và vẫn là khác biệt thật sự của SuperAGI cho các nhóm nghiên cứu tác tử.

Kết luận

SuperAGI đi tiên phong một số ý tưởng ảnh hưởng đến hệ sinh thái tác tử: APM tích hợp, chợ công cụ và quản lý ưu tiên GUI.

Tuy nhiên, thực tế năm 2026 là dự án SuperAGI đã đình trệ. Công ty đã chuyển hướng, lỗ hổng bảo mật chưa được xử lý và không thấy phát triển mới. Cho công việc sản xuất, các lựa chọn được bảo trì tích cực như LangGraph, CrewAI và Microsoft Agent Framework là tốt hơn.

Bước tiếp theo, hãy xem khóa học Giới thiệu về AI Agents của chúng tôi hoặc hướng dẫn về xây dựng AI cục bộ với Docker và n8n.

Tôi là một kỹ sư dữ liệu và người xây dựng cộng đồng, làm việc với pipeline dữ liệu, đám mây và công cụ AI, đồng thời viết các hướng dẫn thực hành, tác động cao cho DataCamp và các nhà phát triển mới nổi.

FAQs

Tôi còn có thể dùng SuperAGI vào năm 2026 không, hay nó coi như không còn được duy trì?

Có, mã nguồn vẫn hoạt động. Bạn có thể clone, chạy bằng Docker và xây dựng tác tử. Tuy nhiên, dự án không còn được duy trì: không có bản phát hành nào kể từ tháng 1/2024 và các issue không được trả lời. Rất phù hợp để học kiến trúc tác tử, nhưng tránh dùng trong sản xuất do lỗ hổng bảo mật chưa được vá.

Người mới có nên học SuperAGI không?

Nếu bạn muốn hiểu cách tác tử tự động vận hành bên dưới, thì nên. Mã nguồn của SuperAGI sạch và có cấu trúc tốt. Vòng lặp ReAct, tích hợp công cụ và bảng APM là ví dụ học tập tuyệt vời. Nhưng nếu mục tiêu của bạn là xây dựng ứng dụng sản xuất, hãy bắt đầu với LangGraph hoặc CrewAI. Chúng có tài liệu tốt hơn, cộng đồng năng động và tính năng sẵn sàng sản xuất.

SuperAGI so với các framework mới như CrewAI thì thế nào?

CrewAI tập trung vào cộng tác đa tác tử theo vai trò và được duy trì tích cực với cập nhật thường xuyên. SuperAGI tiếp cận theo hướng ưu tiên tác tử đơn. Với các dự án mới năm 2026, CrewAI là lựa chọn tốt hơn: phát triển tích cực, tài liệu tốt hơn và hệ sinh thái đang lớn mạnh. Chọn CrewAI nếu bạn cần cộng tác theo vai trò, hoặc LangGraph nếu bạn muốn độ tin cậy cấp sản xuất.

Tôi có cần GPU mạnh để chạy SuperAGI không?

Không. SuperAGI mặc định gọi các nhà cung cấp LLM qua API, nên suy luận diễn ra trên máy chủ của họ. Bạn chỉ cần khoảng 3 đến 4 GB RAM cho các container Docker. Tùy chọn GPU chỉ liên quan nếu bạn muốn chạy LLM cục bộ.

Cách rẻ nhất để thử nghiệm với SuperAGI là gì?

Hãy dùng các mô hình giá rẻ như gpt-3.5-turbo hoặc API miễn phí như Groq (cung cấp truy cập miễn phí vào các mô hình Llama). Đặt số vòng lặp tối đa 10–15 và bắt đầu với tác tử đơn giản chỉ một công cụ. Theo dõi mức dùng token qua bảng APM. Lưu ý rằng HuggingFace Inference API có vấn đề tương thích với định dạng kiểu OpenAI mà SuperAGI mong đợi, vì vậy hãy bám vào các nhà cung cấp tương thích OpenAI.