Kursus

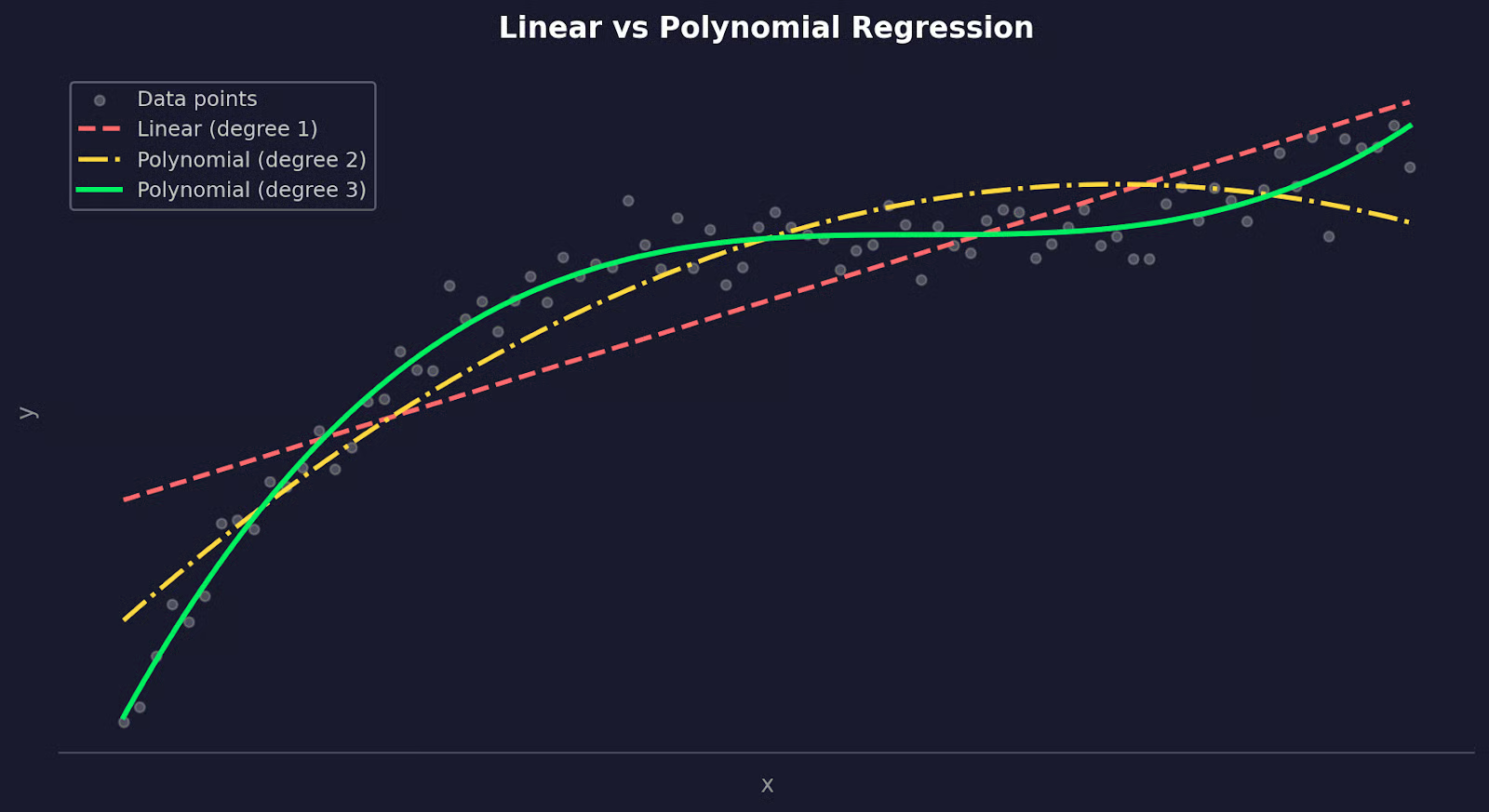

Saat data Anda membentuk kurva, tidak masuk akal menggunakan garis lurus untuk memperkirakan titik data baru. Jika dipaksakan, Anda akan berakhir dengan model yang meleset dari polanya, memiliki residual tinggi, dan prediksi yang buruk. Data dunia nyata jarang berperilaku linear, baik saat Anda memodelkan bagaimana dosis obat memengaruhi respons, bagaimana suhu memengaruhi tegangan material, atau bagaimana harga aset bergerak dari waktu ke waktu.

Regresi polinomial mengatasinya dengan memperluas regresi linear untuk menyesuaikan kurva alih-alih garis lurus. Cukup tambahkan beberapa suku berderajat lebih tinggi - x², x³ - dan model Anda dapat mengikuti bentuk sebenarnya dari data Anda.

Dalam artikel ini, saya akan membahas apa itu regresi polinomial, matematika di baliknya, cara mengimplementasikannya di Python, dan bagaimana menghindari jebakan yang paling sering terjadi: overfitting.

Jika Anda baru mengenal konsep pembelajaran mesin, baca terlebih dahulu tutorial Esensial Regresi Linear di Python terlebih dahulu.

Apa Itu Regresi Polinomial?

Regresi polinomial adalah algoritme yang Anda gunakan saat garis lurus tidak bisa menggambarkan data Anda.

Regresi linear memodelkan hubungan antar variabel sebagai garis lurus. Itu bekerja saat hubungannya memang linear — tetapi sebagian besar data dunia nyata tidak demikian. Pikirkan bagaimana jarak pengereman mobil berubah terhadap kecepatan, atau bagaimana laju pertumbuhan tanaman merespons pupuk. Hubungan-hubungan ini membentuk kurva. Garis lurus tidak akan pas dengan baik, apa pun yang Anda lakukan.

Regresi polinomial memperluas regresi linear dengan menambahkan suku-suku berderajat lebih tinggi ke dalam persamaan. Alih-alih menyesuaikan y = b0 + b1x, Anda menyesuaikan sesuatu seperti y = b0 + b1x + b2x² + b3x³. Derajat polinomial — n dalam "derajat ke-n" — mengontrol berapa banyak tikungan yang dapat dibuat kurva tersebut.

Secara singkat dan sederhana, berikut perbedaan utama di antara keduanya:

-

Regresi linear: Menyesuaikan garis lurus. Satu koefisien per fitur, satu derajat kebebasan pada kurva.

-

Regresi polinomial: Menyesuaikan kurva. Setiap suku tambahan (

x²,x³, ...) memberi model lebih banyak fleksibilitas untuk mengikuti bentuk data.

Regresi linear versus polinomial

Di balik layar, regresi polinomial tetap merupakan model linear. "Linear" di sini merujuk pada bagaimana model memperlakukan koefisiennya, bukan pada bentuk kurva yang dihasilkan. Anda menambahkan fitur baru (x², x³) dan menyesuaikan persamaan linear di atasnya.

Jadi, kapan Anda benar-benar menggunakannya?

Gunakan regresi polinomial ketika plot residual dari model linear menunjukkan pola — itu pertanda hubungannya tidak linear. Ini juga cocok ketika Anda memiliki pengetahuan domain yang menyiratkan hubungan melengkung, seperti pada fisika, biologi, atau ekonomi.

Komprominya adalah polinomial berderajat lebih tinggi dapat menjadi tidak stabil. Polinomial derajat-2 atau derajat-3 dapat menangani sebagian besar kurva dunia nyata, tetapi jika Anda menaikkannya, kemungkinan besar Anda memodelkan noise alih-alih sinyal.

Mengapa Menggunakan Regresi Polinomial?

Kebanyakan hubungan antar variabel di dunia nyata tidak linear.

Garis lurus mungkin mendekati, tetapi "mendekati" tidak cukup baik saat Anda memprediksi hal-hal yang sensitif. Ketika hubungan dalam data berbelok, model linear akan terus-menerus meleset dari belokan itu.

Regresi polinomial bekerja lebih baik dengan membiarkan model melengkung. Alih-alih memaksakan garis lurus melalui data Anda, Anda menyesuaikan kurva yang dapat mengikuti bentuk hubungan tersebut.

Berikut beberapa bidang di berbagai lini bisnis di mana pendekatan ini berdampak nyata:

- Biologi dan kedokteran: Hubungan dosis-respons jarang linear. Dosis rendah mungkin berdampak kecil, dosis sedang bekerja baik, dan dosis tinggi menimbulkan efek samping. Kurva berbentuk-S itu perlu model polinomial untuk menanggapinya

- Rekayasa: Hubungan tegangan-regangan pada material, hambatan aerodinamika, dan pemuaian termal semuanya mengikuti pola nonlinier yang dapat dimodelkan dengan baik oleh regresi polinomial

- Keuangan: Imbal hasil aset, penetapan harga opsi, dan kurva permintaan sering menunjukkan efek yang menurun atau meningkat yang tidak bisa diwakili oleh garis lurus

- Pipeline machine learning: Fitur polinomial adalah cara cepat menambahkan nonlinieritas ke model linear tanpa beralih ke algoritme yang lebih kompleks

Benang merah di semua kasus ini sama: hubungan antara input dan output berubah pada nilai x yang berbeda. Regresi linear mengasumsikan perubahan itu konstan. Regresi polinomial tidak demikian.

Meski begitu, regresi polinomial bukan solusi sakti.

Metode ini bekerja paling baik ketika Anda memiliki pengetahuan domain yang menyiratkan hubungan melengkung, atau ketika plot residual Anda jelas menunjukkan pola yang tidak dapat diperbaiki oleh garis lurus. Gunakan dengan masalah spesifik dalam pikiran — bukan hanya karena R² model linear Anda tidak cukup tinggi.

Memahami Matematika di Balik Regresi Polinomial

Mengetahui matematika dasar di balik regresi polinomial akan membantu Anda memahaminya dengan lebih baik.

Suku-suku polinomial

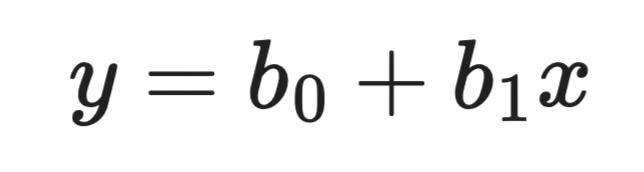

Dalam regresi linear, model Anda tampak seperti ini:

Rumus regresi linear

Itu satu variabel input, satu koefisien, satu garis lurus. Regresi polinomial memperluasnya dengan menambahkan suku-suku berderajat lebih tinggi:

Rumus regresi polinomial

Setiap suku baru — x², x³, dan seterusnya — memberi model satu "tikungan" lagi untuk dikerjakan. Polinomial derajat-2 dapat menyesuaikan satu lengkungan. Polinomial derajat-3 dapat menyesuaikan kurva yang sekali berubah arah. Derajat n mengontrol seberapa fleksibel modelnya.

Algoritme dasarnya tetap sama. Anda hanya menambahkan fitur baru. x² diperlakukan sebagai variabel input tersendiri, sama seperti x. Modelnya masih menyesuaikan persamaan linear — hanya saja di atas fitur-fitur yang ditransformasikan.

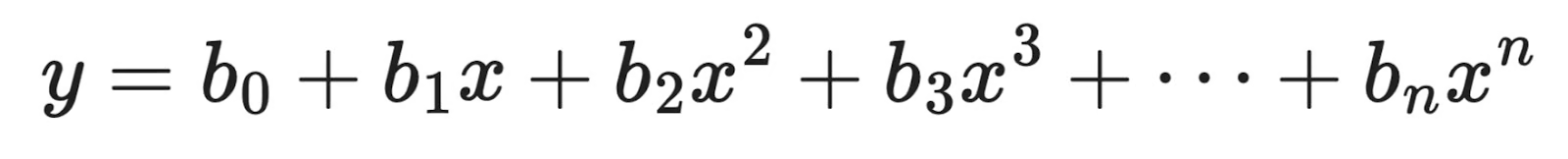

Estimasi kuadrat terkecil

Menyesuaikan model regresi polinomial bekerja dengan cara yang sama seperti regresi linear — yaitu dengan estimasi kuadrat terkecil (least squares).

Gagasannya adalah menemukan koefisien yang meminimalkan jumlah kuadrat residual:

Rumus SSR

Setiap selisih kuadrat adalah residual — jarak antara apa yang diprediksi model dan apa yang diamati. Mengkuadratkannya memastikan kesalahan negatif dan positif tidak saling meniadakan, serta memberi penalti lebih besar pada kesalahan besar dibanding yang kecil.

Dalam praktiknya, pustaka Anda akan menangani ini. Namun mengetahui bahwa kuadrat terkecil adalah objektifnya membantu Anda memahami mengapa outlier sangat merugikan model polinomial — satu residual besar akan dikuadratkan dan menarik koefisien ke arahnya.

Menafsirkan koefisien

Dalam regresi linear, b1 memiliki interpretasi sederhana: untuk setiap kenaikan satu satuan pada x, y berubah sebesar b1.

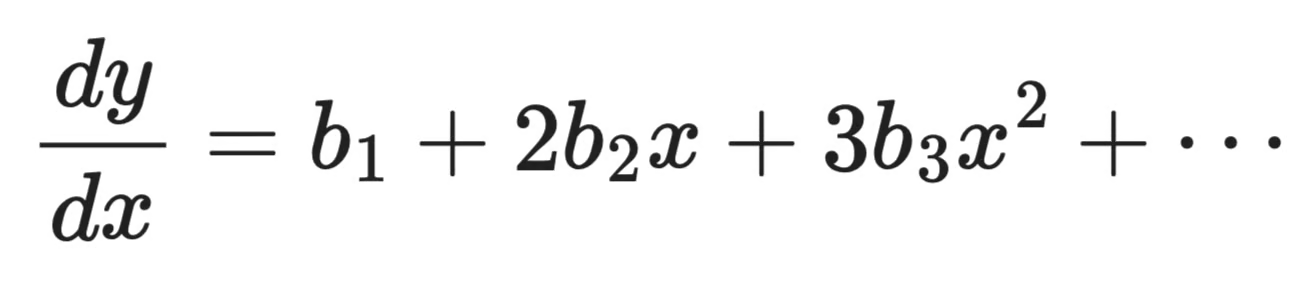

Regresi polinomial sedikit lebih rumit. Ketika model Anda menyertakan b_1x + b_2x^2, efek x terhadap y bergantung pada nilai x saat ini — Anda tidak bisa membaca b2 secara terpisah dan menarik kesimpulan. Kemiringan kurva terus berubah, yang dapat Anda lihat dengan mengambil turunan terhadap x:

Turunan terhadap x

Kemiringan itu sendiri merupakan fungsi dari x. Artinya, dampak perubahan satu satuan pada x berbeda di setiap titik pada kurva.

Inilah alasan Anda tidak sebaiknya mencoba menafsirkan koefisien individual dalam model polinomial. Sebagai gantinya, lihat kurva secara keseluruhan. Plot prediksi Anda terhadap data Anda.

Aplikasi Regresi Polinomial dalam Data Science

Regresi polinomial muncul di banyak bidang karena hubungan melengkung ada di mana-mana dalam data nyata.

Keuangan

Data keuangan jarang bergerak lurus.

Harga aset, pertumbuhan pendapatan, dan kurva permintaan cenderung meningkat, menurun, atau berbalik arah tergantung kondisi pasar. Model linear mengasumsikan laju perubahan konstan, yang hampir tidak pernah benar. Regresi polinomial memungkinkan Anda memodelkan pergeseran ini — misalnya, bagaimana permintaan konsumen turun perlahan pada awalnya, lalu tajam saat harga melewati titik tertentu.

Metode ini juga berguna untuk analisis tren dari waktu ke waktu. Saat Anda menyesuaikan kurva ke data harga historis atau memodelkan bagaimana suatu metrik tumbuh pada fase-fase berbeda dari siklus bisnis, polinomial derajat-2 atau derajat-3 sering memperkirakan bentuknya jauh lebih baik daripada garis lurus.

Rekayasa

Proses fisik adalah contoh terbaik dari hubungan nonlinier.

Tegangan dan regangan pada material, dinamika fluida, pemuaian termal, dan hambatan aerodinamika semuanya mengikuti kurva, bukan garis. Banyak persamaan dasar dalam fisika bersifat polinomial secara alami. Regresi polinomial memberi Anda cara berbasis data untuk menyesuaikan kurva-kurva tersebut saat Anda memiliki pengukuran tetapi tidak ada persamaan bentuk tertutup yang rapi.

Contoh yang bagus adalah gaya hambat, yang meningkat seiring kuadrat kecepatan. Model linear akan meremehkan hambat pada kecepatan tinggi, dan polinomial derajat-2 akan menyesuaikan hubungan tersebut dengan benar.

Machine Learning

Dalam machine learning, regresi polinomial sering digunakan sebagai teknik rekayasa fitur alih-alih model mandiri.

Dengan menambahkan suku-suku polinomial — x², x³, suku interaksi — ke himpunan fitur Anda, Anda memberi model linear kemampuan untuk menyesuaikan pola nonlinier tanpa beralih ke algoritme yang lebih kompleks. Ini adalah langkah awal yang umum ketika model linear Anda underfit dan Anda ingin menambah fleksibilitas sebelum beralih ke pohon keputusan atau jaringan saraf.

Ini juga berguna sebagai model baseline.

Sebelum melatih model yang lebih kompleks, menyesuaikan regresi polinomial memberi tahu Anda seberapa besar varians yang dapat dijelaskan oleh kurva sederhana. Jika polinomial derajat-3 sudah hampir mencapai tujuan, Anda mungkin tidak memerlukan sesuatu yang lebih kompleks.

Cara Memilih Derajat yang Tepat untuk Regresi Polinomial

Memilih derajat polinomial adalah salah satu keputusan terpenting yang akan Anda buat. Jika salah ke arah mana pun, Anda akan berakhir dengan model yang kurang akurat.

Untungnya, beberapa baris kode Python sudah cukup untuk menyelesaikannya.

Overfitting vs. underfitting

Underfitting terjadi ketika derajat Anda terlalu rendah. Polinomial derajat-1 pada data yang melengkung akan melewatkan polanya — bias tinggi, prediksi buruk, dan model yang berkinerja buruk pada data latih maupun data baru.

Overfitting adalah kebalikannya, dan lebih berbahaya karena awalnya terlihat bagus. Polinomial berderajat tinggi dapat melalui setiap titik data di himpunan latih Anda dengan kesalahan hampir nol. Namun modelnya hanya menghafal noise. Model akan runtuh pada data baru.

Anda dapat melihatnya dengan membandingkan kesalahan latih versus uji pada berbagai derajat:

import numpy as np

from sklearn.preprocessing import PolynomialFeatures

from sklearn.linear_model import LinearRegression

from sklearn.metrics import mean_squared_error

from sklearn.model_selection import train_test_split

np.random.seed(42)

# Generate sample data

x = np.linspace(-3, 3, 80).reshape(-1, 1)

y = 0.6 * x.ravel()**2 - x.ravel() + np.random.normal(0, 0.6, 80)

x_train, x_test, y_train, y_test = train_test_split(x, y, test_size=0.25)

for deg in [1, 2, 12]:

poly = PolynomialFeatures(deg)

model = LinearRegression()

model.fit(poly.fit_transform(x_train), y_train)

train_err = mean_squared_error(y_train, model.predict(poly.transform(x_train)))

test_err = mean_squared_error(y_test, model.predict(poly.transform(x_test)))

print(f"Degree {deg:>2} | Train MSE: {train_err:.4f} | Test MSE: {test_err:.4f}")

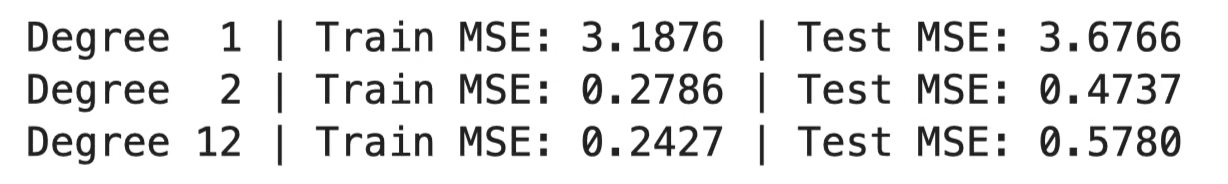

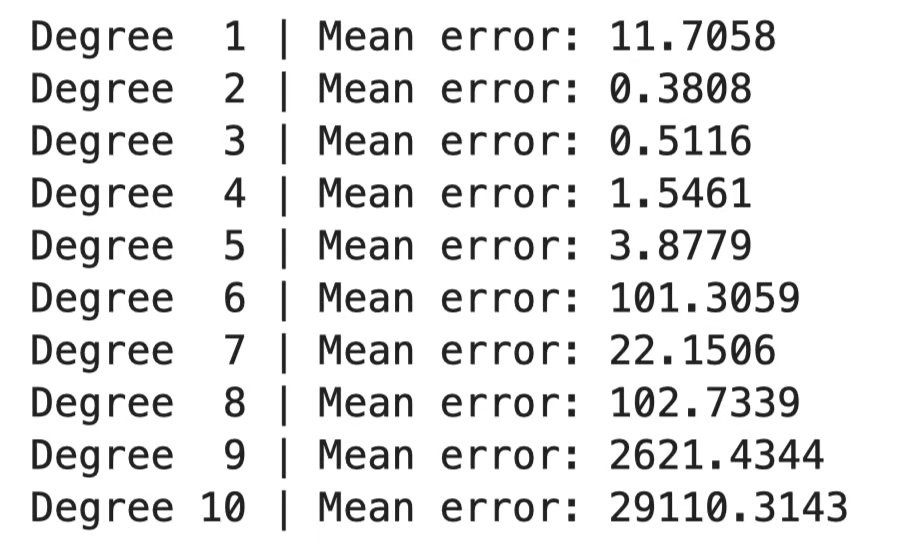

MSE pada derajat yang berbeda

Atau, disajikan secara visual:

Pemasangan data dengan derajat polinomial berbeda

Derajat 1 menunjukkan kesalahan tinggi pada kedua himpunan — itu underfitting. Derajat 2 seimbang dengan baik. Derajat 12 memiliki kesalahan latih lebih rendah tetapi kesalahan uji jauh lebih tinggi — itu overfitting.

Cross-validation

Cara yang tepat untuk menemukan derajat terbaik adalah cross-validation — khususnya, k-fold cross-validation.

Idenya adalah membagi data Anda menjadi k subset, lalu melatih pada k-1 subset dan menguji pada satu subset yang disisihkan, dan ulangi hingga setiap subset pernah menjadi himpunan uji sekali. Terakhir, rata-ratakan kesalahan di seluruh lipatan dan lakukan ini untuk setiap kandidat derajat, lalu pilih yang memiliki rata-rata kesalahan uji terendah.

Implementasinya jauh lebih sederhana daripada penjelasannya:

import numpy as np

from sklearn.preprocessing import PolynomialFeatures

from sklearn.linear_model import LinearRegression

from sklearn.model_selection import cross_val_score

from sklearn.pipeline import make_pipeline

import matplotlib.pyplot as plt

np.random.seed(42)

# Generate sample data

x = np.linspace(-3, 3, 80).reshape(-1, 1)

y = 0.6 * x.ravel()**2 - x.ravel() + np.random.normal(0, 0.6, 80)

# Test degrees 1 through 10

degrees = range(1, 11)

mean_errors = []

for deg in degrees:

model = make_pipeline(PolynomialFeatures(deg), LinearRegression())

scores = cross_val_score(model, x, y, cv=5, scoring="neg_mean_squared_error")

mean_errors.append(-scores.mean())

print(f"Degree {deg:>2} | Mean error: {-scores.mean():.4f}")

best_degree = np.argmin(mean_errors) + 1

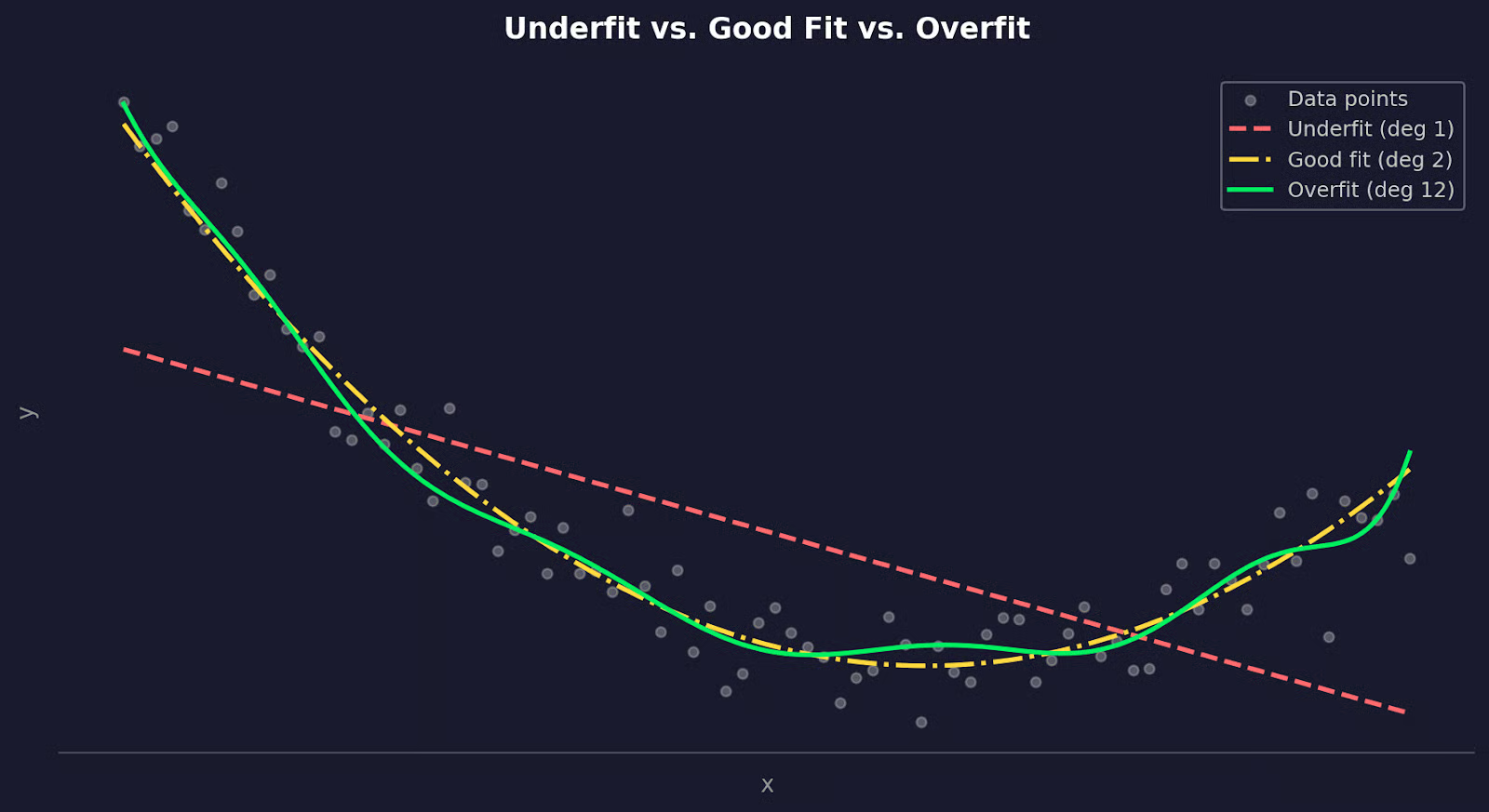

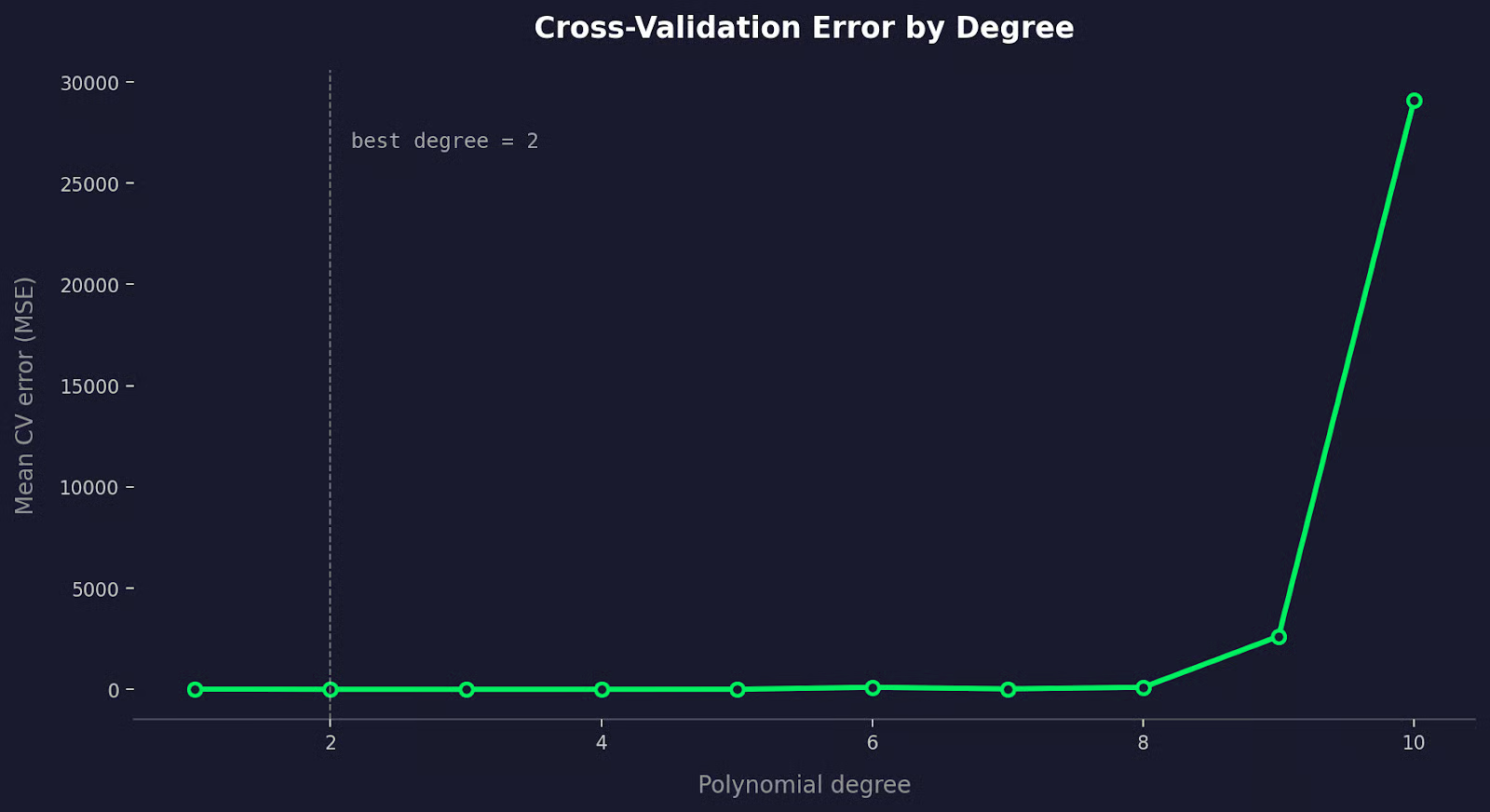

Perbandingan kesalahan per derajat

Atau, direpresentasikan secara visual:

Perbandingan kesalahan cross-validation

Kesalahan CV turun saat Anda menambahkan suku polinomial yang berguna, lalu naik lagi saat model mulai overfit.

Ketika dua derajat memberikan kesalahan CV yang serupa, pilih yang lebih rendah. Model yang lebih sederhana namun kinerjanya sama baik selalu menjadi pilihan yang lebih baik.

Pertimbangan Utama dan Keterbatasan

Ada beberapa cara regresi polinomial dapat menyesatkan Anda. Mari kita bahas sekarang.

Sensitif terhadap outlier

Outlier memengaruhi regresi polinomial lebih dari regresi linear.

Metode kuadrat terkecil menguadratkan setiap residual sebelum menjumlahkannya. Satu titik data yang jauh dari tren menyumbang kesalahan yang sangat besar, dan model akan membengkokkan kurvanya untuk mengurangi kesalahan itu — meski berarti mendistorsi kecocokan di tempat lain.

Efek ini semakin buruk seiring meningkatnya derajat. Polinomial berderajat tinggi memiliki fleksibilitas yang cukup untuk mengejar outlier, yang menarik kurva menjauh dari sebagian besar data Anda untuk menyesuaikan satu titik yang buruk.

Cara mengatasinya adalah membersihkan data sebelum menyesuaikan model. Plot data Anda, identifikasi outlier, dan putuskan apakah mereka mewakili sinyal nyata atau noise. Jika itu noise — kesalahan pengukuran, salah input, catatan rusak — hapus. Jika itu nyata, pertimbangkan metode pemodelan yang lebih tahan terhadap outlier seperti RANSAC atau regresi Huber.

Overfitting

Setiap kali Anda menambahkan suku polinomial, Anda memberi model lebih banyak fleksibilitas. Pada titik tertentu, fleksibilitas itu berhenti membantu, dan model mulai menyesuaikan noise acak dalam data latih, bukan polanya yang sebenarnya. Hasilnya adalah kurva yang bagus pada data latih tetapi gagal pada data baru.

Bagian yang rumit adalah overfitting tak terlihat jika Anda hanya melihat kesalahan latih. Polinomial derajat-10 hampir selalu memiliki MSE latih lebih rendah daripada polinomial derajat-2. Itu tidak berarti modelnya lebih baik.

Berikut pendekatan yang sebaiknya Anda lakukan:

- Mulai dari rendah: Coba derajat 2 atau 3 sebelum naik lebih tinggi. Kebanyakan kurva dunia nyata tidak butuh lebih dari itu

- Selalu evaluasi pada data yang disisihkan: Kesalahan latih saja tidak memberi tahu apa pun tentang generalisasi.

- Cross-validation: Gunakan untuk menemukan derajat di mana kesalahan uji berhenti membaik.

- Amati kurvanya: Jika polinomial Anda berperilaku liar di luar rentang data latih, itu tanda overfitting.

Regresi polinomial bekerja paling baik ketika Anda punya alasan kuat untuk mengharapkan hubungan melengkung, dan Anda dapat menjaga derajatnya tetap rendah.

Alternatif untuk Regresi Polinomial

Regresi polinomial tidak selalu menjadi alat yang tepat — beberapa alternatif ini mungkin lebih cocok untuk Anda, tanpa maksud permainan kata.

Spline

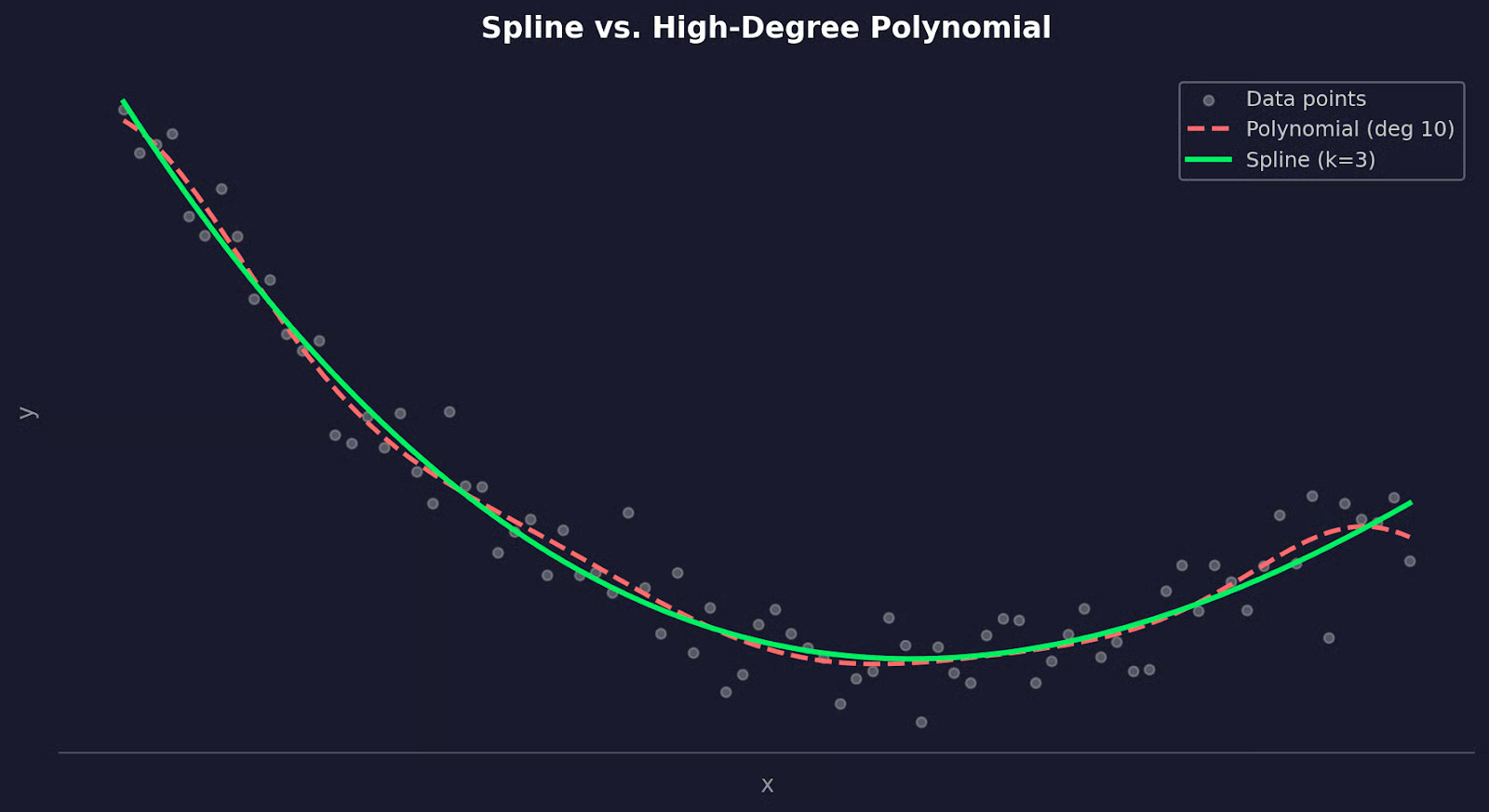

Spline menyelesaikan masalah ketidakstabilan global.

Saat Anda menyesuaikan polinomial derajat-10, setiap koefisien dipengaruhi oleh setiap titik data. Perubahan di satu wilayah data Anda memengaruhi kurva di seluruh tempat lain. Spline menghindarinya dengan membagi data menjadi beberapa segmen dan menyesuaikan polinomial berderajat rendah secara terpisah pada masing-masing segmen. Segmen-segmen disambungkan pada titik yang disebut knot, dengan kendala yang menjaga kurva keseluruhan tetap mulus pada sambungan.

Hasilnya adalah kurva yang fleksibel di tempat yang dibutuhkan dan stabil di tempat lain.

Di Python, scipy dan scikit-learn sama-sama memiliki implementasi spline yang solid:

from scipy.interpolate import UnivariateSpline

spline = UnivariateSpline(x, y, k=3)

y_pred = spline(x_new)

Spline versus polinomial berderajat tinggi

Sebagai penegasan, gunakan spline ketika data Anda memiliki perilaku berbeda di wilayah yang berbeda, atau ketika satu kurva polinomial tidak dapat menangkap bentuknya tanpa menaikkan derajat secara berlebihan.

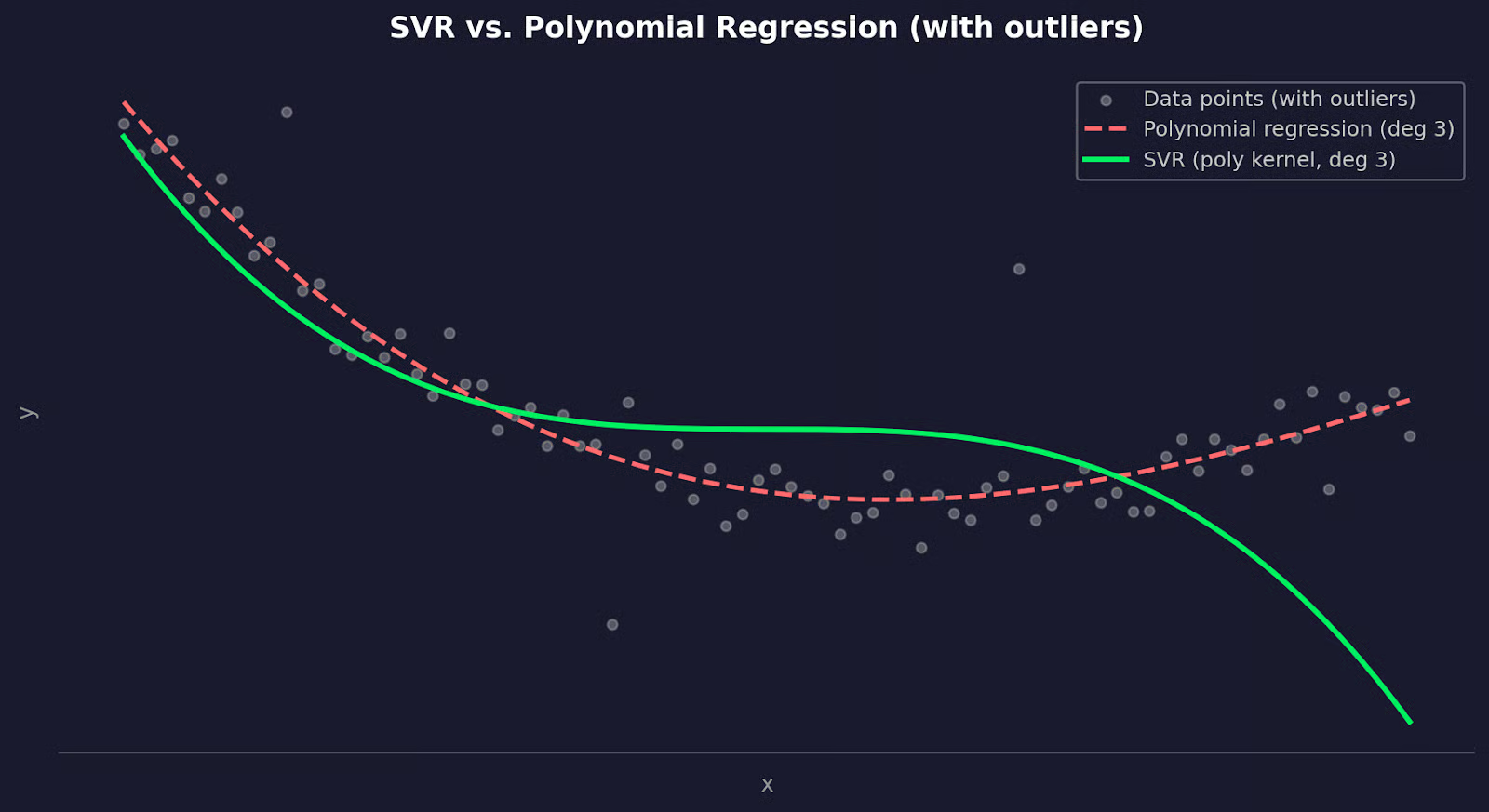

Support Vector Regression

Support Vector Regression (SVR) mengambil pendekatan yang berbeda.

Metode ini tidak menyesuaikan kurva yang meminimalkan kesalahan kuadrat di semua titik, melainkan mencoba mencari fungsi yang tetap dalam margin kesalahan yang ditentukan untuk sebanyak mungkin titik, sambil mengabaikan titik yang jatuh dalam margin tersebut. Ini membuatnya kurang sensitif terhadap outlier dibanding regresi polinomial.

Keterkaitannya dengan regresi polinomial muncul melalui kernel trick. SVR dengan kernel polinomial dapat menyesuaikan hubungan nonlinier yang mirip dengan regresi polinomial — namun dengan generalisasi yang lebih baik dan kontrol lebih besar atas kecocokan melalui parameter regularisasi.

from sklearn.svm import SVR

model = SVR(kernel="poly", degree=3, C=1.0, epsilon=0.1)

model.fit(x_train, y_train)

SVR versus polinomial berderajat tinggi

SVR adalah pilihan yang baik saat data Anda memiliki outlier yang tidak dapat dihapus, ketika Anda membutuhkan kontrol lebih atas trade-off bias-varians, atau ketika regresi polinomial terus overfit meski sudah dilakukan cross-validation.

Kesimpulan

Dalam artikel ini, saya telah menunjukkan bagaimana metode ini memperluas regresi linear untuk menyesuaikan kurva, bagaimana estimasi kuadrat terkecil menemukan koefisien terbaik, dan mengapa menafsirkan koefisien tersebut secara individual tidak banyak memberi tahu Anda.

Derajat yang Anda pilih lebih penting daripada apa pun. Terlalu rendah mengarah ke underfitting, dan terlalu tinggi ke overfitting. Cross-validation memberi Anda cara objektif untuk menemukan titik tengahnya. Dan jika regresi polinomial bukan pilihan yang tepat, spline dan SVR adalah alternatif solid yang layak diketahui.

Cara terbaik membangun intuisi untuk semua ini adalah dengan menggunakannya pada data Anda sendiri. Pilih dataset yang Anda curigai memiliki hubungan nonlinier, sesuaikan model linear terlebih dahulu, plot residualnya, dan lihat apa yang dilakukan regresi polinomial secara berbeda. Baca panduan kami tentang Model Non-Linear dan Insight Menggunakan R untuk melihat pipeline ini dalam praktik.

FAQ Regresi Polinomial

Apa itu regresi polinomial, dan kapan saya harus menggunakannya?

Regresi polinomial adalah perluasan dari regresi linear yang menyesuaikan garis melengkung ke data Anda alih-alih garis lurus. Anda menggunakannya saat hubungan antara variabel input dan output tidak linear — misalnya, ketika plot residual dari model linear menunjukkan pola. Ini adalah langkah awal yang baik sebelum beralih ke model yang lebih kompleks seperti pohon keputusan atau jaringan saraf.

Apa perbedaan regresi polinomial dengan regresi linear?

Regresi linear menyesuaikan garis lurus dengan memodelkan hubungan sebagai y = b0 + b1x. Regresi polinomial menambahkan suku berderajat lebih tinggi seperti x² dan x³, memberi model fleksibilitas untuk mengikuti kurva dalam data. Keduanya menggunakan estimasi kuadrat terkecil yang sama — regresi polinomial hanya memperlakukan suku tambahan itu sebagai fitur input tambahan.

Apa risiko terbesar menggunakan regresi polinomial?

Dua risiko utama adalah overfitting dan sensitivitas terhadap outlier. Polinomial berderajat tinggi dapat menghafal noise dalam data latih Anda dan berkinerja buruk pada data baru. Outlier berbahaya karena metode kuadrat terkecil menguadratkan setiap residual, artinya satu titik data yang buruk dapat menarik kurva menjauh dari sebagian besar data Anda.

Bagaimana cara memilih derajat yang tepat untuk model regresi polinomial saya?

Mulailah dari derajat 2 atau 3 — sebagian besar hubungan melengkung dunia nyata tidak membutuhkan lebih dari itu. Dari sana, gunakan k-fold cross-validation untuk membandingkan rata-rata kesalahan uji di seluruh derajat kandidat dan pilih yang kesalahan ujinya berhenti membaik. Ketika dua derajat memberikan hasil serupa, selalu pilih yang lebih rendah.

Kapan saya harus menggunakan spline atau SVR alih-alih regresi polinomial?

Gunakan spline ketika data Anda berperilaku berbeda di wilayah yang berbeda, atau ketika satu polinomial terus menghasilkan kurva yang tidak stabil di tepi rentang data Anda. Dan gunakan SVR dengan kernel polinomial saat outlier tidak terhindarkan dan Anda memerlukan model yang tidak akan membengkok berlebihan untuk mengakomodasinya. Kedua alternatif memberi Anda kontrol lebih atas kecocokan dengan mengorbankan sebagian interpretabilitas.