Corso

Il cuore di questa guida è rendere il processo di colloquio su AWS più semplice da capire, offrendo un elenco accuratamente selezionato di domande e risposte. Questo ventaglio copre tutto: dai principi fondamentali che costituiscono le basi dell’ampio ecosistema AWS, fino a domande dettagliate basate su scenari reali che mettono alla prova la tua comprensione profonda e l’uso pratico dei servizi AWS.

Che tu sia all’inizio della tua carriera nei dati o un professionista esperto, questo articolo mira a fornirti le conoscenze e la sicurezza necessarie per affrontare qualsiasi domanda su AWS in sede di colloquio. Esplorando domande di livello base, intermedio e avanzato, insieme a quesiti basati su situazioni reali, questa guida punta a coprire tutte le aree importanti, garantendo una preparazione completa.

Perché AWS?

Prima di esplorare domande e risposte, è importante capire perché valga la pena considerare AWS Cloud come piattaforma di riferimento.

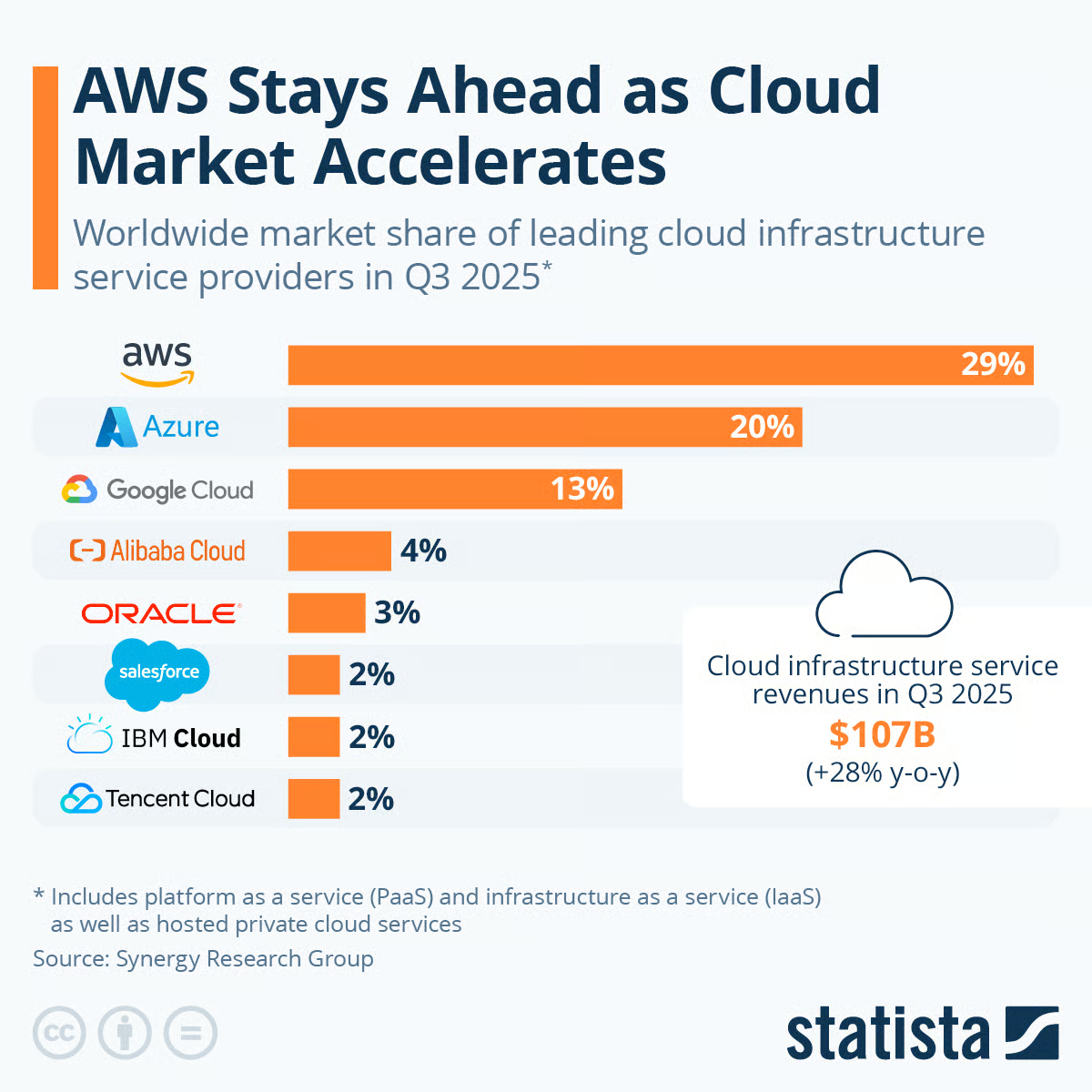

Il seguente grafico mostra le quote di mercato globali dei principali fornitori di servizi di infrastruttura cloud per il terzo trimestre (Q3) del 2025. Di seguito una ripartizione delle quote mostrate:

- Amazon Web Services (AWS) detiene la quota più ampia con il 29%.

- Microsoft Azure segue con il 20%.

- Google Cloud detiene il 13% del mercato.

- Alibaba Cloud ha una quota del 4%.

- Oracle è cresciuta fino a raggiungere il 3%.

- Salesforce, IBM Cloud e Tencent Cloud sono in fondo, con il 2% ciascuno.

Fonte (Statista)

Il grafico indica inoltre che i dati includono platform as a service (PaaS) e infrastructure as a service (IaaS), oltre ai servizi di cloud privato hosted. Inoltre, si segnala che i ricavi dei servizi di infrastruttura cloud nel Q3 2025 hanno raggiunto 107 miliardi di dollari, un aumento significativo rispetto al Q3 2024, quando erano 84 miliardi.

Amazon Web Services (AWS) continua a essere l’attore dominante nel mercato cloud al Q3 2025, mantenendo un vantaggio significativo sul suo concorrente più vicino, Microsoft Azure.

La leadership di AWS nel mercato cloud ne evidenzia l’importanza per l’upskilling e offre notevoli vantaggi di carriera grazie all’ampia adozione e al valore attribuito alle competenze AWS nel settore tech.

La nostra cheat sheet Confronto dei servizi AWS, Azure e GCP per Data Science & AI offre una comparazione dei principali servizi necessari per i lavori legati ai dati e all’AI: dall’ingegneria dei dati all’analisi, dalla data science alla creazione di applicazioni data-driven.

Domande base per colloqui su AWS

Partendo dalle basi, questa sezione introduce le domande fondamentali su AWS, essenziali per costruire una comprensione di base. È pensata per chi è nuovo su AWS o ha bisogno di un ripasso, preparando il terreno a un’esplorazione più approfondita.

Che cos’è il cloud computing?

Il cloud computing fornisce accesso on-demand a risorse IT come compute, storage e database tramite internet. Gli utenti pagano solo per ciò che usano, invece di possedere infrastrutture fisiche.

Il cloud consente di accedere ai servizi tecnologici in modo flessibile, secondo necessità e senza grandi investimenti iniziali. Provider leader come AWS offrono un’ampia gamma di servizi cloud con il modello a consumo pay-as-you-go. Il nostro corso AWS Cloud Concepts copre molti di questi fondamentali.

Qual è il problema dell’approccio IT tradizionale rispetto al Cloud?

Molti settori stanno abbandonando l’IT tradizionale per adottare infrastrutture cloud per vari motivi. L’approccio Cloud offre maggiore agilità aziendale, innovazione più rapida, scalabilità flessibile e un costo totale di proprietà inferiore rispetto all’IT tradizionale. Di seguito alcune caratteristiche che li differenziano:

|

IT tradizionale |

Cloud computing |

|

|

Quanti modelli di deployment esistono nel cloud?

Esistono tre diversi modelli di deployment nel cloud, illustrati di seguito:

- Private cloud: questo tipo di servizio è utilizzato da una singola organizzazione e non è esposto al pubblico. È adatto a organizzazioni che usano applicazioni sensibili.

- Public cloud: queste risorse cloud sono di proprietà e gestite da provider terzi come Amazon Web Services, Microsoft Azure e tutti quelli menzionati nella sezione sulle quote di mercato AWS.

- Hybrid cloud: è la combinazione di cloud privato e pubblico. È progettato per mantenere alcuni server on-premises estendendo al contempo le restanti capacità nel cloud. L’hybrid cloud offre la flessibilità e la convenienza del cloud pubblico.

Quali sono le cinque caratteristiche del cloud computing?

Il cloud computing è composto da cinque principali caratteristiche, illustrate di seguito:

- On-demand self-service: gli utenti possono effettuare il provisioning dei servizi cloud secondo necessità senza interazione umana con il provider.

- Broad network access: i servizi sono disponibili in rete e accessibili tramite meccanismi standard come smartphone, laptop e tablet.

- Multi-tenacy and resource pooling: le risorse sono messe in pool per servire più clienti, con diverse risorse virtuali e fisiche assegnate dinamicamente in base alla domanda.

- Rapid elasticity and scalability: le capacità possono essere fornite in modo elastico e scalate rapidamente in alto o in basso, automaticamente, per allineare la capacità alla domanda.

- Measured service: l’uso delle risorse è monitorato, controllato, rendicontato e fatturato in modo trasparente in base all’utilizzo. L’uso può essere gestito, controllato e rendicontato, fornendo trasparenza per provider e consumatore.

Quali sono i principali tipi di Cloud Computing?

Ci sono tre tipi principali di cloud computing: IaaS, PaaS e SaaS

- Infrastructure as a Service (IaaS): fornisce i blocchi di base dell’IT nel cloud, come compute, storage e networking, a cui gli utenti possono accedere on-demand senza dover gestire l’infrastruttura sottostante. Esempi: AWS EC2, S3, VPC.

- Platform as a Service (PaaS): offre una piattaforma o un ambiente gestito per sviluppare, distribuire e gestire app cloud senza dover costruire l’infrastruttura sottostante. Esempi: AWS Elastic Beanstalk, Heroku

- Software as a Service (SaaS): fornisce accesso ad applicazioni complete per l’utente finale che girano nel cloud e possono essere utilizzate via internet. Gli utenti non gestiscono infrastruttura o piattaforme. Esempi: AWS Simple Email Service, Google Docs, Salesforce CRM.

Puoi approfondire questi temi nel nostro corso Understanding Cloud Computing.

Che cos’è Amazon EC2 e quali sono i suoi usi principali?

Amazon EC2 (Elastic Compute Cloud) fornisce server virtuali scalabili chiamati istanze nel Cloud AWS. È usato per eseguire vari carichi di lavoro in modo flessibile ed economico. Di seguito alcuni dei suoi usi principali:

- Ospitare siti web e applicazioni web

- Eseguire processi backend e job batch

- Implementare soluzioni hybrid cloud

- Raggiungere alta disponibilità e scalabilità

- Ridurre il time-to-market per nuovi casi d’uso

Che cos’è Amazon S3 e perché è importante?

Amazon Simple Storage Service (S3) è un servizio di object storage versatile, scalabile e sicuro. È alla base di molte applicazioni e carichi di lavoro basati sul cloud. Di seguito alcune caratteristiche che ne evidenziano l’importanza:

- Durabilità con il 99,999999999% di durabilità e il 99,99% di disponibilità, adatto a dati critici.

- Supporta funzioni di sicurezza robuste come policy di accesso, crittografia, endpoint VPC.

- Si integra perfettamente con altri servizi AWS come Lambda, EC2, EBS, solo per citarne alcuni.

- Bassa latenza e throughput elevato lo rendono ideale per big data analytics, applicazioni mobile, archiviazione e distribuzione di media.

- Funzioni di gestione flessibili per monitoraggio, access log, replica, versioning, policy di ciclo di vita.

- Supportato dall’infrastruttura globale AWS per accesso a bassa latenza in tutto il mondo.

Spiega il concetto di “Regioni” e “Availability Zones” in AWS

- Le AWS Regions corrispondono a località geografiche separate in cui si trovano le risorse AWS. Le aziende scelgono regioni vicine ai propri clienti per ridurre la latenza, e la replica cross-region offre un migliore disaster recovery.

- Le Availability Zones sono costituite da uno o più data center distinti con alimentazione, rete e connettività ridondanti. Consentono il deployment delle risorse in modo più tollerante ai guasti.

Il nostro corso AWS Cloud Concepts offre una guida completa per conoscere i principali servizi core di AWS, le best practice per progettare applicazioni su AWS e i vantaggi dell’uso di AWS per le aziende.

Che cos’è IAM e perché è importante?

AWS Identity and Access Management (IAM) è un servizio che ti aiuta a controllare in modo sicuro l’accesso a servizi e risorse AWS. IAM ti consente di gestire utenti, gruppi e ruoli con permessi granulari. È importante perché applica il principio del privilegio minimo, garantendo che gli utenti abbiano accesso solo alle risorse necessarie, migliorando così sicurezza e conformità.

La nostra Guida completa ad AWS IAM spiega il servizio in ogni dettaglio.

Che cos’è Amazon RDS e in cosa differisce dai database tradizionali?

Amazon Relational Database Service (RDS) è un servizio di database gestito che consente di configurare, operare e scalare database senza doversi preoccupare di attività di gestione dell’infrastruttura come backup, patch e scalabilità. A differenza dei database tradizionali, Amazon RDS è scalabile e altamente disponibile out of the box, supporta backup automatici e consente read replica e deployment multi-AZ per failover e ridondanza.

Ecco una tabella che evidenzia le differenze tra RDS e database più tradizionali, per chi preferisce una rappresentazione visiva:

| Caratteristica | Amazon RDS | Database tradizionali |

|---|---|---|

| Scalabilità | Scala facilmente in verticale o in orizzontale | Richiede upgrade hardware; la scalabilità può essere costosa |

| Disponibilità | Supporta deployment Multi-AZ per alta disponibilità | La configurazione per alta disponibilità è complessa |

| Manutenzione | Gestita da AWS, inclusi backup, aggiornamenti e patch | Gestita manualmente, inclusi aggiornamenti e backup regolari |

| Backup e ripristino | Backup e snapshot automatici | Processi di backup manuali |

| Costo | Prezzi pay-as-you-go | Costi fissi; richiesto investimento iniziale più elevato |

Che cos’è Amazon VPC e perché si usa?

Amazon Virtual Private Cloud (VPC) ti consente di creare una rete virtuale in AWS che assomiglia da vicino a una rete tradizionale in un data center on-premises. VPC è usato per isolare le risorse, controllare il traffico in ingresso e in uscita e segmentare i carichi di lavoro in subnet con configurazioni di sicurezza rigorose. Fornisce controllo granulare su intervalli IP, security group e network ACL.

Che cos’è Amazon CloudWatch e quali sono i suoi componenti principali?

Amazon CloudWatch è un servizio di monitoraggio e osservabilità progettato per tracciare varie metriche, impostare allarmi e rispondere automaticamente ai cambiamenti nelle risorse AWS. Aiuta a migliorare la visibilità sulle prestazioni delle applicazioni, lo stato del sistema e i problemi operativi, diventando uno strumento essenziale per gli utenti AWS. Ecco i componenti principali di CloudWatch:

- Metriche: CloudWatch raccoglie punti dati, o metriche, che offrono insight sull’utilizzo delle risorse, le prestazioni delle applicazioni e la salute operativa. Questi dati consentono analisi delle tendenze e scaling proattivo.

- Allarmi: gli allarmi avvisano gli utenti o attivano azioni automatiche in base a soglie metriche specifiche. Ad esempio, se l’uso della CPU supera una soglia, un allarme può avviare l’auto-scaling per gestire il carico crescente.

- Log: CloudWatch Logs fornisce archiviazione centralizzata per i log di applicazioni e infrastruttura, essenziale per il troubleshooting e l’identificazione dei problemi. I log possono essere filtrati, monitorati e analizzati per mantenere operazioni fluide.

- Eventi: CloudWatch Events (o Amazon EventBridge) rileva cambiamenti nelle risorse AWS e può attivare azioni predefinite, come invocare una funzione Lambda quando si verifica un evento specifico. Questo permette maggiore automazione e risposta rapida a eventi critici.

Che cos’è AWS Lambda e come abilita il serverless computing?

AWS Lambda è un servizio di calcolo serverless che elimina la necessità di gestire server, semplificando per gli sviluppatori l’esecuzione del codice nel cloud. Ecco come funziona e perché abilita il serverless computing:

- Esecuzione del codice on demand: Lambda esegue il codice solo quando viene attivata da un evento, come una richiesta HTTP o il caricamento di un file in Amazon S3. In questo modo usi risorse solo quando servono, ottimizzando costi ed efficienza.

- Scalabilità automatica: Lambda scala automaticamente in base al numero di richieste in arrivo. Può gestire da una singola richiesta a migliaia al secondo, mantenendo le applicazioni reattive al variare del traffico.

- Focus sul codice, non sull’infrastruttura: poiché Lambda astrae l’infrastruttura server, gli sviluppatori possono concentrarsi esclusivamente sulla scrittura e il deployment del codice senza preoccuparsi di provisioning, gestione o scaling dei server.

Grazie a queste funzionalità, Lambda incarna i principi del serverless computing: rimuove l’onere della gestione dell’infrastruttura e consente di creare, testare e scalare applicazioni con maggiore agilità.

Che cos’è Elastic Load Balancing (ELB) in AWS?

Elastic Load Balancing (ELB) è un servizio che distribuisce automaticamente il traffico applicativo in ingresso su più target, garantendo che la tua applicazione resti reattiva e resiliente. ELB offre diversi vantaggi che lo rendono un componente essenziale nelle architetture AWS scalabili:

- Distribuzione del traffico: ELB bilancia in modo intelligente il traffico in arrivo su più target, inclusi istanze EC2, container e indirizzi IP. Questo aiuta a evitare il sovraccarico di una singola risorsa, garantendo prestazioni costanti.

- Tolleranza ai guasti e alta disponibilità: ELB offre tolleranza ai guasti distribuendo il traffico su più Availability Zone, aiutando l’applicazione a rimanere disponibile anche se una zona ha problemi.

- Affidabilità e scalabilità migliorate: ELB adatta automaticamente la distribuzione del traffico al variare della domanda, semplificando la gestione di picchi improvvisi senza impattare le prestazioni.

Domande per colloqui AWS di livello intermedio e per esperti

Domande per colloqui AWS DevOps

Passando a ruoli specializzati, qui l’enfasi è su come AWS supporta le pratiche DevOps. Questa parte esamina l’automazione e l’ottimizzazione degli ambienti AWS, sfidando i candidati a mostrare le proprie abilità nel sfruttare AWS per integrazione e delivery continui. Se punti a un ruolo AWS avanzato, dai un’occhiata al nostro post Domande per colloqui da Data Architect per esercitarti con domande su infrastruttura e architettura dei dati.

Come usi AWS CodePipeline per automatizzare una pipeline CI/CD per un’applicazione multi-tier?

CodePipeline può essere utilizzato per automatizzare il flusso dal check-in del codice alla build, ai test e al deployment su più ambienti, snellendo la consegna degli aggiornamenti mantenendo alti standard di qualità.

I seguenti passaggi possono essere seguiti per automatizzare una pipeline CI/CD:

- Crea una pipeline: inizia creando una pipeline in AWS CodePipeline, specificando il repository del codice sorgente (ad es. GitHub, AWS CodeCommit).

- Definisci lo stage di build: collega un servizio di build come AWS CodeBuild per compilare il codice, eseguire i test e creare artifact distribuibili.

- Configura gli stage di deployment: imposta gli stage di deployment per ogni livello dell’applicazione. Usa AWS CodeDeploy per automatizzare il deployment su istanze Amazon EC2, AWS Elastic Beanstalk per app web o AWS ECS per app containerizzate.

- Aggiungi step di approvazione (opzionale): per ambienti critici, inserisci approvazioni manuali prima degli stage di deployment per garantire qualità e controllo.

- Monitora e itera: monitora le prestazioni della pipeline e aggiusta quando necessario. Utilizza feedback e iterazioni per migliorare continuamente il processo di deployment.

Quali fattori chiave considerare nel progettare una soluzione di deployment su AWS per effettuare in modo efficace provisioning, configurazione, deployment, scaling e monitoraggio delle applicazioni?

Creare un deployment AWS ben architettato implica adattare i servizi AWS alle esigenze della tua app, coprendo requisiti di compute, storage e database. Questo processo, reso complesso dall’ampio catalogo di servizi AWS, include diversi passaggi cruciali:

- Provisioning: configura l’infrastruttura AWS essenziale come EC2, VPC, subnet o servizi gestiti come S3, RDS, CloudFront per le applicazioni sottostanti.

- Configurazione: adatta l’assetto per soddisfare requisiti specifici relativi ad ambiente, sicurezza, disponibilità e prestazioni.

- Deployment: distribuisci o aggiorna in modo efficiente i componenti dell’app, garantendo transizioni di versione senza intoppi.

- Scalabilità: modifica dinamicamente l’allocazione delle risorse in base a criteri predefiniti per gestire i cambi di carico.

- Monitoraggio: tieni traccia dell’uso delle risorse, degli esiti di deployment, della salute dell’app e dei log per assicurarti che tutto funzioni come previsto.

Che cos’è l’Infrastructure as Code? Descrivila con parole tue

Infrastructure as Code (IaC) è un metodo per gestire e fornire data center tramite file di definizione leggibili dalla macchina, invece che con configurazione hardware fisica o strumenti interattivi di configurazione.

In sostanza, consente a sviluppatori e team IT di gestire, monitorare e fornire automaticamente risorse tramite codice, anziché configurare manualmente l’hardware.

Inoltre, IaC consente di distribuire ambienti coerenti in modo rapido e scalabile codificando l’infrastruttura, riducendo così l’errore umano e aumentando l’efficienza.

Qual è il tuo approccio alla gestione di integrazione e deployment continui in AWS DevOps?

In AWS DevOps, integrazione e deployment continui possono essere gestiti utilizzando gli AWS Developer Tools. Inizia archiviando e versionando il codice sorgente dell’applicazione con questi strumenti.

Quindi sfrutta servizi come AWS CodePipeline per orchestrare processi di build, test e deployment. CodePipeline funge da spina dorsale, integrandosi con AWS CodeBuild per compilazione e test del codice, e con AWS CodeDeploy per automatizzare il deployment in vari ambienti. Questo approccio snello garantisce workflow efficienti e automatizzati per integrazione e delivery continui.

In che modo Amazon ECS avvantaggia AWS DevOps?

Amazon ECS è un servizio di gestione container scalabile che semplifica l’esecuzione di container Docker su istanze EC2 tramite un cluster gestito, migliorando il deployment e l’operatività delle applicazioni.

Quali sono alcune strategie per blue/green deployment su AWS?

I blue/green deployment minimizzano downtime e rischio eseguendo due ambienti: uno (blue) con la versione attuale e uno (green) con la nuova versione. In AWS, ciò può essere ottenuto usando servizi come Elastic Beanstalk, AWS CodeDeploy o ECS. Puoi spostare il traffico tra ambienti con Route 53 o un Application Load Balancer, testare in sicurezza l’ambiente green e, se necessario, effettuare un rollback immediato.

Perché in alcuni casi si preferisce ECS a Kubernetes?

ECS offre maggiore flessibilità, scalabilità e semplicità di implementazione rispetto a Kubernetes, risultando la scelta preferita per alcuni deployment.

Come gestiresti e metteresti in sicurezza i segreti per una pipeline CI/CD in AWS?

Per gestire in modo sicuro i segreti in una pipeline CI/CD AWS, puoi usare AWS Secrets Manager o AWS Systems Manager Parameter Store per archiviare informazioni sensibili come chiavi API, password dei database e certificati. Entrambi i servizi si integrano con servizi AWS come CodePipeline e CodeBuild, consentendo l’accesso sicuro ai segreti senza inserirli hardcoded nel codice.

Controllando i permessi di accesso con IAM, puoi garantire che solo entità autorizzate accedano ai dati sensibili, migliorando la sicurezza all’interno del processo CI/CD.

Come usi AWS Systems Manager in un ambiente di produzione?

AWS Systems Manager aiuta ad automatizzare e gestire l’infrastruttura su larga scala. In produzione, è comunemente usato per gestione delle patch, esecuzione remota di comandi, raccolta inventario e archiviazione sicura di parametri di configurazione e segreti. Si integra con EC2, RDS e altri servizi AWS, offrendo visibilità centralizzata e controllo operativo.

Che cos’è AWS CloudFormation e come facilita le pratiche DevOps?

AWS CloudFormation automatizza il provisioning e la gestione dell’infrastruttura AWS tramite codice, abilitando l’Infrastructure as Code (IaC). Questo servizio ti consente di definire l’infrastruttura come template, rendendo semplice versionare, testare e replicare ambienti tra sviluppo, staging e produzione.

In un contesto DevOps, CloudFormation aiuta a mantenere coerenza, riduce gli errori di configurazione manuale e supporta deployment automatizzati, diventando parte integrante della continuous delivery e della replicazione degli ambienti.

Per chiudere il set di domande DevOps, ecco una tabella che riassume i diversi servizi AWS usati in quest’area e i relativi casi d’uso:

| Servizio | Scopo | Casi d’uso in DevOps |

|---|---|---|

| AWS CodePipeline | Automatizza i workflow CI/CD su più ambienti | Integrazione e deployment continui per aggiornamenti snelli |

| AWS CodeBuild | Compila il codice, esegue test e produce artifact distribuibili | Automazione della build, test e generazione di artifact |

| AWS CodeDeploy | Gestisce i deployment applicativi in vari ambienti AWS (es. EC2, Lambda) | Deployment automatizzati su ambienti con capacità di rollback |

| Amazon ECS | Gestione container per il deployment di container Docker | Esecuzione di microservizi, semplificando deployment e gestione |

| AWS Secrets Manager | Archivia e gestisce in modo sicuro informazioni sensibili | Archiviazione sicura di chiavi API, password e altri dati sensibili |

| AWS CloudFormation | Automatizza il setup dell’infrastruttura tramite codice (IaC) | Coerenza dell’infrastruttura, replica ambienti, best practice IaC |

Domande per colloqui da AWS Solution Architect

Per i solution architect, il focus è progettare soluzioni AWS che soddisfino requisiti specifici. Questa sezione mette alla prova la capacità di creare sistemi scalabili, efficienti ed economici con AWS, evidenziando le best practice architetturali.

Qual è il ruolo di un AWS Solution Architect?

Gli AWS Solutions Architect progettano e supervisionano applicazioni su AWS, garantendo scalabilità e prestazioni ottimali. Guidano sviluppatori, amministratori di sistema e clienti nell’uso efficace di AWS per le loro esigenze di business e comunicano concetti complessi sia a stakeholder tecnici sia non tecnici.

Quali sono le principali best practice di sicurezza per AWS EC2?

Le pratiche di sicurezza essenziali per EC2 includono l’uso di IAM per la gestione degli accessi, la limitazione dell’accesso a host fidati, la minimizzazione dei permessi, la disabilitazione del login con password per le AMI e l’implementazione dell’autenticazione multi-fattore per aumentare la sicurezza.

Come garantisci la ridondanza multi-regione in un’architettura AWS?

Per progettare la ridondanza multi-regione, distribuisci risorse critiche come istanze EC2, database RDS e bucket S3 in più regioni AWS. Usa Route 53 per il routing DNS geolocalizzato e S3 Cross-Region Replication per il backup dei dati. Adotta configurazioni active-active o active-passive a seconda della strategia di failover e monitora prestazioni e replica con CloudWatch e AWS Global Accelerator.

Quali strategie adotti per creare un’architettura AWS altamente disponibile e tollerante ai guasti per applicazioni web critiche?

Costruire un’architettura altamente disponibile e tollerante ai guasti su AWS richiede diverse strategie per ridurre l’impatto dei guasti e garantire la continuità operativa. I principi chiave includono:

- Implementare la ridondanza tra i componenti di sistema per eliminare i single point of failure

- Usare il load balancing per distribuire il traffico in modo uniforme e assicurare prestazioni ottimali

- Impostare monitoraggio automatizzato per rilevare i guasti in tempo reale e rispondere. I sistemi dovrebbero essere progettati per scalare al variare dei carichi, con un’architettura distribuita per migliorare la tolleranza ai guasti.

- Applicare isolamento dei guasti, backup regolari e piani di disaster recovery è essenziale per protezione dei dati e ripristino rapido.

- Progettare per una degradazione controllata mantiene funzionalità durante i disservizi, mentre test e deployment continui migliorano l’affidabilità.

Spiega come sceglieresti tra Amazon RDS, Amazon DynamoDB e Amazon Redshift per un’applicazione data-driven.

La scelta tra Amazon RDS, DynamoDB e Redshift per un’applicazione data-driven dipende dalle esigenze specifiche:

- Amazon RDS è ideale per applicazioni che richiedono un database relazionale tradizionale con supporto SQL standard, transazioni e query complesse.

- Amazon DynamoDB è adatto ad applicazioni che necessitano di un database NoSQL altamente scalabile, con prestazioni rapide e prevedibili a qualsiasi scala. È ottimo per modelli dati flessibili e sviluppo rapido.

- Amazon Redshift è il migliore per applicazioni analitiche che richiedono query complesse su grandi dataset, offrendo prestazioni rapide grazie allo storage colonnare e alla tecnologia di data warehousing.

Quali considerazioni prenderesti in esame nel migrare un’applicazione on-premises esistente su AWS? Usa un esempio a scelta.

Quando si migra il software di customer relationship management (CRM) di un’azienda da un’infrastruttura interna ad Amazon Web Services (AWS), è essenziale seguire un quadro strategico simile a quello suggerito da AWS, adattato a questo scenario specifico:

- Preparazione iniziale e definizione della strategia

- Valuta l’attuale setup del CRM per identificare limitazioni e aree di miglioramento.

- Definisci obiettivi chiari di migrazione, come ottenere maggiore scalabilità, migliorare le funzionalità di analisi dati o ridurre i costi di manutenzione.

- Individua le soluzioni AWS necessarie, ad esempio sfruttando Amazon EC2 per le risorse di calcolo e Amazon RDS per la gestione del database.

- Assessment e pianificazione della strategia

- Cataloga i componenti del CRM per stabilire le priorità di migrazione.

- Seleziona tecniche di migrazione adeguate, ad esempio spostare il database CRM con AWS Database Migration Service (DMS).

- Pianifica una connessione di rete stabile durante la migrazione, potenzialmente con AWS Direct Connect.

- Esecuzione e validazione

- Definisci una strategia dettagliata partendo dai moduli CRM meno critici come prova.

- Ottieni l’approvazione degli stakeholder chiave prima di migrare le funzioni principali del CRM, utilizzando i servizi AWS.

- Testa prestazioni e sicurezza del CRM migrato su AWS, apportando le regolazioni necessarie.

- Transizione all’operatività nel cloud

- Passa alla gestione completa dell’applicazione CRM nell’ambiente AWS, dismettendo gradualmente i componenti on-premises.

- Usa la suite di strumenti AWS per monitoraggio e gestione per un controllo continuo e ottimizzazioni.

- Applica gli insight ottenuti da questa migrazione per guidare transizioni future, valutando un’adozione cloud più ampia per altre applicazioni.

Questo approccio assicura che la migrazione del CRM su AWS sia allineata agli obiettivi strategici di business, massimizzando i benefici del cloud in termini di scalabilità, efficienza e risparmio.

Descrivi come useresti i servizi AWS per implementare un’architettura a microservizi.

Implementare un’architettura a microservizi significa suddividere un’applicazione software in piccoli servizi indipendenti che comunicano tramite API. Ecco una guida concisa per impostare i microservizi:

- Adotta lo sviluppo Agile: usa metodologie agili per favorire sviluppo e deployment rapidi dei singoli microservizi.

- Abbraccia l’API-First Design: sviluppa prima le API per l’interazione tra microservizi, così da garantire comunicazioni chiare e coerenti tra i servizi.

- Applica pratiche CI/CD: implementa integrazione e delivery continui per automatizzare test e deployment, aumentando velocità di sviluppo e affidabilità.

- Integra i principi Twelve-Factor App: applicali per creare servizi scalabili e manutenibili, facili da distribuire su piattaforme cloud come AWS.

- Scegli il giusto pattern architetturale: valuta pattern API-driven, event-driven o data streaming in base alle esigenze dell’applicazione per ottimizzare comunicazione e flusso dati tra servizi.

- Sfrutta AWS per il deployment: usa servizi AWS come tecnologie container per microservizi scalabili o il serverless per ridurre la complessità operativa e concentrarti sulla logica applicativa.

- Implementa i principi serverless: quando opportuno, usa architetture serverless per eliminare la gestione dell’infrastruttura, scalare automaticamente e pagare solo ciò che usi, migliorando efficienza e costi.

- Garantisci resilienza del sistema: progetta i microservizi per tolleranza ai guasti e resilienza, utilizzando le funzionalità di disponibilità integrate di AWS per mantenere la continuità del servizio.

- Concentrati sugli aspetti trasversali: affronta monitoraggio distribuito, logging, tracing e coerenza dei dati per mantenere la salute e le prestazioni del sistema.

- Rivedi con l’AWS Well-Architected Framework: usa l’AWS Well-Architected Tool per valutare la tua architettura rispetto alle best practice AWS, garantendo affidabilità, sicurezza, efficienza e convenienza.

Considerando attentamente questi punti, i team possono implementare efficacemente un’architettura a microservizi scalabile, flessibile e adatta alle esigenze specifiche, sfruttando al massimo le capacità del cloud AWS.

Qual è la relazione tra AWS Glue e AWS Lake Formation?

AWS Lake Formation si basa sull’infrastruttura di AWS Glue, incorporandone le capacità ETL, la console di controllo, il data catalog e l’architettura serverless. Mentre AWS Glue è focalizzato sui processi ETL, Lake Formation aggiunge funzionalità per creare, mettere in sicurezza e gestire data lake, potenziando le funzioni di Glue.

Per le domande su AWS Glue in sede di colloquio, è importante capire come Glue supporti Lake Formation. I candidati dovrebbero essere pronti a discutere il ruolo di Glue nella gestione dei data lake su AWS, dimostrando la comprensione dell’integrazione e delle funzionalità di entrambi i servizi nell’ecosistema AWS. Questo evidenzia una profonda conoscenza di come questi servizi collaborano per elaborare e gestire i dati in modo efficiente.

Come ottimizzi i costi AWS per un’applicazione web ad alto traffico?

Per ottimizzare i costi AWS per un’applicazione ad alto traffico, puoi iniziare utilizzando AWS Cost Explorer e AWS Budgets per monitorare e gestire la spesa. Poi considera queste strategie:

- Usa Reserved e Spot Instances rispettivamente per carichi prevedibili e flessibili.

- Auto Scaling aiuta ad adeguare l’allocazione delle risorse alla domanda, riducendo i costi nei periodi di traffico ridotto.

- Ottimizza lo storage con policy di ciclo di vita S3 e S3 Intelligent-Tiering per spostare i dati raramente accessi in classi di archiviazione più economiche.

- Implementa il caching con Amazon CloudFront e Amazon ElastiCache per ridurre le richieste ripetute alle risorse di backend, risparmiando banda e compute.

Questo approccio garantisce efficienza dei costi senza compromettere prestazioni o disponibilità.

Quali sono i pilastri chiave dell’AWS Well-Architected Framework?

L’AWS Well-Architected Framework fornisce un approccio strutturato per progettare architetture AWS sicure, efficienti e resilienti. Si compone di cinque pilastri principali:

- Eccellenza operativa: si concentra sul supporto allo sviluppo e alle operazioni tramite monitoraggio, risposta agli incidenti e automazione.

- Sicurezza: riguarda la protezione di dati, sistemi e asset tramite gestione delle identità, crittografia e risposta agli incidenti.

- Affidabilità: prevede la costruzione di sistemi in grado di riprendersi dai guasti, scalare dinamicamente le risorse e gestire i problemi di rete.

- Efficienza delle prestazioni: incoraggia l’uso di risorse scalabili e carichi ottimizzati.

- Ottimizzazione dei costi: si focalizza sulla gestione dei costi selezionando le risorse giuste e usando modelli di prezzo come le Reserved Instances.

Comprendere questi pilastri consente agli architetti AWS di costruire soluzioni bilanciate che si allineano alle best practice di sicurezza, prestazioni, affidabilità e gestione dei costi.

Domande e risposte avanzate su AWS

Domande per colloqui da AWS Data Engineer

Rivolgendosi ai data engineer, questa sezione approfondisce i servizi AWS per la gestione dei dati, incluso data warehousing ed elaborazione in tempo reale. Esamina le competenze necessarie per costruire pipeline dati scalabili con AWS.

Descrivi la differenza tra Amazon Redshift, RDS e S3 e quando usare ciascuno.

- Amazon S3 è un servizio di object storage che fornisce archiviazione scalabile e durevole per qualsiasi quantità di dati. Può essere usato per archiviare dati grezzi e non strutturati come log, CSV, immagini, ecc.

- Amazon Redshift è un data warehouse cloud ottimizzato per analytics e business intelligence. Si integra con S3 e può caricare dati lì archiviati per eseguire query complesse e generare report.

- Amazon RDS fornisce database relazionali gestiti come PostgreSQL, MySQL, ecc. Può alimentare applicazioni transazionali che necessitano di database conformi ad ACID con funzionalità come indici, vincoli, ecc.

Descrivi uno scenario in cui useresti Amazon Kinesis invece di AWS Lambda per l’elaborazione dati. Quali sono le considerazioni chiave?

Kinesis può essere usato per gestire grandi quantità di dati in streaming e consente di leggere ed elaborare gli stream con applicazioni consumer.

Alcune considerazioni chiave sono illustrate di seguito:

- Volume dei dati: Kinesis può gestire fino a megabyte al secondo di dati contro il limite di Lambda di 6 MB per invocazione, utile per stream ad alto throughput.

- Elaborazione in streaming: i consumer Kinesis possono elaborare continuamente i dati in tempo reale al loro arrivo, a differenza delle invocazioni batch di Lambda; questo aiuta con la bassa latenza.

- Capacità di replay: gli stream Kinesis mantengono i dati per un periodo configurato, consentendo replay e rielaborazione se necessario, mentre Lambda non è adatto al replay.

- Ordinamento: gli shard Kinesis consentono l’elaborazione ordinata di record correlati. Lambda, invece, potrebbe elaborare fuori ordine.

- Scalabilità e parallelismo: gli shard Kinesis possono scalare per gestire il carico. Lambda può richiedere orchestrazione.

- Integrazione: Kinesis si integra bene con altri servizi AWS come Firehose, Redshift, EMR per l’analisi.

Inoltre, per casi di streaming ad alto volume, continuo, ordinato e riproducibile, come l’analisi in tempo reale, Kinesis offre supporto nativo allo streaming rispetto all’approccio batch di Lambda.

Per saperne di più sul data streaming, il nostro corso Streaming Data with AWS Kinesis and Lambda aiuta a imparare come sfruttare queste tecnologie per ingerire dati da milioni di fonti e analizzarli in tempo reale. Può aiutarti a prepararti meglio per domande su AWS Lambda al colloquio.

Quali sono le differenze chiave tra elaborazione batch e in tempo reale? Quando sceglieresti un approccio rispetto all’altro per un progetto di data engineering?

L’elaborazione batch prevede la raccolta dei dati in un periodo di tempo e la loro elaborazione in grandi blocchi o batch. Funziona bene per analizzare dati storici e meno frequenti.

L’elaborazione in streaming in tempo reale analizza i dati continuamente, man mano che arrivano, in piccoli incrementi. Consente di analizzare dati recenti e frequentemente aggiornati.

Per un progetto di data engineering, potresti scegliere lo streaming in tempo reale quando:

- Hai bisogno di insight immediati e non puoi aspettare l’esecuzione di un processo batch. Ad esempio, il rilevamento frodi.

- I dati cambiano costantemente e l’analisi deve stare al passo, come nel monitoraggio dei social media.

- È richiesta bassa latenza, ad esempio per sistemi di trading automatico.

L’elaborazione batch può essere migliore quando:

- I dati storici richiedono modellazione o analisi complesse, come il forecasting della domanda.

- I dati provengono da fonti varie che forniscono solo dump periodici.

- I costi di elaborazione inferiori sono più critici della velocità di elaborazione.

Quindi, il real-time è ideale per dati in rapida evoluzione che richiedono analisi continue, mentre il batch si adatta a dati disponibili periodicamente che necessitano di modellazione storica.

Come puoi automatizzare l’evoluzione dello schema in una data pipeline su AWS?

L’evoluzione dello schema può essere gestita usando le funzionalità di dynamic frame e inferenza dello schema di AWS Glue. In combinazione con il Glue Data Catalog, puoi tracciare automaticamente i cambiamenti di schema. Per evitare di interrompere i processi a valle, implementa step di validazione dello schema con strumenti come AWS Deequ o integra logiche personalizzate negli script ETL per registrare e risolvere le incongruenze.

Come gestisci schema-on-read vs schema-on-write nei data lake AWS?

Lo schema-on-read è comunemente usato nei data lake, dove i dati grezzi e semi-strutturati sono archiviati (ad es. in S3) e lo schema viene applicato solo in fase di query usando strumenti come Athena o Redshift Spectrum. Questo approccio offre flessibilità per fonti dati eterogenee. Lo schema-on-write, spesso usato in RDS o Redshift, impone la struttura a priori ed è preferito per dataset transazionali o strutturati che richiedono validazioni rigorose.

Che cos’è un operational data store e come completa un data warehouse?

Un operational data store (ODS) è un database progettato per supportare operazioni e analytics in tempo reale. Funziona come piattaforma intermedia tra sistemi transazionali e data warehouse.

Mentre un data warehouse contiene dati di alta qualità ottimizzati per business intelligence e reporting, un ODS contiene dati aggiornati, orientati ai soggetti e integrati da più fonti.

Di seguito le caratteristiche chiave di un ODS:

- Fornisce dati in tempo reale per il monitoraggio delle operazioni e il decision-making

- Integra dati live da più fonti

- È ottimizzato per query e analytics veloci, non per storage a lungo termine

- L’ODS contiene dati granulari e atomici, contro dati aggregati nel warehouse

Un ODS e un data warehouse sono sistemi complementari. L’ODS supporta le operazioni in tempo reale con dati correnti, mentre il data warehouse abilita reporting e analisi strategiche su dati storici integrati. Insieme, offrono una piattaforma completa per esigenze operative e analitiche.

Come imposteresti un data lake su AWS e quali servizi useresti?

Per costruire un data lake su AWS, il servizio core da cui partire è Amazon S3 per archiviare dati grezzi, strutturati e non strutturati in modo scalabile e durevole. Ecco un approccio passo-passo e i servizi aggiuntivi coinvolti:

- Livello di storage: usa Amazon S3 per archiviare grandi volumi di dati. Organizza i dati con una gerarchia di cartelle strutturata in base a tipo, fonte o freschezza.

- Data cataloging: usa AWS Glue per creare un data catalog, che facilita la ricerca e la query dei dati in S3 creando metadati.

- Trasformazione dati ed ETL: usa AWS Glue ETL per preparare e trasformare i dati grezzi in un formato pronto per l’analisi.

- Sicurezza e controllo accessi: implementa AWS IAM e AWS Lake Formation per gestire accessi, permessi e crittografia dei dati.

- Analytics e query: usa Amazon Athena per query ad hoc, Amazon Redshift Spectrum per analytics e Amazon QuickSight per la visualizzazione.

Questa configurazione offre un’architettura di data lake flessibile e scalabile, in grado di gestire grandi volumi di dati per analisi sia strutturate sia non strutturate.

Spiega le diverse classi di storage in Amazon S3 e quando usare ciascuna.

Amazon S3 offre diverse classi di storage, ognuna ottimizzata per specifici casi d’uso ed esigenze di costo. La seguente tabella le riassume:

| Classe di storage | Caso d’uso | Frequenza di accesso | Convenienza economica |

|---|---|---|---|

| S3 Standard | Dati ad accesso frequente | Alta | Prezzi standard |

| S3 Intelligent-Tiering | Pattern di accesso imprevedibili | Regolata automaticamente | Conveniente con tiering automatico |

| S3 Standard-IA | Accesso infrequente ma recupero rapido | Bassa | Costo inferiore, recupero rapido |

| S3 One Zone-IA | Accesso infrequente in una singola AZ | Bassa | Costo inferiore, minore ridondanza |

| S3 Glacier | Archiviazione a lungo termine con accesso infrequente | Raro | Basso costo, recupero in minuti o ore |

| S3 Glacier Deep Archive | Archiviazione per conformità o normative | Molto raro | Costo più basso, recupero in 12–48 ore |

Comprendere le classi di storage S3 aiuta a ottimizzare costi e tempi di accesso in base alle esigenze dei dati.

Domande su AWS basate su scenari

Concentrandosi sull’applicazione pratica, queste domande valutano la capacità di problem solving in scenari realistici, richiedendo una comprensione completa di come impiegare i servizi AWS per affrontare sfide complesse.

La seguente tabella riassume scenari tipici posti durante i colloqui su AWS, insieme alla descrizione e alle possibili soluzioni:

|

Tipo di caso |

Descrizione |

Soluzione |

|

Migrazione applicativa |

Un’azienda intende migrare la sua applicazione legacy su AWS. L’applicazione è data-intensive e richiede accesso a bassa latenza per utenti in tutto il mondo. Quali servizi e quale architettura AWS consiglieresti per garantire alta disponibilità e bassa latenza? |

|

|

Disaster recovery |

La tua organizzazione vuole implementare un piano di disaster recovery per i carichi di lavoro AWS critici con un RPO (Recovery Point Objective) di 5 minuti e un RTO (Recovery Time Objective) di 1 ora. Descrivi i servizi AWS che useresti per soddisfare questi obiettivi. |

|

|

Protezione da DDoS |

Considera uno scenario in cui devi progettare un’infrastruttura applicativa web scalabile e sicura su AWS. L’applicazione deve gestire picchi improvvisi di traffico e proteggersi da attacchi DDoS. Quali servizi e funzionalità AWS useresti nel tuo design? |

|

|

Analisi dati in tempo reale |

Una startup IoT vuole elaborare e analizzare dati in tempo reale da migliaia di sensori in tutto il mondo. La soluzione deve essere altamente scalabile e conveniente. Quali servizi AWS useresti per costruire questa piattaforma e come garantiresti la scalabilità con la domanda? |

|

|

Analisi di grandi volumi di dati |

Un’azienda di servizi finanziari richiede una soluzione di data analytics su AWS per elaborare e analizzare grandi volumi di dati transazionali in tempo reale. La soluzione deve anche rispettare rigorosi standard di sicurezza e conformità. Come progetteresti questa soluzione su AWS e quali misure adotteresti per garantire sicurezza e conformità? |

|

Domande non tecniche su AWS

Oltre alle competenze tecniche, comprendere l’impatto più ampio delle soluzioni AWS è fondamentale per un colloquio di successo. Di seguito alcune domande con relative risposte. Queste possono variare da candidato a candidato, in base a esperienza e background.

Come resti aggiornato su AWS e sulle tendenze del cloud?

- Cosa si aspetta il selezionatore: vuole conoscere il tuo impegno nell’apprendimento continuo e come mantieni attuali le tue competenze. Cerca risorse o pratiche specifiche che usi per restare informato.

- Risposta di esempio: "Resto aggiornato leggendo i blog ufficiali di AWS e partecipando a forum della community come il subreddit AWS. Partecipo anche a meetup locali di utenti AWS e a webinar. Queste attività mi aiutano a restare informato sulle ultime funzionalità e best practice di AWS."

Descrivi un’occasione in cui hai dovuto spiegare un concetto AWS complesso a qualcuno senza background tecnico. Come hai fatto?

- Cosa si aspetta il selezionatore: questa domanda valuta le tue capacità di comunicazione e di semplificazione di informazioni complesse. Cerca prove della tua capacità di insegnare e pazienza.

- Risposta di esempio: "Nel mio precedente ruolo, ho dovuto spiegare i vantaggi dello storage cloud a stakeholder non tecnici. Ho usato l’analogia tra archiviare file in un cloud drive e in un hard disk fisico, evidenziando facilità di accesso e sicurezza. Questo li ha aiutati a capire il concetto senza entrare nei dettagli tecnici."

Cosa ti motiva a lavorare nel settore del cloud computing, in particolare con AWS?

- Cosa si aspetta il selezionatore: vuole valutare la tua passione per il campo e capire cosa ti spinge. Cerca motivazioni autentiche allineate al ruolo e ai valori aziendali.

- Risposta di esempio: "Ciò che mi entusiasma del cloud computing, soprattutto di AWS, è la sua capacità di trasformare i business in termini di scalabilità e innovazione. L’evoluzione costante dei servizi AWS mi motiva a risolvere nuove sfide e contribuire a progetti di impatto."

Puoi descrivere un progetto impegnativo che hai gestito e come ne hai garantito il successo?

- Cosa si aspetta il selezionatore: qui l’attenzione è sulle tue capacità di project management e problem solving. È interessato al tuo approccio nel superare gli ostacoli e portare i progetti a termine.

- Risposta di esempio: "In un progetto precedente, abbiamo affrontato ritardi significativi a causa di vincoli di risorse. Ho dato priorità alle attività in base all’impatto, negoziato risorse aggiuntive e mantenuto una comunicazione chiara con il team e gli stakeholder. Questo approccio ci ha aiutati a rispettare le milestone e a consegnare in tempo."

Come gestisci scadenze strette quando più progetti richiedono la tua attenzione?

- Cosa si aspetta il selezionatore: questa domanda testa le tue abilità di gestione del tempo e di priorità. Vuole sapere come gestisci stress e carico di lavoro in modo efficace.

- Risposta di esempio: "Uso una combinazione di prioritizzazione e delega. Valuto urgenza e impatto di ciascun progetto, stabilisco le priorità di conseguenza e delego quando opportuno. Comunico inoltre regolarmente con gli stakeholder su progressi e eventuali aggiustamenti per rispettare le scadenze."

Cosa pensi distingua AWS dagli altri provider cloud?

- Cosa si aspetta il selezionatore: cerca la tua comprensione della proposta di valore unica di AWS. L’obiettivo è vedere se hai una buona percezione di ciò che rende AWS leader nel settore cloud.

- Risposta di esempio: "AWS si distingue per la sua vasta infrastruttura globale, che offre scalabilità e affidabilità senza pari. Inoltre, l’impegno all’innovazione, con una gamma ampia e profonda di servizi, consente soluzioni cloud più flessibili e su misura rispetto ai concorrenti."

Come affronti l’apprendimento di nuovi strumenti o servizi AWS quando vengono introdotti?

- Cosa si aspetta il selezionatore: questa domanda valuta la tua adattabilità e il tuo stile di apprendimento. Vuole vedere un approccio proattivo alla padronanza di nuove tecnologie, essenziale in un settore in rapida evoluzione come il cloud.

- Risposta di esempio: "Quando AWS introduce un nuovo servizio, inizio consultando la documentazione ufficiale e le release note per comprenderne scopo e funzionalità. Poi esploro tutorial pratici e sperimento in un ambiente sandbox per fare esperienza. Se possibile, discuto il servizio con colleghi o partecipo a forum per vedere come lo sfruttano altri. Questa combinazione di teoria e pratica mi aiuta a prendere confidenza rapidamente."

Descrivi come bilanci sicurezza ed efficienza quando progetti soluzioni AWS.

- Cosa si aspetta il selezionatore: valuta la tua capacità di pensare in modo strategico alla sicurezza considerando anche le prestazioni. L’obiettivo è vedere se sai bilanciare le best practice di sicurezza con l’efficienza operativa.

- Risposta di esempio: "Credo che sicurezza ed efficienza vadano di pari passo. Quando progetto soluzioni AWS, parto con una mentalità security-first implementando policy IAM, isolamento di rete con VPC e crittografia dei dati. Per l’efficienza, mi assicuro che queste pratiche non introducano latenza inutile, ottimizzando le configurazioni e scegliendo servizi scalabili come AWS Lambda per task intensivi. Il mio approccio è costruire architetture sicure, ma anche reattive ed economiche."

Conclusione

Questo articolo ha offerto una roadmap completa delle domande per colloqui su AWS per candidati a vari livelli di esperienza: da chi muove i primi passi nel mondo AWS ai professionisti affermati che vogliono far crescere la propria carriera.

Che tu stia preparando il tuo primo colloquio su AWS o punti a ottenere una posizione più avanzata, questa guida è una risorsa preziosa. Ti prepara non solo a rispondere alle domande di colloquio, ma anche a interagire in profondità con la piattaforma AWS, migliorando la tua comprensione e l’applicazione delle sue vaste capacità.

FAQs

Ho bisogno di una certificazione AWS per ottenere un lavoro nel cloud?

Sebbene non obbligatorie, le certificazioni AWS come AWS Certified Solutions Architect Associate o AWS Certified Developer Associate convalidano la tua esperienza e arricchiscono il CV. Molti datori di lavoro apprezzano le certificazioni come prova delle competenze, ma l’esperienza pratica è altrettanto importante.

Quali sono i servizi AWS più importanti su cui concentrarsi per i colloqui?

I servizi AWS chiave dipendono dal ruolo per cui ti candidi. Alcuni universalmente importanti includono:

- Compute: EC2, Lambda.

- Storage: S3, EBS, Glacier.

- Networking: VPC, Route 53, ELB.

- Sicurezza: IAM, KMS.

- Database: RDS, DynamoDB.

- Strumenti DevOps: CloudFormation, CodePipeline.

Quali soft skill sono essenziali per avere successo in un colloquio AWS?

Oltre alla competenza tecnica, i datori di lavoro spesso valutano:

- Problem solving: sai progettare soluzioni scalabili ed economiche?

- Comunicazione: riesci a spiegare chiaramente concetti tecnici agli stakeholder?

- Gestione del tempo: come dai priorità ai task e rispetti le scadenze in ambienti dinamici?

- Lavoro di squadra: sai collaborare efficacemente in team cross-funzionali?

Cosa succede se non so rispondere a una domanda tecnica durante un colloquio AWS?

Va bene non sapere tutto. Invece di indovinare, sii onesto:

- Spiega come cercheresti la risposta (ad es., consultando la documentazione AWS o conducendo test).

- Metti in evidenza conoscenze correlate che dimostrino la tua comprensione del concetto più ampio.

Come posso negoziare lo stipendio per un ruolo correlato ad AWS?

- Ricerca i livelli retributivi per il tuo ruolo e la tua area usando siti come Glassdoor o Payscale.

- Evidenzia certificazioni, esperienze rilevanti e progetti durante la negoziazione.

- Dimostra come le tue competenze possano portare valore all’azienda, ad esempio riducendo i costi o migliorando l’affidabilità dell’infrastruttura.

Cosa dovrei fare dopo aver fallito un esame di certificazione o un colloquio AWS?

- Individua le aree deboli usando il feedback o il report dell’esame.

- Crea un piano di studio o pratica per rafforzare quelle aree.

- Sfrutta risorse aggiuntive, come prove d’esame o laboratori pratici.

- Non scoraggiarti: molti professionisti superano alla seconda o terza prova.

Un data scientist poliedrico che ama condividere le proprie conoscenze e restituire valore agli altri, Zoumana è un content creator su YouTube e un top writer tech su Medium. Trova soddisfazione nel parlare in pubblico, programmare e insegnare. Zoumana ha due lauree magistrali: la prima in informatica con specializzazione in Machine Learning conseguita a Parigi, Francia, e la seconda in Data Science alla Texas Tech University negli Stati Uniti. Ha iniziato la sua carriera come Software Developer presso Groupe OPEN in Francia, per poi passare a IBM come Machine Learning Consultant, dove ha sviluppato soluzioni di IA end-to-end per compagnie assicurative. Successivamente, è entrato in Axionable, la prima startup di Sustainable AI con sede a Parigi e Montréal. Lì ha lavorato come Data Scientist e ha implementato prodotti di IA, principalmente casi d’uso di NLP, per clienti in Francia, Montréal, Singapore e Svizzera. Inoltre, ha dedicato il 5% del suo tempo ad attività di Ricerca e Sviluppo. Attualmente lavora come Senior Data Scientist presso IFC - World Bank Group.