Corso

L'analisi dei dati è un metodo completo di ispezione, pulizia, trasformazione e modellazione dei dati per scoprire informazioni utili, trarre conclusioni e supportare il processo decisionale. È un processo sfaccettato che coinvolge varie tecniche e metodologie per interpretare dati provenienti da diverse fonti in formati differenti, sia strutturati che non strutturati.

In questo articolo, ti offrirò una panoramica dettagliata del processo di analisi dei dati. Se alla fine vuoi approfondire il campo, prosegui con il nostro articolo correlato, Come diventare Data Analyst, che copre tutto ciò che devi sapere per avviare la tua carriera e le competenze che dovrai padroneggiare.

TL;DR

- L'analisi dei dati è il processo di pulizia, trasformazione e modellazione dei dati per scoprire insight azionabili a supporto delle decisioni

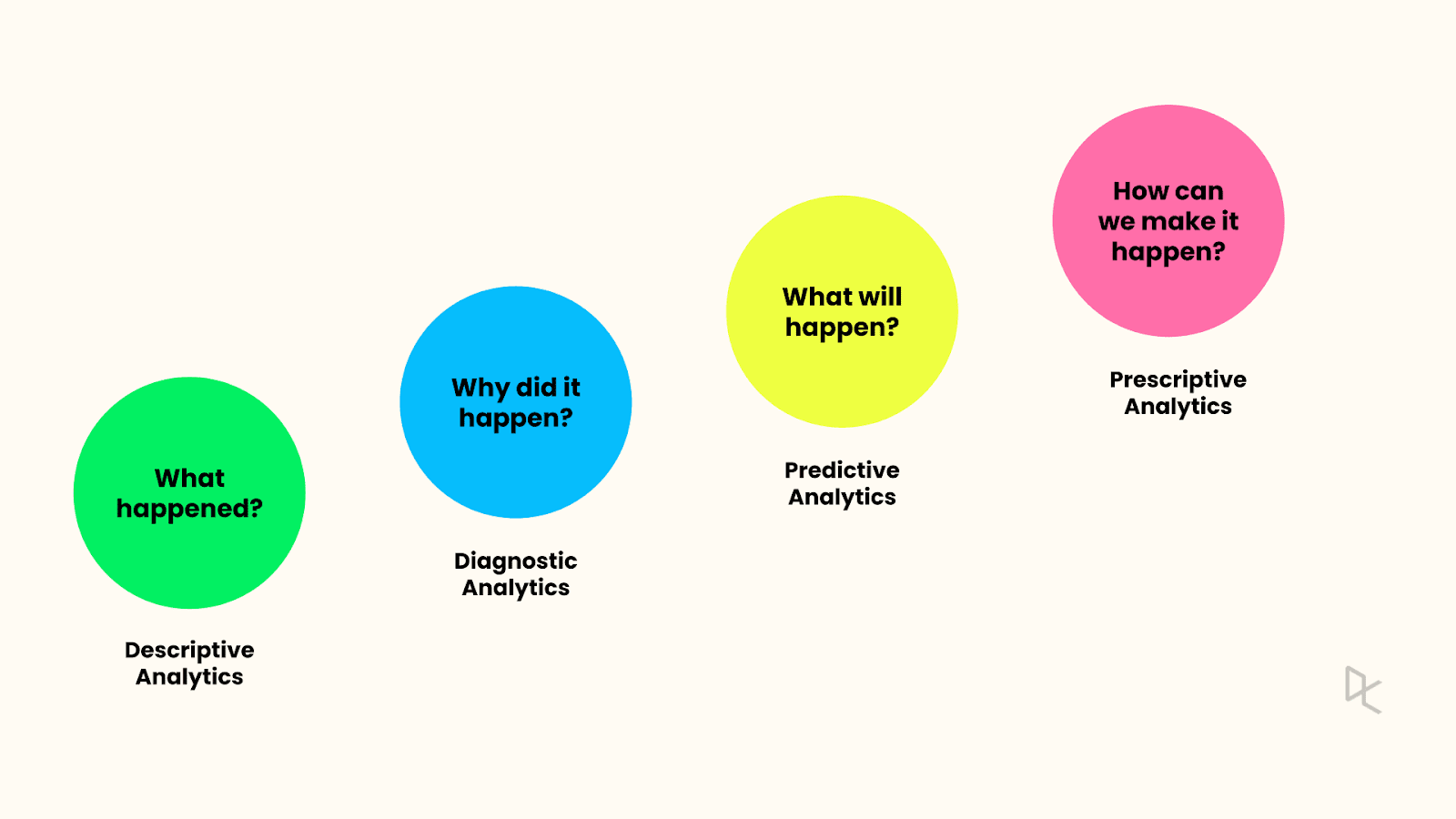

- Le quattro tipologie principali sono descrittiva (cos'è successo), diagnostica (perché), predittiva (cosa succederà) e prescrittiva (cosa fare)

- Strumenti chiave includono Python, R, SQL, Power BI, Tableau ed Excel

- Il processo segue sei fasi: definire obiettivi, raccogliere i dati, pulire i dati, analizzare, visualizzare e raccontare la storia

- Le carriere più richieste includono data scientist, analytics engineer, BI analyst, data engineer e business analyst

Che cos'è l'analisi dei dati?

L'analisi dei dati è il processo sistematico di pulizia, trasformazione e modellazione dei dati per scoprire insight azionabili a supporto delle decisioni.

Non è solo un semplice processo; è una capacità fondamentale di business intelligence (BI) che consente alle organizzazioni di prendere decisioni guidate dai dati, prevedere trend e migliorare l'efficienza operativa. Se usata insieme a modelli statistici e algoritmi di machine learning, costituisce la spina dorsale della pianificazione strategica in aziende, governi e altre organizzazioni.

Consideriamo l'impatto nei settori:

- E-commerce: Un retailer non si limita a "osservare i comportamenti d'acquisto". Usa l'analisi predittiva per calcolare il Customer Lifetime Value (CLV) e ridurre il churn. Analizzando dati strutturati (log delle transazioni) e non strutturati (recensioni), può iper-personalizzare il percorso utente in tempo reale.

- Sanità: Oltre all'assistenza generale, i provider utilizzano i big data per modellare trend epidemiologici e abilitare la medicina di precisione.

- Finanza: Gli algoritmi ora automatizzano la valutazione del rischio e il rilevamento delle frodi individuando anomalie in millisecondi che gli analisti umani non coglierebbero.

L'importanza dell'analisi dei dati nel 2026

Negli ultimi anni, l'analisi dei dati è diventata più cruciale che mai. Mentre l'ultimo decennio è stato definito dall'accumulo di "big data", il 2026 è definito da velocità e utilità. A mio avviso, non basta più limitarsi a raccogliere petabyte di informazioni. Il vantaggio competitivo risiede ora nella Decision Intelligence: la capacità di digitalizzare e automatizzare le decisioni usando dati e AI.

Le ricerche di Grand View Research stimano che il settore della Business Intelligence crescerà da circa 36,6 miliardi di dollari nel 2024 a oltre 86,6 miliardi entro il 2030. Gran parte di questa crescita è trainata dall'integrazione dell'AI generativa negli strumenti di BI.

Oggi le organizzazioni usano l'analisi dei dati per risolvere sfide complesse in tempo reale:

- Iper-personalizzazione: Oltre la semplice segmentazione, verso un'esperienza su misura a livello individuale.

- Resilienza operativa: Manutenzione predittiva per prevenire guasti a supply chain o infrastrutture prima che accadano.

- Ottimizzazione dei profitti: Passaggio dall'analisi dei ricavi all'ottimizzazione automatizzata dei margini.

L'analisi dei dati è il motore che trasforma il carburante grezzo dei dati non strutturati (video, testo, segnali IoT) nel prodotto raffinato della strategia aziendale.

Il processo di analisi dei dati: guida passo dopo passo

Il processo di analisi dei dati è un approccio sistematico che comprende diverse fasi. Qui ti accompagniamo in ogni passaggio, dalla definizione degli obiettivi al data storytelling. Puoi approfondire come le aziende analizzano i dati in una guida separata.

Il processo di analisi dei dati in breve

Fase 1: Definire obiettivi e domande

La prima fase del processo di analisi dei dati è definire gli obiettivi e formulare domande chiare e specifiche a cui l'analisi mira a rispondere. Questo passaggio è cruciale perché determina la direzione dell'intero processo. Comporta la comprensione del problema o della situazione, l'identificazione dei dati necessari per affrontarlo e la definizione di metriche o indicatori per misurare i risultati.

Fase 2: Raccolta dei dati

Una volta definiti obiettivi e domande, il passo successivo è raccogliere i dati pertinenti. Ciò può essere fatto tramite vari metodi come sondaggi, interviste, osservazioni o estraendoli da database esistenti. I dati raccolti possono essere quantitativi (numerici) o qualitativi (non numerici), a seconda della natura del problema e delle domande poste.

Fase 3: Pulizia dei dati

La pulizia dei dati, nota anche come data cleansing, è una fase critica del processo di analisi. Consiste nel verificare la presenza di errori e incongruenze nei dati e nel correggerli o rimuoverli. Questo passaggio garantisce qualità e affidabilità dei dati, fondamentali per ottenere risultati accurati e significativi dall'analisi.

Fase 4: Modellazione statistica e riconoscimento di pattern

Una volta puliti i dati, è il momento dell'analisi vera e propria. Si applicano tecniche statistiche o matematiche ai dati per scoprire pattern, relazioni o trend. Esistono vari strumenti e software per questo scopo, come Python, R, Excel e software specializzati come SPSS e SAS.

Fase 5: Interpretazione e visualizzazione dei dati

Dopo l'analisi, il passaggio successivo è interpretare i risultati e visualizzarli in modo facile da comprendere. Ciò può includere la creazione di grafici, diagrammi o altre rappresentazioni visive dei dati. La data visualization aiuta a rendere comprensibili dati complessi e fornisce un quadro chiaro dei risultati.

Fase 6: Data storytelling

L'ultima fase del processo è il data storytelling. Consiste nel presentare i risultati dell'analisi in forma narrativa, coinvolgente e di facile comprensione. Il data storytelling è fondamentale per comunicare i risultati a pubblici non tecnici e per prendere decisioni guidate dai dati.

Le tipologie di analisi dei dati

L'analisi dei dati può essere classificata in quattro categorie principali, ciascuna con uno scopo specifico e fonti di insight differenti. Sono analisi descrittiva, diagnostica, predittiva e prescrittiva.

Le quattro tipologie di analytics

Analisi descrittiva

L'analisi descrittiva, come suggerisce il nome, descrive o riassume dati grezzi e li rende interpretabili. Comporta l'analisi di dati storici per capire cosa è successo in passato. Questo tipo di analisi serve a identificare pattern e trend nel tempo.

Per esempio, un'azienda potrebbe usare l'analisi descrittiva per capire le vendite medie mensili dell'ultimo anno.

Analisi diagnostica

L'analisi diagnostica fa un passo oltre l'analisi descrittiva determinando perché qualcosa è successo. Prevede un'esplorazione dei dati più dettagliata e il confronto tra diversi dataset per comprendere la causa di un determinato risultato.

Ad esempio, se le vendite di un'azienda sono diminuite in un certo mese, l'analisi diagnostica può essere usata per capire il motivo.

Analisi predittiva

L'analisi predittiva utilizza modelli statistici e tecniche di forecasting per comprendere il futuro. Usa i dati passati per prevedere ciò che potrebbe accadere. È spesso impiegata nella valutazione del rischio, nel marketing e nel forecasting delle vendite.

Per esempio, un'azienda potrebbe usare l'analisi predittiva per prevedere le vendite del prossimo trimestre basandosi sui dati storici.

Analisi prescrittiva

L'analisi prescrittiva è la forma più avanzata di analisi dei dati. Non solo prevede risultati futuri, ma suggerisce anche le azioni da intraprendere per trarre vantaggio da tali previsioni. Usa strumenti e tecnologie sofisticati come machine learning e intelligenza artificiale per formulare raccomandazioni.

Per esempio, un'analisi prescrittiva potrebbe suggerire le migliori strategie di marketing per aumentare le vendite future.

Confronto

Nella tabella seguente trovi un confronto tra le diverse tipologie di analisi dei dati:

| Tipo di analisi | Domanda chiave | Focus | Metodologia | Esempio aziendale |

|---|---|---|---|---|

| Descrittiva | Cos'è successo? | Hindsight (Il passato) | Aggregazione dei dati, statistiche riassuntive | Una dashboard che mostra che le vendite mensili sono calate del 15% nel Q3. |

| Diagnostica | Perché è successo? | Insight (La causa) | Drill-down, discovery, correlazione | Individuare che il calo del Q3 è stato causato da un taglio dei prezzi di un concorrente in una specifica regione. |

| Predittiva | Cosa è probabile che succeda? | Foresight (Il futuro) | Analisi di regressione, modelli di forecasting | Prevedere che le vendite caleranno di un ulteriore 5% nel Q4 se non si interviene. |

| Prescrittiva | Cosa dovremmo fare? | Ottimizzazione (L'azione) | Machine learning, simulazione, raccomandazione AI | Un sistema AI che suggerisce automaticamente uno sconto del 10% ai clienti fedeli per recuperare i ricavi persi. |

Tecniche di analisi dei dati

Esistono numerose tecniche usate nell'analisi dei dati, ognuna con uno scopo e un'applicazione specifici. Qui tratteremo alcune delle più comuni, tra cui analisi esplorativa, analisi di regressione, analisi fattoriale e altre.

Analisi esplorativa

L'analisi esplorativa è usata per comprendere le caratteristiche principali di un dataset. Spesso si utilizza all'inizio di un processo di analisi per riassumere gli aspetti principali dei dati, verificare dati mancanti e testare ipotesi. Questa tecnica include metodi visivi come scatter plot, istogrammi e box plot.

Puoi saperne di più sulla exploratory data analysis con il nostro corso, che copre come esplorare, visualizzare ed estrarre insight dai dati usando Python.

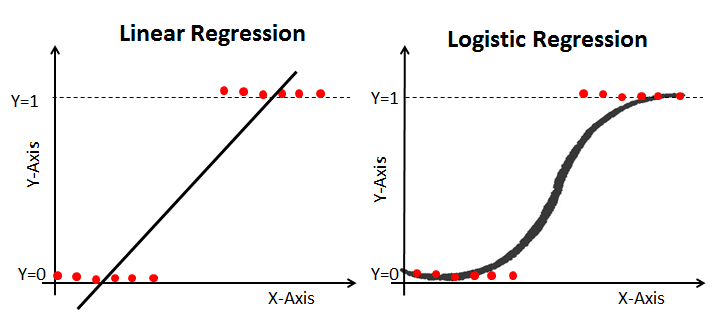

Analisi di regressione

L'analisi di regressione è un metodo statistico usato per comprendere la relazione tra una variabile dipendente e una o più variabili indipendenti. È comunemente usata per forecasting, modellazione di serie temporali e per individuare relazioni di effetto causale tra variabili.

Abbiamo diversi tutorial utili, come la regressione lineare semplice, oltre a risorse specifiche per tecnologia: Essentials of Linear Regression in Python e How to Do Linear Regression in R. Vale la pena conoscere in dettaglio la regressione lineare perché è una delle tecniche più utilizzate per comprendere le relazioni e fare previsioni.

Regressione lineare e logistica

Analisi fattoriale

L'analisi fattoriale è una tecnica utilizzata per ridurre un elevato numero di variabili in pochi fattori. I fattori sono costruiti in modo da catturare quante più informazioni possibili dalle variabili originali. Questa tecnica è spesso impiegata in ricerche di mercato, segmentazione dei clienti e riconoscimento di immagini.

Scopri di più sull'analisi fattoriale in R con il nostro corso, che esplora variabili latenti, come la personalità, usando analisi fattoriale esplorativa e confermativa.

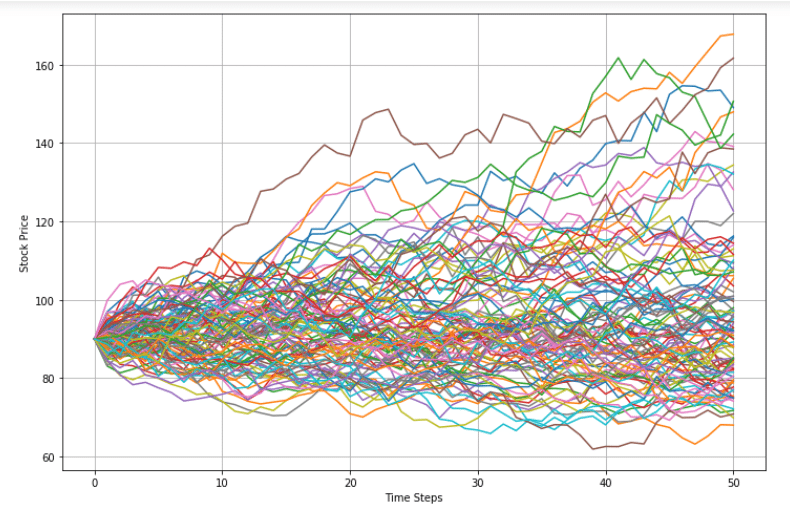

Simulazione Monte Carlo

La simulazione Monte Carlo è una tecnica che usa distribuzioni di probabilità e campionamento casuale per stimare risultati numerici. È spesso impiegata nell'analisi del rischio e nel decision-making quando c'è un'elevata incertezza.

Abbiamo un tutorial che esplora i metodi Monte Carlo in R, oltre a un corso sulle simulazioni Monte Carlo in Python, che possono stimare un range di esiti per eventi incerti.

Esempio di simulazione Monte Carlo

Analisi di cluster

L'analisi di cluster è una tecnica usata per raggruppare un insieme di oggetti in modo che gli oggetti nello stesso gruppo (cluster) siano più simili tra loro che a quelli di altri gruppi. È spesso utilizzata nella segmentazione di mercato, nella segmentazione di immagini e nei sistemi di raccomandazione.

Puoi esplorare una gamma di tecniche di clustering, inclusi clustering gerarchico e k-means, nel nostro corso Cluster Analysis in R.

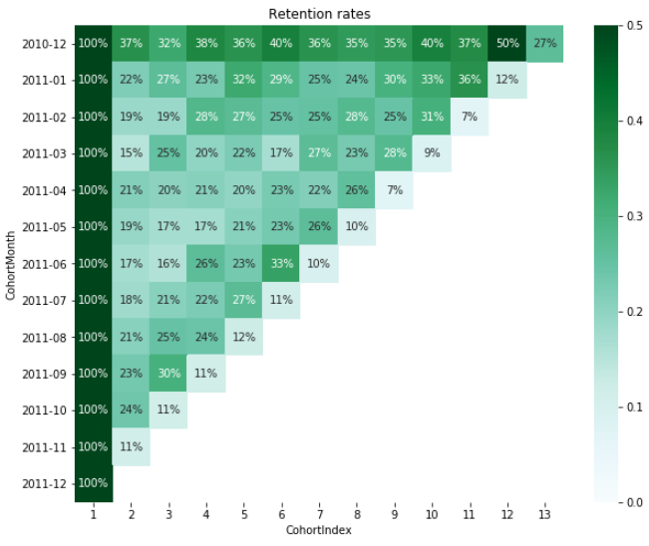

Analisi di coorte

L'analisi di coorte è un sottoinsieme della behavioral analytics che prende i dati di un determinato dataset e li raggruppa in gruppi correlati per l'analisi. Questi gruppi correlati, o coorti, di solito condividono caratteristiche comuni entro un arco temporale definito. Questa tecnica è spesso usata in marketing, engagement degli utenti e analisi del ciclo di vita del cliente.

Il nostro corso Customer Segmentation in Python esplora una gamma di tecniche per segmentare e analizzare i dati dei clienti, inclusa l'analisi di coorte.

Grafico che mostra un esempio di analisi di coorte

Analisi delle serie temporali

L'analisi delle serie temporali è una tecnica statistica che si occupa di dati temporali, o analisi dei trend. Si utilizza per analizzare la sequenza dei punti dati ed estrarne statistiche significative e altre caratteristiche. È spesso impiegata nel forecasting delle vendite, nelle previsioni economiche e meteorologiche.

Il nostro skill track Time Series with Python e il corso Forecasting in R ti guidano su come manipolare e analizzare dati di serie temporali, lavorando con diverse librerie.

Analisi del sentiment

La sentiment analysis, nota anche come opinion mining, utilizza l'elaborazione del linguaggio naturale, l'analisi del testo e la linguistica computazionale per identificare ed estrarre informazioni soggettive dalle fonti. È spesso usata nel monitoraggio dei social media, nel monitoraggio del brand e per comprendere il feedback dei clienti.

Per familiarizzare con la sentiment analysis in Python, puoi seguire il nostro corso online, che ti insegnerà a eseguire un'analisi del sentiment end-to-end.

AutoML (machine learning automatizzato)

Nel 2026, l'AutoML è diventato un "copilota" standard per i professionisti dei dati. Automatizza il processo dispendioso di selezione degli algoritmi e tuning degli iperparametri. Gli analyst ora usano l'AutoML per generare rapidamente modelli di base di alta qualità, concentrando gli sforzi manuali su feature engineering e perfezionamento strategico.

Analisi di dati non strutturati

L'analisi moderna va ben oltre i fogli di calcolo. Questa tecnica prevede l'estrazione di insight da dati non tabulari come immagini, flussi video e registrazioni audio usando il Deep Learning e la Computer Vision. È essenziale per attività come il monitoraggio del brand nei contenuti video o la diagnosi tramite imaging medico.

Analisi dei dati assistita dall'AI

L'AI generativa e i large language model (LLM) stanno trasformando il modo in cui gli analyst interagiscono con i dati nel 2026. Gli analyst usano regolarmente assistenti AI per scrivere query SQL da prompt in linguaggio naturale, generare codice Python per trasformazioni dei dati e creare visualizzazioni in automatico. I copiloti AI nativi di piattaforma in Power BI, Tableau e Databricks consentono agli analyst di concentrarsi sull'interpretazione dei risultati e sulle decisioni strategiche anziché scrivere codice ripetitivo.

Tuttavia, un uso responsabile dell'AI nell'analisi richiede la validazione di tutti gli output generati dall'AI, la comprensione della metodologia sottostante e il mantenimento di pratiche di data governance. L'AI accelera il flusso di lavoro ma non sostituisce il giudizio e l'esperienza di dominio dell'analyst.

Per imparare le best practice su come usare l'AI nei workflow di analisi dei dati, assicurati di consultare le nostre guide su Uso di ChatGPT per progetti di Data Science e Prompt Engineering.

Strumenti per l'analisi dei dati

Nel campo dell'analisi dei dati, sono disponibili vari strumenti che rispondono a esigenze, complessità e livelli di competenza differenti. Si va da linguaggi di programmazione come Python e R a software di visualizzazione come Power BI e Tableau. Vediamo più da vicino alcuni di questi strumenti.

| Strumento | Categoria | Ideale per | Livello di competenza |

|---|---|---|---|

| Python | Programmazione | Analisi personalizzate, machine learning, automazione | Intermedio |

| R | Programmazione | Calcolo statistico, ricerca accademica | Intermedio |

| SQL | Linguaggio di query | Interrogazione database, estrazione dati | Principiante |

| Power BI | BI & Visualizzazione | Dashboard aziendali, ecosistema Microsoft | Principiante |

| Tableau | BI & Visualizzazione | Visualizzazioni avanzate, dataset di grandi dimensioni | Principiante |

| Excel | Foglio di calcolo | Analisi rapide, report ad hoc, prototipazione | Principiante |

Confronto tra i principali strumenti di analisi dei dati

Python

Python è un linguaggio di programmazione di alto livello e di uso generale che è diventato il preferito tra data analyst e data scientist. La sua semplicità e leggibilità, unite a un'ampia gamma di librerie come pandas, NumPy, Matplotlib e Polars, lo rendono un eccellente strumento per analisi e visualizzazione dei dati. I workflow moderni in Python fanno ora largo affidamento su AI Coding Assistant per generare codice standard e fare il debug di script complessi all'istante.

Risorse per iniziare

- Puoi iniziare a imparare Python oggi con il nostro skill track Python Fundamentals, che copre tutte le competenze di base per comprendere il linguaggio.

- Puoi anche seguire il career track Data Analyst with Python per iniziare il tuo percorso da data analyst.

- Dai un'occhiata al nostro cheat sheet Python per principianti come pratica guida di riferimento.

R

R è un linguaggio di programmazione e un ambiente software libero progettato specificamente per il calcolo statistico e la grafica. È ampiamente usato da statistici e data miner per lo sviluppo di software statistico e analisi dei dati. R offre una vasta gamma di tecniche statistiche e grafiche, tra cui modellazione lineare e non lineare, test statistici classici, analisi di serie temporali e altro.

Risorse per iniziare

- Il nostro skill track R Programming ti introdurrà a R e ti aiuterà a sviluppare le competenze necessarie per iniziare a programmare in R.

- Con il career track Data Analyst with R, acquisirai le competenze necessarie per avviare il tuo percorso da data analyst.

- Il nostro Getting Started with R cheat sheet offre una panoramica su come iniziare a imparare la programmazione in R.

SQL

SQL (Structured Query Language) è il linguaggio standard per gestire e manipolare database. Si usa per recuperare e manipolare dati archiviati in database relazionali. SQL è essenziale per i compiti che implicano gestione o manipolazione dei dati all'interno dei database.

Risorse per iniziare

- Per familiarizzare con SQL, considera il nostro skill track SQL Fundamentals, dove imparerai a interagire con i dati e interrogarli.

- SQL for Business Analysts potenzierà le tue competenze di SQL per il business.

- Il nostro cheat sheet SQL Basics copre un elenco di funzioni per interrogare, filtrare, aggregare i dati e molto altro.

Power BI

Power BI è uno strumento di business analytics sviluppato da Microsoft. Fornisce visualizzazioni interattive con funzionalità di business intelligence self-service. Power BI è usato per trasformare dati grezzi in insight significativi tramite dashboard e report di facile comprensione.

Risorse per iniziare

- Esplora la potenza di Power BI con il nostro skill track Power BI Fundamentals, dove imparerai a ottenere il massimo dallo strumento di business intelligence.

- Con Exploratory Data Analysis in Power BI imparerai come arricchire i tuoi report con l'EDA.

- Abbiamo un cheat sheet di Power BI che copre molte basi per iniziare.

Tableau

Tableau è un potente strumento di visualizzazione dei dati usato nell'industria della Business Intelligence. Ti consente di creare dashboard interattivi e condivisibili che mostrano trend, variazioni e densità dei dati sotto forma di grafici e diagrammi.

Risorse per iniziare

- Lo skill track Tableau Fundamentals ti introdurrà allo strumento di business intelligence e a come usarlo per pulire, analizzare e visualizzare i dati.

- Analyzing Data in Tableau ti fornirà competenze avanzate per migliorare analisi e visualizzazioni.

- Dai un'occhiata al nostro cheat sheet di Tableau, che ti guida attraverso le nozioni essenziali per iniziare a usare lo strumento.

Excel

Microsoft Excel è uno degli strumenti più utilizzati per l'analisi dei dati. Offre una gamma di funzionalità per manipolazione, analisi statistica e visualizzazione dei dati. La semplicità e la versatilità di Excel lo rendono ideale sia per attività semplici sia per analisi complesse.

Risorse per iniziare

- Consulta il nostro corso Data Analysis in Excel per sviluppare competenze operative in Excel.

- Per le competenze sui fogli di calcolo in generale, dai un'occhiata a Marketing Analytics in Spreadsheets.

- Lo cheat sheet Excel Basics copre molte formule e operazioni di base per iniziare.

Capire l'impatto dell'analisi dei dati

L'analisi dei dati, su piccola o larga scala, può avere un impatto profondo sulle performance aziendali. Può guidare cambiamenti significativi, portando a maggiore efficienza, redditività e a una comprensione più profonda dei trend di mercato e del comportamento dei clienti.

Decisioni informate

L'analisi dei dati consente alle aziende di prendere decisioni informate basate su fatti, cifre e trend, invece che su supposizioni o intuizioni. Fornisce una base solida per la pianificazione strategica e le policy, garantendo un uso efficace delle risorse e concentrando gli sforzi sulle aree con il maggior ritorno.

Impatto sulle piccole imprese

Per le piccole imprese, anche un'analisi semplice può portare a miglioramenti significativi. Per esempio, analizzare i dati di vendita può aiutare a identificare quali prodotti performano bene e quali no. Queste informazioni possono poi essere usate per adeguare strategie di marketing, prezzi e gestione dell'inventario, portando a maggiori vendite e redditività.

Impatto sulle grandi imprese

Per le aziende più grandi, l'impatto dell'analisi dei dati può essere ancora più profondo. L'analisi dei big data può svelare pattern e trend complessi altrimenti impossibili da rilevare. Questo può portare a insight dirompenti, stimolando l'innovazione e fornendo un vantaggio competitivo.

Per esempio, un grande retailer potrebbe usare l'analisi dei dati per ottimizzare la supply chain, riducendo i costi e migliorando l'efficienza. Oppure un'azienda tech potrebbe analizzare il comportamento degli utenti, migliorando il design del prodotto e l'engagement.

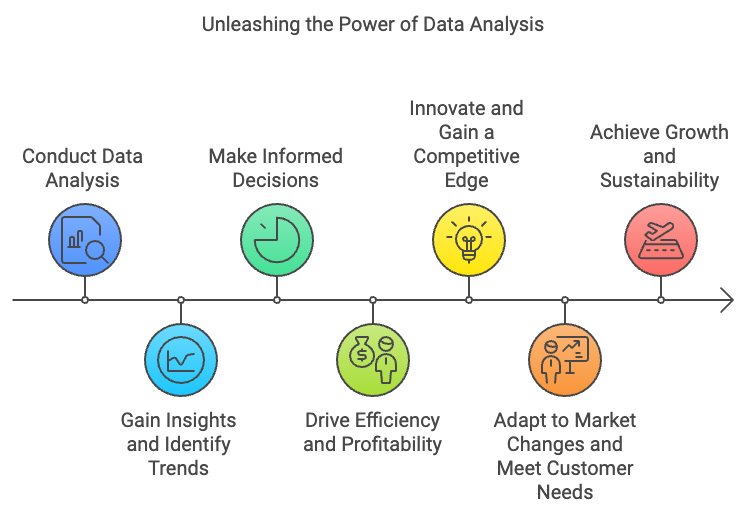

Il ruolo critico dell'analisi dei dati

Nel mondo odierno guidato dai dati, la capacità di analizzare e interpretare i dati è una competenza critica. Le aziende che sanno sfruttare la potenza dell'analisi sono più pronte ad adattarsi ai cambiamenti del mercato, soddisfare le esigenze dei clienti e stimolare crescita e redditività.

Creato con Napkin.AI

Le migliori carriere nell'analisi dei dati nel 2026

Nell'era dei big data, le carriere nell'analisi dei dati stanno fiorendo. Con la crescente domanda di insight, queste professioni offrono prospettive promettenti. Qui discuteremo alcune delle migliori carriere nell'analisi dei dati nel 2026, facendo riferimento alla nostra guida completa sulle dieci carriere top nell'analytics. Nota come le competenze di analisi dei dati siano richieste anche in lavori oltre a quelli con "Data Analyst" nel titolo.

1. Data scientist

I data scientist sono i detective del mondo dei dati, in grado di scoprire pattern, insight e trend a partire da grandi quantità di informazioni. Usano una combinazione di programmazione, competenze statistiche e machine learning per dare senso a dataset complessi. I data scientist non solo analizzano i dati, ma sfruttano gli insight per influenzare le decisioni strategiche all'interno dell'organizzazione.

Abbiamo una guida completa su come diventare data scientist, che spiega tutto ciò che devi sapere per iniziare la tua carriera nel settore.

2. Analytics engineer

Una figura a cavallo tra data analyst e data engineer, questo ruolo è esploso in popolarità. Gli analytics engineer portano le best practice dell'ingegneria del software nei team data. Sono responsabili di trasformare dati grezzi in dataset puliti, testati e documentati di cui gli analyst possano fidarsi. Strumenti come dbt (data build tool) sono parte essenziale del loro toolkit.

3. Business intelligence analyst

I business intelligence analyst forniscono una visione chiara delle performance aziendali analizzando dati relativi a trend di mercato, processi aziendali e concorrenza. Usano strumenti e software per convertire dati complessi in report e dashboard comprensibili, aiutando i decision-maker a capire la posizione dell'azienda e a prendere decisioni informate.

4. Data engineer

I data engineer costruiscono e mantengono le pipeline di dati. Progettano, costruiscono, installano, testano e mantengono sistemi di gestione dei dati altamente scalabili. Garantiscono inoltre che i dati siano puliti, affidabili e pre-processati per consentire ai data scientist di svolgere l'analisi.

Scopri di più su cosa fa un data engineer e come puoi diventare data engineer nella nostra guida dedicata.

5. Business analyst

I business analyst sono il ponte tra IT e stakeholder aziendali. Usano i dati per valutare i processi, definire i requisiti e fornire raccomandazioni e report data-driven a dirigenti e stakeholder. Sono coinvolti nella pianificazione strategica, nell'analisi dei modelli di business, nel design dei processi e nell'analisi dei sistemi.

| Carriera | Competenze chiave | Strumenti essenziali |

|---|---|---|

| Data Scientist | Statistica avanzata, ML/Deep Learning, workflow AutoML, Data Storytelling. | Python, R, SQL, TensorFlow, PyTorch, piattaforme AutoML. |

| Analytics Engineer | Best practice di ingegneria del software, Data Modeling, controllo versione, SQL pulito. | dbt (data build tool), SQL, Git, Snowflake, BigQuery. |

| Data Engineer | Architetture cloud, orchestrazione pipeline, DataOps, elaborazione real-time. | AWS/Azure/GCP, Spark, Kafka, Airflow, Python, SQL. |

| BI Analyst | Design di dashboard, Data Storytelling, business acumen, prompting per insight AI. | Power BI, Tableau, Looker, SQL, Excel. |

| Business Analyst | Raccolta requisiti (tramite GenAI), mappatura processi, gestione stakeholder. | Excel (con Python), Jira, Confluence, Power BI, SQL. |

Tabella che descrive diverse carriere nell'analisi dei dati

Come iniziare con l'analisi dei dati

Intraprendere il tuo percorso nell'analisi dei dati può sembrare impegnativo all'inizio, ma con le giuste risorse e la giusta guida puoi sviluppare le competenze necessarie e la conoscenza. Ecco alcuni passaggi per iniziare, con focus sulle risorse disponibili su DataCamp.

Per avere successo nell'analisi dei dati, devi costruire solide basi di conoscenza, affinare competenze pratiche e accumulare esperienza preziosa. Inizia con statistica, matematica e programmazione e affronta progetti reali. Poi sviluppa competenze di dominio e connettiti con professionisti del settore. Combina competenze, abilità ed esperienza per una carriera di successo nell'analisi dei dati.

Richie Cotton, Data Evangelist at DataCamp

Comprendi le basi

Prima di tuffarti nell'analisi dei dati, è importante comprenderne le basi. Ciò include familiarizzare con concetti statistici, tipi di dati e strutture dati. I corsi di DataCamp Introduction to Data Science in Python o Introduction to Data Science in R sono ottimi punti di partenza.

Impara un linguaggio di programmazione

L'analisi dei dati richiede competenza in almeno un linguaggio di programmazione. Python e R sono tra le scelte più popolari per la loro versatilità e l'ampia gamma di librerie per l'analisi dei dati. Offriamo percorsi di apprendimento completi sia per Python sia per R.

Padroneggia manipolazione e visualizzazione dei dati

La manipolazione e la visualizzazione dei dati sono componenti chiave dell'analisi. Ti permettono di pulire, trasformare e visualizzare i dati, rendendoli più facili da comprendere e analizzare. Corsi come Data Manipulation with pandas o Data Visualization with ggplot2 possono aiutarti a sviluppare queste competenze.

Approfondisci tecniche specifiche di analisi

Una volta acquisite le basi, puoi approfondire tecniche specifiche di analisi come la regressione, l'analisi di serie temporali o il machine learning. Offriamo un'ampia gamma di corsi su molti argomenti, che ti permettono di specializzarti in base ai tuoi interessi e obiettivi professionali.

Pratica, pratica, pratica

La chiave per padroneggiare l'analisi dei dati è la pratica. La practice mode e i progetti di DataCamp offrono esperienza pratica con dati reali, aiutandoti a consolidare l'apprendimento e applicare le competenze. Puoi trovare un elenco di 20 progetti di data analytics per tutti i livelli per ispirarti.

Ricorda, imparare l'analisi dei dati è un percorso. Va benissimo iniziare in piccolo e costruire gradualmente le tue competenze nel tempo. Con pazienza, costanza e le giuste risorse, sarai sulla buona strada per diventare un data analyst competente.

Considerazioni finali

Che tu sia un marketer che vuole capire il comportamento dei clienti, un professionista sanitario che punta a migliorare gli esiti per i pazienti o un leader aziendale che cerca di stimolare crescita e redditività, l'analisi dei dati può fornirti gli insight necessari per avere successo.

Ricorda, l'analisi dei dati non riguarda solo numeri e statistiche. Si tratta di porre le domande giuste, essere curiosi riguardo a pattern e trend e avere il coraggio di prendere decisioni informate dai dati. Si tratta di raccontare una storia con i dati, una storia che può influenzare le strategie, cambiare prospettive e guidare l'innovazione.

Quindi, ti invitiamo ad applicare la tua comprensione dell'analisi dei dati nei rispettivi campi. Sfrutta la potenza dei dati per scoprire insight, prendere decisioni informate e guidare il successo. Il mondo dei dati è a portata di mano, pronto per essere esplorato. Inizia oggi con il nostro career track Data Analyst with Python, che ti darà le competenze di analisi dei dati per manipolare, analizzare e visualizzare i dati.

FAQs

Che cos'è l'analisi dei dati?

L'analisi dei dati è un metodo completo che prevede l'ispezione, la pulizia, la trasformazione e la modellazione dei dati per scoprire informazioni utili, trarre conclusioni e supportare il processo decisionale. È un processo che consente alle organizzazioni di prendere decisioni informate, prevedere i trend e migliorare l'efficienza operativa.

Quali sono le fasi del processo di analisi dei dati?

Il processo di analisi dei dati comprende diverse fasi, tra cui la definizione di obiettivi e domande, la raccolta dei dati, la pulizia dei dati, l'analisi dei dati, l'interpretazione e visualizzazione dei dati e il data storytelling. Ogni fase è fondamentale per garantire accuratezza e utilità dei risultati.

Quali sono le diverse tipologie di analisi dei dati?

L'analisi dei dati può essere suddivisa in quattro categorie: analisi descrittiva, diagnostica, predittiva e prescrittiva. L'analisi descrittiva riassume i dati grezzi, quella diagnostica determina perché è accaduto qualcosa, l'analisi predittiva usa i dati passati per prevedere il futuro e quella prescrittiva suggerisce azioni basate sulle previsioni.

Quali sono alcune tecniche comunemente usate nell'analisi dei dati?

Esistono varie tecniche di analisi dei dati, tra cui analisi esplorativa, analisi di regressione, simulazione Monte Carlo, analisi fattoriale, analisi di coorte, analisi di cluster, analisi di serie temporali e sentiment analysis. Ognuna ha uno scopo e un'applicazione specifici nell'interpretazione dei dati.

Quali sono alcuni degli strumenti utilizzati nell'analisi dei dati?

Tipicamente si utilizzano strumenti come Python, R e SQL per la programmazione, e Power BI, Tableau ed Excel per la visualizzazione e la gestione dei dati.

Come posso iniziare a imparare l'analisi dei dati?

Puoi iniziare imparando le basi di concetti statistici, tipi e strutture di dati. Poi impara un linguaggio di programmazione come Python o R, padroneggia manipolazione e visualizzazione dei dati e approfondisci tecniche specifiche di analisi dei dati.

Come posso diventare un data analyst?

Diventare Data Analyst richiede una solida comprensione delle tecniche statistiche e degli strumenti di analisi dei dati. È generalmente necessaria la padronanza di software come Python, R, Excel e di software specializzati come SPSS e SAS. Leggi la nostra guida completa su come diventare Data Analyst e valuta la nostra Certificazione Data Analyst per farti notare dai recruiter.

Qual è la differenza tra analisi dei dati e data science?

L'analisi dei dati si concentra sull'esame dei dati esistenti per trovare pattern, trend e insight che informano le decisioni aziendali. La data science è un campo più ampio che include l'analisi dei dati ma comprende anche la costruzione di modelli predittivi, lo sviluppo di algoritmi e il lavoro con il machine learning. In breve, l'analisi dei dati chiede "cosa è successo e perché?" mentre la data science chiede anche "cosa succederà dopo?"

Come sta cambiando l'AI l'analisi dei dati nel 2026?

L'AI sta trasformando l'analisi dei dati automatizzando attività di routine come la pulizia dei dati, la generazione di codice e la creazione di visualizzazioni. Gli analyst ora usano assistenti AI per scrivere query SQL dal linguaggio naturale, generare script Python e identificare pattern in grandi dataset. Tuttavia, l'AI integra, non sostituisce, il giudizio umano: gli analyst hanno ancora bisogno di competenza di dominio per interpretare i risultati, validare gli output dell'AI e prendere decisioni strategiche.

Senior editor nell’ambito dell’AI e dell’edtech. Impegnata a esplorare le tendenze in tema di dati e intelligenza artificiale.

Adel è un formatore e speaker in Data Science, nonché VP dei Media presso DataCamp. Adel ha pubblicato diversi corsi e sessioni di formazione live su analisi dei dati, machine learning e data engineering. È appassionato di diffondere competenze e alfabetizzazione sui dati all'interno delle organizzazioni e di esplorare l'intersezione tra tecnologia e società. Ha un MSc in Data Science and Business Analytics. Nel tempo libero, lo trovi spesso in compagnia del suo gatto Louis.