course

Mija niemal równo rok od dnia, w którym ukazała się pierwsza wersja ChatGPT Images z modelem o nazwie GPT Image 1. OpenAI ponownie gruntownie przeprojektowało swój model obrazowania i proponuje nowe podejście: zamiast „generatora obrazów” mamy teraz „wizualnego partnera do myślenia”.

W tym artykule omówimy, co się zmieniło, jak model wypada na tle swojego poprzednika, ChatGPT Images 1.5, jak wypada w porównaniu z Google Nano Banana 2, a także gdzie ten model błyszczy (a gdzie nie).

Zachęcamy też do zapoznania się z naszym przewodnikiem po najnowszym LLM OpenAI, GPT-5.5.

Czym jest ChatGPT Images 2.0?

ChatGPT Images 2.0 to next-genowy model obrazowania OpenAI. Przedstawiany jest jako narzędzie, które najpierw wnioskuje i bada, a dopiero potem renderuje.

Co nowego w ChatGPT Images 2.0?

Jedną z największych obserwacji przy wydaniu ChatGPT Images 1.5 był znaczący wzrost szybkości działania. W tamtym czasie zapowiadano czterokrotne przyspieszenie. Próbowaliśmy to zweryfikować i zauważyliśmy, że dotyczyło to edycji, a nie generowania nowych obrazów.

Tym razem głównym hasłem jest inteligencja. ChatGPT Images 2.0 to „myślący” model obrazowania: ma wyszukiwać, rozumować o faktach i przekładać nieprecyzyjne wejścia (notatki, szkice, referencje) na dopracowane wizualizacje przy znacznie mniejszej liczbie ręcznych podpowiedzi.

Inne najważniejsze punkty ogłoszenia:

- Większa precyzja i kontrola nad samym procesem generowania

- Lepsza wydajność w wielu językach i alfabetach

- Większa wyrafinowanie stylistyczne i realizm

- Ulepszona inteligencja dotycząca świata rzeczywistego wbudowana w model

- Elastyczne proporcje obrazu — od formatów mobilnych po banery

Model, który myśli

Jednym z największych twierdzeń przy tej premierze jest to, że nowy model „myśli” i działa jak „wizualny partner do myślenia”. Chodzi o to, że agenci wykonują część pracy w tle, aby dokładnie zrozumieć zadanie i przeprowadzić nad nim rozumowanie, zanim przystąpią do generowania.

Jego wiedza o świecie została zaktualizowana do grudnia 2025 r., więc wyniki są bardziej trafne kontekstowo. Dzięki temu nowy model ma świetnie sprawdzać się przy materiałach edukacyjnych i wieloetapowych przepływach pracy wymagających kontekstu.

Wyszukiwanie w sieci

Aby zniwelować lukę między datą odcięcia a bieżącymi informacjami, Images 2.0 potrafi przeszukiwać internet w poszukiwaniu odpowiednich danych. Z notatek wydawniczych OpenAI nie wynika dokładnie, jak to działa, ale rozumiemy to tak, że wyszukiwanie w sieci służy jako narzędzie wywoływane przez wspomnianego wyżej myślącego agenta.

Tworzenie wielu obrazów z jednego promptu

Nowy model natywnie obsługuje też generowanie wielu obrazów z tych samych promptów. W API dało się to osiągnąć obejściem (prosząc o „kompozycję”), ale teraz można to robić także w interfejsie, i to do dziesięciu obrazów. OpenAI obiecuje spójność postaci i obiektów we wszystkich wynikach.

Testowanie ChatGPT Images 2.0

Czas sprawdzić, co nowy model naprawdę potrafi! Przetestowaliśmy następujące możliwości i funkcje Images 2.0:

- Przepływ pracy przy edycji

- Tryb myślenia i wyszukiwanie w sieci

- Zakres stylistyczny

- Dopracowywanie surowych szkiców

- Elastyczność proporcji obrazu

- Kreatywność

Testowanie przepływu edycji

OpenAI w wersji 2.0 stawia na iterację: surowe wejście — dopracowany zasób, z poprawą w podążaniu za instrukcjami i wierniejszym renderowaniem gęstego tekstu. Przetestowaliśmy tę pętlę na słynnym amerykańskim znaczku z 1898 r. „Western Cattle in Storm”.

Oto zdjęcie jednego ze znaczków w stanie Fine.

Aby konkretnie sprawdzić przepływ edycji, użyliśmy poniższego promptu bez trybu myślenia. Oznacza to też, że model nie miał dostępu do wyszukiwania w sieci, co przetestowaliśmy osobno.

Please create for me a picture of the famous 1898 Western Cattle in Storm stamp issued by the U.S. Post Office as part of the Trans-Mississippi Issue . The name of the stamp is "Western Cattle in Storm" Quality should be Fine to Very Fine -Centering: design shifted right, left margin twice as wide as right margin, perfs nearly touching design on the right side -Perforations: two short teeth on the top edge, slightly uneven spacing along the bottom -Gum: quarter-inch matte hinge remnant in upper-center of back, small paper fragment still -attached -Paper: diagonal gum bend across lower-left quadrant, light yellow toning along top edge -Cancellation: partial black circular datestamp in lower-right corner, moderate coverage over the cattleA oto wynik:

Samo podpowiadanie tekstowe nie zadziałało. Szczegółowy opis znaczka i jego stanu okazał się błędny w większości kluczowych aspektów — zły kolor, zły układ nominału, karykaturalne przesunięcie centrowania. Odwzorowanie konkretnego historycznego artefaktu wyłącznie na podstawie tekstu to trudne zadanie.

Przekazanie modelowi obrazu referencyjnego i poproszenie o ukierunkowane poprawki to miejsce, w którym 2.0 pokazało swoją wartość: nieregularności perforacji, resztka zawiasu, ukośne zagięcie gumy, lekkie przyżółcenie i częściowe skasowanie.

Edycje w przybliżeniu trafiły tam, gdzie prosiliśmy. Model wprowadził regresję proporcji obrazu, ale jedna doprecyzowująca, zwykła prośba językiem naturalnym rozwiązała problem. Ostateczny efekt nie nadaje się na analizę kryminalistyczną — „$1” wygląda nieco rozciągnięte, inna jest kukurydza — ale pętla zadziałała: surowy start, korekta kursu, użyteczny wynik po trzech turach.

Testowanie renderowania wielojęzycznego tekstu

Renderowanie tekstu w niełacińskich alfabetach było stałą piętą achillesową modeli obrazowania, a OpenAI wskazuje to jako jedną z kluczowych poprawek. Wydanie zapowiada wysoką wierność generowania tekstu po japońsku, koreańsku, chińsku, w hindi i bengalskim — nie tylko tłumaczonego, ale też składanego spójnie i z typografią naturalną dla danego języka.

Uczciwym testem jest poproszenie o plakat lub infografikę z blokiem tekstu w jednym z tych pism i konsultacja wyniku z native speakerem. Poprosiliśmy model o stworzenie nowoczesnego japońskiego plakatu lifestyle’owego reklamującego fikcyjną lokalną kawiarnię i ich sezonowe latte z kwiatem wiśni.

「居心地の良い日本のカフェの窓辺を描いた、モダンなグラフィックデザインスタイルのライフスタイルポスター。大きな窓から差し込む自然な光と、小さな観葉植物。ポスターの中央には、以下の日本語テキストが大きく、はっきりと読みやすく配置されている。フォントは現代的でクリーンなゴシック体(sans-serif)。

テキスト内容:

『桜フェア開催中。

心休まる場所で、

春の訪れを。

さくらラテ 650円』

テキストの下には、小さな文字で『HAVE A GOOD DAY』という英語のサブタイトルがあり、一番下にはロゴマークと『CAFE YUTORI』というローマ字の店名がある。全体的に暖かく、洗練されたレイアウト。」Tak wygląda wynik:

Według naszego kolegi mówiącego po japońsku (pozdrowienia dla Svena!) wygląda to znacznie lepiej niż w poprzednich modelach, gdzie wiele znaków było kompletnie zniekształconych. Tutaj wszystko wypada naturalniej i jest łatwe do odczytania dla native speakerów.

W trybie myślenia model dodał nawet kilka zdań poza instrukcjami promptu na małej tabliczce w lewym dolnym rogu. Pasują do kontekstu i nie są powtórzeniem, w wolnym przekładzie brzmiąc mniej więcej: „Sezonowy, łagodny smak. Zrób relaksującą przerwę — rozsmakuj się w filiżance, która niesie wiosnę”.

Testowanie trybu myślenia i wyszukiwania w sieci

Musieliśmy uważać, jak testujemy możliwości wyszukiwania w sieci, bo jeśli powiemy modelowi w promptcie, czego chcemy, nie testujemy wyszukiwania, tylko podążanie za instrukcją. Najczystszą próbą jest poproszenie o coś bardzo aktualnego i bardzo konkretnego, przekazanie modelowi niemal zerowej ilości informacji i sprawdzenie, czy potrafi poprawnie uzupełnić luki.

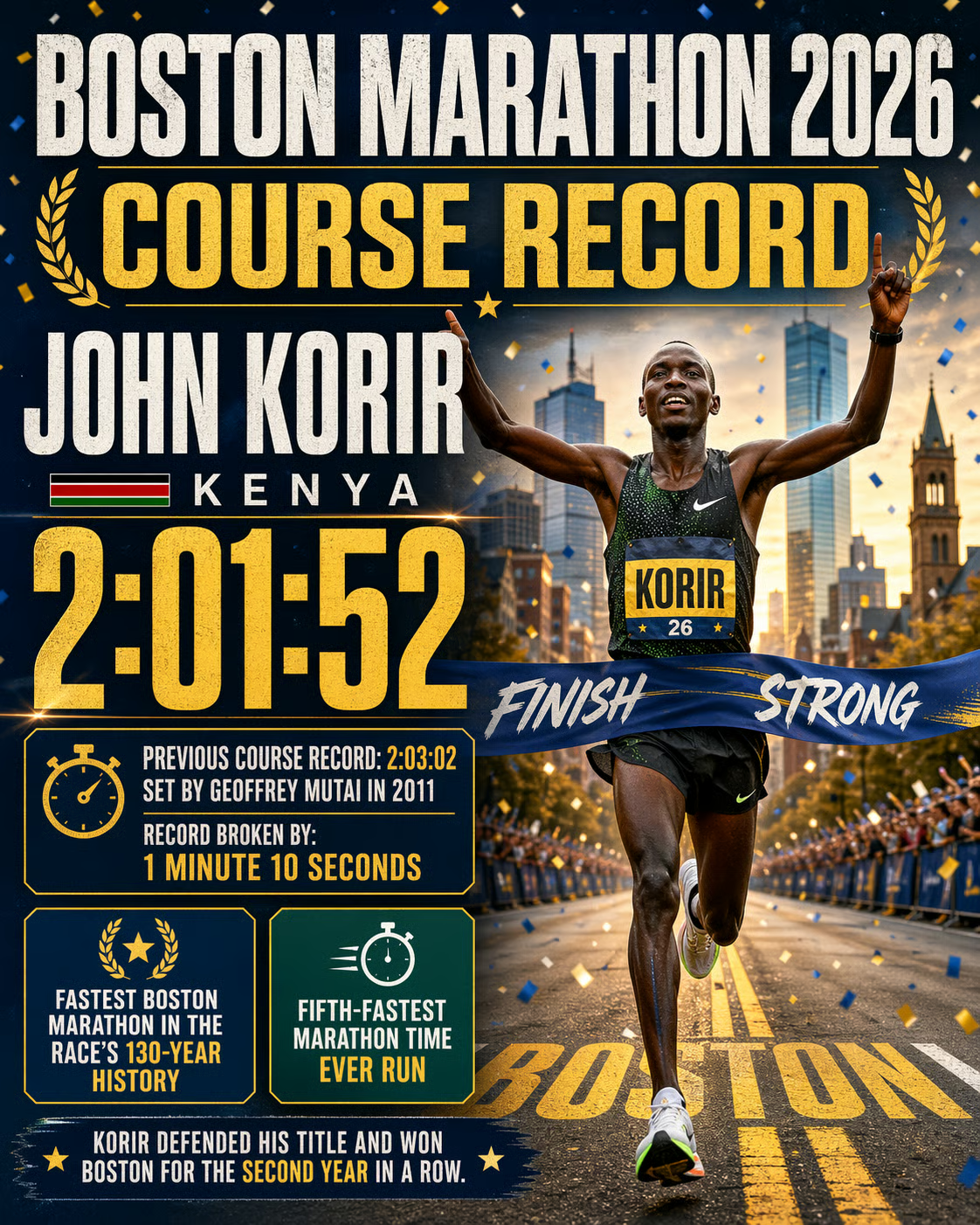

Wybraliśmy wczorajszy maraton bostoński. Zawody zakończyły się w poniedziałek, 20 kwietnia — dzień przed ogłoszeniem ChatGPT Images 2.0 — a rekord trasy mężczyzn został pobity po raz pierwszy od 2011 r. Daje to nam konkretny zestaw faktów (zwycięzca, kraj, czas, różnica, kontekst), których model nie mógł mieć w danych treningowych, a które łatwo zweryfikować szybkim wyszukaniem.

Oto prompt, celowo pozbawiony szczegółów. I widać w wyniku, że model naprawdę przeszukuje sieć!

Create a celebratory poster-style infographic commemorating the course record set at yesterday's Boston Marathon. Include the winner's name, country, finish time, and the margin by which the previous record was broken. Include one or two additional stats or context details that make the achievement meaningful.

Wizualnie rezultat jest bardzo atrakcyjny i utrzymany w kolorystyce maratonu bostońskiego, co jest miłym dodatkiem. Wszystkie podane fakty są poprawne, co dwukrotnie sprawdziliśmy i potwierdziliśmy.

Ponieważ stary model (Images 1.5) nie potrafił przeszukiwać sieci, byliśmy pewni, że udzieli błędnej odpowiedzi. Mimo to przetestowaliśmy go na tym samym promptcie i oto wynik:

Pod względem stylu może konkurować, ale pojawia się tu sporo problemów liczbowych:

- Bieg był 130. edycją maratonu bostońskiego, więc powinno być „129 lat tradycji”, a nie 127.

- Twierdzenie, że to „trzeci biegacz w historii poniżej 2:04 w maratonie”, też jest fałszywe. Około 20 biegaczy tego dokonało.

- Zgodnie ze stroną Boston Athletic Association jego czas drugiej połowy wynosił 1:00:02, a nie 1:01:05 (co mogło nadal być najszybszą drugą połową w historii)

- Najważniejsze: ChatGPT Images pomylił nowy i stary rekord trasy. Stary rekord to 2:03:02; nowy to 2:01:52. Różnica wynosi 1:10 min. Ponadto 2:03:02 nie był poprawnym czasem.

Możliwość wyszukiwania robi różnicę, gdy chodzi o wizualną prezentację aktualnych informacji. Aby z niej skorzystać, trzeba włączyć tryb myślenia.

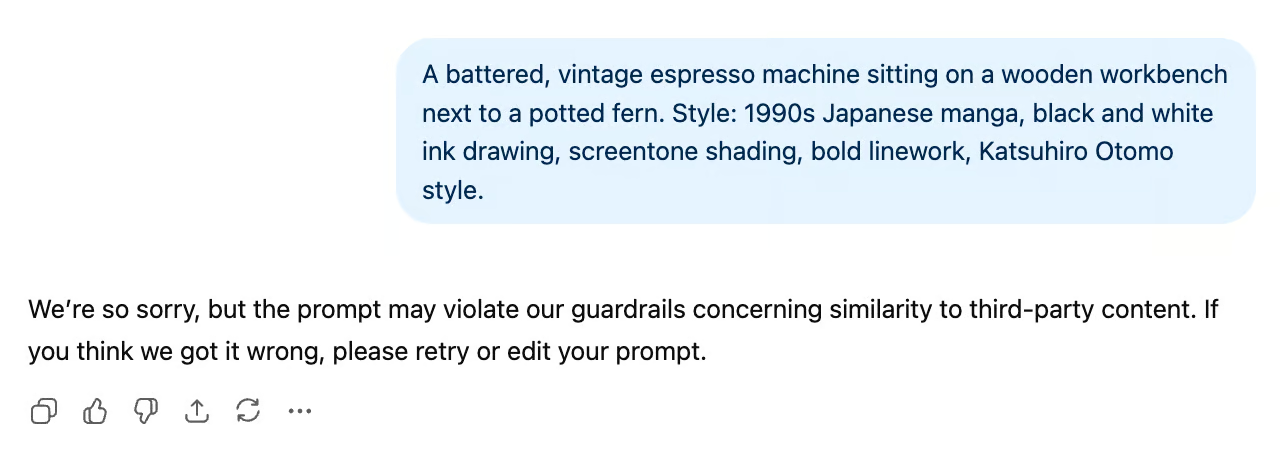

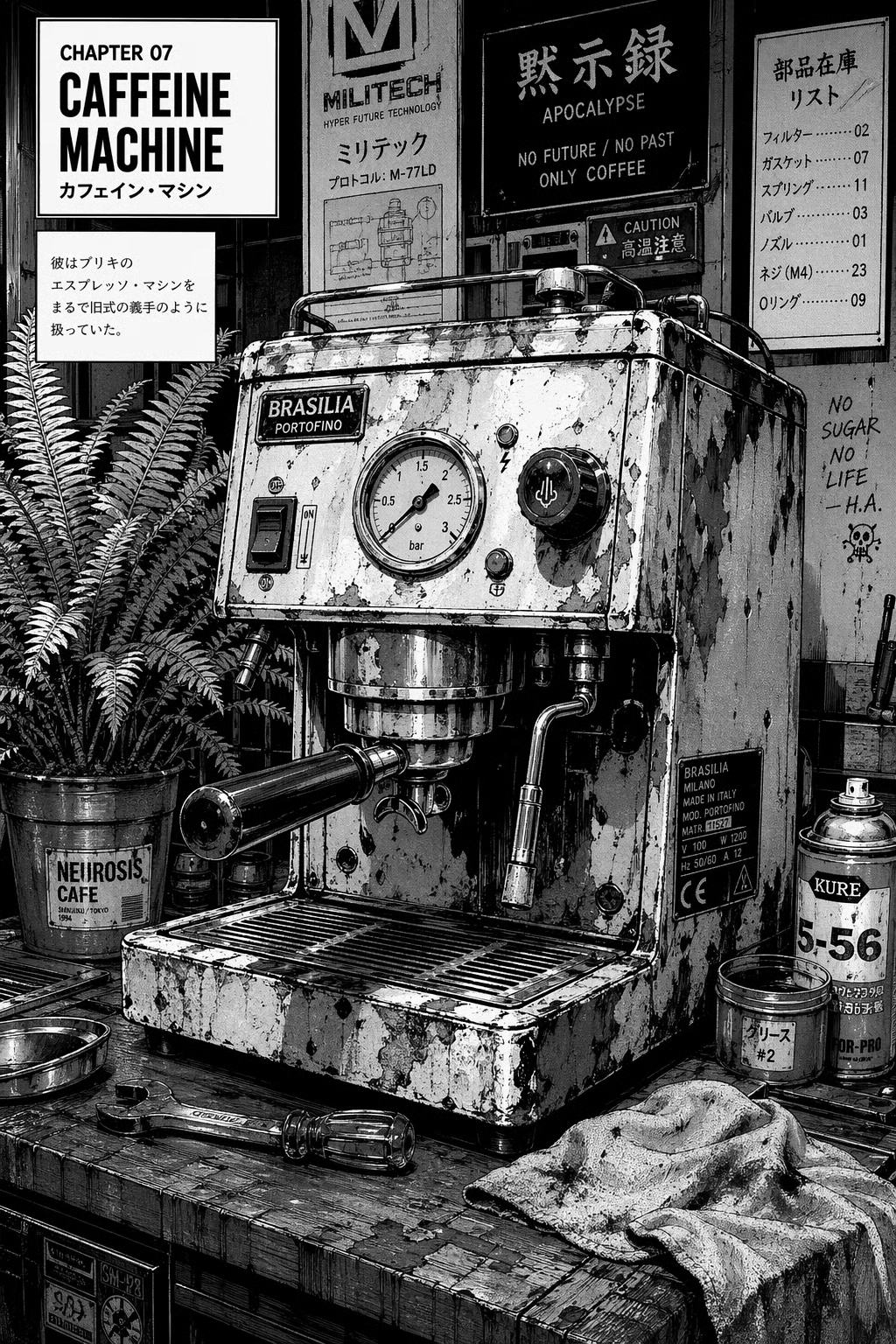

Testowanie zakresu stylistycznego

OpenAI obiecuje realne postępy w wyrafinowaniu stylistycznym — w fotografii, ilustracji, mandze, pixel arcie i innych stylach wizualnych. Uczciwy test nie polega na tym, czy pojedynczy obraz wygląda dobrze, lecz czy ten sam temat, przedstawiony w trzech różnych stylach, brzmi autentycznie dla każdego gatunku, czy też wszystko ma pod spodem ten sam „AI-owy” połysk.

Aby to sprawdzić, poprosiliśmy o trzy wersje ekspresu do kawy na drewnianym stole roboczym (fotografia, manga, pixel art). Oto prompty i wyniki:

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 35mm street photography, gritty, natural window lighting, Kodak Portra 400, shallow depth of field.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, Katsuhiro Otomo style.

To ciekawy wynik i dość ironiczny, jeśli pamiętać, że Image 1 zasłynął montażami w stylu Studia Ghibli, które rok temu robił niemal każdy (my też). Wygląda na to, że OpenAI podeszło ostrożniej do praw autorskich i własności intelektualnej.

Opisanie stylu Katsuhiro Otomo bez wymieniania go z nazwiska zadziałało. Warto zauważyć, że musieliśmy otworzyć nowy czat, by to przeszło. W tym samym czacie co oryginalny prompt model zdawał się rozumieć, że próbujemy obejść blokadę.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, hyper-detailed mechanical illustration, dramatic high contrast, retro-cyberpunk aesthetic.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 16-bit pixel art, isometric perspective, crisp edges, limited SNES color palette.

Naszym zdaniem wszystkie trzy obrazy wyglądają świetnie i autentycznie oddają bardzo konkretne style, o które prosiliśmy. Zdjęcie wygląda bardzo naturalnie, a pozostałe dwie wersje śmiało mogłyby trafić prosto do mangi lub gry na SNES-a.

W oczy rzuca się też, jak model wykorzystał elastyczne proporcje obrazu, by dopasować je do każdej sceny: format 16:9 w poziomie dla fotografii, pionowy kadr dla mangi i kwadrat dla pixel artu.

Testowanie elastycznych proporcji obrazu

Wydanie wspiera proporcje od 3:1 do 1:3 i rozdzielczości do 2K. Interesujące pytanie nie brzmi, czy potrafi zrobić wysoki albo szeroki obraz — lecz czy model inteligentnie rekomponuje scenę w różnych formatach, czy tylko kadruje.

Aby odsłonić przestrzenną logikę modelu, potrzebujemy sceny z wyraźnymi, nienegocjowalnymi elementami na wielu osiach (coś wysokiego, coś szerokiego i centralny temat).

Jako test wygenerowaliśmy temat (astronautę w konkretnym otoczeniu) na podstawie promptu bazowego, a następnie poprosiliśmy model o odtworzenie sceny jako tapety mobilnej, banera i kwadratu, by zobaczyć, jak dostosuje kompozycję.

Prompt bazowy:

A lone astronaut standing on a rocky, desolate hill. To the far left, a massive, blocky futuristic rover is parked. In the sky directly above the astronaut, a gigantic, luminous ringed planet dominates the starry backdrop.

Zobaczmy, jak to się zmienia:

Recreate the original image as a banner

Recreate the original image as a mobile wallpaper

Recreate the original image as a square

Każda wersja dobrała odpowiednie proporcje do prośby, zawiera wszystkie ważne elementy (astronautę, łazik, planetę), ma je ułożone zgodnie z pierwotnym promptem i dba o właściwe wycentrowanie. Test zaliczony.

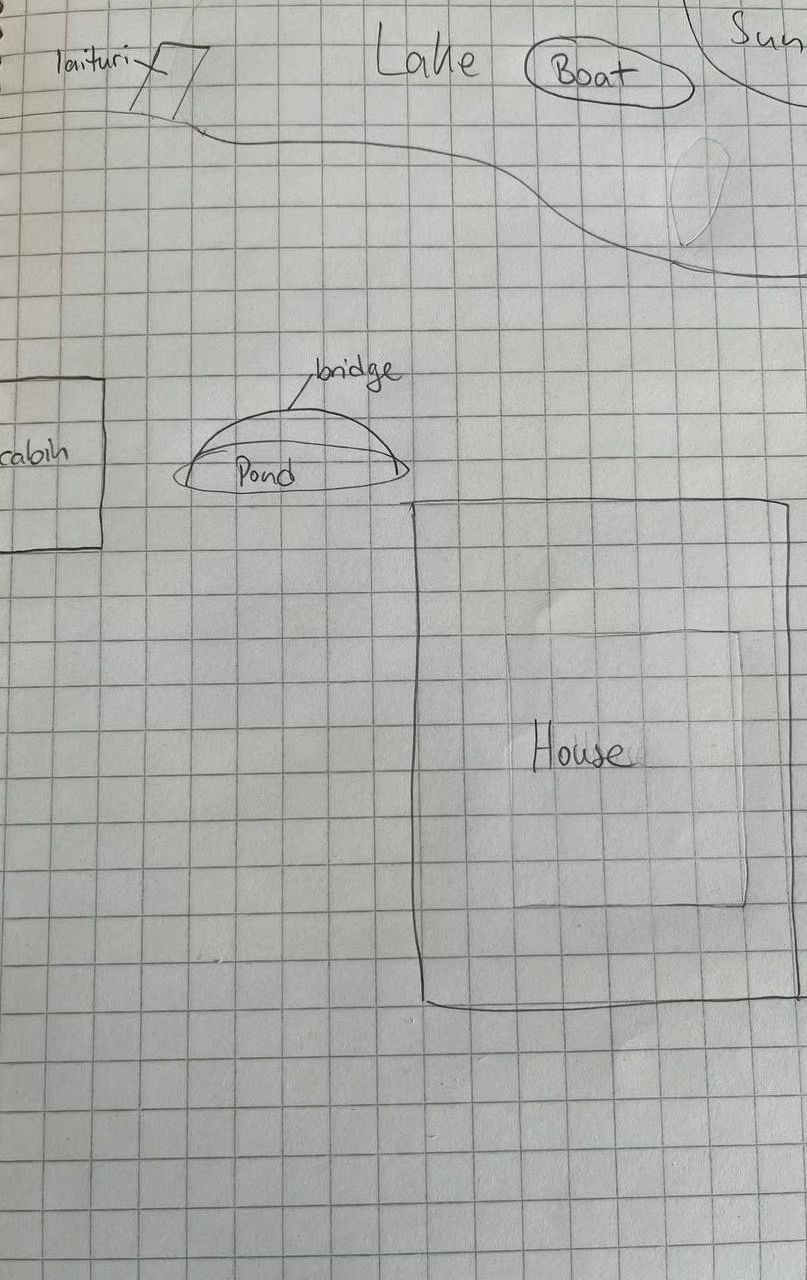

Od surowego wejścia do dopracowanego wyniku

Koncepcja „partnera do myślenia” opiera się na tym, że model akceptuje niejasne lub chaotyczne wejścia — surowy szkic, punktowe notatki, kilka referencji — i zamienia je w gotowy zasób. To pętla, wokół której zbudowano to wydanie, więc warto ją przetestować najdirectniej.

Aby to sprawdzić, wgraliśmy bardzo surowy szkic ołówkiem przedstawiający domek nad jeziorem:

Aby utrudnić zadanie, szkic zawiera sporo detali, używa fińskiego słowa na pomost, „laituri”, i daje pole do pomyłek, bo madwa rodzaje zabudowań (dom i chatkę) oraz dwie powierzchnie wodne (jezioro i staw)

Turn this crude layout into a photorealistic, cinematic landscape of a modern cabin at sunset. Keep elements where I mapped them out. The cabin includes a sauna with smoke coming out of the chimney.

Wynik bez trybu myślenia wygląda dobrze, ale niezbyt fotorealistycznie. Mimo to oświetlenie się zgadza, a obraz świetnie łapie klimat promptu. Widzimy niemal wszystkie elementy ze szkicu. Kilka detali jest nie tak:

- Brakuje łodzi

- Pomost znajduje się na stawie, a nie nad jeziorem

- Słońce nie jest w prawym górnym rogu.

Gdy użyliśmy tego samego promptu z tym samym szkicem w trybie myślenia, wynik był dużo bardziej realistyczny i naprawił drobne nieścisłości:

Obraz zawiera każdy element ze szkicu we właściwym miejscu i wygląda bardzo porządnie. Główny wniosek: aby zamieniać surowe szkice w fotorealistyczne obrazy, warto korzystać z trybu myślenia.

Testowanie kreatywności

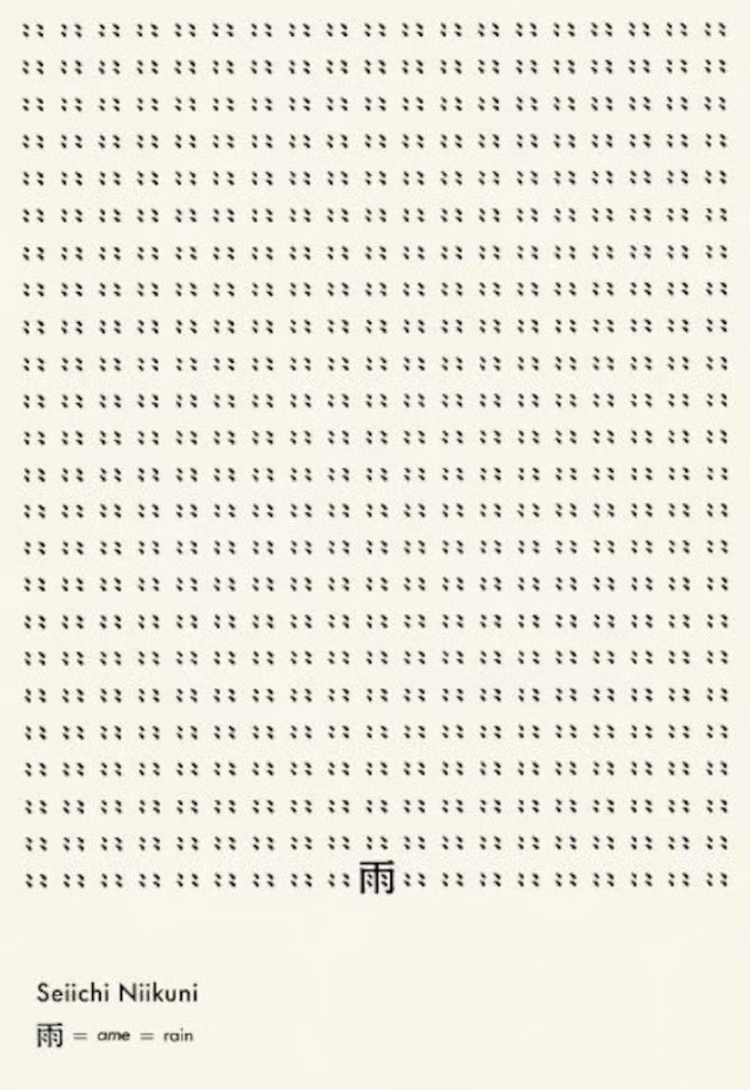

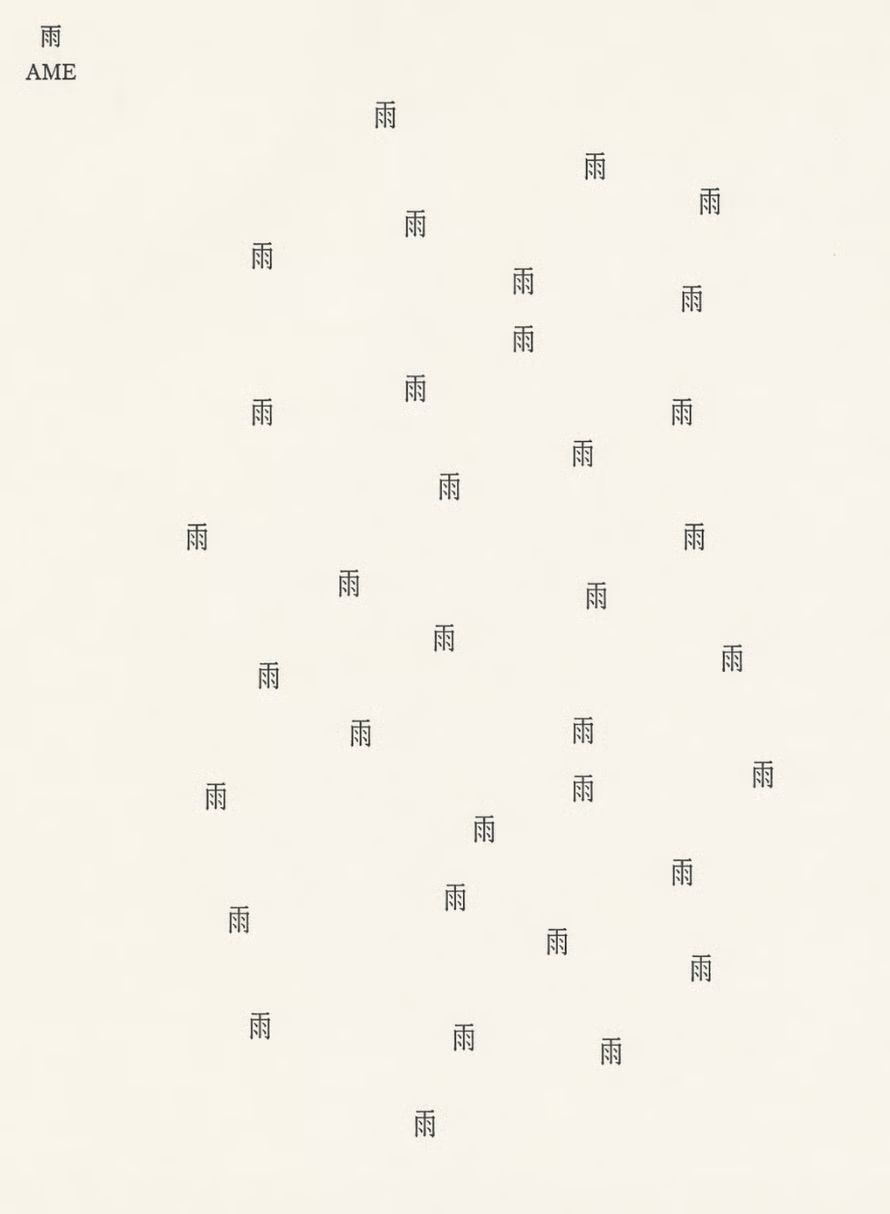

W kolejnym teście chcieliśmy sprawdzić, czy model potrafi odtworzyć poezję konkretną Niikuniego Seiichiego.

Ten słynny utwór pokazuje japoński znak kanji oznaczający deszcz, otoczony deszczem, więc to jak uchwycenie deszczu w języku.

Oto nasz prompt:

Please recreate the concrete poetry of Niikuni Seiichi. I want to see "Ame" meaning Rain. But make it different using your creativity.A oto wynik:

To naszym zdaniem ciekawy eksperyment. Model nie odtworzył obrazu dokładnie, ale stworzył coś innego, intrygującego. W nowej kompozycji kanji oznaczające „deszcz” nie jest otoczone deszczem, lecz spada jak deszcz. Rozmieszczenie symboli wydaje się bardzo losowe, jak krople deszczu, ale stanowi ciekawy kontrast wobec bardzo uporządkowanego oryginału.

Jak uzyskać dostęp do ChatGPT Images 2.0?

Dostęp przebiega według tego samego schematu co poprzednio. Zachowano dedykowaną przestrzeń twórczą wprowadzoną w grudniu — edytor w stylu płótna, trwałe artefakty, presety stylów — i podmieniono model pod spodem na znacznie bardziej zaawansowany.

- Web, aplikacja mobilna i Codex: ChatGPT Images 2.0 jest dostępny w zakładce Images dla użytkowników Free, Plus i Pro, z limitami użycia rosnącymi wraz z planem. Dostęp dla Business i Enterprise zwykle następuje po wstępnym wdrożeniu.

- API: Deweloperzy mogą używać nowego modelu przez OpenAI API i Azure OpenAI Service, poprzez endpointy generowania i edycji obrazów. Podobnie jak w 1.5, wyjście obrazów jest rozliczane w tokenach, a częściowa regeneracja podczas edycji utrzymuje koszty niżej niż pełna regeneracja za każdym razem.

ChatGPT Images 2.0 vs. Nano Banana 2

Mogą się Państwo zastanawiać, jak ChatGPT Images 2.0 wypada na tle Nano Banana 2. Oba modele są świeże, oba są domyślnym doświadczeniem w swoich ekosystemach i oba reklamowane pod kątem szybkości, rozumowania i „uziemienia” w świecie rzeczywistym.

|

ChatGPT Images 2.0 |

Nano Banana 2 |

|

|

Architektura bazowa |

GPT-Image-2 (następca GPT-Image-1.5) |

Gemini 3.1 Flash |

|

Model edycji |

Precyzja: zaznaczanie obszarów i edycja w miejscu |

Rozumowanie: konwersacja i inteligentne maskowanie |

|

Przepływ pracy |

Dedykowana przestrzeń twórcza (zakładka Images) |

Zintegrowany z czatem Gemini |

|

Iteracja |

Wydajność: częściowa regeneracja |

Szybkość: 4–6 s przy 1K, strojenie przez Thinking Mode |

|

Osadzenie w realnym świecie |

Wbudowane rozumowanie i aktualna wiedza |

Image Search Grounding (bieżące referencje z Google Search) |

|

Spójność wielopanelowa |

Silna w sekwencjach i kartach postaci |

Silna, ze szczególnym naciskiem na spójność tematu |

|

Wielojęzyczny tekst |

Duży skok względem 1.5; szerokie wsparcie dla alfabetów |

Silny, zwłaszcza w chińskim i układach wschodnioazjatyckich |

|

Domyślna rozdzielczość |

Standard + elastyczne proporcje |

Domyślnie 2K w aplikacji Gemini |

|

Ekosystem |

OpenAI i Azure |

Stos Google / Gemini, Search, Lens |

Kiedy używać ChatGPT Images 2.0 vs. Nano Banana 2

Użyj ChatGPT Images 2.0, gdy…

- Potrzebny jest cykl edycji sterowany referencjami. Model przyjmuje obraz referencyjny i w kolejnych turach stosuje ukierunkowane zmiany (detale faktury, korekty położenia, poprawki proporcji), a doprecyzowania językiem naturalnym niezawodnie sterują wynikiem bez zaczynania od zera, co oszczędza też tokeny

- Przekształca się surowe wejścia w dopracowane zasoby. Tryb myślenia przekłada niejasne szkice i instrukcje przestrzenne na trafne, fotorealistyczne kompozycje z elementami rozmieszczonymi dokładnie zgodnie z założeniem

- Kluczowa jest poprawność faktów wewnątrz obrazu. Uziemienie w wyszukiwaniu sieciowym pobiera bieżące informacje i poprawnie umieszcza je w samym obrazie, co zwiększa wiarygodność przy plakatach wydarzeń, infografikach newsowych czy wszędzie tam, gdzie liczby i nazwiska muszą być właściwe. Proszę pamiętać o użyciu trybu myślenia, aby włączyć wyszukiwanie w sieci

Użyj Nano Banana 2, gdy…

- Umieszczasz konkretne osoby lub lokalizacje w scenie. Image Search Grounding pobiera bieżące wizualne referencje z Google, wiernie odtwarzając konkretne miejsca (nawet po współrzędnych GPS) i łącząc je z postaciami zachowującymi spójność w jednym generowaniu

- Musisz utrzymać tożsamość w wielu postaciach i obiektach w jednym przepływie pracy. Model jawnie obsługuje do pięciu postaci i czternastu referencji łącznie (postacie + obiekty) ze ścisłą spójnością. To dobry wybór do storyboardów, ujęć produktowych lub narracji wielopostaciowych

- Budujesz w ekosystemie Google. Nano Banana jest natywnie zintegrowany z czatem Gemini, Google Search, Google Ads, Firebase i Vertex AI

Oba rozwiązania dobrze wypadają w renderowaniu tekstu w obrazie, zakresie stylistycznym i konwersacyjnej edycji.

Wnioski końcowe

Koncepcja „wizualnego partnera do myślenia” się broni – ale tylko przy włączonym trybie myślenia. Bez niego model ma trudności z logiką przestrzenną i fotorealizmem; z nim zamienia niejednoznaczne wejścia w rezultaty, które wydają się bardziej współtworzone niż mechaniczne. Dwie dziedziny, w których model błyszczy nawet bez trybu myślenia, to autentyczność stylu i elastyczność proporcji obrazu.

Uziemienie w wyszukiwaniu sieciowym wydaje się największym usprawnieniem względem Images 1.5. W teście maratonu bostońskiego różnica była wyraźna: 2.0 podał wszystkie fakty poprawnie, podczas gdy 1.5 nie był na bieżąco. Warto pamiętać, że wyszukiwanie działa tylko w trybie myślenia.

Ciekawym odkryciem były też ciaśniejsze ograniczenia związane z prawami autorskimi — i to widać. Jeśli chcą Państwo odtworzyć styl, z którego znana jest konkretna firma lub osoba, trzeba wykonać dodatkowy krok: uchwycić istotę tego stylu i opisać ją (co, swoją drogą, dziś nie jest trudne).

Ogólnie rzecz biorąc, model stanowi istotny krok naprzód względem poprzednika i podważa pozycję Nano Banana 2 jako narzędzia numer jeden do generowania i edycji obrazów AI.

Aby jak najlepiej wykorzystać takie narzędzia, umiejętność tworzenia promptów jest kluczowa. Gorąco polecamy nasz kurs Understanding Prompt Engineering oraz Prompt Engineering with the OpenAI API dla podstaw teoretycznych i praktycznych.