Corso

È passato quasi esattamente un anno dal giorno in cui la prima versione di ChatGPT Images è stata rilasciata con un modello chiamato GPT Image 1. OpenAI ha nuovamente rinnovato il suo modello di immagini e ora propone la nuova idea che il "generatore di immagini" è diventato un "partner visivo di pensiero".

In questo articolo vedremo cosa c'è di nuovo, come si confronta con il suo predecessore ChatGPT Images 1.5, come si confronta con Nano Banana 2 di Google e dove il modello brilla (e dove no).

Ti consigliamo anche di dare un'occhiata alla nostra guida sul nuovissimo LLM di OpenAI, GPT-5.5.

Che cos'è ChatGPT Images 2.0?

ChatGPT Images 2.0 è il modello di immagini di nuova generazione di OpenAI. Viene presentato come qualcosa che può ragionare, fare ricerche e poi generare.

Cosa c'è di nuovo in ChatGPT Images 2.0?

Uno dei principali risultati del rilascio di ChatGPT Images 1.5 è stato un grande aumento della velocità. All'epoca si diceva fosse 4 volte più veloce. Abbiamo cercato di verificare l'affermazione, ma sembrava riferirsi alle modifiche, non alla generazione di nuove immagini.

Questa volta, la grande promessa è l'intelligenza. ChatGPT Images 2.0 è un modello di immagini "pensante": dovrebbe cercare, ragionare sui fatti e tradurre input grezzi (note, schizzi, riferimenti) in visual finali con molto meno prompting manuale.

Altri temi principali dell'annuncio sono:

- Maggiore precisione e controllo sulla generazione stessa

- Prestazioni più solide tra lingue e sistemi di scrittura

- Maggiore sofisticazione stilistica e realismo

- Intelligenza sul mondo reale potenziata integrata nel modello

- Rapporti d'aspetto flessibili per tutto, dal mobile ai formati banner

Un modello che pensa

Una delle affermazioni più importanti del rilascio è che il nuovo modello "pensa" e agisce come un "partner visivo di pensiero". L'idea è che agenti lavorino dietro le quinte per comprendere a fondo il compito e ragionarci sopra prima di eseguire la richiesta di generazione.

La sua comprensione del mondo è stata aggiornata a un cutoff di dicembre 2025, quindi gli output sono più accurati dal punto di vista contestuale. Si sostiene che ciò renda il nuovo modello ottimo per grafica educativa e flussi di lavoro multi-step che richiedono contesto.

Cerca sul web

Per colmare il divario tra il cutoff e le informazioni fresche e aggiornate, Images 2.0 può cercare sul web per trovare informazioni rilevanti. Dalle note di rilascio di OpenAI non è chiaro esattamente come funzioni, ma da quanto capiamo, la ricerca web funge da strumento chiamato dall'agente pensante menzionato sopra.

Crea più immagini da un unico prompt

Il nuovo modello supporta nativamente la generazione di più immagini dallo stesso prompt. Era possibile con un workaround nell'API (chiedendo una "composizione"), ma ora si può fare anche nell'interfaccia, fino a dieci immagini. OpenAI promette continuità di personaggi e oggetti in tutti questi output.

Test di ChatGPT Images 2.0

È il momento di vedere cosa può fare davvero il nuovo modello! Abbiamo testato le seguenti capacità e funzionalità di Images 2.0:

- Flusso di lavoro di editing

- Modalità pensiero e ricerca web

- Gamma stilistica

- Rifinitura di schizzi grezzi

- Flessibilità del rapporto d'aspetto

- Creatività

Test del flusso di lavoro di editing

La proposta di OpenAI per la versione 2.0 punta sull'iterazione: input grezzo in entrata, asset rifinito in uscita, con progressi nel seguire le istruzioni e nel rendering di testo denso. Abbiamo testato questo ciclo usando un famoso francobollo statunitense del 1898 chiamato Western Cattle in Storm.

Ecco la foto di uno dei francobolli in condizioni Fine.

Per testare specificamente il flusso di lavoro di editing, abbiamo usato il seguente prompt senza modalità pensiero. Questo significa anche che il modello non ha accesso alle ricerche web, che abbiamo testato separatamente.

Please create for me a picture of the famous 1898 Western Cattle in Storm stamp issued by the U.S. Post Office as part of the Trans-Mississippi Issue . The name of the stamp is "Western Cattle in Storm" Quality should be Fine to Very Fine -Centering: design shifted right, left margin twice as wide as right margin, perfs nearly touching design on the right side -Perforations: two short teeth on the top edge, slightly uneven spacing along the bottom -Gum: quarter-inch matte hinge remnant in upper-center of back, small paper fragment still -attached -Paper: diagonal gum bend across lower-left quadrant, light yellow toning along top edge -Cancellation: partial black circular datestamp in lower-right corner, moderate coverage over the cattleEd ecco il risultato:

Il prompting solo testuale non ha funzionato. Una descrizione dettagliata del francobollo e del suo grado di conservazione è risultata sbagliata nella maggior parte degli aspetti che contano — colore errato, layout del valore errato, decentramento caricaturale. Riprodurre un artefatto storico specifico solo dal testo è una richiesta difficile.

Fornire al modello l'immagine di riferimento e chiedere modifiche mirate è dove la 2.0 si è guadagnata il suo valore: irregolarità delle perforazioni, un residuo di cerniera, una piega della gomma diagonale, una leggera ossidazione e un annullo parziale.

Le modifiche sono atterrate più o meno dove richiesto. Il modello ha introdotto una regressione nel rapporto d'aspetto, ma un semplice follow-up in linguaggio naturale l'ha sistemata. Il risultato finale non è da perizia — il "$1" sembra leggermente stirato, il mais è diverso — ma il ciclo ha funzionato: partenza incerta, rotta corretta, risultato utilizzabile in tre turni.

Test del rendering di testo multilingue

Il rendering del testo in alfabeti non latini è stato a lungo un punto debole nei modelli di immagini, e OpenAI lo indica come una correzione di rilievo. Il rilascio specifica una generazione di testo ad alta fedeltà in giapponese, coreano, cinese, hindi e bengalese — non solo tradotta, ma resa con impaginazione coerente e tipografia dall'aspetto nativo.

Un test equo qui è chiedere un poster o un'infografica con un blocco di testo in uno di questi sistemi di scrittura e far verificare l'output a un madrelingua. Abbiamo chiesto al modello di creare un moderno poster di lifestyle giapponese per pubblicizzare una fittizia caffetteria locale e il loro latte ai fiori di ciliegio stagionale.

「居心地の良い日本のカフェの窓辺を描いた、モダンなグラフィックデザインスタイルのライフスタイルポスター。大きな窓から差し込む自然な光と、小さな観葉植物。ポスターの中央には、以下の日本語テキストが大きく、はっきりと読みやすく配置されている。フォントは現代的でクリーンなゴシック体(sans-serif)。

テキスト内容:

『桜フェア開催中。

心休まる場所で、

春の訪れを。

さくらラテ 650円』

テキストの下には、小さな文字で『HAVE A GOOD DAY』という英語のサブタイトルがあり、一番下にはロゴマークと『CAFE YUTORI』というローマ字の店名がある。全体的に暖かく、洗練されたレイアウト。」Ecco com'è l'output:

Secondo il nostro collega giapponese (grazie Sven!), sembra molto meglio rispetto ai modelli precedenti, in cui molti caratteri erano confusi e senza senso. Questo appare più naturale e può essere letto facilmente dai madrelingua.

In modalità pensiero, ha persino aggiunto altre frasi oltre alle istruzioni del prompt sul piccolo cartello nella parte in basso a sinistra. Si adattano bene al contesto senza essere ripetitive, traducendosi in qualcosa come “Gusto stagionale e delicato. Concediti una pausa rilassante: goditi una tazza che porta con sé la primavera”.

Test della modalità pensiero e della ricerca web

Abbiamo dovuto fare un po' di attenzione a come testare le capacità di ricerca web, perché se dici al modello cosa vuoi nel prompt, non stai testando la ricerca, ma il seguito delle istruzioni. Il test più pulito è chiedere qualcosa di molto recente e molto specifico, dare al modello quasi nessuna informazione e vedere se riesce a colmare correttamente le lacune.

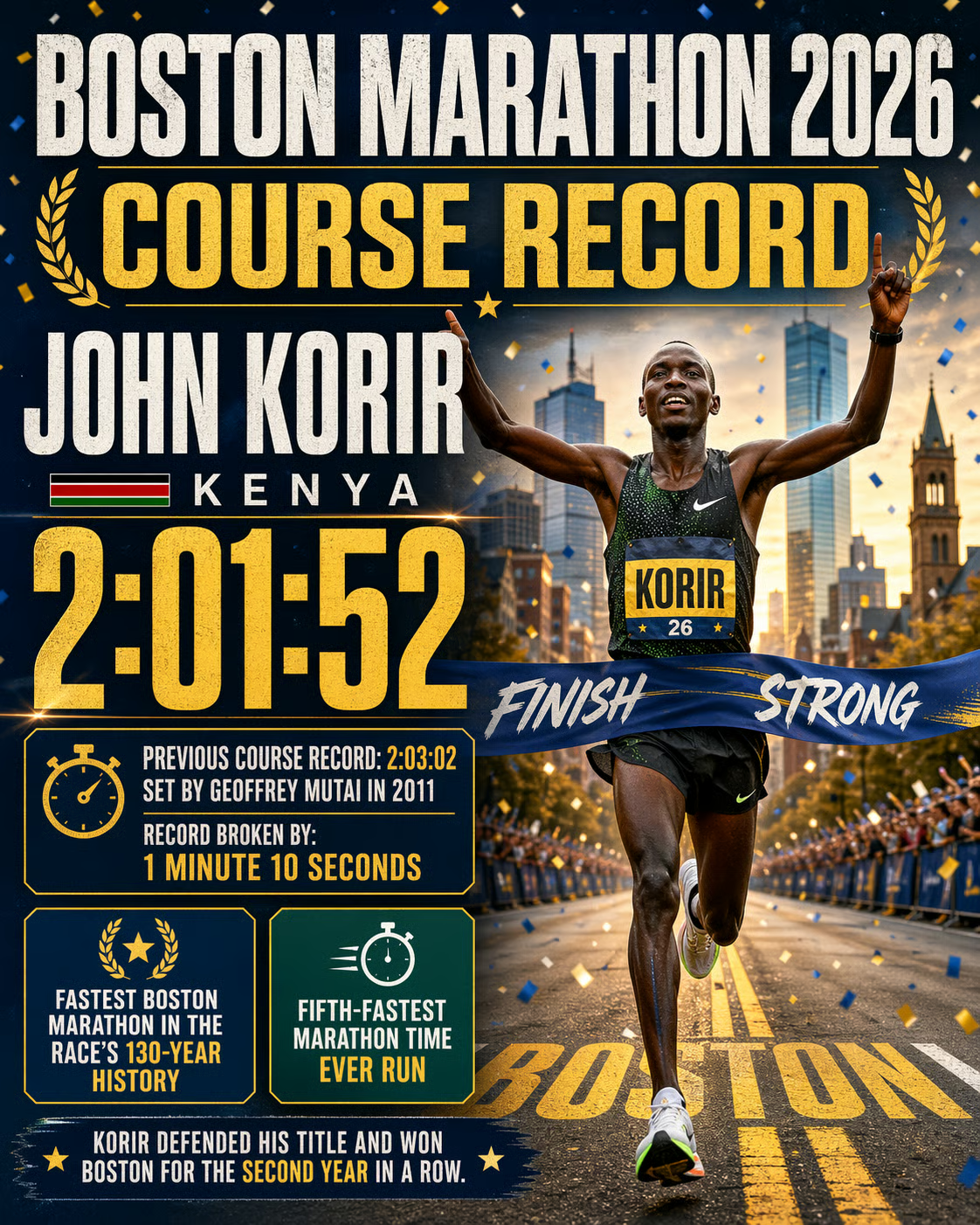

Abbiamo scelto la Boston Marathon di ieri. La gara si è conclusa lunedì 20 aprile — il giorno prima dell'annuncio di ChatGPT Images 2.0 — e il record del percorso maschile è stato battuto per la prima volta dal 2011. Questo ci dà un insieme concreto di fatti (vincitore, paese, tempo, margine, contesto) che il modello non può avere dall'addestramento, ma che sono facili da verificare con una rapida ricerca.

Ecco il prompt, volutamente privo di dettagli. E nel risultato si vede che il modello effettua ricerche sul web!

Create a celebratory poster-style infographic commemorating the course record set at yesterday's Boston Marathon. Include the winner's name, country, finish time, and the margin by which the previous record was broken. Include one or two additional stats or context details that make the achievement meaningful.

Il risultato è visivamente molto accattivante ed è mantenuto nel codice colore della Boston Marathon, che è un bel plus. Tutti i fatti menzionati sono accurati, come abbiamo verificato.

Poiché il vecchio modello (Images 1.5) non poteva cercare sul web, eravamo certi che avrebbe dato la risposta sbagliata. L'abbiamo comunque testato con lo stesso prompt, ed ecco il risultato:

Dal punto di vista dello stile, può competere, ma ci sono diversi problemi legati ai numeri:

- La corsa ha segnato la 130ª edizione della Boston Marathon, quindi dovrebbe dire “129 anni di tradizione”, non 127.

- Anche l'affermazione che sia il “3° corridore nella storia a scendere sotto le 2:04 in maratona” è falsa. Circa 20 corridori l'hanno fatto.

- Secondo il sito della Boston Athletic Association, il suo tempo nella seconda metà è stato 1:00:02, non 1:01:05 (che potrebbe comunque essere stato il negative split più veloce di sempre)

- Ancora più importante, ChatGPT Images ha confuso i tempi del nuovo e del vecchio record. Il vecchio record era 2:03:02; il nuovo record è 2:01:52. La differenza è 1:10 minuti. Inoltre, 2:03:02 non era il tempo corretto.

Le capacità di ricerca fanno la differenza quando si tratta di presentare visivamente informazioni aggiornate. Per usarle, la modalità pensiero deve essere attiva.

Test della gamma stilistica

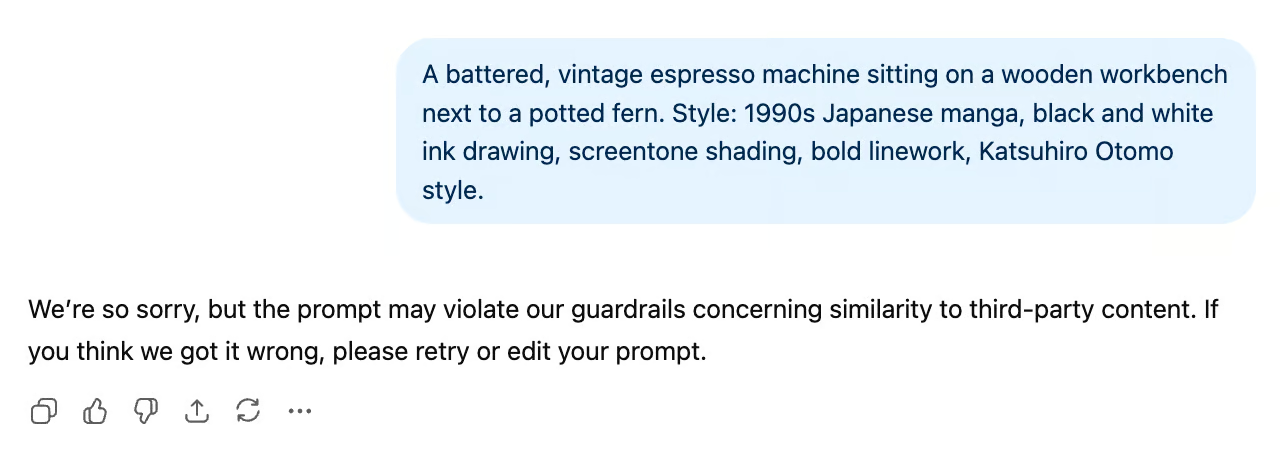

OpenAI propone reali progressi nella sofisticazione stilistica — tra fotografia, illustrazione, manga, pixel art e altri stili visivi. Il test onesto non è se una singola immagine sembri bella, ma se lo stesso soggetto reso in tre stili diversi risulti autentico per ciascun genere, o se tutto torni con la stessa patina “da AI” sotto.

Per testarlo, abbiamo chiesto tre versioni diverse di una macchina per espresso su un banco da lavoro in legno (fotografia, manga, pixel art). Ecco i prompt e i risultati:

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 35mm street photography, gritty, natural window lighting, Kodak Portra 400, shallow depth of field.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, Katsuhiro Otomo style.

Questo è stato un risultato interessante, e piuttosto ironico, se si considera che Image 1 è diventato famoso per i montaggi in stile Studio Ghibli che tutti facevano un anno fa (noi compresi). Sembra che da allora OpenAI sia diventata un po' più attenta al copyright e alla proprietà intellettuale.

Descrivendo lo stile di Katsuhiro Otomo senza citarlo esplicitamente, ha funzionato. Da notare che abbiamo dovuto aprire una nuova chat perché funzionasse. Nella stessa chat del prompt originale, sembrava che il modello si accorgesse che stavamo cercando di aggirare il blocco.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, hyper-detailed mechanical illustration, dramatic high contrast, retro-cyberpunk aesthetic.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 16-bit pixel art, isometric perspective, crisp edges, limited SNES color palette.

Secondo noi, tutte e tre le immagini sono ottime e incarnano in modo autentico gli stili molto specifici richiesti. La fotografia appare molto naturale e le altre due versioni potrebbero essere prese direttamente da un manga o da un videogioco SNES, rispettivamente.

Un'altra cosa che salta all'occhio nel test sopra è come il modello abbia usato le sue capacità di rapporto d'aspetto flessibile per adattarle a ciascuna immagine: un 16:9 orizzontale per la fotografia, un formato verticale per la versione manga e un'immagine quadrata per la pixel art.

Test dei rapporti d'aspetto flessibili

Il rilascio supporta rapporti d'aspetto da 3:1 a 1:3 e risoluzioni fino a 2K. La domanda interessante non è se può produrre un'immagine alta o larga — ma se il modello ricompone in modo intelligente tra i formati o si limita a ritagliare.

Per mettere in evidenza la logica spaziale sottostante del modello, serve una scena con elementi distinti e imprescindibili su più assi (qualcosa di alto, qualcosa di largo e un soggetto centrale).

Come test, abbiamo generato il nostro soggetto (un astronauta in un'ambientazione specifica) da un prompt di base, quindi abbiamo chiesto al modello di ricrearlo come sfondo per mobile, come banner e in formato quadrato per vedere come si adatta la composizione.

Il prompt di base:

A lone astronaut standing on a rocky, desolate hill. To the far left, a massive, blocky futuristic rover is parked. In the sky directly above the astronaut, a gigantic, luminous ringed planet dominates the starry backdrop.

Vediamo come cambia:

Recreate the original image as a banner

Recreate the original image as a mobile wallpaper

Recreate the original image as a square

Ognuna delle versioni sceglie un rapporto d'aspetto adatto alla richiesta, include tutti gli elementi importanti (astronauta, rover, pianeta), li dispone come richiesto nel prompt originale e garantisce che siano centrati. Test superato.

Test da input grezzo a output rifinito

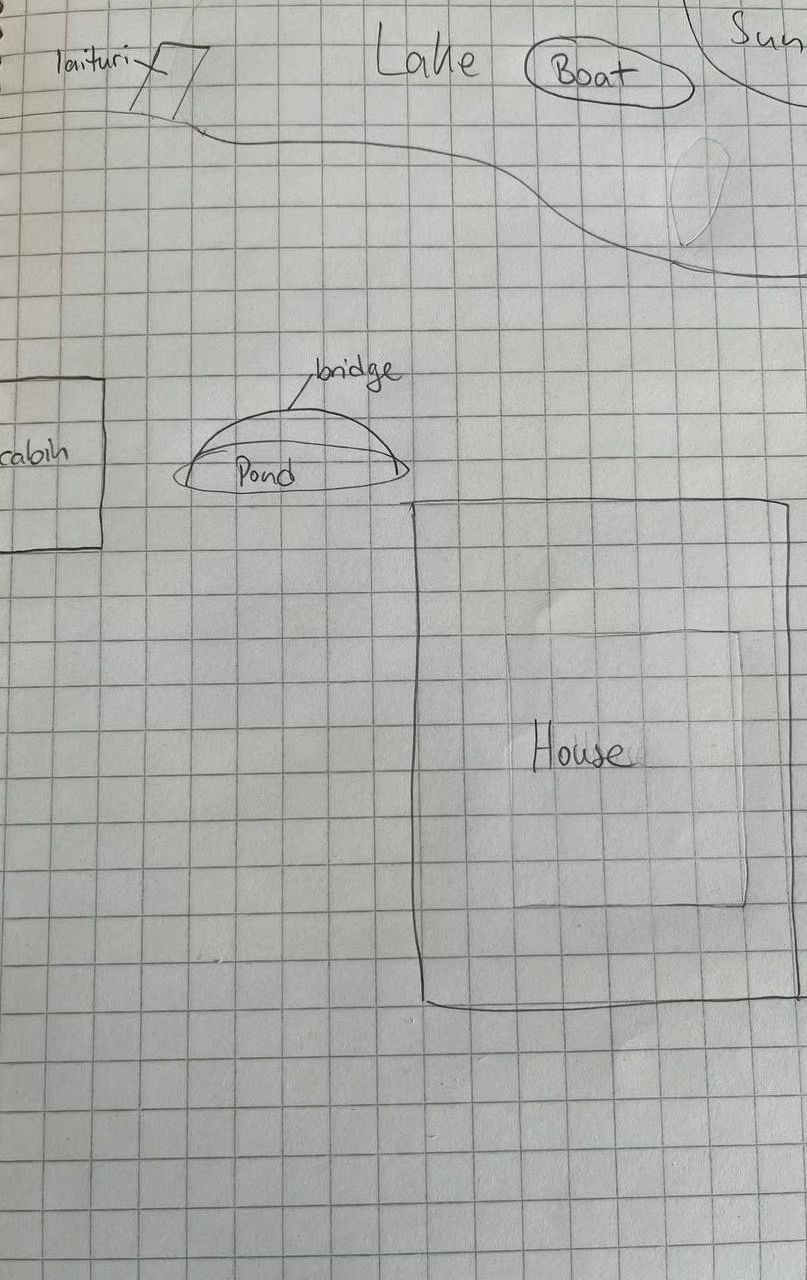

L'inquadramento come partner di pensiero si basa sul fatto che il modello accetti input vaghi o disordinati — uno schizzo grezzo, appunti puntati, alcuni riferimenti — e li trasformi in un asset finito. Questo è il ciclo attorno a cui è davvero costruito il rilascio, ed è quello che vale la pena testare più direttamente.

Per testarlo, abbiamo caricato il seguente schizzo a matita molto grezzo di una baita vicino al lago:

Per renderlo più impegnativo, contiene diversi dettagli, usa la parola finlandese per molo, “laituri”, e crea potenziale confusione perché contiene due tipi di edifici (casa e baita) e due tipi di superfici d'acqua (lago e stagno)

Turn this crude layout into a photorealistic, cinematic landscape of a modern cabin at sunset. Keep elements where I mapped them out. The cabin includes a sauna with smoke coming out of the chimney.

Il risultato senza modalità pensiero è discreto, ma non molto fotorealistico. Tuttavia, l'illuminazione è coerente e l'immagine cattura perfettamente l'atmosfera del prompt. Possiamo vedere quasi tutti gli elementi dello schizzo. Alcuni dettagli sono errati:

- Manca la barca

- Il molo è sullo stagno, non sul lago

- La posizione del sole non è nell'angolo in alto a destra.

Quando abbiamo provato lo stesso prompt con lo stesso schizzo in modalità pensiero, l'output sembrava molto più realistico e ha corretto tutte le piccole imprecisioni:

L'immagine contiene ogni elemento dello schizzo nella sua posizione designata ed è molto pulita. La principale conclusione qui è di usare la modalità pensiero per ottenere i risultati migliori quando si trasformano schizzi grezzi in immagini fotorealistiche.

Test della creatività

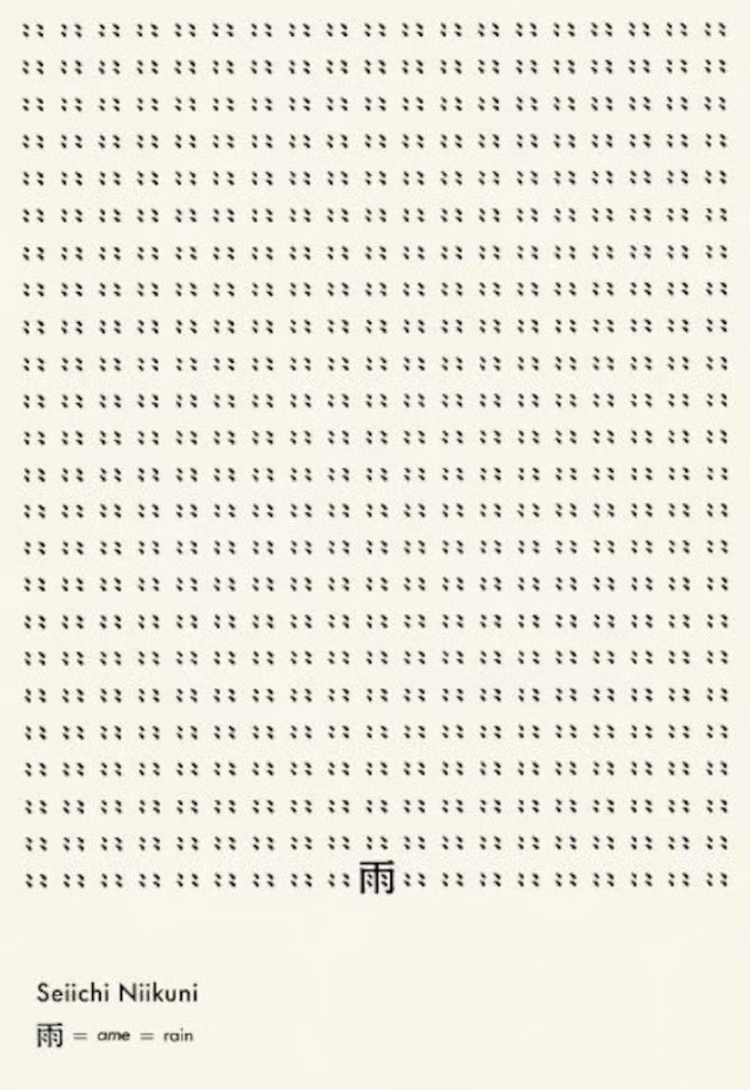

Per il nostro prossimo test, volevamo vedere se riuscisse a ricreare la poesia concreta di Niikuni Seiichi.

Questa famosa poesia mostra il kanji giapponese per pioggia, circondato dalla pioggia, quindi è come catturare la pioggia nel linguaggio, per come la vediamo noi.

Ecco il nostro prompt:

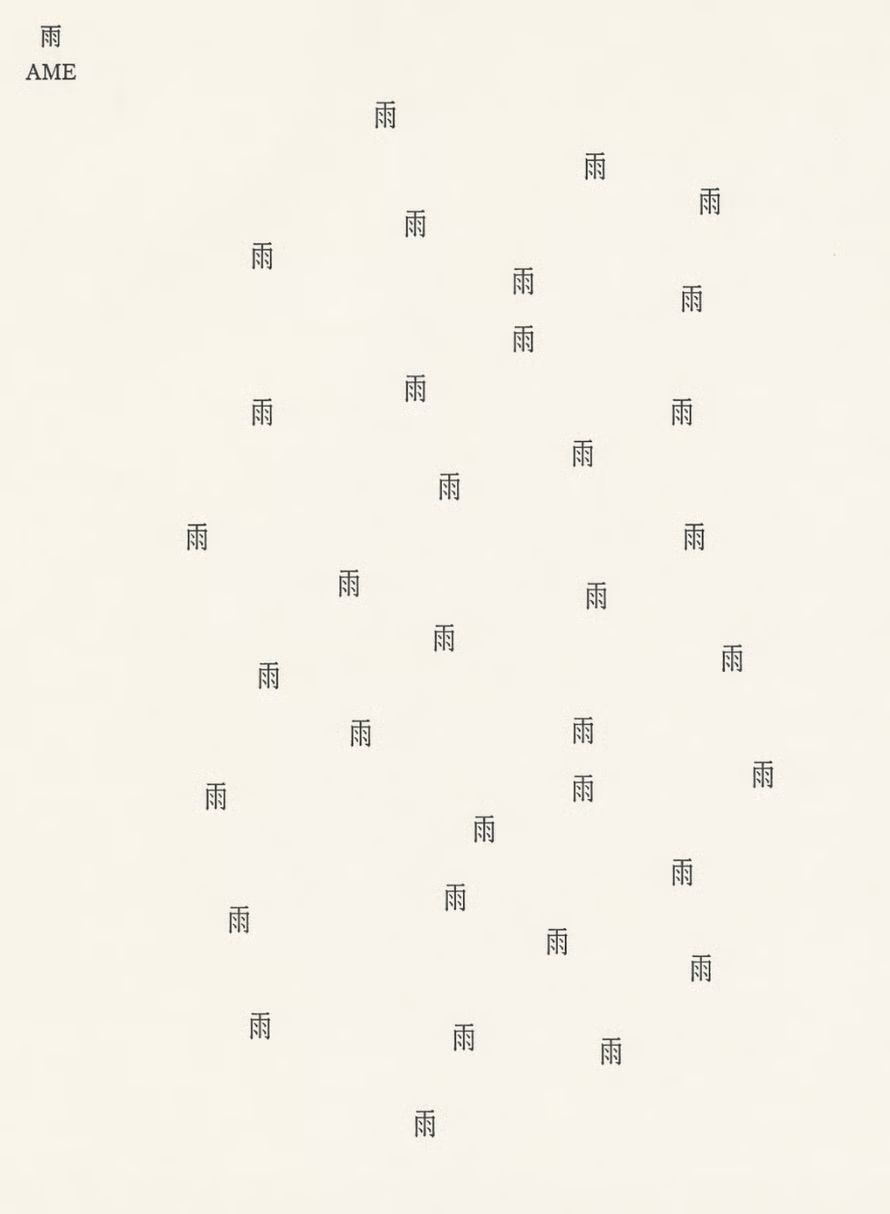

Please recreate the concrete poetry of Niikuni Seiichi. I want to see "Ame" meaning Rain. But make it different using your creativity.E questo è l'output:

Questo, a nostro avviso, è interessante. Non ha ricreato esattamente l'immagine, ma ha creato qualcos'altro di intrigante. Nella nuova composizione, il kanji per “pioggia” non è circondato dalla pioggia, ma scende come pioggia. La composizione dei simboli sembra molto casuale, proprio come ci si aspetterebbe dalle gocce di pioggia, ma crea un bel contrasto con l'originale molto ordinato.

Come posso accedere a ChatGPT Images 2.0?

L'accesso segue lo stesso schema del rilascio precedente. Mantiene lo spazio di lavoro creativo dedicato introdotto a dicembre — l'editor in stile canvas, gli artifact persistenti, i preset di stile — e sostituisce il modello sottostante con uno significativamente più capace.

- Web, app mobile e Codex: ChatGPT Images 2.0 è disponibile nella scheda Images per utenti Free, Plus e Pro, con limiti d'uso che scalano per livello. L'accesso per Business ed Enterprise solitamente segue dopo il rollout iniziale.

- API: Gli sviluppatori possono usare il nuovo modello tramite la OpenAI API e Azure OpenAI Service, tramite gli endpoint di generazione ed editing di immagini. Come con la 1.5, l'output delle immagini è prezzato in token e la rigenerazione parziale durante le modifiche mantiene i costi più bassi rispetto a rigenerare ogni volta un'immagine completa.

ChatGPT Images 2.0 vs. Nano Banana 2

Potresti chiederti come si posizioni ChatGPT Images 2.0 rispetto a Nano Banana 2. Entrambi i modelli sono recenti, entrambi sono l'esperienza predefinita nei rispettivi ecosistemi ed entrambi sono presentati incentrandosi su velocità, ragionamento e intelligenza sul mondo reale.

|

ChatGPT Images 2.0 |

Nano Banana 2 |

|

|

Architettura sottostante |

GPT-Image-2 (successore di GPT-Image-1.5) |

Gemini 3.1 Flash |

|

Modello di editing |

Precisione: selezione area e editing in-place |

Ragionamento: conversazionale e smart masking |

|

Flusso di lavoro |

Spazio di lavoro creativo dedicato (scheda Images) |

Integrato nella chat Gemini |

|

Iterazione |

Efficiente: rigenerazione parziale |

Veloce: 4–6 s a 1K, regolabile via Thinking Mode |

|

Ancoraggio al mondo reale |

Ragionamento integrato e conoscenze aggiornate |

Image Search Grounding (estrae riferimenti live da Google Search) |

|

Coerenza multi-pannello |

Forte su sequenze e schede personaggio |

Forte, con focus sulla coerenza del soggetto |

|

Testo multilingue |

Grande upgrade rispetto a 1.5; ampio supporto di script |

Solido, soprattutto in cinese e layout dell'Asia orientale |

|

Risoluzione predefinita |

Standard + rapporti d'aspetto flessibili |

2K predefinita nell'app Gemini |

|

Ecosistema |

OpenAI e Azure |

Stack Google / Gemini, Search, Lens |

Quando usare ChatGPT Images 2.0 vs. Nano Banana 2

Usa ChatGPT Images 2.0 quando…

- Hai bisogno di un ciclo di editing guidato da riferimenti. Il modello accetta un'immagine di riferimento e applica modifiche mirate (dettagli di texture, correzioni di posizione, sistemazioni del rapporto d'aspetto) lungo più turni, con follow-up in linguaggio semplice che guidano l'output senza ricominciare da capo, risparmiando anche token

- Stai trasformando input grezzi in asset rifiniti. La modalità pensiero risolve schizzi vaghi e istruzioni spaziali in composizioni accurate e fotorealistiche con elementi posizionati esattamente come previsto

- L'accuratezza fattuale all'interno dell'immagine è critica. L'ancoraggio alla ricerca web estrae informazioni live e le rende correttamente dentro l'immagine stessa, rendendolo affidabile per poster di eventi, infografiche di attualità o qualsiasi visual in cui numeri e nomi debbano essere corretti. Ricorda di usare la modalità pensiero per abilitare la ricerca web

Usa Nano Banana 2 quando…

- Stai inserendo soggetti o luoghi reali specifici in una scena. Image Search Grounding estrae riferimenti visivi live da Google, ricostruendo accuratamente luoghi specifici (anche tramite coordinate GPS) e combinandoli con personaggi coerenti in un'unica generazione

- Devi mantenere l'identità su più personaggi e oggetti in un unico flusso di lavoro. Il modello supporta esplicitamente fino a cinque personaggi e quattordici riferimenti totali (personaggi + oggetti) con coerenza rigorosa. Questo lo rende una scelta valida per storyboard, scatti di prodotto o narrazioni multi-personaggio

- Stai costruendo all'interno dell'ecosistema Google. Nano Banana è integrato nativamente nella chat Gemini, in Google Search, Google Ads, Firebase e Vertex AI

Entrambi sono scelte valide per quanto riguarda il rendering del testo nell'immagine, la gamma stilistica e l'editing conversazionale.

Considerazioni finali

L'inquadramento come “partner visivo di pensiero” regge — ma solo con la modalità pensiero attiva. Senza, il modello fatica con la logica spaziale e il fotorealismo; con, trasforma input ambigui in output che sembrano collaborativi più che meccanici. Due aree in cui il modello brilla anche senza modalità pensiero sono l'autenticità stilistica e la flessibilità del rapporto d'aspetto.

L'ancoraggio alla ricerca web sembra il più grande upgrade rispetto a Images 1.5. Nel test della Boston Marathon abbiamo potuto vedere chiaramente il divario: la 2.0 ha azzeccato tutti i fatti, mentre la 1.5 non era aggiornata. È importante sapere che la ricerca web funziona solo in modalità pensiero.

Un aspetto interessante è che i paletti sul copyright sono più stretti, e si nota. Se vuoi ricreare uno stile per cui un'azienda o una persona è riconosciuta, devi fare il passo in più di identificare l'essenza del loro stile e descriverla (il che, si potrebbe dire, oggi è piuttosto semplice).

Nel complesso, il modello è un aggiornamento significativo rispetto al suo predecessore e mette in discussione lo status di Nano Banana 2 come strumento numero uno per la generazione e l'editing di immagini con AI.

Per sfruttare al meglio questi strumenti, saper fare prompting è una competenza essenziale. Ti consigliamo vivamente i nostri corsi Understanding Prompt Engineering e Prompt Engineering with the OpenAI API per una base teorica e pratica.

Sono uno scrittore e editor di data science, con contributi a articoli di ricerca su riviste scientifiche. Sono particolarmente interessato ad algebra lineare, statistica, R e affini. Inoltre, gioco anche parecchio a scacchi!

Tom è un data scientist e formatore tecnico. Scrive e gestisce i tutorial e i post del blog di DataCamp su data science. In precedenza, Tom ha lavorato nella data science presso Deutsche Telekom.