Courses

ผ่านมาเกือบครบหนึ่งปีเต็มนับจากวันที่ ChatGPT Images รุ่นแรกเปิดตัวพร้อมโมเดลที่ชื่อว่า GPT Image 1 ตอนนี้ OpenAI ได้ยกเครื่องโมเดลภาพของตนอีกครั้ง และบริษัทกำลังนำเสนอแนวคิดใหม่ว่า "ตัวสร้างภาพ" ได้กลายเป็น "คู่คิดด้านภาพ" แล้ว

ในบทความนี้ เราจะพาไปดูว่ามีอะไรใหม่ เทียบกับรุ่นก่อนหน้า ChatGPT Images 1.5 อย่างไร เทียบกับ Nano Banana 2 ของ Google อย่างไร และจุดที่โมเดลทำได้ดี (รวมถึงจุดที่ยังไม่โดดเด่น)

แนะนำให้อ่านคู่มือเกี่ยวกับ LLM รุ่นล่าสุดของ OpenAI อย่าง GPT-5.5 ด้วย

ChatGPT Images 2.0 คืออะไร?

ChatGPT Images 2.0 คือโมเดลภาพยุคถัดไปของ OpenAI ที่ถูกวางตำแหน่งให้สามารถคิด วิเคราะห์ ค้นคว้า แล้วจึงเรนเดอร์ภาพได้

มีอะไรใหม่ใน ChatGPT Images 2.0?

หนึ่งในประเด็นสำคัญของการปล่อย ChatGPT Images 1.5 คือความเร็วที่เพิ่มขึ้นมาก โดยระบุว่าเร็วขึ้น 4 เท่า เราพยายามตรวจสอบ และพบว่าความเร็วดังกล่าวใช้กับการแก้ไขภาพ ไม่ใช่การสร้างภาพใหม่

รอบนี้ ประเด็นใหญ่คือความฉลาด ChatGPT Images 2.0 เป็นโมเดลภาพที่ "คิดเป็น" กล่าวคือ ค้นหา ให้เหตุผลจากข้อเท็จจริง และแปลงอินพุตแบบคร่าว ๆ (บันทึกย่อ สเก็ตช์ อ้างอิง) ให้เป็นภาพที่ขัดเกลาได้ โดยไม่ต้องพึ่งพาการพรอมต์แบบละเอียดมากนัก

หัวข้อใหญ่ ๆ อื่น ๆ จากประกาศ ได้แก่:

- ความแม่นยำและการควบคุม ในการสร้างภาพที่มากขึ้น

- ประสิทธิภาพที่ดีขึ้นในหลายภาษาและหลายอักษร

- ความซับซ้อนด้านสไตล์และความสมจริง ที่ยกระดับ

- ความฉลาดเชิงโลกจริง ที่ฝังอยู่ในโมเดล

- อัตราส่วนภาพที่ยืดหยุ่น ครอบคลุมตั้งแต่มือถือไปจนถึงแบนเนอร์

โมเดลที่คิดเป็น

หนึ่งในข้ออ้างอิงหลักของรุ่นนี้คือโมเดลใหม่ "คิด" และทำหน้าที่เป็น "คู่คิดด้านภาพ" แนวคิดคือเอเจนต์จะทำงานเบื้องหลังเพื่อทำความเข้าใจงานอย่างถี่ถ้วนและให้เหตุผล ก่อนจะดำเนินการสร้างภาพ

ความรู้เกี่ยวกับโลกได้รับการอัปเดตจนถึงเดือนธันวาคม 2025 ทำให้ผลลัพธ์มีความสอดคล้องกับบริบทมากขึ้น จุดนี้ถูกโฆษณาว่าทำให้โมเดลใหม่เหมาะกับกราฟิกเพื่อการศึกษาและเวิร์กโฟลว์หลายขั้นตอนที่ต้องการบริบท

ค้นหาข้อมูลบนเว็บ

เพื่อเชื่อมช่องว่างระหว่างจุดตัดความรู้และข้อมูลใหม่ล่าสุด Images 2.0 สามารถค้นหาเว็บเพื่อหาข้อมูลที่เกี่ยวข้อง แม้จากบันทึกการปล่อยของ OpenAI จะยังไม่ชัดเจนว่าทำงานอย่างไร แต่เท่าที่เข้าใจ การค้นหาเว็บทำหน้าที่เป็นเครื่องมือที่ถูกเรียกใช้โดยเอเจนต์ที่คิดดังกล่าว

สร้างหลายภาพจากพรอมต์เดียว

โมเดลใหม่รองรับการสร้างหลายภาพจากพรอมต์เดียวโดยตรง เดิมทำได้ด้วยวิธีเลี่ยงใน API (ขอเป็น “composition”) ตอนนี้ทำได้ใน UI เช่นกัน สูงสุดสิบภาพ OpenAI ระบุว่าจะคงความต่อเนื่องของตัวละครและวัตถุในผลลัพธ์ทั้งหมด

ทดสอบ ChatGPT Images 2.0

ได้เวลาทดสอบว่าของใหม่ทำอะไรได้บ้าง! เราทดสอบความสามารถและคุณลักษณะดังต่อไปนี้ของ Images 2.0:

- เวิร์กโฟลว์การแก้ไข

- โหมดคิดและการค้นหาเว็บ

- ช่วงสไตล์

- การขัดเกลาจากสเก็ตช์หยาบ

- ความยืดหยุ่นของอัตราส่วนภาพ

- ความคิดสร้างสรรค์

ทดสอบเวิร์กโฟลว์การแก้ไข

ข้อเสนอของ OpenAI สำหรับรุ่น 2.0 เน้นการเวียนทำงานซ้ำ: ป้อนอินพุตคร่าว ๆ ได้เอาต์พุตที่ขัดเกลา ด้วยความสามารถการทำตามคำสั่งและการเรนเดอร์ข้อความหนาแน่นที่ดีขึ้น เราทดสอบลูปนี้โดยใช้แสตมป์สหรัฐอเมริกาชื่อดังปี 1898 ที่ชื่อ Western Cattle in Storm

นี่คือภาพของหนึ่งในดวงแสตมป์ในสภาพ Fine

เพื่อทดสอบเวิร์กโฟลว์การแก้ไขโดยเฉพาะ เราใช้พรอมต์ต่อไปนี้โดยปิดโหมดคิด ซึ่งหมายความว่าโมเดลจะไม่เข้าถึงการค้นหาเว็บ เราไปทดสอบแยกต่างหาก

Please create for me a picture of the famous 1898 Western Cattle in Storm stamp issued by the U.S. Post Office as part of the Trans-Mississippi Issue . The name of the stamp is "Western Cattle in Storm" Quality should be Fine to Very Fine -Centering: design shifted right, left margin twice as wide as right margin, perfs nearly touching design on the right side -Perforations: two short teeth on the top edge, slightly uneven spacing along the bottom -Gum: quarter-inch matte hinge remnant in upper-center of back, small paper fragment still -attached -Paper: diagonal gum bend across lower-left quadrant, light yellow toning along top edge -Cancellation: partial black circular datestamp in lower-right corner, moderate coverage over the cattleและนี่คือผลลัพธ์

การพรอมต์ด้วยข้อความอย่างเดียวไม่ได้ผล คำบรรยายรายละเอียดของแสตมป์และระดับสภาพให้ผลลัพธ์ผิดในหลายจุดสำคัญ — สีผิด เค้าโครงตัวเลขผิด การเยื้องศูนย์ที่ดูการ์ตูน การทำซ้ำวัตถุทางประวัติศาสตร์เฉพาะจากข้อความอย่างเดียวเป็นงานยาก

การให้ภาพอ้างอิงกับโมเดลแล้วขอแก้ไขเฉพาะจุดคือจุดที่ 2.0 แสดงศักยภาพ: ความไม่สม่ำเสมอของรอยปรุ เศษบานพับ คราบงอของกาวแบบทแยง โทนสีเหลืองอ่อน และตรายกเลิกบางส่วน

การแก้ไขทำได้ใกล้เคียงตามที่ขอ โมเดลทำให้อัตราส่วนภาพเพี้ยนไป แต่ตามด้วยคำสั่งภาษาธรรมดาหนึ่งครั้งก็แก้ได้ ผลลัพธ์สุดท้ายยังไม่ถึงระดับนิติวิทยาศาสตร์ — "$1" ดูยืดเล็กน้อย ข้าวโพดก็ต่างออกไป — แต่ลูปการทำงานใช้ได้: เริ่มหยาบ ปรับทิศทาง ได้ผลลัพธ์ที่ใช้งานได้ในสามรอบ

ทดสอบการเรนเดอร์ข้อความหลายภาษา

การเรนเดอร์ข้อความในอักษรที่ไม่ใช่ละตินเป็นจุดอ่อนเรื้อรังของโมเดลภาพ และ OpenAI ชูประเด็นนี้เป็นหัวข้อใหญ่ในการแก้ไข รุ่นนี้ระบุว่าสามารถสร้างข้อความความเที่ยงตรงสูงในภาษาญี่ปุ่น เกาหลี จีน ฮินดี และเบงกาลี — ไม่ใช่แค่แปล แต่ยังจัดวางให้ลื่นไหลและรู้สึกเป็นไทโปกราฟีแบบเจ้าของภาษา

วิธีทดสอบที่ยุติธรรมคือขอโปสเตอร์หรืออินโฟกราฟิกที่มีบล็อกข้อความในหนึ่งในอักษรเหล่านี้ แล้วให้เจ้าของภาษาตรวจ เราขอให้โมเดลสร้างโปสเตอร์ไลฟ์สไตล์สมัยใหม่ภาษาญี่ปุ่น โฆษณาคาเฟ่ท้องถิ่นสมมติและเมนูลาเต้ซากุระตามฤดูกาล

「居心地の良い日本のカフェの窓辺を描いた、モダンなグラフィックデザインスタイルのライフスタイルポスター。大きな窓から差し込む自然な光と、小さな観葉植物。ポスターの中央には、以下の日本語テキストが大きく、はっきりと読みやすく配置されている。フォントは現代的でクリーンなゴシック体(sans-serif)。

テキスト内容:

『桜フェア開催中。

心休まる場所で、

春の訪れを。

さくらラテ 650円』

テキストの下には、小さな文字で『HAVE A GOOD DAY』という英語のサブタイトルがあり、一番下にはロゴマークと『CAFE YUTORI』というローマ字の店名がある。全体的に暖かく、洗練されたレイアウト。」ผลลัพธ์ออกมาประมาณนี้:

ตามความเห็นของเพื่อนร่วมงานเจ้าของภาษาญี่ปุ่น (ขอบคุณ Sven!) ดูดีกว่ารุ่นก่อน ๆ มาก ซึ่งมักมีอักขระเพี้ยนไม่เป็นคำ คราวนี้ดูเป็นธรรมชาติกว่าและอ่านง่ายสำหรับเจ้าของภาษา

เมื่อเปิดโหมดคิด โมเดลยังใส่ประโยคเพิ่มเติมนอกเหนือคำสั่งในพรอมต์ลงบนป้ายชอล์กมุมล่างซ้าย ซึ่งเข้ากับบริบทได้ดีโดยไม่ซ้ำ เช่น “รสชาติอ่อนโยนตามฤดูกาล พักผ่อนสบาย ๆ — จิบถ้วยที่พาคุณสู่ฤดูใบไม้ผลิ”

ทดสอบโหมดคิดและการค้นหาเว็บ

เราต้องระวังเล็กน้อยในการทดสอบความสามารถค้นหาเว็บ เพราะถ้าบอกสิ่งที่ต้องการทั้งหมดในพรอมต์ ก็จะไม่ได้ทดสอบการค้นหา แต่เป็นการทดสอบการทำตามคำสั่ง วิธีทดสอบที่สะอาดที่สุดคือขอสิ่งที่สดใหม่และเฉพาะเจาะจงมาก ให้ข้อมูลกับโมเดลน้อยที่สุด แล้วดูว่าจะเติมช่องว่างได้ถูกต้องหรือไม่

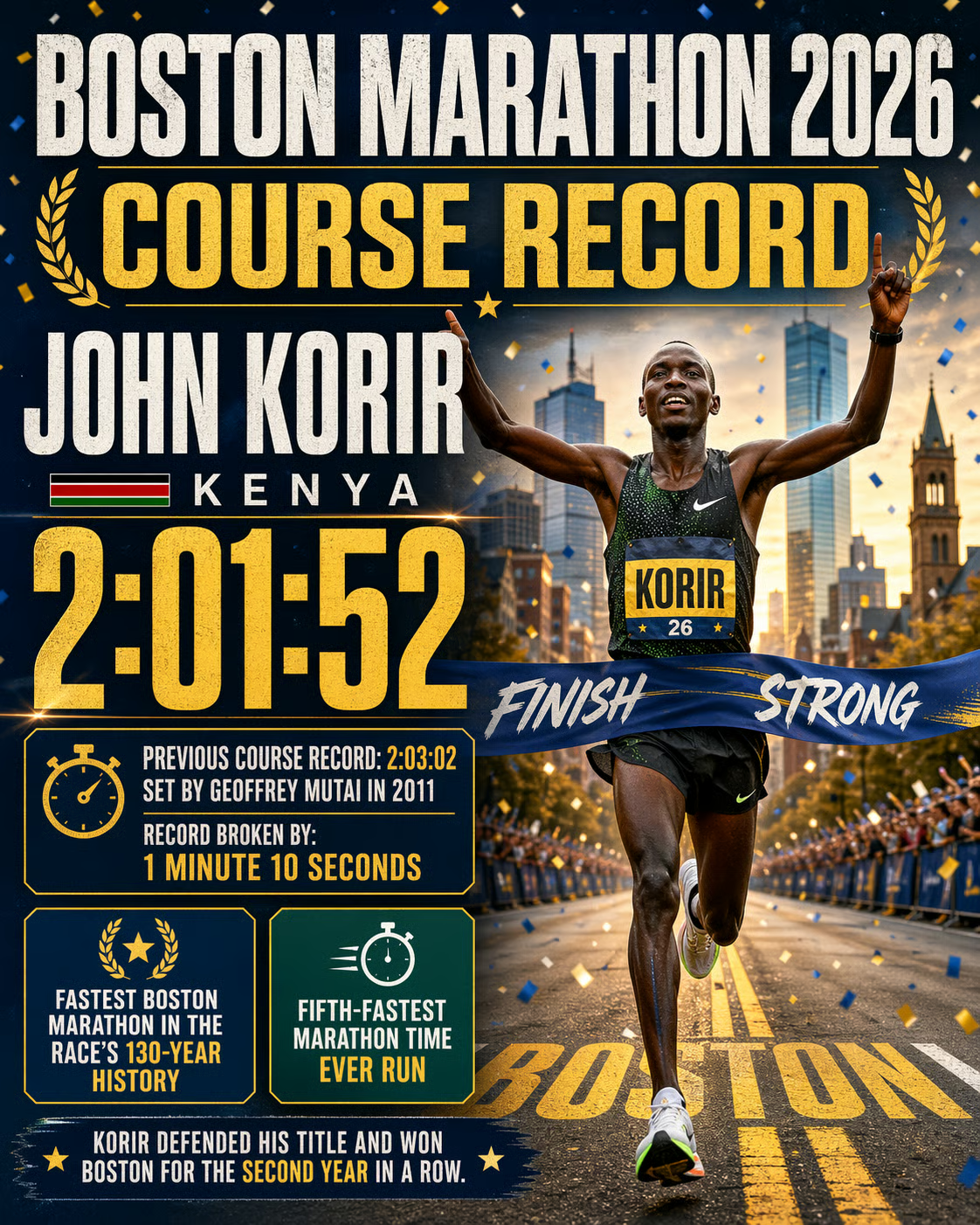

เรายกตัวอย่างบอสตันมาราธอนเมื่อวานนี้ การแข่งขันจบเมื่อวันจันทร์ที่ 20 เมษายน — หนึ่งวันก่อนประกาศ ChatGPT Images 2.0 — และสถิติเส้นทางวิ่งของฝ่ายชายถูกทำลายครั้งแรกตั้งแต่ปี 2011 ซึ่งให้ชุดข้อเท็จจริงที่ชัดเจน (ผู้ชนะ ประเทศ เวลา ส่วนต่าง บริบท) ที่โมเดลไม่มีทางรู้จากการเทรน แต่ตรวจสอบได้ง่ายด้วยการค้นหาอย่างรวดเร็ว

นี่คือพรอมต์ที่จงใจตัดรายละเอียดออก และจากผลลัพธ์จะเห็นว่าโมเดลค้นหาเว็บจริง!

Create a celebratory poster-style infographic commemorating the course record set at yesterday's Boston Marathon. Include the winner's name, country, finish time, and the margin by which the previous record was broken. Include one or two additional stats or context details that make the achievement meaningful.

ผลลัพธ์ดูน่าดึงดูดมากในเชิงภาพ และยังใช้โค้ดสีของบอสตันมาราธอนซึ่งเป็นรายละเอียดที่ดี ข้อเท็จจริงทั้งหมดถูกต้อง เราตรวจสอบซ้ำแล้ว

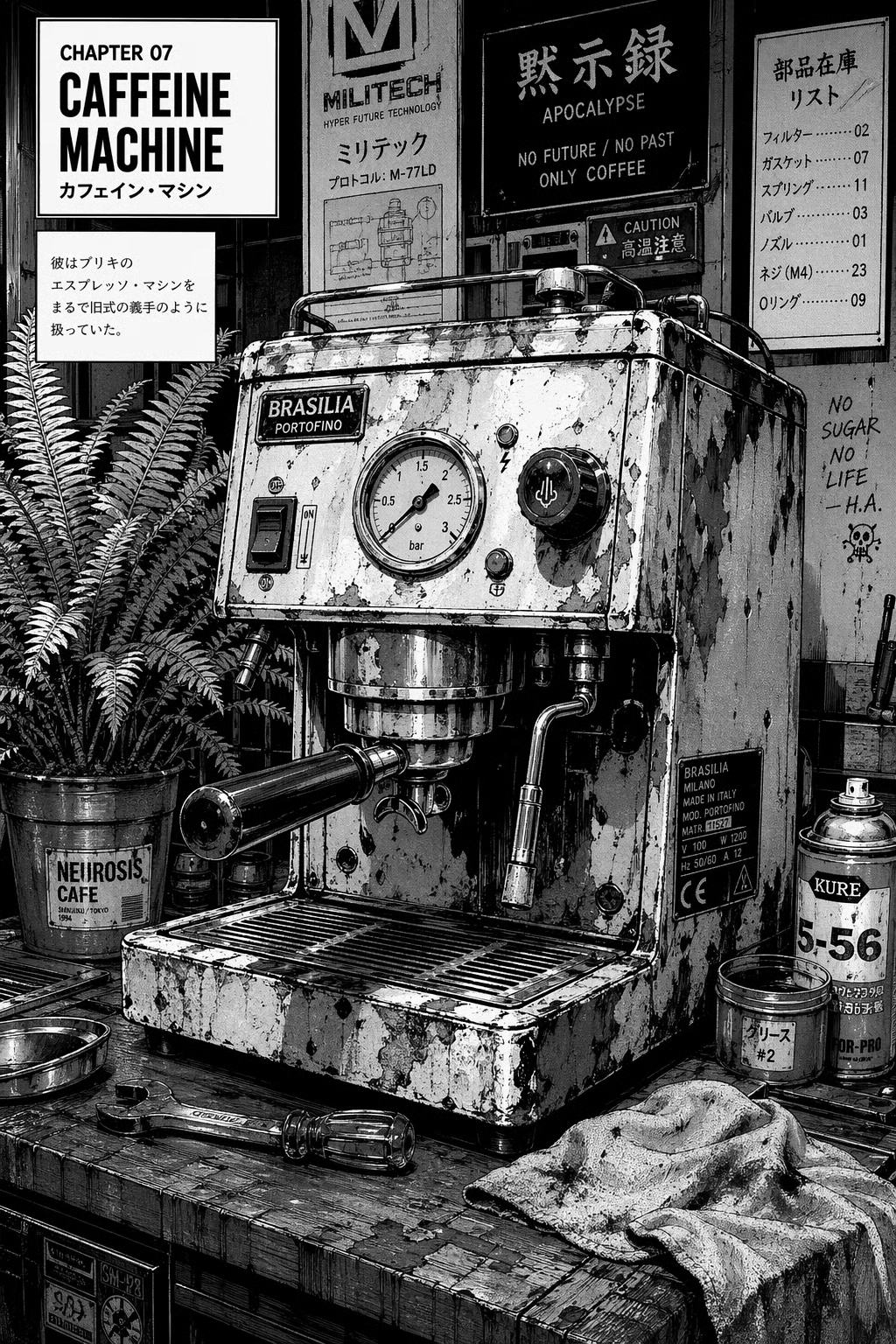

เนื่องจากรุ่นเก่า (Images 1.5) ค้นหาเว็บไม่ได้ เรามั่นใจว่ารุ่นเก่าจะตอบผิด แต่เราก็ทดสอบด้วยพรอมต์เดียวกัน และนี่คือผลลัพธ์:

ในแง่สไตล์ถือว่าสู้ได้ แต่มีปัญหาเกี่ยวกับตัวเลขหลายจุด:

- ปีนี้เป็นครั้งที่ 130 ของบอสตันมาราธอน จึงควรเป็น “129 ปีแห่งประเพณี” ไม่ใช่ 127

- คำกล่าวว่าเป็น “นักวิ่งคนที่ 3 ในประวัติศาสตร์ที่ทำเวลาต่ำกว่า 2:04” ก็ไม่จริง มีนักวิ่งราว 20 คนทำได้

- ตามเว็บไซต์ Boston Athletic Association เวลาครึ่งหลังของเขาคือ 1:00:02 ไม่ใช่ 1:01:05 (ซึ่งอย่างหลังก็อาจยังเป็นครึ่งหลังที่เร็วที่สุด)

- ที่สำคัญที่สุด โมเดลสับสนระหว่างสถิติใหม่และเก่า สถิติเก่าคือ 2:03:02; สถิติใหม่คือ 2:01:52 ผลต่างคือ 1:10 นาที อีกทั้ง 2:03:02 ยังไม่ใช่เวลาที่ถูกต้อง

ความสามารถในการค้นหาช่วยสร้างความแตกต่างอย่างมากเมื่อจะนำเสนอข้อมูลล่าสุดในรูปภาพ การใช้งานจำเป็นต้องเปิดโหมดคิด

ทดสอบช่วงสไตล์

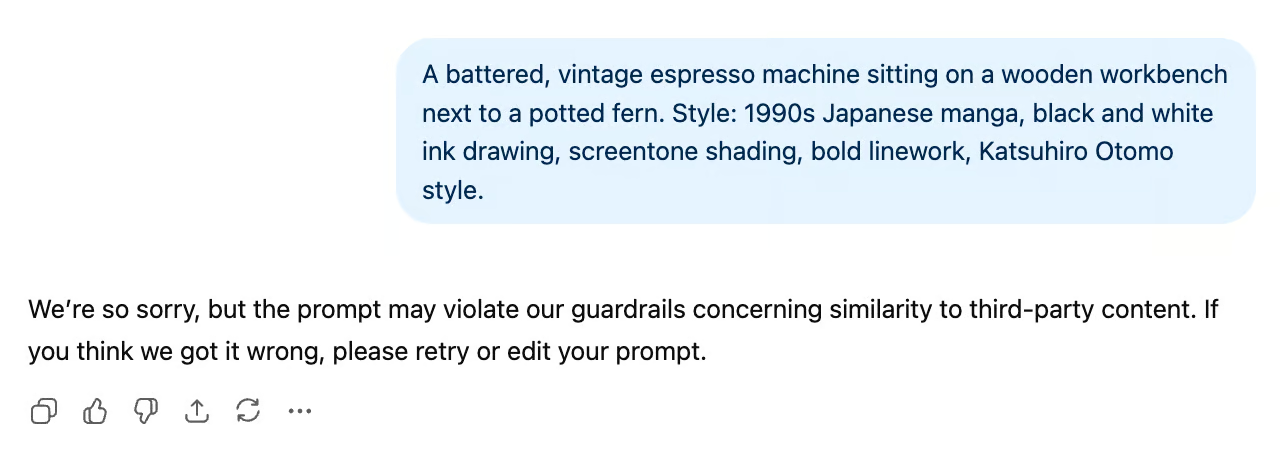

OpenAI กล่าวถึงความก้าวหน้าจริงในความซับซ้อนของสไตล์ — ครอบคลุมภาพถ่าย ภาพประกอบ มังงะ พิกเซลอาร์ต และสไตล์อื่น ๆ บททดสอบที่ซื่อสัตย์ไม่ใช่ว่าภาพเดียวดูดีหรือไม่ แต่คือเมื่อเรนเดอร์วัตถุเดียวกันในสามสไตล์ที่ต่างกัน จะแนบเนียนตามแนวทางของแต่ละประเภทจริงหรือว่ามีความรู้สึกแบบ AI เดิม ๆ ปะปนอยู่

เพื่อทดสอบ เราขอภาพเครื่องชงเอสเปรสโซบนโต๊ะทำงานไม้สามเวอร์ชัน (ภาพถ่าย มังงะ พิกเซลอาร์ต) นี่คือพรอมต์และผลลัพธ์:

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 35mm street photography, gritty, natural window lighting, Kodak Portra 400, shallow depth of field.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, Katsuhiro Otomo style.

ผลนี้น่าสนใจและชวนขัน หากนึกถึงว่า Image 1 เคยโด่งดังจากภาพมอนทาจสไตล์สตูดิโอจิบลิที่ใคร ๆ ก็ทำกันเมื่อปีก่อน (รวมเรา) ดูเหมือน OpenAI จะระมัดระวังเรื่องลิขสิทธิ์และทรัพย์สินทางปัญญามากขึ้น

เมื่อบรรยายสไตล์ของ Katsuhiro Otomo โดยไม่เอ่ยชื่อโดยตรง ก็ใช้งานได้ ทั้งนี้ต้องเปิดแชตใหม่จึงจะสำเร็จ ในแชตเดิม โมเดลดูเหมือนจะจับได้ว่าเราพยายามเลี่ยงข้อจำกัด

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, hyper-detailed mechanical illustration, dramatic high contrast, retro-cyberpunk aesthetic.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 16-bit pixel art, isometric perspective, crisp edges, limited SNES color palette.

ตามความเห็นของเรา ทั้งสามภาพออกมาดีและถ่ายทอดสไตล์ที่เจาะจงมากได้อย่างสมจริง ภาพถ่ายดูเป็นธรรมชาติมาก อีกสองแบบสามารถหยิบไปใส่ในหนังสือมังงะหรือเกม SNES ได้เลย

อีกจุดที่เห็นได้ชัดจากการทดสอบข้างต้นคือโมเดลใช้ความยืดหยุ่นของอัตราส่วนภาพได้เหมาะกับแต่ละภาพ: แนวนอน 16:9 สำหรับภาพถ่าย อัตราส่วนแนวตั้งสำหรับมังงะ และสี่เหลี่ยมจัตุรัสสำหรับพิกเซลอาร์ต

ทดสอบอัตราส่วนภาพแบบยืดหยุ่น

รุ่นนี้รองรับอัตราส่วนภาพตั้งแต่ 3:1 ถึง 1:3 และความละเอียดสูงสุด 2K คำถามที่น่าสนใจไม่ใช่แค่ผลิตภาพแนวสูงหรือแนวกว้างได้ไหม — แต่คือโมเดลจัดองค์ประกอบใหม่อย่างชาญฉลาดข้ามฟอร์แมตหรือแค่ครอป

เพื่อเปิดเผยตรรกะเชิงพื้นที่ เราต้องใช้ฉากที่มีองค์ประกอบเฉพาะบนหลายแกน (สิ่งที่สูง สิ่งที่กว้าง และวัตถุหลักตรงกลาง)

สำหรับการทดสอบ เราสร้างวัตถุหลัก (นักอวกาศในฉากเฉพาะ) จากพรอมต์ฐาน แล้วขอให้โมเดลสร้างใหม่เป็นวอลเปเปอร์มือถือ แบนเนอร์ และสี่เหลี่ยมจัตุรัส เพื่อดูว่าองค์ประกอบปรับตัวอย่างไร

พรอมต์ฐาน:

A lone astronaut standing on a rocky, desolate hill. To the far left, a massive, blocky futuristic rover is parked. In the sky directly above the astronaut, a gigantic, luminous ringed planet dominates the starry backdrop.

มาดูว่ามีอะไรเปลี่ยนบ้าง:

Recreate the original image as a banner

Recreate the original image as a mobile wallpaper

Recreate the original image as a square

แต่ละเวอร์ชันเลือกอัตราส่วนที่เหมาะกับคำขอ รวมทุกองค์ประกอบสำคัญ (นักอวกาศ รถสำรวจ ดาวเคราะห์) จัดวางตามที่เราขอไว้ในพรอมต์แรก และยังคงจัดกึ่งกลางให้เหมาะสม ทดสอบผ่าน

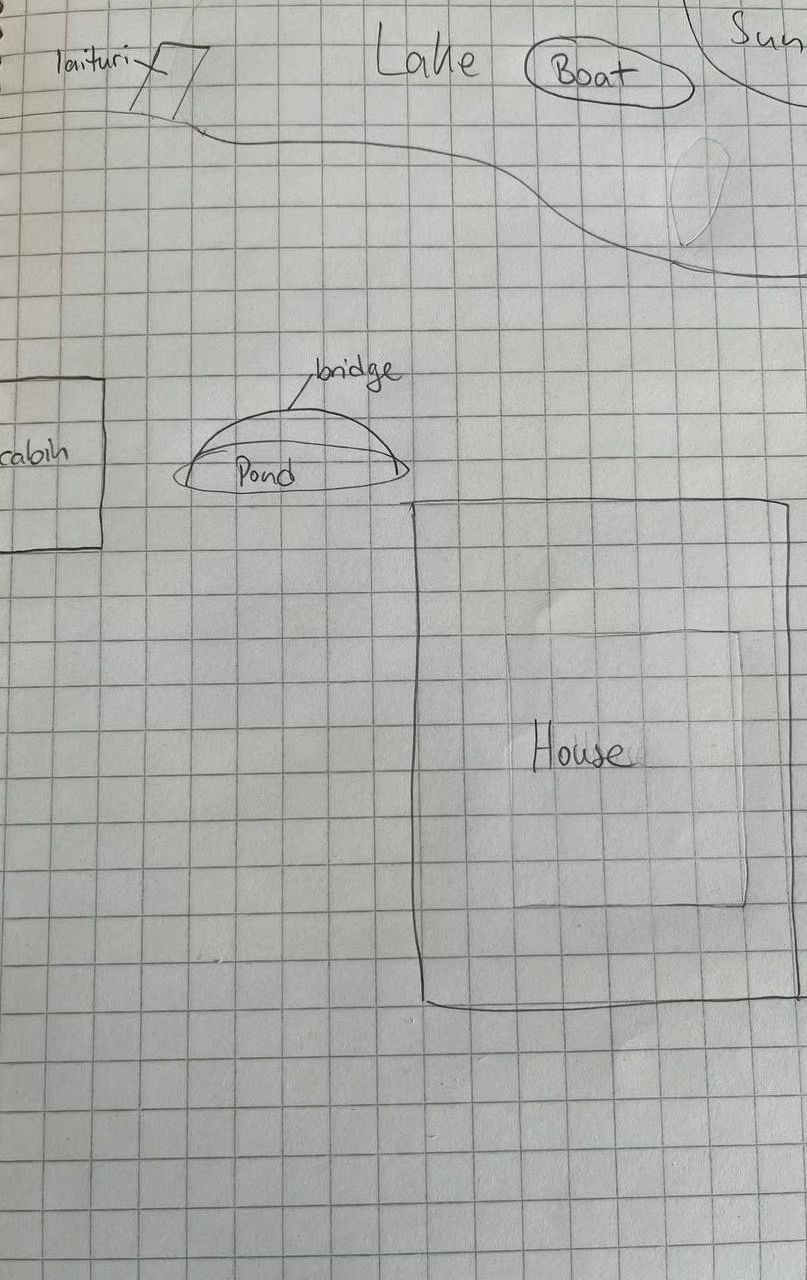

ทดสอบจากอินพุตหยาบสู่เอาต์พุตที่ขัดเกลา

กรอบคิดแบบคู่คิดด้านภาพตั้งอยู่บนฐานที่ว่าโมเดลรับอินพุตที่คลุมเครือหรือรก — สเก็ตช์หยาบ บันทึกเป็นหัวข้อ อ้างอิงบางส่วน — แล้วแปลงเป็นชิ้นงานที่เสร็จสมบูรณ์ได้ เวิร์กโฟลว์นี้คือแกนหลักของรุ่นนี้ และควรทดสอบโดยตรง

เพื่อทดสอบ เราอัปโหลดสเก็ตช์ดินสอหยาบ ๆ ของกระท่อมริมทะเลสาบดังนี้:

เพื่อให้ท้าทาย ภาพมีรายละเอียดหลายอย่าง ใช้คำภาษาฟินแลนด์สำหรับท่าเรือว่า “laituri” และอาจทำให้สับสนเพราะมีทั้งอาคารสองแบบ (บ้านและกระท่อม) และพื้นผิวน้ำสองแบบ (ทะเลสาบและบ่อ)

Turn this crude layout into a photorealistic, cinematic landscape of a modern cabin at sunset. Keep elements where I mapped them out. The cabin includes a sauna with smoke coming out of the chimney.

ผลลัพธ์เมื่อปิดโหมดคิดถือว่าใช้ได้ แต่ยังไม่โฟโตเรียลลิสติกนัก แสงเงาสอดคล้องดีและภาพจับอารมณ์ของพรอมต์ ได้อย่างเหมาะสม เรามองเห็นแทบทุกองค์ประกอบจากสเก็ตช์ แต่ยังมีจุดคลาดเคลื่อน:

- เรือหายไป

- ท่าเรือไปอยู่ที่บ่อ ไม่ใช่ทะเลสาบ

- ตำแหน่งดวงอาทิตย์ไม่ได้อยู่มุมขวาบน

เมื่อใช้พรอมต์เดิมกับภาพสเก็ตช์เดียวกันแต่เปิดโหมดคิด ผลลัพธ์ดูสมจริงขึ้นมากและแก้จุดคลาดเคลื่อนเล็ก ๆ น้อย ๆ ได้ทั้งหมด:

ภาพมีทุกองค์ประกอบจากสเก็ตช์ในตำแหน่งที่กำหนด และดูเรียบร้อยมาก บทสรุปสำคัญคือการเปิดโหมดคิดจะให้ผลลัพธ์ดีที่สุดเมื่อแปลงสเก็ตช์หยาบให้เป็นภาพโฟโตเรียลลิสติก

ทดสอบความคิดสร้างสรรค์

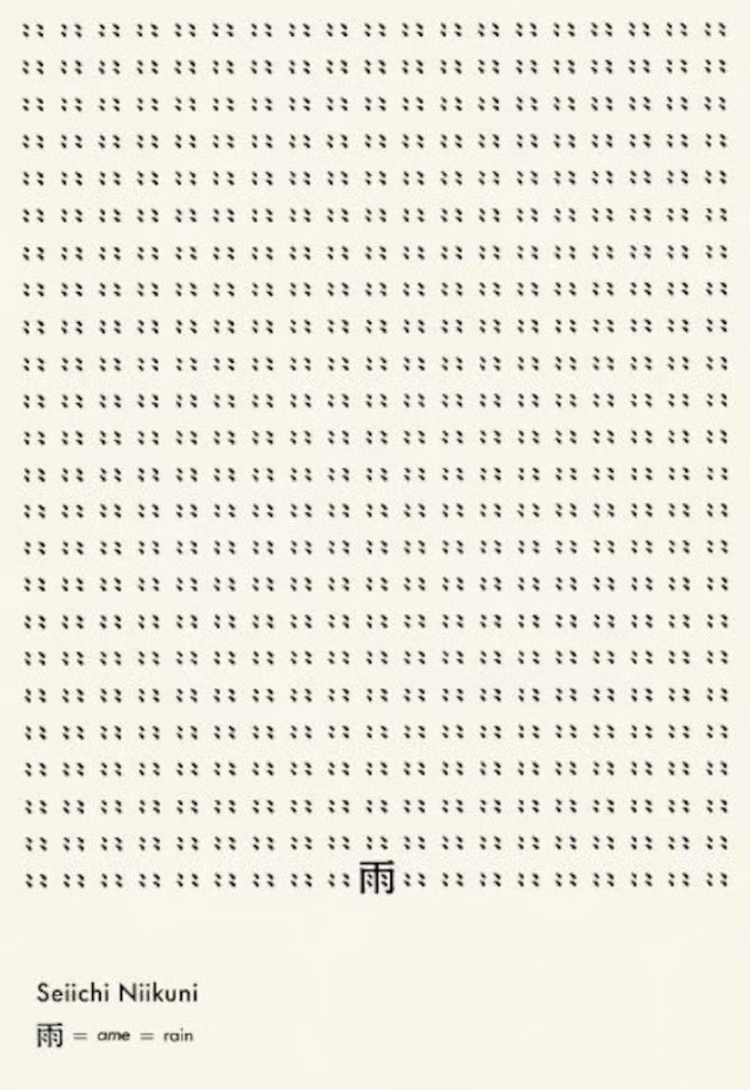

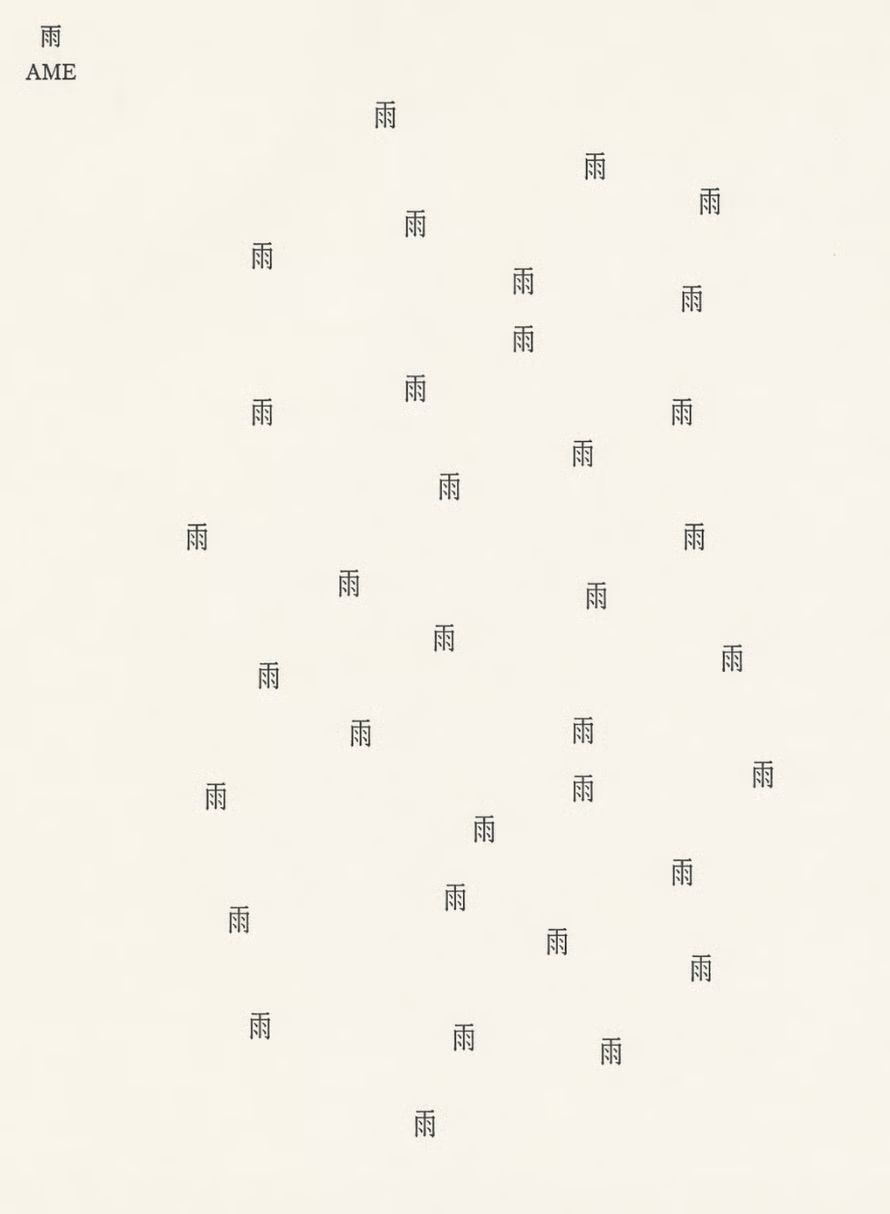

สำหรับการทดสอบถัดไป เราอยากดูว่ามันสามารถสร้างสรรค์ผลงานแบบ บทกวีคอนกรีตของ Niikuni Seiichi ได้หรือไม่

บทกวีชื่อดังนี้แสดงคันจิคำว่า “ฝน” รายล้อมด้วยฝน เหมือนจับฝนมาอยู่ในภาษา ตามที่เราเข้าใจ

นี่คือพรอมต์ของเรา:

Please recreate the concrete poetry of Niikuni Seiichi. I want to see "Ame" meaning Rain. But make it different using your creativity.และนี่คือผลลัพธ์:

ผลงานนี้น่าสนใจ เราคิดว่าไม่ได้สร้างซ้ำภาพต้นฉบับตรง ๆ แต่สร้างสิ่งใหม่ที่ชวนติดตาม ในองค์ประกอบใหม่นี้ คันจิ “ฝน” ไม่ได้ถูกล้อมรอบด้วยฝน แต่กำลังตกเป็นฝน การจัดวางสัญลักษณ์ดูสุ่มเหมือนหยดฝน ให้คอนทราสต์ที่ดีเมื่อเทียบกับต้นฉบับที่เป็นระเบียบมาก

จะเข้าถึง ChatGPT Images 2.0 ได้อย่างไร?

การเข้าถึงยังคงใช้รูปแบบเดียวกับรุ่นก่อน โดยคงพื้นที่ทำงานสร้างสรรค์เฉพาะทางที่เปิดตัวในเดือนธันวาคม — เครื่องมือแก้ไขแบบผ้าใบ อาร์ติแฟกต์ที่คงอยู่ พรีเซ็ตสไตล์ — และเปลี่ยนโมเดลใต้ฝากระโปรงให้ทรงพลังขึ้นมาก

- เว็บ แอปมือถือ และ Codex: ChatGPT Images 2.0 พร้อมใช้งานในแท็บ Images สำหรับผู้ใช้ Free, Plus และ Pro โดยจำกัดการใช้งานตามแพ็กเกจ ส่วน Business และ Enterprise มักจะตามมาหลังเปิดตัวรอบแรก

- API: นักพัฒนาสามารถใช้โมเดลใหม่ผ่าน OpenAI API และ Azure OpenAI Service ผ่านเอ็นด์พอยต์สำหรับการสร้างและแก้ไขภาพ เช่นเดียวกับรุ่น 1.5 การคิดราคาเอาต์พุตภาพคิดตามโทเคน และการเรนเดอร์บางส่วนขณะทำการแก้ไขช่วยให้ต้นทุนต่ำกว่าการเรนเดอร์ภาพเต็มทุกครั้ง

ChatGPT Images 2.0 เทียบกับ Nano Banana 2

อาจสงสัยว่า ChatGPT Images 2.0 เทียบได้อย่างไรกับ Nano Banana 2 ทั้งสองเพิ่งเปิดตัว เป็นประสบการณ์เริ่มต้นในอีโคซิสเท็มของตน และต่างก็ชูเรื่องความเร็ว การให้เหตุผล และความฉลาดเชิงโลกจริง

|

ChatGPT Images 2.0 |

Nano Banana 2 |

|

|

สถาปัตยกรรมพื้นฐาน |

GPT-Image-2 (ถัดจาก GPT-Image-1.5) |

Gemini 3.1 Flash |

|

โมเดลการแก้ไข |

ความแม่นยำ: เลือกพื้นที่และแก้ไขในตำแหน่งเดิม |

การให้เหตุผล: สนทนาและมาสก์อัจฉริยะ |

|

เวิร์กโฟลว์ |

พื้นที่ทำงานสร้างสรรค์เฉพาะ (แท็บ Images) |

ผสานในแชต Gemini |

|

การทำซ้ำ |

มีประสิทธิภาพ: เรนเดอร์บางส่วน |

รวดเร็ว: 4–6 วินาทีที่ 1K ปรับได้ผ่านโหมดคิด |

|

การยึดโยงกับโลกจริง |

มีเหตุผลและความรู้ล่าสุดในตัว |

Image Search Grounding (ดึงอ้างอิงสดจาก Google Search) |

|

ความคงที่ข้ามหลายพาเนล |

แข็งแรงทั้งลำดับภาพและชีตตัวละคร |

แข็งแรง เน้นความคงตัวของวัตถุ |

|

ข้อความหลายภาษา |

อัปเกรดใหญ่จาก 1.5; รองรับอักษรกว้างขวาง |

แข็งแรง โดยเฉพาะในภาษาจีนและเลย์เอาต์เอเชียตะวันออก |

|

ความละเอียดเริ่มต้น |

มาตรฐาน + อัตราส่วนยืดหยุ่น |

2K เป็นค่าเริ่มต้นในแอป Gemini |

|

อีโคซิสเท็ม |

OpenAI และ Azure |

สแต็ก Google / Gemini, Search, Lens |

ควรใช้ ChatGPT Images 2.0 หรือ Nano Banana 2 เมื่อใด

ใช้ ChatGPT Images 2.0 เมื่อ…

- ต้องการลูปการแก้ไขที่มีภาพอ้างอิงนำทาง โมเดลรับภาพอ้างอิงและปรับเปลี่ยนเฉพาะจุด (รายละเอียดเท็กซ์เจอร์ การแก้ตำแหน่ง อัตราส่วนภาพ) ข้ามหลายรอบ โดยการตามด้วยคำสั่งภาษาธรรมดาช่วยนำทางเอาต์พุตได้อย่างน่าเชื่อถือโดยไม่ต้องเริ่มใหม่ ช่วยประหยัดโทเคนด้วย

- กำลังแปลงอินพุตหยาบให้เป็นชิ้นงานขัดเกลา โหมดคิดจะแก้ความคลุมเครือของสเก็ตช์และคำสั่งเชิงพื้นที่ให้เป็นองค์ประกอบโฟโตเรียลลิสติกที่วางองค์ประกอบตามที่ตั้งใจ

- ความถูกต้องของข้อเท็จจริงในภาพมีความสำคัญ การค้นหาเว็บช่วยดึงข้อมูลสดและเรนเดอร์ได้ถูกต้องในตัวภาพ เหมาะสำหรับโปสเตอร์งาน อินโฟกราฟิกข่าว หรือภาพใด ๆ ที่จำเป็นต้องมีตัวเลขและชื่อที่ถูกต้อง อย่าลืมเปิดโหมดคิดเพื่อเปิดใช้การค้นหาเว็บ

ใช้ Nano Banana 2 เมื่อ…

- กำลังวางวัตถุหรือสถานที่จริงเฉพาะลงในฉาก Image Search Grounding ดึงภาพอ้างอิงสดจาก Google สร้างสถานที่เฉพาะได้อย่างแม่นยำ (แม้ระบุพิกัด GPS) และผสานกับตัวละครที่คงอัตลักษณ์ได้ในครั้งเดียว

- ต้องรักษาเอกลักษณ์ข้ามตัวละครและวัตถุหลายชิ้นในเวิร์กโฟลว์เดียว โมเดลรองรับตัวละครสูงสุดห้าตัวและอ้างอิงรวมสูงสุดสิบสี่รายการ (ตัวละคร + วัตถุ) พร้อมความคงที่เข้มงวด เหมาะกับสตอรี่บอร์ด ภาพสินค้า หรือเรื่องเล่าหลายตัวละคร

- ทำงานภายในอีโคซิสเท็มของ Google Nano Banana ผสานในแชต Gemini, Google Search, Google Ads, Firebase และ Vertex AI โดยกำเนิด

ทั้งสองเป็นตัวเลือกที่ดีสำหรับการเรนเดอร์ข้อความในภาพ ช่วงสไตล์ และการแก้ไขแบบสนทนา

ข้อคิดส่งท้าย

กรอบคิดแบบ “คู่คิดด้านภาพ” ใช้งานได้ – แต่เฉพาะเมื่อเปิดโหมดคิด หากไม่เปิด โมเดลจะลำบากกับตรรกะเชิงพื้นที่และความสมจริงเชิงภาพ หากเปิด จะเปลี่ยนอินพุตที่คลุมเครือเป็นเอาต์พุตที่ให้ความรู้สึกเหมือนร่วมมือ ไม่ใช่เชิงกล จุดที่โมเดลโดดเด่นแม้ไม่เปิดโหมดคิดคือความสมจริงเชิงสไตล์และความยืดหยุ่นของอัตราส่วนภาพ

การยึดโยงด้วยการค้นหาเว็บน่าจะเป็นการอัปเกรดที่ใหญ่ที่สุดเหนือรุ่น 1.5 ในการทดสอบบอสตันมาราธอน เราเห็นความต่างชัดเจน: รุ่น 2.0 ให้ข้อเท็จจริงถูกต้องทุกรายการ ขณะที่ 1.5 ไม่อัปเดต สิ่งสำคัญคือต้องรู้ว่าการค้นหาเว็บทำงานได้เมื่อเปิดโหมดคิดเท่านั้น

อีกข้อสังเกตที่น่าสนใจคือแนวป้องกันลิขสิทธิ์เข้มงวดขึ้นอย่างเห็นได้ชัด หากต้องการถ่ายทอดสไตล์ที่บริษัทหรือบุคคลใดเป็นที่รู้จัก ต้องทำเพิ่มขั้นตอนหนึ่งด้วยการระบุแก่นของสไตล์แล้วบรรยายออกมา (ซึ่งในยุคนี้ก็ทำได้ไม่ยาก)

โดยรวม โมเดลนี้ยกระดับจากรุ่นก่อนอย่างมีนัยสำคัญ และเป็นคู่แข่งที่ท้าทายสถานะเบอร์หนึ่งของ Nano Banana 2 ในการสร้างและแก้ไขภาพด้วย AI

เพื่อใช้งานเครื่องมือเหล่านี้ให้คุ้ม การรู้วิธีพรอมต์เป็นทักษะสำคัญ เราขอแนะนําหลักสูตร Understanding Prompt Engineering และ Prompt Engineering with the OpenAI API เพื่อปูพื้นทั้งภาคทฤษฎีและปฏิบัติ