Kurs

Es ist fast auf den Tag genau ein Jahr her, seit die erste Version von ChatGPT Images mit dem Modell GPT Image 1 veröffentlicht wurde. OpenAI hat sein Bildmodell nun erneut grundlegend überarbeitet und verkauft uns die neue Idee, dass der „Bildgenerator“ jetzt ein „visueller Denkpartner“ ist.

In diesem Artikel schauen wir uns an, was neu ist, wie es sich im Vergleich zum Vorgänger ChatGPT Images 1.5 schlägt, wie es gegen Googles Nano Banana 2 abschneidet und wo das Modell glänzt (und wo nicht).

Wir empfehlen außerdem unseren Guide zu OpenAIs neuestem LLM, GPT-5.5.

Was ist ChatGPT Images 2.0?

ChatGPT Images 2.0 ist OpenAIs Bildmodell der nächsten Generation. Es wird als System vermarktet, das erst recherchiert und schlussfolgert – und dann rendert.

Willst du mit generativer KI beginnen?

Lerne, wie du mit LLMs in Python direkt in deinem Browser arbeiten kannst

Was ist neu bei ChatGPT Images 2.0?

Eine der größten Erkenntnisse beim Release von ChatGPT Images 1.5 war der deutliche Performance-Schub. Damals hieß es, es sei viermal schneller. Wir wollten das verifizieren, stellten aber fest, dass es vor allem für Bearbeitungen galt, nicht für die Erzeugung neuer Bilder.

Diesmal lautet der große Anspruch: mehr Intelligenz. ChatGPT Images 2.0 ist ein „denkendes“ Bildmodell. Es soll recherchieren, über Fakten nachdenken und grobe Eingaben (Notizen, Skizzen, Referenzen) mit deutlich weniger manuellem Prompting in ausgereifte Visuals übersetzen.

Weitere Schlagworte aus der Ankündigung sind:

- Mehr Präzision und Kontrolle bei der Generierung selbst

- Stärkere Leistung über Sprachen und Schriftsysteme hinweg

- Mehr stilistische Raffinesse und Realismus

- Verbesserte Realwelt-Intelligenz, im Modell verankert

- Flexible Seitenverhältnisse für alles von Mobile bis Banner

Ein Modell, das denkt

Eine der größten Aussagen des Releases ist, dass das neue Modell „denkt“ und wie ein „visueller Denkpartner“ agiert. Die Idee: Agenten arbeiten im Hintergrund, um die Aufgabe gründlich zu verstehen und zu durchdenken, bevor sie die Generierung ausführen.

Sein Weltwissen wurde bis Dezember 2025 aktualisiert, sodass Ausgaben kontextuell passender sind. Das soll das neue Modell besonders stark für Bildungs‑Grafiken und mehrstufige Workflows mit Kontext machen.

Im Web suchen

Um die Lücke zwischen Wissensstichtag und aktuellen Informationen zu schließen, kann Images 2.0 im Web nach relevanten Infos suchen. Aus OpenAIs Release Notes geht nicht klar hervor, wie genau das funktioniert, aber unseres Verständnisses nach dient die Websuche als Tool, das vom oben erwähnten denkenden Agenten aufgerufen wird.

Mehrere Bilder aus einem Prompt erzeugen

Das neue Modell unterstützt nativ die Generierung mehrerer Bilder aus demselben Prompt. Das war über einen Workaround in der API möglich (Aufforderung zur „Komposition“), geht jetzt aber auch in der UI – bis zu zehn Bilder. OpenAI verspricht Konsistenz bei Figuren und Objekten über alle Ausgaben hinweg.

ChatGPT Images 2.0 im Test

Zeit zu sehen, was das neue Modell wirklich kann! Wir haben folgende Fähigkeiten und Features von Images 2.0 getestet:

- Bearbeitungs‑Workflow

- Thinking Mode und Websuche

- Stilistische Bandbreite

- Veredelung grober Skizzen

- Flexibilität beim Seitenverhältnis

- Kreativität

Den Bearbeitungs‑Workflow testen

OpenAIs Pitch für 2.0 setzt auf Iteration: grobe Eingabe rein, fertiges Asset raus – mit besseren Ergebnissen beim Befolgen von Anweisungen und dichter Textdarstellung. Wir haben diese Schleife mit einer berühmten US‑Briefmarke von 1898 namens Western Cattle in Storm getestet.

Hier ist ein Foto einer der Marken in der Erhaltung „Fine“.

Um gezielt den Bearbeitungs‑Workflow zu testen, nutzten wir den folgenden Prompt ohne Thinking Mode. Das bedeutet auch: kein Zugriff auf die Websuche, die wir separat getestet haben.

Please create for me a picture of the famous 1898 Western Cattle in Storm stamp issued by the U.S. Post Office as part of the Trans-Mississippi Issue . The name of the stamp is "Western Cattle in Storm" Quality should be Fine to Very Fine -Centering: design shifted right, left margin twice as wide as right margin, perfs nearly touching design on the right side -Perforations: two short teeth on the top edge, slightly uneven spacing along the bottom -Gum: quarter-inch matte hinge remnant in upper-center of back, small paper fragment still -attached -Paper: diagonal gum bend across lower-left quadrant, light yellow toning along top edge -Cancellation: partial black circular datestamp in lower-right corner, moderate coverage over the cattleUnd hier ist das Ergebnis:

Nur mit Text zu prompten, hat nicht funktioniert. Die detaillierte Beschreibung der Marke und ihrer Erhaltungsstufe kam in den entscheidenden Punkten falsch zurück – falsche Farbe, falsches Layout der Wertangabe, karikaturhafte Dezentrierung. Ein spezifisches historisches Artefakt nur aus Text nachzubilden, ist eine harte Nuss.

Dem Modell das Referenzbild zu geben und gezielte Bearbeitungen zu verlangen, ist der Bereich, in dem 2.0 überzeugt: unregelmäßige Zähnung, ein Falzrest, ein diagonaler Gummiknick, leichte Tönung und ein teilweiser Stempelabschlag.

Die Edits landeten ungefähr dort, wo wir sie wollten. Das Modell führte ein Rückschritt beim Seitenverhältnis ein, aber eine Folgeanweisung in Umgangssprache hat es behoben. Das Endergebnis ist nicht forensiktauglich – die „$1“ wirkt leicht gestaucht, der Mais ist anders –, aber die Schleife hat funktioniert: holpriger Start, Kurskorrektur, nutzbares Ergebnis in drei Zügen.

Mehrsprachige Textdarstellung testen

Text in nicht‑lateinischen Schriften darzustellen, war bei Bildmodellen ein hartnäckiger Schwachpunkt, und OpenAI hebt hier einen großen Fix hervor. Laut Release gibt es hochpräzise Textgenerierung in Japanisch, Koreanisch, Chinesisch, Hindi und Bengalisch – nicht nur übersetzt, sondern mit stimmigem Layout und typografisch natürlich wirkend.

Ein fairer Test ist, ein Poster oder eine Infografik mit einem Textblock in einer dieser Schriften zu verlangen und das Ergebnis mit einer Person mit Muttersprache zu prüfen. Wir baten das Modell um ein modernes japanisches Lifestyle‑Poster für ein fiktives Café und dessen saisonalen Kirschblüten‑Latte.

「居心地の良い日本のカフェの窓辺を描いた、モダンなグラフィックデザインスタイルのライフスタイルポスター。大きな窓から差し込む自然な光と、小さな観葉植物。ポスターの中央には、以下の日本語テキストが大きく、はっきりと読みやすく配置されている。フォントは現代的でクリーンなゴシック体(sans-serif)。

テキスト内容:

『桜フェア開催中。

心休まる場所で、

春の訪れを。

さくらラテ 650円』

テキストの下には、小さな文字で『HAVE A GOOD DAY』という英語のサブタイトルがあり、一番下にはロゴマークと『CAFE YUTORI』というローマ字の店名がある。全体的に暖かく、洗練されたレイアウト。」So sieht die Ausgabe aus:

Laut unserem japanischsprachigen Kollegen (Shoutout an Sven!) sieht das deutlich besser aus als in früheren Modellen, wo viele Zeichen unleserlicher Kauderwelsch waren. Diese Version wirkt natürlicher und lässt sich für Muttersprachler gut lesen.

Im Thinking Mode hat es sogar zusätzliche Sätze über die Prompt‑Anweisungen hinaus auf die kleine Tafel unten links gesetzt. Sie passen gut zum Kontext, ohne sich zu wiederholen, sinngemäß etwa: „Saisonal, sanfter Geschmack. Gönn dir eine entspannte Pause – genieße eine Tasse, die dir den Frühling bringt.“

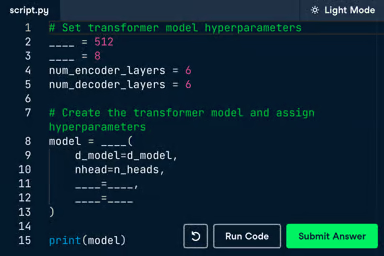

Thinking Mode und Websuche testen

Wir mussten beim Testen der Websuche etwas aufpassen, denn wenn du dem Modell im Prompt sagst, was du willst, testest du nicht die Suche, sondern die Befolgung von Anweisungen. Am saubersten ist es, nach etwas sehr Aktuellem und Konkretem zu fragen, dem Modell fast keine Infos zu geben und zu sehen, ob es die Lücken korrekt füllt.

Wir nahmen den Boston‑Marathon von gestern. Das Rennen endete am Montag, den 20. April – einen Tag vor der Ankündigung von ChatGPT Images 2.0 – und der Männer‑Streckenrekord wurde erstmals seit 2011 gebrochen. Das liefert einen konkreten Faktensatz (Sieger, Land, Zeit, Abstand, Kontext), den das Modell unmöglich aus dem Training haben kann, der aber mit einer kurzen Suche leicht zu verifizieren ist.

Hier ist der Prompt, bewusst ohne Details. Und im Ergebnis sieht man, dass das Modell im Web sucht!

Create a celebratory poster-style infographic commemorating the course record set at yesterday's Boston Marathon. Include the winner's name, country, finish time, and the margin by which the previous record was broken. Include one or two additional stats or context details that make the achievement meaningful.

Das Ergebnis sieht visuell sehr ansprechend aus und hält sich am Farbcode des Boston‑Marathons – ein schönes Extra. Alle genannten Fakten stimmen, was wir überprüft und bestätigt haben.

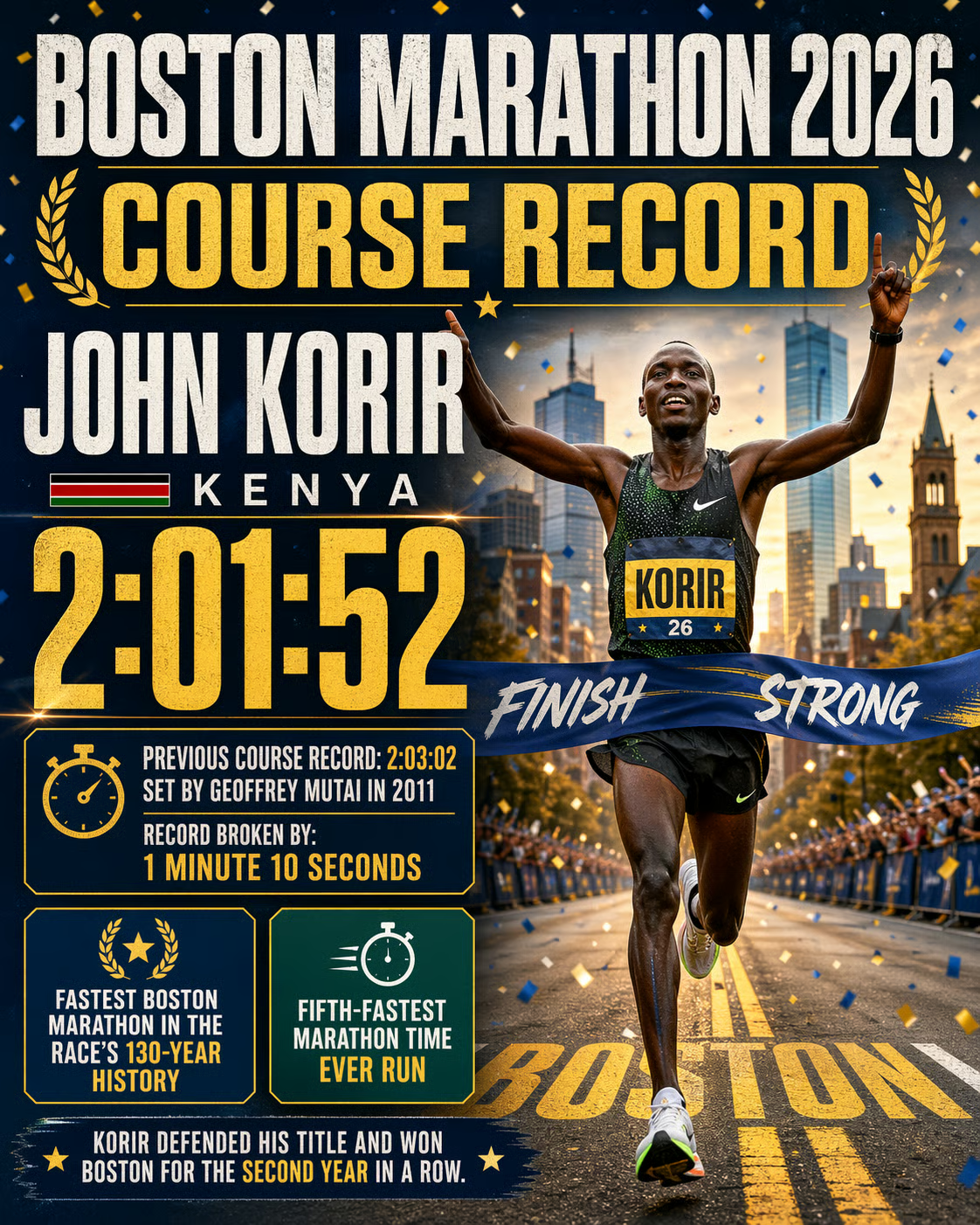

Da das alte Modell (Images 1.5) nicht im Web suchen konnte, waren wir sicher, dass es falsch liegen würde. Wir haben es trotzdem mit demselben Prompt getestet – hier das Ergebnis:

Stilistisch kann es mithalten, aber bei den Zahlen gibt es einige Probleme:

- Es war die 130. Auflage des Boston‑Marathons, daher müsste es „129 Jahre Tradition“ heißen, nicht 127.

- Die Aussage, er sei der „3. Läufer der Geschichte unter 2:04 im Marathon“, ist falsch. Rund 20 Läufer haben das geschafft.

- Laut Boston Athletic Association lag seine zweite Hälfte bei 1:00:02, nicht 1:01:05 (auch wenn das ggf. immer noch die schnellste zweite Hälfte war).

- Am wichtigsten: ChatGPT Images verwechselte die neue und alte Rekordzeit. Der alte Rekord war 2:03:02; der neue Rekord ist 2:01:52. Die Differenz beträgt 1:10 Minuten. Zudem war 2:03:02 nicht die korrekte Zeit.

Die Suchfunktion macht einen echten Unterschied, wenn es darum geht, aktuelle Informationen visuell korrekt darzustellen. Um sie zu nutzen, muss der Thinking Mode aktiviert sein.

Stilistische Bandbreite testen

OpenAI verspricht reale Zugewinne bei stilistischer Raffinesse – von Fotografie über Illustration und Manga bis Pixel Art und andere visuelle Stile. Der ehrliche Test ist nicht, ob ein einzelnes Bild gut aussieht, sondern ob dasselbe Motiv in drei unterschiedlichen Stilen jeweils authentisch rüberkommt oder ob alles den gleichen KI‑Glanz darunter hat.

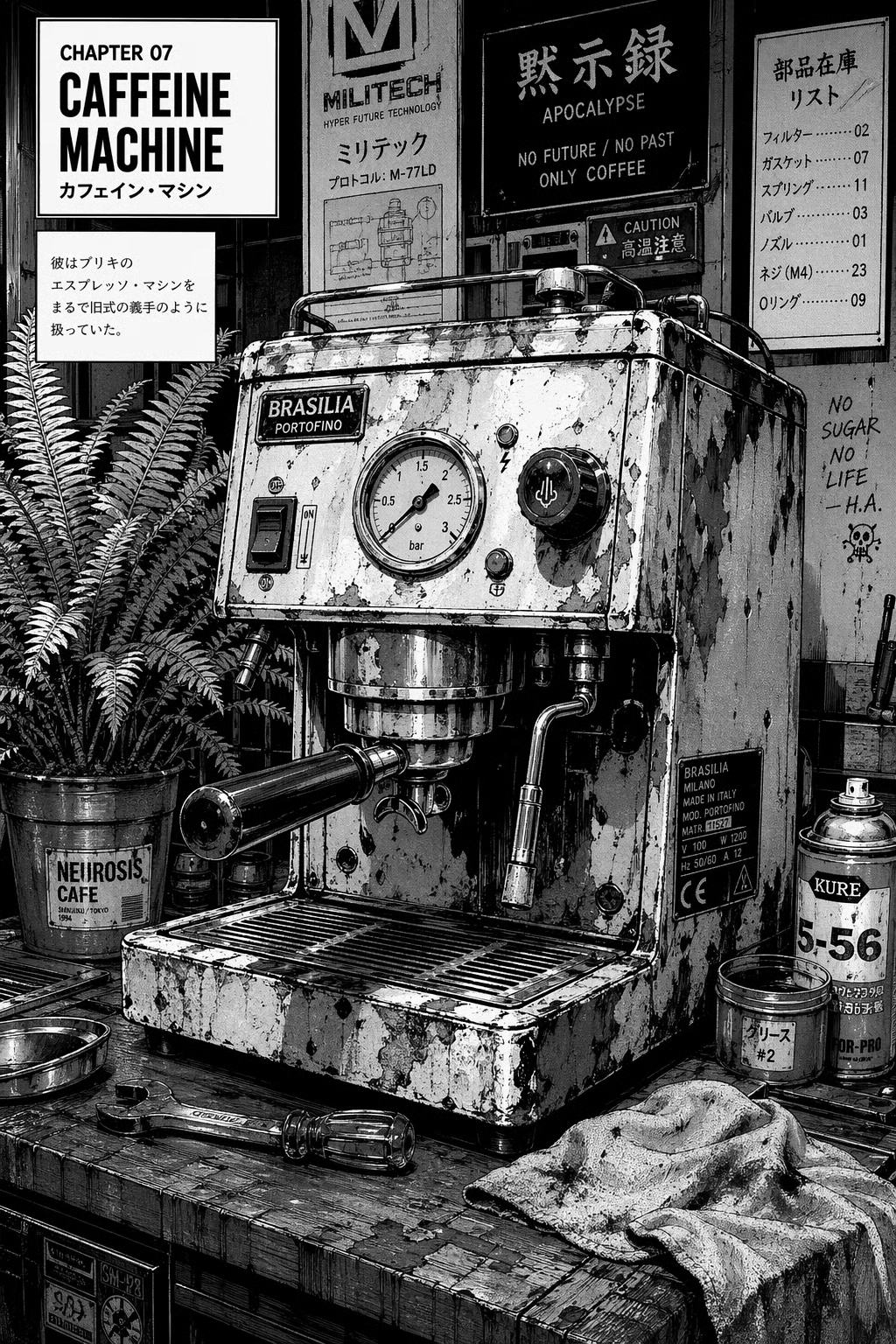

Dafür baten wir um drei Versionen einer Espressomaschine auf einer Holzwerkbank (Fotografie, Manga, Pixel Art). Hier Prompts und Ergebnisse:

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 35mm street photography, gritty, natural window lighting, Kodak Portra 400, shallow depth of field.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, Katsuhiro Otomo style.

Das war ein interessantes – und angesichts der Studio‑Ghibli‑Montagen, die vor einem Jahr alle mit Image 1 gemacht haben (wir auch), fast ironisches – Ergebnis. Offenbar ist OpenAI beim Thema Urheberrecht und IP vorsichtiger geworden.

Wenn man Katsuhiro Otomos Stil umschreibt, ohne ihn namentlich zu nennen, klappt es. Wichtig: Wir mussten dafür einen neuen Chat starten. Im gleichen Chat wie der ursprüngliche Prompt schien das Modell zu merken, dass wir die Sperre umgehen wollten.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, hyper-detailed mechanical illustration, dramatic high contrast, retro-cyberpunk aesthetic.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 16-bit pixel art, isometric perspective, crisp edges, limited SNES color palette.

Unser Eindruck: Alle drei Bilder sind stark und verkörpern die gewünschten, sehr spezifischen Stile authentisch. Das Foto wirkt sehr natürlich, und die anderen beiden könnten direkt einem Manga‑Band bzw. einem SNES‑Spiel entnommen sein.

Auffällig ist auch, wie das Modell seine flexiblen Seitenverhältnisse genutzt hat: 16:9‑Querformat fürs Foto, Hochformat für die Manga‑Variante und ein quadratisches Pixel‑Art‑Bild.

Flexible Seitenverhältnisse testen

Laut Release werden Seitenverhältnisse von 3:1 bis 1:3 und Auflösungen bis 2K unterstützt. Die spannende Frage ist nicht, ob es ein hohes oder breites Bild erzeugen kann – sondern ob das Modell intelligent über Formate hinweg neu komponiert oder nur zuschneidet.

Um die räumliche Logik des Modells offenzulegen, brauchen wir eine Szene mit klaren, unverrückbaren Elementen auf mehreren Achsen (etwas Hohes, etwas Breites und ein zentrales Motiv).

Als Test generierten wir aus einem Basis‑Prompt unser Motiv (einen Astronauten in einem spezifischen Setting) und baten das Modell, es als Mobile‑Wallpaper, als Banner und als Quadrat neu zu erstellen, um zu sehen, wie sich die Komposition anpasst.

Der Basis‑Prompt:

A lone astronaut standing on a rocky, desolate hill. To the far left, a massive, blocky futuristic rover is parked. In the sky directly above the astronaut, a gigantic, luminous ringed planet dominates the starry backdrop.

Schauen wir, wie es sich ändert:

Recreate the original image as a banner

Recreate the original image as a mobile wallpaper

Recreate the original image as a square

Alle Versionen wählen ein passendes Seitenverhältnis für die Anforderung, enthalten alle wichtigen Elemente (Astronaut, Rover, Planet), ordnen sie wie im ursprünglichen Prompt verlangt an und achten auf Zentrierung. Test bestanden.

Von grober Skizze zu poliertem Output

Das „Denkpartner“-Framing lebt davon, dass das Modell vage oder unordentliche Inputs akzeptiert – eine grobe Skizze, Stichpunkte, ein paar Referenzen – und sie in ein fertiges Asset verwandelt. Um diese Schleife dreht sich das Release im Kern, und genau die wollten wir direkt testen.

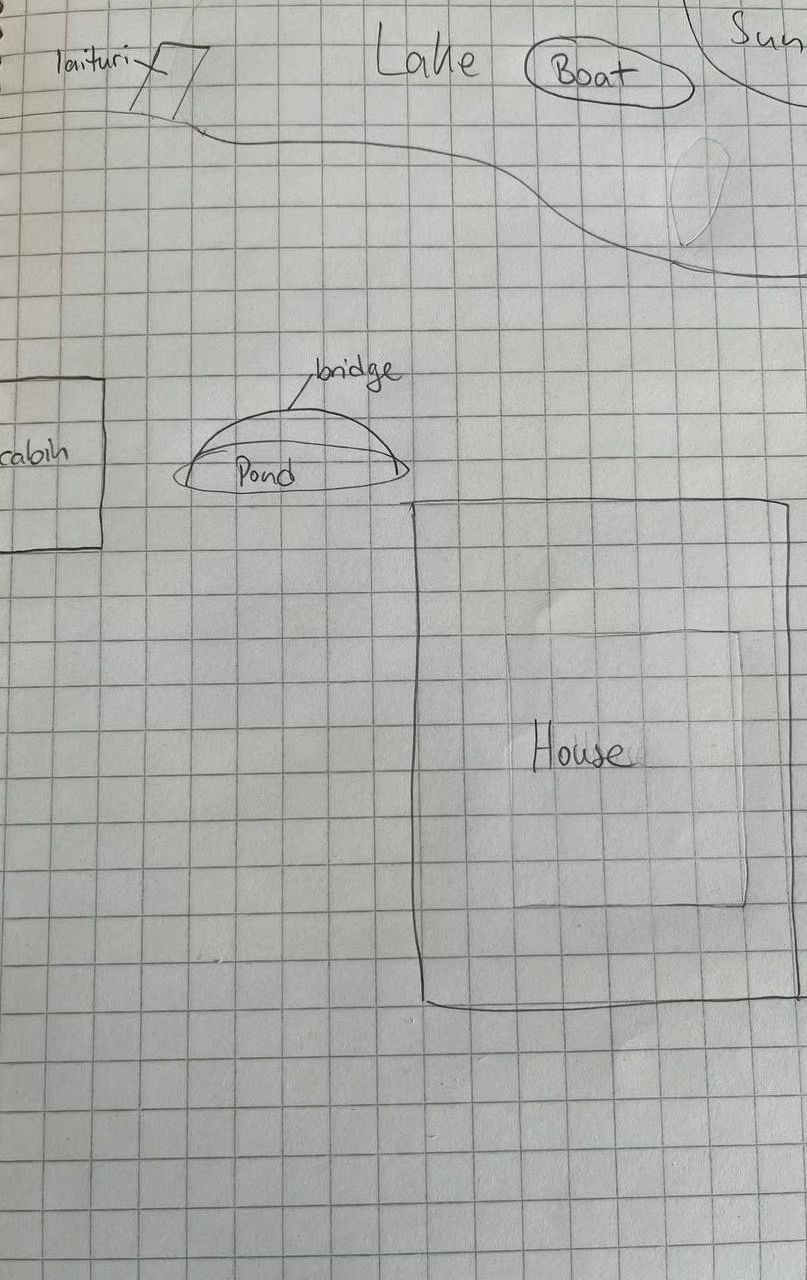

Dafür luden wir die folgende sehr grobe Bleistiftskizze einer Hütte am See hoch:

Zur Erschwernis enthält sie etliche Details, nutzt das finnische Wort für Steg „laituri“ und birgt Verwechslungsgefahr, weil zwei Gebäudetypen (Haus und Hütte) und zwei Wasserflächen (See und Teich) vorkommen.

Turn this crude layout into a photorealistic, cinematic landscape of a modern cabin at sunset. Keep elements where I mapped them out. The cabin includes a sauna with smoke coming out of the chimney.

Das Ergebnis ohne Thinking Mode sieht solide aus, aber nicht sehr fotorealistisch. Das Licht passt jedoch gut, und das Bild trifft die Stimmung des Prompts sehr gut. Wir sehen fast alle Elemente aus der Skizze. Ein paar Details sind daneben:

- Das Boot fehlt.

- Der Steg liegt am Teich, nicht am See.

- Die Sonne steht nicht oben rechts.

Mit demselben Prompt und derselben Skizze im Thinking Mode wirkte die Ausgabe deutlich realistischer und korrigierte alle kleinen Ungenauigkeiten:

Das Bild enthält jedes Element aus der Skizze an der vorgesehenen Position und sieht sehr stimmig aus. Die wichtigste Lehre: Nutze den Thinking Mode, wenn du grobe Skizzen in fotorealistische Bilder verwandeln willst.

Kreativität testen

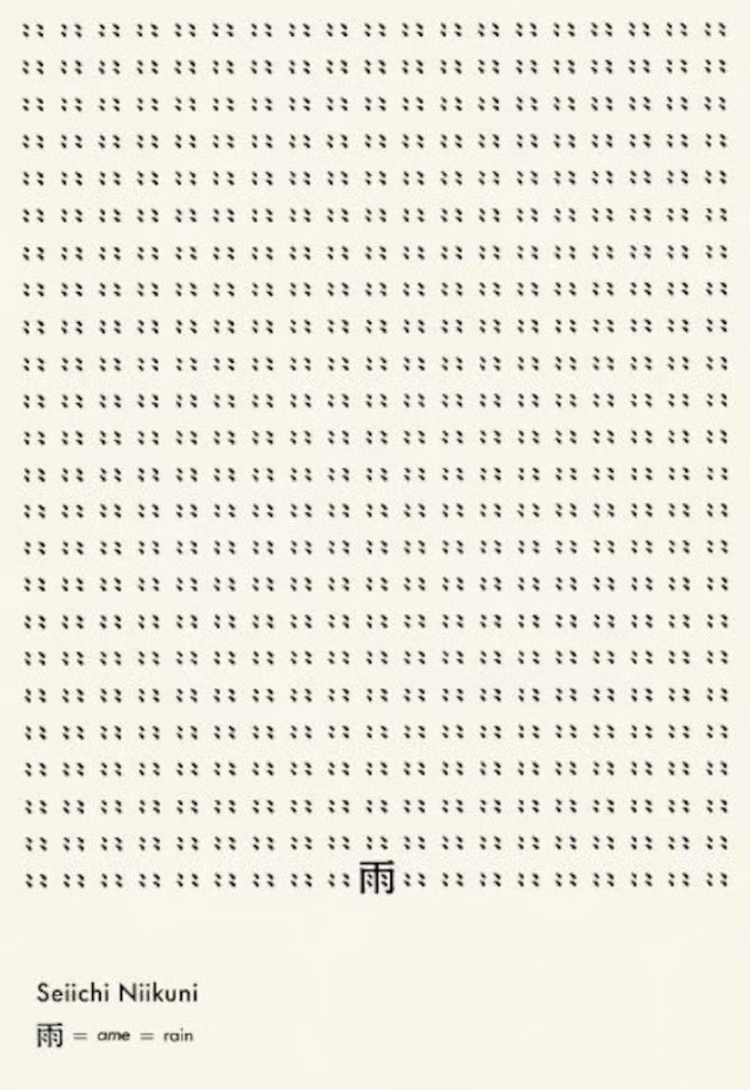

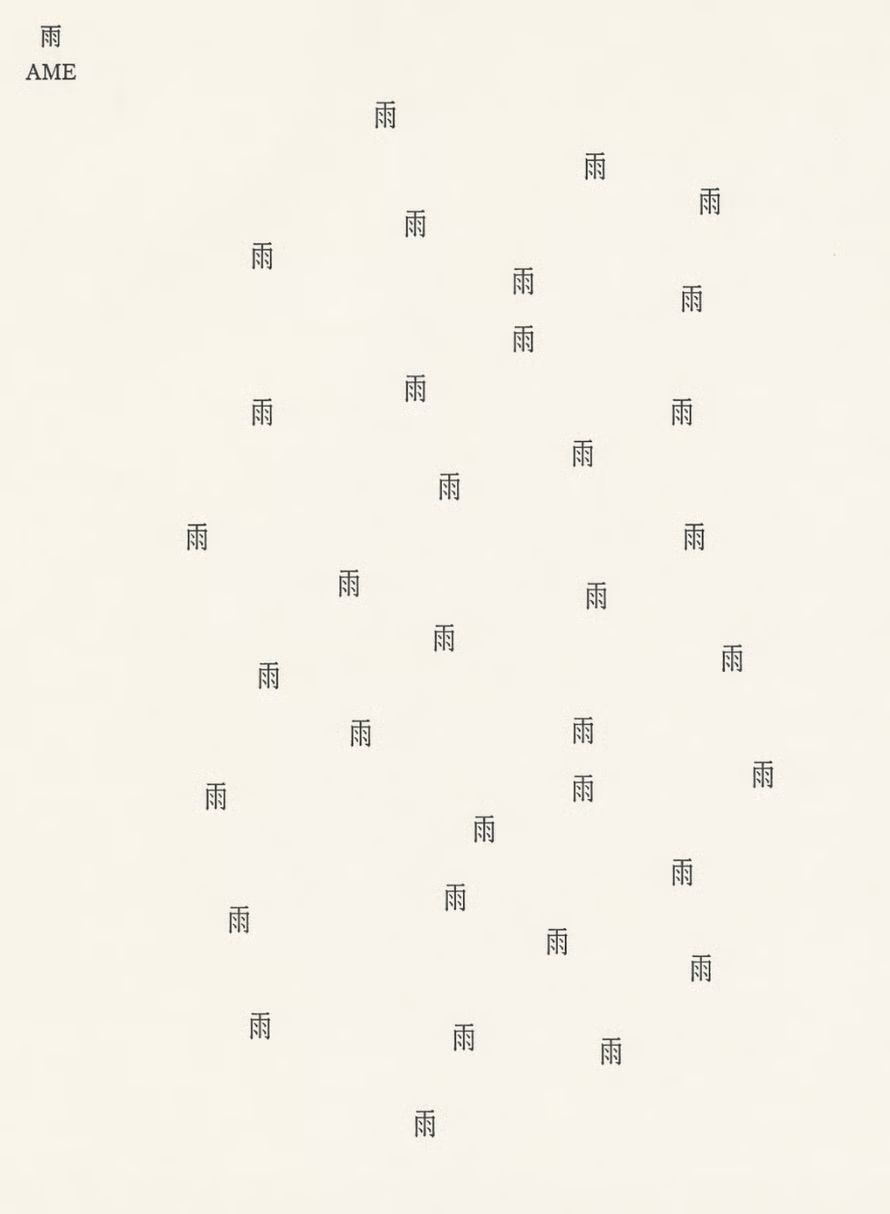

Für den nächsten Test wollten wir sehen, ob es die Konkrete Poesie von Niikuni Seiichi nachbilden kann.

Dieses berühmte Gedicht zeigt das japanische Kanji für Regen, umgeben von Regen – für uns wirkt es wie Regen, der in Sprache eingefangen ist.

Hier ist unser Prompt:

Please recreate the concrete poetry of Niikuni Seiichi. I want to see "Ame" meaning Rain. But make it different using your creativity.Und hier ist die Ausgabe:

Das finden wir spannend. Es hat das Bild nicht exakt rekreiert, aber etwas Eigenes geschaffen, das neugierig macht. Im neuen Aufbau ist das Kanji für „Regen“ nicht umgeben von Regen, sondern es fällt als Regen herab. Die Komposition der Zeichen wirkt zufällig – wie Regentropfen –, setzt aber einen schönen Kontrast zum sehr geordneten Original.

Wie kann ich auf ChatGPT Images 2.0 zugreifen?

Der Zugang folgt demselben Muster wie beim vorherigen Release. Das im Dezember eingeführte dedizierte Kreativ‑Workspace bleibt – Canvas‑Editor, persistente Artefakte, Stil‑Presets – und darunter steckt nun ein deutlich leistungsfähigeres Modell.

- Web, Mobile‑App und Codex: ChatGPT Images 2.0 ist im Tab Images für Free‑, Plus‑ und Pro‑User verfügbar, mit Nutzungsgrenzen je nach Tarif. Business‑ und Enterprise‑Zugänge folgen in der Regel nach dem anfänglichen Rollout.

- API: Developer können das neue Modell über die OpenAI API und den Azure OpenAI Service nutzen – über die Endpunkte für Bildgenerierung und -bearbeitung. Wie bei 1.5 wird die Bildausgabe in Tokens bepreist, und Teil‑Regenerationen bei Bearbeitungen halten die Kosten niedriger als jedes Mal ein komplettes Bild neu zu erzeugen.

ChatGPT Images 2.0 vs. Nano Banana 2

Du fragst dich vielleicht, wie ChatGPT Images 2.0 im Vergleich zu Nano Banana 2 abschneidet. Beide Modelle sind neu, beide sind die Standard‑Experience in ihrem jeweiligen Ökosystem und beide werden mit Tempo, Reasoning und Realwelt‑Intelligenz beworben.

|

ChatGPT Images 2.0 |

Nano Banana 2 |

|

|

Zugrunde liegende Architektur |

GPT‑Image‑2 (Nachfolger von GPT‑Image‑1.5) |

Gemini 3.1 Flash |

|

Bearbeitungsmodell |

Präzision: Bereichsauswahl & In‑Place‑Editing |

Reasoning: Konversation & Smart Masking |

|

Workflow |

Dedizierter Kreativ‑Workspace (Images‑Tab) |

In Gemini Chat integriert |

|

Iteration |

Effizient: Teil‑Regeneration |

Schnell: 4–6 s bei 1K, steuerbar über Thinking Mode |

|

Realwelt‑Verankerung |

Eingebautes Reasoning und aktuelles Wissen |

Image Search Grounding (zieht Live‑Referenzen aus der Google‑Suche) |

|

Mehrfeld‑Konsistenz |

Stark über Sequenzen und Charakterbögen hinweg |

Stark, mit Fokus auf Motiv‑Konsistenz |

|

Mehrsprachiger Text |

Großes Upgrade gegenüber 1.5; breite Skript‑Unterstützung |

Stark, besonders in Chinesisch und ostasiatischen Layouts |

|

Standardauflösung |

Standard + flexible Seitenverhältnisse |

2K Standard in der Gemini‑App |

|

Ökosystem |

OpenAI & Azure |

Google‑/Gemini‑Stack, Search, Lens |

Wann ChatGPT Images 2.0 vs. Nano Banana 2 nutzen?

Nutze ChatGPT Images 2.0, wenn …

- du eine referenzbasierte Bearbeitungsschleife brauchst. Das Modell akzeptiert ein Referenzbild und wendet gezielte Änderungen an (Texturdetails, Positionskorrekturen, Seitenverhältnis‑Fixes) über mehrere Runden, wobei einfache Folgeanweisungen den Output zuverlässig steuern, ohne neu beginnen zu müssen – das spart auch Tokens.

- du grobe Inputs in fertige Assets verwandelst. Der Thinking Mode löst vage Skizzen und räumliche Anweisungen in präzise, fotorealistische Kompositionen auf – mit Elementen genau dort, wo sie hingehören.

- faktische Korrektheit im Bild kritisch ist. Web‑Search‑Grounding zieht Live‑Informationen und stellt sie korrekt im Bild dar – ideal für Event‑Poster, News‑Infografiken oder alle Visuals, bei denen Zahlen und Namen stimmen müssen. Denk dran: Thinking Mode aktivieren, um die Websuche zu nutzen.

Nutze Nano Banana 2, wenn …

- du spezifische reale Motive oder Orte in eine Szene setzen willst. Image Search Grounding zieht visuelle Live‑Referenzen aus Google, rekonstruiert Orte akkurat (sogar über GPS‑Koordinaten) und kombiniert sie mit motivkonsistenten Figuren in einer einzigen Generierung.

- du Identität über mehrere Figuren und Objekte in einem Workflow halten musst. Das Modell unterstützt explizit bis zu fünf Figuren und vierzehn Referenzen (Figuren + Objekte) mit strenger Konsistenz. Stark für Storyboards, Produktshots oder Erzählungen mit mehreren Charakteren.

- du im Google‑Ökosystem arbeitest. Nano Banana ist nativ in Gemini Chat, Google Search, Google Ads, Firebase und Vertex AI integriert.

Bei In‑Image‑Textdarstellung, stilistischer Bandbreite und konversationeller Bearbeitung sind beide solide Optionen.

Fazit

Das Framing als „visueller Denkpartner“ hält – aber nur mit aktiviertem Thinking Mode. Ohne tut sich das Modell mit räumlicher Logik und Fotorealismus schwer; mit ihm werden aus mehrdeutigen Inputs Ergebnisse, die sich eher kollaborativ als mechanisch anfühlen. Zwei Bereiche, in denen das Modell auch ohne Thinking Mode glänzt, sind stilistische Authentizität und flexible Seitenverhältnisse.

Web‑Search‑Grounding fühlt sich wie das größte Upgrade gegenüber Images 1.5 an. Im Boston‑Marathon‑Test war der Unterschied klar: 2.0 lag bei allen Fakten richtig, 1.5 war nicht auf dem aktuellen Stand. Wichtig: Die Websuche funktioniert ebenfalls nur im Thinking Mode.

Interessant war auch: Die Copyright‑Leitplanken sind enger – und das merkt man. Wenn du den Stil eines bestimmten Unternehmens oder einer Person nachbilden willst, musst du den Stil auf seinen Kern herunterbrechen und beschreiben (was heute zugegebenermaßen leicht fällt).

Unterm Strich ist das Modell ein deutliches Upgrade gegenüber seinem Vorgänger und fordert Nano Banana 2s Status als Top‑Tool für KI‑Bildgenerierung und -bearbeitung heraus.

Um solche Tools optimal zu nutzen, ist gutes Prompting eine Schlüsselkompetenz. Wir empfehlen dir sehr, unsere Kurse Understanding Prompt Engineering und Prompt Engineering with the OpenAI API – sie bieten dir theoretisches Fundament und praktische Anwendung.

Datenwissenschaftsredakteur bei DataCamp | Prognosen erstellen und mit APIs arbeiten ist genau mein Ding.