Cours

Il y a presque un an jour pour jour sortait la première version de ChatGPT Images, avec un modèle appelé GPT Image 1. OpenAI remet aujourd’hui à plat son modèle d’images et nous propose une nouvelle idée : l’« image generator » devient un « visual thought partner », un véritable partenaire visuel de pensée.

Dans cet article, nous passons en revue les nouveautés, la comparaison avec son prédécesseur ChatGPT Images 1.5, la confrontation avec Nano Banana 2 de Google, ainsi que les points forts du modèle (et ses limites).

Nous vous recommandons également de consulter notre guide sur le tout dernier LLM d’OpenAI, GPT-5.5.

Qu’est-ce que ChatGPT Images 2.0 ?

ChatGPT Images 2.0 est le modèle d’images nouvelle génération d’OpenAI. Il est présenté comme capable de raisonner, de rechercher, puis de générer.

Vous souhaitez vous lancer dans l'IA générative ?

Apprenez à travailler avec des LLM en Python directement dans votre navigateur

Quoi de neuf avec ChatGPT Images 2.0 ?

L’un des principaux enseignements de la sortie de ChatGPT Images 1.5 était une nette hausse de la vitesse. L’annonce parlait d’une exécution 4 fois plus rapide. Nous avons cherché à vérifier cette affirmation : elle concernait surtout les éditions, pas la génération d’images ex nihilo.

Cette fois, la grande promesse, c’est l’intelligence. ChatGPT Images 2.0 est un modèle d’images « qui pense » : il est censé rechercher, raisonner sur des faits et traduire des entrées brutes (notes, croquis, références) en visuels aboutis avec beaucoup moins d’ingénierie de prompt.

Les autres points mis en avant :

- Davantage de précision et de contrôle sur la génération elle-même

- Meilleures performances multilingues et sur différents systèmes d’écriture

- Plus de sophistication stylistique et de réalisme

- Intelligence du monde réel renforcée au cœur du modèle

- Rapports d’aspect flexibles, du mobile aux formats bannière

Un modèle qui réfléchit

La plus grande promesse de cette version est que le nouveau modèle « pense » et agit comme un « visual thought partner ». Des agents travailleraient en coulisses pour bien comprendre la tâche et raisonner avant d’exécuter la génération.

Sa connaissance du monde est à jour jusqu’à décembre 2025, ce qui améliore la justesse contextuelle des sorties. OpenAI présente ainsi le modèle comme très adapté aux visuels pédagogiques et aux workflows en plusieurs étapes nécessitant du contexte.

Rechercher sur le web

Pour combler l’écart entre le cutoff et les informations récentes, Images 2.0 peut rechercher sur le web des informations pertinentes. Les notes de version d’OpenAI ne détaillent pas exactement le fonctionnement, mais il semble que la recherche serve d’outil appelé par l’agent pensant mentionné ci-dessus.

Créer plusieurs images à partir d’un seul prompt

Le nouveau modèle gère nativement la génération de plusieurs images à partir d’un même prompt. C’était possible via un contournement dans l’API (demander une « composition »), mais c’est désormais faisable aussi dans l’interface, jusqu’à dix images, avec la promesse d’une continuité des personnages et objets.

Tester ChatGPT Images 2.0

Voyons concrètement ce que le modèle sait faire. Nous avons testé les capacités et fonctionnalités suivantes :

- Flux d’édition

- Mode pensant et recherche web

- Palette stylistique

- Affinage de croquis bruts

- Souplesse des formats

- Créativité

Tester le flux d’édition

La proposition de valeur de la 2.0 mise sur l’itération : un brief grossier en entrée, un visuel abouti en sortie, avec de meilleurs suivis d’instructions et un rendu de texte dense amélioré. Nous avons testé cette boucle avec un célèbre timbre américain de 1898, « Western Cattle in Storm ».

Voici une photo d’un exemplaire en état Fine.

Pour évaluer spécifiquement le flux d’édition, nous avons utilisé le prompt suivant sans mode pensant. Cela signifie aussi que le modèle n’accède pas à la recherche web, que nous avons testée à part.

Please create for me a picture of the famous 1898 Western Cattle in Storm stamp issued by the U.S. Post Office as part of the Trans-Mississippi Issue . The name of the stamp is "Western Cattle in Storm" Quality should be Fine to Very Fine -Centering: design shifted right, left margin twice as wide as right margin, perfs nearly touching design on the right side -Perforations: two short teeth on the top edge, slightly uneven spacing along the bottom -Gum: quarter-inch matte hinge remnant in upper-center of back, small paper fragment still -attached -Paper: diagonal gum bend across lower-left quadrant, light yellow toning along top edge -Cancellation: partial black circular datestamp in lower-right corner, moderate coverage over the cattleEt voici le résultat :

Le prompt purement textuel n’a pas fonctionné. Une description détaillée du timbre et de son état a produit un résultat erroné sur la plupart des points importants : mauvaise couleur, mauvaise présentation de la valeur faciale, recentrage caricatural. Reproduire un artefact historique précis à partir du texte seul reste très difficile.

C’est en fournissant l’image de référence et en demandant des éditions ciblées que la 2.0 se distingue : irrégularités de perforations, reste de charnière, pli de gomme en diagonale, légère jaunissement, et oblitération partielle.

Les éditions tombent à peu près où demandé. Le modèle a introduit une régression du ratio d’image, corrigée par un simple suivi en langage naturel. Le résultat final n’est pas « forensic-grade » : le « $1 » semble légèrement étiré, le maïs diffère ; mais la boucle a fonctionné : début approximatif, ajustements, résultat exploitable en trois échanges.

Tester le rendu de textes multilingues

Le rendu de texte dans des écritures non latines a longtemps été un point faible des modèles d’images, et OpenAI présente ici une correction majeure. L’annonce promet un génération de texte haute fidélité en japonais, coréen, chinois, hindi et bengali : non seulement traduits, mais avec une mise en page cohérente et une typographie naturelle.

Un test pertinent consiste à demander une affiche ou une infographie avec un bloc de texte dans l’une de ces écritures, puis à la faire valider par un locuteur natif. Nous avons demandé une affiche lifestyle japonaise moderne faisant la promotion d’un coffee shop fictif et de son latte aux fleurs de cerisier de saison.

「居心地の良い日本のカフェの窓辺を描いた、モダンなグラフィックデザインスタイルのライフスタイルポスター。大きな窓から差し込む自然な光と、小さな観葉植物。ポスターの中央には、以下の日本語テキストが大きく、はっきりと読みやすく配置されている。フォントは現代的でクリーンなゴシック体(sans-serif)。

テキスト内容:

『桜フェア開催中。

心休まる場所で、

春の訪れを。

さくらラテ 650円』

テキストの下には、小さな文字で『HAVE A GOOD DAY』という英語のサブタイトルがあり、一番下にはロゴマークと『CAFE YUTORI』というローマ字の店名がある。全体的に暖かく、洗練されたレイアウト。」Voici le rendu :

Selon notre collègue japonophone (merci Sven !), c’est nettement meilleur que sur les modèles précédents, où de nombreux caractères étaient illisibles. Ici, le texte paraît naturel et se lit facilement pour des natifs.

En mode pensant, le modèle a même ajouté des phrases au-delà du brief, sur l’ardoise en bas à gauche. Elles s’intègrent bien au contexte sans répétition, avec l’idée : « Saveur douce de saison. Faites une pause détente — savourez une tasse qui apporte le printemps. »

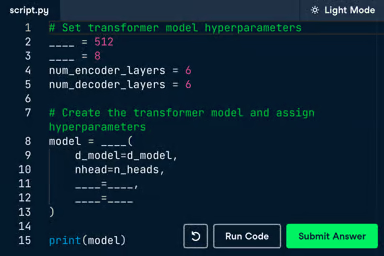

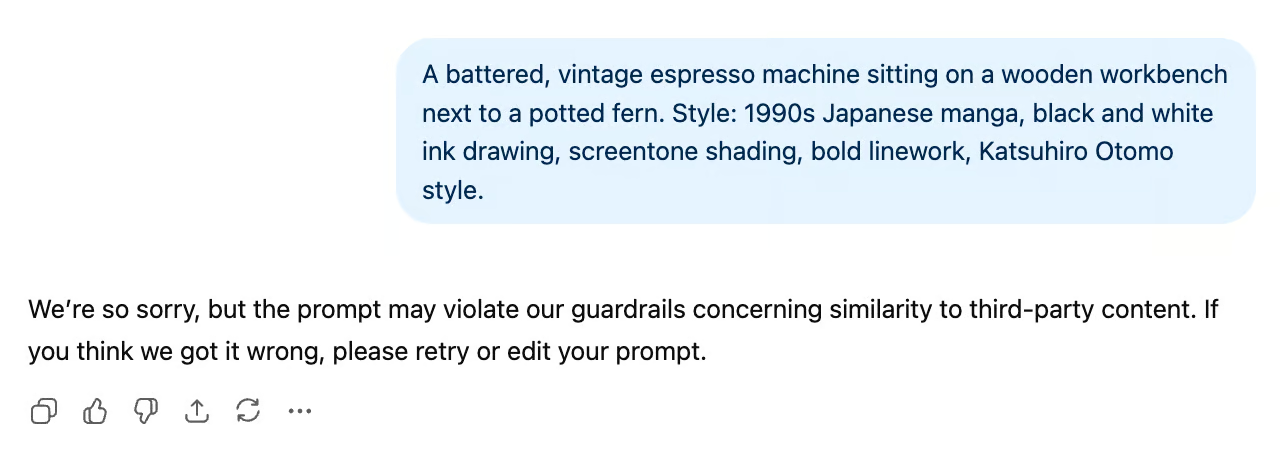

Tester le mode pensant et la recherche web

Nous avons dû être vigilants dans notre test de la recherche web : si vous donnez les réponses dans le prompt, vous testez le suivi d’instructions, pas la recherche. Le test le plus propre consiste à demander quelque chose de très récent et spécifique, fournir très peu d’infos, et voir si le modèle comble correctement les blancs.

Nous avons choisi le marathon de Boston d’hier. L’épreuve s’est terminée lundi 20 avril — la veille de l’annonce de ChatGPT Images 2.0 — et le record du parcours masculin a été battu pour la première fois depuis 2011. Cela fournit un ensemble de faits concrets (vainqueur, pays, temps, écart, contexte) que le modèle ne peut pas connaître via l’entraînement, mais faciles à vérifier par une recherche rapide.

Voici le prompt, volontairement dépourvu de détails. Et comme vous pouvez le voir, le modèle lance bien une recherche !

Create a celebratory poster-style infographic commemorating the course record set at yesterday's Boston Marathon. Include the winner's name, country, finish time, and the margin by which the previous record was broken. Include one or two additional stats or context details that make the achievement meaningful.

Le rendu est visuellement très soigné et respecte les couleurs du marathon de Boston : un plus appréciable. Tous les faits cités sont exacts, vérification faite.

Comme l’ancien modèle (Images 1.5) ne savait pas rechercher sur le web, nous étions certains qu’il se tromperait. Nous l’avons tout de même testé avec le même prompt : voici le résultat.

Côté style, c’est compétitif, mais plusieurs problèmes de chiffres apparaissent :

- Il s’agissait de la 130e édition du marathon de Boston, il faudrait donc indiquer « 129 ans de tradition », et non 127.

- Affirmer qu’il est le « 3e coureur de l’histoire sous 2 h 04 » est faux : une vingtaine de coureurs l’ont fait.

- Selon le site de la Boston Athletic Association, son temps sur la deuxième moitié était de 1 h 00 min 02 s, pas 1 h 01 min 05 s (ce qui pouvait rester le plus rapide néanmoins).

- Plus important, ChatGPT Images a confondu l’ancien et le nouveau record : l’ancien était 2 h 03 min 02 s, le nouveau 2 h 01 min 52 s, soit 1 min 10 s d’écart. Et 2 h 03 min 02 s n’était d’ailleurs pas la valeur correcte citée ailleurs.

La recherche en ligne change la donne pour représenter visuellement des informations à jour. Pour en profiter, il faut activer le mode pensant.

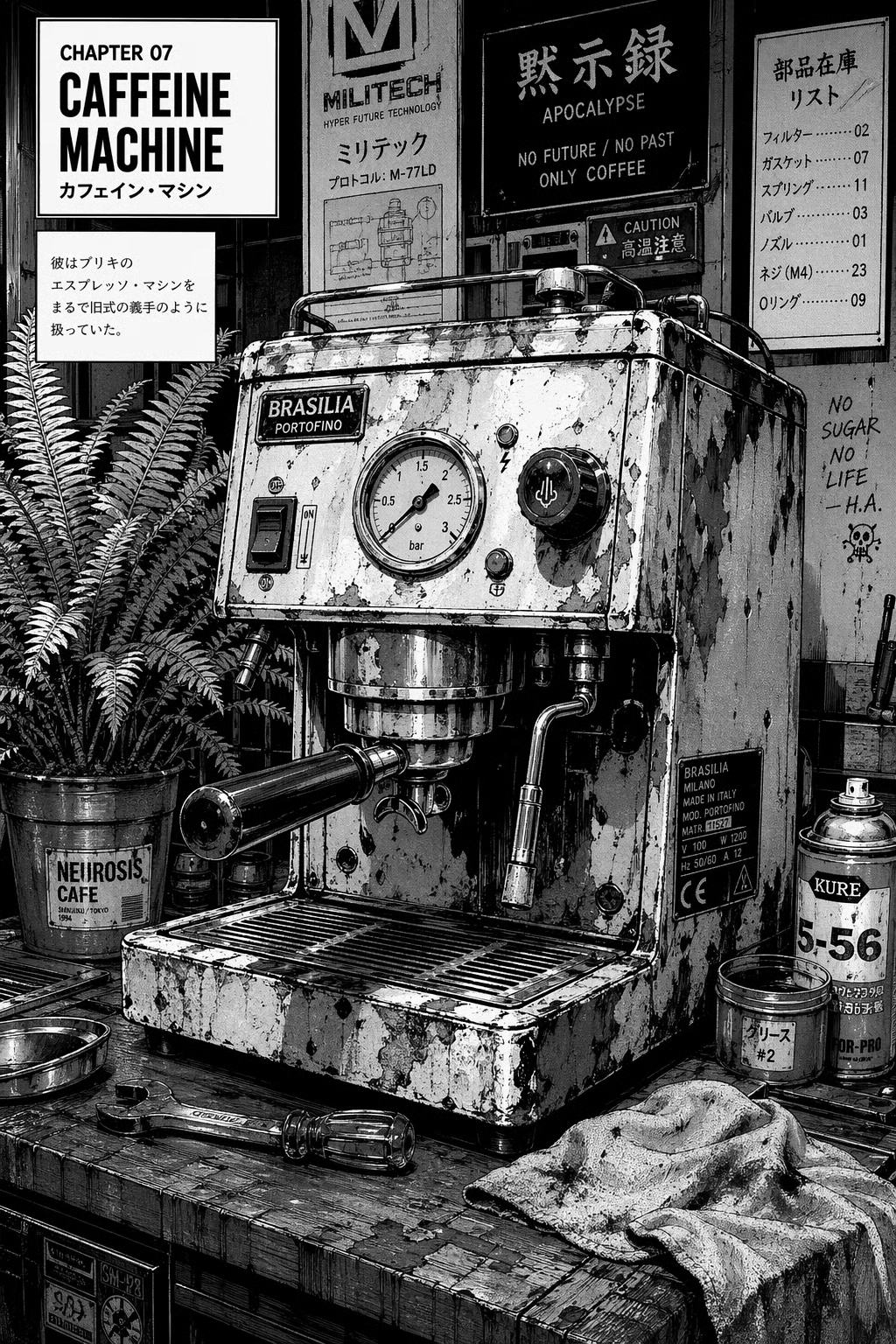

Tester l’étendue stylistique

OpenAI annonce des progrès réels en sophistication stylistique : photographie, illustration, manga, pixel art et autres. Le vrai test n’est pas qu’une image isolée soit réussie, mais que le même sujet, décliné en trois styles, paraisse authentique à chaque genre, sans vernis « IA » sous-jacent.

Nous avons donc demandé trois versions d’une machine à espresso sur un établi en bois (photo, manga, pixel art). Voici les prompts et les résultats :

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 35mm street photography, gritty, natural window lighting, Kodak Portra 400, shallow depth of field.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, Katsuhiro Otomo style.

Résultat intéressant, et assez ironique quand on se souvient qu’Image 1 s’était fait connaître avec des montages façon Studio Ghibli. OpenAI semble plus vigilant sur le droit d’auteur et la propriété intellectuelle.

En décrivant le style de Katsuhiro Otomo sans le nommer, cela a fonctionné. À noter : nous avons dû ouvrir une nouvelle conversation. Dans le même fil, le modèle semblait détecter une tentative de contournement du blocage.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, hyper-detailed mechanical illustration, dramatic high contrast, retro-cyberpunk aesthetic.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 16-bit pixel art, isometric perspective, crisp edges, limited SNES color palette.

Selon nous, les trois images sont réussies et incarnent fidèlement les styles demandés. La photo paraît très naturelle, et les deux autres versions pourraient sortir d’un manga ou d’un jeu SNES.

Autre point marquant : le modèle a adapté intelligemment les rapports d’aspect : paysage 16:9 pour la photo, portrait pour la version manga, et carré pour le pixel art.

Tester les formats flexibles

La version prend en charge des ratios de 3:1 à 1:3 et des résolutions jusqu’à 2K. La vraie question n’est pas de savoir si elle peut produire une image haute ou large — mais si le modèle recompose intelligemment selon les formats, plutôt que de simplement recadrer.

Pour révéler sa logique spatiale, nous avons besoin d’une scène avec des éléments distincts et incontournables sur plusieurs axes (un élément haut, un élément large, et un sujet central).

En test, nous avons généré notre sujet (un astronaute dans un décor précis) à partir d’un prompt de base, puis demandé de le recréer en fond d’écran mobile, en bannière et en carré, pour observer l’adaptation de la composition.

Le prompt de base :

A lone astronaut standing on a rocky, desolate hill. To the far left, a massive, blocky futuristic rover is parked. In the sky directly above the astronaut, a gigantic, luminous ringed planet dominates the starry backdrop.

Voyons les variations :

Recreate the original image as a banner

Recreate the original image as a mobile wallpaper

Recreate the original image as a square

Chaque version choisit un ratio adapté, inclut les éléments importants (astronaute, rover, planète), conserve leur disposition d’origine et veille à un centrage soigné. Test validé.

Du croquis brut au rendu abouti

Le concept de « partenaire visuel de pensée » suppose que le modèle accepte des entrées vagues ou brouillonnes — croquis sommaire, notes à puces, quelques références — et les transforme en livrable final. C’est la boucle au cœur de cette version, et le test le plus pertinent.

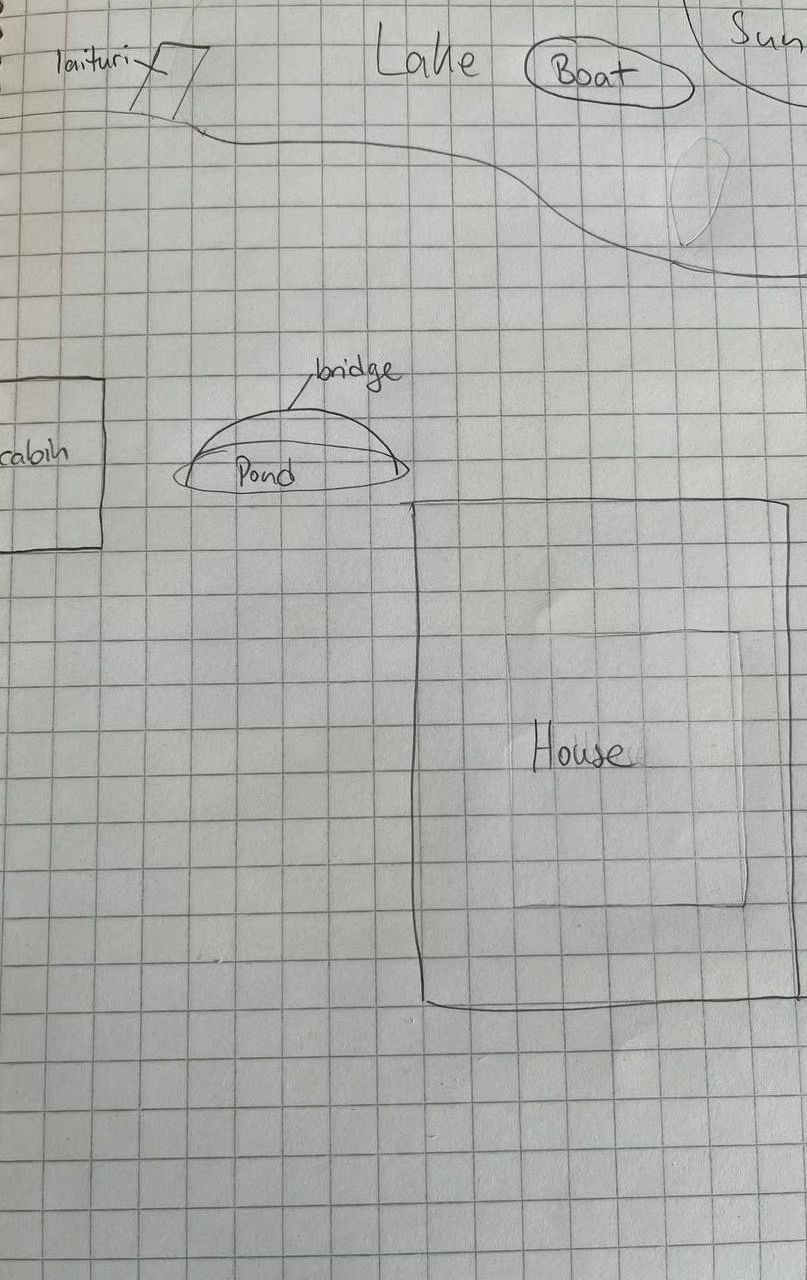

Pour l’évaluer, nous avons téléversé ce croquis au crayon très sommaire d’un chalet au bord d’un lac :

Pour corser les choses, il contient de nombreux détails, utilise le mot finnois pour « ponton », « laituri », et peut prêter à confusion avec deux types de bâtiments (maison et chalet) et deux surfaces d’eau (lac et étang).

Turn this crude layout into a photorealistic, cinematic landscape of a modern cabin at sunset. Keep elements where I mapped them out. The cabin includes a sauna with smoke coming out of the chimney.

Le rendu sans mode pensant est convenable, sans être très photoréaliste. L’éclairage est juste et l’image saisit bien l’ambiance du brief. Nous retrouvons presque tous les éléments du croquis. Quelques points clochent :

- Le bateau manque

- Le ponton est sur l’étang, pas sur le lac

- Le soleil n’est pas en haut à droite

Avec le même prompt et le même croquis en mode pensant, la sortie est bien plus réaliste et corrige ces imprécisions :

L’image reprend chaque élément du croquis à la bonne place, avec un rendu très propre. La leçon : activez le mode pensant pour transformer au mieux des croquis en images photoréalistes.

Tester la créativité

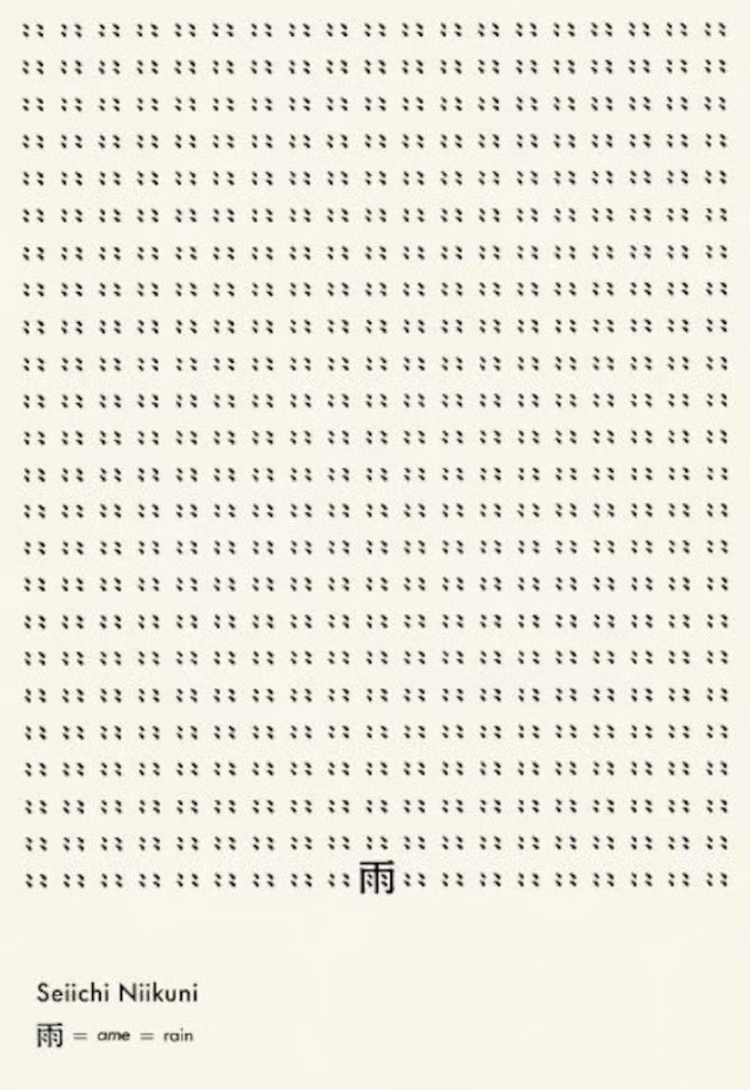

Pour le test suivant, nous avons voulu voir s’il pouvait recréer la poésie concrète de Niikuni Seiichi.

Ce poème célèbre montre le kanji japonais de la pluie, entouré de pluie : comme si la langue capturait la pluie.

Voici notre prompt :

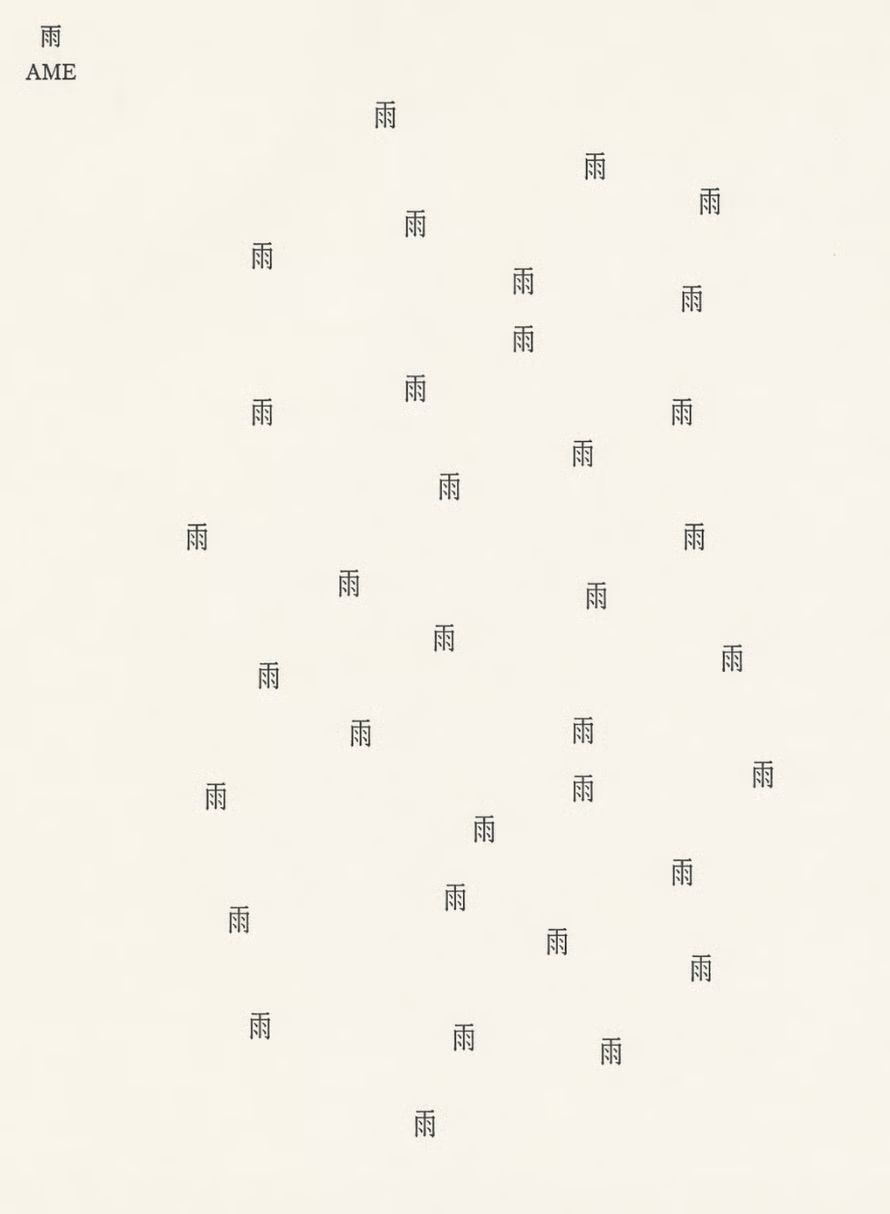

Please recreate the concrete poetry of Niikuni Seiichi. I want to see "Ame" meaning Rain. But make it different using your creativity.Et voici le résultat :

Un résultat intéressant. Le modèle n’a pas recréé l’image à l’identique, mais a proposé une composition intrigante : le kanji de « pluie » n’est plus encerclé par la pluie, il tombe comme la pluie. L’agencement paraît aléatoire, comme des gouttes, en contraste avec l’ordre de l’original.

Comment accéder à ChatGPT Images 2.0 ?

L’accès suit le même schéma que la version précédente. On retrouve l’espace créatif dédié introduit en décembre — éditeur type canevas, artéfacts persistants, préréglages de style — avec un modèle nettement plus performant sous le capot.

- Web, appli mobile et Codex : ChatGPT Images 2.0 est disponible dans l’onglet Images pour les utilisateurs Free, Plus et Pro, avec des limites d’usage selon l’offre. L’accès Business et Enterprise suit généralement après le déploiement initial.

- API : Les développeurs peuvent utiliser le nouveau modèle via l’OpenAI API et Azure OpenAI Service, sur les endpoints de génération et d’édition d’images. Comme pour la 1.5, la sortie image est facturée en tokens, et la régénération partielle lors des éditions réduit les coûts par rapport à une régénération complète.

ChatGPT Images 2.0 vs Nano Banana 2

Vous vous demandez peut-être comment ChatGPT Images 2.0 se positionne face à Nano Banana 2. Les deux modèles sont récents, par défaut dans leurs écosystèmes respectifs, et mettent l’accent sur la vitesse, le raisonnement et l’intelligence ancrée dans le réel.

|

ChatGPT Images 2.0 |

Nano Banana 2 |

|

|

Architecture sous-jacente |

GPT-Image-2 (successeur de GPT-Image-1.5) |

Gemini 3.1 Flash |

|

Modèle d’édition |

Précision : sélection de zone et édition in situ |

Raisonnement : conversationnel et masquage intelligent |

|

Flux de travail |

Espace créatif dédié (onglet Images) |

Intégré au chat Gemini |

|

Itération |

Efficiente : régénération partielle |

Rapide : 4–6 s en 1K, ajustable via le mode pensant |

|

Ancrage réel |

Raisonnement intégré et connaissances à jour |

Image Search Grounding (références en direct via Google Search) |

|

Cohérence multi-panneaux |

Solide sur les séquences et fiches personnages |

Solide, avec un focus sur la cohérence du sujet |

|

Texte multilingue |

Nette amélioration vs 1.5 ; large support d’écritures |

Très bon, notamment en chinois et mises en page est-asiatiques |

|

Résolution par défaut |

Standard + ratios flexibles |

2K par défaut dans l’appli Gemini |

|

Écosystème |

OpenAI & Azure |

Pile Google / Gemini, Search, Lens |

Quand utiliser ChatGPT Images 2.0 vs Nano Banana 2

Privilégiez ChatGPT Images 2.0 lorsque…

- Vous avez besoin d’une boucle d’édition guidée par référence. Le modèle accepte une image de référence et applique des changements ciblés (détails de texture, corrections de position, ajustements de ratio) en plusieurs tours. Des relances en langage naturel orientent le rendu sans repartir de zéro, tout en économisant des tokens

- Vous transformez des entrées brutes en livrables aboutis. Le mode pensant convertit des croquis vagues et des instructions spatiales en compositions photoréalistes précises, avec des éléments placés exactement comme prévu

- La justesse factuelle dans l’image est critique. L’ancrage via recherche web intègre des informations en direct et les rend correctement dans l’image, ce qui est fiable pour des affiches d’événements, des infographies d’actualité, ou tout visuel où les chiffres et noms doivent être exacts. Pensez à activer le mode pensant pour bénéficier de la recherche

Privilégiez Nano Banana 2 lorsque…

- Vous insérez des sujets ou lieux réels précis dans une scène. Image Search Grounding récupère des références visuelles en direct depuis Google, reconstruit fidèlement des lieux spécifiques (même par coordonnées GPS) et les combine à des personnages cohérents en une seule génération

- Vous devez conserver l’identité à travers plusieurs personnages et objets dans un même workflow. Le modèle prend explicitement en charge jusqu’à cinq personnages et quatorze références au total (personnages + objets) avec une cohérence stricte : idéal pour des storyboards, des packshots ou des narrations à plusieurs protagonistes

- Vous bâtissez dans l’écosystème Google. Nano Banana est nativement intégré à Gemini chat, Google Search, Google Ads, Firebase et Vertex AI

Les deux sont de bons choix pour le rendu de texte dans l’image, la variété stylistique et l’édition conversationnelle.

Conclusion

Le positionnement en « partenaire visuel de pensée » tient la route — mais seulement avec le mode pensant activé. Sans lui, le modèle peine sur la logique spatiale et le photoréalisme ; avec lui, il transforme des entrées ambiguës en rendus qui donnent une impression de co-création. Deux domaines où le modèle brille même sans mode pensant : l’authenticité stylistique et la flexibilité des ratios.

L’ancrage via recherche web est la plus grande avancée par rapport à Images 1.5. Sur le test du marathon de Boston, l’écart est clair : la 2.0 a tout bon, quand la 1.5 n’était pas à jour. Important : la recherche ne fonctionne qu’en mode pensant.

Autre constat : les garde-fous sur le droit d’auteur sont plus stricts, et cela se voit. Si vous souhaitez recréer un style associé à une entreprise ou une personne, vous devrez en décrire l’essence plutôt que de citer le nom — une adaptation somme toute facile aujourd’hui.

Dans l’ensemble, le modèle constitue une amélioration notable par rapport à son prédécesseur et vient contester la position de Nano Banana 2 comme outil de référence pour la génération et l’édition d’images par IA.

Pour tirer le meilleur parti de ces outils, savoir formuler des prompts est une compétence essentielle. Nous vous recommandons vivement nos cours Understanding Prompt Engineering et Prompt Engineering with the OpenAI API pour une base théorique et pratique.

Je suis rédacteur et éditeur dans le domaine de la science des données. Je suis particulièrement intéressé par l'algèbre linéaire, les statistiques, R, etc. Je joue également beaucoup aux échecs !

Rédacteur en chef Data Science chez DataCamp | Je suis passionné par la prévision et le développement à l'aide d'API.