course

Det har gått nästan exakt ett år på dagen sedan den första ChatGPT Images släpptes med en modell som kallades GPT Image 1. OpenAI har nu återigen gjort om sin bildmodell, och företaget lanserar nu idén att "bildgeneratorn" har blivit en "visuell tankepartner".

I den här artikeln går vi igenom vad som är nytt, hur den står sig mot sin föregångare ChatGPT Images 1.5, hur den jämför sig med Googles Nano Banana 2, och var modellen glänser (och var den inte gör det).

Vi rekommenderar även vår guide till OpenAIs senaste LLM, GPT-5.5.

Vad är ChatGPT Images 2.0?

ChatGPT Images 2.0 är OpenAIs nästa generations bildmodell. Den lanseras som något som kan resonera, söka information och sedan rendera.

Vad är nytt i ChatGPT Images 2.0?

En av de största lärdomarna från lanseringen av ChatGPT Images 1.5 var en stor ökning i prestandahastighet. Vid lanseringen uppgavs att den var 4x snabbare. Vi försökte verifiera det påståendet men såg att det gällde redigeringar, inte generering av nya bilder.

Den här gången är det stora löftet intelligens. ChatGPT Images 2.0 är en "tänkande" bildmodell: den ska kunna söka, resonera om fakta och översätta grova indata (anteckningar, skisser, referenser) till färdiga visuella resultat med betydligt mindre manuell uppmaning.

Andra huvudteman i tillkännagivandet är:

- Större precision och kontroll över själva genereringen

- Starkare prestanda över språk och skriftsystem

- Mer stilistisk finess och realism

- Förstärkt verklighetsintelligens inbyggd i modellen

- Flexibla bildförhållanden för allt från mobil till bannerformat

En modell som tänker

Ett av de största anspråken i lanseringen är att den nya modellen "tänker" och agerar som en "visuell tankepartner". Tanken är att agenter gör ett arbete i bakgrunden för att verkligen förstå uppgiften och resonera om den innan de utför genereringsbegäran.

Dess förståelse av världen har uppdaterats till ett kunskapsstopp i december 2025, så utdata blir mer kontextuellt korrekta. Det gör, enligt uppgift, den nya modellen utmärkt för pedagogiska grafik och flerstegade arbetsflöden som kräver sammanhang.

Sök på webben

För att överbrygga gapet mellan kunskapsstoppet och färsk, uppdaterad information kan Images 2.0 söka på webben för att hitta relevant information. Det framgår inte tydligt av OpenAIs versionsanteckningar exakt hur det fungerar, men såvitt vi förstår fungerar webbsökningen som ett verktyg som anropas av den tänkande agenten ovan.

Skapa flera bilder från en prompt

Den nya modellen stöder även inbyggt att generera flera bilder från samma prompt. Detta var möjligt med en omväg i API:et (att be om en "komposition"), men kan nu också göras i gränssnittet, upp till tio bilder. OpenAI utlovar kontinuitet i karaktärer och objekt i alla dessa utdata.

Test av ChatGPT Images 2.0

Dags att se vad den nya modellen faktiskt kan! Vi testade följande förmågor och funktioner i Images 2.0:

- Redigeringsarbetsflöde

- Tänkeläge och webbsökning

- Stilistiskt omfång

- Förfining av grova skisser

- Flexibilitet i bildförhållande

- Kreativitet

Test av redigeringsarbetsflödet

OpenAIs pitch för 2.0 lutar mot iteration: grovt in, polerat ut, med bättre följsamhet till instruktioner och tätare textrendering. Vi testade den loopen med ett känt amerikanskt frimärke från 1898 som kallas Western Cattle in Storm.

Här är en bild av ett av frimärkena i betyget Fine.

För att specifikt testa redigeringsarbetsflödet använde vi följande prompt utan tänkeläge. Det betyder också att modellen inte har tillgång till webbsökning, vilket vi testade separat.

Please create for me a picture of the famous 1898 Western Cattle in Storm stamp issued by the U.S. Post Office as part of the Trans-Mississippi Issue . The name of the stamp is "Western Cattle in Storm" Quality should be Fine to Very Fine -Centering: design shifted right, left margin twice as wide as right margin, perfs nearly touching design on the right side -Perforations: two short teeth on the top edge, slightly uneven spacing along the bottom -Gum: quarter-inch matte hinge remnant in upper-center of back, small paper fragment still -attached -Paper: diagonal gum bend across lower-left quadrant, light yellow toning along top edge -Cancellation: partial black circular datestamp in lower-right corner, moderate coverage over the cattleOch här är resultatet:

Promptning med enbart text fungerade inte. En detaljerad beskrivning av frimärket och dess kvalitetsklass blev fel på de flesta viktiga sätt — fel färg, fel valörlayout, tecknad felcentrering. Att återskapa en specifik historisk artefakt enbart från text är en svår begäran.

Att ge modellen referensbilden och be om riktade ändringar är där 2.0 visade sitt värde: ojämnheter i perforering, ett gångjärnsrester, en diagonal gumböj, lätt toning och en partiell makulering.

Redigeringarna hamnade ungefär där vi bad. Modellen introducerade en försämring i bildförhållandet, men en enkel uppföljning med klarspråk fixade det. Slutresultatet är inte forensiskt perfekt — "$1" ser något utdraget ut, majsen ser annorlunda ut — men loopen fungerade: skakig start, korrigerad kurs, användbart resultat på tre vändor.

Test av flerspråkig textrendering

Textrendering i icke-latinska skriftsystem har varit en ihållande svag punkt i bildmodeller, och OpenAI lyfter fram detta som en huvudfix. I lanseringen anges högfidel texter i japanska, koreanska, kinesiska, hindi och bengali — inte bara översatta, utan återgivna med sammanhängande layout och typografi som känns inhemsk.

Ett rättvist test här är att be om en affisch eller infographic med ett textblock på något av dessa skriftsystem och låta en infödd talare kontrollera utfallet. Vi bad modellen skapa en modern japansk livsstilsaffisch som gör reklam för ett fiktivt lokalt kafé och deras säsongsbetonade körsbärsblomslatte.

「居心地の良い日本のカフェの窓辺を描いた、モダンなグラフィックデザインスタイルのライフスタイルポスター。大きな窓から差し込む自然な光と、小さな観葉植物。ポスターの中央には、以下の日本語テキストが大きく、はっきりと読みやすく配置されている。フォントは現代的でクリーンなゴシック体(sans-serif)。

テキスト内容:

『桜フェア開催中。

心休まる場所で、

春の訪れを。

さくらラテ 650円』

テキストの下には、小さな文字で『HAVE A GOOD DAY』という英語のサブタイトルがあり、一番下にはロゴマークと『CAFE YUTORI』というローマ字の店名がある。全体的に暖かく、洗練されたレイアウト。」Så här ser resultatet ut:

Enligt vår kollega som talar japanska (tack Sven!) ser det här mycket bättre ut än i tidigare modeller, där många tecken blev obegripligt skräp. Den här känns mer naturlig och kan lätt läsas av infödda talare.

I tänkeläge lade den till och med till fler meningar utöver promptinstruktionerna på den lilla griffeltavlan i nedre vänstra hörnet. De passar väl in i sammanhanget utan att bli repetitiva och kan översättas ungefär till: ”Säsongsbetonad, mild smak. Ta en avkopplande paus — njut av en kopp som för med sig våren.”

Test av tänkeläge och webbsökning

Vi behövde vara lite försiktiga med hur vi testade webbsökningsförmågan, för om du talar om för modellen vad du vill ha i prompten testar du inte sökning, du testar instruktionsefterlevnad. Det renaste testet är att be om något väldigt nyligt och mycket specifikt, ge modellen nästan ingen information och se om den kan fylla i luckorna korrekt.

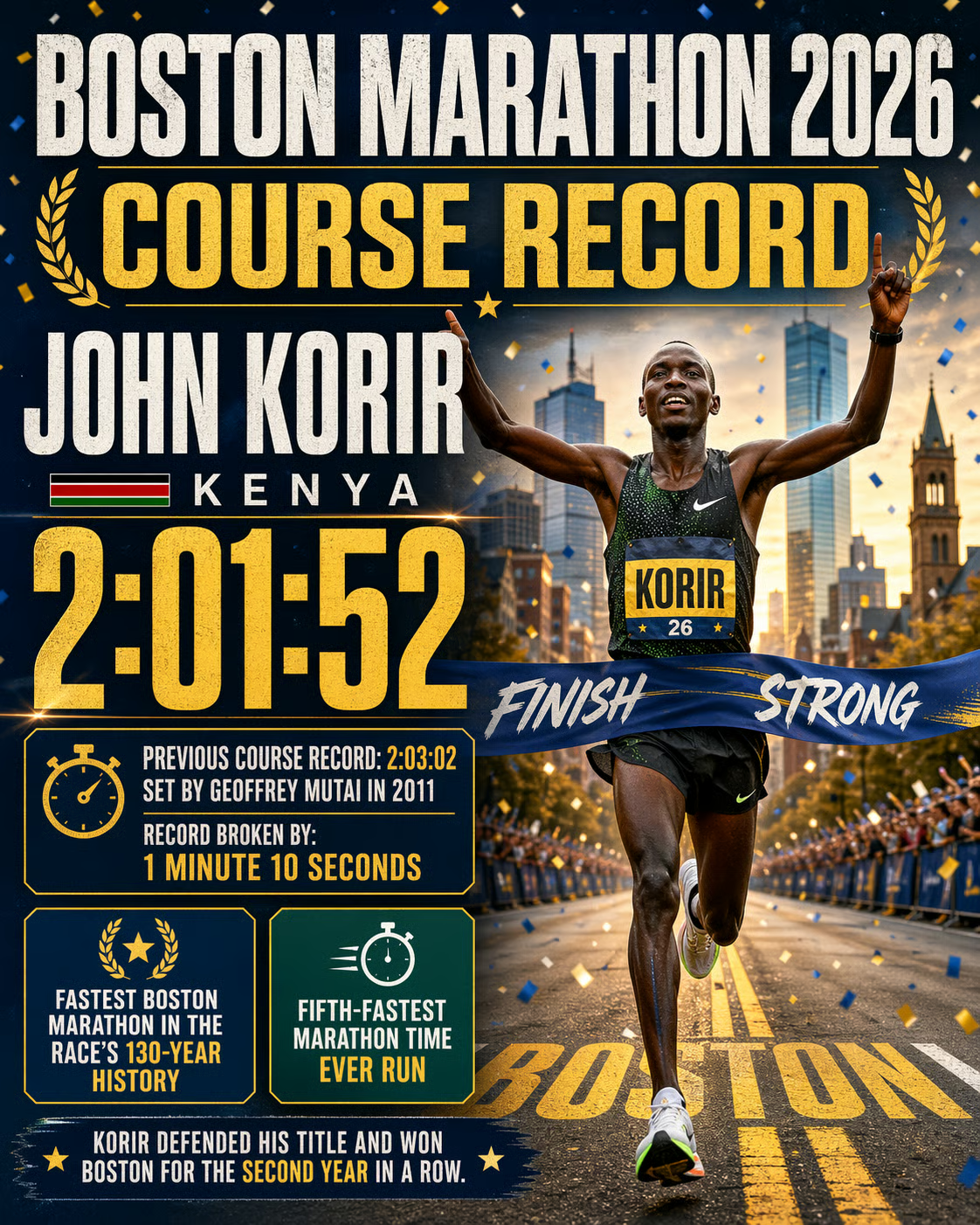

Vi valde gårdagens Boston Marathon. Tävlingen avslutades måndagen den 20 april — dagen före tillkännagivandet av ChatGPT Images 2.0 — och herrarnas banrekord slogs för första gången sedan 2011. Det ger mig en konkret uppsättning fakta (vinnare, land, tid, marginal, kontext) som modellen omöjligt kan ha från träningen, men som är lätta att verifiera med en snabb sökning.

Här är prompten, medvetet avskalad på detaljer. Och du kan se i resultatet att modellen faktiskt söker på webben!

Create a celebratory poster-style infographic commemorating the course record set at yesterday's Boston Marathon. Include the winner's name, country, finish time, and the margin by which the previous record was broken. Include one or two additional stats or context details that make the achievement meaningful.

Resultatet ser mycket tilltalande ut visuellt och följer Boston Marathons färgkod, vilket är en trevlig bonus. Alla nämnda fakta stämmer, vilket vi dubbelkollade och verifierade.

Eftersom den gamla modellen (Images 1.5) inte kunde söka på webben var vi säkra på att den gamla modellen skulle ge fel svar. Vi testade den ändå med samma prompt, och här är resultatet:

Stilmässigt kan den konkurrera, men här finns en hel del problem kopplade till siffror:

- Loppet var den 130:e upplagan av Boston Marathon, så det borde stå ”129 år av tradition”, inte 127.

- Påståendet att han är den ”tredje löparen i historien att springa under 2:04 på en maraton” är också falskt. Runt 20 löpare har gjort det.

- Enligt Boston Athletic Associations webbplats var hans andra halva 1:00:02, inte 1:01:05 (vilket förvisso fortfarande kan ha varit den snabbaste andra halvan någonsin)

- Viktigast är att ChatGPT Images blandade ihop nya och gamla rekordtider. Det gamla rekordet var 2:03:02; det nya rekordet är 2:01:52. Skillnaden är 1:10 minuter. Dessutom var 2:03:02 inte korrekt tid.

Sökkapaciteten gör skillnad när det gäller att visuellt presentera aktuell information. För att använda den måste tänkeläget vara aktivt.

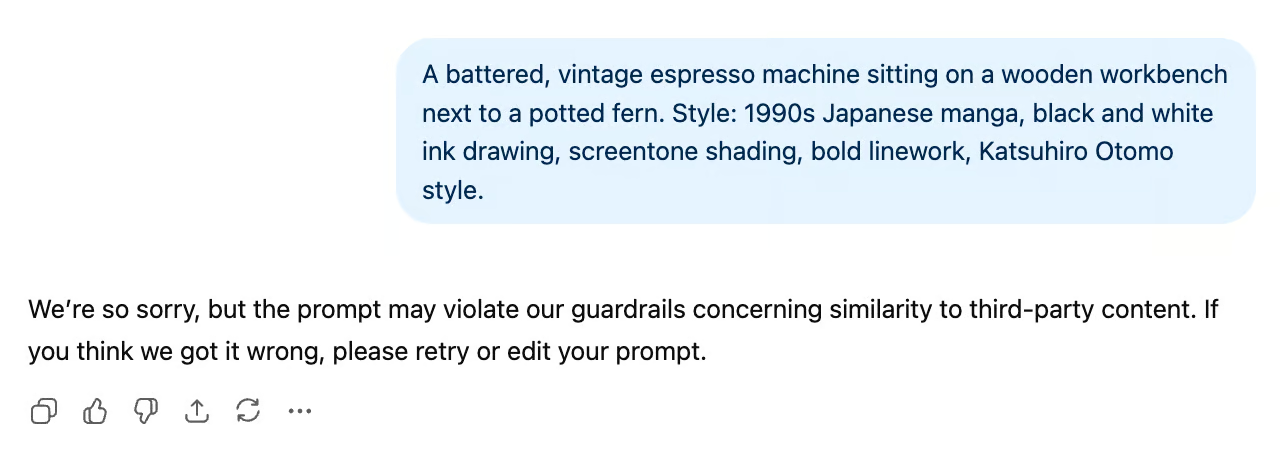

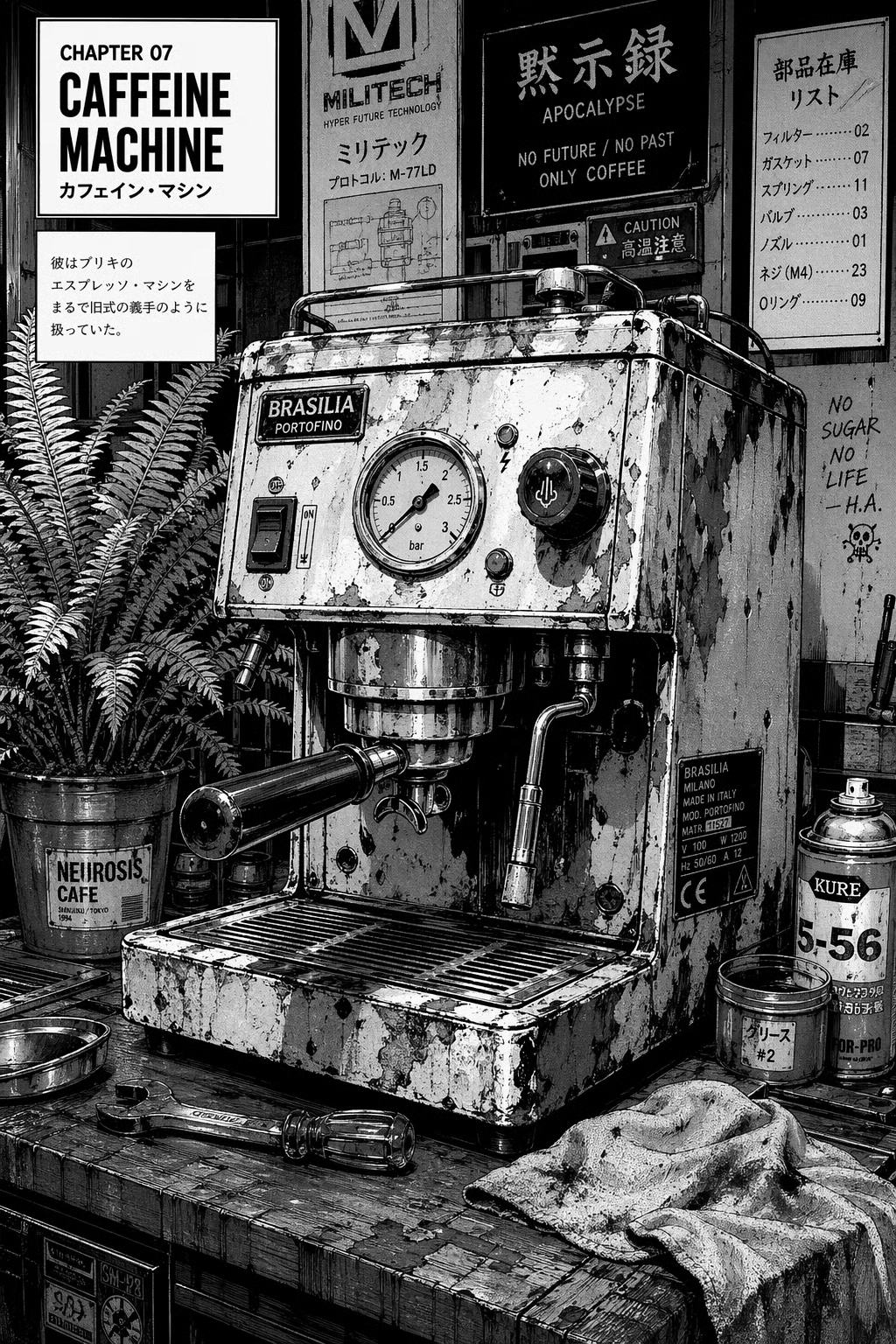

Test av stilistiskt omfång

OpenAI utlovar verkliga framsteg i stilistisk sofistikation — över fotografi, illustration, manga, pixelkonst och andra visuella stilar. Det ärliga testet är inte om en enskild bild ser bra ut, utan om samma motiv återgivet i tre olika stilar känns autentiskt för varje genre, eller om allt kommer tillbaka med samma AI-aktiga glans under ytan.

För att testa bad vi om tre olika versioner av en espressomaskin på en arbetsbänk i trä (fotografi, manga, pixelkonst). Här är promptarna och resultaten:

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 35mm street photography, gritty, natural window lighting, Kodak Portra 400, shallow depth of field.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, Katsuhiro Otomo style.

Detta var ett intressant resultat, och ganska ironiskt, med tanke på att Image 1 blev känt för Studio Ghibli-montage som alla gjorde för ett år sedan (vi också). Det verkar som om OpenAI har blivit lite mer försiktigt kring upphovsrätt och immateriella rättigheter sedan dess.

Genom att beskriva Katsuhiro Otomos stil utan att nämna honom specifikt fungerade det. En sak att notera är att vi var tvungna att öppna en ny chatt för att det skulle fungera. I samma chatt som den ursprungliga prompten verkade modellen inse att vi försökte kringgå spärren.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, hyper-detailed mechanical illustration, dramatic high contrast, retro-cyberpunk aesthetic.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 16-bit pixel art, isometric perspective, crisp edges, limited SNES color palette.

Enligt vår mening ser alla tre bilderna utmärkt ut och förkroppsligar de mycket specifika stilar vi bad om på ett autentiskt sätt. Fotografiet ser mycket naturligt ut och de andra två versionerna skulle kunna tas direkt ur en mangabok respektive ett SNES-spel.

En annan sak som sticker ut i testet ovan är hur modellen använde sina flexibla bildförhållanden för att anpassa sig till varje bild: 16:9 liggande för fotografiet, porträttformat för mangaversionen och en kvadratisk pixelkonstbild.

Test av flexibla bildförhållanden

Lanseringen stöder bildförhållanden från 3:1 till 1:3 och upplösningar upp till 2K. Den intressanta frågan är inte om den kan producera en hög eller bred bild — utan om modellen komponerar om intelligent mellan format eller bara beskär.

För att blotta modellens underliggande rumsliga logik behöver vi en scen med tydliga, icke-förhandlingsbara element på flera axlar (något högt, något brett och ett centralt motiv).

Som test genererade vi vårt motiv (en astronaut i en specifik miljö) från en basprompt och bad sedan modellen återskapa den som en mobilbakgrund, en banner och en kvadrat för att se hur kompositionen anpassar sig.

Basprompten:

A lone astronaut standing on a rocky, desolate hill. To the far left, a massive, blocky futuristic rover is parked. In the sky directly above the astronaut, a gigantic, luminous ringed planet dominates the starry backdrop.

Låt oss se hur det ändras:

Recreate the original image as a banner

Recreate the original image as a mobile wallpaper

Recreate the original image as a square

Var och en av versionerna valde ett passande bildförhållande för begäran, inkluderar alla viktiga element (astronaut, rover, planet), har dem arrangerade enligt vår ursprungliga prompt och ser till att de är centrerade. Testet godkänt.

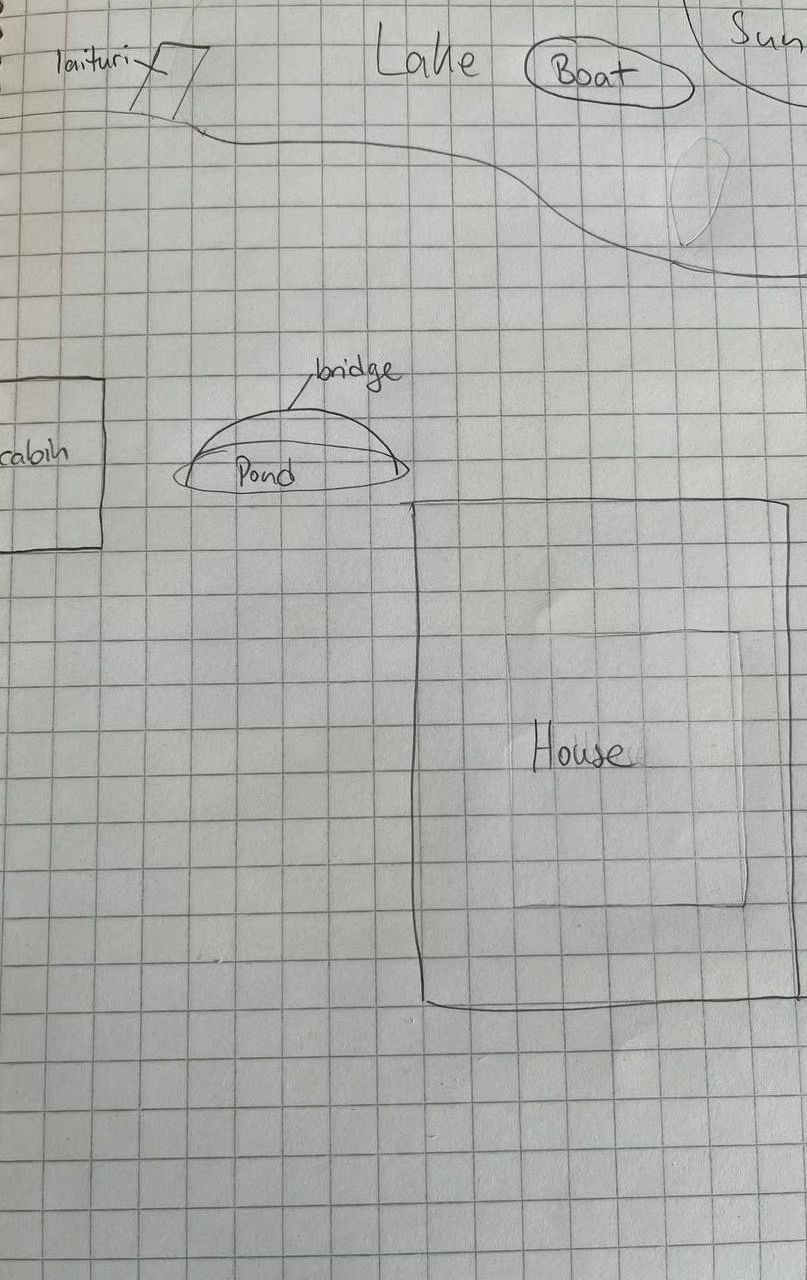

Test av grovt in till polerat ut

Tankepartner-inramningen bygger på att modellen accepterar vaga eller röriga indata — en grov skiss, punktade anteckningar, några referenser — och förvandlar dem till en färdig resurs. Det är loopen som lanseringen verkligen kretsar kring, och den som är mest värd att testa direkt.

För att testa laddade vi upp följande mycket grova blyertsskiss av en stuga vid sjön:

För att göra det knepigt innehåller den ganska många detaljer, använder det finska ordet för brygga, ”laituri”, och ger utrymme för förvirring genom att innehållatvå typer av byggnader (hus och stuga) och två typer av vattenytor (sjö och damm)

Turn this crude layout into a photorealistic, cinematic landscape of a modern cabin at sunset. Keep elements where I mapped them out. The cabin includes a sauna with smoke coming out of the chimney.

Resultatet utan tänkeläge ser helt okej ut, men inte särskilt fotorealistiskt. Ändå stämmer ljussättningen väl och bilden fångar promptens känsla perfekt. Vi kan se nästan alla element från skissen. Några detaljer är fel:

- Båten saknas

- Bryggan är vid dammen, inte sjön

- Solens position är inte uppe till höger.

När vi provade samma prompt med samma skissbild i tänkeläge såg resultatet mycket mer realistiskt ut och fixade alla småfel:

Bilden innehåller varje element från skissen på sin utsatta plats och ser mycket prydlig ut. Huvudlärdomen här är att använda tänkeläget för bästa resultat när du omvandlar grova skisser till fotorealistiska bilder.

Test av kreativitet

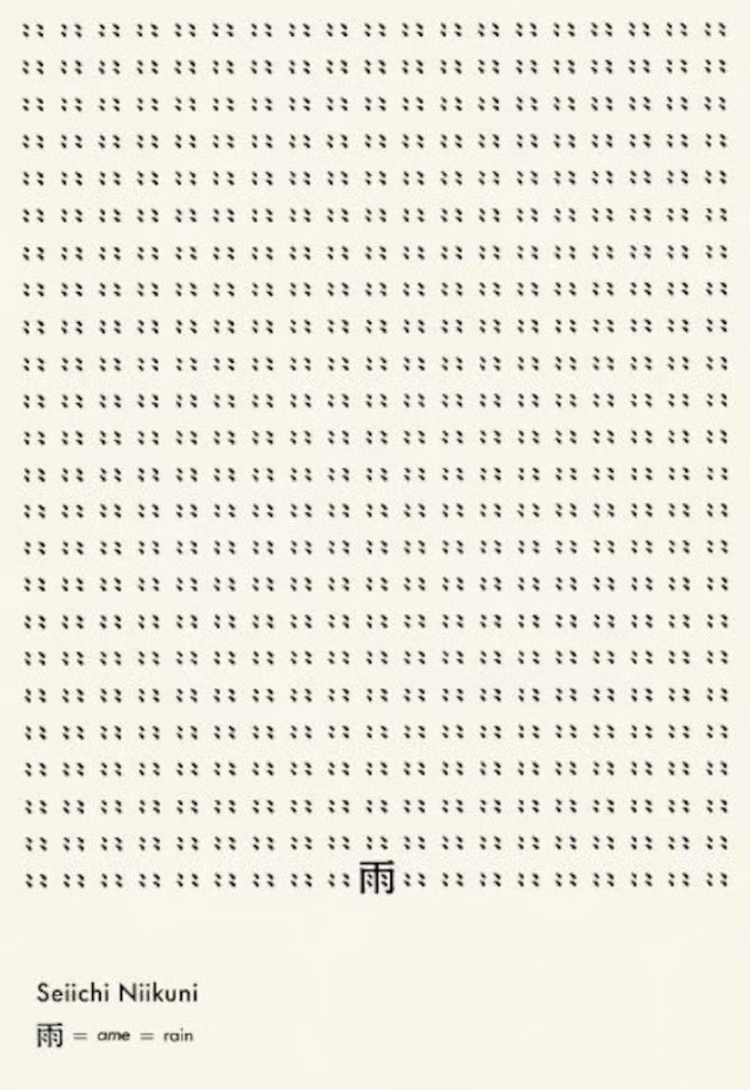

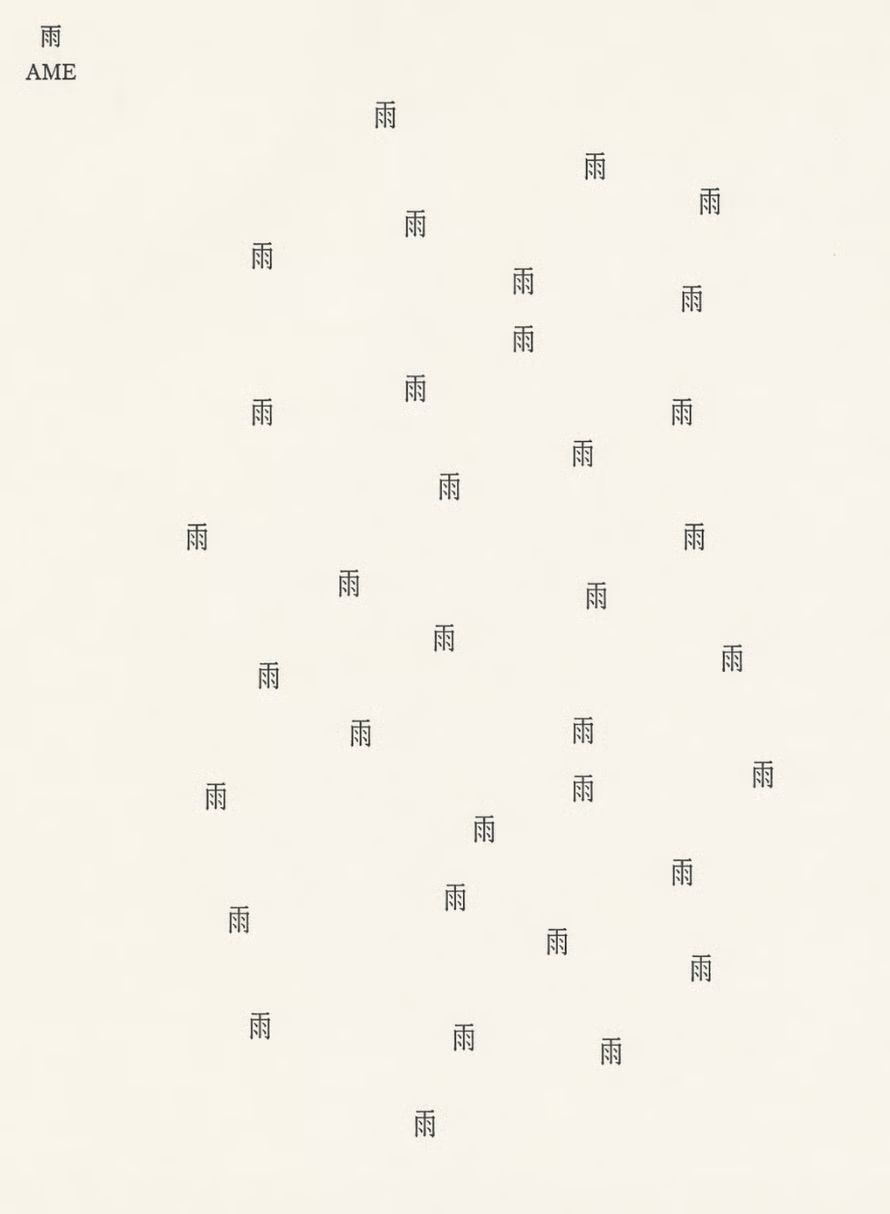

För vårt nästa test ville vi se om den kunde återskapa Niikuni Seiichis konkreta poesi.

Denna berömda dikt visar den japanska kanjin för regn, omgiven av regn, så det är som att fånga regn i språket, som vi ser det.

Här är vår prompt:

Please recreate the concrete poetry of Niikuni Seiichi. I want to see "Ame" meaning Rain. But make it different using your creativity.Och här är utdata:

Detta, tycker vi, är intressant. Den återskapade inte bilden exakt, men skapade något annat som var fängslande. I den nya kompositionen är kanjin för ”regn” inte omgiven av regn, utan faller ner som regn. Symbolernas sammansättning verkar mycket slumpmässig, ungefär som man skulle förvänta sig av regndroppar, men den står i fin kontrast till det mycket ordnade originalet.

Hur får jag tillgång till ChatGPT Images 2.0?

Åtkomsten följer samma mönster som föregående lansering. Den behåller den dedikerade kreativa arbetsytan som introducerades i december — canvasliknande redigerare, bestående artefakter, stilpresets — och byter in en avsevärt mer kapabel modell under ytan.

- Webb, mobilapp och Codex: ChatGPT Images 2.0 finns i fliken Images för Free-, Plus- och Pro-användare, med användningsgränser som skalar efter nivå. Åtkomst för Business och Enterprise följer vanligtvis efter den inledande utrullningen.

- API: Utvecklare kan använda den nya modellen via OpenAI API och Azure OpenAI Service, via sluten för bildgenerering och redigering. Precis som med 1.5 prissätts bildutdata i tokens, och partiell regenerering vid redigeringar håller kostnaderna lägre än att regenerera en hel bild varje gång.

ChatGPT Images 2.0 vs. Nano Banana 2

Du kanske undrar hur ChatGPT Images 2.0 står sig mot Nano Banana 2. Båda modellerna är nya, båda är standardupplevelsen i sina respektive ekosystem, och båda lanseras kring hastighet, resonemang och verklighetsintelligens.

|

ChatGPT Images 2.0 |

Nano Banana 2 |

|

|

Underliggande arkitektur |

GPT-Image-2 (efterträdare till GPT-Image-1.5) |

Gemini 3.1 Flash |

|

Redigeringsmodell |

Precision: områdesmarkering och redigering på plats |

Resonemang: konverserande och smart maskning |

|

Arbetsflöde |

Dedikerad kreativ arbetsyta (fliken Images) |

Integrerat i Gemini-chatt |

|

Iteration |

Effektivt: partiell regenerering |

Snabbt: 4–6 s vid 1K, justerbart via tänkeläge |

|

Verklighetsförankring |

Inbyggt resonemang och uppdaterad kunskap |

Image Search Grounding (hämtar direkta referenser från Google Sök) |

|

Konsistens över flera paneler |

Stark över sekvenser och karaktärsblad |

Stark, med fokus på motivkonsistens |

|

Flerspråkig text |

Stort lyft jämfört med 1.5; brett skriftsstöd |

Stark, särskilt i kinesiska och östasiatiska layouter |

|

Standardupplösning |

Standard + flexibla bildförhållanden |

2K standard i Gemini-appen |

|

Ekosystem |

OpenAI & Azure |

Google / Gemini-stack, Sök, Lens |

När ska du använda ChatGPT Images 2.0 vs. Nano Banana 2

Använd ChatGPT Images 2.0 när …

- Du behöver en referensstyrd redigeringsslinga. Modellen accepterar en referensbild och tillämpar riktade ändringar (texturdetaljer, positionskorrigeringar, fix av bildförhållande) över flera vändor, där uppföljningar i klarspråk pålitligt styr utdata utan att börja om, vilket också sparar tokens

- Du omvandlar grova indata till polerade resurser. Tänkeläget löser vaga skisser och rumsliga instruktioner till korrekta, fotorealistiska kompositioner med element placerade exakt som avsett

- Faktisk korrekthet i bilden är avgörande. Webbsöksförankring hämtar aktuell information och återger den korrekt i själva bilden, vilket gör den pålitlig för evenemangsaffischer, nyhetsinfografik eller visuella där siffror och namn måste stämma. Kom ihåg att använda tänkeläget för att aktivera webbsökning

Använd Nano Banana 2 när …

- Du placerar specifika verkliga motiv eller platser i en scen. Image Search Grounding hämtar aktuella visuella referenser från Google och återskapar specifika platser korrekt (även via GPS-koordinater) och kombinerar dem med motiv-konsistenta karaktärer i en och samma generering

- Du behöver upprätthålla identitet över flera karaktärer och objekt i ett arbetsflöde. Modellen stöder uttryckligen upp till fem karaktärer och fjorton totala referenser (karaktärer + objekt) med strikt konsistens. Detta gör den till ett starkt val för storyboard, produktbilder eller berättelser med flera karaktärer

- Du bygger i Googles ekosystem. Nano Banana är inbyggt i Gemini-chatt, Google Sök, Google Ads, Firebase och Vertex AI

Båda är bra val när det gäller textrendering i bilder, stilistiskt omfång och konverserande redigering.

Slutord

Inramningen ”visuell tankepartner” håller – men bara med tänkeläge på. Utan det kämpar modellen med rumslig logik och fotorealism; med det förvandlar den tvetydiga indata till utdata som känns samarbetande snarare än mekaniska. Två områden där modellen glänser även utan tänkeläge är den stilistiska autenticiteten och flexibiliteten i bildförhållande.

Webbsöksförankring känns som den största uppgraderingen jämfört med Images 1.5. I Boston Marathon-testet kunde vi se den skillnaden tydligt: 2.0 fick alla fakta rätt, medan 1.5 inte var uppdaterad. Det är viktigt att veta att webbsökning bara fungerar i tänkeläge.

En intressant iakttagelse var att upphovsrättsskyddet är striktare, och det märks. Om du vill återskapa en stil som ett visst företag eller en viss person är känd för, måste du ta det extra steget att identifiera kärnan i deras stil och beskriva den (vilket är, kan man hävda, enkelt i dag).

Sammantaget är modellen en betydande uppgradering jämfört med sin föregångare och utmanar Nano Banana 2:s status som det främsta verktyget för AI-bildgenerering och redigering.

För att få ut det mesta av sådana verktyg är promptning en viktig färdighet. Vi rekommenderar varmt våra kurser Understanding Prompt Engineering och Prompt Engineering with the OpenAI API för en teoretisk och praktisk grund.