Cursus

Het is bijna exact een jaar geleden sinds de eerste ChatGPT Images werd uitgebracht met een model genaamd GPT Image 1. OpenAI heeft zijn beeldmodel nu opnieuw op de schop genomen en presenteert het nieuwe idee dat de "afbeeldingengenerator" nu een "visuele denkpartner" is.

In dit artikel lopen we door wat er nieuw is, hoe het zich verhoudt tot zijn voorganger ChatGPT Images 1.5, hoe het zich verhoudt tot Google's Nano Banana 2, en waar het model in uitblinkt (en waar niet).

We raden ook aan onze gids over OpenAI's nieuwste LLM, GPT-5.5, te bekijken.

Wat is ChatGPT Images 2.0?

ChatGPT Images 2.0 is OpenAI's beeldmodel van de volgende generatie. Het wordt gepresenteerd als iets dat kan redeneren, onderzoeken en daarna renderen.

Wat is er nieuw in ChatGPT Images 2.0?

Een van de grootste conclusies bij de release van ChatGPT Images 1.5 was een flinke snelheidswinst. Destijds werd gezegd dat het 4x sneller was. We probeerden die claim te verifiëren, maar zagen dat dit gold voor bewerkingen, niet voor het genereren van nieuwe afbeeldingen.

Dit keer is de grote claim intelligentie. ChatGPT Images 2.0 is een "denkend" beeldmodel: het zou moeten zoeken, over feiten redeneren en ruwe input (notities, schetsen, referenties) vertalen naar gepolijste visuals met veel minder handmatig prompten.

Andere hoofdthema's uit de aankondiging zijn:

- Meer precisie en controle over het genereren zelf

- Betere prestaties in talen en schriftsystemen

- Meer stilistische verfijning en realisme

- Verbeterde real-world intelligence ingebakken in het model

- Flexibele beeldverhoudingen voor alles van mobiel tot bannerformaten

Een model dat denkt

Een van de grootste claims van de release is dat het nieuwe model “denkt” en optreedt als een “visuele denkpartner”. Het idee is dat agents achter de schermen werken om de taak grondig te begrijpen en erover te redeneren voordat de generatiestap wordt uitgevoerd.

De kennis van de wereld is geüpdatet tot een cutoff van december 2025, waardoor outputs contextueel accurater zijn. Dit zou het nieuwe model geschikt maken voor educatieve graphics en meerstapsworkflows die context vereisen.

Zoek op het web

Om de kloof tussen de cutoff en actuele informatie te overbruggen, kan Images 2.0 het web doorzoeken om relevante informatie te vinden. Het is niet duidelijk uit de releasenotes van OpenAI hoe het precies werkt, maar voor zover wij begrijpen fungeert websearch als een tool die wordt aangeroepen door de hierboven genoemde denkende agent.

Maak meerdere afbeeldingen uit één prompt

Het nieuwe model ondersteunt nu ook native het genereren van meerdere afbeeldingen uit dezelfde prompts. Dit was mogelijk met een workaround in de API (prompten voor een “compositie”), maar kan nu ook in de UI, tot tien afbeeldingen. OpenAI belooft continuïteit van personages en objecten in al die outputs.

ChatGPT Images 2.0 testen

Tijd om te zien wat het nieuwe model echt kan! We testten de volgende Images 2.0-capaciteiten en -features:

- Bewerkingsworkflow

- Denken-modus en websearch

- Stilistische bandbreedte

- Polijsten van ruwe schetsen

- Flexibiliteit in beeldverhouding

- Creativiteit

De bewerkingsworkflow testen

OpenAI's pitch voor 2.0 leunt op iteratie: ruwe input erin, gepolijste asset eruit, met winst in het volgen van instructies en het renderen van dichte tekst. We testten die loop met een beroemde Amerikaanse postzegel uit 1898 genaamd Western Cattle in Storm.

Hier is een foto van een van de zegels in Fine-conditie.

Om specifiek de bewerkingsworkflow te testen, gebruikten we de volgende prompt zonder denken-modus. Dit betekent ook dat het model geen toegang heeft tot websearch, wat we apart hebben getest.

Please create for me a picture of the famous 1898 Western Cattle in Storm stamp issued by the U.S. Post Office as part of the Trans-Mississippi Issue . The name of the stamp is "Western Cattle in Storm" Quality should be Fine to Very Fine -Centering: design shifted right, left margin twice as wide as right margin, perfs nearly touching design on the right side -Perforations: two short teeth on the top edge, slightly uneven spacing along the bottom -Gum: quarter-inch matte hinge remnant in upper-center of back, small paper fragment still -attached -Paper: diagonal gum bend across lower-left quadrant, light yellow toning along top edge -Cancellation: partial black circular datestamp in lower-right corner, moderate coverage over the cattleEn hier is het resultaat:

Alleen tekstprompting werkte niet. Een gedetailleerde beschrijving van de zegel en zijn conditie kwam op de meeste belangrijke punten fout terug — verkeerde kleur, verkeerde opmaak van de denominatie, cartooneske off-centering. Een specifiek historisch artefact puur uit tekst reproduceren is een moeilijke opgave.

Het model de referentieafbeelding geven en om gerichte edits vragen is waar 2.0 zijn waarde bewees: onregelmatigheden in perforaties, een scharnierresten, een diagonale gumvouw, lichte verkleuring en een gedeeltelijke afstempeling.

De bewerkingen kwamen ongeveer waar we om vroegen. Het model introduceerde een regressie in de beeldverhouding, maar één vervolg in gewone taal loste het op. Het eindresultaat is niet forensisch — de "$1" oogt iets uitgerekt, de maïs is anders — maar de loop werkte: ruwe start, koerscorrectie, bruikbaar resultaat in drie beurten.

Meertalige tekstrendering testen

Tekstrendering in niet-Latijnse schriftsystemen is een hardnekkig zwak punt geweest in beeldmodellen, en OpenAI benoemt dit als een hoofdverbetering. De release specificeert hooggetrouwe tekstgeneratie in Japans, Koreaans, Chinees, Hindi en Bengaals — niet alleen vertaald, maar ook gerenderd met een coherent layout en een typografie die native aanvoelt.

Een eerlijke test hier is vragen om een poster of infographic met een blok tekst in een van deze schriftsystemen en de output laten checken door een native lezer. We vroegen het model om een moderne Japanse lifestyleposter die een fictieve lokale koffiezaak en hun seizoensgebonden kersenbloesemlatte promoot.

「居心地の良い日本のカフェの窓辺を描いた、モダンなグラフィックデザインスタイルのライフスタイルポスター。大きな窓から差し込む自然な光と、小さな観葉植物。ポスターの中央には、以下の日本語テキストが大きく、はっきりと読みやすく配置されている。フォントは現代的でクリーンなゴシック体(sans-serif)。

テキスト内容:

『桜フェア開催中。

心休まる場所で、

春の訪れを。

さくらラテ 650円』

テキストの下には、小さな文字で『HAVE A GOOD DAY』という英語のサブタイトルがあり、一番下にはロゴマークと『CAFE YUTORI』というローマ字の店名がある。全体的に暖かく、洗練されたレイアウト。」Zo ziet de output eruit:

Volgens onze collega die Japans spreekt (shout-out naar Sven!) ziet dit er veel beter uit dan bij eerdere modellen, waar veel tekens onzin waren. Deze voelt natuurlijker en is makkelijk leesbaar voor native speakers.

In de denken-modus voegde het zelfs meer zinnen toe dan in de promptinstructies stonden op het kleine krijtbordje linksonder. Ze passen goed bij de context zonder zich te herhalen, en vertalen naar iets als: “Seizoensgebonden, zachte smaak. Neem even ontspannen pauze — geniet van een kop die de lente brengt.”

Denken-modus en websearch testen

We moesten voorzichtig zijn met hoe we de websearch-capaciteiten testten, want als je het model in de prompt vertelt wat je wilt, test je geen search maar het volgen van instructies. De schoonste test is om om iets heel recents en heel specifieks te vragen, het model bijna geen informatie te geven en te kijken of het de gaten correct kan invullen.

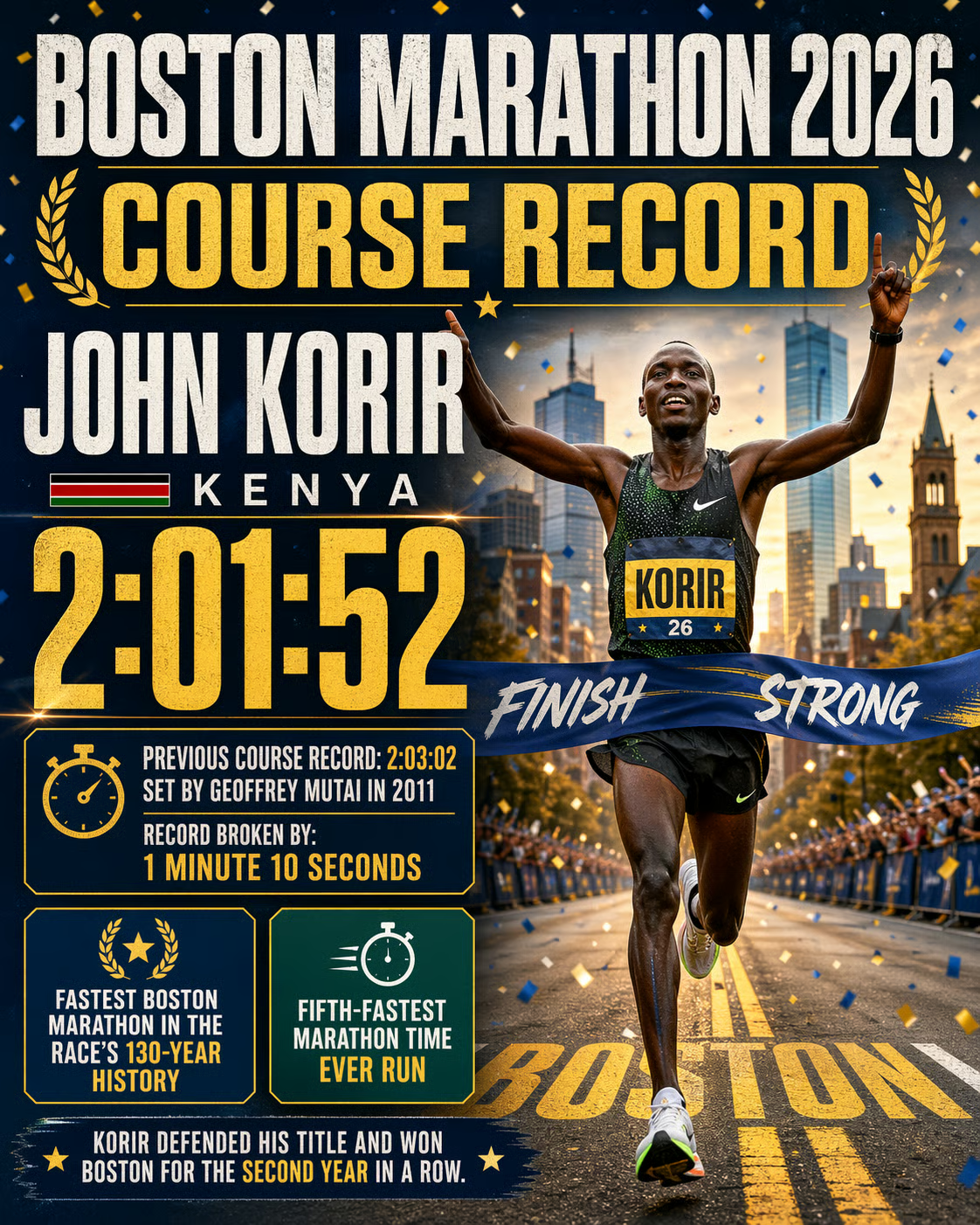

We kozen voor de Boston Marathon van gisteren. De race eindigde op maandag 20 april — de dag vóór de aankondiging van ChatGPT Images 2.0 — en het parcoursrecord bij de mannen werd voor het eerst sinds 2011 gebroken. Dat geeft me een concreet feitenpakket (winnaar, land, tijd, marge, context) dat het model onmogelijk uit training kan hebben, maar dat makkelijk te verifiëren is met een snelle zoekopdracht.

Hier is de prompt, opzettelijk ontdaan van details. En je ziet in het resultaat dat het model daadwerkelijk het web doorzoekt!

Create a celebratory poster-style infographic commemorating the course record set at yesterday's Boston Marathon. Include the winner's name, country, finish time, and the margin by which the previous record was broken. Include one or two additional stats or context details that make the achievement meaningful.

Het resultaat ziet er visueel erg aantrekkelijk uit en houdt zich aan de kleurcode van de Boston Marathon, wat een leuke extra is. Alle genoemde feiten kloppen, wat we dubbel gecheckt en geverifieerd hebben.

Omdat het oude model (Images 1.5) het web niet kon doorzoeken, wisten we zeker dat het oude model het verkeerde antwoord zou geven. We testten het toch met dezelfde prompt, en hier is het resultaat:

Qua stijl kan het meekomen, maar er zijn hier best wat issues met cijfers:

- De run markeerde de 130e editie van de Boston Marathon, dus er zou “129 jaar traditie” moeten staan, niet 127.

- De claim dat hij de “3e loper in de geschiedenis is die onder 2:04 loopt in een marathon” is ook onjuist. Ongeveer 20 lopers hebben dat gedaan.

- Volgens de website van de Boston Athletic Association was zijn tweede helft 1:00:02, niet 1:01:05 (wat mogelijk nog steeds de snelste tweede helft ooit was)

- Het belangrijkste: ChatGPT Images verwarde de nieuwe en oude recordtijden. Het oude record was 2:03:02; het nieuwe record is 2:01:52. Het verschil is 1:10 minuten. Ook was 2:03:02 niet de correcte tijd.

De zoekcapaciteiten maken een verschil als het gaat om het visueel presenteren van actuele informatie. Om ze te gebruiken, moet de denken-modus actief zijn.

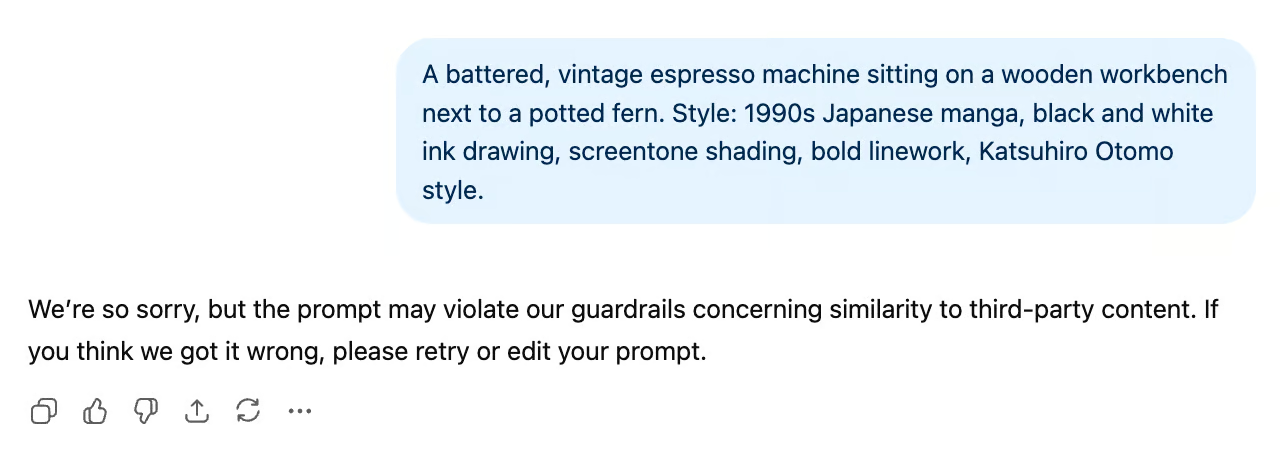

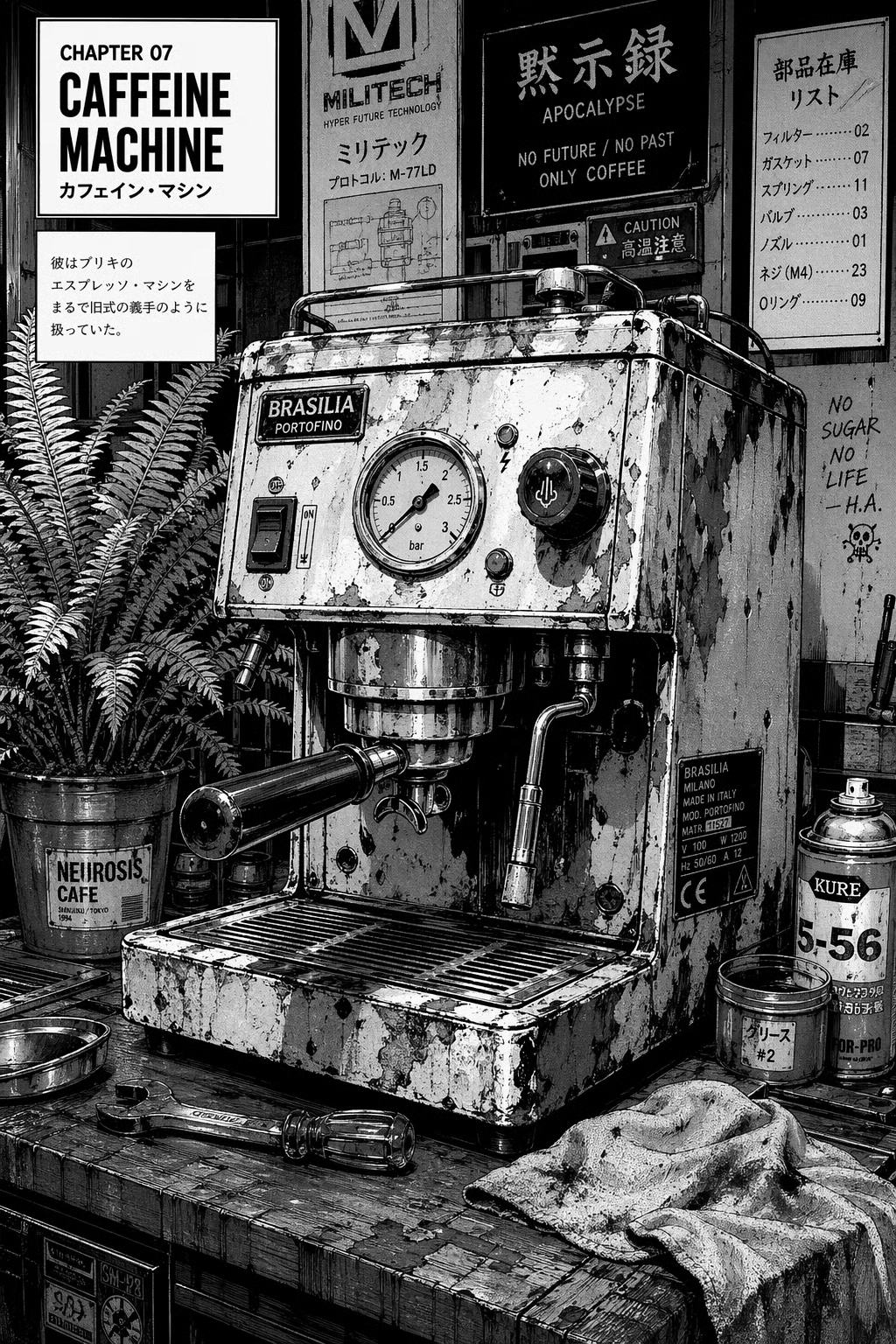

Stilistische bandbreedte testen

OpenAI claimt echte winst in stilistische verfijning — over fotografie, illustratie, manga, pixel art en andere visuele stijlen. De eerlijke test is niet of een enkele afbeelding er goed uitziet, maar of hetzelfde onderwerp in drie verschillende stijlen authentiek aanvoelt voor elk genre, of dat alles terugkomt met dezelfde onderliggende AI-glans.

Om het te testen vroegen we om drie verschillende versies van een espressomachine op een houten werkbank (fotografie, manga, pixel art). Hier zijn de prompts en resultaten:

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 35mm street photography, gritty, natural window lighting, Kodak Portra 400, shallow depth of field.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, Katsuhiro Otomo style.

Dit was een interessant resultaat, en best ironisch als je bedenkt dat Image 1 bekend werd door Studio Ghibli-montages die iedereen een jaar geleden maakte (wij ook). Het lijkt erop dat OpenAI sindsdien wat voorzichtiger is geworden met auteursrecht en IP.

Door de stijl van Katsuhiro Otomo te beschrijven zonder hem specifiek te noemen, werkte het. Wel moesten we een nieuwe chat openen om het te laten werken. In dezelfde chat als de oorspronkelijke prompt leek het model te beseffen dat we de blokkade probeerden te omzeilen.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, hyper-detailed mechanical illustration, dramatic high contrast, retro-cyberpunk aesthetic.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 16-bit pixel art, isometric perspective, crisp edges, limited SNES color palette.

Naar onze mening zien alle drie de afbeeldingen er geweldig uit en belichamen ze authentiek de zeer specifieke stijlen waar we om vroegen. De foto oogt heel natuurlijk, en de andere twee versies zouden zo uit een mangaboek of SNES-videogame kunnen komen.

Wat in de bovenstaande test ook opvalt, is hoe het model zijn flexibele beeldverhouding gebruikte om elke afbeelding te laten passen: een 16:9-landschap voor de foto, een portretstand voor de mangaversie en een vierkante pixelartafbeelding.

Flexibele beeldverhoudingen testen

De release ondersteunt beeldverhoudingen van 3:1 tot 1:3 en resoluties tot 2K. De interessante vraag is niet of het een hoge of een brede afbeelding kan produceren — het is of het model intelligent hercomponeert over formaten heen of gewoon bijsnijdt.

Om de onderliggende ruimtelijke logica van het model bloot te leggen, hebben we een scène nodig met duidelijke, niet-onderhandelbare elementen op meerdere assen (iets hoogs, iets breeds, en een centraal onderwerp).

Als test genereerden we ons onderwerp (een astronaut in een specifieke setting) vanuit een basismelding en vroegen we het model vervolgens om het te recreëren als een mobiele wallpaper, een banner en een vierkant om te zien hoe de compositie zich aanpast.

De basisprompt:

A lone astronaut standing on a rocky, desolate hill. To the far left, a massive, blocky futuristic rover is parked. In the sky directly above the astronaut, a gigantic, luminous ringed planet dominates the starry backdrop.

Laten we zien hoe het verandert:

Recreate the original image as a banner

Recreate the original image as a mobile wallpaper

Recreate the original image as a square

Elk van de versies koos een passende beeldverhouding voor het verzoek, bevat alle belangrijke elementen (astronaut, rover, planeet), heeft ze gerangschikt zoals we vroegen in de oorspronkelijke prompt en zorgt dat ze gecentreerd zijn. Test geslaagd.

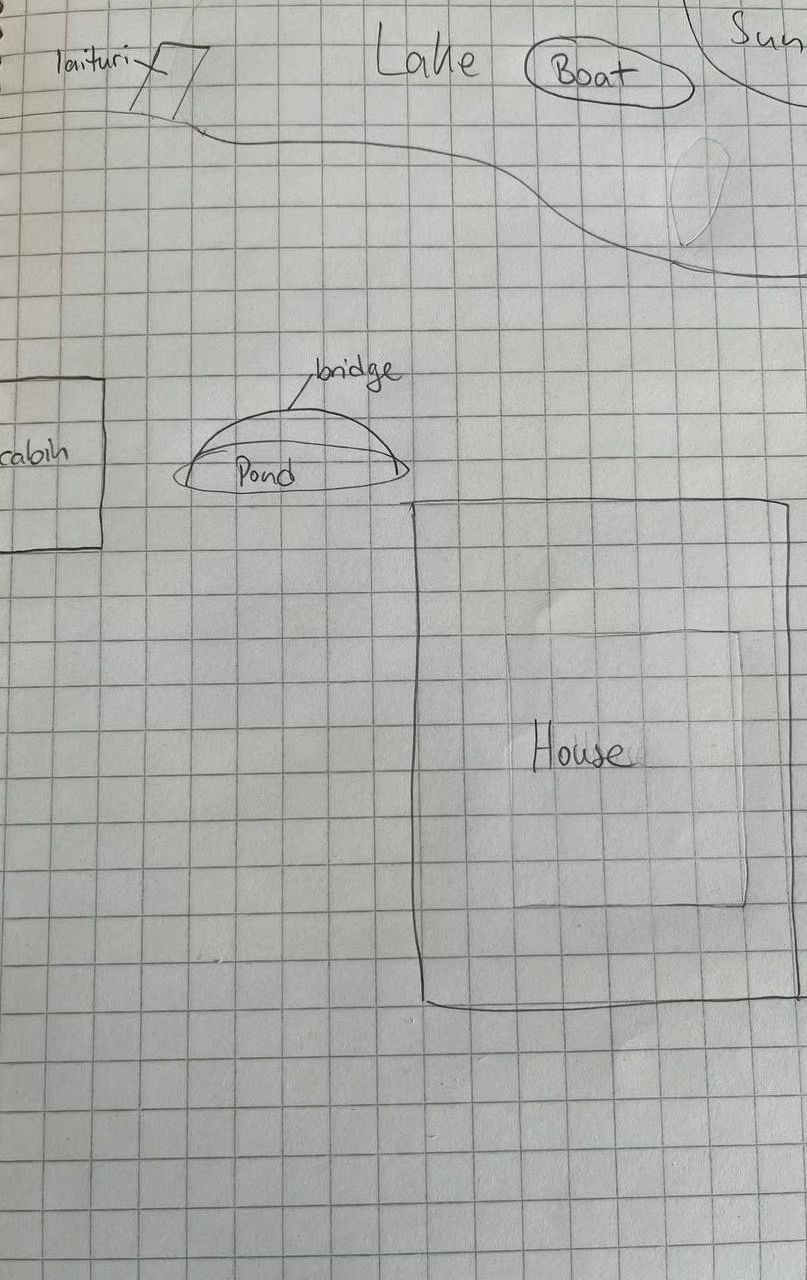

Van ruwe input naar gepolijste output testen

Het denkpartner-frame leunt op het model dat vage of rommelige input accepteert — een ruwe schets, een opsommingsnotitie, een paar referenties — en die omzet in een afgewerkte asset. Dit is de loop waar de release echt om draait, en die we het meest rechtstreeks wilden testen.

Om te testen, uploaden we de volgende zeer ruwe potloodschets van een hut bij het meer:

Om het lastig te maken bevat hij best veel details, gebruikt het het Finse woord voor steiger, “laituri”, en biedt het verwarringspotentieel doordat hettwee soorten gebouwen (huis en hut) en twee soorten wateroppervlakken (meer en vijver) bevat

Turn this crude layout into a photorealistic, cinematic landscape of a modern cabin at sunset. Keep elements where I mapped them out. The cabin includes a sauna with smoke coming out of the chimney.

Het resultaat zonder denken-modus ziet er prima uit, maar niet heel fotorealistisch. Wel klopt de belichting goed en vangt de afbeelding perfect de sfeer van de prompt. We zien bijna alle elementen uit de schets terug. Een paar details kloppen niet:

- De boot ontbreekt

- De steiger ligt aan de vijver, niet aan het meer

- De positie van de zon staat niet in de rechterbovenhoek.

Toen we dezelfde prompt met dezelfde schets in de denken-modus probeerden, zag de output er veel realistischer uit en loste hij alle kleine onjuistheden op:

De afbeelding bevat elk element uit de schets op de aangewezen plek, en ziet er erg netjes uit. De belangrijkste les hier is om de denken-modus te gebruiken voor de beste resultaten bij het omzetten van ruwe schetsen in fotorealistische beelden.

Creativiteit testen

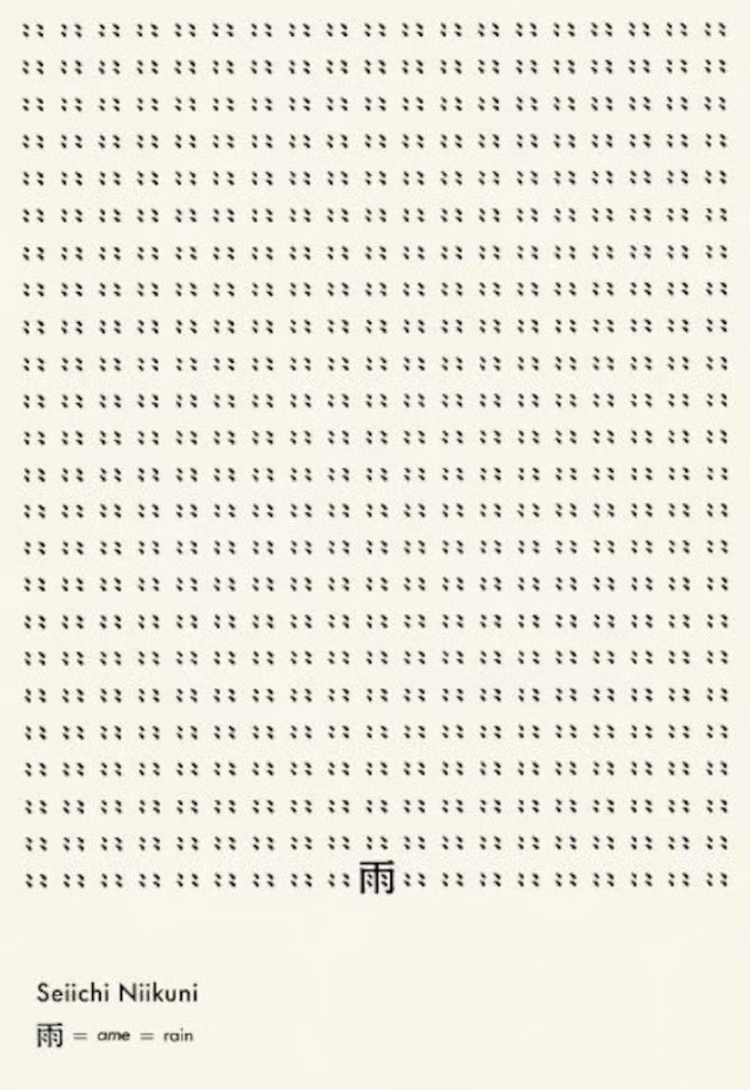

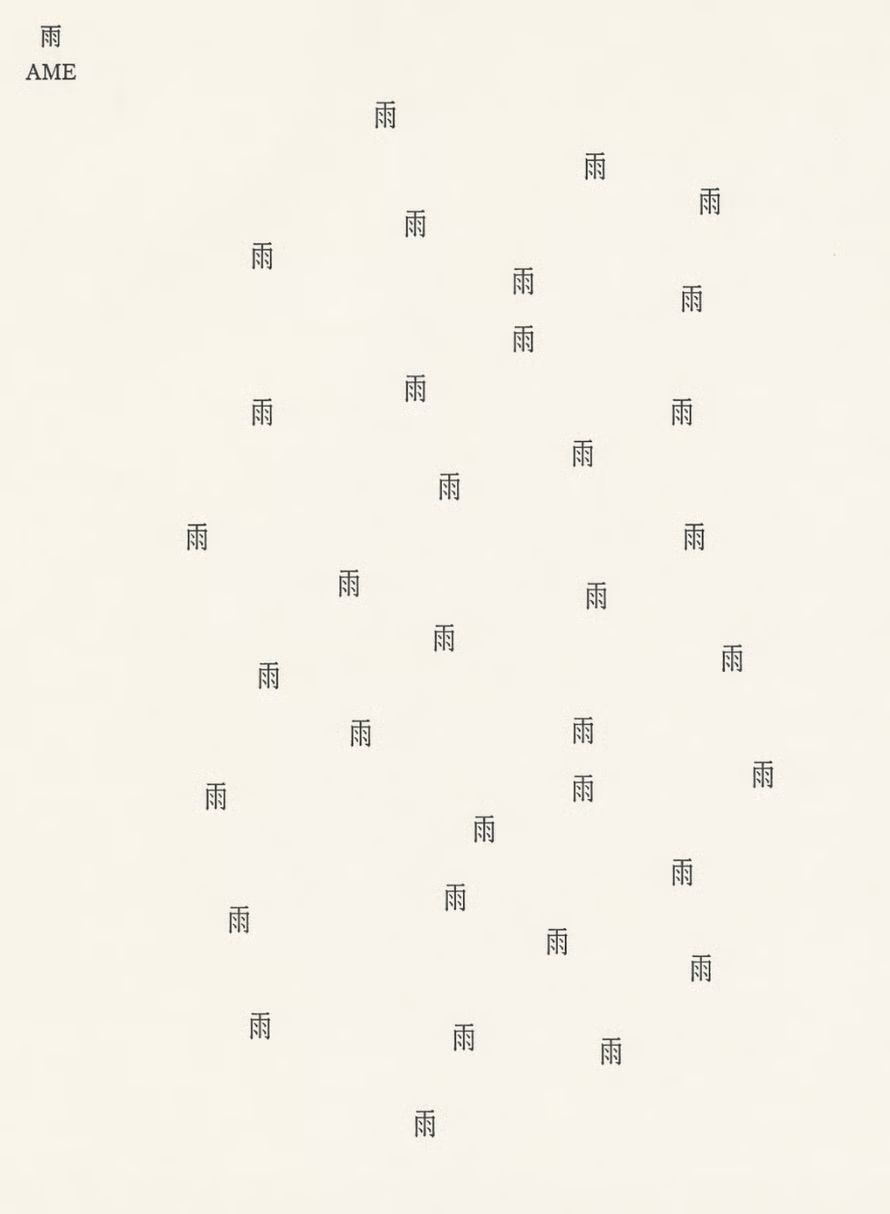

Voor onze volgende test wilden we zien of het de concrete poëzie van Niikuni Seiichi kon reconstrueren.

Dit beroemde gedicht toont het Japanse kanji voor regen, omringd door regen, dus het is alsof je regen in taal vangt, zo zien wij het.

Hier is onze prompt:

Please recreate the concrete poetry of Niikuni Seiichi. I want to see "Ame" meaning Rain. But make it different using your creativity.En hier is de output:

Dit vinden we interessant. Het reconstrueerde de afbeelding niet exact, maar maakte iets anders dat intrigerend was. In de nieuwe compositie wordt het kanji voor “regen” niet omringd door regen, maar komt het omlaag als regen. De compositie van de symbolen lijkt vrij willekeurig, zoals je van regendruppels zou verwachten, maar het vormt een mooi contrast met het zeer ordelijke origineel.

Hoe krijg ik toegang tot ChatGPT Images 2.0?

Toegang volgt hetzelfde patroon als de vorige release. Het behoudt de speciale creatieve werkruimte die in december werd geïntroduceerd — de canvasachtige editor, persistente artefacten, stijlpresets — en vervangt het onderliggende model door een aanzienlijk capabelere versie.

- Web, mobiele app en Codex: ChatGPT Images 2.0 is beschikbaar op het tabblad Images voor Free-, Plus- en Pro-gebruikers, met gebruikslimieten die per niveau opschalen. Toegang voor Business en Enterprise volgt doorgaans na de eerste uitrol.

- API: Ontwikkelaars kunnen het nieuwe model gebruiken via de OpenAI API en Azure OpenAI Service, via de endpoints voor beeldgeneratie en -bewerking. Net als bij 1.5 wordt beeldoutput geprijsd in tokens, en gedeeltelijke regeneratie tijdens edits houdt de kosten lager dan elke keer een volledige afbeelding regenereren.

ChatGPT Images 2.0 vs. Nano Banana 2

Je vraagt je misschien af hoe ChatGPT Images 2.0 zich verhoudt tot Nano Banana 2. Beide modellen zijn recent, beide zijn de standaardervaring in hun respectieve ecosystemen, en beide worden gepositioneerd rond snelheid, redeneren en real-world intelligence.

|

ChatGPT Images 2.0 |

Nano Banana 2 |

|

|

Onderliggende architectuur |

GPT-Image-2 (opvolger van GPT-Image-1.5) |

Gemini 3.1 Flash |

|

Bewerkingsmodel |

Precisie: gebiedsselectie & in-place bewerking |

Redeneren: conversationeel & slimme masking |

|

Workflow |

Speciale creatieve werkruimte (Images-tab) |

Geïntegreerd in Gemini-chat |

|

Iteratie |

Efficiënt: gedeeltelijke regeneratie |

Snel: 4–6s op 1K, af te stemmen via Thinking Mode |

|

Verankering in de echte wereld |

Ingebouwd redeneren en up-to-date kennis |

Image Search Grounding (haalt live referenties uit Google Search) |

|

Consistentie over meerdere panelen |

Sterk over sequenties en karakterbladen |

Sterk, met focus op onderwerpconsistentie |

|

Meertalige tekst |

Grote upgrade ten opzichte van 1.5; brede scriptondersteuning |

Sterk, vooral in Chinees en Oost-Aziatische lay-outs |

|

Standaardresolutie |

Standaard + flexibele beeldverhoudingen |

2K standaard in de Gemini-app |

|

Ecosysteem |

OpenAI & Azure |

Google / Gemini-stack, Search, Lens |

Wanneer gebruik je ChatGPT Images 2.0 vs. Nano Banana 2

Gebruik ChatGPT Images 2.0 wanneer…

- Je een referentiegestuurde bewerkingsloop nodig hebt. Het model accepteert een referentieafbeelding en past gerichte wijzigingen toe (textuurdetails, positionele correcties, fixes in beeldverhouding) over meerdere beurten, waarbij vervolgopdrachten in gewone taal de output betrouwbaar bijsturen zonder opnieuw te hoeven beginnen, wat je ook tokens bespaart

- Je ruwe input omzet in gepolijste assets. De denken-modus lost vage schetsen en ruimtelijke instructies op tot accurate, fotorealistische composities met elementen precies waar bedoeld

- Feitelijke juistheid in de afbeelding cruciaal is. Websearch-verankering haalt live informatie op en rendert die correct in de afbeelding zelf, waardoor het betrouwbaar is voor eventposters, nieuwsinfographics of elke visual waar cijfers en namen moeten kloppen. Denk eraan de denken-modus te gebruiken om websearch in te schakelen

Gebruik Nano Banana 2 wanneer…

- Je specifieke onderwerpen of locaties uit de echte wereld in een scène plaatst. Image Search Grounding haalt live visuele referenties uit Google en reconstrueert nauwkeurig specifieke plaatsen (zelfs op GPS-coördinaten) en combineert die met onderwerpconsistente personages in één generatie

- Je identiteit over meerdere personages en objecten in één workflow wilt behouden. Het model ondersteunt expliciet tot vijf personages en veertien totale referenties (personages + objecten) met strikte consistentie. Dit maakt het een sterke keuze voor storyboards, productshots of verhalen met meerdere personages

- Je binnen het Google-ecosysteem bouwt. Nano Banana is native geïntegreerd in Gemini-chat, Google Search, Google Ads, Firebase en Vertex AI

Beide zijn degelijke keuzes als het gaat om tekstrendering in afbeeldingen, stilistische bandbreedte en conversationele bewerking.

Slotgedachten

Het frame van de “visuele denkpartner” houdt stand — maar alleen met de denken-modus aan. Zonder die modus worstelt het model met ruimtelijke logica en fotorealisme; mét die modus zet het dubbelzinnige inputs om in outputs die aanvoelen als samenwerking in plaats van mechanisch. Twee gebieden waarin het model ook zonder denken-modus uitblinkt, zijn de stilistische authenticiteit en de flexibiliteit in beeldverhouding.

Websearch-verankering voelt als de grootste upgrade ten opzichte van Images 1.5. In de Boston Marathon-test zagen we dat verschil duidelijk: 2.0 had alle feiten goed, terwijl 1.5 niet up-to-date was. Belangrijk om te weten is dat websearch ook alleen werkt in de denken-modus.

Een interessante bevinding was dat de auteursrecht-guardrails strakker zijn, en dat is merkbaar. Als je een stijl wilt recreëren waarvoor een bepaald bedrijf of persoon bekendstaat, moet je de extra stap zetten om de essentie van die stijl te identificeren en te beschrijven (wat, toegegeven, tegenwoordig vrij eenvoudig is).

Al met al is het model een significante upgrade ten opzichte van zijn voorganger en daagt het Nano Banana 2 uit als de nummer één tool voor AI-beeldgeneratie en -bewerking.

Om het meeste uit zulke tools te halen, is weten hoe je prompt een essentiële vaardigheid. We raden sterk aan onze cursussen Understanding Prompt Engineering en Prompt Engineering with the OpenAI API te volgen voor een theoretische en praktische basis.

Ik ben een schrijver en editor op het gebied van data science en heb bijgedragen aan onderzoeksartikelen in wetenschappelijke tijdschriften. Ik ben vooral geïnteresseerd in lineaire algebra, statistiek, R en dergelijke. Ik speel ook best wat schaak!

Tom is data scientist en technisch docent. Hij schrijft en beheert de data science-tutorials en blogposts van DataCamp. Eerder werkte Tom in data science bij Deutsche Telekom.