Curso

Faz quase exatamente um ano desde que o primeiro ChatGPT Images foi lançado com um modelo chamado GPT Image 1. A OpenAI reformulou seu modelo de imagem novamente e agora apresenta a ideia de que o antigo "gerador de imagens" virou um "parceiro visual de pensamento".

Neste artigo, vamos mostrar o que há de novo, como ele se compara ao seu antecessor ChatGPT Images 1.5, como se sai em relação ao Nano Banana 2 do Google e onde o modelo brilha (e onde não brilha).

Recomendamos também conferir nosso guia sobre o LLM mais novo da OpenAI, o GPT-5.5.

O que é o ChatGPT Images 2.0?

ChatGPT Images 2.0 é o modelo de imagem de próxima geração da OpenAI. Ele é apresentado como algo que consegue pesquisar, raciocinar e, então, renderizar.

Você quer começar a usar a IA generativa?

Saiba como trabalhar com LLMs em Python diretamente em seu navegador

O que há de novo no ChatGPT Images 2.0?

Um dos principais destaques do lançamento do ChatGPT Images 1.5 foi o grande aumento na velocidade. Na época, a promessa era de ser 4x mais rápido. Tentamos verificar essa afirmação e vimos que isso se aplicava a edições, não à geração de novas imagens.

Desta vez, a grande promessa é inteligência. O ChatGPT Images 2.0 é um modelo de imagem "pensante": ele deve pesquisar, raciocinar sobre fatos e traduzir entradas brutas (anotações, esboços, referências) em visuais finalizados com muito menos engenharia de prompt manual.

Outros pontos do anúncio incluem:

- Mais precisão e controle sobre a própria geração

- Melhor desempenho em vários idiomas e sistemas de escrita

- Mais sofisticação estilística e realismo

- Mais inteligência de mundo real incorporada ao modelo

- Proporções flexíveis para tudo, do celular a formatos de banner

Um modelo que pensa

Uma das maiores promessas do lançamento é que o novo modelo “pensa” e atua como um “parceiro visual de ideias”. A ideia é que agentes façam um trabalho nos bastidores para entender o pedido a fundo e raciocinar sobre ele antes de executar a geração.

Seu entendimento de mundo foi atualizado até dezembro de 2025, então os resultados são mais contextualizados. Isso o torna ótimo para gráficos educacionais e fluxos de trabalho em várias etapas que exigem contexto.

Pesquise na web

Para reduzir a lacuna entre o cutoff e as informações mais recentes, o Images 2.0 pode pesquisar na web para encontrar dados relevantes. Não está claro nas notas da OpenAI exatamente como funciona, mas entendemos que a busca na web atua como uma ferramenta chamada pelo agente pensante mencionado acima.

Crie várias imagens a partir de um único prompt

O novo modelo também oferece nativamente a geração de várias imagens a partir do mesmo prompt. Isso já era possível com um truque na API (solicitando uma “composição”), mas agora pode ser feito também na interface, para até dez imagens. A OpenAI promete continuidade de personagens e objetos em todas essas saídas.

Testando o ChatGPT Images 2.0

Hora de ver o que o novo modelo realmente faz! Testamos as seguintes capacidades e recursos do Images 2.0:

- Fluxo de edição

- Modo de pensamento e busca na web

- Amplitude estilística

- Refinamento de esboços brutos

- Flexibilidade de proporção

- Criatividade

Testando o fluxo de edição

A proposta da OpenAI para o 2.0 aposta na iteração: entra um insumo bruto, sai um ativo polido, com ganhos em seguir instruções e renderizar textos densos. Testamos esse ciclo usando um famoso selo dos EUA de 1898 chamado Western Cattle in Storm.

Aqui está a foto de um dos selos em condição "Fine".

Para testar especificamente o fluxo de edição, usamos o prompt abaixo sem o modo de pensamento. Isso também significa que o modelo não tem acesso à busca na web, que testamos separadamente.

Please create for me a picture of the famous 1898 Western Cattle in Storm stamp issued by the U.S. Post Office as part of the Trans-Mississippi Issue . The name of the stamp is "Western Cattle in Storm" Quality should be Fine to Very Fine -Centering: design shifted right, left margin twice as wide as right margin, perfs nearly touching design on the right side -Perforations: two short teeth on the top edge, slightly uneven spacing along the bottom -Gum: quarter-inch matte hinge remnant in upper-center of back, small paper fragment still -attached -Paper: diagonal gum bend across lower-left quadrant, light yellow toning along top edge -Cancellation: partial black circular datestamp in lower-right corner, moderate coverage over the cattleE aqui está o resultado:

O prompt só com texto não funcionou. A descrição detalhada do selo e de seu estado veio errada na maioria dos pontos que importam — cor errada, disposição do valor facial errada, desalinhamento caricato. Reproduzir um artefato histórico específico só a partir de texto é pedir demais.

Entregar a imagem de referência ao modelo e pedir edições pontuais foi onde o 2.0 mostrou valor: irregularidades nas perfurações, resquício de dobradiça, vinco diagonal de goma, leve amarelado e um carimbo parcial.

As edições apareceram mais ou menos onde pedimos. O modelo introduziu um problema de proporção, mas um follow-up em linguagem simples resolveu. O resultado final não é nível forense — o "$1" parece levemente esticado, o milho é diferente —, mas o ciclo funcionou: começo torto, correção de rota, resultado utilizável em três rodadas.

Testando renderização de texto multilíngue

Renderizar texto em sistemas de escrita não latinos tem sido um ponto fraco persistente nos modelos de imagem, e a OpenAI destaca isso como uma correção importante. O lançamento especifica geração de texto de alta fidelidade em japonês, coreano, chinês, hindi e bengali — não só traduzido, mas com layout coerente e tipografia com “cara de nativa”.

Um teste justo aqui é pedir um pôster ou infográfico com um bloco de texto em um desses sistemas e validar com um leitor nativo. Pedimos ao modelo que criasse um pôster moderno de estilo de vida japonês para divulgar uma cafeteria local fictícia e seu latte sazonal de flor de cerejeira.

「居心地の良い日本のカフェの窓辺を描いた、モダンなグラフィックデザインスタイルのライフスタイルポスター。大きな窓から差し込む自然な光と、小さな観葉植物。ポスターの中央には、以下の日本語テキストが大きく、はっきりと読みやすく配置されている。フォントは現代的でクリーンなゴシック体(sans-serif)。

テキスト内容:

『桜フェア開催中。

心休まる場所で、

春の訪れを。

さくらラテ 650円』

テキストの下には、小さな文字で『HAVE A GOOD DAY』という英語のサブタイトルがあり、一番下にはロゴマークと『CAFE YUTORI』というローマ字の店名がある。全体的に暖かく、洗練されたレイアウト。」Este foi o resultado:

Segundo nosso colega que fala japonês (valeu, Sven!), está bem melhor do que em modelos anteriores, quando muitos caracteres saíam distorcidos. Aqui soa natural e é facilmente legível para nativos.

No modo de pensamento, ele até adicionou mais frases além das instruções no pequeno quadro-negro no canto inferior esquerdo. Elas se encaixam bem no contexto sem ser repetitivas, algo como: “Sazonal, sabor suave. Faça uma pausa relaxante — aproveite uma xícara que traz a primavera”.

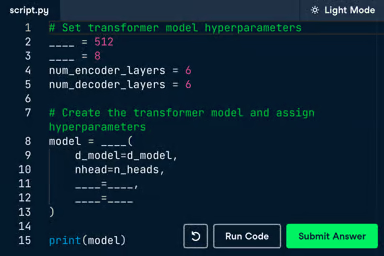

Testando o modo de pensamento e a busca na web

Precisamos ter cuidado ao testar as capacidades de busca na web, porque, se você disser ao modelo exatamente o que quer no prompt, não está testando a busca, e sim a obediência às instruções. O teste mais limpo é pedir algo muito recente e específico, dar pouquíssima informação e ver se ele preenche as lacunas corretamente.

Escolhemos a Maratona de Boston de ontem. A corrida terminou na segunda-feira, 20 de abril — um dia antes do anúncio do ChatGPT Images 2.0 — e o recorde do percurso masculino foi quebrado pela primeira vez desde 2011. Isso nos dá um conjunto concreto de fatos (vencedor, país, tempo, diferença, contexto) que o modelo não pode ter no treino, mas que são fáceis de verificar com uma busca rápida.

Aqui está o prompt, propositalmente sem detalhes. E dá para ver no resultado que o modelo realmente pesquisou na web!

Create a celebratory poster-style infographic commemorating the course record set at yesterday's Boston Marathon. Include the winner's name, country, finish time, and the margin by which the previous record was broken. Include one or two additional stats or context details that make the achievement meaningful.

O resultado é visualmente muito atraente e usa o esquema de cores da Maratona de Boston, um bônus bacana. Todos os fatos citados estão corretos, o que conferimos e validamos.

Como o modelo anterior (Images 1.5) não conseguia pesquisar na web, tínhamos certeza de que ele erraria. Testamos mesmo assim com o mesmo prompt, e aqui está o resultado:

Em termos de estilo, ele compete, mas há vários problemas numéricos aqui:

- A corrida marcou a 130ª edição da Maratona de Boston, então deveria dizer “129 anos de tradição”, não 127.

- A afirmação de que ele é o “3º corredor da história a correr abaixo de 2:04 em uma maratona” também é falsa. Cerca de 20 corredores já fizeram isso.

- Segundo o site da Boston Athletic Association, o tempo da segunda metade dele foi 1:00:02, não 1:01:05 (que talvez ainda fosse o split negativo mais rápido).

- O mais importante: o ChatGPT Images confundiu os tempos do novo e do antigo recorde. O recorde antigo era 2:03:02; o novo é 2:01:52. A diferença é de 1:10. Além disso, 2:03:02 não era o tempo correto citado em outra parte.

A busca faz diferença quando o objetivo é apresentar informações atuais de forma visual. Para usá-la, o modo de pensamento precisa estar ativado.

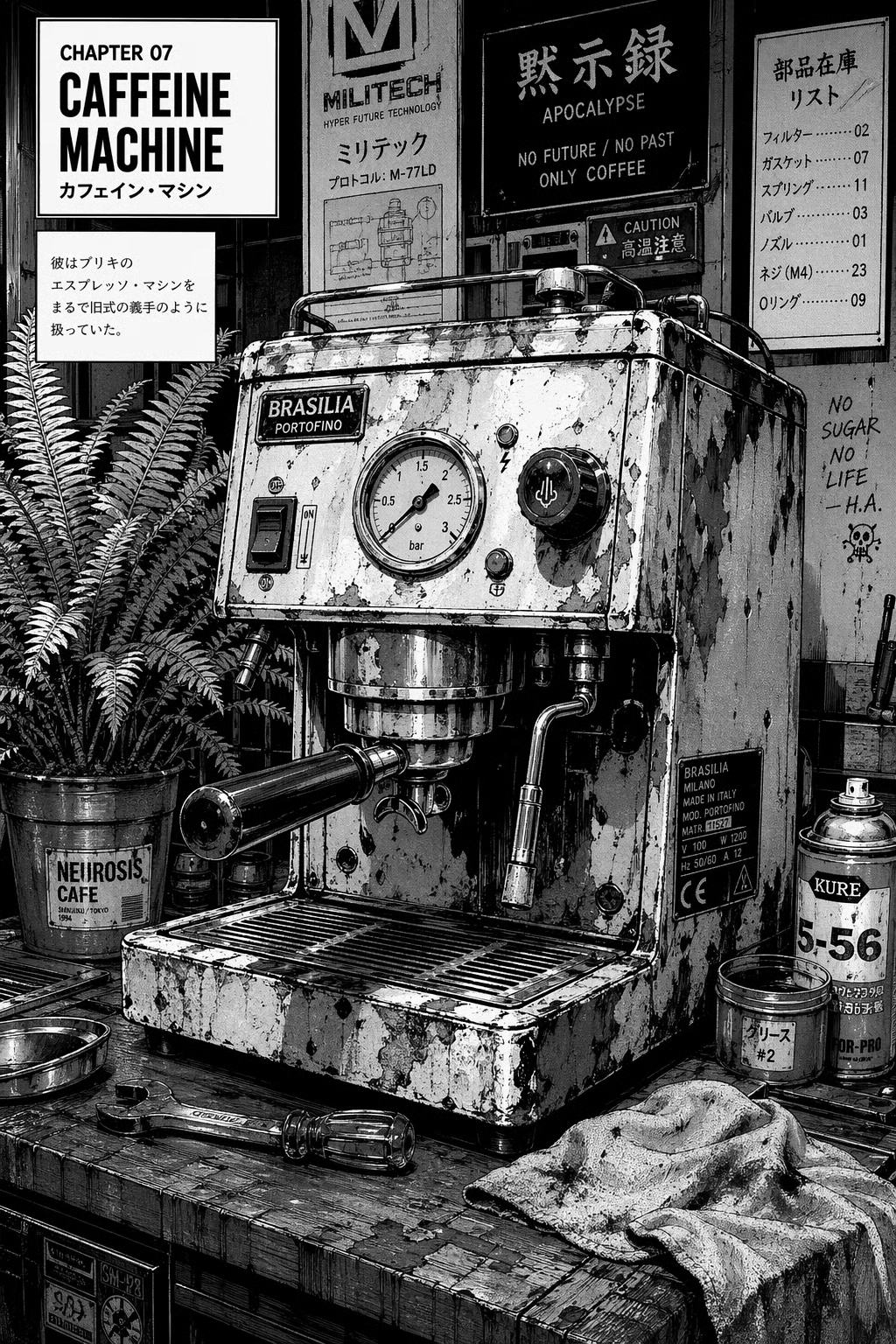

Testando amplitude estilística

A OpenAI promete avanços reais em sofisticação de estilo — em fotografia, ilustração, mangá, pixel art e outros. O teste honesto não é se uma imagem isolada fica boa, mas se o mesmo assunto renderizado em três estilos diferentes soa autêntico a cada gênero, ou se tudo volta com aquele brilho “cara de IA”.

Para testar, pedimos três versões de uma máquina de espresso em uma bancada de madeira (fotografia, mangá, pixel art). Aqui estão os prompts e os resultados:

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 35mm street photography, gritty, natural window lighting, Kodak Portra 400, shallow depth of field.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, Katsuhiro Otomo style.

Esse foi um resultado interessante — e irônico, considerando que o Image 1 ficou famoso por montagens estilo Studio Ghibli que todo mundo fazia há um ano (nós inclusive). Parece que a OpenAI ficou mais cuidadosa com direitos autorais e propriedade intelectual desde então.

Descrevendo o estilo de Katsuhiro Otomo sem citá-lo diretamente, funcionou. Um ponto: tivemos que abrir um novo chat para dar certo. No mesmo chat do prompt original, o modelo parecia perceber que estávamos tentando contornar o bloqueio.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, hyper-detailed mechanical illustration, dramatic high contrast, retro-cyberpunk aesthetic.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 16-bit pixel art, isometric perspective, crisp edges, limited SNES color palette.

Na nossa opinião, as três imagens ficaram ótimas e representam com autenticidade os estilos específicos que pedimos. A fotografia parece muito natural e as outras duas versões poderiam ser tiradas diretamente de um mangá ou de um jogo de SNES, respectivamente.

Outro ponto que chama atenção é como o modelo usou sua flexibilidade de proporção para adequar cada imagem: 16:9 horizontal para a foto, retrato para o mangá e um quadrado para o pixel art.

Testando proporções flexíveis

O lançamento suporta proporções de 3:1 a 1:3 e resoluções de até 2K. A questão interessante não é se ele produz uma imagem alta ou larga — é se o modelo recompõe de forma inteligente entre formatos ou apenas recorta.

Para expor a lógica espacial por trás do modelo, precisamos de uma cena com elementos distintos e inegociáveis em vários eixos (algo alto, algo largo e um sujeito central).

Como teste, geramos nosso sujeito (um astronauta em um cenário específico) a partir de um prompt base e pedimos ao modelo que recriasse como papel de parede de celular, banner e quadrado, para ver como a composição se adapta.

O prompt base:

A lone astronaut standing on a rocky, desolate hill. To the far left, a massive, blocky futuristic rover is parked. In the sky directly above the astronaut, a gigantic, luminous ringed planet dominates the starry backdrop.

Vamos ver como muda:

Recreate the original image as a banner

Recreate the original image as a mobile wallpaper

Recreate the original image as a square

Cada versão escolheu uma proporção adequada ao pedido, inclui todos os elementos importantes (astronauta, rover, planeta), os dispõe como pedimos no prompt original e garante centralização. Teste aprovado.

Do rascunho bruto ao resultado polido

A proposta de “parceiro de ideias” parte do princípio de que o modelo aceita entradas vagas ou bagunçadas — um esboço, uma lista de tópicos, algumas referências — e transforma em um ativo final. Esse é o ciclo central do lançamento, e o que mais vale testar diretamente.

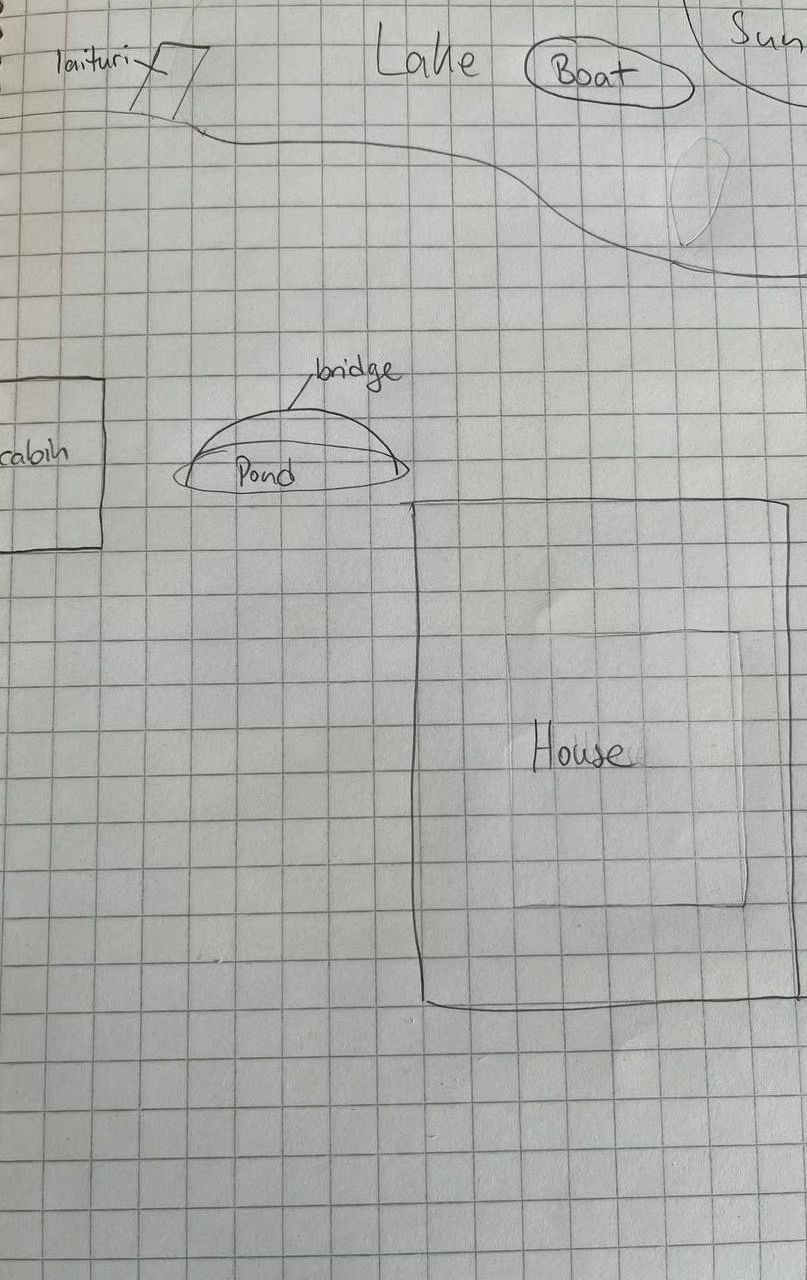

Para testar, enviamos o seguinte esboço bem rudimentar de um chalé perto do lago:

Para dificultar, ele contém vários detalhes, usa a palavra finlandesa para píer, “laituri”, e dá margem a confusão por conter dois tipos de construções (casa e chalé) e dois tipos de superfícies de água (lago e lagoa)

Turn this crude layout into a photorealistic, cinematic landscape of a modern cabin at sunset. Keep elements where I mapped them out. The cabin includes a sauna with smoke coming out of the chimney.

O resultado sem o modo de pensamento ficou decente, mas não muito fotorrealista. Ainda assim, a iluminação bate bem e a imagem captura a proposta do prompt. Conseguimos ver quase todos os elementos do esboço. Alguns detalhes ficaram fora:

- Faltou o barco

- O píer ficou na lagoa, não no lago

- A posição do sol não está no canto superior direito.

Quando tentamos o mesmo prompt com o mesmo esboço no modo de pensamento, a saída ficou bem mais realista e corrigiu todas as pequenas imprecisões:

A imagem contém todos os elementos do esboço nas posições marcadas e ficou muito caprichada. A principal lição aqui é usar o modo de pensamento para ter os melhores resultados ao transformar rascunhos em imagens fotorrealistas.

Testando criatividade

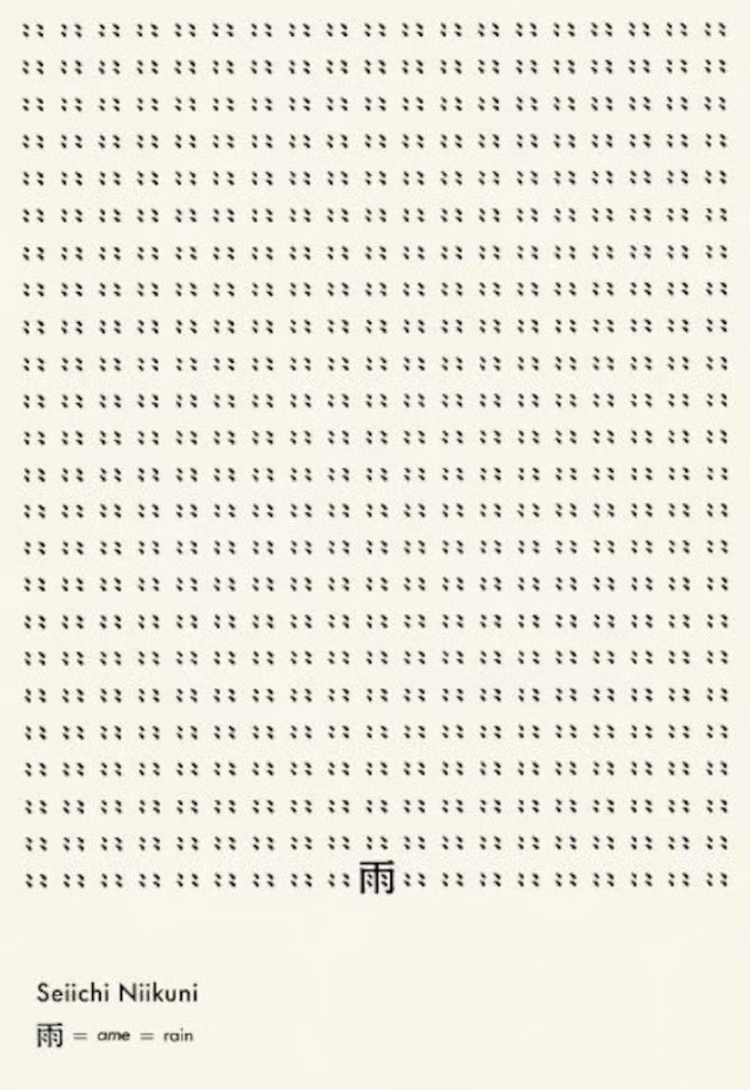

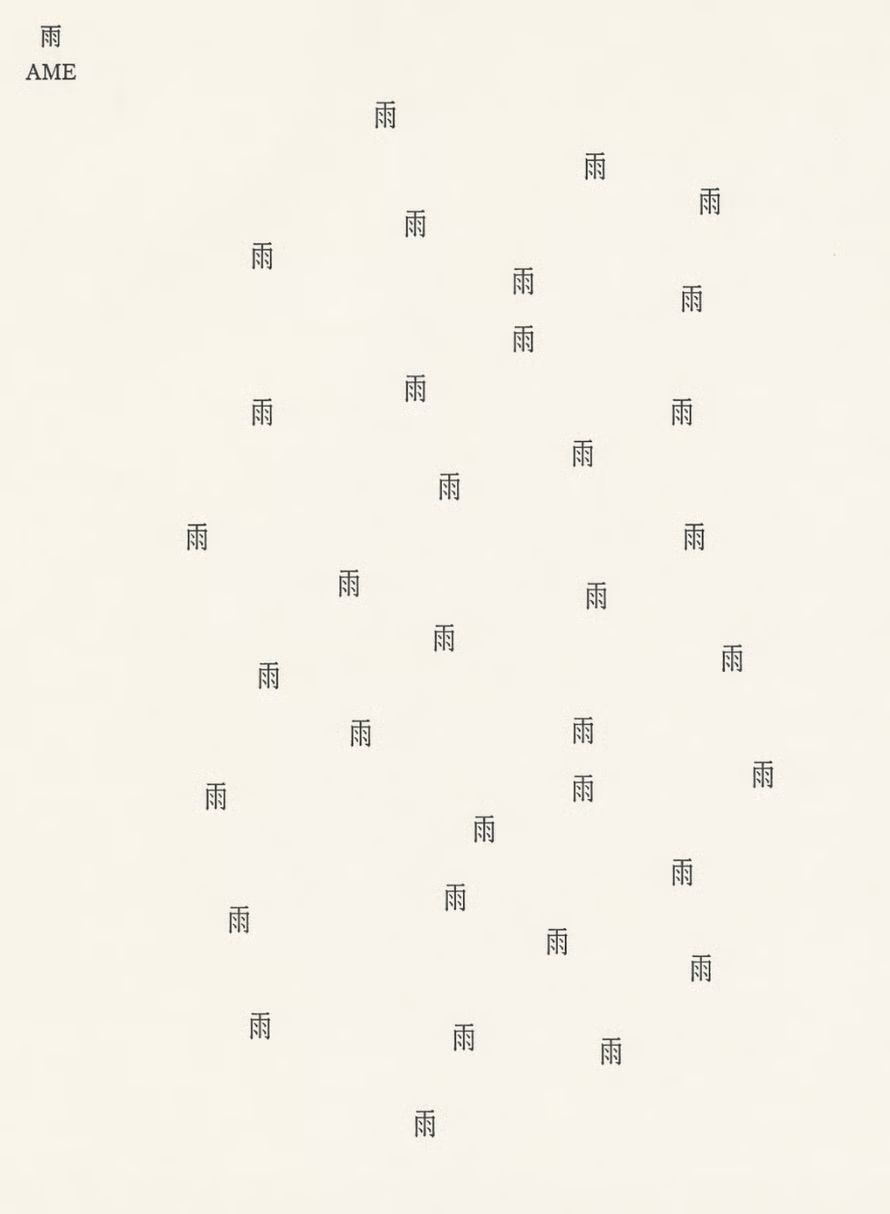

No próximo teste, queríamos ver se ele conseguiria recriar a poesia concreta de Niikuni Seiichi.

Esse poema famoso mostra o kanji japonês de chuva, cercado por chuva — é como capturar a chuva na linguagem, por assim dizer.

Aqui está o nosso prompt:

Please recreate the concrete poetry of Niikuni Seiichi. I want to see "Ame" meaning Rain. But make it different using your creativity.E aqui está a saída:

Este achamos interessante. Ele não recriou a imagem exatamente, mas criou algo intrigante. Na nova composição, o kanji de “chuva” não está cercado por chuva, mas cai como chuva. A composição dos símbolos parece bem aleatória, como você esperaria de gotas de chuva, e cria um bom contraste com o original super organizado.

Como acessar o ChatGPT Images 2.0?

O acesso segue o mesmo padrão do lançamento anterior. Ele mantém o espaço de criação dedicado introduzido em dezembro — editor em estilo de tela, artefatos persistentes, presets de estilo — e troca o motor por um modelo significativamente mais capaz.

- Web, app móvel e Codex: o ChatGPT Images 2.0 está disponível na guia Images para usuários Free, Plus e Pro, com limites de uso que escalam por plano. O acesso para Business e Enterprise costuma vir após o rollout inicial.

- API: desenvolvedores podem usar o novo modelo via OpenAI API e Azure OpenAI Service, pelos endpoints de geração e edição de imagens. Como no 1.5, a saída é precificada em tokens, e a regeneração parcial durante edições mantém custos menores do que refazer a imagem inteira a cada vez.

ChatGPT Images 2.0 vs. Nano Banana 2

Você pode estar se perguntando como o ChatGPT Images 2.0 se compara ao Nano Banana 2. Ambos são recentes, são a experiência padrão em seus ecossistemas e são apresentados com foco em velocidade, raciocínio e inteligência de mundo real.

|

ChatGPT Images 2.0 |

Nano Banana 2 |

|

|

Arquitetura base |

GPT-Image-2 (sucessor do GPT-Image-1.5) |

Gemini 3.1 Flash |

|

Modelo de edição |

Precisão: seleção por área e edição no lugar |

Raciocínio: conversacional e masking inteligente |

|

Fluxo de trabalho |

Espaço criativo dedicado (guia Images) |

Integrado ao chat do Gemini |

|

Iteração |

Eficiente: regeneração parcial |

Rápido: 4–6s em 1K, ajustável via Thinking Mode |

|

Aderência ao mundo real |

Raciocínio embutido e conhecimento atualizado |

Image Search Grounding (puxa referências ao vivo do Google Search) |

|

Consistência multipainel |

Forte em sequências e folhas de personagem |

Forte, com foco na consistência do sujeito |

|

Texto multilíngue |

Grande upgrade sobre o 1.5; amplo suporte a escrituras |

Forte, especialmente em chinês e layouts do leste asiático |

|

Resolução padrão |

Padrão + proporções flexíveis |

2K padrão no app Gemini |

|

Ecossistema |

OpenAI e Azure |

Pilha Google / Gemini, Search, Lens |

Quando usar ChatGPT Images 2.0 vs. Nano Banana 2

Use o ChatGPT Images 2.0 quando…

- Você precisa de um ciclo de edição guiado por referência. O modelo aceita uma imagem de referência e aplica mudanças direcionadas (detalhes de textura, correções de posição, ajustes de proporção) em várias rodadas, com follow-ups em linguagem natural guiando o resultado sem recomeçar do zero — o que também economiza tokens

- Você vai transformar entradas brutas em ativos finalizados. O modo de pensamento resolve esboços vagos e instruções espaciais em composições fotorrealistas com elementos posicionados exatamente como pretendido

- A precisão factual dentro da imagem é crítica. A busca na web traz informações em tempo real e as renderiza corretamente dentro da própria imagem, tornando-a confiável para pôsteres de eventos, infográficos de notícias ou qualquer visual em que números e nomes precisam estar certos. Lembre-se de usar o modo de pensamento para habilitar a busca

Use o Nano Banana 2 quando…

- Você quer inserir sujeitos ou locais reais específicos em uma cena. O Image Search Grounding puxa referências visuais ao vivo do Google, reconstruindo com precisão lugares específicos (até por coordenadas de GPS) e combinando-os com personagens consistentes em uma única geração

- Você precisa manter identidade entre vários personagens e objetos no mesmo fluxo. O modelo suporta explicitamente até cinco personagens e quatorze referências no total (personagens + objetos) com consistência rígida. Ótima escolha para storyboards, fotos de produto ou narrativas com vários personagens

- Você está construindo dentro do ecossistema Google. O Nano Banana é nativamente integrado ao chat Gemini, Google Search, Google Ads, Firebase e Vertex AI

Ambos são boas escolhas para texto em imagem, amplitude estilística e edição conversacional.

Considerações finais

A ideia de “parceiro visual de ideias” se sustenta — mas só com o modo de pensamento ligado. Sem ele, o modelo patina em lógica espacial e fotorrealismo; com ele, transforma entradas ambíguas em saídas que parecem colaboração, não mecânicas. Duas áreas em que o modelo brilha mesmo sem o modo de pensamento são a autenticidade estilística e a flexibilidade de proporção.

A busca na web é, de longe, o maior upgrade em relação ao Images 1.5. No teste da Maratona de Boston, isso ficou claro: o 2.0 acertou todos os fatos, enquanto o 1.5 não estava atualizado. Importante: a busca só funciona com o modo de pensamento ativado.

Um achado interessante foi que os guardrails de copyright estão mais rígidos, e isso aparece. Se você quer recriar um estilo pelo qual uma empresa ou pessoa é reconhecida, precisa dar o passo extra de identificar a essência do estilo e descrevê-la (o que, convenhamos, hoje é fácil).

No geral, o modelo é um upgrade significativo em relação ao anterior e desafia o status do Nano Banana 2 como a principal ferramenta para geração e edição de imagens com IA.

Para tirar o máximo dessas ferramentas, saber fazer prompts é uma habilidade essencial. Recomendamos muito fazer os cursos Understanding Prompt Engineering e Prompt Engineering with the OpenAI API para uma base teórica e prática.

Editor de Ciência de Dados @ DataCamp | Fazer previsões e construir com APIs é a minha paixão.