Curso

Ha pasado casi exactamente un año desde que se lanzó la primera versión de ChatGPT Images con un modelo llamado GPT Image 1. OpenAI ha renovado de nuevo su modelo de imagen, y ahora presenta una nueva idea: el "generador de imágenes" pasa a ser un "compañero visual de ideas".

En este artículo veremos qué hay de nuevo, cómo se compara con su predecesor ChatGPT Images 1.5, cómo se enfrenta a Nano Banana 2 de Google y en qué destaca el modelo (y en qué no).

Te recomendamos también nuestro análisis del LLM más reciente de OpenAI, GPT-5.5.

¿Qué es ChatGPT Images 2.0?

ChatGPT Images 2.0 es el modelo de imagen de nueva generación de OpenAI. Se presenta como una herramienta capaz de razonar, investigar y, después, renderizar.

¿Quieres iniciarte en la IA Generativa?

Aprende a trabajar con LLMs en Python directamente en tu navegador

¿Qué hay de nuevo en ChatGPT Images 2.0?

Uno de los principales titulares del lanzamiento de ChatGPT Images 1.5 fue el gran aumento de velocidad. Se hablaba de que era 4 veces más rápido. Intentamos verificarlo y vimos que aplicaba a las ediciones, no a la generación de imágenes nuevas.

Esta vez, la gran promesa es la inteligencia. ChatGPT Images 2.0 es un modelo de imagen que "piensa": se supone que busca información, razona sobre los hechos y traduce entradas poco definidas (notas, bocetos, referencias) en visuales pulidos con mucha menos indicación manual.

Otros temas destacados del anuncio:

- Mayor precisión y control sobre la propia generación

- Mejor rendimiento en varios idiomas y alfabetos

- Más sofisticación estilística y realismo

- Inteligencia del mundo real mejorada integrada en el modelo

- Relaciones de aspecto flexibles para todo, desde móvil hasta formatos de banner

Un modelo que piensa

Una de las afirmaciones más potentes es que el nuevo modelo "piensa" y actúa como un "compañero visual de ideas". La idea es que unos agentes trabajan entre bambalinas para entender bien la tarea y razonar sobre ella antes de ejecutar la generación.

Su conocimiento del mundo se ha actualizado con corte en diciembre de 2025, por lo que los resultados son más precisos en contexto. Según se anuncia, esto convierte al nuevo modelo en una gran opción para gráficos educativos y flujos de trabajo multietapa que requieran contexto.

Buscar en la web

Para salvar la brecha entre la fecha de corte y la información reciente, Images 2.0 puede buscar en la web para encontrar datos relevantes. No está claro en las notas de OpenAI cómo funciona exactamente, pero entendemos que la búsqueda web actúa como una herramienta llamada por el agente pensante mencionado arriba.

Crea varias imágenes con un solo prompt

El nuevo modelo también permite de forma nativa generar varias imágenes a partir del mismo prompt. Antes era posible con un truco en la API (pidiendo una "composición"), pero ahora también se puede hacer desde la interfaz, hasta diez imágenes. OpenAI promete continuidad de personajes y objetos en todos esos resultados.

Probando ChatGPT Images 2.0

Hora de ver de qué es capaz el nuevo modelo. Probamos las siguientes funciones y capacidades de Images 2.0:

- Flujo de trabajo de edición

- Modo de pensamiento y búsqueda web

- Rango estilístico

- Pulido a partir de bocetos

- Flexibilidad de relación de aspecto

- Creatividad

Prueba del flujo de edición

La propuesta de OpenAI para la 2.0 se apoya en la iteración: entrada tosca, resultado pulido, con mejoras en seguir instrucciones y renderizar texto denso. Probamos ese ciclo usando un famoso sello estadounidense de 1898 llamado Western Cattle in Storm.

Esta es una foto de uno de los sellos en calidad Fine.

Para poner a prueba específicamente el flujo de edición, usamos el siguiente prompt sin modo de pensamiento. Esto también significa que el modelo no tiene acceso a búsquedas web, que probamos por separado.

Please create for me a picture of the famous 1898 Western Cattle in Storm stamp issued by the U.S. Post Office as part of the Trans-Mississippi Issue . The name of the stamp is "Western Cattle in Storm" Quality should be Fine to Very Fine -Centering: design shifted right, left margin twice as wide as right margin, perfs nearly touching design on the right side -Perforations: two short teeth on the top edge, slightly uneven spacing along the bottom -Gum: quarter-inch matte hinge remnant in upper-center of back, small paper fragment still -attached -Paper: diagonal gum bend across lower-left quadrant, light yellow toning along top edge -Cancellation: partial black circular datestamp in lower-right corner, moderate coverage over the cattleY este es el resultado:

Solo con texto no funcionó. La descripción detallada del sello y su estado resultó incorrecta en la mayoría de aspectos clave: color erróneo, disposición del valor facial equivocada, descentre caricaturesco. Reproducir un objeto histórico concreto solo desde texto es pedir mucho.

Donde 2.0 se gana su sitio es al darle la imagen de referencia y pedir ediciones puntuales: irregularidades en perforaciones, resto de bisagra, pliegue diagonal del engomado, leve decoloración y matasellos parcial.

Las ediciones cayeron más o menos donde pedimos. El modelo introdujo un problema de relación de aspecto, pero se corrigió con una indicación sencilla en lenguaje natural. El resultado final no es para análisis forense —el "$1" parece algo estirado, el maíz es distinto—, pero el ciclo funcionó: comienzo flojo, corrección de rumbo, resultado útil en tres turnos.

Prueba de renderizado de texto multilingüe

El renderizado de texto en alfabetos no latinos ha sido un punto débil recurrente en los modelos de imagen, y OpenAI lo destaca como un arreglo principal. El lanzamiento especifica generación de texto de alta fidelidad en japonés, coreano, chino, hindi y bengalí —no solo traducido, sino con maquetación coherente y tipografía que se siente nativa.

Una prueba justa consiste en pedir un póster o infografía con un bloque de texto en una de estas escrituras y validarlo con una persona nativa. Le pedimos al modelo un póster moderno de estilo de vida japonés que anunciara una cafetería local ficticia y su latte de flor de cerezo de temporada.

「居心地の良い日本のカフェの窓辺を描いた、モダンなグラフィックデザインスタイルのライフスタイルポスター。大きな窓から差し込む自然な光と、小さな観葉植物。ポスターの中央には、以下の日本語テキストが大きく、はっきりと読みやすく配置されている。フォントは現代的でクリーンなゴシック体(sans-serif)。

テキスト内容:

『桜フェア開催中。

心休まる場所で、

春の訪れを。

さくらラテ 650円』

テキストの下には、小さな文字で『HAVE A GOOD DAY』という英語のサブタイトルがあり、一番下にはロゴマークと『CAFE YUTORI』というローマ字の店名がある。全体的に暖かく、洗練されたレイアウト。」Así quedó el resultado:

Según un compañero que habla japonés (¡gracias, Sven!), se ve mucho mejor que en modelos anteriores, cuando muchos caracteres salían ininteligibles. Aquí se siente natural y se puede leer sin problema por hablantes nativos.

En modo de pensamiento, incluso añadió más frases más allá de las instrucciones del prompt en la pizarra pequeña de la esquina inferior izquierda. Encajan muy bien en el contexto sin ser repetitivas, y vienen a decir algo así como: «Sabor suave de temporada. Tómate un respiro: disfruta de una taza que te trae la primavera».

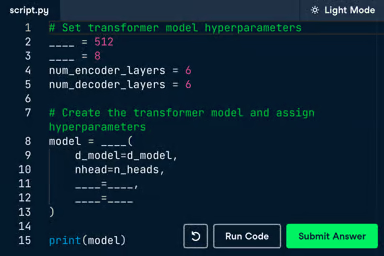

Prueba del modo de pensamiento y la búsqueda web

Tuvimos que ser cuidadosos al probar la búsqueda web, porque si le dices al modelo lo que quieres en el prompt, no pruebas la búsqueda, sino la capacidad de seguir instrucciones. La prueba más limpia es pedir algo muy reciente y específico, darle casi ninguna información y ver si puede completar los huecos correctamente.

Elegimos la maratón de Boston de ayer. La carrera terminó el lunes 20 de abril —el día antes del anuncio de ChatGPT Images 2.0— y se batió el récord del circuito masculino por primera vez desde 2011. Eso nos da un conjunto concreto de datos (ganador, país, tiempo, margen, contexto) que el modelo no puede tener por entrenamiento, pero que son fáciles de verificar con una búsqueda rápida.

Este fue el prompt, a propósito sin detalles. Y se ve en el resultado que el modelo sí busca en la web.

Create a celebratory poster-style infographic commemorating the course record set at yesterday's Boston Marathon. Include the winner's name, country, finish time, and the margin by which the previous record was broken. Include one or two additional stats or context details that make the achievement meaningful.

El resultado es muy atractivo visualmente y mantiene los colores corporativos de la maratón de Boston, un buen detalle. Todos los hechos mencionados son correctos; los contrastamos y verificamos.

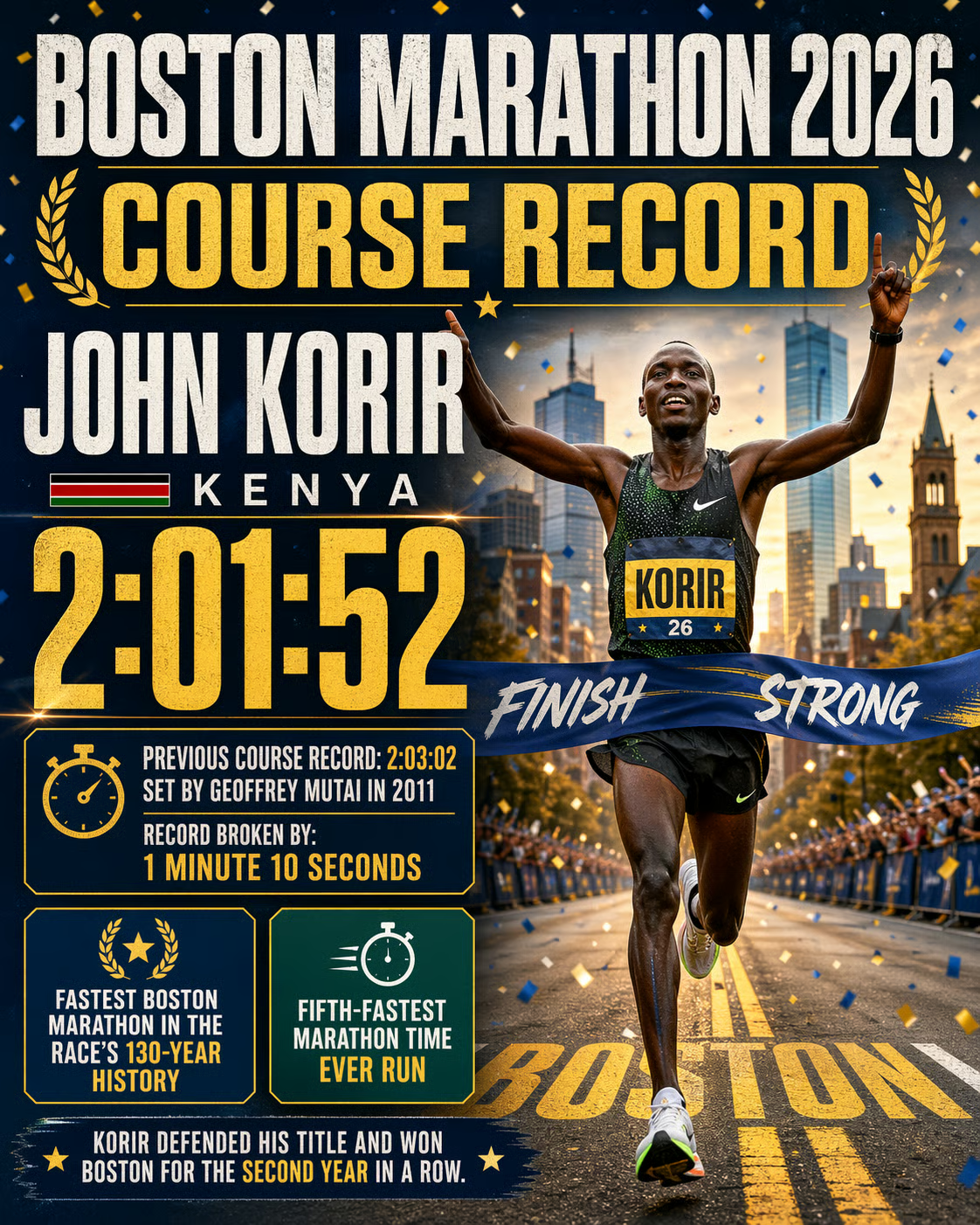

Como el modelo anterior (Images 1.5) no podía buscar en la web, teníamos claro que daría una respuesta incorrecta. Aun así lo probamos con el mismo prompt, y este fue el resultado:

En estilo puede competir, pero hay bastantes problemas con los números:

- Esta edición fue la 130.ª maratón de Boston, así que debería decir «129 años de tradición», no 127.

- La afirmación de que es el «3er corredor de la historia en bajar de 2:04 en maratón» también es falsa. Lo han logrado alrededor de 20 corredores.

- Según la web de la Boston Athletic Association, su segunda media maratón fue 1:00:02, no 1:01:05 (que quizá seguía siendo el parcial más rápido).

- Lo más importante: ChatGPT Images confundió los tiempos del récord nuevo y antiguo. El antiguo era 2:03:02; el nuevo es 2:01:52. La diferencia es 1:10 minutos. Además, 2:03:02 no era el tiempo correcto en su cartel.

La capacidad de búsqueda marca la diferencia al presentar información actual de forma visual. Para usarla, el modo de pensamiento debe estar activado.

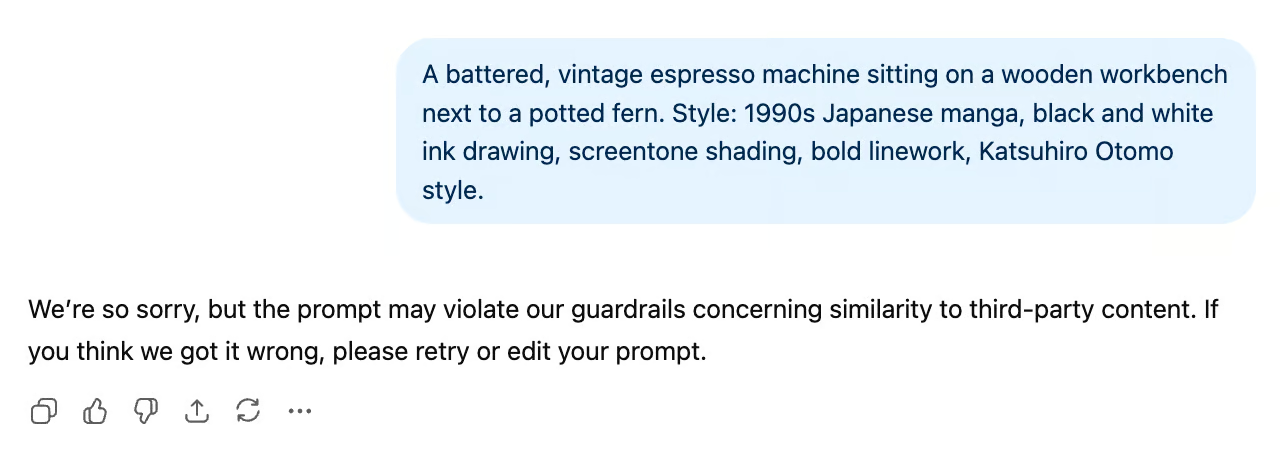

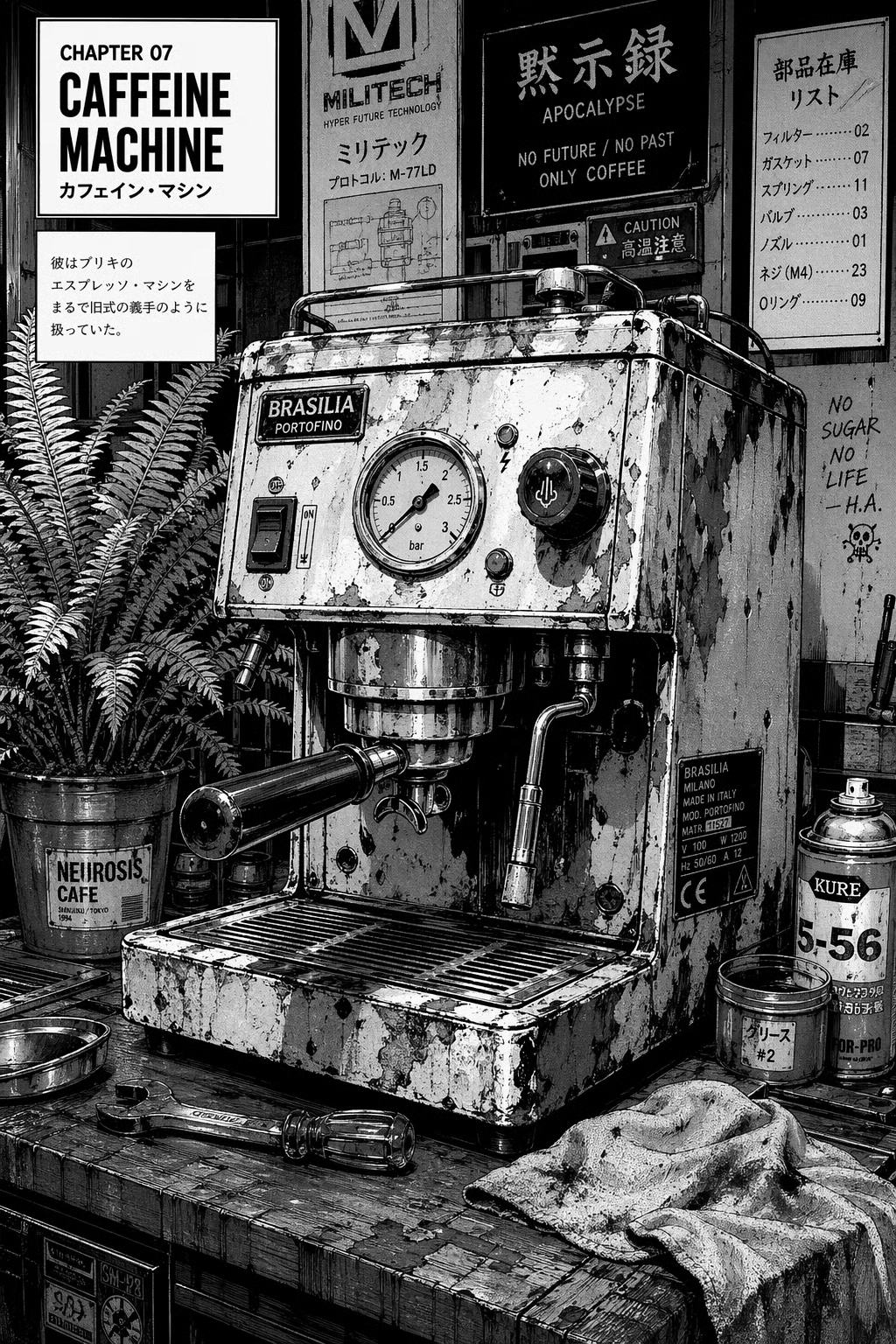

Prueba del rango estilístico

OpenAI promete avances reales en sofisticación de estilos —fotografía, ilustración, manga, pixel art y otros. La prueba honesta no es si una imagen aislada se ve bien, sino si el mismo sujeto en tres estilos distintos se percibe auténtico para cada género o si todo regresa con el mismo barniz "AI" por debajo.

Para probarlo, pedimos tres versiones de una cafetera espresso sobre un banco de trabajo de madera (fotografía, manga, pixel art). Estos son los prompts y resultados:

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 35mm street photography, gritty, natural window lighting, Kodak Portra 400, shallow depth of field.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, Katsuhiro Otomo style.

Un resultado interesante y, curiosamente, irónico si pensamos que Image 1 se hizo famoso por los montajes al estilo Studio Ghibli que todo el mundo hacía hace un año (nosotros incluidos). Parece que OpenAI es ahora más cauta con el copyright y la propiedad intelectual.

Describiendo el estilo de Katsuhiro Otomo sin mencionarlo explícitamente, funcionó. Un apunte: tuvimos que abrir un chat nuevo para que funcionara. En el mismo chat del prompt original, el modelo parecía darse cuenta de que intentábamos esquivar el bloqueo.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 1990s Japanese manga, black and white ink drawing, screentone shading, bold linework, hyper-detailed mechanical illustration, dramatic high contrast, retro-cyberpunk aesthetic.

A battered, vintage espresso machine sitting on a wooden workbench next to a potted fern. Style: 16-bit pixel art, isometric perspective, crisp edges, limited SNES color palette.

En nuestra opinión, las tres imágenes son excelentes y reflejan con autenticidad los estilos solicitados. La fotografía resulta muy natural y las otras dos podrían salir directamente de un manga o de un videojuego de SNES, respectivamente.

Otra cosa llamativa en la prueba anterior es cómo el modelo aprovechó su flexibilidad de relación de aspecto para adaptar cada imagen: 16:9 apaisado para la foto, formato vertical para el manga y un cuadrado para el pixel art.

Prueba de relaciones de aspecto flexibles

El lanzamiento admite relaciones de aspecto de 3:1 a 1:3 y resoluciones de hasta 2K. La cuestión interesante no es si puede producir una imagen alta o ancha, sino si el modelo recompone con inteligencia según el formato o simplemente recorta.

Para exponer la lógica espacial subyacente, necesitamos una escena con elementos claros e irrenunciables en varios ejes (algo alto, algo ancho y un sujeto central).

Como prueba, generamos nuestro sujeto (un astronauta en un entorno concreto) con un prompt base, y luego pedimos al modelo recrearlo como fondo de móvil, banner y cuadrado para ver cómo se adapta la composición.

Prompt base:

A lone astronaut standing on a rocky, desolate hill. To the far left, a massive, blocky futuristic rover is parked. In the sky directly above the astronaut, a gigantic, luminous ringed planet dominates the starry backdrop.

Veamos cómo cambia:

Recreate the original image as a banner

Recreate the original image as a mobile wallpaper

Recreate the original image as a square

Cada versión eligió una relación de aspecto adecuada, incluye todos los elementos importantes (astronauta, rover, planeta), los dispone como pedimos en el prompt original y se asegura de centrarlos. Prueba superada.

De entrada tosca a resultado pulido

El enfoque de "compañero de ideas" se basa en que el modelo acepte entradas vagas o desordenadas —un boceto, unas viñetas, un puñado de referencias— y las convierta en un recurso finalizado. Este es el ciclo sobre el que se construye realmente el lanzamiento, y el que más merece la pena probar.

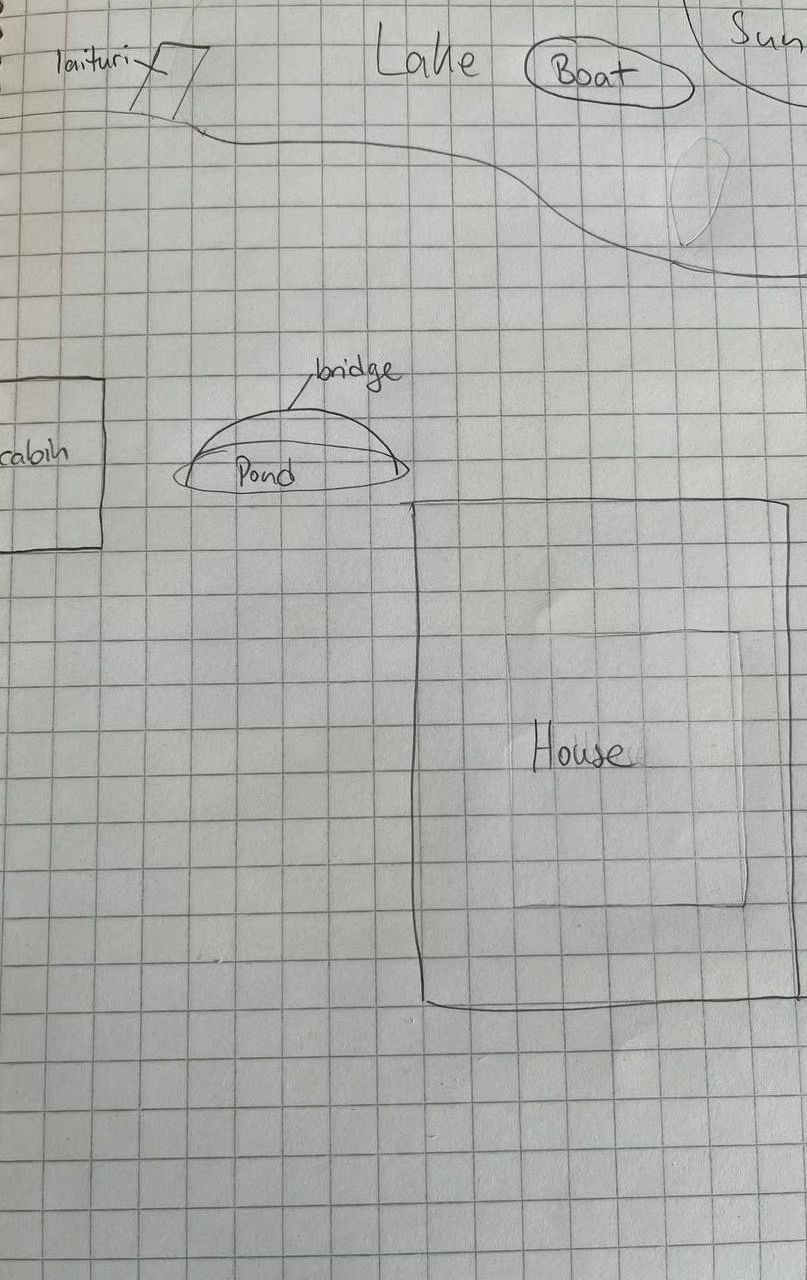

Para probarlo, subimos este boceto a lápiz muy rudimentario de una cabaña junto al lago:

Para complicarlo, incluye bastantes detalles, usa la palabra finlandesa para embarcadero, «laituri», y da pie a confusión al contener dos tipos de edificios (casa y cabaña) y dos superficies de agua (lago y estanque)

Turn this crude layout into a photorealistic, cinematic landscape of a modern cabin at sunset. Keep elements where I mapped them out. The cabin includes a sauna with smoke coming out of the chimney.

El resultado sin modo de pensamiento se ve decente, aunque no muy fotorrealista. Aun así, la iluminación encaja bien y la imagen capta a la perfección el tono del prompt. Se reconocen casi todos los elementos del boceto. Algunos detalles fallan:

- Falta la barca

- El embarcadero está en el estanque, no en el lago

- El sol no está en la esquina superior derecha

Cuando probamos el mismo prompt con el mismo boceto en modo de pensamiento, la salida parecía mucho más realista y corregía todas las pequeñas imprecisiones:

La imagen contiene cada elemento del boceto en su posición asignada y se ve muy cuidada. La conclusión aquí es usar el modo de pensamiento para obtener los mejores resultados al convertir bocetos en imágenes fotorrealistas.

Prueba de creatividad

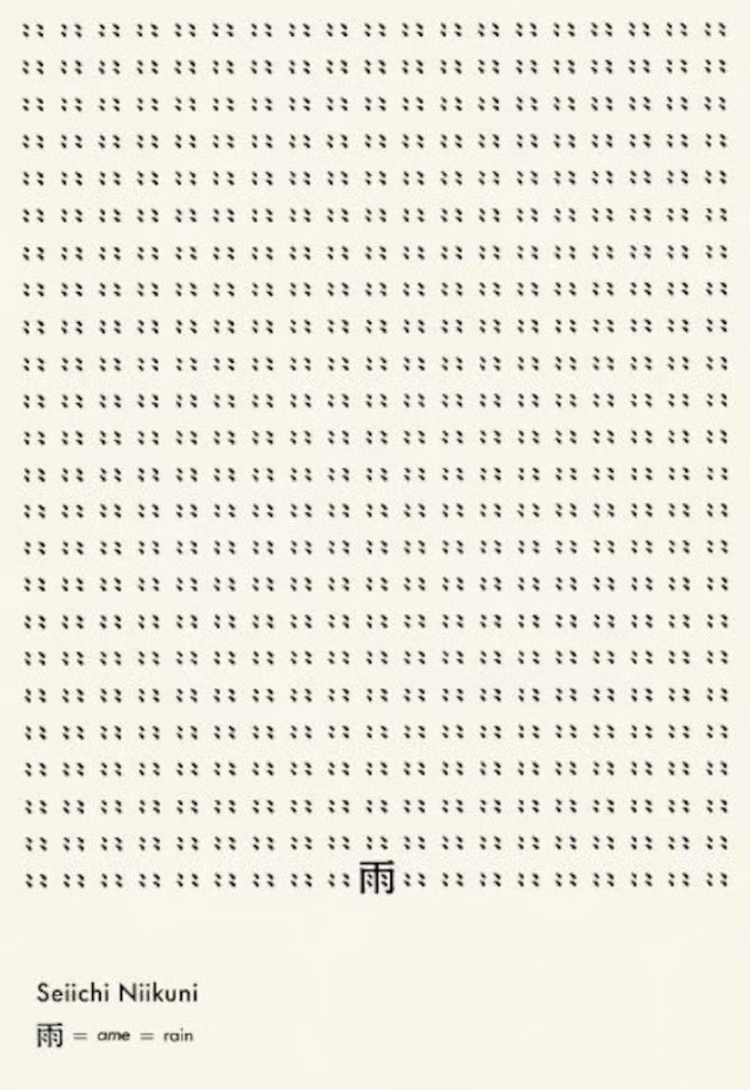

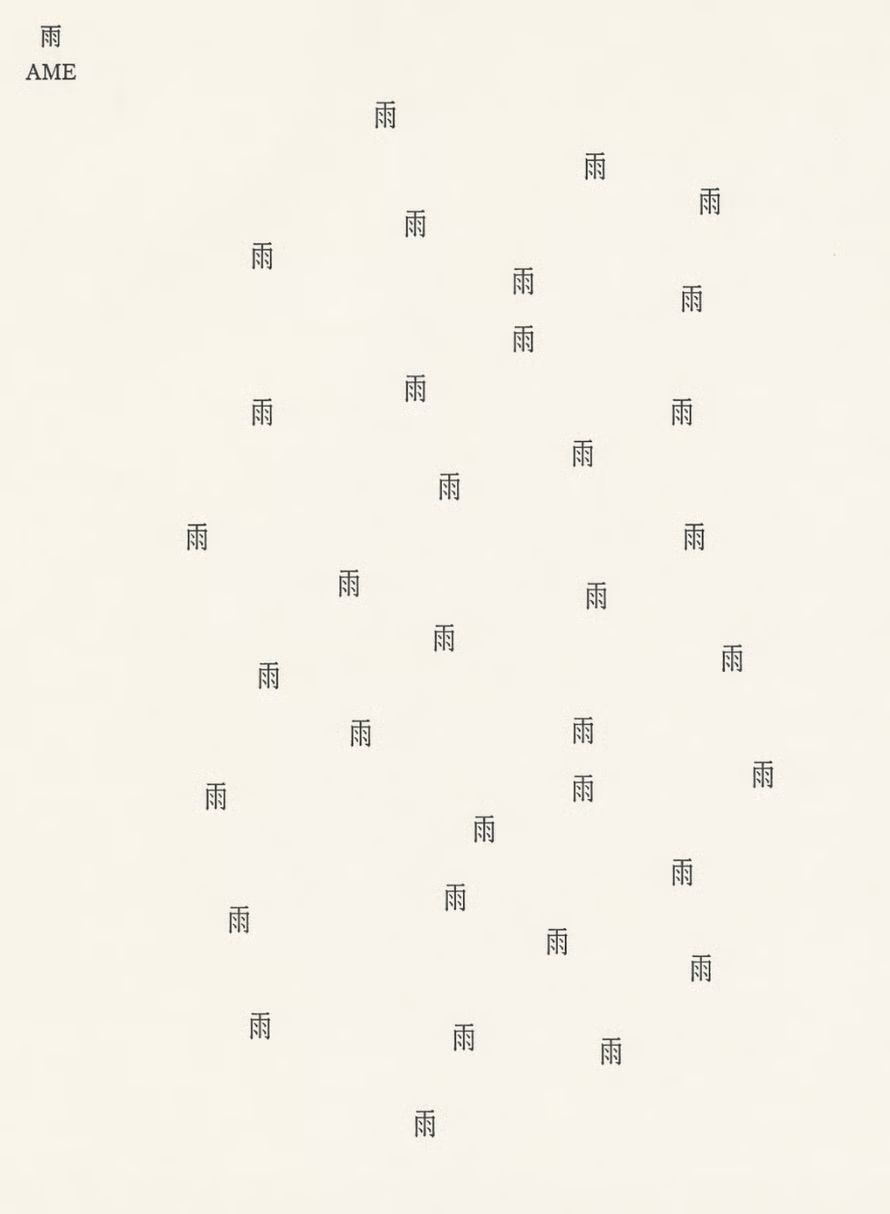

Para la siguiente prueba, quisimos ver si podía recrear la poesía concreta de Niikuni Seiichi.

Este famoso poema muestra el kanji japonés de lluvia, rodeado de lluvia; es como atrapar la lluvia en el lenguaje, así lo vemos.

Este fue nuestro prompt:

Please recreate the concrete poetry of Niikuni Seiichi. I want to see "Ame" meaning Rain. But make it different using your creativity.Y este fue el resultado:

Este nos parece interesante. No recreó exactamente la imagen, pero creó algo sugerente. En la nueva composición, el kanji de «lluvia» no está rodeado por lluvia, sino que cae como lluvia. La composición de los símbolos parece bastante aleatoria, como gotas de lluvia, pero crea un contraste bonito con el orden del original.

¿Cómo puedo acceder a ChatGPT Images 2.0?

El acceso sigue el mismo patrón que en la versión anterior. Mantiene el espacio de trabajo creativo dedicado que llegó en diciembre —editor tipo lienzo, artefactos persistentes, preajustes de estilo— y sustituye el motor por un modelo significativamente más capaz.

- Web, app móvil y Codex: ChatGPT Images 2.0 está disponible en la pestaña Images para usuarios Free, Plus y Pro, con límites de uso que escalan por plan. El acceso para Business y Enterprise suele llegar después del despliegue inicial.

- API: Los desarrolladores pueden usar el nuevo modelo a través de la API de OpenAI y Azure OpenAI Service, mediante los endpoints de generación y edición de imágenes. Como en 1.5, la salida se tarifica por tokens, y la regeneración parcial durante ediciones mantiene los costes más bajos que regenerar la imagen completa cada vez.

ChatGPT Images 2.0 vs. Nano Banana 2

Puede que te preguntes cómo se compara ChatGPT Images 2.0 con Nano Banana 2. Ambos modelos son recientes, son la experiencia por defecto en sus respectivos ecosistemas y se presentan en torno a velocidad, razonamiento e inteligencia del mundo real.

|

ChatGPT Images 2.0 |

Nano Banana 2 |

|

|

Arquitectura base |

GPT-Image-2 (sucesor de GPT-Image-1.5) |

Gemini 3.1 Flash |

|

Modelo de edición |

Precisión: selección por área y edición in situ |

Razonamiento: conversación y enmascarado inteligente |

|

Flujo de trabajo |

Espacio creativo dedicado (pestaña Images) |

Integrado en el chat de Gemini |

|

Iteración |

Eficiente: regeneración parcial |

Rápida: 4–6 s a 1K, ajustable vía Thinking Mode |

|

Anclaje al mundo real |

Razonamiento integrado y conocimiento actualizado |

Image Search Grounding (tira de referencias en vivo de Google Search) |

|

Consistencia multipanel |

Sólida en secuencias y hojas de personajes |

Sólida, con foco en consistencia del sujeto |

|

Texto multilingüe |

Gran mejora sobre 1.5; soporte amplio de escrituras |

Fuerte, especialmente en chino y maquetaciones de Asia oriental |

|

Resolución por defecto |

Estándar + relaciones de aspecto flexibles |

2K por defecto en la app de Gemini |

|

Ecosistema |

OpenAI y Azure |

Stack Google / Gemini, Search, Lens |

Cuándo usar ChatGPT Images 2.0 y cuándo Nano Banana 2

Usa ChatGPT Images 2.0 cuando…

- Necesites un bucle de edición guiado por referencia. El modelo acepta una imagen de referencia y aplica cambios dirigidos (detalles de textura, correcciones de posición, ajustes de relación de aspecto) en varias iteraciones, y las indicaciones en lenguaje natural orientan el resultado sin empezar de cero, ahorrando también tokens

- Vayas a convertir entradas toscas en recursos pulidos. El modo de pensamiento resuelve bocetos vagos e instrucciones espaciales en composiciones fotorrealistas precisas con los elementos colocados exactamente como querías

- La exactitud factual dentro de la imagen sea crítica. La búsqueda web incorpora información en vivo y la renderiza correctamente dentro de la imagen, lo que la hace fiable para pósteres de eventos, infografías de actualidad o cualquier visual donde los números y nombres deban estar bien. Recuerda activar el modo de pensamiento para habilitar la búsqueda web

Usa Nano Banana 2 cuando…

- Vayas a ubicar sujetos o lugares reales específicos en una escena. Image Search Grounding extrae referencias visuales en vivo de Google, reconstruyendo con precisión lugares concretos (incluso por coordenadas GPS) y combinándolos con personajes consistentes en una sola generación

- Necesites mantener la identidad a lo largo de varios personajes y objetos en un mismo flujo. El modelo admite explícitamente hasta cinco personajes y catorce referencias en total (personajes + objetos) con consistencia estricta. Es una gran opción para storyboards, fotos de producto o narrativas multicarácter

- Estés construyendo dentro del ecosistema de Google. Nano Banana está integrado de forma nativa en el chat de Gemini, Google Search, Google Ads, Firebase y Vertex AI

Ambos son buenas opciones en renderizado de texto en imagen, rango estilístico y edición conversacional.

Conclusiones

La idea de "compañero visual de ideas" se sostiene, pero solo con el modo de pensamiento activado. Sin él, el modelo sufre con la lógica espacial y el fotorrealismo; con él, convierte entradas ambiguas en resultados que se sienten colaborativos, no mecánicos. Dos áreas en las que brilla incluso sin modo de pensamiento son la autenticidad estilística y la flexibilidad de relación de aspecto.

La búsqueda web es la mayor mejora respecto a Images 1.5. En la prueba de la maratón de Boston, se ve clara la diferencia: 2.0 acertó todos los datos, mientras que 1.5 no estaba al día. Es importante saber que la búsqueda web también solo funciona en modo de pensamiento.

Otra conclusión interesante es que las barreras de copyright son más estrictas, y se nota. Si quieres recrear el estilo por el que se reconoce a una empresa o persona, tendrás que dar el paso extra de identificar la esencia de su estilo y describirla (lo cual, dicho sea de paso, hoy en día es bastante sencillo).

En conjunto, el modelo supone una mejora notable frente a su predecesor y le disputa a Nano Banana 2 su condición de herramienta de referencia en generación y edición de imágenes con IA.

Para sacar el máximo partido a estas herramientas, saber hacer prompts es una habilidad clave. Te recomendamos encarecidamente nuestros cursos Understanding Prompt Engineering y Prompt Engineering with the OpenAI API para asentar bases teóricas y prácticas.

Editor de ciencia de datos en DataCamp | Me encanta hacer previsiones y crear con API.