course

Har du någonsin kört ett t-test, fått ett prydligt p-värde och sedan insett att du aldrig kontrollerade om dina data var normalfördelade?

Statistiska test berättar inte när deras antaganden bryts. De rapporterar bara ett värde. Problemet är att test som t-test och ANOVA förutsätter att dina data följer en normalfördelning. Om så inte är fallet bygger du slutsatser på skakig grund.

Normalitetstester ger dig ett sätt att verifiera det antagandet. Det finns både visuella och statistiska metoder, och att veta vilka du ska använda – och hur du läser resultaten – är det som gör att du kan stå tryggt bakom dina slutsatser.

I den här artikeln går jag igenom de vanligaste visuella och statistiska metoderna för att kontrollera normalitet, visar hur du kör dem i Python och R och förklarar vad du ska göra när dina data inte klarar testet.

Vad normalfördelning innebär i praktiken

Du har säkert sett klockkurvan förut – men här är vad den faktiskt betyder för dina data.

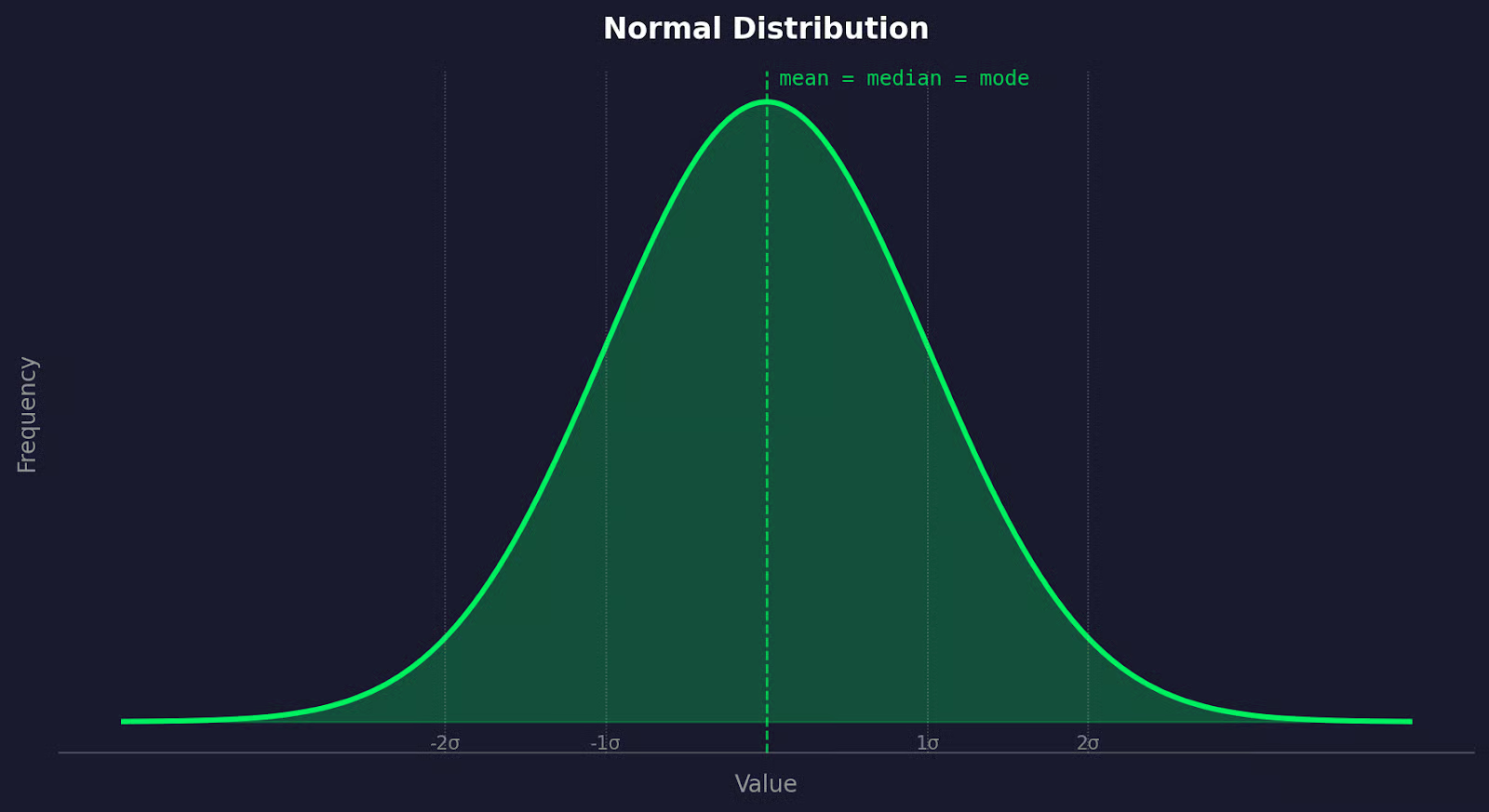

En normalfördelning är ett mönster där de flesta värdena klustrar kring mitten och färre värden dyker upp ju längre ut du rör dig åt något håll. Om du ritar upp det får du en symmetrisk, klockformad kurva. Vänster sida speglar höger sida.

Diagram över normalfördelning

Det som gör normalfördelningen unik är att medelvärde, median och typvärde sammanfaller i samma punkt – klockans centrum. Det finns ingen skevhet åt vänster eller höger. Med andra ord är data i balans.

Det här syns hela tiden i verkliga mätdata. Människors längd, blodtrycksmätningar, toleranser i tillverkning, provresultat – allt detta tenderar att följa en normalfördelning när du samlar tillräckligt många observationer. Naturlig variation i biologiska och fysiska system tenderar att ge den här formen.

Det betyder dock inte att all data beter sig så. Inkomster är högerskevade. Svarstider på webbplatser har långa svansar.

I verkligheten kan det gå riktigt fel om du antar normalitet utan att kontrollera.

Varför det är viktigt att testa normalitet

Problemet med att inte kontrollera normalitet är att de vanligaste statistiska testen – t-test, ANOVA – är parametriska test.

Det betyder att de bygger på antaganden om dina datas fördelning. Normalitet är ett av dem. När det antagandet brister, brister testets matematik med det. Du får fortfarande ett resultat från testet, men det kan leda till felaktiga slutsatser.

Parametriska test fungerar genom att göra matematiska antaganden om populationen som ditt stickprov kommer ifrån. När de antagandena håller är testen användbara och träffsäkra. När de inte gör det blir p-värdena opålitliga och du kan inte dra korrekta slutsatser.

Det är här icke-parametriska test kommer in.

Test som Mann–Whitney U eller Kruskal–Wallis förutsätter inte normalitet – de arbetar med rangordningar i stället för råa värden. De är mer flexibla, men tenderar också att vara mindre användbara när dina data är normala. Så att byta till dem i onödan är inte lösningen.

Det verkliga problemet som många nybörjare inom data science gör är att helt hoppa över kontrollen.

Att testa normalitet kräver några få rader kod. Att inte testa betyder att du antingen litar blint på dina data – eller inte tänker på dem alls.

Visuella metoder för att kontrollera normalitet

Innan du kör något formellt test, visualisera dina data. Diagram berättar mycket om vad du har att jobba med.

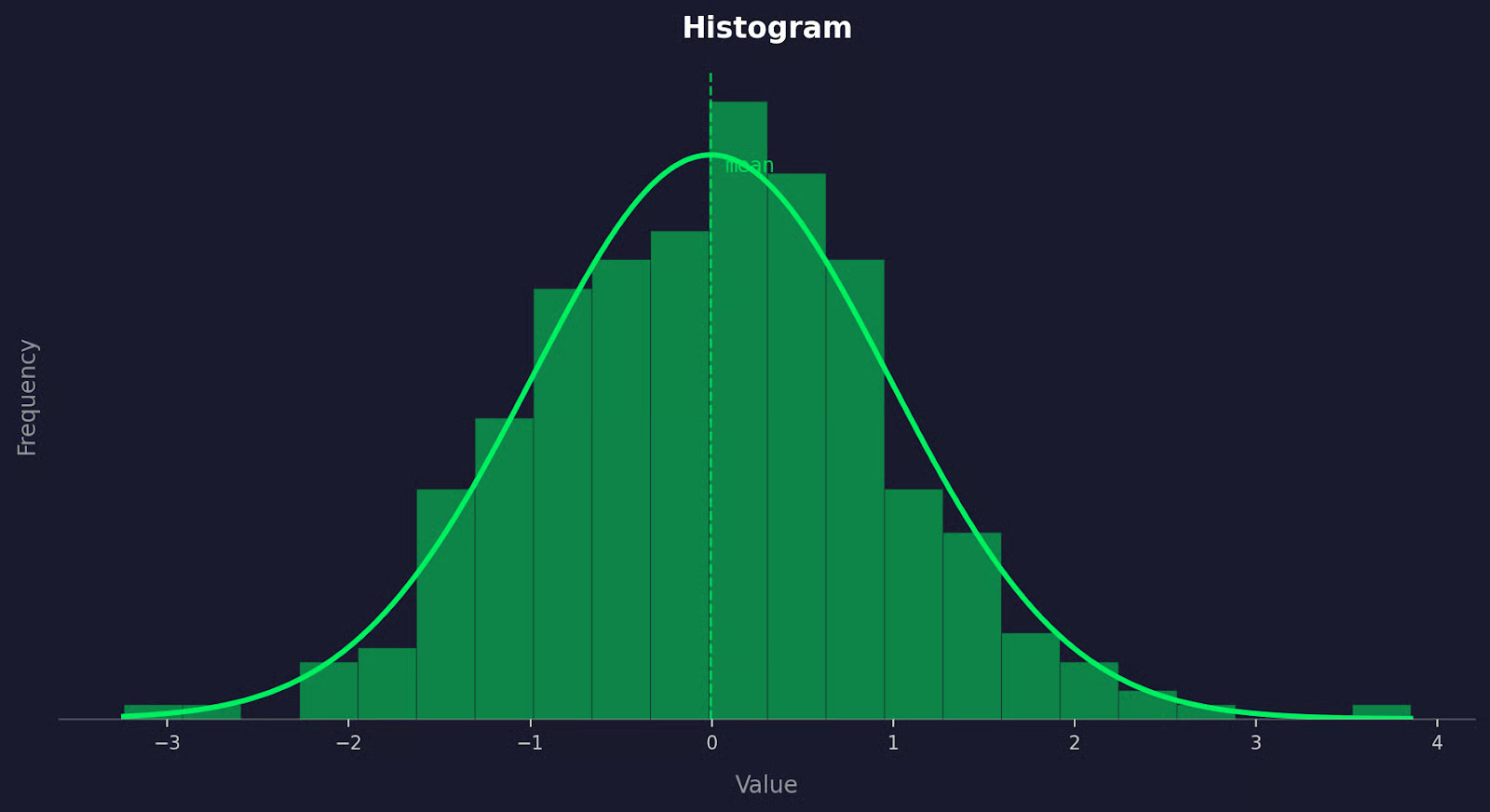

Histogram

Ett histogram visar formen på din fördelning.

Exempel på histogram

Om dina data är normalfördelade bör histogrammet se ut som en klockkurva – högt i mitten och avsmalnande symmetriskt på båda sidor. Det du tittar efter är skevhet: en lång svans åt höger innebär positiv skevhet, en svans åt vänster innebär negativ skevhet. Oavsett vilket är det ett tecken på att dina data kanske inte är normala.

Problemet med histogram är att formen beror på antalet fack (bins):

- För få fack och fördelningen ser platt ut

- För många och den ser taggig ut

Prova alltid några olika fackstorlekar innan du drar slutsatser.

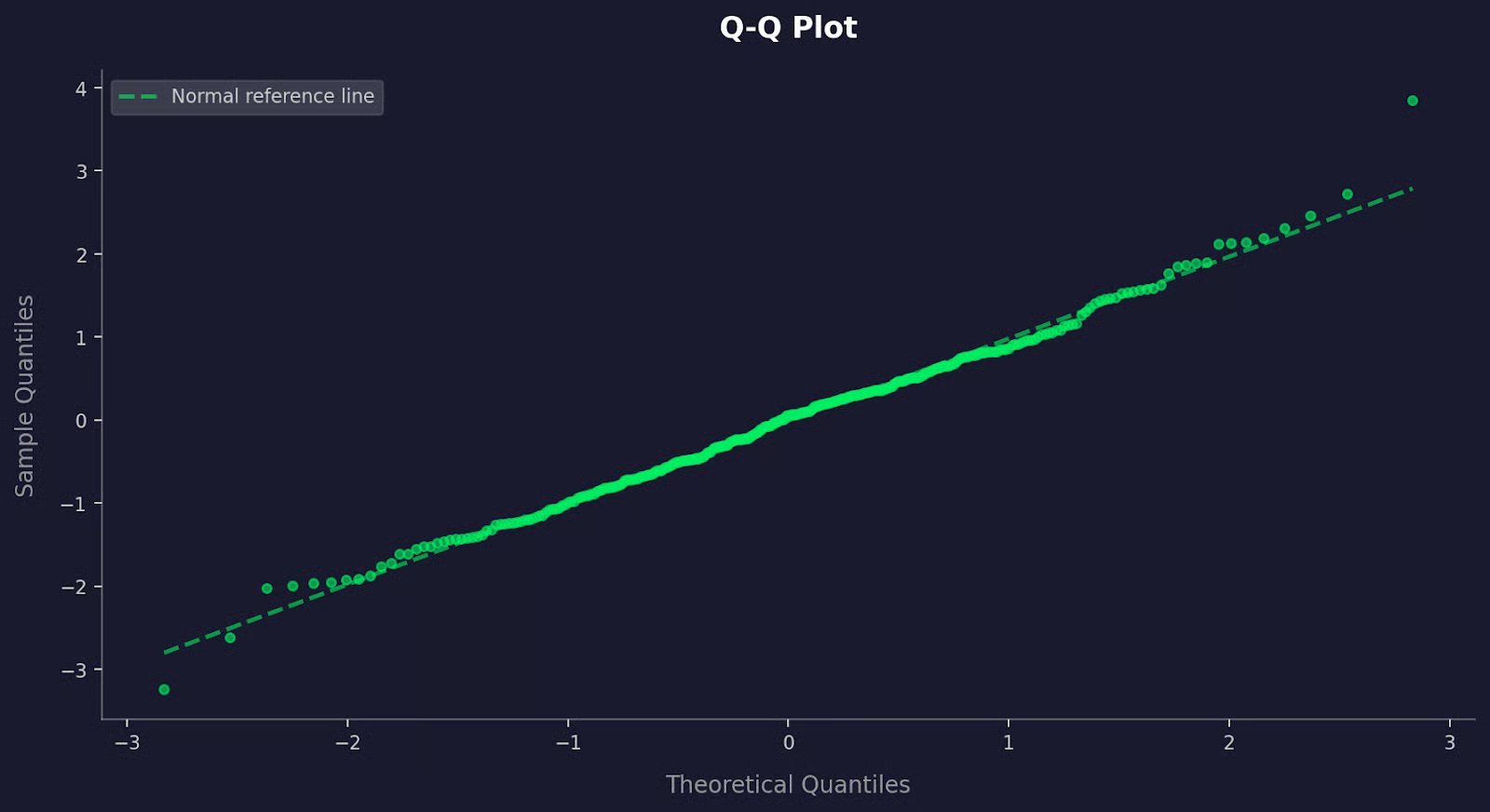

Q–Q-diagram

Ett Q–Q-diagram (quantile–quantile) jämför dina datas kvantiler med kvantilerna för en teoretisk normalfördelning.

Exempel på Q–Q-diagram

Om dina data är normala faller punkterna längs en rak diagonal linje. Avvikelser från den linjen visar var normaliteten brister. Punkter som böjer uppåt i ändarna tyder på tunga svansar. En S-formad kurva pekar på skevhet.

Q–Q-diagram är mer precisa än histogram för att upptäcka subtila avvikelser från normalitet – särskilt i svansarna där histogram ofta missar saker.

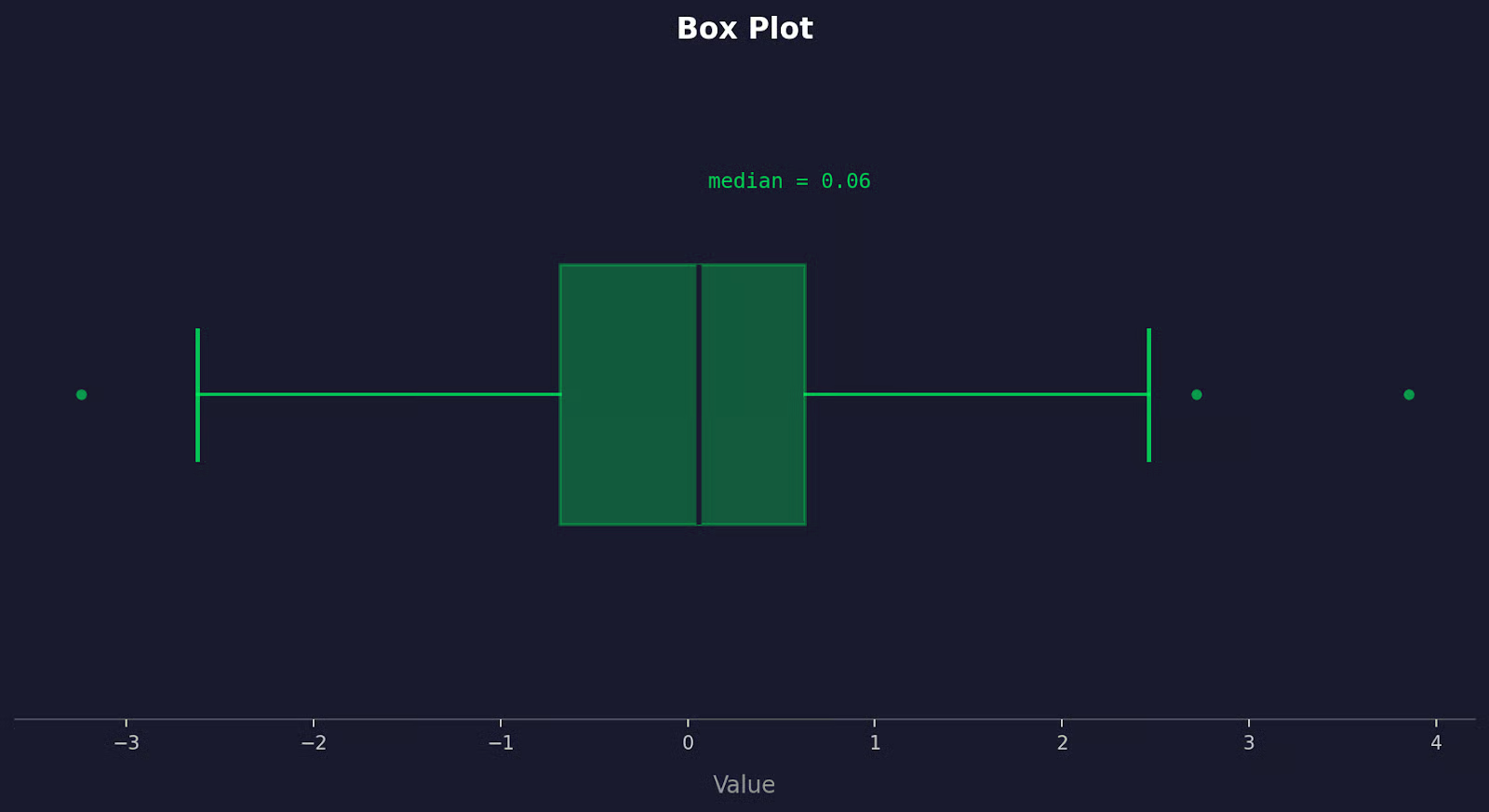

Lådagram

Ett lådagram visar median, spridning och avvikare i en vy.

Exempel på lådagram

Ett normalfördelat dataset ger ett lådagram där medianen ligger ungefär i mitten av lådan och mustascherna sträcker sig ungefär lika långt åt båda håll. Om medianen är decentrerad eller en mustasch är mycket längre än den andra är det skevhet. Prickar utanför mustascherna är avvikare.

Den generella nackdelen med visuella metoder är att de är subjektiva. Två personer kan titta på samma histogram och vara oense. Använd dem för att få känsla för dina data först och bekräfta sedan med ett formellt test.

Vanliga normalitetstester i statistiken

Det finns inget enskilt normalitetstest som fungerar bäst i alla situationer. Rätt val beror på stickprovsstorlek och vad du försöker upptäcka.

Shapiro–Wilk-test

Shapiro–Wilk-testet är förstahandsvalet för små till medelstora stickprov, i allmänhet upp till några hundra observationer.

Det mäter hur nära dina data ligger en normalfördelning genom att jämföra observerade värden med vad du skulle förvänta dig om data vore normalfördelade. Det är allmänt använt, väl förstått och finns i alla större statistikbibliotek. För de flesta analytiker är detta testet att börja med.

Dess främsta begränsning är att det blir överkänsligt vid stora stickprov. Det tenderar att flagga pyttesmå, praktiskt taget betydelselösa avvikelser som statistiskt signifikanta.

Kolmogorov–Smirnov-test

Kolmogorov–Smirnov-testet (KS) jämför ditt stickprovs kumulativa fördelning med en teoretisk – i det här fallet normal.

Det är mer generellt än Shapiro–Wilk och kan testas mot vilken fördelning som helst, inte bara normal. KS-testet är mindre kraftfullt än Shapiro–Wilk för normalitet, vilket innebär att det mer sällan fångar subtila avvikelser. Det kräver också att du anger fördelningens parametrar i förväg, vilket introducerar bias om du skattar dem från samma data.

Använd det när du behöver en snabb, generell kontroll – inte som ditt primära normalitetstest.

Anderson–Darling-test

Anderson–Darling-testet är en variant av KS-testet, men med en viktig skillnad: det ger större vikt åt fördelningens svansar.

Det gör att det bättre fångar avvikelser som visar sig i ytterligheterna – tunga svansar, avvikare eller icke-normalt beteende som KS-testet kan missa. Om ditt användningsfall är känsligt för svansbeteende är Anderson–Darling ett bra val.

D’Agostino–Pearson-test

D’Agostino–Pearson-testet tar en annan ansats.

I stället för att jämföra fördelningar direkt mäter det två egenskaper hos dina data: skevhet (asymmetri) och kurtosis (hur tunga eller lätta svansarna är).

Det kombinerar båda till en enda teststatistika. Det gör det bra på att peka ut varför dina data kanske inte är normala – inte bara om de är det. Det fungerar bäst med större stickprov, där skattningar av skevhet och kurtosis är tillförlitliga.

Jarque–Bera-test

Jarque–Bera-testet använder också skevhet och kurtosis, likt D’Agostino–Pearson.

Det är vanligt inom ekonometri och tidsserieanalys. Liksom D’Agostino–Pearson kräver det ett tillräckligt stort stickprov för tillförlitliga resultat. Med små stickprov är testet inte särskilt pålitligt. Om du arbetar inom finans- eller ekonomiområdet lär du se detta ofta.

Sammanfattningsvis: börja med Shapiro–Wilk för små stickprov och kombinera med ett Q–Q-diagram. Använd Anderson–Darling när svansbeteende spelar roll, och D’Agostino–Pearson när du vill förstå naturen hos avvikelsen.

Hur du tolkar resultat av normalitetstester

Varje normalitetstest är ett hypotesprövningstest.

Den nollhypotes i ett normalitetstest är att dina data är normalfördelade. Testet frågar sedan: givet vad vi ser i data, hur sannolik är denna nollhypotes?

Svaret kommer som ett p-värde:

- p > 0,05 – du har inte tillräckligt med bevis för att förkasta normalitet. Utgå från att data är normalfördelade och fortsätt med parametriska test

- p < 0,05 – data skiljer sig från normalitet tillräckligt mycket för att vara statistiskt upptäckbart. Förkasta normalitetsantagandet

Låter enkelt, men många går fel här.

Ett lågt p-värde talar inte om hur icke-normala dina data är – bara att en skillnad upptäcktes. Vid stora stickprov blir normalitetstester extremt känsliga. De flaggar avvikelser som är så små att de inte har någon verklig påverkan på din analys.

Det motsatta problemet finns också. Med små stickprov kan även synbart skev data ge p > 0,05 eftersom testet inte har tillräcklig styrka för att upptäcka avvikelsen.

Statistisk signifikans och praktisk signifikans är inte samma sak.

Ett p-värde berättar om en avvikelse från normalitet finns. Det berättar inte om den avvikelsen spelar roll för just din analys. Kombinera alltid testresultatet med ett Q–Q-diagram – om punkterna följer linjen nära är dina data troligen tillräckligt normala, oavsett vad p-värdet säger.

Normalitetstester i Python

Pythons scipy.stats-modul har allt du behöver för att köra normalitetstester med några få rader kod.

I alla exempel nedan använder jag samma dataset – 100 stickprov dragna från en normalfördelning – så att du kan köra koden och följa med.

import numpy as np

from scipy import stats

np.random.seed(42)

data = np.random.normal(loc=0, scale=1, size=100)Shapiro–Wilk-test

Använd shapiro() som din första kontroll, särskilt med mindre dataset.

stat, p_value = stats.shapiro(data)

print(f"Statistic: {stat:.4f}, p-value: {p_value:.4f}")Detta är vad du får ut:

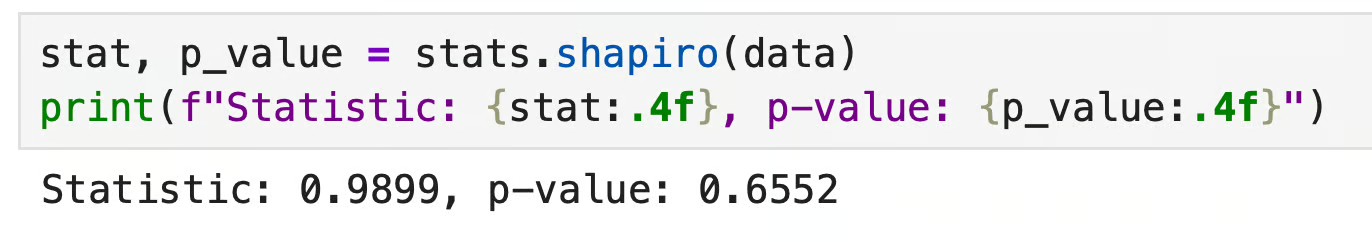

Utdata från Shapiro–Wilk-test i Python

P-värdet är klart över 0,05, så vi förkastar inte normalitet. Data ser normala ut – vilket är rimligt, eftersom vi genererade dem från en normalfördelning.

Kolmogorov–Smirnov-test

kstest() jämför ditt stickprov med en namngiven fördelning. För normalitet, skicka in "norm" tillsammans med stickprovets medelvärde och standardavvikelse.

stat, p_value = stats.kstest(data, 'norm', args=(data.mean(), data.std()))

print(f"Statistic: {stat:.4f}, p-value: {p_value:.4f}")

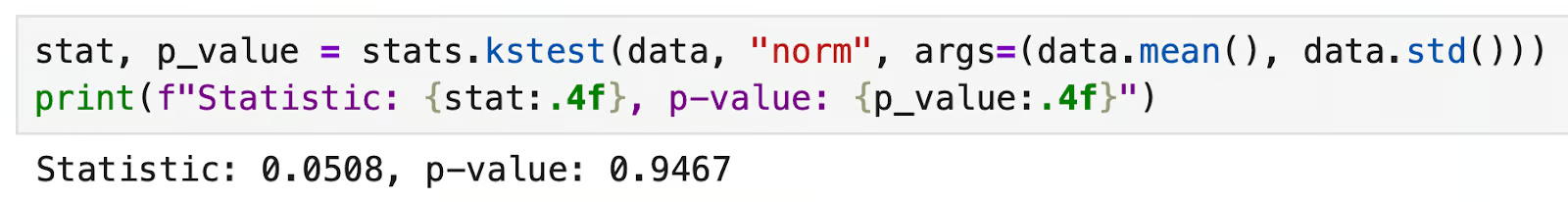

Utdata från Kolmogorov–Smirnov-test i Python

Återigen, p > 0,05 – inga belägg mot normalitet.

Med detta test i Python, ange alltid medelvärde och standardavvikelse uttryckligen via args. Om du hoppar över det antar kstest() en standardnormal (medel=0, std=1), vilket ger opålitliga resultat om inte dina data redan är standardiserade.

D’Agostino–Pearson-test

normaltest() testar normalitet genom att kombinera skevhet och kurtosis. Det fungerar bäst med större stickprov.

stat, p_value = stats.normaltest(data)

print(f"Statistic: {stat:.4f}, p-value: {p_value:.4f}")

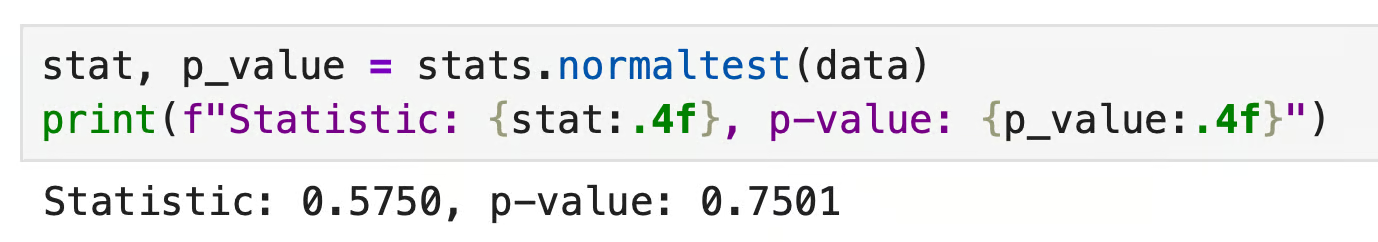

Utdata från D’Agostino–Pearson-test i Python

p > 0,05 igen. Data klarar alla tre testen här, men det är väntat – jag genererade dem som normala. I praktiken kommer du ofta se att testen inte är överens, särskilt runt 0,05-gränsen. När det händer, luta dig mot ditt Q–Q-diagram för att avgöra.

Normalitetstester i R

R har inbyggda funktioner för normalitetstester. Inga extra paket behövs för grunderna.

Liksom i Python-exemplen använder jag samma dataset genomgående: 100 stickprov från en normalfördelning.

set.seed(42)

data <- rnorm(100, mean = 0, sd = 1)Shapiro–Wilk-test

shapiro.test() är förstahandsvalet för små till medelstora stickprov. Skicka bara in din datavektor:

shapiro.test(data)

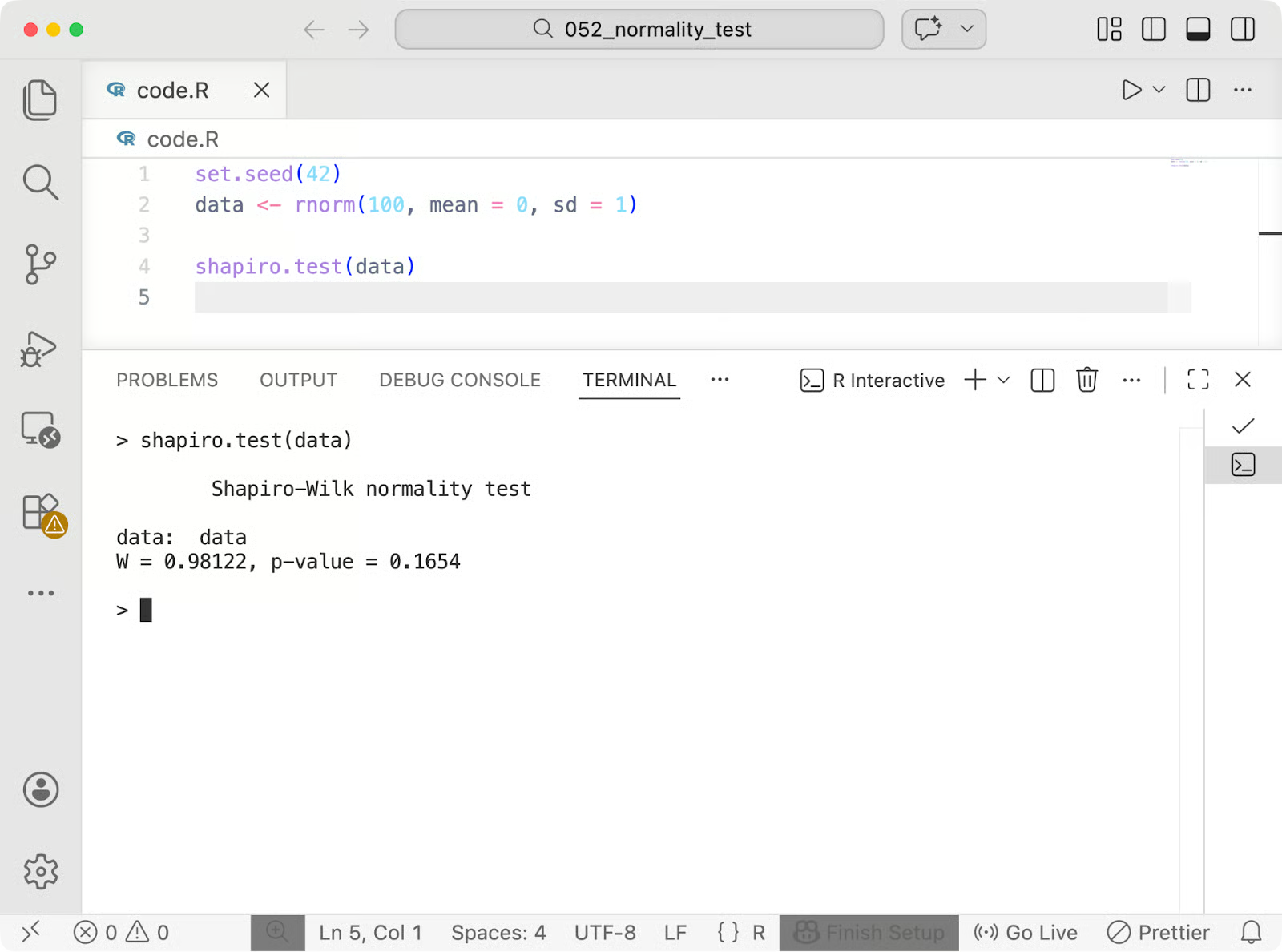

Utdata från Shapiro–Wilk-test i R

p > 0,05 – inga belägg mot normalitet. W-statistikan varierar mellan 0 och 1, där värden nära 1 indikerar att data ligger nära en normalfördelning.

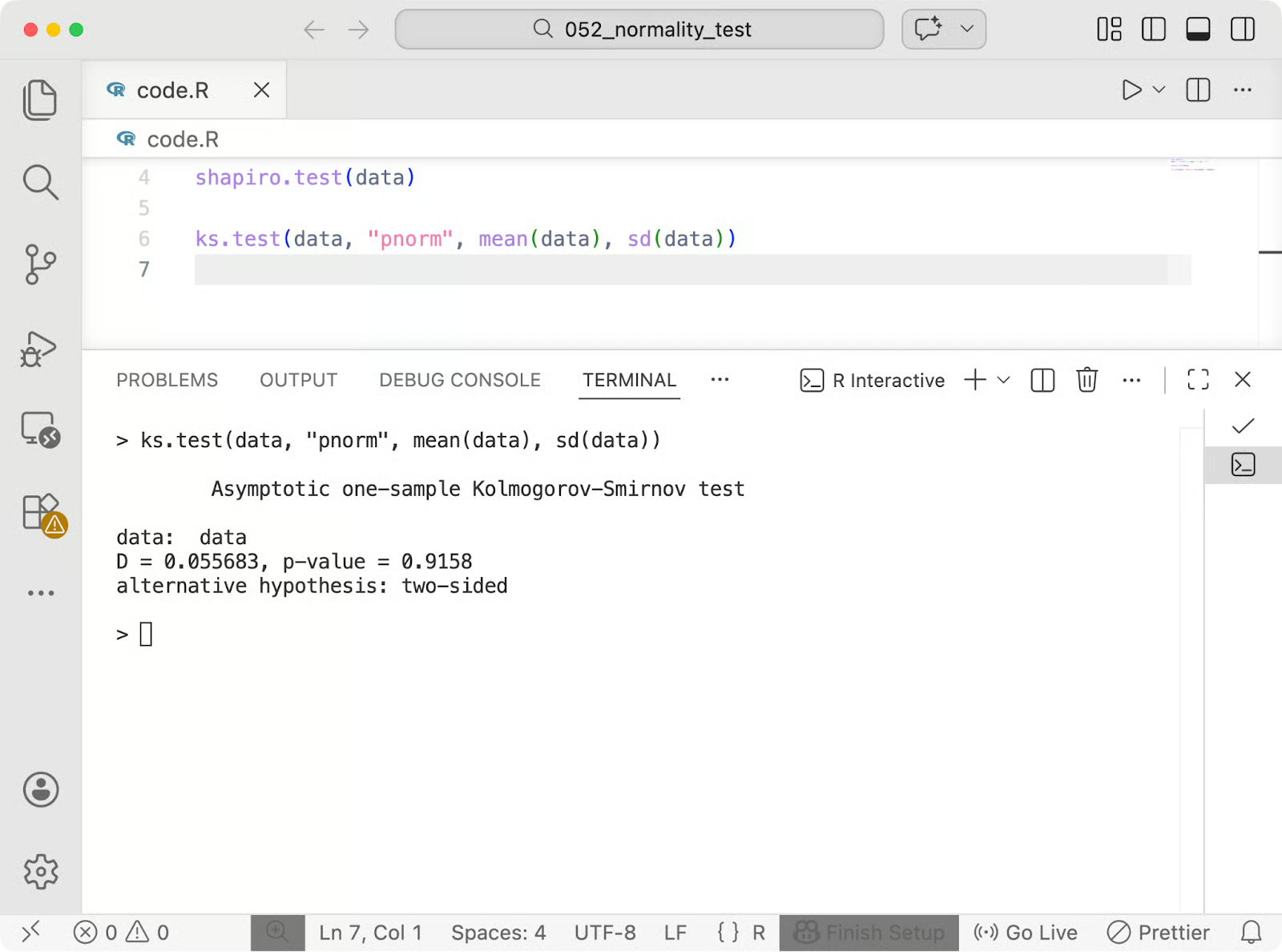

Kolmogorov–Smirnov-test

ks.test() jämför ditt stickprov med en teoretisk fördelning. För normalitet, ange "pnorm" och skicka in stickprovets medelvärde och standardavvikelse.

ks.test(data, "pnorm", mean(data), sd(data))

Utdata från Kolmogorov–Smirnov-test i R

p > 0,05 igen. Detta test i R har samma brasklapp som i Python: ange alltid mean(data) och sd(data). Utelämnar du det blir standarden en standardnormal, vilket snedvrider resultatet om inte dina data redan är standardiserade.

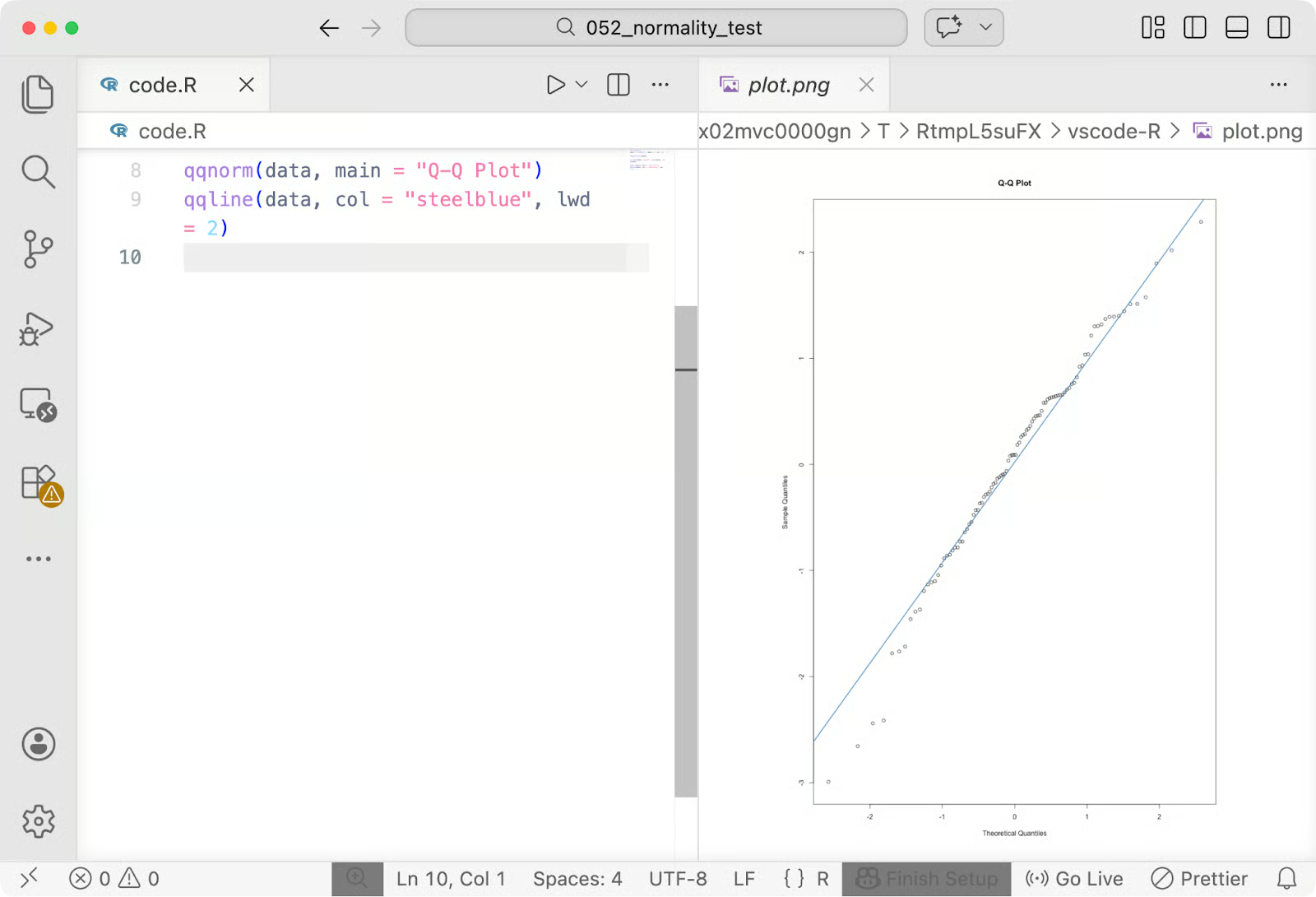

Q–Q-diagram

R:s inbyggda qqnorm() och qqline() ger dig ett Q–Q-diagram med två rader kod.

qqnorm(data, main = "Q-Q Plot")

qqline(data, col = "steelblue", lwd = 2)

Q–Q-diagram i R

qqnorm() ritar dina stickprovskvantiler mot teoretiska normalkvantiler. qqline() ritar referenslinjen. Punkter som följer linjen nära betyder att dina data beter sig normalt. Avvikelser i ändarna signalerar svansproblem som kan vara värda att undersöka.

Vad du gör om data inte är normala

Om dina data inte klarar ett normalitetstest har du ett par bra alternativ.

Transformera data

Ibland är lösningen att transformera dina data så att de beter sig normalt och sedan köra dina ursprungliga test på de transformerade värdena.

Logaritmisk transformation är det vanligaste valet. Det fungerar bra på högerskevade data – tänk inkomster, svarstider eller biologiska mätningar med en lång högersvans. Funktionen i Python är np.log(data) och motsvarigheten i R är log(data).

Kvadratrotstransformation är ett mildare alternativ för måttlig skevhet, och det är praktiskt när dina data innehåller nollor (eftersom du inte kan ta logaritmen av noll). Använd np.sqrt(data) i Python eller sqrt(data) i R.

Efter transformation, kör normalitetstestet igen. Om de transformerade data klarar det, fortsätt med dina parametriska test – kom bara ihåg att tolka resultaten på den transformerade skalan.

Använd icke-parametriska test

Om transformation inte fungerar eller inte är rimlig för dina data, byt till icke-parametriska test. Dessa förutsätter inte normalitet – de rangordnar data i stället för att arbeta med råvärden.

- Mann–Whitney U-test är det icke-parametriska alternativet till t-test för oberoende stickprov. Använd det när du jämför två grupper

- Kruskal–Wallis-test är den icke-parametriska varianten av envägs-ANOVA. Använd det när du jämför tre eller fler grupper

Båda finns i scipy.stats (mannwhitneyu() och kruskal()) och i R:s baspaket (wilcox.test() och kruskal.test()).

Förlita dig på stora stickprov

Med tillräckligt stora stickprov kan du ofta bortse från normalitetsfrågan.

Centrala gränsvärdessatsen säger att när stickprovsstorleken växer närmar sig medelvärdets stickprovsfördelning en normalfördelning – oavsett hur de ursprungliga data är fördelade. I praktiken betyder det att parametriska test tenderar att vara tillförlitliga med stora stickprov även när underliggande data inte är perfekt normala.

Vanliga misstag när man testar normalitet

Att testa normalitet är enkelt – du har sett att det bara kräver en rad kod. Ändå finns det några sätt att göra fel.

Här är några vanliga misstag som nybörjare inom data science ofta gör:

- Att bara förlita sig på p-värden: Ett p-värde berättar om en avvikelse från normalitet upptäcktes, inte hur stor avvikelsen är eller om den spelar roll. Att behandla p > 0,05 som grönt ljus och p < 0,05 som rött är för trubbigt. Kombinera alltid testresultatet med ett Q–Q-diagram

- Att ignorera stickprovsstorlekens effekter: Med små stickprov kan normalitetstest missa verkliga avvikelser och ge p > 0,05 även när dina data är synbart skeva. Med stora stickprov blir testet så känsligt att det flaggar pyttesmå, meningslösa avvikelser som statistiskt signifikanta. Stickprovsstorleken kan ändra vad p-värdet betyder

- Övertestning av normalitet: Inte varje analys kräver ett formellt normalitetstest. Om du gör explorativt arbete räcker oftast ett histogram och ett Q–Q-diagram

- Feltolkning av små avvikelser: Verkliga data är nästan aldrig perfekt normala. En liten avvikelse från referenslinjen i ett Q–Q-diagram, eller ett p-värde strax under 0,05, betyder inte att dina data är långt från normalitet. Frågan är om de är tillräckligt normala för det test du kör

Alltså: normalitetstest är bara en kontroll av dina data. Använd det som ett av flera underlag, inte som sista ordet.

När du kan hoppa över normalitetstest

Normalitetstest är inte alltid nödvändigt. Om du har ont om tid kan det spara tid att veta när du kan hoppa över det utan att påverka resultaten.

Stora dataset

När du har ett stort stickprov garanterar centrala gränsvärdessatsen att medelvärdets stickprovsfördelning är ungefär normal, oavsett formen på dina rådata. Parametriska test är i allmänhet tillförlitliga i den situationen, så att köra ett formellt normalitetstest tillför liten nytta.

Vissa statistiska metoder är dessutom robusta mot icke-normalitet. Tekniker som linjär regression brukar stå sig väl när stickproven är rimliga och överträdelserna inte extrema. (Linjär regression förutsätter fortfarande normalitet i residualerna.)

Explorativ analys

När du skannar data efter mönster, bygger intuition eller bestämmer vilka variabler som ska undersökas vidare räcker ett snabbt histogram eller Q–Q-diagram. Formella test är för konfirmatorisk analys – när dina slutsatser behöver hålla.

Kom ihåg att normalitetstest finns för att skydda dig från att dra fel slutsatser. Om du befinner dig i ett sammanhang där en felaktig slutsats inte får verkliga konsekvenser, eller där din metod inte beror på normalitet, är testet valfritt.

Slutsats

Normalitetstest handlar om att kontrollera om dina antaganden håller tillräckligt väl för att du ska kunna lita på resultaten.

Inget dataset är perfekt normalt. Målet är att förstå hur dina data beter sig och välja metoder därefter. Ett Q–Q-diagram visar var avvikelserna finns. Ett formellt test informerar om de är statistiskt upptäckbara. Tillsammans ger de en tydligare bild än var och en för sig.

Rätt test beror på ditt sammanhang. Använd Shapiro–Wilk för små stickprov, Anderson–Darling när svansar spelar roll, icke-parametriska alternativ när normalitet inte kan antas. Och ibland – med stora stickprov eller robusta metoder – inget test alls.

Tycker du att hela konceptet med p-värden är förvirrande? Läs vår artikel Hypotesprövning på ett enkelt sätt för att säkerställa att du tolkar dem korrekt.

Normalitetstest – vanliga frågor

Vad är ett normalitetstest?

Ett normalitetstest är en statistisk metod som kontrollerar om dina data följer en normal (Gaussisk) fördelning. De vanligaste statistiska testen – som t-test, ANOVA och linjär regression – förutsätter normalitet, så att kontrollera det antagandet innan du kör din analys hjälper dig att undvika felaktiga slutsatser.

Behöver jag alltid testa normalitet?

Inte alltid. Med stora stickprov gör centrala gränsvärdessatsen parametriska test tillförlitliga oavsett underliggande fördelning. För explorativ analys räcker oftast ett snabbt histogram eller Q–Q-diagram – formella normalitetstest är mest användbara när du gör konfirmatorisk analys och dina slutsatser måste hålla.

Vad ska jag göra om mina data inte klarar ett normalitetstest?

Du har några alternativ. Du kan transformera data med en logaritm eller kvadratrot och sedan testa igen. Om transformationen inte fungerar, byt till icke-parametriska test som Mann–Whitney U (för två grupper) eller Kruskal–Wallis (för tre eller fler grupper), som inte förutsätter normalitet.

Vad är skillnaden mellan Shapiro–Wilk och Kolmogorov–Smirnov?

Shapiro–Wilk är specifikt utformat för normalitetstestning och fungerar bäst med små till medelstora stickprov. Kolmogorov–Smirnov-testet är mer generellt – det kan jämföra ett stickprov med vilken teoretisk fördelning som helst, inte bara normal – men det är mindre kraftfullt än Shapiro–Wilk just för normalitet, vilket gör att det lättare missar subtila avvikelser.

Hur tolkar jag ett Q–Q-diagram för normalitet?

Ett Q–Q-diagram jämför dina datas kvantiler med kvantilerna i en teoretisk normalfördelning. Om punkterna faller nära den diagonala referenslinjen beter sig dina data normalt. Avvikelser i ändarna på linjen signalerar svansproblem – en S-formad kurva pekar på skevhet, medan punkter som böjer bort från linjen i båda ändar tyder på tyngre eller lättare svansar än en normalfördelning har.