Kurs

Hiç bir t-testi çalıştırıp temiz bir p-değeri elde ettikten sonra verilerinizin normal dağılıp dağılmadığını kontrol etmediğinizi fark ettiniz mi?

İstatistiksel testler, varsayımları ihlal edildiğinde sizi uyarmaz. Sadece bir değer döndürürler. Sorun şu ki t-testi ve ANOVA gibi testler, verilerinizin normal dağılımı takip ettiğini varsayar. Bu doğru değilse, sonuçlarınızı zayıf temeller üzerine inşa ediyorsunuz demektir.

Normallik testleri bu varsayımı doğrulamanın bir yolunu sunar. Bunu yapmanın hem görsel hem de istatistiksel yöntemleri vardır ve hangisini ne zaman kullanacağınızı - ve sonuçları nasıl okuyacağınızı - bilmek, sonuçlarınızın arkasında güvenle durmanızı sağlar.

Bu yazıda, normalliği kontrol etmek için en yaygın görsel ve istatistiksel yöntemleri anlatacak, bunları Python ve R ile nasıl çalıştıracağınızı gösterecek ve verileriniz testi geçmediğinde ne yapmanız gerektiğini açıklayacağım.

Pratikte Normal Dağılım Nedir

Muhtemelen daha önce çan eğrisini görmüşsünüzdür - ama bu, verileriniz için gerçekte ne anlama gelir?

Normal dağılım, çoğu değerin merkezin etrafında kümelendiği ve her iki yönde de uzaklaştıkça daha az değerin görüldüğü bir örüntüdür. Bunu çizdiğinizde simetrik, çan şeklinde bir eğri elde edersiniz. Sol taraf sağ tarafın aynasıdır.

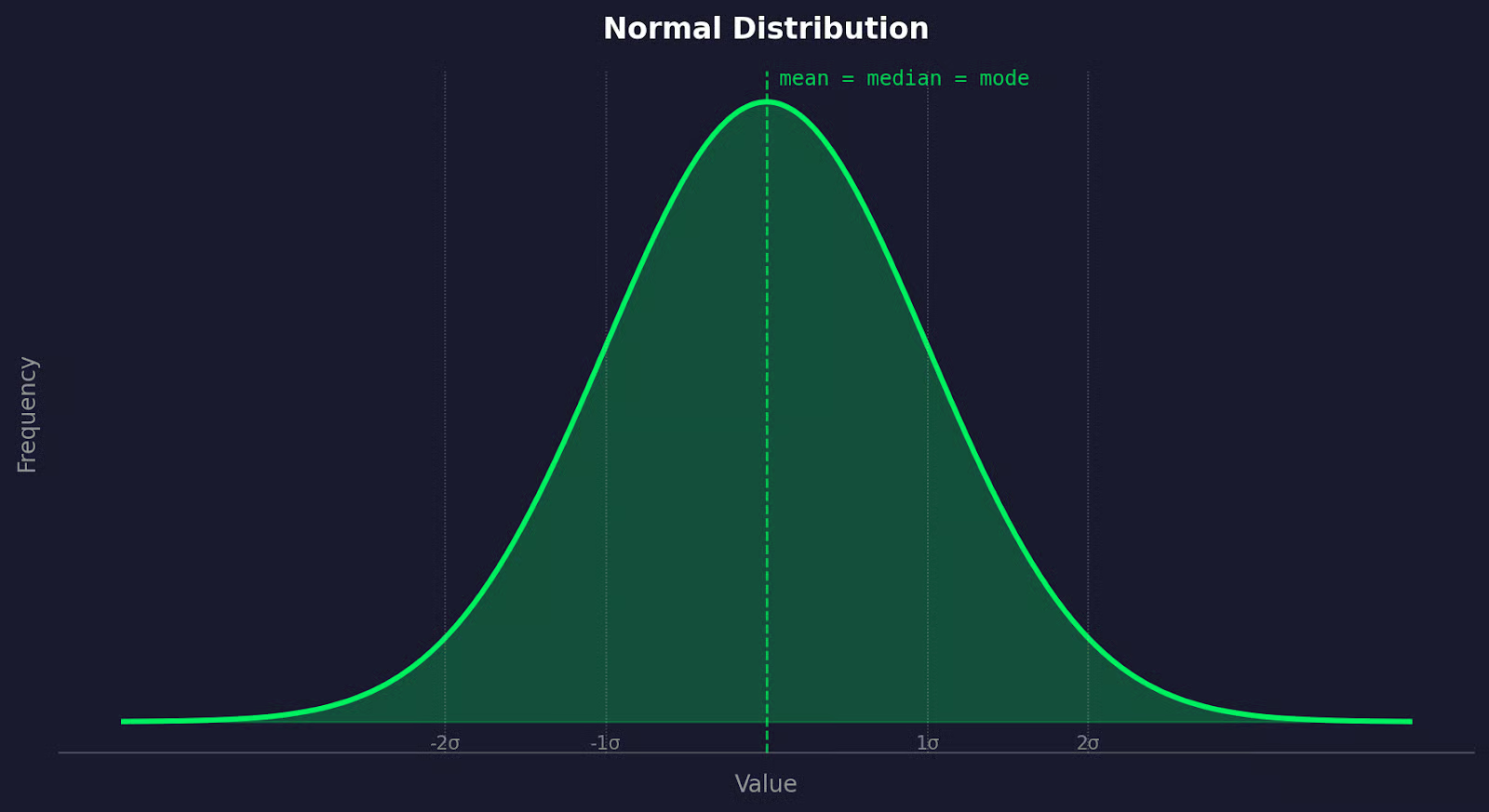

Normal dağılım grafiği

Normal dağılımı benzersiz kılan şey; ortalama, medyan ve modun aynı noktaya - çanın merkezine - denk gelmesidir. Ne sola ne de sağa çarpıklık vardır. Başka bir deyişle, veri dengelidir.

Bu durum, gerçek dünyadaki ölçüm verilerinde sürekli karşımıza çıkar. İnsan boyu, tansiyon ölçümleri, üretim toleransları, sınav notları - yeterince örnek topladığınızda bunların tümü genellikle normal dağılıma uyar. Biyolojik ve fiziksel sistemlerdeki doğal değişkenlik bu şekli üretme eğilimindedir.

Bununla birlikte, tüm veriler böyle davranmaz. Gelir verileri sağa çarpıktır. Web sitesi yanıt sürelerinin uzun kuyrukları vardır.

Gerçek dünyada, kontrol etmeden normalliği varsayarsanız işler çok kötü gidebilir.

Normalliği Test Etmenin Önemi

Normalliği kontrol etmemenin sorunu, en yaygın istatistiksel testlerin - t-testi, ANOVA - parametrik testler olmasıdır.

Yani verinizin dağılımı hakkında varsayımlar üzerine kuruludurlar. Normallik bunlardan biridir. Bu varsayım bozulduğunda, testin matematiği de bozulur. Testten yine bir sonuç alırsınız, ancak bu sonuç sizi yanlış çıkarımlara götürebilir.

Parametrik testler, örnekleminizin geldiği anakitle hakkında matematiksel varsayımlar yaparak çalışır. Bu varsayımlar sağlandığında bu testler kullanışlı ve doğrudur. Sağlanmadığında ise p-değerleri güvenilmez hale gelir ve doğru çıkarımlar yapamazsınız.

İşte bu noktada parametrik olmayan testler devreye girer.

Mann-Whitney U veya Kruskal-Wallis gibi testler normallik varsaymaz - ham değerler yerine sıralamalarla çalışırlar. Daha esnektirler, ancak veriniz normal olduğunda genelde daha az faydalıdırlar. Bu yüzden gereksiz yere onlara geçmek çözüm değildir.

Veri bilimine yeni başlayanların yaptığı asıl hata, bu kontrolü tamamen atlamaktır.

Normallik testi birkaç satır kod alır. Test etmemek, ya verinize güvendiğiniz ya da hiç düşünmediğiniz anlamına gelir.

Normalliği Kontrol Etmek İçin Görsel Yöntemler

Herhangi bir resmi testi çalıştırmadan önce verinizi görselleştirin. Görselleştirmeler, neyle uğraştığınız hakkında çok şey anlatır.

Histogram

Histogram, dağılımınızın şeklini gösterir.

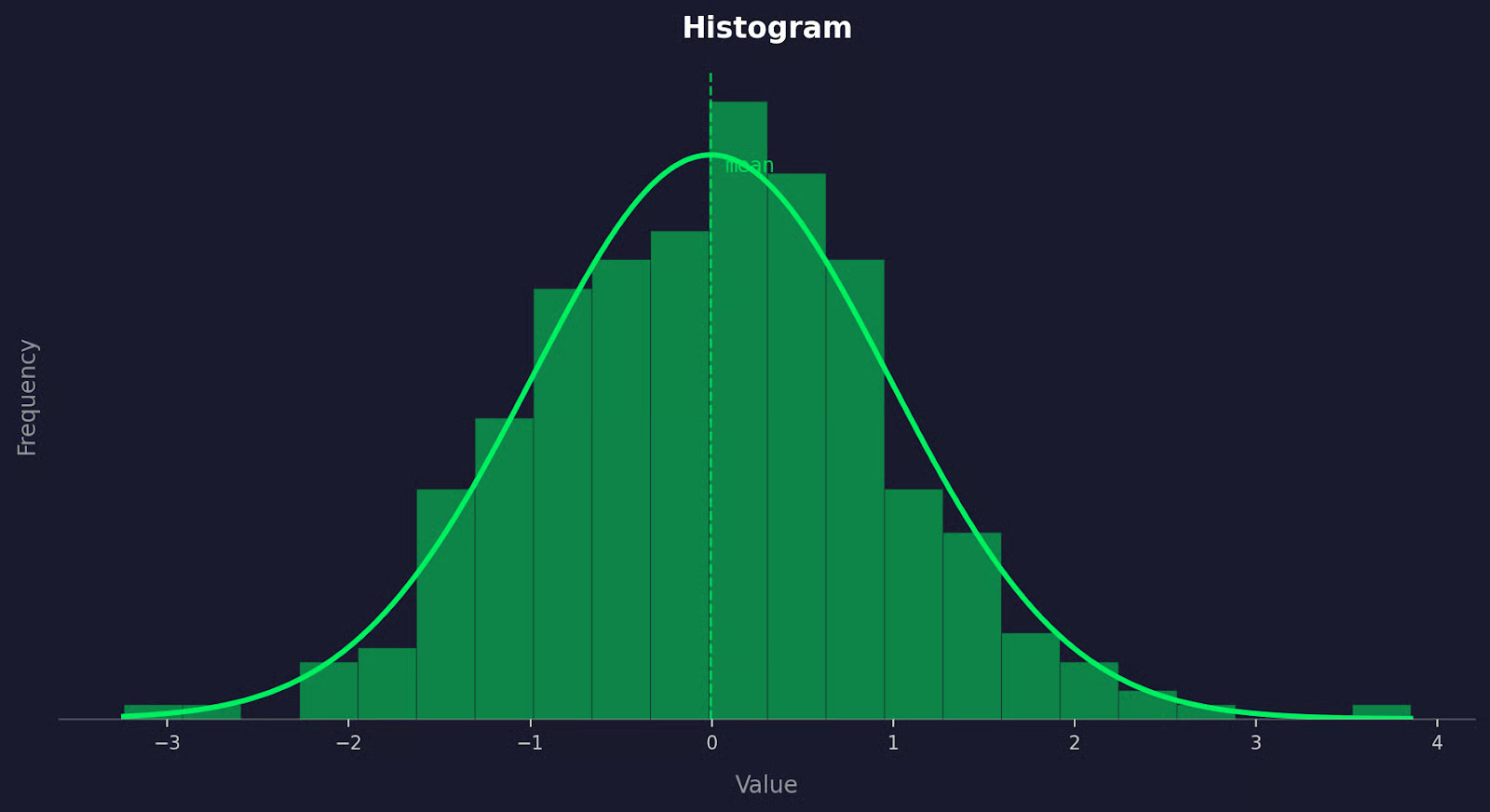

Örnek histogram

Verileriniz normal dağılıyorsa histogram bir çan eğrisi gibi görünmelidir - ortada yüksek, iki tarafta simetrik olarak incelen. Dikkat edeceğiniz şey çarpıklıktır: Sağa doğru uzayan uzun bir kuyruk pozitif çarpıklık, sola doğru uzayan kuyruk negatif çarpıklık demektir. Her iki durumda da bu, verinizin normal olmayabileceğine işaret eder.

Histogramların sorunu, şeklinin kutu (bin) sayısına bağlı olmasıdır:

- Çok az kutu olursa dağılım düz görünür

- Çok fazla olursa tırtıklı görünür

Sonuç çıkarmadan önce her zaman birkaç farklı kutu boyutu deneyin.

Q-Q grafiği

Q-Q grafiği (quantile-quantile plot), verinizin kantillerini teorik bir normal dağılımın kantilleriyle karşılaştırır.

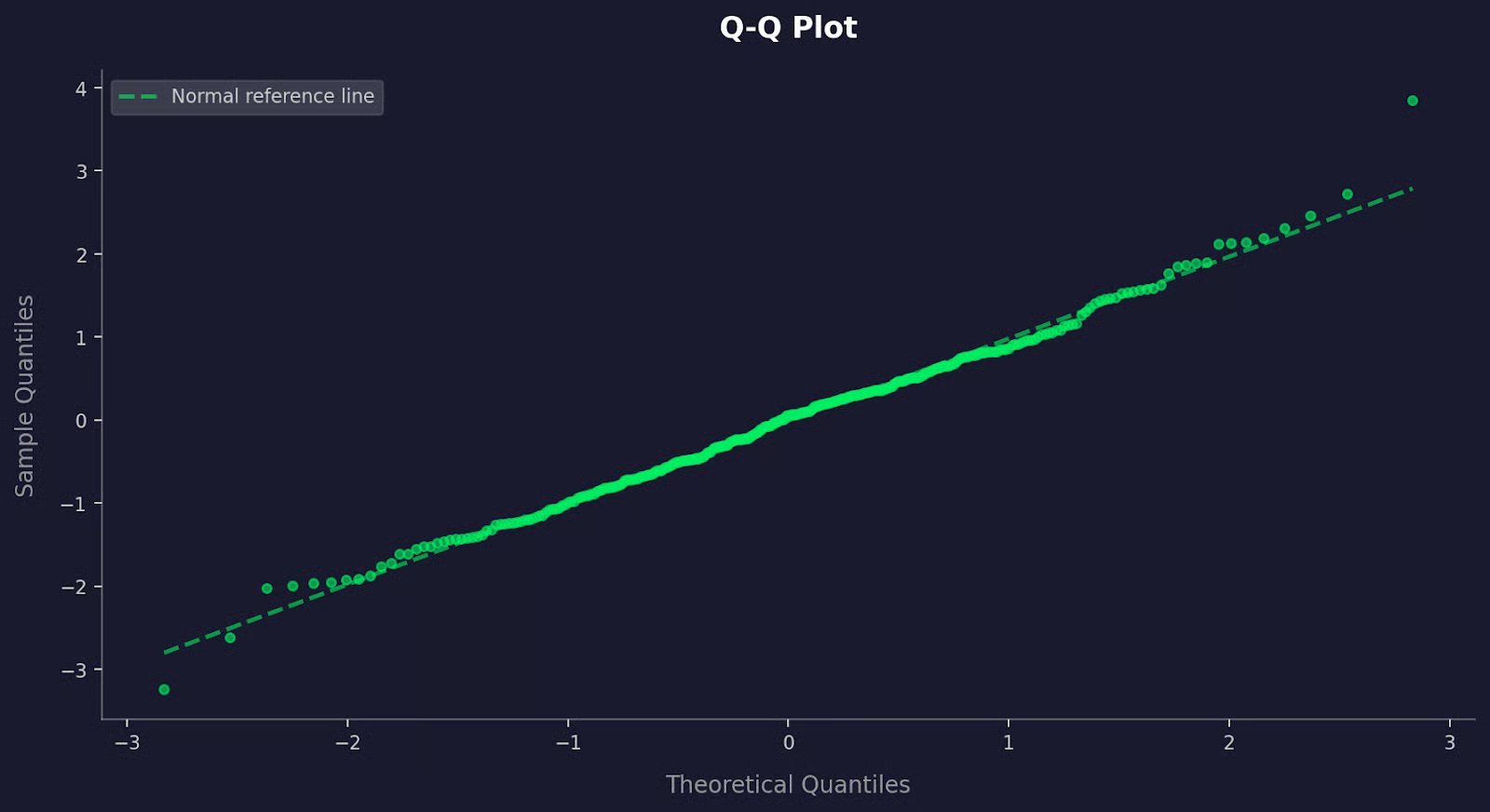

Örnek Q-Q grafiği

Veriniz normalse, noktalar düz bir diyagonal çizgi boyunca sıralanır. Bu çizgiden sapmalar, normalliğin nerede bozulduğunu gösterir. Uçlarda yukarı doğru kıvrılan noktalar ağır kuyruklara işaret eder. S şeklindeki bir eğri çarpıklığı gösterir.

Q-Q grafikleri, özellikle histogramların kaçırma eğiliminde olduğu kuyruklarda, normallikten ince sapmaları belirlemede histogramlardan daha hassastır.

Kutu grafiği

Kutu grafiği medyanı, yayılımı ve aykırı değerleri tek bir görünümde gösterir.

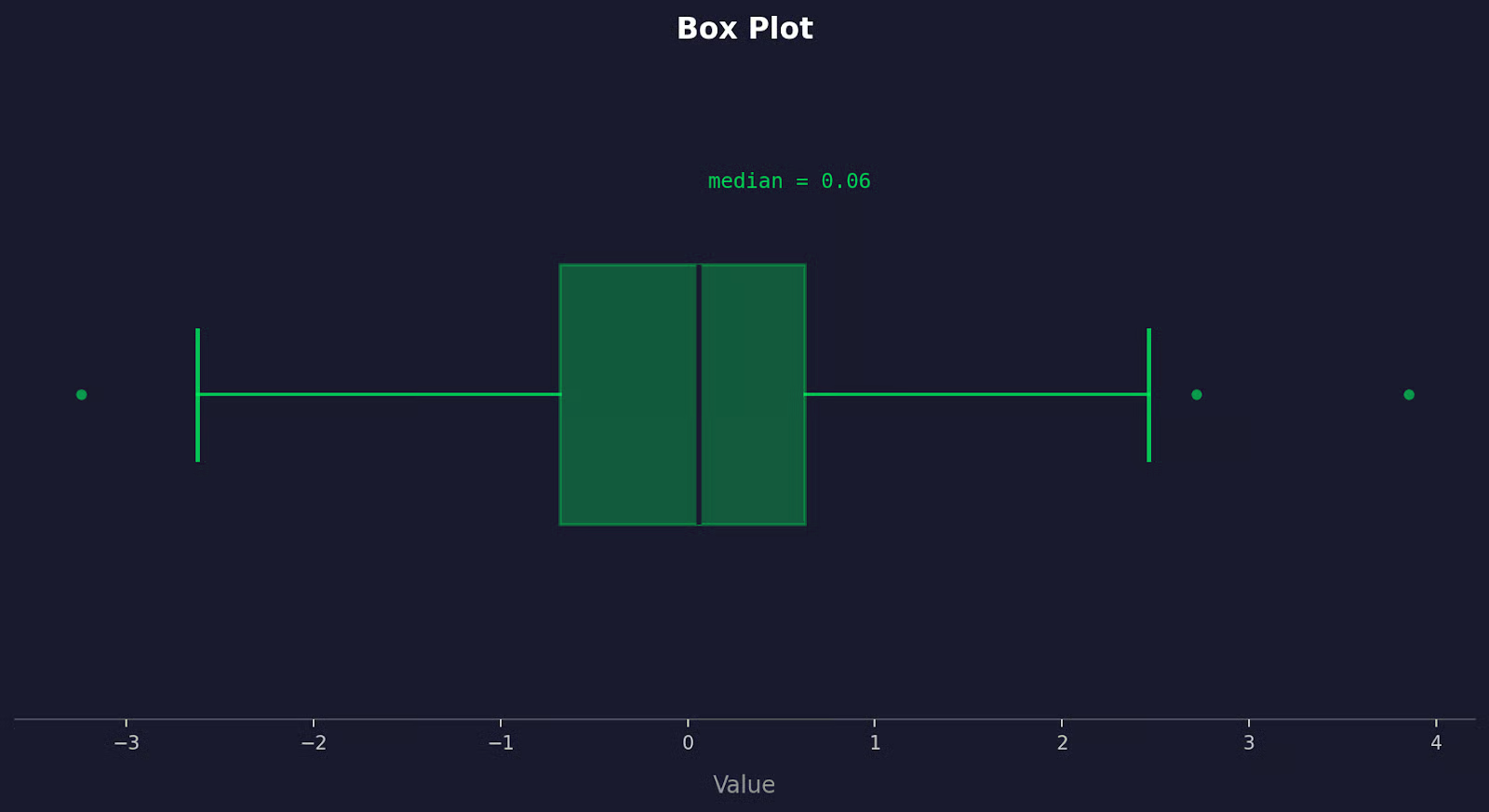

Örnek kutu grafiği

Normal dağılan bir veri kümesi, medyanın kutunun yaklaşık ortasında yer aldığı ve bıyıkların her iki tarafta da yaklaşık eşit uzunlukta uzandığı bir kutu grafiği üretir. Medyan ortadan kaymışsa ya da bir bıyık diğerinden çok daha uzunsa, bu çarpıklıktır. Bıyıkların dışındaki noktalar aykırı değerlerdir.

Görsellerle ilgili genel sorun, öznel olmalarıdır. İki kişi aynı histograma bakıp farklı düşünebilir. Önce verinizi anlamak için görselleri kullanın, ardından resmi bir testle teyit edin.

İstatistikte Yaygın Normallik Testleri

Her durumda en iyi çalışan tek bir normallik testi yoktur. Doğru seçim, örneklem büyüklüğünüze ve tespit etmek istediğiniz şeye bağlıdır.

Shapiro-Wilk testi

Shapiro-Wilk testi, genellikle birkaç yüz gözleme kadar olan küçük ve orta ölçekli örneklemler için başvurulacak seçenektir.

Verdiğiniz verilerin normal dağılıma ne kadar yakından uyduğunu, gözlenen değerleri veriler normal olsaydı bekleyeceğiniz değerlerle karşılaştırarak ölçer. Yaygın olarak kullanılır, iyi anlaşılmıştır ve tüm büyük istatistik kütüphanelerinde mevcuttur. Çoğu analist için başvurulacak ilk test budur.

Ana sınırlaması, büyük örneklemlerde aşırı duyarlı hale gelmesidir. Pratikte önemsiz olan küçücük sapmaları istatistiksel olarak anlamlı diye işaretleme eğilimindedir.

Kolmogorov-Smirnov testi

Kolmogorov-Smirnov (KS) testi, örnekleminizin kümülatif dağılımını teorik bir dağılımla - bu durumda normal - karşılaştırır.

Shapiro-Wilk'ten daha geneldir ve sadece normal değil, herhangi bir dağılıma karşı test edebilir. KS testi, normallik testinde Shapiro-Wilk'e göre daha az güçlüdür; yani ince sapmaları yakalama olasılığı daha düşüktür. Ayrıca dağılımın parametrelerini baştan belirtmenizi gerektirir; bunları aynı veriden tahmin etmek önyargı katabilir.

Genel amaçlı, hızlı bir kontrol gerektiğinde kullanın - birincil normallik testiniz olarak değil.

Anderson-Darling testi

Anderson-Darling testi, KS testinin bir varyasyonudur ama bir önemli farkla: dağılımın kuyruklarına daha fazla ağırlık verir.

Bu, uçlarda ortaya çıkan sapmaları - ağır kuyruklar, aykırı değerler veya KS testinin kaçıracağı normal dışı davranışları - yakalamada daha iyi olmasını sağlar. Kullanım durumunuz kuyruk davranışına duyarlıysa, Anderson-Darling iyi bir seçimdir.

D'Agostino-Pearson testi

D'Agostino-Pearson testi farklı bir yaklaşım benimser.

Dağılımları doğrudan karşılaştırmak yerine, verinizin iki özelliğini ölçer: çarpıklık (asimetri) ve basıklık (kuyrukların ne kadar ağır veya hafif olduğu).

İkisini tek bir test istatistiğinde birleştirir. Bu, verinizin neden normal olmayabileceğini saptamada - sadece olup olmadığını değil - iyidir. En iyi, çarpıklık ve basıklık tahminlerinin güvenilir olduğu daha büyük örneklemlerde çalışır.

Jarque-Bera testi

Jarque-Bera testi de D'Agostino-Pearson'a benzer şekilde çarpıklık ve basıklığı kullanır.

Ekonometri ve zaman serisi analizinde yaygındır. D'Agostino-Pearson gibi, güvenilir sonuçlar üretmek için makul büyüklükte bir örnekleme ihtiyaç duyar. Küçük örneklemlerle test pek güvenilir değildir. Finans veya ekonomi bağlamında çalışıyorsanız bunu sık görürsünüz.

Özetle, küçük örneklemler için Shapiro-Wilk ile başlayın ve bir Q-Q grafiği ile eşleştirin. Kuyruk davranışı önemli olduğunda Anderson-Darling'i, sapmanın doğasını anlamak istediğinizde D'Agostino-Pearson'ı kullanın.

Normallik Testi Sonuçları Nasıl Yorumlanır

Her normallik testi bir hipotez testidir.

Sıfır hipotezi, herhangi bir normallik testinde verilerinizin normal dağıldığıdır. Test ardından şu soruyu sorar: veride gördüklerimize bakarak, bu sıfır hipotezinin doğru olma olasılığı nedir?

Cevap bir p-değeri olarak gelir:

- p > 0.05 - normalliği reddetmek için yeterli kanıt yok. Verinin normal olduğunu varsayın ve parametrik testlerle devam edin

- p < 0.05 - veri normallikten istatistiksel olarak tespit edilebilir düzeyde farklılaşıyor. Normallik varsayımını reddedin

Kulağa basit geliyor, ama birçok kişi burada yanılıyor.

Düşük bir p-değeri, verinizin ne kadar normal olmadığını söylemez - yalnızca bir farkın tespit edildiğini söyler. Büyük örneklemlerde normallik testleri son derece duyarlı hale gelir. Analizinizi hiç etkilemeyecek kadar küçük sapmaları bile işaretlerler.

Tersi sorun da vardır. Küçük örneklemlerde, gözle görülür şekilde çarpık veriler bile, testin sapmayı tespit edecek gücü olmadığı için p > 0.05 üretebilir.

İstatistiksel anlamlılık ile pratik anlamlılık aynı şey değildir.

Bir p-değeri size normallikten bir sapma olup olmadığını söyler. O sapmanın sizin özel analiziniz için önemli olup olmadığını söylemez. Test sonucunu her zaman bir Q-Q grafiğiyle eşleştirin - noktalar çizgiyi yakından takip ediyorsa, p-değerinin ne dediğinden bağımsız olarak veriniz muhtemelen yeterince normaldir.

Python'da Normallik Testleri

Python'un scipy.stats modülü, birkaç satır kodla normallik testlerini çalıştırmanız için gereken her şeye sahiptir.

Aşağıdaki tüm örneklerde aynı veri setini kullanacağım - normal dağılımdan çekilmiş 100 örnek - böylece kodu çalıştırıp takip edebilirsiniz.

import numpy as np

from scipy import stats

np.random.seed(42)

data = np.random.normal(loc=0, scale=1, size=100)Shapiro-Wilk testi

Özellikle küçük veri setlerinde ilk kontrol olarak shapiro() kullanın.

stat, p_value = stats.shapiro(data)

print(f"Statistic: {stat:.4f}, p-value: {p_value:.4f}")Elde edeceğiniz çıktı şudur:

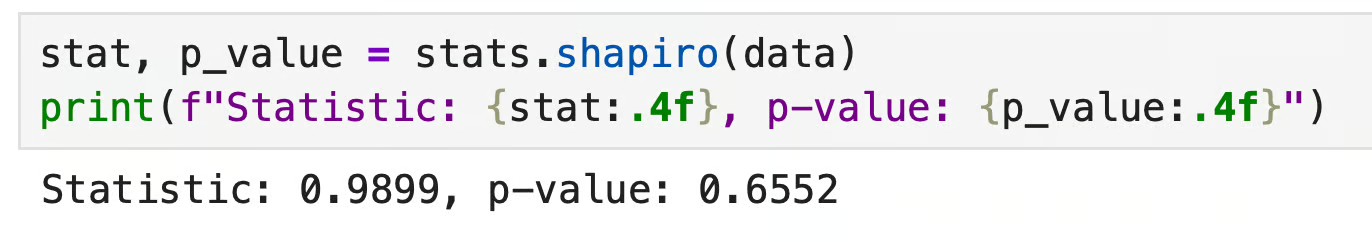

Python'da Shapiro-Wilk testinin çıktısı

p-değeri 0.05'in oldukça üzerindedir, bu nedenle normalliği reddetmiyoruz. Veriler normal görünüyor - ki normal dağılımdan ürettiğimiz için mantıklı.

Kolmogorov-Smirnov testi

kstest() örnekleminizi isimlendirilmiş bir dağılımla karşılaştırır. Normallik için, örneklemin ortalamasını ve standart sapmasını birlikte "norm" iletin.

stat, p_value = stats.kstest(data, 'norm', args=(data.mean(), data.std()))

print(f"Statistic: {stat:.4f}, p-value: {p_value:.4f}")

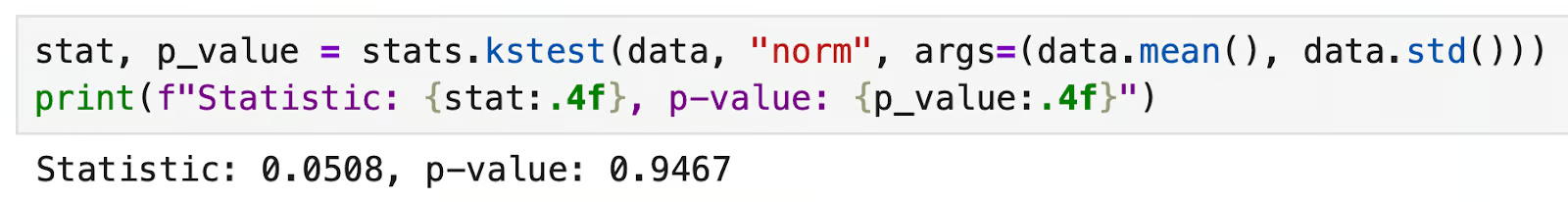

Python'da Kolmogorov-Smirnov testinin çıktısı

Yine p > 0.05 - normalliğe karşı kanıt yok.

Bu testi Python'da kullanırken, ortalamayı ve standart sapmayı her zaman args ile açıkça iletin. Bunu atladığınızda kstest() standart normale (ortalama=0, std=1) varsayar; verileriniz önceden standardize edilmedikçe sonuçlar güvenilir olmaz.

D'Agostino-Pearson testi

normaltest() çarpıklık ve basıklığı birlikte kontrol ederek normalliği test eder. Daha büyük örneklemlerle en iyi şekilde çalışır.

stat, p_value = stats.normaltest(data)

print(f"Statistic: {stat:.4f}, p-value: {p_value:.4f}")

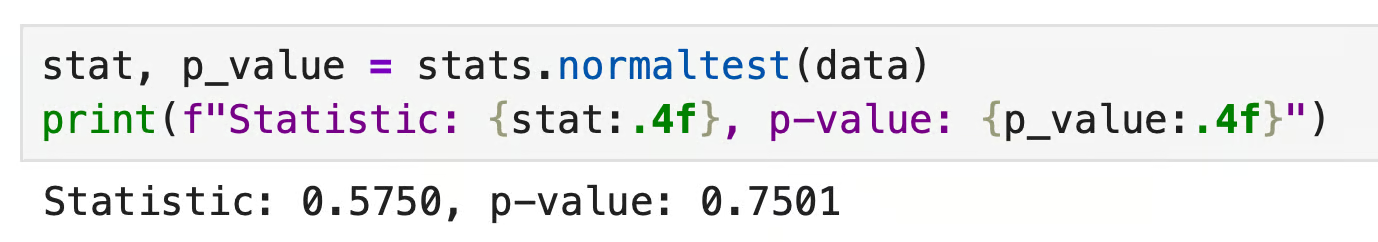

Python'da D'Agostino-Pearson testinin çıktısı

p yine > 0.05. Veri burada üç testten de geçiyor, ancak bu beklenen bir durum - veriyi normal olacak şekilde ürettim. Pratikte, özellikle 0.05 sınırına yakınken bu testlerin farklı sonuçlar verdiğini sıkça görürsünüz. Böyle olduğunda, kararı vermek için Q-Q grafiğinize geri dönün.

R'da Normallik Testleri

R, normallik testi için yerleşik işlevlere sahiptir. Temel ihtiyaçlar için ek paket gerekmez.

Python örneklerinde olduğu gibi, burada da aynı veri setini kullanacağım: normal dağılımdan 100 örnek.

set.seed(42)

data <- rnorm(100, mean = 0, sd = 1)Shapiro-Wilk testi

shapiro.test() küçük ve orta ölçekli örneklemler için başvurulacak yöntemdir. Veri vektörünüzü doğrudan verin:

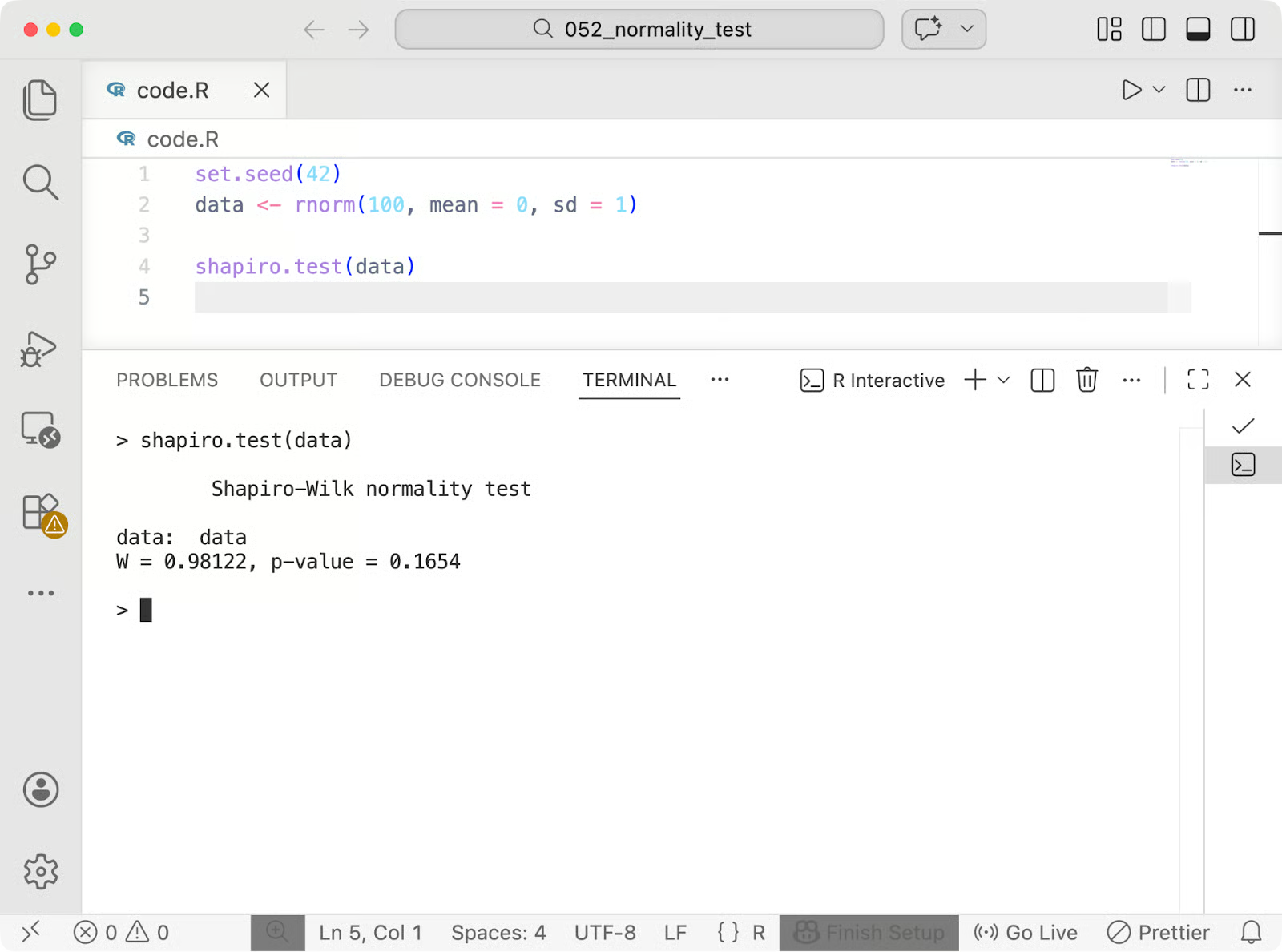

shapiro.test(data)

R'da Shapiro-Wilk testinin çıktısı

p > 0.05 - normalliğe karşı kanıt yok. W istatistiği 0 ile 1 arasında değişir; 1'e yakın değerler, verinin normal dağılıma yakından uyduğunu gösterir.

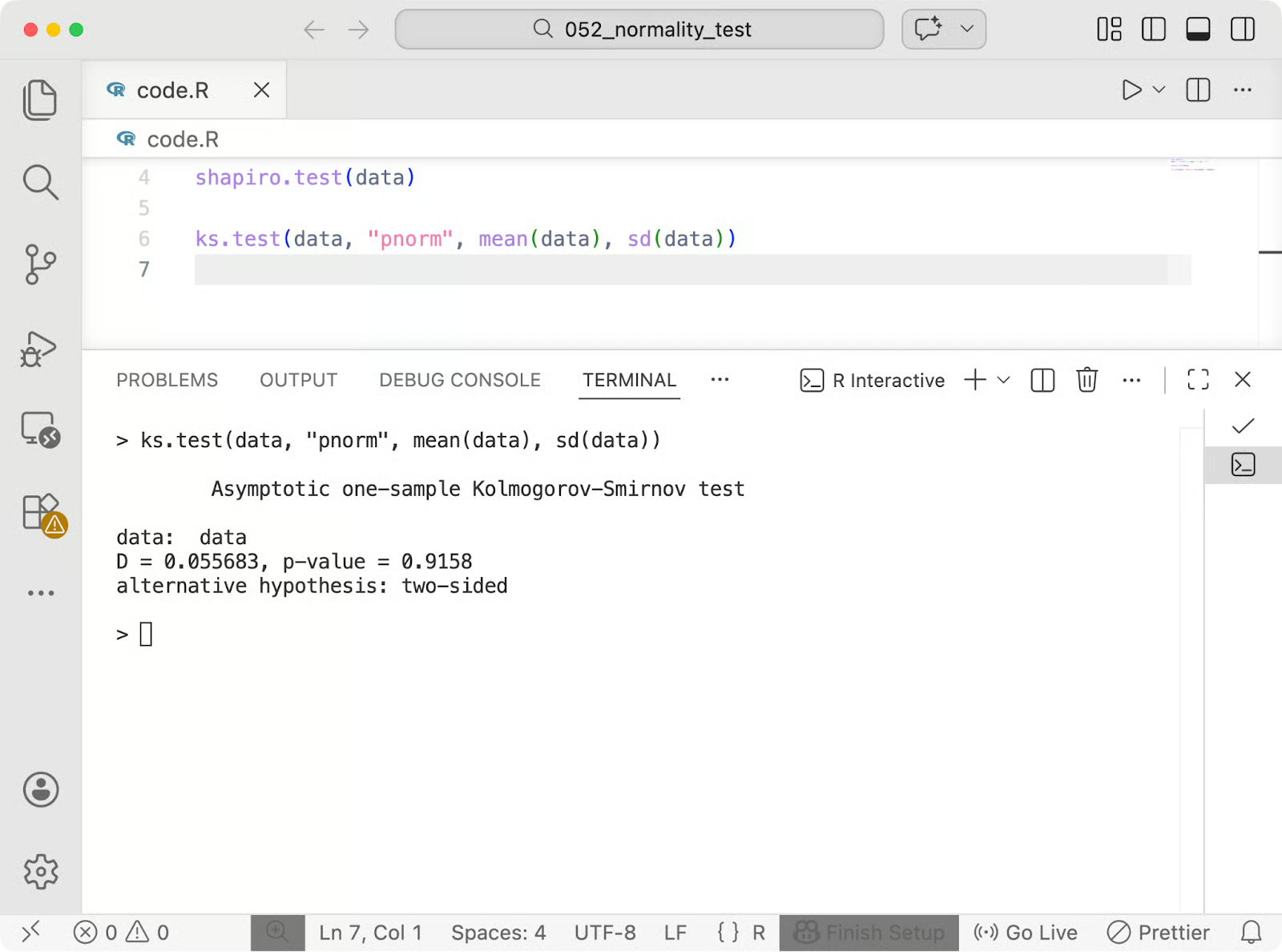

Kolmogorov-Smirnov testi

ks.test() örnekleminizi teorik bir dağılımla karşılaştırır. Normallik için "pnorm" belirtin ve örneklemin ortalama ile standart sapmasını iletin.

ks.test(data, "pnorm", mean(data), sd(data))

R'da Kolmogorov-Smirnov testinin çıktısı

p yine > 0.05. Bu testin R'daki kullanımı da Python'dakiyle aynı uyarıya sahiptir: mean(data) ve sd(data) değerlerini mutlaka iletin. Atlamak standart normale varsayılan ayarı kullanır ve verileriniz önceden standardize edilmedikçe sonucu saptırır.

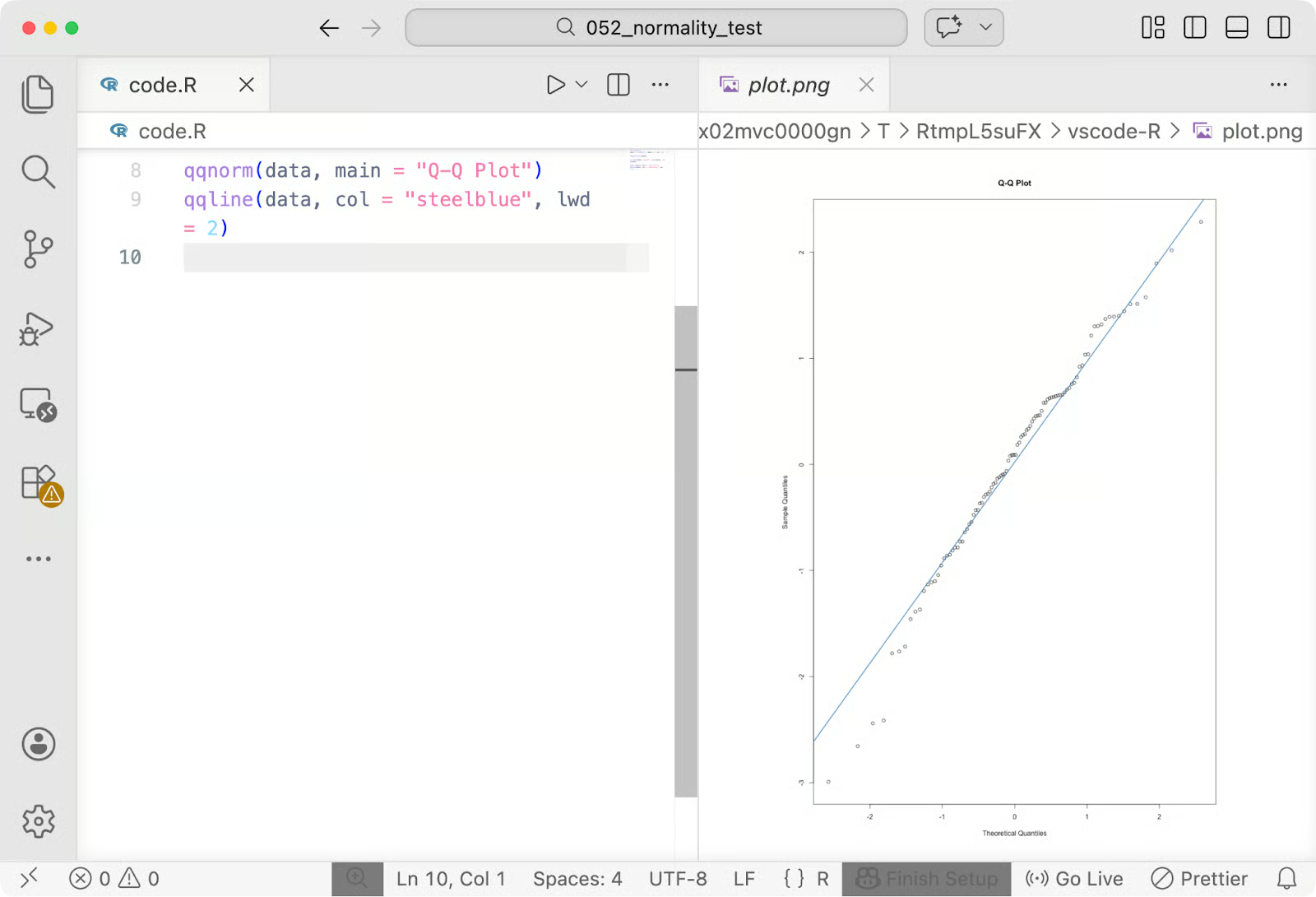

Q-Q grafiği

R'ın yerleşik qqnorm() ve qqline() işlevleri iki satır kodla bir Q-Q grafiği verir.

qqnorm(data, main = "Q-Q Plot")

qqline(data, col = "steelblue", lwd = 2)

R'da Q-Q grafiği

qqnorm() örnek kantillerinizi teorik normal kantillerle karşılaştırır. qqline() referans çizgisini çizer. Noktaların bu çizgiyi yakından takip etmesi, verinizin normal davrandığı anlamına gelir. Uçlardaki sapmalar, araştırmaya değer kuyruk sorunlarını işaret eder.

Veri Normal Değilse Ne Yapmalı

Veriniz bir normallik testinden geçmezse, birkaç sağlam seçeneğiniz var.

Veriyi dönüştürün

Bazen çözüm, verinizi normal davranacak şekilde dönüştürmek ve ardından orijinal testlerinizi dönüştürülmüş değerler üzerinde çalıştırmaktır.

Log dönüşümü en yaygın tercihtir. Sağ çarpık verilerde iyi çalışır - gelir, yanıt süreleri veya sağ tarafta uzun kuyruğu olan biyolojik ölçümler gibi. Python'daki fonksiyon np.log(data), R'daki karşılığı log(data)'dır.

Karekök dönüşümü orta düzey çarpıklık için daha yumuşak bir seçenektir ve veriniz sıfırlar içerdiğinde kullanışlıdır (çünkü sıfırın logunu alamazsınız). Python'da np.sqrt(data) veya R'da sqrt(data) kullanın.

Dönüştürdükten sonra normallik testini yeniden çalıştırın. Dönüştürülmüş veri geçerse, parametrik testlerinizle devam edin - sadece sonuçları dönüştürülmüş ölçek açısından yorumlamayı unutmayın.

Parametrik olmayan testleri kullanın

Dönüşüm işe yaramazsa ya da veriniz için mantıklı değilse, parametrik olmayan testlere geçin. Bunlar normallik varsaymaz - ham değerlerle çalışmak yerine verileri sıralar.

- Mann-Whitney U testi, bağımsız örneklem t-testinin parametrik olmayan alternatifidir. İki grubu karşılaştırırken kullanın

- Kruskal-Wallis testi, tek yönlü ANOVA'nın parametrik olmayan versiyonudur. Üç veya daha fazla grubu karşılaştırırken kullanın

Her ikisi de scipy.stats içinde (mannwhitneyu() ve kruskal()) ve R'ın temel paketinde (wilcox.test() ve kruskal.test()) mevcuttur.

Büyük örneklem büyüklüklerine güvenin

Yeterince büyük örneklemlerde normallik endişesini çoğu zaman göz ardı edebilirsiniz.

merkezi limit teoremi, örneklem büyüklüğünüz arttıkça ortalamanın örnekleme dağılımının - orijinal verinin dağılımı ne olursa olsun - normale yaklaştığını söyler. Pratikte bu, temel veriler mükemmel şekilde normal olmasa bile parametrik testlerin büyük örneklemlerde genellikle güvenilir olduğu anlamına gelir.

Normallik Testi Yaparken Yaygın Hatalar

Normallik testi kolaydır - gördüğünüz gibi tek satır kodla yapılabilir. Yine de yanlış yapılabilecek birkaç nokta vardır.

İşte veri bilimine yeni başlayanların sıklıkla yaptığı yaygın hatalar:

- Yalnızca p-değerlerine güvenmek: Bir p-değeri, normallikten bir sapmanın tespit edilip edilmediğini söyler; bu sapmanın ne kadar büyük olduğunu ya da önemli olup olmadığını değil. p > 0.05'i yeşil ışık, p < 0.05'i kırmızı ışık gibi görmek fazla basittir. Test sonucunu her zaman bir Q-Q grafiğiyle eşleştirin

- Örneklem büyüklüğü etkilerini göz ardı etmek: Küçük örneklemlerde, normallik testleri gerçek sapmaları kaçırabilir ve veriniz gözle görülür şekilde çarpık olsa bile p > 0.05 döndürebilir. Büyük örneklemlerde ise test o kadar duyarlı olur ki küçücük, anlamsız sapmaları istatistiksel olarak anlamlı diye işaretler. Örneklem büyüklüğü p-değerinin anlamını değiştirebilir

- Normalliği aşırı test etmek: Her analiz resmi bir normallik testine ihtiyaç duymaz. Keşif amaçlı çalışıyorsanız genellikle bir histogram ve Q-Q grafiği yeterlidir

- Hafif sapmaları yanlış yorumlamak: Gerçek dünya verileri neredeyse hiçbir zaman tamamen normal değildir. Q-Q grafiğinde referans çizgisinden küçük bir sapma ya da 0.05'in hemen altındaki bir p-değeri, verinizin normallikten çok uzak olduğu anlamına gelmez. Soru, yürüttüğünüz test için yeterince normal olup olmadığıdır

Sonuç olarak, normallik testi veriniz için yalnızca tek bir kontroldür. Bunu nihai hüküm olarak değil, birçok girdiden biri olarak kullanın.

Normallik Testini Ne Zaman Atlayabilirsiniz

Normallik testi her zaman gerekli değildir. Zaman baskısı altındaysanız, ne zaman atlanabileceğini bilmek, sonuçları etkilemeden size zaman kazandırabilir.

Büyük veri setleri

Büyük bir örnekleme sahip olduğunuzda, merkezi limit teoremi, ortalamanın örnekleme dağılımının ham verinizin şekli ne olursa olsun yaklaşık olarak normal olacağını garanti eder. Bu durumda parametrik testler genellikle güvenilirdir; dolayısıyla resmi bir normallik testi çalıştırmak çok az değer katar.

Bazı istatistiksel yöntemler de normal olmayışa karşı dayanıklıdır. Doğrusal regresyon gibi teknikler, örneklem büyüklükleri makulse ve ihlaller aşırı değilse genellikle iyi işler. (Doğrusal regresyon yine de artıkların normalliğini varsayar.)

Keşif analizi

Verilerde örüntüler ararken, sezgi inşa ederken veya hangi değişkenleri daha fazla inceleyeceğinize karar verirken, hızlı bir histogram veya Q-Q grafiği yeterlidir. Resmi testler, sonuçlarınızın sağlam olması gerektiğinde - doğrulayıcı analiz içindir.

Unutmayın, normallik testi sizi yanlış çıkarım yapmaktan korumak için vardır. Yanlış bir çıkarımın gerçek sonuçlar doğurmadığı bir bağlamdaysanız ya da yönteminizi normallik şart koşmuyorsa, test isteğe bağlıdır.

Sonuç

Normallik testi, varsayımlarınızın sonuçlarınıza güvenmek için yeterince sağlanıp sağlanmadığını kontrol etmekle ilgilidir.

Hiçbir veri kümesi mükemmel şekilde normal değildir. Amaç, verinizin nasıl davrandığını anlamak ve yöntemlerinizi buna göre seçmektir. Bir Q-Q grafiği sapmaların nerede olduğunu gösterir. Resmi bir test, bunların istatistiksel olarak tespit edilebilir olup olmadığını bildirir. Birlikte kullanıldıklarında, tek başlarına olduğundan daha net bir resim sunarlar.

Doğru test bağlamınıza bağlıdır. Küçük örneklemler için Shapiro-Wilk, kuyruklar önemliyse Anderson-Darling, normallik varsayılamıyorsa parametrik olmayan alternatifler. Ve bazen - büyük örneklemler veya dayanıklı yöntemlerle - hiç test gerekmeyebilir.

p-değerleri kavramı size tamamen kafa karıştırıcı mı geliyor? Doğru yorumladığınızdan emin olmak için Kolaylaştırılmış Hipotez Testi makalemizi okuyun.

Normallik Testi SSS

Normallik testi nedir?

Normallik testi, verinizin normal (Gauss) dağılımı takip edip etmediğini kontrol eden istatistiksel bir yöntemdir. t-testi, ANOVA ve doğrusal regresyon gibi en yaygın istatistiksel testlerin çoğu normallik varsayar; bu varsayımı analizinizi çalıştırmadan önce kontrol etmek, yanlış çıkarımlardan kaçınmanıza yardımcı olur.

Her zaman normallik testi yapmam gerekir mi?

Her zaman değil. Büyük örneklemlerde merkezi limit teoremi, parametrik testleri temel dağılımdan bağımsız olarak güvenilir kılar. Keşif analizinde, hızlı bir histogram veya Q-Q grafiği genellikle yeterlidir - resmi normallik testleri en çok doğrulayıcı analiz yaparken ve sonuçlarınızın sağlam olması gerektiğinde kullanışlıdır.

Verim normallik testinden kalırsa ne yapmalıyım?

Birkaç seçeneğiniz var. Veriyi log veya karekök dönüşümüyle dönüştürüp yeniden test edebilirsiniz. Dönüşüm işe yaramazsa, normallik varsaymayan parametrik olmayan testlere geçin; iki grup için Mann-Whitney U, üç veya daha fazla grup için Kruskal-Wallis gibi.

Shapiro-Wilk ve Kolmogorov-Smirnov testleri arasındaki fark nedir?

Shapiro-Wilk özellikle normallik testi için tasarlanmıştır ve küçük-orta ölçekli örneklemlerde en iyi sonucu verir. Kolmogorov-Smirnov testi daha geneldir - sadece normal değil, herhangi bir teorik dağılıma karşı bir örneği karşılaştırabilir - ancak özellikle normallik testi için Shapiro-Wilk'e göre daha az güçlüdür; bu da ince sapmaları kaçırma olasılığının daha yüksek olduğu anlamına gelir.

Normallik için bir Q-Q grafiğini nasıl yorumlarım?

Q-Q grafiği, verinizin kantillerini teorik bir normal dağılımın kantilleriyle karşılaştırır. Noktalar diyagonal referans çizgisine yakın düşüyorsa veriniz normal davranıyor demektir. Çizginin uçlarındaki sapmalar kuyruk sorunlarına işaret eder - S şeklindeki bir eğri çarpıklığa, her iki uçta çizgiden uzaklaşan noktalar ise normal dağılıma kıyasla daha ağır ya da daha hafif kuyruklara işaret eder.