Program

Küçük dil modelleri (SLM'ler), büyük dil modellere (LLM'ler) kıyasla daha küçük, daha hızlı ve daha kolay özelleştirilebilir olmaları sayesinde, sınırlı kaynaklara sahip olanlar için yapay zekâyı daha erişilebilir ve verimli hâle getirme sorununu çözer.

SLM'ler daha az parametreye sahiptir (genellikle 10 milyarın altında); bu da hesaplama maliyetlerini ve enerji kullanımını ciddi şekilde düşürür. Belirli görevlere odaklanırlar ve daha küçük veri kümeleriyle eğitilirler. Böylece performans ile kaynak verimliliği arasında denge korunur.

Küçük Dil Modelleri Nedir?

Küçük dil modelleri, son dönemde çokça duyduğumuz devasa büyük dil modellerinin daha kompakt ve son derece verimli sürümleridir. GPT-4o gibi LLM'lerin yüz milyarlarca parametresi bulunur; SLM'ler ise çok daha az—genellikle milyonlardan birkaç milyara kadar—parametre kullanır.

SLM'lerin temel özellikleri şunlardır:

- Verimlilik: SLM'ler, LLM'lerin ihtiyaç duyduğu devasa hesaplama gücüne ihtiyaç duymaz. Bu da onları akıllı telefonlar, tabletler veya IoT cihazları gibi sınırlı kaynaklara sahip aygıtlarda kullanım için ideal kılar—bu konuda daha fazla bilgi için uç yapay zekâ blog yazısını inceleyin.

- Erişilebilirlik: Sınırlı bütçeye sahip kişiler, üst düzey altyapıya ihtiyaç duymadan SLM'leri hayata geçirebilir. Ayrıca, her zaman bulut tabanlı altyapıya dayanmadıkları için gizlilik ve veri güvenliğinin çok önemli olduğu kurum içi dağıtımlar için de uygundurlar.

- Özelleştirme: SLM'leri ince ayar yapmak kolaydır. Daha küçük boyutları, niş görevler ve uzmanlaşmış alanlara hızla uyum sağlamalarına olanak tanır. Bu da onları müşteri desteği, sağlık veya eğitim gibi belirli uygulamalar için çok uygun kılar (buna az sonra daha detaylı değineceğiz!).

- Daha hızlı çıkarım: SLM'lerin işlenecek parametre sayısı daha az olduğundan yanıt süreleri daha kısadır. Bu da onları, sohbet botları, sanal asistanlar veya hızlı kararların kritik olduğu her türlü sistem gibi gerçek zamanlı uygulamalar için mükemmel kılar. Yanıtları beklemek zorunda kalmazsınız; bu da düşük gecikmenin şart olduğu ortamlarda büyük avantaj sağlar.

Küçük Dil Modeli Örnekleri

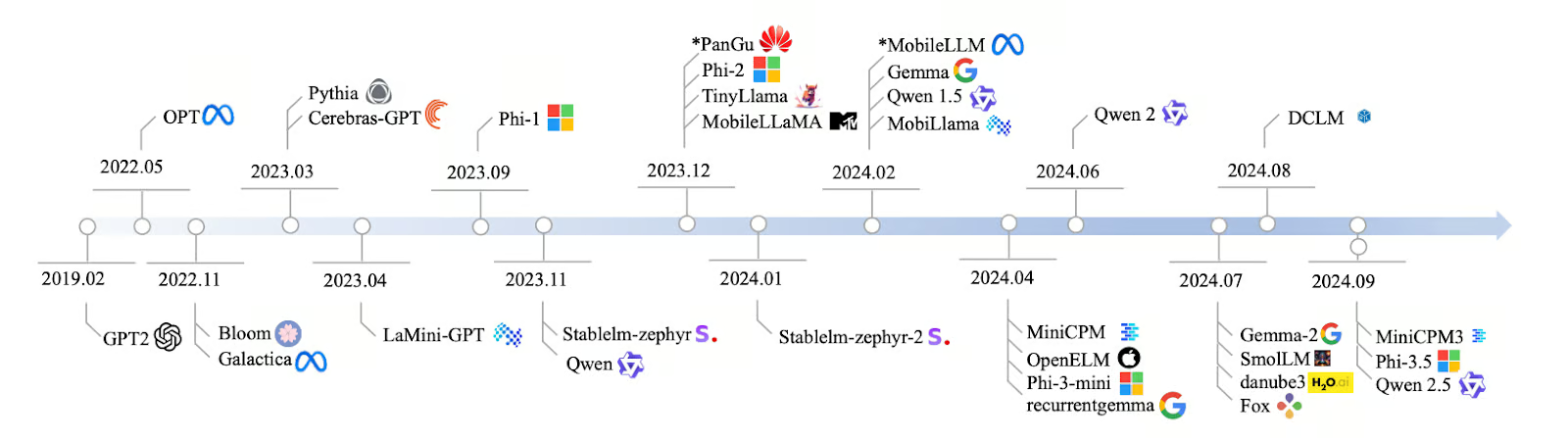

2019'dan 2024'e kadar SLM'lerin gelişimi hızlı oldu; daha verimli yapay zekâ ihtiyacını karşılamak için birçok yeni model ortaya çıktı. 2019'da GPT-2 ile başladı ve yıllar içinde modeller daha odaklı ve hızlı hâle geldi. 2022'ye gelindiğinde Bloom ve Galactica gibi modeller çok dilli içeriği ve bilimsel verileri işleyebiliyordu; 2023'te Pythia ve Cerebras-GPT gibi modeller kodlama ve mantıksal düşünme gibi görevlere yönelik tasarlandı.

2024'te LaMini-GPT, MobileLLaMA ve TinyLlama gibi, mobil cihazlar ve diğer düşük güçlü sistemlerde iyi çalışacak şekilde tasarlanmış daha da fazla SLM yayımlandı. Meta, Google ve Microsoft gibi şirketler bu modellerin geliştirilmesine öncülük ediyor; bazıları kamuya açıkken bazıları özel tutuluyor.

Kaynak: Lu ve ark., 2024

Uygulayıcılar, hafif, hızlı ve çalıştırmak için çok fazla kaynağa ihtiyaç duymadıkları için SLM'leri birçok sektörde kullanır. İşte bu modellerden bazıları, parametreleri ve öne çıkan özellikleriyle:

|

Model Adı |

Parametreler |

Açık Kaynak |

Öne Çıkan Özellikler |

|

Qwen2 |

0.5B, 1B, 7B |

Evet |

Ölçeklenebilir, çeşitli görevler için uygun |

|

Mistral Nemo 12B |

12B |

Evet |

Karmaşık NLP görevleri, yerel dağıtım |

|

Llama 3.1 8B |

8B |

Evet* |

Güç ve verimlilik arasında dengeli |

|

Pythia |

160M - 2.8B |

Evet |

Akıl yürütme ve kodlamaya odaklı |

|

Cerebras-GPT |

111M - 2.7B |

Evet |

Hesaplama açısından verimli, Chinchilla ölçekleme yasalarına uyar |

|

Phi-3.5 |

3.8B |

Evet** |

Uzun bağlam uzunluğu (128K token), çok dilli |

|

StableLM-zephyr |

3B |

Evet |

Hızlı çıkarım, uç sistemler için verimli |

|

TinyLlama |

1.1B |

Evet |

Mobil ve uç cihazlar için verimli |

|

MobileLLaMA |

1.4B |

Evet |

Mobil ve düşük güçlü cihazlar için optimize edilmiş |

|

LaMini-GPT |

774M - 1.5B |

Evet |

Çok dilli, talimat izleme görevleri |

|

Gemma2 |

9B, 27B |

Evet |

Yerel dağıtım, gerçek zamanlı uygulamalar |

|

MiniCPM |

1B - 4B |

Evet |

Dengeli performans, İngilizce ve Çince için optimize edilmiş |

|

OpenELM |

270M - 3B |

Evet |

Çoklu görev, düşük gecikme, enerji verimli |

|

DCLM |

1B |

Evet |

Günlük akıl yürütme, mantıksal çıkarım |

|

Fox |

1.6B |

Evet |

Mobil uygulamalar için hız açısından optimize edilmiş |

*Kullanım kısıtlamalarıyla

**Yalnızca araştırma amaçlı

Bu modeller hakkında daha fazla bilgiyi, yazdığım ayrı bir makalede bulabilirsiniz: en iyi küçük dil modelleri.

SLM'ler Nasıl Çalışır

Küçük dil modellerinin nasıl çalıştığına bakalım.

Sonraki kelime tahmini

LLM'ler gibi SLM'ler de bir metin dizisinde sonraki kelimeyi tahmin ederek çalışır. SLM'ler, eğitildikleri metinlerden öğrendikleri kalıpları kullanarak sırada neyin geleceğini kestirir. Bu, tüm dil modellerinin merkezinde yer alan basit ama güçlü bir kavramdır.

Örneğin şu girdi verildiğinde: "Harry Potter serisinde, ana karakterin en iyi arkadaşının adı Ron..." Bir SLM bu bağlamı analiz eder ve en olası sonraki kelimeyi tahmin eder—bu durumda "Weasley".

Transformer mimarisi

Transformer mimarisi, LLM'lerin ve SLM'lerin dili anlaması ve üretmesinde kilit öneme sahiptir. Transformer'lar dil modellerinin beyni gibi düşünülebilir. Cümle içindeki hangi kelimelerin birbirleriyle daha ilgili olduğunu bulmak için öz-dikkat mekanizmasını kullanırlar. Bu, modelin bağlamı anlamasına yardımcı olur—örneğin, "Paris"in bir şehri mi yoksa iş yerinden tanıdığınız kişiyi mi ifade ettiğini ayırt etmek gibi.

Boyut ve performans dengesi

SLM'lerin gücü, boyut ile performans arasında denge kurabilmelerinde yatar. LLM'lere kıyasla önemli ölçüde daha az parametre kullanırlar; LLM'lerde yüz milyarlar varken bunlarda genellikle milyonlardan birkaç milyara kadar değişir.

Daha az parametre ile SLM'ler eğitilmek için daha az hesaplama gücü ve veriye ihtiyaç duyar; bu da sınırlı kaynaklarınız varsa onları daha erişilebilir kılar. SLM'lerin kompakt boyutu, girdiyi işlemelerini ve çıktı üretmelerini hızlandırır; bu da mobil klavyeler veya sesli asistanlar gibi gerçek zamanlı uygulamalar için son derece önemlidir.

SLM'ler, büyük modeller kadar çok yönlü veya derin kavrayışlı olmayabilir; ancak belirli görevleri iyi yürütürler. Örneğin, hukuk metinlerini analiz etmek üzere eğitilmiş bir SLM, o alanda genel amaçlı bir LLM'den daha iyi performans gösterebilir.

SLM'ler Nasıl Oluşturulur: Teknikler ve Yaklaşımlar

SLM'ler, daha küçük, daha hızlı ve daha verimli hâle gelmek için damıtma, budama ve kuantizasyon gibi teknikleri kullanır.

Damıtma

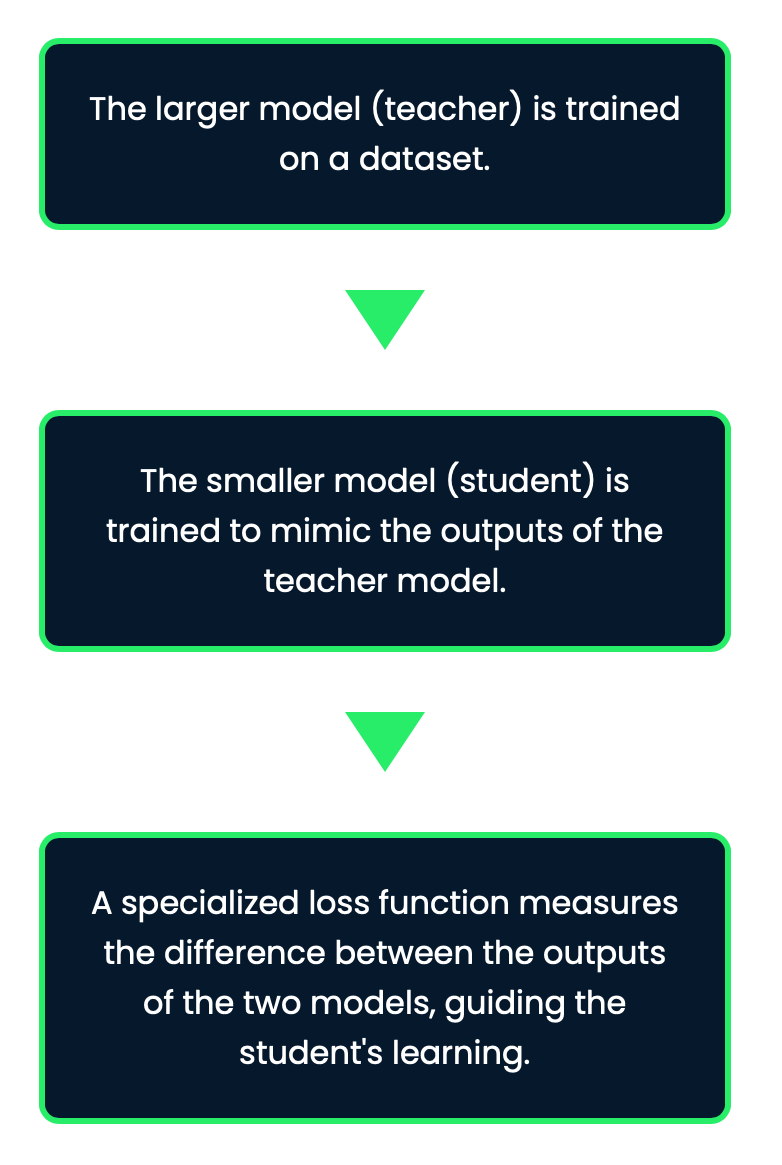

Bu, daha büyük bir "öğretmen" modelden daha küçük bir "öğrenci" modele bilgi aktarılarak SLM oluşturma tekniğidir. Amaç, öğretmen modelin öğrendiklerini, performanstan çok fazla ödün vermeden öğrenci modele sıkıştırmaktır.

Bu süreç, SLM'lerin daha yönetilebilir boyut ve hesaplama gereksinimleriyle, büyük modellerin doğruluğunun önemli bir kısmını korumasını sağlar. Bu teknikle küçük model, sadece öğretmenin nihai tahminlerini değil, altta yatan kalıpları ve nüansları da öğrenir.

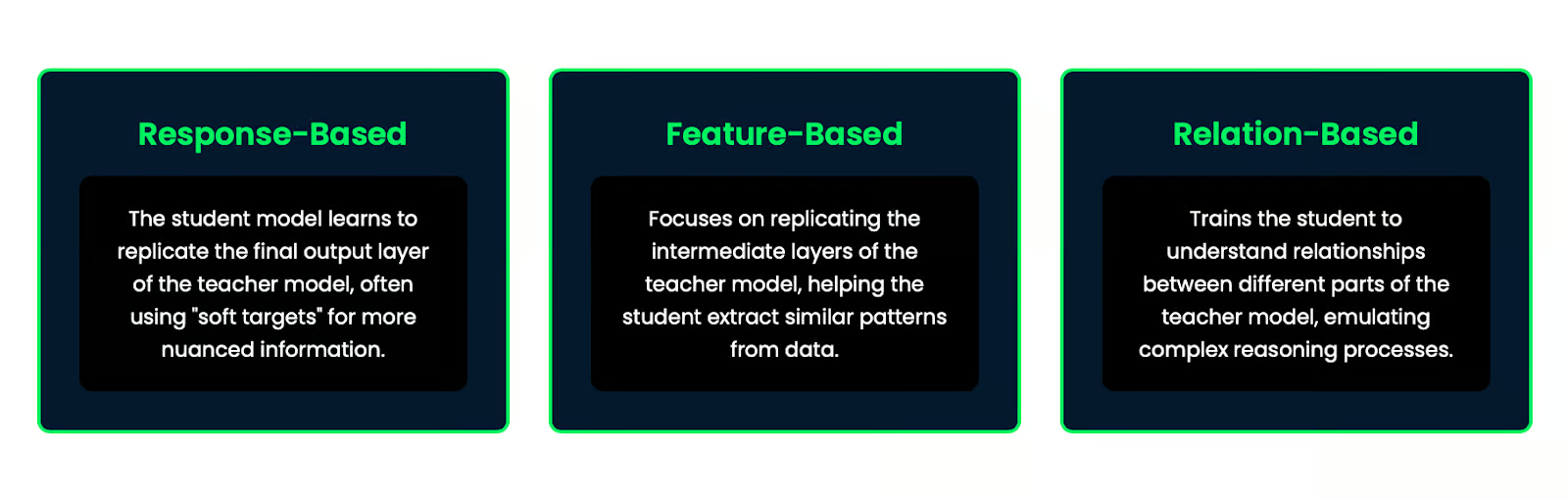

Bilgi damıtmanın birkaç yöntemi vardır:

- Yanıt tabanlı: Öğrenci model, çoğu zaman daha nüanslı bilgi için "yumuşak hedefler" kullanarak, öğretmen modelin nihai çıktı katmanını kopyalamayı öğrenir.

- Özellik tabanlı: Öğretmen modelin ara katmanlarının kopyalanmasına odaklanır; bu da öğrencinin veriden benzer kalıplar çıkarmasına yardımcı olur.

- İlişki tabanlı: Öğrenciyi, öğretmen modelin farklı kısımları arasındaki ilişkileri anlaması için eğitir; böylece karmaşık akıl yürütme süreçlerini taklit eder.

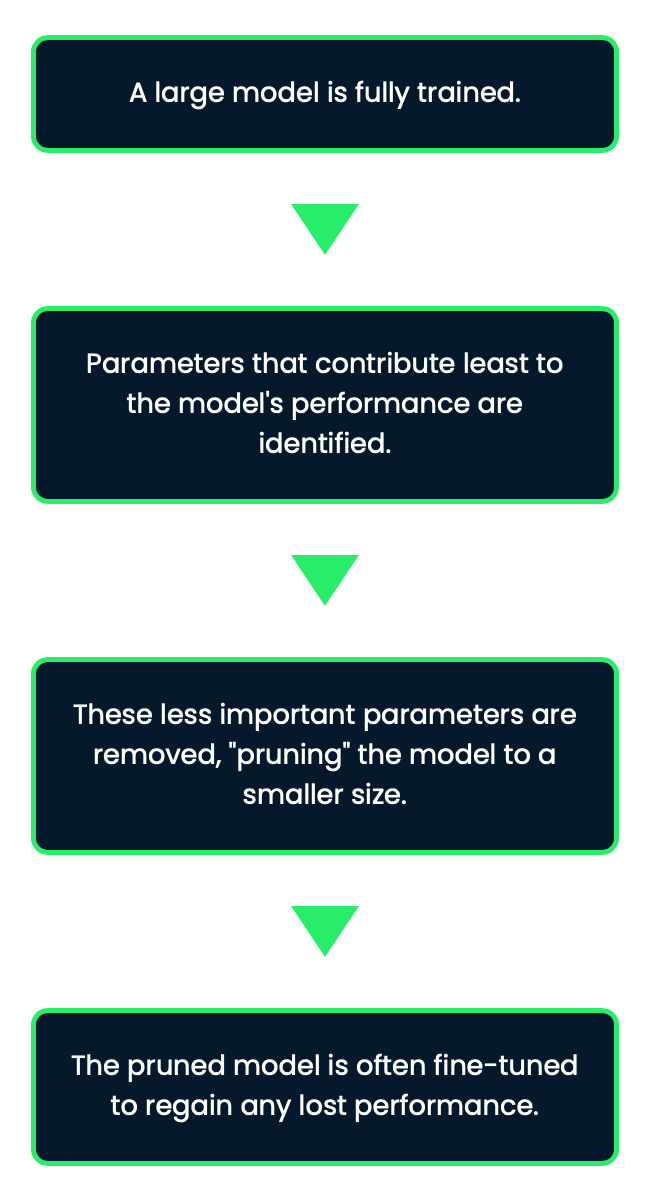

Budama

Budama, ihtiyaç olmayan kısımları kırpmaya benzer. Budama sırasında, genel performansa fazla katkı sunmayan nöronlar veya parametreler gibi modelin daha önemsiz kısımları çıkarılır. Bu teknik, doğruluğu anlamlı ölçüde etkilemeden modeli küçültmeye yardımcı olur. Ancak budama biraz hassastır; fazla agresif olursanız, çok fazla kesip model performansına zarar verme riski vardır.

Budama, model boyutunu önemli ölçüde azaltırken özgün performansın büyük bölümünü koruyabilir; bu da onu SLM oluşturmak için etkili bir teknik yapar.

Kuantizasyon

Kuantizasyon, modeldeki sayıların daha az bit ile saklanmasını içerir. Normalde bir model 32 bit sayılar kullanabilir; fakat bu yöntemle bu sayılar çok daha küçük olan 8 bit değerlere indirgenir. Bu, modelin kapladığı alanı azaltır ve daha hızlı çalışmasını sağlar. En iyi yanı ise, sayılar daha az hassas olsa bile modelin yalnızca küçük bir doğruluk kaybıyla iyi çalışmaya devam etmesidir.

Bir hava durumu uygulamasında sıcaklık değerlerini depoladığınızı düşünün. Bunları yüksek hassasiyetle (örneğin 32 bit sayılarla) tutmak ihtiyacınızın ötesindedir. Hassasiyeti 8 bite düşürerek bazı ayrıntıları kaybedebilirsiniz; ancak uygulama daha hızlı çalışırken daha az bellek kullanarak hâlâ kullanışlı olur.

Bu yaklaşım özellikle akıllı telefonlar veya uç cihazlar gibi sınırlı bellek ve hesaplama gücüne sahip aygıtlarda yapay zekâyı dağıtmak için yararlıdır.

Kuantizasyon, bellek gereksinimlerini azaltıp çıkarım hızını artırdığı için, kaynakları sınırlı aygıtlarda modelleri dağıtmak adına özellikle etkilidir.

Küçük Dil Modellerinin Kullanım Alanları

SLM'lerin güzelliği, devasa altyapılara veya sürekli internet bağlantısına ihtiyaç duymadan güçlü yapay zekâ sunabilmeleridir; bu da pek çok kullanım alanının önünü açar.

Cihaz üzerinde yapay zekâ

Günlük hayatınızı kolaylaştıran, telefonunuzdaki sesli asistanları düşünün. Bunu mümkün kılan SLM'lerdir. Verileri buluta göndermeye gerek kalmadan gerçek zamanlı metin tahmini, sesli komutlar ve hatta çeviri sağlarlar. Her şey yerelde yapılır; bu da daha hızlı yanıtlar ve gizliliği daha çok gözeten etkileşimler demektir.

Örneğin SwiftKey ve Gboard, bağlamsal olarak isabetli metin önerileri sunmak için SLM'leri kullanır; bu da yazma hızını ve doğruluğunu artırır.

Bu, çevrimdışı uygulamalara da uzanır; böylece yapay zekâ, internet bağlantısı olmadan da çalışabilir ve sınırlı bağlantının olduğu bölgelerde kullanışlı hâle gelir.

Örneğin Google Çeviri, SLM'ler tarafından desteklenen çevrimdışı çeviri yetenekleri sunarak, internet erişiminin kısıtlı olduğu yerlerde iletişimi kolaylaştırır.

Kişiselleştirilmiş yapay zekâ

SLM'lerin harika yanlarından biri de belirli görevler veya kullanıcı tercihleri için özelleştirilebilmeleridir. İşinizde müşteri hizmetlerine özel olarak ince ayar yapılmış bir sohbet botuna ya da önceki etkileşimlerinize göre size tam olarak nasıl yardımcı olacağını bilen bir yapay zekâya sahip olduğunuzu hayal edin. Bu modeller daha küçük olduğundan, farklı sektörlerde ince ayar yapmak ve dağıtmak çok daha kolaydır.

Bazı örneklere bakalım:

- Sağlık: SLM'ler, akıllı giyilebilirlerde gerçek zamanlı sağlık takibi ve tavsiye için tıbbi metin analizine özel olarak uyarlanabilir. Sürekli bulut bağlantısından bağımsız çalışırlar.

- Akıllı ev cihazları: Akıllı ev sistemlerine gömülü SLM'ler, sıcaklık ve aydınlatma için bireysel tercihleri öğrenebilir ve günün farklı saatlerine veya özel durumlara göre ayarları otomatik olarak düzenleyebilir.

- Eğitim: SLM kullanan eğitim uygulamaları, bireysel öğrenme stillerine ve hızlarına uyum sağlayarak öğrencilere kişiselleştirilmiş rehberlik ve destek sunabilir.

Nesnelerin İnterneti

SLM'ler, akıllı ev sisteminiz veya diğer aygıtlar gibi gündelik cihazlarda arka planda sessizce çalışır. Bu cihazların sizi doğrudan internet bağlantısına ihtiyaç duymadan anlamasına ve yanıt vermesine yardımcı olarak onları daha hızlı ve daha akıllı hâle getirir.

Diğer uygulamalar

SLM'ler, çok sayıda başka alanda da kullanım buluyor:

- Gerçek zamanlı dil çevirisi: SLM'ler anlık çeviriyi mümkün kılar; bu da küresel iletişim için önemlidir. Bazı seyahat uygulamaları artık SLM'leri kullanarak tabelaları, menüleri veya sesli yönlendirmeleri gerçek zamanlı çevirir. Bu, kullanıcıların yabancı dillerde yolunu bulmasına yardımcı olur.

- Otomotiv sistemleri: Araçlarda SLM'ler, gerçek zamanlı trafik güncellemeleri sağlayıp en iyi rotaları önererek akıllı navigasyon sunar. Ayrıca sürücülerin ellerini kullanmadan müzik kontrolü, arama yapma veya mesaj gönderme gibi işlemler için sesli komutları iyileştirirler.

- Eğlence sistemleri: Akıllı TV'ler ve oyun konsolları, sesli kontrol ve daha önce izlediklerinize veya oynadıklarınıza göre dizi/oyun önerileri için SLM'leri kullanır.

- Müşteri hizmetleri: SLM'ler, şirketlerin müşteri sorularını daha verimli yönetmesine yardımcı olur. Perakende mağazaları, ürünler, sipariş durumu veya iade politikaları hakkında soruları yanıtlamak için SLM kullanır. Bu da insan destek ihtiyacını azaltır.

LLM'ler ve SLM'ler

Şimdi, ne zaman LLM'lerle büyümek, ne zaman SLM'leri tercih etmek gerektiğinden bahsedelim.

Görev karmaşıklığı

Derin kavrayış, uzun içerik üretimi veya zorlu problemleri çözme gibi son derece karmaşık görevlerde, GPT-4o gibi büyük modeller, genelde SLM'lerden daha iyi performans gösterir. Bu görevleri, daha ayrıntılı yanıtlar sunmak için çok büyük miktarda veriden yararlanarak yerine getirebilirler. Ancak bu düzeydeki yetkinlik, çok fazla hesaplama gücü ve zaman gerektirir.

|

LLM'ler |

SLM'ler |

|

Karmaşık, sofistike ve genel görevleri ele almakta çok iyidir |

Daha makul, daha basit görevler için en uygundur |

|

Farklı görevlerde daha iyi doğruluk ve performans |

Uzmanlaşmış uygulamalar ve alan-özgü görevlerde çok iyidir |

|

Uzun pasajlarda bağlamı koruyup tutarlı yanıtlar verebilir |

Karmaşık dil görevleri ve uzun menzilli bağlamı anlamada zorlanabilir |

Örneğin, farklı konuları ve karmaşık sorguları ele alması gereken genel amaçlı bir sohbet botu geliştiriyorsanız, bir LLM daha uygun olacaktır. Ancak belirli bir ürün hattına odaklanan uzmanlaşmış bir müşteri hizmetleri botu için bir SLM fazlasıyla yeterli olabilir ve odaklı eğitimi sayesinde bir LLM'yi bile geride bırakabilir.

Kaynak kısıtları

Kaynak kısıtlarının olduğu durumlarda SLM'ler öne çıkar. Eğitmek ve dağıtmak için çok daha az hesaplama gücü gerektirirler. Kaynakların sınırlı olduğu ortamlarda çalışıyorsanız harika bir seçenektirler.

|

LLM'ler |

SLM'ler |

|

Önemli düzeyde hesaplama gücü ve bellek gerektirir |

Kaynak tüketimi açısından daha ekonomiktir |

|

Çıkarım için sıklıkla GPU gibi özel donanımlara ihtiyaç duyar |

Standart donanımda ve hatta Raspberry Pi veya akıllı telefon gibi cihazlarda çalışabilir |

|

Kaynak talebi nedeniyle daha yüksek operasyonel maliyetler |

Daha kısa eğitim süreleri; hızlı dağıtımlar için daha erişilebilir |

Mobil cihazlar veya uç bilişim gibi hesaplama gücünün sınırlı olduğu durumlarda SLM'ler, performans ve verimliliği iyi harmanladıkları için çoğunlukla daha iyi seçenektir.

Dağıtım ortamı

Kaynakların sorun olmadığı bir bulut sunucusunda yapay zekâ dağıtıyorsanız, özellikle yanıtlarda yüksek doğruluk ve akıcılık istiyorsanız LLM tercih edilebilir. Ancak CPU veya GPU gücü sınırlı aygıtlarda, örneğin IoT cihazları veya mobil uygulamalarda çalışıyorsanız SLM'ler biçilmiş kaftandır.

|

LLM'ler |

SLM'ler |

|

Bol hesaplama gücünün bulunduğu bulut ortamları için en iyisi |

Bulutta da kullanılabilirler; ancak küçük boyutları onları kaynakların sınırlı olduğu yerler için daha iyi kılar. Daha küçük görevleri ele almakta daha etkilidirler |

|

Çok fazla hesaplama gücü gerektirdiği ve internet bağlantısına dayandığı için cihaz üzerinde yapay zekâ için ideal değildir |

Cihaz üzerinde yapay zekâ için mükemmeldir; çevrimdışı kullanım ve daha hızlı yanıt süreleri sağlar. İnternet bağlantısı gerekmeksizin mobil asistanlar, ses tanıma ve diğer gerçek zamanlı uygulamaları çalıştırabilirler |

|

Yüksek hesaplama gücü gereksinimi ve yavaş yanıt nedeniyle uç bilişim için uygun değildir |

Hızlı yanıtlar ve kaynakların verimli kullanımı önemli olduğu için uç bilişimde harikadır. IoT cihazlarında, akıllı evlerde ve diğer uç uygulamalarda yapay zekâyı mümkün kılarlar |

Dağıtım ortamını değerlendirirken internet bağlantısı, gecikme gereksinimleri ve gizlilik endişeleri gibi faktörleri dikkate almak gerekir. Çevrimdışı çalışması veya en az gecikmeyle yanıt vermesi gereken uygulamalar için, cihaz üzerinde ya da uçta dağıtılan SLM'ler genellikle daha iyi tercihtir.

LLM'ler ile SLM'ler arasında seçim, görevin karmaşıklığına, sahip olduğunuz kaynaklara ve nerede dağıtmak istediğinize bağlıdır. LLM'ler, yüksek doğruluk gerektiren karmaşık görevler için harikadır; SLM'ler ise verimlidir ve daha fazla yerde çalışabilir.

Sonuç

SLM'ler, yapay zekâyı çok daha erişilebilir kılıyor. Çok fazla hesaplama gücüne ihtiyaç duyan büyük dil modellerinin aksine SLM'ler, daha az kaynakla çalışır. Bu da küçük şirketlerin, bireysel geliştiricilerin ve hatta girişimlerin, devasa sunuculara veya büyük bütçelere ihtiyaç duymadan onları kullanabilmesi anlamına gelir.

Küçük dil modelleri hakkında daha fazla bilgi edinmek için şu iki kaynağı öneririm:

SSS

Tipik bir kurumsal uygulama için SLM çalıştırmak ile LLM çalıştırmak arasındaki spesifik enerji tüketimi farkları nelerdir?

SLM'ler ile LLM'lerin enerji tüketimi farkı kayda değerdir. Tipik bir kurumsal uygulamada bir SLM, bir LLM'in ihtiyaç duyduğu enerjinin yalnızca %10-20'sini tüketebilir. Örneğin, bir müşteri hizmetleri sohbet botu için SLM çalıştırmak ayda yaklaşık 50-100 kWh kullanırken, aynı görev için bir LLM 500-1000 kWh tüketebilir. Ancak kesin değerler, model boyutu, kullanım örüntüleri ve donanım verimliliğine göre değişir. Google ve OpenAI gibi şirketler, en büyük modellerini çalıştırmanın yüzlerce evin tüketimine eşdeğer enerji harcayabildiğini bildirirken; SLM'ler sıklıkla standart sunucularda veya güç gereksinimi belirgin şekilde daha düşük uç cihazlarda çalıştırılabilir.

Özel SLM'ler oluşturmak ile mevcut LLM'leri özelleştirilmiş görevler için ince ayar yapmak arasındaki geliştirme zaman çizelgeleri nasıl karşılaştırılır?

Özel SLM geliştirmek ile mevcut LLM'leri özelleştirilmiş görevler için ince ayar yapmak arasındaki geliştirme zaman çizelgeleri önemli ölçüde farklılaşabilir. Sıfırdan özel bir SLM oluşturmak genellikle daha uzun sürer; deneyimli bir veri bilimi ekibi için çoğunlukla 3-6 ay alır; çünkü veri toplama, model mimarisi tasarımı, eğitim ve kapsamlı testleri içerir. Halihazırdaki bir LLM'i belirli bir görev için ince ayar yapmak ise çok daha hızlı olabilir; potansiyel olarak yalnızca birkaç hafta sürer. Ancak bunun karşılığında, ince ayar yapılan LLM'ler, özel olarak inşa edilmiş bir SLM kadar verimli veya uzmanlaşmış olmayabilir. Seçim, çoğu zaman özel kullanım durumuna, mevcut kaynaklara ve istenen performans özelliklerine bağlıdır.

Özellikle veri gizliliği ve fikri mülkiyet açısından, SLM'leri ve LLM'leri dağıtırken yasal ve etik hususlar nelerdir?

Veri gizliliği başlıca bir endişedir; LLM'ler sıklıkla çok fazla eğitim verisine sahip olduğundan kişisel bilgilerin açığa çıkma riski artabilir. Daha odaklı olan SLM'ler, daha küçük ve daha kontrollü veri kümeleri kullanabilir; bu da gizlilik risklerini potansiyel olarak azaltır. Fikri mülkiyet konuları da kritiktir; internetten derlenen çeşitli verilerle eğitilen LLM'ler, telif hakkıyla korunan içerikleri yeniden üretebilir. Daha belirli verilerle eğitilen SLM'ler, bu tür risklerle daha az karşılaşabilir; ancak eğitim verilerine bağlı olarak yine de sorunlar yaşanabilir. Ayrıca, model kararlarının yorumlanabilirliği ve açıklanabilirliği genellikle SLM'lerde daha kolaydır; bu da düzenlemeye tabi sektörlerdeki uygulamalar için çok önemli olabilir.

Özellikle daha az yaygın dillerde, çok dilli yetenekler açısından SLM'ler ve LLM'ler nasıl karşılaştırılır?

SLM'ler ve LLM'ler, özellikle daha az yaygın dillerde çok dilliliği farklı şekilde ele alır. Çok büyük eğitim verileriyle LLM'ler, nadir olanlar da dâhil pek çok dilde iyi çalışmaya eğilimlidir; ancak bunun bedeli büyük ve karmaşık olmalarıdır. Daha küçük olmalarına rağmen SLM'ler, belirli diller veya dil grupları için özelleştirilebilir ve kimi zaman bu alanlarda LLM'leri bile geride bırakabilir. Daha az yaygın diller için, özel olarak eğitilmiş SLM'ler, LLM'lerin daha geniş ama muhtemelen daha az hassas verilerine kıyasla, yüksek kaliteli ve dile özgü verilerle odaklı olduklarından daha doğru ve kültürel bağlama duyarlı çeviriler veya metinler üretebilir.

Üretim ortamında SLM'ler ile LLM'lerle çalışırken sürüm kontrolü ve model yönetişimi için en iyi uygulamalar nelerdir?

Üretim ortamlarında SLM ve LLM'lerin sürüm yönetimi ve yönetişimi için en iyi uygulamalar benzerlikler taşır; ancak önemli farklılıklar da vardır. Her ikisi için de modeller, eğitim verileri ve ayarlar için sağlam bir sürümleme sistemi tutmak önemlidir. Ancak LLM'ler, boyutları ve ince ayara duyarlılıkları nedeniyle sürüm kontrolü için daha karmaşık altyapı gerektirir. Daha küçük olan SLM'ler ise farklı sürümleri yönetip dağıtmayı kolaylaştırır. Yönetişim açısından, LLM'ler geniş yetenekleri ve beklenmedik davranış potansiyelleri nedeniyle genellikle daha sıkı gözetim gerektirir. Daha belirli kullanım alanlarına sahip SLM'ler ise daha az genel gözetim, ancak daha hedefli yönetişim gerektirebilir. Her ikisi için de düzenli denetimler, performans takibi ve sınırlamalar ile amaçlanan kullanımın açık belgelenmesi, sorumlu yapay zekâ kullanımı açısından çok önemlidir.

Ana Rojo Echeburúa, Uygulamalı Matematik alanında doktora derecesine sahip bir yapay zeka ve veri uzmanıdır. Verileri eyleme dönüştürülebilir içgörülere çevirmeyi sever ve teknik ekipleri yönetme konusunda geniş deneyime sahiptir. Ana, müşterilerle yakın çalışarak onların iş sorunlarını çözmekten ve yenilikçi yapay zeka çözümleri geliştirmekten keyif alır. Sorun çözme becerileri ve açık iletişimiyle tanınan Ana, özellikle üretken yapay zeka olmak üzere yapay zekaya tutkuyla bağlıdır. Sürekli öğrenmeye ve etik yapay zeka geliştirmeye, ayrıca karmaşık sorunları basitleştirmeye ve teknolojiyi anlaşılır biçimde açıklamaya kendini adamıştır.