Leerpad

Small language models (SLM’s) lossen het probleem op om AI toegankelijker en efficiënter te maken voor wie beperkte middelen heeft, doordat ze kleiner, sneller en eenvoudiger te personaliseren zijn dan large language models (LLM’s).

SLM’s hebben minder parameters (meestal onder de 10 miljard), wat de rekenkosten en het energieverbruik drastisch verlaagt. Ze richten zich op specifieke taken en worden getraind op kleinere datasets. Zo blijft de balans tussen prestaties en efficiënt gebruik van resources behouden.

Wat zijn small language models?

Small language models zijn compacte, zeer efficiënte versies van de enorme large language models waar we zoveel over horen. LLM’s zoals GPT-4o hebben honderden miljarden parameters, maar SLM’s gebruiken er veel minder—meestal van miljoenen tot enkele miljarden.

De belangrijkste eigenschappen van SLM’s zijn:

- Efficiëntie: SLM’s hebben niet de enorme rekenkracht nodig die LLM’s vragen. Daardoor zijn ze ideaal voor apparaten met beperkte resources, zoals smartphones, tablets of IoT-apparaten—lees hier meer over in deze blog over edge AI.

- Toegankelijkheid: Mensen met een beperkt budget kunnen SLM’s implementeren zonder high-end infrastructuur. Ze zijn ook geschikt voor on-premise implementaties waar privacy en gegevensbeveiliging heel belangrijk zijn, omdat ze niet altijd afhankelijk zijn van cloudinfrastructuur.

- Personalisatie: SLM’s zijn gemakkelijk te fine-tunen. Door hun kleinere omvang kunnen ze zich snel aanpassen aan niche-taken en gespecialiseerde domeinen. Daardoor zijn ze goed inzetbaar voor specifieke toepassingen zoals klantenservice, gezondheidszorg of onderwijs (daar komen we later uitgebreider op terug!).

- Snellere inferentie: SLM’s reageren sneller omdat ze minder parameters hoeven te verwerken. Daardoor zijn ze perfect voor realtime toepassingen zoals chatbots, virtuele assistenten of elk systeem waarin snelle beslissingen cruciaal zijn. Je hoeft niet te wachten op reacties, wat ideaal is in omgevingen waar lage latentie een must is.

Voorbeelden van small language models

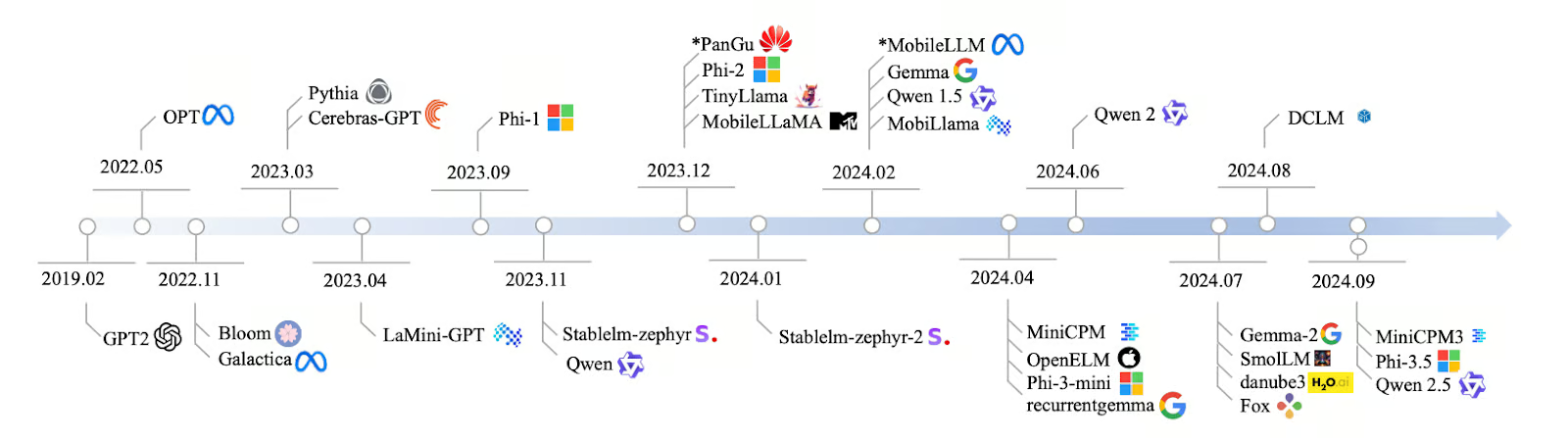

De ontwikkeling van SLM’s van 2019 tot 2024 ging snel, met veel nieuwe modellen om te voldoen aan de behoefte aan efficiëntere AI. Het begon met GPT-2 in 2019 en door de jaren heen werden modellen gerichter en sneller. In 2022 konden modellen zoals Bloom en Galactica meerdere talen en wetenschappelijke data aan, en in 2023 werden modellen zoals Pythia en Cerebras-GPT ontworpen voor taken als coderen en logisch redeneren.

In 2024 verschenen nog meer SLM’s, zoals LaMini-GPT, MobileLLaMA en TinyLlama, die zijn gemaakt om goed te werken op mobiele apparaten en andere systemen met weinig stroomverbruik. Bedrijven zoals Meta, Google en Microsoft leiden de ontwikkeling van deze modellen, waarvan sommige openbaar zijn en andere privé blijven.

Bron: Lu et al., 2024

Praktijkmensen gebruiken SLM’s in veel sectoren omdat ze licht, snel en zuinig in gebruik zijn. Hier zijn enkele van deze modellen met hun parameters en kernfeatures:

|

Modelnaam |

Parameters |

Open source |

Belangrijkste kenmerken |

|

Qwen2 |

0.5B, 1B, 7B |

Ja |

Schaalbaar, geschikt voor diverse taken |

|

Mistral Nemo 12B |

12B |

Ja |

Complexe NLP-taken, lokale implementatie |

|

Llama 3.1 8B |

8B |

Ja* |

Balans tussen kracht en efficiëntie |

|

Pythia |

160M - 2.8B |

Ja |

Gefocust op redeneren en coderen |

|

Cerebras-GPT |

111M - 2.7B |

Ja |

Rekenefficiënt, volgt Chinchilla-schaalwetten |

|

Phi-3.5 |

3.8B |

Ja** |

Lange contextlengte (128K tokens), meertalig |

|

StableLM-zephyr |

3B |

Ja |

Snelle inferentie, efficiënt voor edge-systemen |

|

TinyLlama |

1.1B |

Ja |

Efficiënt voor mobiele en edge-apparaten |

|

MobileLLaMA |

1.4B |

Ja |

Geoptimaliseerd voor mobiele en low-power apparaten |

|

LaMini-GPT |

774M - 1.5B |

Ja |

Meertalig, instruction-following taken |

|

Gemma2 |

9B, 27B |

Ja |

Lokale implementatie, realtime toepassingen |

|

MiniCPM |

1B - 4B |

Ja |

Gebalanceerde prestaties, geoptimaliseerd voor Engels en Chinees |

|

OpenELM |

270M - 3B |

Ja |

Multitasking, lage latentie, energiezuinig |

|

DCLM |

1B |

Ja |

Alledaags redeneren, logische deductie |

|

Fox |

1.6B |

Ja |

Snelheidsgeoptimaliseerd voor mobiele toepassingen |

*Met gebruiksbeperkingen

**Alleen voor onderzoeksdoeleinden

Lees meer over deze modellen in dit aparte artikel dat ik schreef over top small language models.

Hoe SLM’s werken

Laten we ingaan op hoe small language models werken.

Volgend woord voorspellen

Net als LLM’s werken SLM’s door het volgende woord te voorspellen in een tekstreeks. SLM’s gebruiken patronen uit de tekst waarop ze zijn getraind om te raden wat erop volgt. Het is een eenvoudig maar krachtig concept dat aan de basis ligt van alle taalmodellen.

Bijvoorbeeld, gegeven de input: "In de Harry Potter-serie heet de beste vriend van het hoofdpersonage Ron..." Een SLM zou deze context analyseren en het meest waarschijnlijke volgende woord voorspellen—in dit geval "Weasley".

Transformer-architectuur

De transformer-architectuur is cruciaal voor hoe LLM’s en SLM’s taal begrijpen en genereren. Transformers kun je zien als het brein achter taalmodellen. Ze gebruiken self-attention om te bepalen welke woorden in een zin het meest relevant voor elkaar zijn. Dit helpt het model de context te begrijpen—bijvoorbeeld herkennen dat "Paris" verwijst naar de stad of naar die collega die je van het werk kent.

Balans tussen omvang en prestaties

De kracht van SLM’s zit in hun vermogen om omvang en prestaties in balans te houden. Ze gebruiken aanzienlijk minder parameters dan LLM’s, meestal van miljoenen tot enkele miljarden, vergeleken met honderden miljarden in LLM’s.

Met minder parameters hebben SLM’s minder rekenkracht en data nodig om te trainen, waardoor ze toegankelijker zijn als je beperkte middelen hebt. De compacte omvang zorgt ervoor dat SLM’s input sneller verwerken en output genereren, wat superbelangrijk is voor realtime toepassingen zoals mobiele toetsenborden of spraakassistenten.

SLM’s zijn misschien niet zo veelzijdig of diepgaand begrijpend als grote modellen, maar ze kunnen specifieke taken uitstekend aan. Een SLM die bijvoorbeeld is getraind om juridische teksten te analyseren, kan het in dat domein beter doen dan een algemeen LLM.

Hoe SLM’s worden gemaakt: technieken en aanpakken

SLM’s gebruiken technieken zoals distillatie, pruning en kwantisatie om kleiner, sneller en efficiënter te worden.

Distillatie

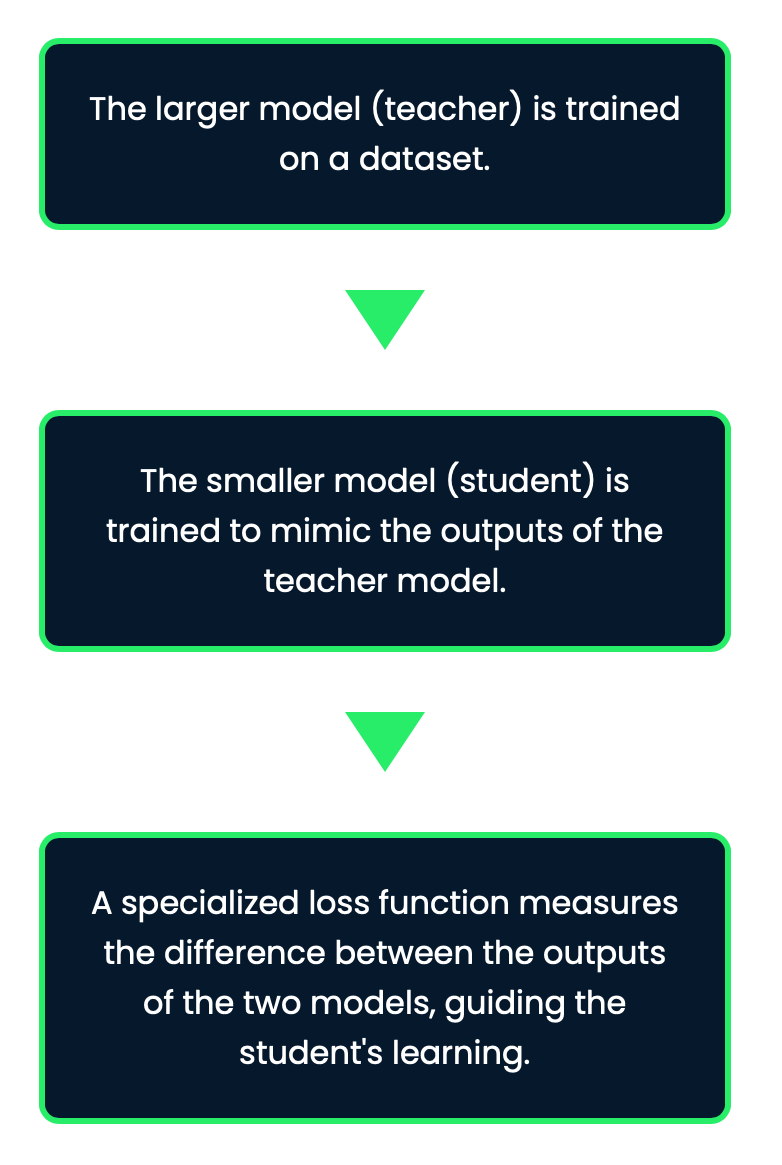

Dit is een techniek om SLM’s te creëren door kennis over te dragen van een grotere "teacher"-model naar een kleiner "student"-model. Het doel is om wat het teachermodel heeft geleerd te comprimeren in het studentmodel zonder al te veel prestatieverlies.

Hierdoor behouden SLM’s veel van de nauwkeurigheid van grotere modellen, terwijl ze veel beter hanteerbaar zijn qua omvang en rekenbehoefte. Met deze techniek leert het kleinere model niet alleen de uiteindelijke voorspellingen van de teacher, maar ook de onderliggende patronen en nuances.

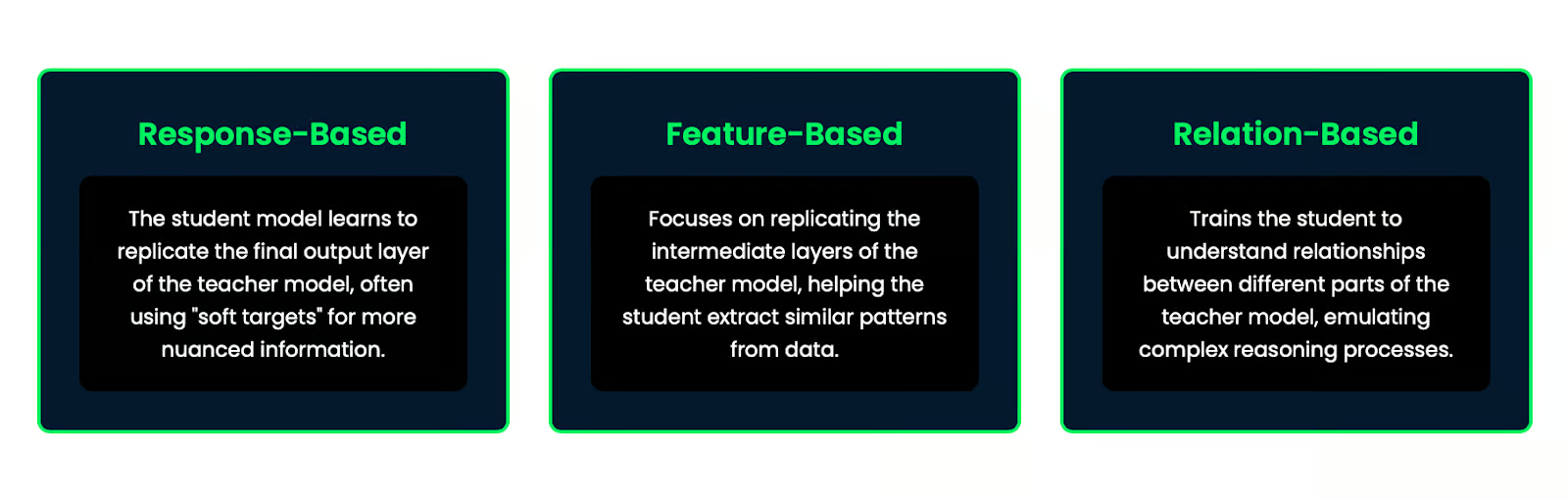

Er zijn verschillende methoden van knowledge distillation:

- Response-based: het studentmodel leert de uiteindelijke outputlaag van het teachermodel te reproduceren, vaak met "soft targets" voor meer nuance.

- Feature-based: richt zich op het reproduceren van tussenlagen van het teachermodel, waardoor de student vergelijkbare patronen uit data leert halen.

- Relation-based: traint de student om relaties tussen verschillende onderdelen van het teachermodel te begrijpen en zo complex redeneren te imiteren.

Pruning

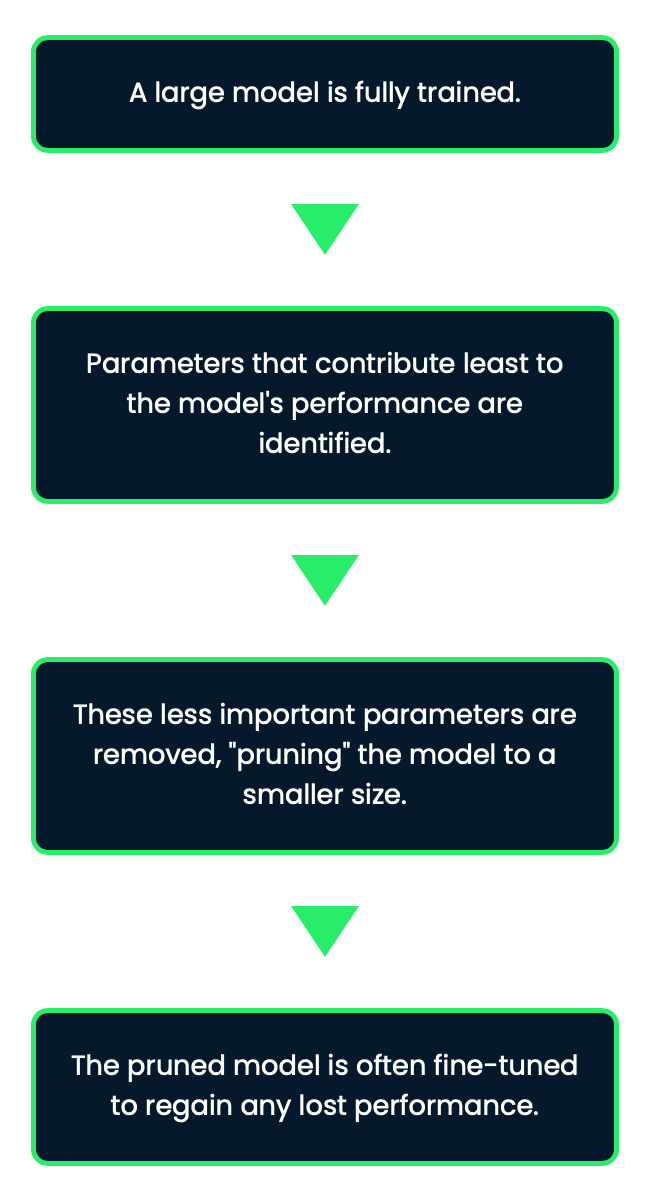

Pruning is een beetje als het wegsnoeien van wat niet nodig is. Tijdens pruning worden onderdelen van het model die minder belangrijk zijn—zoals neuronen of parameters die weinig bijdragen aan de algehele prestatie—verwijderd. Deze techniek helpt het model te verkleinen zonder de nauwkeurigheid noemenswaardig te beïnvloeden. Pruning kan echter lastig zijn: als je te agressief snoeit, loop je het risico te veel weg te halen en de prestaties te schaden.

Pruning kan de modelgrootte aanzienlijk verminderen terwijl veel van de oorspronkelijke prestaties behouden blijven, wat het een effectieve techniek maakt voor het creëren van SLM’s.

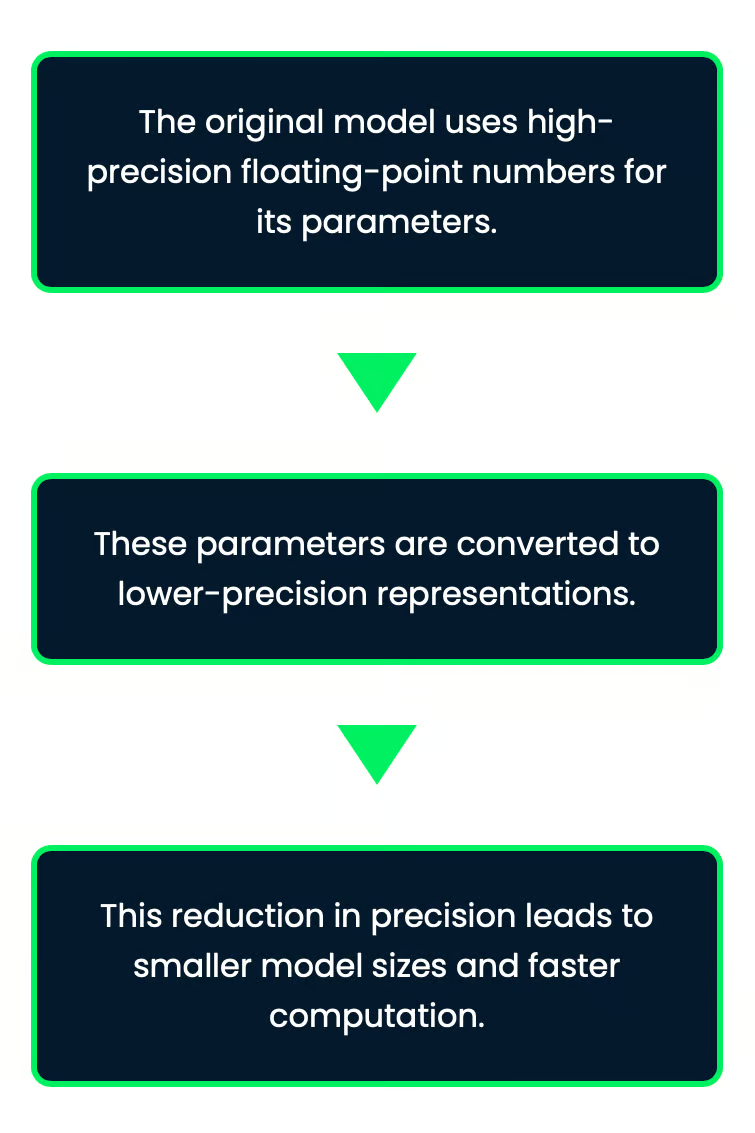

Kwantisatie

Kwantisatie houdt in dat je minder bits gebruikt om de getallen van het model op te slaan. Normaal gebruikt een model 32-bit getallen, maar met deze methode worden die teruggebracht naar 8-bit waarden, die veel kleiner zijn. Zo neemt het model minder ruimte in en kan het sneller draaien. Het mooiste is dat, hoewel de getallen minder precies zijn, het model nog steeds goed werkt met slechts een kleine impact op de nauwkeurigheid.

Stel dat je temperatuurwaarden opslaat in een weerapp. Je zou ze met hoge precisie opslaan (zoals 32-bit getallen), wat meer is dan nodig. Door de precisie terug te brengen naar 8-bit verlies je misschien details, maar de app blijft nuttig terwijl hij sneller draait en minder geheugen gebruikt.

Dit is vooral nuttig om AI te draaien op apparaten met beperkte geheugen- en rekenkracht, zoals smartphones of edge-apparaten.

Kwantisatie is bijzonder effectief voor het inzetten van modellen op apparaten met beperkte resources, omdat het het geheugenverbruik verlaagt en de inferentiesnelheid verbetert.

Toepassingen van small language models

Het mooie van SLM’s is dat ze krachtige AI leveren zonder enorme infrastructuur of constante internetverbinding, waardoor heel veel toepassingen mogelijk worden.

On-device AI

Denk aan mobiele assistenten—die spraakassistenten op je telefoon die je door je dag helpen. SLM’s maken dit mogelijk. Ze zorgen voor realtime tekstvoorspelling, spraakopdrachten en zelfs vertaling zonder data naar de cloud te sturen. Alles gebeurt lokaal, wat snellere reacties en meer privacyvriendelijke interacties betekent.

Zo gebruiken SwiftKey en Gboard SLM’s om contextueel nauwkeurige tekstsuggesties te geven, wat de typesnelheid en -nauwkeurigheid verbetert.

Dit strekt zich ook uit tot offline toepassingen waarbij AI blijft functioneren zonder internetverbinding, wat handig is in gebieden met beperkte connectiviteit.

Google Translate biedt bijvoorbeeld offline vertaalmogelijkheden, aangedreven door SLM’s, wat communicatie in gebieden met beperkte internettoegang vergemakkelijkt.

Gepersonaliseerde AI

Een van de mooie dingen aan SLM’s is dat ze aangepast kunnen worden aan specifieke taken of gebruikersvoorkeuren. Stel je een chatbot voor die specifiek is gefine-tuned voor klantenservice binnen jouw bedrijf, of een AI die precies weet hoe je te helpen op basis van eerdere interacties. Omdat deze modellen kleiner zijn, zijn ze veel makkelijker te fine-tunen en uit te rollen in verschillende sectoren.

Een paar voorbeelden:

- Zorg: SLM’s kunnen worden aangepast voor medische tekstanalyse om realtime gezondheidsmonitoring en advies te bieden op slimme wearables. Ze werken onafhankelijk van continue cloudverbinding.

- Slimme huisapparaten: SLM’s die in slimme huissystemen zijn ingebed, kunnen individuele voorkeuren voor temperatuur en verlichting leren en instellingen automatisch aanpassen voor verschillende tijden of gelegenheden.

- Onderwijs: Onderwijsapps die SLM’s gebruiken kunnen zich aanpassen aan individuele leerstijlen en -tempo’s, en zo gepersonaliseerde begeleiding en ondersteuning bieden aan studenten.

Internet of Things

SLM’s draaien geruisloos op de achtergrond op alledaagse apparaten zoals je slimme huissysteem of andere gadgets. Ze helpen deze apparaten je direct te begrijpen en te reageren zonder internetverbinding, waardoor ze sneller en slimmer worden.

Andere toepassingen

SLM’s vinden toepassingen in tal van andere domeinen:

- Realtime taalvertaling: SLM’s maken directe vertaling mogelijk, wat belangrijk is voor wereldwijde communicatie. Sommige reisapps gebruiken SLM’s om borden, menu’s of gesproken aanwijzingen in realtime te vertalen. Dit helpt gebruikers zich door vreemde talen te navigeren.

- Automotivesystemen: In auto’s verzorgen SLM’s slimme navigatie, met realtime verkeersupdates en de beste routevoorstellen. Ze verbeteren ook spraakbesturing, zodat bestuurders muziek kunnen bedienen, bellen of berichten sturen zonder handen te gebruiken.

- Entertainment systemen: Smart-tv’s en gameconsoles gebruiken SLM’s voor spraakbediening en om shows of games aan te bevelen op basis van wat je eerder hebt gekeken of gespeeld.

- Klantenservice: SLM’s helpen bedrijven klantvragen efficiënter af te handelen. Winkels gebruiken SLM om vragen te beantwoorden over producten, bestelstatus of retourbeleid. Dit vermindert de noodzaak van menselijke support.

LLM’s vs. SLM’s

Laten we nu kijken wanneer je groot inzet met LLM’s en wanneer SLM’s de betere keuze zijn.

Taakcomplexiteit

Voor zeer complexe taken zoals diep begrip, lange contentcreatie of het oplossen van lastige problemen presteren grote modellen zoals GPT-4o meestal beter dan SLM’s. Ze kunnen dit aan doordat ze putten uit enorme hoeveelheden data om meer gedetailleerde antwoorden te geven. Keerzijde is dat dit veel rekenkracht en tijd kost.

|

LLM’s |

SLM’s |

|

Uitstekend in complexe, geavanceerde en algemene taken |

Het best geschikt voor meer afgebakende, eenvoudigere taken |

|

Betere nauwkeurigheid en prestaties over verschillende taken |

Sterk in gespecialiseerde toepassingen en domeinspecifieke taken |

|

Kan context over lange passages behouden en samenhangende reacties geven |

Kan moeite hebben met complexe taaltaken en langetermijncontext |

Als je bijvoorbeeld een algemene chatbot ontwikkelt die verschillende onderwerpen en complexe vragen moet aankunnen, is een LLM geschikter. Voor een gespecialiseerde klantenservicebot voor één productlijn kan een SLM echter ruimschoots voldoende zijn en zelfs beter presteren dan een LLM dankzij de gerichte training.

Beperkingen in resources

Wanneer je resources beperkt zijn, scoren SLM’s. Ze hebben veel minder rekenkracht nodig om te trainen en te deployen. Ze zijn een prima optie als je in een omgeving met beperkte middelen werkt.

|

LLM’s |

SLM’s |

|

Vereisen aanzienlijke rekenkracht en geheugen |

Zuinigere resourceconsumptie |

|

Hebben vaak gespecialiseerde hardware zoals GPU’s nodig voor inferentie |

Kunnen draaien op standaardhardware en zelfs op apparaten zoals Raspberry Pi of smartphone |

|

Hogere operationele kosten door resourcevraag |

Kortere trainingstijden, waardoor ze toegankelijker zijn voor snelle uitrol |

In situaties met beperkte rekenkracht, zoals op mobiele apparaten of bij edge computing, zijn SLM’s vaak de betere keuze doordat ze prestaties en efficiëntie goed combineren.

Implementatieomgeving

Als je AI inzet op een cloudserver waar resources geen probleem zijn, kan een LLM de juiste keuze zijn, zeker als je hoge nauwkeurigheid en vloeiende antwoorden nodig hebt. Werk je echter op apparaten met beperkte CPU- of GPU-kracht, zoals IoT-apparaten of mobiele apps, dan zijn SLM’s een perfecte match.

|

LLM’s |

SLM’s |

|

Het best voor cloudomgevingen met ruime rekenkracht |

Ze kunnen in de cloud worden gebruikt, maar hun kleinere omvang maakt ze geschikter voor plekken met beperkte resources. Ze zijn efficiënter voor kleinere taken |

|

Niet ideaal voor on-device AI omdat veel rekenkracht en internetverbinding nodig zijn |

Perfect voor on-device AI, met offline gebruik en snellere reacties. Ze kunnen mobiele assistenten, spraakherkenning en andere realtime apps draaien zonder internetverbinding |

|

Geen goede match voor edge computing door hoge rekenbehoefte en trage respons |

Geweldig voor edge computing, waar snelle reacties en efficiënt resourcegebruik belangrijk zijn. Ze maken AI mogelijk in IoT-apparaten, slimme huizen en andere edge-toepassingen |

Bij het kiezen van de implementatieomgeving is het belangrijk om factoren als internetconnectiviteit, latentie-eisen en privacy mee te nemen. Voor toepassingen die offline moeten werken of minimale latentie vereisen, zijn SLM’s on-device of aan de edge vaak de betere keuze.

De keuze tussen LLM’s en SLM’s hangt af van de complexiteit van de taak, de beschikbare resources en de beoogde inzetplek. LLM’s zijn geweldig voor complexe taken die hoge nauwkeurigheid vragen, terwijl SLM’s efficiënt zijn en op meer plekken kunnen draaien.

Conclusie

SLM’s maken AI een stuk toegankelijker. In tegenstelling tot large language models die enorme rekenkracht nodig hebben, draaien SLM’s op minder resources. Dat betekent dat kleinere bedrijven, individuele ontwikkelaars en zelfs startups ze kunnen gebruiken zonder gigantische servers of enorme budgetten.

Wil je meer leren over small language models, dan raad ik deze twee bronnen aan:

FAQ’s

Wat zijn de specifieke verschillen in energieverbruik tussen het draaien van een SLM en een LLM voor een typische enterprise-toepassing?

Het verschil in energieverbruik tussen SLM’s en LLM’s kan aanzienlijk zijn. Voor een typische enterprise-toepassing kan een SLM slechts 10–20% verbruiken van de energie die een LLM nodig heeft. Het draaien van een SLM voor een klantenservicechatbot kan bijvoorbeeld rond de 50–100 kWh per maand gebruiken, terwijl een LLM voor dezelfde taak 500–1000 kWh kan verbruiken. Exacte cijfers variëren echter op basis van modelgrootte, gebruikspatronen en hardware-efficiëntie. Bedrijven zoals Google en OpenAI hebben gemeld dat het draaien van hun grootste modellen energie kan verbruiken die gelijkstaat aan die van enkele honderden huishoudens, terwijl SLM’s vaak op standaardservers of zelfs edge-apparaten kunnen draaien met aanzienlijk lagere stroomvereisten.

Hoe vergelijken de doorlooptijden voor het creëren van aangepaste SLM’s met het fine-tunen van bestaande LLM’s voor gespecialiseerde taken?

Doorlooptijden voor het ontwikkelen van aangepaste SLM’s versus het fine-tunen van LLM’s kunnen sterk verschillen. Een aangepaste SLM vanaf nul bouwen duurt doorgaans langer, vaak 3–6 maanden voor een team van ervaren data scientists, omdat dit dataverzameling, modelarchitectuur, training en uitgebreid testen omvat. Het fine-tunen van een bestaand LLM voor een gespecialiseerde taak kan veel sneller, soms in slechts enkele weken. De trade-off is echter dat gefine-tunede LLM’s mogelijk niet hetzelfde niveau van efficiëntie of specialisatie bereiken als een op maat gebouwde SLM. De keuze hangt vaak af van de usecase, beschikbare middelen en gewenste prestatiekenmerken.

Wat zijn de juridische en ethische overwegingen bij het inzetten van SLM’s versus LLM’s, met name rond dataprivacy en intellectueel eigendom?

Dataprivacy is een belangrijk aandachtspunt: LLM’s hebben vaak enorme hoeveelheden trainingsdata, wat het risico op blootstelling van persoonsgegevens kan vergroten. SLM’s, die meer gefocust zijn, gebruiken mogelijk kleinere, beter beheersbare datasets en kunnen zo privacyrisico’s verkleinen. Intellectuele-eigendomsrechten zijn ook cruciaal: LLM’s die op diverse internetdata zijn getraind, kunnen auteursrechtelijk beschermd materiaal reproduceren. SLM’s, getraind op specifiekere data, lopen mogelijk minder van dit soort risico’s, maar kunnen er nog steeds mee te maken krijgen, afhankelijk van hun trainingsdata. Daarnaast zijn de interpreteerbaarheid en uitlegbaarheid van modelbeslissingen vaak eenvoudiger bij SLM’s, wat erg belangrijk kan zijn voor toepassingen in gereguleerde sectoren.

Hoe vergelijken SLM’s en LLM’s qua meertalige capaciteiten, vooral voor minder gangbare talen?

SLM’s en LLM’s gaan verschillend om met meerdere talen, vooral bij minder gangbare. LLM’s presteren dankzij hun enorme trainingsdata vaak goed in veel talen, inclusief zeldzame, maar dat maakt ze groot en complex. SLM’s zijn kleiner, maar kunnen worden aangepast aan specifieke talen of taalgroepen en presteren die daar soms beter dan LLM’s. Voor minder gangbare talen kunnen speciaal getrainde SLM’s accuratere en cultureel beter passende vertalingen of teksten geven, omdat ze zijn gericht op hoogwaardige, taalspecifieke data, in tegenstelling tot de bredere maar mogelijk minder precieze data van LLM’s.

Wat zijn de best practices voor versiebeheer en modelgovernance bij het werken met SLM’s versus LLM’s in een productieomgeving?

Best practices voor versiebeheer en governance van SLM’s en LLM’s in productieomgevingen vertonen overeenkomsten maar ook belangrijke verschillen. Voor beide is het cruciaal om een goed versiesysteem te hanteren voor modellen, trainingsdata en instellingen. LLM’s hebben door hun omvang en gevoeligheid voor fine-tuning echter complexere infrastructuur nodig voor versiebeheer. SLM’s, die kleiner zijn, maken het eenvoudiger om verschillende versies te beheren en te deployen. Qua governance hebben LLM’s doorgaans strikter toezicht nodig vanwege hun brede capaciteiten en het potentieel voor onverwacht gedrag. SLM’s, met hun specifieker gebruik, vragen mogelijk minder toezicht maar wel meer gerichte governance. Voor beide zijn regelmatige controles, prestatiemonitoring en duidelijke documentatie van beperkingen en beoogde inzet cruciaal voor verantwoord AI-gebruik.

Ana Rojo Echeburúa is een AI- en dataspecialist met een PhD in Toegepaste Wiskunde. Ze houdt ervan om data om te zetten in bruikbare inzichten en heeft ruime ervaring in het aansturen van technische teams. Ana werkt graag nauw samen met klanten om hun bedrijfsproblemen op te lossen en innovatieve AI-oplossingen te creëren. Ze staat bekend om haar probleemoplossend vermogen en heldere communicatie, en is gepassioneerd door AI, vooral generatieve AI. Ana zet zich in voor continue ontwikkeling en ethische AI, en voor het vereenvoudigen van complexe vraagstukken en het op een toegankelijke manier uitleggen van technologie.