Tracks

Các mô hình ngôn ngữ nhỏ (SLM) giải quyết bài toán đưa AI đến gần hơn và hiệu quả hơn với những người có nguồn lực hạn chế nhờ nhỏ gọn hơn, nhanh hơn và dễ tùy chỉnh hơn so với mô hình ngôn ngữ lớn (LLM).

SLM có ít tham số hơn (thường dưới 10 tỷ), giúp giảm mạnh chi phí tính toán và năng lượng. Chúng tập trung vào các nhiệm vụ cụ thể và được huấn luyện trên tập dữ liệu nhỏ hơn, nhờ đó cân bằng giữa hiệu năng và hiệu quả tài nguyên.

Mô hình ngôn ngữ nhỏ là gì?

Mô hình ngôn ngữ nhỏ là các phiên bản gọn nhẹ, hiệu quả cao của những mô hình ngôn ngữ khổng lồ mà chúng ta thường nghe đến. Các LLM như GPT-4o có hàng trăm tỷ tham số, nhưng SLM sử dụng ít hơn nhiều—thường chỉ từ vài triệu đến vài tỷ.

Những đặc điểm chính của SLM gồm:

- Hiệu quả: SLM không cần sức mạnh tính toán khổng lồ như LLM. Nhờ đó rất phù hợp cho các thiết bị hạn chế tài nguyên như điện thoại thông minh, máy tính bảng hoặc thiết bị IoT—tìm hiểu thêm trong bài viết về edge AI.

- Khả năng tiếp cận: Những người có ngân sách hạn chế có thể triển khai SLM mà không cần hạ tầng cao cấp. Chúng cũng phù hợp với triển khai on-premise, nơi quyền riêng tư và bảo mật dữ liệu rất quan trọng, vì không nhất thiết phụ thuộc vào hạ tầng đám mây.

- Tùy chỉnh: SLM dễ fine-tune. Nhờ kích thước nhỏ, chúng nhanh chóng thích ứng với các tác vụ ngách và lĩnh vực chuyên biệt. Điều này khiến chúng phù hợp cho những ứng dụng cụ thể như chăm sóc khách hàng, y tế, hoặc giáo dục (chúng ta sẽ bàn chi tiết ở phần sau!).

- Suy luận nhanh hơn: SLM phản hồi nhanh hơn vì có ít tham số cần xử lý. Rất lý tưởng cho ứng dụng thời gian thực như chatbot, trợ lý ảo, hay bất kỳ hệ thống nào đòi hỏi quyết định nhanh. Bạn không phải chờ đợi, điều này tuyệt vời cho môi trường yêu cầu độ trễ thấp.

Ví dụ về mô hình ngôn ngữ nhỏ

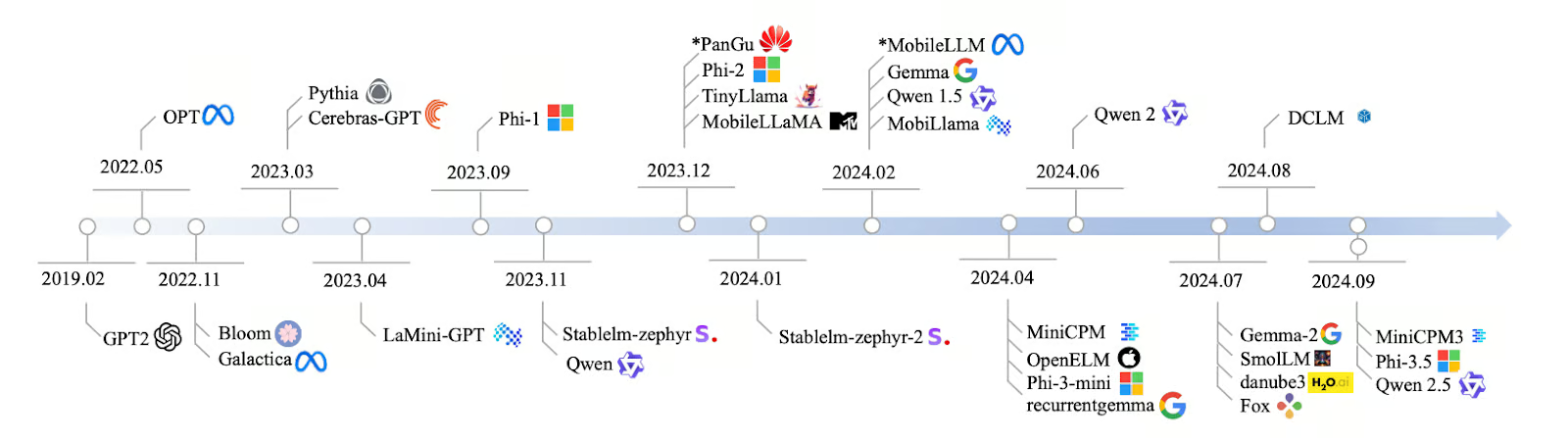

Sự phát triển của SLM từ 2019 đến 2024 diễn ra nhanh chóng, với nhiều mô hình mới ra đời nhằm đáp ứng nhu cầu AI hiệu quả hơn. Bắt đầu với GPT-2 năm 2019, qua các năm, mô hình ngày càng tập trung và nhanh hơn. Đến 2022, các mô hình như Bloom và Galactica đã xử lý được đa ngôn ngữ và dữ liệu khoa học, và năm 2023, các mô hình như Pythia và Cerebras-GPT được thiết kế cho các nhiệm vụ như lập trình và tư duy logic.

Năm 2024, còn nhiều SLM khác được phát hành như LaMini-GPT, MobileLLaMA và TinyLlama, tối ưu để hoạt động tốt trên thiết bị di động và hệ thống công suất thấp. Các công ty như Meta, Google và Microsoft dẫn dắt phát triển, với một số mô hình mở cho công chúng và số khác là riêng tư.

Nguồn: Lu et al., 2024

Người làm thực tiễn sử dụng SLM trong nhiều ngành vì chúng nhẹ, nhanh và không đòi hỏi nhiều tài nguyên. Dưới đây là một số mô hình với số tham số và tính năng chính:

|

Tên mô hình |

Tham số |

Mã nguồn mở |

Tính năng chính |

|

Qwen2 |

0.5B, 1B, 7B |

Có |

Có thể mở rộng, phù hợp nhiều tác vụ |

|

Mistral Nemo 12B |

12B |

Có |

Nhiệm vụ NLP phức tạp, triển khai cục bộ |

|

Llama 3.1 8B |

8B |

Có* |

Cân bằng sức mạnh và hiệu quả |

|

Pythia |

160M - 2.8B |

Có |

Tập trung vào suy luận và lập trình |

|

Cerebras-GPT |

111M - 2.7B |

Có |

Hiệu quả tính toán, tuân theo quy luật scale của Chinchilla |

|

Phi-3.5 |

3.8B |

Có** |

Ngữ cảnh dài (128K token), đa ngôn ngữ |

|

StableLM-zephyr |

3B |

Có |

Suy luận nhanh, hiệu quả cho hệ thống edge |

|

TinyLlama |

1.1B |

Có |

Hiệu quả cho thiết bị di động và edge |

|

MobileLLaMA |

1.4B |

Có |

Tối ưu cho thiết bị di động và công suất thấp |

|

LaMini-GPT |

774M - 1.5B |

Có |

Đa ngôn ngữ, tác vụ theo chỉ dẫn |

|

Gemma2 |

9B, 27B |

Có |

Triển khai cục bộ, ứng dụng thời gian thực |

|

MiniCPM |

1B - 4B |

Có |

Hiệu năng cân bằng, tối ưu tiếng Anh và tiếng Trung |

|

OpenELM |

270M - 3B |

Có |

Đa nhiệm, độ trễ thấp, tiết kiệm năng lượng |

|

DCLM |

1B |

Có |

Suy luận thường thức, suy diễn logic |

|

Fox |

1.6B |

Có |

Tối ưu tốc độ cho ứng dụng di động |

*Có hạn chế về sử dụng

**Chỉ dành cho mục đích nghiên cứu

Tìm hiểu thêm về các mô hình này trong bài viết riêng tôi đã viết về các mô hình ngôn ngữ nhỏ hàng đầu.

Cách SLM hoạt động

Hãy cùng tìm hiểu cách mô hình ngôn ngữ nhỏ vận hành.

Dự đoán từ kế tiếp

Tương tự LLM, SLM hoạt động bằng cách dự đoán từ tiếp theo trong chuỗi văn bản. SLM dùng các mẫu từ văn bản đã được huấn luyện để đoán phần tiếp theo. Đây là ý tưởng đơn giản nhưng mạnh mẽ cốt lõi của mọi mô hình ngôn ngữ.

Ví dụ, với đầu vào: "Trong loạt truyện Harry Potter, người bạn thân nhất của nhân vật chính tên là Ron..." Một SLM sẽ phân tích ngữ cảnh này và dự đoán từ khả dĩ nhất — trong trường hợp này là "Weasley."

Kiến trúc transformer

Kiến trúc transformer là chìa khóa giúp LLM và SLM hiểu và sinh ngôn ngữ. Có thể coi transformer là “bộ não” phía sau các mô hình ngôn ngữ. Chúng sử dụng cơ chế tự chú ý (self-attention) để xác định những từ nào trong câu liên quan nhất với nhau. Điều này giúp mô hình hiểu ngữ cảnh—chẳng hạn, nhận ra “Paris” chỉ thành phố hay một người bạn cùng chỗ làm.

Cân bằng kích thước và hiệu năng

Sức mạnh của SLM nằm ở khả năng cân bằng giữa kích thước và hiệu năng. Chúng sử dụng ít tham số hơn đáng kể so với LLM, thường từ vài triệu đến vài tỷ, so với hàng trăm tỷ ở LLM.

Với ít tham số hơn, SLM cần ít sức mạnh tính toán và dữ liệu để huấn luyện, nên dễ tiếp cận hơn nếu bạn có nguồn lực hạn chế. Kích thước gọn giúp SLM xử lý đầu vào và tạo đầu ra nhanh hơn, rất quan trọng cho các ứng dụng thời gian thực như bàn phím di động hoặc trợ lý giọng nói.

SLM có thể không đa năng hay hiểu sâu như các mô hình lớn, nhưng chúng xử lý tốt các nhiệm vụ cụ thể. Ví dụ, một SLM được huấn luyện để phân tích văn bản pháp lý có thể làm tốt hơn LLM tổng quát ở lĩnh vực đó.

Cách tạo SLM: Kỹ thuật và phương pháp

SLM sử dụng các kỹ thuật như chưng cất (distillation), cắt tỉa (pruning) và lượng tử hóa (quantization) để trở nên nhỏ gọn, nhanh và hiệu quả hơn.

Chưng cất (Distillation)

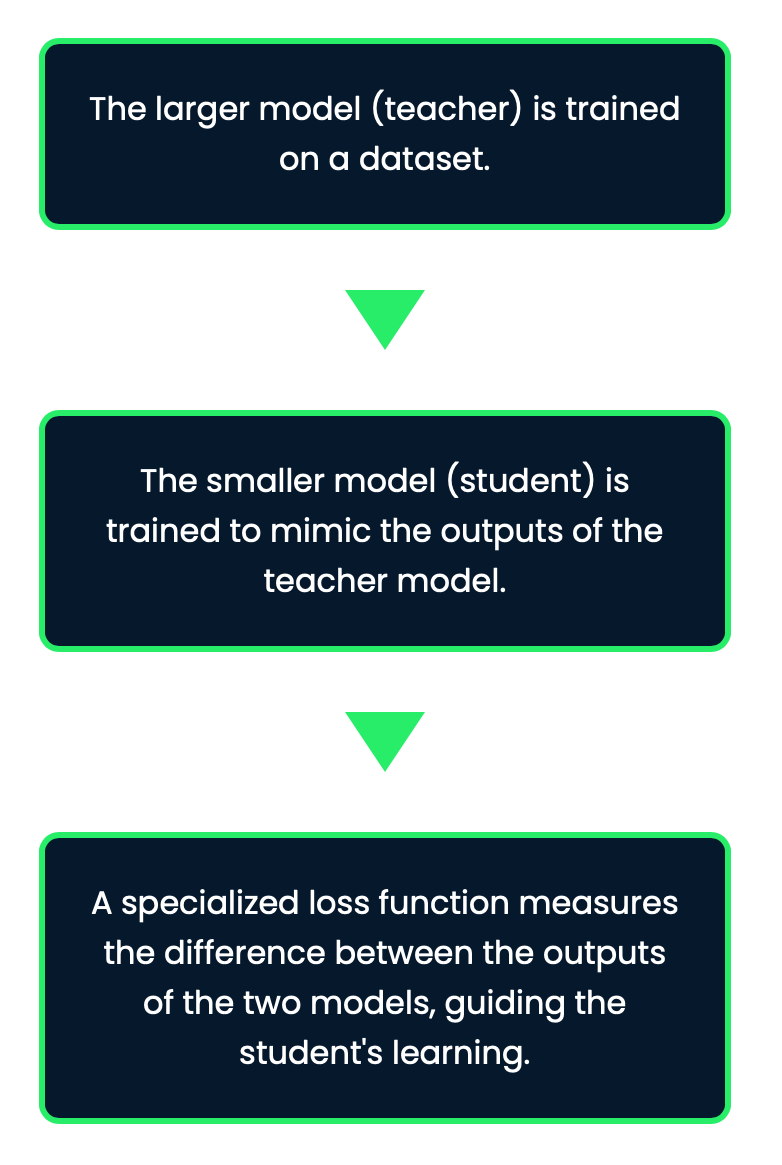

Đây là kỹ thuật tạo SLM bằng cách chuyển giao tri thức từ mô hình "giáo viên" lớn sang mô hình "học trò" nhỏ. Mục tiêu là nén những gì mô hình giáo viên đã học vào mô hình học trò mà không làm mất quá nhiều hiệu năng.

Quy trình này giúp SLM giữ được nhiều độ chính xác của mô hình lớn trong khi kích thước và nhu cầu tính toán dễ quản lý hơn nhiều. Với kỹ thuật này, mô hình nhỏ không chỉ học các dự đoán cuối cùng của giáo viên mà còn học các mẫu và sắc thái bên dưới.

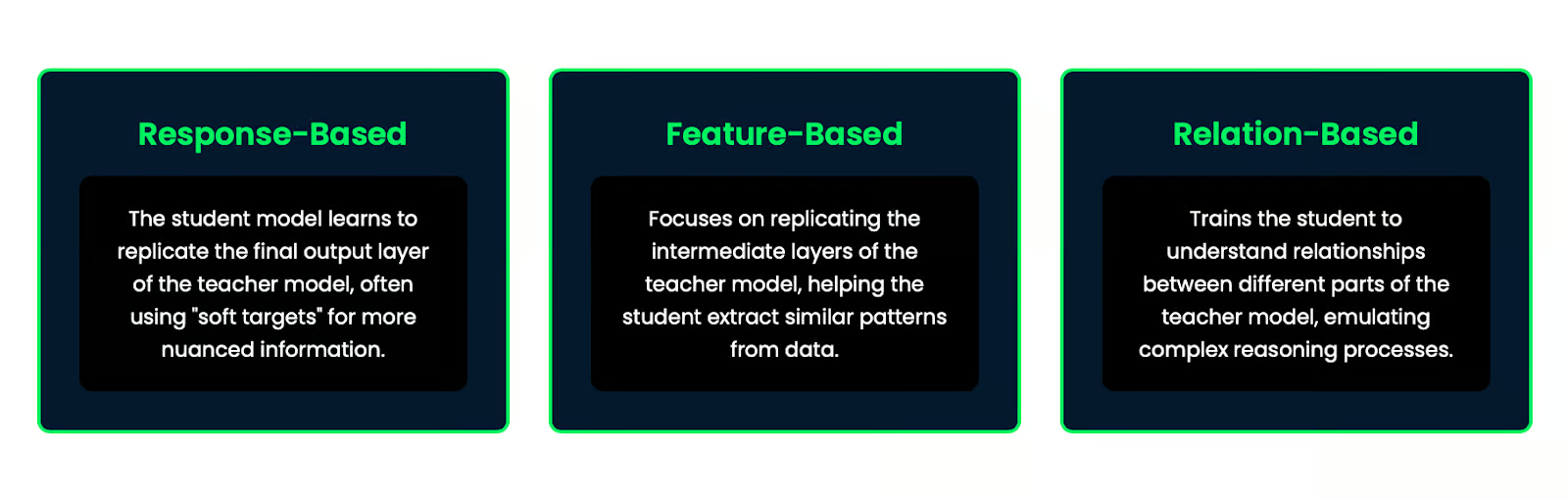

Có một số phương pháp chưng cất tri thức:

- Dựa trên phản hồi (Response-based): Mô hình học trò học cách tái tạo lớp đầu ra cuối của mô hình giáo viên, thường dùng "mục tiêu mềm" để có thông tin tinh tế hơn.

- Dựa trên đặc trưng (Feature-based): Tập trung tái tạo các tầng trung gian của mô hình giáo viên, giúp học trò trích xuất các mẫu tương tự từ dữ liệu.

- Dựa trên quan hệ (Relation-based): Huấn luyện học trò hiểu các mối quan hệ giữa các phần khác nhau của mô hình giáo viên, mô phỏng quy trình suy luận phức tạp.

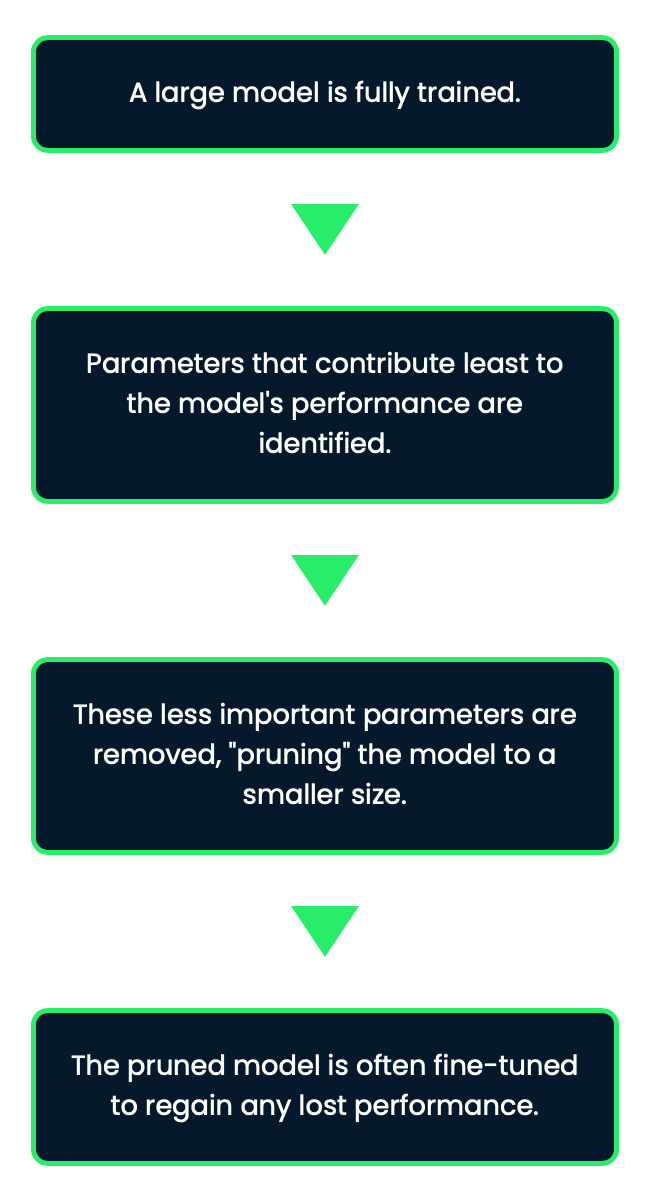

Cắt tỉa (Pruning)

Cắt tỉa giống như loại bỏ phần không cần thiết. Trong quá trình này, các phần ít quan trọng—như neuron hoặc tham số đóng góp ít vào hiệu năng tổng thể—được loại bỏ. Kỹ thuật này giúp thu nhỏ mô hình mà không ảnh hưởng đáng kể đến độ chính xác. Tuy nhiên, cắt tỉa có thể khó vì nếu quá tay, bạn có nguy cơ loại bỏ quá nhiều và làm giảm hiệu năng.

Cắt tỉa có thể giảm đáng kể kích thước mô hình trong khi vẫn giữ phần lớn hiệu năng gốc, nên là kỹ thuật hiệu quả để tạo SLM.

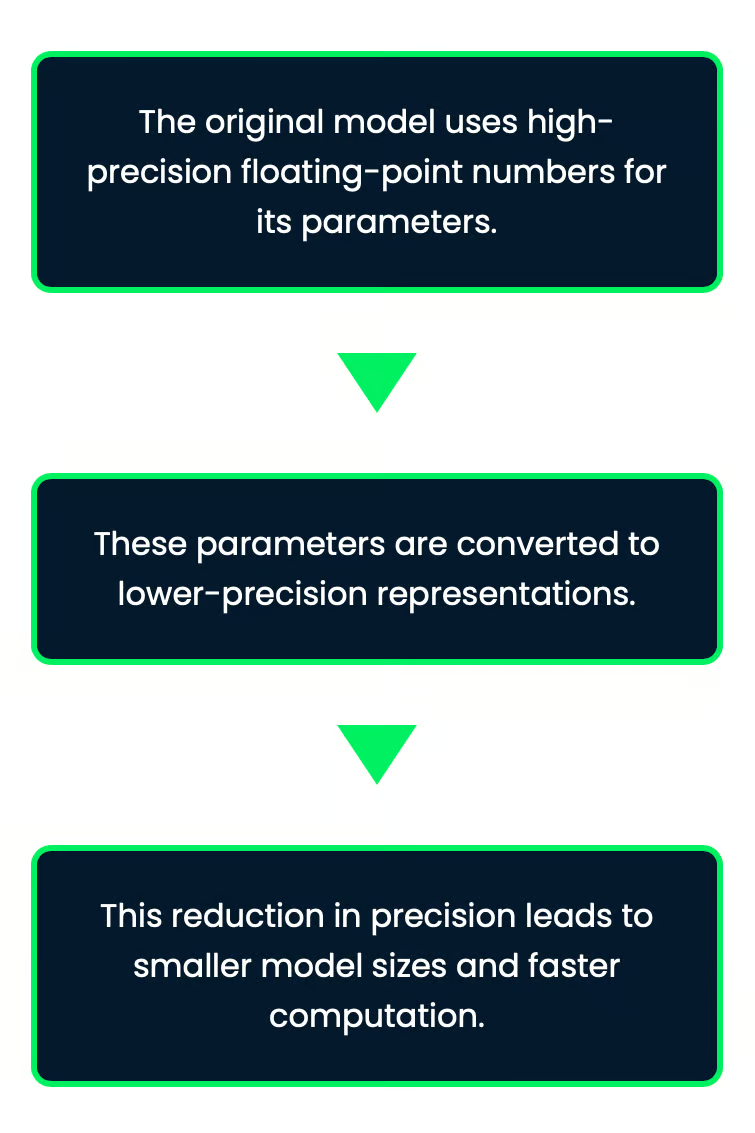

Lượng tử hóa (Quantization)

Lượng tử hóa là dùng ít bit hơn để lưu các số của mô hình. Thông thường mô hình dùng số 32-bit, nhưng với phương pháp này, các số được giảm xuống 8-bit, nhỏ hơn nhiều. Điều này giúp mô hình chiếm ít dung lượng và chạy nhanh hơn. Điểm hay là dù độ chính xác số liệu giảm, mô hình vẫn hoạt động tốt và chỉ ảnh hưởng nhỏ đến độ chính xác tổng thể.

Hãy tưởng tượng bạn lưu giá trị nhiệt độ trong một ứng dụng thời tiết. Bạn có thể lưu với độ chính xác cao (như số 32-bit), vốn nhiều hơn mức cần thiết. Giảm độ chính xác xuống 8-bit có thể mất chút chi tiết, nhưng ứng dụng vẫn hữu ích, chạy nhanh hơn và dùng ít bộ nhớ hơn.

Điều này đặc biệt hữu ích khi triển khai AI trên thiết bị có bộ nhớ và năng lực tính toán hạn chế, như điện thoại thông minh hoặc thiết bị edge.

Lượng tử hóa đặc biệt hiệu quả khi triển khai mô hình trên thiết bị tài nguyên hạn chế vì giảm yêu cầu bộ nhớ và cải thiện tốc độ suy luận.

Ứng dụng của mô hình ngôn ngữ nhỏ

Điểm tuyệt vời của SLM là có thể mang lại AI mạnh mẽ mà không cần hạ tầng khổng lồ hay kết nối internet liên tục, mở ra rất nhiều ứng dụng.

AI trên thiết bị

Hãy nghĩ về các trợ lý di động—những trợ lý giọng nói trên điện thoại giúp bạn xử lý công việc hằng ngày. SLM làm điều đó trở nên khả thi. Chúng cho phép dự đoán văn bản thời gian thực, lệnh thoại và thậm chí dịch thuật mà không cần gửi dữ liệu lên đám mây. Mọi thứ đều xử lý cục bộ, nghĩa là phản hồi nhanh hơn và tương tác bảo vệ quyền riêng tư hơn.

Ví dụ, SwiftKey và Gboard sử dụng SLM để đưa ra gợi ý văn bản theo ngữ cảnh chính xác, cải thiện tốc độ và độ chính xác khi gõ.

Điều này cũng mở rộng sang các ứng dụng ngoại tuyến, nơi AI vẫn hoạt động khi không có kết nối internet, hữu ích cho khu vực kết nối hạn chế.

Chẳng hạn, Google Dịch cung cấp khả năng dịch ngoại tuyến được hỗ trợ bởi SLM, giúp giao tiếp tại nơi truy cập internet hạn chế.

AI cá nhân hóa

Một ưu điểm lớn của SLM là có thể tùy chỉnh cho tác vụ hoặc sở thích người dùng cụ thể. Hãy tưởng tượng có một chatbot được fine-tune riêng cho dịch vụ khách hàng trong doanh nghiệp của bạn, hoặc một AI biết chính xác cách hỗ trợ dựa trên tương tác trước đó. Nhờ kích thước nhỏ, các mô hình này dễ fine-tune và triển khai trên nhiều ngành.

Một vài ví dụ:

- Y tế: SLM có thể tùy chỉnh để phân tích văn bản y khoa, cung cấp theo dõi sức khỏe thời gian thực và tư vấn trên thiết bị đeo thông minh. Chúng hoạt động độc lập, không cần kết nối đám mây liên tục.

- Thiết bị nhà thông minh: SLM tích hợp trong hệ thống nhà thông minh có thể học sở thích cá nhân về nhiệt độ và ánh sáng, tự động điều chỉnh theo thời điểm trong ngày hoặc các dịp cụ thể.

- Giáo dục: Ứng dụng giáo dục dùng SLM có thể thích ứng với phong cách và tốc độ học riêng, cung cấp hướng dẫn và hỗ trợ cá nhân hóa cho học viên.

Internet vạn vật

SLM âm thầm chạy nền trên những thiết bị thường ngày như hệ thống nhà thông minh hay các thiết bị khác. Chúng giúp thiết bị hiểu và phản hồi trực tiếp với bạn mà không cần kết nối internet, khiến chúng nhanh và thông minh hơn.

Ứng dụng khác

SLM đang được ứng dụng trong nhiều lĩnh vực khác:

- Dịch ngôn ngữ thời gian thực: SLM giúp dịch tức thời, quan trọng cho giao tiếp toàn cầu. Một số ứng dụng du lịch hiện dùng SLM để dịch biển báo, thực đơn hoặc chỉ đường nói trong thời gian thực, giúp người dùng xử lý ngôn ngữ nước ngoài.

- Hệ thống ô tô: Trong xe, SLM cung cấp dẫn đường thông minh, cập nhật giao thông thời gian thực và gợi ý lộ trình tối ưu. Chúng cũng cải thiện lệnh thoại, cho phép tài xế điều khiển nhạc, gọi điện hoặc nhắn tin rảnh tay.

- Hệ thống giải trí: TV thông minh và máy chơi game sử dụng SLM cho điều khiển giọng nói và gợi ý chương trình hoặc trò chơi dựa trên lịch sử xem/chơi của bạn.

- Dịch vụ khách hàng: SLM giúp doanh nghiệp xử lý câu hỏi khách hàng hiệu quả hơn. Các cửa hàng bán lẻ dùng SLM để trả lời câu hỏi về sản phẩm, trạng thái đơn hàng, hoặc chính sách đổi trả, từ đó giảm nhu cầu hỗ trợ thủ công.

LLM so với SLM

Giờ hãy bàn xem khi nào nên dùng LLM lớn và khi nào SLM là lựa chọn tốt hơn.

Độ phức tạp của tác vụ

Với các tác vụ rất phức tạp như hiểu sâu, sáng tạo nội dung dài, hoặc giải bài toán hóc búa, các mô hình lớn như GPT-4o thường vượt trội hơn SLM. Chúng xử lý tốt vì khai thác lượng dữ liệu khổng lồ để đưa ra câu trả lời chi tiết. Tuy nhiên, nhược điểm là mức tinh vi này đòi hỏi nhiều tài nguyên tính toán và thời gian.

|

LLM |

SLM |

|

Giỏi xử lý các tác vụ phức tạp, tinh vi và tổng quát |

Phù hợp nhất cho các tác vụ vừa đủ, đơn giản hơn |

|

Độ chính xác và hiệu năng tốt hơn trên nhiều tác vụ khác nhau |

Xuất sắc ở các ứng dụng chuyên biệt và tác vụ theo lĩnh vực |

|

Duy trì ngữ cảnh trên đoạn dài và đưa ra phản hồi mạch lạc |

Có thể gặp khó với tác vụ ngôn ngữ phức tạp và hiểu ngữ cảnh dài hạn |

Ví dụ, nếu bạn phát triển một chatbot đa dụng cần xử lý nhiều chủ đề và truy vấn phức tạp, LLM sẽ phù hợp hơn. Tuy nhiên, với bot dịch vụ khách hàng chuyên sâu cho một dòng sản phẩm cụ thể, SLM có thể là quá đủ và thậm chí vượt LLM nhờ được huấn luyện tập trung.

Giới hạn tài nguyên

Khi bạn bị giới hạn tài nguyên, SLM tỏa sáng. Chúng cần ít sức mạnh tính toán để huấn luyện và triển khai. Đây là lựa chọn tuyệt vời nếu bạn làm việc trong môi trường hạn chế tài nguyên.

|

LLM |

SLM |

|

Cần nhiều sức mạnh tính toán và bộ nhớ |

Tiết kiệm tài nguyên hơn |

|

Thường cần phần cứng chuyên dụng như GPU để suy luận |

Có thể chạy trên phần cứng tiêu chuẩn, thậm chí trên Raspberry Pi hoặc điện thoại thông minh |

|

Chi phí vận hành cao do nhu cầu tài nguyên |

Thời gian huấn luyện ngắn hơn, dễ tiếp cận cho các triển khai nhanh |

Trong những tình huống sức mạnh tính toán hạn chế, như trên thiết bị di động hoặc tính toán biên (edge), SLM thường là lựa chọn tốt hơn vì cân bằng giữa hiệu năng và hiệu quả.

Môi trường triển khai

Nếu bạn triển khai AI trên máy chủ đám mây nơi tài nguyên không phải vấn đề, LLM có thể là hướng đi, đặc biệt khi cần độ chính xác và lưu loát cao. Nhưng nếu làm việc trên thiết bị có CPU hoặc GPU hạn chế như thiết bị IoT hoặc ứng dụng di động, SLM là lựa chọn hoàn hảo.

|

LLM |

SLM |

|

Phù hợp nhất cho môi trường đám mây nơi có dồi dào sức mạnh tính toán |

Có thể dùng trên đám mây, nhưng kích thước nhỏ giúp phù hợp hơn cho nơi tài nguyên hạn chế. Hiệu quả hơn với tác vụ nhỏ |

|

Không lý tưởng cho AI trên thiết bị vì cần nhiều sức mạnh tính toán và phụ thuộc kết nối internet |

Hoàn hảo cho AI trên thiết bị, cho phép dùng ngoại tuyến và phản hồi nhanh hơn. Có thể chạy trợ lý di động, nhận dạng giọng nói, và ứng dụng thời gian thực khác mà không cần internet |

|

Không phù hợp cho tính toán biên vì cần nhiều tài nguyên và có thể phản hồi chậm |

Tuyệt vời cho tính toán biên, nơi phản hồi nhanh và sử dụng tài nguyên hiệu quả là quan trọng. Kích hoạt AI trên thiết bị IoT, nhà thông minh và ứng dụng biên khác |

Khi cân nhắc môi trường triển khai, cần đánh giá các yếu tố như kết nối internet, yêu cầu độ trễ và lo ngại về quyền riêng tư. Với ứng dụng cần hoạt động ngoại tuyến hoặc độ trễ tối thiểu, triển khai SLM trên thiết bị hoặc tại biên thường là lựa chọn tốt hơn.

Việc chọn giữa LLM và SLM phụ thuộc vào độ phức tạp của tác vụ, nguồn lực bạn có và nơi bạn muốn triển khai. LLM phù hợp cho tác vụ phức tạp đòi hỏi độ chính xác cao, trong khi SLM hiệu quả và có thể hoạt động ở nhiều môi trường hơn.

Kết luận

SLM đang giúp AI dễ tiếp cận hơn rất nhiều. Không giống các mô hình lớn cần lượng lớn sức mạnh tính toán, SLM chạy với ít tài nguyên hơn. Điều này có nghĩa các công ty nhỏ, nhà phát triển cá nhân và cả startup có thể sử dụng mà không cần máy chủ khổng lồ hay ngân sách lớn.

Để tìm hiểu thêm về mô hình ngôn ngữ nhỏ, tôi gợi ý hai tài nguyên sau:

Câu hỏi thường gặp

Sự khác biệt cụ thể về tiêu thụ năng lượng khi chạy SLM so với LLM cho một ứng dụng doanh nghiệp điển hình là gì?

Sự khác biệt về tiêu thụ năng lượng giữa SLM và LLM có thể rất lớn. Với một ứng dụng doanh nghiệp điển hình, SLM có thể chỉ tiêu thụ 10–20% năng lượng so với LLM. Ví dụ, chạy SLM cho chatbot chăm sóc khách hàng có thể dùng khoảng 50–100 kWh mỗi tháng, trong khi LLM cho cùng tác vụ có thể tiêu thụ 500–1000 kWh. Tuy nhiên, con số chính xác phụ thuộc vào kích thước mô hình, cách sử dụng và hiệu quả phần cứng. Các công ty như Google và OpenAI cho biết vận hành những mô hình lớn nhất của họ có thể tiêu thụ năng lượng tương đương hàng trăm hộ gia đình, trong khi SLM thường chạy trên máy chủ tiêu chuẩn hoặc thậm chí thiết bị biên với yêu cầu điện năng thấp hơn đáng kể.

So sánh thời gian phát triển khi tạo SLM tùy chỉnh với việc fine-tune các LLM hiện có cho tác vụ chuyên biệt như thế nào?

Tiến độ phát triển giữa SLM tùy chỉnh và fine-tune LLM có thể khác biệt đáng kể. Tạo một SLM tùy chỉnh từ đầu thường lâu hơn, thường 3–6 tháng với một đội ngũ khoa học dữ liệu giàu kinh nghiệm, do cần thu thập dữ liệu, thiết kế kiến trúc mô hình, huấn luyện và kiểm thử chuyên sâu. Fine-tune một LLM hiện có cho tác vụ chuyên biệt có thể nhanh hơn nhiều, chỉ mất vài tuần. Tuy nhiên, đánh đổi là LLM đã fine-tune có thể không đạt cùng mức hiệu quả hoặc chuyên môn hóa như SLM xây từ đầu. Lựa chọn phụ thuộc vào bài toán cụ thể, nguồn lực sẵn có và đặc tính hiệu năng mong muốn.

Những cân nhắc pháp lý và đạo đức nào khi triển khai SLM so với LLM, đặc biệt liên quan đến quyền riêng tư dữ liệu và sở hữu trí tuệ?

Quyền riêng tư dữ liệu là mối quan ngại lớn, các LLM thường có rất nhiều dữ liệu huấn luyện, có thể làm tăng rủi ro lộ thông tin cá nhân. SLM, do tập trung hơn, có thể dùng tập dữ liệu nhỏ và kiểm soát tốt hơn, từ đó giảm rủi ro về quyền riêng tư. Vấn đề sở hữu trí tuệ cũng quan trọng, vì LLM được huấn luyện trên dữ liệu internet đa dạng có thể tái tạo nội dung có bản quyền. SLM, được huấn luyện trên dữ liệu cụ thể hơn, có thể gặp ít rủi ro như vậy hơn nhưng vẫn có thể phát sinh tùy dữ liệu huấn luyện. Ngoài ra, khả năng diễn giải và giải thích quyết định của mô hình thường dễ dàng hơn với SLM, điều này rất quan trọng cho các ứng dụng trong ngành được quản lý chặt chẽ.

SLM và LLM so sánh thế nào về khả năng đa ngôn ngữ, đặc biệt với các ngôn ngữ ít phổ biến?

SLM và LLM xử lý đa ngôn ngữ khác nhau, đặc biệt với ngôn ngữ ít phổ biến. LLM, nhờ dữ liệu huấn luyện khổng lồ, thường hoạt động tốt trên nhiều ngôn ngữ, kể cả hiếm, nhưng đánh đổi là kích thước lớn và phức tạp. SLM, dù nhỏ hơn, có thể tùy chỉnh cho ngôn ngữ hoặc nhóm ngôn ngữ cụ thể, đôi khi còn vượt LLM ở các lĩnh vực đó. Với ngôn ngữ ít phổ biến, SLM được huấn luyện chuyên biệt có thể mang lại bản dịch hoặc văn bản chính xác và phù hợp văn hóa hơn, vì tập trung vào dữ liệu chất lượng cao, đặc thù ngôn ngữ, trái ngược với dữ liệu rộng nhưng có thể kém chính xác của LLM.

Thực hành tốt nhất cho kiểm soát phiên bản và quản trị mô hình khi làm việc với SLM so với LLM trong môi trường sản xuất là gì?

Thực hành tốt nhất để quản lý phiên bản và quản trị SLM và LLM trong môi trường sản xuất có điểm giống và khác quan trọng. Với cả hai, cần có hệ thống quản lý phiên bản tốt cho mô hình, dữ liệu huấn luyện và thiết lập. Tuy nhiên, LLM do kích thước và độ nhạy với fine-tune, cần hạ tầng phức tạp hơn cho kiểm soát phiên bản. SLM nhỏ hơn nên dễ quản lý và triển khai nhiều phiên bản. Về quản trị, LLM thường cần giám sát chặt chẽ hơn do phạm vi năng lực rộng và khả năng hành vi ngoài dự kiến. SLM, với mục đích sử dụng cụ thể hơn, có thể cần ít giám sát tổng thể nhưng yêu cầu quản trị có trọng tâm. Với cả hai, kiểm tra định kỳ, theo dõi hiệu năng và tài liệu rõ ràng về giới hạn và mục đích sử dụng là rất quan trọng để sử dụng AI có trách nhiệm.

Ana Rojo Echeburúa là chuyên gia AI và dữ liệu, có bằng Tiến sĩ Toán Ứng dụng. Cô yêu thích việc biến dữ liệu thành những insight có thể hành động và có nhiều kinh nghiệm lãnh đạo các nhóm kỹ thuật. Ana thích làm việc chặt chẽ với khách hàng để giải quyết các vấn đề kinh doanh và tạo ra những giải pháp AI sáng tạo. Được biết đến với kỹ năng giải quyết vấn đề và giao tiếp rõ ràng, cô đam mê AI, đặc biệt là AI tạo sinh. Ana luôn theo đuổi việc học tập không ngừng và phát triển AI có đạo đức, cũng như đơn giản hóa các vấn đề phức tạp và giải thích công nghệ theo cách dễ tiếp cận.