Program

Small language models (SLM) memecahkan masalah membuat AI lebih mudah diakses dan efisien bagi mereka yang memiliki sumber daya terbatas dengan menjadi lebih kecil, lebih cepat, dan lebih mudah disesuaikan dibandingkan large language models (LLM).

SLM memiliki lebih sedikit parameter (biasanya di bawah 10 miliar), yang secara drastis mengurangi biaya komputasi dan penggunaan energi. SLM berfokus pada tugas tertentu dan dilatih pada dataset yang lebih kecil. Ini menjaga keseimbangan antara kinerja dan efisiensi sumber daya.

Apa Itu Small Language Models?

Small language models adalah versi ringkas dan sangat efisien dari large language models besar yang sering kita dengar. LLM seperti GPT-4o memiliki ratusan miliar parameter, tetapi SLM menggunakan jauh lebih sedikit—biasanya dari jutaan hingga beberapa miliar.

Karakteristik utama SLM adalah:

- Efisiensi: SLM tidak memerlukan daya komputasi masif seperti yang dibutuhkan LLM. Ini menjadikannya sangat cocok untuk digunakan pada perangkat dengan sumber daya terbatas, seperti ponsel pintar, tablet, atau perangkat IoT—pelajari lebih lanjut tentang hal ini di blog tentang edge AI.

- Aksesibilitas: Orang dengan anggaran terbatas dapat menerapkan SLM tanpa memerlukan infrastruktur kelas atas. SLM juga sangat cocok untuk penerapan on-premise di mana privasi dan keamanan data sangat penting, karena tidak selalu bergantung pada infrastruktur berbasis cloud.

- Kustomisasi: SLM mudah di-fine-tune. Ukurannya yang lebih kecil membuatnya cepat beradaptasi dengan tugas khusus dan domain spesialis. Ini membuatnya sangat cocok untuk aplikasi spesifik seperti layanan pelanggan, kesehatan, atau pendidikan (kita akan membahas ini lebih detail nanti!).

- Inferensi lebih cepat: SLM memiliki waktu respons lebih cepat karena parameter yang diproses lebih sedikit. Ini ideal untuk aplikasi waktu nyata seperti chatbot, asisten virtual, atau sistem apa pun yang membutuhkan keputusan cepat. Anda tidak perlu menunggu lama untuk jawaban—sangat cocok untuk lingkungan yang menuntut latensi rendah.

Contoh Small Language Models

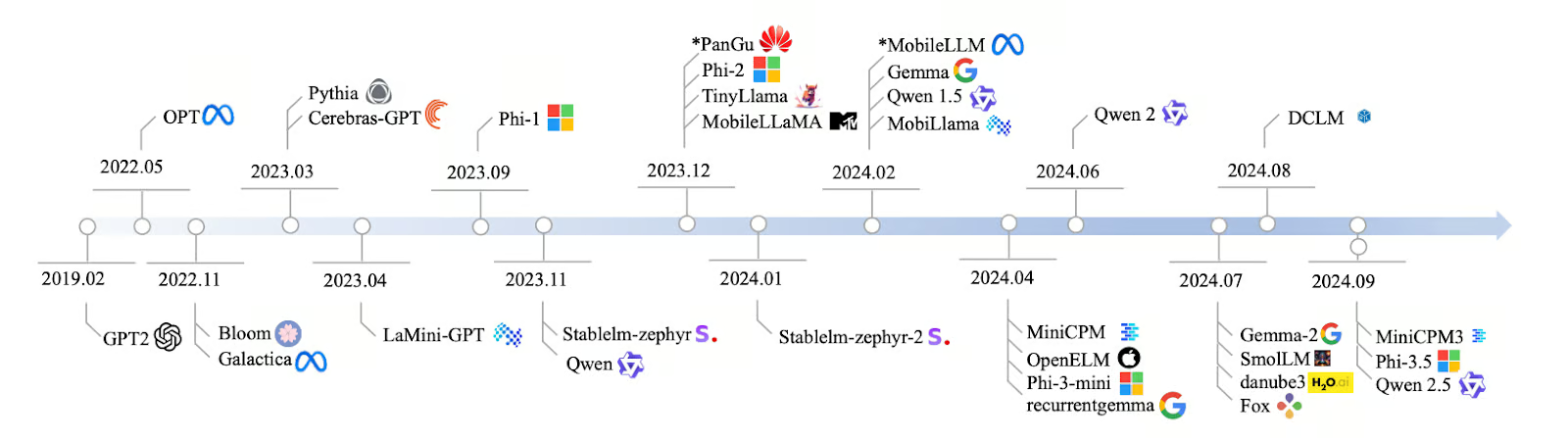

Perkembangan SLM dari 2019 hingga 2024 berlangsung cepat, dengan banyak model baru dibuat untuk memenuhi kebutuhan AI yang lebih efisien. Dimulai dengan GPT-2 pada 2019, dan selama bertahun-tahun, model menjadi lebih fokus dan lebih cepat. Pada 2022, model seperti Bloom dan Galactica mampu menangani banyak bahasa dan data ilmiah, dan pada 2023, model seperti Pythia dan Cerebras-GPT dirancang untuk tugas seperti pemrograman dan penalaran logis.

Pada 2024, lebih banyak lagi SLM dirilis, seperti LaMini-GPT, MobileLLaMA, dan TinyLlama, yang dibuat agar bekerja baik di perangkat seluler dan sistem berdaya rendah lainnya. Perusahaan seperti Meta, Google, dan Microsoft memimpin pengembangan model ini, dengan beberapa tersedia untuk publik dan lainnya bersifat privat.

Sumber: Lu dkk., 2024

Praktisi menggunakan SLM di banyak industri karena ringan, cepat, dan tidak membutuhkan banyak sumber daya untuk berjalan. Berikut beberapa model beserta parameter dan fitur utamanya:

|

Nama Model |

Parameter |

Sumber Terbuka |

Fitur Utama |

|

Qwen2 |

0.5B, 1B, 7B |

Ya |

Dapat diskalakan, cocok untuk berbagai tugas |

|

Mistral Nemo 12B |

12B |

Ya |

Tugas NLP kompleks, penerapan lokal |

|

Llama 3.1 8B |

8B |

Ya* |

Keseimbangan daya dan efisiensi |

|

Pythia |

160M - 2.8B |

Ya |

Fokus pada penalaran dan pemrograman |

|

Cerebras-GPT |

111M - 2.7B |

Ya |

Efisien komputasi, mengikuti hukum penskalaan Chinchilla |

|

Phi-3.5 |

3.8B |

Ya** |

Panjang konteks panjang (128K token), multibahasa |

|

StableLM-zephyr |

3B |

Ya |

Inferensi cepat, efisien untuk sistem edge |

|

TinyLlama |

1.1B |

Ya |

Efisien untuk perangkat seluler dan edge |

|

MobileLLaMA |

1.4B |

Ya |

Dioptimalkan untuk perangkat seluler dan berdaya rendah |

|

LaMini-GPT |

774M - 1.5B |

Ya |

Multibahasa, tugas mengikuti instruksi |

|

Gemma2 |

9B, 27B |

Ya |

Penerapan lokal, aplikasi waktu nyata |

|

MiniCPM |

1B - 4B |

Ya |

Kinerja seimbang, dioptimalkan untuk bahasa Inggris dan Tionghoa |

|

OpenELM |

270M - 3B |

Ya |

Multitugas, latensi rendah, hemat energi |

|

DCLM |

1B |

Ya |

Penalaran akal sehat, deduksi logis |

|

Fox |

1.6B |

Ya |

Dioptimalkan untuk kecepatan pada aplikasi seluler |

*Dengan pembatasan penggunaan

**Hanya untuk tujuan riset

Pelajari lebih lanjut tentang model-model ini dalam artikel terpisah yang saya tulis mengenai small language models terbaik.

Cara Kerja SLM

Mari kita bahas cara kerja small language models.

Prediksi kata berikutnya

Sama seperti LLM, SLM bekerja dengan memprediksi kata berikutnya dalam sebuah rangkaian teks. SLM menggunakan pola dari teks yang telah dilatih untuk menebak apa yang datang selanjutnya. Konsep sederhana namun kuat ini menjadi inti dari semua model bahasa.

Sebagai contoh, dengan masukan: "Dalam seri Harry Potter, sahabat tokoh utamanya bernama Ron..." SLM akan menganalisis konteks ini dan memprediksi kata yang paling mungkin berikutnya—dalam hal ini, "Weasley."

Arsitektur transformer

Arsitektur transformer adalah kunci bagaimana LLM dan SLM memahami dan menghasilkan bahasa. Transformer dapat dipahami sebagai otak di balik model bahasa. Transformer menggunakan self-attention untuk mencari tahu kata mana dalam sebuah kalimat yang paling relevan satu sama lain. Ini membantu model memahami konteks—misalnya, mengenali bahwa “Paris” merujuk pada kota atau orang yang Anda kenal dari kantor.

Keseimbangan ukuran dan kinerja

Kekuatan SLM terletak pada kemampuannya menyeimbangkan ukuran dan kinerja. SLM menggunakan parameter yang jauh lebih sedikit daripada LLM, biasanya berkisar dari jutaan hingga beberapa miliar, dibandingkan ratusan miliar pada LLM.

Dengan parameter lebih sedikit, SLM memerlukan daya komputasi dan data yang lebih rendah untuk pelatihan, sehingga lebih mudah diakses jika Anda memiliki sumber daya terbatas. Ukuran SLM yang ringkas membuatnya memproses input dan menghasilkan output lebih cepat, yang sangat penting untuk aplikasi waktu nyata seperti papan ketik seluler atau asisten suara.

SLM mungkin tidak se-serbaguna atau sedalam model besar dalam memahami konteks, tetapi SLM sangat baik menangani tugas spesifik. Misalnya, sebuah SLM yang dilatih untuk menganalisis teks hukum dapat bekerja lebih baik daripada LLM umum di area tersebut.

Cara Membuat SLM: Teknik dan Pendekatan

SLM menggunakan teknik seperti distilasi, pruning, dan kuantisasi untuk menjadi lebih kecil, lebih cepat, dan lebih efisien.

Distilasi

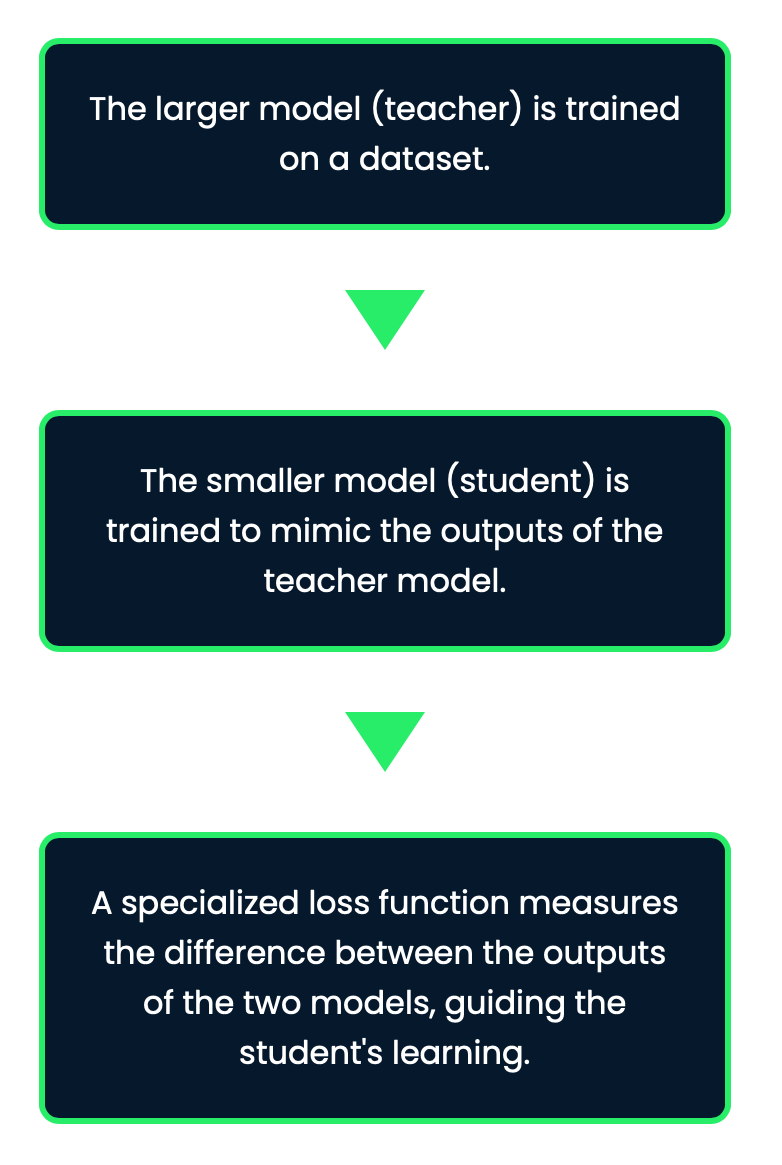

Ini adalah teknik untuk membuat SLM dengan mentransfer pengetahuan dari model "guru" yang lebih besar ke model "murid" yang lebih kecil. Tujuannya adalah mengambil apa yang telah dipelajari model guru dan memampatkannya ke dalam model murid tanpa terlalu banyak kehilangan kinerja.

Proses ini membuat SLM mempertahankan banyak akurasi model yang lebih besar sambil jauh lebih mudah dikelola dari sisi ukuran dan kebutuhan komputasi. Dengan teknik ini, model yang lebih kecil belajar bukan hanya prediksi akhir dari guru, tetapi juga pola dan nuansa yang mendasarinya.

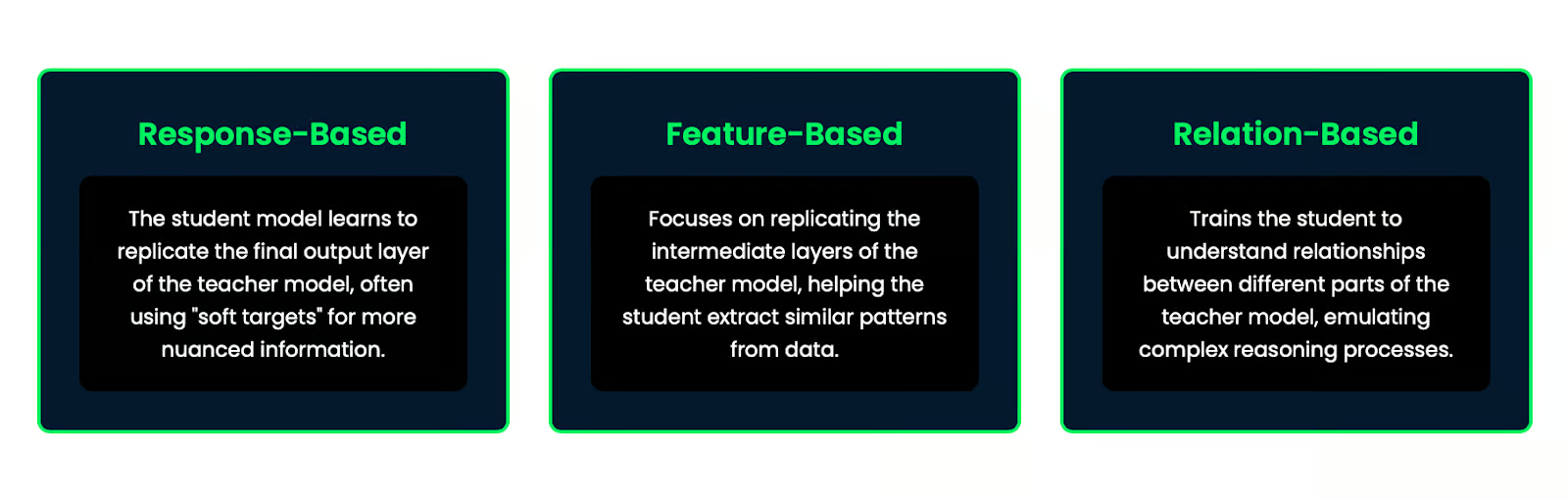

Ada beberapa metode distilasi pengetahuan:

- Berbasis respons: Model murid belajar mereplikasi layer output akhir model guru, sering menggunakan "soft targets" untuk informasi yang lebih bernuansa.

- Berbasis fitur: Berfokus pada replikasi layer menengah model guru, membantu murid mengekstraksi pola serupa dari data.

- Berbasis relasi: Melatih murid untuk memahami hubungan antar bagian dalam model guru, meniru proses penalaran yang kompleks.

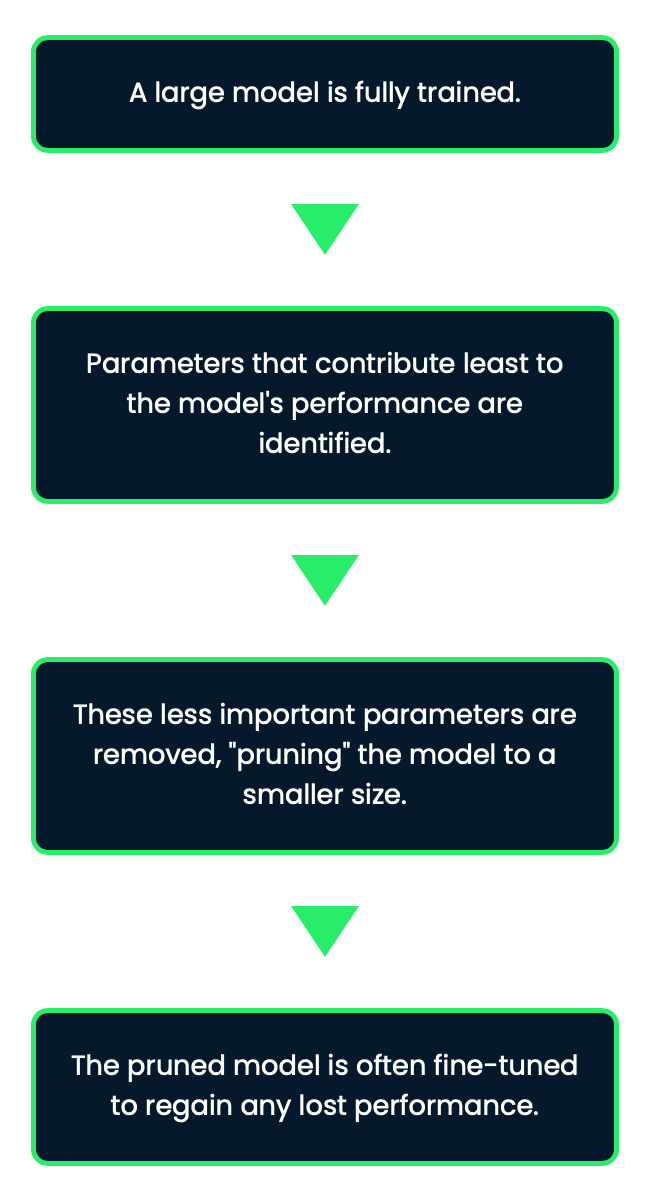

Pruning

Pruning mirip seperti memangkas bagian yang tidak dibutuhkan. Selama pruning, bagian model yang kurang penting—seperti neuron atau parameter yang tidak banyak berkontribusi pada kinerja keseluruhan—dihilangkan. Teknik ini membantu mengecilkan model tanpa berdampak signifikan pada akurasinya. Namun, pruning dapat menjadi rumit karena jika terlalu agresif, Anda berisiko memotong terlalu banyak dan menurunkan kinerja model.

Pruning dapat secara signifikan mengurangi ukuran model sambil mempertahankan sebagian besar kinerja awal, sehingga menjadi teknik yang efektif untuk membuat SLM.

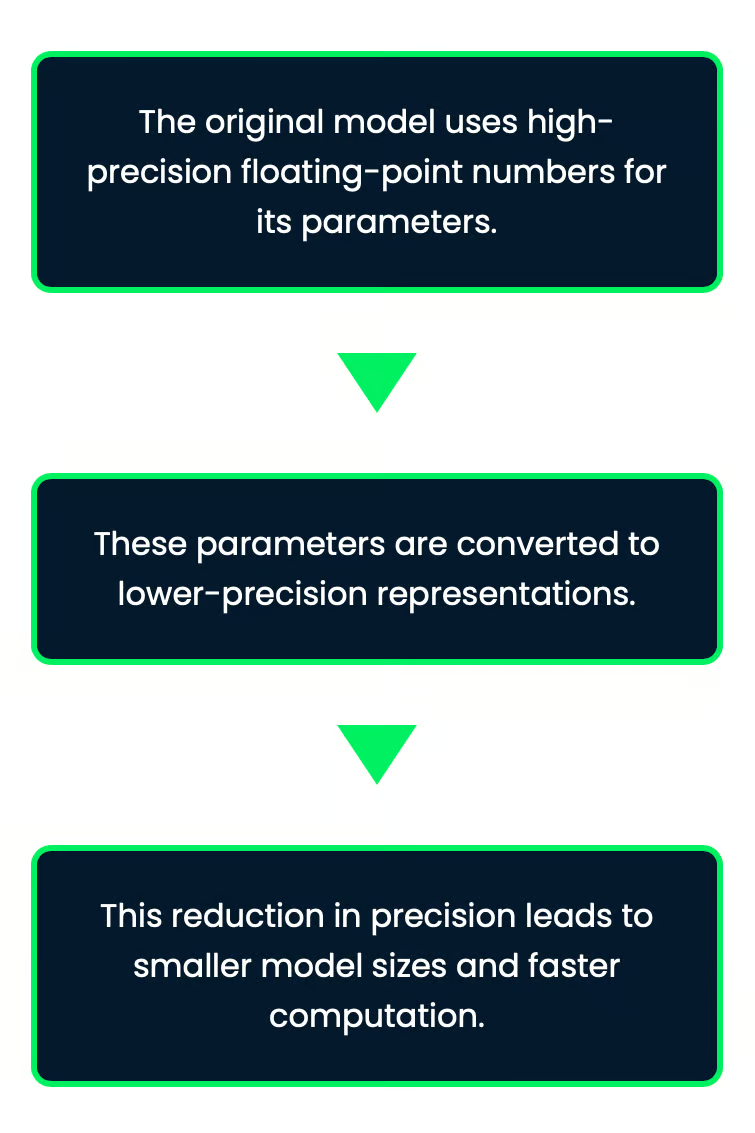

Kuantisasi

Kuantisasi melibatkan penggunaan bit yang lebih sedikit untuk menyimpan angka-angka dalam model. Biasanya, sebuah model menggunakan angka 32-bit, namun dengan metode ini angka-angka tersebut dikurangi menjadi 8-bit, yang jauh lebih kecil. Ini membuat ukuran model lebih ringkas dan memungkinkan model berjalan lebih cepat. Yang terbaik adalah, meskipun angkanya kurang presisi, model tetap bekerja baik dengan dampak kecil pada akurasi.

Bayangkan Anda menyimpan nilai suhu dalam aplikasi cuaca. Anda mungkin menyimpannya dengan presisi tinggi (seperti angka 32-bit), yang sebenarnya lebih dari yang dibutuhkan. Dengan menurunkan presisi menjadi 8-bit, Anda mungkin kehilangan detail, tetapi aplikasi tetap bermanfaat sambil berjalan lebih cepat dan menggunakan lebih sedikit memori.

Ini sangat berguna untuk menerapkan AI pada perangkat dengan memori dan daya komputasi terbatas, seperti ponsel pintar atau perangkat edge.

Kuantisasi sangat efektif untuk menerapkan model pada perangkat dengan sumber daya terbatas karena mengurangi kebutuhan memori dan meningkatkan kecepatan inferensi.

Aplikasi Small Language Models

Keunggulan SLM terletak pada kemampuannya menghadirkan AI yang andal tanpa memerlukan infrastruktur besar atau konektivitas internet yang konstan, yang membuka banyak aplikasi.

AI pada perangkat

Pikirkan tentang asisten seluler—asisten suara di ponsel Anda yang membantu aktivitas harian. SLM memungkinkan hal ini. SLM memungkinkan prediksi teks waktu nyata, perintah suara, dan bahkan terjemahan tanpa perlu mengirim data ke cloud. Semua dilakukan secara lokal, yang berarti respons lebih cepat dan interaksi yang lebih menjaga privasi.

Sebagai contoh, SwiftKey dan Gboard memanfaatkan SLM untuk memberikan saran teks yang kontekstual dan akurat, sehingga meningkatkan kecepatan dan ketepatan mengetik.

Ini juga meluas ke aplikasi luring di mana AI tetap dapat berfungsi tanpa koneksi internet, sehingga berguna di area dengan konektivitas terbatas.

Google Translate, misalnya, menawarkan kemampuan terjemahan luring yang didukung oleh SLM, memudahkan komunikasi di wilayah dengan akses internet terbatas.

AI yang dipersonalisasi

Salah satu keunggulan SLM adalah dapat disesuaikan untuk tugas tertentu atau preferensi pengguna. Bayangkan memiliki chatbot yang di-fine-tune khusus untuk layanan pelanggan di bisnis Anda atau AI yang tahu persis bagaimana membantu Anda berdasarkan interaksi sebelumnya. Karena model ini lebih kecil, SLM jauh lebih mudah di-fine-tune dan diterapkan di berbagai industri.

Berikut beberapa contohnya:

- Kesehatan: SLM dapat disesuaikan untuk analisis teks medis guna memberikan pemantauan kesehatan waktu nyata dan saran pada perangkat wearable pintar. SLM beroperasi tanpa perlu konektivitas cloud yang terus-menerus.

- Perangkat rumah pintar: SLM yang tertanam dalam sistem rumah pintar dapat mempelajari preferensi individu untuk suhu dan pencahayaan, menyesuaikan pengaturan secara otomatis untuk waktu yang berbeda atau acara tertentu.

- Pendidikan: Aplikasi edukasi yang menggunakan SLM dapat beradaptasi dengan gaya dan kecepatan belajar individu, memberikan bimbingan dan dukungan yang dipersonalisasi kepada siswa.

Internet of Things

SLM berjalan diam-diam di latar belakang pada perangkat sehari-hari seperti sistem rumah pintar atau gawai lain. SLM membantu perangkat ini memahami dan merespons Anda secara langsung tanpa perlu terhubung ke internet, sehingga lebih cepat dan lebih cerdas.

Aplikasi lainnya

SLM menemukan penerapan di banyak area lainnya:

- Penerjemahan bahasa waktu nyata: SLM memungkinkan terjemahan instan, yang penting untuk komunikasi global. Beberapa aplikasi perjalanan kini menggunakan SLM untuk menerjemahkan rambu, menu, atau petunjuk lisan secara waktu nyata. Ini membantu pengguna menavigasi bahasa asing.

- Sistem otomotif: Di mobil, SLM menyediakan navigasi cerdas, memberikan pembaruan lalu lintas secara waktu nyata dan menyarankan rute terbaik. SLM juga meningkatkan perintah suara, memungkinkan pengemudi mengontrol musik, melakukan panggilan, atau mengirim pesan tanpa menggunakan tangan.

- Sistem hiburan: Smart TV dan konsol gim menggunakan SLM untuk kontrol suara dan menyarankan acara atau gim berdasarkan yang pernah Anda tonton atau mainkan sebelumnya.

- Layanan pelanggan: SLM membantu perusahaan menangani pertanyaan pelanggan dengan lebih efisien. Toko ritel menggunakan SLM untuk menjawab pertanyaan tentang produk, status pesanan, atau kebijakan pengembalian. Ini mengurangi kebutuhan dukungan pelanggan manusia.

LLM vs. SLM

Sekarang, mari bahas kapan sebaiknya menggunakan LLM yang besar dan kapan SLM menjadi pilihan yang lebih baik.

Kompleksitas tugas

Untuk tugas yang sangat kompleks seperti pemahaman mendalam, pembuatan konten panjang, atau memecahkan masalah pelik, model besar seperti GPT-4o biasanya berkinerja lebih baik daripada SLM. LLM dapat menangani tugas-tugas ini karena menarik dari jumlah data yang sangat besar untuk memberikan jawaban yang lebih mendetail. Namun, kelemahannya adalah tingkat kecanggihan ini membutuhkan banyak daya komputasi dan waktu.

|

LLM |

SLM |

|

Unggul dalam menangani tugas yang kompleks, canggih, dan umum |

Paling cocok untuk tugas yang lebih sederhana dan memadai |

|

Akurasi dan kinerja lebih baik di berbagai tugas |

Unggul pada aplikasi khusus dan tugas spesifik domain |

|

Mampu mempertahankan konteks pada teks panjang dan memberikan respons koheren |

Dapat kesulitan pada tugas bahasa kompleks dan pemahaman konteks jangka panjang |

Sebagai contoh, jika Anda mengembangkan chatbot tujuan umum yang perlu menangani berbagai topik dan kueri kompleks, LLM akan lebih sesuai. Namun, untuk bot layanan pelanggan khusus yang berfokus pada satu lini produk, SLM mungkin sudah lebih dari cukup dan bahkan bisa mengungguli LLM karena pelatihannya yang terfokus.

Keterbatasan sumber daya

Ketika ada keterbatasan sumber daya, di situlah SLM unggul. SLM membutuhkan daya komputasi yang jauh lebih sedikit untuk dilatih dan diterapkan. SLM adalah pilihan yang bagus jika Anda bekerja di lingkungan dengan sumber daya terbatas.

|

LLM |

SLM |

|

Memerlukan daya komputasi dan memori yang signifikan |

Lebih ekonomis dalam konsumsi sumber daya |

|

Sering memerlukan perangkat keras khusus seperti GPU untuk inferensi |

Dapat berjalan pada perangkat keras standar bahkan pada perangkat seperti Raspberry Pi atau ponsel pintar |

|

Biaya operasional lebih tinggi karena kebutuhan sumber daya |

Waktu pelatihan lebih singkat, membuatnya lebih mudah diakses untuk penerapan cepat |

Dalam situasi di mana daya komputasi terbatas, seperti pada perangkat seluler atau komputasi edge, SLM sering menjadi pilihan yang lebih baik karena memberikan perpaduan kinerja dan efisiensi yang baik.

Lingkungan penerapan

Jika Anda menerapkan AI pada server cloud di mana sumber daya bukan masalah, LLM mungkin menjadi pilihan, terutama jika Anda membutuhkan akurasi dan kefasihan tinggi dalam respons. Namun, jika Anda bekerja pada perangkat dengan daya CPU atau GPU terbatas, seperti perangkat IoT atau aplikasi seluler, SLM adalah pilihan yang tepat.

|

LLM |

SLM |

|

Terbaik untuk lingkungan cloud di mana tersedia banyak daya komputasi |

Dapat digunakan di cloud, tetapi ukurannya yang lebih kecil membuatnya lebih baik untuk tempat dengan sumber daya terbatas. Lebih efisien untuk menangani tugas yang lebih kecil |

|

Tidak ideal untuk AI pada perangkat karena membutuhkan banyak daya komputasi dan bergantung pada koneksi internet |

Sangat cocok untuk AI pada perangkat, memungkinkan penggunaan luring dan waktu respons lebih cepat. Dapat menjalankan asisten seluler, pengenalan suara, dan aplikasi waktu nyata lainnya tanpa koneksi internet |

|

Kurang cocok untuk komputasi edge karena memerlukan banyak daya komputasi dan dapat lambat merespons |

Sangat baik untuk komputasi edge, di mana respons cepat dan penggunaan sumber daya yang efisien penting. Memungkinkan AI di perangkat IoT, rumah pintar, dan aplikasi edge lainnya |

Saat mempertimbangkan lingkungan penerapan, penting untuk mengevaluasi faktor seperti konektivitas internet, persyaratan latensi, dan kekhawatiran privasi. Untuk aplikasi yang perlu berfungsi luring atau dengan latensi minimal, SLM yang diterapkan pada perangkat atau di edge sering kali menjadi pilihan yang lebih baik.

Memilih antara LLM dan SLM bergantung pada kompleksitas tugas, sumber daya yang Anda miliki, dan di mana Anda ingin menerapkannya. LLM sangat baik untuk tugas kompleks yang membutuhkan akurasi tinggi, sementara SLM efisien dan dapat bekerja di lebih banyak tempat.

Kesimpulan

SLM membuat AI jauh lebih mudah diakses. Berbeda dengan large language models yang memerlukan daya komputasi besar, SLM berjalan dengan sumber daya lebih sedikit. Artinya, perusahaan kecil, pengembang individu, dan bahkan startup dapat menggunakannya tanpa memerlukan server besar atau anggaran besar.

Untuk mempelajari lebih lanjut tentang small language models, saya merekomendasikan dua sumber ini:

FAQs

Apa perbedaan spesifik konsumsi energi antara menjalankan SLM dibandingkan LLM untuk aplikasi perusahaan khas?

Perbedaan konsumsi energi antara SLM dan LLM bisa sangat besar. Untuk aplikasi perusahaan khas, SLM mungkin hanya mengonsumsi 10–20% energi yang dibutuhkan LLM. Misalnya, menjalankan SLM untuk chatbot layanan pelanggan dapat menggunakan sekitar 50–100 kWh per bulan, sementara LLM untuk tugas yang sama bisa mengonsumsi 500–1000 kWh. Namun, angka pasti bervariasi berdasarkan ukuran model, pola penggunaan, dan efisiensi perangkat keras. Perusahaan seperti Google dan OpenAI melaporkan bahwa menjalankan model terbesar mereka dapat mengonsumsi energi setara dengan ratusan rumah, sementara SLM sering dapat berjalan pada server standar atau bahkan perangkat edge dengan kebutuhan daya yang jauh lebih rendah.

Bagaimana perbandingan linimasa pengembangan saat membuat SLM kustom dibandingkan fine-tuning LLM yang ada untuk tugas khusus?

Linimasa pengembangan untuk SLM kustom dibandingkan fine-tuning LLM dapat sangat berbeda. Membuat SLM kustom dari nol biasanya memakan waktu lebih lama, sering kali 3–6 bulan bagi tim data scientist berpengalaman, karena melibatkan pengumpulan data, perancangan arsitektur model, pelatihan, dan pengujian ekstensif. Fine-tuning LLM yang ada untuk tugas khusus bisa jauh lebih cepat, berpotensi hanya beberapa minggu. Namun, trade-off-nya adalah LLM yang di-fine-tune mungkin tidak mencapai tingkat efisiensi atau spesialisasi yang sama dengan SLM yang dibangun khusus. Pilihan sering bergantung pada kasus penggunaan spesifik, sumber daya yang tersedia, dan karakteristik kinerja yang diinginkan.

Apa pertimbangan hukum dan etika saat menerapkan SLM dibandingkan LLM, khususnya terkait privasi data dan kekayaan intelektual?

Privasi data adalah perhatian utama, dengan LLM sering memiliki banyak data pelatihan, yang berpotensi meningkatkan risiko paparan informasi pribadi. SLM, yang lebih terfokus, mungkin menggunakan dataset yang lebih kecil dan lebih terkendali, sehingga berpotensi mengurangi risiko privasi. Isu kekayaan intelektual juga krusial, karena LLM yang dilatih pada beragam data internet bisa mereproduksi konten berhak cipta. SLM, yang dilatih pada data yang lebih spesifik, mungkin menghadapi lebih sedikit risiko seperti itu namun masih dapat menemui masalah tergantung data pelatihannya. Selain itu, interpretabilitas dan keterjelasan keputusan model sering lebih mudah dengan SLM, yang bisa sangat penting untuk aplikasi di industri yang diatur ketat.

Bagaimana perbandingan kemampuan multibahasa SLM dan LLM, terutama untuk bahasa yang kurang umum?

SLM dan LLM menangani banyak bahasa dengan cara berbeda, terutama untuk bahasa yang kurang umum. LLM, dengan data pelatihan yang sangat besar, cenderung bekerja baik di banyak bahasa, termasuk yang langka, namun dengan konsekuensi ukuran dan kompleksitas besar. SLM, meski lebih kecil, dapat disesuaikan untuk bahasa atau kelompok bahasa tertentu, terkadang bahkan mengungguli LLM di area tersebut. Untuk bahasa yang kurang umum, SLM yang dilatih khusus dapat memberikan terjemahan atau teks yang lebih akurat dan peka budaya, karena berfokus pada data berkualitas tinggi yang spesifik bahasa, tidak seperti data yang lebih luas namun mungkin kurang presisi yang digunakan LLM.

Apa praktik terbaik untuk kontrol versi dan tata kelola model saat bekerja dengan SLM dibandingkan LLM di lingkungan produksi?

Praktik terbaik untuk pengelolaan versi dan tata kelola model saat mengoperasikan SLM dan LLM di lingkungan produksi memiliki kesamaan namun juga perbedaan penting. Untuk keduanya, penting menjaga sistem versioning yang baik untuk model, data pelatihan, dan pengaturan. Namun, LLM, karena ukurannya dan sensitivitas terhadap fine-tuning, memerlukan infrastruktur yang lebih kompleks untuk kontrol versi. SLM, yang lebih kecil, memudahkan pengelolaan dan penerapan berbagai versi. Dalam hal tata kelola, LLM biasanya memerlukan pengawasan lebih ketat karena cakupan kemampuan yang luas dan potensi perilaku tak terduga. SLM, dengan penggunaan yang lebih spesifik, mungkin memerlukan pengawasan yang lebih ringan namun tata kelola yang lebih terarah. Untuk keduanya, pemeriksaan rutin, pelacakan kinerja, dan dokumentasi yang jelas tentang keterbatasan serta penggunaan yang dimaksud sangat penting untuk penggunaan AI yang bertanggung jawab.

Ana Rojo Echeburúa adalah spesialis AI dan data dengan gelar PhD di Bidang Matematika Terapan. Ia senang mengubah data menjadi wawasan yang dapat ditindaklanjuti dan memiliki pengalaman luas dalam memimpin tim teknis. Ana menikmati bekerja langsung dengan klien untuk menyelesaikan masalah bisnis mereka dan menciptakan solusi AI yang inovatif. Dikenal karena keterampilan pemecahan masalah dan komunikasi yang jelas, ia sangat antusias terhadap AI, terutama AI generatif. Ana berkomitmen pada pembelajaran berkelanjutan dan pengembangan AI yang etis, serta menyederhanakan masalah kompleks dan menjelaskan teknologi dengan cara yang mudah dipahami.