Programma

Docker è diventato lo strumento di containerizzazione più popolare nello sviluppo software moderno, soprattutto all'interno dei flussi di lavoro DevOps e CI/CD. Semplifica il deployment e la gestione delle applicazioni tramite container, consentendo di distribuire software in modo rapido e coerente.

Le sue caratteristiche di scalabilità e flessibilità rendono Docker un requisito per i ruoli legati ai dati come data engineering, MLOps e persino data science. Ecco perché ho raccolto le domande più comuni sui colloqui relativi a Docker, che coprono concetti di base e scenari reali.

Cos'è Docker?

Docker è una piattaforma di container che gli sviluppatori usano per impacchettare applicazioni con tutte le loro dipendenze, così da farle girare senza problemi in ambienti diversi.

Sebbene i container condividano lo stesso kernel del sistema operativo, ognuno opera nel proprio ambiente isolato. Questa configurazione riduce i problemi di compatibilità, diminuisce i ritardi e migliora la comunicazione tra team di sviluppo, test e operations.

Logo di Docker. Fonte immagine

Nel 2023, Docker ha guidato il mercato della containerizzazione con oltre il 32% di quota. Questo evidenzia la sua importanza nello sviluppo software moderno! Ecco perché è probabile che i selezionatori testino la tua competenza su Docker nei colloqui per ruoli legati ai dati.

Domande di base su Docker

Per prima cosa, familiarizza con alcuni concetti fondamentali di Docker. Queste domande di base ti aiuteranno a costruire le fondamenta e a prepararti per la fase iniziale del colloquio.

1. Cos'è un'immagine Docker?

Un'immagine Docker è come un blueprint che crea i container. Contiene tutto ciò di cui uno sviluppatore ha bisogno per eseguire un'applicazione, ad esempio:

- Codice

- Librerie

- Impostazioni

Quando usi un'immagine Docker, Docker la trasforma in un container, che è un ambiente completamente isolato. È lì che l'applicazione gira in modo indipendente.

2. Cos'è un Docker host?

Un Docker host è il sistema su cui installiamo Docker. Funziona come ambiente principale che esegue e gestisce i container Docker. Possiamo configurare un Docker host su un dispositivo locale oppure in un ambiente virtuale o cloud.

3. In cosa si differenziano il client Docker e il demone Docker? Puoi fare un esempio?

Il client Docker e il demone Docker lavorano insieme ma hanno ruoli distinti. Il client Docker è lo strumento che invia i comandi e il demone Docker è il motore che agisce su quei comandi.

Per esempio, se digitiamo il comando docker run per avviare un container, il client prenderà la richiesta e la invierà al demone Docker. Il demone Docker si occuperà quindi del lavoro effettivo avviando il container.

4. Puoi spiegare cos'è il networking di Docker e quali comandi creano una rete bridge e una overlay?

Il networking di Docker consente ai container di connettersi e comunicare con altri container e host. Il comando docker network create ci permette di configurare reti definite dall'utente.

- Rete bridge: Crea una rete locale per la comunicazione tra container sullo stesso Docker host.

- Comando:

docker network create -d bridge my-bridge-network - Questo configura una rete bridge chiamata

my-bridge-networkper i container sullo stesso host. - Rete overlay: Consente la comunicazione tra container su più Docker host, spesso usata in un setup Swarm.

- Comando:

docker network create --scope=swarm --attachable -d overlay my-multihost-network - Questo crea una rete overlay collegabile chiamata

my-multihost-networkper container in esecuzione su host diversi in un Docker Swarm.

5. Spiega come funziona il bridge networking di Docker.

Il bridge networking è la configurazione predefinita che Docker usa per connettere i container. Se non specifichiamo una rete, Docker collega il container alla rete bridge. Questo bridge connette tutti i container sullo stesso Docker host. Ogni container ha un indirizzo IP univoco, che permette ai container di comunicare direttamente.

Domande intermedie su Docker

Queste domande servono a testare la conoscenza di concetti Docker di livello intermedio.

6. Cos'è un Dockerfile? Spiega come lo scriveresti.

Un Dockerfile è uno script che definisce le istruzioni per costruire un'immagine Docker. Ogni comando nel Dockerfile configura una parte specifica dell'ambiente. Quando eseguiamo questi comandi, Docker costruisce un'immagine strato dopo strato. Ecco come possiamo scriverlo:

- Per prima cosa, scegli un'immagine di base. Contiene gli strumenti essenziali per l'app.

- Poi, specifica una working directory all'interno del container. È lì che i file dell'app saranno archiviati ed eseguiti.

- Nel terzo passaggio, usa il comando

COPY . .per copiare tutti i file del progetto nella working directory del container. - Usa il comando

RUNper installare le dipendenze. - Usa il comando

EXPOSEper specificare la porta su cui gira la tua app. - Infine, definisci il comando che Docker deve eseguire quando avvia il container.

Ecco un semplice esempio di Dockerfile per un'applicazione web Python:

# Step 1: Choose a base image

FROM python:3.9-slim

# Step 2: Specify the working directory

WORKDIR /app

# Step 3: Copy project files into the container

COPY . .

# Step 4: Install dependencies

RUN pip install -r requirements.txt

# Step 5: Expose the port the app runs on

EXPOSE 5000

# Step 6: Define the default command

CMD ["python", "app.py"]Usando il Dockerfile qui sopra, puoi creare un'immagine con docker build -t my-python-app . ed eseguire un container con docker run -p 5000:5000 my-python-app.

7. Cos'è Docker Compose e in cosa differisce da un Dockerfile?

Docker Compose è uno strumento per definire e gestire applicazioni Docker multi-container usando un file YAML (docker-compose.yml). Ci permette di configurare servizi, reti e volumi in un unico file, rendendo più semplice la gestione di applicazioni complesse.

Differenze rispetto al Dockerfile:

- Un Dockerfile viene usato per costruire una singola immagine Docker definendone i layer e le dipendenze.

- Docker Compose viene usato per eseguire e orchestrare più container che possono dipendere l'uno dall'altro (ad esempio, un container per la web app e uno per il database).

Per esempio, un file docker-compose.yml può essere simile a questo:

version: '3.9'

services:

web:

build: .

ports:

- "5000:5000"

depends_on:

- db

db:

image: postgres

volumes:

- db-data:/var/lib/postgresql/data

volumes:

db-data:Questo file definisce due servizi, web e db, con configurazioni di rete e volumi.

8. Perché usiamo i volumi in Docker?

Usiamo i volumi Docker per mantenere i dati al sicuro al di fuori dei container. Forniscono una posizione separata sull'host dove i dati restano anche se il container viene rimosso. Inoltre, è più facile gestire, eseguire backup e condividere i volumi tra container.

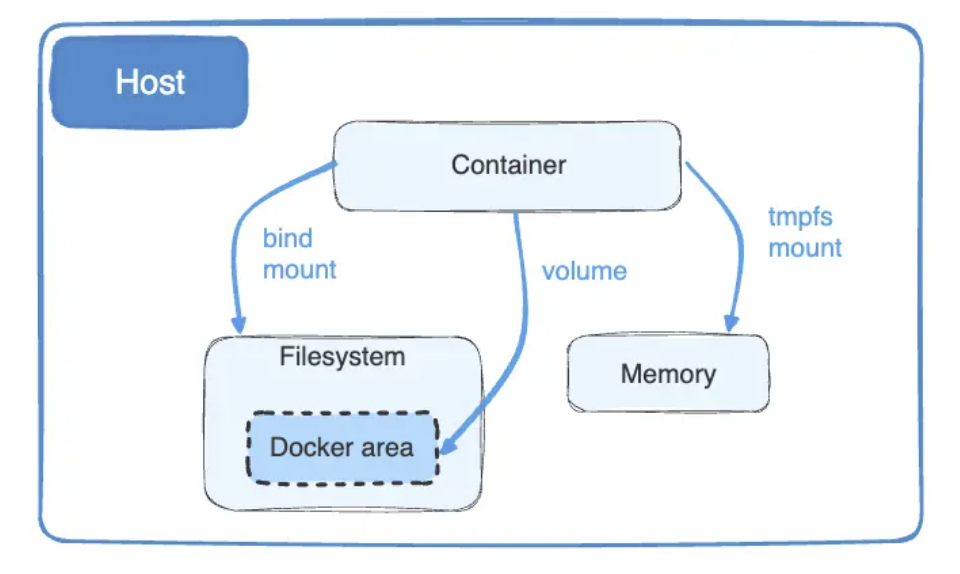

9. Cosa sono i bind mount in Docker e perché preferiamo i volumi ai bind mount?

Con i bind mount di Docker possiamo condividere file tra la macchina host e un container. Collegano un file specifico sul sistema host a una posizione nel container. Se apportiamo modifiche ai file, queste appariranno immediatamente all'interno del container.

I bind mount sono adatti alla condivisione di file in tempo reale — ma dipendono dal sistema operativo dell'host, il che comporta problemi di sicurezza.

Al contrario, poiché i volumi Docker funzionano in modo indipendente, sono più sicuri dei mount.

Diagramma dei bind mount e dei volumi in Docker. Fonte immagine: Docker

10. Cos'è Docker Swarm?

Docker Swarm è uno strumento di orchestrazione che gestisce e distribuisce servizi su un cluster di nodi Docker. Consente alta disponibilità, scalabilità e bilanciamento del carico, permettendo a più host di agire come un unico motore Docker virtuale.

11. Possiamo fare autoscaling con Docker Swarm?

No, Docker Swarm non supporta nativamente l'autoscaling automatico. Per ottenere l'autoscaling, dobbiamo integrare strumenti di monitoraggio e usare script per regolare manualmente il numero di istanze. Ecco come:

- Installa uno strumento di monitoraggio, come Prometheus o Grafana, per tracciare l'utilizzo delle risorse, come CPU e memoria.

- Imposta i trigger di scaling. Per esempio, possiamo definire che un utilizzo CPU oltre l'82% attivi lo scaling verso l'alto.

- Poi scrivi uno script con il comando

docker service scaleper regolare il numero di repliche. Ad esempio, per scalare un servizio a 5 repliche:docker service scale <service_name>=5

Combinando strumenti di monitoraggio, trigger e script, puoi implementare una forma di autoscaling in Docker Swarm, anche se non è integrata di default.

12. Come useresti Docker Compose per scalare i servizi?

Per scalare i servizi con Docker Compose, possiamo usare il flag --scale con il comando docker-compose up. Questo si usa tipicamente per servizi stateless come i web server. Per esempio, per scalare un servizio web a 3 istanze:

docker-compose up --scale web=3

È importante assicurarsi che il file docker-compose.yml abbia i servizi definiti correttamente e usi un bilanciatore di carico esterno o supporti istanze scalate. Scalare servizi stateful (ad es. database) richiede configurazioni aggiuntive per garantire la consistenza dei dati.

13. Un container può riavviarsi da solo? Definisci le policy default e always.

Sì, un container può riavviarsi da solo. Tuttavia, dobbiamo impostare una policy di riavvio per farlo.

Docker ha diverse policy di riavvio che controllano quando e come i container devono riavviarsi. La policy predefinita è no, il che significa che un container non si riavvia se si ferma. Con la policy always, Docker riavvierà automaticamente il container ogni volta che si ferma.

Possiamo applicare la policy always con questo comando:

docker run --restart=always <container-name>

Domande avanzate su Docker

Passiamo ora alle domande avanzate su Docker!

14. Spiega il ciclo di vita dei container Docker.

Un container Docker attraversa un ciclo di vita che definisce gli stati in cui può trovarsi e come opera in tali stati. Le fasi del ciclo di vita di un container Docker sono:

- Create: In questo stato, configuriamo un container a partire da un'immagine con il comando

docker create. - Run: Qui usiamo il comando

docker startper eseguire il container, che svolge i compiti finché non lo fermiamo o mettiamo in pausa. - Pause: Usiamo il comando

docker pauseper fermare il processo. Questo stato mantiene intatti memoria e disco. Se vuoi riprendere il container, usa il comandodocker unpause. - Stop: Se il container è inattivo, entra nella fase di stop, ma ciò può accadere per diversi motivi:

- Stop immediato: Il comando

docker killferma il container senza cleanup. - Completamento del processo: Quando il container termina il compito, si ferma automaticamente.

- Out of memory: Il container si ferma quando consuma troppa memoria.

- Delete: Nella fase finale, rimuoviamo il container arrestato o creato con il comando

docker rm.

15. Cos'è un repository di immagini Docker?

Un repository di immagini Docker archivia e condivide con i client o la community più immagini di container con lo stesso nome. Possiamo etichettarle con tag per differenziarne le varie versioni. Ad esempio, app/marketing_campaign:v1 sarà la prima versione di un'app di marketing e app/marketing_campaign:v2 la seconda versione.

Docker Hub, il repository di immagini Docker più popolare, consente agli utenti di ospitare, condividere e scaricare immagini di container pubblicamente o privatamente. Altre alternative includono Amazon ECR, Google Artifact Registry e GitHub Container Registry.

16. Parlami di 3 best practice per mantenere sicuro un container Docker.

Per migliorare la sicurezza dei container e ridurre al minimo le vulnerabilità comuni, seguo queste best practice:

- Scegli immagini leggere: Usa immagini di base minimali come Alpine per ridurre la superficie di attacco.

- Limita le system call: Poiché i container Docker possono accedere a chiamate non necessarie, usa strumenti come Seccomp per limitarle.

- Proteggi i dati sensibili: Usa Docker secrets per gestire API key o password. Criptano i secret e li rendono disponibili solo a runtime.

17. Perché i container Docker hanno bisogno di health check?

I container Docker si basano su health check per assicurare che funzionino correttamente. Distribuire un container che è in esecuzione ma non elabora richieste può creare problemi per i team di deployment. Gli health check monitorano questi problemi in tempo reale e ci informano immediatamente.

Per esempio, un health check può essere aggiunto in un Dockerfile così:

HEALTHCHECK --interval=30s --timeout=10s --retries=3 CMD curl -f http://localhost:8080/health || exit 1

Questo health check interroga l'endpoint di salute del container ogni 30 secondi e contrassegna il container come unhealthy se fallisce tre tentativi consecutivi. Questo monitoraggio proattivo aiuta a identificare e risolvere rapidamente i problemi.

18. Cosa sono le immagini dangling in Docker e come le rimuovi?

Le immagini dangling in Docker sono layer di immagine inutilizzati che non hanno più alcun tag associato. Spesso si accumulano quando crei nuove immagini con lo stesso nome e tag, lasciando i vecchi layer senza riferimenti. Queste immagini possono consumare molto spazio su disco, quindi è importante pulirle. Ecco come:

- Esegui il comando

docker images -f dangling=trueper trovare le immagini dangling. - Poi esegui il comando

docker image prune -fper eliminare tutte le immagini in un colpo solo. - Se vuoi rimuovere le immagini manualmente, usa il comando

docker rmi -f $(docker images -f dangling=true -q).

Questi passaggi aiutano a mantenere il sistema pulito e liberare spazio in modo efficiente.

Domande su Docker e Kubernetes

Docker e Kubernetes sono spesso usati insieme, quindi non sarebbe sorprendente trovare alcune domande su Kubernetes in un colloquio su Docker, soprattutto se il ruolo è orientato al DevOps. Ecco alcune domande che potresti ricevere:

19. Qual è la principale differenza tra Docker e Kubernetes?

Docker è una piattaforma di containerizzazione che ti permette di creare, distribuire ed eseguire container. Si concentra sulla creazione e gestione di singoli container.Kubernetes, invece, è una piattaforma di orchestrazione progettata per gestire più container su larga scala. Gestisce deployment, scaling, bilanciamento del carico e self-healing su cluster di nodi.

Scopri di più sulle differenze nel post Kubernetes vs Docker.

20. Confronta Docker Swarm con Kubernetes.

Kubernetes e Docker Swarm gestiscono i container, ma funzionano in modo diverso:

- Kubernetes gestisce ambienti containerizzati grandi e complessi. Le sue funzionalità di self-healing e monitoraggio integrato lo rendono più adatto a contesti complessi.

- Docker Swarm è adatto a setup più piccoli o meno complessi, poiché non offre le funzionalità integrate di Kubernetes. Si integra facilmente con gli strumenti Docker come Docker CLI e Docker Compose.

21. Come gestisce Kubernetes un gran numero di container Docker?

Mentre Docker è ottimo per creare ed eseguire container, per gestirne un gran numero serve Kubernetes. Kubernetes orchestra i container in modo efficiente:

- Impostando limiti di risorse: assegna CPU, memoria e altre risorse a ciascun container per evitare sovraconsumo.

- Schedulando i container: decide dove eseguire ciascun container, ottimizzando l'uso delle risorse tra i nodi in un cluster.

- Scalando automaticamente: in base al carico di lavoro, scala i pod (gruppi di uno o più container) verso l'alto o verso il basso per mantenere prestazioni ed efficienza.

Automatizzando questi processi, Kubernetes assicura un funzionamento fluido anche quando gestisce migliaia di container. Pur potendo verificarsi errori occasionali, le sue capacità di self-healing, come il riavvio dei container falliti, riducono al minimo le interruzioni.

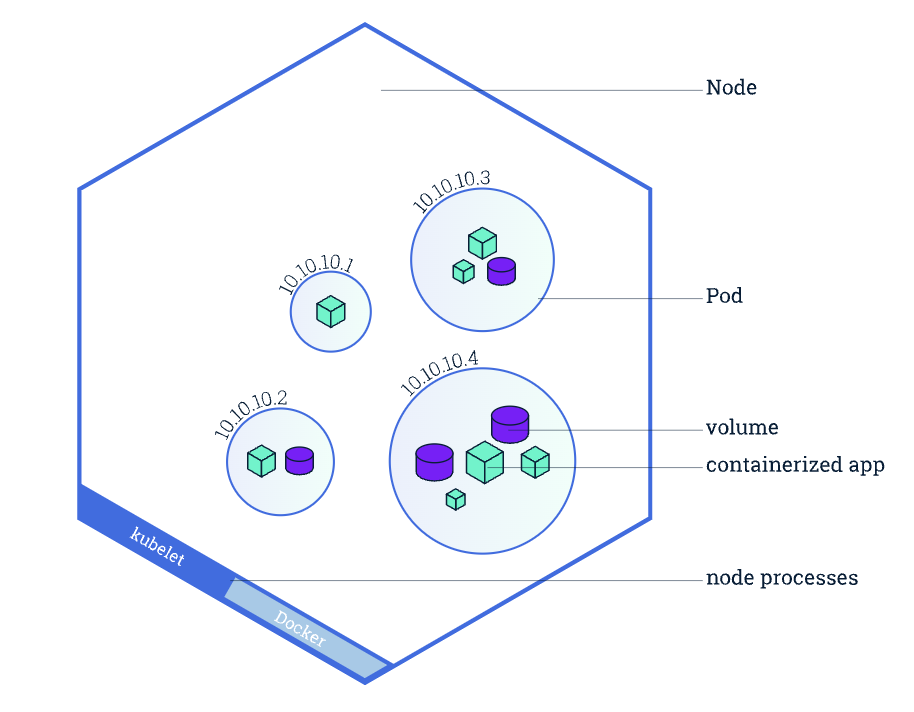

22. Cos'è un Pod in Kubernetes e in cosa differisce da un container?

Un Pod è la più piccola unità distribuibile in Kubernetes e rappresenta un gruppo di uno o più container che condividono lo stesso namespace di rete, lo storage e la configurazione.A differenza dei singoli container, i Pod permettono a più container strettamente accoppiati di lavorare insieme come un'unica unità (ad es., un web server e un sidecar per il logging).

Panoramica di un nodo Kubernetes, con evidenza di pod e container. Fonte immagine: Kubernetes.

23. Come puoi gestire dati sensibili come password in Docker e Kubernetes?

- In Docker: possiamo usare i Docker secrets, che criptano i dati sensibili e li rendono accessibili solo ai container autorizzati a runtime.

- In Kubernetes: usiamo gli oggetti Secrets, che archiviano dati sensibili come password, token e API key. I Secret possono essere montati come volumi o esposti come variabili d'ambiente ai pod in modo sicuro.

Esempio in Kubernetes:

apiVersion: v1

kind: Secret

metadata:

name: my-secret

type: Opaque

data:

password: cGFzc3dvcmQ= # Base64-encoded "password"Domande su Docker basate su scenari

L'intervistatore pone domande basate su scenari e sulla risoluzione dei problemi per testare come affronti situazioni reali. Vediamo alcune domande per darti un'idea:

24. Immagina di creare un'immagine di un'API basata su Maven. Hai già configurato il Dockerfile con le impostazioni di base. Ora noti che la dimensione dell'immagine è grande. Come la ridurresti?

Risposta di esempio:

Per ridurre la dimensione di un'immagine Docker per un'API basata su Maven, seguirei questi passaggi:

Crea un file .dockerignore nella directory del progetto per specificare file e cartelle da escludere dal contesto di build di Docker. Questo evita che file non necessari vengano aggiunti all'immagine, riducendone le dimensioni. Per esempio, aggiungerei quanto segue a .dockerignore:

.git # Version control files

target # Compiled code and build artifacts

.idea # IDE configuration filesOttimizza il Dockerfile usando build multi-stage. Compilerei il progetto Maven in uno stage e copierei solo gli artefatti necessari (ad es., i file JAR compilati) nello stage finale per mantenere l'immagine piccola. Esempio di Dockerfile con build multi-stage:

# Stage 1: Build the application

FROM maven:3.8.5-openjdk-11 AS build

WORKDIR /app

COPY pom.xml .

COPY src ./src

RUN mvn clean package

# Stage 2: Create a lightweight runtime image

FROM openjdk:11-jre-slim

WORKDIR /app

COPY --from=build /app/target/my-api.jar .

CMD ["java", "-jar", "my-api.jar"]Ignorando i file non necessari e usando build multi-stage, si può ridurre significativamente la dimensione dell'immagine mantenendo l'efficienza.

25. Immagina di dover inviare un'immagine di container Docker su Docker Hub con Jenkins. Come lo faresti?

Risposta di esempio:

Ecco come invierei un'immagine di container Docker su Docker Hub con Jenkins:

- Configura una pipeline Jenkins: crea un job di pipeline multi-branch in Jenkins e collegalo al repository che contiene Dockerfile e Jenkinsfile.

- Definisci la pipeline nel mio Jenkinsfile: il

Jenkinsfileincluderà i seguenti passaggi: - Build dell'immagine Docker

- Login a Docker Hub (usando credenziali archiviate in modo sicuro in Jenkins)

- Push dell'immagine su Docker Hub

- Esegui la pipeline: attiva il job Jenkins. Compilerà l'immagine, effettuerà il login a Docker Hub e invierà automaticamente l'immagine.

26. Immagina di dover migrare un container Docker di WordPress su un nuovo server senza perdere dati. Come lo faresti?

Risposta di esempio:

Ecco come migrerei un container Docker di WordPress:

- Esegui il backup dei dati di WordPress: esporta i dati persistenti del container (file di WordPress e database). Userei

docker cpo uno strumento di backup dei volumi per salvare i volumi necessari, in genere la directoryhtmlper i file di WordPress e il volume del database. - Trasferisci i file di backup: userei

scpper copiare in modo sicuro i file di backup sul nuovo server. - Configura WordPress sul nuovo server: distribuirei un nuovo container WordPress e un container database sul nuovo server.

- Riavvia e verifica: infine, riavvierei i container per applicare le modifiche e verificherei che il sito WordPress funzioni correttamente.

Eseguendo il backup dei volumi e ripristinandoli su un nuovo server, si può migrare WordPress senza perdere dati. Questo metodo evita la dipendenza da estensioni specifiche e offre maggiore controllo sul processo di migrazione.

Consigli per prepararsi a un colloquio su Docker

Se stai leggendo questa guida, hai già fatto un passo importante per eccellere nel tuo prossimo colloquio! Ma per chi parte da zero, prepararsi può essere travolgente. Ecco perché ho messo insieme alcuni consigli:

Padroneggia le basi di Docker

Per eccellere in un colloquio su Docker, inizia con una solida comprensione dei concetti chiave.

- Scopri come le immagini Docker fungono da blueprint per i container e fai pratica nel creare, eseguire e gestire container per familiarizzare con i loro ambienti leggeri e isolati.

- Esplora i volumi Docker per gestire efficacemente i dati persistenti e approfondisci il networking sperimentando con reti bridge, host e overlay per facilitare la comunicazione tra container.

- Studia i Dockerfile per capire come vengono create le immagini, concentrandoti su istruzioni chiave come

FROM,RUNeCMD. - Inoltre, fai pratica con Docker Compose per gestire applicazioni multi-container e comprendi come i registry Docker, come Docker Hub, archiviano e condividono le immagini.

DataCamp offre molte altre risorse per guidarti lungo il tuo percorso di apprendimento:

- Per concetti introduttivi su Docker: Corso Introduction to Docker

- Per concetti intermedi su Docker: Corso Intermediate Docker

- Per imparare containerizzazione e virtualizzazione: Corso Containerization and Virtualization Concepts

Fai pratica concreta con Docker

Una volta appresi gli argomenti essenziali di Docker, è il momento di metterti alla prova con lavori pratici. Ecco 10 ottime idee di progetti Docker per principianti e profili più avanzati. Durante questi progetti, usa la cheat sheet di Docker di DataCamp per avere i comandi chiave sempre a portata di mano.

Documenta la tua esperienza

Preparati a raccontare la tua esperienza con Docker nei colloqui. Prepara esempi di:

- Progetti: metti in evidenza le applicazioni containerizzate che hai costruito o a cui hai contribuito.

- Sfide: descrivi i problemi che hai incontrato, come il debug dei container o l'ottimizzazione delle immagini, e come li hai risolti.

- Ottimizzazione: condividi come hai migliorato i tempi di build, ridotto le dimensioni delle immagini o semplificato i flussi di lavoro con Docker Compose.

- Collaborazione: se hai lavorato in team, spiega come hai usato Docker per migliorare collaborazione, test o processi di deployment.

I tuoi esempi reali dimostreranno conoscenze pratiche e capacità di problem solving!

Conclusione

Mentre ti prepari al colloquio, ricorda che queste domande sono un punto di partenza. Sebbene memorizzare le risposte possa aiutare, i selezionatori apprezzano candidati che dimostrano esperienza pratica e una profonda comprensione dei concetti di containerizzazione. Dovresti esercitarti a implementare questi concetti in scenari reali e costruire i tuoi progetti.

Se sei un principiante, inizia dal nostro corso Introduction to Docker. Alla fine, il successo nel colloquio arriverà combinando conoscenze teoriche, esperienza pratica e la capacità di spiegare il tuo approccio alla risoluzione dei problemi!

FAQ

Devo imparare Kubernetes per usare Docker?

No, non devi imparare Kubernetes per usare Docker. Docker svolge un lavoro completamente diverso rispetto a Kubernetes. Si usa per creare, eseguire e gestire container su una singola macchina.

Docker richiede di saper programmare?

No, non servono competenze di programmazione per usare Docker. Conoscere le basi della riga di comando, i file YAML e la documentazione di Docker è sufficiente per svolgere la maggior parte dei compiti. Ma devi imparare come funzionano i comandi Linux e il networking.

Quanto tempo ci vorrà per prepararsi al colloquio su Docker?

Se ti dedichi completamente, prepararti per un colloquio su Docker può richiedere da 3 a 4 settimane. Dedica almeno una settimana alle basi di Docker. Poi passa a Docker Compose e ai setup multi-container. Nelle ultime 2 settimane, concentrati sulle build multi-stage e sull'ottimizzazione dei container. Inoltre, crea un portfolio con esempi reali.

Sono una content strategist: mi piace semplificare argomenti complessi. Ho aiutato aziende come Splunk, Hackernoon e Tiiny Host a creare contenuti coinvolgenti e informativi per il loro pubblico.