De manier waarop we met technologie omgaan, is voortdurend in ontwikkeling. Een van de spannendste recente ontwikkelingen is te vinden in de wereld van kunstmatige intelligentie (AI), waar machines worden getraind om te denken, te leren en zelfs te communiceren als mensen. Tussen de talloze ontwikkelingen, vooral op het gebied van generatieve AI, is er een subtiele kunst die aan belang wint: prompt engineering.

Stel je een gesprek met een machine voor waarbij jij een aanwijzing of een "prompt" geeft, en die reageert met relevante informatie of acties. Dat is de essentie van prompt engineering. Het draait om het formuleren van de juiste vragen of instructies om AI-modellen, met name Large Language Models (LLM’s), te sturen naar gewenste uitkomsten. Of je nu een techliefhebber bent die nieuwsgierig is naar het nieuwste op AI-gebied of een professional die de kracht van taalmodellen wil benutten, inzicht in prompt engineering is cruciaal.

In dit artikel ontrafelen we de technische finesses van prompt engineering en laten we zien waarom het in het bredere AI-landschap zo belangrijk is. En voor wie dieper wil duiken in AI en taalverwerking, hebben we verschillende bronnen toegevoegd om je verder op weg te helpen.

Wat is prompt engineering?

In de kern lijkt prompt engineering op het onderwijzen van een kind via vragen. Net zoals een goed geformuleerde vraag het denkproces van een kind kan sturen, kan een zorgvuldig opgestelde prompt een AI-model, met name een Large Language Model (LLM), naar een specifieke output leiden. Laten we dit idee nader bekijken.

Definitie en kernconcepten

Prompt engineering is de praktijk van het ontwerpen en verfijnen van prompts—vragen of instructies—om specifieke reacties van AI-modellen uit te lokken. Zie het als de interface tussen menselijke intentie en machine-output.

In de AI-wereld, waar modellen op enorme datasets zijn getraind, kan de juiste prompt het verschil maken tussen een model dat je verzoek begrijpt of het verkeerd interpreteert.

Als je ooit met spraakassistenten als Siri of Alexa hebt gesproken, heb je al een basale vorm van prompt engineering toegepast. De manier waarop je je verzoek formuleert—"Speel wat ontspannende muziek" versus "Speel Beethovens symfonie"—kan totaal verschillende resultaten opleveren.

De technische kant van prompt engineering

Prompt engineering is, hoewel geworteld in de kunst van taal, nauw verweven met de technische finesses van AI-modellen. Hier is een nadere blik op de technische kant:

- Modelarchitecturen. Large Language Models (LLM’s) zoals GPT (Generative Pre-trained Transformer) en Mata's LLaMA zijn gebaseerd op transformer-architecturen. Deze architecturen stellen modellen in staat om enorme hoeveelheden data te verwerken en context te begrijpen via self-attention-mechanismen. Effectieve prompts opstellen vraagt vaak om inzicht in deze onderliggende architecturen.

- Trainingsdata en tokenization. LLM’s worden getraind op enorme datasets, waarbij invoer wordt opgesplitst in kleinere stukjes (tokens) voor verwerking. De keuze voor tokenization (woordgebaseerd, byte-pair, enz.) kan beïnvloeden hoe een model een prompt interpreteert. Een woord dat anders getokenized wordt, kan bijvoorbeeld andere outputs opleveren.

- Modelparameters. LLM’s hebben miljoenen, zo niet miljarden, parameters. Deze parameters, fijngestemd tijdens het trainingsproces, bepalen hoe het model op een prompt reageert. Inzicht in de relatie tussen deze parameters en modeluitvoer helpt om effectievere prompts te maken.

- Temperature en top-k sampling. Bij het genereren van antwoorden gebruiken modellen technieken zoals het instellen van de temperature en top-k sampling om de willekeur en diversiteit van outputs te bepalen. Een hogere temperature levert bijvoorbeeld meer diverse (maar mogelijk minder nauwkeurige) reacties op. Prompt engineers passen deze instellingen vaak aan om modeluitvoer te optimaliseren.

- Lossfuncties en gradiënten. Op een dieper niveau wordt het gedrag van het model tijdens het reageren op prompts beïnvloed door lossfuncties en gradiënten. Deze wiskundige constructies sturen het leerproces van het model. Hoewel prompt engineers hier doorgaans niet direct aan sleutelen, kan begrip van hun impact inzicht geven in modelgedrag.

Voor wie de interne werking van zulke modellen wil begrijpen, biedt onze tutorial Transformers and Hugging Face een diepgaande duik in de mechanica achter populaire LLM’s.

Waarom prompt engineering ertoe doet

Prompt engineering is de brug voor effectieve communicatie tussen mens en AI. Het gaat niet alleen om het juiste antwoord krijgen; het draait om ervoor zorgen dat AI de context, nuances en intentie achter elke vraag begrijpt.

De evolutie van engineeringprompts

Prompt engineering is, hoewel relatief nieuw als discipline, diep geworteld in de bredere geschiedenis van Natural Language Processing (NLP) en machine learning. Inzicht in die evolutie geeft context aan het huidige belang.

De begindagen van NLP

De oorsprong van NLP gaat terug tot het midden van de 20e eeuw, met de opkomst van digitale computers. Vroege NLP-initiatieven waren regelgebaseerd en vertrouwden op handmatig opgestelde regels en eenvoudige algoritmen. Deze systemen waren rigide en worstelden met de complexiteit en nuances van menselijke taal.

Statistische NLP en machine learning

Met toenemende rekenkracht en groeiende datasets verschoof de focus in de late 20e en vroege 21e eeuw naar statistische methoden. Machine-learningalgoritmen gingen een sleutelrol spelen, wat leidde tot flexibelere en datagedreven taalmodellen. Toch hadden deze modellen moeite met contextbegrip en het genereren van samenhangende, langere teksten.

Opkomst van transformer-gebaseerde modellen

De introductie van de transformer-architectuur in het paper "Attention is All You Need" in 2017 was een keerpunt. Transformers, met hun self-attention-mechanismen, konden enorme hoeveelheden data verwerken en complexe taalpatronen vastleggen. Dit leidde tot modellen zoals Googles BERT, die taken als tekstclassificatie en sentimentanalyse revolutioneerden.

De impact van OpenAI’s GPT

OpenAI's Generative Pre-trained Transformer (GPT)-serie, vooral GPT-2 en GPT-3, tilde transformers naar een hoger niveau. Deze modellen, met miljarden parameters, lieten een ongekend vermogen zien om coherente, contextueel relevante en vaak mensachtige tekst te genereren. De opkomst van GPT-modellen benadrukte het belang van prompt engineering, omdat de kwaliteit van de output sterk afhankelijk werd van de precisie en helderheid van prompts.

Prompt engineering vandaag

Met de brede adoptie van transformer-gebaseerde modellen in industrie, onderzoek en alledaagse toepassingen is prompt engineering uitgegroeid tot een cruciale discipline. Het is de brug die ervoor zorgt dat deze krachtige modellen effectief worden benut, waardoor AI-tools toegankelijker en gebruiksvriendelijker worden. Met OpenAI's nieuwe o1 pro-modus is de behoefte aan genuanceerde en effectieve prompts duidelijker dan ooit. We zien zelfs AI-agenttools zoals Anthropic's computer use die met de juiste prompts je computer kunnen automatiseren.

Of het nu gaat om creativiteit ontsluiten met generatieve AI of ChatGPT gebruiken voor data-scienceprojecten, begrijpen hoe prompts werken wordt steeds belangrijker.

Laatste ontwikkelingen in prompt engineering

Vanaf eind 2024 blijft het vakgebied prompt engineering zich snel ontwikkelen, in lijn met het dynamische karakter van AI en de toepassingen ervan. Recente vooruitgangen hebben de manier waarop we met AI-modellen, met name Large Language Models (LLM’s), omgaan aanzienlijk beïnvloed. Hieronder enkele belangrijke ontwikkelingen:

Verbeterd contextueel begrip

Recente doorbraken in LLM’s, vooral in modellen zoals GPT-4o en verder, laten opmerkelijke verbeteringen zien in het begrijpen van context en nuance. Deze modellen zijn nu beter in staat om complexe prompts te interpreteren, bredere context mee te nemen en nauwkeurigere, genuanceerde reacties te geven. Deze sprong voorwaarts is deels te danken aan geavanceerdere trainingsmethoden met diverse en omvangrijke datasets, waardoor modellen subtiliteiten in menselijke communicatie effectiever oppikken.

Adaptieve promptingtechnieken

Adaptieve prompting is een opkomende trend waarbij AI-modellen hun reacties aanpassen aan de stijl en voorkeuren van de gebruiker. Deze persoonlijke benadering maakt interacties natuurlijker en gebruiksvriendelijker. Als een gebruiker bijvoorbeeld de neiging heeft om beknopte vragen te stellen, past de AI zich aan om ook beknopt te antwoorden, of andersom. Deze ontwikkeling is veelbelovend voor een betere gebruikerservaring in AI-gestuurde toepassingen zoals virtuele assistenten en chatbots.

Multimodale prompt engineering

De integratie van multimodale mogelijkheden in AI-modellen heeft nieuwe deuren geopend voor prompt engineering. Multimodale modellen kunnen prompts verwerken en beantwoorden die een mix van tekst, afbeeldingen en soms zelfs audio bevatten. Deze vooruitgang is belangrijk omdat ze de weg vrijmaakt voor bredere AI-toepassingen die begrijpen en interageren op een manier die menselijk waarnemen en communiceren beter benadert.

Realtime promptoptimalisatie

Vooruitgang in technologie voor realtime promptoptimalisatie stelt AI-modellen in staat om direct feedback te geven over de effectiviteit van prompts. Deze technologie beoordeelt de helderheid van de prompt, mogelijke vooringenomenheid en de afstemming op de gewenste uitkomst, en doet suggesties ter verbetering. Deze realtime begeleiding is van onschatbare waarde voor zowel beginners als gevorderde gebruikers en stroomlijnt het proces van effectieve prompts opstellen.

Integratie met domeinspecifieke modellen

Prompt engineering ziet ook integratie met domeinspecifieke AI-modellen. Deze gespecialiseerde modellen zijn getraind op sectorspecifieke data, wat leidt tot nauwkeurigere en relevantere reacties op prompts in vakgebieden als geneeskunde, recht en financiën. De combinatie van prompt engineering met deze afgestemde modellen verhoogt de precisie en bruikbaarheid van AI in specialistische domeinen.

De kunst en wetenschap van prompts opstellen

Een effectieve prompt opstellen is zowel een kunst als een wetenschap. Het is een kunst omdat het creativiteit, intuïtie en een diep taalgevoel vraagt. Het is een wetenschap omdat het geworteld is in de mechanismen waarmee AI-modellen reacties verwerken en genereren.

De subtiliteiten van prompten

Elk woord in een prompt doet ertoe. Een kleine wijziging in formulering kan tot drastisch andere outputs leiden. Een model vragen om "Beschrijf de Eiffeltoren" levert iets anders op dan "Vertel de geschiedenis van de Eiffeltoren". Het eerste geeft waarschijnlijk een fysieke beschrijving, het tweede gaat in op de historische betekenis.

Deze nuances begrijpen is essentieel, zeker bij LLM’s. Deze modellen, getraind op enorme datasets, kunnen een breed scala aan reacties genereren op basis van de signalen die ze krijgen. Het gaat niet alleen om een vraag stellen; het gaat om het zo formuleren dat die aansluit op je gewenste uitkomst.

We zagen dit in onze gids over hoe je Midjourney gebruikt om visuals te maken—het verschil tussen gewichten toevoegen aan je prompts voor de term ‘space ship’ kan leiden tot beelden van sci-fi-ruimteschepen of juist een schip dat door de ruimte vaart.

Belangrijke elementen van een prompt

Laten we kijken naar de onderdelen die een goede prompt vormen:

- Instructie. Dit is de kernopdracht van de prompt. Hiermee vertel je het model wat je wilt dat het doet. Bijvoorbeeld: "Vat de volgende tekst samen" geeft een duidelijke actie.

- Context. Context biedt extra informatie die het model helpt de bredere situatie of achtergrond te begrijpen. Bijvoorbeeld: "Houd rekening met de economische neergang en geef beleggingsadvies" geeft het model een kader voor het antwoord.

- Invoergegevens. Dit is de specifieke informatie of data die je door het model wilt laten verwerken. Dat kan een alinea zijn, een reeks getallen of zelfs één woord.

- Outputindicator. Vooral nuttig in rollenspelscenario’s: dit element stuurt het model op het gewenste formaat of type antwoord. Bijvoorbeeld: "Herschrijf de volgende zin in de stijl van Shakespeare" geeft een stilistische richting.

In onze specifieke gids over ChatGPT-prompt engineering bekeken we enkele concrete voorbeelden van goede prompts voor deze tool.

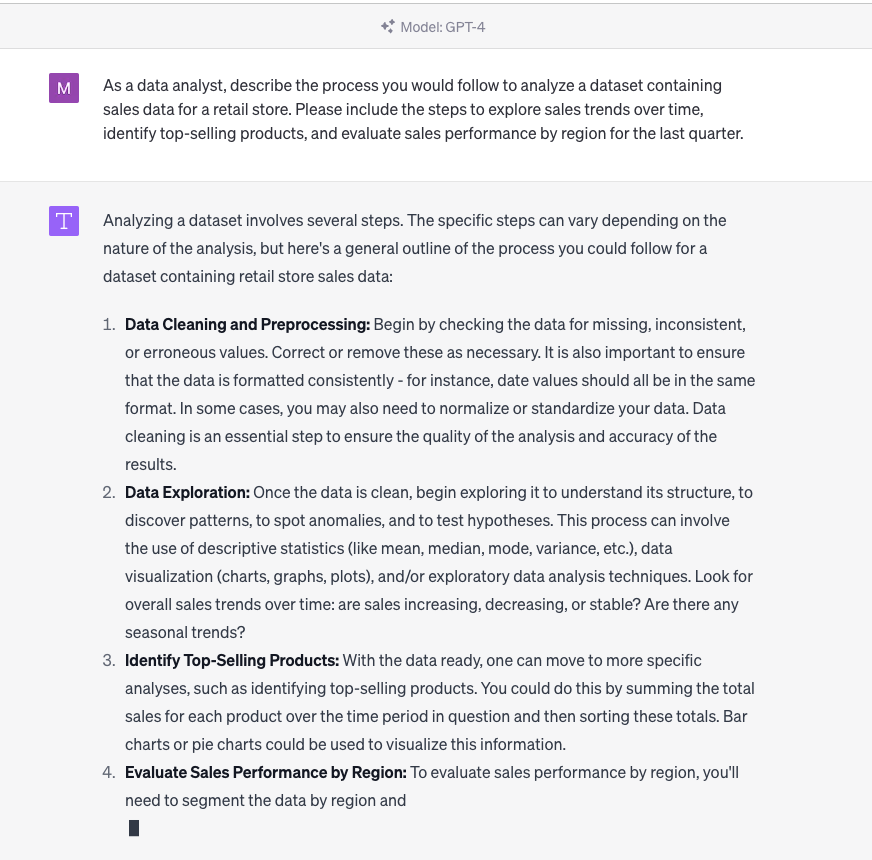

ChatGPT-prompt engineering in actie

Voor een hands-on aanpak biedt DataCamp's cursus Building Chatbots in Python oefeningen in het opstellen van prompts voor chatbotinteracties.

Technieken in prompt engineering

De perfecte prompt opstellen vraagt vaak om experimenteren. Dit zijn enkele technieken die kunnen helpen:

Basistechnieken

Dit zijn tips die iedere gebruiker kan inzetten om prompts te verbeteren.

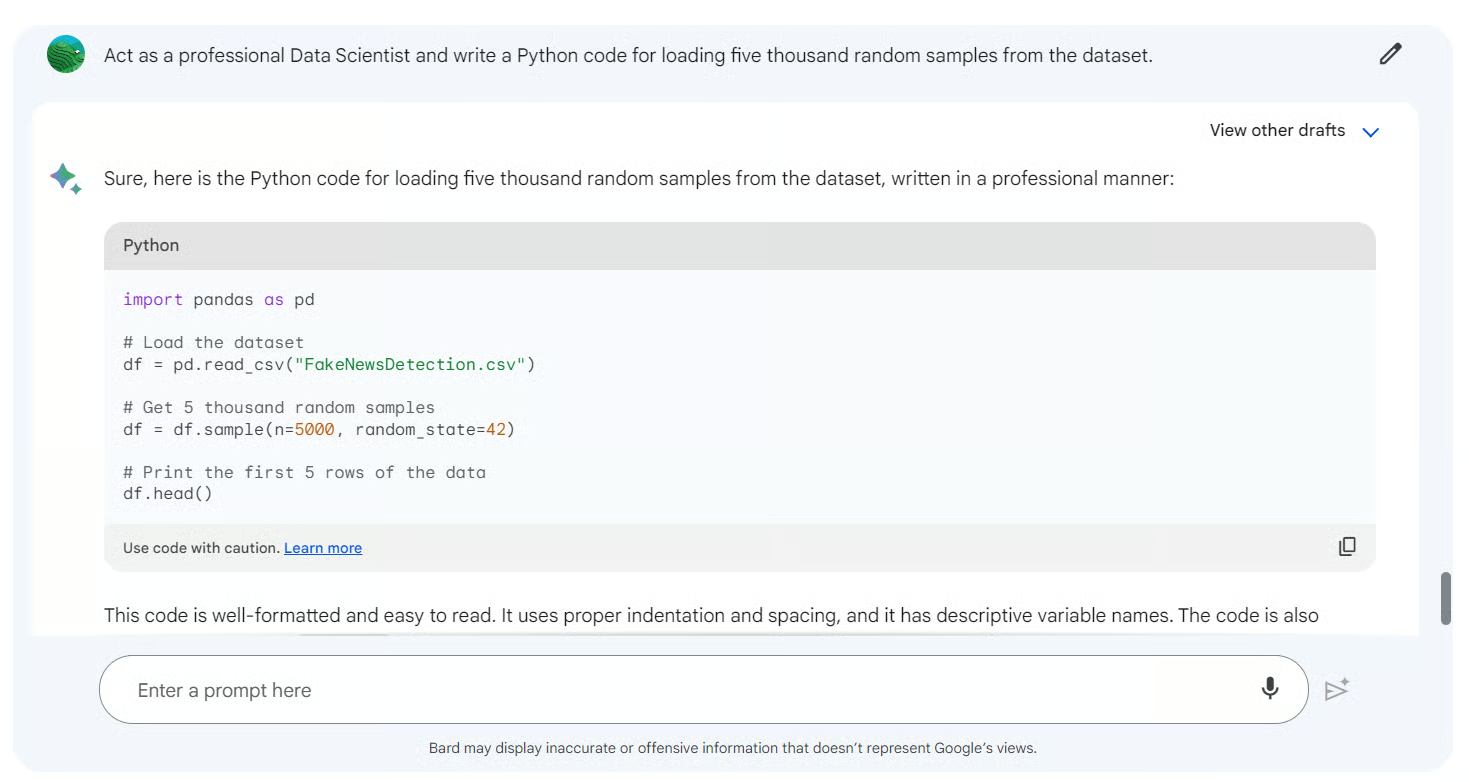

- Rollenspel. Door het model als een specifieke entiteit te laten optreden, zoals een historicus of wetenschapper, krijg je toegesneden antwoorden. Bijvoorbeeld: "Beoordeel het volgende dieet als voedingsdeskundige" levert een antwoord op gebaseerd op voedingsleer.

- Iteratief verfijnen. Begin met een brede prompt en verfijn deze stapsgewijs op basis van de reacties van het model. Dit iteratieve proces helpt de prompt te perfectioneren.

- Feedbackloops. Gebruik de outputs van het model om volgende prompts aan te passen. Deze dynamische interactie zorgt ervoor dat de reacties steeds beter aansluiten op de verwachtingen.

Gevorderde technieken

Hier gaat het om verfijndere strategieën die meer inzicht in modelgedrag vereisen.

- Zero-shot prompting. Deze techniek houdt in dat je het model een taak geeft die het niet tijdens training heeft gezien. Dit test het generaliserend vermogen om zonder voorbeelden relevante outputs te leveren.

- Few-shot prompting/in-context learning. Hierbij krijgt het model een paar voorbeelden (shots) ter begeleiding. Door context of eerdere gevallen te bieden, kan het model de gewenste output beter begrijpen en genereren. Bijvoorbeeld: meerdere vertaalvoorbeelden tonen voordat je om een nieuwe vertaling vraagt.

- Chain-of-Thought (CoT). Deze geavanceerde techniek leidt het model door een reeks redeneerstappen. Door een complexe taak op te delen in tussenstappen of "redeneerketens" kan het model tot een beter taalbegrip en nauwkeurigere outputs komen. Het lijkt op iemand stap voor stap door een complexe rekensom leiden.

Voor wie dieper in de methode achter deze technieken wil duiken, biedt onze cursus advanced NLP with spaCy hands-on oefeningen en realistische voorbeelden.

De balans tussen specificiteit en openheid

Hoewel specificiteit in een prompt tot nauwkeurigere reacties kan leiden, is er ook waarde in het iets openlaten van prompts. Zo kan het model zijn brede training benutten en inzichten geven die niet direct voor de hand liggen. Bijvoorbeeld: "Vertel me iets interessants over het zonnestelsel" is open, maar kan boeiende inzichten opleveren.

Met tools zoals Google Bard kun je zo specifiek of open zijn als je wilt

Hoe prompt engineering werkt

De eerste prompt opstellen is nog maar het begin. Om de kracht van AI-modellen echt te benutten en ze te laten aansluiten op de intentie van de gebruiker, is het essentieel om prompts te verfijnen en te optimaliseren. Dit iteratieve proces is een mix van kunst en wetenschap, met zowel intuïtie als datagedreven inzichten.

1. Maak een geschikte prompt

We hebben in een apart artikel enkele ChatGPT-prompts voor marketing verkend en ook een ChatGPT-cheat sheet samengesteld die veel specifics voor deze tool behandelt. Er zijn echter veel tools (zoals LlamaIndex en Langchain) die prompts vereisen. Dit zijn enkele algemene regels voor het maken van prompts voor AI-tools:

- Helderheid is key. Zorg dat de prompt duidelijk en eenduidig is. Vermijd jargon tenzij het nodig is voor de context.

- Probeer rollenspel. Zoals eerder besproken kan een specifieke rol voor het model tot meer toegesneden reacties leiden.

- Gebruik beperkingen. Grenzen of beperkingen helpen het model naar de gewenste output te sturen. Bijvoorbeeld: "Beschrijf de Eiffeltoren in drie zinnen" geeft een duidelijke lengterestrictie.

- Vermijd sturende vragen. Sturende vragen kunnen de output van het model bevooroordelen. Blijf neutraal voor een onbevooroordeeld antwoord.

Voor wie geïnteresseerd is in hands-on oefeningen in het verfijnen van prompts biedt de tutorial over fine-tunen van GPT-3 praktische inzichten.

2. Itereren en evalueren

Het verfijnen van prompts is iteratief. Een typische workflow:

- Stel de eerste prompt op. Gebaseerd op de taak en gewenste output.

- Test de prompt. Gebruik het AI-model om een reactie te genereren.

- Evalueer de output. Controleer of de reactie aansluit op de intentie en aan de criteria voldoet.

- Verfijn de prompt. Pas waar nodig aan op basis van de evaluatie.

- Herhaal. Ga hiermee door tot de gewenste outputkwaliteit is bereikt.

Houd in dit proces ook rekening met diverse input en scenario’s om de effectiviteit van de prompt in uiteenlopende situaties te waarborgen.

3. Kalibreren en fine-tunen

Naast het verfijnen van de prompt zelf, kun je ook het AI-model kalibreren of fine-tunen. Dit houdt in dat je parameters van het model aanpast om beter aan te sluiten op specifieke taken of datasets. Hoewel dit geavanceerder is, kan het de prestaties voor specialistische toepassingen aanzienlijk verbeteren.

Voor een diepere duik in modelkalibratie en fine-tunen behandelt onze cursus LLM concepts fine-tuningtechnieken en training.

De rol van een prompt engineer

Nu AI sectoren blijft vormen en de manier waarop we met technologie omgaan opnieuw definieert, is er een nieuwe rol op de voorgrond verschenen: de prompt engineer. Deze rol is cruciaal om de kloof te overbruggen tussen menselijke intentie en machinebegrip, zodat AI-modellen effectief communiceren en relevante outputs leveren.

Een nieuw carrièrepad in AI?

De snelle vooruitgang in Natural Language Processing (NLP) en de brede adoptie van Large Language Models (LLM’s) hebben een niche, maar cruciale vraag gecreëerd naar experts die effectieve prompts kunnen opstellen. Deze mensen, prompt engineers, zijn niet alleen technici maar ook taalvakmensen die de nuances van taal, context en AI-gedrag begrijpen.

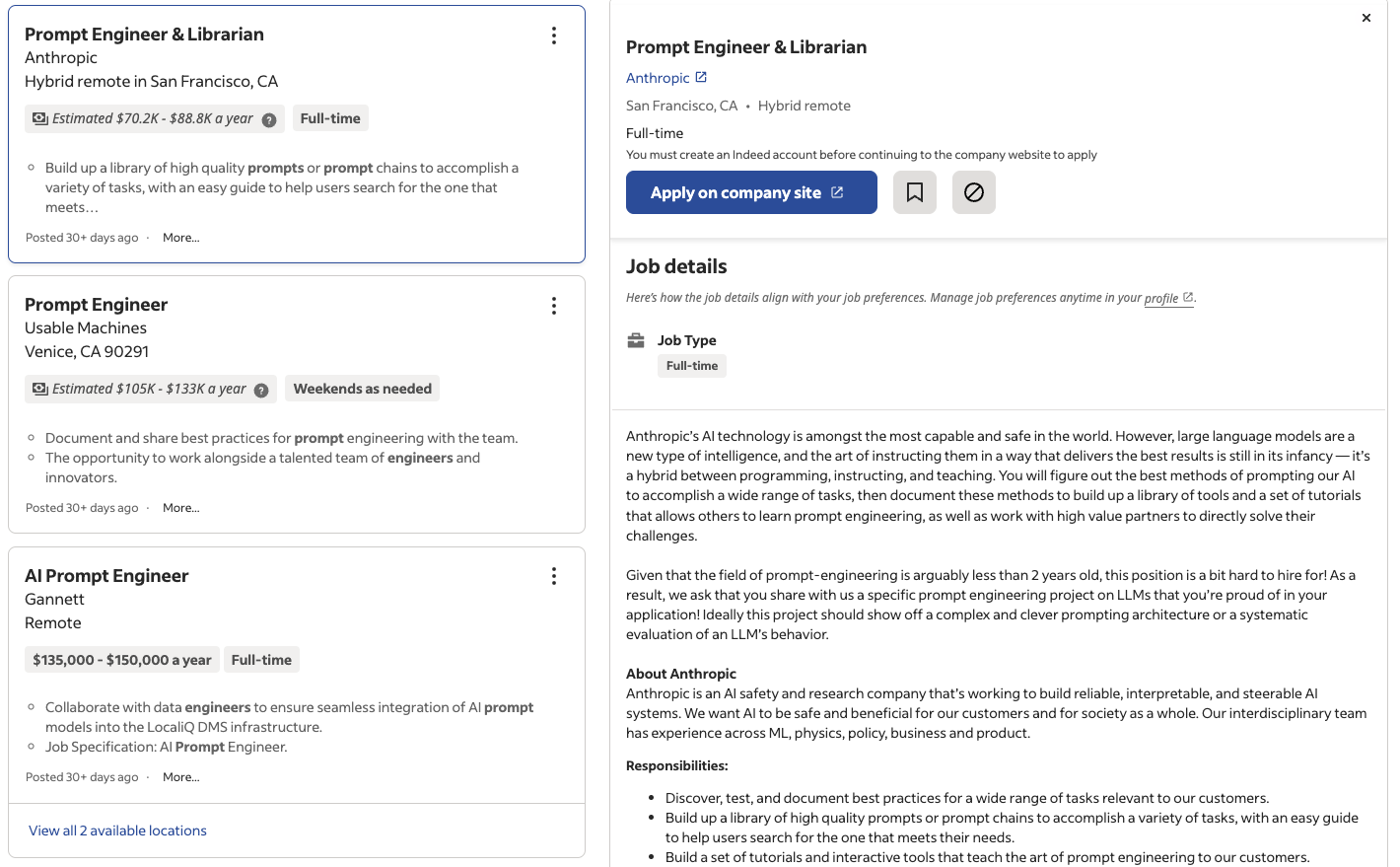

Zoals onder meer gemeld in Time Magazine, erkennen bedrijven, van techreuzen tot startups, de waarde van gespecialiseerde prompt-engineeringrollen. Nu AI-gedreven oplossingen steeds meer in producten en diensten worden geïntegreerd, zorgt de expertise van een prompt engineer ervoor dat deze oplossingen effectief, gebruiksvriendelijk en contextueel relevant zijn.

Vacaturesites zoals Indeed en LinkedIn vermelden al duizenden prompt-engineerbanen alleen al in de VS, met salarissen variërend van $50.000 tot meer dan $150.000 per jaar.

Prompt-engineerbanen geadverteerd op Indeed

Technische skills voor prompt engineering

Afhankelijk van de exacte en technische invulling van de rol heeft een prompt engineer een stevige basis nodig in meerdere technische gebieden:

- Inzicht in NLP. Grondige kennis van Natural Language Processing-technieken en -algoritmen is essentieel.

- Bekendheid met LLM’s. Ervaring met modellen zoals GPT, PaLM2 en andere opkomende modellen en hun onderliggende architecturen.

- Experimenteren en itereren. Vermogen om prompts te testen, verfijnen en optimaliseren op basis van modeluitvoer.

- Data-analyse. Modelreacties analyseren, patronen herkennen en datagedreven beslissingen nemen.

Wie zijn technische skills wil opbouwen of aanscherpen, vindt in onze Natural Language Processing in Python skill track een uitgebreid curriculum voor aankomende prompt engineers.

Niet-technische skills voor prompt engineering

Hoewel technische vaardigheid belangrijk is, heeft een prompt engineer ook een set niet-technische skills nodig:

- Communicatie. Ideeën overbrengen, samenwerken met teams en gebruikersbehoeften begrijpen.

- Vakkennis. Afhankelijk van de toepassing kan domeinspecifieke kennis van onschatbare waarde zijn.

- Taalvaardigheid. Beheersing van taal, grammatica en semantiek om effectieve prompts te formuleren.

- Kritisch denken. Modeluitvoer evalueren, vooringenomenheid herkennen en zorgen voor ethische AI-praktijken.

- Creativiteit. Buiten de gebaande paden denken, met nieuwe promptstijlen experimenteren en oplossingen innoveren.

Deze soft skills, gecombineerd met technische expertise, maken de rol van prompt engineer zowel uitdagend als lonend en banen de weg voor een nieuw tijdperk van samenwerking tussen mens en AI.

De toekomst van prompt engineering

Nu we aan de vooravond staan van een door AI gedreven tijdperk, zal prompt engineering een sleutelrol spelen in de toekomst van mens-AI-interacties. Het vakgebied is nog jong, maar biedt enorme belofte en groeipotentieel.

Lopend onderzoek en ontwikkelingen

De AI-wereld is dynamisch, met razendsnelle innovaties en onderzoek. In de context van prompt engineering:

- Adaptieve prompting. Onderzoekers verkennen manieren waarop modellen zelf adaptief prompts genereren op basis van de context, waardoor er minder handmatige input nodig is.

- Multimodale prompts. Met de opkomst van multimodale AI-modellen die zowel tekst als beelden kunnen verwerken, breidt de scope van prompt engineering zich uit met visuele aanwijzingen.

- Ethical prompting. Nu AI-ethiek aan belang wint, is er focus op prompts die eerlijkheid, transparantie en het verminderen van bias waarborgen.

Voor wie op de hoogte wil blijven van de laatste ontwikkelingen, behandelt ons artikel over ethiek in generatieve AI enkele grote vragen van dit moment. In een aparte gids kun je ook de skills van een AI-engineer verkennen en waar die overlappen met prompt engineering.

De langetermijnwaarde en relevantie

Prompt engineering is geen voorbijgaande trend. Naarmate AI-modellen complexer worden en in uiteenlopende toepassingen worden geïntegreerd—van gezondheidszorg tot entertainment—wordt effectieve communicatie cruciaal. Prompt engineers worden de spilfiguren die ervoor zorgen dat deze modellen toegankelijk, gebruiksvriendelijk en contextueel relevant blijven.

Bovendien, naarmate AI democratischer wordt en meer mensen zonder technische achtergrond met deze modellen gaan werken, zal de rol van prompt engineer zich ontwikkelen. Zij worden verantwoordelijk voor intuïtieve interfaces, gebruiksvriendelijke prompts en ervoor zorgen dat AI een hulpmiddel blijft dat menselijke capaciteiten versterkt.

Uitdagingen en kansen

Zoals elk opkomend vakgebied kent prompt engineering de nodige uitdagingen:

- Complexiteit van modellen. Naarmate modellen in omvang en complexiteit groeien, wordt het opstellen van effectieve prompts lastiger.

- Bias en eerlijkheid. Voorkomen dat prompts onbedoeld bias introduceren of versterken in modeluitvoer.

- Interdisciplinaire samenwerking. Prompt engineering bevindt zich op het snijvlak van taalkunde, psychologie en informatica en vraagt om samenwerking tussen disciplines.

Deze uitdagingen bieden echter ook kansen. Ze stimuleren innovatie, bevorderen interdisciplinaire samenwerking en effenen het pad voor de volgende generatie AI-tools en -oplossingen.

Ethiek bij prompt engineering

Naarmate AI een vaste waarde wordt in diverse sectoren, staan ethische overwegingen in prompt engineering centraal. De rol van prompt engineers gaat verder dan effectieve prompts opstellen—ze moeten er ook voor zorgen dat AI-modellen op een eerlijke, onbevooroordeelde en ethische manier met gebruikers omgaan. Hieronder enkele focuspunten:

Bias verminderen

Prompt engineers spelen een cruciale rol bij het verkleinen van bias in AI-outputs, die kan voortkomen uit trainingsdata of de formulering van prompts zelf. Strategieën zijn onder andere:

- Neutrale prompts ontwerpen: Vermijd sturende vragen of prompts die het model naar bevooroordeelde reacties kunnen bewegen.

- Testen op eerlijkheid: Test prompts regelmatig met diverse input om evenwichtige outputs over verschillende demografieën of contexten te waarborgen.

- Bewustzijn van databias: Begrip van de datasets waarop LLM’s zijn getraind en prompts afstemmen om inherente bias tegen te gaan.

Eerlijke AI-interacties

Om gelijke behandeling te borgen, kunnen prompt engineers:

- Contextbewuste prompts gebruiken: Modellen sturen om bredere perspectieven mee te nemen, zoals onderbelichte gezichtspunten.

- Ethiek monitoren: Ethische richtlijnen opnemen in prompt-engineeringpraktijken, zoals het vermijden van prompts die schadelijke of discriminerende outputs kunnen uitlokken.

Transparantie en uitlegbaarheid

Prompt engineers moeten streven naar transparantie door prompts te maken die duidelijke en begrijpelijke AI-interacties mogelijk maken. Dit omvat:

- De beperkingen van de AI in reacties benoemen.

- Prompts ontwerpen die het model aanmoedigen om bronnen te noemen of de redenering te verduidelijken.

Slotgedachten

De wereld van kunstmatige intelligentie is groot, complex en voortdurend in beweging. Zoals we hebben gezien in onze verkenning van prompt engineering, is dit vakgebied meer dan alleen een technische bezigheid—het is een brug tussen menselijke intentie en machinebegrip. Het is de subtiele kunst van de juiste vragen stellen om de gewenste antwoorden te krijgen.

Prompt engineering, hoewel relatief nieuw als discipline, is de sleutel tot het volledig benutten van AI-modellen, vooral Large Language Models. Nu deze modellen steeds meer deel uitmaken van ons dagelijks leven, kan het belang van effectieve communicatie niet overschat worden. Of het nu gaat om een spraakassistent voor dagelijkse taken, een chatbot voor klantenservice of een AI-tool die onderzoekers ondersteunt, de kwaliteit van de interactie staat of valt met de prompts die ze sturen.

Voor datafans, professionals en ook het brede publiek draait inzicht in prompt engineering niet alleen om betere AI-communicatie. Het gaat om het voor je zien van een toekomst waarin AI naadloos in ons leven past, onze capaciteiten vergroot en onze ervaringen verrijkt.

Op dit kruispunt is de toekomst van prompt engineering veelbelovend, met uitdagingen om te overwinnen en mijlpalen om te bereiken. Voor wie door dit vakgebied gefascineerd is: de reis begint pas. Leer de basis van prompt engineering met onze cursus, ontdek hoe je AI leert in onze aparte gids, of leer in onze tutorial hoe je je eigen LLM traint met PyTorch.

Senior redacteur in AI en edtech. Toegewijd aan het verkennen van data- en AI-trends.

Veelgestelde vragen over prompt engineering

Wat is precies een prompt in de context van AI?

Een prompt is een vraag of instructie die aan een AI-model, met name een Large Language Model (LLM), wordt gegeven om een specifiek antwoord uit te lokken. Het fungeert als de interface tussen menselijke intentie en machine-output.

Waarom is prompt engineering belangrijk?

Prompt engineering zorgt ervoor dat AI-modellen nauwkeurige en relevante outputs produceren. Het is de kunst van het opstellen van effectieve prompts die het gedrag van het model sturen en zo zorgen voor effectieve communicatie tussen mens en AI.

Heb ik een achtergrond in AI of machine learning nodig om prompt engineering te begrijpen?

Hoewel een achtergrond in AI nuttig kan zijn, is het niet strikt noodzakelijk. Prompt engineering draait net zozeer om taal en communicatie als om technische expertise. Met de juiste bronnen en begeleiding kan iedereen de basis onder de knie krijgen.

Hoe verhoudt prompt engineering zich tot chatbots en spraakassistenten?

Chatbots en spraakassistenten leunen sterk op prompts. De vragen die je stelt of de opdrachten die je geeft, zijn in wezen prompts. Effectieve prompt engineering zorgt ervoor dat deze tools gebruikersvragen nauwkeurig begrijpen en beantwoorden.

Zijn er risico’s verbonden aan prompt engineering?

Zoals bij elke AI-praktijk zijn er ook hier uitdagingen. Bevooroordeelde of slecht geformuleerde prompts kunnen leiden tot onnauwkeurige of bevooroordeelde outputs. Het is belangrijk om prompt engineering zorgvuldig aan te pakken, met aandacht voor eerlijkheid en transparantie.