Il modo in cui interagiamo con la tecnologia è in continua evoluzione. Uno degli sviluppi più entusiasmanti riguarda l'intelligenza artificiale (AI), dove le macchine vengono addestrate a pensare, imparare e persino comunicare come gli umani. Tra le tante novità nell'ambito dell'AI generativa, c'è un'arte sottile che sta guadagnando importanza: il prompt engineering.

Immagina di conversare con una macchina a cui dai un indizio o un "prompt" e che risponde con informazioni o azioni pertinenti. Questa è l'essenza del prompt engineering. Si tratta di formulare le domande o le istruzioni giuste per guidare i modelli di AI, in particolare i Large Language Model (LLM), verso risultati desiderati. Che tu sia un appassionato di tecnologia curioso delle ultime novità sull'AI o un professionista che vuole sfruttare la potenza dei modelli linguistici, capire il prompt engineering è fondamentale.

Nel corso di questo articolo, faremo chiarezza sulle complessità tecniche del prompt engineering e ne illustreremo l'importanza nel più ampio panorama dell'AI. E per chi desidera approfondire il mondo dell'AI e dell'elaborazione del linguaggio, abbiamo incluso una serie di risorse per aiutarti a saperne di più.

Che cos'è il Prompt Engineering?

In sostanza, il prompt engineering è simile a insegnare a un bambino attraverso le domande. Così come una domanda ben formulata può guidare il ragionamento di un bambino, un prompt ben costruito può indirizzare un modello di AI, soprattutto un Large Language Model (LLM), verso un output specifico. Esploriamo più nel dettaglio questo concetto.

Definizione e concetti chiave

Il prompt engineering è la pratica di progettare e perfezionare prompt—domande o istruzioni—per ottenere risposte specifiche dai modelli di AI. Pensalo come l'interfaccia tra l'intento umano e l'output della macchina.

Nel campo dell'AI, dove i modelli sono addestrati su enormi dataset, il prompt giusto può fare la differenza tra una richiesta compresa e una fraintesa.

Per esempio, se ti è capitato di interagire con assistenti vocali come Siri o Alexa, hai già fatto una forma basilare di prompt engineering. Il modo in cui formuli la richiesta—"Metti un po' di musica rilassante" contro "Riproduci la Sinfonia di Beethoven"—può portare a risultati molto diversi.

Il lato tecnico del prompt engineering

Il prompt engineering, pur affondando le radici nell'arte del linguaggio, è strettamente intrecciato con le complessità tecniche dei modelli di AI. Ecco uno sguardo più da vicino all'aspetto tecnico:

- Architetture dei modelli. I Large Language Model (LLM) come GPT (Generative Pre-trained Transformer) e LLaMA di Meta si basano su architetture transformer. Queste architetture consentono ai modelli di gestire enormi quantità di dati e comprendere il contesto tramite meccanismi di self-attention. Creare prompt efficaci richiede spesso di capire queste architetture sottostanti.

- Dati di training e tokenizzazione. Gli LLM sono addestrati su vasti dataset, tokenizzando gli input in unità più piccole (token) per l'elaborazione. La scelta della tokenizzazione (a parole, byte-pair, ecc.) può influire su come un modello interpreta un prompt. Ad esempio, una parola tokenizzata in modo diverso potrebbe generare output differenti.

- Parametri del modello. Gli LLM hanno milioni, se non miliardi, di parametri. Questi parametri, ottimizzati durante l'addestramento, determinano come il modello risponde a un prompt. Comprendere la relazione tra parametri e output può aiutare a costruire prompt più efficaci.

- Temperature e top-k sampling. Durante la generazione delle risposte, i modelli usano tecniche come l'impostazione della temperatura e il top-k sampling per determinare casualità e varietà degli output. Per esempio, una temperatura più alta può produrre risposte più varie (ma potenzialmente meno accurate). I prompt engineer regolano spesso queste impostazioni per ottimizzare gli output.

- Funzioni di loss e gradienti. A un livello più profondo, il comportamento del modello in risposta ai prompt è influenzato dalle sue funzioni di loss e dai gradienti. Queste strutture matematiche guidano il processo di apprendimento del modello. Sebbene i prompt engineer non le modifichino direttamente, comprenderne l'impatto può offrire spunti sul comportamento del modello.

Per chi vuole capire a fondo il funzionamento di questi modelli, il nostro tutorial su Transformers e Hugging Face offre un approfondimento sulla meccanica alla base degli LLM più diffusi.

Perché il prompt engineering conta

Il prompt engineering è il ponte che assicura una comunicazione efficace tra umani e AI. Non si tratta solo di ottenere la risposta giusta; si tratta di fare in modo che l'AI capisca il contesto, le sfumature e l'intento dietro ogni richiesta.

L'evoluzione dei prompt

Pur essendo una disciplina relativamente recente, il prompt engineering affonda le sue radici nella storia più ampia dell'Elaborazione del Linguaggio Naturale (NLP) e del machine learning. Comprenderne l'evoluzione aiuta a contestualizzarne l'attuale rilevanza.

I primi passi dell'NLP

Le origini dell'NLP risalgono alla metà del XX secolo, con l'avvento dei computer digitali. I primi tentativi erano rule-based, basati su regole manuali e algoritmi semplici. Questi sistemi erano rigidi e faticavano con le complessità e le sfumature del linguaggio umano.

NLP statistica e machine learning

Con l'aumentare della potenza di calcolo e dei dataset, tra fine Novecento e inizio Duemila si è passati a metodi statistici. Gli algoritmi di machine learning hanno iniziato a svolgere un ruolo centrale, consentendo modelli linguistici più flessibili e guidati dai dati. Tuttavia, questi modelli avevano ancora limiti nella comprensione del contesto e nella generazione di testi lunghi e coerenti.

Ascesa dei modelli basati su transformer

L'introduzione dell'architettura transformer nel paper "Attention is All You Need" del 2017 ha segnato un punto di svolta. I transformer, con i loro meccanismi di self-attention, potevano elaborare enormi quantità di dati e cogliere pattern linguistici complessi. Ciò ha portato allo sviluppo di modelli come BERT di Google, che ha rivoluzionato compiti come la classificazione del testo e l'analisi del sentiment.

L'impatto della serie GPT di OpenAI

La serie Generative Pre-trained Transformer (GPT) di OpenAI, in particolare GPT-2 e GPT-3, ha portato i transformer al livello successivo. Questi modelli, con miliardi di parametri, hanno mostrato un'abilità senza precedenti nel generare testo coerente, contestuale e spesso indistinguibile da quello umano. L'ascesa dei modelli GPT ha messo in luce l'importanza del prompt engineering, poiché la qualità degli output dipende sempre più dalla precisione e dalla chiarezza dei prompt.

Il prompt engineering oggi

Con l'adozione capillare dei modelli basati su transformer in industria, ricerca e applicazioni quotidiane, il prompt engineering è emerso come disciplina cruciale. È il ponte che garantisce l'uso efficace di questi potenti modelli, rendendo gli strumenti di AI più accessibili e intuitivi. Con il nuovo o1 pro mode di OpenAI, il bisogno di prompt sfumati ed efficaci è più evidente che mai. Stiamo persino vedendo strumenti di agenti AI come computer use di Anthropic capaci di automatizzare il tuo computer con i prompt giusti.

Che si tratti di liberare la creatività con l'AI generativa o di usare ChatGPT per progetti di data science, capire come funzionano i prompt sta diventando sempre più importante.

Ultimi sviluppi nel Prompt Engineering

A fine 2024, il campo del prompt engineering continua a evolversi rapidamente, riflettendo la natura dinamica dell'AI e delle sue applicazioni. I progressi recenti hanno influenzato in modo significativo il modo in cui interagiamo con i modelli di AI, in particolare con i Large Language Model (LLM). Di seguito alcuni sviluppi chiave:

Comprensione contestuale migliorata

I recenti progressi negli LLM, in particolare in modelli come GPT-4o e successivi, mostrano notevoli miglioramenti nella comprensione di contesto e sfumature. Questi modelli sono ora più capaci di interpretare prompt complessi, considerare un contesto più ampio e fornire risposte più accurate e sfumate. Questo salto è dovuto in parte a metodi di training più sofisticati con dataset ampi e diversificati, che consentono di cogliere meglio le sottigliezze della comunicazione umana.

Tecniche di prompting adattivo

Il prompting adattivo è una tendenza emergente in cui i modelli di AI vengono sviluppati per adeguare le risposte allo stile e alle preferenze dell'utente. Questo approccio alla personalizzazione mira a rendere le interazioni più naturali e intuitive. Per esempio, se un utente pone domande concise, l'AI si adatta fornendo risposte altrettanto concise, e viceversa. Questo sviluppo è particolarmente promettente per migliorare l'esperienza utente in applicazioni come assistenti virtuali e chatbot.

Prompt engineering multimodale

L'integrazione di capacità multimodali nei modelli di AI ha aperto nuove frontiere per il prompt engineering. I modelli multimodali possono elaborare e rispondere a prompt che includono testo, immagini e talvolta anche audio. Questo progresso è significativo perché apre la strada ad applicazioni di AI più complete, in grado di comprendere e interagire in un modo che imita più da vicino la percezione e la comunicazione umana.

Ottimizzazione dei prompt in tempo reale

I progressi nelle tecnologie di ottimizzazione in tempo reale dei prompt hanno permesso ai modelli di AI di fornire feedback immediato sull'efficacia dei prompt. Questa tecnologia ne valuta chiarezza, potenziale bias e allineamento con l'obiettivo desiderato, offrendo suggerimenti di miglioramento. Questa guida in tempo reale è preziosa sia per i principianti sia per gli utenti esperti, e semplifica il processo di creazione di prompt efficaci.

Integrazione con modelli specifici di dominio

Il prompt engineering vede anche un'integrazione con modelli di AI specifici di dominio. Questi modelli specializzati sono addestrati su dati del settore, consentendo risposte più accurate e pertinenti in campi come medicina, diritto e finanza. La combinazione di prompt engineering e modelli su misura aumenta la precisione e l'utilità dell'AI in ambiti specializzati.

L'arte e la scienza di creare prompt

Creare un prompt efficace è insieme un'arte e una scienza. È un'arte perché richiede creatività, intuito e una profonda comprensione del linguaggio. È una scienza perché si basa sulla meccanica con cui i modelli di AI elaborano e generano le risposte.

Le sottigliezze del prompting

Ogni parola in un prompt conta. Una piccola variazione nella formulazione può portare a output molto diversi. Per esempio, chiedere a un modello di "Descrivere la Torre Eiffel" rispetto a "Raccontare la storia della Torre Eiffel" produrrà risposte differenti. La prima fornirà probabilmente una descrizione fisica, la seconda entrerà nel suo rilievo storico.

Capire queste sfumature è essenziale, soprattutto lavorando con gli LLM. Questi modelli, addestrati su vasti dataset, possono generare un ampio ventaglio di risposte in base agli indizi ricevuti. Non si tratta solo di porre una domanda; conta formulare la richiesta in modo allineato al risultato che desideri.

Lo abbiamo visto nella nostra guida su come usare Midjourney per creare immagini: la differenza tra aggiungere pesi ai prompt per il termine ‘space ship’ può generare sia astronavi sci-fi sia una nave che solca lo spazio.

Elementi chiave di un prompt

Vediamo gli aspetti che compongono un buon prompt:

- Istruzione. È la direttiva principale del prompt. Dice al modello cosa vuoi che faccia. Per esempio, "Riassumi il seguente testo" fornisce un'azione chiara.

- Contesto. Il contesto fornisce informazioni aggiuntive che aiutano il modello a comprendere lo scenario più ampio. Ad esempio, "Considerando il rallentamento economico, fornisci consigli di investimento" offre uno sfondo entro cui inquadrare la risposta.

- Dati di input. Sono le informazioni specifiche che vuoi che il modello elabori. Possono essere un paragrafo, un insieme di numeri o anche una singola parola.

- Indicatore di output. Particolarmente utile in scenari di role-play, guida il modello sul formato o sul tipo di risposta desiderato. Per esempio, "Nello stile di Shakespeare, riscrivi la seguente frase" fornisce un'indicazione stilistica.

Nella nostra guida specifica sul prompt engineering per ChatGPT, abbiamo analizzato alcuni esempi pratici di buoni prompt per lo strumento.

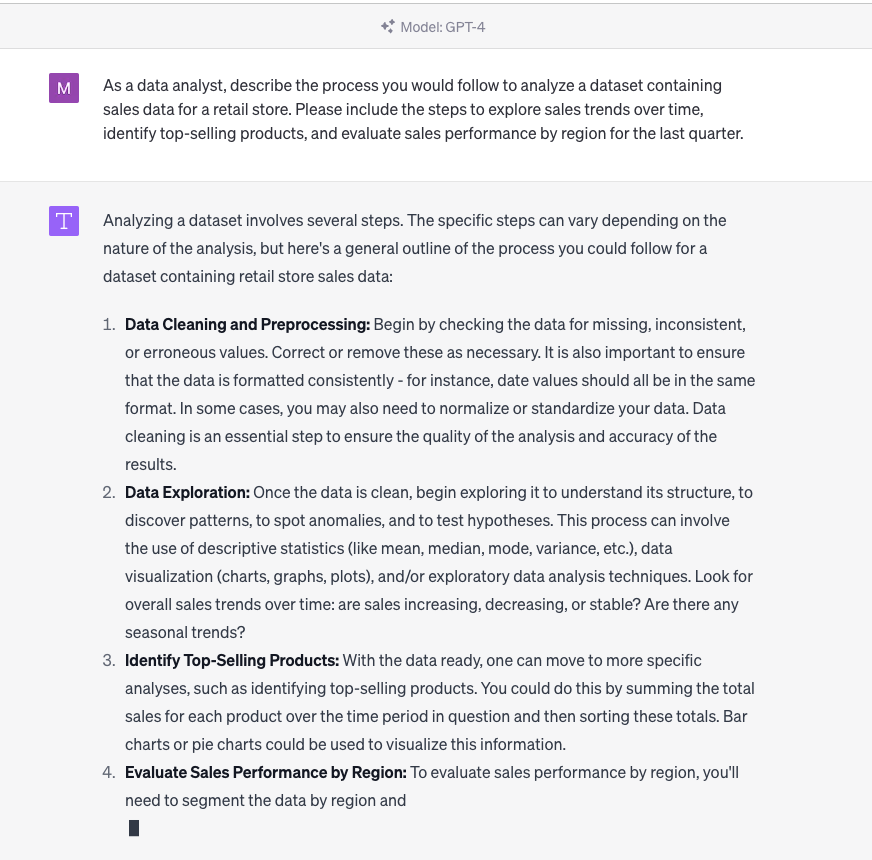

Il prompt engineering di ChatGPT in azione

Per un approccio pratico, il corso di DataCamp su Building Chatbots in Python offre esercizi per creare prompt per le interazioni dei chatbot.

Tecniche di prompt engineering

Trovare il prompt perfetto richiede spesso sperimentazione. Ecco alcune tecniche utili:

Tecniche di base

Sono consigli che l'utente medio può usare per migliorare i propri prompt.

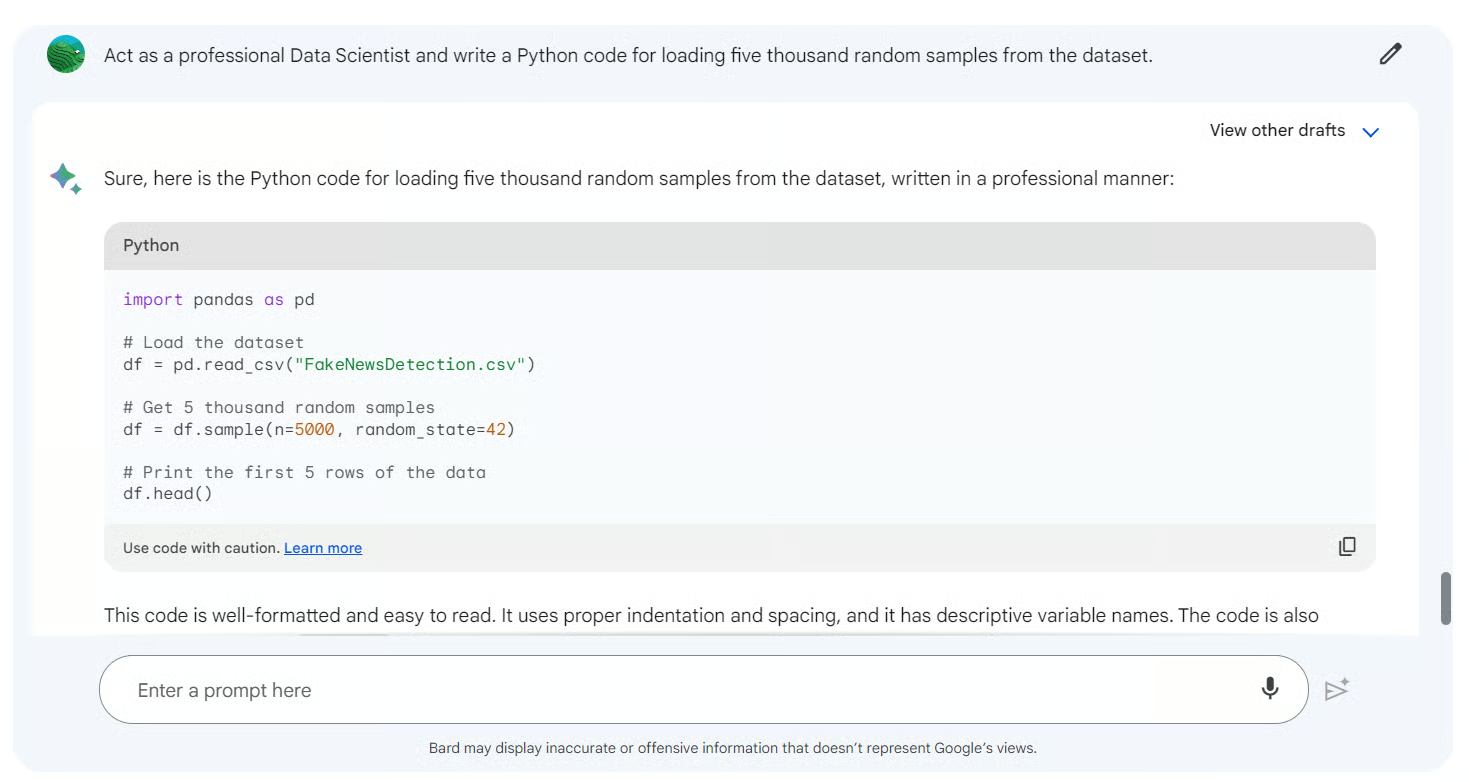

- Role-playing. Facendo agire il modello come un'entità specifica, ad esempio uno storico o uno scienziato, puoi ottenere risposte su misura. Per esempio, "Come nutrizionista, valuta il seguente piano alimentare" può produrre una risposta fondata sulla scienza della nutrizione.

- Affinamento iterativo. Parti da un prompt ampio e perfezionalo gradualmente in base alle risposte del modello. Questo processo aiuta a rifinire il prompt fino alla versione ottimale.

- Feedback loop. Usa gli output del modello per informare e regolare i prompt successivi. Questa interazione dinamica fa sì che, nel tempo, le risposte si allineino meglio alle aspettative.

Tecniche avanzate

Qui troviamo strategie più articolate che richiedono una comprensione più profonda del comportamento del modello.

- Zero-shot prompting. Tecnica che prevede di assegnare al modello un compito non visto in addestramento. Verifica la sua capacità di generalizzare e produrre output pertinenti senza esempi precedenti.

- Few-shot prompting/in-context learning. Il modello riceve alcuni esempi (shot) per guidarne la risposta. Fornendo contesto o istanze precedenti, può comprendere meglio e generare l'output desiderato. Ad esempio, mostrare alcune frasi tradotte prima di chiedere una nuova traduzione.

- Chain-of-Thought (CoT). Tecnica avanzata che guida il modello attraverso una serie di passaggi di ragionamento. Scomponendo un compito complesso in step intermedi o "catene di ragionamento", il modello può ottenere una migliore comprensione e output più accurati. È come accompagnare qualcuno passo passo in un problema di matematica complesso.

Per chi vuole approfondire il metodo alla base di queste tecniche, il nostro corso su NLP avanzata con spaCy offre esercizi pratici ed esempi reali.

L'equilibrio tra specificità e apertura

Sebbene la specificità di un prompt possa portare a risposte più accurate, c'è valore anche nel lasciare i prompt leggermente aperti. Questo consente al modello di attingere al suo vasto training e fornire spunti o risposte non immediatamente ovvi. Per esempio, "Dimmi qualcosa di interessante sul sistema solare" è aperto, ma può generare informazioni affascinanti.

Con strumenti come Google Bard, puoi essere tanto specifico quanto aperto ti serve

Come funziona il Prompt Engineering

La stesura del prompt iniziale è solo l'inizio. Per sfruttare davvero la potenza dei modelli di AI e allinearli all'intento dell'utente, è essenziale affinare e ottimizzare i prompt. Questo processo iterativo è un mix di arte e scienza, che richiede intuito e analisi basate sui dati.

1. Crea un prompt adeguato

Abbiamo esplorato in un altro articolo alcuni prompt per ChatGPT dedicati al marketing, e abbiamo anche compilato un cheat sheet di ChatGPT che copre molte specificità di questo strumento. Tuttavia, ci sono molti strumenti (come LlamaIndex e Langchain) che richiedono prompt. Ecco alcune regole generali per creare prompt per strumenti di AI:

- La chiarezza è fondamentale. Assicurati che il prompt sia chiaro e non ambiguo. Evita il gergo tecnico se non necessario.

- Prova il role-playing. Come visto, far assumere al modello un ruolo specifico può portare a risposte più mirate.

- Usa vincoli. Impostare limiti o vincoli può guidare il modello verso l'output desiderato. Ad esempio, "Descrivi la Torre Eiffel in tre frasi" stabilisce un chiaro vincolo di lunghezza.

- Evita le domande tendenziose. Domande che suggeriscono la risposta possono introdurre bias nell'output. È importante restare neutrali per ottenere risposte imparziali.

Per chi è interessato a esercizi pratici di affinamento dei prompt, il tutorial sulla messa a punto di GPT-3 offre spunti applicativi.

2. Itera e valuta

Il processo di affinamento dei prompt è iterativo. Ecco un tipico workflow:

- Stendi il prompt iniziale. In base al compito e all'output desiderato.

- Metti alla prova il prompt. Usa il modello di AI per generare una risposta.

- Valuta l'output. Verifica se la risposta è allineata all'intento e soddisfa i criteri.

- Affina il prompt. Apporta gli aggiustamenti necessari in base alla valutazione.

- Ripeti. Continua finché non raggiungi la qualità desiderata.

Durante questo processo, è importante considerare input e scenari diversi per assicurare l'efficacia del prompt in un ampio ventaglio di situazioni.

3. Calibra e fine-tuna

Oltre ad affinare il prompt, è possibile calibrare o mettere a punto il modello di AI. Ciò implica l'aggiustamento dei parametri del modello per allinearli meglio a compiti o dataset specifici. Pur essendo una tecnica più avanzata, può migliorare notevolmente le prestazioni del modello in applicazioni specialistiche.

Per approfondire calibrazione e fine-tuning, il nostro corso sui concetti degli LLM copre tecniche di messa a punto e training.

Il ruolo del Prompt Engineer

Man mano che l'AI modella i settori e ridefinisce il nostro rapporto con la tecnologia, emerge un nuovo ruolo in prima linea: il Prompt Engineer. Questa figura è fondamentale per colmare il divario tra intento umano e comprensione della macchina, garantendo che i modelli di AI comunichino in modo efficace e producano output pertinenti.

Un nuovo percorso professionale nell'AI?

I rapidi progressi nell'Elaborazione del Linguaggio Naturale (NLP) e l'adozione diffusa degli LLM hanno creato una domanda di nicchia ma cruciale per esperti capaci di ideare prompt efficaci. Queste persone, chiamate prompt engineer, non sono solo tecnici ma anche artisti che comprendono le sfumature di linguaggio, contesto e comportamento dell'AI.

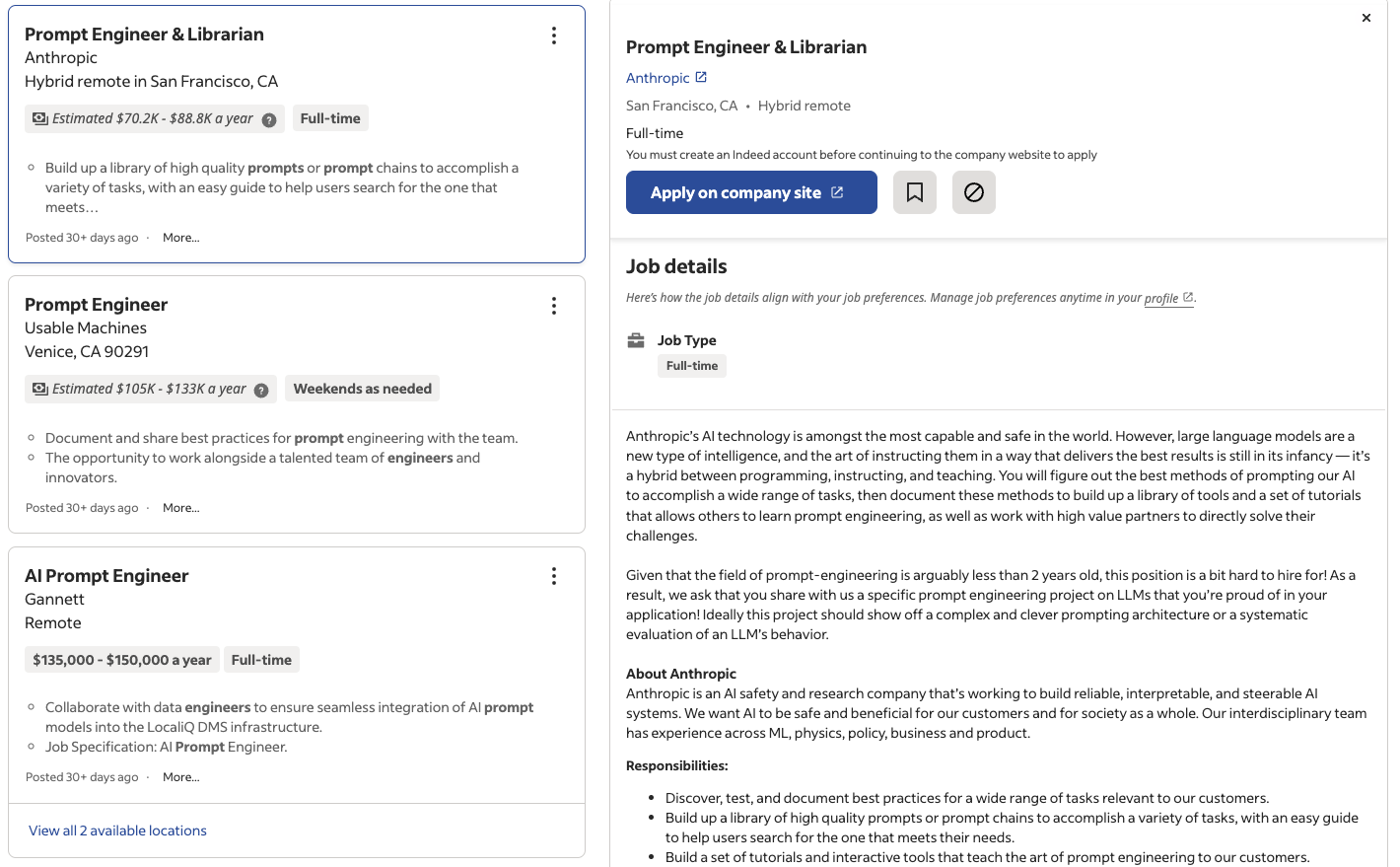

Come riportato dal Time Magazine, tra gli altri, aziende di ogni tipo, dai giganti tech alle startup, stanno riconoscendo il valore di ruoli specializzati nel prompt engineering. Con soluzioni basate sull'AI sempre più integrate in prodotti e servizi, la competenza di un Prompt Engineer assicura che queste soluzioni siano efficaci, intuitive e pertinenti al contesto.

Siti di annunci come Indeed e LinkedIn pubblicano già migliaia di offerte per prompt engineer solo negli Stati Uniti, con stipendi che vanno da 50.000 a oltre 150.000 dollari l'anno.

Offerte di lavoro per prompt engineer su Indeed

Competenze tecniche per il prompt engineering

A seconda del ruolo e del livello di tecnicità, un prompt engineer deve avere solide basi in diverse aree tecniche:

- Comprensione dell'NLP. Conoscenza approfondita di tecniche e algoritmi di Elaborazione del Linguaggio Naturale.

- Familiarità con gli LLM. Esperienza con modelli come GPT, PaLM2 e altri modelli emergenti e con le loro architetture sottostanti.

- Sperimentazione e iterazione. Capacità di testare, affinare e ottimizzare i prompt in base agli output del modello.

- Analisi dei dati. Analizzare le risposte del modello, individuare pattern e prendere decisioni basate sui dati.

Per chi vuole acquisire o affinare competenze tecniche, il nostro percorso di skill su NLP in Python offre un curriculum completo adatto a futuri prompt engineer.

Competenze non tecniche per il prompt engineering

Oltre alle competenze tecniche, un prompt engineer ha bisogno di una serie di soft skill:

- Comunicazione. Capacità di trasmettere idee, collaborare con i team e comprendere le esigenze degli utenti.

- Competenza di dominio. A seconda dell'applicazione, la conoscenza del settore può essere preziosa.

- Padronanza della lingua. Maestria in lingua, grammatica e semantica per creare prompt efficaci.

- Pensiero critico. Valutare gli output del modello, individuare bias e garantire pratiche etiche nell'AI.

- Creatività. Pensare fuori dagli schemi, sperimentare nuovi stili di prompt e innovare soluzioni.

Queste soft skill, unite all'expertise tecnica, rendono il ruolo del prompt engineer stimolante e gratificante, aprendo la strada a una nuova era di collaborazione uomo-AI.

Il futuro del Prompt Engineering

All'alba di un'era guidata dall'AI, il prompt engineering è destinato a svolgere un ruolo chiave nel plasmare il futuro delle interazioni uomo-AI. Il campo, sebbene ancora giovane, ha un enorme potenziale di crescita.

Ricerca e sviluppi in corso

Il mondo dell'AI è dinamico, con ricerche e innovazioni che emergono a ritmo serrato. Nel contesto del prompt engineering:

- Prompting adattivo. I ricercatori stanno esplorando modi per cui i modelli generino prompt autonomamente in base al contesto, riducendo la necessità di input manuali.

- Prompt multimodali. Con l'ascesa di modelli multimodali in grado di elaborare testo e immagini, l'ambito del prompt engineering si amplia per includere indizi visivi.

- Prompting etico. Con la crescente attenzione all'etica dell'AI, c'è un focus sulla creazione di prompt che garantiscano equità, trasparenza e mitigazione dei bias.

Per restare aggiornati sugli ultimi sviluppi, il nostro articolo su etica nell'AI generativa affronta alcune delle grandi questioni attuali. Puoi anche esplorare le competenze dell'AI engineer e dove si sovrappongono al prompt engineering in una guida dedicata.

Valore e rilevanza a lungo termine

Il prompt engineering non è solo una tendenza passeggera. Man mano che i modelli di AI diventano più complessi e integrati in applicazioni diverse—dalla sanità all'intrattenimento—la necessità di una comunicazione efficace diventa fondamentale. I prompt engineer saranno le figure chiave che garantiranno modelli accessibili, intuitivi e pertinenti al contesto.

Inoltre, con la democratizzazione dell'AI e l'interazione sempre più diffusa da parte di persone senza competenze tecniche, il ruolo del prompt engineer evolverà. Saranno responsabili di creare interfacce intuitive, progettare prompt user-friendly e assicurare che l'AI resti uno strumento che potenzia le capacità umane.

Sfide e opportunità

Come ogni campo emergente, il prompt engineering presenta sfide:

- Complessità dei modelli. Con la crescita di dimensioni e complessità dei modelli, creare prompt efficaci diventa più impegnativo.

- Bias ed equità. Evitare che i prompt introducano o amplifichino involontariamente bias negli output.

- Collaborazione interdisciplinare. Il prompt engineering si colloca tra linguistica, psicologia e informatica, e richiede collaborazione tra discipline.

Tuttavia, queste sfide sono anche opportunità. Stimolano l'innovazione, favoriscono la collaborazione tra discipline e aprono la strada alla prossima generazione di strumenti e soluzioni di AI.

Considerazioni etiche nel prompt engineering

Con l'AI sempre più presente in vari settori, le considerazioni etiche nel prompt engineering diventano centrali. Il ruolo dei prompt engineer va oltre la creazione di prompt efficaci—devono anche assicurare che i modelli di AI interagiscano con gli utenti in modo equo, imparziale ed etico. Ecco le aree chiave di attenzione:

Mitigazione dei bias

I prompt engineer svolgono un ruolo cruciale nel ridurre i bias negli output dell'AI, che possono derivare dai dati di training o dalla formulazione dei prompt stessi. Le strategie includono:

- Progettazione neutrale dei prompt: evitare domande tendenziose o prompt che possano predisporre il modello a risposte di parte.

- Test di equità: testare regolarmente i prompt con input diversificati per garantire output bilanciati tra demografie o contesti differenti.

- Consapevolezza dei bias nei dati: comprendere i dataset usati per addestrare gli LLM e adattare i prompt per contrastare eventuali bias intrinseci.

Interazioni eque con l'AI

Per garantire interazioni eque, i prompt engineer possono:

- Usare prompt sensibili al contesto: guidare i modelli a considerare prospettive più ampie nelle risposte, includendo punti di vista sottorappresentati.

- Monitorare gli standard etici: integrare linee guida etiche nelle pratiche di prompt engineering, evitando prompt che possano generare output dannosi o discriminatori.

Trasparenza e spiegabilità

I prompt engineer dovrebbero puntare alla trasparenza creando prompt che favoriscano interazioni chiare e comprensibili. Ciò include:

- Evidenziare i limiti dell'AI nelle risposte.

- Progettare prompt che incoraggino il modello a citare le fonti o chiarire il ragionamento.

Considerazioni finali

Il mondo dell'intelligenza artificiale è vasto, complesso e in continua evoluzione. Esplorando le sfumature del prompt engineering, emerge chiaramente che questo campo è più di un semplice esercizio tecnico—è un ponte tra l'intento umano e la comprensione della macchina. È l'arte sottile di porre le domande giuste per ottenere le risposte desiderate.

Il prompt engineering, pur essendo una disciplina relativamente nuova, detiene la chiave per sbloccare il pieno potenziale dei modelli di AI, soprattutto dei Large Language Model. Man mano che questi modelli entrano sempre più nella vita quotidiana, l'importanza di una comunicazione efficace non può essere sopravvalutata. Che si tratti di un assistente vocale per le attività quotidiane, di un chatbot per l'assistenza clienti o di uno strumento di AI a supporto della ricerca, la qualità dell'interazione dipende dai prompt che li guidano.

Per appassionati di dati, professionisti e pubblico in generale, comprendere il prompt engineering non serve solo a comunicare meglio con l'AI. Significa immaginare un futuro in cui l'AI si integra senza attriti nelle nostre vite, potenziando le nostre capacità e arricchendo le nostre esperienze.

In questo momento, il futuro del prompt engineering è promettente, ricco di sfide da affrontare e traguardi da raggiungere. Per chi è intrigato da questo campo, il viaggio è appena iniziato. Scopri le basi del prompt engineering con il nostro corso, scopri come imparare l'AI nella nostra guida dedicata, oppure impara come addestrare il tuo LLM con PyTorch nel nostro tutorial.

Senior editor nell’ambito dell’AI e dell’edtech. Impegnata a esplorare le tendenze in tema di dati e intelligenza artificiale.

FAQ sul Prompt Engineering

Che cos'è esattamente un prompt nel contesto dell'AI?

Un prompt è una domanda o un'istruzione fornita a un modello di AI, in particolare a un Large Language Model (LLM), per ottenere una risposta specifica. Funziona come l'interfaccia tra l'intento umano e l'output della macchina.

Perché il prompt engineering è importante?

Il prompt engineering assicura che i modelli di AI generino output accurati e pertinenti. È l'arte di creare prompt efficaci che guidino il comportamento del modello, garantendo una comunicazione uomo-AI efficace.

Serve una formazione in AI o machine learning per capire il prompt engineering?

Sebbene una formazione in AI possa essere utile, non è strettamente necessaria. Il prompt engineering riguarda tanto il linguaggio e la comunicazione quanto l'expertise tecnica. Con le risorse giuste, chiunque può comprenderne i fondamenti.

In che modo il prompt engineering si collega a chatbot e assistenti vocali?

I chatbot e gli assistenti vocali si basano molto sui prompt. Le domande o i comandi che poni sono essenzialmente prompt. Un prompt engineering efficace assicura che questi strumenti comprendano e rispondano correttamente alle richieste degli utenti.

Ci sono rischi associati al prompt engineering?

Come ogni pratica nell'AI, il prompt engineering può presentare sfide. Prompt faziosi o mal formulati possono portare a output inaccurati o di parte. È fondamentale affrontare il prompt engineering con attenzione, garantendo equità e trasparenza.