Cara kita berinteraksi dengan teknologi terus berkembang. Salah satu kemajuan terbaru yang paling menarik ada di ranah kecerdasan buatan (AI), di mana mesin dilatih untuk berpikir, belajar, dan bahkan berkomunikasi seperti manusia. Di antara beragam perkembangan dalam area seperti AI generatif, ada seni halus yang semakin menonjol: prompt engineering.

Bayangkan Anda berbincang dengan mesin, Anda memberikan isyarat atau "prompt", lalu mesin merespons dengan informasi atau tindakan yang relevan. Itulah inti prompt engineering. Ini tentang merancang pertanyaan atau instruksi yang tepat untuk membimbing model AI, terutama Large Language Models (LLM), agar menghasilkan keluaran yang diinginkan. Baik Anda penggemar teknologi yang penasaran dengan perkembangan terbaru AI maupun profesional yang ingin memanfaatkan kekuatan model bahasa, memahami prompt engineering adalah hal yang krusial.

Sepanjang artikel ini, kami akan mengurai seluk-beluk teknis prompt engineering sekaligus memberikan gambaran tentang signifikansinya dalam lanskap AI yang lebih luas. Dan bagi Anda yang ingin menyelami lebih dalam dunia AI dan pemrosesan bahasa, kami sertakan beragam sumber untuk membantu Anda belajar lebih lanjut.

Apa itu Prompt Engineering?

Pada dasarnya, prompt engineering mirip dengan mengajar anak melalui pertanyaan. Sebagaimana pertanyaan yang dirumuskan dengan baik dapat membimbing proses berpikir seorang anak, prompt yang dirancang dengan cermat dapat mengarahkan model AI, khususnya Large Language Model (LLM), menuju keluaran tertentu. Mari kita telusuri konsep ini lebih lanjut.

Definisi dan konsep inti

Prompt engineering adalah praktik merancang dan menyempurnakan prompt—pertanyaan atau instruksi—untuk memancing respons spesifik dari model AI. Anggap saja ini sebagai antarmuka antara niat manusia dan keluaran mesin.

Dalam ranah AI, tempat model dilatih pada himpunan data yang sangat besar, prompt yang tepat bisa menjadi pembeda antara model yang memahami permintaan Anda atau justru salah menafsirkannya.

Sebagai contoh, jika Anda pernah berinteraksi dengan asisten suara seperti Siri atau Alexa, Anda sudah terlibat dalam bentuk dasar prompt engineering. Cara Anda merumuskan permintaan—"Putar musik yang menenangkan" dibandingkan "Putar Simfoni Beethoven"—dapat menghasilkan keluaran yang sangat berbeda.

Sisi teknis prompt engineering

Prompt engineering, meski berakar pada seni berbahasa, sangat terkait dengan seluk-beluk teknis model AI. Berikut tinjauan lebih dekat sisi teknisnya:

- Arsitektur model. Large Language Models (LLM) seperti GPT (Generative Pre-trained Transformer) dan LLaMA dari Meta LLaMA dibangun di atas arsitektur transformer. Arsitektur ini memungkinkan model menangani data dalam jumlah besar dan memahami konteks melalui mekanisme self-attention. Merancang prompt yang efektif sering kali memerlukan pemahaman atas arsitektur dasar ini.

- Data pelatihan dan tokenisasi. LLM dilatih pada dataset yang luas, dengan melakukan tokenisasi input menjadi potongan-potongan kecil (token) untuk diproses. Pilihan tokenisasi (berbasis kata, byte-pair, dll.) dapat memengaruhi bagaimana model menafsirkan prompt. Misalnya, kata yang ditokenisasi berbeda dapat menghasilkan keluaran yang beragam.

- Parameter model. LLM memiliki jutaan, bahkan miliaran, parameter. Parameter yang disetel selama proses pelatihan ini menentukan bagaimana model merespons suatu prompt. Memahami hubungan antara parameter ini dan keluaran model dapat membantu merancang prompt yang lebih efektif.

- Temperature dan top-k sampling. Saat menghasilkan respons, model menggunakan teknik seperti pengaturan temperature dan top-k sampling untuk menentukan tingkat keacakan dan keragaman keluaran. Misalnya, temperature yang lebih tinggi dapat menghasilkan respons yang lebih beragam (namun berpotensi kurang akurat). Prompt engineer kerap menyesuaikan pengaturan ini untuk mengoptimalkan keluaran model.

- Fungsi loss dan gradien. Pada level yang lebih dalam, perilaku model saat merespons prompt dipengaruhi oleh fungsi loss dan gradiennya. Konstruksi matematis ini membimbing proses pembelajaran model. Meski prompt engineer biasanya tidak menyesuaikannya secara langsung, memahami dampaknya dapat memberi wawasan tentang perilaku model.

Bagi yang ingin memahami seluk-beluk model seperti ini, tutorial Transformers dan Hugging Face kami menyajikan ulasan mendalam tentang mekanisme LLM populer.

Mengapa prompt engineering penting

Prompt engineering adalah jembatan yang memastikan komunikasi manusia-AI berjalan efektif. Ini bukan sekadar soal memperoleh jawaban yang benar; melainkan memastikan AI memahami konteks, nuansa, dan niat di balik setiap pertanyaan.

Evolusi rekayasa prompt

Prompt engineering, meski merupakan disiplin yang relatif baru, berakar kuat pada sejarah lebih luas Natural Language Processing (NLP) dan machine learning. Memahami evolusinya memberi konteks atas signifikansinya saat ini.

Masa awal NLP

Asal-usul NLP dapat ditelusuri ke pertengahan abad ke-20, seiring hadirnya komputer digital. Upaya awal NLP berbasis aturan, mengandalkan aturan yang dirancang manual dan algoritme sederhana. Sistem-sistem ini kaku dan kesulitan menghadapi kompleksitas serta nuansa bahasa manusia.

NLP statistik dan machine learning

Seiring meningkatnya daya komputasi dan bertambahnya dataset, akhir abad ke-20 dan awal abad ke-21 menyaksikan pergeseran ke metode statistik. Algoritme machine learning mulai berperan penting, memungkinkan model bahasa yang lebih fleksibel dan berbasis data. Namun, model-model ini masih memiliki keterbatasan dalam memahami konteks dan menghasilkan teks panjang yang koheren.

Bangkitnya model berbasis transformer

Pengenalan arsitektur transformer dalam makalah "Attention is All You Need" pada 2017 menjadi titik balik signifikan. Transformer, dengan mekanisme self-attention, dapat memproses data dalam jumlah besar dan menangkap pola bahasa yang rumit. Ini memicu pengembangan model seperti BERT dari Google, yang merevolusi tugas-tugas seperti klasifikasi teks dan analisis sentimen.

Dampak GPT dari OpenAI

Seri Generative Pre-trained Transformer (GPT) dari OpenAI, khususnya GPT-2 dan GPT-3, membawa transformer ke level berikutnya. Model-model ini, dengan miliaran parameter, menunjukkan kemampuan tak tertandingi dalam menghasilkan teks yang koheren, relevan dengan konteks, dan sering kali sulit dibedakan dari tulisan manusia. Bangkitnya model GPT menegaskan pentingnya prompt engineering, karena kualitas keluaran sangat bergantung pada ketepatan dan kejernihan prompt.

Prompt engineering saat ini

Dengan adopsi luas model berbasis transformer di industri, riset, dan aplikasi sehari-hari, prompt engineering muncul sebagai disiplin krusial. Ia menjadi jembatan yang memastikan model-model kuat ini dimanfaatkan secara efektif, sehingga alat AI lebih mudah diakses dan ramah pengguna. Dengan mode o1 pro baru dari OpenAI, kebutuhan akan prompt yang bernuansa dan efektif semakin nyata. Kita bahkan melihat alat agen AI seperti computer use dari Anthropic yang mampu mengotomatiskan komputer Anda dengan prompt yang tepat.

Baik untuk membuka kreativitas dengan AI generatif maupun menggunakan ChatGPT untuk proyek data science, memahami cara kerja prompt menjadi semakin penting.

Perkembangan Terbaru dalam Prompt Engineering

Hingga akhir 2024, bidang prompt engineering terus berkembang pesat, mencerminkan sifat AI dan aplikasinya yang dinamis. Kemajuan terbaru telah sangat memengaruhi cara kita berinteraksi dengan model AI, khususnya Large Language Models (LLM). Berikut beberapa perkembangan kunci:

Pemahaman konteks yang ditingkatkan

Terobosan terbaru pada LLM, khususnya pada model seperti GPT-4o dan seterusnya, menunjukkan peningkatan luar biasa dalam memahami konteks dan nuansa. Model-model ini kini lebih mahir menafsirkan prompt yang kompleks, mempertimbangkan konteks yang lebih luas, dan memberikan respons yang lebih akurat serta bernuansa. Lompatan ini sebagian berkat metode pelatihan yang lebih canggih dengan dataset yang beragam dan ekstensif, memungkinkan model menangkap kehalusan komunikasi manusia dengan lebih efektif.

Teknik prompting adaptif

Prompting adaptif adalah tren yang muncul di mana model AI dikembangkan untuk menyesuaikan respons berdasarkan gaya dan preferensi input pengguna. Pendekatan personalisasi ini bertujuan membuat interaksi dengan AI lebih natural dan ramah pengguna. Misalnya, jika pengguna cenderung bertanya secara ringkas, AI akan menyesuaikan memberikan jawaban ringkas, atau sebaliknya. Perkembangan ini sangat menjanjikan untuk meningkatkan pengalaman pengguna pada aplikasi berbasis AI seperti asisten virtual dan chatbot.

Prompt engineering multimodal

Integrasi kapabilitas multimodal pada model AI membuka babak baru dalam prompt engineering. Model multimodal dapat memproses dan merespons prompt yang mencakup campuran teks, gambar, dan terkadang bahkan audio. Kemajuan ini penting karena membuka jalan bagi aplikasi AI yang lebih komprehensif, yang dapat memahami dan berinteraksi dengan cara yang lebih mendekati persepsi dan komunikasi manusia.

Optimasi prompt secara real-time

Kemajuan teknologi optimasi prompt real-time memungkinkan model AI memberikan umpan balik instan atas efektivitas prompt. Teknologi ini menilai kejelasan prompt, potensi bias, dan kesesuaiannya dengan hasil yang diinginkan, lalu menawarkan saran perbaikan. Panduan real-time ini sangat berharga bagi pengguna pemula maupun berpengalaman, sehingga proses merancang prompt yang efektif menjadi lebih efisien.

Integrasi dengan model spesifik domain

Prompt engineering juga mulai terintegrasi dengan model AI spesifik domain. Model khusus ini dilatih pada data industri tertentu, sehingga mampu memberikan respons terhadap prompt yang lebih akurat dan relevan di bidang seperti kesehatan, hukum, dan keuangan. Kombinasi prompt engineering dengan model yang disesuaikan ini meningkatkan ketepatan dan utilitas AI di area spesialis.

Seni dan Sains Merancang Prompt

Merancang prompt yang efektif adalah seni sekaligus sains. Disebut seni karena memerlukan kreativitas, intuisi, dan pemahaman mendalam tentang bahasa. Disebut sains karena berlandaskan pada mekanisme bagaimana model AI memproses dan menghasilkan respons.

Kehalusan dalam membuat prompt

Setiap kata dalam prompt berarti. Perubahan kecil dalam perumusan dapat berujung pada keluaran model AI yang sangat berbeda. Misalnya, meminta model untuk "Jelaskan Menara Eiffel" dibandingkan "Uraikan sejarah Menara Eiffel" akan menghasilkan respons yang berbeda. Yang pertama mungkin memberi deskripsi fisik, sedangkan yang kedua menyelami signifikansi historisnya.

Memahami nuansa ini penting, terutama saat bekerja dengan LLM. Model-model ini, yang dilatih pada dataset besar, dapat menghasilkan beragam respons berdasarkan isyarat yang diterima. Ini bukan sekadar mengajukan pertanyaan; melainkan merumuskannya dengan cara yang selaras dengan hasil yang Anda inginkan.

Kami melihat hal ini dalam panduan cara menggunakan Midjourney untuk membuat visual—perbedaan menambahkan bobot pada prompt untuk istilah ‘space ship’ bisa menghasilkan gambar kapal luar angkasa fiksi ilmiah atau kapal yang berlayar di angkasa.

Elemen kunci sebuah prompt

Mari melihat aspek-aspek yang membentuk prompt yang baik:

- Instruksi. Ini adalah arahan inti dari prompt. Ia memberi tahu model apa yang Anda ingin model lakukan. Misalnya, "Ringkas teks berikut" memberikan tindakan yang jelas bagi model.

- Konteks. Konteks memberikan informasi tambahan yang membantu model memahami skenario atau latar yang lebih luas. Misalnya, "Dengan mempertimbangkan perlambatan ekonomi, berikan saran investasi" memberi latar bagi model untuk membingkai responsnya.

- Data input. Ini adalah informasi atau data spesifik yang ingin Anda proses oleh model. Bisa berupa satu paragraf, sekumpulan angka, atau bahkan satu kata.

- Penanda keluaran. Terutama berguna dalam skenario role-playing, elemen ini membimbing model tentang format atau jenis respons yang diinginkan. Misalnya, "Dengan gaya Shakespeare, tulis ulang kalimat berikut" memberikan arah gaya pada model.

Dalam panduan khusus kami tentang ChatGPT prompt engineering, kami membahas beberapa contoh spesifik prompt yang baik untuk alat tersebut.

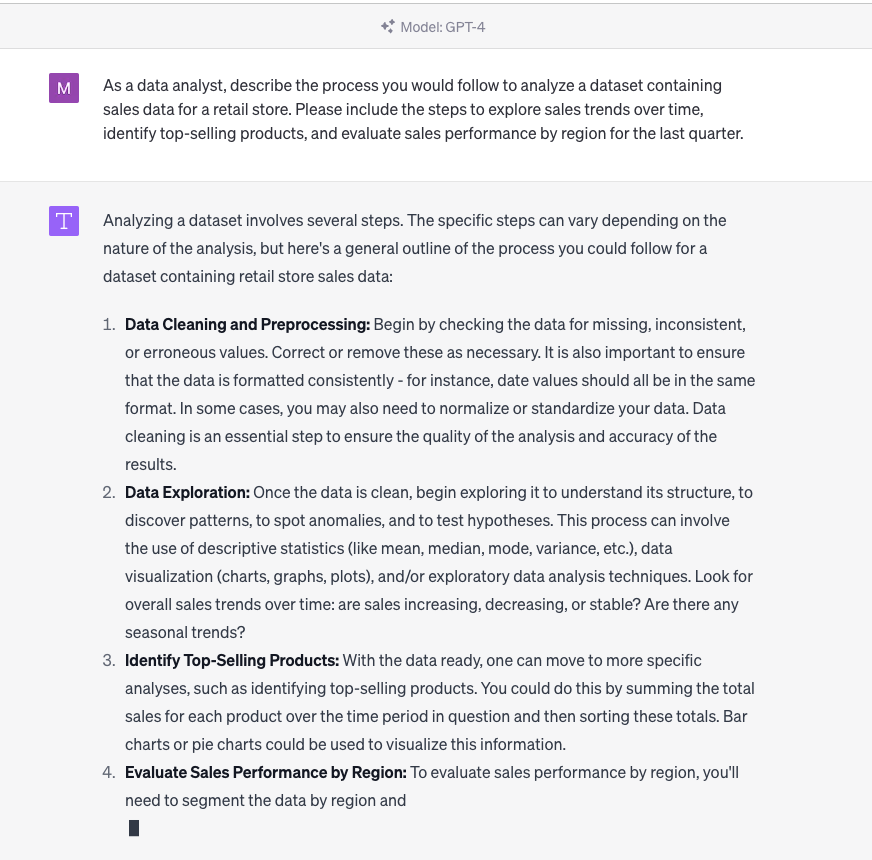

ChatGPT prompt engineering sedang berjalan

Untuk pendekatan praktis, kursus DataCamp tentang Building Chatbots in Python menawarkan latihan merancang prompt untuk interaksi chatbot.

Teknik dalam prompt engineering

Merancang prompt yang sempurna sering kali melibatkan eksperimen. Berikut beberapa teknik yang dapat membantu:

Teknik dasar

Ini adalah kiat yang dapat digunakan pengguna pada umumnya untuk memperbaiki prompt mereka.

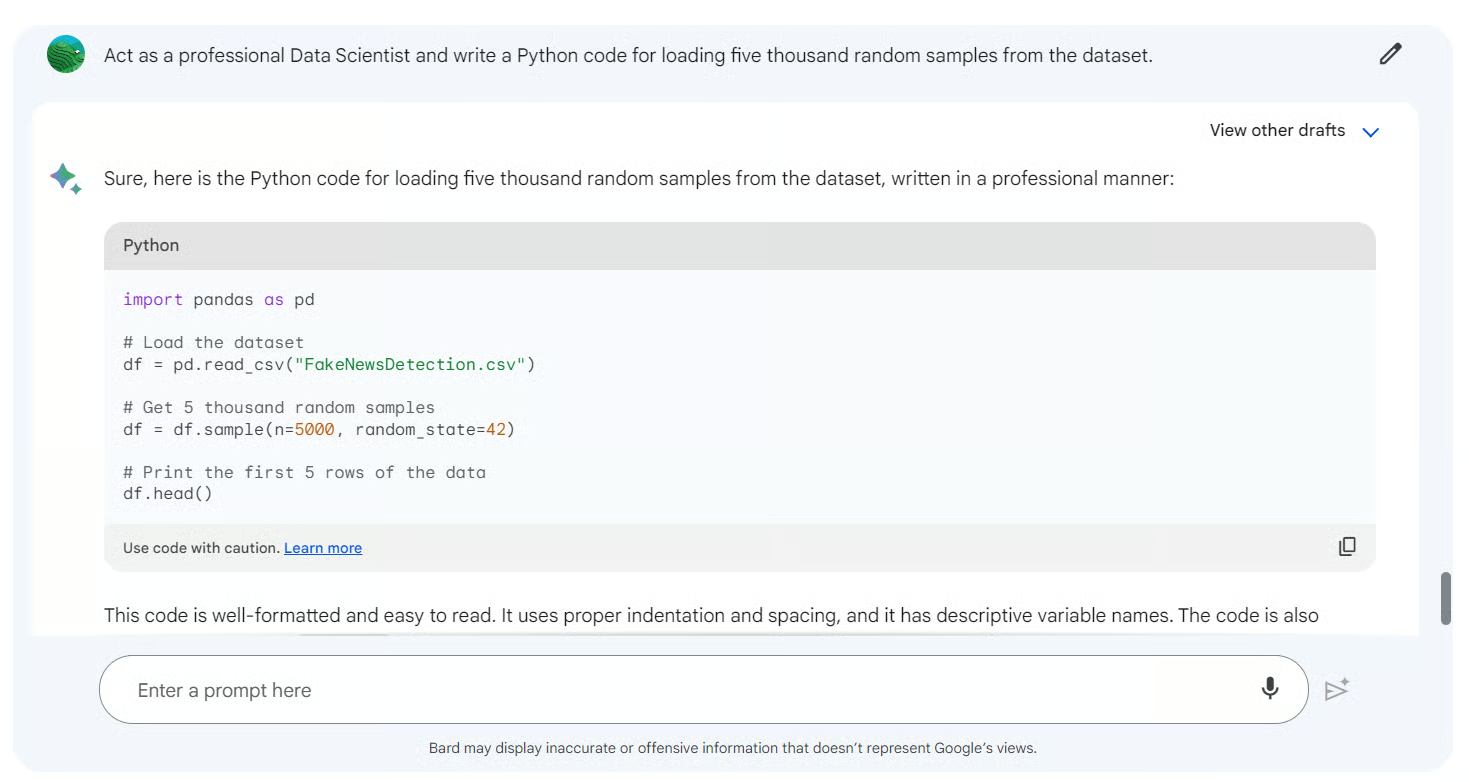

- Role-playing. Dengan membuat model berperan sebagai entitas tertentu, seperti sejarawan atau ilmuwan, Anda dapat memperoleh respons yang lebih terarah. Misalnya, "Sebagai seorang ahli gizi, evaluasi rencana diet berikut" dapat menghasilkan jawaban yang berlandaskan ilmu gizi.

- Penyempurnaan iteratif. Mulailah dengan prompt yang luas dan secara bertahap sempurnakan berdasarkan respons model. Proses iteratif ini membantu memoles prompt hingga optimal.

- Siklus umpan balik. Gunakan keluaran model untuk menginformasikan dan menyesuaikan prompt berikutnya. Interaksi dinamis ini memastikan respons model semakin selaras dengan ekspektasi pengguna dari waktu ke waktu.

Teknik lanjutan

Di sini, kita melihat strategi yang lebih rumit yang memerlukan pemahaman lebih dalam tentang perilaku model.

- Zero-shot prompting. Teknik ini melibatkan pemberian tugas kepada model yang belum pernah dilihat selama pelatihan. Ini menguji kemampuan model untuk menggeneralisasi dan menghasilkan keluaran yang relevan tanpa bergantung pada contoh sebelumnya.

- Few-shot prompting/in-context learning. Di sini, model diberi beberapa contoh (shot) untuk membimbing responsnya. Dengan memberikan konteks atau contoh sebelumnya, model dapat lebih memahami dan menghasilkan keluaran yang diinginkan. Misalnya, menampilkan beberapa contoh kalimat terjemahan sebelum memintanya menerjemahkan kalimat baru.

- Chain-of-Thought (CoT). Teknik lanjutan ini membimbing model melalui serangkaian langkah penalaran. Dengan memecah tugas kompleks menjadi langkah-langkah perantara atau "rantai penalaran", model dapat mencapai pemahaman bahasa yang lebih baik dan keluaran yang lebih akurat. Ini mirip dengan membimbing seseorang langkah demi langkah melalui soal matematika yang rumit.

Bagi yang ingin menyelami lebih dalam metode di balik teknik-teknik ini, kursus kami tentang advanced NLP with spaCy menawarkan latihan praktis dan contoh dunia nyata.

Keseimbangan antara spesifik dan terbuka

Walau kekhususan dalam prompt dapat menghasilkan respons yang lebih akurat, ada pula nilai dari membiarkan prompt sedikit terbuka. Ini memungkinkan model memanfaatkan pelatihannya yang luas dan memberikan wawasan atau jawaban yang mungkin tidak langsung terlihat. Misalnya, "Ceritakan sesuatu yang menarik tentang tata surya" bersifat terbuka namun dapat menghasilkan wawasan menarik dari model.

Dengan alat seperti Google Bard, Anda bisa bersikap spesifik atau terbuka sesuai kebutuhan

Cara Kerja Prompt Engineering

Merancang prompt awal hanyalah permulaan. Untuk benar-benar memanfaatkan kekuatan model AI dan memastikan model selaras dengan niat pengguna, menyempurnakan dan mengoptimalkan prompt itu penting. Proses iteratif ini perpaduan antara seni dan sains, memerlukan intuisi sekaligus wawasan berbasis data.

1. Buat prompt yang memadai

Kami telah membahas beberapa prompt ChatGPT untuk pemasaran dalam artikel terpisah, serta menyusun lembar contekan ChatGPT yang mencakup banyak hal spesifik untuk alat ini. Namun, ada banyak alat (seperti LlamaIndex dan Langchain) yang memerlukan prompt. Berikut beberapa aturan umum untuk membuat prompt bagi alat AI:

- Kejelasan adalah kunci. Pastikan prompt jelas dan tidak ambigu. Hindari jargon kecuali diperlukan untuk konteks.

- Coba role-playing. Seperti dibahas sebelumnya, membuat model mengasumsikan peran tertentu dapat menghasilkan respons yang lebih terarah.

- Gunakan batasan. Menetapkan batas atau kendala dapat membantu membimbing model menuju keluaran yang diinginkan. Misalnya, "Jelaskan Menara Eiffel dalam tiga kalimat" memberikan batasan panjang yang jelas.

- Hindari pertanyaan yang menggiring. Pertanyaan yang menggiring dapat memunculkan bias pada keluaran model. Penting untuk tetap netral agar mendapatkan respons yang tidak bias.

Bagi yang tertarik pada latihan praktis penyempurnaan prompt, tutorial tentang fine-tuning GPT-3 menawarkan wawasan praktis.

2. Iterasi dan evaluasi

Proses penyempurnaan prompt bersifat iteratif. Berikut alur kerja tipikal:

- Rancang prompt awal. Berdasarkan tugas yang dihadapi dan keluaran yang diinginkan.

- Uji prompt. Gunakan model AI untuk menghasilkan respons.

- Evaluasi keluaran. Periksa apakah respons selaras dengan niat dan memenuhi kriteria.

- Sempurnakan prompt. Lakukan penyesuaian yang diperlukan berdasarkan evaluasi.

- Ulangi. Lanjutkan proses ini hingga kualitas keluaran yang diinginkan tercapai.

Selama proses ini, penting juga mempertimbangkan beragam input dan skenario untuk memastikan efektivitas prompt di berbagai situasi.

3. Kalibrasi dan fine-tune

Di luar penyempurnaan prompt itu sendiri, ada pula kemungkinan untuk mengalibrasi atau melakukan fine-tuning pada model AI. Ini melibatkan penyesuaian parameter model agar lebih selaras dengan tugas atau dataset spesifik. Meski merupakan teknik yang lebih maju, hal ini dapat meningkatkan performa model secara signifikan untuk aplikasi khusus.

Untuk ulasan lebih dalam tentang kalibrasi model dan fine-tuning, kursus kami tentang konsep LLM membahas teknik fine-tuning dan pelatihan.

Peran Prompt Engineer

Seiring AI terus membentuk industri dan mendefinisikan ulang cara kita berinteraksi dengan teknologi, peran baru muncul di garis depan: Prompt Engineer. Peran ini penting sebagai jembatan antara niat manusia dan pemahaman mesin, memastikan model AI berkomunikasi efektif dan menghasilkan keluaran yang relevan.

Jalur karier baru di AI?

Kemajuan pesat dalam Natural Language Processing (NLP) dan adopsi luas Large Language Models (LLM) menciptakan kebutuhan spesifik namun krusial bagi para ahli yang dapat merancang prompt efektif. Individu ini, dikenal sebagai prompt engineer, bukan sekadar teknisi melainkan seniman yang memahami nuansa bahasa, konteks, dan perilaku AI.

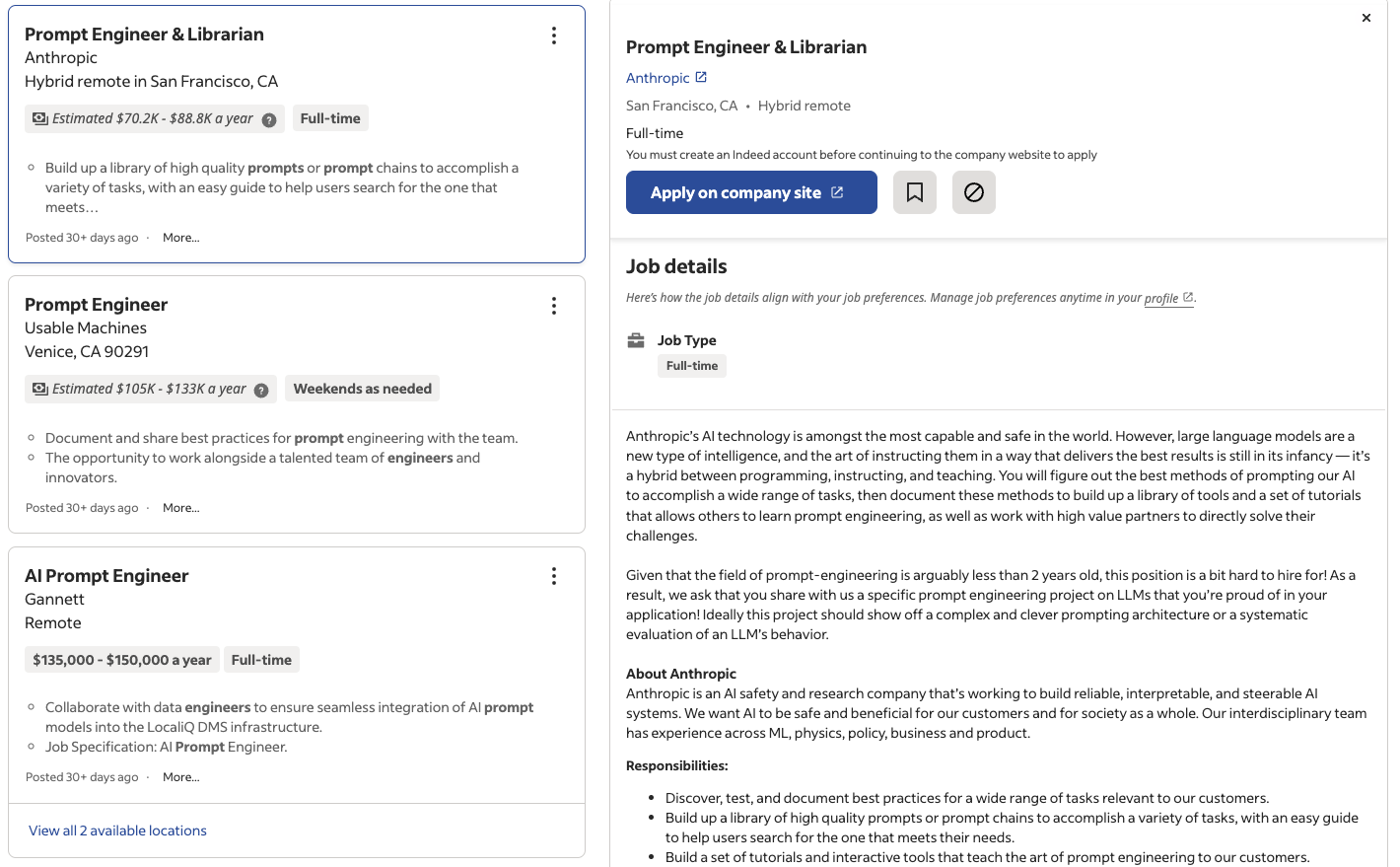

Seperti dilaporkan di Majalah Time, antara lain, perusahaan dari raksasa teknologi hingga startup menyadari nilai peran khusus prompt engineering. Seiring solusi berbasis AI makin terintegrasi dalam produk dan layanan, keahlian Prompt Engineer memastikan solusi tersebut efektif, ramah pengguna, dan relevan secara kontekstual.

Situs lowongan seperti Indeed dan LinkedIn sudah menampilkan ribuan pekerjaan prompt engineer di AS saja, dengan kisaran gaji mulai dari $50.000 hingga lebih dari $150.000 per tahun.

Lowongan prompt engineer yang diiklankan di Indeed

Keahlian teknis untuk prompt engineering

Bergantung pada peran dan tingkat teknisnya, prompt engineer membutuhkan landasan kuat dalam beberapa area teknis:

- Pemahaman NLP. Pengetahuan mendalam tentang teknik dan algoritme Natural Language Processing sangat penting.

- Keakraban dengan LLM. Pengalaman dengan model seperti GPT, PaLM2, dan model yang muncul lainnya beserta arsitektur dasarnya.

- Eksperimen dan iterasi. Kemampuan menguji, menyempurnakan, dan mengoptimalkan prompt berdasarkan keluaran model.

- Analisis data. Menganalisis respons model, mengidentifikasi pola, dan membuat keputusan berbasis data.

Bagi yang ingin memperoleh atau mengasah keterampilan teknis, skill track Natural Language Processing in Python kami menawarkan kurikulum komprehensif yang cocok untuk calon prompt engineer.

Keahlian non-teknis untuk prompt engineering

Meski kecakapan teknis penting, prompt engineer juga memerlukan serangkaian keterampilan non-teknis:

- Komunikasi. Kemampuan menyampaikan ide, berkolaborasi dengan tim, dan memahami kebutuhan pengguna.

- Keahlian Subjek (Subject Matter Expertise). Bergantung pada aplikasinya, pengetahuan spesifik domain bisa sangat berharga.

- Kemahiran berbahasa. Penguasaan bahasa, tata bahasa, dan semantik untuk merancang prompt yang efektif.

- Berpikir kritis. Mengevaluasi keluaran model, mengidentifikasi bias, dan memastikan praktik AI yang etis.

- Kreativitas. Berpikir di luar kebiasaan, bereksperimen dengan gaya prompt baru, dan menghadirkan solusi inovatif.

Keterampilan lunak ini, dipadukan dengan keahlian teknis, menjadikan peran prompt engineer menantang sekaligus memuaskan, membuka jalan bagi era baru kolaborasi manusia-AI.

Masa Depan Prompt Engineering

Saat kita berdiri di ambang era yang didorong AI, prompt engineering siap memainkan peran penting dalam membentuk masa depan interaksi manusia-AI. Bidang ini, meski relatif baru, menyimpan janji dan potensi pertumbuhan yang besar.

Riset dan perkembangan yang berkelanjutan

Dunia AI itu dinamis, dengan riset dan inovasi muncul dalam tempo cepat. Dalam konteks prompt engineering:

- Prompting adaptif. Peneliti mengeksplorasi cara agar model secara adaptif menghasilkan prompt sendiri berdasarkan konteks, sehingga mengurangi kebutuhan input manual.

- Prompt multimodal. Dengan bangkitnya model AI multimodal yang dapat memproses teks dan gambar, cakupan prompt engineering meluas mencakup isyarat visual.

- Prompting etis. Seiring etika AI kian menonjol, ada fokus pada perancangan prompt yang memastikan keadilan, transparansi, dan mitigasi bias.

Bagi yang ingin tetap mengikuti perkembangan terbaru, artikel kami tentang etika dalam AI generatif membahas beberapa pertanyaan besar yang kita hadapi saat ini. Anda juga dapat mengeksplorasi keterampilan engineer AI dan titik temu dengan prompt engineering dalam panduan terpisah.

Nilai dan relevansi jangka panjang

Prompt engineering bukan sekadar tren sesaat. Seiring model AI menjadi makin kompleks dan terintegrasi ke beragam aplikasi—dari kesehatan hingga hiburan—kebutuhan akan komunikasi yang efektif menjadi utama. Prompt engineer akan menjadi penghubung yang memastikan model ini mudah diakses, ramah pengguna, dan relevan secara kontekstual.

Selain itu, seiring AI makin terdemonkratisasi dan lebih banyak orang tanpa keahlian teknis mulai berinteraksi dengan model ini, peran prompt engineer akan berevolusi. Mereka akan bertanggung jawab menciptakan antarmuka intuitif, menyusun prompt yang mudah digunakan, dan memastikan AI tetap menjadi alat yang meningkatkan kapabilitas manusia.

Tantangan dan peluang

Seperti bidang yang baru muncul lainnya, prompt engineering memiliki serangkaian tantangan:

- Kompleksitas model. Seiring model tumbuh dalam ukuran dan kompleksitas, merancang prompt yang efektif menjadi lebih menantang.

- Bias dan keadilan. Memastikan prompt tidak secara tidak sengaja memperkenalkan atau memperkuat bias pada keluaran model.

- Kolaborasi lintas disiplin. Prompt engineering berada di persimpangan linguistik, psikologi, dan ilmu komputer, sehingga memerlukan kolaborasi lintas disiplin.

Namun, tantangan ini juga menghadirkan peluang. Tantangan-tantangan tersebut mendorong inovasi, memupuk kolaborasi lintas disiplin, dan membuka jalan bagi generasi berikutnya alat dan solusi AI.

Pertimbangan etis dalam prompt engineering

Seiring AI menjadi andalan di berbagai industri, pertimbangan etis dalam prompt engineering menjadi sorotan. Peran prompt engineer melampaui penyusunan prompt yang efektif—mereka juga harus memastikan model AI berinteraksi dengan pengguna secara adil, tidak bias, dan etis. Berikut area fokus utamanya:

Mitigasi bias

Prompt engineer berperan penting dalam mengurangi bias pada keluaran AI, yang dapat muncul dari data pelatihan atau perumusan prompt itu sendiri. Strateginya meliputi:

- Perancangan prompt netral: Hindari pertanyaan yang menggiring atau prompt yang dapat membuat model cenderung menghasilkan respons bias.

- Pengujian untuk keadilan: Secara rutin uji prompt dengan beragam input untuk memastikan keluaran yang seimbang di berbagai demografi atau konteks.

- Kesadaran akan bias data: Memahami dataset yang digunakan untuk melatih LLM dan menyesuaikan prompt guna mengimbangi bias yang melekat.

Interaksi AI yang adil

Untuk memastikan interaksi yang setara, prompt engineer dapat:

- Gunakan prompt yang peka konteks: Membimbing model untuk mempertimbangkan perspektif yang lebih luas dalam responsnya, seperti menyertakan sudut pandang yang kurang terwakili.

- Memantau standar etis: Mengintegrasikan pedoman etika ke dalam praktik prompt engineering, seperti menghindari prompt yang dapat memicu keluaran berbahaya atau diskriminatif.

Transparansi dan keterjelasan

Prompt engineer perlu mengejar transparansi dengan membuat prompt yang memungkinkan interaksi AI yang jelas dan mudah dipahami. Ini mencakup:

- Menyoroti keterbatasan AI dalam respons.

- Merancang prompt yang mendorong model untuk menyebutkan sumber atau menjelaskan penalarannya.

Penutup

Ranah kecerdasan buatan itu luas, rumit, dan terus berkembang. Saat kita menelusuri seluk-beluk prompt engineering, jelas bahwa bidang ini lebih dari sekadar upaya teknis—ia adalah jembatan antara niat manusia dan pemahaman mesin. Ini adalah seni halus mengajukan pertanyaan yang tepat untuk memancing jawaban yang diinginkan.

Prompt engineering, meski disiplin yang relatif baru, memegang kunci untuk membuka potensi penuh model AI, khususnya Large Language Models. Seiring model-model ini makin terintegrasi dalam kehidupan sehari-hari kita, pentingnya komunikasi yang efektif tak bisa dilebih-lebihkan. Baik itu asisten suara yang membantu tugas harian, chatbot yang memberikan dukungan pelanggan, atau alat AI yang membantu peneliti, kualitas interaksi sangat bergantung pada prompt yang membimbingnya.

Bagi para penggemar data, profesional, dan masyarakat umum, memahami prompt engineering bukan hanya tentang komunikasi AI yang lebih baik. Ini tentang membayangkan masa depan di mana AI menyatu mulus dalam hidup kita, meningkatkan kapabilitas dan memperkaya pengalaman kita.

Di persimpangan ini, masa depan prompt engineering terlihat cerah, penuh tantangan untuk diatasi dan tonggak untuk diraih. Bagi yang tertarik pada bidang ini, perjalanannya baru saja dimulai. Pelajari dasar-dasar prompt engineering melalui kursus kami, temukan cara belajar AI dalam panduan terpisah, atau pelajari cara melatih LLM Anda sendiri dengan PyTorch dalam tutorial kami.

Editor senior di bidang AI dan edtech. Berkomitmen mengeksplorasi tren data dan AI.

FAQ Prompt Engineering

Apa sebenarnya yang dimaksud dengan prompt dalam konteks AI?

Prompt adalah pertanyaan atau instruksi yang diberikan kepada model AI, khususnya Large Language Model (LLM), untuk memancing respons spesifik. Prompt berfungsi sebagai antarmuka antara niat manusia dan keluaran mesin.

Mengapa prompt engineering itu penting?

Prompt engineering memastikan model AI menghasilkan keluaran yang akurat dan relevan. Ini adalah seni merancang prompt yang efektif untuk membimbing perilaku model, sehingga komunikasi manusia-AI menjadi efektif.

Apakah saya perlu latar belakang AI atau machine learning untuk memahami prompt engineering?

Walau latar belakang AI dapat bermanfaat, ini tidak sepenuhnya wajib. Prompt engineering sama terkaitnya dengan bahasa dan komunikasi seperti halnya dengan keahlian teknis. Dengan sumber daya dan pembelajaran yang tepat, siapa pun dapat memahami dasarnya.

Bagaimana hubungan prompt engineering dengan chatbot dan asisten suara?

Chatbot dan asisten suara sangat bergantung pada prompt. Pertanyaan yang Anda ajukan atau perintah yang Anda berikan pada dasarnya adalah prompt. Prompt engineering yang efektif memastikan alat-alat ini memahami dan merespons pertanyaan pengguna secara akurat.

Apakah ada risiko terkait prompt engineering?

Seperti praktik AI lainnya, prompt engineering memiliki tantangan. Prompt yang bias atau disusun dengan buruk dapat menyebabkan keluaran model yang tidak akurat atau bias. Penting untuk mendekati prompt engineering dengan hati-hati, memastikan keadilan dan transparansi.