Programma

Quando ho iniziato a lavorare con applicazioni containerizzate, gestire manualmente una manciata di container era fattibile, ma scalarle richiedeva un approccio diverso. Ed è qui che le piattaforme di orchestrazione dei container diventano essenziali: due nomi spiccano costantemente, Docker Swarm e Kubernetes.

L’orchestrazione dei container automatizza il deployment, la gestione, lo scaling e il networking dei container su cluster di macchine. Scegliere la piattaforma giusta può avere un impatto significativo sulla produttività del tuo team, sui costi operativi e sulle capacità di scalabilità.

In questa guida confronterò in modo completo Docker Swarm e Kubernetes, aiutandoti a scegliere la piattaforma migliore per le tue esigenze, che tu stia gestendo una piccola startup o un’infrastruttura enterprise.

Se sei nuovo su Docker, ti consiglio di iniziare con il nostro corso Introduction to Docker. Assicurati anche di leggere il nostro tutorial su come eseguire Claude Code in Docker.

Che cos’è Docker Swarm?

Cominciamo esplorando Docker Swarm, la più semplice delle due piattaforme.

Docker Swarm è la soluzione di orchestrazione nativa di Docker che trasforma più host Docker in un unico host virtuale. La trovo particolarmente interessante per la sua integrazione senza soluzione di continuità con l’ecosistema Docker che molti team già utilizzano.

Logo di Docker Swarm

Integrato direttamente nel Docker Engine, Swarm estende le capacità di Docker per gestire container distribuiti su più macchine. Abilitare la modalità Swarm crea un cluster che distribuisce i carichi in modo intelligente, mantiene un’alta disponibilità e scala i servizi senza la complessità tipica delle piattaforme di orchestrazione.

Se hai ancora dubbi su Docker e sulle sue funzionalità, e su come si confrontano con Kubernetes, ti consiglio i nostri altri articoli comparativi su Kubernetes vs Docker e Docker Compose vs Kubernetes.

Nota: Sebbene la modalità Swarm resti funzionante e riceva aggiornamenti di sicurezza, lo sviluppo attivo di nuove funzionalità si è significativamente rallentato a favore di soluzioni basate su Kubernetes.

Architettura e componenti di Docker Swarm

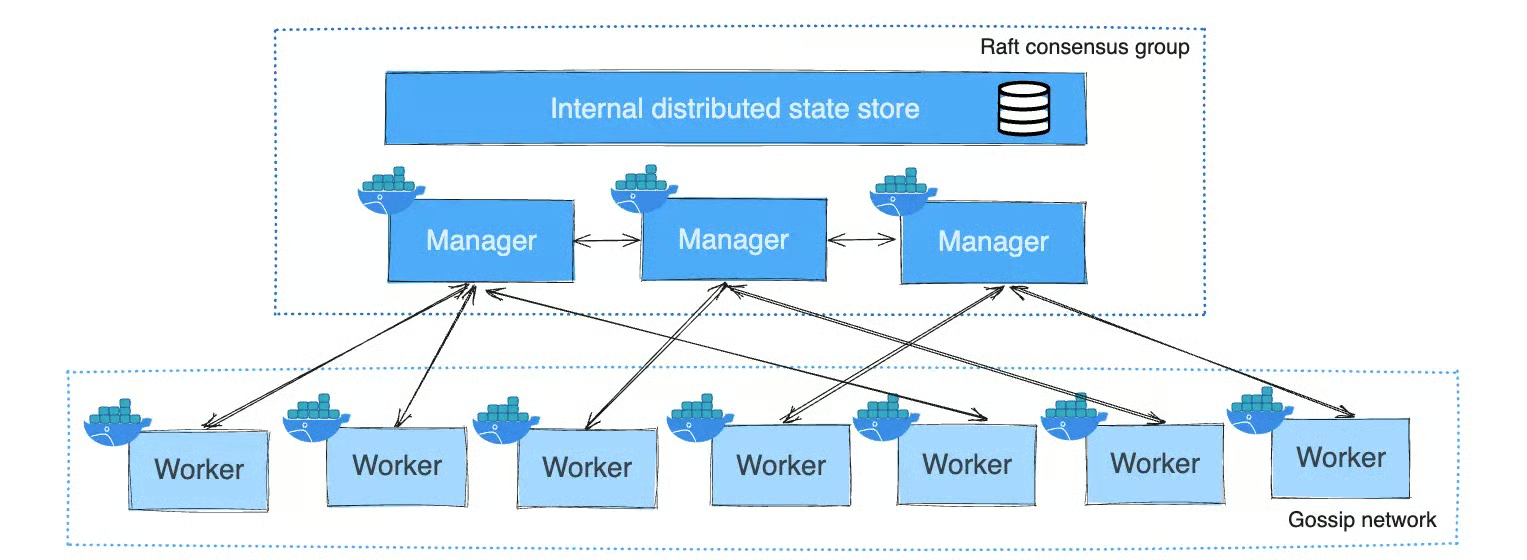

Docker Swarm segue un modello manager-worker. I nodi manager orchestrano e mantengono lo stato del cluster, mentre i nodi worker eseguono i task. I manager possono anche eseguire carichi di lavoro oppure essere dedicati solo all’orchestrazione.

Utilizza l’algoritmo di consenso Raft, che nomina un singolo leader tra i nodi manager incaricato di tutte le decisioni di gestione del cluster. Le decisioni richiedono l’accordo della maggioranza dei manager. In questo modo, Docker Swarm garantisce che lo stato del cluster rimanga coerente tra i manager, consentendo il funzionamento nonostante guasti di singoli nodi manager.

I servizi sono definiti in file YAML simili a Docker Compose, specificando lo stato dell’applicazione, incluse repliche, reti e risorse

Ora che abbiamo compreso l’architettura, vediamo cosa può fare Docker Swarm per te.

Funzionalità principali di Docker Swarm

Docker Swarm include diverse funzionalità integrate per un’orchestrazione dei container accessibile:

- Service discovery: Avviene automaticamente tramite DNS integrato, permettendo ai container di trovarsi usando i nomi dei servizi

- Load balancing: Integrato tramite una routing mesh che distribuisce le richieste tra repliche in salute su nodi diversi

- Rolling update: Consentono aggiornamenti graduali dei servizi con parallelismo e ritardi configurabili, e rollback rapidi in caso di problemi

- Alta disponibilità: Ottenuta tramite replica dei servizi e ripianificazione automatica in caso di guasti

- Overlay networking: Consente la comunicazione tra container su host diversi, con cifratura opzionale per il traffico dati applicativo (non abilitata di default)

Funzionalità principali di Docker Swarm

Queste funzionalità lavorano insieme per un’orchestrazione pronta per la produzione senza configurazioni estese. La semplicità di queste feature integrate è ciò che rende Docker Swarm così interessante per i team che vogliono partire rapidamente.

Vantaggi di Docker Swarm

Chiarite le funzionalità, ecco dove Docker Swarm dà il meglio. Offre diversi vantaggi notevoli:

- Setup rapido: Per inizializzare un cluster basta docker swarm init

- Curva di apprendimento morbida: Se conosci Docker, sei già a metà strada: usi comandi CLI familiari e formati Docker Compose

- Integrazione nativa: Elimina la necessità di nuove API o software aggiuntivo

- Perfetto per progetti piccoli e medi: Fornisce l’orchestrazione essenziale senza complessità eccessiva

- Minore overhead di risorse: È possibile eseguire più container applicativi sullo stesso hardware rispetto a Kubernetes, risultando conveniente per deployment più piccoli

Questi vantaggi rendono Docker Swarm particolarmente attraente per startup, piccoli team di sviluppo e organizzazioni che privilegiano la velocità di implementazione rispetto a set di funzionalità estesi. La bassa barriera d’ingresso significa che puoi orchestrare container in produzione in poche ore, non giorni o settimane.

Svantaggi di Docker Swarm

Ovviamente nessuna piattaforma è perfetta. Ecco le principali limitazioni da considerare:

- Limiti di scalabilità: Non eguaglia Kubernetes per migliaia di nodi o carichi altamente complessi

- Ecosistema più piccolo: Meno strumenti di terze parti e risorse della community

- Estensibilità limitata: Il forte legame con le API Docker limita le personalizzazioni avanzate

- Funzionalità avanzate mancanti: Autoscaling sofisticato e policy di rete complesse sono assenti o richiedono workaround

- Gestione multi-cluster debole: Capacità minime, complicato per deployment distribuiti geograficamente

- Challenge con workload stateful: Database che richiedono orchestrazione dello storage sofisticata sono più difficili da gestire

- Sviluppo rallentato: Lo sviluppo attivo di funzionalità si è in gran parte fermato, con Docker focalizzato su soluzioni basate su Kubernetes. Questo è diverso dal "Classic Swarm", che è stato completamente deprecato e rimosso in Docker v23.0

Sebbene queste limitazioni siano reali, diventano un problema solo se il tuo caso d’uso richiede effettivamente tali capacità avanzate. Per molti progetti, il set di funzionalità di Docker Swarm è più che adeguato, e la semplicità ripaga ampiamente.

La domanda non è se Swarm abbia limitazioni, ma se queste limitazioni contino per le tue esigenze specifiche. Se vuoi esplorare strumenti alternativi, leggi il nostro articolo sulle migliori alternative a Docker nel 2026.

Che cos’è Kubernetes?

Dopo aver trattato Docker Swarm, concentriamoci su Kubernetes, l’alternativa più potente ma anche più complessa.

Kubernetes (K8s) rappresenta lo standard del settore per l’orchestrazione dei container. Sviluppato originariamente da Google e ora mantenuto dalla Cloud Native Computing Foundation, è stato creato per gestire applicazioni containerizzate su larga scala. Per un’introduzione più dettagliata, leggi la nostra guida What is Kubernetes?.

Logo di Kubernetes

Kubernetes offre una piattaforma pensata per affrontare praticamente tutte le sfide di produzione con i container. Oltre all’orchestrazione di base, propone molte soluzioni per storage persistente, gestione della configurazione, gestione dei secret e job processing.

La sua ampia adozione ha creato un enorme ecosistema di strumenti e servizi.

Architettura e componenti di Kubernetes

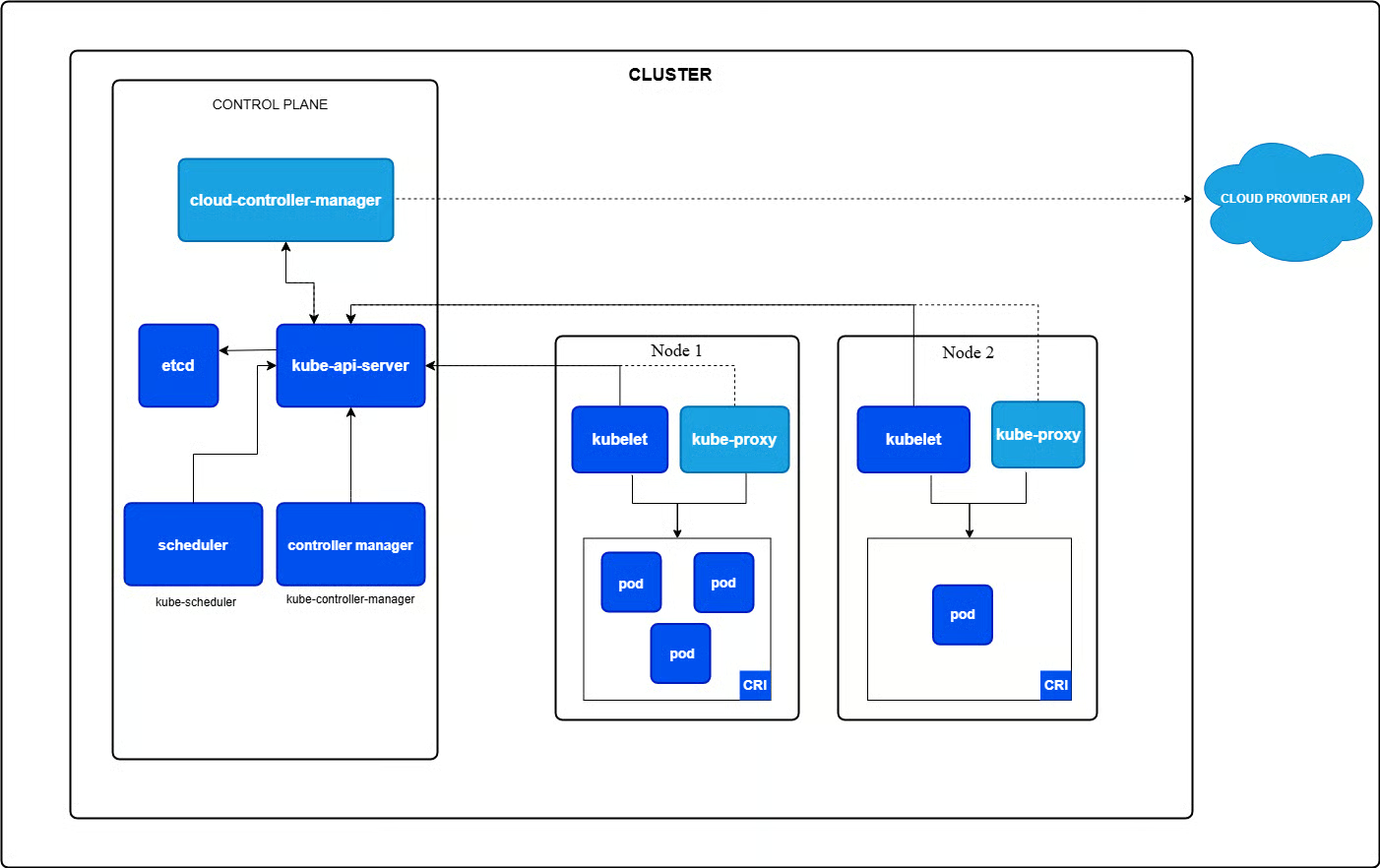

Kubernetes utilizza una topologia master-worker, con il master chiamato control plane. I componenti chiave del control plane includono:

- kube-apiserver: Il server del componente principale che espone le API HTTP di Kubernetes

- etcd: Uno store distribuito key-value per i dati dell’API server

- kube-scheduler: Assegna i Pod ai nodi

- kube-controller-manager: Esegue i controller per implementare il comportamento dell’API di Kubernetes

- cloud-controller-manager: Opzionale; si integra con i cloud provider sottostanti

I nodi worker eseguono kubelet (comunica con il control plane), kube-proxy (gestisce il networking) e contengono i Pod, le unità di deployment più piccole che ospitano uno o più container che condividono risorse.

Componenti del cluster Kubernetes

Questa architettura distribuita è più complessa di quella di Docker Swarm, ma è ciò che consente la notevole scalabilità e resilienza di Kubernetes. Ogni componente ha un ruolo specifico e ben definito, e lavorano insieme per creare un sistema di orchestrazione altamente robusto.

Per approfondire, ti consiglio la nostra guida su Kubernetes Architecture.

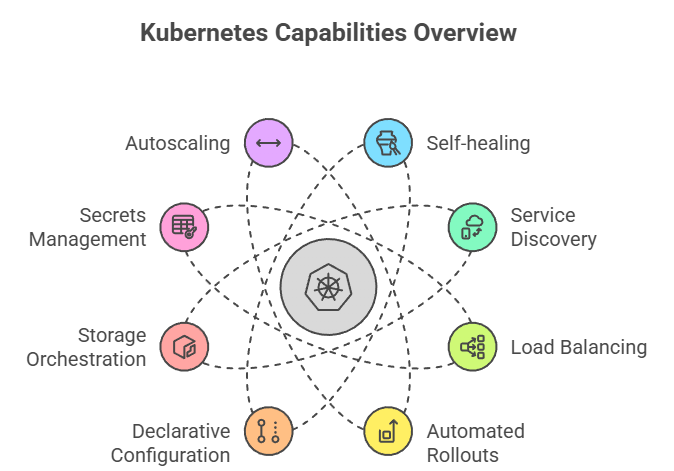

Funzionalità principali di Kubernetes

Con questa architettura, Kubernetes offre un ricco set di capacità. Propone funzionalità estese per operazioni container in produzione:

- Self-healing: Sostituisce automaticamente i container guasti, ripianifica i Pod quando i nodi si spengono e riavvia i container non sani

- Service discovery e load balancing: Nomi DNS integrati e distribuzione intelligente del traffico tra repliche di Pod

- Rollout e rollback automatizzati: Deployment sicuri con controllo granulare e ripristino automatico in caso di problemi

- Configurazione dichiarativa: Descrivi lo stato desiderato del cluster in file YAML, con Kubernetes che mantiene continuamente quello stato

- Orchestrazione dello storage: La Container Storage Interface supporta numerosi backend con provisioning dinamico

- Gestione dei secret: Gestisce in modo sicuro dati sensibili e configurazioni

- Autoscaling: L’autoscaling orizzontale regola le repliche basandosi su metriche, mentre quello verticale modifica le allocazioni di risorse

Panoramica delle capacità di Kubernetes

Questo set di funzionalità completo rende Kubernetes la scelta ideale per ambienti di produzione complessi. Mentre Docker Swarm fornisce le basi, Kubernetes offre capacità sofisticate che diventano essenziali man mano che l’infrastruttura cresce.

Vantaggi di Kubernetes

Ecco dove Kubernetes dimostra perché è diventato lo standard del settore. Kubernetes eccelle con deployment complessi e su larga scala:

- Scalabilità eccezionale: I cluster possono comprendere migliaia di nodi mantenendo le prestazioni

- Vasto ecosistema: Ampie integrazioni, servizi gestiti dei principali cloud provider e innumerevoli strumenti

- Scheduling avanzato: Regole di affinità, taint, tolleration e quote di risorse per un controllo preciso dei carichi

- Supporto multi-cloud: API coerenti consentono deployment multi-cloud e ibridi reali

- Gestione multi-cluster: Diversi strumenti (come Karmada, successore del deprecato KubeFed) permettono di gestire workload su più cluster per applicazioni globali

- Estensibilità: Custom Resource e Operator consentono di gestire praticamente qualsiasi tipo di workload

- Community attiva: Documentazione abbondante e competenze facilmente reperibili

Questi vantaggi spiegano perché Kubernetes è diventato sinonimo di orchestrazione dei container negli ambienti enterprise. Quando servono funzionalità di livello produttivo, un ampio tooling e una piattaforma che possa crescere con la tua organizzazione, Kubernetes è all’altezza.

Per vedere i punti di forza dello strumento in azione, dai un’occhiata a questo tutorial su Kubernetes.

Svantaggi di Kubernetes

Tutta questa potenza, però, ha un costo:

- Elevata complessità: Il setup di un cluster pronto per la produzione comporta numerose configurazioni e decisioni

- Curva di apprendimento ripida: Per padroneggiare Kubernetes è necessario comprendere molti componenti e best practice

- Maggiori requisiti di risorse: I componenti del control plane consumano risorse significative, aumentando l’overhead operativo

- Rischio di eccesso: Per team piccoli o applicazioni semplici, Kubernetes può introdurre complessità non necessaria

Comprendere questi trade-off è cruciale nella scelta tra le piattaforme. Gli svantaggi di Kubernetes non sono difetti: sono conseguenze intrinseche del suo design potente e flessibile. La domanda è se il tuo caso d’uso giustifichi l’accettazione di tale complessità.

Docker Swarm vs Kubernetes: confronto delle caratteristiche chiave

Dopo aver esplorato entrambe le piattaforme singolarmente, vediamo come si confrontano su dimensioni critiche.

|

Caratteristica |

Docker Swarm |

Kubernetes |

|

Setup |

Semplice (un solo comando) |

Complesso |

|

Curva di apprendimento |

Morbida |

Ripida |

|

Scalabilità |

~50-100 nodi |

Fino a 5.000 nodi |

|

Ecosistema |

Più piccolo |

Vasto |

|

Autoscaling |

Non integrato (richiede strumenti esterni) |

Automatico (HPA); VPA disponibile come add-on |

|

Ideale per |

Progetti piccoli-medi |

Scala enterprise |

Ora approfondiamo ogni area di confronto. Inizio da ciò che spesso è il primo contatto con qualsiasi piattaforma di orchestration: metterla in funzione.

Installazione, setup e curva di apprendimento

Installare Docker Swarm è semplice: con Docker Engine installato, un singolo comando docker swarm init crea un cluster. Aggiungere nodi richiede solo il join token. La maggior parte dei team può avere un cluster attivo in meno di un’ora.

Al contrario, l’installazione di Kubernetes varia a seconda dell’approccio. I servizi gestiti (AWS EKS, GKE, AKS) si occupano della maggior parte della complessità. Le installazioni self-managed richiedono kubectl, setup del networking, certificati e configurazione di etcd. Strumenti come kubeadm o k3s semplificano le cose, ma Kubernetes richiede comunque più lavoro di setup rispetto a Swarm.

La curva di apprendimento segue un pattern simile. Se già conosci i comandi Docker e i file Compose, Swarm risulta naturale: è essenzialmente Docker su scala. Kubernetes, invece, introduce concetti completamente nuovi (Pod, ReplicaSet, Service, Ingress) e un modello mentale più impegnativo da padroneggiare.

Strategie di deployment e gestione delle applicazioni

Una volta che il cluster è in esecuzione, ecco come differiscono gli approcci al deployment tra le due piattaforme.

Docker Swarm mantiene le cose semplici: le applicazioni vengono distribuite come servizi utilizzando file YAML compatibili con Docker Compose. Se hai usato Compose per lo sviluppo locale, riconoscerai subito il formato. I deployment di stack gestiscono più servizi insieme e i rolling update funzionano specificando le nuove versioni con parametri di aggiornamento configurabili.

Kubernetes adotta un approccio più sofisticato. Piuttosto che un singolo concetto di deployment, offre più tipi di risorse specializzate:

- Deployment per rolling update

- StatefulSet per app stateful che richiedono identità stabili

- DaemonSet per Pod specifici per nodo

- Job per attività batch.

Questa varietà offre potenza e flessibilità, ma richiede di capire quale tipo di risorsa si adatti al tuo caso d’uso. Strategie avanzate come canary e blue-green sono ben supportate da varie tecniche e strumenti di terze parti.

Scalabilità, alta disponibilità e prestazioni

Qui le piattaforme iniziano davvero a divergere in termini di capacità.

Docker Swarm gestisce bene la scalabilità per cluster piccoli e medi (tipicamente sotto i 50-100 nodi). Lo scaling è dichiarativo: specifichi le repliche desiderate e Swarm si adatta automaticamente. Le prestazioni sono buone con overhead ridotto, rendendolo efficiente per carichi più piccoli.

Il compromesso? Sei limitato a decisioni di scaling manuali; Swarm non aggiunge né rimuove repliche automaticamente in base a CPU o memoria.

Kubernetes, invece, eccelle nella scalabilità su più dimensioni. Primo, può gestire migliaia di nodi e decine di migliaia di Pod senza problemi. Secondo, e ancor più importante, scala in modo intelligente.

L’Horizontal Pod Autoscaler regola automaticamente le repliche basandosi su metriche, il Vertical Pod Autoscaler modifica le allocazioni di risorse e il Cluster Autoscaler gestisce persino il numero di nodi negli ambienti cloud. Questo scaling automatico rende Kubernetes notevolmente conveniente per carichi variabili.

Networking e bilanciamento del carico

Il networking è fondamentale, e ciascuna piattaforma adotta un approccio diverso per risolvere gli stessi problemi di base.

Docker Swarm include il bilanciamento del carico integrato tramite la sua routing mesh, che distribuisce il traffico automaticamente tra gli endpoint del servizio. Le reti overlay consentono comunicazioni cifrate tra container, mentre il service discovery funziona tramite DNS integrato. È un approccio "batterie incluse": tutto ciò di cui hai bisogno è integrato e configurato di default.

Kubernetes offre più flessibilità, al costo di maggiore configurazione. Il networking si basa sulla Container Network Interface (CNI), che supporta diverse soluzioni come Calico, Cilium e Flannel. Sei tu a scegliere quale usare.

Gli Ingress controller offrono un routing HTTP/HTTPS sofisticato con terminazione SSL. Le network policy consentono un controllo granulare del traffico tra Pod. Per casi avanzati, i service mesh come Istio possono integrarsi senza problemi per gestione del traffico, sicurezza e osservabilità. Questa modularità è potente, ma comporta più decisioni iniziali.

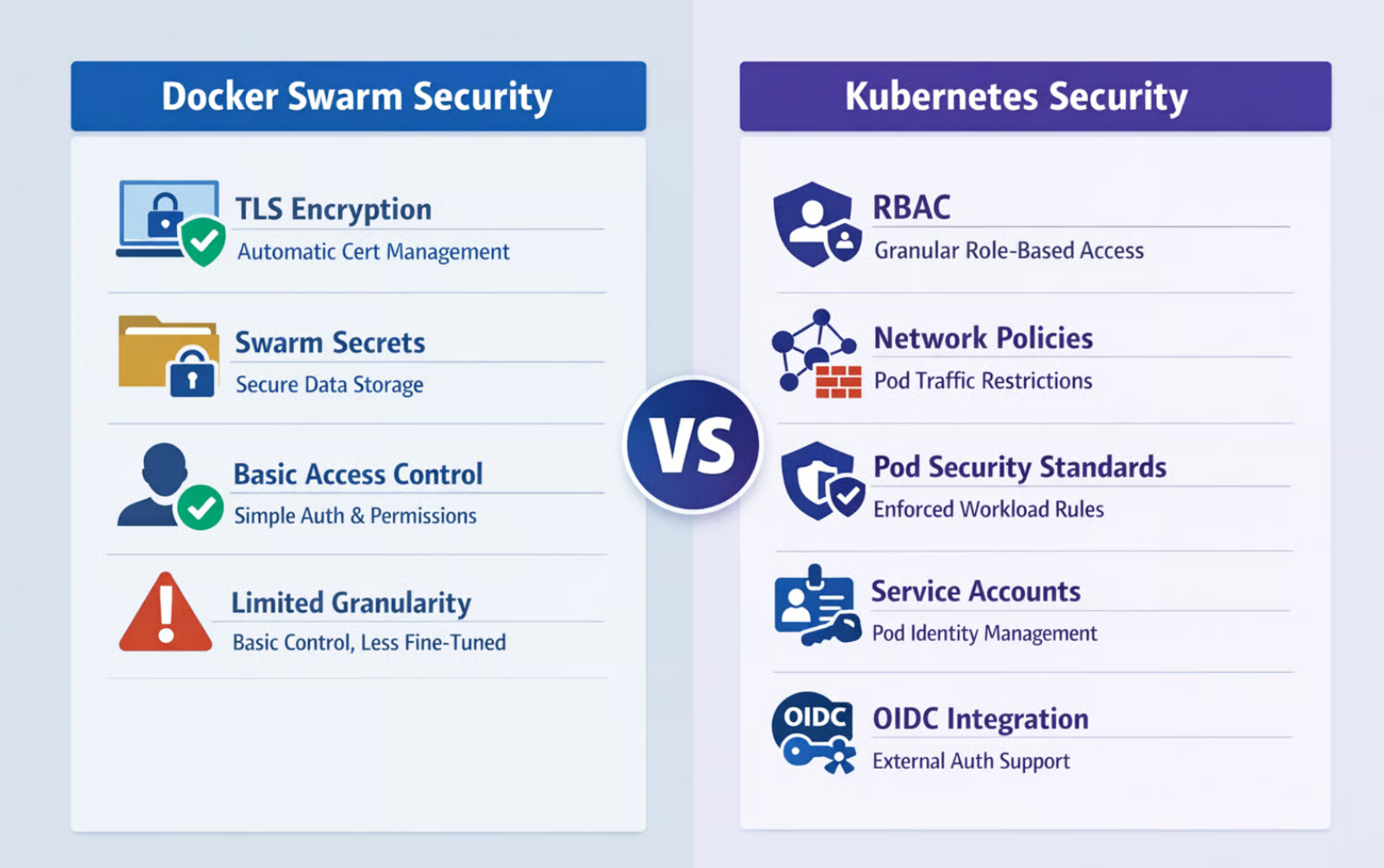

Sicurezza e controllo degli accessi

La sicurezza è fondamentale, e qui emerge chiaramente l’anima enterprise di Kubernetes.

Docker Swarm fornisce l’essenziale: cifratura TLS con gestione automatica dei certificati per mettere in sicurezza la comunicazione tra nodi, mentre Swarm Secrets offre archiviazione sicura per dati sensibili come password e chiavi API. Il controllo degli accessi si basa sui meccanismi di autenticazione di Docker. È semplice e sufficiente per molti casi d’uso, ma manca di controllo granulare.

Sicurezza: Docker Swarm vs. Kubernetes

Kubernetes offre una sicurezza completa, pensata per ambienti multi-tenant. Uno degli asset maggiori per deployment sicuri in team è l’RBAC (Role-Based Access Control), che offre permessi granulari sia a livello di namespace sia di cluster. Puoi specificare esattamente chi può fare cosa con quali risorse.

Le network policy limitano il traffico tra Pod in base a label e regole. I Pod Security Standards impongono vincoli di sicurezza sulle specifiche dei workload. Gli account di servizio forniscono identità ai Pod, con supporto per l’integrazione con sistemi di autenticazione esterni tramite OIDC e altri protocolli.

Questo modello di sicurezza esteso rende Kubernetes adatto a settori regolamentati ed esigenze organizzative complesse.

Storage e persistenza dei dati

Per i dati persistenti, è un’area in cui le filosofie progettuali delle piattaforme diventano molto chiare.

Docker Swarm supporta volumi locali e nominati, adeguati per casi semplici. Tuttavia, la gestione dello storage rimane basilare, il provisioning dinamico è limitato e coordinare lo storage tra repliche per applicazioni stateful complesse diventa impegnativo. Spesso servono strumenti esterni o configurazioni manuali per esigenze che vadano oltre il semplice mount di volumi.

Kubernetes è stato progettato fin dall’inizio pensando ai workload stateful. Fornisce PersistentVolume (PV) come risorse di storage a livello di cluster e PersistentVolumeClaim (PVC) che consentono alle applicazioni di richiedere storage senza conoscere i dettagli sottostanti.

Le StorageClass abilitano il provisioning dinamico, con lo storage creato automaticamente quando necessario. La Container Storage Interface supporta numerosi provider con funzionalità avanzate come snapshot, cloning ed espansione. Gli StatefulSet coordinano lo storage con l’identità dei Pod, rendendo possibile l’esecuzione affidabile di database distribuiti complessi.

Questa sofisticazione rende Kubernetes la scelta chiara per i workload stateful.

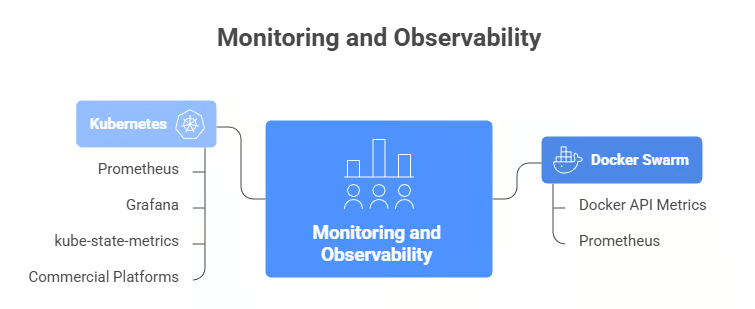

Monitoring, osservabilità e strumenti operativi

L’osservabilità ti aiuta a capire cosa accade nel cluster, ma la maturità dell’ecosistema varia in modo netto.

Docker Swarm offre metriche di base tramite le API di Docker, che ti danno visibilità sulla salute di container e nodi. Per qualcosa di completo, in genere servono strumenti esterni come Prometheus. L’ecosistema di osservabilità attorno a Swarm è più piccolo, con meno integrazioni specifiche e un investimento minore della community nelle soluzioni di monitoraggio.

Monitoring e osservabilità: Docker Swarm vs. Kubernetes

L’ecosistema di monitoraggio di Kubernetes è, a dirla tutta, enorme. Prometheus è diventato lo standard de facto per le metriche di Kubernetes, tipicamente abbinato a Grafana per la visualizzazione. Il componente kube-state-metrics espone metriche a livello di cluster sullo stato degli oggetti. Strumenti di tracing distribuito come Jaeger si integrano senza attriti.

Numerose piattaforme commerciali (Datadog, New Relic, Dynatrace) offrono integrazioni sofisticate specifiche per Kubernetes con dashboard e alerting integrati. L’ampiezza degli strumenti consente un’osservabilità di livello enterprise, ma implica anche scegliere e configurare tali strumenti.

Ecosistema, estensibilità e supporto della community

Oltre alle funzionalità core, l’ecosistema circostante può fare la differenza, e qui il divario tra le piattaforme è più evidente.

Kubernetes ha un ecosistema enorme. Ogni principale strumento di monitoraggio, piattaforma di sicurezza, sistema CI/CD e cloud provider offre supporto di prima classe a Kubernetes. Hai bisogno di estendere Kubernetes con funzionalità personalizzate? Le Custom Resource Definition (CRD) ti permettono di aggiungere i tuoi tipi di risorsa, mentre gli Operator automatizzano la gestione di applicazioni complesse usando pattern nativi di Kubernetes.

La community è vasta e attiva, con documentazione estesa, conferenze regolari, infiniti tutorial e competenze facilmente disponibili sul mercato.

L’ecosistema di Docker Swarm è decisamente più piccolo. La community Docker resta di supporto, ma meno strumenti di terze parti sono mirati specificamente a Swarm. Le opzioni di personalizzazione sono limitate dai vincoli dell’API Docker. Lavori entro i confini che Swarm fornisce. Questo ecosistema più ridotto significa meno soluzioni pronte all’uso per casi limite e meno slancio comunitario nell’innovazione.

Integrazioni cloud e capacità multi-cluster

L’integrazione con il cloud conta se operi su AWS, Azure o GCP, e le piattaforme qui adottano approcci molto diversi. Per un confronto tra i 3 cloud provider più popolari, consulta questa guida su AWS vs. Azure vs. GCP.

Tutti i principali cloud provider offrono servizi Kubernetes gestiti (AWS EKS, Google GKE, Azure AKS), in cui gestiscono il control plane, gli upgrade e forniscono un’integrazione stretta con i loro servizi nativi.

Le astrazioni di Kubernetes funzionano in modo coerente su ambienti cloud diversi, supportando architetture multi-cloud e ibride reali. Devi gestire applicazioni su più regioni o persino su più cloud? Karmada, il successore della Kubernetes Federation (KubeFed), consente di gestire più cluster come un’unica unità logica, essenziale per deployment globali.

Docker Swarm funziona bene negli ambienti cloud, ma manca di queste integrazioni profonde. Puoi certamente eseguire cluster Swarm su AWS, Azure o GCP, ma dovrai gestire più aspetti infrastrutturali in autonomia. La gestione multi-cluster è limitata, poiché ogni cluster Swarm opera in modo indipendente.

Coordinare deployment su più regioni o provider cloud richiede tooling su misura e livelli aggiuntivi di orchestrazione.

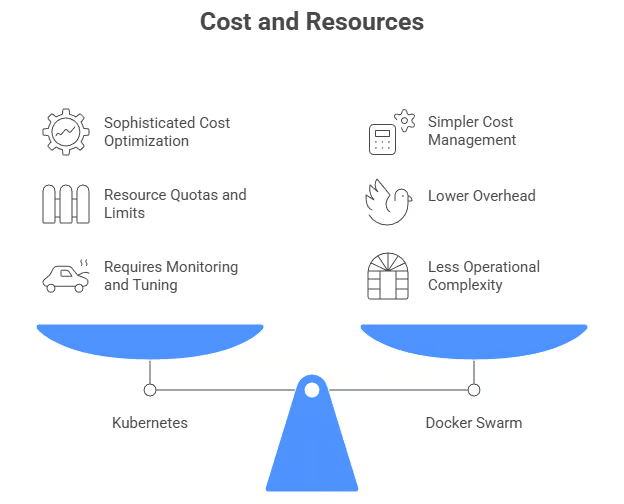

Ottimizzazione dei costi ed efficienza delle risorse

Il costo è sempre un fattore, e le piattaforme lo gestiscono in modo diverso, riflettendo le loro priorità progettuali.

Kubernetes offre sofisticate ottimizzazioni dei costi integrate nel suo design. Quote e limiti di risorse impediscono a un singolo team o applicazione di monopolizzare il cluster. L’Horizontal Pod Autoscaler e il Cluster Autoscaler lavorano insieme per adeguare l’allocazione delle risorse alla domanda reale, riducendo la scala nei periodi di bassa attività per risparmiare.

L’integrazione con istanze spot dei cloud provider può ridurre significativamente i costi di calcolo. Strumenti come Kubecost offrono visibilità dettagliata sui pattern di spesa e raccomandazioni di ottimizzazione. Lo svantaggio? Questa sofisticazione richiede monitoraggio, tuning e competenze per essere sfruttata al meglio.

Costi e risorse: Docker Swarm vs. Kubernetes

Docker Swarm adotta un approccio più semplice. Il modello di risorse è lineare, con meno funzionalità di ottimizzazione integrate. Tuttavia, il minor overhead della piattaforma significa che più risorse della tua infrastruttura sono dedicate all’esecuzione delle applicazioni reali anziché all’orchestrazione.

La gestione dei costi in genere si basa su strumenti di monitoraggio esterni e regolazioni manuali. Per deployment più piccoli, questa semplicità può risultare addirittura più conveniente: spendi meno in complessità operativa anche se la piattaforma non offre funzionalità avanzate di ottimizzazione.

Ora che abbiamo confrontato le piattaforme in tutte queste dimensioni tecniche, dalla complessità di installazione all’ottimizzazione dei costi, potresti chiederti: "Quale dovrei usare davvero?" La risposta, come prevedibile, dipende interamente dalla tua situazione specifica. Vediamo gli scenari reali in cui ciascuna piattaforma brilla davvero.

Casi d’uso per Docker Swarm e Kubernetes

Comprendere le differenze tecniche è un conto, ma sapere quando usare ciascuna piattaforma è ciò che conta davvero. Ti accompagno attraverso gli scenari ideali per ognuna.

Casi d’uso di Docker Swarm

Docker Swarm eccelle in questi scenari:

- Deployment piccoli e medi: Progetti sotto i 50 nodi con esigenze di orchestrazione lineari

- Prototipazione rapida: Ambienti di sviluppo in cui contano soprattutto setup veloce e iterazione

- Risorse DevOps limitate: Team alle prime armi con l’orchestrazione o privi di ingegneri di piattaforma dedicati

- Ambienti nativi Docker: Organizzazioni fortemente investite in tool e workflow Docker

- Progetti orientati alla semplicità: Applicazioni in cui la semplicità operativa prevale su funzionalità avanzate

Se il tuo progetto rientra in queste caratteristiche, Docker Swarm ti consente di ottenere l’orchestrazione dei container senza l’overhead di apprendere e gestire un sistema più complesso. Sarai produttivo in fretta e potrai sempre migrare a Kubernetes in seguito se le tue esigenze supereranno ciò che Swarm offre.

Casi d’uso di Kubernetes

Dall’altro lato, Kubernetes è la scelta giusta quando ti serve:

- Deployment su larga scala: Sistemi complessi che richiedono la gestione di centinaia o migliaia di nodi

- Ambienti enterprise: Organizzazioni multi-team con severi requisiti di conformità e sicurezza

- Architetture multi-cloud: Deployment che abbracciano più provider cloud o setup ibridi

- Sistemi ad alta disponibilità: Applicazioni che richiedono failover sofisticato, disaster recovery e distribuzione geografica

- Automazione avanzata: Workload che richiedono autoscaling, self-healing e logiche di orchestrazione complesse

- Team di piattaforma dedicati: Organizzazioni con ingegneri in grado di gestire e ottimizzare l’infrastruttura Kubernetes

Questi casi d’uso giustificano l’investimento nell’apprendimento e nella gestione di Kubernetes. La complessità della piattaforma diventa un asset, non un peso, quando stai risolvendo sfide di orchestrazione complesse su larga scala. Se ti riconosci in questi scenari, lo sforzo per adottare Kubernetes ripagherà in capacità operative e flessibilità futura.

Come scegliere tra Docker Swarm e Kubernetes

Capiti i casi d’uso, come prendi la decisione? Ecco un framework:

|

Scegli Swarm se... |

Scegli Kubernetes se... |

|

< 50 nodi |

> 100 nodi |

|

Il team conosce Docker |

Il team ha competenze K8s |

|

Partenza rapida cruciale |

Servono funzionalità enterprise |

|

Budget limitato |

Puoi usare servizi gestiti |

Esaminiamo ciascun fattore decisionale.

Dimensioni e complessità del progetto

Considera la scala attuale e le proiezioni di crescita. Per qualche dozzina di servizi con requisiti lineari, Swarm è sufficiente. Per crescita rapida, microservizi complessi o deployment enterprise, Kubernetes fornisce le fondamenta necessarie.

Competenze del team e curva di apprendimento

Oltre ai requisiti del progetto, contano moltissimo le capacità del tuo team.

Valuta le skill del team e il tempo di apprendimento. Team esperti di Docker ma nuovi all’orchestrazione saranno più produttivi e veloci con Swarm. Team con competenze Kubernetes o risorse formative possono sfruttare le capacità avanzate di Kubernetes.

Infrastruttura ed esigenze di scaling

Anche i requisiti infrastrutturali guideranno la scelta.

Valuta i requisiti di disponibilità, i pattern di scaling e la distribuzione dell’infrastruttura. Uno scaling semplice in un singolo data center si adatta a Swarm. Autoscaling complesso, deployment multi-regione e gestione dinamica delle risorse favoriscono Kubernetes.

Considerazioni su costi e risorse

Infine, considera i costi iniziali e quelli ricorrenti.

Il minor overhead di Swarm può ridurre i costi per deployment più piccoli. L’autoscaling di Kubernetes può offrire un’efficienza migliore su larga scala, nonostante requisiti iniziali più elevati.

Alternative e opzioni emergenti

Docker Swarm e Kubernetes non sono le uniche opzioni. Esistono diverse alternative per casi d’uso specifici.

K3s e orchestrator leggeri

K3s, una distribuzione Kubernetes leggera, offre funzionalità Kubernetes complete in un unico binario di meno di 100 MB. È ideale per edge computing, IoT e ambienti con risorse limitate, mantenendo la compatibilità.

MicroK8s di Canonical e k0s di Mirantis offrono esperienze leggere simili.

Altri strumenti di orchestrazione dei container

Oltre alle distribuzioni Kubernetes leggere, meritano considerazione diverse piattaforme completamente differenti:

- HashiCorp Nomad: Orchestrazione più semplice che supporta sia workload containerizzati sia non containerizzati

- Red Hat OpenShift: Si basa su Kubernetes con strumenti per sviluppatori e funzionalità enterprise aggiuntive

- Apache Mesos con Marathon: Orchestrazione matura per workload eterogenei

- AWS ECS: Integrazione AWS senza la complessità di Kubernetes

Queste alternative potrebbero adattarsi meglio ai tuoi requisiti specifici e all’infrastruttura esistente rispetto a Docker Swarm o Kubernetes.

Conclusione

Docker Swarm e Kubernetes rispondono a esigenze diverse. Swarm eccelle per semplicità e rapidità di deployment, ideale per progetti più piccoli e risorse DevOps limitate. Kubernetes brilla nei deployment complessi che richiedono funzionalità avanzate: la curva di apprendimento ripida è compensata da capacità impareggiabili su larga scala.

Scegli in base alle tue esigenze, alle competenze del team e ai requisiti. Molti team usano entrambe le piattaforme: Swarm per i servizi più semplici e Kubernetes per le applicazioni complesse.

La tua scelta non è definitiva. Molti partono con Swarm e poi migrano a Kubernetes quando le esigenze crescono. Scegli ciò che si adatta alla tua situazione attuale, tenendo presenti i bisogni futuri.

Per approfondire l’uso di entrambi gli strumenti, ti consiglio vivamente di iscriverti al nostro skill track Containerization and Virtualization with Docker and Kubernetes.

Docker Swarm vs Kubernetes FAQ

Docker Swarm è più facile da imparare rispetto a Kubernetes?

Sì, Docker Swarm è significativamente più semplice da imparare. Se conosci già i comandi Docker e Docker Compose, puoi essere produttivo con Swarm in poche ore. Kubernetes ha una curva di apprendimento più ripida e richiede di comprendere Pod, Service, Deployment e altri nuovi concetti. Tuttavia, questa complessità abilita funzionalità più potenti per deployment su larga scala.

Docker Swarm può gestire carichi di lavoro in produzione?

Sì, Docker Swarm può gestire carichi di lavoro di produzione in modo efficace per deployment piccoli e medi (tipicamente sotto i 50-100 nodi). Fornisce funzionalità essenziali come alta disponibilità, load balancing e rolling update. Tuttavia, per deployment di livello enterprise che richiedono migliaia di nodi, autoscaling avanzato o architetture multi-cloud complesse, Kubernetes è la scelta migliore.

Dovrei migrare da Docker Swarm a Kubernetes?

La migrazione dipende dalle tue esigenze specifiche. Valuta la migrazione se stai raggiungendo i limiti di scalabilità di Swarm (oltre 100 nodi), se hai bisogno di funzionalità avanzate come l’autoscaling orizzontale, se richiedi un supporto multi-cloud sofisticato o se vuoi accedere al vasto ecosistema di Kubernetes. Se Swarm soddisfa le tue esigenze, non c’è alcuna urgenza di migrare. Molte organizzazioni eseguono Swarm con successo in produzione.

Quale piattaforma è più conveniente?

Per deployment piccoli, Docker Swarm è spesso più conveniente grazie al minore overhead di risorse e alla ridotta complessità operativa. Kubernetes può risultare più efficiente in termini di costi su larga scala grazie a sofisticate funzionalità di autoscaling e ottimizzazione delle risorse. Considera sia i costi infrastrutturali (risorse di calcolo) sia quelli operativi (tempo di gestione e competenze richieste).

Posso usare insieme Docker Swarm e Kubernetes?

Sì, molte organizzazioni usano entrambe le piattaforme per scopi diversi. Uno schema comune è utilizzare Docker Swarm per servizi interni più semplici e ambienti di sviluppo, mentre si distribuiscono le applicazioni rivolte ai clienti o complesse su Kubernetes. Questo approccio ibrido combina la semplicità di Swarm con le capacità avanzate di Kubernetes.

Come fondatore di Martin Data Solutions e Data Scientist/ML & AI Engineer freelance, porto un portfolio vario che include Regression, Classification, NLP, LLM, RAG, reti neurali, metodi ensemble e computer vision.

- Ho sviluppato con successo diversi progetti ML end-to-end, includendo data cleaning, analytics, modellazione e deployment su AWS e GCP, offrendo soluzioni efficaci e scalabili.

- Ho realizzato applicazioni web interattive e scalabili con Streamlit e Gradio per casi d’uso in settori diversi.

- Ho insegnato e fatto mentoring a studenti di data science e analytics, supportandone la crescita professionale con approcci di apprendimento personalizzati.

- Ho progettato contenuti didattici per applicazioni di retrieval-augmented generation (RAG) su misura per le esigenze enterprise.

- Ho scritto articoli tecnici di grande impatto su AI & ML, trattando temi come MLOps, database vettoriali e LLM, ottenendo un notevole coinvolgimento.

In ogni progetto che affronto, applico pratiche aggiornate di ingegneria del software e DevOps, come CI/CD, linting del codice, formattazione, monitoraggio dei modelli, tracciamento degli esperimenti e gestione robusta degli errori. Mi impegno a fornire soluzioni complete, trasformando gli insight dai dati in strategie pratiche che aiutano le aziende a crescere e a sfruttare al meglio data science, machine learning e AI.