Lernpfad

Als ich erstmals mit containerisierten Anwendungen gearbeitet habe, ließ sich eine Handvoll Container noch gut manuell verwalten. Doch beim Skalieren brauchte es einen anderen Ansatz. Genau hier werden Orchestrierungsplattformen unverzichtbar – und zwei Namen dominieren: Docker Swarm und Kubernetes.

Container-Orchestrierung automatisiert Bereitstellung, Verwaltung, Skalierung und Netzwerkbetrieb von Containern über ganze Maschinen-Cluster hinweg. Die richtige Plattform zu wählen, kann Produktivität, Betriebskosten und Skalierungsfähigkeit deines Teams maßgeblich beeinflussen.

In diesem Guide vergleiche ich Docker Swarm und Kubernetes umfassend, damit du die beste Plattform für deine Anforderungen findest – egal ob du ein kleines Startup betreibst oder eine Enterprise-Infrastruktur managst.

Wenn Docker neu für dich ist, starte am besten mit unserem Kurs Introduction to Docker. Lies dir außerdem unser Tutorial zum Ausführen von Claude Code in Docker durch.

Was ist Docker Swarm?

Beginnen wir mit Docker Swarm, der einfacheren der beiden Plattformen.

Docker Swarm ist die native Orchestrierungslösung von Docker und verwandelt mehrere Docker-Hosts in einen einheitlichen, virtuellen Host. Besonders ansprechend finde ich die nahtlose Integration in das Docker-Ökosystem, das viele Teams ohnehin nutzen.

Docker-Swarm-Logo

Direkt in die Docker Engine integriert, erweitert Swarm die Docker-Funktionalität zur Verwaltung verteilter Container über mehrere Maschinen. Durch das Aktivieren des Swarm-Modus entsteht ein Cluster, der Workloads intelligent verteilt, hohe Verfügbarkeit sicherstellt und Services skaliert – ohne die sonst übliche Komplexität vieler Orchestrierungsplattformen.

Wenn dir Docker, seine Features und die Abgrenzung zu Kubernetes noch unklar sind, empfehle ich unsere weiteren Vergleiche Kubernetes vs Docker und Docker Compose vs Kubernetes.

Hinweis: Der Swarm-Modus funktioniert weiterhin und erhält Sicherheitsupdates, die aktive Feature-Entwicklung wurde jedoch zugunsten von Kubernetes-basierten Lösungen deutlich zurückgefahren.

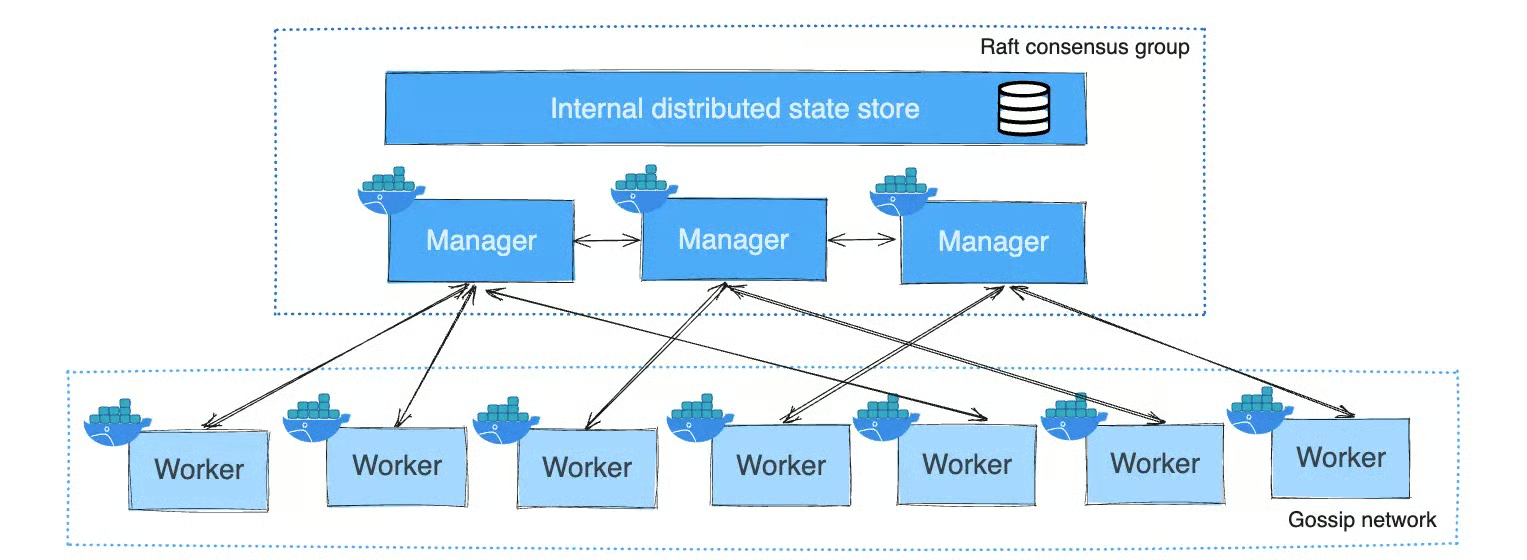

Architektur und Komponenten von Docker Swarm

Docker Swarm setzt auf ein Manager-Worker-Modell. Managernodes orchestrieren und halten den Clusterzustand aufrecht, während Workernodes Aufgaben ausführen. Manager können ebenfalls Workloads ausführen oder ausschließlich für die Orchestrierung reserviert sein.

Es verwendet den Raft-Konsensalgorithmus, der unter den Managernodes einen Leader bestimmt, der alle Clusterentscheidungen trifft. Entscheidungen benötigen die Zustimmung der Mehrheit der Managernodes. So stellt Docker Swarm sicher, dass der Clusterzustand über alle Manager hinweg konsistent bleibt und auch bei Ausfällen einzelner Managernodes weiter funktioniert.

Services werden in YAML-Dateien ähnlich wie bei Docker Compose definiert. Darin beschreibst du den angestrebten Anwendungszustand, inklusive Replikas, Netzwerken und Ressourcen.

Jetzt, da wir die Architektur kennen, schauen wir uns an, was Docker Swarm für dich leisten kann.

Kernfunktionen von Docker Swarm

Docker Swarm bringt mehrere integrierte Funktionen für eine leicht zugängliche Container-Orchestrierung mit:

- Service Discovery: Erfolgt automatisch über integriertes DNS, sodass Container sich über Servicenamen finden

- Load Balancing: Über ein Routing-Mesh, das Anfragen über gesunde Replikas auf verschiedenen Nodes verteilt

- Rolling Updates: Gestaffelte Aktualisierungen mit konfigurierbarer Parallelität und Wartezeiten sowie schnellen Rollbacks bei Problemen

- Hohe Verfügbarkeit: Durch Servicereplikation und automatisches Neuscheduling bei Ausfällen

- Overlay Networking: Ermöglicht Container-Kommunikation über Hosts hinweg, optional mit Verschlüsselung für Anwendungsdatenverkehr (nicht standardmäßig aktiviert)

Kernfunktionen von Docker Swarm

Diese Funktionen greifen ineinander und ermöglichen produktionsreife Orchestrierung ohne aufwendige Konfiguration. Gerade diese Einfachheit macht Docker Swarm attraktiv für Teams, die schnell starten möchten.

Vorteile von Docker Swarm

Auf Basis dieser Funktionen zeigt sich, wo Docker Swarm besonders glänzt. Die Plattform bietet mehrere überzeugende Vorteile:

- Schnelles Setup: Einen Cluster initialisieren erfordert nur docker swarm init

- Sanfte Lernkurve: Wenn du Docker kennst, bist du schon halb am Ziel – mit vertrauten CLI-Befehlen und Docker-Compose-Formaten

- Native Integration: Keine neuen APIs oder zusätzliche Software nötig

- Ideal für kleine bis mittlere Projekte: Liefert essenzielle Orchestrierung ohne überbordende Komplexität

- Geringerer Ressourcenbedarf: Auf derselben Hardware laufen mehr Anwendungskontainer als bei Kubernetes – kosteneffektiv für kleinere Deployments

Diese Vorteile machen Docker Swarm besonders attraktiv für Startups, kleine Entwicklungsteams und Organisationen, die Geschwindigkeit über einen riesigen Funktionsumfang stellen. Die niedrige Einstiegshürde bedeutet, dass du Container-Orchestrierung in Stunden statt Tagen oder Wochen produktiv einsetzen kannst.

Nachteile von Docker Swarm

Keine Plattform ist perfekt. Das sind die wichtigsten Limitierungen:

- Skalierungsgrenzen: Kommt an Kubernetes bei Tausenden Nodes oder hochkomplexen Workloads nicht heran

- Kleineres Ökosystem: Weniger Drittanbieter-Tools und Community-Ressourcen

- Begrenzte Erweiterbarkeit: Enge Kopplung an die Docker-API erschwert fortgeschrittene Anpassungen

- Fehlende Advanced Features: Ausgereiftes Autoscaling und komplexe Netzwerk-Policies fehlen oder erfordern Workarounds

- Schwache Multi-Cluster-Verwaltung: Nur rudimentäre Möglichkeiten – herausfordernd für geographisch verteilte Deployments

- Herausforderungen bei zustandsbehafteten Workloads: Datenbanken mit anspruchsvoller Storage-Orchestrierung sind schwerer zu betreiben

- Verlangsamte Entwicklung: Neue Features werden kaum noch entwickelt, Docker fokussiert Kubernetes-basierte Lösungen. Das ist zu unterscheiden vom vollständig eingestellten „Classic Swarm“, das in Docker v23.0 entfernt wurde

Diese Einschränkungen sind real, stören aber nur, wenn dein Use Case diese erweiterten Fähigkeiten wirklich benötigt. Für viele Projekte reicht der Funktionsumfang von Docker Swarm völlig aus – der Gewinn an Einfachheit ist den Tausch wert.

Die Frage ist nicht, ob Swarm Limitierungen hat, sondern ob sie für deinen konkreten Bedarf relevant sind. Wenn du Alternativen prüfen willst, lies unseren Beitrag zu den Top Docker-Alternativen 2026.

Was ist Kubernetes?

Nachdem wir Docker Swarm beleuchtet haben, wenden wir uns Kubernetes zu – der mächtigeren, aber komplexeren Alternative.

Kubernetes (K8s) ist der Branchenstandard für Container-Orchestrierung. Ursprünglich von Google entwickelt und heute von der Cloud Native Computing Foundation betreut, wurde es gebaut, um containerisierte Anwendungen in enormem Maßstab zu betreiben. Für eine ausführlichere Einführung lies unseren Guide What is Kubernetes?.

Kubernetes-Logo

Kubernetes ist eine Plattform, die praktisch jede Anforderung im Produktivbetrieb von Containern adressiert. Über die Grundorchestrierung hinaus bietet sie Lösungen für persistenten Speicher, Konfigurationsmanagement, Secrets-Handling und Jobverarbeitung.

Die weite Verbreitung hat ein riesiges Ökosystem an Tools und Services hervorgebracht.

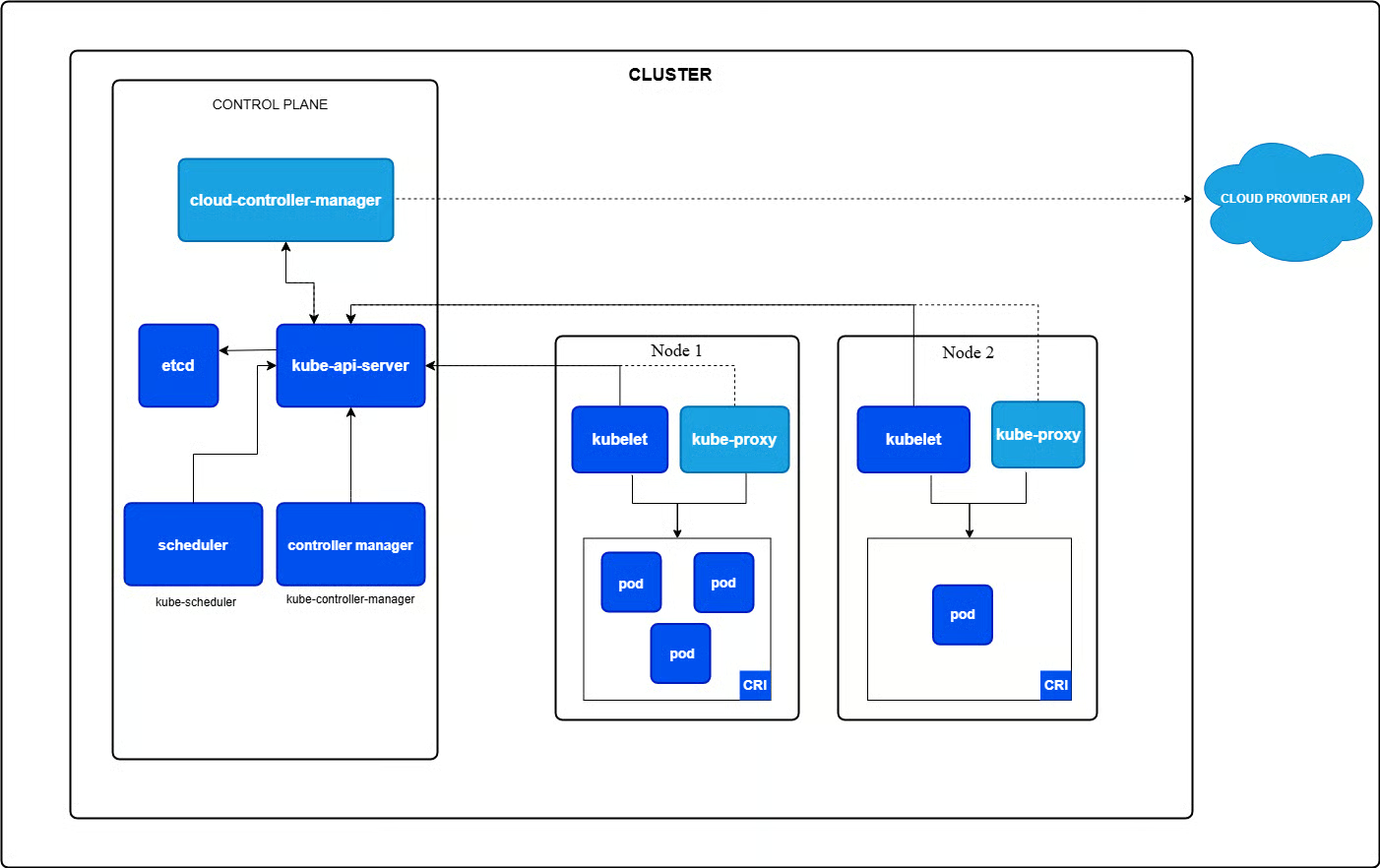

Kubernetes-Architektur und -Komponenten

Kubernetes nutzt eine Master-Worker-Topologie, wobei der Master die Control Plane ist. Wichtige Control-Plane-Komponenten sind:

- kube-apiserver: Der zentrale Server, der die Kubernetes-HTTP-API bereitstellt

- etcd: Ein verteilter Key-Value-Store für API-Server-Daten

- kube-scheduler: Weist Pods Nodes zu

- kube-controller-manager: Führt Controller aus, die das Verhalten der Kubernetes-API implementieren

- cloud-controller-manager: Optional; integriert Cloud-Provider

Workernodes betreiben kubelet (Kommunikation mit der Control Plane), kube-proxy (Netzwerk) und hosten Pods – die kleinsten deploybaren Einheiten mit einem oder mehreren Containern, die sich Ressourcen teilen.

Diese verteilte Architektur ist komplexer als die von Docker Swarm, ermöglicht aber die beeindruckende Skalierbarkeit und Resilienz von Kubernetes. Jede Komponente hat eine klar definierte Rolle, und zusammen entsteht ein äußerst robustes Orchestrierungssystem.

Für einen tieferen Einblick empfehle ich unseren Guide zur Kubernetes-Architektur.

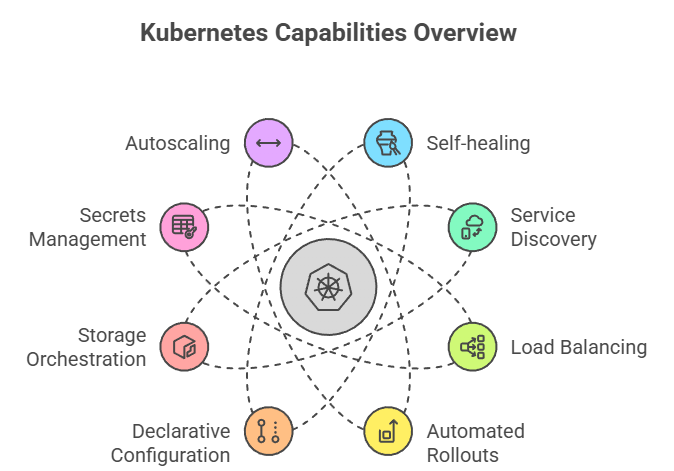

Kernfunktionen von Kubernetes

Auf dieser Architektur aufbauend liefert Kubernetes einen breiten Funktionsumfang für den Produktivbetrieb von Containern:

- Self-Healing: Ersetzt fehlgeschlagene Container automatisch, plant Pods bei Node-Ausfällen neu und startet ungesunde Container neu

- Service Discovery und Load Balancing: Integrierte DNS-Namen und intelligente Verkehrsverteilung über Pod-Replikas

- Automatisierte Rollouts und Rollbacks: Sichere Deployments mit feingranularer Steuerung und automatischer Rücknahme bei Problemen

- Deklarative Konfiguration: Beschreibe den gewünschten Clusterzustand in YAML, Kubernetes hält diesen Zustand kontinuierlich ein

- Storage-Orchestrierung: Die Container Storage Interface unterstützt zahlreiche Backends mit dynamischer Bereitstellung

- Secrets-Management: Sichere Handhabung sensibler Daten und Konfigurationen

- Autoscaling: Horizontales Autoscaling passt Replikas anhand von Metriken an, vertikales Autoscaling justiert Ressourcen

Kubernetes-Funktionsübersicht

Dieser umfassende Funktionsumfang macht Kubernetes zur ersten Wahl für komplexe Produktivumgebungen. Während Docker Swarm die Basics liefert, bietet Kubernetes ausgereifte Möglichkeiten, die mit wachsender Infrastruktur unverzichtbar werden.

Vorteile von Kubernetes

Hier zeigt Kubernetes, warum es zum Branchenstandard geworden ist. Es überzeugt bei komplexen, großskaligen Deployments:

- Außergewöhnliche Skalierbarkeit: Cluster können Tausende Nodes umfassen und dabei performant bleiben

- Riesiges Ökosystem: Breite Integrationen, Managed Services aller großen Cloudprovider und zahllose Tools

- Erweitertes Scheduling: Affinity-Regeln, Taints, Tolerations und Ressourcenquoten für präzise Workload-Steuerung

- Multi-Cloud-Support: Konsistente APIs ermöglichen echte Multi- und Hybrid-Cloud-Deployments

- Multi-Cluster-Management: Tools wie Karmada (Nachfolger des eingestellten KubeFed) erlauben das Verwalten von Workloads über mehrere Cluster für globale Anwendungen

- Erweiterbarkeit: Custom Resources und Operators erlauben die Verwaltung nahezu jeder Workload-Art

- Aktive Community: Umfangreiche Doku und leicht verfügbare Expertise

Diese Vorteile erklären, warum Kubernetes in Enterprise-Umgebungen praktisch synonym mit Container-Orchestrierung ist. Wenn du Funktionen in Produktionsqualität, umfangreiche Tooling-Unterstützung und eine mitwachsende Plattform brauchst, liefert Kubernetes.

Um die Stärken in Aktion zu sehen, wirf einen Blick in dieses Kubernetes Tutorial.

Nachteile von Kubernetes

All diese Power hat ihren Preis:

- Hohe Komplexität: Ein produktionsreifer Cluster erfordert zahlreiche Konfigurationen und Entscheidungen

- Steile Lernkurve: Du musst viele Komponenten und Best Practices verstehen

- Höherer Ressourcenbedarf: Control-Plane-Komponenten benötigen spürbare Ressourcen und erhöhen den Betriebsaufwand

- Möglicher Overkill: Für kleine Teams oder einfache Apps kann Kubernetes unnötige Komplexität einführen

Diese Trade-offs zu verstehen, ist entscheidend für die Wahl der Plattform. Die Nachteile von Kubernetes sind keine Mängel, sondern Konsequenzen seines leistungsfähigen, flexiblen Designs. Die Frage ist, ob dein Use Case diese Komplexität rechtfertigt.

Docker Swarm vs. Kubernetes: Der Feature-Vergleich

Nachdem wir beide Plattformen einzeln betrachtet haben, vergleichen wir sie jetzt entlang zentraler Kriterien.

|

Feature |

Docker Swarm |

Kubernetes |

|

Setup |

Einfach (ein Befehl) |

Komplex |

|

Lernkurve |

Sanft |

Steil |

|

Skalierbarkeit |

~50–100 Nodes |

Bis zu 5.000 Nodes |

|

Ökosystem |

Kleiner |

Sehr groß |

|

Autoscaling |

Nicht integriert (externe Tools nötig) |

Automatisch (HPA); VPA als Add-on |

|

Am besten geeignet für |

Kleine bis mittlere Projekte |

Enterprise-Maßstab |

Jetzt steigen wir tiefer in die Vergleichsbereiche ein. Beginnen wir mit dem, was oft die erste Berührung mit einer Orchestrierungsplattform ist: das Setup und der erste Betrieb.

Installation, Setup und Lernkurve

Die Installation von Docker Swarm ist unkompliziert: Ist die Docker Engine installiert, erzeugt ein einzelner docker swarm init-Befehl einen Cluster. Das Hinzufügen weiterer Nodes erfolgt mit dem Join-Token. Die meisten Teams haben innerhalb einer Stunde einen laufenden Cluster.

Bei Kubernetes hängt die Installation vom Ansatz ab. Managed Services (AWS EKS, GKE, AKS) nehmen dir den Großteil der Komplexität ab. Self-managed Installationen erfordern kubectl, Netzwerkkonfiguration, Zertifikate und etcd-Setup. Tools wie kubeadm oder k3s vereinfachen vieles, dennoch ist der Einrichtungsaufwand höher als bei Swarm.

Die Lernkurve verläuft ähnlich. Wenn du Docker-Befehle und Compose-Dateien kennst, fühlt sich Swarm natürlich an – es ist im Grunde Docker im größeren Maßstab. Kubernetes hingegen führt neue Konzepte ein (Pods, ReplicaSets, Services, Ingress) und verlangt ein deutlich umfangreicheres mentales Modell.

Deployment-Strategien und Anwendungsmanagement

Sobald dein Cluster läuft, unterscheiden sich die Deployment-Ansätze der beiden Plattformen wie folgt.

Docker Swarm bleibt bewusst einfach: Anwendungen werden als Services über YAML-Dateien bereitgestellt, die mit Docker Compose kompatibel sind. Wenn du Compose in der lokalen Entwicklung nutzt, erkennst du das Format sofort wieder. Stacks fassen mehrere Services zusammen, Rolling Updates definierst du über neue Versionen und Update-Parameter.

Kubernetes geht deutlich differenzierter vor. Statt eines einzigen Deployment-Konzepts gibt es spezialisierte Ressourcentypen:

- Deployments für Rolling Updates

- StatefulSets für zustandsbehaftete Apps mit stabiler Identität

- DaemonSets für Node-spezifische Pods

- Jobs für Batch-Aufgaben.

Diese Vielfalt bringt Power und Flexibilität, verlangt aber, dass du den passenden Ressourcentyp für deinen Use Case auswählst. Fortgeschrittene Strategien wie Canary- und Blue-Green-Deployments sind mit verschiedenen Techniken und Drittanbieter-Tools hervorragend unterstützt.

Skalierung, Hochverfügbarkeit und Performance

Hier beginnen sich die Plattformen deutlich zu unterscheiden.

Docker Swarm skaliert solide für kleine bis mittlere Cluster (typisch unter 50–100 Nodes). Skalierung ist deklarativ: Du gibst die gewünschte Replikazahl an, Swarm passt automatisch an. Die Performance ist gut bei geringem Overhead – effizient für kleinere Workloads.

Der Trade-off: Skalierungsentscheidungen triffst du manuell; Swarm skaliert nicht automatisch nach CPU- oder Speicherauslastung.

Kubernetes hingegen glänzt in mehreren Dimensionen der Skalierung. Erstens kann es Tausende Nodes und Zehntausende Pods verwalten. Zweitens – und noch wichtiger – skaliert es intelligent.

Der Horizontal Pod Autoscaler passt Replikas automatisch anhand von Metriken an, der Vertical Pod Autoscaler justiert Ressourcen und der Cluster Autoscaler steuert in Cloud-Umgebungen sogar die Node-Anzahl. Dieses automatisierte Scaling macht Kubernetes für variable Workloads äußerst kosteneffizient.

Netzwerk und Load Balancing

Netzwerke sind kritisch – beide Plattformen lösen die gleichen Grundprobleme auf unterschiedliche Weise.

Docker Swarm bringt integriertes Load Balancing über das Routing-Mesh mit und verteilt den Traffic automatisch über Service-Endpunkte. Overlay-Netzwerke erlauben verschlüsselte Kommunikation zwischen Containern, und die Service Discovery erfolgt über integriertes DNS. Ein „Batteries included“-Ansatz: Alles Nötige ist vorhanden und standardmäßig konfiguriert.

Kubernetes bietet mehr Flexibilität, erfordert dafür mehr Konfiguration. Das Networking basiert auf der Container Network Interface (CNI) und unterstützt Lösungen wie Calico, Cilium und Flannel – du wählst aus.

Ingress-Controller bieten ausgereiftes HTTP/HTTPS-Routing mit SSL-Terminierung. Network Policies erlauben feingranulare Verkehrskontrolle zwischen Pods. Für fortgeschrittene Szenarien lassen sich Service Meshes wie Istio nahtlos integrieren – für Traffic-Management, Sicherheit und Observability. Diese Modularität ist mächtig, verlangt aber mehr Entscheidungen im Vorfeld.

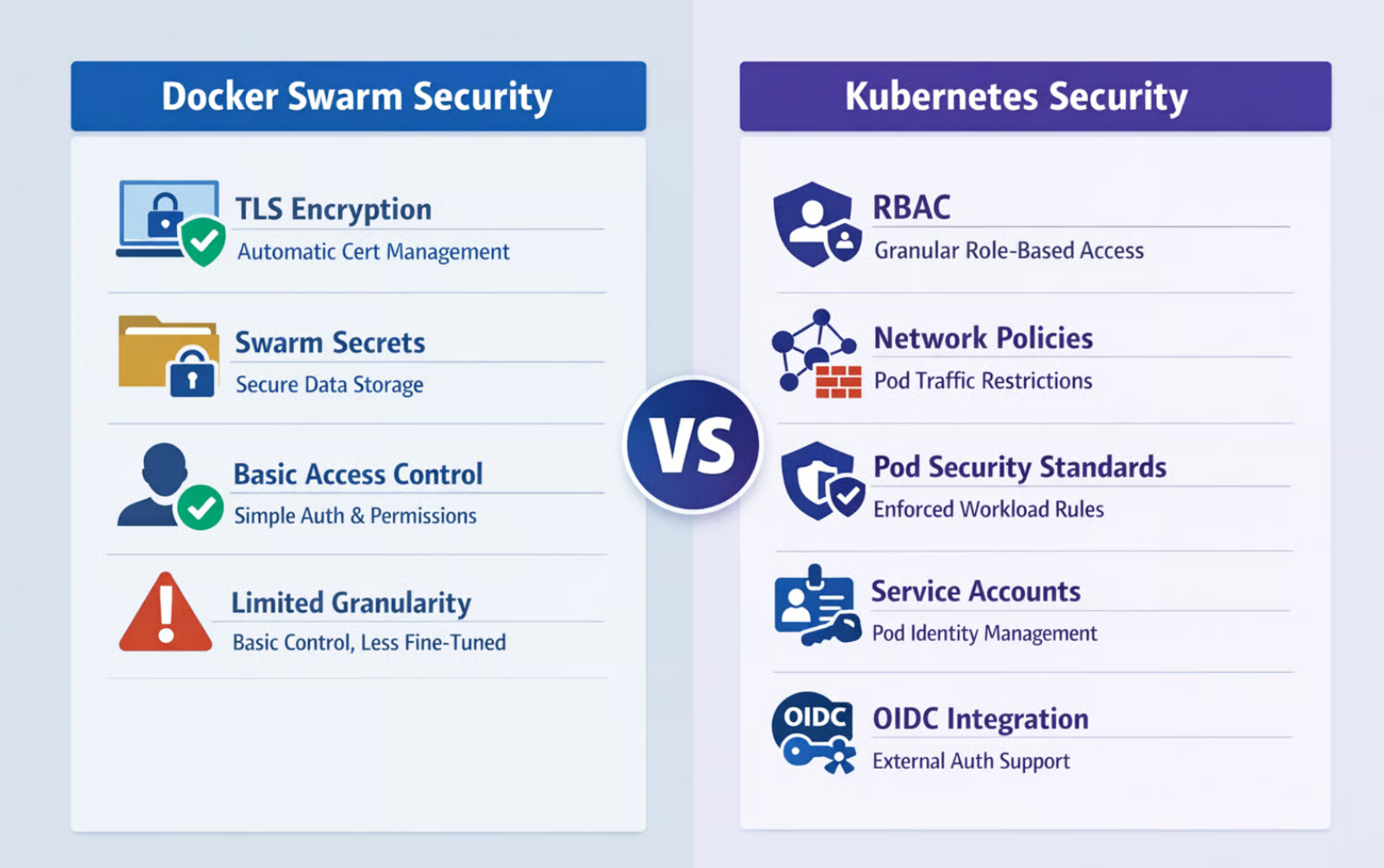

Sicherheit und Zugriffskontrolle

Sicherheit ist zentral – hier zeigt sich die Enterprise-Herkunft von Kubernetes deutlich.

Docker Swarm liefert das Wesentliche: TLS-Verschlüsselung mit automatischem Zertifikatsmanagement sichert die Node-zu-Node-Kommunikation, Swarm Secrets speichern sensible Daten wie Passwörter und API-Keys sicher. Die Zugriffskontrolle stützt sich auf Dockers Authentifizierungsmechanismen. Das ist unkompliziert und für viele Fälle ausreichend, aber nicht fein granular.

Sicherheit: Docker Swarm vs. Kubernetes

Kubernetes bietet umfassende Sicherheit für Multi-Tenant-Umgebungen. Ein großes Plus für sichere Team-Deployments ist Role-Based Access Control (RBAC) mit granularem Rechtemanagement auf Namespace- und Cluster-Ebene. Du legst exakt fest, wer was mit welchen Ressourcen tun darf.

Network Policies beschränken den Verkehr zwischen Pods anhand von Labels und Regeln. Pod Security Standards erzwingen Sicherheitsvorgaben für Workloadspezifikationen. Service Accounts stellen Identitäten für Pods bereit; externe Authentifizierung via OIDC u. a. ist integrierbar.

Dieses umfangreiche Sicherheitsmodell macht Kubernetes für regulierte Branchen und komplexe Organisationsanforderungen geeignet.

Storage und Datenpersistenz

Beim Thema persistente Daten zeigen sich die unterschiedlichen Philosophien besonders deutlich.

Docker Swarm unterstützt lokale und benannte Volumes – das reicht für einfache Fälle. Storage-Management bleibt jedoch grundlegend, dynamische Bereitstellung ist begrenzt, und die Koordination über Replikas hinweg wird bei komplexen Stateful-Anwendungen herausfordernd. Für alles jenseits einfacher Volume-Mounts brauchst du oft externe Tools oder manuelle Konfiguration.

Kubernetes wurde von Anfang an mit zustandsbehafteten Workloads im Blick entwickelt. PersistentVolumes (PVs) dienen als clusterweite Speicherressourcen, PersistentVolumeClaims (PVCs) erlauben Anwendungen, Speicher anzufordern, ohne die Details des Backends zu kennen.

StorageClasses ermöglichen dynamische Bereitstellung – Speicher wird bei Bedarf automatisch erstellt. Die Container Storage Interface unterstützt zahlreiche Provider mit Features wie Snapshots, Klonen und Expansion. StatefulSets koordinieren Storage mit Pod-Identitäten, sodass sich komplexe verteilte Datenbanken zuverlässig betreiben lassen.

Damit ist Kubernetes bei Stateful-Workloads die klare Wahl.

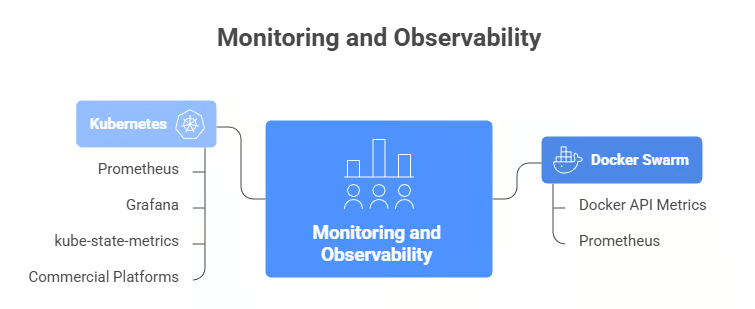

Monitoring, Observability und Betriebstools

Observability macht Clusteraktivitäten verständlich – doch die Ökosystemreife unterscheidet sich deutlich.

Docker Swarm bietet grundlegende Metriken über die Docker-API – Einblick in Container- und Node-Gesundheit. Für umfassendes Monitoring brauchst du typischerweise externe Tools wie Prometheus. Das Observability-Ökosystem rund um Swarm ist kleiner, mit weniger spezialisierten Integrationen und geringerer Community-Investition.

Monitoring und Observability: Docker Swarm vs. Kubernetes

Das Kubernetes-Monitoring-Ökosystem ist – ehrlich gesagt – riesig. Prometheus ist de facto Standard für Kubernetes-Metriken, oft gepaart mit Grafana zur Visualisierung. kube-state-metrics stellt Cluster-Metriken zum Objektzustand bereit. Verteiltes Tracing mit Tools wie Jaeger integriert sich nahtlos.

Zahlreiche kommerzielle Plattformen (Datadog, New Relic, Dynatrace) bieten ausgefeilte, Kubernetes-spezifische Integrationen mit vordefinierten Dashboards und Alerting. Die Toolvielfalt ermöglicht Observability auf Enterprise-Niveau – erfordert aber Auswahl und Konfiguration.

Ökosystem, Erweiterbarkeit und Community-Support

Abseits der Kernfunktionen kann das Ökosystem über die Nutzererfahrung entscheiden – hier wird der Unterschied besonders sichtbar.

Kubernetes hat ein enormes Ökosystem. Nahezu jedes Monitoring-Tool, jede Sicherheitsplattform, jedes CI/CD-System und jeder Cloudprovider bietet erstklassigen Kubernetes-Support. Du willst Kubernetes um eigene Funktionen erweitern? Mit Custom Resource Definitions (CRDs) fügst du eigene Ressourcentypen hinzu, während Operators komplexes Applikationsmanagement nach Kubernetes-Prinzipien automatisieren.

Die Community ist riesig und aktiv – mit umfangreicher Dokumentation, Konferenzen, unzähligen Tutorials und leicht zugänglicher Expertise.

Das Ökosystem von Docker Swarm ist deutlich kleiner. Die Docker-Community bleibt unterstützend, doch weniger Drittanbieter-Tools zielen speziell auf Swarm. Anpassungsmöglichkeiten sind durch die Docker-API begrenzt. Du bewegst dich stärker innerhalb der vorgegebenen Grenzen. Das bedeutet weniger Lösungen „von der Stange“ für Sonderfälle und weniger Community-Dynamik.

Cloud-Integrationen und Multi-Cluster-Fähigkeiten

Cloud-Integration ist wichtig, wenn du auf AWS, Azure oder GCP betreibst – und die Plattformen gehen hier sehr unterschiedlich vor. Für einen Vergleich der drei beliebtesten Cloudprovider sieh dir diesen Guide AWS vs. Azure vs. GCP an.

Alle großen Cloudprovider bieten gemanagte Kubernetes-Services (AWS EKS, Google GKE, Azure AKS), die Control-Plane-Management und Upgrades übernehmen und eng mit nativen Diensten integrieren.

Kubernetes-Abstraktionen funktionieren über verschiedene Clouds hinweg konsistent und unterstützen echte Multi-Cloud- und Hybrid-Architekturen. Du musst Anwendungen über mehrere Regionen oder Clouds managen? Karmada, der Nachfolger der Kubernetes Federation (KubeFed), erlaubt die Verwaltung mehrerer Cluster als eine logische Einheit – essenziell für globale Deployments.

Docker Swarm funktioniert in der Cloud ebenfalls gut, es fehlen jedoch tiefgehende Integrationen. Du kannst Swarm-Cluster auf AWS, Azure oder GCP betreiben, musst aber mehr Infrastrukturmanagement selbst übernehmen. Multi-Cluster-Management ist eingeschränkt, da jeder Swarm-Cluster unabhängig arbeitet.

Die Koordination von Deployments über Regionen oder Provider hinweg erfordert eigene Tools und zusätzliche Orchestrierungsebenen.

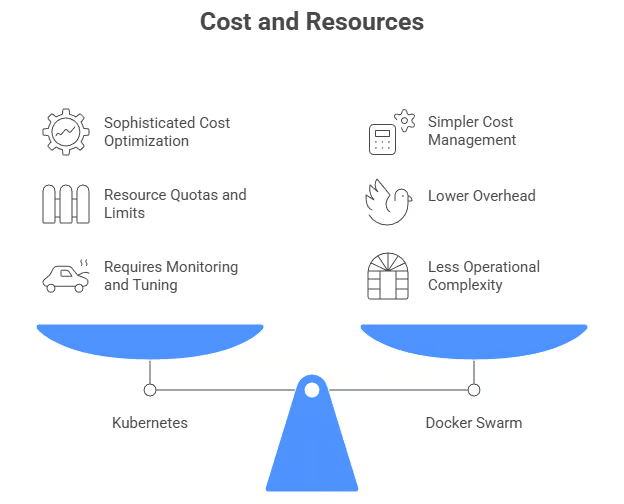

Kostenoptimierung und Ressourceneffizienz

Kosten spielen immer eine Rolle – die Plattformen gehen sie aufgrund ihrer Designprioritäten unterschiedlich an.

Kubernetes bringt ausgefeilte Kostenoptimierung ins Design mit. Ressourcenlimits und -quoten verhindern, dass einzelne Teams/Apps den Cluster dominieren. Horizontaler Pod Autoscaler und Cluster Autoscaler passen Ressourcen dem Bedarf an und skalieren in ruhigen Zeiten herunter – das spart Kosten.

Die Integration mit Spot-Instanzen der Cloudprovider kann Compute-Kosten stark senken. Tools wie Kubecost geben tiefe Einblicke in Ausgabenmuster und Optimierungsmöglichkeiten. Nachteil: Diese Raffinesse verlangt Monitoring, Tuning und Expertise, um ihr Potenzial auszuschöpfen.

Kosten und Ressourcen: Docker Swarm vs. Kubernetes

Docker Swarm verfolgt einen einfacheren Ansatz. Das Ressourcenmodell ist übersichtlich, integrierte Optimierungsfunktionen sind rar. Durch den geringeren Overhead fließen jedoch mehr Infrastrukturressourcen in deine Anwendungen statt in die Orchestrierung.

Das Kostenmanagement stützt sich meist auf externe Monitoring-Tools und manuelle Anpassungen. Für kleinere Deployments kann diese Einfachheit sogar kosteneffizienter sein – weniger Betriebsaufwand, auch wenn die Plattform keine hochgradige Optimierung mitbringt.

Nach dem Vergleich entlang all dieser technischen Dimensionen – von der Installation bis zur Kostenoptimierung – fragst du dich vielleicht: „Welche soll ich nun einsetzen?“ Wie so oft lautet die Antwort: Es kommt darauf an. Schauen wir uns die Szenarien an, in denen jede Plattform wirklich punktet.

Use Cases für Docker Swarm und Kubernetes

Die technischen Unterschiede zu kennen ist das eine – zu wissen, wann du welche Plattform einsetzt, ist entscheidend. Hier sind die idealen Szenarien.

Docker-Swarm-Use-Cases

Docker Swarm überzeugt in diesen Fällen:

- Kleine bis mittlere Deployments: Projekte unter 50 Nodes mit klaren Orchestrierungsanforderungen

- Schnelles Prototyping: Entwicklungsumgebungen, in denen schneller Setup und schnelle Iteration zählen

- Begrenzte DevOps-Ressourcen: Teams, die erst in die Orchestrierung einsteigen oder ohne dedizierte Plattform-Engineers arbeiten

- Docker-native Umgebungen: Organisationen, die stark in Docker-Tools und -Workflows investiert sind

- Simplicity first: Anwendungen, bei denen operative Einfachheit schwerer wiegt als Advanced Features

Wenn dein Projekt dazu passt, erreichst du mit Docker Swarm Orchestrierung ohne den Overhead einer komplexen Plattform. Du wirst schnell produktiv und kannst bei wachsendem Bedarf jederzeit zu Kubernetes migrieren.

Kubernetes-Use-Cases

Kubernetes ist die richtige Wahl, wenn du Folgendes brauchst:

- Großskalige Deployments: Komplexe Systeme mit Hunderten oder Tausenden von Nodes

- Enterprise-Umgebungen: Multi-Team-Organisationen mit strengen Compliance- und Sicherheitsanforderungen

- Multi-Cloud-Architekturen: Deployments über mehrere Cloudprovider oder Hybrid-Cloud

- Hochverfügbarkeit: Anwendungen mit Anforderungen an Failover, Disaster Recovery und geographische Verteilung

- Fortgeschrittene Automatisierung: Workloads mit Autoscaling, Self-Healing und komplexer Orchestrierungslogik

- Dedizierte Plattformteams: Organisationen mit Engineers, die Kubernetes betreiben und optimieren können

In diesen Szenarien wird die Komplexität von Kubernetes zum Vorteil. Wenn du dich hier wiedererkennst, zahlt sich die Einführung in Form verbesserter Betriebsfähigkeiten und zukünftiger Flexibilität aus.

So wählst du zwischen Docker Swarm und Kubernetes

Mit den Use Cases im Blick: Wie triffst du die Entscheidung? Hier ist ein Rahmenwerk:

|

Wähle Swarm, wenn … |

Wähle Kubernetes, wenn … |

|

< 50 Nodes |

> 100 Nodes |

|

Team kennt Docker |

Team hat K8s-Skills |

|

Schneller Start entscheidend |

Enterprise-Features nötig |

|

Budget ist knapp |

Managed Services nutzbar |

Schauen wir uns die Entscheidungsfaktoren im Detail an.

Projektgröße und -komplexität

Betrachte deinen aktuellen Umfang und das erwartete Wachstum. Für einige Dutzend Services mit überschaubaren Anforderungen genügt Swarm. Bei schnellem Wachstum, komplexen Microservices oder Enterprise-Deployments liefert Kubernetes das nötige Fundament.

Teamkompetenz und Lernkurve

Neben den Projektanforderungen zählen die Fähigkeiten deines Teams enorm.

Bewerte Skills und Lernzeit. Teams mit Docker-Erfahrung, aber neu in der Orchestrierung, sind mit Swarm schneller produktiv. Teams mit Kubernetes-Expertise oder Trainingsressourcen können die erweiterten Möglichkeiten von Kubernetes ausschöpfen.

Infrastruktur- und Skalierungsbedarf

Auch deine Infrastrukturanforderungen beeinflussen die Wahl.

Bewerte Verfügbarkeitsanforderungen, Skalierungsmuster und Verteilung der Infrastruktur. Einfache Skalierung in einem Rechenzentrum passt zu Swarm. Komplexes Autoscaling, Multi-Region-Deployments und dynamisches Ressourcenmanagement sprechen für Kubernetes.

Kosten- und Ressourcenüberlegungen

Berücksichtige schließlich Initial- und Betriebskosten.

Der geringere Overhead von Swarm kann bei kleinen Deployments Kosten sparen. Kubernetes-Autoscaling bringt bei großem Maßstab oft höhere Effizienz – trotz höherer Einstiegshürden.

Alternativen und neue Optionen

Docker Swarm und Kubernetes sind nicht die einzigen Optionen. Für spezielle Use Cases gibt es Alternativen.

K3s und leichte Orchestratoren

K3s, eine schlanke Kubernetes-Distribution, liefert volle Kubernetes-Funktionalität in einem Binary von weniger als 100 MB. Ideal für Edge, IoT und ressourcenarme Umgebungen – bei voller Kompatibilität.

MicroK8s von Canonical und k0s von Mirantis bieten ähnliche Lightweight-Erfahrungen.

Weitere Orchestrierungstools

Neben schlanken Kubernetes-Distributionen verdienen auch völlig andere Plattformen Beachtung:

- HashiCorp Nomad: Einfachere Orchestrierung für Container und Nicht-Container-Workloads

- Red Hat OpenShift: Baut auf Kubernetes auf – mit zusätzlichen Developer-Tools und Enterprise-Features

- Apache Mesos mit Marathon: Ausgereifte Orchestrierung für diverse Workloads

- AWS ECS: Nahtlose AWS-Integration ohne Kubernetes-Komplexität

Je nach Anforderungen und bestehender Infrastruktur können diese Alternativen besser passen als Docker Swarm oder Kubernetes.

Fazit

Docker Swarm und Kubernetes bedienen unterschiedliche Bedürfnisse. Swarm punktet mit Einfachheit und schnellem Rollout – ideal für kleinere Projekte und begrenzte DevOps-Ressourcen. Kubernetes brilliert bei komplexen Deployments mit Advanced Features. Die steile Lernkurve wird durch unerreichte Fähigkeiten im großen Maßstab aufgewogen.

Entscheide anhand deiner Anforderungen, Teamkompetenz und Rahmenbedingungen. Viele Teams nutzen beide Plattformen: Swarm für einfache Services, Kubernetes für komplexe Anwendungen.

Deine Wahl ist nicht endgültig. Viele starten mit Swarm und migrieren später zu Kubernetes, wenn der Bedarf wächst. Triff heute die passende Wahl – mit Blick auf morgen.

Wenn du tiefer in beide Tools einsteigen willst, empfehle ich dir unseren Lernpfad Containerization and Virtualization with Docker and Kubernetes.

Docker Swarm vs Kubernetes FAQs

Is Docker Swarm easier to learn than Kubernetes?

Ja, Docker Swarm ist deutlich leichter zu lernen. Wenn du Docker-Befehle und Docker Compose bereits kennst, wirst du innerhalb weniger Stunden produktiv. Kubernetes hat eine steilere Lernkurve und erfordert das Verständnis von Pods, Services, Deployments und weiteren Konzepten. Diese Komplexität ermöglicht jedoch leistungsfähige Features für großskalige Deployments.

Can Docker Swarm handle production workloads?

Ja, Docker Swarm kann Produktiv-Workloads für kleine bis mittlere Deployments (typisch unter 50–100 Nodes) zuverlässig bewältigen. Es bietet essenzielle Funktionen wie hohe Verfügbarkeit, Load Balancing und Rolling Updates. Für Enterprise-Maßstab mit Tausenden Nodes, fortgeschrittenem Autoscaling oder komplexen Multi-Cloud-Architekturen ist jedoch Kubernetes die bessere Wahl.

Should I migrate from Docker Swarm to Kubernetes?

Die Migration hängt von deinem Bedarf ab. Ziehe sie in Erwägung, wenn du an die Skalierungsgrenzen von Swarm stößt (über 100 Nodes), Advanced Features wie horizontales Autoscaling brauchst, anspruchsvolle Multi-Cloud-Unterstützung benötigst oder vom großen Kubernetes-Ökosystem profitieren willst. Wenn Swarm deine Anforderungen erfüllt, gibt es keinen akuten Migrationsdruck. Viele Organisationen betreiben Swarm erfolgreich in Produktion.

Which platform is more cost-effective?

Für kleine Deployments ist Docker Swarm oft kostengünstiger – dank geringerem Ressourcen-Overhead und weniger Betriebsaufwand. Im großen Maßstab kann Kubernetes durch ausgefeiltes Autoscaling und Ressourcenoptimierung effizienter sein. Berücksichtige sowohl Infrastrukturkosten (Compute) als auch Betriebskosten (Managementzeit und nötige Expertise).

Can I use both Docker Swarm and Kubernetes together?

Ja, viele Organisationen nutzen beide Plattformen für unterschiedliche Zwecke. Ein gängiges Muster: Docker Swarm für einfachere interne Services und Entwicklungsumgebungen, Kubernetes für kundennahe oder komplexe Anwendungen. So kombinierst du Swarms Einfachheit mit den erweiterten Möglichkeiten von Kubernetes.

Als Gründer von Martin Data Solutions und freiberuflicher Datenwissenschaftler, ML- und KI-Ingenieur bringe ich ein vielfältiges Portfolio in den Bereichen Regression, Klassifizierung, NLP, LLM, RAG, Neuronale Netze, Ensemble-Methoden und Computer Vision mit.

- Er hat erfolgreich mehrere End-to-End-ML-Projekte entwickelt, einschließlich Datenbereinigung, Analyse, Modellierung und Bereitstellung auf AWS und GCP, und dabei wirkungsvolle und skalierbare Lösungen geliefert.

- Du hast mit Streamlit und Gradio interaktive und skalierbare Webanwendungen für verschiedene Branchen entwickelt.

- Er unterrichtete und betreute Studierende in den Bereichen Datenwissenschaft und Analytik und förderte ihre berufliche Entwicklung durch personalisierte Lernansätze.

- Entwickelte Kursinhalte für Retrieval-Augmented-Generating (RAG)-Anwendungen, die auf die Anforderungen von Unternehmen zugeschnitten sind.

- Er hat hochwirksame technische Blogs zu Themen wie MLOps, Vektordatenbanken und LLMs verfasst und damit ein hohes Maß an Engagement erzielt.

Bei jedem Projekt, das ich übernehme, achte ich darauf, dass ich die neuesten Praktiken des Software-Engineerings und der DevOps anwende, wie CI/CD, Code Linting, Formatierung, Modellüberwachung, Experiment-Tracking und robuste Fehlerbehandlung. Ich biete Komplettlösungen an und verwandle Datenerkenntnisse in praktische Strategien, die Unternehmen dabei helfen, zu wachsen und das Beste aus Data Science, maschinellem Lernen und KI herauszuholen.