Cursus

Quand j’ai commencé à travailler avec des applications conteneurisées, gérer manuellement quelques conteneurs restait faisable, mais passer à l’échelle exigeait une autre approche. C’est là que les plateformes d’orchestration de conteneurs deviennent indispensables, et deux noms s’imposent systématiquement : Docker Swarm et Kubernetes.

L’orchestration de conteneurs automatise le déploiement, la gestion, la mise à l’échelle et le réseau des conteneurs sur des grappes de machines. Choisir la bonne plateforme peut avoir un impact majeur sur la productivité de votre équipe, vos coûts d’exploitation et vos capacités de montée en charge.

Dans ce guide, je compare en profondeur Docker Swarm et Kubernetes pour vous aider à choisir la meilleure plateforme selon vos besoins, que vous pilotiez une startup ou une infrastructure d’entreprise.

Si vous débutez avec Docker, je vous recommande notre cours Introduction to Docker. Lisez aussi notre tutoriel sur l’exécution de Claude Code dans Docker.

Qu’est-ce que Docker Swarm ?

Commençons par explorer Docker Swarm, la plus simple des deux plateformes.

Docker Swarm est la solution d’orchestration native de Docker qui transforme plusieurs hôtes Docker en un hôte virtuel unifié. Je la trouve particulièrement attrayante grâce à son intégration fluide à l’écosystème Docker déjà adopté par de nombreuses équipes.

Logo Docker Swarm

Intégré directement au Docker Engine, Swarm étend les capacités de Docker pour gérer des conteneurs distribués sur plusieurs machines. Activer le mode Swarm crée un cluster qui répartit intelligemment les charges, maintient une haute disponibilité et met les services à l’échelle sans la complexité habituelle des plateformes d’orchestration.

Si vous hésitez encore sur Docker, ses fonctionnalités et la comparaison avec Kubernetes, consultez nos autres articles comparatifs Kubernetes vs Docker et Docker Compose vs Kubernetes.

Remarque : le mode Swarm reste fonctionnel et reçoit des mises à jour de sécurité, mais le développement actif de nouvelles fonctionnalités a fortement ralenti au profit des solutions basées sur Kubernetes.

Architecture et composants de Docker Swarm

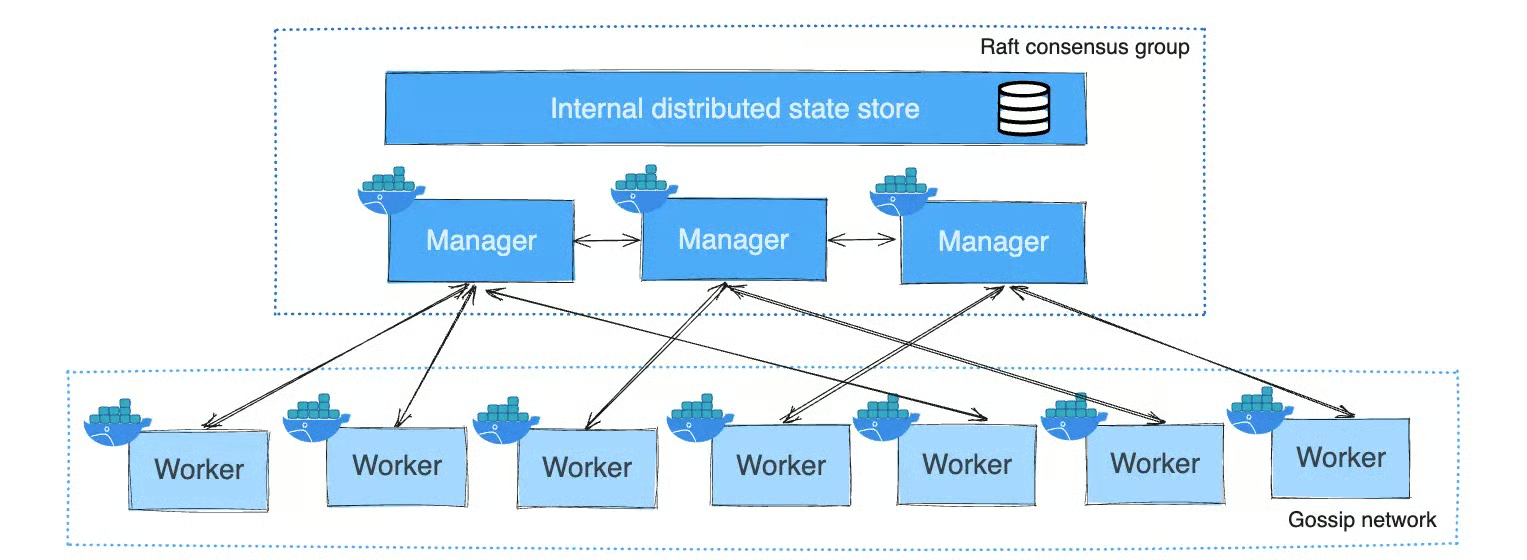

Docker Swarm suit un modèle manager-worker. Les nœuds managers orchestrent et maintiennent l’état du cluster, tandis que les nœuds workers exécutent les tâches. Les managers peuvent aussi exécuter des charges ou être dédiés à l’orchestration.

Il utilise l’algorithme de consensus Raft, qui désigne un leader unique parmi les managers pour gérer toutes les décisions du cluster. Les décisions exigent l’accord de la majorité des managers. Ainsi, Docker Swarm garantit la cohérence de l’état du cluster entre les managers et peut continuer à fonctionner malgré la défaillance de certains nœuds managers.

Les services sont définis dans des fichiers YAML similaires à Docker Compose, précisant l’état de l’application, y compris les réplicas, les réseaux et les ressources.

Maintenant que nous avons vu l’architecture, regardons ce que Docker Swarm peut vous apporter.

Fonctionnalités clés de Docker Swarm

Docker Swarm intègre plusieurs fonctionnalités prêtes à l’emploi pour une orchestration accessible :

- Découverte de services : automatique via le DNS intégré, permettant aux conteneurs de se retrouver par noms de service

- Répartition de charge : mesh de routage intégré qui distribue les requêtes entre des réplicas sains sur différents nœuds

- Mises à jour progressives : déploiements progressifs avec parallélisme et délais configurables, et retours arrière rapides en cas de problème

- Haute disponibilité : assurée par la réplication des services et le replanification automatique en cas de défaillance

- Réseau overlay : communication entre conteneurs à travers les hôtes, avec chiffrement optionnel du trafic applicatif (non activé par défaut)

Fonctionnalités clés de Docker Swarm

Ces fonctionnalités se combinent pour offrir une orchestration prête pour la production, sans configuration lourde. Cette simplicité intégrée rend Docker Swarm très attractif pour les équipes qui veulent démarrer vite.

Avantages de Docker Swarm

Compte tenu de ces atouts, voici où Docker Swarm excelle vraiment. Il propose plusieurs avantages déterminants :

- Mise en place rapide : initialiser un cluster ne demande qu’un docker swarm init

- Douce : si vous maîtrisez Docker, vous avez déjà fait la moitié du chemin avec des commandes CLI familières et des formats Docker Compose

- Intégration native : pas besoin de nouvelles API ni de logiciels supplémentaires

- Idéal pour des projets petits à moyens : l’essentiel de l’orchestration sans complexité excessive

- Faible surcoût de ressources : vous exécutez plus de conteneurs applicatifs sur le même matériel qu’avec Kubernetes, ce qui est économique pour de petits déploiements

Ces avantages rendent Docker Swarm particulièrement séduisant pour les startups, les petites équipes de développement et les organisations qui privilégient la rapidité de mise en œuvre à une richesse fonctionnelle pléthorique. La barrière d’entrée faible vous permet d’orchestrer des conteneurs en production en quelques heures plutôt qu’en jours ou semaines.

Inconvénients de Docker Swarm

Aucune plateforme n’est parfaite. Voici les principales limites à garder en tête :

- Contraintes de montée en charge : n’atteint pas le niveau de Kubernetes pour des milliers de nœuds ou des charges très complexes

- Écosystème réduit : moins d’outils tiers et de ressources communautaires

- Extensibilité limitée : le couplage étroit à l’API Docker restreint les personnalisations avancées

- Fonctionnalités avancées manquantes : autoscaling sophistiqué et politiques réseau complexes absents ou nécessitant des contournements

- Gestion multi-cluster faible : capacités minimales, difficile pour des déploiements distribués géographiquement

- Charges avec état difficiles : les bases de données nécessitant une orchestration de stockage avancée sont plus complexes à gérer

- Développement ralenti : le développement actif de fonctionnalités est en grande partie à l’arrêt, Docker se concentrant sur des solutions basées sur Kubernetes. À distinguer du « Classic Swarm », totalement déprécié et supprimé dans Docker v23.0

Ces limites existent, mais elles ne posent problème que si votre cas d’usage requiert réellement ces capacités avancées. Pour de nombreux projets, l’éventail de fonctionnalités de Docker Swarm est amplement suffisant, et la simplicité vaut largement le compromis.

La question n’est pas de savoir si Swarm a des limites, mais si elles importent pour vos besoins précis. Si vous souhaitez explorer d’autres outils, lisez notre article sur les meilleures alternatives à Docker en 2026.

Qu’est-ce que Kubernetes ?

Après Docker Swarm, intéressons-nous à Kubernetes, l’alternative plus puissante mais plus complexe.

Kubernetes (K8s) est devenu le standard du secteur pour l’orchestration de conteneurs. Initialement développé par Google et aujourd’hui maintenu par la Cloud Native Computing Foundation, il a été conçu pour gérer des applications conteneurisées à très grande échelle. Pour une introduction détaillée, consultez notre guide What is Kubernetes?.

Logo Kubernetes

Kubernetes propose une plateforme pensée pour répondre à quasiment tous les défis de production liés aux conteneurs. Au-delà de l’orchestration de base, il offre des solutions pour le stockage persistant, la gestion de configuration, la gestion des secrets et le traitement de tâches.

Son adoption massive a donné naissance à un vaste écosystème d’outils et de services.

Architecture et composants de Kubernetes

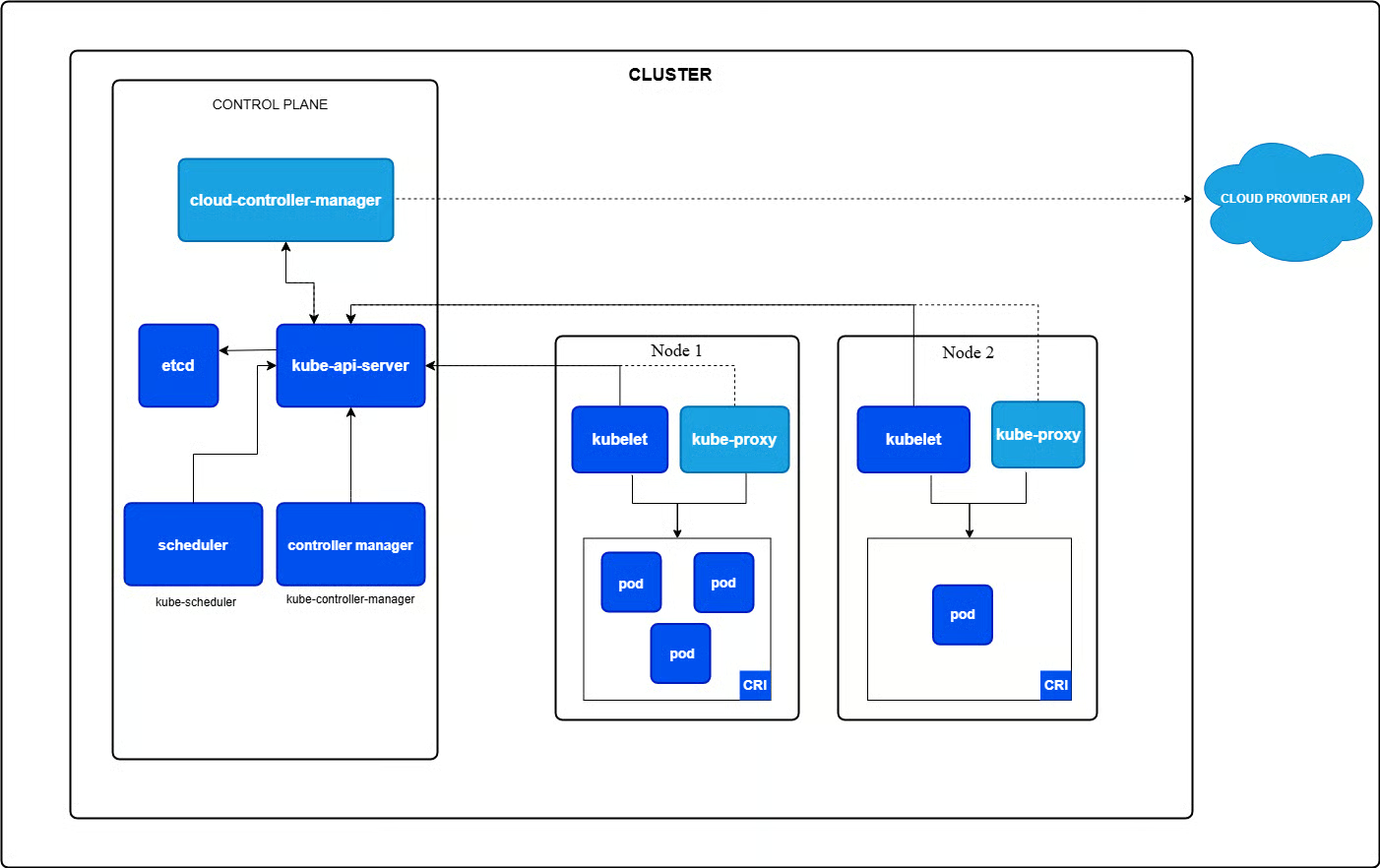

Kubernetes utilise une topologie maître-worker, le « maître » étant appelé plan de contrôle (control plane). Les composants clés du plan de contrôle incluent :

- kube-apiserver : le serveur central qui expose l’API HTTP de Kubernetes

- etcd : un magasin clé-valeur distribué pour les données de l’API server

- kube-scheduler : assigne les Pods aux nœuds

- kube-controller-manager : exécute les contrôleurs qui implémentent le comportement de l’API Kubernetes

- cloud-controller-manager : optionnel ; intègre les fournisseurs cloud sous-jacents

Les nœuds workers exécutent kubelet (communication avec le plan de contrôle), kube-proxy (gestion du réseau), et hébergent les Pods, plus petite unité déployable contenant un ou plusieurs conteneurs partageant des ressources.

Composants d’un cluster Kubernetes

Cette architecture distribuée est plus complexe que celle de Docker Swarm, mais elle rend possible l’excellente scalabilité et résilience de Kubernetes. Chaque composant a un rôle précis et bien défini, et l’ensemble forme un système d’orchestration particulièrement robuste.

Pour aller plus loin, consultez notre guide Kubernetes Architecture.

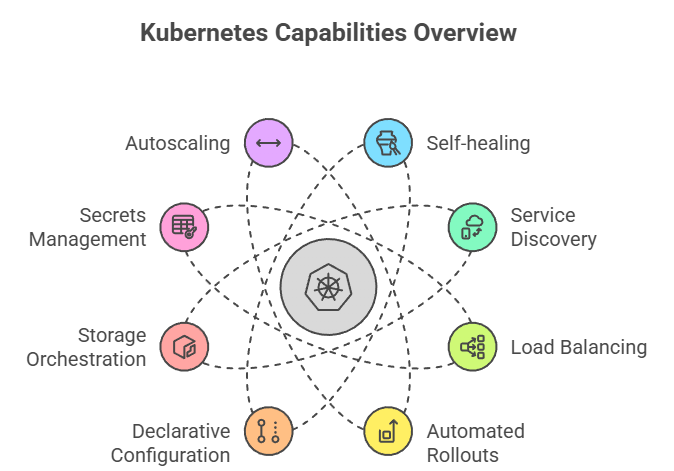

Fonctionnalités clés de Kubernetes

Avec cette architecture, Kubernetes propose un riche éventail de capacités. Voici ses fonctionnalités étendues pour les opérations de conteneurs en production :

- Auto-réparation : remplacement automatique des conteneurs en échec, replanification des Pods quand des nœuds tombent, redémarrage des conteneurs défaillants

- Découverte de services et répartition de charge : noms DNS intégrés et distribution intelligente du trafic entre les réplicas de Pods

- Déploiements et retours arrière automatisés : mises en production sûres avec contrôle fin et retour automatique en cas de problème

- Configuration déclarative : décrivez l’état souhaité du cluster en YAML, Kubernetes le maintient en continu

- Orchestration du stockage : Container Storage Interface prenant en charge de nombreux backends avec provisionnement dynamique

- Gestion des secrets : prise en charge sécurisée des données sensibles et de la configuration

- Autoscaling : autoscaling horizontal qui ajuste les réplicas selon des métriques, autoscaling vertical qui modifie les allocations de ressources

Aperçu des capacités de Kubernetes

Cette panoplie complète explique pourquoi Kubernetes est le choix privilégié pour des environnements de production complexes. Là où Docker Swarm assure les fondamentaux, Kubernetes apporte des capacités avancées qui deviennent essentielles à mesure que votre infrastructure grandit.

Avantages de Kubernetes

Voici pourquoi Kubernetes est devenu la référence du secteur. Il excelle sur des déploiements complexes et à grande échelle :

- Scalabilité exceptionnelle : des clusters pouvant atteindre des milliers de nœuds tout en maintenant les performances

- Écosystème immense : intégrations étendues, services managés des grands clouds, myriade d’outils

- Planification avancée : règles d’affinité, taints, tolerations et quotas de ressources pour un contrôle fin des charges

- Support multi-cloud : des API cohérentes pour des déploiements véritablement multi-cloud et hybrides

- Gestion multi-cluster : plusieurs outils (tels que Karmada, successeur de KubeFed déprécié) permettent de gérer des charges sur plusieurs clusters pour des applications globales

- Extensibilité : Custom Resources et Operators pour gérer presque tout type de charge

- Communauté active : documentation abondante et expertise facilement accessible

Ces avantages expliquent pourquoi Kubernetes est devenu synonyme d’orchestration de conteneurs dans les grandes organisations. Quand vous avez besoin de fonctions de niveau entreprise, d’un outillage étendu et d’une plateforme qui évolue avec vous, Kubernetes répond présent.

Pour voir l’outil en action, consultez ce Kubernetes Tutorial.

Inconvénients de Kubernetes

Toute cette puissance a toutefois un coût :

- Complexité élevée : rendre un cluster prêt pour la production suppose de nombreux réglages et choix

- Courbe d’apprentissage abrupte : maîtriser Kubernetes exige de comprendre de nombreux composants et bonnes pratiques

- Exigences en ressources plus fortes : les composants du plan de contrôle consomment des ressources notables, augmentant la charge opérationnelle

- Surdimensionné possible : pour de petites équipes ou des applis simples, Kubernetes peut introduire une complexité inutile

Comprendre ces arbitrages est essentiel pour décider. Les inconvénients de Kubernetes ne sont pas des défauts, mais la conséquence de sa conception puissante et flexible. La question est de savoir si votre cas d’usage justifie d’accepter cette complexité.

Docker Swarm vs Kubernetes : comparaison des fonctionnalités clés

Après avoir étudié chaque plateforme séparément, examinons leur comparaison selon des critères essentiels.

|

Fonctionnalité |

Docker Swarm |

Kubernetes |

|

Mise en place |

Simple (une commande) |

Complexe |

|

Courbe d’apprentissage |

Douce |

Abrupte |

|

Montée en charge |

~50–100 nœuds |

Jusqu’à 5 000 nœuds |

|

Écosystème |

Plus réduit |

Très vaste |

|

Autoscaling |

Non natif (nécessite des outils externes) |

Automatique (HPA) ; VPA disponible en add-on |

|

Idéal pour |

Projets petits à moyens |

Échelle entreprise |

Passons maintenant en détail chaque critère de comparaison. Commençons par ce qui est souvent votre premier contact avec une plateforme d’orchestration : la mise en service.

Installation, configuration et courbe d’apprentissage

Installer Docker Swarm est simple : avec Docker Engine en place, une seule commande docker swarm init crée un cluster. Ajouter des nœuds ne demande que le jeton de jonction. La plupart des équipes peuvent avoir un cluster opérationnel en moins d’une heure.

À l’inverse, l’installation de Kubernetes varie selon l’approche. Les services managés (AWS EKS, GKE, AKS) prennent en charge l’essentiel de la complexité. Les installations autogérées requièrent kubectl, la configuration réseau, les certificats et etcd. Des outils comme kubeadm ou k3s simplifient les choses, mais Kubernetes demande davantage d’efforts de mise en place que Swarm.

La courbe d’apprentissage suit la même logique. Si vous connaissez déjà les commandes Docker et les fichiers Compose, Swarm est naturel. C’est, en somme, Docker à l’échelle. Kubernetes, lui, introduit de nouveaux concepts (Pods, ReplicaSets, Services, Ingress) et un modèle mental plus exigeant à maîtriser.

Stratégies de déploiement et gestion des applications

Une fois votre cluster en place, voici comment les approches de déploiement diffèrent entre les deux plateformes.

Docker Swarm reste simple : les applications sont déployées comme services via des fichiers YAML compatibles avec Docker Compose. Si vous utilisez Compose en local, le format vous sera immédiatement familier. Les stacks permettent de déployer plusieurs services ensemble, et les mises à jour progressives se font en indiquant de nouvelles versions avec des paramètres de mise à jour configurables.

Kubernetes adopte une approche plus sophistiquée. Plutôt qu’un seul concept de déploiement, vous disposez de plusieurs types de ressources spécialisées :

- Deployments pour les mises à jour progressives

- StatefulSets pour les applications avec état nécessitant des identités stables

- DaemonSets pour des Pods spécifiques à chaque nœud

- Jobs pour les traitements batch.

Cette diversité offre puissance et flexibilité, mais impose de choisir le type de ressource adapté à votre cas. Les stratégies avancées comme le canary ou le blue-green sont bien prises en charge via diverses techniques et outils tiers.

Scalabilité, haute disponibilité et performances

C’est ici que les plateformes se différencient vraiment.

Docker Swarm gère correctement la montée en charge pour des clusters petits à moyens (généralement moins de 50–100 nœuds). La mise à l’échelle est déclarative : vous indiquez le nombre de réplicas souhaité et Swarm s’ajuste automatiquement. Les performances sont bonnes avec un surcoût moindre, ce qui est efficace pour de petites charges.

En contrepartie, vous êtes limité à des décisions de scaling manuelles ; Swarm n’ajoute ni ne retire automatiquement des réplicas en fonction de l’usage CPU ou mémoire.

Kubernetes, de son côté, excelle à l’échelle sur plusieurs axes. D’abord, il peut gérer des milliers de nœuds et des dizaines de milliers de Pods sans difficulté. Ensuite, et surtout, il met à l’échelle intelligemment.

L’Horizontal Pod Autoscaler ajuste automatiquement les réplicas selon des métriques, le Vertical Pod Autoscaler modifie les allocations de ressources, et le Cluster Autoscaler pilote même le nombre de nœuds dans les environnements cloud. Cette automatisation rend Kubernetes très économique pour des charges variables.

Réseau et répartition de charge

Le réseau est critique, et chaque plateforme aborde différemment les mêmes problèmes fondamentaux.

Docker Swarm inclut une répartition de charge intégrée via son routing mesh, qui distribue automatiquement le trafic entre les points de terminaison des services. Les réseaux overlay permettent une communication chiffrée entre conteneurs, tandis que la découverte de services repose sur le DNS intégré. Une approche « tout inclus » : tout ce dont vous avez besoin est intégré et configuré par défaut.

Kubernetes offre davantage de flexibilité, au prix d’une configuration plus poussée. Le réseau s’appuie sur la Container Network Interface (CNI), qui supporte des solutions comme Calico, Cilium ou Flannel. À vous de choisir.

Les Ingress controllers proposent un routage HTTP/HTTPS avancé avec terminaison SSL. Les network policies permettent un contrôle fin du trafic entre Pods. Pour des cas avancés, des service meshes comme Istio s’intègrent pour la gestion du trafic, la sécurité et l’observabilité. Cette modularité est puissante mais exige plus de décisions en amont.

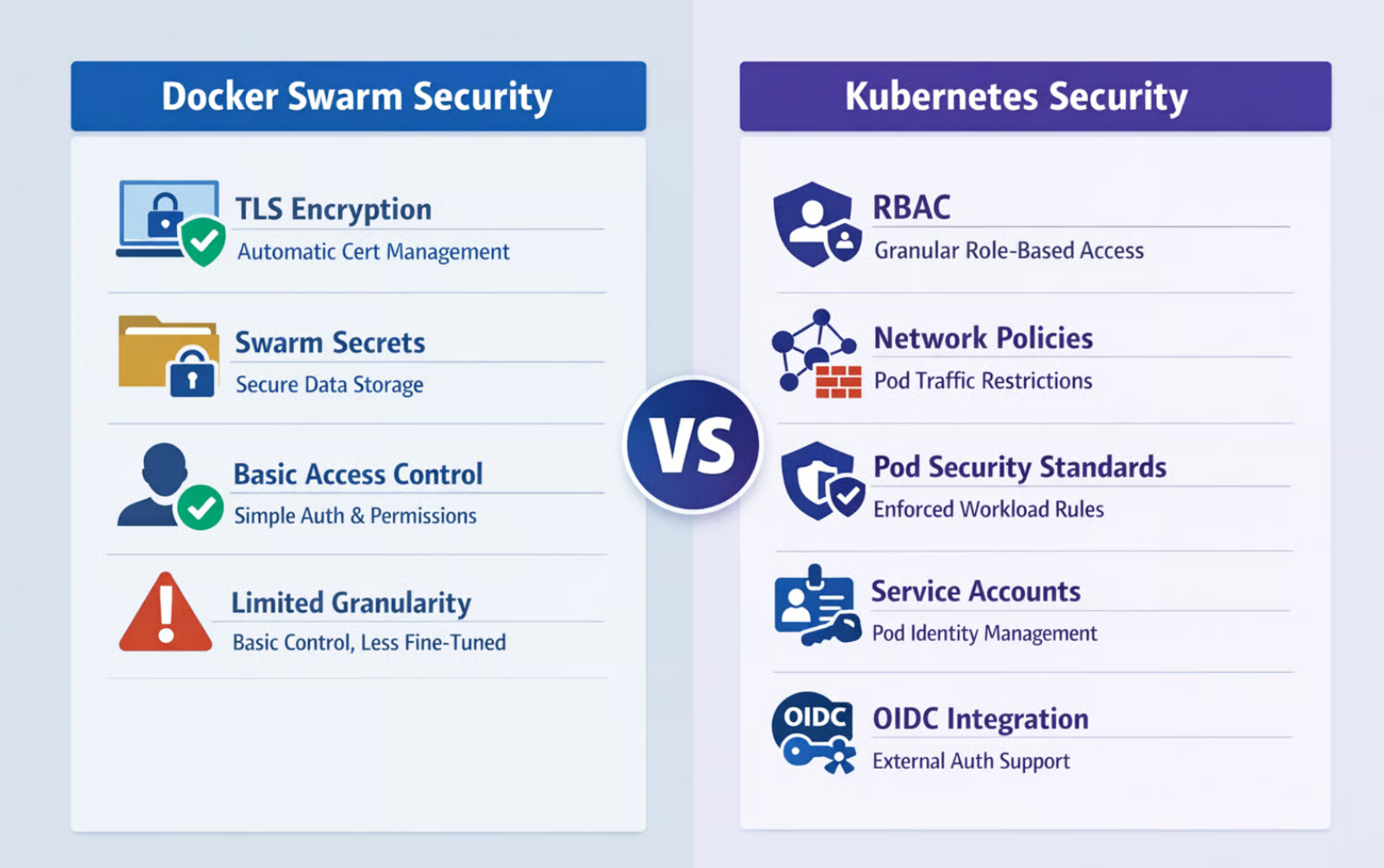

Sécurité et contrôle d’accès

La sécurité est primordiale, et l’héritage « entreprise » de Kubernetes s’y démarque.

Docker Swarm fournit l’essentiel : chiffrement TLS avec gestion automatique des certificats pour sécuriser la communication inter-nœuds, et Swarm Secrets pour stocker de manière sûre les données sensibles (mots de passe, clés d’API). Le contrôle d’accès s’appuie sur les mécanismes d’authentification de Docker. C’est simple et suffisant pour beaucoup de cas, mais cela manque de granularité.

Sécurité : Docker Swarm vs. Kubernetes

Kubernetes propose une sécurité complète, pensée pour des environnements multi-locataires. Un de ses plus grands atouts pour des déploiements sûrs en équipe est le Role-Based Access Control (RBAC), qui offre des permissions fines au niveau des namespaces comme du cluster. Vous spécifiez précisément qui peut faire quoi sur quelles ressources.

Les network policies restreignent le trafic entre Pods selon des labels et des règles. Les Pod Security Standards imposent des contraintes de sécurité sur les spécifications de workload. Les comptes de service fournissent une identité aux Pods, avec intégration possible à des fournisseurs d’authentification externes via OIDC et autres protocoles.

Ce modèle de sécurité étendu rend Kubernetes adapté aux secteurs réglementés et aux exigences organisationnelles complexes.

Stockage et persistance des données

S’agissant des données persistantes, les philosophies de conception divergent nettement.

Docker Swarm prend en charge les volumes locaux et nommés, suffisants pour des cas simples. Mais la gestion du stockage reste basique, le provisionnement dynamique est limité, et la coordination du stockage entre réplicas pour des applications avec état complexes devient difficile. Vous aurez souvent besoin d’outils externes ou de configurations manuelles au-delà d’un simple montage de volume.

Kubernetes a été pensé dès le départ pour les charges avec état. Il propose des PersistentVolumes (PV) comme ressources de stockage à l’échelle du cluster et des PersistentVolumeClaims (PVC) pour que les applications demandent du stockage sans connaître les détails sous-jacents.

Les StorageClasses permettent le provisionnement dynamique : le stockage est créé automatiquement à la demande. La Container Storage Interface prend en charge de nombreux fournisseurs avec des fonctions avancées comme les snapshots, le clonage et l’extension. Les StatefulSets coordonnent stockage et identité des Pods, rendant fiables des bases de données distribuées complexes.

Sur ce volet, Kubernetes s’impose pour les charges avec état.

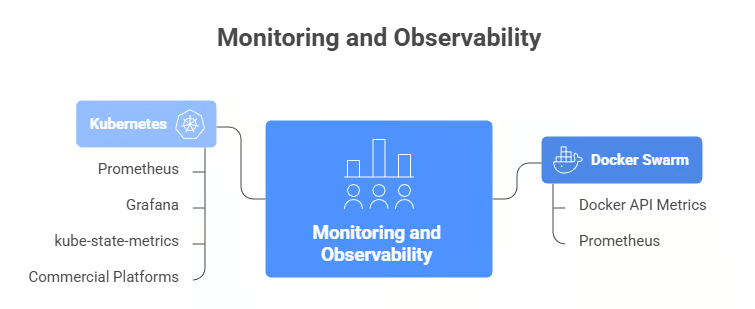

Supervision, observabilité et outillage opérationnel

L’observabilité vous aide à comprendre l’activité du cluster, mais la maturité de l’écosystème diffère fortement.

Docker Swarm offre des métriques de base via l’API Docker, utiles pour la santé des conteneurs et des nœuds. Pour une vue complète, vous recourrez généralement à des outils externes comme Prometheus. L’écosystème d’observabilité autour de Swarm est plus restreint, avec moins d’intégrations dédiées et une communauté moins investie sur ces sujets.

Supervision et observabilité : Docker Swarm vs Kubernetes

L’écosystème de supervision Kubernetes est, disons-le, immense. Prometheus est le standard de facto pour les métriques Kubernetes, souvent associé à Grafana pour la visualisation. Le composant kube-state-metrics expose des métriques au niveau du cluster sur l’état des objets. Des outils de traçage distribué comme Jaeger s’intègrent sans friction.

De nombreuses plateformes commerciales (Datadog, New Relic, Dynatrace) proposent des intégrations spécifiques à Kubernetes, avec tableaux de bord et alertes prêts à l’emploi. Cette richesse d’outils permet une observabilité de niveau entreprise, mais implique de choisir et configurer ces solutions.

Écosystème, extensibilité et support communautaire

Au-delà des fonctionnalités de base, l’écosystème environnant peut transformer l’expérience — et c’est là que l’écart est le plus flagrant.

Kubernetes dispose d’un écosystème colossal. Tous les grands outils de monitoring, plateformes de sécurité, systèmes CI/CD et clouds offrent un support Kubernetes de premier plan. Besoin d’étendre Kubernetes ? Les Custom Resource Definitions (CRD) permettent d’ajouter vos propres types de ressources, et les Operators automatisent la gestion d’applications complexes selon les schémas natifs Kubernetes.

La communauté est vaste et active, avec une documentation abondante, des conférences régulières, d’innombrables tutoriels et une expertise aisément mobilisable.

L’écosystème de Docker Swarm est nettement plus restreint. La communauté Docker reste présente, mais moins d’outils tiers ciblent spécifiquement Swarm. Les possibilités de personnalisation sont limitées par les contraintes de l’API Docker. Vous travaillez dans les limites que Swarm propose. Résultat : moins de solutions « prêtes à l’emploi » pour les cas limites et moins de dynamique d’innovation communautaire.

Intégrations cloud et capacités multi-clusters

L’intégration au cloud est clé si vous opérez sur AWS, Azure ou GCP, et les plateformes y adoptent des approches très différentes. Pour comparer les 3 principaux fournisseurs cloud, consultez ce guide AWS vs. Azure vs. GCP.

Tous les grands clouds proposent des services Kubernetes managés (AWS EKS, Google GKE, Azure AKS), où ils gèrent le plan de contrôle, les mises à niveau et fournissent une intégration étroite à leurs services natifs.

Les abstractions Kubernetes fonctionnent de manière cohérente sur différents environnements cloud, facilitant de véritables architectures multi-cloud et hybrides. Besoin de gérer des applications sur plusieurs régions ou clouds ? Karmada, successeur de Kubernetes Federation (KubeFed), permet de piloter plusieurs clusters comme une seule entité logique — essentiel pour des déploiements globaux.

Docker Swarm fonctionne correctement dans le cloud, mais sans intégrations aussi profondes. Vous pouvez faire tourner des clusters Swarm sur AWS, Azure ou GCP, mais vous devrez gérer davantage d’infrastructure vous-même. Le multi-cluster est limité, chaque cluster Swarm opérant de manière indépendante.

Coordonner des déploiements entre régions ou fournisseurs demandera des outils maison et des couches d’orchestration supplémentaires.

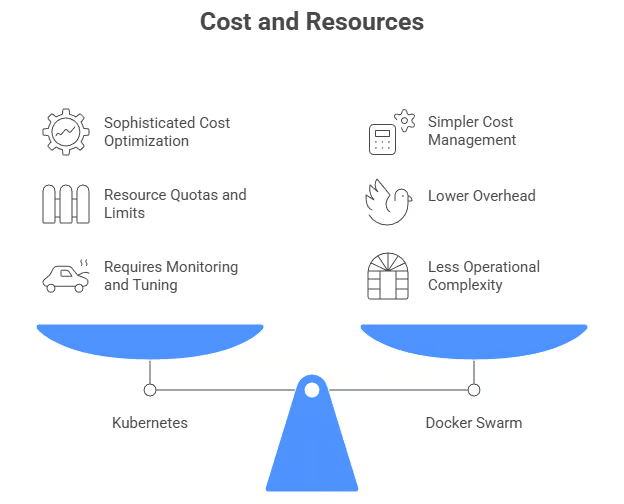

Optimisation des coûts et efficacité des ressources

Le coût reste un critère clé, et les plateformes l’adressent différemment, selon leurs priorités de conception.

Kubernetes intègre des leviers sophistiqués d’optimisation des coûts. Les quotas et limites de ressources évitent qu’une équipe ou une application ne monopolise le cluster. L’Horizontal Pod Autoscaler et le Cluster Autoscaler alignent allocation et demande réelle, avec une réduction automatique pendant les périodes creuses pour économiser.

L’intégration aux instances spot des clouds peut réduire fortement les coûts de calcul. Des outils comme Kubecost offrent une visibilité fine sur les dépenses et des recommandations d’optimisation. L’envers de cette sophistication : il faut surveiller, régler et disposer de l’expertise nécessaire pour en tirer le meilleur parti.

Coûts et ressources : Docker Swarm vs Kubernetes

Docker Swarm adopte une approche plus simple. Le modèle de ressources est droit au but, avec moins de fonctions d’optimisation intégrées. Toutefois, son faible surcoût signifie que plus de ressources de votre infrastructure servent réellement vos applications plutôt que l’orchestration.

La gestion des coûts repose généralement sur des outils de monitoring externes et des ajustements manuels. Pour de petits déploiements, cette simplicité peut être plus économique : vous dépensez moins en complexité opérationnelle, même si la plateforme manque de mécanismes avancés.

Après cette comparaison technique, de l’installation à l’optimisation des coûts, vous vous demandez peut-être : « Laquelle dois-je choisir ? » Comme souvent, la réponse dépend de votre contexte. Voyons dans quels scénarios chacune brille vraiment.

Cas d’usage de Docker Swarm et Kubernetes

Comprendre les différences techniques est une chose ; savoir quand utiliser chaque plateforme est essentiel. Voici les scénarios idéaux pour chacune.

Cas d’usage de Docker Swarm

Docker Swarm excelle dans ces situations :

- Déploiements petits à moyens : projets sous 50 nœuds avec des besoins d’orchestration simples

- Prototypage rapide : environnements de développement où l’installation et l’itération rapides priment

- Ressources DevOps limitées : équipes qui débutent l’orchestration ou sans ingénieurs plateforme dédiés

- Environnements 100 % Docker : organisations très investies dans les outils et workflows Docker

- Priorité à la simplicité : applications où la simplicité opérationnelle prime sur les fonctions avancées

Si votre projet correspond à ces critères, Docker Swarm vous permet d’orchestrer vos conteneurs sans la charge d’apprentissage et d’exploitation d’un système plus complexe. Vous serez productif rapidement, avec la possibilité de migrer vers Kubernetes si vos besoins dépassent ceux de Swarm.

Cas d’usage de Kubernetes

À l’inverse, Kubernetes s’impose quand vous avez besoin de :

- Déploiements à grande échelle : systèmes complexes gérant des centaines ou milliers de nœuds

- Environnements d’entreprise : organisations multi-équipes avec exigences strictes de conformité et de sécurité

- Architectures multi-cloud : déploiements couvrant plusieurs clouds ou hybrides

- Systèmes hautement disponibles : applications exigeant bascule, PRA et distribution géographique avancées

- Automatisation avancée : charges nécessitant autoscaling, auto-réparation et logique d’orchestration complexe

- Équipes plateforme dédiées : organisations disposant d’ingénieurs pour gérer et optimiser l’infrastructure Kubernetes

Ces cas justifient l’investissement dans l’apprentissage et l’exploitation de Kubernetes. Sa complexité devient un atout quand vous résolvez des défis d’orchestration à grande échelle. Si vous vous reconnaissez dans ces scénarios, l’effort d’adoption de Kubernetes sera vite rentabilisé.

Comment choisir entre Docker Swarm et Kubernetes

Une fois les cas d’usage clarifiés, comment décider ? Voici un cadre :

|

Choisissez Swarm si… |

Choisissez Kubernetes si… |

|

< 50 nœuds |

> 100 nœuds |

|

Équipe à l’aise avec Docker |

Équipe avec compétences K8s |

|

Démarrage rapide prioritaire |

Besoins de niveau entreprise |

|

Budget serré |

Recours possible aux services managés |

Examinons chaque facteur de décision.

Taille et complexité du projet

Considérez votre échelle actuelle et votre trajectoire. Pour quelques dizaines de services aux besoins simples, Swarm suffit. Pour une croissance rapide, des microservices complexes ou un déploiement d’entreprise, Kubernetes offre la base requise.

Expertise de l’équipe et courbe d’apprentissage

Au-delà des besoins du projet, les compétences de votre équipe pèsent lourd.

Évaluez les compétences et le temps d’apprentissage disponibles. Des équipes expérimentées sur Docker mais novices en orchestration seront plus rapides et productives avec Swarm. Celles qui maîtrisent Kubernetes, ou disposent de ressources de formation, sauront exploiter ses capacités avancées.

Infrastructure et besoins de scaling

Votre infrastructure guidera aussi votre choix.

Évaluez vos exigences de disponibilité, vos patterns de montée en charge et la distribution de votre infrastructure. Un scaling simple dans un seul datacenter convient à Swarm. L’autoscaling complexe, le multi-région et la gestion dynamique des ressources privilégient Kubernetes.

Coûts et ressources

Enfin, considérez les coûts initiaux et récurrents.

Le faible surcoût de Swarm peut réduire les coûts pour de petits déploiements. À l’échelle, l’autoscaling de Kubernetes peut offrir une meilleure efficience, malgré des prérequis plus élevés.

Alternatives et options émergentes

Docker Swarm et Kubernetes ne sont pas vos seules options. Plusieurs alternatives existent pour des besoins spécifiques.

K3s et orchestrateurs légers

K3s, une distribution Kubernetes légère, fournit l’intégralité de Kubernetes dans un binaire de moins de 100 Mo. Idéale pour l’edge, l’IoT et les environnements contraints en ressources, tout en restant compatible.

MicroK8s de Canonical et k0s de Mirantis offrent des expériences légères similaires.

Autres outils d’orchestration de conteneurs

Au-delà des distributions Kubernetes légères, d’autres plateformes méritent d’être étudiées :

- HashiCorp Nomad : orchestration plus simple, gérant à la fois les charges conteneurisées et non conteneurisées

- Red Hat OpenShift : basé sur Kubernetes, avec des outils développeurs et des fonctions d’entreprise ajoutés

- Apache Mesos avec Marathon : orchestration mature pour des charges hétérogènes

- AWS ECS : intégration AWS fluide sans la complexité de Kubernetes

Selon vos exigences et votre existant, ces alternatives peuvent mieux convenir que Docker Swarm ou Kubernetes.

Conclusion

Docker Swarm et Kubernetes répondent à des besoins différents. Swarm brille par sa simplicité et sa rapidité de déploiement, idéal pour les petits projets et des ressources DevOps limitées. Kubernetes s’illustre sur des déploiements complexes nécessitant des fonctions avancées. Sa courbe d’apprentissage raide est compensée par des capacités inégalées à l’échelle.

Choisissez selon vos besoins, l’expertise de votre équipe et vos exigences. Beaucoup d’équipes utilisent les deux : Swarm pour les services simples et Kubernetes pour les applications complexes.

Votre choix n’est pas gravé dans le marbre. Nombreux sont ceux qui démarrent avec Swarm puis migrent vers Kubernetes à mesure que les besoins évoluent. Choisissez ce qui correspond à votre situation actuelle, tout en gardant à l’esprit vos besoins futurs.

Pour aller plus loin avec les deux outils, nous vous recommandons vivement de vous inscrire à notre parcours de compétences Containerization and Virtualization with Docker and Kubernetes.

Docker Swarm vs Kubernetes : FAQ

Docker Swarm est-il plus facile à apprendre que Kubernetes ?

Oui, Docker Swarm est nettement plus facile à apprendre. Si vous connaissez déjà les commandes Docker et Docker Compose, vous pouvez être productif avec Swarm en quelques heures. Kubernetes a une courbe d’apprentissage plus abrupte et impose de comprendre Pods, Services, Deployments et d’autres concepts. Cette complexité permet toutefois des fonctionnalités plus puissantes pour des déploiements à grande échelle.

Docker Swarm peut-il gérer des charges de production ?

Oui, Docker Swarm peut gérer efficacement des charges de production pour des déploiements petits à moyens (généralement sous 50–100 nœuds). Il fournit des fonctionnalités essentielles comme la haute disponibilité, la répartition de charge et les mises à jour progressives. En revanche, pour des déploiements à l’échelle entreprise nécessitant des milliers de nœuds, un autoscaling avancé ou des architectures multi-cloud complexes, Kubernetes est plus adapté.

Dois-je migrer de Docker Swarm vers Kubernetes ?

La migration dépend de vos besoins. Envisagez-la si vous atteignez les limites de Swarm (au-delà de 100 nœuds), si vous avez besoin de fonctions avancées comme l’autoscaling horizontal, d’un support multi-cloud sophistiqué ou si vous souhaitez profiter du vaste écosystème Kubernetes. Si Swarm répond à vos besoins, rien n’oblige à migrer. De nombreuses organisations exécutent Swarm en production avec succès.

Quelle plateforme est la plus économique ?

Pour de petits déploiements, Docker Swarm est souvent plus économique grâce à un surcoût en ressources plus faible et une complexité opérationnelle réduite. Kubernetes peut être plus rentable à l’échelle via des mécanismes d’autoscaling et d’optimisation des ressources. Prenez en compte à la fois les coûts d’infrastructure (calcul) et les coûts opérationnels (temps de gestion et expertise requise).

Puis-je utiliser Docker Swarm et Kubernetes ensemble ?

Oui, de nombreuses organisations utilisent les deux plateformes pour des besoins différents. Un schéma courant consiste à utiliser Docker Swarm pour des services internes simples et les environnements de développement, et à déployer les applications complexes ou orientées client sur Kubernetes. Cette approche hybride marie la simplicité de Swarm et les capacités avancées de Kubernetes.

En tant que fondateur de Martin Data Solutions et Data Scientist freelance, ingénieur ML et AI, j'apporte un portefeuille diversifié en régression, classification, NLP, LLM, RAG, réseaux neuronaux, méthodes d'ensemble et vision par ordinateur.

- A développé avec succès plusieurs projets de ML de bout en bout, y compris le nettoyage des données, l'analyse, la modélisation et le déploiement sur AWS et GCP, en fournissant des solutions impactantes et évolutives.

- Création d'applications web interactives et évolutives à l'aide de Streamlit et Gradio pour divers cas d'utilisation dans l'industrie.

- Enseigne et encadre des étudiants en science des données et en analyse, en favorisant leur développement professionnel par le biais d'approches d'apprentissage personnalisées.

- Conception du contenu des cours pour les applications de génération augmentée par récupération (RAG) adaptées aux exigences de l'entreprise.

- Rédaction de blogs techniques à fort impact sur l'IA et le ML, couvrant des sujets tels que les MLOps, les bases de données vectorielles et les LLM, avec un engagement significatif.

Dans chaque projet que je prends en charge, je m'assure d'appliquer des pratiques actualisées en matière d'ingénierie logicielle et de DevOps, comme le CI/CD, le linting de code, le formatage, la surveillance des modèles, le suivi des expériences et la gestion robuste des erreurs. Je m'engage à fournir des solutions complètes, en transformant les connaissances sur les données en stratégies pratiques qui aident les entreprises à se développer et à tirer le meilleur parti de la science des données, de l'apprentissage automatique et de l'IA.