programa

Cuando empecé a trabajar con aplicaciones contenerizadas, gestionar a mano unos cuantos contenedores era factible, pero escalar requería otro enfoque. Ahí es donde las plataformas de orquestación de contenedores se vuelven esenciales, y dos nombres destacan siempre: Docker Swarm y Kubernetes.

La orquestación de contenedores automatiza el despliegue, la gestión, el escalado y las redes de contenedores en clústeres de máquinas. Elegir la plataforma adecuada puede impactar significativamente en la productividad del equipo, los costes operativos y tu capacidad de escalar.

En esta guía compararé a fondo Docker Swarm y Kubernetes para ayudarte a elegir la mejor plataforma según tus necesidades, tanto si diriges una startup como si gestionas una infraestructura enterprise.

Si eres nuevo en Docker, te recomiendo empezar por nuestro curso Introduction to Docker. Además, no te pierdas nuestro tutorial sobre cómo ejecutar Claude Code en Docker.

¿Qué es Docker Swarm?

Empecemos por Docker Swarm, la opción más sencilla de las dos.

Docker Swarm es la solución de orquestación nativa de Docker que convierte varios hosts Docker en un único host virtual. A mí me resulta especialmente atractiva por su integración perfecta con el ecosistema Docker que tantos equipos ya utilizan.

Logotipo de Docker Swarm

Integrado directamente en Docker Engine, Swarm amplía las capacidades de Docker para gestionar contenedores distribuidos en múltiples máquinas. Al activar el modo Swarm, creas un clúster que distribuye cargas de trabajo de forma inteligente, mantiene alta disponibilidad y escala servicios sin la complejidad típica de otras plataformas de orquestación.

Si aún dudas sobre qué es Docker y sus funciones, y cómo se compara con Kubernetes, te recomiendo nuestros artículos comparativos Kubernetes vs Docker y Docker Compose vs Kubernetes.

Nota: aunque el modo Swarm sigue funcionando y recibe actualizaciones de seguridad, el desarrollo activo de nuevas funciones se ha ralentizado considerablemente en favor de soluciones basadas en Kubernetes.

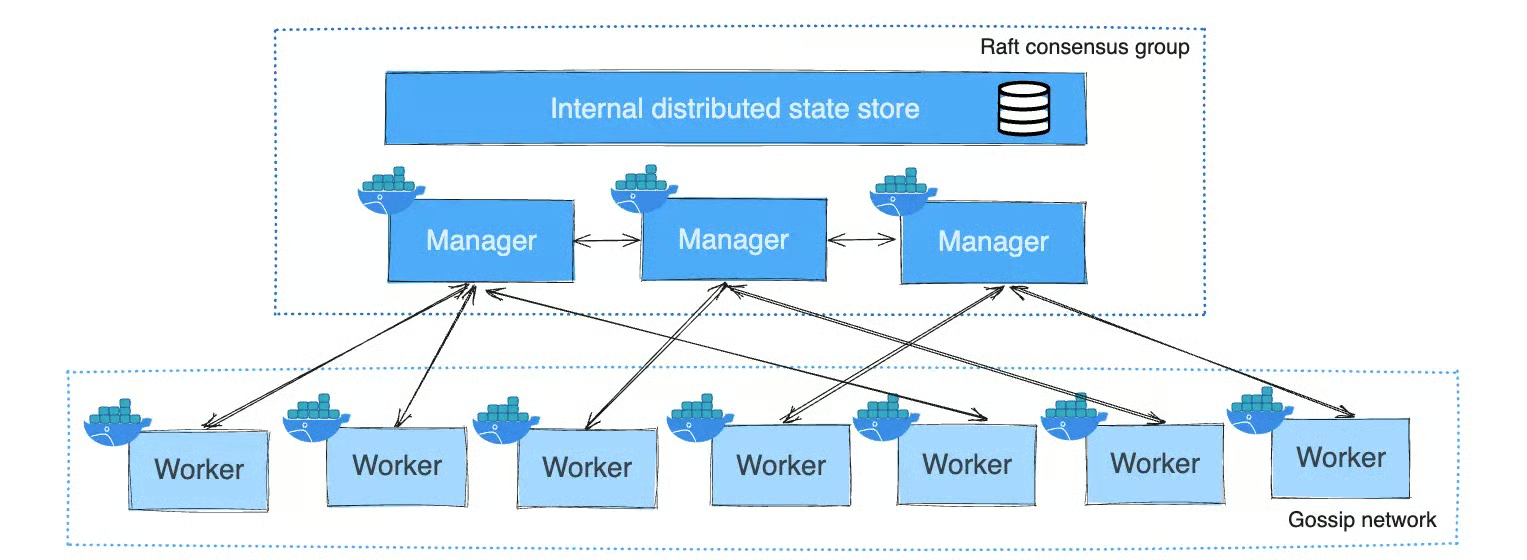

Arquitectura y componentes de Docker Swarm

Docker Swarm sigue un modelo de gestores y trabajadores. Los nodos gestores orquestan y mantienen el estado del clúster, mientras que los nodos trabajadores ejecutan tareas. Los gestores también pueden ejecutar cargas de trabajo o dedicarse solo a la orquestación.

Utiliza el algoritmo de consenso Raft, que designa un único líder entre los nodos gestores para tomar las decisiones de gestión del clúster. Las decisiones requieren acuerdo de la mayoría de gestores. Así, Docker Swarm garantiza que el estado del clúster se mantenga coherente entre gestores y pueda seguir funcionando incluso si fallan gestores individuales.

Los servicios se definen en archivos YAML similares a Docker Compose, especificando el estado de la aplicación, incluidas réplicas, redes y recursos.

Ahora que entendemos la arquitectura, veamos qué puede hacer Docker Swarm por ti.

Funciones clave de Docker Swarm

Docker Swarm incluye varias funciones integradas para facilitar la orquestación de contenedores:

- Service discovery: Se realiza automáticamente mediante DNS integrado, permitiendo que los contenedores se encuentren por nombres de servicio

- Balanceo de carga: Integrado a través de un routing mesh que distribuye peticiones entre réplicas sanas en distintos nodos

- Actualizaciones continuas (rolling updates): Permiten actualizar servicios gradualmente con paralelismo y retrasos configurables, con reversión rápida si surgen problemas

- Alta disponibilidad: Lograda con replicación de servicios y reprogramación automática ante fallos

- Redes overlay: Proporcionan comunicación entre contenedores en distintos hosts, con cifrado opcional del tráfico de datos de la aplicación (no activado por defecto)

Funciones clave de Docker Swarm

Estas funciones trabajan en conjunto para ofrecer una orquestación lista para producción sin configuraciones extensas. La sencillez de estas capacidades integradas es lo que hace que Docker Swarm resulte tan atractivo para equipos que quieren ponerse en marcha rápido.

Ventajas de Docker Swarm

Tras ver las funciones, aquí es donde Docker Swarm realmente brilla. Ofrece varias ventajas claras:

- Puesta en marcha rápida: Inicializar un clúster requiere solo docker swarm init

- Curva de aprendizaje suave: Si ya conoces Docker, tienes medio camino hecho: comandos de CLI familiares y formatos de Docker Compose

- Integración nativa: Elimina la necesidad de nuevas APIs o software adicional

- Perfecto para proyectos pequeños y medianos: Aporta la orquestación esencial sin una complejidad abrumadora

- Menor sobrecarga de recursos: Puedes ejecutar más contenedores de aplicación en el mismo hardware comparado con Kubernetes, lo que lo hace rentable para despliegues pequeños

Estas ventajas hacen que Docker Swarm sea especialmente atractivo para startups, equipos de desarrollo pequeños y organizaciones que valoran la velocidad de implementación por encima de un conjunto de funciones extensas. La barrera de entrada baja te permite orquestar contenedores en producción en cuestión de horas, no de días o semanas.

Desventajas de Docker Swarm

Por supuesto, ninguna plataforma es perfecta. Ten en cuenta estas limitaciones clave:

- Limitaciones de escalabilidad: No alcanza a Kubernetes con miles de nodos o cargas muy complejas

- Ecosistema más pequeño: Menos herramientas de terceros y menos recursos de comunidad

- Extensibilidad limitada: El fuerte acoplamiento con la API de Docker restringe personalizaciones avanzadas

- Faltan funciones avanzadas: No incluye autoscaling sofisticado ni políticas de red complejas, o requieren apaños

- Gestión multi‑clúster débil: Capacidades mínimas, complicado para despliegues distribuidos geográficamente

- Retos con cargas con estado: Las bases de datos que requieren orquestación de almacenamiento avanzada son más difíciles de gestionar

- Desarrollo ralentizado: El desarrollo activo de nuevas funciones prácticamente se ha detenido, con Docker centrado en soluciones basadas en Kubernetes. Esto es distinto del "Classic Swarm", que sí fue totalmente deprecado y eliminado en Docker v23.0

Aunque estas limitaciones son reales, solo te afectarán si tu caso de uso requiere esas capacidades avanzadas. Para muchos proyectos, el conjunto de funciones de Docker Swarm es más que suficiente, y la simplicidad compensa con creces.

La cuestión no es si Swarm tiene limitaciones, sino si esas limitaciones importan para tus necesidades concretas. Si quieres explorar herramientas alternativas, lee nuestro artículo sobre las principales alternativas a Docker en 2026.

¿Qué es Kubernetes?

Tras cubrir Docker Swarm, pasamos a Kubernetes, la alternativa más potente pero también más compleja.

Kubernetes (K8s) es el estándar del sector para la orquestación de contenedores. Desarrollado originalmente por Google y ahora mantenido por la Cloud Native Computing Foundation, se creó para gestionar aplicaciones contenerizadas a gran escala. Para una introducción más detallada, consulta nuestra guía What is Kubernetes?.

Logotipo de Kubernetes

Kubernetes ofrece una plataforma pensada para prácticamente cualquier desafío de contenedores en producción. Más allá de la orquestación básica, incluye soluciones para almacenamiento persistente, gestión de configuración, manejo de secretos y procesamiento de trabajos.

Su adopción generalizada ha dado lugar a un enorme ecosistema de herramientas y servicios.

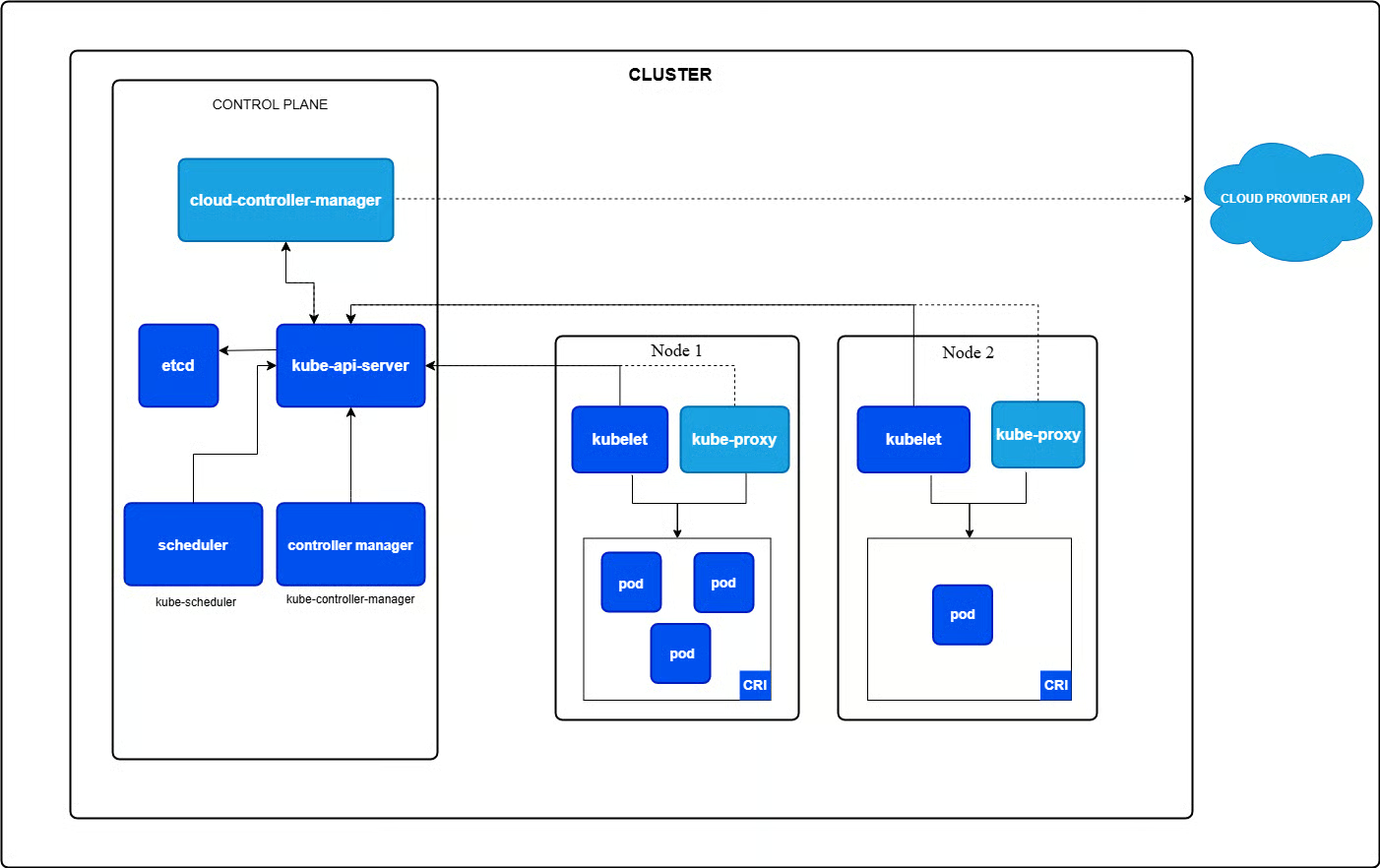

Arquitectura y componentes de Kubernetes

Kubernetes usa una topología maestro‑trabajador, donde el maestro es el plano de control (control plane). Los componentes clave del plano de control incluyen:

- kube-apiserver: El componente central que expone la API HTTP de Kubernetes

- etcd: Almacén distribuido clave‑valor para los datos del API server

- kube-scheduler: Asigna Pods a nodos

- kube-controller-manager: Ejecuta controladores que implementan el comportamiento de la API de Kubernetes

- cloud-controller-manager: Opcional; integra con proveedores cloud subyacentes

Los nodos trabajadores ejecutan kubelet (se comunica con el plano de control), kube-proxy (gestiona el networking) y contienen Pods, la unidad mínima desplegable que agrupa uno o varios contenedores compartiendo recursos.

Componentes de un clúster de Kubernetes

Esta arquitectura distribuida es más compleja que la de Docker Swarm, pero es la que permite la impresionante escalabilidad y resiliencia de Kubernetes. Cada componente tiene un rol específico y bien definido, y trabajan en conjunto para crear un sistema de orquestación muy robusto.

Para profundizar, te recomiendo nuestra guía Kubernetes Architecture.

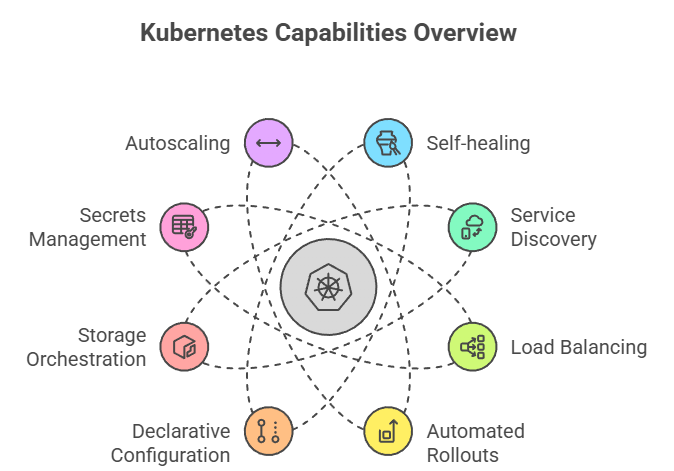

Funciones clave de Kubernetes

Con esta arquitectura, Kubernetes ofrece un conjunto de capacidades muy completo para operaciones de contenedores en producción:

- Autocuración: Reemplaza contenedores fallidos automáticamente, reprograma Pods cuando caen nodos y reinicia contenedores no saludables

- Service discovery y balanceo: Nombres DNS integrados y distribución inteligente del tráfico entre réplicas de Pods

- Despliegues y reversiones automatizados: Deployments seguros con control granular y reversión automática si surgen problemas

- Configuración declarativa: Describe el estado deseado del clúster en archivos YAML y Kubernetes lo mantiene de forma continua

- Orquestación de almacenamiento: La Container Storage Interface admite numerosos backends con aprovisionamiento dinámico

- Gestión de secretos: Maneja de forma segura datos sensibles y configuración

- Autoscaling: El escalado horizontal ajusta réplicas según métricas, mientras el vertical modifica asignaciones de recursos

Resumen de capacidades de Kubernetes

Este conjunto tan completo es lo que hace de Kubernetes la opción de referencia para entornos de producción complejos. Mientras Docker Swarm cubre lo básico, Kubernetes aporta capacidades sofisticadas que se vuelven esenciales a medida que tu infraestructura crece.

Ventajas de Kubernetes

Aquí es donde se entiende por qué Kubernetes se ha convertido en el estándar del sector. Kubernetes destaca en despliegues complejos y a gran escala:

- Escalabilidad excepcional: Los clústeres pueden abarcar miles de nodos manteniendo el rendimiento

- Ecosistema vasto: Integraciones extensas, servicios gestionados de los principales proveedores cloud y multitud de herramientas

- Planificación avanzada: Reglas de afinidad, taints, tolerations y cuotas de recursos para un control preciso de cargas

- Soporte multicloud: APIs coherentes que permiten despliegues multicloud e híbridos reales

- Gestión multi‑clúster: Diversas herramientas (como Karmada, sucesor del deprecado KubeFed) permiten gestionar cargas entre múltiples clústeres para aplicaciones globales

- Extensibilidad: Custom Resources y Operators permiten gestionar prácticamente cualquier tipo de carga

- Comunidad activa: Documentación abundante y expertise disponible con facilidad

Estas ventajas explican por qué Kubernetes se ha convertido en sinónimo de orquestación de contenedores en entornos enterprise. Cuando necesitas funciones de nivel producción, un amplio ecosistema y una plataforma que crezca con tu organización, Kubernetes cumple.

Para ver sus puntos fuertes en acción, echa un vistazo a este Kubernetes Tutorial.

Desventajas de Kubernetes

Ahora bien, todo ese poder tiene un coste:

- Alta complejidad: Montar un clúster listo para producción implica numerosas configuraciones y decisiones

- Curva de aprendizaje pronunciada: Dominar Kubernetes requiere entender muchos componentes y buenas prácticas

- Mayores requisitos de recursos: Los componentes del plano de control consumen recursos significativos, añadiendo sobrecarga operativa

- Posible sobredimensionamiento: Para equipos pequeños o aplicaciones simples, Kubernetes puede añadir complejidad innecesaria

Entender estos trade‑offs es clave al decidir entre plataformas. No son defectos, sino consecuencias inherentes de su diseño potente y flexible. La pregunta es si tu caso de uso justifica asumir esta complejidad.

Docker Swarm vs Kubernetes: comparación de características clave

Tras analizar cada plataforma por separado, veamos cómo se comparan en dimensiones críticas.

|

Característica |

Docker Swarm |

Kubernetes |

|

Configuración |

Sencilla (un comando) |

Compleja |

|

Curva de aprendizaje |

Suave |

Pronunciada |

|

Escalabilidad |

~50‑100 nodos |

Hasta 5.000 nodos |

|

Ecosistema |

Más pequeño |

Enorme |

|

Autoscaling |

No integrado (requiere herramientas externas) |

Automático (HPA); VPA como add‑on |

|

Mejor para |

Proyectos pequeños‑medianos |

Escala enterprise |

Ahora profundicemos en cada área de comparación. Empezaré por lo que suele ser el primer contacto con cualquier plataforma de orquestación: ponerla en marcha.

Instalación, configuración y curva de aprendizaje

Instalar Docker Swarm es directo: con Docker Engine instalado, un solo comando docker swarm init crea un clúster. Añadir nodos requiere únicamente el token de unión. La mayoría de equipos pueden tener un clúster funcionando en menos de una hora.

En cambio, la instalación de Kubernetes varía según el enfoque. Los servicios gestionados (AWS EKS, GKE, AKS) resuelven gran parte de la complejidad. Las instalaciones autogestionadas requieren kubectl, configurar la red, certificados y etcd. Herramientas como kubeadm o k3s simplifican, pero Kubernetes exige más esfuerzo de puesta en marcha que Swarm.

La curva de aprendizaje sigue un patrón parecido. Si ya conoces los comandos de Docker y los archivos Compose, Swarm resulta natural: es Docker a escala. Kubernetes, sin embargo, introduce conceptos totalmente nuevos (Pods, ReplicaSets, Services, Ingress) y un modelo mental más exigente.

Estrategias de despliegue y gestión de aplicaciones

Una vez tienes el clúster en marcha, así difieren los enfoques de despliegue en ambas plataformas.

Docker Swarm apuesta por la simplicidad: las aplicaciones se despliegan como servicios usando archivos YAML compatibles con Docker Compose. Si has usado Compose en desarrollo local, reconocerás el formato al instante. Los stacks permiten desplegar varios servicios juntos, y las actualizaciones continuas funcionan especificando nuevas versiones con parámetros de actualización configurables.

Kubernetes adopta un enfoque más sofisticado. En vez de un único concepto de despliegue, ofrece varios tipos de recursos especializados:

- Deployments para actualizaciones continuas

- StatefulSets para apps con estado que requieren identidades estables

- DaemonSets para Pods específicos por nodo

- Jobs para tareas por lotes

Esta variedad aporta potencia y flexibilidad, pero exige entender qué recurso encaja con cada caso. Estrategias avanzadas como canary y blue‑green están bien soportadas mediante diversas técnicas y herramientas de terceros.

Escalabilidad, alta disponibilidad y rendimiento

Aquí es donde las plataformas empiezan a divergir claramente en capacidades.

Docker Swarm escala bien en clústeres pequeños o medianos (habitualmente por debajo de 50‑100 nodos). El escalado es declarativo: especificas las réplicas deseadas y Swarm ajusta automáticamente. El rendimiento es bueno con menor sobrecarga, lo que lo hace eficiente para cargas pequeñas.

¿El peaje? Estás limitado a decisiones de escalado manual; Swarm no añadirá ni quitará réplicas automáticamente según CPU o memoria.

Kubernetes, por su parte, destaca a escala en varias dimensiones. Primero, puede gestionar miles de nodos y decenas de miles de Pods sin despeinarse. Segundo, y más importante, escala de forma inteligente.

El Horizontal Pod Autoscaler ajusta réplicas automáticamente en base a métricas, el Vertical Pod Autoscaler modifica asignaciones de recursos y el Cluster Autoscaler incluso gestiona el número de nodos en entornos cloud. Este escalado automático hace que Kubernetes sea muy rentable para cargas variables.

Red y balanceo de carga

La red es crítica, y cada plataforma aborda los mismos problemas fundamentales con enfoques distintos.

Docker Swarm incluye balanceo de carga integrado mediante su routing mesh, que distribuye el tráfico automáticamente entre los endpoints del servicio. Las redes overlay permiten comunicación cifrada entre contenedores, y el service discovery funciona con DNS integrado. Es un enfoque "con pilas incluidas": todo lo necesario viene integrado y configurado por defecto.

Kubernetes ofrece más flexibilidad, a costa de más configuración. El networking se basa en la Container Network Interface (CNI), que admite soluciones como Calico, Cilium y Flannel. Tú eliges cuál usar.

Los controladores de Ingress proporcionan enrutado HTTP/HTTPS sofisticado con terminación SSL. Las Network Policies permiten un control de tráfico muy fino entre Pods. Para casos avanzados, los service mesh como Istio se integran sin problema para gestión de tráfico, seguridad y observabilidad. Esta modularidad es potente, pero implica tomar más decisiones al principio.

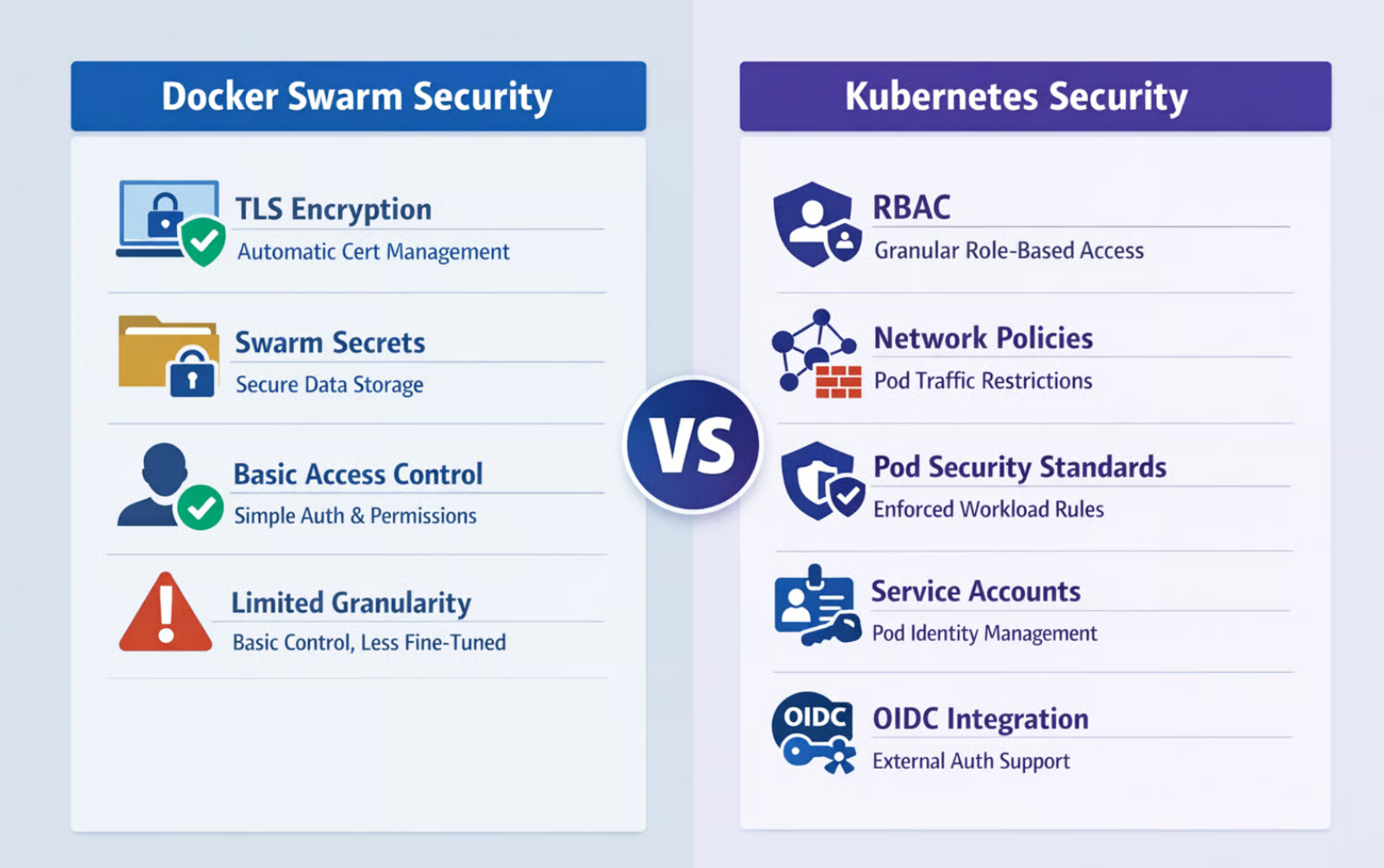

Seguridad y control de acceso

La seguridad es prioritaria, y aquí se nota el ADN enterprise de Kubernetes.

Docker Swarm aporta lo esencial: cifrado TLS con gestión automática de certificados para asegurar la comunicación entre nodos, y Swarm Secrets para almacenar de forma segura datos sensibles como contraseñas y claves de API. El control de acceso se apoya en los mecanismos de autenticación de Docker. Es sencillo y suficiente para muchos casos, pero carece de control granular.

Seguridad: Docker Swarm vs. Kubernetes

Kubernetes ofrece seguridad integral pensada para entornos multi‑tenant. Uno de los mayores activos para despliegues seguros en equipo es el control de acceso basado en roles (RBAC), que proporciona permisos granulares tanto a nivel de namespace como de clúster. Puedes definir con precisión quién puede hacer qué sobre qué recursos.

Las Network Policies restringen el tráfico entre Pods según etiquetas y reglas. Los Pod Security Standards aplican restricciones de seguridad en las especificaciones de las cargas. Las cuentas de servicio aportan identidad a los Pods, con soporte para integrar autenticación externa mediante OIDC y otros protocolos.

Este modelo de seguridad tan completo hace que Kubernetes sea adecuado para sectores regulados y requisitos organizativos complejos.

Almacenamiento y persistencia de datos

En materia de datos persistentes, aquí se aprecia claramente la filosofía de diseño de cada plataforma.

Docker Swarm admite volúmenes locales y con nombre, válidos para casos sencillos. Sin embargo, la gestión de almacenamiento es básica, el aprovisionamiento dinámico es limitado y coordinar almacenamiento entre réplicas para aplicaciones con estado complejas se complica. A menudo necesitarás herramientas externas o configuraciones manuales para algo más allá de montar volúmenes simples.

Kubernetes se diseñó desde el inicio pensando en cargas con estado. Proporciona PersistentVolumes (PV) como recursos de almacenamiento a nivel de clúster y PersistentVolumeClaims (PVC) para que las aplicaciones soliciten almacenamiento sin conocer los detalles subyacentes.

Las StorageClasses permiten aprovisionamiento dinámico: el almacenamiento se crea automáticamente cuando se necesita. La Container Storage Interface admite numerosos proveedores con funciones avanzadas como snapshots, clonado y ampliación. Los StatefulSets coordinan el almacenamiento con las identidades de los Pods, haciendo posible ejecutar bases de datos distribuidas complejas con fiabilidad.

Esta sofisticación convierte a Kubernetes en la opción clara para cargas con estado.

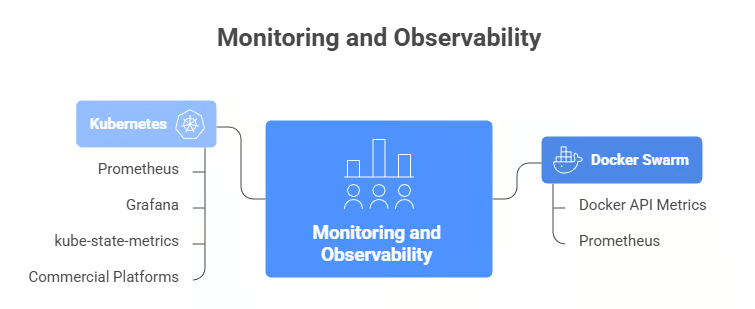

Monitorización, observabilidad y herramientas operativas

La observabilidad te ayuda a entender qué ocurre en el clúster, pero la madurez del ecosistema varía enormemente.

Docker Swarm ofrece métricas básicas a través de la API de Docker, que aportan visibilidad sobre la salud de contenedores y nodos. Para algo más completo, normalmente necesitarás herramientas externas como Prometheus. El ecosistema de observabilidad alrededor de Swarm es más pequeño, con menos integraciones específicas y menor inversión comunitaria en soluciones de monitorización.

Monitorización y observabilidad: Docker Swarm vs. Kubernetes

El ecosistema de monitorización de Kubernetes es, siendo francos, enorme. Prometheus se ha convertido en el estándar de facto para métricas de Kubernetes, normalmente junto a Grafana para visualización. El componente kube-state-metrics expone métricas a nivel de clúster sobre el estado de los objetos. Herramientas de trazabilidad distribuida como Jaeger se integran sin fricciones.

Numerosas plataformas comerciales (Datadog, New Relic, Dynatrace) ofrecen integraciones específicas para Kubernetes con paneles y alertas integrados. La amplitud de herramientas te permite lograr observabilidad de nivel enterprise, aunque también implica elegir y configurar estas soluciones.

Ecosistema, extensibilidad y soporte comunitario

Más allá de las funciones base, el ecosistema que rodea a cada plataforma puede marcar la diferencia, y aquí la brecha es más evidente.

Kubernetes cuenta con un ecosistema enorme. Todas las grandes herramientas de monitorización, plataformas de seguridad, sistemas de CI/CD y proveedores cloud ofrecen soporte de primer nivel para Kubernetes. ¿Necesitas ampliar Kubernetes con funcionalidad propia? Las Custom Resource Definitions (CRD) te permiten añadir tipos de recurso, y los Operators automatizan la gestión de aplicaciones complejas con patrones nativos de Kubernetes.

La comunidad es masiva y activa, con documentación extensa, conferencias periódicas, incontables tutoriales y expertise disponible para contratar.

El ecosistema de Docker Swarm es considerablemente menor. La comunidad central de Docker sigue siendo activa, pero hay menos herramientas de terceros específicas para Swarm. Las opciones de personalización están limitadas por las restricciones de la API de Docker. Trabajas dentro de los márgenes que Swarm ofrece. Este ecosistema más pequeño implica menos soluciones listas para casos límite y menos impulso comunitario para la innovación.

Integraciones en la nube y capacidades multi‑clúster

La integración con la nube es clave si ejecutas en AWS, Azure o GCP, y las plataformas siguen enfoques muy distintos aquí. Para comparar los 3 proveedores cloud más populares, consulta esta guía AWS vs. Azure vs. GCP.

Todos los grandes proveedores ofrecen servicios gestionados de Kubernetes (AWS EKS, Google GKE, Azure AKS), donde se encargan del plano de control, las actualizaciones e integran estrechamente sus servicios nativos.

Las abstracciones de Kubernetes funcionan de forma coherente en distintos entornos cloud, lo que permite arquitecturas multicloud e híbridas reales. ¿Necesitas gestionar aplicaciones en varias regiones o incluso en varias nubes? Karmada, sucesor de Kubernetes Federation (KubeFed), permite gestionar múltiples clústeres como una sola unidad lógica, esencial para despliegues globales.

Docker Swarm funciona bien en la nube, pero carece de integraciones tan profundas. Puedes ejecutar clústeres Swarm en AWS, Azure o GCP, pero tendrás que encargarte tú de más gestión de infraestructura. La gestión multi‑clúster es limitada, ya que cada clúster Swarm opera de forma independiente.

Coordinar despliegues entre regiones o proveedores requiere herramientas a medida y capas adicionales de orquestación.

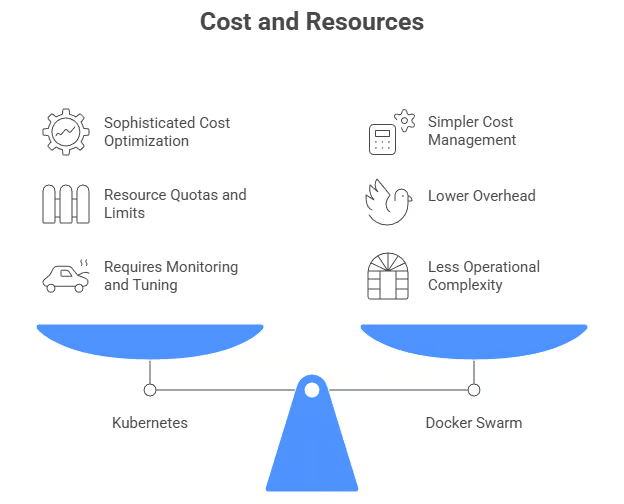

Optimización de costes y eficiencia de recursos

El coste siempre importa, y las plataformas lo abordan de forma distinta, reflejando sus prioridades de diseño.

Kubernetes incorpora optimización de costes sofisticada. Las cuotas y límites de recursos evitan que un equipo o aplicación monopolice el clúster. El Horizontal Pod Autoscaler y el Cluster Autoscaler alinean la asignación de recursos con la demanda real, reduciendo escala en periodos de baja actividad para ahorrar.

La integración con instancias spot de proveedores cloud puede reducir mucho el coste de cómputo. Herramientas como Kubecost dan visibilidad detallada del gasto y recomendaciones de optimización. ¿El contra? Para aprovecharlo, necesitas monitorización, ajuste fino y expertise.

Costes y recursos: Docker Swarm vs. Kubernetes

Docker Swarm adopta un enfoque más simple. Su modelo de recursos es directo y con menos funciones integradas de optimización. Sin embargo, su menor sobrecarga implica que más recursos de tu infraestructura se destinan a ejecutar aplicaciones, no a la orquestación.

La gestión de costes suele apoyarse en herramientas externas de monitorización y ajustes manuales. Para despliegues pequeños, esta simplicidad puede ser incluso más rentable: gastas menos en complejidad operativa aunque la plataforma no tenga funciones avanzadas de optimización.

Después de comparar las plataformas en todas estas dimensiones técnicas, desde la instalación hasta la optimización de costes, quizá te preguntes: "¿Cuál debería usar en realidad?" Como imaginarás, depende por completo de tu situación. Veamos los escenarios reales donde cada plataforma brilla.

Casos de uso de Docker Swarm y Kubernetes

Entender las diferencias técnicas es una cosa, pero saber cuándo usar cada plataforma es lo que realmente importa. Te guío por los escenarios ideales para cada una.

Casos de uso de Docker Swarm

Docker Swarm destaca en estos escenarios:

- Despliegues pequeños a medianos: Proyectos por debajo de 50 nodos con necesidades de orquestación sencillas

- Prototipado rápido: Entornos de desarrollo donde importa montar e iterar rápido

- Recursos DevOps limitados: Equipos que empiezan con orquestación de contenedores o sin ingenieros de plataforma dedicados

- Entornos nativos de Docker: Organizaciones muy invertidas en herramientas y flujos de Docker

- Proyectos donde prima la simplicidad: Aplicaciones en las que la sencillez operativa pesa más que las funciones avanzadas

Si tu proyecto encaja con estas características, Docker Swarm te permite orquestar sin la sobrecarga de aprender y gestionar un sistema más complejo. Serás productivo rápido y siempre podrás migrar a Kubernetes más adelante si tus necesidades crecen.

Casos de uso de Kubernetes

Por el contrario, Kubernetes es la elección adecuada cuando necesitas:

- Despliegues a gran escala: Sistemas complejos con cientos o miles de nodos

- Entornos enterprise: Organizaciones con múltiples equipos y requisitos estrictos de cumplimiento y seguridad

- Arquitecturas multicloud: Despliegues que abarcan varios proveedores cloud o entornos híbridos

- Sistemas de alta disponibilidad: Aplicaciones que exigen failover sofisticado, recuperación ante desastres y distribución geográfica

- Automatización avanzada: Cargas que requieren autoescalado, autocuración y lógica de orquestación compleja

- Equipos de plataforma dedicados: Organizaciones con ingenieros capaces de gestionar y optimizar la infraestructura de Kubernetes

Estos casos de uso justifican la inversión en aprender y operar Kubernetes. Su complejidad se convierte en un activo cuando resuelves retos de orquestación complejos a escala. Si te ves reflejado, el esfuerzo por adoptar Kubernetes se traducirá en mayores capacidades operativas y flexibilidad futura.

Cómo elegir entre Docker Swarm y Kubernetes

Con los casos de uso claros, ¿cómo tomar la decisión? Aquí tienes un marco:

|

Elige Swarm si... |

Elige Kubernetes si... |

|

< 50 nodos |

> 100 nodos |

|

El equipo domina Docker |

El equipo tiene skills en K8s |

|

Es crítico empezar rápido |

Necesitas funciones enterprise |

|

Presupuesto ajustado |

Puedes usar servicios gestionados |

Vamos a examinar cada factor de decisión.

Tamaño y complejidad del proyecto

Valora tu escala actual y la previsión de crecimiento. Para unas pocas docenas de servicios con requisitos sencillos, Swarm basta. Para un crecimiento rápido, microservicios complejos o despliegues enterprise, Kubernetes aporta la base necesaria.

Experiencia del equipo y curva de aprendizaje

Además de los requisitos del proyecto, las capacidades del equipo importan mucho.

Evalúa las habilidades de tu equipo y el tiempo de aprendizaje. Los equipos con experiencia en Docker pero nuevos en orquestación serán más productivos y rápidos con Swarm. Los equipos con experiencia en Kubernetes o con recursos de formación pueden aprovechar sus capacidades avanzadas.

Infraestructura y necesidades de escalado

Tus requisitos de infraestructura también orientarán la elección.

Valora tus necesidades de disponibilidad, patrones de escalado y distribución de la infraestructura. Un escalado simple dentro de un único centro de datos encaja con Swarm. El autoscaling complejo, los despliegues multirregión y la gestión dinámica de recursos favorecen a Kubernetes.

Costes y recursos

Por último, considera tanto los costes iniciales como los continuos.

La menor sobrecarga de Swarm puede reducir costes en despliegues pequeños. El autoscaling de Kubernetes puede ofrecer mejor eficiencia a gran escala, pese a mayores requisitos iniciales.

Alternativas y opciones emergentes

Docker Swarm y Kubernetes no son tus únicas opciones. Existen varias alternativas para casos de uso concretos.

K3s y orquestadores ligeros

K3s, una distribución ligera de Kubernetes, ofrece toda la funcionalidad en un único binario de menos de 100 MB. Es ideal para edge computing, IoT y entornos con pocos recursos, manteniendo la compatibilidad.

MicroK8s de Canonical y k0s de Mirantis ofrecen experiencias ligeras similares.

Otras herramientas de orquestación de contenedores

Más allá de las distribuciones ligeras de Kubernetes, hay otras plataformas diferentes que merece la pena considerar:

- HashiCorp Nomad: Orquestación más simple que admite cargas contenerizadas y no contenerizadas

- Red Hat OpenShift: Basada en Kubernetes con herramientas para desarrolladores y funciones enterprise añadidas

- Apache Mesos con Marathon: Orquestación madura para cargas diversas

- AWS ECS: Integración nativa con AWS sin la complejidad de Kubernetes

Según tus requisitos y la infraestructura existente, estas alternativas pueden encajar mejor que Docker Swarm o Kubernetes.

Conclusión

Docker Swarm y Kubernetes cubren necesidades diferentes. Swarm destaca por su sencillez y despliegue rápido, ideal para proyectos pequeños y con recursos DevOps limitados. Kubernetes brilla en despliegues complejos que requieren funciones avanzadas: su curva de aprendizaje se compensa con capacidades inigualables a escala.

Elige según tus necesidades, la experiencia de tu equipo y los requisitos. Muchos equipos usan ambas: Swarm para servicios sencillos y Kubernetes para aplicaciones complejas.

Tu elección no es definitiva. Muchos empiezan con Swarm y migran a Kubernetes cuando las necesidades crecen. Elige lo que mejor encaje ahora, sin perder de vista el futuro.

Para profundizar en el uso de ambas herramientas, te recomiendo apuntarte a nuestro itinerario de habilidades Containerization and Virtualization with Docker and Kubernetes.

Docker Swarm vs Kubernetes: preguntas frecuentes

¿Es más fácil aprender Docker Swarm que Kubernetes?

Sí, Docker Swarm es significativamente más fácil de aprender. Si ya conoces los comandos de Docker y Docker Compose, podrás ser productivo con Swarm en cuestión de horas. Kubernetes tiene una curva más pronunciada: requiere entender Pods, Services, Deployments y otros conceptos nuevos. Sin embargo, esta complejidad permite funciones más potentes para despliegues a gran escala.

¿Puede Docker Swarm gestionar cargas en producción?

Sí, Docker Swarm puede gestionar cargas en producción de forma eficaz para despliegues pequeños y medianos (normalmente por debajo de 50‑100 nodos). Ofrece funciones esenciales como alta disponibilidad, balanceo de carga y actualizaciones continuas. Sin embargo, para despliegues a escala enterprise con miles de nodos, autoscaling avanzado o arquitecturas multicloud complejas, Kubernetes es la mejor opción.

¿Debería migrar de Docker Swarm a Kubernetes?

La migración depende de tus necesidades. Valora migrar si estás alcanzando los límites de escalabilidad de Swarm (más de 100 nodos), necesitas funciones avanzadas como autoscaling horizontal, requieres soporte multicloud sofisticado o quieres acceder al vasto ecosistema de Kubernetes. Si Swarm cubre tus necesidades, no hay motivo urgente para migrar. Muchas organizaciones ejecutan Swarm en producción con éxito.

¿Qué plataforma es más rentable?

Para despliegues pequeños, Docker Swarm suele ser más rentable por su menor sobrecarga de recursos y menor complejidad operativa. Kubernetes puede ser más eficiente en costes a gran escala gracias a su autoscaling y a la optimización de recursos. Considera tanto los costes de infraestructura (cómputo) como los operativos (tiempo de gestión y expertise requerido).

¿Puedo usar Docker Swarm y Kubernetes a la vez?

Sí, muchas organizaciones usan ambas plataformas con fines distintos. Un patrón habitual es usar Docker Swarm para servicios internos sencillos y entornos de desarrollo, mientras que las aplicaciones de cara al cliente o más complejas se despliegan en Kubernetes. Este enfoque híbrido combina la simplicidad de Swarm con las capacidades avanzadas de Kubernetes.

Como fundador de Martin Data Solutions y científico de datos autónomo, ingeniero de ML e IA, aporto una cartera diversa en Regresión, Clasificación, PNL, LLM, RAG, Redes Neuronales, Métodos de Ensemble y Visión por Ordenador.

- Desarrolló con éxito varios proyectos de ML de extremo a extremo, incluyendo la limpieza de datos, análisis, modelado y despliegue en AWS y GCP, ofreciendo soluciones impactantes y escalables.

- Construí aplicaciones web interactivas y escalables utilizando Streamlit y Gradio para diversos casos de uso de la industria.

- Enseñó y tuteló a estudiantes en ciencia de datos y analítica, fomentando su crecimiento profesional mediante enfoques de aprendizaje personalizados.

- Diseñó el contenido del curso para aplicaciones de generación aumentada por recuperación (RAG) adaptadas a los requisitos de la empresa.

- Es autora de blogs técnicos de IA y ML de gran impacto, que tratan temas como MLOps, bases de datos vectoriales y LLMs, logrando un compromiso significativo.

En cada proyecto que asumo, me aseguro de aplicar prácticas actualizadas en ingeniería de software y DevOps, como CI/CD, code linting, formateo, monitorización de modelos, seguimiento de experimentos y una sólida gestión de errores. Me comprometo a ofrecer soluciones completas, convirtiendo los datos en estrategias prácticas que ayuden a las empresas a crecer y a sacar el máximo partido de la ciencia de datos, el aprendizaje automático y la IA.