Cursus

Toen ik voor het eerst met datamodellering in aanraking kwam, leek het gewoon weer een technische stap bij het werken met databases. Maar naarmate ik me er meer in verdiepte, besefte ik hoe essentieel het is om data goed te structureren, makkelijk toegankelijk te maken en klaar te zetten voor analyse. Zonder een solide datamodel kunnen zelfs de krachtigste databases lastig te beheren worden, met inefficiënties en inconsistenties tot gevolg.

Of je nu een database ontwerpt vanaf nul of een bestaand systeem verfijnt, inzicht in datamodellering is de sleutel om data voor je te laten werken.

In deze post bekijken we fundamentele technieken voor datamodellering, best practices en voorbeelden uit de praktijk om je te helpen effectieve modellen te bouwen!

Wat is datamodellering?

Datamodellering is een gedetailleerd proces waarbij je een visuele weergave maakt van data en de onderlinge relaties. Het fungeert als een blauwdruk voor hoe data is gestructureerd, opgeslagen en benaderd om consistentie en helderheid te waarborgen in databeheer.

Door data-elementen en hun relaties te definiëren, kunnen teams informatie zo organiseren dat opslag, opvraging en analyse efficiënt verlopen—wat zowel prestaties als besluitvorming verbetert.

Soorten datamodellen

Er zijn drie hoofdtypen datamodellen. Laten we ze in deze sectie verkennen.

Conceptueel datamodel

Een conceptueel model biedt een weergave op hoog niveau van de data. Dit model definieert belangrijke bedrijfsentiteiten (bijv. klanten, producten en bestellingen) en hun relaties, zonder in technische details te treden.

Logisch datamodel

Het logische model definieert hoe de data wordt gestructureerd. Dit model richt zich op de organisatie van data zonder vast te zitten aan een specifieke database of technologie. Het bevat gedetailleerde informatie over attributen, relaties en beperkingen, en vormt zo een brug tussen zakelijke vereisten en de fysieke implementatie van de data.

Fysiek datamodel

Een fysiek datamodel geeft weer hoe data daadwerkelijk in een database wordt opgeslagen. Dit model definieert de specifieke tabelstructuren, indexen en opslagmechanismen die nodig zijn om prestaties te optimaliseren en dataintegriteit te waarborgen. Het vertaalt het logisch ontwerp naar een formaat dat geschikt is voor databasesystemen.

Technieken voor datamodellering

Datamodellering is geen one-size-fits-all-proces. Afhankelijk van de complexiteit van de data en de doelen worden verschillende technieken ingezet. In deze sectie bekijken we enkele van de meest populaire benaderingen van datamodellering.

Entity-relationship (ER) modellering

ER-modellering is een van de meest gebruikte technieken om data te representeren. Het draait om het definiëren van drie kernelementen:

- Entiteiten (objecten of dingen binnen het systeem).

- Relaties (hoe deze entiteiten met elkaar omgaan).

- Attributen (eigenschappen van de entiteiten).

Het ER-model biedt een duidelijke, visuele weergave van hoe data is gestructureerd, zodat je de verbindingen tussen verschillende datapunten kunt in kaart brengen.

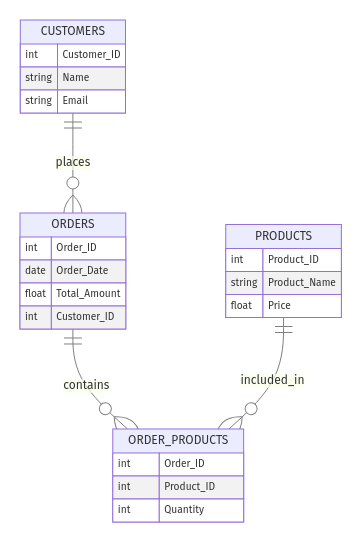

Voorbeeld: e-commercestore

Neem een online winkel. Je zou de volgende entiteiten kunnen hebben:

- Klanten (met attributen zoals

Customer_ID,NameenEmail) - Bestellingen (met

Order_ID,Order_Date,Total_Amount) - Producten (met

Product_ID,Product_Name,Price)

De relaties kunnen zijn:

- "Klanten plaatsen Bestellingen" (één-op-veel)

- "Bestellingen bevatten Producten" (veel-op-veel)

Zo ziet het ER eruit:

Voorbeeld van ER-model voor e-commercestore. Afbeelding door auteur

Dimensionale modellering

Dimensionale modellering wordt veel gebruikt in datawarehousing en analytics, waar data vaak wordt weergegeven in termen van feiten en dimensies. Deze techniek vereenvoudigt complexe data door deze te organiseren in een ster- of sneeuwvlokschema, wat helpt bij efficiënt bevragen en rapporteren.

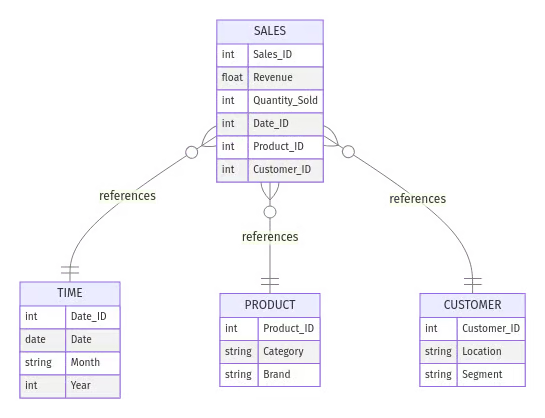

Voorbeeld: verkooprapportage

Stel dat je verkoopdata moet analyseren. Je zou die als volgt structureren:

- Feitentabel:

Sales(slaat transactionele data op, bijv.Sales_ID,Revenue,Quantity_Sold)- Dimensionstabellen:

Time(bijv.Date,Month,Year)Product(bijv. Product_ID, Category, Brand)Customer(bijv.Customer_ID,Location,Segment)

In een sterschema is de Sales-feitentabel direct gekoppeld aan de dimensionstabellen, waardoor analisten efficiënt rapporten kunnen genereren, zoals totale omzet per maand of best verkopende producten per categorie. Zo ziet het schema eruit:

Voorbeeld van sterschema voor verkooprapportage. Afbeelding door auteur

💡 Wil je dieper duiken in dimensionale datamodellering? Bekijk onze gids Sterrenschema vs. Sneeuwvlokschema om te begrijpen wanneer je elk schema gebruikt voor optimale prestaties.

Objectgeoriënteerde modellering

Objectgeoriënteerde modellering wordt gebruikt om complexe systemen te representeren, waarbij data en de functies die erop werken als objecten worden ingekapseld. Deze techniek is nuttig voor het modelleren van toepassingen met complexe, onderling verbonden data en gedragingen—vooral in software-engineering en programmeren.

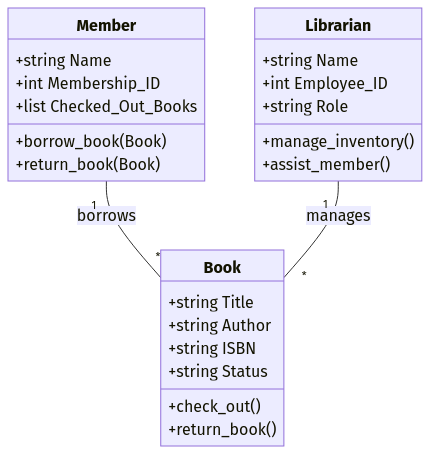

Voorbeeld: bibliotheekbeheersysteem

Stel dat je een bibliotheekbeheersysteem ontwerpt. Je zou objecten kunnen definiëren zoals:

- Book (

Title,Author,ISBN,Status) - Member (

Name,Membership_ID,Checked_Out_Books) - Librarian (

Name,Employee_ID,Role)

Elk object bevat zowel attributen (datavelden) als methoden (functies). Zo kan een Book-object een methode .check_out() hebben die de status van het boek bijwerkt wanneer het wordt geleend.

Deze aanpak is vooral nuttig in objectgeoriënteerde programmeertalen zoals Java en Python, waar datamodellen direct kunnen worden gekoppeld aan klassen en objecten.

Voorbeeld van het objectgeoriënteerde datamodel. Afbeelding door auteur

💡 Wil je leren hoe je objectgeoriënteerd programmeren in Python toepast? Bekijk DataCamp’s Object-Oriented Programming in Python-cursus om OOP-concepten onder de knie te krijgen en toe te passen in projecten uit de echte wereld.

NoSQL- en documentgebaseerde modellering

NoSQL en documentgebaseerde modelleringstechnieken zijn ontworpen voor flexibele databases zonder schema.

Deze techniek wordt vaak gebruikt wanneer datastructuren minder star zijn of in de loop van de tijd evolueren. Deze modellen maken het mogelijk ongestructureerde of semi-gestructureerde data op te slaan en te beheren, zoals JSON-documenten, zonder vooraf gedefinieerde schema’s.

In NoSQL-databases zoals MongoDB organiseert een documentgebaseerd model data in verzamelingen van documenten, waarbij elk document een unieke structuur kan hebben. Deze flexibiliteit maakt sneller itereren en schalen mogelijk, vooral in bigdata-omgevingen of toepassingen die hoge datasnelheid vereisen.

Voorbeeld: gebruikersprofielen opslaan in MongoDB

In een relationele database worden gebruikersprofielen mogelijk over meerdere tabellen verspreid opgeslagen. Maar in een NoSQL-documentmodel zoals MongoDB kan de data van een gebruiker in één JSON-achtig document worden opgeslagen:

{

"user_id": 123,

"name": "Alice Smith",

"email": "alice@example.com",

"address": {

"street": "123 Main St",

"city": "New York",

"zip": "10001"

},

"purchases": [

{ "product_id": 101, "price": 19.99 },

{ "product_id": 202, "price": 49.99 }

]

}Datamodellen koppelen aan modelleringstechnieken

Elke techniek voor datamodellering sluit aan op verschillende fasen van databaseontwerp, van plannen op hoofdlijnen tot fysieke implementatie. Zo sluiten ze aan op de typen die we eerder in het artikel zagen:

- Conceptueel datamodel → Entity-relationship (ER) modellering

- Definieert bedrijfsentiteiten en relaties op hoofdlijnen, zonder technische details.

- Voorbeeld: een ER-diagram dat laat zien hoe Klanten, Bestellingen en Producten zich tot elkaar verhouden.

- Logisch datamodel → ER-, dimensionale en objectgeoriënteerde modellering

- Specificeert datastructuur, attributen en beperkingen zonder te focussen op opslag.

- Voorbeeld: een sterschema met een Sales-feitentabel en dimensionstabellen zoals Time, Product en Customer.

- Fysiek datamodel → Dimensionale, objectgeoriënteerde en NoSQL-modellering

- Geeft weer hoe data fysiek wordt opgeslagen en geoptimaliseerd in een database.

- Voorbeeld: een MongoDB-document dat gebruikersprofielen opslaat als flexibele JSON-objecten of een geoptimaliseerd relationeel schema in PostgreSQL.

Best practices voor datamodellering

Een effectief datamodel bouwen draait niet alleen om de juiste aanpak kiezen—het gaat ook om het volgen van best practices die je model schaalbaar, efficiënt en afgestemd op de bedrijfsbehoeften houden. Een goed ontworpen model helpt veelvoorkomende problemen te voorkomen, zoals redundantie, prestatieknelpunten en moeite om je aan toekomstige veranderingen aan te passen.

Hieronder behandelen we belangrijke best practices om datamodellen te maken die langdurige bruikbaarheid en prestaties ondersteunen.

Normaliseer vroeg, denormaliseer waar nodig

Normalisatie is een fundamenteel concept in datamodellering. Het organiseert data zo dat redundantie wordt geminimaliseerd en consistentie wordt gewaarborgd door deze op te splitsen in kleinere, logisch gerelateerde tabellen. Dit verkleint de kans op anomalieën en discrepanties, en maakt de data makkelijker te beheren en bij te werken.

Voorbeeld: een klantendatabase normaliseren

In plaats van klant- en bestelgegevens in één grote tabel op te slaan:

|

Order_ID |

Customer_Name |

Customer_Email |

Product |

Price |

|

101 |

Alice Smith |

alice@email.com |

Laptop |

1200 |

|

102 |

Alice Smith |

alice@email.com |

Mouse |

25 |

Normaliseer je door klanten en bestellingen op te splitsen in twee gerelateerde tabellen:

- Customers(

Customer_ID,Name,Email) - Orders(

Order_ID,Customer_ID,Product,Price)

Dit voorkomt dubbele klantgegevens en maakt updates eenvoudiger.

Voor rapportage en analytics kan denormalisatie echter nodig zijn om queryprestaties te optimaliseren. In plaats van meerdere joins over tabellen uit te voeren, kan een vooraf geaggregeerde, gedennormaliseerde tabel queries versnellen.

Weten wanneer je elke techniek toepast is belangrijk!

💡Bekijk onze diepgaande tutorial over Normalisatie in SQL om te begrijpen hoe normalisatie de dataintegriteit verbetert en prestaties optimaliseert.

Je datamodel toekomstbestendig maken

Naarmate bedrijven evolueren, veranderen ook hun databehoeften. Een toekomstbestendig datamodel ontwerpen betekent een model creëren dat flexibel en schaalbaar is, klaar om nieuwe databronnen en veranderende eisen aan te kunnen.

Door rekening te houden met potentiële groei en toekomstige technologische vooruitgang kun je kostbare herontwerpen voorzien en vermijden. Door vanaf het begin te bouwen op schaalbaarheid, modulariteit en onderhoudbaarheid kan het model zich aanpassen aan veranderende omgevingen en blijvend waarde leveren.

Voorbeeld: plannen voor schaalbaarheid in een e-commercedatabase

Stel, je ontwerpt een database voor een online winkel. In eerste instantie volg je alleen binnenlandse bestellingen, maar later breid je wereldwijd uit. Als je schema slechts één valuta ondersteunt, zijn later grote aanpassingen nodig.

- Neem in plaats van een simpele

Price-kolom de veldenCurrency_CodeenExchange_Rateop. - Gebruik een flexibel schema dat nieuwe attributen toelaat zonder de database te herstructureren.

Andere manieren om je model toekomstbestendig te maken:

- Gebruik UUID’s in plaats van auto-increment-id’s voor schaalbaarheid in gedistribueerde systemen.

- Overweeg schema-evolutie in NoSQL-databases, waar documenten optionele velden kunnen hebben die in de tijd veranderen.

Zorg voor datakwaliteit en consistentie

Een datamodel is slechts zo goed als de data die het bevat. Het implementeren van sterke datagovernance en validatietechnieken is cruciaal om datakwaliteit en consistentie in het hele model te behouden.

Datavalidatie zorgt ervoor dat het juiste type data wordt ingevoerd en aan specifieke regels voldoet, om fouten te verminderen en de betrouwbaarheid van zakelijke inzichten te vergroten. Dit bewaart de integriteit van het datamodel en zorgt dat besluitvormers kunnen vertrouwen op de informatie voor nauwkeurige inzichten.

Voorbeeld: datavalidatie voor productvermeldingen

Inconsistente productomschrijvingen in een online winkel kunnen tot fouten in rapportages leiden. Voorkom dit door:

CHECK-constraints te gebruiken om toegestane waarden af te dwingen (bijv.Stock_Quantity >= 0).- Vreemde sleutels te implementeren om referentiële integriteit te garanderen.

- Datavalidatie te automatiseren met tools om inconsistenties te detecteren voordat ze de rapportage beïnvloeden.

💡Bekijk mijn Great Expectations-tutorial om te leren hoe je datavalidatie automatiseert met Python en consistentie waarborgt in je datapijplijnen.

Richt je op bedrijfsvereisten

Een goed ontworpen datamodel moet direct bijdragen aan bedrijfsdoelen. Werk vóór het opzetten van het schema nauw samen met stakeholders om te definiëren:

- Welke inzichten hebben ze nodig?

- Hoe wordt de data benaderd en bijgewerkt?

- Welke performance trade-offs zijn acceptabel?

Voorbeeld: een retaildashboard optimaliseren voor snellere inzichten

Een retailbedrijf wil verkooptrends in realtime volgen. In plaats van een volledig genormaliseerd schema met meerdere joins te gebruiken, kun je een gedennormaliseerde rapportagetabel ontwerpen die dagelijkse verkoopcijfers vooraf aggregeert, waardoor dashboardqueries aanzienlijk sneller worden.

Op het bedrijf afgestemd datamodel:

- Realtime data wordt opgeslagen in een OLTP-systeem (Online Transaction Processing) voor snelle transacties.

- Geaggregeerde verkooprapporten worden opgeslagen in een OLAP-database (Online Analytical Processing) voor analyse.

💡Verken onze gids OLTP vs. OLAP om te begrijpen wanneer je optimaliseert voor transacties versus rapportage.

Door het datamodel af te stemmen op de bedrijfsbehoeften voorkom je onnodige complexiteit en zorg je dat stakeholders de inzichten krijgen die ze nodig hebben, zonder performanceproblemen.

Conclusie

Het begrijpen en toepassen van de juiste technieken voor datamodellering is essentieel als je data effectief wilt structureren, beheren en optimaliseren. Zoals we hebben gezien, hangt de keuze voor een modelleringaanpak af van bedrijfsdoelen, datacomplexiteit en systeemvereisten.

Wil je je begrip van datamodellering, datawarehousing en databaseontwerp verdiepen? Dan raad ik deze bronnen aan:

- The Data Warehouse Toolkit – Een fundamentele gids voor dimensionale modellering door Ralph Kimball, met best practices voor het ontwerpen van datawarehouses.

- Introduction to Data Modeling in Snowflake – Leer schaalbare datamodellen ontwerpen in Snowflake.

- Data Warehousing Concepts – Begrijp de kernprincipes van datawarehousing, waaronder dimensionale modellering en ETL-processen.

- Database Design – Beheers technieken voor het structureren van databases om efficiëntie, consistentie en schaalbaarheid te waarborgen.