Corso

Quando ho incontrato per la prima volta il data modeling, mi è sembrato solo un altro passaggio tecnico nel lavoro con i database. Ma approfondendo, ho capito quanto sia essenziale per garantire che i dati siano ben strutturati, facilmente accessibili e pronti per l’analisi. Senza un modello dati solido, anche i database più potenti possono diventare difficili da gestire, causando inefficienze e incoerenze.

Che tu stia progettando un database da zero o perfezionando un sistema esistente, capire il data modeling è la chiave per far lavorare i dati a tuo favore.

In questo post, esploreremo le tecniche fondamentali di data modeling, le best practice e esempi reali per aiutarti a costruire modelli efficaci!

Che cos’è il Data Modeling?

Il data modeling è un processo dettagliato che prevede la creazione di una rappresentazione visiva dei dati e delle loro relazioni. Funziona come un blueprint di come i dati sono strutturati, archiviati e accessibili per garantire coerenza e chiarezza nella data management.

Definire gli elementi dei dati e le loro relazioni aiuta i team a organizzare le informazioni per supportare archiviazione, recupero e analisi efficienti, migliorando sia le prestazioni sia il processo decisionale.

Tipi di modelli dati

Esistono tre principali tipi di modelli dati. Esploriamoli in questa sezione.

Modello dati concettuale

Un modello concettuale offre una vista di alto livello dei dati. Definisce le principali entità di business (ad esempio clienti, prodotti e ordini) e le loro relazioni senza entrare nei dettagli tecnici.

Modello dati logico

Il modello logico definisce come saranno strutturati i dati. Si concentra sull’organizzazione dei dati senza essere legato a uno specifico database o tecnologia. Include informazioni dettagliate su attributi, relazioni e vincoli dei dati, fungendo così da ponte tra i requisiti di business e l’implementazione fisica dei dati.

Modello dati fisico

Un modello dati fisico rappresenta come i dati sono effettivamente archiviati in un database. Definisce le specifiche strutture delle tabelle, gli indici e i meccanismi di storage necessari per ottimizzare le prestazioni e garantire l’integrità dei dati. Traduce il design logico in un formato adatto ai sistemi di database.

Tecniche di Data Modeling

Il data modeling non è un processo unico per tutti. Si utilizzano tecniche diverse a seconda della complessità dei dati e degli obiettivi. In questa sezione, esploreremo alcuni degli approcci più diffusi.

Modeling entity-relationship (ER)

L’ER modeling è una delle tecniche più comuni per rappresentare i dati. Si concentra sulla definizione di tre elementi chiave:

- Entità (oggetti o elementi all’interno del sistema).

- Relazioni (come queste entità interagiscono tra loro).

- Attributi (proprietà delle entità).

Il modello ER offre una rappresentazione visiva chiara di come sono strutturati i dati per aiutare a mappare le connessioni tra i diversi punti dati.

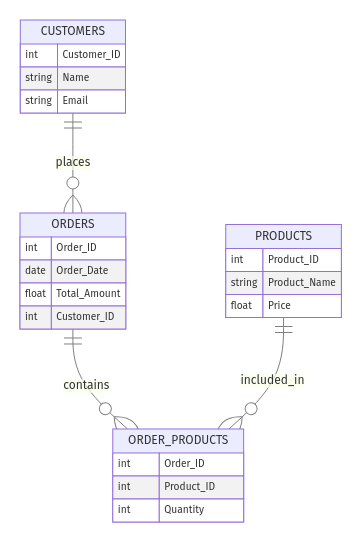

Esempio: e-commerce

Considera un negozio online. Potresti avere le seguenti entità:

- Clienti (con attributi come

Customer_ID,NameedEmail) - Ordini (con

Order_ID,Order_Date,Total_Amount) - Prodotti (con

Product_ID,Product_Name,Price)

Le relazioni potrebbero essere:

- "I clienti effettuano ordini" (uno-a-molti)

- "Gli ordini contengono prodotti" (molti-a-molti)

Ecco come appare l’ER:

Esempio di modello ER per un e-commerce. Immagine dell’autore

Modeling dimensionale

Il modeling dimensionale è ampiamente utilizzato nel data warehousing e nell’analisi, dove i dati sono spesso rappresentati in termini di fatti e dimensioni. Questa tecnica semplifica i dati complessi organizzandoli in uno schema a stella o a fiocco di neve, favorendo interrogazioni e report efficienti.

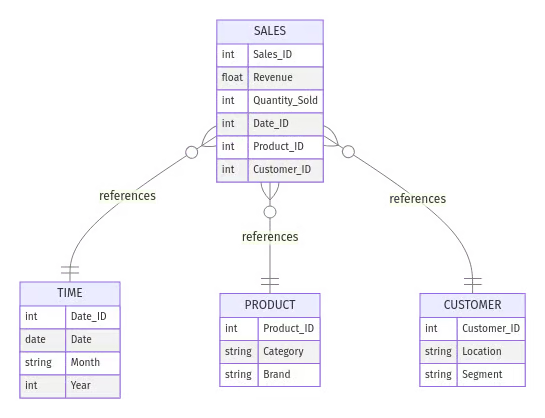

Esempio: reportistica sulle vendite

Immagina di dover analizzare i dati di vendita. Li struttureresti così:

- Tabella dei fatti:

Sales(memorizza i dati transazionali, ad es.Sales_ID,Revenue,Quantity_Sold)- Tabelle delle dimensioni:

Time(ad es.,Date,Month,Year)Product(ad es., Product_ID, Category, Brand)Customer(ad es.,Customer_ID,Location,Segment)

In uno schema a stella, la tabella dei fatti Sales si collega direttamente alle tabelle dimensionali, consentendo agli analisti di generare con efficienza report come il fatturato totale per mese o i prodotti più venduti per categoria. Ecco come appare lo schema:

Esempio di schema a stella per la reportistica sulle vendite. Immagine dell’autore

💡 Vuoi approfondire il modeling dimensionale? Dai un’occhiata alla nostra guida Star Schema vs. Snowflake Schema per capire quando usare l’uno o l’altro per prestazioni ottimali.

Modeling orientato agli oggetti

Il modeling orientato agli oggetti è usato per rappresentare sistemi complessi, in cui dati e funzioni che vi operano sono incapsulati come oggetti. Questa tecnica è utile per modellare applicazioni con dati e comportamenti complessi e interrelati, soprattutto nell’ingegneria del software e nella programmazione.

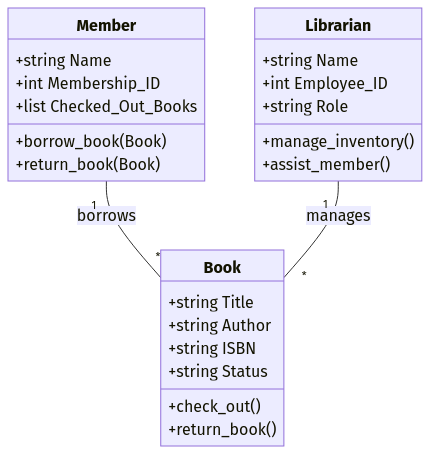

Esempio: sistema di gestione di una biblioteca

Supponiamo che tu stia progettando un sistema di gestione di una biblioteca. Potresti definire oggetti come:

- Book (

Title,Author,ISBN,Status) - Member (

Name,Membership_ID,Checked_Out_Books) - Librarian (

Name,Employee_ID,Role)

Ogni oggetto include sia attributi (campi dati) sia metodi (funzioni). Ad esempio, un oggetto Book potrebbe avere un metodo .check_out() che aggiorna lo stato del libro quando è preso in prestito.

Questo approccio è particolarmente utile nei linguaggi di programmazione OOP come Java e Python, dove i modelli dati possono essere mappati direttamente a classi e oggetti.

Esempio di modello dati orientato agli oggetti. Immagine dell’autore

💡 Vuoi imparare a implementare la programmazione orientata agli oggetti in Python? Dai un’occhiata al corso di DataCamp Object-Oriented Programming in Python per padroneggiare e applicare i concetti OOP in progetti reali.

Modeling NoSQL e basato su documenti

NoSQL e le tecniche di modeling basate su documenti sono progettate per database flessibili e senza schema.

Questa tecnica è spesso usata quando le strutture dei dati sono meno rigide o evolvono nel tempo. Questi modelli consentono di archiviare e gestire dati non strutturati o semi-strutturati, come documenti JSON, senza schemi predefiniti.

Nei database NoSQL come MongoDB, un modello basato su documenti organizza i dati in raccolte di documenti, dove ogni documento può avere una struttura unica. Questa flessibilità consente iterazioni e scalabilità più rapide, in particolare in ambienti big data o in applicazioni che richiedono accesso ai dati ad alta velocità.

Esempio: archiviare profili utente in MongoDB

In un database relazionale, i profili utente potrebbero essere distribuiti su più tabelle. Ma in un modello basato su documenti NoSQL come MongoDB, i dati di un utente possono essere archiviati in un singolo documento simile a JSON:

{

"user_id": 123,

"name": "Alice Smith",

"email": "alice@example.com",

"address": {

"street": "123 Main St",

"city": "New York",

"zip": "10001"

},

"purchases": [

{ "product_id": 101, "price": 19.99 },

{ "product_id": 202, "price": 49.99 }

]

}Abbinare i modelli dati alle tecniche di data modeling

Ogni tecnica di data modeling si allinea a diverse fasi della progettazione del database, dalla pianificazione di alto livello all’implementazione fisica. Ecco come si collegano ai tipi visti in precedenza nell’articolo:

- Modello dati concettuale → Entity-relationship (ER) modeling

- Definisce entità di business e relazioni di alto livello senza dettagli tecnici.

- Esempio: un diagramma ER che mostra come Clienti, Ordini e Prodotti si relazionano.

- Modello dati logico → ER, dimensionale e orientato agli oggetti

- Specifica struttura dei dati, attributi e vincoli senza focalizzarsi sull’archiviazione.

- Esempio: uno schema a stella che delinea una tabella dei fatti Sales con tabelle dimensionali come Time, Product e Customer.

- Modello dati fisico → dimensionale, orientato agli oggetti e NoSQL

- Rappresenta come i dati sono fisicamente archiviati e ottimizzati in un database.

- Esempio: un documento MongoDB che archivia profili utente come oggetti JSON flessibili o uno schema relazionale ottimizzato in PostgreSQL.

Best practice per il Data Modeling

Creare un modello dati efficace non significa solo scegliere l’approccio giusto, ma seguire best practice che mantengano il modello scalabile, efficiente e allineato alle esigenze di business. Un modello ben progettato aiuta a prevenire problemi comuni come ridondanza, colli di bottiglia prestazionali e difficoltà nell’adattarsi a cambiamenti futuri.

Di seguito vedremo le principali best practice per creare modelli dati che supportino usabilità e prestazioni nel lungo termine.

Normalizza all’inizio, denormalizza quando necessario

La normalizzazione è un concetto fondamentale nel data modeling. Organizza i dati per minimizzare la ridondanza e garantire la coerenza, strutturandoli in tabelle più piccole e logicamente correlate. Questo processo riduce le probabilità di anomalie e discrepanze, rendendo i dati più facili da gestire e aggiornare.

Esempio: normalizzare un database clienti

Invece di archiviare dettagli di clienti e ordini in un’unica grande tabella:

|

Order_ID |

Customer_Name |

Customer_Email |

Product |

Price |

|

101 |

Alice Smith |

alice@email.com |

Laptop |

1200 |

|

102 |

Alice Smith |

alice@email.com |

Mouse |

25 |

Normalizzi separando clienti e ordini in due tabelle correlate:

- Customers(

Customer_ID,Name,Email) - Orders(

Order_ID,Customer_ID,Product,Price)

Questo evita dati cliente ridondanti, semplificando gli aggiornamenti.

Tuttavia, per la reportistica e l’analisi, la denormalizzazione può essere necessaria per ottimizzare le prestazioni delle query. Invece di eseguire più join tra tabelle, una tabella denormalizzata pre-aggregata può velocizzare le interrogazioni.

Sapere quando applicare ciascuna tecnica è importante!

💡 Dai un’occhiata al nostro tutorial approfondito sulla Normalization in SQL per capire come la normalizzazione migliora l’integrità dei dati e ottimizza le prestazioni.

Rendi il tuo modello a prova di futuro

Con l’evoluzione del business, evolvono anche i requisiti dei dati. Progettare un modello dati a prova di futuro significa crearne uno flessibile e scalabile, pronto a gestire nuove fonti dati ed esigenze in cambiamento.

Considerare la possibile crescita e i futuri avanzamenti tecnologici ti permette di prevedere e evitare costosi rifacimenti. Costruire fin dall’inizio per scalabilità, modularità e manutenibilità assicura che il modello possa adattarsi a scenari in evoluzione e continuare a generare valore nel tempo.

Esempio: pianificare la scalabilità in un database e-commerce

Immagina di progettare un database per un negozio online. Inizialmente tracci solo ordini domestici, ma in seguito ti espandi a livello globale. Se lo schema supporta una sola valuta, più avanti avrai bisogno di modifiche importanti.

- Al posto di una semplice colonna

Price, includi i campiCurrency_CodeeExchange_Rate. - Usa uno schema flessibile che consenta nuovi attributi senza dover ristrutturare il database.

Altri modi per rendere il tuo modello a prova di futuro:

- Usa UUID invece di ID auto-incrementali per la scalabilità nei sistemi distribuiti.

- Considera l’evoluzione dello schema nei database NoSQL, dove i documenti possono avere campi opzionali che cambiano nel tempo.

Garantisci qualità e coerenza dei dati

Un modello dati è valido solo quanto i dati che contiene. Implementare solide pratiche di data governance e validazione è fondamentale per mantenere qualità e coerenza in tutto il modello.

La validazione dei dati assicura che venga inserito il tipo corretto di dato e che rispetti regole specifiche, riducendo gli errori e migliorando l’affidabilità degli insight aziendali. Questo preserva l’integrità del modello dati e garantisce che i decisori possano fare affidamento sulle informazioni per ottenere insight accurati.

Esempio: usare la validazione dati per le schede prodotto

Descrizioni prodotto incoerenti in un negozio online possono causare errori nei report. Per evitarlo:

- Usa vincoli

CHECKper imporre valori consentiti (ad es.,Stock_Quantity >= 0). - Implementa chiavi esterne per garantire l’integrità referenziale.

- Automatizza la validazione dei dati con strumenti che intercettino le incoerenze prima che impattino la reportistica.

💡 Dai un’occhiata al mio tutorial su Great Expectations per imparare ad automatizzare la validazione dei dati con Python e garantire coerenza nelle tue pipeline.

Concentrati sui requisiti di business

Un modello dati ben progettato deve supportare direttamente gli obiettivi di business. Prima di creare lo schema, lavora a stretto contatto con gli stakeholder per definire:

- Quali insight servono?

- Come verranno accessi e aggiornati i dati?

- Quali compromessi sulle prestazioni sono accettabili?

Esempio: ottimizzare una dashboard retail per insight più rapidi

Un’azienda retail vuole monitorare le tendenze di vendita in tempo reale. Invece di usare uno schema completamente normalizzato con molte join, potresti progettare una tabella di reporting denormalizzata che pre-aggregi le vendite giornaliere, rendendo le query della dashboard molto più veloci.

Modello dati allineato al business:

- I dati in tempo reale sono archiviati in un sistema OLTP (Online Transaction Processing) per transazioni rapide.

- I report di vendita aggregati sono archiviati in un database OLAP (Online Analytical Processing) per l’analisi.

💡 Esplora la nostra guida OLTP vs. OLAP per capire quando ottimizzare per le transazioni rispetto alla reportistica.

Allineando il modello dati alle esigenze di business, eviti complessità non necessarie e garantisci agli stakeholder gli insight di cui hanno bisogno senza problemi di prestazioni.

Conclusione

Capire e applicare le giuste tecniche di data modeling è essenziale se vuoi strutturare, gestire e ottimizzare i dati in modo efficace. Come abbiamo visto, la scelta dell’approccio dipende dagli obiettivi di business, dalla complessità dei dati e dai requisiti del sistema.

Per approfondire il data modeling, il data warehousing e la progettazione di database, ti consiglio di esplorare queste risorse:

- The Data Warehouse Toolkit – Una guida fondamentale al modeling dimensionale di Ralph Kimball, con best practice per progettare data warehouse.

- Introduction to Data Modeling in Snowflake – Impara a progettare modelli dati scalabili in Snowflake.

- Data Warehousing Concepts – Comprendi i principi chiave del data warehousing, incluso il modeling dimensionale e i processi ETL.

- Database Design – Padroneggia le tecniche di strutturazione dei database per garantire efficienza, coerenza e scalabilità.