Leerpad

Het recente nieuws van OpenAI is vooral interessant voor gebruikers van GPT-5 mini: het nieuwe GPT-5.4 mini‑model is twee keer zo snel en levert betere prestaties over de hele linie. Daarnaast bracht OpenAI de nieuwste versie uit van hun meest efficiënte modelklasse, GPT-5.4 nano.

In dit artikel laten we je zien wat GPT-5.4 mini en nano zijn, hoe ze presteren in vergelijking met GPT-5.4, en wie kan profiteren van OpenAI’s nieuwste “fast lane”-modellen.

Bekijk ook zeker onze vergelijking van GPT-5.4 vs Claude Opus en onze gids voor OpenAI Frontier.

Wat is GPT-5.4 mini?

GPT-5.4 mini is OpenAI’s nieuwste kleine LLM en vervangt GPT-5 mini. Het brengt meerdere belangrijke verbeteringen ten opzichte van zijn voorganger, terwijl het twee keer zo snel is — een van de belangrijkste pluspunten.

In de API ondersteunt het een breed scala aan functies:

- Tekst- en beeldinvoer

- Toolgebruik en functieaanroepen

- Zoeken op het web

- Computerbediening

- Skills

Wat is GPT-5.4 nano?

GPT-5.4 nano is de kleinste versie van OpenAI’s nieuwste modellijn en vervangt GPT-5 nano. Zoals de naam al doet vermoeden, is het nog efficiënter dan het mini‑model, met lagere prestaties. Toch verslaat GPT-5.4 nano het oude minimodel, GPT-5 mini, in veel benchmarks.

Het ondersteunt niet zoveel functies als het mini‑model, maar biedt wel de huidige standaard API‑functies zoals beeldinvoer, toolgebruik, functieaanroepen en gestructureerde output.

Voor wie zijn GPT-5.4 mini en nano echt bedoeld?

De nieuwe release biedt flexibiliteit bij het kiezen van het juiste model, gezien de klassieke afweging tussen prestaties aan de ene kant en latency en prijs aan de andere.

OpenAI raadt mini en nano aan voor ontwikkelaars die werken aan applicaties waarbij je geen vertraging wilt. Kortom: dingen die responsief moeten aanvoelen, waar gebruikers weinig tolerant zijn voor wachttijd.

Voor taken met veel redenering en weinig foutmarge, multimodaliteit en agentische taken blijft GPT-5.4 de eerste keuze.

GPT-5.4 mini en nano‑benchmarks

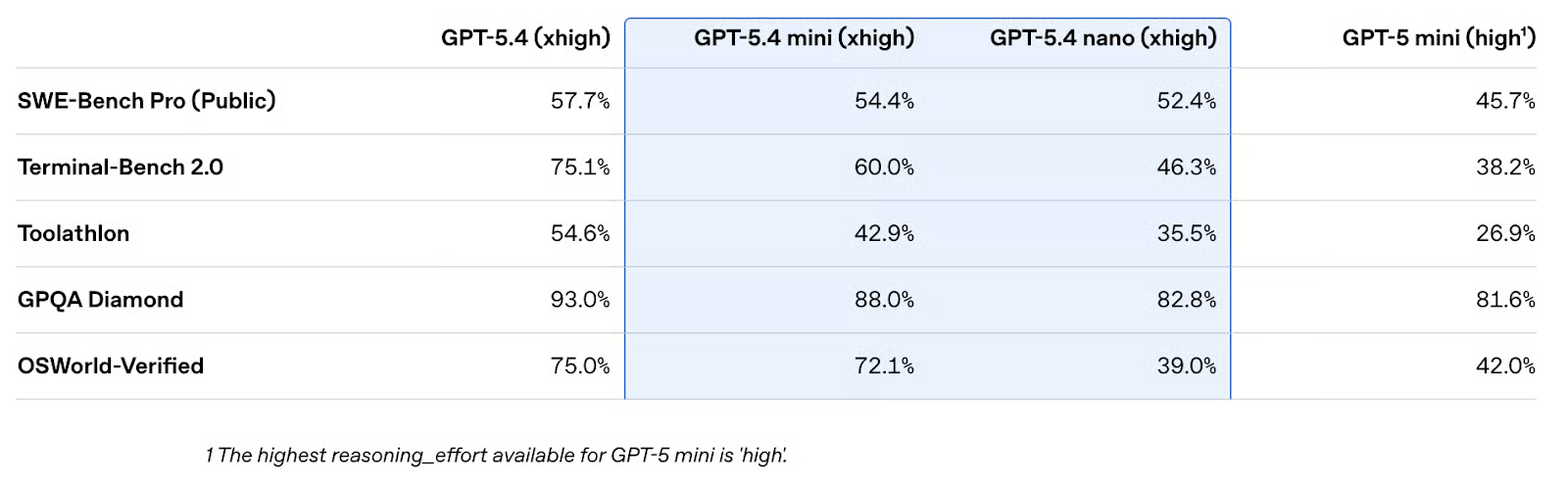

Laten we eens kijken naar de LLM-benchmarks. Sommige opvallende resultaten:

- Coding: Zowel 5.4 mini (54,4%) als nano (52,4%) halen een SWE‑Bench Pro‑score van boven de 50% en blijven niet veel achter op GPT-5.4. De verbetering ten opzichte van GPT-5 mini (45,7%) is aanzienlijk.

- Terminal‑agents: In Terminal‑Bench 2.0 wordt het verschil tussen de drie varianten van 5.4‑modellen echt zichtbaar. GPT-5.4 mini (60,0%) kan concurreren met eerdere vlaggenschepen, zoals GPT 5.2 (62,2%), en 5.4 nano (46,3%) met GPT-5 (49,6%), maar ze blijven ver achter bij de topprestaties van GPT-5.4.

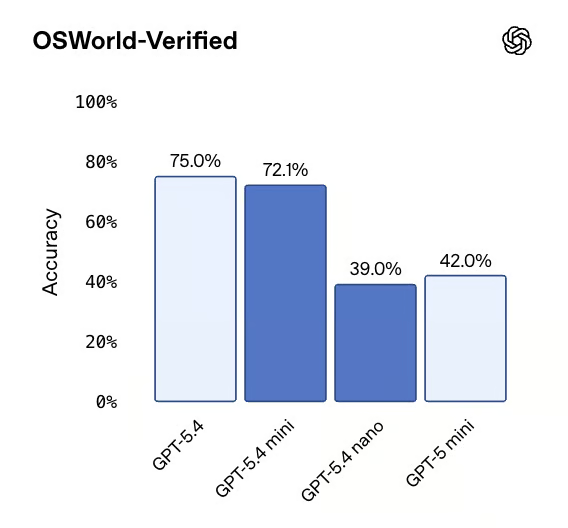

- Computergebruik: Hoewel GPT-5.4 mini een indrukwekkende 72,1% behaalt in OSWorld‑Verified, vlak achter GPT-5.4, blijft GPT-5.4 nano duidelijk achter (39,0%). Het is duidelijk dat dit model niet is gemaakt voor taken op het gebied van computergebruik.

Wat ons meteen ook opviel, was dat de volgorde van de benchmarkscores in (bijna) alle categorieën hetzelfde was: GPT-5.4 > GPT-5.4 mini > GPT-5.4 nano > GPT-5 mini. In alle gepubliceerde scores was de enige uitzondering dat het oude minimodel GPT-5.4 nano versloeg in de domeinen vision en computergebruik, wat niet de focusgebieden van nano zijn.

Het is echter onduidelijk hoeveel verschil het nieuwe “xhigh”-niveau voor redeneerinspanning maakt, dat niet beschikbaar was voor GPT-5 mini.

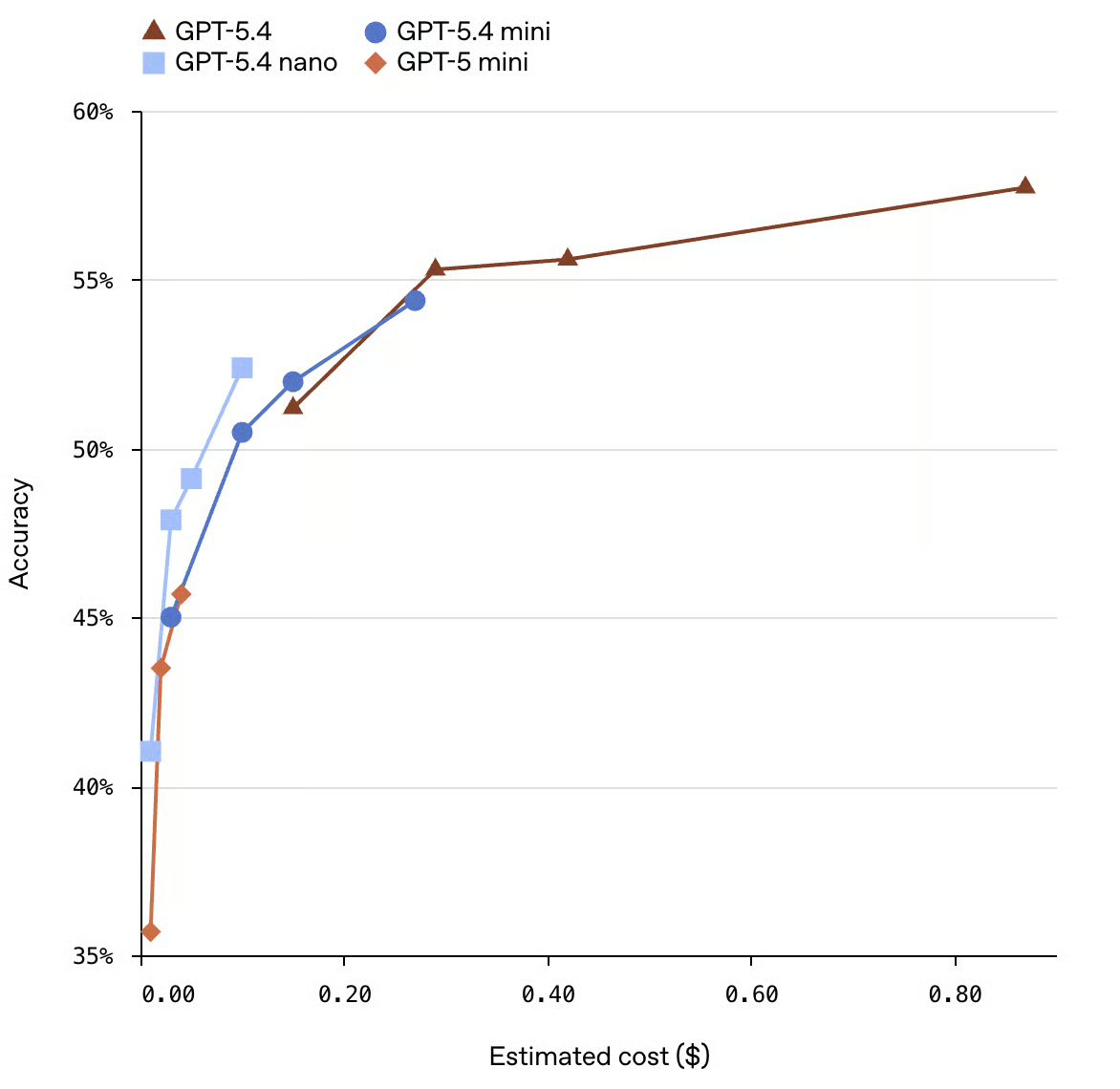

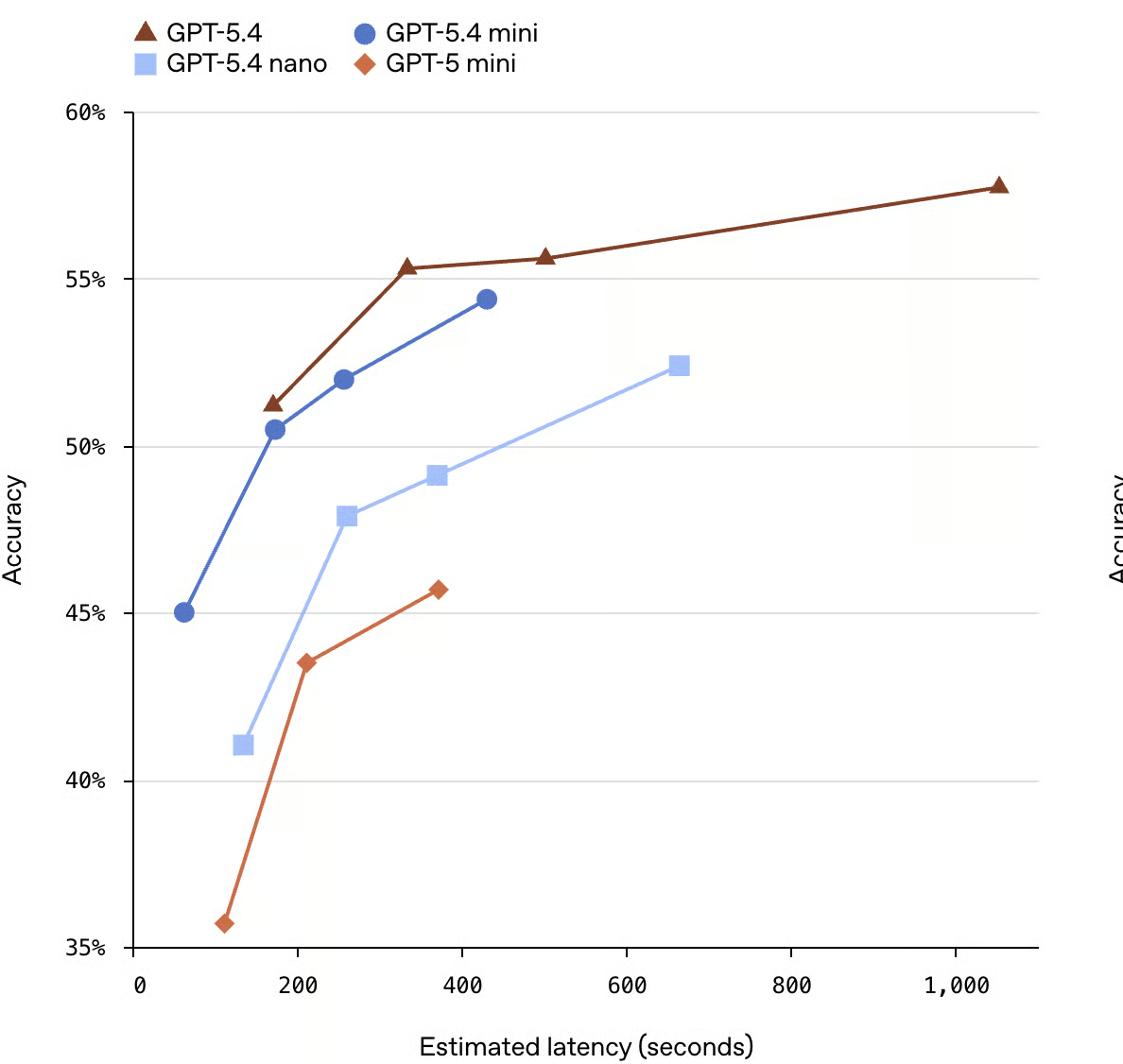

Maar natuurlijk is prestatie niet alles. OpenAI wil een punt maken over afnemende meeropbrengsten, zoals te zien is in de grafieken die ze hebben gedeeld. Van de vier vergeleken modellen is GPT-5.4 de traagste en duurste.

De krommen illustreren afnemende meeropbrengsten: je kunt meer rekenkracht/geld tegen een model aangooien en bescheiden nauwkeurigheidswinsten behalen, maar de sprongen worden kleiner. De laatste paar procentpunten van GPT-5.4 kosten veel meer dan de eerste. Dit soort grafiek helpt engineers bepalen of die extra 3–4% nauwkeurigheid de kosten waard is in hun specifieke toepassing.

We voelen wel de noodzaak de grafiek kritisch te bekijken: de Y‑as begint op 35%, niet op 0%. Dat vergroot de visuele verschillen tussen modellen echt. De voorsprong van GPT-5.4 op GPT-5 mini lijkt groter op de grafiek die bij 35% begint dan wanneer de grafiek bij nul zou beginnen.

Ook wijst OpenAI erop dat deze latency‑cijfers niet uit echte productie‑runs komen; het zijn gemodelleerde schattingen. Dat is een beetje incongruent. OpenAI doet veel suggesties over infrastructuurbeslissingen, en hun grafiek bevat alleen modelschattingen.

We vinden het ook vreemd om naar modelschattingen te kijken zonder foutmarges. Ik durf te wedden dat de foutbalken veel zouden overlappen als OpenAI ervoor had gekozen die op te nemen.

Hoe krijg je toegang tot GPT-5.4 mini en nano

Je zou GPT‑5.4 mini al moeten kunnen vinden in de ChatGPT‑browserinterface, Codex en in de API. In ChatGPT is het het standaard “Thinking”-model voor gebruikers in de Free- en Go‑tiers, en het fallback‑model voor alle andere gebruikers die hun GPT-5.4 Thinking‑rate‑limit hebben bereikt.

GPT‑5.4 nano is echter alleen beschikbaar via de API.

Prijzen van GPT-5.4 mini en nano

GPT-5.4 mini kost $0,75 per 1M inputtokens en $4,50 per 1M outputtokens. GPT‑5.4 nano, dat opnieuw alleen in de API beschikbaar is, kost $0,20 per 1M inputtokens en $1,25 per 1M outputtokens. Voor die prijzen krijg je een contextvenster van 400k.

Dat is uiteraard veel goedkoper dan het vlaggenschipmodel van OpenAI ($2,50/$15 per 1M input/output).

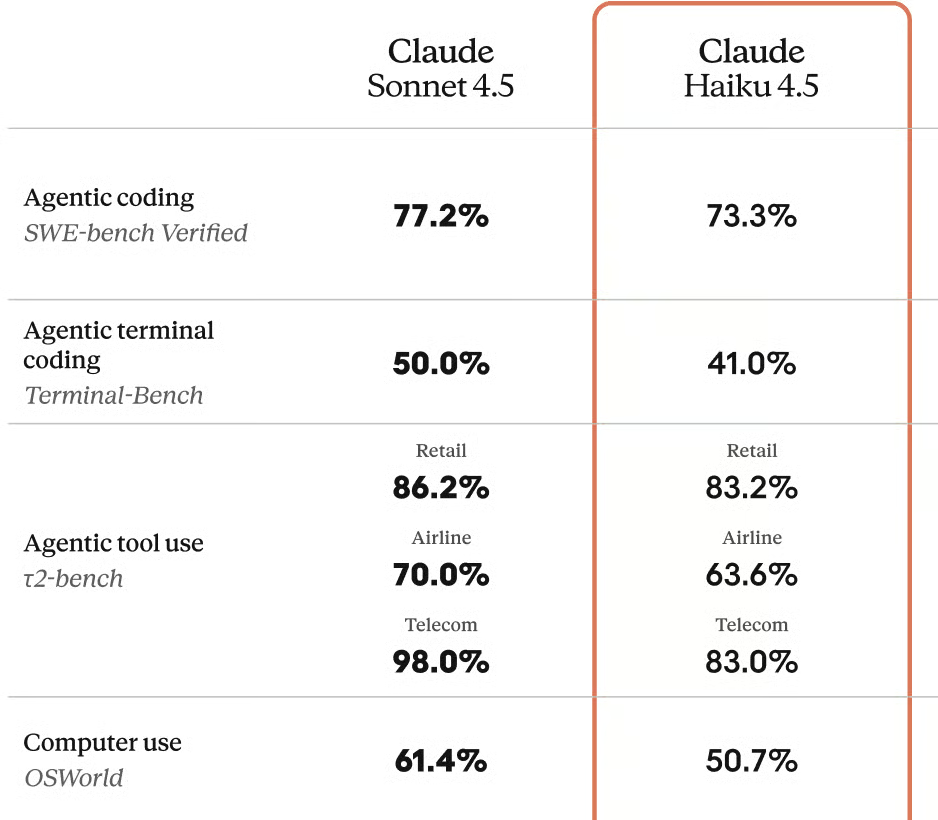

GPT-5.4 mini en nano vs. Claude Haiku 4.5

Wat echt interessant is, is dat GPT-5.4 nano lager is geprijsd dan veel lager presterende kleine modellen van concurrenten, met name Claude Haiku 4.5, dat $1 per miljoen inputtokens en $5 per miljoen outputtokens kost. OpenAI heeft de prijs van Claude Haiku in beide gevallen onderboden.

Maar hoe verhouden de modellen zich in de tests? Vergelijken is lastig omdat ze op verschillende testvarianten zijn beoordeeld. De SWE‑bench‑resultaten zijn totaal niet vergelijkbaar omdat ze geheel verschillende versies gebruiken. Claude Haiku 4.5 is getest op SWE‑bench Verified en scoorde 73,3%, en GPT-5.4 nano is getest op SWE‑bench Pro (Public) en scoorde 52,4%. Pro is de moeilijkere en recentere test.

Claude Haiku 4.5‑score van 50,7% op OSWorld

Bij de twee schoonste appels‑met‑appels‑vergelijkingen ligt GPT-5.4 nano op beide voor.

- Bij GPQA Diamond scoort GPT-5.4 nano 9,8% hoger, en

- bij τ2‑bench Telecom scoort GPT-5.4 nano 9,5% hoger.

Haiku 4.5 kan echter een voorsprong hebben op OSWorld computergebruik, al maken de benchmarkvarianten de vergelijking opnieuw lastig.

- Claude Haiku 4.5 is getest op standaard OSWorld en scoorde 50,7%

- GPT-5.4 nano is getest op OSWorld‑Verified en scoorde 39,0%.

OSWorld‑Verified is de moeilijkere test, maar het gat van bijna 12% oogt behoorlijk significant. We zijn voorzichtiger met het wegwuiven van dit gat, omdat er — in tegenstelling tot SWE‑bench Verified en SWE‑bench Pro, waar bekend is dat modellen die goed scoren op Verified vaak slechter presteren op Pro — minder bewijs is dat hetzelfde verhaal geldt voor OSWorld en OSWorld‑Verified.

GPT-5.4 nano‑score van 39% op OSWorld‑Verified

Wat mensen zeggen over GPT-5.4 mini en nano

Veel online reacties wezen op een bekend patroon in tech: het vlaggenschip van vorig jaar wordt de gratis tier van volgend jaar. Dat is allemaal te verwachten, maar het tempo van verandering is verbluffend.

Mensen zeggen dat frontier‑AI de snelste waardedaling kent van elk product ooit gebouwd. Men vraagt zich af of het model waarvoor je vandaag een premium betaalt over zes maanden nog steeds de moeite waard voelt. Soms willen ontwikkelaars niet zomaar een model omwisselen als ze een fine‑tuningproces hebben doorlopen of kosten‑ en prestatie‑afstemmingen hebben gedaan.

Conclusie

De benchmarks laten een duidelijke prestatieladder zien van GPT-5.4 via 5.4 mini naar 5.4 nano. Maar voor veel taken hangt de praktische keuze meer af van latency en budget dan van het uitpersen van een paar extra procentpunten.

Voor veel productie‑apps kan GPT-5.4 mini een uitstekende nieuwe standaard zijn, omdat de kwaliteit genoeg “frontier” aanvoelt, terwijl het goedkoop en snel genoeg is voor grootschalig gebruik.

GPT-5.4 nano is meer een specialist voor grote realtime‑workloads die zeer latency‑gevoelig zijn. Het is ook ideaal voor sub‑agents om het eenvoudigere “massa”‑werk te doen, gedelegeerd door beter presterende Thinking‑modellen.

In een wereld waar het vlaggenschip van vorig jaar dit jaar “mini” wordt, is het ontwerpen van systemen die modellen eenvoudig kunnen wisselen de betere keuze boven optimaliseren voor losse modelreleases. Ik raad onze cursus Building Scalable Agentic Systems aan, die deze vraag behandelt en je leert werken met agentische frameworks zoals het Model Context Protocol (MCP).

GPT-5.4 mini en nano: veelgestelde vragen

Is GPT‑5.4 mini gewoon een snellere GPT‑5 mini?

Nee, het is zowel sneller als aanzienlijk sterker op benchmarks zoals SWE‑Bench Pro, met behoud van een contextvenster van 400k.

Wat is de belangrijkste trade‑off tussen GPT‑5.4 en 5.4 mini?

GPT‑5.4 is nog steeds het beste voor maximale kwaliteit; 5.4 mini levert een beetje nauwkeurigheid in voor veel betere latency en kosten.

Wanneer moet ik GPT‑5.4 nano gebruiken in plaats van mini?

Gebruik nano voor ultragevoelige latency of zeer grootschalige workloads waarbij kosten en snelheid belangrijker zijn dan topnauwkeurigheid.

Ondersteunen GPT-5.4 mini en nano tools en afbeeldingen?

Ja, beide ondersteunen beeldinvoer, toolgebruik, functieaanroepen en gestructureerde output in de API.

Zijn GPT-5.4 mini en nano goed genoeg voor coding en agents?

Ja. Vooral 5.4 mini haalt meer dan 50% op SWE‑Bench Pro en competitieve scores op Terminal‑Bench 2.0, waardoor het sterk is voor code en terminal‑agents.

5.4 nano is zwakker maar nog steeds capabel genoeg voor veel ondersteunende taken, zoals het routeren van verzoeken, optreden als goedkope sub‑agent, en het afhandelen van eenvoudige terminal‑workflows waar snelheid en kosten het belangrijkst zijn.

Ik ben een schrijver en editor op het gebied van data science en heb bijgedragen aan onderzoeksartikelen in wetenschappelijke tijdschriften. Ik ben vooral geïnteresseerd in lineaire algebra, statistiek, R en dergelijke. Ik speel ook best wat schaak!

Tom is data scientist en technisch docent. Hij schrijft en beheert de data science-tutorials en blogposts van DataCamp. Eerder werkte Tom in data science bij Deutsche Telekom.