Lernpfad

Die neuesten Nachrichten von OpenAI sind besonders spannend für Nutzer von GPT-5 mini: Das neue Modell GPT-5.4 mini ist doppelt so schnell und liefert in allen Bereichen bessere Ergebnisse. Zusätzlich hat OpenAI die neueste Version seiner effizientesten Modellklasse veröffentlicht: GPT-5.4 nano.

In diesem Artikel zeigen wir dir, was GPT-5.4 mini und nano sind, wie sie im Vergleich zu GPT-5.4 abschneiden und wer von OpenAIs neuen „Fast-Lane“-Modellen profitiert.

Sieh dir auch unseren Vergleich GPT-5.4 vs Claude Opus und unseren Guide zu OpenAI Frontier an.

Was ist GPT-5.4 mini?

GPT-5.4 mini ist OpenAIs neuestes kleines LLM und ersetzt GPT-5 mini. Es bringt deutliche Leistungsverbesserungen gegenüber seinem Vorgänger – und ist dabei doppelt so schnell. Genau das ist einer der wichtigsten Pluspunkte.

In der API unterstützt es eine breite Palette an Funktionen:

- Text- und Bildeingaben

- Toolnutzung und Function Calling

- Websuche

- Computersteuerung

- Skills

Was ist GPT-5.4 nano?

GPT-5.4 nano ist die kleinste Ausführung der neuen Modellreihe von OpenAI und ersetzt GPT-5 nano. Wie der Name vermuten lässt, ist es noch effizienter als das mini‑Modell, bei geringerer Leistung. Dennoch übertrifft GPT-5.4 nano das alte mini‑Modell, GPT-5 mini, in vielen Benchmarks.

Es unterstützt nicht ganz so viele Features wie das mini‑Modell, bietet aber die heute üblichen API‑Funktionen wie Bildeingabe, Toolnutzung, Function Calling und strukturierte Ausgaben.

Für wen sind GPT-5.4 mini und nano wirklich gedacht?

Das Release schafft mehr Spielraum bei der Modellwahl – klassisch zwischen Leistung auf der einen und Latenz sowie Preis auf der anderen Seite.

OpenAI empfiehlt mini und nano für Anwendungen, in denen Verzögerungen tabu sind. Also alles, was sich reaktiv anfühlen muss, wo Nutzer wenig Geduld für Wartezeiten haben.

Für anspruchsvolle Reasoning‑Aufgaben mit wenig Fehlertoleranz, Multimodalität und agentische Workloads bleibt GPT-5.4 die erste Wahl.

Benchmarks von GPT-5.4 mini und nano

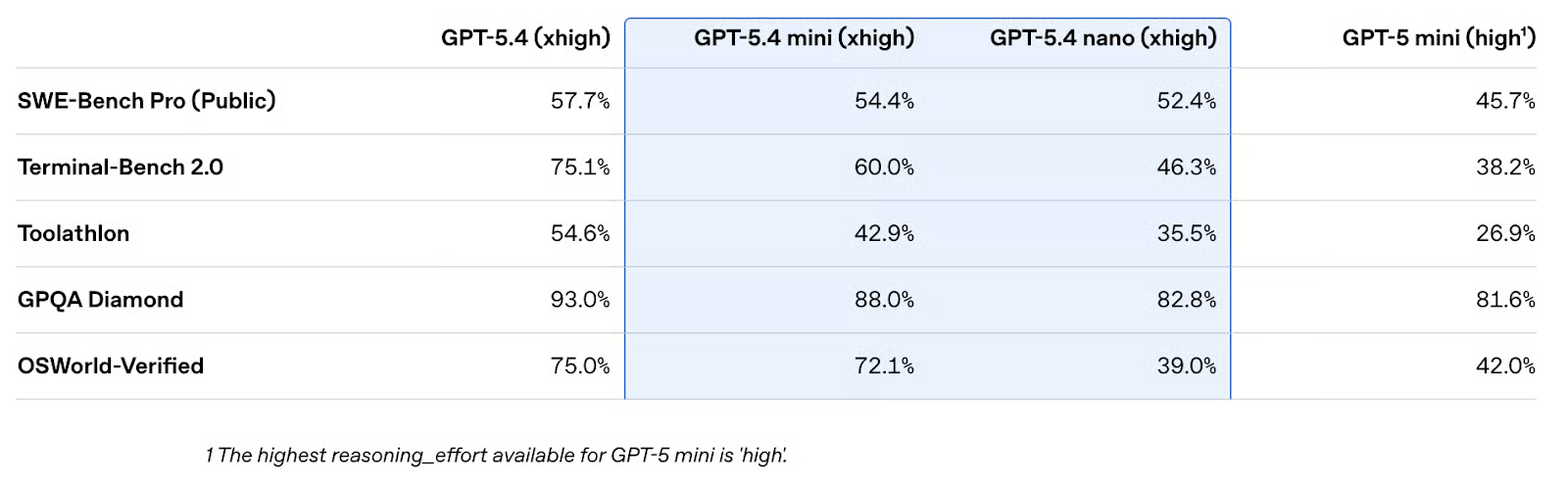

Schauen wir uns die LLM‑Benchmarks an. Einige auffällige Ergebnisse:

- Coding: Sowohl 5.4 mini (54,4%) als auch nano (52,4%) erreichen im SWE‑Bench Pro über 50% und liegen damit nicht weit hinter GPT-5.4. Der Fortschritt gegenüber GPT-5 mini (45,7%) ist deutlich.

- Terminal‑Agents: In Terminal‑Bench 2.0 zeigt sich der Abstand zwischen den drei 5.4‑Varianten klar. GPT-5.4 mini (60,0%) kann mit früheren Flaggschiffmodellen wie GPT 5.2 (62,2%) mithalten, und 5.4 nano (46,3%) mit GPT-5 (49,6%), beide aber deutlich hinter der Top‑Performance von GPT-5.4.

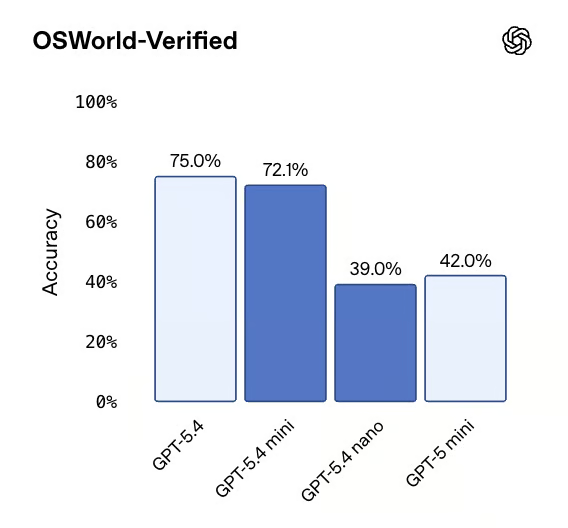

- Computersteuerung: Während GPT-5.4 mini in OSWorld‑Verified beeindruckende 72,1% erzielt und damit dicht hinter GPT-5.4 liegt, hinkt GPT-5.4 nano klar hinterher (39,0%). Man sieht: Es ist nicht für Computersteuerungs‑Tasks ausgelegt.

Auffällig ist außerdem, dass die Rangfolge der Benchmarks (fast) überall identisch ist: GPT-5.4 > GPT-5.4 mini > GPT-5.4 nano > GPT-5 mini. Einzige Ausnahme über alle veröffentlichten Scores: Das alte mini‑Modell lag im Bereich Vision und Computersteuerung vor GPT-5.4 nano – Bereiche, die nicht zum nano‑Sweet‑Spot gehören.

Unklar bleibt, wie groß der Effekt der neuen Reasoning‑Stufe „xhigh“ ist, die es für GPT-5 mini noch nicht gab.

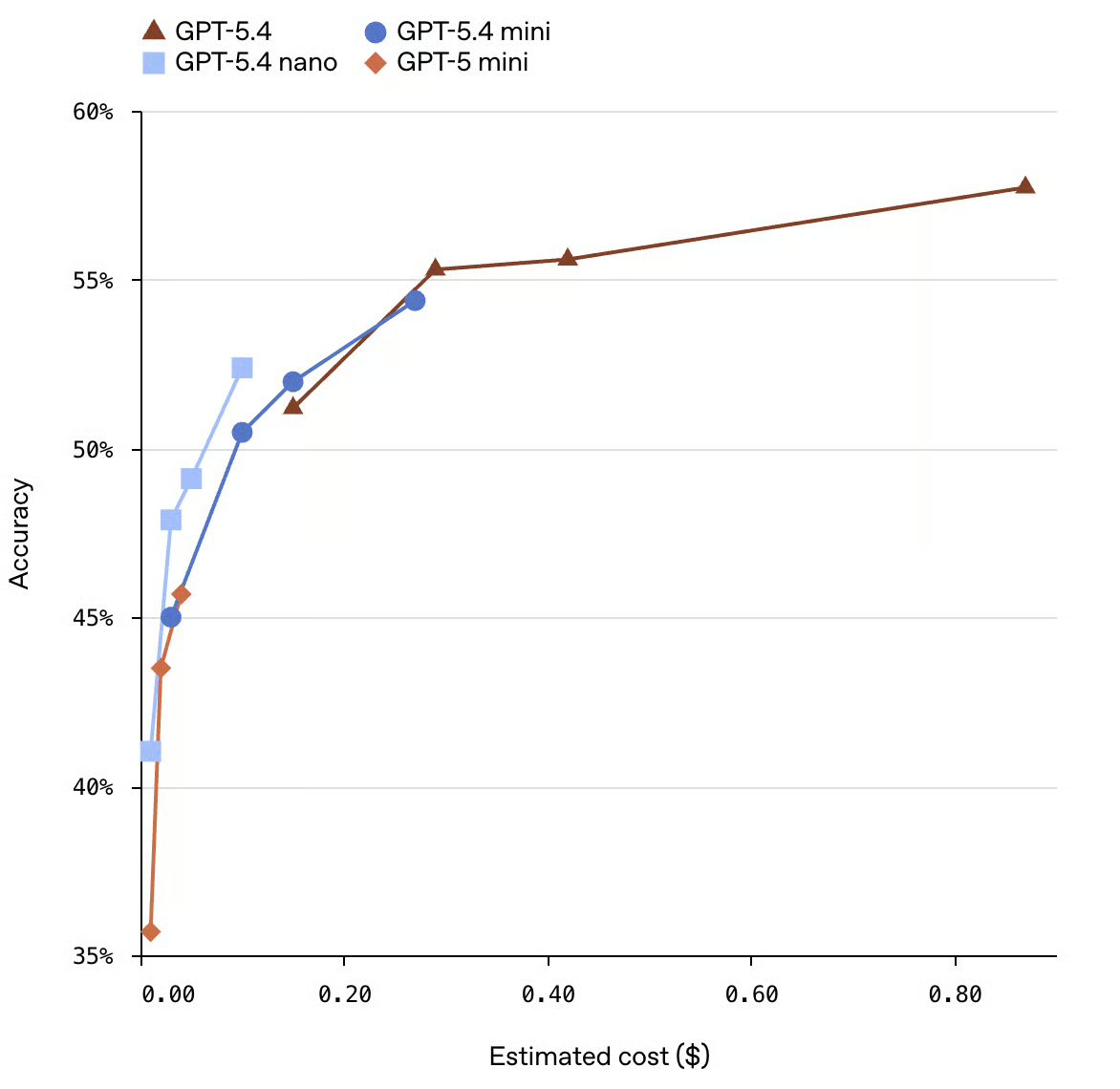

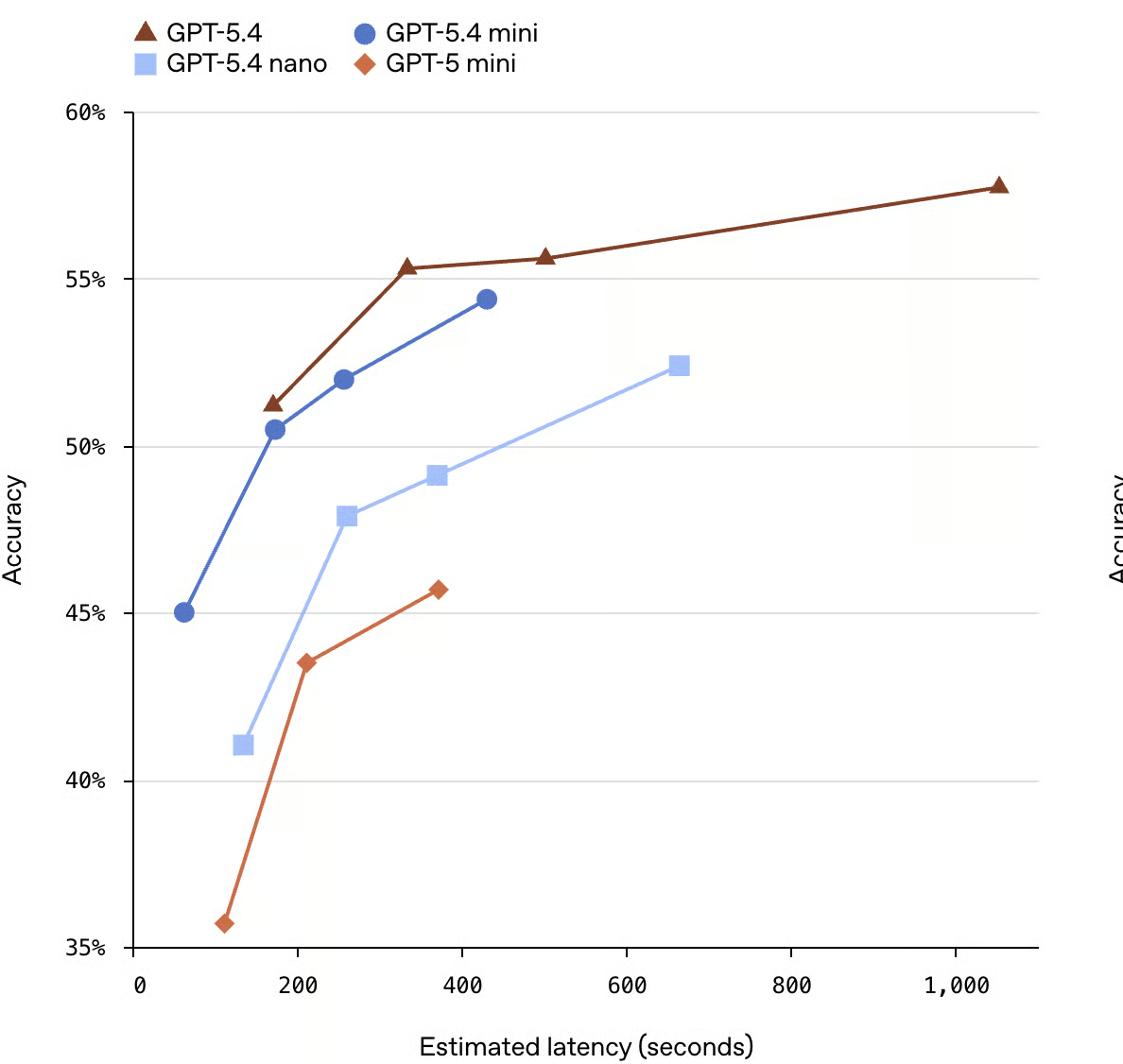

Leistung ist allerdings nicht alles. OpenAI betont das Prinzip abnehmender Grenzerträge – gut sichtbar in den bereitgestellten Grafiken. Von den vier verglichenen Modellen ist GPT-5.4 das langsamste und teuerste.

Die Kurven zeigen die abnehmenden Erträge: Du kannst mehr Rechenleistung/Geld investieren und bekommst noch Genauigkeitsgewinne, aber immer kleinere. Die letzten Prozentpunkte bei GPT-5.4 kosten deutlich mehr als die ersten. Solche Charts helfen Engineers abzuwägen, ob die zusätzlichen 3–4% Genauigkeit den Aufpreis für die jeweilige Anwendung rechtfertigen.

Trotzdem drängt sich eine kritische Einordnung auf: Die Y‑Achse startet bei 35% statt bei 0%. Das überzeichnet die visuellen Unterschiede zwischen den Modellen. Der Vorsprung von GPT-5.4 gegenüber GPT-5 mini wirkt in einer bei 35% startenden Grafik größer, als er bei einer Achse ab Null aussähe.

Außerdem weist OpenAI darauf hin, dass diese Latenzwerte keine produktiven Messwerte sind, sondern modellierte Schätzungen. Das wirkt etwas widersprüchlich: OpenAI gibt viele Hinweise für Infrastrukturentscheidungen, zeigt in der Grafik aber nur Modellschätzungen.

Auch seltsam: Modellschätzungen ohne Fehlerspannen darzustellen. Ich würde wetten, dass sich die Fehlerbalken stark überlappt hätten, wenn OpenAI sie gezeigt hätte.

So greifst du auf GPT-5.4 mini und nano zu

GPT‑5.4 mini solltest du bereits in der ChatGPT‑Browseroberfläche, in Codex und in der API finden. In ChatGPT ist es das Standard‑„Thinking“-Modell für Nutzer der Free‑ und Go‑Stufen sowie das Fallback‑Modell für alle anderen, die ihr GPT-5.4‑Thinking‑Kontingent ausgeschöpft haben.

GPT‑5.4 nano ist hingegen nur über die API verfügbar.

Preise für GPT-5.4 mini und nano

GPT-5.4 mini kostet 0,75 $ pro 1 M Eingabetokens und 4,50 $ pro 1 M Ausgabetokens. GPT‑5.4 nano, das wie gesagt nur in der API verfügbar ist, kostet 0,20 $ pro 1 M Eingabetokens und 1,25 $ pro 1 M Ausgabetokens. Dafür bekommst du ein Kontextfenster von 400k.

Das ist natürlich deutlich günstiger als das Flaggschiffmodell von OpenAI (2,50 $/15 $ pro 1 M Input/Output).

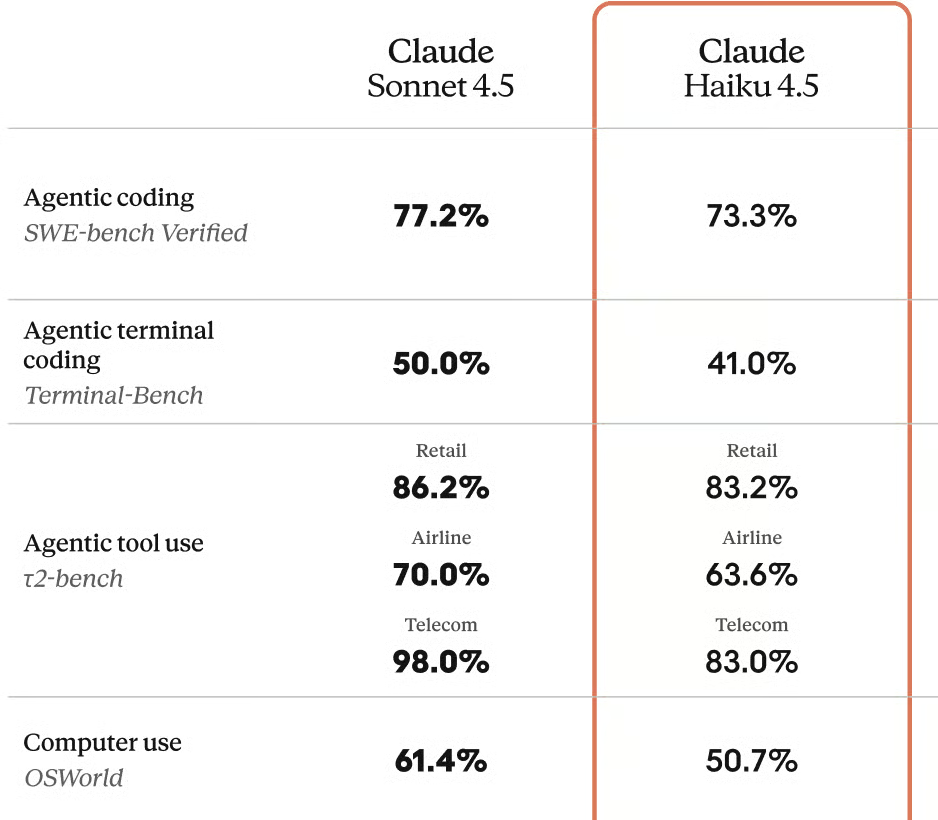

GPT-5.4 mini und nano vs. Claude Haiku 4.5

Spannend ist, dass GPT-5.4 nano günstiger ist als viele leistungsschwächere Small‑Modelle von Wettbewerbern, insbesondere Claude Haiku 4.5, das 1 $ pro Million Eingabetokens und 5 $ pro Million Ausgabetokens kostet. OpenAI unterbietet Haiku also in beiden Fällen.

Doch wie schneiden die Modelle in Tests ab? Der Vergleich ist nicht ganz trivial, weil sie auf unterschiedlichen Testvarianten evaluiert wurden. Die SWE‑bench‑Ergebnisse sind gar nicht vergleichbar, da komplett unterschiedliche Versionen genutzt wurden. Claude Haiku 4.5 wurde auf SWE‑bench Verified getestet und erreichte 73,3%, GPT-5.4 nano auf SWE‑bench Pro (Public) mit 52,4%. Pro ist der härtere und neuere Test.

Claude Haiku 4.5 mit 50,7% auf OSWorld

In den zwei saubersten 1:1‑Vergleichen liegt GPT-5.4 nano jeweils vorn.

- Bei GPQA Diamond erzielt GPT-5.4 nano 9,8% mehr, und

- bei τ2‑bench Telecom liegt GPT-5.4 nano 9,5% vorn.

Allerdings könnte Haiku 4.5 bei der Computersteuerung in OSWorld die Nase vorn haben – wobei die unterschiedlichen Bench‑Varianten den Vergleich erschweren.

- Claude Haiku 4.5 wurde auf dem Standard‑OSWorld getestet und erreichte 50,7%.

- GPT-5.4 nano wurde auf OSWorld‑Verified getestet und kam auf 39,0%.

OSWorld‑Verified ist der schwierigere Test, dennoch wirkt die Lücke von fast 12% beachtlich. Wir sind vorsichtig damit, diese Differenz einfach abzutun, denn anders als bei SWE‑bench Verified vs. SWE‑bench Pro, wo bekannt ist, dass Modelle auf Verified oft deutlich besser abschneiden als auf Pro, gibt es weniger Evidenz, dass dieselbe Dynamik auch für OSWorld vs. OSWorld‑Verified gilt.

GPT-5.4 nano mit 39% auf OSWorld‑Verified

Was die Community über GPT-5.4 mini und nano sagt

Viele Reaktionen im Netz verweisen auf ein bekanntes Tech‑Muster: Das letztjährige Flaggschiff wird zum diesjährigen Free‑Tier. Erwartbar – aber das Tempo ist bemerkenswert.

Es heißt, Frontier‑KI verliere schneller an Wert als jedes andere Produkt zuvor. Viele fragen sich, ob sich das heutige Premium‑Modell in sechs Monaten noch „lohnt“. Manchmal wollen Entwickler nicht einfach das Modell tauschen, wenn sie Feintuning betrieben oder Kosten‑/Leistungsparameter sorgfältig kalibriert haben.

Fazit

Die Benchmarks zeigen eine klare Leistungstritte: von GPT-5.4 über 5.4 mini bis 5.4 nano. Für viele Anwendungsfälle entscheidet aber vor allem Latenz und Budget – nicht das letzte Prozent Genauigkeit.

Für viele produktive Apps kann GPT-5.4 mini ein starker neuer Standard sein: Die Qualität fühlt sich frontier an, gleichzeitig ist es günstig und schnell genug für hohes Volumen.

GPT-5.4 nano ist eher der Spezialist für große Echtzeit‑Workloads mit hoher Latenzempfindlichkeit. Es eignet sich auch hervorragend als Sub‑Agent, der einfachere „Massenarbeit“ übernimmt, delegiert von leistungsstärkeren Thinking‑Modellen.

In einer Welt, in der das letztjährige Flaggschiff dieses Jahr zur „mini“‑Variante wird, ist es klüger, Systeme so zu bauen, dass sich Modelle leicht austauschen lassen – statt auf einzelne Releases zu optimieren. Empfohlen: Unser Kurs Building Scalable Agentic Systems, der genau das behandelt und zeigt, wie du agentische Frameworks wie das Model Context Protocol (MCP) nutzt.

GPT-5.4 mini und nano: FAQs

Ist GPT‑5.4 mini nur ein schnelleres GPT‑5 mini?

Nein. Es ist sowohl schneller als auch deutlich stärker in Benchmarks wie SWE‑Bench Pro – bei gleichbleibendem 400k‑Kontextfenster.

Was ist der Haupt-Trade-off zwischen GPT‑5.4 und 5.4 mini?

GPT‑5.4 bleibt die beste Wahl für maximale Qualität; 5.4 mini tauscht etwas Genauigkeit gegen deutlich bessere Latenz und Kosten.

Wann sollte ich GPT‑5.4 nano statt mini verwenden?

Nutze nano für ultra‑latenzempfindliche oder sehr hochvolumige Workloads, bei denen Kosten und Geschwindigkeit wichtiger sind als Top‑Genauigkeit.

Unterstützen GPT-5.4 mini und nano Tools und Bilder?

Ja. Beide unterstützen in der API Bildeingabe, Toolnutzung, Function Calling und strukturierte Ausgaben.

Sind GPT-5.4 mini und nano gut genug für Coding und Agents?

Ja. Vor allem 5.4 mini erreicht über 50% im SWE‑Bench Pro und konkurrenzfähige Werte im Terminal‑Bench 2.0 – stark für Code‑ und Terminal‑Agents.

5.4 nano ist schwächer, aber für viele unterstützende Aufgaben ausreichend – etwa für Request‑Routing, als günstiger Sub‑Agent und für einfache Terminal‑Workflows, bei denen es vor allem auf Tempo und Kosten ankommt.

Datenwissenschaftsredakteur bei DataCamp | Prognosen erstellen und mit APIs arbeiten ist genau mein Ding.